自己总结材料地Kettle使用方法和成果

自己总结的Kettle使用方法和成果

KETTLE使用自己总结的Kettle使用方法和成果说明简介Kettle是一款国外开源的ETL工具,纯java编写,可以在Window、Linux、Unix 上运行,绿色无需安装,数据抽取高效稳定。

Kettle 中文名称叫水壶,该项目的主程序员MATT 希望把各种数据放到一个壶里,然后以一种指定的格式流出.Kettle这个ETL工具集,它允许你管理来自不同数据库的数据,通过提供一个图形化的用户环境来描述你想做什么,而不是你想怎么做.Kettle中有两种脚本文件,transformation和job,transformation完成针对数据的基础转换,job则完成整个工作流的控制。

Kettle可以在http://kettle。

pentaho。

org/网站下载到。

注:ETL,是英文Extract—Transform—Load 的缩写,用来描述将数据从来源端经过萃取(extract)、转置(transform)、加载(load)至目的端的过程.ETL一词较常用在数据仓库,但其对象并不限于数据仓库。

下载和安装首先,需要下载开源免费的pdi-ce软件压缩包,当前最新版本为5.20。

0。

下载网址:/projects/pentaho/files/Data%20Integration/然后,解压下载的软件压缩包:pdi—ce—5。

2.0.0—209.zip,解压后会在当前目录下上传一个目录,名为data—integration。

由于Kettle是使用Java开发的,所以系统环境需要安装并且配置好JDK。

žKettle可以在http:///网站下载ž下载kettle压缩包,因kettle为绿色软件,解压缩到任意本地路径即可。

运行Kettle进入到Kettle目录,如果Kettle部署在windows环境下,双击运行spoon.bat或Kettle.exe文件.Linux用户需要运行spoon。

sh文件,进入到Shell提示行窗口,进入到解压目录中执行下面的命令:# chmod +x spoon。

kettle使用总结

Kettle使用笔记一、基本概念:1.1、资源库保存kettle脚本或转换、存放数据库连接的地方,可以建立多个数据库连接,使用时就无需每次重复建立1.2、数据库连接(db links)连接数据库的功能,需处理数据库中的数据时创建,可连接Oracle、SqlServer、MySQL、DB2等1.3、转换(trans)处理数据的ETL过程,里面存放许多处理数据的组件,完成后保存会生成一个ktl文件。

1.4、作业(job)自动、定时执行转换的步骤的名称,可以在自动执行转换的过程添加参数进行控制。

1.5、步骤(steps)转换和作用的每个操作都是一个步骤。

二、工具栏:2.1、资源库概念保存kettle脚本或转换的地方,相当于myeclipes的workspace,另一种保存kettle脚本或流程的方法是需要保存的时候用文件保存,点击另存为出现(PS:打开kettle的时候加载的也是资源库)2.2、资源库位置Tools -> 数据库-> 连接数据库2.3、数据库连接创建数据库连接的时候会同时创建数据库连接?右键点击新建转换-> 点击主对象树-> 右键DB连接->新建数据库连接(PS:创建数据库后可以点击Test 判断数据库连接创建成功了没!,Oracle RAC 环境下的数据库连接创建数据库连接的方法不同)三、基本操作:3.1、轮流发送模式和复制发送模式的区别如果获取的数据必须同时进行多步处理(一种方式是将数据复制后处理,一种是获取的数据进行轮流的间隔处理),设置方式为:选中Data Grid –> 点击右键–> 数据发送-> 选择轮流发送模式或复制发送模式下图为复制处理的方式:红框选中的标签为复制处理3.2、分离步骤的方法比如下图中分离出步骤”删除”的方法:选中”删除”->点击右键-> 点击分离步骤3.3、过滤错误数据的方法采集的数据保存到数据库的时候如果有错误就,整个ETL处理流程就会停止,可以用过滤错误的方法将错误的数据写到文本中,保证ETL流程继续执行步骤:在连接”表输出”和“文本文件输出2”的时候选择”Error Handing of step”效果如下图(PS:可以明确是哪个字段,那条数据出现的错误)3.4、查询步骤中数据详情的方法比如查看下图中”表输出”步骤的数据情况的步骤:选中”表输出” -> 点击右键-> 选择显示输入\输出字段四、转换组件介绍:4.1、核心对象-输入目录下组件4.1.1、表输入组件及属性4.1.1.1允许延迟转换像Oracled的BLOB类型字段,需要的时候开始不加载这些数据,最后输出的时候才进行4.1.1.2 替换SQL语句里的变量(只在Job里面应用)配置需注意的地方:1、SQL语句的条件必须用${}符合关联起来2、替换SQL语句里的变量必须勾选3、Job中的参数组件的设置及转换必须指明是哪个转换4.1.1.3 从步骤插入数据配置需注意的地方:1、从”获取系统信息”组件中输入的参数名称必须和表输入的字段名相同2、表输入的where 条件中的值用”?”代替3、从步骤插入数据必须勾选4、获取系统信息组件中的参数类型必须选“命令行参数1”5、执行JOB后,在参数输入栏中输入你的参数值4.1.1.4 表输入组件里的执行每一行?(必须和从步骤插入数据选项一起使用)配置需注意的地方:1、从”DataGrid”组件中输入的参数名称必须和表输入的字段名相同.且该字段有多个值2、表输入的where 条件中的值用”?”代替3、从步骤插入数据、执行每一行?两个选项必须勾选4.1.1.5 记录数量限制如果查询的数据有多条,可选择”记录数量限制”选项进行查询数据的数量进行限制,比如只取100条。

kettle的使用方法

kettle的使用方法Kettle是一种用于数据集成和转换的开源工具,也被称为Pentaho Data Integrator(PDI)。

它提供了一套功能强大的工具,可以帮助用户从不同的数据源中提取、转换和加载数据。

本文将介绍Kettle 的使用方法,帮助读者快速上手使用该工具。

一、安装Kettle您需要从Kettle官方网站下载最新版本的安装包。

安装包通常是一个压缩文件,您可以将其解压到您选择的目录中。

然后,通过运行解压后的文件夹中的启动脚本来启动Kettle。

二、连接数据源在使用Kettle之前,您需要先连接到您的数据源。

Kettle支持多种类型的数据源,包括关系型数据库、文件、Web服务等。

您可以使用Kettle提供的连接器来连接到您的数据源,或者根据需要自定义连接器。

连接成功后,您可以在Kettle中查看和操作您的数据。

三、创建转换在Kettle中,数据转换是通过创建转换作业来实现的。

转换作业是由一系列的转换步骤组成的,每个步骤都执行特定的数据操作。

您可以使用Kettle提供的各种转换步骤,如数据提取、数据过滤、数据转换、数据加载等,来构建您的转换作业。

四、配置转换步骤在创建转换作业后,您需要配置每个转换步骤的参数和选项。

例如,在数据提取步骤中,您需要指定要提取的数据源和查询条件。

在数据转换步骤中,您可以定义数据的转换逻辑,如数据清洗、数据合并、数据计算等。

在数据加载步骤中,您需要指定目标数据表和加载方式。

五、运行转换作业完成转换步骤的配置后,您可以运行整个转换作业,将数据从源数据源提取、转换和加载到目标数据源。

在运行转换作业之前,您可以选择性地预览转换结果,以确保数据操作的准确性和一致性。

Kettle还提供了调试功能,可以帮助您快速定位和解决转换作业中的问题。

六、调度转换作业除了手动运行转换作业之外,Kettle还支持将转换作业安排为定期执行的任务。

您可以使用Kettle提供的调度功能,根据您的需求设置转换作业的执行时间和频率。

kettle使用方法

kettle使用方法一、什么是kettle?Kettle是一款功能强大的开源ETL (Extract, Transform, Load) 工具,用于处理各种数据的抽取、转换和加载。

它提供了可视化的界面,使用户能够轻松地创建和管理数据流程。

二、kettle的安装和配置1.下载kettle安装包,并解压到指定目录。

2.进入kettle目录,在终端中运行spoon.sh (Linux/Mac) 或spoon.bat(Windows) 启动kettle。

3.在弹出的窗口中,点击”File”菜单,选择”Preferences”打开配置页面。

4.在配置页面中,设置kettle的选项,如数据连接、插件路径等。

三、kettle中的数据流程1.创建一个新的数据流程:点击工具栏上的”新建”按钮,在弹出的对话框中选择”Transformation”创建一个新的转换,或选择”Job”创建一个作业。

2.在数据流程中,可以拖拽各种组件来构建转换或作业,如数据输入、数据输出、转换、聚合等。

3.连接组件:使用鼠标拖拽连线工具,连接各个组件,定义数据的流向。

4.配置组件:双击组件,如数据输入组件,可以配置数据源的连接信息、查询语句等。

5.定义转换规则:在转换组件中,根据需要配置字段映射、条件过滤、转换函数等。

6.运行数据流程:点击工具栏上的”运行”按钮,运行数据流程并查看结果。

四、kettle的常用组件和功能1.数据输入:用于读取数据源的组件,支持多种数据源,如数据库、文件、Web服务等。

2.数据输出:用于将数据写入目标的组件,支持多种输出格式,如数据库表、文件、Web服务等。

3.转换组件:用于对数据进行转换的组件,如字段映射、类型转换、条件过滤、聚合等。

4.调度和监控:kettle提供了作业调度和监控的功能,可以定时执行作业、生成报表等。

5.插件扩展:kettle支持插件扩展,用户可以根据需要开发自己的插件,用于处理特定的数据源或转换规则。

kettle实验总结

kettle实验总结我们来了解一下kettle的基本概念和功能。

Kettle是一款基于图形化界面的工具,通过可视化的方式帮助用户构建数据整合和转换的过程。

它提供了丰富的组件和功能,用户可以通过拖拽组件、设置参数和连接组件的方式来构建数据处理流程。

Kettle支持多种数据源和格式,包括关系型数据库、文件、Web服务等,用户可以方便地从不同的数据源中提取数据,并进行预处理、转换和加载。

接下来,我们将探讨如何使用kettle进行数据整合和转换的实验。

在实验前,我们需要准备好数据源和目标数据库,并确保kettle已经正确安装和配置。

首先,我们需要创建一个kettle的工作空间,并在工作空间中创建一个转换(Transformation)。

转换是kettle 中的基本单位,它由一系列的步骤(Step)组成,每个步骤都是一个数据处理的单元。

在转换中,我们可以使用多个步骤来完成不同的数据处理任务。

例如,我们可以使用"输入"步骤从源数据库中提取数据,然后使用"过滤"步骤对数据进行筛选,再使用"转换"步骤进行数据转换,最后使用"输出"步骤将结果加载到目标数据库中。

在每个步骤中,我们可以设置相应的参数和选项,以满足具体的数据处理需求。

除了基本的数据处理步骤,kettle还提供了丰富的功能和插件,用于处理更复杂的数据转换任务。

例如,我们可以使用"维度表输入"步骤来处理维度表的数据,使用"合并记录"步骤来合并不同数据源的记录,使用"数据校验"步骤来验证数据的完整性等。

通过灵活地组合和配置这些步骤,我们可以实现各种复杂的数据整合和转换任务。

在进行实验时,我们还可以使用kettle提供的调试和监控功能,以确保数据处理流程的正确性和性能。

例如,我们可以使用"调试"功能逐步执行转换,并观察每个步骤的输入和输出结果,以及中间数据的变化情况。

kettle经验总结

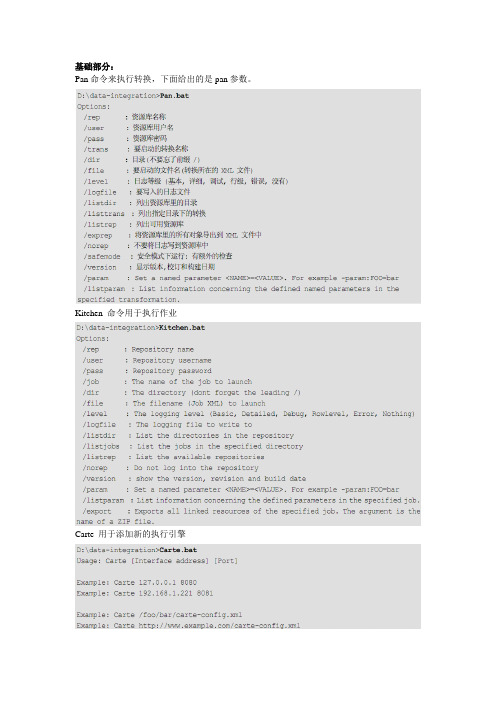

Pan命令来执行转换,下面给出的是pan参数。

Kitchen 命令用于执行作业Carte 用于添加新的执行引擎Kettle的资源库和Carte的登录,密码都是用Encr加密的。

使用中遇到的问题及总结:这两个组件用之前必须先对数据进行排序,否则数据会不准确。

而且merge join会很慢,尽量要少用。

这个组件默认auto commit false,所以如果要执行一些sql,必须在后面加commit。

貌似没什么用,其实也没什么用。

Kettle讲究有进有出,如果最后的没有输出,要加上这个空操作。

实际上测试不写也没问题。

执行java script,这个组件很强大,大部分用组件实现不了的东西,都可以通过这个来转换。

而且可以调用自己写的java 类。

强大到不行~这个组件很奇怪,顾名思义调用存储过程的,但实际上不能调用不传参数的存储过程。

如果有没有参数的存储过程,现在的解决方案是用sql脚本来执行。

一个设置变量,一个获得变量。

这个本来没什么要说的,但在实际应用中发现,在一个trans中设置的变量,在当前trans中并不一定能获得到,所以设计的时候先在一个trans中设置变量,然后在后续的trans中来获得就可以了。

让人惊喜的东西,大数据量导入,事实上让人近乎绝望,研究了一天依旧不会用。

而且我怀疑确实不能用。

其实这个组件无非是实现了copy命令,目前的解决方案,sql脚本,先汗一个,不知道跟这些组件相比效率会怎样。

三个亲兄弟,功能差不多,长的也很像,看了源码感觉,性能有差异,就性能而言,文本文件输入组件很差,它不如csv file input和fixed file input组件,因为后面的两者启用了java nio技术。

顺便提一句而已。

kettle内置性能监控,通过分析能知道哪一环节出现瓶颈。

以上是trans的内容,关于job相比而言简单一些,只是调用trans而已。

值得一说的是job 以start开始,这个start只能有一个。

KETTLE使用经验总结

KETTLE使用经验总结1.熟悉KETTLE的基本概念和操作在开始使用KETTLE之前,建议先花一些时间了解KETTLE的基本概念和操作。

KETTLE的核心概念包括转换(Transformation)、作业(Job)、步骤(Step)、输入(Input)和输出(Output)等。

了解这些基本概念可以帮助你更好地理解和使用KETTLE。

2.认真设计转换和作业在使用KETTLE进行数据转换和加载之前,我们需要先认真设计转换和作业。

转换和作业的设计应该考虑到实际需求和数据流程,避免设计不合理或冗余的步骤。

同时,还需要考虑数据的质量和稳定性,以确保转换和作业的可靠性。

3.使用合适的步骤和功能KETTLE提供了很多不同的步骤和功能,我们需要选择和使用合适的步骤和功能来实现实际需求。

比如,如果需要从数据库中抽取数据,可以使用“表输入”步骤;如果需要将数据写入到数据库中,可以使用“表输出”步骤。

熟悉并正确使用这些步骤和功能,可以提高工作效率。

4.合理使用转换和作业参数KETTLE提供了转换和作业参数的功能,可以方便地传递参数和配置信息。

合理使用转换和作业参数可以使转换和作业更具灵活性和可重复性。

比如,可以使用作业参数来配置文件路径和数据库连接等信息,这样可以只修改参数值而不需要修改转换和作业的配置。

5.使用调试和日志功能在进行复杂的数据转换和加载时,很可能遇到问题和错误。

KETTLE 提供了调试和日志功能,可以帮助我们定位和解决问题。

比如,可以在转换和作业中插入“日志”步骤,将关键信息输出到日志文件中;还可以使用“调试”选项来跟踪转换和作业的执行过程。

6.定期备份和优化转换和作业转换和作业的备份和优化非常重要。

定期备份可以避免转换和作业的丢失和损坏;而优化转换和作业可以提高其执行性能。

比如,可以使用数据库索引来加快查询速度,可以使用缓存来减少数据库访问次数。

7.与其他工具和系统集成KETTLE可以与其他工具和系统进行集成和扩展。

KETTLE使用说明

KETTLE使用说明在本使用说明中,我们将详细介绍如何使用KETTLE完成一些常见的数据处理任务。

第一步:安装和启动KETTLE在Windows中,双击运行Spoon.bat文件来启动KETTLE。

在Linux 和Mac OS中,打开终端,进入KETTLE目录,输入"./spoon.sh"命令来启动KETTLE。

第二步:创建一个新的数据流程启动KETTLE后,您将看到一个图形化界面。

在左上角的工具栏中,有一个新建按钮,点击它来创建一个新的数据流程。

在创建数据流程时,您需要为其指定一个名称。

完成后,点击确定按钮。

第三步:添加数据源在左侧的工具箱中,您可以找到各种组件,如输入步骤、输出步骤、转换步骤等。

为了演示,我们先添加一个输入步骤。

在工具箱中,找到输入步骤,并将其拖放到主界面中。

然后,双击该步骤,在弹出的对话框中配置数据源。

在配置对话框中,您需要指定数据源的类型,如文本文件、Excel文件、数据库等。

根据不同的类型,您可能需要提供相应的连接信息。

完成配置后,点击确定按钮。

在数据流程中,您可以使用转换步骤对数据进行处理。

为了演示,我们使用一个简单的转换步骤来删除重复的数据。

在工具箱中,找到去重复步骤,并将其拖放到已添加的输入步骤的下方。

然后,双击该步骤,在弹出的对话框中配置参数。

在配置对话框中,您需要指定要去重的字段。

您可以选择多个字段以进行复合去重。

完成配置后,点击确定按钮。

第五步:添加输出在数据流程中,您也需要指定一个输出步骤来保存处理后的数据。

在工具箱中,找到输出步骤,并将其拖放到已添加的去重复步骤的下方。

然后,双击该步骤,在弹出的对话框中配置输出格式和目标文件。

在配置对话框中,您需要指定输出的格式,如文本文件、Excel文件、数据库等。

根据不同的格式,您可能需要提供相应的连接信息。

完成配置后,点击确定按钮。

第六步:保存和运行数据流程完成对数据流程的配置后,点击工具栏中的保存按钮来保存数据流程。

kettle工具用法

kettle工具用法关于"kettle工具用法"的1500-2000字文章:Kettle工具是一款功能强大的开源数据集成工具,旨在简化和自动化数据导入、转换和输出的过程。

它拥有直观而强大的用户界面,可让用户通过图形化界面创建和管理数据管道。

本文将逐步回答Kettle工具的用法,涵盖安装、界面介绍、数据导入和转换、数据输出等方面。

一、安装Kettle工具首先,访问Kettle官方网站并下载最新版本的Kettle工具。

下载完成后,运行安装程序,并按照提示进行安装。

安装完成后,打开Kettle工具。

二、界面介绍打开Kettle工具后,你将看到一个主界面,其中包含了工具栏、转换面板和作业面板等。

工具栏上有各种按钮,用于打开、保存和运行数据转换和作业。

转换面板用于创建、编辑和管理数据转换,而作业面板用于创建和管理作业。

你可以通过拖放组件和连接器来建立转换和作业的流程。

三、数据导入数据导入是Kettle工具的一个重要功能,它允许将数据从各种来源导入到目标数据库或文件中。

在Kettle中,你可以通过以下步骤导入数据:1. 创建新的数据转换:在转换面板上右键单击,选择“新建转换”来创建一个新的数据转换。

2. 添加数据输入组件:在工具栏上选择“输入”,然后拖放数据源到转换面板上。

根据需要选择适当的输入类型,如CSV文件、数据库、Excel文件等。

3. 配置数据输入组件:选择添加到转换面板的数据输入组件,右键单击并选择“编辑”。

在配置窗口中,设置数据源的连接信息、查询语句和字段映射等。

4. 添加目标组件:与添加数据输入组件类似,选择“输出”按钮并拖放目标数据库或文件组件到转换面板上。

5. 配置目标组件:选择添加到转换面板的目标组件,右键单击并选择“编辑”。

在配置窗口中,设置目标数据库的连接信息、目标表或文件的格式等。

6. 连接输入和目标组件:在转换面板上,拖动鼠标从数据输入组件的输出连接器到目标组件的输入连接器上,建立数据流。

kettle使用经验总结 -回复

kettle使用经验总结-回复首先,让我们来详细解释一下scaled dot product attention的概念和原理。

scaled dot product attention是一种在自然语言处理和机器翻译任务中非常常用的注意力机制。

它可以在序列到序列的模型中,将不同位置的信息融合在一起,进而提高模型在长序列上的性能。

在理解scaled dot product attention之前,我们需要先了解一下注意力机制。

注意力机制可以将不同位置的信息聚焦在一起,从而更好地进行信息传递和处理。

在一个典型的注意力机制中,我们有一个查询(query)向量和一系列键(keys)和值(values)向量。

注意力机制会为查询向量选择在键向量上的权重,然后将这些权重应用到值向量上,从而得到输出。

这个输出可以被用来计算模型的下一个状态或是最终的预测。

在scaled dot product attention中,我们使用了一个称为点积(dot product)的操作来计算查询向量和键向量之间的相似度。

具体来说,我们将查询向量和键向量的点积除以一个被称为缩放因子(scale factor)的数值。

这个缩放因子是一个与向量维度相关的固定数值。

通过这个缩放因子,我们可以控制点积的大小,从而对相似度进行缩放。

为了更好地理解scaled dot product attention的原理,我们可以将其分为几个重要的步骤:1. 输入:我们有一个查询向量Q,以及一系列的键向量K和值向量V。

这些向量可以由前一层的模型或是其他方式得到。

2. 相似度计算:我们首先计算查询向量Q与每个键向量K之间的点积相似度。

这可以通过将Q和K进行点乘得到。

然后,我们将点积除以缩放因子得到缩放的相似度。

3. 注意力权重:我们使用softmax函数来将缩放的相似度转换为注意力权重。

这样可以保证所有注意力权重的和为1。

softmax函数可以将原始的相似度值归一化。

kettle常用的记录处理心得

kettle常用的记录处理心得

kettle常用的记录处理心得

在使用Kettle数据集成工具时,我们经常需要对数据进行记录处理,以便更好地进行数据分析和应用。

下面是我在使用Kettle的过程中总结的一些记录处理的心得:

1. 去重复:使用Kettle的“去重复”步骤可以帮助我们去掉重复的记录。

我们选择需要去重复的字段为主键,然后在处理过程中进行比较和过滤即可。

2. 过滤记录:使用Kettle的“过滤记录”步骤可以帮助我们排除不需要的记录,比如为空或特定数值的记录。

在过滤的过程中,我们可以使用正则表达式或自定义脚本进行过滤。

3. 合并记录:使用Kettle的“合并记录”步骤可以帮助我们将多个记录合并成一个记录。

在合并的过程中,我们需要选择合并的字段,并且可以根据需要拼接或聚合字段值。

4. 分割记录:使用Kettle的“分割记录”步骤可以帮助我们将一个记录分割成多个记录。

在分割的过程中,我们可以选择分割的方式,比如按照指定的分割符或按照字段值。

5. 排序记录:使用Kettle的“排序记录”步骤可以帮助我们对记录进行排序,以便更好地进行后续的数据分析和应用。

我们可以选择需要排序的字段和排序的方式,比如升序或降序。

总之,在使用Kettle处理记录时,我们需要根据数据的实际情况选择合适的处理方式,并在处理的过程中注意数据类型的转换和数据精度的保留,以便保证处理结果的准确性和可靠性。

在实践中多尝试,多摸索,相信你会有更多的记录处理心得。

kettle使用经验总结 -回复

kettle使用经验总结-回复Kettle使用经验总结在现代生活中,水壶是我们家庭中不可或缺的小电器之一。

它方便快捷地为我们提供了热水,无论是用来冲泡茶叶、咖啡还是做其他热饮料,都离不开水壶的帮助。

但是,不同的水壶在使用方法上可能会有所不同,本文将一步一步回答关于kettle使用的问题,帮助您更好地使用这一家庭必备工具。

第一步:购买合适的水壶在开始使用水壶之前,您需要购买一款合适的水壶。

市场上有许多不同类型的水壶可供选择,包括电水壶和传统水壶。

电水壶使用更加方便快捷,而传统水壶则可以直接放在火炉上加热。

考虑到电水壶的普遍使用和便捷性,本文将重点介绍如何使用电水壶。

第二步:了解水壶的基本部件在使用电水壶之前,您需要熟悉水壶的基本部件。

常见的电水壶通常由以下几个部分组成:1. 水壶底座:用于放置水壶并提供电力,通常带有电源插头和控制按钮。

2. 电源线:连接水壶底座和电源插座的线缆,确保电力供应。

3. 取手:用于握住水壶并倒水。

4. 盖子:盖住水壶的顶部,可防止水的溢出和蒸汽。

5. 口嘴:从水壶倒水的地方,通常带有过滤器。

根据您所购买的具体型号,水壶的部件可能会有所不同。

在使用之前,请先查看说明书以了解您所购买的水壶的特殊功能和部件。

第三步:填充水壶在开始使用之前,您需要仔细选择并填充水壶。

请注意以下几点:1. 水位线:大多数水壶上都有装水的水位线,确保不要超过该线。

如果您需要少量热水,可以根据需要调整水位。

2. 冷水:用冷水来填充水壶,而不是使用温水或热水。

这样可以避免热水烫伤和延长水壶的使用寿命。

3. 净化水质:如果您居住的地方水质较差,可以使用过滤器或瓶装水来填充水壶,以确保水的纯净度。

第四步:加热水壶在填充水壶后,将其放置在底座上并插上电源。

根据水壶上的控制按钮,选择所需的加热温度。

大多数电水壶都有不同的温度选项,如80C、90C 和100C。

根据您需要的热水温度,选择合适的选项。

一般来说,煮沸水时选择100C,而冲泡咖啡或绿茶时选择较低的温度。

利用 kettle 实现数据迁移的实验总结

数据迁移是指将数据从一个系统或评台移动到另一个系统或评台的过程。

在进行数据迁移时,我们通常需要借助一些工具来帮助我们高效地完成数据迁移任务。

Kettle 是一款功能强大的开源数据集成工具,它可以帮助用户实现数据的抽取、转换和加载(ETL)操作,非常适用于数据迁移的实施。

在本文中,我们将结合我们的实际经验,对利用Kettle 实现数据迁移的实验进行总结,并共享一些经验和教训。

一、实验背景1.1 实验目的在进行数据迁移的实验之前,我们首先需要明确实验的目的和意义。

数据迁移的目的通常是为了将数据从一个系统迁移到另一个系统,实现数据的共享、备份或者更新等操作。

我们希望通过本次实验,探索并验证 Kettle 工具在数据迁移中的实际效用,为以后的项目工作提供参考和借鉴。

1.2 实验环境在进行实验之前,我们需要搭建相应的实验环境,以确保实验的顺利进行。

在本次实验中,我们使用了一台装有 Windows 操作系统的服务器,并在上面成功安装了Kettle 工具。

我们还准备了两个数据源,分别用于模拟数据的来源和目的地,以便进行数据迁移的实验。

二、实验过程2.1 数据抽取在进行数据迁移之前,我们首先需要从数据源中抽取需要迁移的数据。

在本次实验中,我们使用 Kettle 工具的数据抽取功能,成功地将源数据抽取到 Kettle 中,并对数据进行了初步的清洗和处理。

通过Kettle 的直观界面和丰富的抽取组件,我们轻松地完成了数据抽取的工作,为后续的数据转换和加载操作奠定了基础。

2.2 数据转换在数据抽取之后,我们往往需要对数据进行一定的转换和处理,以满足目的系统的要求。

在本次实验中,我们利用 Kettle 的数据转换功能,对抽取得到的数据进行了格式化、清洗和加工操作。

Kettle 提供了丰富的转换组件和灵活的数据转换规则,让我们能够快速地实现各种复杂的数据转换需求。

Kettle 还支持可视化的数据转换设计,让我们可以直观地了解数据转换的过程和结果。

kettle的用法

kettle的用法Kettle 是一款开源的 ETL(Extract, Transform, Load)工具,用于数据的提取、转换和加载。

它提供了一个图形化界面,使用户能够通过拖拽和连接组件来构建数据处理流程。

下面是一些 Kettle 的基本用法:1. 安装和启动 Kettle:首先,你需要下载并安装 Kettle。

然后,启动 Kettle 并打开 Spoon 应用程序。

2. 创建转换(Transformation):在 Spoon 中,点击“File”菜单,选择“New”,然后选择“Transformation”来创建一个新的转换。

3. 添加源和目标:在转换设计界面中,你可以通过拖拽源(Source)和目标(Target)组件来定义数据的来源和去处。

例如,你可以添加一个 CSV 文件读取源来读取 CSV 数据,然后添加一个数据库写入目标来将数据写入数据库。

4. 配置源和目标:双击源或目标组件,可以配置它们的属性。

你需要提供适当的连接信息、文件路径或数据库表名等。

5. 添加转换步骤:在源和目标之间,你可以添加各种转换步骤来对数据进行处理。

例如,你可以使用过滤(Filter)、排序(Sort)、字段转换(Field Transformer)等组件来修改数据。

6. 连接组件:通过连接(Connector)将源、转换步骤和目标组件连接起来,以定义数据的流动路径。

7. 运行转换:在完成转换设计后,你可以点击运行(Run)按钮来执行转换。

Kettle 将执行转换步骤,并将结果输出到目标。

8. 创建作业(Job):除了转换,你还可以创建作业来执行一系列相关的转换。

作业可以按照顺序执行多个转换,并可以设置执行时间和条件。

9. 保存和部署:在完成转换或作业的设计后,记得保存你的工作。

你可以将转换或作业保存为 KTR 或 JAR 文件,以便在其他环境中部署和运行。

这只是 Kettle 的一些基本用法,它还提供了更多高级功能和扩展选项,例如数据清洗、数据集成、数据仓库等。

kettle数据迁移实验总结

kettle数据迁移实验总结Kettle数据迁移实验总结一、实验目标本次实验的主要目标是学习和掌握Kettle工具的使用,实现数据的迁移。

希望通过本次实验,我们能理解并掌握Kettle的安装、配置及使用方法,提升在大数据环境下的数据处理和迁移能力。

二、实验过程1. Kettle的安装与配置:首先,我们按照官方文档的指引,下载并安装了Kettle。

然后,配置了Kettle的运行环境,包括设置环境变量和配置数据库连接等。

2. 数据源与目标配置:根据实验需求,我们选择了两个数据源和目标,分别为MySQL和Hive。

在Kettle中配置了相应的数据库连接信息,包括用户名、密码、数据库名等。

3. 建立转换任务:在Kettle中,我们根据需求创建了数据迁移任务。

首先,通过“View Database Connections”查看并配置数据库连接。

然后,通过“Design View”设计数据迁移的步骤和流程。

4. 数据清洗与转换:在数据迁移过程中,我们使用了Kettle的过滤器、转换器等工具,对原始数据进行了清洗和转换。

例如,去重、过滤无效数据、转换数据格式等。

5. 数据迁移与验证:最后,我们执行了数据迁移任务,将清洗和转换后的数据从源数据库迁移到目标数据库。

迁移完成后,对目标数据库中的数据进行验证,确保数据的准确性和完整性。

三、问题与解决方案在实验过程中,我们遇到了一些问题,以下是部分问题的描述和解决方案:1. 数据库连接失败:在配置数据库连接时,发现无法连接到指定的数据库。

经过检查,发现是数据库连接参数配置错误。

解决方案是核对并修正数据库连接参数,包括主机名、端口号、用户名、密码等。

2. 数据格式不匹配:在数据迁移过程中,发现源数据和目标数据的格式不匹配。

解决方案是使用Kettle的转换器工具,对数据进行格式转换,使其符合目标数据的格式要求。

3. 数据迁移速度慢:在执行数据迁移任务时,发现迁移速度较慢。

经过分析,发现是网络带宽和数据库性能瓶颈所致。

kettle使用经验总结

Kettle使用经验总结一、关于变量的使用在etl过程中难免不使用变量,所以就先介绍变量的使用。

其中可以使用kettle已经定义好的变量。

个人感觉最有用的就是“Internal.Job.Filename.Directory”。

这个变量为运行时变量,含义为启动的当前job的目录,是个相对路径。

可以在job中的作业转换名、日志文件名、转换文件名等任何可以使用到文件路径的地方使用。

这样很方便移植,不用每次当文件更改目录后或者移植到不同系统下需要一一更改每个步骤的路径,节省了许多不必要的时间。

还可以在Kettle的属性文件kettle.properties中设置环境变量。

此文件所在目录如下:$HOME/.kettle (Unix/Linux/OSX)C:\Documents and Settings\<username>\.kettle\kettle.properties (Windows) 使用变量的方法可以如下指定:${V ARIABLE}。

还可以设置运行时变量。

关于命令行启动job/trans直接设置动态变量还没有验证。

待验证后补充。

现在使用的是将参数输入到文本中,然后从文本取得变量的值再在各个trans中使用。

包含设置变量的trans里不能放置使用此变量的步骤,此变量只能在之后的trans/Job中才能使用。

使用的时候直接${varName}即可。

还有一种是使用局部变量可以直接用?代替。

这个需要注意的是在使用变量的步骤中有一个“从步骤插入数据”下拉列表,需要从中选择之前的变量。

对于全量提取和每天增量提取,可以将提取的过程作为一个通用的job,前面根据提取方式的不同连接不同的时间变量,后面提取的sql写为between…and…。

这样既实现了功能,又实现了代码复用。

但是需要注意的是格式问题,获取系统信息取到的时间格式形如“2009/08/10 00:00:00.000”。

如果将此时间使用js截断后再设置,格式会变成类似“Sat Aug 10 00:00:00 CST 2009”。

kettle完成总结

关于kettle工具及脚本开发的总结前一阶段,对质检、外汇局以及东软医疗等项目进行了业务流程的模拟实现以及在对应的业务中,使用kettle工具对业务涉及的数据抽取和转换进行了脚本实现。

经过这三个项目业务场景的模拟和演示,总结使用kettle开发数据处理脚本的设计思路、开发过程,得到了很多实用的经验,对kettle的使用以及其框架、接口等更加清楚和熟悉。

以上所述的三个项目的demo仅仅完成了核心业务数据处理的流程和逻辑,相关的增量抽取、循环读取文件目录、定时执行等逻辑都没有在demo中体现。

通过进一阶段的整理和总结,目前的核心业务需求不外乎DB到DB的数据直接抽取、根据DB信息生成特定格式XMl、解析已有XML并存入DB以及XML与XML之间的格式转换。

对于这些需求,通常采用以下手段进行设计和实现:1.尽量使用kettle脚本的方式处理数据的抽取、转换、载入等操作;2.Kettle脚本方式无法完成或者复杂度很高的业务交由java编码实现或者其他方式实现,如XSLT基于这个设计思路,下面将结合质检的业务流程对kettle的业务开发及流程设计思路进行分析和总结。

质检前置机数据处理分为四个步骤:步骤1:在指定位置读取企业端上传的XML报文,并存入E IG中间库;步骤2:读取中间库状态位为0(未上报)的报文信息,并交由X S LT进行转换;步骤3:解析转换后的XML报文,并将对应的数据存入业务库对应的字段中;步骤4:将业务库补录后的数据抽取出来生成平台端需要的格式的XML报文。

流程如下图所示:方案一:循环、增量、定时等逻辑交由编码控制,具体执行交由kettle企业端到EIG中间库的数据处理:由于现有kettle组件读取文件的方式是对文本内容进行字段解析和分割,因此并不符合业务中读取完整XML报文并存入数据库大字段的需求,因此针对步骤1采用java编码的方式读取文件内容并操作数据库保存读取的报文信息。

采用这种方式,循环读取报文目录、定时读取等既定规则的报文读取逻辑也均可通过硬编码方式实现。

kettle 用法

Kettle是一款开源的ETL工具,使用Kettle可以轻松地实现数据集成、转换和加载等任务。

以下是Kettle的基本用法:1. 下载并解压Kettle:可以从官网下载Kettle的最新版本,然后解压到本地。

2. 创建转换任务:在Kettle中,可以使用“转换”标签页来创建转换任务。

首先,需要点击“新建”按钮创建一个新的转换任务。

然后,可以在左侧的“资源”面板中选择需要用到的转换组件,例如输入、输出、过滤器、连接器等。

将组件拖动到中间的画布中,并对其进行配置。

3. 连接输入和输出数据:在转换任务中,需要连接输入和输出数据。

可以通过拖动“输入”和“输出”组件到画布中,并使用箭头连接它们。

在连接时,可以设置数据的映射关系,例如将输入表中的某个字段映射到输出表中的某个字段。

4. 添加过滤器:在转换任务中,可以添加过滤器来筛选数据。

可以通过拖动“过滤器”组件到画布中,并对其进行配置。

可以设置过滤器的条件,例如筛选出年龄大于等于18岁的用户。

5. 配置连接信息:在转换任务中,需要配置连接信息,以便能够连接到数据源和目标数据库。

可以通过拖动“连接”组件到画布中,并对其进行配置。

需要设置连接的数据库类型、数据库的主机名、用户名、密码等信息。

6. 运行转换任务:在配置完转换任务后,可以点击“运行”按钮来执行转换任务。

在运行时,需要选择转换任务的输入和输出路径,并设置其他相关参数。

如果一切正常,转换任务将会执行成功,并将数据加载到目标数据库中。

以上是Kettle的基本用法,通过Kettle可以轻松地实现数据集成、转换和加载等任务。

如果需要更复杂的操作,可以参考Kettle的官方文档或者搜索相关教程进行学习。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

KETTLE使用自己总结的Kettle使用方法和成果说明简介Kettle是一款国外开源的ETL工具,纯java编写,可以在Window、Linux、Unix上运行,绿色无需安装,数据抽取高效稳定。

Kettle 中文名称叫水壶,该项目的主程序员MATT 希望把各种数据放到一个壶里,然后以一种指定的格式流出。

Kettle这个ETL工具集,它允许你管理来自不同数据库的数据,通过提供一个图形化的用户环境来描述你想做什么,而不是你想怎么做。

Kettle中有两种脚本文件,transformation和job,transformation完成针对数据的基础转换,job则完成整个工作流的控制。

Kettle可以在/下载到。

注:ETL,是英文Extract-Transform-Load 的缩写,用来描述将数据从来源端经过萃取(extract)、转置(transform)、加载(load)至目的端的过程。

ETL 一词较常用在数据仓库,但其对象并不限于数据仓库。

下载和安装首先,需要下载开源免费的pdi-ce软件压缩包,当前最新版本为5.20.0。

下载网址:/projects/pentaho/files/Data%20Integration/然后,解压下载的软件压缩包:pdi-ce-5.2.0.0-209.zip,解压后会在当前目录下上传一个目录,名为data-integration。

由于Kettle是使用Java开发的,所以系统环境需要安装并且配置好JDK。

žKettle可以在/下载ž 下载kettle压缩包,因kettle为绿色软件,解压缩到任意本地路径即可。

运行Kettle进入到Kettle目录,如果Kettle部署在windows环境下,双击运行spoon.bat 或Kettle.exe文件。

Linux用户需要运行spoon.sh文件,进入到Shell提示行窗口,进入到解压目录中执行下面的命令:# chmod +x spoon.sh# nohup ./spoon.sh & 后台运行脚本这样就可以打开配置Kettle脚本的UI界面。

Kettle的简单使用首先,点击“文件—新建—转换”菜单创建一个转换。

我们可以看到转换的主对象数和核心对象区域,然后我们添加一个DB连接。

选择“注对象数”,双击“转换2”标签下的“DB连接”会弹出一个设置窗口。

填入连接名称,选择连接类型,配置数据库设置,然后测试下配置是否正确。

由于Kettle没有将所有的数据库的Driver文件集成,所以如果想连接指定的数据库,需要自己下载JDBC驱动,放入到解压目录下的lib目录中。

添加完JDBC 驱动后,必须重启下Kettle才能加载驱动。

1)Oracle的JDBC驱动:ojdbc6.jar2)MySQL的JDBC驱动:mysql-connector-java-5.1.32.jar注:在转换之前需要创建转换所需的表,原始表和转换的目标表。

点击“核心对象”标签页中的“输入”,选择“表输入”拖到“转换”区域。

双击“表输入”图标弹出表输入对话框,填入步骤名称,选择数据库连接,点击“获取SQL查询语句”,或者直接写入SQL语句,填写附件信息,点击“预览”按钮查看执行结果,没有错误,点击“确认”关闭对话框。

点击“核心对象”—“输出”,选择“Excel输出”拖入到转换区,双击Excel 输出图标,弹出对话框,选择文件名和其它附加参数,点击确认。

点击输入表的图标,同时按下shift键,再点击输出文件,将两者连接起来。

然后双击Excel输出进行配置。

最后一步就是执行kettle脚本,点击工具栏上的绿色箭头即可。

点击“启动”开始转换,在转换过程中会出现转换的信息,如下图所示。

完成转换后,我们可以Excel输出目录中查看转换结果。

注:时间字段换到Excel为空,修改SELECT语句中使用TO_CHAR转换成字符串,例如:TO_CHAR(START_TIME, 'yyyy-mm-dd HH24:MM:SS') AS START_TIME。

注:Excel中的记录不能超过65535条,否则会自动关闭文件,导致转换失败。

上面是一个简单的数据迁徙脚本,从数据库导出数据到EXCEL文件中。

Kettle处理HBase本教程使用的软件版本信息如下:1)Hadoop(1.2.1)2)Pantaho Data Integration(5.2.0)3)HBase(0.94.19)。

Pentaho Shim(社区版)目前支持的Hadoop版本:参考:wiki.pentaho./display/BAD/Configuring+Pentaho+for+your+Hadoop+Distro+and+Ver sion注:从上表中看出它不支持hadoop 1.2.x版本。

解决办法是使用HDP13的插件(基于hadoop-1.0.3/hbase-0.94.6)替代,步骤如下:1)从https://pentaho.box./50-hdp12下载hdp13的shim插件。

2)解压到plugins/pentaho-big-data-plugin/hadoop-configurations目录下,目录名为hdp13。

3)进入plugins/pentaho-big-data-plugin目录,修改plugin.properties文件中的active.hadoop.configuration属性为,缺省值为hadoop-20,如下:active.hadoop.configuration=hdp133)替换掉hdp13/lib目录下与Hbase和hadoop有关的Jar包,拷贝一份hbase-site.xml到hdp13目录下。

| hdp13/lib/pmr目录下替换后的Jar包:| hdp13/lib/client目录下替换后的Jar包:* 在HBase中创建一个weblogs表,步骤如下:1)打开HBase shell,在命令行中输入:hbase shell2)在Hbase中创建一个表,在hbase shell中输入:create 'weblogs', 'pageviews'* 上面命令会创建一个带有一个列族pageviews的weblogs的表。

3)执行quit退出HBase shell。

参考文档:help.pentaho./Documentation/5.2/0L0/0Y0/0F0/040/000/000/0301. 从下面网址下载weblogs_hbase.txt.zip压缩文件作为文本文件数据源导入:wiki.pentaho./download/attachments/23530622/weblogs_hbase.txt.zip2. 从Spoon(Kettle)中,创建一个新的转换,选择“文件—新建—转换”。

点击“核心对象—输入”标签,然后把“文本文件输入”拖到画板中。

3. 双击文本文件输入,弹出文本文件输入对话框,点击“浏览…”按钮选择weblog_hbase.txt文件,点击“添加”按钮。

选择“容”标签,清空分隔符点击“Insert TAB”按钮,选中“头部行数量”选择框,从格式的下拉菜单中选择Unix格式。

配置输入字段,从“字段”标签页中选择“获取字段”按钮,弹出可用的字段列表,询问采样的数量,输入100点击“OK”按钮。

修改字段key的类型为String,长度为20。

点击“OK”按钮关闭对话框。

●在“核心对象—Big Data”下,把HBase Output图标拖入到面板中。

并且把文本文件输入与HBase Outpu连接起来(按住shift+拖曳)。

●双击Hbase Output,在弹出对话框中输入Zookeeper的主机名和端口号。

1)Zookeeper host(s)字段中输入Zookeeper主机名,多个主机名使用逗号分隔。

对于本地集群使用localhost。

2)在Zookeeper port字段中,输入你的Zookeeper端口号,缺省值2181。

●创建一个Hbase映射,在Create/Edit mappings标签页中告诉Pentaho在HBase中如何存储数据。

1)点击Get table names按钮,在HBase table name的选择框中选择weblogs2)Mapping name,输入pageviews3)点击“Get imcoming fields”按钮4)从Alias的key这行修改Key为Y,清除掉Column family和Column name 字段,并且设置Type字段为String,点击Save mapping。

配置HBase out使用上面刚刚创建的映射。

1)进入到Configuration Connection标签页,点击Get table names。

2)点击Get table names,在Hbase table name的选择框中选择weblogs。

3)点击Get mappings for speficed table获取指定的表。

4)点击Mapping name,选择pageviews,点击“确认”按钮关闭窗口。

点击“文件—另存为”菜单保存转换,在选择目录中输入load_hbase.ktr作为文件名。

点击转换工具栏中的运行按钮运行转换,或者选择“动作—运行”菜单打开一个执行转换的窗口,点击“启动”按钮。

在Spoon接口的下面打开一个执行结果窗口,显示运行时转换的进度。

在几十秒之后完成转换。

如果在转换过程中出现任何错误,将会红色高亮显示,在日志标签页查看错误信息。

通过查询HBase验证数据1)从命令行中,输入下面命令打开HBase shell:hbase shell2)通过这个命令查询HBase:scan 'weblogs', {LIMIT => 10}应该返回数据的行数。