像元与分辨率

面阵相机的主要参数及成像影响

面阵相机的主要参数及成像影响1. 分辨率:面阵相机的分辨率由所采用的感光芯片分辨率决定,表现为芯片靶面排列的像元数量,即像素数。

在采集图像时,相机的分辨率对图像质量有很大的影响。

在对同样大的视场成像时,分辨率越高,对细节的展示越明显。

需要注意的是,像素越多并不一定是越高越好,因为高像素会带来更大的图像数据量,增加后期的算法处理复杂度。

2. 帧率(行频):面阵相机的帧率表示相机采集图像的频度。

相机的帧率受到芯片的帧频和数据输出接口带宽的影响。

在实际应用中,很多时候需要对运动物体成像,相机的帧率需要满足一定要求,才能清晰准确地对物体成像。

3. 灵敏度:面阵相机的灵敏度取决于像元对光线的敏感程度。

灵敏度高的相机可以在低照度环境下捕捉到更多的细节,而灵敏度低的相机则可能无法捕捉到这些细节。

因此,在选择面阵相机时,需要根据实际应用场景的照度情况来选择具有适当灵敏度的相机。

4. 噪声水平:面阵相机的噪声水平对成像质量有很大影响。

噪声可能来源于相机内部和外部的因素,如电子干扰、光子散粒噪声等。

低噪声水平的相机可以更好地还原图像的细节,提高图像质量。

因此,在选择面阵相机时,需要关注其噪声水平,并选择具有较低噪声的相机。

5. 动态范围:面阵相机的动态范围指的是相机能够同时记录最亮和最暗区域的能力。

动态范围越大,相机能够记录的图像细节就越多。

因此,在选择面阵相机时,需要根据实际应用场景的亮度范围来选择具有适当动态范围的相机。

6. 光谱响应:面阵相机的光谱响应指的是相机对不同波长光线的敏感程度。

不同的相机可能对不同波长的光线有不同的敏感度,因此在选择面阵相机时,需要根据实际应用场景的光线波长来选择具有适当光谱响应的相机。

7. 镜头焦距:面阵相机搭配的镜头焦距也会对成像产生影响。

镜头的焦距决定了相机视场的大小和拍摄距离的远近。

焦距越短,视场越大,拍摄距离越近;焦距越长,视场越小,拍摄距离越远。

在选择相机和镜头时,需要根据实际应用场景的需求来选择合适的焦距。

关于各种分辨率的区分

1.图像分辨率image resolution 能区分图像上两个像元的最小距离。

指图象中存储的信息量。

图像分辨率为数码相机可选择的成像大小及尺寸,单位为dpi。

常见的有640 x 480;1024 x 768;1600 x 1200;2048 x 1536。

在成像的两组数字中,前者为图片宽度,后者为图片的高度,两者相乘得出的是图片的像素。

像素越高,其图片的分辨率越大。

分辨率表示的是图片在长和宽上占的点数的单位。

数码相机能产生在每寸图像内,点数最多的图片,通常以dpi为单位,英文为Dot per inch。

分辨率越大,图片的面积越大。

像素越大,分辨率越高,照片越清晰,可输出照片尺寸也可以越大。

表示图像分辨率的方法有很多种,这主要取决于不同的用途。

下面所要探讨的,就是在各种情况下分辨率所起的作用,以及它们相互间的关系。

在平面设计中,图像的分辨率以PPI来度量,它和图像的宽、高尺寸一起决定了图像文件的大小及图像质量。

该值越大图形文件所占用的磁盘空间也就越多。

图象分辨率以比例关系影响着文件的大小,即文件大小与其图象分辨率的平方成正比。

如果保持图象尺寸不变,将图象分辨率提高一倍,则其文件大小增大为原来的四倍。

在计算机中处理的图像,有时要输出印刷。

在大多数印刷方式中,都使用CMYK(品红、青、黄、黑)四色油墨来表现丰富多彩的色彩,但印刷表现色彩的方式和电视、照片不一样,它使用一种半色调点的处理方法来表现图像的连续色调变化,不像后两者能够直接表现出连续色调的变化。

在电视工业中,分辨率分为水平分辨率和垂直分辨率,在大多数情况下两者是相等的,因此在技术指标中一般仅给出水平分辨率,其度量单位电视线也往往简称为线。

总的说来,设备分辨率反映了硬件设备处理图像时的效果,图像分辨率指标的高低反映了图像清晰度的好坏。

认清设备分辨率和图像分辨率的关系,在图像处理中选择合适的设备分辨率值和图像分辨率值,既能保证图像质量,又能提高工作效率和减少投资。

可见光传感器的像元尺寸 -回复

可见光传感器的像元尺寸-回复可见光传感器的像元尺寸,是指传感器中的每个像素的大小。

像元尺寸对于图像的质量、分辨率和噪声有着重要的影响。

在本文中,我们将逐步解释可见光传感器的像元尺寸是什么,为什么它很重要,以及如何选择适合自己需求的像元尺寸。

第一部分:可见光传感器的像元尺寸是什么可见光传感器是一种能够感知可见光波段的器件,常用于数码相机、手机摄像头等设备中。

传感器中的像元(或称为像点)是构成图像的最小单位,它们由光敏元件(通常是光电二极管)和与之对应的信号处理器组成。

像元尺寸是指像元在传感器上的物理尺寸,通常以微米(μm)为单位。

第二部分:像元尺寸的重要性像元尺寸对于图像质量和分辨率有重要影响。

较大的像元尺寸能够接收更多的光线,因此具有更高的感光度和动态范围。

这意味着在低光条件下,大像元尺寸的传感器能够捕捉到更多的细节,并减少图像噪声的产生。

此外,大像元尺寸还有助于实现更好的曝光控制和更精细的色彩渲染,从而提供更真实、更生动的图像。

此外,像元尺寸还直接影响图像的分辨率。

较小的像元尺寸可以容纳更多的像元,并提供更高的分辨率。

然而,这也会导致每个像元的感光面积减小,从而限制了每个像元的光线接收能力。

因此,在选择像元尺寸时,需要权衡分辨率和感光度之间的关系,以满足具体的拍摄需求。

第三部分:选择适合的像元尺寸选择适合的像元尺寸取决于具体的应用需求。

对于专业摄影师和摄影爱好者来说,他们通常会追求更高的图像质量和更好的低光性能,因此他们可能会选择较大像元尺寸的传感器。

较大的像元尺寸可以在暗光条件下捕捉更多的细节,并产生更少的噪声。

这对于拍摄夜景、室内场景或高动态范围场景非常重要。

然而,较大的像元尺寸通常也会导致相机体积的增加,并且更昂贵。

因此,对于普通消费者和手机制造商来说,他们更关注的是紧凑性和成本效益。

在这种情况下,他们可能会选择较小的像元尺寸,以实现更高的分辨率和更小的相机体积。

此时,算法优化和后期处理变得尤为重要,以解决较小像元尺寸可能带来的噪声和图像质量问题。

彩色线阵相机分辨率计算公式

彩色线阵相机分辨率计算公式全文共四篇示例,供读者参考第一篇示例:彩色线阵相机是一种常用的数字成像设备,其原理是利用线阵传感器捕捉场景的光学信号,并将其转换成数字图像。

在图像处理领域,对于相机的分辨率是一个非常重要的指标,它直接影响到图像的清晰度和细节显示。

了解彩色线阵相机的分辨率计算公式是很有必要的。

彩色线阵相机的分辨率是指在一定的物理尺寸下,相机能够显示出多少个像素。

通常情况下,分辨率可以通过水平和垂直方向上的像素数来表示。

彩色线阵相机的分辨率计算公式可以通过以下方式进行推导:假设彩色线阵相机的有效像元行数为H,有效像元列数为V,每个像元的大小为p×p(单位为mm^2)。

则相机的有效像元总数N可以表示为:\( N = H \times V \)而相机的分辨率R可以表示为:\[ R = NH]对于传统的黑白线阵相机,其色彩信息只有一个通道,因此每个像元只需要一个像素来记录亮度信息。

而对于彩色线阵相机,则需要三个像素来记录RGB三个通道的色彩信息。

彩色线阵相机的分辨率可以进一步表示为:\[ R_c = N_c = 3N \]还应考虑像元之间的间隔,以及像元的数量和相机的物理尺寸之间的关系。

这涉及到了线阵相机的物理结构和镜头系统的设计。

一般情况下,像元之间的间隔会影响到图像的清晰度和细节度,因此需要根据具体的应用场景来选择适当的像元尺寸和相机分辨率。

除了以上的计算公式,还可以通过实际测试来获取彩色线阵相机的分辨率。

方法是通过拍摄一系列测试图像,利用图像处理软件进行分析和测量,得出相机的分辨率值。

根据实际的测量结果,可以进一步优化相机的设置和应用环境,以提高图像的质量和清晰度。

了解彩色线阵相机的分辨率计算公式对于图像处理和信号处理领域的工作者来说是非常重要的。

通过计算公式和实际测试,可以更好地了解相机的性能特点和优缺点,从而优化图像采集和处理流程,提高图像质量和分辨率。

希望通过本文的介绍,读者对彩色线阵相机分辨率的计算有了更深入的了解和认识。

图像传感器的光电参数和选择标准

图像传感器的光电参数和选择标准图像传感器可将光信号转化为电信号,其光电参数直接决定了成像质量,是所有成像设备中的核⼼关键器件。

图像传感器分为 CCD器件和CMOS 器件。

CMOS图像传感器在帧频、集成度、可靠性、功耗和成本等⽅⾯优势明显。

随着 CMOS 技术的不断进步,CMOS 图像传感器的成像性能已接近或超越 CCD 器件,在⾼端⼯业、医疗、和科研应⽤中逐步取代 CCD,成为主流图像传感技术。

⽆论是 CMOS 或 CCD 图像传感器,其光电参数都可依据业界成熟的标准进⾏评价。

图像传感器的主要光电参数CMOS 和 CCD 图像传感器的性能指标可分为光学指标和电学指标,⽽其成像质量主要取决于以下光学指标:分辨率及像元尺⼨(Resolution and Pixel size)快门类型(Shutter Type)量⼦效率(Quantum Efficiency, QE)灵敏度(Sensitivity)暗噪声(Dark Noise)满阱容量(Full Well Capacity, FWC)动态范围(Dynamic Range, DR)暗电流(Dark Current, DC)除上述光学指标外,图像传感器的电学指标,如帧频、功耗、输出格式及数据率也是设计成像系统时需要考虑的重要指标。

1) 分辨率及像元尺⼨图像传感器的感光区是由多个像元排列的⼀维或⼆维矩阵,其中像元(或像素)为单个感光单元。

图像传感器的分辨率通常由该矩阵的横纵⽅向的像元数表⽰,如 1920 x 1080,或由其乘积表⽰,如 2 百万分辨率(2MP)。

像元尺⼨为每个像元的物理尺⼨,即相邻像元中⼼的间距。

像元尺⼨越⼤,能收集到的光⼦数越多,芯⽚灵敏度越⾼,意味着在同样的光照条件下和曝光时间内,芯⽚能收集到的有效信号越多。

在光强可控的⼯业应⽤中,像元尺⼨⼀般在 4.5-6.5 微⽶之间;⽽在微光应⽤中,像元尺⼨多在 10 微⽶到 24 微⽶之间,以保证⾜够的灵敏度,提升图像信噪⽐;在 X射线成像应⽤中,多采⽤ 10-16 微⽶的像元,可有效降低所需射线剂量,减少对⼈体不必要的辐射。

镜头分辨力计算和理解

镜头分辨⼒计算和理解1、镜头分辨率镜头的分辨率是指在成像平⾯上 1 毫⽶间距内能分辨开的⿊⽩相间的线条对数,单位是“线对/毫⽶”( lp/mm,line-pairs/mm )最⼩能分辨的尺⼨是线对数的2倍倒数。

例如:镜头分辨率是100 lp/mm,最⼩能分辨的尺⼨是 1/(100*2)=0.005mm。

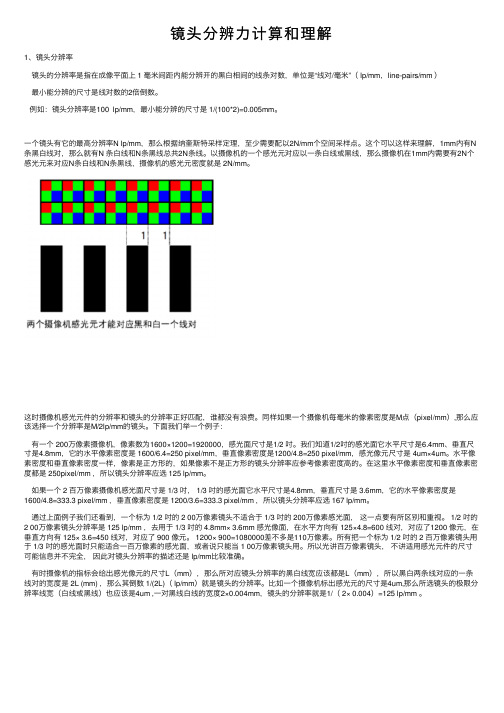

⼀个镜头有它的最⾼分辨率N lp/mm,那么根据纳奎斯特采样定理,⾄少需要配以2N/mm个空间采样点。

这个可以这样来理解,1mm内有N 条⿊⽩线对,那么就有N 条⽩线和N条⿊线总共2N条线。

以摄像机的⼀个感光元对应以⼀条⽩线或⿊线,那么摄像机在1mm内需要有2N个感光元来对应N条⽩线和N条⿊线,摄像机的感光元密度就是 2N/mm。

这时摄像机感光元件的分辨率和镜头的分辨率正好匹配,谁都没有浪费。

同样如果⼀个摄像机每毫⽶的像素密度是M点(pixel/mm),那么应该选择⼀个分辨率是M/2lp/mm的镜头。

下⾯我们举⼀个例⼦:有⼀个 200万像素摄像机,像素数为1600×1200=1920000,感光⾯尺⼨是1/2 吋。

我们知道1/2吋的感光⾯它⽔平尺⼨是6.4mm、垂直尺⼨是4.8mm,它的⽔平像素密度是 1600/6.4=250 pixel/mm,垂直像素密度是1200/4.8=250 pixel/mm,感光像元尺⼨是 4um×4um。

⽔平像素密度和垂直像素密度⼀样,像素是正⽅形的,如果像素不是正⽅形的镜头分辨率应参考像素密度⾼的。

在这⾥⽔平像素密度和垂直像素密度都是 250pixel/mm ,所以镜头分辨率应选 125 lp/mm。

如果⼀个 2 百万像素摄像机感光⾯尺⼨是 1/3 吋, 1/3 吋的感光⾯它⽔平尺⼨是4.8mm,垂直尺⼨是 3.6mm,它的⽔平像素密度是1600/4.8=333.3 pixel/mm ,垂直像素密度是 1200/3.6=333.3 pixel/mm ,所以镜头分辨率应选 167 lp/mm。

基于像元形状指数方法的高空间分辨率遥感影像分类

收稿日期:2018-02-13*基金项目:陕西省土地工程建设集团科研项目“基于GIS和RS技术的地形因子与丘陵沟壑区土体侵蚀的相关性研究”(DJNY2018-22)作者简介:孔辉(1990—),男,陕西西安人,硕士,助理工程师,主要从事土地工程技术及研究。

在遥感影像的空间分辨率提升越来越快,且内部能提供的空间特征也越来丰富的时候,也带来了不少对于图像信息,光谱分辨率质量的问题,使得在影像分类中对于精度的把握出现了很多问题。

我们如何结束不同的方法来对难以通过光谱特征来描述的高分影像的纹理、形状结构、几何特征等物体变的至关重要。

本文便是利用一种基于像元形状指数的方法对上述所说的影响的特点进行描述,比弥补传统光谱信息提取方法的不足。

1 像元形状指数像元形状指数,简称为PSI(Pixel Shape Index),它是以设计原则为基础,定义了一系列穿过中心像元的方向线,将这些方向线集合构造多维特征,即像元形状指数,对高空间分辨率遥感影像的光谱特征进行补充。

1.1 方向线的提取某个像元的PSI特征某种意义上讲就是该像元的方向线集合的特征,因此提取PSI首先在于方向线的提取。

定义方向线为由中心像元),(centercenteryx出发向两端扩展的D条夹角为D的线段,第i条线段扩展的条件。

1.2 PSI特征的提取在得到了任意像元),(ji的方向线集合,此时计算方向线集合中每条方向线的长度,得到了任意像元),(ji的方向线长度序列],...,,[),(21Ddddjid 。

根据像元的方向线长度序列。

2 用于对比的特征提取方法2.1 小波纹理特征方法小波文理特征是一种常见的影响纹理特征提取的方法,其优势在与在一定尺度下,能细粒度的分离细节信息,对于空间的信号变化有极强的识别能力,敏感性很高,因此,我们通常可以把小波纹理提取法视作一种在某尺度上的纹理测度。

它将影像中的每个像元对应一个窗口,将小波变换的子影像的能量值作为特征向量。

工业相机 像元尺寸

工业相机像元尺寸

工业相机的像元尺寸是指传感器上每个像素的物理尺寸,通常

以微米(μm)为单位。

像元尺寸对于工业相机的性能和图像质量至

关重要。

较大的像元尺寸通常意味着更高的光子收集能力,可以提

供更好的低光性能和动态范围。

此外,较大的像元尺寸还有助于减

少图像噪声,并提高相机的灵敏度和分辨率。

在工业相机中,常见的像元尺寸包括1/3英寸、1/2.5英寸、

1/2英寸、2/3英寸、1英寸等,这些尺寸通常与传感器的物理尺寸

相关。

较小的像元尺寸适合于紧凑型相机和成本较低的应用,而较

大的像元尺寸则常用于需要高质量图像的工业应用,如机器视觉、

自动化检测等领域。

除了像元尺寸外,工业相机的像素数量也会影响图像质量。

较

高的像素数量可以提供更高的分辨率和细节捕捉能力,但也会增加

数据处理和存储的要求。

因此,在选择工业相机时,需要综合考虑

像元尺寸、像素数量以及其他性能指标,以满足具体应用的需求。

总之,工业相机的像元尺寸是影响其性能和图像质量的重要因素,合理选择像元尺寸可以提高相机在工业应用中的表现和适用性。

遥感影像的比例尺和分辨率的关系

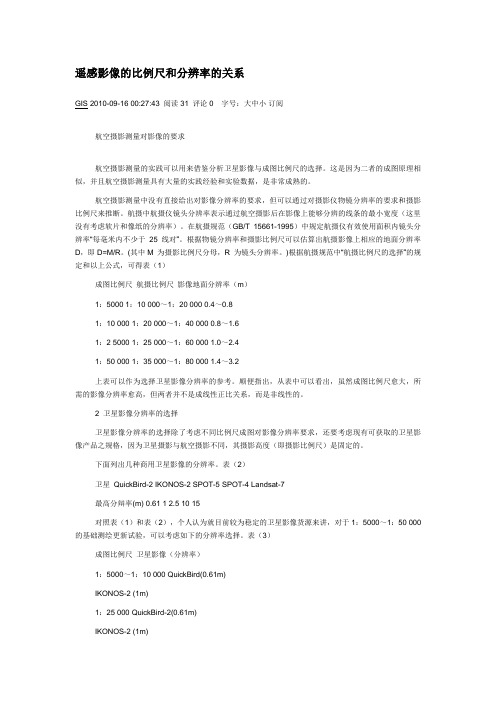

遥感影像的比例尺和分辨率的关系GIS 2010-09-16 00:27:43 阅读31 评论0 字号:大中小订阅航空摄影测量对影像的要求航空摄影测量的实践可以用来借鉴分析卫星影像与成图比例尺的选择。

这是因为二者的成图原理相似,并且航空摄影测量具有大量的实践经验和实验数据,是非常成熟的。

航空摄影测量中没有直接给出对影像分辨率的要求,但可以通过对摄影仪物镜分辨率的要求和摄影比例尺来推断。

航摄中航摄仪镜头分辨率表示通过航空摄影后在影像上能够分辨的线条的最小宽度(这里没有考虑软片和像纸的分辨率)。

在航摄规范(GB/T 15661-1995)中规定航摄仪有效使用面积内镜头分辨率“每毫米内不少于25 线对”。

根据物镜分辨率和摄影比例尺可以估算出航摄影像上相应的地面分辨率D,即D=M/R。

(其中M 为摄影比例尺分母,R 为镜头分辨率。

)根据航摄规范中“航摄比例尺的选择”的规定和以上公式,可得表(1)成图比例尺航摄比例尺影像地面分辨率(m)1:5000 1:10 000~1:20 000 0.4~0.81:10 000 1:20 000~1:40 000 0.8~1.61:2 5000 1:25 000~1:60 000 1.0~2.41:50 000 1:35 000~1:80 000 1.4~3.2上表可以作为选择卫星影像分辨率的参考。

顺便指出,从表中可以看出,虽然成图比例尺愈大,所需的影像分辨率愈高,但两者并不是成线性正比关系,而是非线性的。

2 卫星影像分辨率的选择卫星影像分辨率的选择除了考虑不同比例尺成图对影像分辨率要求,还要考虑现有可获取的卫星影像产品之规格,因为卫星摄影与航空摄影不同,其摄影高度(即摄影比例尺)是固定的。

下面列出几种商用卫星影像的分辨率。

表(2)卫星QuickBird-2 IKONOS-2 SPOT-5 SPOT-4 Landsat-7最高分辩率(m) 0.61 1 2.5 10 15对照表(1)和表(2),个人认为就目前较为稳定的卫星影像货源来讲,对于1:5000~1:50 000 的基础测绘更新试验,可以考虑如下的分辨率选择。

ccd像元尺寸计算

ccd像元尺寸计算CCD像元尺寸是指CCD(Charge-Coupled Device,电荷耦合器件)图像传感器上一个像元的尺寸大小。

在数字相机、摄像机以及其他图像采集设备中,CCD图像传感器是将光信号转换为电信号的核心部件之一。

像元是构成图像的最基本单元,像元的大小直接影响图像的清晰度和细节捕捉能力。

CCD像元的尺寸通常以微米(μm)为单位进行描述。

一个常见的CCD像元尺寸是5.6μm×5.6μm。

这意味着每个像元的边长都是5.6微米,而像元的面积则为31.36平方微米。

CCD像元尺寸的大小对图像质量有着重要的影响。

较大的像元尺寸可以捕捉更多的光线,因此具有更好的低光照性能和动态范围。

这意味着在暗光环境下,相机可以更好地还原细节并减少噪点。

此外,较大的像元尺寸还能提供更好的色彩还原能力和图像清晰度。

然而,较大的像元尺寸也会对图像分辨率产生一定的影响。

相同像素数量的CCD传感器,如果像元尺寸较大,那么图像的分辨率会相对较低。

这是因为较大的像元会占据更多的传感器面积,导致单位面积上的像元数量减少。

因此,在选择相机或其他图像采集设备时,需要根据实际需求和使用场景权衡像元尺寸和分辨率之间的关系。

除了像元尺寸,CCD图像传感器的像素总数也是影响图像质量的重要因素之一。

较高的像素总数可以提供更高的图像分辨率,更多的细节和更精确的图像还原能力。

然而,高像素总数也会导致图像文件的体积增大,处理速度变慢,以及在低光照环境下噪点增加等问题。

因此,在选择相机或其他图像采集设备时,需要考虑到像素总数与图像质量之间的平衡。

CCD像元尺寸是衡量图像传感器性能的重要指标之一。

较大的像元尺寸可以提供更好的低光照性能和动态范围,但可能会牺牲一定的图像分辨率。

在选择相机或其他图像采集设备时,需要根据实际需求和使用场景综合考虑像元尺寸、像素总数以及其他参数,以获得最佳的图像质量和拍摄效果。

dem分辨率和比例尺的计算公式

dem分辨率和比例尺的计算公式DEM分辨率和比例尺的计算公式一、引言在地理信息系统(GIS)领域中,DEM(Digital Elevation Model)即数字高程模型,用来表示地表的高程信息。

DEM分辨率和比例尺是衡量DEM精度和空间分辨率的重要指标。

本文将介绍DEM分辨率和比例尺的计算公式,并解释其含义和应用。

二、DEM分辨率的计算公式DEM分辨率是指DEM中每个像元(Pixel)所代表的地面范围。

常用的DEM分辨率单位有米和度。

假设DEM的水平分辨率为H_res,垂直分辨率为V_res,则DEM分辨率的计算公式如下:DEM分辨率= H_res × V_res其中,H_res和V_res分别是DEM在水平和垂直方向上的分辨率。

三、比例尺的计算公式比例尺是指地图上距离与实际地面距离之间的比例关系。

比例尺可以表示为分数形式或比例形式。

在GIS中,比例尺通常表示为1:N 的形式,表示地图上的一单位距离对应实际地面上的N单位距离。

假设地图上的一单位距离为D_map,实际地面上的距离为D_ground,则比例尺的计算公式如下:比例尺 = D_map / D_ground = 1 / N其中,N是比例尺的分母,表示地图上的距离是实际地面上距离的多少倍。

四、DEM分辨率和比例尺的关系DEM分辨率和比例尺是两个不同的概念,但它们之间存在一定的关系。

通过比较DEM的分辨率和比例尺,可以了解到DEM在地图上所表示的地面范围和精度。

1. DEM分辨率和比例尺的关系DEM分辨率越高,表示每个像元所代表的地面范围越小,地图的细节表现能力越强。

而比例尺表示地图上的距离与实际地面距离之间的比例关系,比例尺越大,表示地图上的距离相对于实际地面距离越小,地图的细节表现能力也越强。

因此,DEM分辨率和比例尺都是衡量地图精度和细节表现能力的重要指标。

2. DEM分辨率和比例尺的应用DEM分辨率和比例尺在地理信息系统中有着广泛的应用。

地面分辨率名词解释

地面分辨率名词解释

地面分辨率是指遥感图像中一个像元所代表的实际地面面积大小。

通俗来说,就是遥感图像中每个像素所对应的实际地面面积大小。

地面分辨率不同,对应的图像信息就不同,反映出来的地物细节也不同。

地面分辨率的单位一般是米/像素,也可以用千米/像素、公里/

像素等表示。

例如,1米/像素的地面分辨率,表示一张遥感图像中每个像素所对应的实际地面面积为1平方米。

地面分辨率的大小决定了遥感图像所能反映的地物细节。

一般来说,地面分辨率越小,遥感图像所反映的地物细节就越丰富。

例如,在1米/像素的遥感图像中,可以清晰地看到建筑物的

细节、道路的标线、车辆的型号等信息;而在10米/像素的遥

感图像中,这些信息就会模糊不清。

地面分辨率的大小与遥感技术密切相关。

在早期的遥感技术中,由于传感器分辨率较低,地面分辨率也比较大。

随着遥感技术的不断发展,传感器分辨率越来越高,地面分辨率也越来越小。

除了传感器分辨率外,地面分辨率还受到其他因素的影响,如飞行高度、拍摄角度等。

在相同传感器分辨率下,飞行高度越低,地面分辨率就越小;拍摄角度越垂直,地面分辨率也越小。

地面分辨率在很多领域都有应用。

例如,在城市规划中,可以利用高分辨率遥感图像对城市建筑物进行分类和测量;在农业生产中,可以利用高分辨率遥感图像对农田进行监测和评估;在环境监测中,可以利用高分辨率遥感图像对污染源进行识别和定位等。

总之,地面分辨率是遥感技术中非常重要的一个概念,它决定了遥感图像所能反映的地物细节和信息量。

在实际应用中,需要根据具体需求选择合适的地面分辨率,以获得最优的遥感图像效果。

像元与分辨率

像元——pixel,是栅格图像的基本单元。

像元-定义像元亦称像素或像元点。

即影像单元(pictureelement)。

是组成数字化影像的最小单元。

在遥感数据采集,如扫描成像时,它是传感器对地面景物进行扫描采样的最小单元;在数字图像处理中,它是对模拟影像进行扫描数字化时的采样点。

像元是反映影像特征的重要标志。

是同时具有空间特征和波谱特征的数据元。

几何意义是其数据值确定所代表的地面面积。

物理意义是其波谱变量代表该像元内在某一特定波段中波谱响应的强度。

即同一像元内的地物,只有一个共同灰度值。

像元大小决定了数字影像的影像分辨率和信息量。

像元小,影像分辨率高,信息量大;反之,影像分辨率低,信息量小。

如陆地卫星MSS影像像元为56×79平方米,单波段像元数为7581600;而TM影像像元大小为30×30平方米,单波段像元数为38023666,相当于MSS的5倍。

像元-像元分辨率分辨率是用于记录数据的最小度量单位,一般用来描述在显示设备上所能够显示的点的数(行、列),或在影像中一个像元点所表示的面积。

由于遥感拍摄的像片是由位于不同高度,装在不同载体(如飞机、卫星等)上的不同清晰度(分辨率)照相设备,以不同的照相(采集)方式,获取的遥感像片(图像、数据、影像等),这些遥感图像是具有不同清晰度、不同分辨率的照片。

类似我们在生活中用135照相机拍摄一棵树,从汽车上拍一张,然后再从飞机上拍一张,两张135底片在放大同一棵树时,其放大效果是不一样的。

肯定是高度低的135照片放大后的效果最清晰,也就是说分辨率最高。

遥感卫星的飞行高度一般在4000千米~600千米之间,图像分辨率一般从1千米~1米之间。

像元-图像分辨率图像分辨率是指,一个像元代表地面的面积的多少。

像元相当于电视屏幕上的一个点(电视是由若干个点组成的图像画面),相当于计算机显示屏幕上的一个象素,相当于一群举着不同色板拼成画图的人中的一个。

空间分辨率名词解释

空间分辨率名词解释空间分辨率是指遥感影像中能够区分和辨别地物对象的最小尺寸。

具体来说,就是在遥感图像中能够分辨出两个相邻地物之间的最小距离。

空间分辨率通常用来描述遥感影像的细节程度,也可以理解为影像中每个像素代表地表多大的面积。

较高的空间分辨率意味着每个像素代表的面积较小,即能够更细致地观察和分析地物特征;较低的空间分辨率则表示每个像素代表的面积较大,只能观察到较大尺度的地物特征。

空间分辨率受到遥感传感器的技术能力和参数限制,主要包括飞行高度、光学系统的焦距、探测器的像元尺寸等。

常见的遥感数据有不同的空间分辨率,例如Landsat卫星的TM (Thematic Mapper)传感器具有30米的空间分辨率,而高分辨率的SPOT卫星影像可以达到2.5米的空间分辨率。

空间分辨率对于遥感应用有重要意义。

较高的空间分辨率可以提供细粒度的地表信息,对城市规划、环境监测、土地利用等领域的研究具有很大的帮助。

例如,利用高空间分辨率的影像可以识别出道路、建筑物和绿化带等细节,从而更准确地评估城市的扩张和变化趋势。

而较低的空间分辨率则适用于较大尺度的地表研究,如区域的植被分布、农作物生长等。

除了遥感影像,空间分辨率也可以应用在其他地理信息系统(GIS)中。

在GIS中,空间分辨率可以指代栅格数据集中像元大小的定义,即每个像元代表的地理区域。

栅格数据集的空间分辨率会影响到分析和模型的精确性,因此,在进行空间分析和空间建模时,需要根据研究目的和数据可用性选择合适的空间分辨率。

总而言之,空间分辨率是遥感影像中能够区分和辨别地物对象最小的尺寸,它决定了影像中能够观察到的细节程度和地表特征的分辨能力。

在遥感和GIS应用中,对于不同的研究目的和数据需求,可以选择不同的空间分辨率来满足精度和效果的要求。

如何计算无人机分辨率的公式

如何计算无人机分辨率的公式无人机分辨率的计算公式如下:

分辨率GSD=H/d

其中,H为飞行高度,d为单位长度(cm)内的像素数量。

例如,如果飞行高度为1000米,像素尺寸为0.0056mm,则可以计算出地面分辨率:

GSD=1000/0.0056=178571(cm/pixel)

这个结果表示在178571平方厘米的地面范围内,只有一个像素。

因此,该无人机的地面分辨率可以达到厘米级精度。

此外,无人机的地面分辨率也可以使用其他公式计算,例如空间分辨率 d = s * H / f,其中s为像元大小(µm),H 为飞行高度(m),f为焦距(mm)。

这个公式可以用来计算无人机在不同飞行高度和焦距下的空间分辨率。

计算值像元大小xy

计算值像元大小xy

摘要:

1.计算值像元大小xy 的含义

2.计算值像元大小xy 的方法

3.应用价值和实际案例

正文:

一、计算值像元大小xy 的含义

计算值像元大小xy 是指在地理信息系统(GIS)中,通过一定的计算方法得到像元(像素)的大小。

其中,x 代表像元的行号,y 代表像元的列号。

像元大小通常用来描述遥感图像或者地图图像的空间分辨率,即图像中每个像素所代表的实际地面面积大小。

二、计算值像元大小xy 的方法

计算值像元大小xy 的方法通常分为以下两步:

1.确定像元的行列号。

在GIS 软件中,通过读取遥感图像或地图图像的属性,可以获取图像的行列号信息。

2.计算像元大小。

根据像元的行列号,可以通过以下公式计算像元大小:

像元大小= 图像分辨率/ (图像行数* 图像列数)

其中,图像分辨率是指图像的宽度和高度,通常以像素为单位。

图像行数和图像列数是指图像的行数和列数。

三、应用价值和实际案例

计算值像元大小xy 在地理信息系统中有广泛的应用,如:

1.评估图像的空间分辨率。

通过计算像元大小,可以了解图像的空间分辨率,从而为遥感图像的选用和处理提供依据。

2.计算图像中某个区域的像素数量。

通过计算像元大小,可以快速估算某个区域的像素数量,从而为图像的缩放、裁剪等操作提供参考。

3.制图和可视化。

在GIS 软件中,通过计算像元大小,可以为不同分辨率的图像设置合适的比例尺,使得地图制图和可视化效果更加精细。

实际案例:假设有一张遥感图像,分辨率为500x500 像素,图像行数为500,图像列数为500。

空间分辨率的单位

空间分辨率的单位引言在遥感领域,空间分辨率是指遥感图像所能分辨的最小空间细节的能力。

它是评估遥感图像质量和解译能力的重要指标之一。

空间分辨率的单位是用来衡量图像中一个像素所表示的实际地面区域的大小。

本文将介绍空间分辨率的单位及其在遥感中的应用。

像素和分辨率在遥感图像中,图像被分割成一个个小方块,每个小方块被称为像素。

像素是图像的最小单位,它可以表示图像中的一个点或一个区域。

像素的大小是由空间分辨率决定的。

空间分辨率通常用于描述遥感图像中一个像素所代表的实际地面区域的大小。

它是指在地面上,一个像素所对应的长度或面积。

常见的空间分辨率的单位有米、千米和像素等。

空间分辨率的单位米米是最常用的空间分辨率单位之一。

它表示一个像素在地面上所代表的线性距离。

例如,一个1米的空间分辨率意味着一个像素代表地面上1米的距离。

米是一种常见的单位,能够提供较高的精度和细节。

千米千米是用来表示较大范围的空间分辨率的单位。

它表示一个像素在地面上所代表的线性距离。

例如,一个1千米的空间分辨率意味着一个像素代表地面上1千米的距离。

千米适用于大范围的遥感应用,如地理信息系统(GIS)中的地图制作和区域规划。

像素像素是另一种常见的空间分辨率单位。

它表示一个像素所代表的地面区域的面积。

像素的大小通常以平方米为单位。

例如,一个1平方米的空间分辨率意味着一个像素代表地面上1平方米的区域。

像素适用于遥感图像分类和对象提取等应用。

空间分辨率的计算空间分辨率的计算可以通过遥感图像的像元大小和传感器的分辨率来实现。

像元大小是指遥感图像中一个像元的实际大小。

它可以通过图像的分辨率和图像的尺寸来计算。

例如,一个1000x1000像素的图像,其尺寸为1千米x1千米,那么像元大小就是1米x1米。

传感器的分辨率是指传感器在水平和垂直方向上能够分辨的最小细节。

传感器的分辨率通常以米为单位。

例如,一个传感器的分辨率为1米,那么它能够分辨的最小细节就是1米。

空间分辨率的计算公式为:空间分辨率 = 像元大小 / 传感器分辨率空间分辨率的应用空间分辨率在遥感中有着广泛的应用。

科学相机的像元尺寸如何选择?

像元尺寸是什么,科学相机的像元尺寸如何选择?像元尺寸是指传感器上单位像元的物理宽度和高度,单位一般是微米(μm),它既能影响相机的灵敏度,也会影响相机捕获细节(采样率)的能力,是成像应用系统最重要的相机参数之一。

传感器像元尺寸很重要,但实际应用中,经过光学系统放大后得到的图像像素大小才是真正决定相机的成像特性的关键。

图像像素大小是通过将传感器像元尺寸除以总系统放大倍率来计算得出的。

图像像素大小=传感器像元尺寸/光学系统总放大倍率因此,不同光学系统由于总放大倍率的影响因素不同,对于像元尺寸的选择也会存在显著差异。

对于可以灵活调整焦距和成像距离的光学系统,我们通常可以通过靠近或远离成像对象,或使用变焦镜头来改变放大倍率,所以我们传感器像元尺寸的选型可以结合现场实际情况做出灵活调整。

而对于显微镜这类光学系统而言,由于物镜的焦距和成像对象的距离都是固定的,所以我们可以认为更大的像元可以帮助收集更多的光子,芯片的灵敏度也越高,这就好比你要收集雨水,水桶会比杯子更有效。

像元尺寸(面积)是一个重要因素,如果像元的X和Y方向的尺寸各提升两倍,则单像素的面积相当于提升了四倍,可以帮助收集四倍数量的光子。

在弱光成像的应用中,增加像素尺寸可以大大提高相机的感光度,提升灵敏度,从而减少曝光时间、降低对光照条件的要求。

但在这些固定倍率的光学系统中,大像素也有缺点。

它可能会影响图像中精细细节的解析能力。

如果图像像素越大,图像的“像素化”程度就越大。

假设图像中的一个像素宽度只有1μm,它就无法分辨小于2μm的细节信息,因为相邻的细节特征会模糊成一个整体。

另外要注意的是,相机像元大小并不是解析精细细节、提高采样率的唯一限制因素,光学系统也会对其有所限制。

每个光学系统都有一个对应的最小像素尺寸,这种情况下,即使选择更小像元尺寸的相机,不仅细节分辨率不会有所提升,还会降低成像灵敏度。

在使用显微镜物镜的光学系统中,这种限制主要由物镜的数值孔径(NA)决定。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

像元——pixel,是栅格图像的基本单元。

像元-定义

像元亦称像素或像元点。

即影像单元(pictureelement)。

是组成数字化影像的最小单元。

在遥感数据采集,如扫描成像时,它是传感器对地面景物进行扫描采样的最小单元;在数字图像处理中,它是对模拟影像进行扫描数字化时的采样点。

像元是反映影像特征的重要标志。

是同时具有空间特征和波谱特征的数据元。

几何意义是其数据值确定所代表的地面面积。

物理意义是其波谱变量代表该像元内在某一特定波段中波谱响应的强度。

即同一像元内的地物,只有一个共同灰度值。

像元大小决定了数字影像的影像分辨率和信息量。

像元小,影像分辨率高,信息量大;反之,影像分辨率低,信息量小。

如陆地卫星MSS影像像元为56×79平方米,单波段像元数为7581600;而TM影像像元大小为30×30平方米,单波段像元数为,相当于MSS的5倍。

像元-像元分辨率

分辨率是用于记录数据的最小度量单位,一般用来描述在显示设备上所能够显示的点的数(行、列),或在影像中一个像元点所表示的面积。

由于遥感拍摄的像片是由位于不同高度,装在不同载体(如飞机、卫星等)上的不同清晰度(分辨率)照相设备,以不同的照相(采集)方式,获取的遥感像片(图像、数据、影像等),这些遥感图像是具有不同清晰度、不同分辨率的照片。

类似我们在生活中用135照相机拍摄一棵树,从汽车上拍一张,然后再从飞机上拍一张,两张135底片在放大同一棵树时,其放大效果是不一样的。

肯定是高度低的135照片放大后的效果最清晰,也就是说分辨率最高。

遥感卫星的飞行高度一般在4000千米~600千米之间,图像分辨率一般从1千米~1米之间。

像元-图像分辨率

图像分辨率是指,一个像元代表地面的面积的多少。

像元相当于电视屏幕上的一个点(电视

是由若干个点组成的图像画面),相当于计算机显示屏幕上的一个象素,相当于一群举着不同色板拼成画图的人中的一个。

当分辨率为1千米时,一个像元代表地面1千米X1千米的面积,即1平方千米;当分辨率为30米时,一个像元代表地面30米×30米的面积;当分辨率为1米时,也就是说,图像上的一个像元相当于地面1米x1米的面积,即1平方米。