贝叶斯网络模型代码

matlab贝叶斯算法

matlab贝叶斯算法一、引言随着科技的发展,人工智能、数据挖掘等领域的研究日益深入,贝叶斯算法作为一种基于概率推理的方法,在这些领域中得到了广泛的应用。

MATLAB 作为一款强大的数学软件,为贝叶斯算法的实现和应用提供了便利。

本文将介绍贝叶斯算法的原理,以及如何在MATLAB中实现和应用贝叶斯算法。

二、贝叶斯算法的原理1.贝叶斯定理贝叶斯定理是贝叶斯算法的基础,它描述了在已知某条件概率的情况下,求解相关联的逆条件概率。

贝叶斯定理的数学表达式为:P(A|B) = P(B|A) * P(A) / P(B)2.概率论基础贝叶斯算法涉及到的概率论基础包括概率分布、条件概率、独立性等概念。

在实际问题中,我们需要根据已知条件来计算概率分布,从而得出相关联的概率值。

三、MATLAB实现贝叶斯算法的方法1.贝叶斯网络贝叶斯网络是一种基于贝叶斯定理的图形化表示方法,它可以帮助我们构建复杂的问题模型。

在MATLAB中,可以使用Bayes Net Toolbox工具包来创建和计算贝叶斯网络。

2.极大似然估计极大似然估计是一种求解概率模型参数的方法。

在贝叶斯算法中,我们可以通过极大似然估计来优化模型参数,从而提高预测准确性。

在MATLAB中,可以使用统计工具箱中的极大似然估计函数进行计算。

3.朴素贝叶斯分类器朴素贝叶斯分类器是一种基于贝叶斯定理的分类方法,它要求特征之间相互独立。

在MATLAB中,可以使用朴素贝叶斯分类器进行文本分类、故障诊断等任务。

四、实例分析1.故障诊断应用贝叶斯算法在故障诊断领域具有广泛的应用。

通过建立故障诊断模型,可以对设备的故障进行预测和诊断。

例如,在MATLAB中,可以使用朴素贝叶斯分类器对轴承故障数据进行分类。

2.文本分类应用贝叶斯算法在文本分类领域也具有较高的准确率。

通过构建贝叶斯网络模型,可以对文本进行自动分类。

例如,在MATLAB中,可以使用朴素贝叶斯分类器对新闻分类数据进行分类。

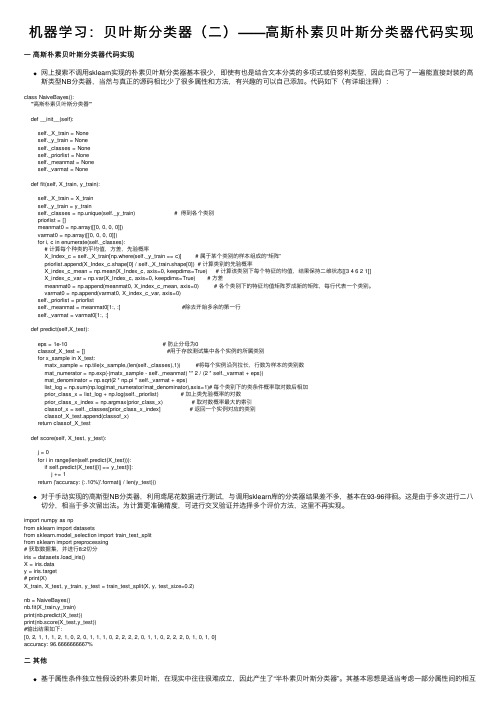

机器学习:贝叶斯分类器(二)——高斯朴素贝叶斯分类器代码实现

机器学习:贝叶斯分类器(⼆)——⾼斯朴素贝叶斯分类器代码实现⼀⾼斯朴素贝叶斯分类器代码实现⽹上搜索不调⽤sklearn实现的朴素贝叶斯分类器基本很少,即使有也是结合⽂本分类的多项式或伯努利类型,因此⾃⼰写了⼀遍能直接封装的⾼斯类型NB分类器,当然与真正的源码相⽐少了很多属性和⽅法,有兴趣的可以⾃⼰添加。

代码如下(有详细注释):class NaiveBayes():'''⾼斯朴素贝叶斯分类器'''def __init__(self):self._X_train = Noneself._y_train = Noneself._classes = Noneself._priorlist = Noneself._meanmat = Noneself._varmat = Nonedef fit(self, X_train, y_train):self._X_train = X_trainself._y_train = y_trainself._classes = np.unique(self._y_train) # 得到各个类别priorlist = []meanmat0 = np.array([[0, 0, 0, 0]])varmat0 = np.array([[0, 0, 0, 0]])for i, c in enumerate(self._classes):# 计算每个种类的平均值,⽅差,先验概率X_Index_c = self._X_train[np.where(self._y_train == c)] # 属于某个类别的样本组成的“矩阵”priorlist.append(X_Index_c.shape[0] / self._X_train.shape[0]) # 计算类别的先验概率X_index_c_mean = np.mean(X_Index_c, axis=0, keepdims=True) # 计算该类别下每个特征的均值,结果保持⼆维状态[[3 4 6 2 1]]X_index_c_var = np.var(X_Index_c, axis=0, keepdims=True) # ⽅差meanmat0 = np.append(meanmat0, X_index_c_mean, axis=0) # 各个类别下的特征均值矩阵罗成新的矩阵,每⾏代表⼀个类别。

贝叶斯优化的bpnn模型python代码-概述说明以及解释

贝叶斯优化的bpnn模型python代码-概述说明以及解释1.引言1.1 概述在这个部分,你可以描述贝叶斯优化和BP神经网络模型的基本概念和背景。

可以简要介绍贝叶斯优化是一种基于概率和贝叶斯理论的优化方法,用于在给定的限制条件下寻找最优解。

同时也可以介绍BP神经网络是一种常用的人工神经网络模型,用于解决分类和回归等问题。

你可以讨论贝叶斯优化和BP神经网络在不同领域的应用,以及它们之间结合起来的潜在优势。

可以指出这种结合可以帮助优化神经网络的超参数,提高训练效率和准确性。

最后,可以强调本文旨在探讨如何使用贝叶斯优化优化BP神经网络的参数,以提高其性能和应用范围。

1.2文章结构1.2 文章结构本文主要分为引言、正文和结论三部分。

具体结构安排如下:引言部分将会首先概述贝叶斯优化和BP神经网络,并介绍本文的研究目的。

正文部分主要分为三个小节。

首先是贝叶斯优化简介,介绍这一优化方法的原理和应用场景;接着是BP神经网络模型概述,解释BP神经网络的基本原理和结构;最后是结合贝叶斯优化和BP神经网络的优势,探讨将两者结合应用的好处和可行性。

结论部分将总结贝叶斯优化在BP神经网络中的应用情况,展望未来研究方向,并对整个文章进行总结概括。

1.3 目的:本文旨在探讨贝叶斯优化在BP神经网络中的应用,并分析结合两者的优势。

通过对贝叶斯优化和BP神经网络的简介,以及它们各自的优势进行论述,旨在为读者提供一个全面的了解和认识。

同时,本文也将总结贝叶斯优化在BP神经网络中的实际应用和未来研究方向,为相关领域的研究者和从业者提供参考和启发。

通过本文的阐述,希望能够为贝叶斯优化和BP神经网络的进一步研究和应用提供一定的指导和帮助。

2.正文2.1 贝叶斯优化简介:贝叶斯优化是一种通过在可能的目标函数空间中建立高斯过程来优化目标函数的方法。

其主要思想是在探索和利用之间进行权衡,通过不断地试验目标函数来找到最优解。

贝叶斯优化通常用于处理黑箱函数,即目标函数的具体形式未知,只能通过输入输出的对应关系进行观测。

动态贝叶斯网络DBN

动态贝叶斯网络DBN2008年12月08日星期一 14:49贝叶斯网络(Bayesian Networks)也被称为信念网络(Belif Networks)或者因果网络(Causal Networks),是描述数据变量之间依赖关系的一种图形模式,是一种用来进行推理的模型。

贝叶斯网络为人们提供了一种方便的框架结构来表示因果关系,这使得不确定性推理变得在逻辑上更为清晰、可理解性强。

对于贝叶斯网络,我们可以用两种方法来看待它:首先贝叶斯网表达了各个节点间的条件独立关系,我们可以直观的从贝叶斯网当中得出属性间的条件独立以及依赖关系;另外可以认为贝叶斯网用另一种形式表示出了事件的联合概率分布,根据贝叶斯网的网络结构以及条件概率表(CPT)我们可以快速得到每个基本事件(所有属性值的一个组合)的概率。

贝叶斯学习理论利用先验知识和样本数据来获得对未知样本的估计,而概率(包括联合概率和条件概率)是先验信息和样本数据信息在贝叶斯学习理论当中的表现形式。

贝叶斯网络由以下两部分组成:贝叶斯网的网络结构是一个有向无环图(Directed Acyclic Graph),其中每个结点代表一个属性或者数据变量,结点间的弧代表属性(数据变量)间的概率依赖关系。

一条弧由一个属性(数据变量)A指向另外一个属性(数据变量)B说明属性A的取值可以对属性B的取值产生影响,由于是有向无环图,A、B间不会出现有向回路。

在贝叶斯网当中,直接的原因结点(弧尾)A叫做其结果结点(弧头)B的双亲结点(parents),B叫做A的孩子结点(children)。

如果从一个结点X有一条有向通路指向Y,则称结点X为结点Y的祖先(ancestor),同时称结点Y为结点X的后代(descendent)。

我们用下面的例子来具体说明贝叶斯网的结构:图2.1 简单的贝叶斯网模型图2.1中共有五个结点和五条弧。

下雪A1是一个原因结点,它会导致堵车A2和摔跤A3。

而我们知道堵车A2和摔跤A3都可能最终导致上班迟到A4。

概率图模型中的贝叶斯网络建模方法解析(Ⅲ)

概率图模型中的贝叶斯网络建模方法解析概率图模型是一种用来描述随机变量之间关系的工具,它可以帮助我们理解复杂系统中的概率分布和因果关系。

其中,贝叶斯网络是一种常用的概率图模型,它能够有效地表示变量之间的依赖关系,并且在推断、预测等领域有着广泛的应用。

本文将介绍贝叶斯网络的建模方法,帮助读者更好地理解和应用这一重要的概率图模型。

贝叶斯网络是由节点和有向边构成的有向图,其中节点表示随机变量,有向边表示变量之间的依赖关系。

贝叶斯网络中的节点可以分为两类:随机变量节点和参数节点。

随机变量节点表示我们感兴趣的变量,而参数节点则表示这些变量之间的依赖关系的参数。

贝叶斯网络通过条件概率分布来描述节点之间的依赖关系,每个节点的条件概率分布都是给定其父节点时的条件概率分布。

贝叶斯网络的建模方法主要包括确定网络结构和参数估计两个步骤。

在确定网络结构时,我们需要考虑两个方面的因素:变量之间的因果关系和观测数据的分布。

变量之间的因果关系可以通过领域知识或实验数据来确定,而观测数据的分布则可以通过统计方法来估计。

一般来说,我们可以通过分析变量之间的相关性,来确定网络中的有向边。

此外,我们还可以使用一些自动学习算法,如基于信息论的方法或基于约束条件的方法,来帮助确定网络结构。

在参数估计方面,我们需要根据实际观测数据来估计节点之间的条件概率分布。

一种常用的方法是最大似然估计,通过最大化观测数据的似然函数来估计网络中的参数。

另一种方法是贝叶斯估计,它可以用来对参数进行先验分布的建模,并通过观测数据来更新参数的后验分布。

贝叶斯估计可以有效地处理数据稀疏和参数过拟合的问题,但它需要对参数的先验分布进行假设,这可能会引入一定的主观性。

在贝叶斯网络的建模过程中,我们还需要考虑一些常见的问题,如遗漏变量、共线性和因果关系的确定。

遗漏变量是指在网络中没有被考虑到的变量,它可能会导致对网络结构和参数的估计出现偏差。

共线性是指变量之间存在高度相关性,它可能会导致参数估计不稳定。

贝叶斯网络Matlab

Matlab贝叶斯网络建模1 FullBNT简介基于Matlab的贝叶斯网络工具箱BNT是kevin p.murphy基于matlab语言开发的关于贝叶斯网络学习的开源软件包,提供了许多贝叶斯网络学习的底层基础函数库,支持多种类型的节点(概率分布)、精确推理和近似推理、参数学习及结构学习、静态模型和动态模型。

1.1贝叶斯网络表示BNT中使用矩阵方式表示贝叶斯网络,即若节点i到j有一条弧,则对应矩阵中值为1,否则为0。

1.2结构学习算法函数BNT中提供了较为丰富的结构学习函数,都有:1. 学习树扩展贝叶斯网络结构的算法.2. 数据完整条件下学习一般贝叶斯网络结构学习算法表1-1 数据完整条件下贝叶斯结构算法算法名称调用函数K2算法learn_struct_k2()贪婪搜索GS(greedy search)算法earn_struct_gs()3. 缺失数据条件下学习一般贝叶斯网络结构学习算法表1-2 缺失数据条件下贝叶斯结构算法1.3参数学习算法函数1. BNT中也提供了丰富的参数学习函数,都有:2. 完整数据时,学习参数的方法主要有两种:最大似然估计learn_params()和贝叶斯方法bayes_update_params();3. 数据缺失时,如果已知网络拓扑结构,用EM算法来计算参数,learn_params_em ()。

1.4推理机制及推理引擎为了提高运算速度,使各种推理算法能够有效应用,BNT工具箱采用了引擎机制,不同的引擎根据不同的算法来完成模型转换、细化和求解。

这个推理过程如下:BNT中提供了多种推理引擎,都有:表1-3 BNT推理引擎算法名称调用函数联合树推理引擎jtree_inf_engine()全局联合树推理引擎global_joint_inf_engine()信念传播推理引擎belprop_inf_engine()变量消元推理引擎var_elim_inf_engine()采样传播引擎gibbs_sampling_inf_engine2 参数学习在BNT中,参数评估程序可以分为4类。

马尔可夫网络与贝叶斯网络的比较(Ⅲ)

马尔可夫网络和贝叶斯网络是两种常用的概率图模型,它们在处理不确定性和推理方面有着广泛的应用。

本文将对这两种网络模型进行比较,从原理、应用、优缺点等几个方面进行讨论。

1. 原理马尔可夫网络(Markov Network)是由一组随机变量构成的图模型,其中节点表示随机变量,边表示变量之间的依赖关系。

马尔可夫网络基于马尔可夫性质,即给定一个节点的状态,它的概率分布只与其邻居节点的状态有关。

因此,马尔可夫网络可以用条件概率分布来表示节点之间的依赖关系。

贝叶斯网络(Bayesian Network)也是一种概率图模型,它由一组节点和有向边构成。

节点表示随机变量,有向边表示变量之间的因果关系。

贝叶斯网络基于贝叶斯定理,可以用联合概率分布和条件概率分布来表示节点之间的依赖关系。

2. 应用马尔可夫网络常用于建模复杂系统的状态空间,例如自然语言处理、计算机视觉和社交网络分析等领域。

马尔可夫网络的一个经典应用是隐马尔可夫模型(Hidden Markov Model, HMM),用于序列数据的建模和预测。

贝叶斯网络常用于建模复杂系统的因果关系,例如医学诊断、智能决策和风险分析等领域。

贝叶斯网络的一个经典应用是专家系统,用于知识表示和推理。

3. 优缺点马尔可夫网络的优点在于能够自然地建模节点的联合概率分布,适用于对状态空间的建模和推理。

然而,马尔可夫网络的缺点在于难以处理因果关系和条件独立性,需要更多的参数和计算资源。

贝叶斯网络的优点在于能够自然地建模节点的条件概率分布,适用于对因果关系的建模和推理。

然而,贝叶斯网络的缺点在于难以处理联合概率分布和复杂的因果关系,需要更多的先验知识和推理算法。

4. 结论马尔可夫网络和贝叶斯网络都是重要的概率图模型,在不同的领域和问题中有着各自的优势和局限。

在实际应用中,我们可以根据具体的问题和需求选择合适的网络模型,或者将两种模型结合起来,以更好地解决复杂的不确定性和推理问题。

希望本文的比较能够帮助读者更好地理解和应用马尔可夫网络和贝叶斯网络。

贝叶斯网络

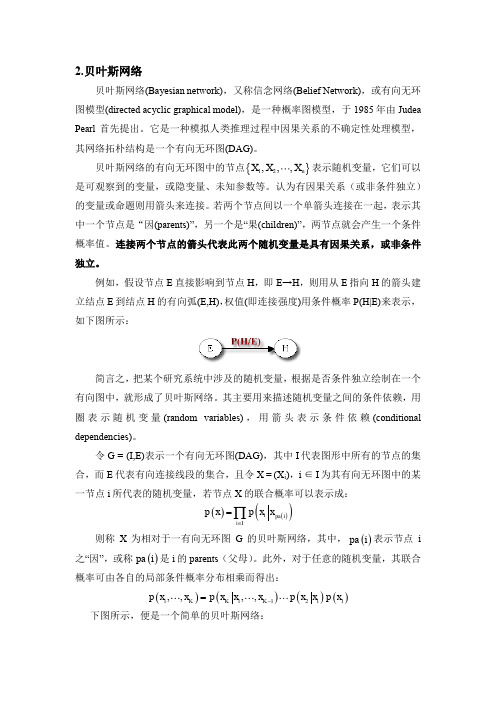

2.贝叶斯网络贝叶斯网络(Bayesian network),又称信念网络(Belief Network),或有向无环图模型(directed acyclic graphical model),是一种概率图模型,于1985年由Judea Pearl 首先提出。

它是一种模拟人类推理过程中因果关系的不确定性处理模型,其网络拓朴结构是一个有向无环图(DAG)。

贝叶斯网络的有向无环图中的节点{}12,,,n X X X 表示随机变量,它们可以是可观察到的变量,或隐变量、未知参数等。

认为有因果关系(或非条件独立)的变量或命题则用箭头来连接。

若两个节点间以一个单箭头连接在一起,表示其中一个节点是“因(parents)”,另一个是“果(children)”,两节点就会产生一个条件概率值。

连接两个节点的箭头代表此两个随机变量是具有因果关系,或非条件独立。

例如,假设节点E 直接影响到节点H ,即E→H ,则用从E 指向H 的箭头建立结点E 到结点H 的有向弧(E,H),权值(即连接强度)用条件概率P(H|E)来表示,如下图所示:简言之,把某个研究系统中涉及的随机变量,根据是否条件独立绘制在一个有向图中,就形成了贝叶斯网络。

其主要用来描述随机变量之间的条件依赖,用圈表示随机变量(random variables),用箭头表示条件依赖(conditional dependencies)。

令G = (I,E)表示一个有向无环图(DAG),其中I 代表图形中所有的节点的集合,而E 代表有向连接线段的集合,且令X = (X i ),i ∈ I 为其有向无环图中的某一节点i 所代表的随机变量,若节点X 的联合概率可以表示成:()()()i pa i i Ip x p x x ∈=∏则称X 为相对于一有向无环图G 的贝叶斯网络,其中,()pa i 表示节点i 之“因”,或称()pa i 是i 的parents (父母)。

此外,对于任意的随机变量,其联合概率可由各自的局部条件概率分布相乘而得出:()()()()111211,,,,K K K p x x p x x x p x x p x -=下图所示,便是一个简单的贝叶斯网络:因为a 导致b ,a 和b 导致c ,所以有:()()()(),,,p a b c p c a b p b a p a =2.1贝叶斯网络的3种结构形式:给定如下图所示的一个贝叶斯网络:(1) x 1, x 2 , …,x 7的联合分布为:()()()()()()()()1234567123412351364745,,,,,,,,,,p x x x x x x x p x p x p x p x x x x p x x x p x x p x x x =(2)x 1和x 2独立(对应head-to-head );(3)x 6和x 7在x 4给定的条件下独立(对应tail-to-tail )根据上图,第(1)点可能很容易理解,但第(2)、(3)点中所述的条件独立是啥意思呢?其实第(2)、(3)点是贝叶斯网络中3种结构形式中的其中二种。

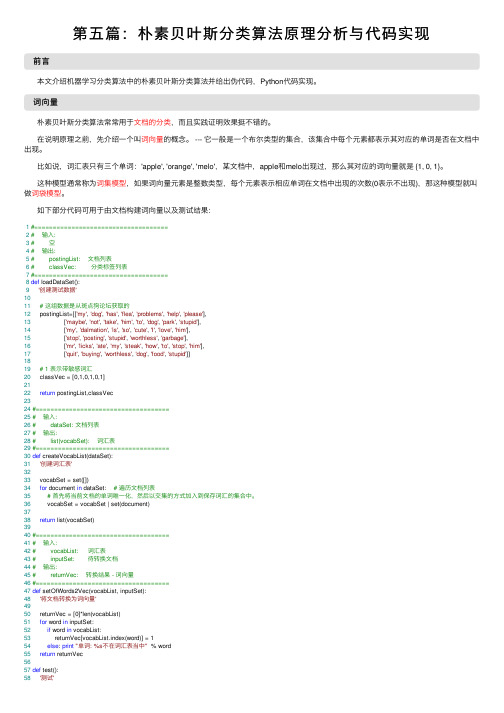

第五篇:朴素贝叶斯分类算法原理分析与代码实现

第五篇:朴素贝叶斯分类算法原理分析与代码实现前⾔本⽂介绍机器学习分类算法中的朴素贝叶斯分类算法并给出伪代码,Python代码实现。

词向量朴素贝叶斯分类算法常常⽤于⽂档的分类,⽽且实践证明效果挺不错的。

在说明原理之前,先介绍⼀个叫词向量的概念。

--- 它⼀般是⼀个布尔类型的集合,该集合中每个元素都表⽰其对应的单词是否在⽂档中出现。

⽐如说,词汇表只有三个单词:'apple', 'orange', 'melo',某⽂档中,apple和melo出现过,那么其对应的词向量就是 {1, 0, 1}。

这种模型通常称为词集模型,如果词向量元素是整数类型,每个元素表⽰相应单词在⽂档中出现的次数(0表⽰不出现),那这种模型就叫做词袋模型。

如下部分代码可⽤于由⽂档构建词向量以及测试结果:1#====================================2# 输⼊:3# 空4# 输出:5# postingList: ⽂档列表6# classVec: 分类标签列表7#====================================8def loadDataSet():9'创建测试数据'1011# 这组数据是从斑点狗论坛获取的12 postingList=[['my', 'dog', 'has', 'flea', 'problems', 'help', 'please'],13 ['maybe', 'not', 'take', 'him', 'to', 'dog', 'park', 'stupid'],14 ['my', 'dalmation', 'is', 'so', 'cute', 'I', 'love', 'him'],15 ['stop', 'posting', 'stupid', 'worthless', 'garbage'],16 ['mr', 'licks', 'ate', 'my', 'steak', 'how', 'to', 'stop', 'him'],17 ['quit', 'buying', 'worthless', 'dog', 'food', 'stupid']]1819# 1 表⽰带敏感词汇20 classVec = [0,1,0,1,0,1]2122return postingList,classVec2324#====================================25# 输⼊:26# dataSet: ⽂档列表27# 输出:28# list(vocabSet): 词汇表29#====================================30def createVocabList(dataSet):31'创建词汇表'3233 vocabSet = set([])34for document in dataSet: # 遍历⽂档列表35# ⾸先将当前⽂档的单词唯⼀化,然后以交集的⽅式加⼊到保存词汇的集合中。

朴素贝叶斯c代码实现

朴素贝叶斯c代码实现朴素贝叶斯分类器是一种常见的文本分类算法,它的主要思想是利用贝叶斯定理计算出文本属于某个类别的概率,然后选择概率最大的类别作为分类结果。

以下是一个使用 C 语言实现朴素贝叶斯分类器的示例代码:```c#include <stdio.h>#include <stdlib.h>#include <string.h>#include <math.h>#define MAX_FEATURES 1000#define MAX_SAMPLES 1000int num_features; // 特征数int num_samples; // 样本数int num_classes; // 类别数// 存储训练数据void train_data(char filename[]) {FILE *file = fopen(filename, "r");if (file == NULL) {printf("无法打开文件\n");exit(1);}char line[MAX_FEATURES];while (fgets(line, sizeof(line), file)) {char *token = strtok(line, "\t");if (token == NULL) {continue;}int feature = atoi(token);token = strtok(NULL, "\t");if (token == NULL) {continue;}int classlabel = atoi(token);add_sample(feature, classlabel);}fclose(file);}// 添加样本到训练数据中void add_sample(int feature, int classlabel) { if (num_samples >= MAX_SAMPLES) {printf("达到最大样本数\n");exit(1);}sample[num_samples].feature = feature;sample[num_samples].classlabel = classlabel; num_samples++;}// 对训练数据进行朴素贝叶斯分类void naive_bayes() {int i, j;double p[MAX_FEATURES];double likehood[MAX_FEATURES][num_classes]; // 初始化概率for (i = 0; i < num_features; i++) {p[i] = 1.0 / num_features;for (j = 0; j < num_classes; j++) {likehood[i][j] = 1.0;}}for (i = 0; i < num_samples; i++) {int feature = sample[i].feature;int classlabel = sample[i].classlabel;for (j = 0; j < num_features; j++) {if (j == feature) {likehood[j][classlabel] *= p[j];} else {likehood[j][classlabel] *= (1 - p[j]);}}for (j = 0; j < num_classes; j++) {p[j] *= num_samples / (num_samples + 1);p[j] += likehood[j][classlabel] / num_samples;}}// 分类结果int test_feature;printf("请输入测试特征:");scanf("%d", &test_feature);double max_prob = 0.0;int max_class = 0;for (i = 0; i < num_classes; i++) {double prob = p[test_feature] * likehood[test_feature][i]; if (prob > max_prob) {max_prob = prob;max_class = i;}}printf("属于类别%d 的概率最大\n", max_class);}int main() {// 特征数num_features = 5;// 样本数num_samples = 10;// 类别数num_classes = 3;// 训练数据文件名char filename[] = "train_data.txt";// 训练数据train_data(filename);// 朴素贝叶斯分类naive_bayes();return 0;}```在上述代码中,定义了一个`MAX_FEATURES`常量,表示特征的最大数量,`MAX_SAMPLES`常量,表示样本的最大数量,`num_features`,`num_samples`和`num_classes`分别表示特征数、样本数和类别数。

贝叶斯网络的采样方法(九)

贝叶斯网络的采样方法贝叶斯网络是一种用来描述变量之间依赖关系的概率图模型,它使用有向无环图来表示变量之间的依赖关系,通过概率分布来描述变量之间的联合概率分布。

贝叶斯网络常用于机器学习、人工智能等领域,具有很强的表达能力和推理能力。

在实际应用中,贝叶斯网络需要通过对变量进行采样来进行推断,即根据当前已有的变量值,生成符合联合概率分布的新样本。

本文将介绍几种常见的贝叶斯网络采样方法。

1. 马尔可夫链蒙特卡洛采样(MCMC)MCMC是一种常用的贝叶斯网络采样方法,它通过构建一个马尔可夫链来进行采样。

MCMC算法的核心思想是利用马尔可夫链的遍历性质,对联合概率分布进行遍历,从而得到符合概率分布的样本。

MCMC算法的具体步骤包括初始化状态、迭代采样、接受-拒绝和状态转移等。

通过不断迭代,MCMC算法可以得到符合联合概率分布的样本,从而进行推断和预测。

2. 重要性采样(IS)重要性采样是一种基于权重的贝叶斯网络采样方法,它通过对样本进行加权来估计联合概率分布。

重要性采样的核心思想是利用已有的样本来估计新样本的概率分布,从而得到符合联合概率分布的样本。

重要性采样的具体步骤包括选择重要性函数、对样本进行加权、生成新样本和计算概率分布等。

通过对样本进行加权,重要性采样可以得到符合联合概率分布的样本,从而进行推断和预测。

3. 高斯混合模型采样(GMM)高斯混合模型是一种常用的概率模型,它可以用来对复杂的概率分布进行建模。

在贝叶斯网络中,可以使用高斯混合模型来进行采样,从而得到符合联合概率分布的样本。

高斯混合模型采样的核心思想是通过多个高斯分布的线性组合来对联合概率分布进行建模。

通过对高斯分布的参数进行估计和优化,高斯混合模型可以得到符合联合概率分布的样本,从而进行推断和预测。

总结贝叶斯网络的采样方法包括马尔可夫链蒙特卡洛采样、重要性采样和高斯混合模型采样等多种方法,它们都具有各自的特点和适用范围。

在实际应用中,可以根据具体的问题和数据特点选择合适的采样方法,从而进行推断和预测。

贝叶斯网络的参数学习方法(Ⅰ)

贝叶斯网络(Bayesian network)是一种概率图模型,用于表示变量之间的依赖关系。

它由一组节点和有向边组成,每个节点表示一个随机变量,有向边表示变量之间的依赖关系。

在贝叶斯网络中,节点的条件概率分布可以用来描述节点与其父节点之间的依赖关系。

参数学习是指从数据中估计贝叶斯网络中的参数,使得网络能够更好地拟合数据。

本文将介绍一些常见的贝叶斯网络参数学习方法。

贝叶斯网络参数学习的方法包括极大似然估计(Maximum Likelihood Estimation,简称MLE)、最大后验概率估计(Maximum A Posteriori,简称MAP)和期望最大化算法(Expectation-Maximization,简称EM)。

首先,我们来介绍极大似然估计。

极大似然估计是一种常用的参数学习方法,它的目标是找到使观测数据出现的概率最大的参数值。

在贝叶斯网络中,极大似然估计的目标是找到使得给定父节点条件下子节点的条件概率分布最大化的参数值。

通过最大化观测数据出现的概率,我们可以得到贝叶斯网络中节点之间的依赖关系。

极大似然估计的优点是计算简单,但它也有一些缺点,比如容易产生过拟合的问题。

最大后验概率估计是在极大似然估计的基础上加入了先验分布。

通过引入先验分布,最大后验概率估计可以在一定程度上减小过拟合的风险。

在贝叶斯网络中,最大后验概率估计的目标是找到使观测数据出现的概率和先验分布的乘积最大化的参数值。

最大后验概率估计的优点是可以有效地处理过拟合的问题,但它的计算复杂度较高。

期望最大化算法是一种迭代的参数学习方法,它可以用来估计贝叶斯网络中的参数,特别是在存在隐变量的情况下。

期望最大化算法的基本思想是通过交替地进行期望步和最大化步来估计参数。

在期望步中,我们计算隐变量的期望;在最大化步中,我们最大化完整数据(包括观测变量和隐变量)的对数似然函数。

通过交替进行期望步和最大化步,我们可以逐渐提高对参数的估计。

贝叶斯网络简介

? Dealing with time ? In many systems, data arrives sequentially ? Dynamic Bayes nets (DBNs) can be used to

分类语义理解军事目标识别多目标跟踪战争身份识别生态学生物信息学贝叶斯网络在基因连锁分析中应编码学分类聚类时序数据和动态模型图分割有向分割dseparated分割变量x和y通过第三个变量z间接相连的三种情况

贝叶斯网络简介

Introduction to Bayesian Networks

基本框架

? 贝叶斯网络: ? 概率论 ? 图论

hidden structure learning)

一个简单贝叶斯网络例子

一个简单贝叶斯网络例子

? 计算过程:

? (1)

? P(y1|x1)=0.9

? P(z1|x1)=P(z1|y1,x1)P(y1|x1)+P(z1|y2,x1)P(y2|x1)

?

=P(z1|y1)P(y1|x1)+P(z1|y2)P(y2|x1)

? 使得运算局部化。消元过程实质上就是一个边缘化的过程。 ? 最优消元顺序:最大势搜索,最小缺边搜索

贝叶斯网络推理(Inference)

2. 团树传播算法

?利用步骤共享来加快推理的算法。

?团树(clique tree)是一种无向树,其中每 一个节点代表一个变量集合,称为团(clique) 。团树必须满足变量连通性,即包含同一变 量的所有团所导出的子图必须是连通的。

Conditional Independence

基本概念

例子

P(C, S,R,W) = P(C)P(S|C)P(R|S,C)P(W|S,R,C) chain rule = P(C)P(S|C)P(R|C)P(W|S,R,C) since = P(C)P(S|C)P(R|C)P(W|S,R) since

非常全面的贝叶斯网络介绍非常多的例子说明

⾮常全⾯的贝叶斯⽹络介绍⾮常多的例⼦说明这是⼀篇关于贝叶斯⽅法的科普⽂,我会尽量少⽤公式,多⽤平⽩的语⾔叙述,多举实际例⼦。

更严格的公式和计算我会在相应的地⽅注明参考资料。

贝叶斯⽅法被证明是⾮常 general 且强⼤的推理框架,⽂中你会看到很多有趣的应⽤。

1. 历史托马斯·贝叶斯(Thomas Bayes)同学的详细⽣平在。

以下摘⼀段 wikipedia 上的简介:所谓的贝叶斯⽅法源于他⽣前为解决⼀个“逆概”问题写的⼀篇⽂章,⽽这篇⽂章是在他死后才由他的⼀位朋友发表出来的。

在贝叶斯写这篇⽂章之前,⼈们已经能够计算“正向概率”,如“假设袋⼦⾥⾯有N个⽩球,M个⿊球,你伸⼿进去摸⼀把,摸出⿊球的概率是多⼤”。

⽽⼀个⾃然⽽然的问题是反过来:“如果我们事先并不知道袋⼦⾥⾯⿊⽩球的⽐例,⽽是闭着眼睛摸出⼀个(或好⼏个)球,观察这些取出来的球的颜⾊之后,那么我们可以就此对袋⼦⾥⾯的⿊⽩球的⽐例作出什么样的推测”。

这个问题,就是所谓的逆概问题。

实际上,贝叶斯当时的论⽂只是对这个问题的⼀个直接的求解尝试,并不清楚他当时是不是已经意识到这⾥⾯包含着的深刻的思想。

然⽽后来,贝叶斯⽅法席卷了概率论,并将应⽤延伸到各个问题领域,所有需要作出概率预测的地⽅都可以见到贝叶斯⽅法的影⼦,特别地,贝叶斯是机器学习的核⼼⽅法之⼀。

这背后的深刻原因在于,现实世界本⾝就是不确定的,⼈类的观察能⼒是有局限性的(否则有很⼤⼀部分科学就没有必要做了——设想我们能够直接观察到电⼦的运⾏,还需要对原⼦模型争吵不休吗?),我们⽇常所观察到的只是事物表⾯上的结果,沿⽤刚才那个袋⼦⾥⾯取球的⽐⽅,我们往往只能知道从⾥⾯取出来的球是什么颜⾊,⽽并不能直接看到袋⼦⾥⾯实际的情况。

这个时候,我们就需要提供⼀个猜测(hypothesis,更为严格的说法是“假设”,这⾥⽤“猜测”更通俗易懂⼀点),所谓猜测,当然就是不确定的(很可能有好多种乃⾄⽆数种猜测都能满⾜⽬前的观测),但也绝对不是两眼⼀抹⿊瞎蒙——具体地说,我们需要做两件事情:1. 算出各种不同猜测的可能性⼤⼩。

lstm的贝叶斯自动调参python代码

1. LSTM简介长短期记忆网络(Long Short-Term Memory,LSTM)是一种特殊的循环神经网络(Recurrent Neural Network,RNN)。

它能够学习长期依赖关系,并且在处理时序数据时表现出色。

LSTM网络的结构相对复杂,通常需要进行一定的调参才能使其发挥最佳性能。

2. 贝叶斯优化贝叶斯优化是一种基于贝叶斯定理的全局优化方法,它能够在有限次采样的情况下找到全局最优解。

与传统的网格搜索和随机搜索相比,贝叶斯优化在寻找最佳超参数时有着更高的效率和可靠性。

3. LSTM的自动调参在实际应用中,调参是非常耗时耗力的工作。

为了提高调参效率,许多研究者将贝叶斯优化应用于LSTM网络的超参数搜索中,以实现自动调参的目的。

下面将介绍如何使用Python代码实现LSTM的贝叶斯自动调参。

4. Python代码实现我们需要安装贝叶斯优化的Python库,常用的有BayesianOptimization和hyperopt。

我们需要定义LSTM网络的超参数空间。

一般来说,超参数包括学习率、隐藏层大小、优化器类型等。

我们可以编写一个目标函数,它接收超参数作为输入,并返回LSTM网络在验证集上的性能指标,比如准确率或者损失函数值。

5. 贝叶斯优化的调用接下来,我们可以调用贝叶斯优化库中的函数,传入目标函数和超参数空间,开始进行自动调参。

贝叶斯优化库会根据已有的样本,选择下一个最有可能取得最佳性能的超参数进行评估。

这样不断迭代,直到达到设定的迭代次数或者达到停止条件。

6. 结果分析与验证我们可以分析贝叶斯优化得到的最优超参数,将其应用于LSTM网络中,在测试集上进行验证。

通过与默认超参数或者手动调参的结果进行对比,可以验证贝叶斯自动调参的效果。

7. 总结使用贝叶斯优化进行LSTM网络的自动调参可以大大提高调参效率,节省调参的时间和精力。

通过Python代码的实现,我们可以方便地将贝叶斯优化应用到实际项目中,提升LSTM网络的性能,为时序数据分析提供更好的解决方案。

贝叶斯网络PPT课件

2019/8/21

3.贝叶斯网络学习 贝叶斯网络学习是指由先验的贝叶斯网络得到后验的贝叶斯网络的过程。

先验贝叶斯网络是根据用户的先验知识构造的贝叶斯网络,后验贝叶斯网络 是把先验贝叶斯网络和数据相结合而得到的贝叶斯网络。

贝叶斯网络学习的实质是用现有数据对先验知识的修正。贝叶斯网络能 够持续学习.上次学习得到的后验贝叶斯网络变成下一次学习的先验贝叶斯 网络,每一次学习前用户都可以对先验贝叶斯网络进行调整,使得新的贝叶 斯网络更能体现数据中蕴涵的知识。贝叶斯网络的学习关系如图7.2所示。

(2)具有良好的可理解性和逻辑性,这是神经元网络无法比拟的,神经 元网络从输入层输入影响因素信息,经隐含层处理后传人输出层,是黑匣子 似的预测和评估,而贝叶斯网络是白匣子。

(3)专家知识和试验数据的有效结合相辅相成,忽略次要联系而突出主 要矛盾,可以有效避免过学习。

(4)贝叶斯网络以概率推理为基础,推理结果说服力强,而且相对贝叶 斯方法来说,贝叶斯网络对先验概率的要求大大降低。贝叶斯网络通过实践 积累可以随时进行学习来改进网络结构和参数,提高预测诊断能力,并且基 于网络的概率推理算法,贝叶斯网络接受了新信息后立即更新网络中的概率 信息。

图7.1 基于结点间概率关系的推理

3

2019/8/21

通过长期的观察,或者从别人那里了解,这个中学生的父母知道他 们的女儿参加晚会的概率。通过长时间的数据积累,他们也知道他们的 女儿参加晚会后宿醉的概率。因此,结点party和结点hangover之间有 一条连线。同样,有明显的因果关系或相关关系的结点之间都有一条连 线,并且连线从原因结点出发,指向结果结点。

12

2019/8/21

7.l 引例

先看一个关于概率推理的例子。图7.1中有6个结点:参加晚 会(party,PT)、 宿醉(hangover,HO)、患脑瘤(brain tumor, BT)、头疼(headache,HA)、有酒精味(smell alcohol,SA)和X射 线检查呈阳性(posxray,PX)。可以把图7.1想象成为这样一个场 景:一个中学生回家后,其父母猜测她参加了晚会,并且喝了酒; 第二天这个学生感到头疼,她的父母带她到医院做头部的X光检查 ……

sklearn 3种贝叶斯 用法

sklearn 3种贝叶斯用法全文共四篇示例,供读者参考第一篇示例:高斯朴素贝叶斯算法假设特征的分布服从正态分布,即在每个类别下,特征的条件概率分布均为高斯分布。

在sklearn中,我们可以使用GaussianNB类来实现高斯朴素贝叶斯算法。

下面是一个简单的示例:# 加载数据集iris = load_iris()X = iris.datay = iris.target# 创建高斯朴素贝叶斯模型gnb = GaussianNB()# 预测y_pred = gnb.predict(X_test)# 评估模型准确率accuracy = accuracy_score(y_test, y_pred)print("准确率:", accuracy)```# 预测X_test = vectorizer.transform(newsgroups_test.data)y_pred = mnb.predict(X_test)```sklearn提供了三种常用的贝叶斯算法实现,分别是高斯朴素贝叶斯、多项式朴素贝叶斯和伯努利朴素贝叶斯。

根据不同的数据特征和应用场景,我们可以选择合适的贝叶斯算法来建立模型。

利用这些算法,我们可以在文本分类、垃圾邮件检测、情感分析等任务中取得不错的效果。

如果你对贝叶斯算法感兴趣,不妨尝试使用sklearn进行实践,相信你会有更深刻的理解和体会。

第二篇示例:贝叶斯定理是概率论中一种非常重要的方法,通过利用现有信息来更新对事件发生概率的预测。

在机器学习中,贝叶斯方法也被广泛运用,可以用于分类、回归等多种任务。

在sklearn库中,提供了三种不同的贝叶斯分类器,分别是高斯朴素贝叶斯、多项式朴素贝叶斯和伯努利朴素贝叶斯。

本文将分别介绍这三种贝叶斯分类器的用法及适用场景。

1. 高斯朴素贝叶斯高斯朴素贝叶斯是一种基于高斯分布假设的贝叶斯分类器,适用于特征满足连续型变量的数据集。

在sklearn中,可以使用GaussianNB类来构建高斯朴素贝叶斯分类器。

贝叶斯网络的模型解释方法(五)

贝叶斯网络是一种概率图模型,用于描述变量之间的依赖关系。

它是基于贝叶斯定理的一种表示方法,可以用来描述不同变量之间的概率关系,并通过概率推断来进行决策和预测。

在实际应用中,贝叶斯网络可以用于风险评估、医学诊断、金融分析等领域。

本文将介绍贝叶斯网络的模型解释方法。

一、贝叶斯网络的基本原理贝叶斯网络是一种有向无环图,由节点和边组成。

节点表示随机变量,边表示变量之间的依赖关系。

每个节点都与一个条件概率表相关联,用来描述该节点在不同条件下的概率分布。

当给定一些节点的观测值时,可以通过贝叶斯网络进行概率推断,计算其他节点的后验概率分布。

贝叶斯网络的基本原理包括贝叶斯定理、概率分布和条件独立性。

贝叶斯定理描述了在给定一些证据的情况下,如何更新对事件的概率分布。

概率分布描述了随机变量之间的关系,而条件独立性则描述了在给定一些条件的情况下,变量之间的独立关系。

二、贝叶斯网络的模型解释方法在贝叶斯网络中,模型解释是指理解网络结构和参数的含义。

模型解释可以帮助我们理解变量之间的关系,解释模型预测的结果,以及进行因果推断。

下面将介绍几种常见的贝叶斯网络的模型解释方法。

1. 条件概率表解释每个节点在贝叶斯网络中都与一个条件概率表相关联,用来描述该节点在不同条件下的概率分布。

通过观察条件概率表,我们可以理解节点在不同条件下的变化规律,以及节点与其父节点之间的依赖关系。

通过分析条件概率表,可以揭示变量之间的因果关系,帮助我们理解网络结构和参数的含义。

2. 网络结构解释贝叶斯网络的结构反映了变量之间的依赖关系,可以帮助我们理解变量之间的关系。

通过分析网络结构,可以发现变量之间的直接和间接依赖关系,识别出潜在的因果关系,揭示变量之间的联合分布规律。

网络结构解释可以帮助我们理解变量之间的关系,指导模型的改进和优化。

3. 推断结果解释贝叶斯网络可以用来进行概率推断,计算变量的后验概率分布。

通过分析推断结果,可以理解不同变量的概率分布,揭示变量之间的依赖关系,解释模型的预测结果。