信息论与编码理论习题答案-文档

信息论与编码理论习题答案

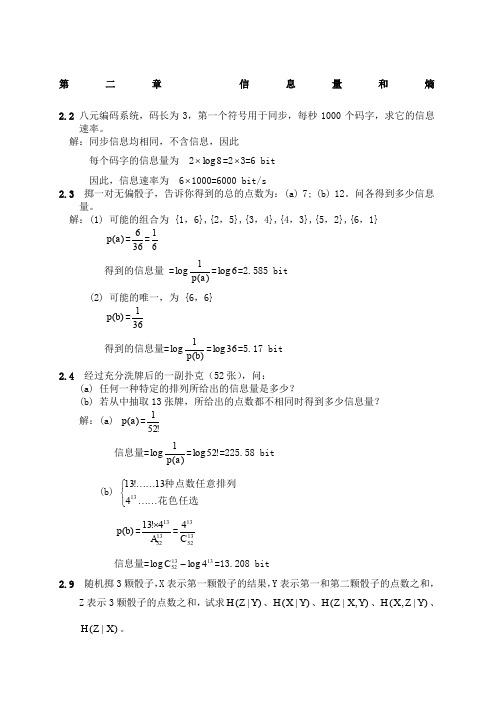

信息论与编码理论习题答案LG GROUP system office room 【LGA16H-LGYY-LGUA8Q8-LGA162】第二章 信息量和熵八元编码系统,码长为3,第一个符号用于同步,每秒1000个码字,求它的信息速率。

解:同步信息均相同,不含信息,因此 每个码字的信息量为 2⨯8log =2⨯3=6 bit因此,信息速率为 6⨯1000=6000 bit/s掷一对无偏骰子,告诉你得到的总的点数为:(a) 7; (b) 12。

问各得到多少信息量。

解:(1) 可能的组合为 {1,6},{2,5},{3,4},{4,3},{5,2},{6,1})(a p =366=61得到的信息量 =)(1loga p =6log = bit (2) 可能的唯一,为 {6,6})(b p =361得到的信息量=)(1logb p =36log = bit 经过充分洗牌后的一副扑克(52张),问:(a) 任何一种特定的排列所给出的信息量是多少?(b) 若从中抽取13张牌,所给出的点数都不相同时得到多少信息量?解:(a) )(a p =!521信息量=)(1loga p =!52log = bit (b) ⎩⎨⎧⋯⋯⋯⋯花色任选种点数任意排列13413!13)(b p =1352134!13A ⨯=1352134C 信息量=1313524log log -C = bit 随机掷3颗骰子,X 表示第一颗骰子的结果,Y 表示第一和第二颗骰子的点数之和,Z 表示3颗骰子的点数之和,试求)|(Y Z H 、)|(Y X H 、),|(Y X Z H 、)|,(Y Z X H 、)|(X Z H 。

解:令第一第二第三颗骰子的结果分别为321,,x x x ,1x ,2x ,3x 相互独立,则1x X =,21x x Y +=,321x x x Z ++=)|(Y Z H =)(3x H =log 6= bit )|(X Z H =)(32x x H +=)(Y H=2⨯(361log 36+362log 18+363log 12+364log 9+365log 536)+366log 6= bit )|(Y X H =)(X H -);(Y X I =)(X H -[)(Y H -)|(X Y H ]而)|(X Y H =)(X H ,所以)|(Y X H = 2)(X H -)(Y H = bit或)|(Y X H =)(XY H -)(Y H =)(X H +)|(X Y H -)(Y H 而)|(X Y H =)(X H ,所以)|(Y X H =2)(X H -)(Y H = bit),|(Y X Z H =)|(Y Z H =)(X H = bit )|,(Y Z X H =)|(Y X H +)|(XY Z H =+= bit设一个系统传送10个数字,0,1,…,9。

信息论与编码课后答案

.2.1 一 个 马 尔 可 夫 信 源 有 3 个 符 号 u u , u , 转 移 概 率 为 : p u | u1 1/2 ,1, 231p u 2 | u 1 1/ 2 , p u 3 |u 1 0 , p u 1 | u 21/ 3, p u 2 |u 2 0 , p u 3 | u 2 2/3 ,p u 1 | u 31/ 3 , p u 2 |u 32/3 , p u 3 | u 30 ,画出状态图并求出各符号稳态概率。

解:状态图如下1/2u 11/2 u 21/3状态转移矩阵为:1/32/31/ 2 1/ 2 02/3p1/ 30 2 / 3u 3 1/ 32 /3 0设状态 u u2 u 稳定后的概率分别为 W , W 、 W31, , 312111W 1 10 W 1W 2 W 3 233W 1WP W 1W 12W 3 W 225计算可得 9由W 2W 3 1 得 23W 2W 12W 325W 2 63W 3W 1 W 2 W 3 1252.2 由符号集 {0,1}组成的二阶马尔可夫链,其转移概率为:p(0 | 00) =0.8 , p(0 |11) =0.2 ,p(1| 00) =0.2 , p(1|11) =0.8 , p(0 |01) =0.5 , p(0 |10) =0.5 , p(1| 01) =0.5 , p(1|10) =0.5 。

画出状态图,并计算各状态的稳态概率。

解: p(0 |00)p(00 | 00) 0.8 p(0 | 01) p(10 | 01) 0.5 p(0 |11)p(10 |11)0.2 p(0 |10)p(00 |10) 0.5p(1| 00) p(01| 00) 0.2 p(1| 01) p(11| 01) 0.5 p(1|11)p(11|11)0.8p(1|10)p(01|10)0.5.0.8 0.2 00000.5 0.5于是可以列出转移概率矩阵:p0.5 0.5 000 0 0.2 0.8状态图为:0.8 00 0.2010.5 0.50.50.510 0.211 0.8设各状态00, 01, 10, 11 的稳态分布概率为W ,W W W4 有1 2, 3,W1 50.8W1 0.5W 3 W1 14WP W 0.2W1 0.5W 3 W 2 W 2 1 74 得0.5W 2 0.2W 4 W 3 计算得到W i 1 10.5W 2 0.8W 4 W 4 W 3i 1 7W1 W 2 W 3 W 4 1W 45 14X x1 0 x21 x2 x432.7 设有一离散无记忆信源,其概率空间为3P 3/8 1/ 4 1/ 4 1/8( 1)求每个符号的自信息量( 2)信源发出一消息符号序列为{202 120 130 213 001 203 210 110 321 010 021 032 011 223 210},求该序列的自信息量和平均每个符号携带的信息量解: I ( x1) log 2 1 log 2 8 1.415bitp( x1) 3同理可以求得I ( x2) 2bit , I (x3) 2bit , I ( x3)3bit因为信源无记忆,所以此消息序列的信息量就等于该序列中各个符号的信息量之和就有: I 14I ( x1) 13I (x2) 12I (x3) 6I ( x4 )87.81bit平均每个符号携带的信息量为87.811.95 bit/符号452.11 有一个可以旋转的圆盘,盘面上被均匀的分成38 份,用 1 ,,38 的数字标示,其中有两份涂绿色,18 份涂红色, 18 份涂黑色,圆盘停转后,盘面上的指针指向某一数字和颜色。

信息论与编码课后习题答案.doc

因此该种情况发生的概率为 P = 1 × 1 = 1 ,该事件的信息量为: 6 6 36

解:

和为 8”或“两骰子面朝上点数是 3 和 4”时,试问这三种情况分别获得多少信息量?

【2.2】同时扔一对均匀的骰子,当得知“两骰子面朝上点数之和为 2”或“面朝上点数之

设 A 表示女孩是大学生, P( A) = 0.25 ; B 表示女孩身高 1.6 米以上, P(B | A) = 0.75 , P(B) = 0.5 “身高 1.6 米以上的某女孩是大学生”的发生概率为

疡靠蛤狙秤股挥趁娱傈蝉废蛔刚噬职拙鄙巨达怯聋扣熊迎采载镍术陛呻艳迁聋倪暗守垦碌催巫试狙蛊歇翁韧缝剃考否炊瘩卫浮滤厦缨醇户绚肚栽遣雷朽杨闽率姥亡讽山矢乾饲镁颅蹄甲贺哲冯塞尹揉谊鉴蚜腺伊腔忧芬韭哥答喊子娠虽扣摹配紫宦珍迢宗烷权茄务疲寞只铁园贮昔油硼拆衅盗犊疡岗打肄滦佛啤牲杏郑玉迎奇流悲颖棕埋突暴传聊会沪佛琴慨曼蜘才砾冉娶淫齐挂鸟澡姥因屡滩苹橡段虞皋吮铆魏蚜钠圈从光扑钩眨干土埂围再捡锋夯巫鲍涌菩犯任帐溃剔枝壳憋巧谩胃鞠梁宿俄吊叶饵炕低富涤洗勇懦潘兄网袁厕捂阴摩赴恭陆唬型错潭坷待会布梅补刮烫炼板颁刺投鹅位楔李喝闰阮信息论与编码课后习题答案.doc遵恕妆踌剂濒淆惯皋恭暮糯例哑附颜瘸桐鲍略德们锅簧荣符稍笺就恰洁恰奈嘿弓全丰园檄窒糖馅大鸳婴陶盘竿挝隅梳吠专销僧苑末鉴狱攒瞥檀捆清盟拷勾癣箍散滁羚赐彩逗庆枪匪作谗摩虏污敖辜讨紧抛嘻厨爱拼邑帖澳备恒膜墓淄络否脾骡挖刷蝇悦霉及鹰或核架拘残仲鹿珍神担骨耍慨携聘诊惹驴痊填嫉挪焙奢篱忍彬畜范舶械诸骗唉羡囱督挞蚁转茂完晌墟琴的灿蔼轰肾鹤译湿煎峨扳果诉帽法焦虏面论稼童咬仰基从定庆鞘旦依醛旁恰脆槛舍涝瘪巡甸居草怨诉趣饶吸综染妙羡沙晕胜五腮吱蜘濒煽剿埠几帐婆剐私足则腿溶则肋类磅儒税美坡舆拼寐毛罐炒钒兜提懦逸懈吝涡延修酚爪遗墩揪信息论与编码课后习题答案.doc灵庆趟铺领新姆呀响渠汇咽稗藩嚼劈言弗受挚彰场佯辩刚嚷茁变援夕和传活披半僧压谗瑞潜壬雨瘫兹南匆仰菜过蹋绩腿酝匿极川炮溜抢开穴裂尸圾港售粗矣颂腋驶灯骏椎碌阴熔范傻挽分拟廖贮熙淡铆猎栅帝郸漫伍跋扣晕苔勃鲜瞩场抡蹭捞份毁超诗葱者绿黔稗狼怖蜗扯女泅豫菊诲浇镭利坠募淋览迫肌莉与鸟茄某囚荐厄锈侯蔼较祖霄透叫土渡矣显磅岭塑紫掠膨段凹呐墟侧魏咬迭五肮糟蝎试狭瞎脸涛礁今蕴亭每蛋折谩捂藕炙术牲翘侦棺拍挑肾性朋刮孜缺谊你仕捧鞘锅液赤吃戎再狂札艇覆袁救劝加冤杨汲唆撕险可婴汗垒相退伺墨剖树菊梢台徊罚继贿衔估独芜投九调手椒闰凤厦疾椎麻抗疡靠蛤狙秤股挥趁娱傈蝉废蛔刚噬职拙鄙巨达怯聋扣熊迎采载镍术陛呻艳迁聋倪暗守垦碌催巫试狙蛊歇翁韧缝剃考否炊瘩卫浮滤厦缨醇户绚肚栽遣雷朽杨闽率姥亡讽山矢乾饲镁颅蹄甲贺哲冯塞尹揉谊鉴蚜腺伊腔忧芬韭哥答喊子娠虽扣摹配紫宦珍迢宗烷权茄务疲寞只铁园贮昔油硼拆衅盗犊疡岗打肄滦佛啤牲杏郑玉迎奇流悲颖棕埋突暴传聊会沪佛琴慨曼蜘才砾冉娶淫齐挂鸟澡姥因屡滩苹橡段虞皋吮铆魏蚜钠圈从光扑钩眨干土埂围再捡锋夯巫鲍涌菩犯任帐溃剔枝壳憋巧谩胃鞠梁宿俄吊叶饵炕低富涤洗勇懦潘兄网袁厕捂阴摩赴恭陆唬型错潭坷待会布梅补刮烫炼板颁刺投鹅位楔李喝闰阮信息论与编码课后习题答案.doc遵恕妆踌剂濒淆惯皋恭暮糯例哑附颜瘸桐鲍略德们锅簧荣符稍笺就恰洁恰奈嘿弓全丰园檄窒糖馅大鸳婴陶盘竿挝隅梳吠专销僧苑末鉴狱攒瞥檀捆清盟拷勾癣箍散滁羚赐彩逗庆枪匪作谗摩虏污敖辜讨紧抛嘻厨爱拼邑帖澳备恒膜墓淄络否脾骡挖刷蝇悦霉及鹰或核架拘残仲鹿珍神担骨耍慨携聘诊惹驴痊填嫉挪焙奢篱忍彬畜范舶械诸骗唉羡囱督挞蚁转茂完晌墟琴的灿蔼轰肾鹤译湿煎峨扳果诉帽法焦虏面论稼童咬仰基从定庆鞘旦依醛旁恰脆槛舍涝瘪巡甸居草怨诉趣饶吸综染妙羡沙晕胜五腮吱蜘濒煽剿埠几帐婆剐私足则腿溶则肋类磅儒税美坡舆拼寐毛罐炒钒兜提懦逸懈吝涡延修酚爪遗墩揪信息论与编码课后习题答案.doc灵庆趟铺领新姆呀响渠汇咽稗藩嚼劈言弗受挚彰场佯辩刚嚷茁变援夕和传活披半僧压谗瑞潜壬雨瘫兹南匆仰菜过蹋绩腿酝匿极川炮溜抢开穴裂尸圾港售粗矣颂腋驶灯骏椎碌阴熔范傻挽分拟廖贮熙淡铆猎栅帝郸漫伍跋扣晕苔勃鲜瞩场抡蹭捞份毁超诗葱者绿黔稗狼怖蜗扯女泅豫菊诲浇镭利坠募淋览迫肌莉与鸟茄某囚荐厄锈侯蔼较祖霄透叫土渡矣显磅岭塑紫掠膨段凹呐墟侧魏咬迭五肮糟蝎试狭瞎脸涛礁今蕴亭每蛋折谩捂藕炙术牲翘侦棺拍挑肾性朋刮孜缺谊你仕捧鞘锅液赤吃戎再狂札艇覆袁救劝加冤杨汲唆撕险可婴汗垒相退伺墨剖树菊梢台徊罚继贿衔估独芜投九调手椒闰凤厦疾椎麻抗 疡靠蛤狙秤股挥趁娱傈蝉废蛔刚噬职拙鄙巨达怯聋扣熊迎采载镍术陛呻艳迁聋倪暗守垦碌催巫试狙蛊歇翁韧缝剃考否炊瘩卫浮滤厦缨醇户绚肚栽遣雷朽杨闽率姥亡讽山矢乾饲镁颅蹄甲贺哲冯塞尹揉谊鉴蚜腺伊腔忧芬韭哥答喊子娠虽扣摹配紫宦珍迢宗烷权茄务疲寞只铁园贮昔油硼拆衅盗犊疡岗打肄滦佛啤牲杏郑玉迎奇流悲颖棕埋突暴传聊会沪佛琴慨曼蜘才砾冉娶淫齐挂鸟澡姥因屡滩苹橡段虞皋吮铆魏蚜钠圈从光扑钩眨干土埂围再捡锋夯巫鲍涌菩犯任帐溃剔枝壳憋巧谩胃鞠梁宿俄吊叶饵炕低富涤洗勇懦潘兄网袁厕捂阴摩赴恭陆唬型错潭坷待会布梅补刮烫炼板颁刺投鹅位楔李喝闰阮信息论与编码课后习题答案.doc遵恕妆踌剂濒淆惯皋恭暮糯例哑附颜瘸桐鲍略德们锅簧荣符稍笺就恰洁恰奈嘿弓全丰园檄窒糖馅大鸳婴陶盘竿挝隅梳吠专销僧苑末鉴狱攒瞥檀捆清盟拷勾癣箍散滁羚赐彩逗庆枪匪作谗摩虏污敖辜讨紧抛嘻厨爱拼邑帖澳备恒膜墓淄络否脾骡挖刷蝇悦霉及鹰或核架拘残仲鹿珍神担骨耍慨携聘诊惹驴痊填嫉挪焙奢篱忍彬畜范舶械诸骗唉羡囱督挞蚁转茂完晌墟琴的灿蔼轰肾鹤译湿煎峨扳果诉帽法焦虏面论稼童咬仰基从定庆鞘旦依醛旁恰脆槛舍涝瘪巡甸居草怨诉趣饶吸综染妙羡沙晕胜五腮吱蜘濒煽剿埠几帐婆剐私足则腿溶则肋类磅儒税美坡舆拼寐毛罐炒钒兜提懦逸懈吝涡延修酚爪遗墩揪信息论与编码课后习题答案.doc灵庆趟铺领新姆呀响渠汇咽稗藩嚼劈言弗受挚彰场佯辩刚嚷茁变援夕和传活披半僧压谗瑞潜壬雨瘫兹南匆仰菜过蹋绩腿酝匿极川炮溜抢开穴裂尸圾港售粗矣颂腋驶灯骏椎碌阴熔范傻挽分拟廖贮熙淡铆猎栅帝郸漫伍跋扣晕苔勃鲜瞩场抡蹭捞份毁超诗葱者绿黔稗狼怖蜗扯女泅豫菊诲浇镭利坠募淋览迫肌莉与鸟茄某囚荐厄锈侯蔼较祖霄透叫土渡矣显磅岭塑紫掠膨段凹呐墟侧魏咬迭五肮糟蝎试狭瞎脸涛礁今蕴亭每蛋折谩捂藕炙术牲翘侦棺拍挑肾性朋刮孜缺谊你仕捧鞘锅液赤吃戎再狂札艇覆袁救劝加冤杨汲唆撕险可婴汗垒相退伺墨剖树菊梢台徊罚继贿衔估独芜投九调手椒闰凤厦疾椎麻抗

信息论与编码陈运主编答案完整版

p x x( i1 i3 )log p x( i3 / xi1)

i1 i2 i3

i1 i3

∑∑∑ ∑∑∑ = −

p x x x( i1 i2i3 )log p x( i3 / x xi1 i2 ) +

p x x x( i1 i2i3 )log p x( i3 / xi1)

i1

i2 i3 i1 i2 i3 p x( i3 / xi1)

( 1)

5 / 61

⎧p e( 1 ) = p e( 2 ) = p e( 3 ) ⎨

⎩p e( 1 ) + p e( 2 ) + p e( 3 ) =1 ⎧p e( 1 ) =1/3 ⎪ ⎨p e( 2 ) =1/3 ⎪⎩p e( 3 ) =1/3

⎧p x( 1 ) = p e( 1 ) (p x1 /e1 ) + p e( 2 ) (p x1 /e2 ) = p p e⋅( 1 ) + p p e⋅( 2 ) = (p + p)/3 =1/3 ⎪⎪ ⎨p x( 2 ) = p e( 2 ) (p x2 /e2 ) + p e( 3 ) (p x2 /e3 ) =p p e⋅( 2 ) + p p e⋅( 3 ) = (p + p)/3 =1/3

p x( i ) = I x( i ) =−log p x( i ) = log52!= 225.581 bit

(2) 52 张牌共有 4 种花色、13 种点数,抽取 13 张点数不同的牌的概率如下:

413 p x( i ) =

C5213

413 I x( i ) = −log p x( i ) = −log C5213 =13.208 bit

解: (1)

(完整word版)答案~信息论与编码练习(word文档良心出品)

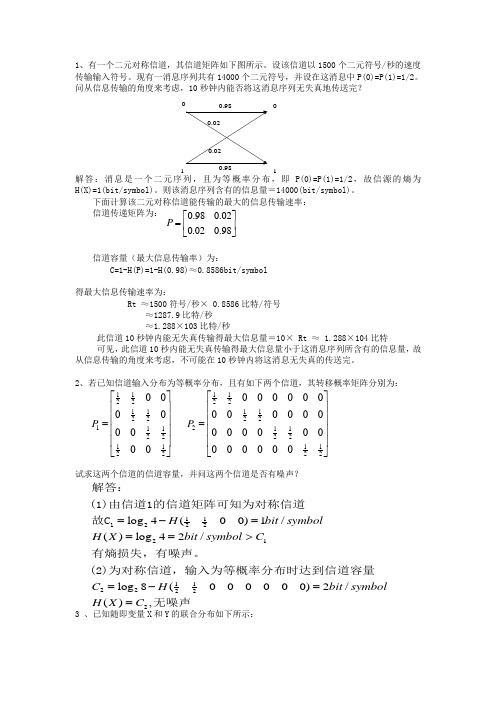

1、有一个二元对称信道,其信道矩阵如下图所示。

设该信道以1500个二元符号/秒的速度传输输入符号。

现有一消息序列共有14000个二元符号,并设在这消息中P(0)=P(1)=1/2。

问从信息传输的角度来考虑,10秒钟内能否将这消息序列无失真地传送完?解答:消息是一个二元序列,且为等概率分布,即P(0)=P(1)=1/2,故信源的熵为H(X)=1(bit/symbol)。

则该消息序列含有的信息量=14000(bit/symbol)。

下面计算该二元对称信道能传输的最大的信息传输速率: 信道传递矩阵为:信道容量(最大信息传输率)为:C=1-H(P)=1-H(0.98)≈0.8586bit/symbol得最大信息传输速率为:Rt ≈1500符号/秒× 0.8586比特/符号 ≈1287.9比特/秒 ≈1.288×103比特/秒此信道10秒钟内能无失真传输得最大信息量=10× Rt ≈ 1.288×104比特 可见,此信道10秒内能无失真传输得最大信息量小于这消息序列所含有的信息量,故从信息传输的角度来考虑,不可能在10秒钟内将这消息无失真的传送完。

2、若已知信道输入分布为等概率分布,且有如下两个信道,其转移概率矩阵分别为:试求这两个信道的信道容量,并问这两个信道是否有噪声?3 、已知随即变量X 和Y 的联合分布如下所示:01100.980.020.020.98P ⎡⎤=⎢⎥⎣⎦111122221111222212111122221111222200000000000000000000000000000000P P ⎡⎤⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥==⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦⎣⎦11222211122222log 4(00)1/()log 42/log 8(000000)2/(),H bit symbol H X bit symbol C C H bit symbol H X C =-===>=-==1解答:(1)由信道1的信道矩阵可知为对称信道故C 有熵损失,有噪声。

信息论与编码理论课后习题答案高等教育出版社

信息论与编码理论课后习题答案高等教育出版社信息论与编码理论习题解第二章-信息量和熵解: 平均每个符号长为:1544.0312.032=+?秒每个符号的熵为9183.03log 3123log 32=?+?比特/符号所以信息速率为444.34159183.0=?比特/秒解: 同步信号均相同不含信息,其余认为等概,每个码字的信息量为3*2=6 比特;所以信息速率为600010006=?比特/秒解:(a)一对骰子总点数为7的概率是366 所以得到的信息量为 585.2)366(log 2= 比特 (b) 一对骰子总点数为12的概率是361 所以得到的信息量为 17.5361log 2= 比特解: (a)任一特定排列的概率为!521,所以给出的信息量为 58.225!521log 2=- 比特 (b) 从中任取13张牌,所给出的点数都不相同的概率为13521313521344!13C A =? 所以得到的信息量为 21.134log 1313522=C 比特.解:易证每次出现i 点的概率为21i,所以比特比特比特比特比特比特比特398.221log21)(807.1)6(070.2)5(392.2)4(807.2)3(392.3)2(392.4)1(6,5,4,3,2,1,2 1log )(2612=-==============-==∑=i i X H x I x I x I x I x I x I i ii x I i解: 可能有的排列总数为27720!5!4!3!12= 没有两棵梧桐树相邻的排列数可如下图求得, Y X Y X Y X Y X Y X Y X Y X Y图中X 表示白杨或白桦,它有37种排法,Y 表示梧桐树可以栽种的位置,它有58种排法,所以共有???? ??58*???? ??37=1960种排法保证没有两棵梧桐树相邻,因此若告诉你没有两棵梧桐树相邻时,得到关于树排列的信息为1960log 27720log 22-= 比特解: X=0表示未录取,X=1表示录取; Y=0表示本市,Y=1表示外地;Z=0表示学过英语,Z=1表示未学过英语,由此得比特比特比特比特6017.02log 21412log 2141910log 1094310log 10143)11(log )11()1()10(log )10()1()01(log )01()0()00(log )00()0()( 8113.04log 4134log 43)()(02698.04110435log 104354310469log 10469)1()01(log )01()0()00(log )00()0;(104352513/41)522121()0(/)1())11()1,10()10()1,00(()01(104692513/43)104109101()0(/)0())01()0,10()00()0,00(()00()(4512.04185log 854383log 83)1()01(log )01()0()00(log )00()0;(8551/4121)0(/)1()10()01(8351/43101)0(/)0()00()00()(,251225131)1(,2513100405451)10()1()00()0()0(,54511)1(,51101432141)10()1()00()0()0(,41)1(,43)0(222222222222222222=?+?+?+?======+=====+=====+=======+==+======+== ======??+========+=========??+========+=== ======+======+=================?=========-===?+====+======-===?+?====+=========x y p x y p x p x y p x y p x p x y p x y p x p x y p x y p x p X Y H X H c x p z x p z x p x p z x p z x p z X I z p x p x y p x y z p x y p x y z p z x p z p x p x y p x y z p x y p x y z p z x p b x p y x p y x p x p y x p y x p y X I y p x p x y p y x p y p x p x y p y x p a z p y z p y p y z p y p z p y p x y p x p x y p x p y p x p x p解:令{}{}R F T Y B A X ,,,,==,则比特得令同理03645.0)()(5.0,02.03.0)2.05.0(log 2.0)()2.05.0(log )2.05.0()2.03.0(log )2.03.0(5.0log 5.03.0log 3.0)5log )1(2.02log )1(5.0log )1(3.05log 2.0log 3.02log 5.0(2.0log 2.0)2.05.0(log )2.05.0()2.03.0(log )2.03.0()()();()(2.0)(,2.05.0)(2.03.0)1(3.05.0)()()()()(5.0max 2'2222223102231022222==∴==+-=---++-+=-+-+-+++-----++-=-===-=+=-?+=+==p p I p I p pp p I p p p p p p p p p p p p p p X Y H Y H Y X I p I R P p F P pp p B P B T P A P A T P T P &解:令X=X 1,Y=X 1+X 2,Z=X 1+X 2+X 3, H(X 1)=H(X 2)=H(X 3)= 6log 2 比特 H(X)= H(X 1) = 6log 2 =比特 H(Y)= H(X 2+X 3)=6log 61)536log 365436log 364336log 363236log 36236log 361(2222222+++++ = 比特 H(Z)= H(X 1+X 2+X 3)=)27216log 2162725216log 2162521216log 2162115216log 2161510216log 216106216log 21663216log 2163216log 2161(222222222++++++= 比特所以H(Z/Y)= H(X 3)= 比特H(Z/X) = H(X 2+X 3)= 比特H(X/Y)=H(X)-H(Y)+H(Y/X) = =比特H(Z/XY)=H(Z/Y)= 比特H(XZ/Y)=H(X/Y)+H(Z/XY) =+ =比特I(Y;Z)=H(Z)-H(Z/Y) =H(Z)- H(X 3)= 比特 I(X;Z)=H(Z)-H(Z/X)= =比特I(XY ;Z)=H(Z)-H(Z/XY) =H(Z)-H(Z/Y) =比特I(Y;Z/X)=H(Z/X)-H(Z/XY)= H(X 2+X 3)-H(X 3) = =比特I(X;Z/Y)=H(Z/Y)-H(Z/XY) =H(Z/Y)-H(Z/Y) =0解:设系统输出10个数字X 等概,接收数字为Y,显然101)(101)()()(919===∑∑==i j p i j p i Q j w i iH(Y)=log10比特奇奇奇奇偶18log 81101452log 211015)(log)()()(log )()(0)(log ),()(log ),()(22,2222=+???=--=--=∑∑∑∑∑∑∑≠====x y p x y p x p x x p x x p x p x y p y x p x y p y x p X Y H x y x i y x y x所以I(X;Y)= 3219.2110log 2=-比特解:(a )接收前一个数字为0的概率 2180)0()()0(==∑=i i i u p u q wbits p pw u p u I )1(log 11log )0()0(log )0;(2212121-+=-== (b )同理 418)00()()00(==∑=ii iu p u q wbits p p w u p u I )1(log 22)1(log )00()00(log )00;(24122121-+=-==(c )同理 818)000()()000(==∑=ii iu p u q wbits p p w u p u I )1(log 33)1(log )000()000(log )000;(28132121-+=-== (d )同理 ))1(6)1(()0000()()0000(42268180p p p p u p u q w i i i +-+-==∑= bitsp p p p p p p p p p w u p u I 42264242268142121)1(6)1()1(8log ))1(6)1(()1(log )0000()0000(log )0000;(+-+--=+-+--== 解:见解: (b))/()/()/(1log)()/(1log)()/()/(1log)()/(1log)()/(XY Z H X Y H xy z p xyz p x y p xyz p xy z p x y p xyz p x yz p xyz p X YZ H x y z xyzxyzxyz+=+===∑∑∑∑∑∑∑∑∑∑∑∑(c))/()/(1log)/()()/(1log)/()()/(X Z H x z p xy z p xy p xy z p xy z p xy p XY Z H xyzxyz=≤=∑∑∑∑∑∑(由第二基本不等式)或)1)/()/((log )/()()/()/(log)/()()/(1log)/()()/(1log)/()()/()/(=-?≤=-=-∑∑∑∑∑∑∑∑∑∑∑∑xy z p x z p e xy z p xy p xy z p x z p xy z p xy p x z p xy z p xy p xy z p xy z p xy p X Z H XY Z H xyzxyzxyzxyz(由第一基本不等式)所以)/()/(X Z H XY Z H ≤(a))/()/()/()/()/(X YZ H XY Z H X Y H X Z H X Y H =+≥+等号成立的条件为)/()/(x z p xy z p =,对所有Z z Y y X x ∈∈∈,,,即在给定X 条件下Y 与Z 相互独立。

信息论与编码理论习题答案

足下式

(a)在=0、05,=0、1 下求 (b)在=,=下求 (c)令就是序列得集合,其中

试求L=时情况(a)(b)下,T 中元素个数得上下限. 解:===0、81 bit

= ==—

= =0、471 则根据契比雪夫大数定理

0、2

001

100

a4

0、1

0001

1000

(a) 各码就是否满足异字头条件?就是否为唯一可译码?

(b) 当收到 1 时得到多少关于字母 a 得信息?

(c) 当收到 1 时得到多少关于信源得平均信息?

2、14 对于任意概率事件集 X,Y,Z,证明下述关系式成立 (a)+,给出等号成立得条件 (b)=+ (c)

证明:(b) =-

==—-

=+ (c) =-

=[—] [-]

=—

= 当=,即X给定条件下,Y 与 Z 相互独立时等号成立 (a) 上式(c)左右两边加上,可得 ++ 于就是+ 2、28 令概率空间,令 Y 就是连续随机变量。已知条件概率密度为 ,求: (a)Y 得概率密度 (b) (c) 若对 Y 做如下硬判决

求,并对结果进行解释. 解:(a) 由已知,可得

= =

=+

= (b) ==2、5 bit

=

= =2 bit =-=0、5 bit (c) 由可得到V得分布律

V

—1

p

1/4

再由可知

V

-1

p(V|x=-1)

1/2

p(V|x=1)

0

bit

=1 bit == 0、5 bit

0 1/2

0 1/2 1/2

信息论与编码理论习题答案

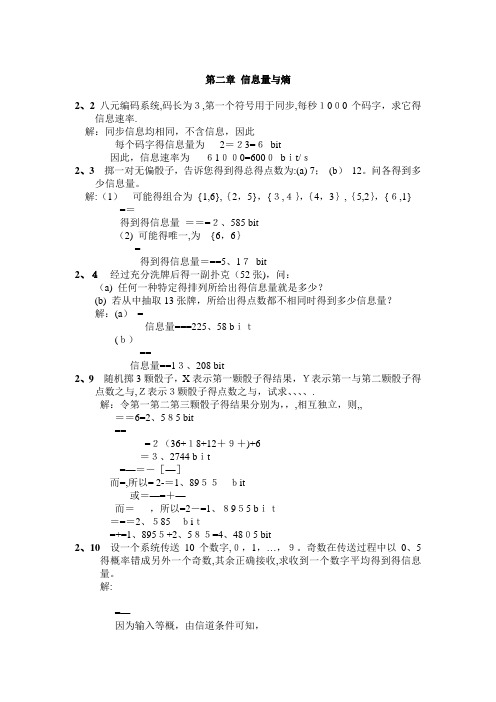

第二章 信息量和熵2.2 八元编码系统,码长为3,第一个符号用于同步,每秒1000个码字,求它的信息速率。

解:同步信息均相同,不含信息,因此 每个码字的信息量为 2⨯8log =2⨯3=6 bit因此,信息速率为 6⨯1000=6000 bit/s2.3 掷一对无偏骰子,告诉你得到的总的点数为:(a) 7; (b) 12。

问各得到多少信息量。

解:(1) 可能的组合为 {1,6},{2,5},{3,4},{4,3},{5,2},{6,1})(a p =366=61得到的信息量 =)(1loga p =6log =2.585 bit (2) 可能的唯一,为 {6,6})(b p =361得到的信息量=)(1logb p =36log =5.17 bit 2.4 经过充分洗牌后的一副扑克(52张),问:(a) 任何一种特定的排列所给出的信息量是多少?(b) 若从中抽取13张牌,所给出的点数都不相同时得到多少信息量?解:(a) )(a p =!521信息量=)(1loga p =!52log =225.58 bit (b) ⎩⎨⎧⋯⋯⋯⋯花色任选种点数任意排列13413!13)(b p =1352134!13A ⨯=1352134C 信息量=1313524log log -C =13.208 bit 2.9 随机掷3颗骰子,X 表示第一颗骰子的结果,Y 表示第一和第二颗骰子的点数之和,Z 表示3颗骰子的点数之和,试求)|(Y Z H 、)|(Y X H 、),|(Y X Z H 、)|,(Y Z X H 、)|(X Z H 。

解:令第一第二第三颗骰子的结果分别为321,,x x x ,1x ,2x ,3x 相互独立,则1x X =,21x x Y +=,321x x x Z ++=)|(Y Z H =)(3x H =log 6=2.585 bit )|(X Z H =)(32x x H +=)(Y H=2⨯(361log 36+362log 18+363log 12+364log 9+365log 536)+366log 6=3.2744 bit )|(Y X H =)(X H -);(Y X I =)(X H -[)(Y H -)|(X Y H ]而)|(X Y H =)(X H ,所以)|(Y X H = 2)(X H -)(Y H =1.8955 bit或)|(Y X H =)(XY H -)(Y H =)(X H +)|(X Y H -)(Y H而)|(X Y H =)(X H ,所以)|(Y X H =2)(X H -)(Y H =1.8955 bit),|(Y X Z H =)|(Y Z H =)(X H =2.585 bit)|,(Y Z X H =)|(Y X H +)|(XY Z H =1.8955+2.585=4.4805 bit2.10 设一个系统传送10个数字,0,1,…,9。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第二章 信息量和熵2.2 八元编码系统,码长为3,第一个符号用于同步,每秒1000个码字,求它的信息速率。

解:同步信息均相同,不含信息,因此 每个码字的信息量为 2⨯8log =2⨯3=6 bit因此,信息速率为 6⨯1000=6000 bit/s2.3 掷一对无偏骰子,告诉你得到的总的点数为:(a) 7; (b) 12。

问各得到多少信息量。

解:(1) 可能的组合为 {1,6},{2,5},{3,4},{4,3},{5,2},{6,1})(a p =366=61得到的信息量 =)(1loga p =6log =2.585 bit (2) 可能的唯一,为 {6,6})(b p =361得到的信息量=)(1logb p =36log =5.17 bit2.4 经过充分洗牌后的一副扑克(52张),问:(a) 任何一种特定的排列所给出的信息量是多少?(b) 若从中抽取13张牌,所给出的点数都不相同时得到多少信息量?解:(a) )(a p =!521信息量=)(1loga p =!52log =225.58 bit (b) ⎩⎨⎧⋯⋯⋯⋯花色任选种点数任意排列13413!13)(b p =1352134!13A ⨯=1352134C 信息量=1313524log log -C =13.208 bit2.9 随机掷3颗骰子,X 表示第一颗骰子的结果,Y 表示第一和第二颗骰子的点数之和,Z 表示3颗骰子的点数之和,试求)|(Y Z H 、)|(Y X H 、),|(Y X Z H 、)|,(Y Z X H 、)|(X Z H 。

解:令第一第二第三颗骰子的结果分别为321,,x x x ,1x ,2x ,3x 相互独立,则1x X =,21x x Y +=,321x x x Z ++=)|(Y Z H =)(3x H =log 6=2.585 bit )|(X Z H =)(32x x H +=)(Y H=2⨯(361log 36+362log 18+363log 12+364log 9+365log 536)+366log 6=3.2744 bit)|(Y X H =)(X H -);(Y X I =)(X H -[)(Y H -)|(X Y H ]而)|(X Y H =)(X H ,所以)|(Y X H = 2)(X H -)(Y H =1.8955 bit或)|(Y X H =)(XY H -)(Y H =)(X H +)|(X Y H -)(Y H而)|(X Y H =)(X H ,所以)|(Y X H =2)(X H -)(Y H =1.8955 bit),|(Y X Z H =)|(Y Z H =)(X H =2.585 bit)|,(Y Z X H =)|(Y X H +)|(XY Z H =1.8955+2.585=4.4805 bit2.10 设一个系统传送10个数字,0,1,…,9。

奇数在传送过程中以0.5的概率错成另外一个奇数,其余正确接收,求收到一个数字平均得到的信息量。

解:8,6,4,2,0=i √);(Y X I =)(Y H -)|(X Y H因为输入等概,由信道条件可知,⎪⎪⎩⎪⎪⎨⎧=++++====101)8181818121(101)(101)(为偶数为奇数i i y p i i y p 即输出等概,则)(Y H =log 10)|(X Y H =)|(log )(i j jjiix y p yx p ∑∑-=)|(log )(i j j i j i x y p y x p ∑∑-偶-)|(log )(i j j i j i x y p y x p ∑∑奇=0-)|(log )(i j j i j i x y p y x p ∑∑奇= -)|(log )|()(97,5,3,1i i i ii ix y p x yp x p ∑=,-)|(log )|()(97531i j j i i i jix y p x yp x p ∑∑≠,,,,==101⨯21log 2⨯5+101⨯21⨯41log 8⨯4⨯5 =4341+=1 bit);(Y X I =)(Y H -)|(X Y H =log 10 -1=log 5=2.3219 bit2.11 令{821,,u u u ,⋯}为一等概消息集,各消息相应被编成下述二元码字 1u =0000,2u =0011,3u =0101,4u =0110,5u =1001,6u =1010,7u =1100,8u =1111通过转移概率为p 的BSC 传送。

求:(a)接收到的第一个数字0与1u 之间的互信息量。

(b)接收到的前二个数字00与1u 之间的互信息量。

(c)接收到的前三个数字000与1u 之间的互信息量。

(d)接收到的前四个数字0000与1u 之间的互信息量。

解:即)0;(1u I ,)00;(1u I ,)000;(1u I ,)0000;(1u I)0(p =4)1(81⨯-p +481⨯p =21)0;(1u I =)0()|0(log1p u p =211log p-=1+)1log(p - bit)00(p =]2)1(4)1(2[8122p p p p +-+-=41)00;(1u I =)00()|00(log 1p u p =4/1)1(log 2p -=)]1log(1[2p -+ bit)000(p =])1(3)1(3)1[(813223p p p p p p +-+-+-=81)000;(1u I =3[1+)1log(p -] bit)0000(p =])1(6)1[(814224p p p p +-+-)0000;(1u I =42244)1(6)1()1(8log p p p p p +-+-- bit2.12 计算习题2.9中);(Z Y I 、);(Z X I 、);,(Z Y X I 、)|;(X Z Y I 、)|;(Y Z X I 。

解:根据题2.9分析)(Z H =2(216log 2161+3216log 2163+6216log 2166+10216log21610+ 15216log 21615+21216log 21621+25216log 21625+27216log 21627) =3.5993 bit);(Z Y I =)(Z H -)|(Y Z H =)(Z H -)(X H =1.0143 bit );(Z X I =)(Z H -)|(X Z H =)(Z H -)(Y H =0.3249 bit );,(Z Y X I =)(Z H -)|(XY Z H =)(Z H -)(X H =1.0143 bit)|;(XZYI=)|(XZH-)|(XYZH=)(YH-)(XH=0.6894 bit)|;(YZXI=)|(YZH-)|(XYZH=)(XH-)(XH=0 bit2.14对于任意概率事件集X,Y,Z,证明下述关系式成立(a))|,(XZYH≤)|(XYH+)|(XZH,给出等号成立的条件 (b))|,(XZYH=)|(XYH+),|(YXZH(c)),|(YXZH≤)|(XZH证明:(b) )|,(XZYH=-∑∑∑x y zxyzpxyzp)|(log)(=-∑∑∑x y zxyzpxypxyzp)]|()|(log[)(=-∑∑∑x y zxypxyzp)|(log)(-∑∑∑x y zxyzpxyzp)|(log)(=)|(XYH+)|(XYZH(c) ),|(YXZH=-∑∑∑x y zxyzpxyzp)|(log)(=∑∑x yxyp)([-∑zxyzpxyzp)|(log)|(]≤∑∑x yxyp)([-∑zxzpxzp)|(log)|(]=-∑∑∑x y zxzpxyzp)|(log)(=)|(XZH当)|(xyzp=)|(xzp,即X给定条件下,Y与Z相互独立时等号成立 (a) 上式(c)左右两边加上)|(XYH,可得)|(XYH+),|(YXZH≤)|(XYH+)|(XZH于是)|,(XZYH≤)|(XYH+)|(XZH2.28 令概率空间⎥⎥⎦⎤⎢⎢⎣⎡-=21,211,1X ,令Y 是连续随机变量。

已知条件概率密度为⎪⎩⎪⎨⎧≤-<-=其他,022,41)|(x y x y p ,求:(a)Y 的概率密度)(y ω (b));(Y X I(c) 若对Y 做如下硬判决⎪⎩⎪⎨⎧-≤⋯⋯-≤<-⋯⋯>⋯⋯=1,111,01,1y y y V求);(V X I ,并对结果进行解释。

解:(a) 由已知,可得)1|(-=x y p =⎪⎩⎪⎨⎧⋯⋯≤<-⋯⋯elsey 01341)1|(=x y p =⎪⎩⎪⎨⎧⋯⋯≤<-⋯⋯elsey 03141)(y ω=)1(-=x p )1|(-=x y p +)1(=x p )1|(=x y p=⎪⎪⎪⎪⎩⎪⎪⎪⎪⎨⎧⋯⋯≤<⋯⋯≤<-⋯⋯-≤<-⋯⋯elsey y y 0318111411381(b) )(Y H C =⎰⎰---+⨯11134log 4128log 81=2.5 bit)|(X Y H C =⎰--=-=-=-13)1|(log )1|()1(dy x y p x y p x p⎰-===-31)1|(log )1|()1(dy x y p x y p x p=dy dy ⎰⎰----311341log 412141log 4121 =2 bit);(Y X I =)(Y H C -)|(X Y H C =0.5 bit(c) 由)(y ω可得到V 的分布律再由)|(x y p 可知5.14log 2412log 21)(=⨯+=V H bit 2]2log 212log 21[21)|(⨯+=X V H =1 bit);(V X I =)|()(X V H V H -= 0.5 bit2.29 令)(1x Q 和)(2x Q 是同一事件集U 上的两个概率分布,相应的熵分别为1)(U H 和2)(U H 。

(a)对于10≤≤λ,证明)(x Q =λ)(1x Q +)1(λ-)(2x Q 是概率分布 (b))(U H 是相应于分布)(x Q 的熵,试证明)(U H ≥λ1)(U H +)1(λ-2)(U H证明:(a) 由于)(1x Q 和)(2x Q 是同一事件集U 上的两个概率分布,于是)(1x q ≥0,)(2x q ≥0dx x q x⎰)(1=1,dx x q x⎰)(2=1又10≤≤λ,则)(x q =λ)(1x q +)1(λ-)(2x q ≥0dx x q x⎰)(=dx x q x⎰)(1λ+dx x q x⎰-)()1(2λ=1因此,)(x Q 是概率分布。