中文指代消解名词短语的识别

如何“破译”指代词语的指代义- -

如何“破译”指代词语的指代义- -【注】:本文在2001年3月于浙江温州召开的全国中语会教改中心第三届年会上获得第四届"语通杯"好文章大赛全国二等奖(由中国教育学会中学语文教学专业委员会教学改革研究中心与中国教育学会中学语文教学专业委员会会刊《语文教学通讯》联合主办)如何"破译"指代词语的指代义福建省福鼎市第五中学林承雄"理解词语在文中的含义"是高考现代文阅读的一项重要技能,而"理解指代词语在文中的指代义"又是文章词语阅读的一种常见的题型。

1990、1994、1996高考全国卷等先后多次考查过对指代词语的理解。

本文试图结合具体题例谈谈指代词语理解题的解答技巧。

指代词语包括指代词与指代短语两类。

指代词是指具有指示、代替作用的代词等。

主要起替代作用的有人称代词"我、你、他","我们、你们、他们","自己、人家、别人"等,"它"不指人,但习惯上也归入人称代词,既有代替作用,又有指称作用的有指示代词,包括近指代词"这"、"此"和远指代词"那"。

此外,现代书面语中经常使用两个文言代词"之"与"其"来指代一定内容,"之"相当于"他(它)"、"他(它)们",在句中作宾语(或兼语),不能作主语;"其"相当于"他(它)的"、"他(它)们的"在句中作领属性定语。

指代语是由代词与其他词类(如:名词、数量词、连词、动词等)复合生成的某些特殊的短语。

如"这些、那些","某些","这样、那样","如此","之所以如此","既然这样"等等。

基于多注意力机制的维吾尔语人称代词指代消解

的先行语, 因为文本中 “

(布葛热汗)” 与

“ (他)” 距离更近. 但是, 候选先行语 “

(吾

斯英)” 才是照应语 “ (他)” 正确的先行语. 所以,

人称代词指代消解应该充分考虑候选先行语距离特

征和更深层次的语境信息.

针对以上问题, 本文提出基于多注意力机制的

深度学习模型应用于维吾尔语人称代词指代消解任

2. Key Laboratory of software engineering technology, Xinjiang University, Urumqi 830046 3. Key Laboratory of Signal and Information Processing, Xinjiang University, Urumqi 830046 4. Network Center, Xinjiang University, Urumqi 830046 5. College of formation Science and Technology, Xinjiang University, Urumqi 830046

指代消解作为自然语言处理一个重要子任务, 深度学习模型在指代消解中得到广泛的研究. 这些 研究关注照应语和候选先行语的语义信息, 应用大 量的神经网络模型进行候选先行语预测[6−8]. 目前 的研究主要针对中文和英文等具有充足语料库的语 种, 对维吾尔语等小语种的研究不够深入, 针对小语 种的研究无论是语料标注还是实体识别都需要掌握 多级语法知识、语义知识, 甚至相应语言领域知识, 在当前自然语言处理的研究阶段, 要获取和学习研 究中所需知识仍比较困难. 人称代词指代消解作为 指代消解任务更细粒度的一个分支, 不仅依赖照应 语和候选先行语特征信息, 还要关注距离特征和上 下文语境信息. 例如句子:

中英文论文参考文献范例

中英文论文参考文献一、中英文论文期刊参考文献[1].面向中英文混合环境的多模式匹配算法.《软件学报》.被中信所《中国科技期刊引证报告》收录ISTIC.被EI收录EI.被北京大学《中文核心期刊要目总览》收录PKU.2008年3期.孙钦东.黄新波.王倩.[2].基于自适应特征与多级反馈模型的中英文混排文档分割.《自动化学报》.被中信所《中国科技期刊引证报告》收录ISTIC.被EI收录EI.被北京大学《中文核心期刊要目总览》收录PKU.2006年3期.夏勇.王春恒.戴汝为.[3].基于最大熵方法的中英文基本名词短语识别.《计算机研究与发展》.被中信所《中国科技期刊引证报告》收录ISTIC.被EI 收录EI.被北京大学《中文核心期刊要目总览》收录PKU.2003年3期.周雅倩.郭以昆.黄萱菁.吴立德.[4].中英文指代消解中待消解项识别的研究.《计算机研究与发展》.被中信所《中国科技期刊引证报告》收录ISTIC.被EI 收录EI.被北京大学《中文核心期刊要目总览》收录PKU.2012年5期.孔芳.朱巧明.周国栋.[5].基于树核函数的中英文代词消解?.《软件学报》.被中信所《中国科技期刊引证报告》收录ISTIC.被EI收录EI.被北京大学《中文核心期刊要目总览》收录PKU.2013年5期.孔芳.周国栋.[6].基于树核函数的中英文代词消解.《软件学报》.被中信所《中国科技期刊引证报告》收录ISTIC.被EI收录EI.被北京大学《中文核心期刊要目总览》收录PKU.2012年5期.孔芳.周国栋.[7].一种并行中英文混合多模式匹配算法.《计算机工程》.被中信所《中国科技期刊引证报告》收录ISTIC.被北京大学《中文核心期刊要目总览》收录PKU.2014年4期.王震.李仁发.李彦彪.田峥.[8].中英文混合文章识别问题.《软件学报》.被中信所《中国科技期刊引证报告》收录ISTIC.被EI收录EI.被北京大学《中文核心期刊要目总览》收录PKU.2005年5期.王恺.王庆人.[10].中英文混排扭曲文本图像快速校正方法.《图学学报》.被中信所《中国科技期刊引证报告》收录ISTIC.被北京大学《中文核心期刊要目总览》收录PKU.2015年6期.王景中.孙婷.童立靖.二、中英文论文参考文献学位论文类[1].中英文足球新闻标题中隐喻的对比研究.作者:郭浩.英语语言文学安徽大学2013(学位年度)[2].中英文汽车广告的人际意义比较研究.被引次数:2作者:王洁璁.外国语言学与应用语言学山东师范大学2012(学位年度)[3].中英文字体匹配初探.被引次数:1作者:姚文凭.艺术设计学湖南师范大学2011(学位年度)[4].多模态理论视角下中英文环保广告的对比研究.作者:张楠.外国语言学及应用语言学山西师范大学2013(学位年度)[5].基于字符串匹配的中英文混合分词技术研究.被引次数:4作者:王茜.计算机软件与理论四川师范大学2011(学位年度)[6].基于ROI原则的中英文公益广告修辞劝说及其诉求分析.作者:马欣宇.商务英语对外经济贸易大学2013(学位年度)[7].跨文化视角下中英文简历的语类分析.作者:高琳.外国语言学及应用语言学天津商业大学2015(学位年度)[8].中英文商务信函比较研究.作者:王卓.汉语言文字学长春理工大学2013(学位年度)[9].中英文混排名片识别系统研究.被引次数:4作者:金鑫.计算机应用技术南京航空航天大学2011(学位年度)[10].网上中英文招聘广告信息流动模式对比研究.作者:韩蕊.外国语言学及应用语言学天津理工大学2012(学位年度)三、中英文论文专著参考文献[1]VisualEPlus—EnergyPlus的中英文图形化界面工具.潘毅群.李歧强.周辉.黄治钟.何宗键,2010全国暖通空调制冷2010年学术年会[2]一种适合中英文混排的字符分割技术.刘娟.郭钧天.范依林,20082008中国计算机大会[3]医学期刊中英文姓名的著录及中英文转换.王冰,2003第三届中国科技期刊青年编辑学术研讨会[4]清管技术与设备中英文术语探析.杨路,2006第三届全国管道技术学术会议[5]科研论文写作中的汉英杂糅现象及编辑策略.石春让,2010第八届全国核心期刊与期刊国际化、网络化研讨会[6]高影响力医学期刊中英文参考文献著录差错分析.朱红梅.张大志.任红,2011第九届全国医药卫生期刊编辑出版学术会议[7]基于聚合关系的中英文词表概念映射方法及实证.邓盼盼.常春.李晓瑛,20142014年第五届全国知识组织与知识链接学术交流会[8]合理运用语言比例,提高经济学科双语教学质量.王时芬,2010第五届中国经济学教育年会暨院长(系主任)联席会议[9]VisualEPlus——EnergyPlus的中英文图形化界面工具.潘毅群.李歧强.周辉.黄治钟.何宗键,20092009年全国暖通空调专业委员会空调模拟分析学组学术交流会[10]‘大峡谷与谷地’名称问题讨论.凌小惠.钱方,2009中国地质学会旅游地学与地质公园研究分会第24届年会暨白水洋国家地质公园建设与旅游发展研讨会。

指代消解的主要方法及其机制

静态变元约束机制 ,意义被看作是模型中的状态变元之间的关系 ,语句的意义看作是语境更新的潜

力。

一

、

处理 照 应现象 的主 要方 法

据笔者所知 ,到 目 前为止 ,处理指代现象 的方法在逻辑学界就多达十多种 ,比如 :话语表现理

收 稿 日期 :0 2 0 — 0 21—62

基金项 目: 国家社科 基金重大招标项 目“ 自然语言信 息处理 的逻辑语义学研究 ” 阶段 性成果之一 , 目编号 :0 D0 3 项 1&Z 7 作者简介 : 张晓君(9 O )女 , 17一 , 四川南充人 , 厦门大学哲学 系博士后 。研究方 向 : 自然语 言逻辑 、 动态认知行动逻辑 。

指代 (np oa是 自然 语言 中非 常普 遍 的语 言现 象 ,对 于简 化表 述 ,衔接 上下 文 和意 义 的连贯 起 aah r ) 着重 要 的作用 。在 语言 学 中 ,指代 词(npo 所 指 的对象 和 内容 叫做 先行 词 ,为指代 词确 定先 行词 的 ห้องสมุดไป่ตู้aahO

过程 叫做指代消解( ahr r o tn。指代消解在信息抽取 、自 a poae l i ) n s uo 然语言接 口、机器翻译 、文本摘要 和问答系统等人工智能的应用领域中起着重要的作用 。n 在 自然语言中,具有指代现象 的典型语句

合性话语表现理论(P o p si a D T等,而仅使用范畴对指代现象进行处理的方法就有六种。 S C m oiol R ) tn 笔者通过对 比研究发现 :话语表现理论虽然具有动态地处理指代现象 的能力 ,但它却不满足组 合性原则 ;动态谓词逻辑虽然满足组合性且能够进行指代消解 ,但其语境增量具有破坏性 ;动态蒙 太格语 法在其动态内涵逻辑的翻译 中 ,选择一个 特别 的话语标 记对 成分 间可 能的指代关系进行标 示 ,能 够很 好 地 处理 指 代 现 象 ;带 有 内在 动态 广 义 量词 的动 态谓 词 逻辑 允 许 在其 第 一个 论 元 的动 态 存在量词与其第二个论元相应变元之 间具有间接约束关系 ,能够进行指代消解 ;增量动态逻辑规定 量词可 以约束 下一 个可 以达 到的变元寄存器 (g t ) ,并定义 了能够为代词找到先行 词的语境 ; r ie ① esr kD T - R 是通过向话语表现理论中添加入 演算从而得到语句的组合性处理 ;【 组合性话语表现理论是 一 8 ] m

nlp面试题目及答案

nlp面试题目及答案NLP(自然语言处理)是人工智能领域中的一个重要分支,涉及到理解、处理和生成人类语言的能力。

对于从事NLP相关工作的人员来说,准备好面试题目及其答案是至关重要的。

本文将为大家提供一些常见的NLP面试题目及其答案,希望对大家的面试准备有所帮助。

一、基础理论题1. 请解释自然语言处理(NLP)的概念。

自然语言处理(NLP)是指计算机通过对自然语言进行分析和理解,并利用这些分析结果进行相关任务的一种技术。

它包括了文本理解、机器翻译、文本生成、信息抽取等一系列技术和应用。

2. 请介绍NLP的主要挑战是什么?NLP的主要挑战包括语义理解、语义生成、指代消解、语音识别、机器翻译等。

其中,语义理解是指理解句子的具体意义和上下文关联;语义生成是指根据一定的输出规则和输入生成句子;指代消解是解决代词、名词短语等的指代问题;语音识别是将语音转化为文字的过程;机器翻译是将一种语言的内容转化为另一种语言的过程。

3. 请解释什么是词嵌入(Word Embedding)?词嵌入是将单词转化为连续向量表示的技术。

它通过将单词映射到高维向量空间中的点来表示单词的语义。

通常使用的方法是通过训练语言模型或者神经网络自动学习词嵌入。

4. 请解释什么是词袋模型(Bag of Words Model)?词袋模型是一种简化的文本表示方法,将文本中的每个词都看做一个独立的特征,并将其转化为一个向量。

在词袋模型中,每个词的出现与否是一个二进制的特征,向量的每一维表示对应词的出现次数。

5. 请解释什么是TF-IDF值?TF-IDF(Term Frequency-Inverse Document Frequency)是一种用于衡量词语在文本中的重要性的方法。

TF指的是词语在文本中的频率,IDF指的是逆文档频率,即该词语在整个文本集合中的重要程度。

TF-IDF值越大,表示该词在文本中的重要性越高。

二、应用题1. 请解释一下词性标注是什么?词性标注是指为文本中的每个词语标注词性或者词类的过程。

自然语言处理领域存在哪些亟待解决的问题?

自然语言处理领域存在哪些亟待解决的问题?自然语言处理(Natural Language Processing, NLP)是计算机科学与人工智能领域中探索和处理人与机器之间的自然语言交互的研究领域。

随着人工智能的迅速发展,NLP也取得了长足的进步和成就。

然而,尽管取得了重要的突破,但NLP领域仍然面临许多亟待解决的问题。

本文将重点介绍一些当前NLP领域中存在的亟待解决的问题。

一、语义理解与推理语义理解是指计算机对语句进行深入的理解和解释,使其能够捕捉到言外之意、常识性知识和上下文的相互关系。

目前,NLP系统的语义理解仍然相对较浅,无法涵盖复杂的语义推理和逻辑推理。

在真正地理解人类语言的同时,将语言转化为计算机可处理的结构将是一个重要的问题。

此外,许多基于统计的方法在处理复杂的语义关系上也存在局限性。

二、语言生成语言生成是指计算机根据一定的输入信息生成自然语言。

虽然自动生成某些文本内容的技术已经取得了进展,但生成的文本在语义和流畅性方面仍然存在问题。

生成文本往往不自然,缺乏结构和条理性,特别是当涉及到长篇文章或复杂议题时。

为了解决这个问题,需要进一步改进生成模型,提高生成文本的自然程度和准确性。

三、语言理解的上下文语言理解的上下文理解是NLP中一个重要的挑战。

人类往往依靠上下文信息来理解含糊或模棱两可的语句,但对于计算机而言,理解语句时上下文信息往往是不可见的。

因此,在NLP中引入上下文信息变得非常重要。

解决这个问题的方法包括引入语义角色标注、指代消解和共指消解等技术,以更好地利用语境信息来理解和解释自然语言。

四、多语言处理随着全球化的发展,多语言处理成为NLP领域的一个重要问题。

许多NLP技术在处理英语之外的其他语言时效果不佳。

在处理多语言数据时仍存在着语言差异和结构差异的挑战。

如何在各种不同的语言和语境中进行高效准确的处理,仍然是一个亟待解决的问题。

五、数据稀缺和数据偏见大规模的高质量数据是许多NLP任务的基础。

中文指代消解方法研究讲义brmq

搭配

数

饰限定 饰数量

类型

类型

I、J的距 I、J的全 I、J的子 I、J的抽

离

匹配信 串缩略 取缩略

息

信息

信息

Outline

研究背景及意义 国内外研究现状 论文研究方法及内容 名词短语识别及特征向量选定 基于决策树的中文指代消解 结合规则的决策树中文指代消解 结论 下一步工作

基于决策树的中文指代消解

{19980101-01-001-002/m}Q {中共中央 /nt}O {总书记/n 、/w 国家/n 主席/n}G {江 /nr 泽民/nr}H

特征向量选定

参考国内外相关研究选定16个特征

I

搭配

数

饰限定 饰数量

类型

类型

J的句法 J的单复 J的性别 J的类型 J的被修 J的被修

名词短语识别(识别步骤)

第一步:识别出基本名词成分。各种名词成分 分为六组,如上页所示。

第二步:同组短语局部最大化,亦即如果两个 相邻的标出的短语的组别相同,那么就将二者 合并为一个短语。

第三步:并列名词性短语合并。如果出现在 “和”、“与”或“、”两侧的短语组别相同, 则将两侧短语连带“和”、“与”或“、”一 起合并为一个短语(这里排除代词组的情况)。

决策树学习概况:ID3、C4.5、C5.0 实验数据准备情况

正反例类型 指代类型

正例(有指代 名词短语 关系) 代词

反例(无指代 名词短语 关系) 代词

数 百分 量比

44 29.3%

35 23.3%

58 38.7%

13 8.7%

样例的不同类型分布情况

C5.0生成的决策树

IJ全匹配

T

F

+

指代消解中代词待消解项识别研究

指代消解中代词待消解项识别研究陈九昌;孔芳;朱巧明;周国栋【摘要】This paper studies the identification of pronouns to be resolved on the basis of a machine learning based coreference resolution platform.A filter of pronouns to be resolved is generated with machine learning method by combining these two: to mine sets of features which are able to discriminate whether the pronouns are the items to be resolved or not, and to summarise and educe syntactic structure of pronouns to be resolved with rules, and they are add onto the pronouns coreference resolution platform. The performance of the filter and the contribution to pronouns coreference resolution are tested with ACE2003 benchmark corpus. Experiment shows that the filter achieves higher precision rate and the performance of pronouns coreference resolution system can be improved outstandingly.%以基于机器学习的指代(Anaphora)消解平台为基础,研究代词待消解项识别问题.挖掘能区分代词是否为待消解项的特征集,总结归纳具有规律的代词待消解项的句法结构,使用机器学习的方法将二者结合生成代词待消解项过滤器并将其加入到代词指代消解平台.在ACE2003基准语料上测试过滤器自身性能及对代词指代消解的贡献.实验表明过滤器具有较高的准确率,能明显地提高代词指代消解系统的性能.【期刊名称】《计算机应用与软件》【年(卷),期】2011(028)003【总页数】4页(P217-219,249)【关键词】指代消解;待消解项识别;机器学习【作者】陈九昌;孔芳;朱巧明;周国栋【作者单位】【正文语种】中文0 引言指代是自然语言中常见的语言现象,它是指在语篇中用一个指代词回指某个以前说到过的语言单位,这对保持文章的连贯性上起着重要的作用。

中文词义消歧的方法研究

中文词义消歧的方法研究摘要:词义消歧一直是自然语言处理领域的难题之一,它的研究对包括机器翻译、信息检索、文本分类等众多研究领域都会有一个积极的推动作用。

本文阐述了词义消歧的方法,以及各种消歧方法的优缺点,分析了影响词义消歧效果的因素,并给出了自己在词义消歧方面的想法。

关键词:词义消歧;自然语言处理;规则;统计词义消歧是自然语言处理领域一个重要的研究课题.也是近年来该领域研究的热点问题之一。

歧义的存在使计算机在“理解”自然语言时发生了困难,并很可能出现了错误。

词义消歧要解决的问题是如何让计算机理解多义词在特定的上下文环境中具体代表的语义。

汉语的词义消歧研究起步比较晚,整体水平不容乐观.尚局限在几个歧义词,譬如说选择5~10个有歧义的名词或动词作为消歧研究对象,个别正确率很高,但难以推广至全文(即所有的歧义词)。

目前的词义消歧研究还停留在实验室阶段,离实际应用还有很长的一段距离。

一、词义消歧方法语言学知识描述了词汇间的关系,歧义的产生源于词汇所涉及的领域、所处的结构等因素。

消解歧义的前提是为歧义词选择恰当上下文。

所有歧义的消解都依赖于多义词上下文提供的信息。

所以通过特定的上下文环境判断歧义词的特定词义是解决词义消歧问题的唯一出发点,是所有词义消歧技术、方法的源头。

1、基于规则的词义消歧方法早期的词义消歧研究重点在于基于规则的方法。

该方法依赖语言学家的语言知识来描述词义之间的关系,并建立规则库。

通过对歧义词及其上下文词语的分析,选择满足规则、条件的词义作为正确答案。

该方法符合人类的认知习惯,像专家系统那样很容易理解并被接受。

但由于规则通常由语言专家制定,具有很大的主观性,难免存在一些错误。

此外,如何保证规则库的一致性、可扩充性和完备性是该方法面临的难题。

2、统计词义消歧方法统计词义消歧方法借助统计学的思想和方法来处理词义歧义问题,统计学的方法不需要制定规则,自动在语料库、知识库中获取所需信息,来指导词义消歧。

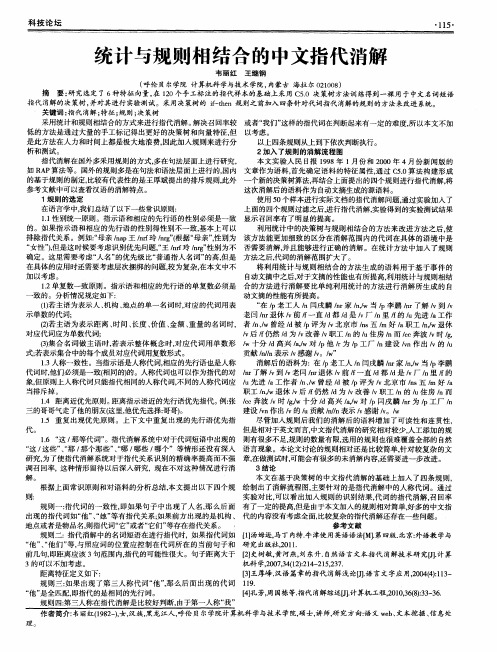

统计与规则相结合的中文指代消解

距离特征定义如下: [ 3 】 王厚峰. 汉语篇章的指代 消解浅论[ J ] . 语 言文 字应 用, 2 0 0 4 ( 4 ) : 1 1 3 — 1 9 . 规则 三: 如果 出现 了第 三人称代 词 “ 他” , 那 么后 面出现 的代词 1 “ 他” 是全匹配, 即指代的是相 同的先行词 。 『 4 】 孔芳, 周 国栋等. 指代 消解综述『 J ] 计 算机 工程, 2 0 1 0 , 3 6 ( 8 ) : 3 3 — 3 6 . 规则 四: 第三人称在指代消解是 比较好判断, 由于第一人称 “ 我”

科 技论 坛

・ 1 1 5 ・

统 计与规则相结合 的中文指代消解

韦丽红 王继 钢

( 呼伦 贝尔学院 计算机科学与技 术学院, 内蒙古 海拉 尔 0 2 1 0 0 8 ) 摘 要: 研 究选定了 6 种特征 向量 , 在1 2 0个手工标注的指代样本的基础上采用 C5 . 0 决策树 方法训练得到一棵 用于 中文名词短语 指代 消解 的决策树 , 并对其进行 实验测试 。采用决策树 的 i f - t h e n规 则之前加入 四奈针对代词指代 消解 的规则的方法来改进 系统。 关键词 : 指代消解 ; 特征 ; 规 则; 决策树 采用统计和规则 相结合 的方式来进行指代消解。 解决召 回率较 或者 “ 我们” 这样 的指代 词在判 断起来有一 定的难度, 所 以本 文不加 低的方法是通过大量 的手工标记 得出更好 的决策树 和向量特征, 但 以考 虑 。 以上 四条规则从上到下依次判断执行。 2加入 了规则的消解流程图 指代消解在 国外多采用规则 的方式 , 多在句法层 面上进行研究, 本文实 验人 民 E t 报 1 9 9 8年 1 月份 和 2 0 0 0年 4月 份新 闻版 的 如R A P算法等。国外的规则 多是在句法和语法层面上进行的, 国内 文章作为语料 , 首先 确定语料 的特征属性 , 通过 C 5 . 0算法构建形 成 的基 于规则 的制定, 比较有代表性 的是 王厚斌 提出的排斥 规则, 此外 个新的决策树算法, 再结合上 面提 出的四个规则进行指代消解, 将 参 考文献中可 以查看汉语 的消解特点。 这次消解后 的语料作为 自动文摘生成的源语料 。 1规则 的选 定 使用 5 0个样本进行 实际文档 的指代消解 问题, 通过 实验加入 了 在语 言学 中, 我们总结 了以下一些常识原则 : 上面的四个规则过滤之后, 进行指代消解, 实验 得到的实验测试结果 1 . 1 J 陛别 统一原则 。指示语 和相应 的先行 语的性别必须是一致 显示 召回率有 了明显的提高。 的。如果 指示语 和相应的先行语 的性别得性别 不一致, 基本 上可 以 利用统计 中的决 策树 与规则相结合 的方法来 改进方法之 后, 使 排除指代关系 。例如: “ 母亲 / n a p 王/ n r f 玲/ n r g ” ( 根据 “ 母亲” , 性别 为 该 方法能更加细致 的区分在消解范 围内的代词在具体 的语 境 中是 “ 女性” ) , 但是这时候要考虑识别优先 问题 , “ 王/ n r f 玲/ n r g ” 性 别为不 否需 要消解, 并且能够进行正确 的消解 。在统计 方法中加人 了规则 确定 。这里需要考虑 “ 人名 ” 的优先级 比“ 普通指人名词 ” 的高, 但 是 方法之后, 代词 的消解范 围扩大了。 在具体 的应用时还需要考虑层 次捆绑的问题, 较为复杂, 在本 文中不 将 利用统计 与规则相结合 的方法生成 的语料用 于基 于事件 的 加 以考虑。 自动文摘 中之后, 对于文摘的性能也有所提高, 利用统计与规则相结 1 . 2 单复数一致原则 。指示语和相应 的先行语 的单 复数 必须是 合 的方法进行消解要 比单 纯利用统计 的方 法进 行消解所生 成的 自 致的 。分析情 况规定如下 : 动文摘的性能有所提高。 ( 1 ) 若主语为表示人 、 机构 、 地点的单一名词 时, 对应 的代词用 表 “ 在, p老工人 , n闫戌麟 , n r 家, n , , w当 , p李鹏 / n r 了解 , v 到/ v 示单数的代 词; 老闰/ n r 退休 , v 前, f 一直 , d都 / d 是/ v 厂, n里 , f 的, u先进 , a工作 ( 2 ) 若 主语为表示距 离 、 时间、 长度 、 价值 、 金额 、 重量 的名 词时, 者 , n 、 , w曾经 , d被 / p评 为 , v 北 京市 , n s 五/ m好 , a 职工 , n , , w退 休 对应代 词应 为单数代词; / v 后, f 仍然 , d 为, v 改善 , v 职工 , n的 / u住房 / n而 , c c 奔波 , v 时 , ( 3 ) 集合 名词做 主语 时, 若 表示 整体概念 时, 对应代 词用单 数形 , w十分 , d高兴 , a , , w对 , p他 / r 为, p工 厂 , n建设 , v n作 出 , v的 , u 式; 若表示 集合 中的每个成员对应代词用复数形式。 贡献 / n / / n表示 , v 感谢 , v 。, w ” 1 . 3人称一致性。当指示语是人称代词, 相应的先行语也是人称 消解后 的语料为:在 , p 老 工人 / n闫戌麟 , n r 家, n , / w当 , p 李 鹏 代 词时, 他们必 须是一致 ( 相同的) 的。人称代词也可以作 为指代 的对 / n r 了解 , v 到, v 老闫 / n r 退休 , v 前/ f 一直 , d都 , d 是, v 厂, n 里, f 的 象, 但原则上人称代词 只能指代相 同的人称 代词, 不 同的人称代词应 , u 先进 , a 工作 者 , n 、 , w曾经 , d被 , p评为 , v 北 京市 , n s 五, m好 , a 当排斥掉 。 职工 , n , , w退休 , v 后, f 仍然 , d为 / v改善 , v 职工 , n的 , u 住房 , n而 1 . 4 距 离近优先原则 。 距离指示语近 的先行语优先指代 。 例: 张 , c c奔波 , v时 / g , / w十分 / d高兴 / a , / w对 / p闫戌 麟 , n r 为, D工厂 / n 三的哥哥气走 了他的朋友( 这里, 他优先选择: 哥哥) 。 建设 , v n作出 , v的 , u 贡献 / n / / n表示 , v 感谢 , v 。, w 1 . 5 重 复出现优先原 则。上下文 中重复 出现的先行语 优先指 尽管加入规则后 我们 的消解后 的语料增加 了可读性 和连 贯性, 代。 但是相对 于英文而言, 中文指代消解 的研究相对较少, 人工添加 的规 1 . 6“ 这/ 那等代词 ” 。指代消解系统中对 于代词短语 中出现的 则有很 多不足, 规则 的数量有 限, 选用 的规则也很难覆盖全部 的 自然 “ 这/ 这些 ” 、 “ 那/ 那个那些 ” 、 “ 哪/ 哪些 / 哪个”等情形还没有深入 语 言现象。本论 文讨论的规则相对还是 比较简单, 针对较复杂的文 在做测试 时, 可能会有很多 的未消解内容, 还需要进一步改进。 研究 , 为 了使指代消解系统对 于指代关 系识别的精确率提 高而不强 章, 调 召回率,这种情形留待以后 深入研 究, 现在不对这 种情况进行消 3结 论 解。 本 文在基于决策树 的中文指代消解 的基础上 加入 了四条规则 , 根据上 面常识原则 和对语 料的分析总结 , 本文提 出以下 四个规 绘 制出了消解 流程图, 主要针对的是指代消解 中的人 称代词 。通过 则: 实验对 比, 可 以看 出加 入规则 的识别结果 , 代词 的指代消解, 召 回率 规则一 : 指 代词 的一 致性, 即如果句子 中出现 了人 名, 那么后 面 有 了一定 的提高, 但是 由于本 文加 入的规则 相对 简单 , 好多的 中文指 出现 的指代 词如“ 他” 、 “ 她” 等有 指代关 系; 如果前方 出现的是机构 、 代 的内容没有考虑全面, 比较复杂 的指代消解还存在一些 问题 。 参 考 文 献 地点或者是物品名, 则指代词“ 它” 或者“ 它们” 等存在指代关系。 规则二:指代 消解 中的名词 短语 在进 行指代时,如果指代 词如 【 1 】 汤姆逊, 马丁 内特 . 牛津使 用英语语 法【 M】 锑 四版. 北京: 外语教 学与 2 0 1 I . “ 他” 、 “ 他们 ” 等, 与照应 词的位 置应 控制在代 词所在 的当前句子 和 研 究 出版 社 。 前几句, 即距离应该 3句范围 内, 指代 的可能性很 大。句子距 离大于 【 2 】 史树敏, 黄河燕, 刘 东升. 自然语 言文本指代 消解技 术研 究『 J 1 . 计算 3的可以不加 考虑 。 机科 学, 2 0 0 7 , 3 4 ( 1 2 ) : 2 1 4 — 2 1 5 , 2 3 7 .

使用ChatGPT进行对话历史管理和上下文追踪的技巧

使用ChatGPT进行对话历史管理和上下文追踪的技巧人工智能的快速发展使得自动对话系统在各个领域得到了广泛应用。

其中,OpenAI的ChatGPT(Chat-based Language Model)以其出色的生成对话能力和自然语言处理能力备受瞩目。

然而,在实际应用中,ChatGPT还存在一些挑战,如对话历史管理和上下文追踪。

本文将介绍一些使用ChatGPT进行对话历史管理和上下文追踪的技巧,帮助我们更好地利用这一强大的工具。

首先,对话历史管理是指对先前对话的内容进行适当处理和管理,以便ChatGPT能够更好地理解和回应后续对话。

一个简单而有效的方法是将对话历史以文本列表的形式传递给ChatGPT。

这样,ChatGPT就可以通过逐步更新对话历史,通过阅读整个对话历史来获取先前的语境。

在生成回应时,我们可以根据需要选择保留最近几轮的对话历史,以免过多的历史信息对生成结果产生干扰。

通过对话历史管理,我们可以提供清晰而连贯的上下文,使ChatGPT能够更好地理解对话的背景和语义。

其次,上下文追踪是指在对话过程中跟踪对话的上下文,并正确理解并回应基于这些上下文的问题。

一个常见的难题是指代消解,即理解代词或名词短语指向的具体对象。

为了解决这个问题,我们可以使用特殊的标记将代词替换为其对应的实体或上下文中的名称,这有助于ChatGPT正确理解代词的指向。

此外,上下文追踪还包括处理多轮对话中的逻辑关系和时间线,以便ChatGPT能够更好地捕捉到对话中的演变和连贯性。

对于复杂的对话场景,合理的上下文追踪是确保ChatGPT生成一致和有逻辑的回复的关键。

另外,通过适当的问题引导,可以帮助ChatGPT更好地理解并回答问题。

一个简单而有效的方法是使用明确的问题标记。

例如,在对话开始阶段,我们可以用“用户:”来引导用户提问,用“系统:”来引导ChatGPT生成回答。

这样一来,在对话中,我们可以根据特定的标记来区分用户的问题和ChatGPT的回答,以便更好地理解并引导对话进程。

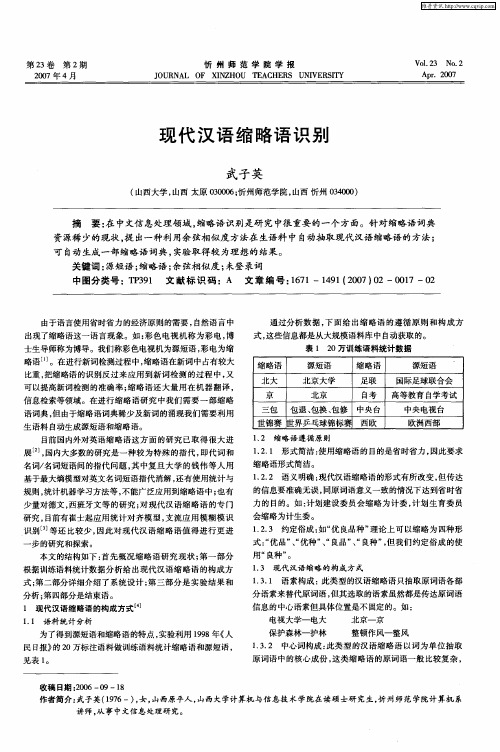

现代汉语缩略语识别

步的研究 和探索 。 本 文的结构如下 : 首先概况 缩略语研 究 现状 ; 第一 部分 根据训练语料统计数据分 析给 出现代汉语 缩略语 的构成 方

式; 第二部分详细介 绍 了系统设 计 ; 第三部分 是实 验结果 和 分析 ; 第四部分是结束语 。

1 现 代 汉 语 缩 略语 的构 成 方 式 11 语 料 统计 分析 .

关键 词 : 源短语 ; 缩略语 ; 弦相似 度 ; 余 未登 录词

中 图分 类号 :T 3 1 文 献 标 识 码 :A 文 章 编 号 :6 1—19 (07) 2—0 1 P9 17 4 1 20 0 07—0 2

由于语言使用省时省力 的经济原则 的需要 , 自然语 言中

通 过分 析数 据 , 面 给 出缩 略语 的遵循 原 则和 构成 方 下

讲 师, 事 中文信息处理研 究。 从

维普资讯

1 8 由三个以上的词组成 。如 :

忻 州 师 范 学 院 学 报

一

第 2 卷 3

个窗 口单元 ( 词语 前后 2个相邻 词语 为一 个窗 口单元 ) 。

,

中国工农红军一 红军 人造地球卫 星一人造卫星

见表 1 。

13 2 中心词构成 : .. 此类 型的汉语缩 略语 以词为 单位抽取 原词 语中的核心成份 , 类缩略语 的原词 语一般 比较复 杂 , 这

收 稿 日期 :0 6— 9 8 20 0 —1

作者简介 : 武予英( 96一) 女 , 17 , 山西原平人 , 山西大学计算机与信 息技 术学院在读 硕士研 究生 , 忻州师 范学院计 算机 系

13 1 语素构成 :此类型 的汉语缩略语 只抽取 原词语各部 . .

分语 素来替代原词语 , 但其选取的语素虽然都是传达原词 语

指代是一种什么方法

指代是一种什么方法指代是一种语言表达中用来替代特定事物、概念或人物的方法。

它是语言中的一个重要現象,用来帮助人们在沟通交流时更加简洁、流利地表达自己的意思。

在日常生活中,指代能够让我们避免重复使用某个名词或词组,以提高语篇的行文流畅性;在文学作品中,指代则有促进情节发展、增加文学艺术性的作用。

指代主要包括代词和名词性成分的使用。

代词是一种专门用来指代名词、代替名词的词类,如“我、你、他、她、它、我们、你们、他们”等。

代词与所代替的名词之间是一一对应的关系,通过代词的使用,可以避免重复使用名词,并简化句子结构。

例如,在句子中,我们可以用“我”代替“小明”:小明去买菜,小明煮饭,小明吃饭;代词的使用则可以简化为:他去买菜,他煮饭,他吃饭。

除了代词,名词性成分也可以充当指代的作用。

名词性成分包括名词、代名词、动名词、不定式等,它们可以充当句子成分中的主语、宾语、表语等,用来指代句子中的某个概念、事物或人物。

例如,在句子中,我们可以用“酒”指代“兴奋剂”:运动员在比赛中使用兴奋剂是违反规定的;名词性成分的使用则可以简化为:运动员在比赛中使用酒是违反规定的。

指代不仅可以简化句子结构,提高句子的简洁性,还可以增加语篇的连贯性。

通过指代,我们可以在后续句子中引用前面提到的事物或概念,使得文章更加连贯,更加易于理解。

例如,在文章中,我们可以用“这个问题”指代前文中提到的某个问题:在城市化进程中,环境污染问题不容忽视。

这个问题直接关系到人民群众的生活质量;通过指代,“这个问题”引用了前文中的环境污染问题,使得文章更加连贯。

此外,指代还在文学创作中具有重要的作用。

通过指代的巧妙运用,可以达到强调、暗示、留白等修辞效果。

在小说、诗歌等文学作品中,指代可以使得作品更加抽象、多义,给读者留下空间进行想象和思考。

例如,在王小波的小说《黄金时代》中,主人公的“我”作为一个指代,不仅是个体的存在,也代表着整个社会的困境和迷茫。

英语指代消解

英语指代消解全文共四篇示例,供读者参考第一篇示例:英语指代消解是指在英语语境中,为了消除不清楚或多义的指代关系,根据上下文和语境,确定代词指代的具体内容。

指代消解是英语语言表达中非常重要的一部分,因为准确的指代可以帮助读者和听者更好地理解语句的意义,同时也可以避免歧义和误解。

在英语中,代词通常用来替代先行词,以避免重复使用相同的名词或短语。

在句子“John went to the store. He bought some groceries.”中,代词“he”指代了先行词“John”。

有时候在文本中,代词的先行词可能并不明确或多义,这时就需要进行指代消解来确定代词的具体指代对象。

在英语语境中,有几种常见的指代消解方式。

第一种是通过上下文进行指代消解。

通常来说,前文中提到的名词或短语会成为代词的先行词。

在句子“I had a great time at th e party. The music was fantastic.”中,代词“the”指代了前文中提到的“party”。

通过上下文,读者可以很容易地理解代词的指代对象。

第三种指代消解方式是通过语用信息进行指代消解。

语用信息是指文本中的暗示和隐含信息,读者可以根据这些信息来确定代词的指代对象。

在句子“Could you pass me that book?”中,代词“that”指代了与说话者最接近的“book”。

通过语用信息,读者可以轻松地确定代词的具体指代对象。

第二篇示例:英语中的指代消解是指当我们在使用语言时,通过后续的语境或者上下文来确定前文中出现的代词或名词短语的指代对象,使得整个语篇具有连贯性和清晰性。

指代消解在英语中是非常常见且重要的现象,因为很多时候一个代词或名词短语并不直接指明其指代对象,需要通过语境来推测。

指代消解可以分为两种类型:文内指代和文间指代。

文内指代是指代消解发生在同一句子或同一段落内,通常可以通过一些语法规则或语境线索来确定指代对象。

共指消解在NLP中的作用与实践经验分享

共指消解在NLP中的作用与实践经验分享自然语言处理(Natural Language Processing,简称NLP)是人工智能领域的一个重要分支,研究如何使计算机能够理解和处理人类语言。

在NLP中,共指消解是一项核心任务,它解决了指代问题,即在一段文本中,当出现代词、名词短语等指代词时,如何确定其所指的具体对象。

共指消解的正确处理对于机器理解文本的准确性至关重要。

本文将探讨共指消解在NLP中的作用,并分享一些实践经验。

共指消解在自然语言处理中扮演着重要的角色。

在现实世界的文本中,经常会出现指代词,如“它”、“他”、“她”等,这些指代词需要通过共指消解来找到其所指的具体对象。

例如,在一篇新闻报道中,可能会出现这样的句子:“小明说他要去上学。

”这里的“他”指的是谁?是指小明自己还是其他人?通过共指消解,我们可以确定“他”指的是小明自己。

共指消解在机器翻译、问答系统、信息抽取等领域都有广泛的应用。

在机器翻译中,正确处理共指消解可以提高翻译的准确性。

在问答系统中,当用户提问时,系统需要理解问题中的指代词,以便给出正确的回答。

在信息抽取中,共指消解可以帮助识别出文本中的实体,并将其与相关信息进行关联。

在实践中,共指消解是一个具有挑战性的任务。

首先,共指消解需要考虑上下文的语义和语法信息。

例如,在句子“小明说他要去上学。

”中,我们需要通过上下文判断“他”指的是小明自己,而不是其他人。

其次,共指消解需要处理不同类型的指代词,如代词、名词短语等。

不同类型的指代词可能有不同的消解方式。

此外,共指消解还需要解决指代歧义的问题。

在一段文本中,可能存在多个候选对象与指代词匹配,需要通过上下文的语义信息进行消解。

为了解决这些挑战,研究者提出了各种共指消解算法。

其中,基于规则的方法使用预定义的规则来处理共指消解,但规则的覆盖范围有限,无法处理复杂的语义关系。

基于机器学习的方法使用训练数据来学习共指消解模型,可以捕捉更丰富的语义信息,但需要大量标注数据和计算资源。

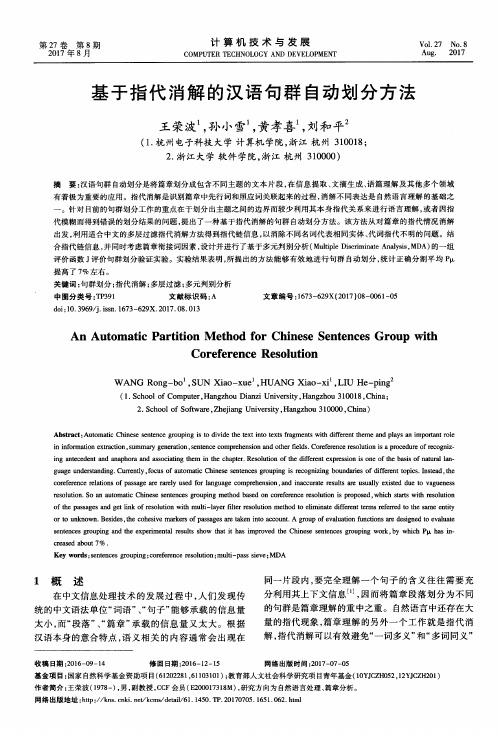

基于指代消解的汉语句群自动划分方法

2 . S c h o o l o f S o f t wa r e , Z h e j i a n g Un i v e r s i t y , H a n g z h o u 3 1 0 0 0 0, C in h a )

Ab s t r a c t: Au t o ma i t c Ch i n e s e s e n t e n c e g r o u p i n g i s t o d i v i d e t h e t e x t i n t o t e x t s f r a g me n t s wi h t d i fe r e n t he t me a n d p l a y s a n i mp o r t nt a r o l e i n i n f o r ma t i o n e x t r a c io t n, s u mm a r y g e n e r a t i o n, s e n t e n c e c omp r e h e n s i o n a n d o he t r ie f l d s . Co r e f e r e n c e r e s o l u i t o n i s a p r o c e d u r e o f ec r o g n i z — i n g nt a e c e d e n t nd a na a p h o r a nd a a s s o c i a i t n g he t m i n he t c h a p t e r . Re s o l u t i o n o f he t d i f f e r e n t e x p es r s i o n i s o n e o f he t b a s i s o f n a t u r a l l a n — g u a g e u n d e r s t a n d i n g . Cu r r e n t l y, f o c u s o f a u t oma i t c Ch i n e s e s e n t e n c e s g r ou p i n g i s ec r o g n i z i n g b o u n d a r i e s o f d i fe en r t t o p i c s . I ns t e a d, he t

基于决策树的中文指代消解

基于决策树的中文指代消解作者:韦丽红来源:《软件导刊》2014年第03期摘要:指代消解是自动文摘的重要技术,中文指代消解的重要手段是名词短语特征向量的确定和选取。

将名词向量构建成决策树,训练得到中文指代消解测试结果。

关键词:指代消解;名词短语;决策树中图分类号:TP301文献标识码:A 文章编号:1672-7800(2014)003-0031-021 中文指代消解采用的特征指代消解技术对于自然语言处理中的自动文摘、信息抽取等都具有非常重要的意义。

解决指代消解的关键技术是词性标注、命名实体识别、名词短语识别等相关技术。

中文指代消解采用的特征,相关研究中主要有:李国臣、罗云飞利用决策树方法[1]提出将距离属性和反映指代相似性的频次属性相结合的优先选择策略,主要通过明显的性别特征词来识别;北京大学的王厚峰[2]提出的采用特征中可以借鉴的有:性别、单复数;哈尔滨工业大学的郎君、刘挺和秦兵[3]提出了16个特征来构建特征向量,尽管提出16个特征,但在构建决策树时,只采用了其中的6个特征,所以不是特征选择的越多,就表示指代消解的结果越理想。

根据语言学经验选定适合决策树方法的特征属性,才能够保证识别的正确率。

2 名词短语特征向量通过参考前述国内外文献中选用的特征向量,以及对中文语法和句法的分析,我们选定6个特征来构建特征向量。

2.1 专有名词属性每个名词短语本身的属性。

先行词一般是名词短语,人名(Human Name)、地名(Place Name)、机构名(Organization Name)、时间(Time)、代词(Pronoun Name)和一般名词(General),分别用符号H、P、O、T、D和G 表示。

不同类型的先行词对应的照应语类型不同。

分组例句:{代表/v(n-Vg)}Q宁夏/ns }P{530万/m}Q {各族/r}D{ 人民/n }Q{ 深情厚意/i 的/u(d-Ng-u) 5万/m 公斤/q 优质/b}Q{ 大米/n}G{ 在/p(d-p-v)}Q{ 银川/ns}P{火车站/n }G{装运/v 上/v(f-Ng-v) }Q{ 车/n(n-q-v) }G ,{/w 紧急/ad 运往/v }Q{灾区/n}g 。

语料对中文名词短语指代消解影响研究

语 料 对 中 文 名 词 短 语 指 代 消 解 影 响 研 究

高俊伟 , 孔 芳, 朱巧 明 , 李 培 峰

( 苏 州 大 学 计 算 机 科 学 与 技 术 学 院 ,江 苏 省 计 算 机 信 息 处 理 技 术 重 点 实 验 室 , 江苏 苏州 2 1 5 0 O 6 ) 摘 要 : 指 代 是 自然语 言 中一 种 常 见 的语 言 现 象 , 对 简化 语 言 , 减 少 冗余 有 很 大的 作 用 。指 代 消解 是 用计 算机 找 出 这 些指 代 现 象的 一 个 过 程 。近 几 年 英 文 指 代 消解 研 究取 得 了很 大 的 成 就 , 然而, 中 文指 代 消解 研 究 目前 还 较 少 , 一

基 础 上从 语 料 库 的 数 量 和 质 量 两个 方 面 来探 讨语 料 对 中文 名 词 短 语 指 代 消解 的影 响 。 关 键 词 :指代 消 解 ; 名词短语 ; 无监督 ; 聚 类; 语 料 中图分类号 : TP 3 9 1 文献标识码 : A

Re s e a r c h o n t h e Co r pu s Ef f e c t t o t h e Ch i n e s e No u n Ph r a s e An a p ho r a Re s o l u t i o n

Ke y La b o f C o mp u t e r I n f o r ma t i o n P r o c e s s i n g Te c h n o l o g y o f J i a n g s u P r o v i n c e ,S u z h o u,J i a n g s u 2 1 5 0 0 6 , Ch i n a )

第 2 7卷 第 3 期 2 0 1 3年 5 月

基于深度学习的维吾尔语名词短语指代消解

第43卷第11期自动化学报Vol.43,No.11 2017年11月ACTA AUTOMATICA SINICA November,2017基于深度学习的维吾尔语名词短语指代消解李敏1禹龙2田生伟1吐尔根·依布拉音3赵建国4摘要针对维吾尔语名词短语指代现象,提出了一种利用栈式自编码深度学习算法进行基于语义特征的指代消解方法.通过对维吾尔语名词短语指称性的研究,提取出利于消解任务的13项特征.为提高特征对文本语义的表达,在特征集中引入富含词汇语义及上下文位置关系的Word embedding.利用深度学习机制无监督的提取隐含的深层语义特征,训练Softmax分类器进而完成指代消解任务.该方法在维吾尔语指代消解任务中的准确率为74.5%,召回率为70.6%,F值为72.4%.实验结果证明,深度学习模型较浅层的支持向量机更合适于本文的指代消解任务,对Word embedding特征项的引入,有效地提高了指代消解模型的性能.关键词深度学习,栈式自编码神经网络,指代消解,Word embedding,维吾尔语引用格式李敏,禹龙,田生伟,吐尔根·依布拉音,赵建国.基于深度学习的维吾尔语名词短语指代消解.自动化学报,2017, 43(11):1984−1992DOI10.16383/j.aas.2017.c160330Coreference Resolution of Uyghur Noun Phrases Based on Deep Learning LI Min1YU Long2TIAN Sheng-Wei1TurgLm IBRAHIM3ZHAO Jian-Guo4Abstract Aimed at the reference phenomena of Uyghur noun phrases,a method using stacked autoencoder model to achieve coreference resolution based on semantic characteristics is presented.Through the study of noun phrases referentiality,we pick up beneficial13features for coreference resolution tasks.In order to improve the expression of features for semantic text,Word embedding is added into feature sets,which makes feature sets contain lexical semantic information and context positional relationship.A deep learning algorithm is proposed for unsupervised detection of implicit semantic information,and also introduced is a softmax classifier to decide whether the two markables actually corefer.Experiments show that precision rate,recall rate and F value of coreference resolution reach74.5%,70.6%and 72.4%,respectively,which demonstrates that the proposed method on coreference resolution of Uyghur noun phrase and introduction of Word embedding to feature sets are able to improve the performance of coreference resolution system. Key words Deep learning,stacked autoencoder,coreference resolution,word embedding,UyghurCitation Li Min,Yu Long,Tian Sheng-Wei,TurgLm IBRAHIM,Zhao Jian-Guo.Coreference resolution of Uyghur noun phrases based on deep learning.Acta Automatica Sinica,2017,43(11):1984−1992指代(Anaphora)是自然语言的普遍现象,也是语篇内句与句之间衔接(Cohesion)的重要手段之一,对指代成分准确无歧义的消解有助于机器分析和语篇理解[1].随着篇章处理相关应用的日益发展,指代消解在自动文摘、信息抽取、机器翻译等自然收稿日期2016-04-12录用日期2016-08-02Manuscript received April12,2016;accepted August2,2016国家自然科学基金(61563051,61262064,61662074,61331011),自治区科技人才培养项目(QN2016YX0051)资助Supported by National Natural Science Foundation of China(61563051,61262064,61662074,61331011)and Re-gional Scientific and Technological Personnel Training Project (QN2016YX0051)本文责任编委张民Recommended by Associate Editor ZHANG Min1.新疆大学软件学院乌鲁木齐8300082.新疆大学网络中心乌鲁木齐8300463.新疆大学信息科学与工程学院乌鲁木齐8300464.新疆大学人文学院乌鲁木齐8300461.School of Software,Xinjiang University,Urumqi8300082. Network Center,Xinjiang University,Urumqi8300463.Col-lege of Information Science and Technology,Xinjiang University, Urumqi8300464.College of Humanities,Xinjiang University, Urumqi830046语言处理领域有着广泛的运用.基于机器学习的方法在指代消解任务中得到广泛的应用.Soon等[2]提出一种基于机器学习的指代消解方法,利用决策树算法消解非限制领域名词短语,首次给出了完整的实现步骤.Bergsma等[3]利用支持向量机(Support vector machine,SVM)结合统计信息进行指代消解,提出一种基于语法路径的代词消解方法.Ng[4]通过对不同语义类之间指代关系的研究,提出一种自动推导语义类扩充特征的方法,提升了指代消解的性能.Bengtson等[5]将指代消解视为图式问题,根据最佳链路决策算法生成指代图,利用机器学习技术研究不同类型特征对指代消解任务的贡献,强调距离特征和同位结构特征在消解任务中的重要作用.与国际上指代消解的研究相比,国内的指代消解研究起步较晚,周俊生等[6]利用了一种无监督的聚类算法来实现名词短语的指代消解,采用带权图对指代消解问题进行建模,引入有效模块函数实现11期李敏等:基于深度学习的维吾尔语名词短语指代消解1985指代等价类的自动划分.王海东等[7]探索了语义角色对指代消解性能的影响,其研究表明,语义角色信息的引入能够显著提高指代消解的性能.孔芳等[8]提出了一种基于卷积树核函数的中英文代词消解方法,利用卷积树核函数,探索语义信息对代词消解性能的作用.奚雪峰等[9]提出采用深度学习的深层机器学习代替传统浅层机器学习,通过构建多隐层机器学习模型,自动挖掘深层语义信息并探索面向指代消解的语义特征泛化表示.实验结果表明,多层的学习结构有效地提高了模型的性能,特征抽象层的引入,进一步促进模型对深层语义信息的学习.随着指代消解研究的不断深入,如何有效地获取语义信息在指代消解中起至关重要的作用.基于神经网络的Word embedding方法在词语语义表示方面表现出很好的性能,受到广泛的关注[10−11].本文提出利用Word embedding之间的位置关系表示语义层面上的联系,作为文本的高层抽象特征,通过深度学习模型多映射单元提取主要的结构信息,发现变量之间的真正关系形式,进而完成指代消解任务.目前,许多学者从不同的角度探讨了各种语言的指代现象,但对于像维吾尔语这样的小语种研究还不够深入.因此本文针对维吾尔语的名词短语指代现象进行研究,主要研究代词和名词/名词短语、名词和名词/名词短语、名词短语和名词短语间的指代问题.1相关研究深度学习是机器学习研究中的一个新的领域,最早于2006年Hinton等提出,Hinton指出,深层神经网络(Deep neural network,DNN)具有更好的特征学习能力,无监督式逐层预训练其抽象后的数学特征对原始数据有更本质的刻画.随着深度学习方法在图像和语音领域的应用,越来越多的深度学习方法被用于自然语言处理.Glorot等[12]利用深度自编码算法完成文本分类任务,通过添加纠正激活函数,有效地提高了分类效果.Glorot等[13]在文献[12]的基础上,提取出评论的高层抽象特征,解决了跨领域文本分类的问题.Lu等[14]将深度自编码算法运用到机器翻译任务中,为基于词汇翻译模型提取到了有效地特征集,并在中英文翻译过程中取得了很好的效果.由此可见,深度自编码算法具有很强的无监督学习特征的能力,能较好地提取文本中隐含特征.本文利用深度栈式自编码算法无监督学习文本特征,通过构建多隐层机器学习模型,逐层变换特征,将样本在原空间的特征表示变换到一个新特征空间,获取数据的分布式特征表示,并自动挖掘深层语义,从而使分类更加容易.2预备知识为了便于读者理解本文对维吾尔语名词短语指代消解分析研究的方法,先明确以下定义:定义1.指代消解:指自然语篇中的一个语言单位(通常是词或者短语)确定其指向之前出现的语言的单位的过程[15].用于指向的语言单位,称为照应语(Anaphora),被指向的语言单位称为先行语(Antecedent).本文采用消息理解会议(Message understand-ing conference,MUC)对指代的定义,认为指代关系不仅在于代词和名词/名词短语间,还存在于名词或者名词短语间,例如(维吾尔语的书写规范是从右向左):(流行音乐小皇后蕾哈娜,最近在阿联酋首都阿布扎比举办演唱会过程中去了当地的谢赫扎伊德清真寺游览,她大肆拍照,遭到了工作人员的轰赶)例①摘自实验语料,反映了多种指代关系,包括名词和代词的指代关系:“(蕾哈娜)”和“(她)”;名词短语和代词的指代关系“(流行乐界小皇后)”和“(她)”;名词短语和名词的指代关系:“(当地)”和“(阿布扎比)”;名词短语间:“(阿联酋首都阿布扎比)”和“(当地)”;只有准确地找到这些指代关系所指的实体,才能准确地完成指代消解任务,从而提高系统的性能.定义2.指称:语篇中指代成分(照应语)与所指对象(先行语)之间的相互解释关系.它旨在帮助说话者向听者指出正在被谈论的对象[16].指称性取决于说话者特定使用一个表达式的意图,是一种潜在的语义特征.在维吾尔语语篇中,并不是所有的名词短语都具有指称功能[16],因此辨别名词短语的指称性是指代消解研究中的一个重要任务.经过深入分析和研究,结合维吾尔语具体的语言特点,在参考相关文献后,实验组维吾尔语语言学专家总结出维吾尔语中具有指称性的名词短语:1986自动化学报43卷1)专有名词表示某一特有事物名称的词.在维吾尔语语篇中,表示人、地点和机构的专有名词都有一个特有的指称对象,例如:(新疆维吾尔自治区成立于1955年,它的矿产资源丰富)2)带领属性人称词尾的名词短语领属性人称词尾表示一种归属关系,一般附加在名词之后,用来明确某一实体的归属性问题.例如:(我的哥哥擅长书法和绘画,他画过一幅嘲讽迷信活动的漫画)在例③中(我的哥哥)带有领属性人称词尾,与下文(他)具有指称关系.3)被指示词修饰的名词短语指示词用来指示或区别事物,被指示词修饰的名词短语通常作为先行语的解释扩充,目的是为了帮助读者或者受话人更好地理解所传达的信息.例如:(今年我们没有夺得粮食丰收,这个问题我刚才和苏莱曼会计等人已经聊过了)在例④中(这个问题)指代(今年我们没有夺得粮食丰收).指示代词(这个)修饰名词(问题),做照应语.4)被形容词或形容词化的成分修饰的名词短语形容词或形容词化的成分充当限定词对名词短语做了限定,具有确定性,一般可作为先行语或者照应语.例如:(个头矮小、身体壮实的伊米尔进来了,他开始高声说话)5)带宾格标志的名词短语带宾格的名词短语通常所表达的事物已经被确定或者已被确定将要出现.例如:(我找到了一本书,它在家里)在例⑥中,(书)带宾格后缀“”,与下文中“(它)”具有指代关系.3基于栈式自编码的指代消解模型针对维吾尔语名词短语指代消解问题本文参考Soon 等[2]提出的指代消解基本框架.首先,确定先行语和照应语对应的候选项,构建名词短语特征向量;接着生成训练实例、训练分类器;最后,识别测试文档,构建指代链,完成消解任务.本文采用文献[9]一致的方式进行实例的初步生成,引入Word embedding 作为特征项,利用栈式自编码非线性逐层贪心算法无监督地学习深层语义特征,用学习到的特征训练Softmax 分类器,进而实现名词短语的指代消解.整个消解过程如图1所示.3.1特征提取提取的特征是否有效对本文提出的栈式自编码指代消解模型有直接的影响,使用准确的特征对文本进行描述,实验效果会相应提高.结合实验组维吾尔语语言学专家总结的具有指称性的名词短语,选取以下特征进行指代消解:1)AnProperNoun:若照应语是专有名词,该特征值为1;否则,为0;本文对维吾尔语专有名词限定为人名、地名、机构名.2)CaProperNoun:若先行语是专有名词,该特征值为1;否则,为0;3)AnDefiniteNP:若照应语是被形容词或形容词化成分修饰的名词短语,该特征值为1;否则,为0.在语料标注过程中,这类名词短语的词性标注为AdjNP,特征提取时判断,若词性为AdjNP,该特征值为1;否则,为0.4)CaDefiniteNP:若先行语是被形容词或形容词化成分修饰的名词短语,该特征值为1;否则,为0.11期李敏等:基于深度学习的维吾尔语名词短语指代消解1987图1维吾尔语名词短语指代消解框架Fig.1The coreference resolution of Uyghur noun phrases framework5)AnDemonstrativeNP:若照应语被指示词修饰的名词短语,则该特征值为1;否则,为0.实验组维吾尔语语言学专家制定了一个指示词库,提取特征时扫描词库,当名词短语包含指示词时,该特征值为1;否则,为0.指示词库如表1所示(此处仅列举出部分指代词).表1指示词库Table1The demonstrative thesaurus 指人指物指性质指数量指地点/这个/这样/这么/这儿/这个/这样/这么/这儿/那个/那样/那么/那儿/那个/那样/那么/那儿············6)CaDemonstrativeNP:若先行语被指示词修饰的名词短语,则该特征值为1;否则,为0.7)AnPossessionNP:若照应语是带领属性人称词尾的名词短语,该特征值为1;否则,为0;维吾尔语中属格有两种形式:加后缀“”和附加人称词尾.语料标注过程中对名词的格范畴进行了标注,特征提取是判断,若格范畴为领属性人称词尾,该特征值为1;否则,为0.8)CaPossessionNP:若先行语是带领属性人称词尾的名词短语,该特征值为1;否则,为0.9)AnObjectiveNP:若照应语是带宾格标志的名词短语,该特征值为1;否则,为0;带宾格标志的名词短语,通常在名词短语后附加“”后缀,判断名词短语是否包含后缀成分,包含该特征值为1;否则,为0.10)CaObjectiveNP:若先行语是带宾格标志的名词短语,该特征值为1;否则,为0.11)PropertyFit:若照应语和先行语满足词性一致,该特征值为1;否则,为0.12)SinglePluralFit:若照应语和先行语满足单复数一致,该特征值为1;否则,为0.13)FullMatch:若照应语和先行语去掉“(这)”“(那)”等修饰性的词后满足全匹配,该特征值为1;否则,为0.3.2Word Embedding不同于传统的词袋模型,基于神经网络训练的Word embedding包含丰富的上下文信息,可以很好地表现目标词在当前文本中的语义规则,同时也避免了维数灾难[17].本文使用Mikolov等[10]提出的Word2vec工具进行Word embedding的训练,选择Skip-gram+HS模型作为训练框架,通过计算词之间的余弦相似度表示文本语义上的相关程度.为了更准确地获取每个词在低维空间中语义的分布情况,本文在原有实验语料的基础上进行了扩充.选取天山网、人民网等维吾尔语版网页作为语料来源,利用网络爬虫下载网页,进行去重、去噪处理之后获取约7000篇不限题材且未标注任何内容的生语料.同语料训练的词向量每一维表达的隐含语义相似[17],本文在词向量的基础上,通过将短语中的词语向量融合,构建实验需要的包含隐含语义信息的短语向量Phrase embedding.如例⑤中(个头矮小、身体壮实的伊米尔)的句向量表示:C(S)=(C() +C()+C()+C()+ C())/5.3.3训练样例和测试样例的生成3.3.1构建训练实例本文首先对实验语料中的维吾尔语名词短语(这里的名词短语包括代词、单个名词、名词短语)1988自动化学报43卷进行提取,并按一定的规则两两组队,通过名词短语与标注语料中指代链的对应关系,判断组队的名词短语是否具有指代.若两个名词短语之间存在指代关系,即为正例;不存在则为负例.具体的算法步骤如下:步骤1.提取语料中的名词短语,存入集合{NounP hraseSet},提出语料中指代链信息,存入集合{ChainNum,ChainContent}.步骤2.对于每一个名词短语判断其是否满足NP i≥2∈{ChainContent},若满足继续步骤3,不满足存入集合{NagativeSet},i++.步骤 3.NP i(i≥2)从后向前依次与NP i−1至NP0间的每个名词短语组队,组队结果存入集合{W ordsGroup},其中NP i−k NP i∈{W ordsGroup}步骤4.判断NP i−k NP i单复数是否冲突,不冲突继续步骤5,冲突则删除NP i−k NP i,k++,更新{W ordsGroup}.步骤 5.判断NP i与NP i−k是否满足NP i−k∈{ChainContent}且NP i−k.ChainNum =NP i.ChainNum.满足继续步骤6,不满足k++.步骤6.将NP i与NP i−k组成的词语对构成正例,存入集合{+instance}.将NP i与NP j (i>j>i−k)且NP j∈{NagativeSet}组成的词语队构成负例,存入集合{−instance},k++.步骤7.重复步骤4∼步骤6,当k=i时, i++,执行步骤2.当i>NounP hraseSet.length 时停止.3.3.2构建测试实例测试实例的构建过程与训练实例过程类似,由于指代链信息未知,因此对提取出的每个名词短语都作为照应语依次向前组队,判断组队中的名词短语单复数是否冲突,将不冲突的组队供给训练时生成的分类器模型进行分类.若分类器根据生成的分类模型判断该实例为正列,则认为这两个名词短语之间具有指代关系,组队过程结束.否则,继续向前与前一个名词短语组队,直到整篇文档的第一个名词短语为止.构建训练和测试实例后,根据第3.1节和第3.2节给出的文本特征向量和Phrase embedding依次获得每一实例对应的特征向量取值,生成训练样例和测试样例.以例句⑦为例:(因为吾斯英是当代的大学者之一,所以布葛热汗尊敬他)提取出的名词短语包括:(吾斯英),(当代大学者之一),(当代大学者),(大学者),(布葛热汗), (他),后一项名词短语与前一项名词短语依次组队,删除单复数冲突的名词短语组队.通过对比集合{ChainNum,ChainContent},(吾斯英)和(他)在指代链中,且在同一条指代链,经过处理后形成维吾尔语名词短语指代消解的训练和测试样例如表2所示.3.4栈式自编码栈式自编码(Stack autoencoder,SAE)是深度学习领域中一种重要的无监督学习结构,它由多个自编码器堆栈组成,结构如图2所示,前一层自编码器的输出作为后一层自编码器的输入,通过逐层贪婪训练方法得到最优模型.自编码器对数据的处理主要分为两个阶段:编码和解码.在编码阶段,栈式自编码接受训练数据x∈[0,1]N,首先对其进行线性变化,在激活函数作用下得到一个编码结果y(y∈[0,1]M),计算如式(1)所示.将编码结果y在解码器的作用下,得到重构训练数据ˆx∈[0,1]N,计算如式(2)所示.表2维吾尔语名词短语指代消解训练和测试样例Table2Training or testing sample format for Uyghur noun phrases先行语照应语样例值(13个特征值+50维先行语、照应语Word embedding)是否指代0,1,0,0,0,0,0,0,0,0,1,1,00.133,−0.053,0.114,···,−0.1080.177,−0.008,0.127,···,−0.055是0,0,0,1,0,0,0,0,0,0,1,1,00.076,0.099,0.019,···,−0.0690.177,−0.008,0.127,···,−0.055否0,1,0,0,0,0,0,0,0,0,1,1,00.060,−0.135,0.277,···,−0.0420.177,−0.008,0.127,···,−0.055否11期李敏等:基于深度学习的维吾尔语名词短语指代消解1989y =f θ(x )=sigmoid (W x +b )(1)ˆx =g θ (y )=sigmoid (W T y +b)(2)其中,θ和θ是编码解码过程中的参数,W ∈R M ×N 代表权重矩阵,b 和b∈R M 代表隐层的偏置向量,sigmoid(·)=(1/1+exp(−z )),函数值域为[0,1].自编码器的学习过程是无监督的,其目的是最小化x 和ˆx 的差距,降低重构损失,本文使用的损失函数为Kullback-Liebler 散度[13],计算公式如式(3)、式(4).argmin J (x,ˆx )=argmin J (x,g θ (f θ(x )))(3)J (x,ˆx )=KL (x ||ˆx )(4)栈式自编码采用经典的随机梯度下降算法进行训练,在每次迭代的过程中更新网络参数θ,利用更新得到的最优化参数,对训练数据进行无监督的学习,计算公式如式(5)所示.a l +1i=sigm (z l +1i )=sigm (s lj =1W (l )ij x j +b i l )(5)式(5)中,s l 是第l 层的神经元总数.a l i 表示神经网络的第l 层中第i 个神经元的激活值,即特征值.令h =a i ,h 为栈式自编码无监督学习算法提取出的一组维吾尔语名词短语对特征,对于训练数据中n 组名词短语对构成的特征集合Feature 可表示为Feature =h 1,h 2,···,h n .图2栈式自编码网络结构图Fig.2Structure of SAE3.5Softmax 回归Softmax 回归模型是Logistic 回归模型在多分类问题上的推广,本文利用Softmax 解决维吾尔语名词短语指代消解的分类问题.其基本思想是通过计算给定样本属于某一类别的概率,确定样本的所属类别.假设{(x 1,y 1),···,(x n ,y n )}为给定样本,且x i ∈F eature 其中Feature 为第3.4节中栈式自编码器提取的特征集合,y i ∈{1,2}为x i 对应的标签,则估计样本x i 在softmax 函数中所对应的类别标签概率p 为h θ(x i )=p ((y i )=1|x i;θ)p ((y i )=2|x i ;θ)=1eθT 1x +eθT 2x (i )eθT1x e θT2x(6)其中,θ是h θ(x i )的参数,1/(e θT1x +e θT2x (i ))是对概率分布进行归一化,使得所有概率和为1.4实验与分析4.1语料准备目前比较知名的指代消解标注语料有MUC (仅有English 语料)和ACE (有Ara-bic 、English 、Chinese 三种语料),而关于维吾尔语指代消解评测语料还未见报道.因此,本文针对维吾尔语指代消解任务对语料进行了筛选和标注.叙述文是话语分析中典型的语料,本文选取天山网、人民网、论坛和博客等维吾尔语版网页作为语料来源,筛选出以记人和叙事为题材且至少包含两条指代链信息的叙述文作为实验语料.在实验组维吾尔语专家的指导下对语料进行标注,所标注的内容包括指代链信息、名词短语、名词的类别、名词的数范畴、名词的格范畴.对标注后的语料选用XML 文件进行存储.本次实验采用200篇标注完成的语料其中包括489条指代链信息,7924个名词短语.经过第3.3节生成训练和测试数据,其中具有指代关系的名词短语对有7721组,不具有指代关系的名词短语对有20432组.4.2实验结果与分析为了便于比较,本文采用MUC 评测对指代消解结果进行技术评估.采用准确率P (Precision)、召回率R (Recall)和F 值三个重要指标衡量消解结果.其中,准确率指正确消解的对象占实际消解的对象的百分比.召回率是指正确消解的对象占消解系统应消解对象的百分比.F 值是正确率、召回率的综合评价指标,即:F =R ×P ×2/(R +P ).本文所有实验都采用5折交叉验证,为保证结果的稳定性,取平均值作为最终结果.通过反复试验尝试了网络模型不同的参数,本实验数据量下的最优参数如下表3所示.(ρ:稀疏性参数,β:稀疏惩罚因子权重,λ:权重衰减参数,maxIter :迭代次数)表3SAE 模型最优参数Table 3Optimal parameters of SAE参数ρβλmaxIter 值0.133E −38001990自动化学报43卷4.2.1基于SAE模型的有效性验证在不引入Word embedding的前提下,使用第3.1节提取的特征向量作为输入,利用SAE i(i表示SAE包含的自编码器层数)和SVM模型进行指代消解实验.SVM是处理非线性数据较好的浅层机器学习模型,与SAE模型有较好的对比性,通过实验验证,利用多项式核函数的SVM模型性能优于线性核函数和RBF核函数.因此本文选用性能最优的SVM模型进行对比实验.结果如表4所示.从表4可以看出:SAE1与SVM相比召回率高了3.2%,但准确率和F系数都低于SVM;增加2层自编码器之后的三个指标已经超过SVM;增加3层自编码器时,F系数较SVM有了一定的增长;当增加4层自编码器时,正确率较SVM提高了1.9%,召回率提高了1.6%,F系数提高了1.8%,实验结果证明了针对维吾尔语名词短语指代消解任务,基于SAE的模型其效果要优于基于SVM的模型.从表4中还可以看出,随着自编码器层数的增多,实验结果的准确率均有所提高,这是因为深度学习通过多层映射单元提取出主要的结构信息,其计算能力优于单层结构.表4基于SAE模型的有效性验证Table4The validation of SAE effectiveness模型P(%)R(%)F(%)SAE161.77573.31967.054SAE266.06471.25668.562SAE366.13471.99568.940SAE468.69571.74370.186SVM66.72770.11568.3794.2.2特征选取对模型性能的影响在指代消解过程中,特征的选择对模型的性能影响较大,为了探讨单个特征对指代消解的贡献度,本文基于第4.2.1节中实验效果最佳的SAE4对各个特征所起的作用分别进行了详细实验,采用的特征集逐步在上一级特征集扩展,即下级采用的特征集包含上级所有特征集,实验结果如表5所示.从表5中可以看出,随着特征集的不断扩展,指代消解识别结果的各项指标均有所提高.当照应语判定为专有名词时指代消解的准确率为46.079%,但召回率较低,这是因为特征集很少的情况下自编码算法无法学习到充分语义特征.当加入带领属性名词短语的特征时,F系数较前一项有了一定的提升,这是因为本文选取的语料以记人或叙事为题材,这类文章多出现(我的朋友)(他的爸爸)等带领属性人称词尾的名词短语.随着特征集的不断加入,当特征集包含了本文提取的13个特征项时正确率达到68.695%,召回率达到71.743%,F系数达到了70.186%最高值.实验证明本文提取的特征集合是有效的.表5特征集对结果的影响Table5The influence of introducing features sets特征项P(%)R(%)F(%) AnProperNoun46.0790.856 1.681CaProperNoun66.1590.713 1.411AnDefiniteNP75.897 1.102 2.172CaDefiniteNP59.932 4.5798.508 AnDemonstrativeNP65.4328.40914.903 CaDemonstrativeNP57.0929.11215.716AnPossessionNP60.41126.91237.222CaPossessionNP44.43938.40341.201AnPossessionNP48.23151.08249.616CaPossessionNP45.83170.33455.498PropertyFit64.47051.10857.017SinglePluralFit58.63180.20567.742 FullMatch68.69571.74370.1864.2.3Word Embedding对实验的影响Word embedding富含词汇语义及上下文位置关系,为探讨Word embedding对模型的分层结构学习性能的影响,实验选用10维的Word embed-ding加入特征集,依次训练SAE1,SAE2,SAE3, SAE4模型,实验结果如表6所示,SAE i+WE表示,在原有特征集中加入Word embedding,训练SAE i模型.表6Word embedding的引入对实验的影响Table6The influence of introducing word embedding模型P(%)R(%)F(%)SAE160.91574.56967.054 SAE1+WE64.38270.10367.121 SAE266.06471.25668.562 SAE2+WE66.57171.41968.910 SAE366.13471.99568.940 SAE3+WE68.21572.37570.233 SAE468.69571.74370.186 SAE4+WE72.35269.74371.024从表6中可以看出,引入Word embedding作为特征项对包含不同层自编码器的SAE模型都是。