广义递推最小二乘辨识

各类最小二乘算法

β N −1 H* = N 0

β N −2

β 2( N −1) WN = 0

β 2( N −2)

0 ⋱ 1

三、递推算法 ∵

k θ(k ) = ∑ β i =1

∧

2(k −i) h (i )h T (i )

2随着采样次数的增多数据量不断增加ls估计有可能出现所谓的数据饱和现象导致递推算法不能接近参数真二关于数据饱和现象的分析所谓数据饱和现象就是随着时间的推移采集到的数据越来越多新数据所提供的信息被淹没在老数据的海洋之中

Ⅴ 各种最小二乘类参数辨识算法 §1 概 述

最小二乘类参数辨识算法(一次完成算法、递推算法) 最小二乘类参数辨识算法 (一次完成算法 、 递推算法 ) 是一种 最基本和常用的参数估计方法。但研究和应用表明, 最基本和常用的参数估计方法。 但研究和应用表明, 这一算 法仍存在明显的不足。 法仍存在明显的不足。 一、LS 算法的主要不足之处 1、当模型噪声为有色噪声时,LS 估计不再是无偏估计、一致 、当模型噪声为有色噪声时, 估计不再是无偏估计、 估计。 估计。 2、随着采样次数的增多,数据量不断增加,LS估计有可能出 、随着采样次数的增多,数据量不断增加, 估计有可能出 现所谓的“数据饱和”现象, 现所谓的“数据饱和”现象,导致递推算法不能接近参数真 值。

于是有: 于是有:

α P ( k ) P − 1 ( k − 1) = I − P ( k ) h ( k ) h T ( k )

则:

ˆ θ ( k ) = P ( k ) H * T Z * = P ( k ) α H * −1T Z * −1 + h ( k ) z ( k ) k k k k

现代控制理论_第14章_最小二乘法辨识

y n 2 ai y n 2 i bi u n 2 i n 2

i 1 i 0

n

y n N ai y n N i bi u n N i n N

即

y k ai y k i bi u k i v k ai v k i

i 1 i 0 i 1

n

n

n

(14-3)

假设v k k 1,2,, n 是均值为零的独立分布的平稳随机序列,且与 序列u k k 1,2,, n 相互独立。设

ˆ 表示 y 的最优估值,则有 设ˆ 表示 的最优估值, y

ˆ ˆ y

(14-12)

式中

ˆ n 1 y a ˆ ˆ y n 2 ˆ ˆ y , b ˆ ˆ y n N

T 的展开式如下所示:

y n 1 y n y n y n 1 y 1 y 2 T u n 1 u n 2 u n 1 u n u 2 u 1 y n N 1 n 1 y n N 2 n 2 yN u n N u n N 1 n N uN

1

因为ˆ 有解与 T 正定等价,所以可以保证 T 正定来确定对输 入 u k 序列的要求。由式(14-9)可知

Y U

(14-20)

则

YT U YT U Y T Y U T T T U Y U U U

基于广义最小二乘法的系统参数辨识与仿真

基于广义最小二乘法的系统参数辨识与仿真摘要:系统辨识是自动控制学科的一个重要分支,由于其特殊作用,已经广泛应用于各种领域,尤其是复杂系统或参数不容易确定的系统的建模。

过去,系统辨识主要用于线性系统的建模,经过多年的研究,已经形成成熟的理论。

但随着社会、科学的发展,非线性系统越来越受到人们的关注,其控制与模型之间的矛盾越来越明显,因而非线性系统的辨识问题也越来越受到重视,其便是理论不断发展和完善。

本文重点介绍了系统参数辨识中广义最小二乘法的基本原理,具体说明了基于广义最小二乘法参数辨识在Matlab中的实现方法,结合实例给出相应的仿真程序及结果分析。

关键词:系统辨识;参数辨识;广义最小二乘法;Matlab1.引言所谓辨识就是通过测取研究对象在人为输入作用下的输出响应,或正常运行时的输入输出数据记录,加以必要的数据处理和数学计算,估计出对象的数学模型。

这是因为对象的动态特性被认为必然表现在它的变化着的输入输出数据之中,辨识只不过是利用数学的方法从数据序列中提炼出对象的数学模型而已。

在系统辨识领域中,最小二乘法是最基本最常用的方法。

可用于动态、静态、线性、非线性系统。

这种方法只适用于噪声是不相关随机序列时才是无偏估计,但大多数情况下噪声却是相关随机序列。

所以本文讨论克服最小二乘法有偏估计的一种方法—广义最小二乘法。

2.系统辨识一般而言,建立系统的数学模型有两种方法:激励分析法和系统辨识法。

前者是按照系统所遵循的物化(或社会、经济等)规律分析推导出模型。

后者则是从实际系统运行和实验数据处理获得模型。

如图1所示,系统辨识就是从系统的输入输出数据测算系统数学模型的理论和方法。

更进一步的定义是L.A.Zadeh曾经与1962年给出的,即“系统辨识是在输入和输出的基础上,从系统的一类系统范围内,确立一个与所实验系统等价的系统。

”另外,系统辨识还应该具有3个基本要素,即模型类、数据和准则。

被辨识系统模型根据模型形式可分为参数模型和非参数模型两大类。

第四章-最小二乘参数辨识方法及原理

脉冲传递函数描述:

Y ( z ) b0 b1 z 1 bn z n B( z 1 ) G( z) = 1 n 1 U ( z ) 1 a1 z an z A( z )

2.随机模型

v(k )

u(k )

G (k )

x(k )

y(k )

观测值可表示为:

本章的学习目的

1、掌握最小二乘参数辨识方法的基本原理

2、掌握常用的最小二乘辨识方法 3、熟练应用最小二乘参数辨识方法进行模型参数辨识 4、能够编程实现最小二乘参数辨识

回

顾

辨识目的:根据过程所提供的测量信息,在某种准则意 义下,估计模型的未知参数。 Input

Process 目 的

Output

工程实践

88 1010

95.7 1032

表 1 热敏电阻的测量值

t (C ) R ()

20.5 765

26 790

32.7 826

40 850

51 873

61 910

73 942

80 980

88 1010

95.7 1032

R a bt

N N N N ˆ Ri 2 R a 702ti.762i ti ti i 1 i 1 a i 1 i 1 ˆ 2 N N ˆ N. t i2 t i b 3 4344 i 1 i 1 N N N N Ri t i Ri t i i 1 i 1 b i 1 ˆ R 943 .1682 N N 2 N ti ti i 1 i 1

上述N个方程可写成下列向量-矩阵形式

y (n) y (1) u (n 1) y (n 1) y (n 2) y (n 1) y (2) u ( n 2) y (n N ) y (n N 1) y ( N ) u (n N )

广义最小二乘法和递推最小二乘法

广义最小二乘法和递推最小二乘法

广义最小二乘法和递推最小二乘法是最小二乘法算法的改进版本。

最小二乘法

是一种常见的统计学技术,它有效地估计未知参数集,也可以用于回归分析。

本文旨在详细介绍广义最小二乘法和递推最小二乘法。

首先让我们了解最小二乘法。

最小二乘法(Least Squares)是一种最常用的

方法,其中未知参数的估计量是穷举法的最优估计,这是一种很有效的技术。

最小二乘法的求解过程中,以平方的残差来最小化两个估计量的差异,以求得最优参数。

然而,最小二乘法有时也会出现缺陷,其中一个原因是可能会把噪声干扰包含

在结果中,另一个原因是它依赖被观测值的方差,而方差受因素影响。

因此,有了广义最小二乘法。

广义最小二乘法是在最小二乘法的基础上改进的算法。

在广义最小二乘法中,

我们通过加入惩罚参数来最小化残差,以对噪声进行抑制。

惩罚参数的加入,使得预测变更的安全降低,同时噪声的影响也可以得以抑制。

因此,广义最小二乘法在回归分析中也有广泛的应用。

此外,基于最小二乘法的另一种增强方法是“递推最小二乘法”。

递推最小二

乘法是将最小二乘法算法进行改良,从而改善对噪声的抑制能力。

和广义最小二乘法一样,递推最小二乘法也需要惩罚参数的加入。

递推最小二乘法也通过持续更新未知参数,来达到最小化残差的目的,从而能有效地抑制噪声。

以上就是本文要陈述的关于广义最小二乘法和递推最小二乘法的改进方法以及

它们的比较。

从技术上讲,广义最小二乘法和递推最小二乘法都比最小二乘法更能抑制噪声和拟合回归曲线,因此,它们在回归分析中都有广泛的应用。

(完整word版)多种最小二乘算法分析+算法特点总结

第一部分:程序设计思路、辨识结果分析和算法特点总结 (3)一:RLS遗忘因子法 (3)RLS遗忘因子法仿真思路和辨识结果 (3)遗忘因子法的特点: (4)二:RFF遗忘因子递推算法 (4)仿真思路和辨识结果 (4)遗忘因子递推算法的特点: (6)三:RFM限定记忆法 (6)仿真思路和辨识结果 (6)RFM限定记忆法的特点: (7)四:RCLS偏差补偿最小二乘法 (7)仿真思路和辨识结果 (7)RCLS偏差补偿最小二乘递推算法的特点: (9)五:增广最小二乘法 (9)仿真思路和辨识结果 (9)RELS增广最小二乘递推算法的特点: (11)六:RGLS广义最小二乘法 (11)仿真思路和辨识结果 (11)RGLS广义最小二乘法的特点: (13)七:RIV辅助变量法 (14)仿真思路和辨识结果 (14)RIV辅助变量法的特点: (15)八:Cor-ls相关最小二乘法(二步法) (15)仿真思路和辨识结果 (15)Cor—ls相关最小二乘法(二步法)特点: (17)九:MLS多级最小二乘法 (17)仿真思路和辨识结果 (17)MLS多级最小二乘法的特点: (21)十:yule_walker辨识算法 (21)仿真思路和辨识结果 (21)yule_walker辨识算法的特点: (22)第二部分:matlab程序 (23)一:RLS遗忘因子算法程序 (23)二:RFF遗忘因子递推算法 (24)三:RFM限定记忆法 (26)四:RCLS偏差补偿最小二乘递推算法 (29)五:RELS增广最小二乘的递推算法 (31)六;RGLS 广义最小二乘的递推算法 (33)七:Tally辅助变量最小二乘的递推算法 (37)八:Cor-ls相关最小二乘法(二步法) (39)九:MLS多级最小二乘法 (42)十yule_walker辨识算法 (46)第一部分:程序设计思路、辨识结果分析和算法特点总结一:RLS遗忘因子法RLS遗忘因子法仿真思路和辨识结果仿真对象如下:其中, v(k )为服从N(0,1)分布的白噪声。

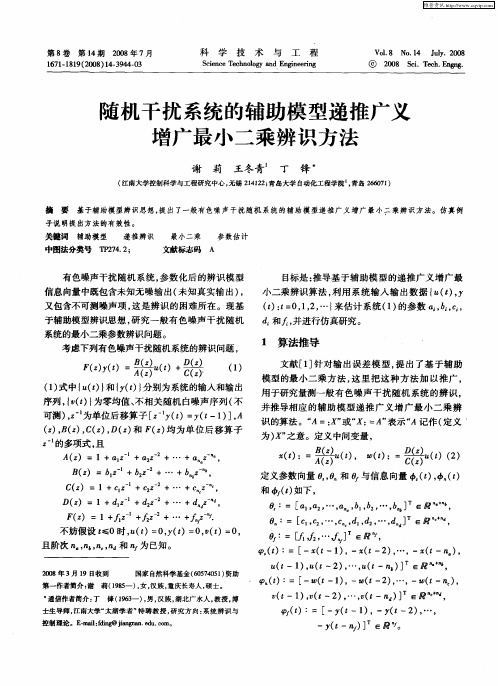

随机干扰系统的辅助模型递推广义增广最小二乘辨识方法

()f 0 12 … } t := ,, , 来估计系统( ) 1 的参数 a, , , b c

d 和 , 进行仿 真研 究 。 并

考虑下列有色噪声干扰随机系统的辨识问题 ,

=

1 算法推导

文献[ ] 1 针对输 出误差模 型, 出了基于辅助 提

模 型 的最 小 二乘 方法 , 里 把 这 种 方 法 加 以推 广 , 这 用 于研究 量测 一般 有 色 噪声 干 扰 随 机 系统 的辨 识 , 并推 导相 应 的辅 助 模 型 递 推 广 义 增 广 最 / - 辨 bZ 乘 识 的算 法 。“ A=: 或 “ = 表 示 “ ” : A” A记 作 ( 义 定

() ()c ) D() ,( 均 为单 位 后 移 算 子 , , ( , 和 ) 的多项 式 , 且

A =1+a 1+口 +… +口 () I- 2一 n B( )=b 1+6 +… +6 l. 2 , ,

) ,

)( ) 2

定义 参数 向量 , 0 与信 息 向量 ,t , () 0和 z () t

@

2 0 Si eh E gg 0 8 e.Te . nn .

随机干扰系统的辅助模 型递推广义 增广 最 小 二乘 辨 识方 法

谢 莉 王冬青 丁 锋

( 江南大学控制科学 与工程研究中心, 无锡 2 4 2 ; 1 12 青岛大学 自动化工程学 院 青岛 26 7 ) , 6 0 1

维普资讯

第 8卷 第 l 4期

20 0 8年 7月

科

学

技

术

与

工

程

Vo. No 1 J l.2 0 18 .4 uy 0 8

17 ・89 2 0 )43 4 -3 6 11 1 (0 8 1 -94 0 ・

广义最小二乘法的推导

广义最小二乘法的推导1. 引言广义最小二乘法(Generalized Least Squares, GLS)是一种用于解决线性回归问题的方法。

与最小二乘法相比,GLS可以处理数据中存在异方差(heteroscedasticity)和自相关(autocorrelation)的情况,提高了回归模型的准确性和效果。

在本文中,我们将详细推导广义最小二乘法的数学原理和推导过程。

首先,我们将介绍最小二乘法的基本概念和原理,然后讨论广义最小二乘法的推导过程,并最后给出一个示例来说明广义最小二乘法的应用。

2. 最小二乘法最小二乘法是一种常用的用于拟合线性回归模型的方法。

其基本思想是通过最小化残差平方和来选择最优的回归系数。

对于一个具有n个数据点的线性回归模型:Y=Xβ+ε其中,Y是n维的因变量向量,X是n行p列的自变量矩阵,β是p维的系数向量,ε是n维的误差向量。

最小二乘法的目标是找到最优的β,使得残差平方和最小:εTεminβ通过对目标函数求导,并令导数等于零,可以得到最优解的闭式解表达式:β̂=(X T X)−1X T Y其中,β̂表示最优的回归系数。

3. 广义最小二乘法最小二乘法假设误差项具有同方差且不相关的性质,然而在实际问题中,数据往往存在异方差和自相关的情况。

为了解决这些问题,我们引入广义最小二乘法。

3.1 异方差问题当误差项具有异方差性质时,最小二乘法的估计结果可能是偏误的。

为了解决异方差问题,我们可以对误差项进行加权处理。

假设误差项的方差为σi2,我们可以使用加权最小二乘法来估计回归系数。

目标函数可以表示为:minεT Wεβ其中,W是一个对角矩阵,对角线元素为σi−2。

通过对目标函数求导,并令导数等于零,可以得到最优解的闭式解表达式:β̂GLS=(X T WX)−1X T WYβ̂GLS表示广义最小二乘法的估计系数。

3.2 自相关问题当误差项存在自相关性质时,最小二乘法的估计结果也可能是偏误的。

递推最小二乘辨识

• 令

P(k ) (ΦΦk )-1 k

(2)

将Φk展开,故有

P(k ) ([Φ-1 (k -1)][Φ-1 (k -1)] )-1 k k [Φ-1Φk -1 (k -1) (k -1)]-1 k

[ P -1 (k -1) (k -1) (k -1)]-1 (3)

– 遗忘因子法

• 通过对不同时刻的数据赋予一定的加权系数,使得对旧 数据逐渐遗忘,加强新数据对当前辨识结果的影响,从而 避免协方差矩阵P(k)与增益矩阵K(k)急剧衰减而失去对 参数估计的修正能力,使算法始终保持较快的收敛速度. • 遗忘因子法在后面将重点讨论.

L=[(0), (1), ..., (L-1)]T, L×(na+nb) (k - 1) [ y (k - 1), , y (k - na ) u (k - 1), , u (k - nb )]

θ [-a1 , , - ana

b1 , , bnb ]

• 设在k-1时刻和k时刻,系统的参数估计结果为

在第k次递推时,我们已获得新的观测数据向量 (k-1)和 y(k),则记 Φk-1=[(0), (1), ..., (k-2)]T

ˆ θ(k -1) (Φ1Φk 1 )1 Φ1Yk 1 k k 1 ˆ θ(k ) (Φk Φk ) Φk Yk

递推最小二乘法

2

1

Φ

T N

ΦN

1

1 1 1 T T T T N 1 1 N 1 2 Φ N Φ N N 1 N 1 2 Φ N Φ N 1

Φ ΦN 2

T N

Φ Φ N N 1 2

T N 1 2

最小二乘估计法的缺陷

系统 B(z-1)/A(z-1)

+

x(k ) a1 x(k 1) b0 u (k )

an x(k n)

bn u (k n), k 1, 2,3

y(k ) x(k ) (k )

y (k ) a1 y (k 1) b0 u (k )

YN YN 1 y ( n N 1)

10

YN YN 1 y ( n N 1)

此时,由n+N+1个观测数据获得 的最小二乘估计为

1 T N 1 (T ) N 1YN 1 N 1 N 1

N T N 1

1

T T N 1 Φ N Φ N

1 T ) NYN ,则上式变为 又因为 N (T N N

N 1 N Φ Φ N N 1

T N 1 2

Φ

T N

Φ N N 1

1 2 T N 1

T N 1 1

T 1 T

J为极小值的充分条件是

2 J T 2 0 2

4

即矩阵 T 为正定矩阵。

递推最小二乘 参数辨识算法 u(k) y(k)

动态系统模型

(完整)各类最小二乘法比较

最小二乘法(LS)最小二乘是一种最基本的辨识方法,最小二乘法可以用于线性系统,也可以用于非线性系统;可用于离线估计和在线估计。

在随机情况下,利用最小二乘法时,并不要求观测数据提供其概率统计方法的信息,而其估计结果,却有相当好的统计特性。

但它具有两方面的缺陷:一是当模型噪声是有色噪声时,最小二乘估计不是无偏、一致估计;二是随着数据的增长,将出现所谓的“数据饱和”现象.针对这两个问题,出现了相应的辨识算法,如遗忘因子法、限定记忆法、偏差补偿法、增广最小二乘、广义最小二乘、辅助变量法、二步法及多级最小二乘法等.广义最小二乘法(GLS)广义最小二乘法的基本思想在于引入一个所谓成形滤波器(白化滤波器),把相关噪声)ξ转(k化成白噪声)ε。

(k优:能够克服当存在有色噪声干扰时,基本最小二乘估计的有偏性,估计效果较好,在实际中得到较好的应用.缺:1、计算量大,每个循环要调用两次最小二乘法及一次数据滤波,2、求差分方程的参数估值,是一个非线性最优化问题,不一定总能保证算法对最优解的收敛性。

广义最小二乘法本质上是一种逐次逼近法.对于循环程序的收敛性还没有给出证明。

3、GLS算法的最小二乘指标函数J中可能存在一个以上局部极小值,(特别在信噪比不大时,J可能是多举的)。

GLS方法的估计结果往往取决于所选用参数的初始估值。

参数估计初值应选得尽量接近优参数。

在没有验前信息的情况下,最小二乘估值被认为是最好的初始条件。

4、广义最小二乘法的收敛速度不是很高.递推最小二乘法(RLS)优点:1、无需存储全部数据,取得一组观测数据便可估计一次参数,而且都能在一个采样周期中完成,所需计算量小,占用的存储空间小。

2、具有一定的实时处理能力辅助变量法(IV、RIV)计算较简单,估计是无偏估计,但计算精度较低辅助变量法、增广矩阵法能保证精度和收敛,算法简单,可同时得到参数和噪声模型的估计,工程应用效果很好但计算量也较大。

RIV总收敛于参数真值。

超级电容模型的递推增广最小二乘辨识

超级电容模型的递推增广最小二乘辨识李月;张晓冬【摘要】In order to analyze the electrical characteristics of supercapacitor ,the model of supercapacitor should be built at first.In this paper, a new model of supercapacitor based on system identification was presented. This paper also introduces the principle of system identification and the basic principle of how to apply recursive extended least squares method to parameter identification. Based on the MATLAB,the program of recursive extended least squares is compiled. According to this program, the transfer function of the supercapacitor is estimated. Finally, the model was simulated and verified. The experimental and simulated results prove that the model presented can depict the characteristics of supercapacitor exactly.%为了更好的描述超级电容的电气特性,需要建立超级电容模型。

提出系统辨识方法进行建模,阐述了系统辨识的原理和递推增广最小二乘法算法,在此基础上利用MATLAB编写递推增广最小二乘法程序估计出超级电容的传递函数,通过仿真对辨识结果进行验证。

最小二乘辨识方法的优劣比较

最小二乘辨识方法的优劣比较摘 要:本文系统的探讨了三种最小二乘类辨识方法的原理和性能,并对各种方法在各种不同的环境下进行了MATLAB 仿真,仿真结果证明:最小二乘法不适合实时处理,在同等情况下,递推最小二乘的辨识速度较快,但在有色噪声干扰下效果不理想,广义最小二乘法的辨识效果最好,且不受噪声是否有色的影响,但是费时最多。

关键词:最小二乘 辨识速度 MATLAB 仿真1 引言系统辨识是一门介于现代控制理论和系统理论的边缘学科.它将现代控制论的平滑、滤波、预测和参数估计理论,以及系统论的系统分析方法和建模思想应用于自然科学、社会科学和工程实践中的各个领域,与各个领域的专业知识相给合,形成了一个个新的交叉学科分支。

关于系统辨识的含义,早在1962年Zacleh 曾作如下定义:“根据系统的输入和输出,在指定的一类系统中确定一个相被辨识系统等价的系统”。

根据这个定义,在系统辨识中必须确定三方面的问题;第一,必须指定一类系统.即根据先验信息确定系统模型的类型。

第二,必须规定一类插入信号。

例如正弦信号、阶跃信号、脉冲信号、白噪声、伪随机信号等。

而且这些信号从时域考虑,必须能持续地激励系统的所有状态;从频域考虑,输入信号的频带能覆盖系统的频带宽度。

第三,必须规定“系统等价”的含义及其度量准则。

2 线性系统的辨识2.1 问题描述考虑如下线性系统:()()()()()()1111a b n a n b z k a z k a z k n bu k b u k n e k +-++-=-++-+L L L L (1) 其中,u(k)为系统激励信号,y(k)为系统输出,e(k)为模型噪声。

其系统模型如图1所示:N(z)u(k)u(k)G(z)y(k)z(k)e(k)++图1 SISO 的系统模型结构图其中G(z -1)是系统函数模型,N(z -1)为有色噪声系统模型,e(k)为白噪声v(k)经过系统函数为N(z -1)的系统后的输出。

最小二乘法在系统辨识中的应用(包含相关的三种算法)

2008级硕士研究生《系统建模理论》试卷已知一个三阶线性离散系统的输入、输出数据,共有40个采样值,试分别用:最小二乘法(LS )、递推最小二乘法(RLS )、广义最小二乘法(GLS )进行参数估计,给出相应的数学模型,并阐述相应的辨识原理。

k 1 2 3 4 5 6 7 8 9 10 u (k ) 0.8251 0.0988 0.4628 -0.9168 2.2325 0.0777 2.3654 0.3476 1.1473 -1.9035 y (k ) 1.5333 -1.0680 1.0666 -0.5284 -0.5835 3.1471 -3.7185 6.2149 -6.3026 7.2705k 11 12 13 14 15 16 17 18 19 20 u (k ) -0.9229 1.6400 -0.8410 0.7599 -0.4739 -0.1784 -1.7760 -1.6722 1.2959 -0.0591 y (k ) -9.0552 8.1735 -5.9004 3.9870 -2.2486 0.9525 -0.5325 -1.5227 0.4200 1.0786k 21 22 23 24 25 26 27 28 29 30 u (k ) -1.0576 -1.0071 1.1342 -0.0740 0.6759 0.5221 0.9954 0.5271 -1.7656 0.4936 y (k ) -1.5579 0.6640 -1.4222 2.6444 -2.9572 3.6340 -3.1281 3.8334 -3.2542 1.1568k 31 32 33 34 35 36 37 38 39 40 u (k ) 1.4810 0.9591 -3.1293 -0.3604 -0.4251 0.4185 -0.6728 -0.0027 2.1145 1.1157 y (k ) 0.0615 0.9120 -0.0692 -3.2731 3.7486 -4.3194 4.7230 -5.2781 5.1507 -2.7235一、最小二乘法(LS )1、数学模型设时不变SISO 动态过程的数学模型为)()()()()(11k n k u z B k z z A +=-- (1.1.1)其中,)(k u 为过程的输入量,)(k z 为过程的输出量,)(k n 是噪声,多项式)(1-z A 和)(1-z B 为:⎪⎩⎪⎨⎧+++=++++=--------nb n n n zb z b z b z B z a z a z a z A b a a 2211122111)(1)( 在本题中,a n =b n =3.即⎩⎨⎧++=+++=--------33221113322111)(1)(z b z b z b z B z a z a z a z A 将此模型写成最小二乘格式)()()(k n k k z +=θh τ (1.1.2) 其中,)(k z 是过程的输出量;)(k τh 是可观测的数据向量;)(k n 是均值为零的随机噪声。

应用最小二乘一次完成法和递推最小二乘法算法的系统辨识.

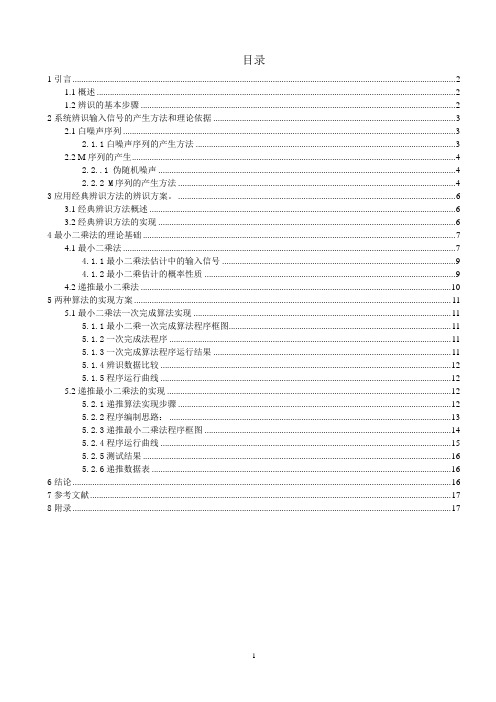

目录1引言 (2)1.1概述 (2)1.2辨识的基本步骤 (2)2系统辨识输入信号的产生方法和理论依据 (3)2.1白噪声序列 (3)2.1.1白噪声序列的产生方法 (3)2.2 M序列的产生 (4)2.2..1 伪随机噪声 (4)2.2.2 M序列的产生方法 (4)3应用经典辨识方法的辨识方案。

(6)3.1经典辨识方法概述 (6)3.2经典辨识方法的实现 (6)4最小二乘法的理论基础 (7)4.1最小二乘法 (7)4.1.1最小二乘法估计中的输入信号 (9)4.1.2最小二乘估计的概率性质 (9)4.2递推最小二乘法 (10)5两种算法的实现方案 (11)5.1最小二乘法一次完成算法实现 (11)5.1.1最小二乘一次完成算法程序框图 (11)5.1.2一次完成法程序 (11)5.1.3一次完成算法程序运行结果 (11)5.1.4辨识数据比较 (12)5.1.5程序运行曲线 (12)5.2递推最小二乘法的实现 (12)5.2.1递推算法实现步骤 (12)5.2.2程序编制思路: (13)5.2.3递推最小二乘法程序框图 (14)5.2.4程序运行曲线 (15)5.2.5测试结果 (16)5.2.6递推数据表 (16)6结论 (16)7参考文献 (17)8附录 (17)应用最小二乘一次完成法和递推最小二乘法算法的系统辨识摘要:本题针对一个单输入单输出系统的便是问题,辨识的输入信号采用的是伪随机二位式序列(M序列),系统噪声为独立同分布高斯随机向量序列(白噪声),辨识的算法是递推最小二乘法和广义最小二乘法,本文简单描述应用经典辨识方法的辨识方案,详细描述了输入信号、噪声的产生方法及matlab程序,阐述了用两种不同算法的辨识原理并对它们的推导过程及辨识程序编制思路做了详细的描述。

最后结合真值与估计值对不同辨识算法的优劣进行了比较。

关键词:系统辨识M序列最小二乘法1引言1.1概述系统辨识是现代控制理论中的一个分支,它是根据系统的输入输出时间函数来确定描述系统行为的数学模型。

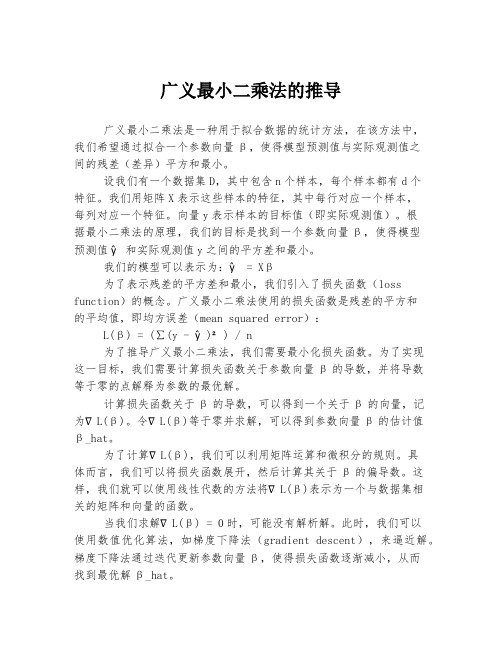

广义最小二乘法的推导

广义最小二乘法的推导广义最小二乘法是一种用于拟合数据的统计方法,在该方法中,我们希望通过拟合一个参数向量β,使得模型预测值与实际观测值之间的残差(差异)平方和最小。

设我们有一个数据集D,其中包含n个样本,每个样本都有d个特征。

我们用矩阵X表示这些样本的特征,其中每行对应一个样本,每列对应一个特征。

向量y表示样本的目标值(即实际观测值)。

根据最小二乘法的原理,我们的目标是找到一个参数向量β,使得模型预测值ŷ和实际观测值y之间的平方差和最小。

我们的模型可以表示为:ŷ= Xβ为了表示残差的平方差和最小,我们引入了损失函数(loss function)的概念。

广义最小二乘法使用的损失函数是残差的平方和的平均值,即均方误差(mean squared error):L(β) = (∑(y - ŷ)²) / n为了推导广义最小二乘法,我们需要最小化损失函数。

为了实现这一目标,我们需要计算损失函数关于参数向量β的导数,并将导数等于零的点解释为参数的最优解。

计算损失函数关于β的导数,可以得到一个关于β的向量,记为∇L(β)。

令∇L(β)等于零并求解,可以得到参数向量β的估计值β_hat。

为了计算∇L(β),我们可以利用矩阵运算和微积分的规则。

具体而言,我们可以将损失函数展开,然后计算其关于β的偏导数。

这样,我们就可以使用线性代数的方法将∇L(β)表示为一个与数据集相关的矩阵和向量的函数。

当我们求解∇L(β) = 0时,可能没有解析解。

此时,我们可以使用数值优化算法,如梯度下降法(gradient descent),来逼近解。

梯度下降法通过迭代更新参数向量β,使得损失函数逐渐减小,从而找到最优解β_hat。

总之,广义最小二乘法通过最小化损失函数,找到一个最优的参数向量β,从而实现数据拟合的目标。

这是一种常用的统计方法,在回归分析等领域得到了广泛应用。

几种最小二乘法递推算法的小结

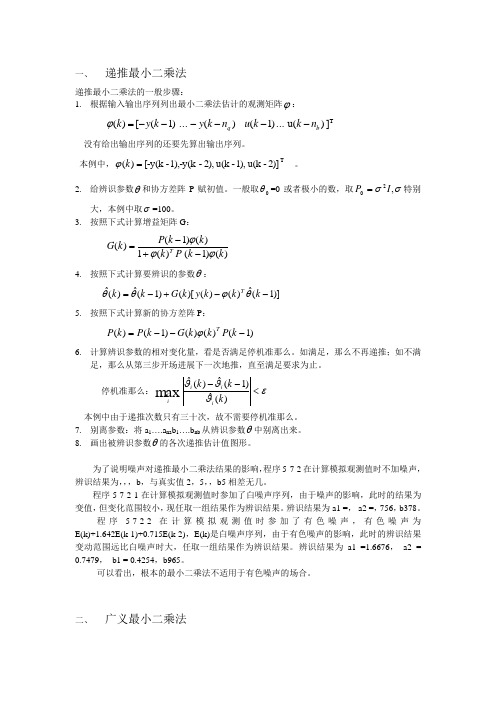

一、 递推最小二乘法递推最小二乘法的一般步骤:1. 根据输入输出序列列出最小二乘法估计的观测矩阵ϕ:] )(u ... )1( )( ... )1([)(T b q n k k u n k y k y k ------=ϕ没有给出输出序列的还要先算出输出序列。

本例中, 2)]-u(k 1),-u(k 2),-1),-y(k -[-y(k )(T =k ϕ。

2. 给辨识参数θ和协方差阵P 赋初值。

一般取0θ=0或者极小的数,取σσ,20I P =特别大,本例中取σ=100。

3. 按照下式计算增益矩阵G :)()1()(1)()1()(k k P k k k P k G T ϕϕϕ-+-= 4. 按照下式计算要辨识的参数θ:)]1(ˆ)()()[()1(ˆ)(ˆ--+-=k k k y k G k k T θϕθθ5. 按照下式计算新的协方差阵P :)1()()()1()(---=k P k k G k P k P T ϕ6. 计算辨识参数的相对变化量,看是否满足停机准那么。

如满足,那么不再递推;如不满足,那么从第三步开场进展下一次地推,直至满足要求为止。

停机准那么:εϑϑϑ<--)(ˆ)1(ˆ)(ˆmax k k k i i i i 本例中由于递推次数只有三十次,故不需要停机准那么。

7. 别离参数:将a 1….a na b 1….b nb 从辨识参数θ中别离出来。

8. 画出被辨识参数θ的各次递推估计值图形。

为了说明噪声对递推最小二乘法结果的影响,程序5-7-2在计算模拟观测值时不加噪声, 辨识结果为,,,b ,与真实值2,5,,b5相差无几。

程序5-7-2-1在计算模拟观测值时参加了白噪声序列,由于噪声的影响,此时的结果为变值,但变化范围较小,现任取一组结果作为辨识结果。

辨识结果为a1 =, a2 =,756,b378。

程序5-7-2-2在计算模拟观测值时参加了有色噪声,有色噪声为E(k)+1.642E(k-1)+0.715E(k-2),E(k)是白噪声序列,由于有色噪声的影响,此时的辨识结果变动范围远比白噪声时大,任取一组结果作为辨识结果。

广义最小二乘

由递推广义最小二乘的计算可知:

θs:=[1.60 ,0.80,0.412,0.309] θn:=[0.80]

1 w(t ) : v (t ) c( z )

s (t ) : [ y (t 1), y (t 2), u (t 1), u (t 2)]T n (t ) : [ w(t 1)]T s (t ) ( t ) n

T w(t ) n (t ) n v (t )

y (t ) T (t ) v (t )

s 是系统模型参数向量,信息向量s (t )

向量。

,

n 是噪声模型参数向量 , n (t )

是信息

s (t )

n (t )

是由输入输出 数据构成的已知信息向量 。 是由噪声构成的未知信息向量。

初始化

计算估计

生成数据

结果展示

李国朝,Matelab基础及应用—北京大学出版 社.2011

汇报人:刘兵、 夏鑫

第一组组员:韩宇 王伟 马丽艳 韩栉 曾朴 汪英博 蒋克成 夏鑫 刘兵

相关背景 递推广义最小二乘分析 仿真结果

什么是广义最小二乘?

广义最小二乘法是用迭代的松弛算法对最小二 乘估计的一种改进,它的基本思想是引入一个白 化滤波器,把相关噪声转换为白噪声,基于对观 测数据先进行一次滤波处理然后利用普通最小二 乘法对滤波后的数据进行辨识。 缺点:一般可给出好的结果,但计算量较大, 信噪比较小时收敛不到真值。可能出现局部最小 值的情况。

估计CARAR模型参数向量的递推广义最小二乘算法:

广义最小二乘法的基本思想是:

先对输入输出进行滤波处理,然后在利用最小二乘法对 滤波后的数据进行辨识。如果滤波器选择合适,对输入输出 进行了较好的白色化处理,那么直接利用最小二乘就能获得 无偏、一致的估计。但是,由于实际问题的复杂性,要事先 选好滤波器一般是比较困难的。广义最小二乘所用的滤波器 是动态的,在迭代过程中根据偏差信息不断调整滤波器参数, 逐渐逼近与理想的滤波器,以便对于输入输出数据进行实时 的白色化处理,使模型参数估计成为无偏、一致估计。从理 论上说,广义最小二乘经过几次迭代后是可以找到合适的滤 波器的。但是,如果系统噪声较大或者参数较多,这种迭代 的处理方法可能会导致出现多个局部收敛点,致使辨识结果 不能收敛到全局极小点上,造成模型参数估计可能是有偏的。

系统辨识第5章 线性动态模型参数辨识 最小二乘法

度函数

,则称uS(uk()为) “持续激励”信号。

● 定义4 一个具有谱密度 Fn (为z 1的) 平f1z稳1 信f2号z 2u(k)称fn为z nn 阶

“持续激励”Fn信(e号j ),2 S若u (对) 一0 切形如 Fn (e j ) 0

的滤波器,关系式

,意味着

。

● 定理2 设输入信号u(kR)u是(0)平稳R随u (1机) 信号,Ru (如n 果1)相关函数矩阵

式中

zL H L nL

nzHLLL[[zn(h(hh11TT)T),((,(zL12n())()22)),,,,znz(((LzLzL)(()]10]))1)

z(1 na ) z(2 na )

z(L na )

u(0) u(1)

u(L 1)

u(1 nb )

u(2

nb

)

u(L nb )

5.2 最小二乘法的基本概念

● 两种算法形式

① 批处理算法:利用一批观测数据,一次计算或经反复迭代,

以获得模型参数的估计值。

②

递推算法:在上次模型参数估计值

ˆ

(k

1)的基础上,根据当

前获得的数据提出修正,进而获得本次模型参数估计值ˆ (k ),

广泛采用的递推算法形式为

(k ) (k 1) K (k )h(k d )~z (k )

z(k ) h (k ) n(k )

式中z(k)为模型输出变量,h(k)为输入数据向量, 为模型参

数向量,n(k)为零均值随机噪声。为了求此模型的参数估计值, 可以利用上述最小二乘原理。根据观测到的已知数据序列

和{z(k)} ,{h极(k小)} 化下列准则函数

L

J ( ) [z(k ) h (k ) ]2

递推最小二乘法相关辨识方法

z ( k ) + a1 z ( k − 1) + LL + ana z ( k − na ) = b1u ( k − 1) + LL +bnb u ( k − nb ) + e ( k )

l 则系统可表示为

A ( z −1 ) z ( k ) = B ( z −1 ) u ( k ) + A ( z −1 )

l 为了减少计算量,减少数据在计算机中占用的 内存,并实时辨识出系统动态特性,我们常利用最 小二乘法的递推形式。其基本思想可以概括成 ) ) 新的估计值θ ( k ) =旧的估计值θ ( k − 1) +修正项 下面我们来推导递推最小二乘算法的原理。 首先,将最小二乘一次完成算法写为

) −1 T T T θ LS = ( H L H L ) H L zL = P ( L ) H L zL

l 把P(k)写成

利用矩阵反演公式 可得

P (k ) = P

T −1

−1

( k − 1) + h ( k ) h ( k )

T

−1 T −1 −1

−1

( A + CC )

= A − A C ( I + C A C ) C T A −1

−1

−1

T P ( k ) = P ( k − 1) − P ( k − 1) h ( k ) hT ( k ) P ( k − 1) h ( k ) P ( k − 1) h ( k ) + 1

l 设一个时不变SISO线性离散动态系统的数学模 型为 A ( z −1 ) z ( k ) = B ( z −1 ) u ( k ) + e ( k ) 假设模型的阶次已经设定,且一般有na ≥ nb 。将模型 写成最小二乘形式

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

广义递推最小二乘辨识一、实验目的1 通过实验掌握广义最小二乘辨识算法;2 运用MATLAB编程,掌握算法实现方法。

二、实验原理广义最小二乘法的基本思想是基于对数据先进行一次滤波预处理,然后利用普通最小二乘法对滤波后的数据进行辨识。

如果滤波模型选择得合适,对数据进行了较好的白色化处理,那么直接利用普通最小二乘法就能获得无偏一致估计。

广义最小二乘法所用的滤波模型实际上就是一种动态模型,在整个迭代过程中不断靠偏差信息来调整这个滤波模型,使它逐渐逼近于一个较好的滤波模型,以便对数据进行较好的白色化处理,使模型参数估计称为无偏一致估计。

理论上说,广义最小二乘法所用的动态模型经过几次迭代调整后,便可对数据进行较好的白化处理,但是,当过程的输出噪信比比较大或模型参数比较多时,这种数据白色化处理的可靠性就会下降。

此时,准则函数可能出现多个局部收敛点,因而辨识结果可能使准则函数收敛于局部极小点上而不是全局极小点上。

这样,最终的辨识结果往往也会是有偏的。

其收敛速度比较慢,需要经过多次迭代计算,才能得到较准确的参数估计值。

一般情况下,经过多次迭代后,估计值便会收敛到稳态值。

但在某些情况下(如噪声比较低时)存在局部极小值,估计值不一定收敛到准则函数的全局极小值上。

为了防止参数估计值收敛到局部极小值,最好选定初值接近最优解,一般可以用最小二乘法的批处理估计值作为初值。

如果系统是时变的,或为了克服数据饱和现象,可以在两次RLS算法中分别引进遗忘因子。

三、实验内容<1> 数据获取:实验数据按照表9-1,为二阶线性离散系统的输入输出数据<2> 数据处理:为了提高辨识精度,实验者必须对原始数据进行剔除坏数据、零均值化、工频滤波等处理。

实验进行了白化滤波处理。

<3> 辨识算法:利用处理过的数据(取适当的数据长度),选择某种辨识方法(如RLS递推最小二乘法、RELS、RIV或RML等参数估计算法及F-检验或AIC定阶法),估计出模型参数和阶次,同时分析辨识结果。

本实验采用广义递推最小二乘法进行系统辨识。

三、广义递推最小二乘法(RLS )原理广义最小二乘法是用迭代的松弛算法对最小二乘估计的一种改进,它的基本思想是引入一个白化滤波器,把相关噪声转换为白噪声,基于对观测数据先进行一次滤波处理然后利用普通最小二乘法对滤波后的数据进行辨识。

广义最小二乘法的计算步骤如下:1 给定初始条件:包括给定的输入输出数据或者产生的数据序列,初始状态矩阵P0,被辨识参数的初始值(取一个充分小的实向量),滤波器参数与矩阵初值。

2 利用式1()()()f z k C z z k -= 1()()()f u k C z u k -=计算滤波后的输入输出序列。

3 对于二阶离散系统,利用式()[(1),(2),(1),(2)]T f f f f f h k z k z k u k u k =------构造()f h k 。

4 利用()(1)()[()()(1)]T f f k k K k z k h k k θθθ=-+--1()(1)()[1()(1)()]f Tf f f f f K k P k h k h k P k h k -=-+-()[()()](1)Tf f f f P k I K k h k P k =--三个式子递推计算辨识矩阵()k θ5 利用式()()()()T e k z k h k k θ=-计算()e k ,并根据()[(1),(2)]T e h k e k e k =----构造()e h k 。

6 利用()(1)()[()()(1)]T e e e e k k K k e k h k k θθθ=-+--1()(1)()[1()(1)()]e T e e e e e K k P k h k h k P k h k -=-+-()[()()](1)T e e e e P k I K k h k P k =--三个式子递推计算()e k θ。

7 返回第二步进行迭代计算,直至获得满意的辨识结果。

四、实验步骤<1> 输入输出数据:u=[1.147,0.201 ,-0.787 ,-1.584 -1.052, 0.866 ,1.152 ,1.573 ,0.626, 0.433 ...-0.958,0.810, -0.044, 0.947, -1.474, -0.719, -0.086, 1.099, 1.450, 1.151...0.485,1.633, 0.043 ,1.326, 1.706, -0.340, 0.890,0.433, -1.177, -0.390...-0.982,1.435 ,-0.119 ,-0.769, -0.899, 0.882,-1.008, -0.844, 0.628,-0.679 ...1.541,1.375, -0.984, -0.582, 1.609,0.090, -0.813, -0.428 ,-0.848,-0.410...0.048,-1.099 ,-1.108 ,0.259,-1.627, -0.528, 0.203, 1.204,1.691, -1.235...-1.228,-1.267, 0.309,0.043, 0.043, 1.461, 1.585, 0.552,-0.601, -0.319...0.744 0.829,-1.626, -0.127, -1.578, -0.822, 1.469, -0.379,-0.212, 0.178...0.493 -0.056, -0.1294, 1.228, -1.606, -0.382, -0.229, 0.313,-0.161, -0.810...-0.277 0.983, -0.288, 0.846, 1.325, 0.723, 0.713, 0.643 0.463,0.786...1.161,0.850, -1.349, -0.596, 1.512, 0.795, -0.713, 0.453,-1.604, 0.889...-0.938, 0.056, 0.829,-0.981, -1.232, 1.327, -0.681,0.114,-1.135, 1.284...-1.201 0.758, 0.590, -1.007, 0.390, 0.836,-1.52, -1.053, -0.083, 0.619...0.840 -1.258, -0.354, 0.629, -0.242,1.680, -1.236, -0.803,0.537, -1.100...1.417,-1.024, 0.671, 0.688,-0.123, -0.952, 0.232, -0.793,-1.138, 1.154...0.206,1.196, 1.013,1.518, -0.553, -0.987, 0.167, -1.445,0.630, 1.255...0.311,-1.726,0.975, 1.718, 1.360, 1.667, 1.111, 1.018, 0.078,-1.665...-0.760, 1.184, -0.614, 0.994, -0.089, 0.947, 1.706, -0.395, 1.222, -1.351...0.231,1.425, 0.114, -0.689, -0.704, 1.070, 0.262, 1.610 ,1.489,-1.602...0.020, -0.601, -0.020, -0.601, -0.235, 1.245, 1.226, -0.204, 0.926, -1.297]; figure(1);stem(u)grid ontitle('图1 输入信号')y=[1.381 3.794 2.481 -0.280 -2.742 -1.554 2.129 2.691 3.427 2.199 ...1.679 -1.249 1.371 0.637 3.131 -0.819 0.235 1.2622.8493.374...2.346 0.6643.015 0.561 2.271 3.650 0.625 2.305 0.364 1.857...-0.912 -1.547 1.940 0.262 -0.379 -0.176 3.720 0.058 -0.752 1.983...-0.923 3.361 4.240 -0.074 -0.481 3.780 2.137 0.086 0.638 -0.971...-0.929 0.679 -0.664 -0.433 1.570 -2.785 -1.153 0.819 3.484 4.091...-2.375 -2.561 -2.778 2.911 1.362 0.735 3.118 3.770 2.381 -0.812...-1.635 0.589 1.550 -3.410 -1.249 -3.692 -2.358 2.552 -0.228 0.554...2.178 2.471 0.743 -0.004 2.504 -3.204 -1.800 -1.284 0.159 0.426...0.059 0.395 2.371 -0.157 2.248 3.297 2.329 2.780 2.375 1.873...2.4113.928 2.846 -2.215 -1.104 3.460 2.883 0.245 -0.231 -2.963...2.072 -0.845 -0.074 1.037 2.468 -3.679 2.149 -0.081 1.639 -1.291...2.548 -1.681 2.307 2.227 -1.558 0.008 2.055 -1.102 -1.427 0.350...2.736 2.965 -2.346 -1.510 0.809 -0.592 2.706 -1.941 2.275 2.802...-1.337 2.091 -2.585 0.013 1.217 0.691 -0.491 2.114 0.333 -0.482...3.388 2.082 3.7974.0795.036 1.250 -1.019 -0.160 -3.201 1.161...3.926 1.789 -2.703 2.125 5.0544.6785.236 -0.241 2.152 0.356 ...-3.519 2.213 1.527 -1.206 2.151 0.264 1.595 2.864 -0.539 1.982...-3.104 -0.264 2.433 0.009 -1.360 -0.521 3.319 1.445 3.105 3.783...-1.973 -0.138 -0.452 -0.586 -4.045 -1.743 2.577 3.849 0.367 1.324];<2>初始值设置,包括被辨识参数的初始值、误差序列以及滤波器参数初值;<3>迭代循环,辨识参数更新,根据误差调整滤波器参数,迭代计算被辨识参数,直至参数符合条件或迭代次数到。