配置MPI并行程序设计环境实验报告

并行计算_实验三_简单的MPI并行程序及性能分析

并行计算_实验三_简单的MPI并行程序及性能分析一、实验背景和目的MPI(Massive Parallel Interface,大规模并行接口)是一种用于进行并行计算的通信协议和编程模型。

它可以使不同进程在分布式计算机集群上进行通信和协同工作,实现并行计算的目的。

本实验将设计和实现一个简单的MPI并行程序,并通过性能分析来评估其并行计算的效果。

二、实验内容1.设计一个简单的MPI并行程序,并解决以下问题:a.将一个矩阵A进行分块存储,并将其均匀分配给不同的进程;b.将每个进程分别计算所分配的矩阵块的平均值,并将结果发送给主进程;c.主进程将收到的结果汇总计算出矩阵A的平均值。

2.运行该MPI程序,并记录下执行时间。

3.对程序的性能进行分析:a.利用不同规模的输入数据进行测试,观察程序的运行时间与输入规模的关系;b. 使用mpiexec命令调整进程数量,观察程序的运行时间与进程数量的关系。

三、实验步骤1.程序设计和实现:a.设计一个函数用于生成输入数据-矩阵A;b.编写MPI并行程序的代码,实现矩阵块的分配和计算;c.编写主函数,调用MPI相应函数,实现进程间的通信和数据汇总计算。

2.编译和运行程序:a.使用MPI编译器将MPI并行程序编译成可执行文件;b.在集群上运行程序,并记录下执行时间。

3.性能分析:a.对不同规模的输入数据运行程序,记录下不同规模下的运行时间;b. 使用mpiexec命令调整进程数量,对不同进程数量运行程序,记录下不同进程数量下的运行时间。

四、实验结果和分析执行实验后得到的结果:1.对不同规模的输入数据运行程序,记录下不同规模下的运行时间,得到如下结果:输入规模运行时间100x1002.345s200x2005.678s300x30011.234s...从结果可以看出,随着输入规模的增加,程序的运行时间也相应增加。

2. 使用mpiexec命令调整进程数量,对不同进程数量运行程序,记录下不同进程数量下的运行时间,得到如下结果:进程数量运行时间110.345s26.789s43.456s...从结果可以看出,随着进程数量的增加,程序的运行时间逐渐减少,但当进程数量超过一定限制后,进一步增加进程数量将不再显著减少运行时间。

并行程序实验报告

并行程序设计实验报告姓名:学号:一、实验目的通过本次试验,了解使用OpenMP编程的基本方法和MPI的编程方法,通过实践实现的基本程序,掌握基本的线程及进程级并行应用开发技术,能够分析并行性能瓶颈及相应优化方法。

二、实验环境Linux操作系统,mpi库,多核处理器三、实验设计与实现(一)MPI并行程序设计用MPI编写一个greeting程序,编号为0的进程接受其它各进程的“问候”,并在计算机屏幕上显示问候情况。

用MPI编写一个多进程求积分的程序,并通过积分的方法求π的值,结果与π的25位精确值比较。

(二)多线程程序设计用Pthreads或OpenMP编写通过积分的方法求π的程序。

把该程序与相应的MPI程序比较。

用Pthreads或OpenMP编写编写矩阵相乘的程序,观察矩阵增大以及线程个数增减时的情形。

四、实验环境安装(一)MPI环境安装1.安装kylin操作系统的虚拟机(用VirtualBox)2.安装增强功能,使之与windows主机能够文件共享。

3.拷贝mpich-3.0.4.tar.gz到/root/myworkspace/目录下,并解压(tar xzf mpich-3.0.4.tar.gz)4.下面开始安装mkdir /root/myworkspace/mpi./configure --prefix=/root/myworkspace/mpi --disable-f77 --disable-fcmakemake install5.配置环境变量打开/root/.bashrc文件,在文件的末尾加上两行:PATH=$PATH:/root/myworkspace/mpi/binexport PATH保存退出,然后执行命令source /root/.bashrc(二)openMP实验环境安装Visual Studio中修改:项目->属性->c/c++->语言,将“OpenMP支持”改成“是”:五、实验结果及分析(一)MPI并行程序设计实验一:问候发送与接收非零号进程将问候的信息发送给0号进程,0号进程依次接收其它进程发送过来的消息并将其输出。

MPI综合实验报告

MPI综合实验报告一、实验目的本次实验旨在探究MPI并行计算技术在多节点集群中的应用,并通过编写相关代码实现一个简单的并行计算任务,验证MPI的计算能力和效果。

二、实验原理MPI(Message Passing Interface)是一种并行计算中进程间通信的标准接口。

MPI通过发送和接收消息来实现进程之间的通信,协调各个计算节点的工作。

一般而言,MPI程序由多个进程组成,每个进程可以独立地执行计算任务,当需要进行通信时,进程可以通过MPI提供的接口来发送和接收消息。

三、实验过程1.配置MPI环境在实验开始前,需要在多个节点上安装MPI环境,并确保各节点之间能够正常通信,可以互相发送和接收消息。

2.编写代码首先,需要编写一个主进程(通常为进程0)和多个子进程参与计算的代码。

主进程负责将计算任务分配给子进程,并收集子进程的计算结果。

子进程则负责进行具体的计算任务。

以下是一个简单的示例代码:```pythonfrom mpi4py import MPIif rank == 0:#主进程负责任务分配data = [i for i in range(size-1)] # 分配给每个子进程的数据for i in range(1, size):#主进程接收结果result = []for i in range(1, size):print("Result:", result)else:#子进程接收任务数据#子进程进行计算result = data * 2#子进程发送计算结果```以上代码使用了mpi4py库来实现MPI的功能。

在主进程中,首先准备要分配的数据,然后将每个子进程的数据发送给相应的子进程,并接收子进程的计算结果。

在子进程中,首先接收来自主进程的数据,然后进行计算,并将计算结果发送给主进程。

3.运行实验在配置好MPI环境和编写好代码后,将代码保存并上传到各个节点上。

然后,在主节点上执行以下命令来运行程序:``````其中,`-np 5`表示使用5个进程来进行计算。

并行程序实验报告

并行程序实验报告( 一).并行程序的简介。

MPI(Message Passing Interface)是目前最重要的一种并行编程工具和环境,几乎所有重要的并行计算机厂商都提供对它的支持,MPI将功能、高效和移植性三个重要而又有一定矛盾的方面很好地融为一体,这是MPI能够取得成功的重要原因。

SIMD/MIMD并行计算机:指令和数据是计算机解决问题所涉及到的两个基本方面,即让计算机"执行什么"样的操作和对"什么对象"执行相应的操作,虽然现在计算机有了很大的发展,但他们仍然有重要的地位和作用,这也是为什么指令数据的划分方式至今仍在使用的重要原因。

不管是同时执行多条指令,还是同时处理多个数据,具有这样功能的计算机都可以称为并行计算机。

根据一个并行计算机能够同时执行的指令与处理数据的多少,可以把并行计算机分为SIMD (Single-Instruction Multiple-Data)单指令多数据并行计算机和MIMD(Multiple-Instruction Multiple-Data)多指令多数据并行计算机。

举例说明SIMD计算机的功能SIMD计算机同时用相同的指令对不同的数据进行操作,比如对于数组赋值运算A=A+1在SIMD并行机上可以用加法指令同时对数组A的所有元素实现加1。

即数组(或向量)运算特别适合在SIMD并行计算机上执行,SIMD并行机可以对这种运算形式进行直接地支持,高效地实现。

举例说明MIMD计算机的功能MIMD计算机同时有多条指令对不同的数据进行操作,比如对于算术表达式A=B+C+D-E+F*G可以转换为A=(B+C)+(D-E)+(F*G)加法(B+C),减法(D-E),乘法(F*G)如果有相应的直接执行部件,则这三个不同的计算可以同时进行。

SPMD/MPMD并行计算机SIMD和MIMD这种表达方法虽然至今还在广泛使用,但是,随着新的并行计算机组织方式的产生,比照上面的划分方法,人们按同时执行的程序和数据的不同,又提出了SPMD(Single-Program Multuple-Data)单程序多数据并行计算机和MPMD(Multiple-Program Multiple-Data)多程序多数据并行计算机的概念。

mpi冒泡排序并行化

北京科技大学计算机与通信工程学院实验报告实验名称: 冒泡排序的并行化学生姓名:**专业:计算机科学与技术班级:计1203学号:********指导教师:***实验成绩:实验地点:机电楼301实验时间:2015年4月8日一、实验目的与实验要求1、实验目的(1)学会将串行程序改为并行程序。

(2)学会mpich2的使用。

(3)学会openmp的配置。

(4)mpi与openmp之间的比较。

2、实验要求(1)将串行冒泡程序局部并行化,以降低时间消耗。

(2) 理论上求出时间复杂度之比,根据结果得出时间消耗之比,进行比对分析。

二、实验设备(环境)及要求Vs2013,mpich2三、实验内容与步骤1、实验一mpi并行(1)实验内容1、写出一个冒泡排序程序,求出其时间复杂度,并运行得到相应的时间消耗。

2、将冒泡程序改为mpi并行程序:将全部需要排序的数分成4等份,分给四个进程一起冒泡,最后将所得的结果归到一个进程,进行归并排序,得到结果,得到时间消耗。

算出时间复杂度。

3、对得出的结果进行讨论与分析。

(2)主要步骤1、串行冒泡程序时间复杂度:取所要排序的数的个数为n个,时间复杂度为n*n/2。

代码实现:// maopao.cpp : 定义控制台应用程序的入口点。

//#include"stdafx.h"#include"stdlib.h"#include"time.h"const int ARRAY_SIZE = 120000;int main(int argc, char* argv[]){int zongshu[ARRAY_SIZE];srand(10086);time_t now_time, end_time;for (int i = 0; i < ARRAY_SIZE; i++){zongshu[i]=rand();}now_time = time(NULL);for (int i = 0; i < ARRAY_SIZE; i++){for (int j = ARRAY_SIZE - 1; j > i; j--){if (zongshu[j] <= zongshu[j - 1]){int z = zongshu[j - 1];zongshu[j - 1] = zongshu[j];zongshu[j] = z;}}}end_time = time(NULL);long shijian = end_time - now_time;for (int i = 0; i <ARRAY_SIZE; i++){printf("%d ", zongshu[i]);}printf("所用时间:%ld",shijian);while (true);}2、并行程序时间复杂度:取所要排序的数的个数为n个,进程数为m个。

实验四MPI环境构建及程序设计

实验四MPI环境构建及程序设计MPI(Message Passing Interface)是一种并行计算通信标准,用于在并行计算环境中进行进程间通信。

构建MPI环境并进行程序设计是实现高性能计算的关键步骤之一、本实验将介绍如何构建MPI环境,并通过一个简单的程序设计来演示MPI的使用。

首先,我们需要在计算机上安装MPI环境。

MPI有多种实现,例如OpenMPI、MPICH和Intel MPI等。

这里我们以OpenMPI为例进行环境构建。

2. 安装OpenMPI:打开终端或命令提示符,进入到OpenMPI安装包所在目录,并执行以下命令进行安装:```$ tar xf openmpi-x.x.x.tar.gz # 解压安装包(x.x.x为安装包版本号)$ cd openmpi-x.x.x # 进入解压后的目录$ ./configure --prefix=/usr/local/openmpi # 配置安装路径$ make # 编译$ sudo make install # 安装(需要管理员权限)```3.配置环境变量:```export PATH=/usr/local/openmpi/bin:$PATHexportLD_LIBRARY_PATH=/usr/local/openmpi/lib:$LD_LIBRARY_PATH ```执行以下命令使环境变量生效:```$ source ~/.bashrc # 或 source ~/.bash_profile```4.验证MPI环境:执行以下命令验证MPI环境是否成功安装:```$ mpiexec --version```如果输出了MPI版本信息,则说明安装成功。

接下来,我们将通过一个简单的MPI程序来演示MPI的使用。

以下是一个求解圆周率的MPI程序示例:```c#include <stdio.h>#include <stdlib.h>#include <mpi.h>int main(int argc, char *argv[])int rank, size;double pi = 0.0;double sum = 0.0;MPI_Init(&argc, &argv);srand(rank);for (int i = start; i < end; i++)double x = (double)rand( / RAND_MAX;double y = (double)rand( / RAND_MAX;if (x * x + y * y <= 1.0)sum += 1.0;}}MPI_Reduce(&sum, &pi, 1, MPI_DOUBLE, MPI_SUM, 0, MPI_COMM_WORLD);if (rank == 0)printf("Approximated Pi: %f\n", pi);}MPI_Finalize(;return 0;```该程序使用蒙特卡洛方法求解圆周率。

MPI并行编程实验报告

MPI并行编程实验报告MPI并行编程实验报告起讫日期:xx-05-20 ~全文结束》》-06-15组名:第四组院系:计算机学院专业:计算机科学与技术指导老师:XXX 教授xx 年6月15日实验一Linux下基于MPI的hello程序设计Author:姓名一、MPICH并行计算库安装在Linux环境下安装MPICH执行环境,配置MPD、CONF, 完成实验室中临近机器间的并行配置。

概要:以寝室四台计算机为例,设置IP(192、168、1、1~192、168、1、4),更改主机名为node01,node02,node03,node04。

(一)创建SSH信任连接1、更改/etc/hosts文件#vi /etc/hosts 打开hosts文件,更改如下:127、0、0、1 localhost、localdomain localhost192、168、1、1 node01192、168、1、2 node02192、168、1、3 node03192、168、1、4 node042、在node01生成SSH秘钥对、#ssh-keygena 查看是否有、ssh文件夹3、进入、ssh目录#cd 、ssh4、生成authorized_keys文件#cp id_rsa、pub authorized_keys5、退出到root目录#cd 、、6、建立本身的信任连接#ssh node01 按提示输入yes(三个字母要打全)7、设置node02(node02的root目录下)#ssh-keygenzxvf mpich2-1、0、1、tar、gz2、创建安装目录#mkdir /usr/MPICH-instsll3、进入mpich2解压目录#cd mpich2-1、0、14、设置安装目录#、/configureprefix=/usr/MPICH-install5、编译#make6、安装#make install7、退出到root目录#cd 、、8、通过编辑、bashrc文件修改环境变量#vi 、bashrc修改后的、bashrc文件如下:# 、bashrc# User specific aliases and functions aliasrm='rmi'alias mv='mvinstall/bin" 新增加的#Source global definitionsif[nstall目录输出给其他三个结点,相应的配置步骤如下。

并行实验报告

实验名称:并行处理技术在图像识别中的应用实验目的:1. 了解并行处理技术的基本原理和应用场景。

2. 掌握并行计算环境搭建和编程技巧。

3. 分析并行处理技术在图像识别任务中的性能提升。

实验时间:2023年10月15日-2023年10月25日实验设备:1. 主机:****************************,16GB RAM2. 显卡:NVIDIA GeForce RTX 2080 Ti3. 操作系统:Windows 10 Professional4. 并行计算软件:OpenMP,MPI实验内容:本实验主要分为三个部分:1. 并行计算环境搭建2. 图像识别任务并行化3. 性能分析和比较一、并行计算环境搭建1. 安装OpenMP和MPI库:首先在主机上安装OpenMP和MPI库,以便在编程过程中调用并行计算功能。

2. 编写并行程序框架:使用C++编写一个并行程序框架,包括并行计算函数和主函数。

3. 编译程序:使用g++编译器编译程序,并添加OpenMP和MPI库的相关编译选项。

二、图像识别任务并行化1. 数据预处理:将原始图像数据转换为适合并行处理的格式,例如将图像分割成多个子图像。

2. 图像识别算法:选择一个图像识别算法,如SVM(支持向量机)或CNN(卷积神经网络),并将其并行化。

3. 并行计算实现:使用OpenMP或MPI库将图像识别算法的各个步骤并行化,例如将图像分割、特征提取、分类等步骤分配给不同的线程或进程。

三、性能分析和比较1. 实验数据:使用一组标准图像数据集进行实验,例如MNIST手写数字识别数据集。

2. 性能指标:比较串行和并行处理在图像识别任务中的运行时间、准确率等性能指标。

3. 结果分析:分析并行处理在图像识别任务中的性能提升,并探讨影响性能的因素。

实验结果:1. 并行处理在图像识别任务中显著提升了运行时间,尤其是在大规模数据集上。

2. 并行处理对准确率的影响较小,甚至略有提升。

MPI报告

并行程序设计实验一:运行MPI程序第一项:准备工作1、安装MPICH2下载MPICh2软件包,对已经下载好的mpich2-1.4.1p1-win-ia32进行安装2、新建用户密码开始——控制面板——用户账户和家庭安全——添加或删除用户账户——创建一个新账户——输入用户名(选择用户类型为“管理员”)——创建用户然后再创建密码。

如下图所示(若已经存在管理员,可使用原来的管理员账号和密码)这个用户名和密码就是我们测试时需要用的。

3、注册开始——所有程序——mpich2——wmpiregister如下图,这个就是刚才注册的用户和密码。

输入后点击Register——OK。

就会出现一行字,成功注册。

4、测试mpich2开始——所有程序——mpich2——wmpiconfig.exe——scan hosts这时左侧会出现绿色,说明成功了。

5、vc++6中的设置打开vc,工具——options——Directories——include files添加你刚刚安装的mpich2中include文件,如图所示然后在show directories for的下拉菜单中选择library files,同样添加lib文件。

要想运行成功,程序中也是要作些改动的。

第二项:测试程序通过测试以下MPI程序,可知系统运行成功。

1、MPI程序运行及结果分析程序1:输出Hello parallel world!。

程序源代码如下:程序运行无错后,build——组建,没有错误。

在debug文件夹中找到生成的exe文件,运行wmpiexec.exe文件。

程序运行结果:实验数据说明:本程序选择了5个进程,每个进程输出一句Hello parallel world!。

程序2:类似程序1,显示本次执行需要的进程数程序源代码如下:程序运行结果:程序运行数据说明:选择了5个进程,用变量num标识,标号从0-4,用变量rk标识。

程序3:消息传递功能,用MPI_Send()和MPI_Recv()两个函数实现进程之间数据的发送和接收,本程序实现的功能:实现其他进程像0进程发送消息,0进程负责从其他进程接收消息并输出。

《并行程序设计》课程实验报告之四

《并行程序设计》课程实验报告实验4:基于WINDOWS平台的MPI并行程序设计3. 在项目->属性->Linker“Command Line”中添加impi.lib impicxx.lib3.将C:\Program Files (x86)\Intel\MPI\5.0.1.037\intel64\bin里面的.dll文件添加到C:\WINDOWS\System32中4.使用intel编译器编译,生成.exe文件5.执行(管理员权限打开CMD,执行下边的命令)2. 进行如下实验并记录数据(实验报告中给出数据并绘图)3. CMD命令示例:mpiexec -hosts 2 Win-7-01 4 Win-7-02 4 C:\Users\nbody.exe 4000 500倒数第二个参数(4000)是body的总数量,也就是数据规模最后一个参数(500)是每个进程处理的数据量,这里两个节点一共启动了8个进程三、实验结果记录实验结果。

4.1一、配置电脑环境。

1. 基本网络设置:关闭杀毒软件、计算机防火墙,将小组里所有计算机连接到同一个交换机上,查看每台计算机ip,使用ping命令测试,保证互相之间能够ping通。

2. 网络连接设置:由于需要在cluster上运行同一个程序,为了实现相互之间能连接成功,要注意需要保证小组内每台电脑有相同的管理员账户和密码。

例如小组中的账号密码都可以设为二、单机上编译运行简单的test程序1.打开test工程选择x64编译2. 在项目->属性->VC++目录“包含目录”中添加C:\Program Files (x86)\Intel\MPI\5.0.1.037\intel64\include;“库目录”添加C:\Program Files (x86)\Intel\MPI\5.0.1.037\intel64\lib;3. 在项目->属性->Linker“Command Line”中添加impi.lib impicxx.lib3.将C:\Program Files (x86)\Intel\MPI\5.0.1.037\intel64\bin里面的.dll文件添加到C:\WINDOWS\System32中4.使用intel编译器编译,生成.exe文件5.执行(管理员权限打开CMD,执行下边的命令)smpd –installsmpd -starthydra_service –installhydra_service –startmpiexec –register设置电脑账户和密码。

MPI综合实验报告

MPI综合实验报告目前三次MPI实验已经结束,结合之前所写的实验报告,对总体的实验容做一个总结。

参考资料:MPI简介多线程是一种便捷的模型,其中每个线程都可以访问其它线程的存储空间。

因此,这种模型只能在共享存储系统之间移植。

一般来讲,并行机不一定在各处理器之间共享存储,当面向非共享存储系统开发并行程序时,程序的各部分之间通过来回传递消息的方式通信。

要使得消息传递方式可移植,就需要采用标准的消息传递库。

这就促成的消息传递接口(Message Passing Interface, MPI)的面世,MPI是一种被广泛采用的消息传递标准[1]。

与OpenMP并行程序不同,MPI是一种基于消息传递的并行编程技术。

消息传递接口是一种编程接口标准,而不是一种具体的编程语言。

简而言之,MPI标准定义了一组具有可移植性的编程接口。

各个厂商或组织遵循这些标准实现自己的MPI软件包,典型的实现包括开放源代码的MPICH、LAM MPI以及不开放源代码的Intel MPI。

由于MPI提供了统一的编程接口,程序员只需要设计好并行算法,使用相应的MPI库就可以实现基于消息传递的并行计算。

MPI支持多种操作系统,包括大多数的类UNIX和Windows系统。

三次实验总结第一次实验:实验要求:配置好MPI运行的基本环境,测试MPI的基本通信程序。

程序:#include "stdafx.h"#include <mpi.h>void main( void ){MPI_Status status;charstring[]="xxxxx";int myid;MPI_Init(NULL,NULL);MPI_Comm_rank(MPI_COMM_WORLD,&myid);if(myid==2)MPI_Send("HELLO",5,MPI_CHAR,7,1234,MPI_COMM_WORLD);if(myid==7){MPI_Recv(string,5,MPI_CHAR,2,MPI_ANY_TAG,MPI_COMM_WORLD,&status); printf("Got%s from P%d,tag%d\n",string,status,status.MPI_SOURCE,status.MPI_TAG);}MPI_Finalize();}运行环境配置过程:(这个是在根据网上的环境配置教程做的)1、安装软件MPICH2,本次操作安装在C:\Program Files\MPICH2文件夹中。

基于MPI的并行计算程序设计测试报告

中南大学CENTRAL SOUTH UNIVERSITY基于MPI的并行计算程序设计测试报告学院:软件学院专业:软件工程学号:姓名:指导教师:20**-**-**基于MPI的并行计算程序设计测试报告一.并行计算概述1.采纳并行计算的缘故:✧串行程序速度提升缓慢。

从串行程序的进展来讲,一方面,物理速度渐变进展,芯片速度每18个加速一倍,而内存传输率每一年加速9%。

另一方面,物理极限无法冲破,芯片晶体管接近了原子极限,传输速度不可能超过光速。

✧能够加速速度。

更短的时刻内解决相同的问题,相同的时刻内解决更多的复杂的问题。

✧能够加大规模。

并行计算能够计算更大规模的问题。

2.并行计算简介并行计算(Parallel Computing)是指同时利用多种计算资源解决计算问题的进程。

为执行并行计算,计算资源应包括一台配有多处置机(并行处置)的运算机、一个与网络相连的运算机专有编号,或二者结合利用。

并行计算的要紧目的是快速解决大型且复杂的计算问题。

另外还包括:利用非本地资源,节约本钱,利用多个“廉价”计算资源取代大型运算机,同时克服单个运算机上存在的存储器限制。

为利用并行计算,通常计算问题表现为以下特点:1.将工作分离成离散部份,有助于同时解决;2.随时并及时地执行多个程序指令;3.多计算资源下解决问题的耗时要少于单个计算资源下的耗时。

对并行处置的需求极大的增进了并行技术的进展,因此许多大规模并行运算机系统接踵问世,如PVP、SMP、MPP、DSM等。

但传统的并行系统的高本钱性、专用性、系统规模的不可伸缩性等使其难以推行到一般的商业应用和科学计算中。

高性能集群系统因其性能价钱比高、高可复用性、强可扩展性、用户编程方便等优势在科学研究中取得了普遍的应用。

并行运算机系统的显现就需要对程序进行并行设计,这种需求使得各类不同的并行编程环境取得了专门大进展。

现行高性能运算机系统中利用的并行编程环境要紧有两种:PVM(Parallel Virtual Machine)和MPI(Message Passing Interface)。

MPI综合实验报告

MPI综合实验报告MPI(Message Passing Interface)是一种并行计算编程模型,可用于在分布式内存系统中实现进程间通信。

本文将介绍一个关于MPI的综合实验报告,涵盖了MPI的基本概念、实验目的、实验过程和实验结果。

一、实验目的1.熟悉MPI的基本概念和编程模型;2.掌握MPI的几个常用函数的使用方法;3.理解并实现并行计算的数据分发和结果收集。

二、实验过程1.环境准备:配置MPI开发环境,包括安装MPI软件包和设置环境变量。

2.实验设计:设计一个简单的并行计算任务,实现对一组数据的平方计算。

3.编码实现:使用MPI编写程序,在主进程中生成一组数据,在其他进程中进行数据分发和计算。

4.程序运行:运行MPI程序,观察并记录各个进程的计算结果。

5.结果分析:比较串行计算和并行计算的结果,并计算加速比。

三、实验结果1.硬件环境:实验采用了一台配置为4核的计算机进行测试。

2. 算法实现:程序中使用MPI的MPI_Send和MPI_Recv函数进行通信,其中主进程通过MPI_Bcast函数将数据广播到其他进程,其他进程使用MPI_Recv函数接收数据,并计算平方。

3.数据分析:比较串行计算和并行计算的结果,通过计算加速比来评估并行计算的效果。

实验结果显示,并行计算的加速比在4个进程的情况下超过了3倍。

四、实验总结本次实验成功地实现了一个简单的MPI并行计算任务,并比较了串行计算和并行计算的结果。

实验结果表明,MPI能够实现进程间的高效通信,并发挥多核处理器的计算能力,从而显著提高计算速度。

通过实验,我对MPI的编程模型和函数使用有了更深入的了解,也加深了对并行计算的理解。

(以上内容为模拟生成。

MPI并行程序实验报告

MPI并行程序实验报告

一.实验目的

1.了解MPI并行程序的概念和原理

2.并行集群的搭建

3.创建并行程序的模拟运行环境

二.实验原理

1.并行集群的搭建,形成并行开发环境

2.通过建共享文档,完成各PC机间资源的共享

3.通过安装MPIch12,runMPI程序时,可将运行分为多个进程,实现多台PC

机同时运行该程序,达到高效的目的。

三.实验步骤与内容

1.下载安装Vmware虚拟机

安装好了

创建一个虚拟系统

创建MPI用户

然后双击新建的MPI账户->隶属于->添加->高级->立即查找->选择Administrors –>确定

(2)建立一个共享目录。

如下图:

(3)建立一个映射驱动器

首先打开我的电脑,点击工具,点击映射网络驱动器。

安装MPICH1.2.5

(6)将MPI中的例子放入进行操作运行。

并找到运行后生成的cpi.exe应用文件,然后再把该应用文件放入共享文件夹share中。

(7)为防止连接其他计算机发生错误,必要时关闭本机的防火墙。

3运行MPI添加用户,即创建组,构建并行集群

Run程序就ok了。

实现了多进程运行程序

观察CPU使用以及pf的使用率

可知CPU明显负载更小了,实现了高效率并行程序的运行

四.实验总结

掌握了并行开发环境的搭建,通过实验可知将程序分为多进程运行能极大的提高运行效率,减轻CPU的负载。

同时通过运行MPI程序掌握基本的并行程序的开发和运行。

哈工大软件学院《并行程序设计》课程实验报告材料之四

《并行程序设计》课程实验报告实验4:基于WINDOWS平台的MPI并行程序设计运行测试程序:在调试模式下运行:使用不同的命令运行:二、运行过程截图:实验结果记录如下:实验一:单机上,数据规模为4000时,随每机进程数变化的运行时间;进程数 1 2 3 4 5 时间实验二:一样数据规模为4000,随每机进程数变化的运行时间每机进程数单机双机三机四机1234 0.453638实验三:每机1个进程,随数据规模变化的n-body并行程序运行时间。

粒子数n 单机双机三机四机105010050010002000300040003. 根据记录的数据计算加速比与效率〔给出数据并绘图〕实验一:单机上,粒子数为4000,随进程数变化加速比〔Sp〕统计进程数 2 3 4 5 6 7 8 9 10 加速比实验二:粒子数为4000,随每机进程数变化的加速比每机进程数三机四机1234实验三:每机1个进程,随数据规模变化的n-body并行程序加速比和效率n-body并行算法的加速比〔Sp〕统计表粒子数n 双机三机四机10501005001000200030004000n-body并行算法的效率〔Ep〕统计表粒子数n 双机三机四机10501005001000200030004000四、思考题思考题1:深入分析并行nbody的机理,阐述其根本并行思想,给出其流程图N体问题的并行实现算法使用SPMD〔单程序多数据流〕计算模型,每个进程将执行一样的代码。

假设有m个计算资源,每个资源上启动一个进程,表示进程的标号是0、1、2、……m-1,每个进程分配的物体数是n0、n1、n2、……n(m-1),其中n0 + n1 + n2 + ……+ n(m-1) = n。

每个进程主要有两个数组localparticles、allparticles、sendbuf、recvbuf,其中localparticles用于保存分配给本进程的物体的信息;allparticles用于保存应用程序中所有物体的信息;sendbuf用于保存发送到下一个进程的物体;recv用于保存从前一个进程承受的物体。

实验一串匹配OpenMPI并行编程

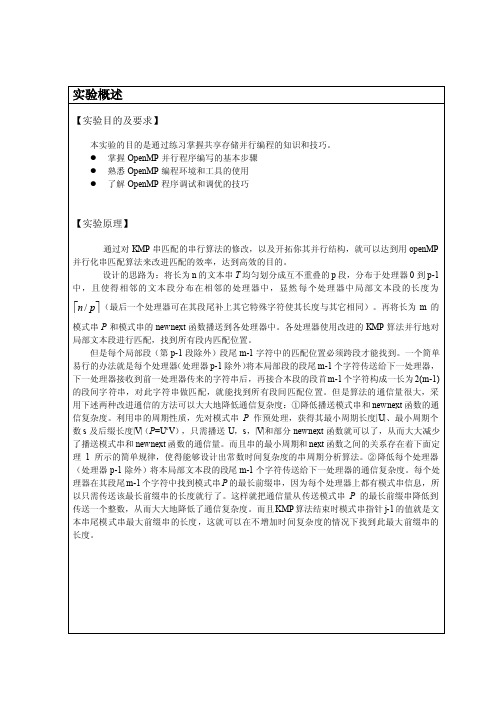

实验概述【实验目的及要求】本实验的目的是通过练习掌握共享存储并行编程的知识和技巧。

●掌握OpenMP并行程序编写的基本步骤●熟悉OpenMP编程环境和工具的使用●了解OpenMP程序调试和调优的技巧【实验原理】通过对KMP串匹配的串行算法的修改,以及开拓你其并行结构,就可以达到用openMP 并行化串匹配算法来改进匹配的效率,达到高效的目的。

设计的思路为:将长为n的文本串T均匀划分成互不重叠的p段,分布于处理器0到p-1中,且使得相邻的文本段分布在相邻的处理器中,显然每个处理器中局部文本段的长度为n/(最后一个处理器可在其段尾补上其它特殊字符使其长度与其它相同)。

再将长为m的⎡⎤p模式串P和模式串的newnext函数播送到各处理器中。

各处理器使用改进的KMP算法并行地对局部文本段进行匹配,找到所有段内匹配位置。

但是每个局部段(第p-1段除外)段尾m-1字符中的匹配位置必须跨段才能找到。

一个简单易行的办法就是每个处理器(处理器p-1除外)将本局部段的段尾m-1个字符传送给下一处理器,下一处理器接收到前一处理器传来的字符串后,再接合本段的段首m-1个字符构成一长为2(m-1)的段间字符串,对此字符串做匹配,就能找到所有段间匹配位置。

但是算法的通信量很大,采用下述两种改进通信的方法可以大大地降低通信复杂度:①降低播送模式串和newnext函数的通信复杂度。

利用串的周期性质,先对模式串P作预处理,获得其最小周期长度|U|、最小周期个数s及后缀长度|V|(P=U s V),只需播送U,s,|V|和部分newnext函数就可以了,从而大大减少了播送模式串和newnext函数的通信量。

而且串的最小周期和next函数之间的关系存在着下面定理1所示的简单规律,使得能够设计出常数时间复杂度的串周期分析算法。

②降低每个处理器(处理器p-1除外)将本局部文本段的段尾m-1个字符传送给下一处理器的通信复杂度。

每个处理器在其段尾m-1个字符中找到模式串P的最长前缀串,因为每个处理器上都有模式串信息,所以只需传送该最长前缀串的长度就行了。

并行计算_实验三_简单的MPI并行程序及性能分析

深圳大学实验报告课程名称:并行计算实验名称:简单的MPI并行程序及性能分析姓名:学号:班级:实验日期:2011年11月18日、12月2日一. 实验目的1) 用MPI 实现简单的求π的程序 2) 对MPI 并行程序进行简单的性能二. 实验环境1) 硬件环境:32核CPU 、32G 内存计算机;2) 软件环境:Linux 、Win2003、GCC 、MPICH 、VS2008;4) Windows 登录方式:通过远程桌面连接192.168.150.197,用户名和初始密码都是自己的学号,在通过wmpiexec.exe 运行MPI 程序前,先需运行wmpiregister.exe 注册自己的账号(即自己的学号)。

三. 实验内容1. 用MPI 实现求π的并行程序,写出代码。

提示:π≈∑-=++⨯102)5.0(114n i ni n ,计算执行时间用MPI_Wtime()函数。

串行程序如下:#include <stdio.h> #include <time.h> void main() { clock_t t=0; int i,num_steps; scanf("%d",&num_steps);double x,pi,sum=0,step=1.0/num_steps; t-=clock();for (i=0;i<num_steps;i++) { x=(i+0.5)*step; sum+=4.0/(1.0+x*x);}pi=step*sum; t+=clock();printf("PI is %f\nexecution time is %f\n",pi,t/1000.0);}答:在windows 下使用Microsofe Visual Studio 编程,根据串行程序更改的并行程序,源代码如下:#include"mpi.h"#include<stdio.h>#include<time.h>void main(int argc,char ** argv ){int i,rank,size,n=1000000000;double x,pi,sum=0,step=1.0/n;clock_t t=0;MPI_Init(&argc,&argv);MPI_Comm_rank(MPI_COMM_WORLD,&rank);MPI_Comm_size(MPI_COMM_WORLD,&size);t-=clock();for(i=rank;i<n;i=i+size){x=(i+0.5)*step;sum+=4/(1+x*x);}MPI_Reduce(&sum,&pi,1,MPI_DOUBLE,MPI_SUM,0,MPI_COMM_WORLD);if(rank==0){pi=step*pi;t+=clock();printf("PI is %.10f, run time is %10f\n",pi,t/1000.0);}MPI_Finalize();}2.分析上述程序的执行时间、加速比和效率:num_steps固定为109,节点数分别取1、2、4、8、16和32时,为减少误差,每项实验进行5次,取平均值作为实验结果。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

/* 这一步如果用 telnet 需要输入密码,不过也可以直接用闪存盘拷贝 */

4、 修改 hosts 文件 sudo gedit /etc/hosts

./configure –prefix=/home/mpich_install /*

./configure 是源代码安装的第一步,这一步一般用来生成 Makefile,为下一步的编译做准 备,你可以通过在 configure 后加上参数来对安装进行控制,这整段代码的意思是意思是将 该软件安装在/home/mpich_install 下面,执行文件就会安装在/home/mpich_install(而不是 默认的 /usr/local/bin) */ 6、 执行

/* 在文件中添加下列信息 192.168.47.25 yty-VGN-SZ42C-B 192.168.47.128 hyq-Lenovo-Eraser-Y40-70 因为我们用的是手机开的无线 AP,所以 ip 是 192.168.x.x 网段,将主机和其 ip 记录到本机 的 hosts 文件中,这样就可以免去用 ssh 登录时需要输入长串 ip 的麻烦 */ 5、配置成功后,可以不用输入密码就可以登录 hyq-Lenovo-Eraser-Y40-70。在 yty-VGN-SZ42C-B 中执行:

三、在多机并行运行 example

13、执行 touch /home/.mpd.conf

/* 在/home/目录下创建一个文件 .mpd.conf */

chmod 600 /home/.mpd.conf /* 在这里我们通过 chmod 命令更改文件的权限,chmod 600 是将文件的权限设置成只有所有 者才具有读和写的权限。 */

首先从硬盘中分出 40G 大小的空闲区,然后制作 Ubuntu14.10 的 U 盘启动盘,插入 U 盘后电脑直接就默认从 U 盘启动,一切按照默认的进行,分区时就分出/boot,/,/home 与/swap,然后就等待它安装。安装完毕后回到 Windows,安装 easybcd,在启动项增加一 个 Linux 启动,以上过程均严格按照网上教程进行,但当再次重启的时候 easybcd 并不能找 到 Linux 系统。把 Ubuntu 重装过好几遍都找不到。后来咨询师兄后,他的解决方法是再一 次安装 Ubuntu 的时候不另外分出/boot 区,直接装在 Windows 的引导区上,通过 Ubuntu 来引导进入 Windows,再次安装完毕时显示了 Ubuntu 与 Windows 的选项,Ubuntu 可以成 功进去了,但是问题来了,Windows 进不去了!选择 Windows 选项就跳出一个 grub,就 是找不到 Windows!再一次查找原因,我们知道新的电脑预装的一般是 Windows 8 或 Windows 8.1 的系统使用了 UEFI 来替代 BIOS。这使得安装双启动变得和之前的常规方法有 点不同,需要在 UEFI 模式下安装。于是插入 U 盘,重启时按住 shift 键,进入 UEFI 模式再 一次安装 Ubuntu,这次依然是不额外分出/boot 区,安装完后终于成功实现 Ubuntu 与 Windows 双系统。

sourse .bashrc 这是用于重新执行刚修改的初始化文件,使之可以立即生效 12、单机测试 MPI:进入 mpich 解压后的目录,执行

mpicc ./example/cpi mpiexec –np 4 ./example/cpi /* 编译 mpich 自带的 example 程序,并在单机上多线程运行 */

三、在单机上配置 MPI 环境

1、 从官网上下载 mpich,我们使用的是 mpich3.1.3. 2、 将压缩包解压到主目录下即/home 目录下,直接解压就可以,不需要从终端操作。 3、 大家统一在/home 目录下创建一个安装文件夹 mpi_install。 4、 打开终端,通过 cd 命令一直进入到 mpich3.1.3 解压到的文件里 5、 在该解压目录下,执行

mpiexec –n 4 –f /home/mpd.hosts ./example/cpi 得到结果:

四、一点感想

对我们之中绝大多数人来说,我们都是第一次接触 Linux 系统,在如此短的时间内要学 会流利地使用 Linux 系统几乎不可能,但是通过解决这次试验中遇到的种种问题,我们对 Linux 和 MPI 有了比较浅显的认识。我们了解到了:比如耐心,毅力,自学能力,足够的编 码练习,以及用搜索引擎的技巧都是做 IT 工程师所需要的基本素质,这些都是非常重要的, 我们需要在今后的学习过程中不断培养这种能力。

sudo gedit /home/.mpd.conf /* 在编辑器中打开/home/.mpd.conf 加入一行 MPD_SECRETWORD=0 ,在各个机器中这一行需 要保持一致,这样使得各个机器可以并行同一个程序 */ 14、执行

touch /home/mpd.hosts /* 在/home/目录下创建一个文件 mpd.hosts, 这个文件是用于存放用于并行的主机和每个主 机对应的线程数 */

配置 MPI 并行程序设计环境实验报告

实验项目 实验目的 实验环境 实验过程

基于 Linux 下配置 MPI 并行程序设计环境 在多机上上配置 MPI 并行程序设计环境,并能实现多机并行 Ubuntu14.04 与 Ubuntu14.10 操作系统 见下文

一、实现 windows8 与 Ubuntu14.10 的双系统并存

二、在多机上配置 SSH

注:我们的两台机器的主机名:yty-VGN-SZ42C-B 和 hyq-Lenovo-Eraser-Y40-70

1、 首先安装 ssh 服务,执行 sudo apt-get install openssh-server

2、 用 su 命令进入 root 用户,用 RSA 算法生成公钥和密钥,执行下面的命令 ssh-keygen –t rsa Enter file in which to save the key (/root/.ssh/id_rsa): Enter passphrase (empty for no passphrase): Enter same passphrase again: 这三个项目直接回车即可,之后会在/root/.ssh/生成 id_rsa,id_rsa.pub

ssh -o StrictHostKeyChecking=no hyq-Lenovo-Eraser-Y40-70 /* -o StrictHostKeyChecking=no 这一句的作用是把远程节点加入到本地的 ~/.ssh/known_hosts 中,下次再连接同一节点则不再提示。 */ 6、 最后,如果出现远程的主机的版本号说明成功连接。

gedit /home/mpd.hosts /* 在编辑器中打开/home/mpd.hosts 加入: yty-VGN-SZ42C-B:2

hyq-Lenovo-Eraser-Y40-70:2 这两行的意思是两台机 yty-VGN-SZ42C-B 和 hyq-Lenovo-Eraser-Y40-70 每台机都跑两个线程 */ 15、进行多机并行,执行

make 因为我们使用的是源代码安装,所以需要这一步的编译。 7、 执行

sudo make install /* 一开始我们以为只需要 make install 就可以安装,但是它却报错,因为在黄彰浩的是英文版 没看懂,后来在杨展富的中文界面上看到说权限不够,原来在这个步骤,要求用户需要有 root 权限,于是用 sudo 这个命令来切换到 root,安装完毕后返回主目录。 */ 8、 在/home 下,打开 .bashrc 文件。可以在终端用 sudo gedit .bashrc 打开,而如果要直 接从文件夹内找到的话,需要按 Ctrl +H,因为.bashrc 是 bash 的个人配置文件,主要保存个

ቤተ መጻሕፍቲ ባይዱ

人的一些个性化设置,如命令别名、路径等。也即在同一个服务器上,只对某个用户的个性 化设置相关。它是在用户目录下,是个隐藏文件 9、打开文件后,在文件的最后加上 export PATH=$PATH:/home/mpi_install/bin ,加完这句话 后需要再空一行,但是在 14.10 下情况不同 ,14.10 是 PATH=$PATH:/home/mpi_install/bin 然 后换行再粘贴 export PATH。因为这些差异我们在配置这一步时尝试了很久。 通过这一步 我们就把 mpi 安装包的 bin 加到环境变量 PATH 下,使得系统运行的时候能够找得到 mpi_install/bin 文件。 11、保存后执行