最大似然估计学习总结(概率论大作业)

第六章-最大似然估计

第 2 页 共 27 页

第六章 最大似然估计

与非线性回归的情况一样,在 ML 估计中也需要假定参数的可识别性,具体如下:

假定(可识别假定):对参数空间 的任意

,有

其中, 为参数 的真值。

这里需要说明一下,与 LS 估计不同,在 ML 估计的框架中,用于保证估计量性质的约 束条件无法很清晰的划分为几类简单的假定。因此,更常用的做法是直接给出这些约束条件 (正则条件),而不是作为假定提出。我们之所以单独列出可识别假定,是因为它是整个极 值估计的核心假定,且在性质证明中能直接看出。

CRLB 是指任意无偏估计量的方差所能达到的最低水平,计算如下:

(6-8)

以下简单证明 CRLB 的性质。

证明: 已知密度函数

,满足

,其得分函数为 ,则有

。记

的估计量

其中,

注意到,对任意矩阵 得

所以有 当估计量为无偏估计时,即

,存在满秩矩阵 ,则有

,上式可化简为:

。 。

,使

其中,

为

。

证明完毕。

称为

的估计量的 CRLB。当

第六章 最大似然估计

,对应的检验统计量计算如下:

(6-23)

LR 检验统计量: LM 检验统计量:

(6-24)

(6-25)

其中, 和 分别表示无约束和有约束下的 ML 估计, 和 似然函数的估计。

在零假设下,上述的 Wald 检验、LR 检验和 LM 检验都收敛于

个数。

分别表示对应的 ,其中 J 为约束的

考虑线性约束

,Wald 检验统计量可计算如下:

(6-27)

其中,

,

;

残差。

又,有约束的对数似然函数可计算如下:

最大似然估计学习总结(概率论大作业)

最大似然估计学习总结航天学院探测制导与控制技术杨若眉1110420123摘要:最大似然估计是一种统计方法,它用来求一个样本集的相关概率密度函数的参数。

最大似然法明确地使用概率模型,其目标是寻找能够以较高概率产生观察数据的系统发生树。

最大似然法是一类完全基于统计的系统发生树重建方法的代表。

关键词:最大似然估计;离散;连续;概率密度最大似然估计是一种统计方法,它用来求一个样本集的相关概率密度函数的参数。

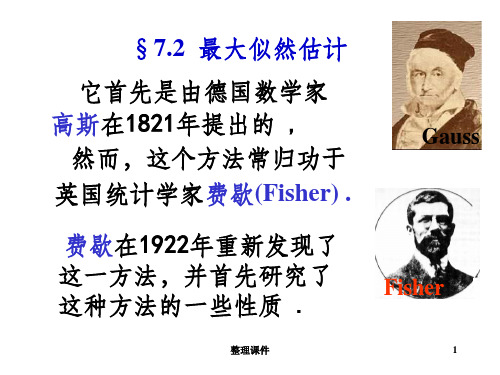

这个方法最早是遗传学家以及统计学家罗纳德·费雪爵士在1912年至1922年间开始使用的。

“似然”是对likelihood 的一种较为贴近文言文的翻译,“似然”用现代的中文来说即“可能性”。

故而,若称之为“最大可能性估计”则更加通俗易懂。

最大似然法明确地使用概率模型,其目标是寻找能够以较高概率产生观察数据的系统发生树。

最大似然法是一类完全基于统计的系统发生树重建方法的代表。

该方法在每组序列比对中考虑了每个核苷酸替换的概率。

最大似然法是要解决这样一个问题:给定一组数据和一个参数待定的模型,如何确定模型的参数,使得这个确定参数后的模型在所有模型中产生已知数据的概率最大。

通俗一点讲,就是在什么情况下最有可能发生已知的事件。

举个例子,假如有一个罐子,里面有黑白两种颜色的球,数目多少不知,两种颜色的比例也不知。

我们想知道罐中白球和黑球的比例,但我们不能把罐中的球全部拿出来数。

现在我们可以每次任意从已经摇匀的罐中拿一个球出来,记录球的颜色,然后把拿出来的球再放回罐中。

这个过程可以重复,我们可以用记录的球的颜色来估计罐中黑白球的比例。

假如在前面的一百次重复记录中,有七十次是白球,请问罐中白球所占的比例最有可能是多少?我想很多人立马有答案:70%。

这个答案是正确的。

可是为什么呢?(常识嘛!这还要问?!)其实,在很多常识的背后,都有相应的理论支持。

在上面的问题中,就有最大似然法的支持例如,转换出现的概率大约是颠换的三倍。

数学之美_深入浅入详解的最(极)大似然估计

数学之美_深⼊浅⼊详解的最(极)⼤似然估计1 第⼀个问题:最⼤似然估计是什么?从分类上来说属于概率论中的点估计⽅式。

2 由Fisher这个⼈才在1912年重新提出,最早提出还是数学王⼦⾼斯。

不过准确的说他属于数理统计的范畴。

3 概率论和数理统计是互逆的思想过程。

概率论可以看成是由因推果,数理统计则是由果溯因。

互为逆思考的过程。

4 正如我们提到的数学,不在于眼花缭乱的公式提炼,⾸先应该每⼀个细节的意义,这个是最终要的。

是精华部分。

5 似然估计(有的教材叫拟然估计)。

就看英⽂名likelihood estimate(LE),⽽likelihood的意思是可能性。

知道⼀个现象,他可能是由什么因引起的。

概念性的解释⼀下:在传统概率学派中假定的是概率分布的参数固定,随机样本。

那么我们该如何谈过样本去确定这个概率分布的参数呢?这⾥就需要⽤到似然估计的⽅法了。

也就是说,样本出现后,反推模型参数值,⽽这个参数值有多种可能性(M,最Max,最⼤的可能性。

最⼤似然估计也叫Max likelihood estimate MLE)。

举个例⼦,假设我们有很多块西⽠⽪,⽠⽪的纹路分为清洗、稍微模糊、模糊,现在我们的⽬的就是通过⽠⽪去推断西⽠的成熟程度(⽠青,⽠烂,⽠熟)。

但是现实⽣活中,我们的关注点⼀般都只希望得到最好的参数(也就是希望当前⽠⽪所对应的西⽠最⼤可能成熟程度),也就是说,我们只希望得到那个使得样本发⽣可能性最⼤的参数,其余低可能性的我们不考虑。

所以通俗来说,最⼤似然 ======>>>最有可能的情况。

6 案例1:加⼊有⼀个管⼦,⾥⾯有⿊⽩两种颜⾊的球,数⽬多少不知道,两种颜⾊⽐例也不知道,我们想知道罐中⽩球和⿊球的⽐例,但我们不能把罐⼦中的球全部拿出来数(球太多了,耽误我玩⼉dota)。

现在我们可以每次任意从已经均摇⼀摇的罐⼦中拿出⼀个球来,记录求的颜⾊,然后把拿出来的球再放回罐⼦中。

这个过程可以重复,我们⽤以记录球的颜⾊来估计罐⼦中的⿊⽩球的⽐例。

最大似然估计学习总结(概率论大作业)

最大似然估计学习总结(概率论大作业)最大似然估计学习总结航天学院探测制导与控制技术杨若眉1110420123摘要:最大似然估计是一种统计方法,它用来求一个样本集的相关概率密度函数的参数。

最大似然法明确地使用概率模型,其目标是寻找能够以较高概率产生观察数据的系统发生树。

最大似然法是一类完全基于统计的系统发生树重建方法的代表。

关键词:最大似然估计;离散;连续;概率密度最大似然估计是一种统计方法,它用来求一个样本集的相关概率密度函数的参数。

这个方法最早是遗传学家以及统计学家罗纳德·费雪爵士在1912年至1922年间开始使用的。

“似然”是对likelihood 的一种较为贴近文言文的翻译,“似然”用现代的中文来说即“可能性”。

故而,若称之为“最大可能性估计”则更加通俗易懂。

最大似然法明确地使用概率模型,其目标是寻找能够以较高概率产生观察数据的系统发生树。

最大似然法是一类完全基于统计的系统发生树重建方法的代表。

该方法在每组序列比对中考虑了每个核苷酸替换的概率。

最大似然法是要解决这样一个问题:给定一组数据和一个参数待定的模型,如何确定模型的参数,使得这个确定参数后的模型在所有模型中产生已知数据的概率最大。

通俗一点讲,就是在什么情况下最有可能发生已知的事件。

举个例子,假如有一个罐子,里面有黑白两种颜色的球,数目多少不知,两种颜色的比例也不知。

我们想知道罐中白球和黑球的比例,但我们不能把罐中的球全部拿出来数。

现在我们可以每次任意从已经摇匀的罐中拿一个球出来,记录球的颜色,然后把拿出来的球再放回罐中。

这个过程可以重复,我们可以用记录的球的颜色来估计罐中黑白球的比例。

假如在前面的一百次重复记录中,有七十次是白球,请问罐中白球所占的比例最有可能是多少?我想很多人立马有答案:70%。

这个答案是正确的。

可是为什么呢?(常识嘛!这还要问?!)其实,在很多常识的背后,都有相应的理论支持。

在上面的问题中,就有最大似然法的支持例如,转换出现的概率大约是颠换的三倍。

最大似然估计(Maximum likelihood estimation)(通过例子理解)

最大似然估计(Maximum likelihood estimation)(通过例子理解)之前看书上的一直不理解到底什么是似然,最后还是查了好几篇文章后才明白,现在我来总结一下吧,要想看懂最大似然估计,首先我们要理解什么是似然,不然对我来说不理解似然,我就一直在困惑最大似然估计到底要求的是个什么东西,而那个未知数θ到底是个什么东西TT似然与概率在统计学中,似然函数(likelihood function,通常简写为likelihood,似然)是一个非常重要的内容,在非正式场合似然和概率(Probability)几乎是一对同义词,但是在统计学中似然和概率却是两个不同的概念。

概率是在特定环境下某件事情发生的可能性,也就是结果没有产生之前依据环境所对应的参数来预测某件事情发生的可能性,比如抛硬币,抛之前我们不知道最后是哪一面朝上,但是根据硬币的性质我们可以推测任何一面朝上的可能性均为50%,这个概率只有在抛硬币之前才是有意义的,抛完硬币后的结果便是确定的;而似然刚好相反,是在确定的结果下去推测产生这个结果的可能环境(参数),还是抛硬币的例子,假设我们随机抛掷一枚硬币1,000次,结果500次人头朝上,500次数字朝上(实际情况一般不会这么理想,这里只是举个例子),我们很容易判断这是一枚标准的硬币,两面朝上的概率均为50%,这个过程就是我们根据结果来判断这个事情本身的性质(参数),也就是似然。

结果和参数相互对应的时候,似然和概率在数值上是相等的,如果用θ 表示环境对应的参数,x 表示结果,那么概率可以表示为:P(x|θ)P(x|θ)是条件概率的表示方法,θ是前置条件,理解为在θ 的前提下,事件 x 发生的概率,相对应的似然可以表示为:理解为已知结果为 x ,参数为θ (似然函数里θ 是变量,这里## 标题 ##说的参数是相对与概率而言的)对应的概率,即:需要说明的是两者在数值上相等,但是意义并不相同,是关于θ 的函数,而 P 则是关于 x 的函数,两者从不同的角度描述一件事情。

2016考研数学概率统计之最大似然估计法分析

2016考研数学概率统计之最大似然估计法分析最大似然估计是概率论与数理统计中参数估计的一种基本方法。

参数估计包括点估计和区间估计,所谓点估计是指采用总体的样本来估计总体分布中的未知参数,点估计有两种基本方法,一个是矩估计,另一个是最大似然估计;最大似然估计是利用样本的联合分布律或联合概率密度来求未知参数的方法,这种方法在考研数学中经常出现,因此大家应该熟练掌握。

下面我们对这种方法做些分析总结,供各位考生参考。

从前面的分析可知,求最大似然估计就是求似然函数或对数似然函数的最大值,求最大值一般是通过求其驻点(即导数或偏导数为0的点)来计算,如果似然函数是未知参数的单调函数,则其最大值在参数的取值区间的端点处取得,如果不是单调函数,则在驻点处取得。

以上分析希望对大家掌握好最大似然估计法有些帮助,最后文都教育的老师衷心祝各位的考研梦想成真!。

深度学习之最大似然估计

深度学习之最⼤似然估计⼀、定义⼆、知识解读 极⼤似然估计,通俗理解来说,就是利⽤已知的样本结果信息,反推最具有可能(最⼤概率)导致这些样本结果出现的模型参数值! 换句话说,极⼤似然估计提供了⼀种给定观察数据来评估模型参数的⽅法,即:“模型已定,参数未知”。

可能有⼩伙伴就要说了,还是有点抽象呀。

我们这样想,⼀当模型满⾜某个分布,它的参数值我通过极⼤似然估计法求出来的话。

⽐如正态分布中公式如下: 如果我通过极⼤似然估计,得到模型中参数和的值,那么这个模型的均值和⽅差以及其它所有的信息我们是不是就知道了呢。

确实是这样的。

极⼤似然估计中采样需满⾜⼀个重要的假设,就是所有的采样都是独⽴同分布的。

下⾯我通过俩个例⼦来帮助理解⼀下最⼤似然估计 但是⾸先看⼀下似然函数的理解: 对于这个函数:输⼊有两个:x表⽰某⼀个具体的数据;表⽰模型的参数 如果是已知确定的,是变量,这个函数叫做概率函数(probability function),它描述对于不同的样本点,其出现概率是多少。

如果是已知确定的,是变量,这个函数叫做似然函数(likelihood function), 它描述对于不同的模型参数,出现这个样本点的概率是多少。

这有点像“⼀菜两吃”的意思。

其实这样的形式我们以前也不是没遇到过。

例如, , 即x的y次⽅。

如果x是已知确定的(例如x=2),这就是 , 这是指数函数。

如果y是已知确定的(例如y=2),这就是,这是⼆次函数。

同⼀个数学形式,从不同的变量⾓度观察,可以有不同的名字。

这么说应该清楚了吧?如果还没讲清楚,别急,下⽂会有具体例⼦。

现在真要先讲讲MLE了。

例⼦⼀ 别⼈博客的⼀个例⼦。

假如有⼀个罐⼦,⾥⾯有⿊⽩两种颜⾊的球,数⽬多少不知,两种颜⾊的⽐例也不知。

我们想知道罐中⽩球和⿊球的⽐例,但我们不能把罐中的球全部拿出来数。

现在我们可以每次任意从已经摇匀的罐中拿⼀个球出来,记录球的颜⾊,然后把拿出来的球再放回罐中。

5.2参数的最大似然估计

当有两个 或两个以上 未知参数 θ1 ,θ 2 ,...,θ k 时, 似然函数为L(θ1 ,θ 2 ,...,θ k ) 若此似然函数在θ1* ,θ 2* ,...,θ k* 达到最大, 则称 θ 为 θ i 的最大似然估计值, 达到最大, 相应的 最大似然估计值,

* i

估计量 称为θi的 最大似然估计量. i = 1, 2,.., k 估计量. 称为θ 最大似然估计量 此时, 一般应满足条件: 此时, 一般应满足条件: θ

e

− nλ

为似然函数. 为似然函数.

( )

(∑ x ) λ = n

n

1

i =1

i

1 n ˆ λ = ∑ xi 为λ的最大似然估计值 的最大似然估计值. n i =1

1 n ˆ λ = ∑ X i 为λ的最大似然估计量 的最大似然估计量. n i =1

3.指数分布 3.指数分布 −λ x λe 设总体 X 服从指数分布 X ~ f ( x ) = 0 为待估参数. λ为待估参数 求参数λ的最大似然估计. 求参数λ的最大似然估计. 解 设样本观测值为 x1 , x2 ,..., xn

= P { X 1= x1} P { X 2 = x2 }... P { X n = xn } 记为 n = p( x1 ;θ ) p( x2 ;θ ) ... p( xn ;θ ) = ∏ p( xi ;θ ) = L( θ )

i =1

P { X 1= x1 , X 2 = x2 , ..., X n = xn }

i =1 n

P { X 1= x1 , X 2 = x2 , ..., X n = Fra bibliotekn }或

f ( x1 ;θ1 ,θ 2 ,...,θ k ) f ( x2 ;θ1 ,θ 2 ,...,θ k ) ... f ( xn ;θ1 ,θ 2 ,...,θ k )

5.2参数的最大似然估计

0 X ~ 1 p

10次摸球得到样本值 ( 1, 0, 1, 0, 0, 0,1, 0,0,0 ) 的概率

为 L( p) p (1 p) , 即求 L( p ) 的最大值点.

L'( p ) 3 p 2 (1 p)7 p 37(1 p)6 p 2(1 p)6 3(1 p) 7 p

即一次抽样, 得样本观测值为

..., x10 0 x1 1, x2 0,x3 1,

10 1 p的最大似然估计值为 p ˆ xi 0.3 10 i 1

2.泊松分布 k e , k 0,1,2,3,... 设总体 X ~ P ( ), P X k k! x 即 P X x e , x 0,1,2,3,..., λ 为待估参数.

d ln L( ) 0 2.写出似然方程 d

并判断驻点是否为 3.求解似然方程 得到驻点,

最大值点.

几种常见分布的最大似然估计量 1.0—1分布

1 0 p 为待估参数. , 设总体 X ~ 1 p p 1 P X 1 p p (1 p ) 0 0 1 p P X 0 1 p (1 p)

p x1 (1 p)1 x1 p x2 (1 p )1 x2 ... p xn (1 p)1 xn

p x x ... x (1 p ) n ( x x ... x ) 为似然函数.

1 2 n 1 2 n

L( p )

p x x ... x (1 p ) n ( x x ... x ) 为似然函数.

x!

设样本观测值为 x1 , x2 ,..., xn

L( ) P X 1 x1 , X 2 x2 , ..., X n xn

概率论教学实践报告总结(3篇)

第1篇一、前言概率论是数学的一个重要分支,它研究随机现象及其规律。

随着我国教育事业的不断发展,概率论在教学中的地位日益重要。

为了提高教学质量,探索有效的教学策略,我们开展了一系列概率论教学实践活动。

现将本次实践活动的总结如下:二、实践目的1. 提高学生对概率论知识的掌握程度,培养学生的逻辑思维能力。

2. 探索适合我国学生特点的概率论教学方法,提高课堂教学效果。

3. 加强师生互动,培养学生的自主学习能力。

4. 丰富教师的教学经验,提高教师的专业素养。

三、实践内容1. 教学方法改革(1)启发式教学:教师在课堂上注重引导学生思考,通过提问、讨论等方式,激发学生的学习兴趣,提高学生的思维能力。

(2)案例教学:结合实际生活中的例子,让学生理解概率论知识在实际中的应用,提高学生的实践能力。

(3)小组合作学习:将学生分成若干小组,共同完成教学任务,培养学生的团队协作能力。

2. 教学手段创新(1)多媒体教学:利用PPT、视频等多媒体手段,使教学内容更加生动形象,提高学生的学习兴趣。

(2)网络教学:通过在线课程、论坛等网络平台,拓宽学生的学习渠道,提高学生的学习效果。

(3)实验教学:开展概率实验,让学生亲身体验概率现象,加深对概率论知识的理解。

3. 教学评价改革(1)过程性评价:关注学生在学习过程中的表现,如课堂发言、作业完成情况等。

(2)结果性评价:关注学生对知识掌握程度,如期中、期末考试等。

(3)多元评价:结合学生自评、互评、教师评价等多种方式,全面评价学生的学习成果。

四、实践效果1. 学生对概率论知识的掌握程度有了明显提高,课堂参与度显著提升。

2. 学生在解决实际问题时,能够运用概率论知识进行分析,提高了解决问题的能力。

3. 学生在团队协作、自主学习等方面取得了较好成绩,综合素质得到提高。

4. 教师的教学经验得到了丰富,教学水平得到提高。

五、存在问题及改进措施1. 存在问题(1)部分学生对概率论知识缺乏兴趣,学习积极性不高。

概率与数理统计极大似然估计详细讲解及例题

P(Y=3) 0.343 0.027

估计

估计

应如何估计p? p=0.7 或 p=0.3

P (Y

k)

3 k

pk

(1

p)3k

k=0,1,2,3

如果有p1,p2,…,pm可供选择, 又如何合理地 选p呢?

若重复进行试验n次,结果“1”出现k次 (0 ≤ k≤ n), 我们计算一切可能的

P(Y=k; pi )=Qi , i=1,2,…,m 从中选取使Qi 最大的pi 作为p的估计.

i

n 1

(

xi

)

0,

min xi

其它

对 min xi , L( , ) 0, 且是 的增函数

取其它值时,L( , ) 0.

故使 L( , ) 达到最大的 , 即 的MLE,

是

*

min

1in

xi

即 *, 为* , 的MLE .

于是

*

1 n

n i 1

xi

*

如果要你推测, 是谁打中的呢? 你会如何想呢?

你就会想,只发一枪便打中,猎人命中的 概率一般大于这位同学命中的概率. 看来这 一枪是猎人射中的 .

这个例子所作的推断已经体现了极大似 然法的基本思想 .

下面我们再看一个例子,进一步体会极 大似然法的基本思想 .

例4 设X~B(1,p), p未知.设想我们事先知

极大似然估计

二、寻求估计量的方法

1. 矩估计法 2. 极大似然法 3. 最小二乘法 4. 贝叶斯方法 …… 这里我们主要介绍第二两种方法 .

2. 极大似然法

是在总体类型已知条件下使用的一种 参数估计方法 .

极大似然法的基本思想 先看一个简单例子:

概率论与数理统计第七章最大似然估计

最大似然法的基本思想 先看一个简单例子: 某位同学与一位猎人一 起外出打猎 . 一只野兔从前方窜过 . 只听一声枪响,野兔应声倒下 .

如果要你推测, 是谁打中的呢? 你会如何想呢?

整理课件

3

因为只发一枪便打中,猎人命中的概率 一般大于这位同学命中的概率. 看来这一 枪是猎人射中的 . 其数学模型为

,ax(1),bx(n);

0 , 其它

似然函数a 越大, b 越小, L 越大.

整理课件

33

取 aˆx(1), bˆx(n)

则对满足 ax(1) x(n) b的一切a,b, 都有

1

1

(ba)n

(x(n)

x(1))n

故

aˆx(1), bˆx(n)

是 a , b 的最大似然估计值.

整理课件

34

例7 设总体X的概率分布为

随 机 点 (X1, ,Xn)落 在 (x1, ,xn)的 邻 域 ( 边 长 分

别 为 dx1, ,dxn的 n维 立 方 体 ) 内 的 概 率 近 似 为 : n

f(xi;)dxi

i1

整理课件

14

取 的 估 计 值 ˆ , 使 上 式 概 率 取 到 最 大 值 。

但 d x i不 随 而 变 , 故 只 需 考 虑 :

x1

x2

e e

x1! x2!

xn

e xn!

整理课件

20

对数似然函数为:

n

n

l() ln L () x iln () n ln ( x i!)

i 1

令

i 1

dl() 1 n

dp

i1

xi

n

=0

得 的最大似然估计为

最大似然估计

n

p( xi , )

L( ) i1

n

f

(

xi ,

)

i 1

X是离散型随机变量 X是连续型随机变量

2.写出似然方程

d L( ) 0 d

或

d ln L( ) d

1

L( )

d

L( ) d

0

3.求解似然方程

得到驻点, 并判断驻点是否为

最大值点.

几种常见分布的 最大似然估计量

1.0—1分布

设总体

X

~

设其密度函数为

X ~ f ( x; )

其中θ是待估参数,

记

n

L(

)

f

(

x1;

)

f

(

x2;

) ...

f

(

xn;

)

i 1

f

(

xi ;

)

为待估参数θ的函数,

它的大小反映了

( X1, X2 ,..., Xn ) 落在 ( x1, x2 ,..., xn ) 附近的概率的大小.

L( ) 称为似然函数.

若 L( ) 在 ˆ处达到最大值,

记为

p( x1;

) p(

x2;

)... p(

xn;

)

i 1

p(

xi ;

)

L(

)

L( )为待估参数θ的函数,

称为似然函数.

若 L( )在 ˆ处达到最大值,

则称 为ˆ参数 的 最大

似然估计值. 相应的估计量 ˆ( X1, X2,..., Xn ) 称为θ

的最大似然估计量.

统称为θ的 最大似然估计.

当 X是 连续型随机变量时,

2

什么是概率论中的最大似然估计?

什么是概率论中的最⼤似然估计?什么是参数?在机器学习中,我们经常使⽤⼀个模型来描述所观察到的数据产⽣的过程。

例如,我们可以使⽤⼀个随机森林模型来分类客户是否会取消订阅服务(称为流失建模),或者我们可以⽤线性模型根据公司的⼴告⽀出来预测公司的收⼊(这是⼀个线性回归的例⼦)。

每个模型都包含⾃⼰的⼀组参数,这些参数最终定义了模型的样⼦。

我们可以把线性模型写成y = mx + c的形式。

在⼴告预测收⼊的例⼦中,x 可以表⽰⼴告⽀出,y 是产⽣的收⼊。

m 和 c 则是这个模型的参数。

这些参数的不同值将在坐标平⾯上给出不同的直线(见下图)。

参数值不同的三个线性模型。

因此,参数为模型定义了⼀个蓝图。

只有将参数选定为特定值时,才会给出⼀个描述给定现象的模型实例。

最⼤似然估计的直观解释最⼤似然估计是⼀种确定模型参数值的⽅法。

确定参数值的过程,是要找到能够最⼤化模型产⽣真实观察到的数据的可能性的那⼀组参数。

上述的定义可能听起来还是有点模糊,那么让我们通过⼀个例⼦来帮助理解这⼀点。

假设我们从某个过程中观察了 10 个数据点。

例如,每个数据点可以代表⼀个学⽣回答特定考试问题的时间长度(以秒为单位)。

这 10 个数据点如下图所⽰我们观察到的 10 个(假设的)数据点我们⾸先要决定我们认为哪个模型最适合描述⽣成数据的过程。

这⼀部⾄关重要。

⾄少,我们应该对使⽤哪种模型有⼀个不错的想法。

这个判断通常来⾃于⼀些领域内专家,但我们不在这⾥讨论这个问题。

对于这些数据,我们假设数据⽣成过程可以⽤⾼斯分布(正态分布)进⾏充分描述。

对以上数字⽬测⼀番就可以得知,⾼斯分布是合理的,因为这 10 个点的⼤部分都集中在中间,⽽左边和右边的点都很少。

(对只使⽤ 10 个数据点的做出这样的草率决定是不明智的,但考虑到我⽣成了这些数据点,我们就凑合着⽤吧)。

回想⼀下⾼斯分布有两个参数:均值µ和标准差σ。

这些参数的不同值会对应不同的曲线(就像上⾯的直线⼀样)。

概率论与数理统计7.1点估计与最大似然估计

得其寿命数据如下:

110,184,145,122,165,143,78,129,62,130,168

(1)用矩估计法估计λ的值;(2)求总体的平均寿命

解:(1)、X 1 (110 184 168) 130.55 11

总体期望E(X) 1 ,令X 1 , 得= 1 = 1 =0.0077

,k ,

再利用总体 X 分布已知, 具体求出 E(X r ),

当然它是未知参数 1 ,2 , ,k 的函数, 这样

就得到含 k 个未知数和 k 个方程的方程组 ,

解方程组即得

1 = 1 ( X1 , X2 ,

k = k ( X1 , X2 ,

, Xn), , Xn),

这就是1 ,2 , ,k 的矩估计量 .

X 130.55

(2) : E( X ) 1 130.55 0.0077

三、最大似然估计:

1、设总体X为连续型随机变量,其密度函数为f(x, θ) 求(1):样本的联合密度;

(2):θ的估计值。 n

解:(1)f(x1 , x2 , , xn, ) = f (xi , ),(Xi相互独立) i 1 (2)根据经验一次试验中概率大的事件比概率小 的事件容易发生。在已经得到试验结果的情况下, 应该寻求使这个结果出现的可能性最大的估计值作 为总体参数的估计值。

令

1 , Xi = 0 ,

第 i 次是次品 第 i 次是合格品

则 P{Xi = 1} = p , P{Xi = 0} = 1 p .

若 10 次试验的结果是样本观测值

(x1 , x2 , … , xn) = (1, 0, 1, 0, 0, 0, 1, 0, 0, 0) ,

则有 P{X1 = 1, X2 = 0, X3 = 1, X4 = X5 = X6 = 0, X7 = 1, X8 = X9 = X10 = 0 }

概率论第十九讲极大似然估计法

i1

i1

而

1

n

2

ci

n

ci2 2

cic ji1 i1 Nhomakorabea1i jn

n

n

ci2 (ci2 c2j ) n ci2

i 1

1i jn

i 1

n

i1

ci2

1 n

D(ˆ )

1 n

2

D(ˆ1)

结论 算术均值比加权均值更有效.

例如 X ~ N( , 2 ) , ( X 1 ,X 2 ) 是一样本.

X

)2

Sn2

极大似然估计方法

1) 写出似然函数 L

2)求出 ˆ1,ˆ2,,ˆk , 使得

L(x1, x2,, xn;ˆ1,ˆ2,,ˆk )

(1

max

,2 ,,k

{L(

)

x1,

x2

,,

xn

;1,

2

,,

k

)}

若 L是 1, ,k的可微函数,解似然方程组

r

L( x1 ,

x2 ,,

xn;1,2,,k ) 0

极大似然估计法

思想方法:一次试验就出现的 事件有较大的概率

例如: 有两外形相同的箱子,各装100个球 一箱 99个白球 1 个红球 一箱 1 个白球 99个红球

现从两箱中任取一箱, 并从箱中任取一球, 结果所取得的球是白球. 问: 所取的球来自哪一箱? 答: 第一箱.

例6 设总体 X 服从0-1分布,且P (X = 1) = p, 用极大似然法求 p 的估计值.

FZ (z) 1 P(X1 z, X2 z,, Xn z)

1 P(X1 z)P(X2 z)P(Xn z)

1

n i 1

最大似然估计法

2、有效性

设ˆ1,ˆ2 是θ的两个无偏估计量,若

D(ˆ1) D(ˆ 2 )

则称

ˆ 1比ˆ

更有效。

2

因为:设Eˆ1 Eˆ2 , 则 Dˆ1 E(ˆ1 Eˆ1 )2 E(ˆ1 )2 Dˆ2 E(ˆ2 Eˆ2 )2 E(ˆ2 )2

若Dˆ1 Dˆ2 , 则E(ˆ1 )2 E(ˆ2 )2 因此ˆ1比ˆ2有效。

i 1

n

n ln X i ,

i 1

即为θ的最大似然估计值。 即为θ的最大似然估计量。

例 设总体 X ~N( μ ,σ 2) , μ ,σ 2未知 . x1, , xn 是来自 X 的样本值 , 试求 μ ,σ2的最大似然估计量 .

解 X 的概率密度为

f (x)

1

( x )2

e , 2 2

解:总体X的概率密度函数为:

f

( x, )

e

x,

x

0

0, x 0

① 似然函数为: n

n

n

xi

L( )

f (xi ,)

e e xi n

i 1

i 1

i 1

② 取对数

n

ln L( ) n ln xi i 1

③

d l n L( ) n n

d

i1 xi 0

1 n

2

x

似然函数为

n

L( μ,σ 2 )

i 1

1

e

(

xi μ 2σ2

)2

2πσ

n

L( μ,σ 2 )

i 1

1

e

(

xi μ 2σ2

)2

2πσ

2

n/ 2 (

) e 2 2 / n

概率与数理统计 第七章-1-最大似然估计

定义 对给定的样本值x1 , x2 ,… , xn, 若

存在: qˆ qˆ(x1, x2,L , xn) 使

L(qˆ) max L(q ).

参数q的 取值范围。

q

则称qˆ qˆ(x1, x2,L , xn)为q的最大似然估计值;

定义 对给定的样本值x1 , x2 ,… , xn, 若

存在: qˆ qˆ(x1, x2,L , xn) 使

)

0

求出驻点;

2.

由

dL(q dq

)

0

或

d

ln L(q dq

)

0

求出驻点;

3. 判断并求出最大值点:

qˆ qˆ(x1, x2,L , xn)

即为参数q的最大似然估计值;

qˆ qˆ(X1, X2,L , Xn)

为参数q的最大似然估计量 .

需要注意:

需要注意: ① 当似然函数对未知参数q不可微或由

最大似然估计法的思想:

在一次抽样得到结果x1, x2,…, xn的情 况下, 一般认为这个结果出现的概率:

P{X1= x1, X2 =x2 ,…, Xn = xn} 是最大的。

因此,应该寻找使这个结果出现的可

能性最大的那个qˆ 作为真值q的估计.

下面分别就离散型总体和连续型总体 情形作具体讨论.

设X1, X2,…, Xn是取自总体X的样本, 样本的观察值为x1 , x2 ,… , xn(一次抽样得 到结果) ,其概率为:

概率论与数理统计

张保田 第七章 参数估计

第一节 点估计 二、 最大似然估计法

极大似然法是在总体类型已知条件 下使用的一种参数估计方法 .

它首先是由德国数学家 高斯在1821年提出的 , 然而,这个方法常归功于 英国统计学家费歇 .

概率论与数理统计-第6章-第2讲-最大似然估计法

解 X 的分布律为: P( X k) p(1 p)k1, k 1,2,

n

故似然函数为 L( p)

n

p(1

p) xi 1

pn (1

xi n p) i1 ,

i 1

n

令

d

ln L( p)

n

xi n

i 1

0.

dp

p 1 p

如何求EX 的

最大似然估计?

解得 p的最大似然估计

pˆ

n

n

xi

f

(xi )

( x1 x2

n

xn ) 1

,

xi 1

n

ln L( ) n ln ( 1)ln xi i 1

d

ln L( ) d

n

n i 1

ln

xi

0

解得

n

n

的最大似然估计 ˆ n n .

ln xi

ln X i

i 1

i 1

02 典型例题

例 设X ~ G( p), x1, , xn是来自X 的一个样本值, 试求参数p与EX 的最大似然估计.

我们先来看一个实例

2

第2讲 最大似然估计法

例 ——生活经验:

黑球白球9:1,不知哪种多?有放回抽三次,两次白球,一次黑球.

哪种多?

白ห้องสมุดไป่ตู้多!

原理: 一次试验就出现的事件有较大的概率

这种选择一个参数使得实验结果具有最大概率的思想就是最大似 然法的基本思想 .

方法

0.9? 0.1?

最大

L( ) P(X1 1, X2 0, X3 1)

大似然原则来求.

L( ) 无驻点

不可导

7

最大似然估计

1 n Xi n i 1 所以 n 1 X 2 2 2 2 2 i n i 1

解得参数θ和μ的矩估计量为

n 1 ˆ S n n 1 ˆX , S n

⑵ 设x1, x2, …, xn是X1, X2, …, Xn的样本值,则 似然函数为

7

例4 对某种型号飞机的飞行速度进行15次试验, 测 得最大飞行速度(单位: 米/秒)为422.2, 417.2, 425.6

420.3, 425.8, 423.1, 418.7, 438.3, 434.0, 412.3, 431.5 413.5, 441.3, 423.0, 428.2, 根据长期经验, 可以认为 最大飞行速度服从正态分布. 求飞机最大飞行速度 的期望值的置信水平为 0.95 的置信区间。

2 2 ( n 1) S ( n 1) S , 2 置信区间 2 (n 1) 1 (n 1) 2 2 2 Nhomakorabea2

标准差σ的一个置信水平为 1 的置信区间

2 (n 1) S , 2 (n 1) 2 (n 1) S 2 1 (n 1) 2

的,称为置信概率,置信度或置信水平。 习惯上把置信水平记作 1 ,这里 是一个 很小的正数.

一 、置信区 间 定义1 设总体 X 的分布函数为 F ( x ; ),其中 含一待估参数 ; 对于样本 X 1 ,, X n , 找出统计量

( X 1 ,, X n ) , ( X 1,, X n ) ,

一 、置信区间

二 、正态总体均值与方差的区间估计 三 、两个正态总体均值与方差 的区间估计

例如,在估计湖中鱼数的问题中,若我们 根据一个实际样本,得到鱼数 N 的最大似然 估计值为1000条.

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

最大似然估计学习总结

航天学院探测制导与控制技术杨若眉1110420123

摘要:最大似然估计是一种统计方法,它用来求一个样本集的相关概率密度函数的参数。

最大似然法明确地使用概率模型,其目标是寻找能够以较高概率产生观察数据的系统发生树。

最大似然法是一类完全基于统计的系统发生树重建方法的代表。

关键词:最大似然估计;离散;连续;概率密度

最大似然估计是一种统计方法,它用来求一个样本集的相关概率密度函数的参数。

这个方法最早是遗传学家以及统计学家罗纳德·费雪爵士在1912年至1922年间开始使用的。

“似然”是对likelihood 的一种较为贴近文言文的翻译,“似然”用现代的中文来说即“可能性”。

故而,若称之为“最大可能性估计”则更加通俗易懂。

最大似然法明确地使用概率模型,其目标是寻找能够以较高概率产生观察数据的系统发生树。

最大似然法是一类完全基于统计的系统发生树重建方法的代表。

该方法在每组序列比对中考虑了每个核苷酸替换的概率。

最大似然法是要解决这样一个问题:给定一组数据和一个参数待定的模型,如何确定模型的参数,使得这个确定参数后的模型在所有模型中产生已知数据的概率最大。

通俗一点讲,就是在什么情况下最有可能发生已知的事件。

举个例子,假如有一个罐子,里面有黑白两种颜色的球,数目多少不知,两种颜色的比例也不知。

我们想知道罐中白球和黑球的比例,但我们不能把罐中的球全部拿出来数。

现在我们可以每次任意从已经摇匀的罐中拿一个球出来,记录球的颜色,然后把拿出来的球再放回罐中。

这个过程可以重复,我们可以用记录的球的颜色来估计罐中黑白球的比例。

假如在前面的一百次重复记录中,有七十次是白球,请问罐中白球所占的比例最有可能是多少?

我想很多人立马有答案:70%。

这个答案是正确的。

可是为什么呢?(常识嘛!这还要问?!)其实,在很多常识的背后,都有相应的理论支持。

在上面的问题中,就有最大似然法的支持例如,转换出现的概率大约是颠换的三倍。

在一个三条序列的比对中,如果发现其中有一列为一个C,一个T和一个G,我们有理由认为,C和T所在的序列之间的关系很有可能更接近。

由于被研究序列的共同祖先序列是未知的,概率的计算变得复杂;又由于可

能在一个位点或多个位点发生多次替换,并且不是所有的位点都是相互独立,概率计算的复杂度进一步加大。

尽管如此,还是能用客观标准来计算每个位点的概率,计算表示序列关系的每棵可能的树的概率。

然后,根据定义,概率总和最大的那棵树最有可能是反映真实情况的系统发生树。

最大似然估计的原理

给定一个概率分布D ,假定其概率密度函数(连续分布)或概率聚集函数(离散分布)为f D ,以及一个分布参数θ,我们可以从这个分布中抽出一个具有n 个值的采样,通过利用f D ,我们就能计算出其概率:

但是,我们可能不知道θ的值,尽管我们知道这些采样数据来自于分布D 。

那么我们如何才能估计出θ呢?一个自然的想法是从这个分布中抽出一个具有n 个值的采样X 1 ,X 2 ,...,X n ,然后用这些采样数据来估计θ.

一旦我们获得,我们就能从中找到一个关于θ的估计。

最大似然估计会寻找关于θ的最可能的值(即,在所有可能的θ取值中,寻找一个值使这个采样的“可能性”最大化)。

这种方法正好同一些其他的估计方法不同,如θ的非偏估计,非偏估计未必会输出一个最可能的值,而是会输出一个既不高估也不低估的θ值。

要在数学上实现最大似然估计法,我们首先要定义可能性:

并且在θ的所有取值上,使这个[[函数最大化。

这个使可能性最大的值即被称为θ的最大似然估计。

注意

这里的可能性是指不变时,关于θ的一个函数。

最大似然估计函数不一定是惟一的,甚至不一定存在。

1. 作用

在已知试验结果(即是样本)的情况下,用来估计满足这些样本分布的参数,把可能性最大的那个参数作为真实的参数估计。

2. 离散型

设为离散型随机变量,为多维参数向量,如果随机变量相互独

立且概率计算式为P{,则可得概率函数为

P{}=,在固定时,上式表示

的概率;当已知的时候,它又变成

的函数,可以把它记为,称此函数为似然函数。

似然函数值的大小意味着该样本值出现的可能性的大小,既然已经得到了样本值

,那么它出现的可能性应该是较大的,即似然函数的值也应该是比较大的,因而最大似然估计就是选择使达到最大值的那个作为真实的估计。

3. 连续型

设为连续型随机变量,其概率密度函数为,为从该总体中抽出的样本,同样的如果相互独立且同分布,于是样本的联合概率密度为。

大致过程同离散型一样。

4. 关于概率密度(PDF)

我们来考虑个简单的情况(m=k=1),即是参数和样本都为1的情况。

假设进行一个实验,实验次数定为10次,每次实验成功率为0.2,那么不成功的概率为0.8,用y来表示成功的次数。

由于前后的实验是相互独立的,所以可以计算得到成功的次数的概率密度为:

=其中y

由于y的取值范围已定,而且也为已知,所以图1显示了y取不同值时的概率分布情况,而图2显示了当时的y值概率情况。

图1 时概率分布图

图2 时概率分布图

那么在[0,1]之间变化而形成的概率密度函数的集合就形成了一个模型。

5. 最大似然估计的求法

由上面的介绍可以知道,对于图1这种情况y=2是最有可能发生的事件。

但是在现实中我们还会面临另外一种情况:我们已经知道了一系列的观察值和一个感兴趣的模型,现在需要找出是哪个PDF(具体来说参数为多少时)产生出来的这些观察值。

要解决这个问题,就需要用到参数估计的方法,在最大似然估计法中,我们对调PDF中数据向量和参数向量的角色,于是可以得到似然函数的定义为:

该函数可以理解为,在给定了样本值的情况下,关于参数向量取值情况的函数。

还是以上面的简单实验情况为例,若此时给定y为7,那么可以得到关于的似然函数为:

继续回顾前面所讲,图1,2是在给定的情况下,样本向量y取值概率的分布情况;而图3是图1,2横纵坐标轴相交换而成,它所描述的似然函数图则指出在给定样本向量y的情况下,符合该取值样本分布的各种参数向量的可能性。

若相比于,使得y=7出现的可能性要高,那么理所当然的要比更加接近于真正的估计参数。

所以求的极大似然估计就归结为求似然函数的最大值点。

那么取何值时似然函数最大,这就需要用到高等数学中求导的概念,如果是多维参数向量那么就是求偏导。

图3 的似然函数分布图

主要注意的是多数情况下,直接对变量进行求导反而会使得计算式子更加的复杂,此时可以借用对数函数。

由于对数函数是单调增函数,所以与

具有相同的最大值点,而在许多情况下,求的最大值点比较简单。

于是,我们将求

的最大值点改为求的最大值点。

若该似然函数的导数存在,那么对关于参数向量的各个参数求导数(当前情况向量维数为1),并命其等于零,得到方程组:

可以求得时似然函数有极值,为了进一步判断该点位最大值而不是最小值,可以继续求二阶导来判断函数的凹凸性,如果的二阶导为负数那么即是最大值,这里再不细说。

还要指出,若函数关于的导数不存在,我们就无法得到似然方程组,这时就必须用其它的方法来求最大似然估计值,例如用有界函数的增减性去求的最大值点

6. 总结

最大似然估计,只是一种概率论在统计学的应用,它是参数估计的方法之一。

说的是已知某个随机样本满足某种概率分布,但是其中具体的参数不清楚,参数估计就是通过若干次试验,观察其结果,利用结果推出参数的大概值。

最大似然估计是建立在这样的思想上:已知某个

参数能使这个样本出现的概率最大,我们当然不会再去选择其他小概率的样本,所以干脆就把这个参数作为估计的真实值。

求最大似然函数估计值的一般步骤:

(1)写出似然函数

(2)对似然函数取对数,并整理

(3)求导数

(4)解似然方程

对于最大似然估计方法的应用,需要结合特定的环境,因为它需要你提供样本的已知模型进而来估算参数,例如在模式识别中,我们可以规定目标符合高斯模型。