第六章 聚类分析

六章聚类分析-PPT精选

一 它般们地之,间若的记距配离合可的 定变义量为数为m1,不配合的变量数为m2,则

故按此定义,本例中xd与12y之m间1m的2距m2离为2/3。

14

二、相似系数

变量之间的相似性度量,在一些应用中要看相似系 数的大小,而在另一些应用中要看相似系数绝对值 的大小。

2

相似性的不同定义

3

§6.2 距离和相似系数

相似性度量:距离和相似系数。 样品之间的距离和相似系数有着各种不同的定义,而这些定

义与变量的类型有着非常密切的关系。 变量的测量尺度:间隔、有序和名义尺度。 间隔变量:变量用连续的量来表示,如长度、重量、速度、

温度等。 有序变量:变量度量时不用明确的数量表示,而是用等级来

图6.3.4 最长距离法树形图

35

异常值的影响

最长距离法容易被异常值严重地扭曲。

36

例6.3.2 对305名女中学生测量八个体型指标:

表6.3.5

x1:身高

x5:体重

x2:手臂长

x6:颈围

x3:上肢长

x7:胸围

x4:下肢长

x8:胸宽

各对变量之间的相关系数

x1

x2

x3

x4

x5

x6

x7

x1

1.000

dij

iGK,jGL

图6.3.6 类平均法

39

递推公式:

1

1

DMJ

nM nJ

dij

iGM , jGJ

nM nJ

dij

iGK , jGJ

聚类分析_精品文档

1聚类分析内涵1.1聚类分析定义聚类分析(Cluste.Analysis)是一组将研究对象分为相对同质的群组(clusters)的统计分析技术.也叫分类分析(classificatio.analysis)或数值分类(numerica.taxonomy), 它是研究(样品或指标)分类问题的一种多元统计方法, 所谓类, 通俗地说, 就是指相似元素的集合。

聚类分析有关变量类型:定类变量,定量(离散和连续)变量聚类分析的原则是同一类中的个体有较大的相似性, 不同类中的个体差异很大。

1.2聚类分析分类聚类分析的功能是建立一种分类方法, 它将一批样品或变量, 按照它们在性质上的亲疏、相似程度进行分类.聚类分析的内容十分丰富, 按其聚类的方法可分为以下几种:(1)系统聚类法: 开始每个对象自成一类, 然后每次将最相似的两类合并, 合并后重新计算新类与其他类的距离或相近性测度. 这一过程一直继续直到所有对象归为一类为止. 并类的过程可用一张谱系聚类图描述.(2)调优法(动态聚类法): 首先对n个对象初步分类, 然后根据分类的损失函数尽可能小的原则对其进行调整, 直到分类合理为止.(3)最优分割法(有序样品聚类法): 开始将所有样品看成一类, 然后根据某种最优准则将它们分割为二类、三类, 一直分割到所需的K类为止. 这种方法适用于有序样品的分类问题, 也称为有序样品的聚类法.(4)模糊聚类法: 利用模糊集理论来处理分类问题, 它对经济领域中具有模糊特征的两态数据或多态数据具有明显的分类效果.(5)图论聚类法: 利用图论中最小支撑树的概念来处理分类问题, 创造了独具风格的方法.(6)聚类预报法:利用聚类方法处理预报问题, 在多元统计分析中, 可用来作预报的方法很多, 如回归分析和判别分析. 但对一些异常数据, 如气象中的灾害性天气的预报, 使用回归分析或判别分析处理的效果都不好, 而聚类预报弥补了这一不足, 这是一个值得重视的方法。

第六章 地理系统的聚类分析

G4 G5

0 0.862

0

上一页

下一页

返回目录

第六章 地理系统的聚类分析

退出

§2 主 要 聚 类 方 法

二、聚类形成的方法-最短距离法

3.在D(2)中,选出距离系数最小的,即d45=0.862, 将G4和G5合并成新类G8,记为G8={G4,G5},并记入 联结表中。

计算G8与其它各类之间的距离。

m

m

xi2k

x

2 jk

k 1

k 1

式个上中地一页:点i和和第j代j个表地两下点个一的地页第点k(个样地品理返)指回,目标x录值ik,x。jk分别代退表出第

第六章 地理系统的聚类分析

§1 聚类分析的基本思想

三、分类统计量-夹角余弦

相似系数矩阵

c os11 cos21

c os n1

性质:

联结表

联结顺序

1 2 3 4

新类

联结法 类别

距离系数

G6

G1、G2

0.043

G7

G3、G1、G2

0.723

G8

G4、G5

0.862

G9 G3、G1、G2、 G4、G5 1.442

第上一页步

第下二一页步

返第回三目步录

第六章 地理系统的聚类分析

第退四出步

§2 主 要 聚 类 方 法

二、聚类形成的方法-最短距离法

三、分类统计量-夹角余弦

二维: 三维:

n 维:

cos

xi1x j1 xi2 x j2

( xi21

xi22

)(

x

2 j1

x

2 j2

)

cos

xi1x j1 xi2 x j2 xi3 x j3

《SPSS数据分析与应用》第6章聚类分析

《SPSS数据分析与应用》第6章聚类分析聚类分析是一种数据挖掘技术,用于将一组数据中的对象进行分类或分组。

其主要目标是将相似的对象放在同一组中,而将不相似的对象放在不同的组中,以便研究者能够更好地理解数据的结构和特征。

在《SPSS数据分析与应用》第6章中,聚类分析被详细地介绍了。

该章节主要包括以下内容:聚类分析的基本概念、聚类分析的步骤、聚类分析的常见算法以及聚类分析的应用。

聚类分析的基本概念是指将一组数据中的对象根据其相似性进行分组的过程。

相似性可以通过计算对象之间的距离或相似性度量来确定。

距离可以是欧氏距离、曼哈顿距离、切比雪夫距离等,而相似性度量可以是相关系数、余弦相似度等。

聚类分析的步骤包括:选择变量、选择聚类算法、设置聚类分析选项、运行聚类分析、解释和评估聚类结果。

其中,选择变量是指从原始数据中选择要参与聚类的变量;选择聚类算法是指选择适合研究问题的聚类算法,常见的有层次聚类、K均值聚类等;设置聚类分析选项是指设置聚类分析的参数,如距离度量、聚类方法等;运行聚类分析是指将设置好的聚类分析选项应用到原始数据中进行聚类分析;解释和评估聚类结果是指根据聚类分析的结果,对不同的聚类进行解释和评估。

聚类分析的常见算法有层次聚类和K均值聚类。

层次聚类是一种通过生成层次树状结构将数据分成不同的聚类的方法。

它可以分为凝聚法和分立法两种,其中凝聚法是自下而上的将对象进行合并,而分立法则是自上而下的将对象进行分割。

K均值聚类是一种迭代的聚类算法,它将数据划分为K个聚类,每个聚类中的对象与其他聚类中的对象的差异最小。

聚类分析的应用非常广泛,它可以用于市场分割、群体分析、图像分析等领域。

在市场分割中,聚类分析可以根据消费者的属性和行为将市场细分为不同的目标市场,以便企业能够更好地满足不同目标市场的需求;在群体分析中,聚类分析可以将相似的个体划分为同一个群体,以便研究者能够更好地理解不同群体的特征和行为规律;在图像分析中,聚类分析可以将图像中的像素根据其颜色和亮度进行分组,以便研究者能够更好地理解图像的结构和特征。

聚类分析

算法

聚类分析是数据挖掘中的一个很活跃的研究领域,并提出了许多聚类算法。传统的聚类算法可以被分为五类: 划分方法、层次方法、基于密度方法、基于格方法和基于模型方法。

1划分方法(PAM:PArtitioning method)首先创建k个划分,k为要创建的划分个数;然后利用一个循环定位 技术通过将对象从一个划分移到另一个划分来帮助改善划分质量。典型的划分方法包括:

k-means,k-medoids,CLARA(Clustering LARge Application), CLARANS(Clustering Large Application based upon RANdomized Search). FCM 2层次方法(hierarchical method)创建一个层次以分解给定的数据集。该方法可以分为自上而下(分解) 和自下而上(合并)两种操作方式。为弥补分解与合并的不足,层次合 并经常要与其它聚类方法相结合,如循环定位。典型的这类方法包括: BIRCH(Balanced Iterative Reducing and Clustering using Hierarchies)方法,它首先利用进行优化。

主要步骤

1.数据预处理,

2.为衡量数据点间的相似度定义一个距离函数,

3.聚类或分组,

4.评估输出。

数据预处理包括选择数量,类型和特征的标度,它依靠特征选择和特征抽取,特征选择选择重要的特征,特 征抽取把输入的特征转化为一个新的显著特征,它们经常被用来获取一个合适的特征集来为避免“维数灾”进行 聚类,数据预处理还包括将孤立点移出数据,孤立点是不依附于一般数据行为或模型的数据,因此孤立点经常会 导致有偏差的聚类结果,因此为了得到正确的聚类,我们必须将它们剔除。

聚类分析法ppt课件全

8/21/2024

25

1.2.2 动态聚类分析法

1.2 聚类分析的种类

(3)分类函数

按照修改原则不同,动态聚类方法有按批修改法、逐个修改法、混合法等。 这里主要介绍逐步聚类法中按批修改法。按批修改法分类的原则是,每一步修 改都将使对应的分类函数缩小,趋于合理,并且分类函数最终趋于定值,即计 算过程是收敛的。

8/21/2024

23

1.2.2 动态聚类分析法

1.2 聚类分析的种类

(2)初始分类 有了凝聚点以后接下来就要进行初始分类,同样获得初始分类也有不同的

方法。需要说明的是,初始分类不一定非通过凝聚点确定不可,也可以依据其 他原则分类。

以下是其他几种初始分类方法: ①人为分类,凭经验进行初始分类。 ②选择一批凝聚点后,每个样品按与其距离最近的凝聚点归类。 ③选择一批凝聚点后,每个凝聚点自成一类,将样品依次归入与其距离

8/21/2024

14

1.2 聚类分析的种类

(2)系统聚类分析的一般步骤 ①对数据进行变换处理; ②计算各样品之间的距离,并将距离最近的两个样品合并成一类; ③选择并计算类与类之间的距离,并将距离最ቤተ መጻሕፍቲ ባይዱ的两类合并,如果累的个

数大于1,则继续并类,直至所有样品归为一类为止; ④最后绘制系统聚类谱系图,按不同的分类标准,得出不同的分类结果。

8/21/2024

18

1.2 聚类分析的种类

(7)可变法

1 2 D kr

2 (8)离差平方和法

(D k 2 pD k 2 q)D p 2q

D k 2 rn n ir n n p i D i2 pn n ir n n q iD i2 qn rn in iD p 2 q

8/21/2024

《SPSS数据分析与应用》第6章 聚类分析

• 当纵坐标为13时,15个样本被12个白色 间隙分隔为13类。

系统聚类的结果解读

冰柱图聚类进程(最后一步)

依次类推,直到将15个样本全部 聚为一类,在15个样本之间没有 白色间隙,表示系统聚类结束。

• 测度观测点之间“亲疏”程度的方法与K-means聚类相同。 • 观测点与小类、小类与小类之间“亲疏”程度的测度,常用的方法有以下几种:

(1)重心法 (2)最近邻元素法 (3)组间平均联接法 (4)组间平均联接法 (5)离差平方和法

系统聚类的基本操作

第一步:用SPSS打开数据文件“移动通信客户_样本15.sav”。 第二步:在菜单栏中选择【分析(A)】→【描述统计(E)】→【描述(D)】,在弹出的 “描述”对话框的左下 角勾选【将标准化值另存为变量(Z)】,将已有的 6 个连续性变量都选到【变量(V)】列表框中,单击【确定】 按钮。

第四步:在“K均值聚类分析”对话框中单击右上角的【迭代(I)】按钮,在弹出的“K-均值聚类分析:迭代” 对话框中将【最大迭代次数(M)】修改为“50”,【收敛准则(C)】暂时不做修改。单击【继续(C)】按钮, 回到“K 均值聚类分析” 对话框。

K-Means聚类的基本操作

第五步:在“K均值聚类分析”对话框中单击右上角的【保存 (S)】按钮,在弹出的“K-均值聚类:保存新 变量”对话框中勾选【聚类成员(C)】和【与聚类中心的距离(D)】。单击【继续(C)】按钮,回到“K均 值聚类分析”对话框。

第一,如何测度样本的“亲疏程度”; 第二,如何进行聚类

K-means聚类对“亲疏程度”的测度

第六章--聚类分析和判别分析

13.88

f 107.8

62.24

15.6

8.88

31

g 73.18

44.54

23.9

15.2

22.38

h 72.23

47.31

9.48

6.43

13.14

i 84.66

44.05

13.5

7.47

19.11

j

114

41.44

33.2

11.2

48.72

k 74.96

50.13

13.9

9.62

16.14

l

12.7

上海

0.74

13.1

10.0

东山

1.01

12.5

11.7

长

南京

0.87

10.9

11.5

从表中可知,判别方程为: y=-9.3+2.074X1+0.197X2+0.294X3。

计算 和

y1

y2

求均值

y1

求均值

y2

y 计算 0

y0 n1 y1 n2 y2 n1 n2

徐州 1.48 8.3 11.1 -1.33198

阜阳 1.07 8.6 10.9 -2.18202

判别归类

yc

y0

0.29362 > 1E-06

华北

0.1154 > 1E-06

华北

-0.3799 < 1E-06 长江中下游

-1.33198 < 1E-06 长江中下游

-2.18202 < 1E-06 长江中下游

第六章 聚类分析与判别分析

快速样本聚类分析

聚类分析法ppt课件

7

(2)计算样品的距离。

d ij xi x j yi y j

8

G1

D(0)

G2 G3

G4

G5

G1 G2 G3 G4 G5

0 0.34 1.37 1.34 1.33

0 1.03 1 1.67

0 0.63 1.3

0 0.67

0

9

(3)找出D(0)非对角线上的最小元素, 将其对应的两个类合并为一个新类。

0 0.63 1.30 0 0.67

0

19

0

D(2)

1.37 0

1.67 1.30

0

20

0 1.67

D(3)

0

21

G1 G2 G3 G4 G5

0.4

0.8 1.2 1.6 2.0

聚类距离

பைடு நூலகம்22

G1 G2 G3 G4 G5

0.2 0.4 0.6 0.8 1.0

G1 G2 G3 G4 G5

0.4

0.8

1.2

1.6

2.0

聚类距离

聚类距离

23

某村对5个地块就其土壤质地和土壤有机 质含量进行了评估,结果如下。请分别 使用最长距离法和最短距离法对这5个地 块进行聚类分析,要求分为两类。

地块 A

B

C

D

E

质地 8

3

6

6

4

有机质 5

7

4

9

7

含量

24

聚类分析法

Cluster Analysis

1

聚类分析

将具有相似(similarity)性质(或距离)的 个体(样本)聚为一类,具有不同性质 的个体聚为不同的类。

计算药物分析(药学与生物信息学)第六章

6.2.3

距离与相似性度量

通过样本间的相似性来对样本进行分类的。

可用距离来描述样本间的相似程度; 距离越小两个样本越接近,相似性大,分在 同一类的可能性就越大,距离大则相反。

China Pharmaceutical University

距离越小两样本越接近,分在同一类的可能性就越大

距离

如何定义两类的距离

平均距离法 最短距离法 H,K为两类, DHK min duv u K类,v H类 K类是P和Q类两类合并而成的,

DHP min dm,n

DHQ min dm,n

m H, n P m H , n Q

DHK minDHP , DHQ

计算距离(欧氏距离),D,E最近

x1 100,80,70,60 x2 80,60,50,40 x3 80,70,40,50 x4 40,20,20,10 x5 50,10,20,10

0 0 1 0 0 得 G 1 G 1 G 1 G 0* 合并 GD 与GE GD* GD , GE A B C D

编号

1 100 80 80 40 50

2 80 60 70 20 10

3 70 50 40 20 20

A B C D E

解: 按 Dkl

x

m j 1

kj xlj

2

计算其距离矩阵如下:

China Pharmaceutical University

编号

A 0 40.0 38.7 110.4 111.4

例讲: 对于5种陨石样品分别测试4种金属的含量。

China Pharmaceutical University

编号 A B C D E

第六章 聚类分析

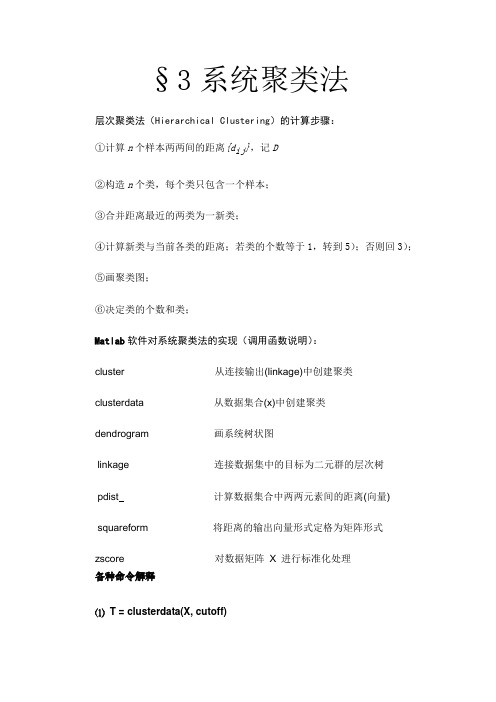

§3系统聚类法层次聚类法(Hierarchical Clustering)的计算步骤:①计算n个样本两两间的距离{d ij},记D②构造n个类,每个类只包含一个样本;③合并距离最近的两类为一新类;④计算新类与当前各类的距离;若类的个数等于1,转到5);否则回3);⑤画聚类图;⑥决定类的个数和类;Matlab软件对系统聚类法的实现(调用函数说明):cluster 从连接输出(linkage)中创建聚类clusterdata 从数据集合(x)中创建聚类dendrogram 画系统树状图linkage 连接数据集中的目标为二元群的层次树pdist计算数据集合中两两元素间的距离(向量) squareform 将距离的输出向量形式定格为矩阵形式zscore 对数据矩阵X 进行标准化处理各种命令解释⑴T = clusterdata(X, cutoff)其中X为数据矩阵,cutoff是创建聚类的临界值。

即表示欲分成几类。

以上语句等价与以下几句命令:Y=pdist(X,’euclid’)Z=linkage(Y,’single’)T=cluster(Z,cutoff)以上三组命令调用灵活,可以自由选择组合方法!⑵T = cluster(Z, cutoff)从逐级聚类树中构造聚类,其中Z是由语句likage产生的(n-1)×3阶矩阵,cutoff是创建聚类的临界值。

⑶Z = linkage(Y) Z = linkage(Y, 'method')创建逐级聚类树,其中Y是由语句pdist产生的n(n-1)/2 阶向量,’method’表示用何方法,默认值是欧氏距离(single)。

有’complete’——最长距离法;‘average’——类平均距离;‘centroid’——重心法;‘ward‘——递增平方和等。

⑷Y = pdist(X) Y = pdist(X, 'metric')计算数据集X中两两元素间的距离,‘metric’表示使用特定的方法,有欧氏距离‘euclid’(缺失值) 、标准欧氏距离‘SEuclid’ 、马氏距离‘mahal’、明可夫斯基距离‘Minkowski‘等。

第六讲——聚类分析PPT课件

什么是聚类分析?

(两种分类方式)

聚类分析的“对象”可以是所观察的多个样本, 也可以是针对每个样本测得的多个变量

按照变量对所观察的样本进行分类称为Q型聚类

按照多项经济指标(变量)对不同的地区(样本)进行分 类

按照样本对多个变量进行分类,则称为R型聚类

统计名言 现实是复杂的,是绝对不可能由一 个有组织的科学模型完全描述出来 的。

——Thomas Kuhn

聚类分析

1 聚类分析的基本原理 2 层次聚类 3 K-均值聚类

怎样把消费者分类?

南京雅兴市场研究有限公司在A城市的14个城区抽取3000个 15岁以上具有独立购买能力的消费者样本, 研究消费者的生 活方式。调查中采用一系列关于对社会活动、价值观念等内容 的陈述,请消费者根据自己的情况做出评价。评价结果采用7 分评价法,1分表示“非常同意”,7分表示“非常不同意”

本章主要介绍聚类分析方法

聚类分析

1. 聚类分析的基本原理

1.1 什么是聚类分析? 1.2 相似性的度量

1 聚类分析的基本原理 1.1 什么是聚类分析?

什么是聚类分析?

(cluster analysis)

把“对象”分成不同的类别

这些类不是事先给定的,而是直接根据数据的特 征确定的

把相似的东西放在一起,从而使得类别内部 的“差异”尽可能小,而类别之间的“差异 ”尽可能大

怎样把消费者分类?

上进型:占消费者总人数的不到13%。他们对生活的态度积极,多 为未婚青年,平均年龄在28岁左右,25岁以下的占40%,单身未婚 的比例占1/2以上。职业上的显著特征是:1/3为学生,三资企业员工 的比例达1/10。男性的比例高于女性。这类消费者是受教育程度最 高的,他们的平均家庭收入却是最高的,月平均收入在2300元左右

聚类分析课件

聚类分析课件聚类分析课件聚类分析是一种常用的数据分析方法,它可以将一组数据分成不同的类别或簇,每个簇内的数据点具有相似的特征,而不同簇之间的数据点具有较大的差异。

聚类分析在各个领域都有广泛的应用,如市场细分、社交网络分析、医学诊断等。

在本文中,我们将介绍聚类分析的基本概念、常用算法和实际应用案例。

一、聚类分析的基本概念聚类分析的目标是通过对数据进行分组,使得每个组内的数据点相似度较高,而不同组之间的相似度较低。

聚类分析的基本概念包括距离度量和聚类算法。

1. 距离度量距离度量是衡量数据点之间相似度或差异度的标准。

常用的距离度量方法包括欧氏距离、曼哈顿距离和闵可夫斯基距离等。

欧氏距离是最常用的距离度量方法,它计算数据点在多维空间中的直线距离。

曼哈顿距离则计算数据点在坐标轴上的绝对距离,而闵可夫斯基距离则是这两种距离的一种泛化形式。

2. 聚类算法常用的聚类算法包括K-means算法、层次聚类算法和DBSCAN算法等。

K-means算法是一种迭代的、基于距离的聚类算法,它将数据点分成K个簇,使得每个簇内的数据点与该簇的中心点的距离最小。

层次聚类算法则是一种自底向上的聚类算法,它通过计算数据点之间的相似度来构建一个层次结构。

DBSCAN算法是一种基于密度的聚类算法,它将数据点分为核心点、边界点和噪声点三类,具有较好的鲁棒性和灵活性。

二、常用的聚类分析算法1. K-means算法K-means算法是一种迭代的、基于距离的聚类算法。

它的基本思想是随机选择K个初始中心点,然后将每个数据点分配到距离其最近的中心点所对应的簇中。

接着,重新计算每个簇的中心点,并重复这个过程直到收敛。

K-means算法的优点是简单易实现,但它对初始中心点的选择敏感,并且需要预先指定簇的个数K。

2. 层次聚类算法层次聚类算法是一种自底向上的聚类算法。

它的基本思想是将每个数据点看作一个独立的簇,然后通过计算数据点之间的相似度来构建一个层次结构。

数据挖掘 聚类分析(第六章)

❖ 具体过程如表:

m1

m2

K1

K2

2

4

{2,3}

{4,10,12,20,30,11,25}

2.5

16

{2,3,4}

{10,12,20,30,11,25}

3

18

{2,3,4,10}

{12,20,30,11,25}

4.75

19.6 {2,3,4,10,11,12}

{20,30,25}

7

25

{2,3,4,10,11,12}

❖ 2、考虑下一个数据项,把它分配到目前 某个类中或一个新类中。给分配是基于 一些准则的,例如新数据项到目前类的 重心的距离。在这种情况下,每次添加 一个新数据项到一个目前的类中时,需 要重新计算重心的值。

❖ 3、重复步骤2,直到所有的数据样本都 被聚类完毕。

❖ 例如: 设 x1=(0,2),x2=(0,0),x3=(1.5,0),x4=(5,0),X5=(5,2) 假定样本的顺序是:X1,X2,X3,X4,X5, 类间相似度的 阈值水平是s=3。

❖ 聚类结果的质量也取决于它发现隐藏模式的 能力。.

K-均值聚类

❖ K-均值聚类方法是最简单、最常用的使 用使用准则的方法。

❖ K-均值聚类是属于划分方法中的基于质 心技术的一种方法。划分的思路是以k 为参数,把n个对象分为k 个类,以使类 内具有较高的相似度,而类间的相似度 较低。相似度的计算根据一个类中对象 的平均值(被看作类的重心)来进行。

1、第一个样本X1将变成第一个类C1={x1}.x1的坐标就 是重心坐标M1={0,2}。

2、开始分析其他样本。 a)把第2个样本x2和M1比较,距离d为:

d(x2,M1)= 02 22 =2.0<3

最新[理学]应用多元统计分析课后习题答案详解北大高惠璇第六章习题解答课件PPT

![最新[理学]应用多元统计分析课后习题答案详解北大高惠璇第六章习题解答课件PPT](https://img.taocdn.com/s3/m/021cb26ef121dd36a22d820f.png)

xi)2

n

t1

xt2i

nxi2

abnab2 n

(ab)[n(ab)]1(ab)(cd)

n

n

8

第六章 聚类分析

n (xtj

t1

xj)2

n

t1

xt2j

nx2j

acnac2 n

(ac)[n(ac)]1(ac)(bd)

n

n

故二值变量的相关系数为:

n

Cij(7)

(xtixi)x(tjxj)

t1

dik dkj,对一i切 ,k, j.

(2) 设d是距离,a >0为正常数.令d*=ad,显然有

① di*jcd ij0,且仅 X(i)当 X(j)时 di*j0; ② di*jcd ijcdjid*ji,对一 i,j;切

3

第六章 聚类分析

6-2 试证明二值变量的相关系数为(6.2.2)式,夹角余

并类距离 D1=1.

D(2)

0 9 3 7

0 5 10

0 8

X(2)

X

(3)

0

X (5) CL4

11

第六章 聚类分析

② 合并{X(2),X(5)}=CL3,并类距离 D2=3.

D(3) 100 9

0 8

0CCXL(L334)

③ 合并{CL3,CL4}=CL2,并类距离 D3=8.

D(4) 100 0CX(3L2)

n

(xti xi)(xtj xj )

rij

t1 n

n

(xti xi)2

(xtj xj )2

t1

t1

7

第六章 聚类分析

n

(xti xi)(xtj

应用多元统计分析课后习题答案高惠璇第六章习题解答

目录

习题一:多元线性回归分析 习题二:主成分分析 习题三:因子分析 习题四:聚类分析

01

习题一:多元线性回归分析

多元线性回归模型的建立

总结词:多元线性回归模型是用来研究多个自变量与因变量之间线性关系的统计方法。

多元线性回归模型的参数估计

总结词:参数估计是多元线性回归模型建立的重要步骤,常用的方法有最小二乘法和加权最小二乘法等。

步骤4

重新计算每个聚类的中心,并更新聚类中心。

步骤5

重复步骤3和4,直到聚类中心收敛或达到预设的最大迭代次数。

算法

常见的聚类算法包括K-means、层次聚类、DBSCAN等。

聚类分析的步骤与算法

感谢您的观看

THANKS

01

主成分在几何上表示数据集的投影方向,即数据在各主成分上的投影点形成的直线方向。

02

第一主成分是数据点散布最广的方向,第二主成分是数据点散布次广的方向,以此类推。

主成分的几何意义

03

习题三:因子分析

因子分析的基本概念

因子分析是一种多元统计分析方法,用于从一组变量中提取公因子,并对这些公因子进行解释。

习题四:聚类分析

聚类分析的目标是发现数据的内在结构,以便对数据进行更深入的理解和分类。

聚类分析广泛应用于数据挖掘、模式识别、图像处理等领域。

聚类分析是一种无监督学习方法,通过将数据点或观测值分组,使得同一组(即聚类)内的数据尽可能相似,而不同组之间的数据尽可能不同。

聚类分析的基本思想

设$X = {x_1, x_2, ..., x_n}$为数据集,其中每个$x_i$是一个$p$-维向量。

正的因子载荷表示正相关,负的因子载荷表示负相关。

应用多元统计分析课后习题答案高惠璇(第六章习题解答)

0,

第六章 聚类分析

6-5 试从定义直接证明最长和最短距离法的单调性. 证明:先考虑最短距离法: ( L1) ( L1) D D 设第L步从类间距离矩阵 ij

D

( L1) pq

min D

( L1) pq

( L1) ij

故合并Gp和Gq为一新类Gr,这时第L步的并类距离:

0, p (1 )

0, q (1 ) np nr (1 ) nq nr

nq nr

0, ( 1)

p q (1 )

11

18

故可变类平均法具有单调性。

第六章 聚类分析

对于可变法,因

1 1 0, p 0, q 0, ( 1) 2 2 1 1 p q 11 2 2

证明 : (1)设d 和d 为距离, 令d d

(1) ( 2)

(1)

d .

( 2)

2

以下来验证d满足作为距离所要求的3个条件.

第六章 聚类分析

① ② ③

(2) 设d是距离,a >0为正常数.令d*=ad,显然有

① ②

d cd ij 0, 且仅当X (i ) X ( j )时d 0;

应用多元统计分析

第六章部分习题解答

第六章 聚类分析

6-1 证明下列结论: (1) 两个距离的和所组成的函数仍是距离; (2) 一个正常数乘上一个距离所组成的函数 仍是距离; (3)设d为一个距离,c>0为常数,则 d * d d c 仍是一个距离; (4) 两个距离的乘积所组成的函数不一定是 距离;

(6.2.2)

9

第六章 聚类分析

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

聚类分析在实际工作中,我们经常遇到分类问题。

若事先已经建立类别,则使用判别分析,若事先没有建立类别,则使用聚类分析。

聚类分析主要是研究在事先没有分类的情况下,如何将样本归类的方法。

聚类分析的内容包含十分广泛,有系统聚类法、动态聚类法、分裂法、最优分割法、模糊聚类法、图论聚类法、聚类预报等多种方法。

在Matlab 软件包中,主要使用系统聚类法。

系统聚类法是聚类分析中应用最为广泛的一种方法。

它的基本原理是:首先将一定数量的样品(或指标)各自看成一类,然后根据样品(或指标)的亲疏程度,将亲疏程度最高的两类合并,如此重复进行,直到所有的样品都合成一类。

衡量亲疏程度的指标有两类:距离、相似系数。

(1)常用距离 ①欧氏距离假设有两个n 维样本()n x x x x 112111,,,⋅⋅⋅=和()n x x x x 222212,,,⋅⋅⋅=,则它们的欧氏距离为:()()∑=-=nj j jx xx x d 122121,②标准化欧氏距离假设有两个n 维样本()n x x x x 112111,,,⋅⋅⋅=和()n x x x x 222212,,,⋅⋅⋅=,则它们的标准化欧氏距离为:()()()Tx x D x x x x sd 2112121,--=-其中,D 表示m 个样本的方差矩阵:()22221,,,m diagonal D σσσ⋅⋅⋅=,其中2jσ表示第j 个样本的方差。

③马氏距离假设共有n 个指标,第i 个指标共测得m 个数据(要求n m >):⎪⎪⎪⎪⎪⎭⎫⎝⎛⋅⋅⋅=im i i i x x x x 21于是,我们得到n m ⨯阶的数据矩阵()n x x x X ,,,21⋅⋅⋅=,每一行是一个样本数据。

n m ⨯阶数据矩阵X 的n n ⨯阶协方差矩阵记作()X Cov 。

两个n 维样本()n x x x x 112111,,,⋅⋅⋅=和()n x x x x 222212,,,⋅⋅⋅=的马氏距离如下:()()()()()T x x X Cov x x x x mahal2112121,--=-马氏距离考虑了各个指标量纲的标准化,是对其它几种距离的改进。

马氏距离不仅排除了量纲的影响,而且合理考虑了指标的相关性。

④布洛克(C ity Block )距离两个n 维样本()n x x x x 112111,,,⋅⋅⋅=和()n x x x x 222212,,,⋅⋅⋅=的布洛克距离如下:()∑=-=nj j j x x x x b 12121,⑤明可夫斯基(Minkowski )距离两个n 维样本()n x x x x 112111,,,⋅⋅⋅=和()n x x x x 222212,,,⋅⋅⋅=的明可夫斯基距离:()pnj pjj x x x x m 112121,⎪⎪⎭⎫ ⎝⎛-=∑= 注意:1=p 时是布洛克距离,2=p 时是欧氏距离。

⑥余弦距离(Cosine distance )()⎪⎪⎭⎫ ⎝⎛-=T T T X X X X X X X X d 221121211, 这是受相似形几何原理启发而产生的一种标准,在识别图像和文字时,常用夹角余弦为标准。

⑦相似距离(Correlation distance )()TTTX X X X X X X X X X X X X X d ⎪⎭⎫ ⎝⎛-⎪⎭⎫ ⎝⎛-⎪⎭⎫ ⎝⎛-⎪⎭⎫ ⎝⎛-⎪⎭⎫ ⎝⎛-⎪⎭⎫ ⎝⎛--=------222211112211211,(2)Matlab 中常用的计算距离的函数假设我们有n m ⨯阶的数据矩阵()n x x x X ,,,21⋅⋅⋅=,每一行是一个样本数据。

在Matlab 中计算样本点之间距离的内部函数为:出。

(3)常用的聚类方法常用的聚类方法主要有以下几种:最短距离法、最长距离法、中间距离法、重心法、平方和递增法等等。

(4)创建系统聚类树假设已经得到样本点之间的距离y,可以用linkage函数创建系统聚类树,格式为:z = linkage(y),其中z为一个包含聚类树信息的(m –1)×3的矩阵。

例如,z =2.000 5.000 0.23.0004.000 1.28则,z的第一行表示第2、第5样本点连接为一个类,它们的距离为0.2,z的第二行表示第3、第4样本点连接为一个类,它们的距离为1.28。

例1 在Matlab中写一个名字为opt_linkage_1的M—文件:x=[3 1.7;1 1;2 3;2 2.5;1.2 1;1.1 1.5;3 1];y=pdist(x,'mahal');yy=squareform(y)z=linkage(y,’centroid’)h=dendrogram(z)存盘后按F5键执行,得到结果:yy =0 2.3879 2.1983 1.6946 2.1684 2.22842.3879 0 2.6097 2.0616 0.2378 0.62552.1983 2.6097 0 0.6353 2.5522 2.01531.69462.0616 0.6353 0 1.9750 1.51062.1684 0.2378 2.5522 1.9750 0 0.66662.2284 0.6255 2.0153 1.5106 0.6666 00.8895 2.3778 2.9890 2.4172 2.1400 2.4517z =2.0000 5.0000 0.23788.0000 6.0000 0.63533.00004.0000 0.63531.0000 7.0000 0.88959.0000 10.0000 2.106311.0000 12.0000 2.0117按重心距离法得到的系统聚类树为:其中,h=dendrogram(z)表示输出聚类树形图的冰状图。

(5)根据系统聚类树创建聚类假设已经求出系统聚类树z,我们根据z来创建聚类,使用cluster函数。

例2 在Matlab中写一个名字为opt_cluster_1的M—文件:x=[3 1.7;1 1;2 3;2 2.5;1.2 1;1.1 1.5;3 1];y=pdist(x,'mahal');yy=squareform(y)z=linkage(y,'centroid');h=dendrogram(z)t=cluster(z,3)程序中“t=cluster(z,3)”表示分成3个聚类,需要分成几类由人工选择。

存盘后按F5键执行,得到:t =3122113即,第1个样本点、第7个样本点为第3类,第2、第5、第6样本点为第1类,第3、第4样本点为第2类。

(6)根据原始数据创建分类在Matlab软件包中,由内部函数clusterdata对原始数据创建分类,格式有两种:①clusterdata(x, a),其中1<a,表示在系统聚类树中距离小于a的样本点归0<结为一类;②clusterdata(x, b),其中1>b是整数,表示将原始数据x分为b类。

例3 在Matlab中写一个名字为opt_clusterdata_1的M—文件:x=[3 1.7;1 1;2 3;2 2.5;1.2 1;1.1 1.5;3 1];t=clusterdata(x,0.5)z=clusterdata(x,3)存盘后按F5键执行,得到:t =2144132z =1322331其中,t的结果表示距离小于0.5的样本点归结为一类,这样,共有四类,第1类:样本点2、5;第2类:样本点1、7;第3类:样本点6;第4类:样本点3、4。

而z的结果表示首先约定将原始数据x分为3类,然后计算,结果如下,第1类:样本点1、7;第2类:样本点3、4;第3类:样本点2、5、6。

利用内部函数clusterdata对原始数据创建分类,其缺点是不能更改距离的计算方法。

比较好的方法是分步聚类法。

(7)分步聚类法假设有样本数据矩阵x。

第1步对于不同的距离,利用pdist函数计算样本点之间的距离y1 = pdist(x)y2 = pdist(x, ‘seuclid’)y3 = pdist(x, ‘mahal’)y4 = pdist(x, ‘cityblock’)第2步计算系统聚类树以及相关信息z1 = linkage(y1)z2 = linkage(y2)z3 = linkage(y3)z4 = linkage(y4)第3步利用cophenet函数计算聚类树信息与原始数据的距离之间的相关性,这个值越大越好。

t1 = cophenet(z1, y1)t2 = cophenet(z2, y2)t3 = cophenet(z3, y3)t4 = cophenet(z4, y4)注意:z在前y在后,顺序不能颠倒。

第4步选择具有最大的cophenet值的距离进行分类。

利用函数clusterdata(x, a)对数据x进行分类,其中1<a,表示在系统聚0<类树中距离小于a的样本点归结为一类。

例4 在Matlab中写一个名字为opt_cluster_2的M—文件:x=[3 1.7;1 1;2 3;2 2.5;1.2 1;1.1 1.5;3 1];y1=pdist(x);y2=pdist(x,'seuclid');y3=pdist(x,'mahal');y4=pdist(x,'cityblock');z1=linkage(y1);z2=linkage(y2);z3=linkage(y3);z4=linkage(y4);a1=cophenet(z1,y1)a2=cophenet(z2,y2)a3=cophenet(z3,y3)a4=cophenet(z4,y4)存盘后按F5键执行,得到:a1 =0.9291a2 =0.9238a3 =0.9191a4 =0.9242结果中a1 = 0.9291最大,可见此例利用欧氏距离最合适。

于是,在Matlab中另写一个名字为opt_cluster_3的M—文件:x=[3 1.7;1 1;2 3;2 2.5;1.2 1;1.1 1.5;3 1];y1=pdist(x);z1=linkage(y1)存盘后按F5键执行,得到:z1 =2.0000 5.0000 0.20003.00004.0000 0.50008.0000 6.0000 0.50991.0000 7.0000 0.700011.0000 9.0000 1.280612.0000 10.0000 1.3454矩阵z1的第1行表示样本点2、5为一类,在系统聚类树上的距离为0.2,其它类推。

考察矩阵z1的第3列,系统聚类树上的6个距离,可以选择0.5作为聚类分界值。