基于近邻稳定性的离群点检测算法

实现离群点检测的机器学习算法

实现离群点检测的机器学习算法离群点检测(Outlier detection)是机器学习中的一项重要任务,旨在识别数据集中与其他数据点不太相似或异常的数据点。

离群点也被称为异常值,它们与正常的数据点存在明显的偏离或异常行为。

离群点检测的目标是从大量的数据中准确地识别这些异常值,以便进一步分析和采取相应的措施。

实现离群点检测的机器学习算法有多种,下面将介绍一些常用的方法:1. 统计学方法:这些方法利用统计学原理来识别离群点。

其中一个常用的方法是基于数据的标准差或均值的阈值判断。

如果数据点的值偏离均值或标准差超过一定的阈值,则将其标记为离群点。

这种方法简单易用,但对于复杂的数据分布可能不够准确。

2. 基于距离的方法:这些方法通过计算数据点与最近邻数据点之间的距离来判断是否为离群点。

其中一种常见的方法是K近邻算法,它通过计算每个数据点与其K个最近邻数据点的距离,并将距离较远的点标记为离群点。

还有一种方法是基于密度的离群点检测算法,如LOF(局部离群因子)算法,它衡量数据点周围的局部密度与其邻近数据点的局部密度之比,从而识别离群点。

3. 基于聚类的方法:这些方法将数据点分为不同的聚类,并将边界上的数据点标记为离群点。

其中一个常用的算法是DBSCAN(基于密度的聚类应用噪声)算法,它通过将数据点组织成高密度区域和低密度区域来判断离群点。

也有一些其他的聚类算法可用于离群点检测,如基于谱聚类、层次聚类等。

4. 基于深度学习的方法:近年来,深度学习在离群点检测中的应用日益增多。

深度学习模型可以自动从数据中学习特征,并且对非线性和高维数据具有较好的处理能力。

一些常用的深度学习模型,如自编码器(Autoencoder)和变分自编码器(Variational Autoencoder),可以用于离群点检测。

这些模型可以通过重构误差或潜在空间的分布来判断数据点的异常性。

总结而言,离群点检测是机器学习中的一项重要任务,可以通过多种算法实现。

离群点判断算法

离群点判断算法

离群点判断算法主要用于检测数据集中与大多数观测值显著不同的异常值。

简要介绍如下:

1. 四分位数法则:基于箱线图原理,若数据点小于下四分位数(Q1)减去1.5倍四分位距(IQR),或大于上四分位数(Q3)加上1.5倍IQR,则视为离群点。

2. Z-score方法:计算每个数据点与其均值的偏差(即标准分数),若绝对值超过预定阈值(如3),则视为离群点。

3. DBSCAN聚类算法:通过密度连接度识别核心对象和边界对象,不满足邻域密度要求的数据点被视为离群点。

4. LOF(Local Outlier Factor):比较数据点与周围邻居的局部密度,LOF值过高表示该点可能为离群点。

5. Isolation Forest:利用随机森林构建隔离树,孤立于树结构顶层的数据点更可能是离群点。

这些算法可应用于数据分析、故障检测等多个领域,有助于发现潜在问题或异常现象。

离群点算法

离群点算法全文共四篇示例,供读者参考第一篇示例:离群点(Outlier)是指数据集中与其他数据点明显不同的数据点。

离群点算法是指一系列用来检测和识别离群点的技术和方法。

在数据分析和机器学习中,离群点算法可以有效地识别异常数据点,帮助我们更准确地进行数据分析和建模。

离群点算法主要分为基于统计学的方法、基于聚类的方法和基于密度的方法等多种类型。

每种类型的算法都有其独特的优缺点和适用范围。

在实际应用中,我们可以根据具体的数据集和需求选择合适的算法进行离群点检测。

一种常用的离群点算法是基于统计学的方法,其中最常见的是Z 分数(Z-score)方法。

Z分数是一种标准化的统计量,表示数据点与平均值的偏离程度。

通过计算数据点的Z分数,我们可以判断数据点是否为离群点。

一般来说,Z分数绝对值大于3的数据点可以被认为是离群点。

除了Z分数方法外,还有一些其他基于统计学的离群点算法,如Tukey的箱线图(Boxplot)、Grubbs检验等。

这些方法都可以有效地检测离群点,但在实际应用中需要根据具体情况选择最合适的方法。

另一种常用的离群点算法是基于聚类的方法,其中LOF(Local Outlier Factor)算法是一种常见的基于聚类的离群点算法。

LOF算法通过计算数据点周围邻近点的密度来判断数据点是否为离群点。

密度较低的数据点很可能是离群点。

通过计算LOF值,我们可以对数据点进行离群点判断。

基于密度的离群点算法也是一种常用的方法,其中DBSCAN (Density-Based Spatial Clustering of Applications with Noise)算法是一种典型的基于密度的离群点算法。

DBSCAN算法通过将数据点分为核心点、边界点和噪声点来判断数据点是否为离群点。

在DBSCAN算法中,噪声点通常被认为是离群点。

离群点算法在数据分析和机器学习中扮演着重要的角色。

通过识别和处理离群点,我们可以得到更准确的数据分析结果,提高模型的准确性和稳定性。

L O F 离 群 点 检 测 算 法

数据挖掘(五)离群点检测5 异常检测方法异常对象被称作离群点。

异常检测也称偏差检测和例外挖掘。

异常检测的方法:(1)基于模型的技术:首先建立一个数据模型,异常是那些同模型不能完美拟合的对象;如果模型是簇的集合,则异常是不显著属于任何簇的对象;在使用回归模型时,异常是相对远离预测值的对象。

(2)基于邻近度的技术:通常可以在对象之间定义邻近性度量,异常对象是那些远离其他对象的对象。

(3)基于密度的技术:仅当一个点的局部密度显著低于它的大部分近邻时才将其分类为离群点。

(1)统计方法。

统计学方法是基于模型的方法,即为数据创建一个模型,并且根据对象拟合模型的情况来评估它们。

大部分用于离群点检测的统计学方法都是构建一个概率分布模型,并考虑对象有多大可能符合该模型。

离群点的概率定义:离群点是一个对象,关于数据的概率分布模型,它具有低概率。

这种情况的前提是必须知道数据集服从什么分布,如果估计错误就造成了重尾分布。

异常检测的混合模型方法:对于异常检测,数据用两个分布的混合模型建模,一个分布为普通数据,而另一个为离群点。

聚类和异常检测目标都是估计分布的参数,以最大化数据的总似然(概率)。

聚类时,使用EM算法估计每个概率分布的参数。

然而,这里提供的异常检测技术使用一种更简单的方法。

初始时将所有对象放入普通对象集,而异常对象集为空。

然后,用一个迭代过程将对象从普通集转移到异常集,只要该转移能提高数据的总似然(其实等价于把在正常对象的分布下具有低概率的对象分类为离群点)。

(假设异常对象属于均匀分布)。

异常对象由这样一些对象组成,这些对象在均匀分布下比在正常分布下具有显著较高的概率。

优缺点:(1)有坚实的统计学理论基础,当存在充分的数据和所用的检验类型的知识时,这些检验可能非常有效;(2)对于多元数据,可用的选择少一些,并且对于高维数据,这些检测可能性很差。

(2)基于邻近度的离群点检测。

一个对象是异常的,如果它远离大部分点。

matlab lof离群点检测算法

matlab lof离群点检测算法离群点检测是数据挖掘和统计学中的一项重要任务,它旨在识别数据集中异常或独特的数据点。

离群点通常表示数据集中潜在的异常模式、错误或欺诈行为。

在许多领域,如金融、医疗、图像处理和自然语言处理,离群点检测都有广泛的应用。

本文将介绍一种基于Matlab的LOF(Local Outlier Factor)离群点检测算法。

一、LOF算法原理LOF算法是一种基于密度的离群点检测方法。

它通过计算每个数据点对本地密度估计的影响来评估其离群程度。

算法的核心思想是,如果一个数据点与邻近数据点的分布不一致,那么它更可能是离群点。

LOF算法通过计算每个数据点对邻近数据点的局部影响,并使用这些影响来评估每个数据点的离群程度。

二、Matlab实现步骤1. 导入数据:首先,将需要检测离群点的数据导入Matlab中。

数据可以来自各种格式,如CSV文件、Excel文件或直接从其他应用程序导入。

2. 创建LOF对象:在Matlab中,可以使用fit方法创建一个LOF对象。

该对象将用于计算每个数据点的离群程度。

3. 拟合模型:使用LOF对象,可以对数据进行多次拟合,以获取每个数据点的离群程度估计。

4. 检测离群点:使用detect方法,可以检测出数据集中离群程度最高的数据点。

这些点可以被视为潜在的异常模式、错误或欺诈行为。

5. 结果可视化:可以使用Matlab的绘图功能,将检测到的离群点可视化,以便更好地理解它们的分布和性质。

三、应用示例假设我们有一组股票价格数据,我们希望检测出价格波动异常的数据点作为潜在的离群点。

首先,我们将数据导入Matlab中,并使用LOF算法创建LOF对象。

然后,我们拟合模型并检测出离群点。

最后,我们将结果可视化,以便更好地理解这些离群点的性质和分布。

四、结论LOF离群点检测算法是一种有效的离群点检测方法,它能够识别出数据集中异常或独特的数据点。

通过在Matlab环境中实现LOF算法,我们可以方便地进行离群点检测,并获得准确的离群程度估计。

基于距离的离群点检测算法

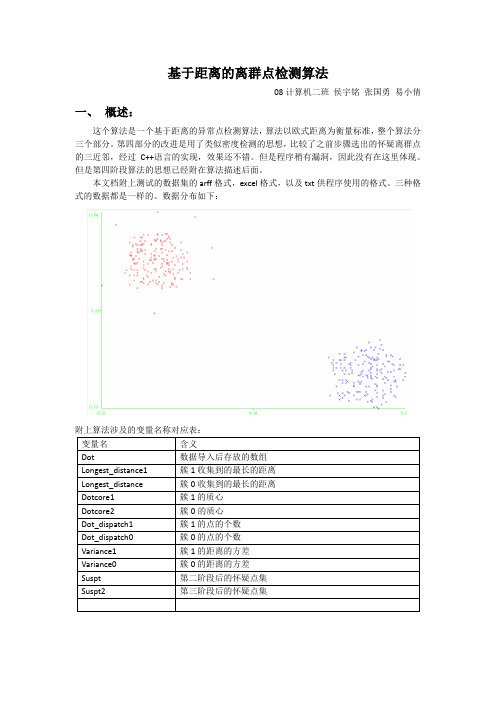

基于距离的离群点检测算法08计算机二班侯宇铭张国勇易小倩一、概述:这个算法是一个基于距离的异常点检测算法,算法以欧式距离为衡量标准,整个算法分三个部分。

第四部分的改进是用了类似密度检测的思想,比较了之前步骤选出的怀疑离群点的三近邻,经过C++语言的实现,效果还不错。

但是程序稍有漏洞,因此没有在这里体现。

但是第四阶段算法的思想已经附在算法描述后面。

本文档附上测试的数据集的arff格式,excel格式,以及txt供程序使用的格式。

三种格式的数据都是一样的。

数据分布如下:附上算法涉及的变量名称对应表:二、算法描述:(这里以数据集为两个相对集中的数据簇和若干离群点为例进行说明)第一部分:找出两个质心Step1: 遍历数据,将数据存入数组dot中该数据设为二维数据,有x,y两个属性。

Step2:设定遍历时的第一个和第二个数据为初始质心。

设定两个变量longest_distance分别记录两个初始簇的最长的距离,设置dotcore1变量记录第一个簇的质心,dotcore2变量记录第二个簇的质心。

Step3:循环:当一个新的点p进入程序时,首先比较点p分别到点dotcore1的距离和到dotcore2的距离,选择距离较小的质心(这里假设选择了dotcore1),记该距离为distancep。

比较distancep和第一个簇(因为选择了dotcore1)的longest_distance。

若distancep<longest_distance,开始下一次循环。

若distancep>longest_distance,则使点p成为新的质心coredot1。

这样循环下去,就可以找到两个簇的最终质心。

算法流程图:进入阶段2图.1 阶段1第二部分:将所有的点归簇,并筛选一部分点Step4: 开始第二次点的扫描:当一个新的点p进入程序时,首先比较点p分别到点dotcore1的距离和到dotcore2的距离,选择距离较小的质心。

基于近邻传播的离群点检测算法

收稿日期:2020 08 25;修回日期:2020 10 10 基金项目:国家自然科学基金资助项目(61862060,61462079,61562086,61562078) 作者简介:张倩倩(1996 ),女,河南周口人,硕士研究生,主要研究方向为数据挖掘(2481574352@qq.com);于炯(1964 ),男,北京人,教授,博导,博士,主要研究方向为网络安全、网格计算、分布式计算;李梓杨(1993 ),男,新疆乌鲁木齐人,博士研究生,主要研究方向为云计算、分布式计算;蒲勇霖(1991 ),男,山东淄博人,博士研究生,主要研究方向为流式计算、绿色计算.基于近邻传播的离群点检测算法张倩倩1,于 炯1,2,李梓杨2,蒲勇霖2(1.新疆大学软件学院,乌鲁木齐830091;2.新疆大学信息科学与工程学院,乌鲁木齐830046)摘 要:离群点是与其他正常点属性不同的一类对象,其检测技术在各行业上均有维护数据纯度、保障业内安全等重要应用,现有算法大多是基于距离、密度等传统方法判断检测离群点。

本算法给每个对象分配一个“孤立度”,即该点相对其邻点的孤立程度,通过排序进行判定,比传统算法效率更高。

在AP(affinitypropagation)聚类算法的基础上进行改进与优化,提出能检测异常数据点的算法APO(outlierdetectionalgorithmbasedonaffinitypropagation)。

通过加入孤立度模块并计算处理样本点的孤立信息,并引入放大因子,使其与正常点之间的差异更明显,通过增大算法对离群点的敏感性,提高算法的准确性。

分别在模拟数据集和真实数据集上进行对比实验,结果表明:该算法与AP算法相比,对离群点的敏感性更加强烈,且本算法检测离群点的同时也能聚类,是其他检测算法所不具备的。

关键词:离群点检测;聚类算法;数据挖掘;近邻传播中图分类号:TP391 文献标志码:A 文章编号:1001 3695(2021)06 011 1662 06doi:10.19734/j.issn.1001 3695.2020.08.0226OutlierdetectionalgorithmbasedonaffinitypropagationZhangQianqian1,YuJiong1,2,LiZiyang2,PuYonglin2(1.SchoolofSoftware,XinjiangUniversity,Urumqi830091,China;2.CollegeofInformationScience&Engineering,XinjiangUniversity,Urumqi830046,China)Abstract:Outliersareaclassofobjectswithdifferentpropertiesfromothernormalpoints,whosedetectiontechnologyinvariousindustrieshasawideapplicationtomaintainthepurityofdataandensurethesafetyoftheindustry.Mostoftheexistingalgorithmsarebasedondistance,density,andothertraditionalmethodstodetectoutliers.Thispaperassignedeachobjectan“isolationdegree”,thedegreeofisolationofthepointrelativetoadjacentpoints,whichcouldidentifyoutliersbysorting,thatwasmoreefficient.ItproposedthedetectiontechnologyAPObyimprovingandoptimizingtheAPclusteringalgorithm.Itintroducedtheoutliermoduleandprocessedtheisolatedinformationofpoints.Inaddition,itaddedtheamplificationfactortomakethedifferencebetweentheoutliersandthenormalpointsmoreobvious.Byincreasingthesensitivityofthealgorithmtooutliers,itimprovedtheaccuracyofthealgorithm.Theexperimentusedsimulateddatasetrealdatasets,who’stheresultsshowedthatthealgorithmwasmoresensitiveanditdetectedoutliersmoreaccuratelythanAPalgorithm.Inaddition,thisalgo rithmcanclusteroutlierswhiledetectingoutliers,whichisnotavailableinotherdetectionalgorithms.Keywords:outlierdetection;clusteringalgorithm;datamining;affinitypropagation 聚类算法[1]在计算机、银行金融、电子商务[2~4]等众多领域中都得到了广泛的应用。

一种改进的基于反k近邻的流数据离群点检测算法

2016年第 8期

呼妮 等 :一种 改进 的基 于反 k近邻的流数据 离群点检测 算法

33

象 的离群因子,虽然算法效果较好 ,但是对于受到影响 的对象需要多次扫描数据进行更新 ,因此计算量较大。

An Im proved Stream Data Outlier M ining Algorithm Based on Reverse k Nearest Neighbors

HU Ni,W ANG Yong

(School of Natural and Applied Sciences,Northwestern Polytechnical University,Xi’an 7101 14,China)

流 数 据 的离 群 点检 测 已经受 到 越 来越 多 的关 注 和 研 究 ,数 据 流 的 挖 掘 模 型 有 一 层 的 J、2 层 的 、分布式的等H ”J。在数据流的离群点检测算 法——基于近邻 的检测算法 SOMRNN¨ 中,根据反 k邻 域 内点数 的 多少来 判 断离群 的程 度 大小 ,点 对 象 的离群 度越 大 ,则 反 k近 邻个 数越 少。但 是文 献 [14]中同时采用 k邻域与反 k邻域 2个概念 ,需要 同 时对 它们进 行更 新 ,计 算 量较 大 ,而且 文 中反 k近 邻 数的定义具有一定的漏洞 ,因此算法具有一定的局 限 性。文献 [15]所介绍的检测算法 DSOKP,把数据流 进行分块 ,再分别进行离群点挖掘 ,该算法运行速度较 快 ,但是 对于数 据 流 的概 念漂 移 特点 缺 乏一 定 的适 应 性 。文献 [16—17]基 于密度 的局部离群点检测算法 ,提 出 了增量 挖掘算 法 。在 有 新 的数据 到 来 时 ,更 新数 据 对

DBSCAN算法在离群点检测中的应用分析

DBSCAN算法在离群点检测中的应用分析随着物联网、互联网等技术的发展,数据量呈现爆炸性增长,数据中包含大量的噪声和离群点,这些噪声和离群点对数据的分析和挖掘产生了很大的干扰和误导。

离群点检测就是识别数据集中的异常记录或离群点,这些离群点不符合数据集中的规律或趋势,然而离群点检测一直是数据挖掘中的一个难点问题。

本文将介绍一种离群点检测算法,即密度聚类算法(DBSCAN),其原理和应用场景。

一. DBSCAN算法原理DBSCAN是一种基于密度的聚类算法,它发现具有相同密度的点集并将它们视为一个簇,这个算法能够自动发现任意形状的簇,并且能够处理噪声。

该算法会对数据点进行分类,将点分成三类:核心点、边界点和噪声点。

其中,核心点是指在以某一数据点为圆心,半径为ε的圆中,至少有MinPts个数据点的点。

边界点是指不是核心点,但在同一领域内,任何一个核心点与它之间的距离不超过ε的点。

噪声点是指既不是核心点也不是边界点的点。

DBSCAN算法可以分为以下几个步骤:1. 确定半径ε和MinPts2. 随机选择一个未访问过的数据点p3. 如果p是核心点,以p为圆心,半径为ε画一个圆,将圆内的所有数据点标记为同一簇,并递归地进行这种方式的迭代。

4. 如果p是边界点,则将p加入适合的簇中。

5. 重复步骤2-4,直到所有数据点都被访问过。

二. DBSCAN算法在离群点检测中的应用DBSCAN算法在离群点检测中应用广泛。

例如,在交通流量数据的处理中,可以采用这种密度聚类算法,从而实现智能交通的实时监控和优化。

当出现异常的数据时,可以通过DBSCAN算法将其识别为离群点,从而帮助监控人员及时发现并处理问题。

此外,DBSCAN算法在医疗、金融、食品等行业中也有广泛的应用。

例如,在医疗数据中,离群点可能表明患者数据出现异常,通过DBSCAN算法可以快速检测出患者数据的离群点,从而提高医疗服务的质量。

三. DBSCAN算法的优缺点1. 优点DBSCAN算法不需要预先指定簇的个数,能够自动发现任意形状的簇,同时可以处理噪声。

离群点算法

离群点算法全文共四篇示例,供读者参考第一篇示例:离群点算法(Outlier Detection Algorithm)是一种常见的数据挖掘技术,用于识别数据集中的异常值或离群点。

离群点通常指的是与数据集中的大部分数据分布不同的数据点,可能是错误数据、异常数据或者唯一性数据。

识别和检测离群点可以帮助我们发现数据中的异常情况,进而采取相应的措施进行处理,以保证数据质量和模型准确性。

离群点算法可以分为基于统计方法、基于距离方法、基于密度方法等多种类型。

下面将介绍几种常见的离群点检测算法:1.基于统计方法基于统计方法是通过对数据进行统计分析,判断数据点是否符合某种统计模型来识别离群点。

其中最常用的方法是基于箱线图的离群点检测方法。

箱线图首先计算数据的上四分位数和下四分位数,然后根据四分位数计算出箱线的上下限,超出上下限的数据点被判断为离群点。

2.基于距离方法基于距离方法是通过计算数据点之间的相似性或距离来判断数据点是否为离群点。

其中最常用的方法是LOF(局部离群因子)算法。

LOF 算法通过计算数据点周围邻居数据点的密度与自身密度的比值来判断数据点是否为离群点。

密度比值越小,则数据点越可能是离群点。

3.基于密度方法基于密度方法是通过对数据集进行聚类分析,识别数据集中的高密度区域和低密度区域,从而识别离群点。

其中最常用的方法是DBSCAN(基于密度的空间聚类算法)。

DBSCAN算法通过定义核心对象和边界对象的概念,将数据点划分为核心对象、边界对象和噪声点,从而实现离群点的检测。

除了上述的几种常见离群点检测算法之外,还有一些其他的算法如One-Class SVM、Isolation Forest等也常用于离群点检测。

不同的离群点算法适用于不同的数据场景和问题需求,可以根据实际情况选择合适的算法进行离群点检测。

离群点算法在实际的数据分析和挖掘过程中有着广泛的应用。

在金融领域中,离群点算法可以用于检测信用卡欺诈、异常交易等;在工业生产中,离群点算法可以用于监测设备异常、预测设备故障等;在医学领域中,离群点算法可以用于识别疾病患者的异常生理指标等。

离群点检测方法

离群点检测方法随着大数据时代的到来,数据的规模和复杂度不断增加,数据中的离群点也越来越多。

离群点是指与其他数据点相比,具有明显不同的特征或数值。

在数据分析中,离群点通常被视为异常值,因为它们可能是数据采集或处理中的错误,或者是数据中真正的异常情况。

离群点检测是数据分析中的重要问题,因为它可以帮助我们发现数据中的异常情况,并提高数据分析的准确性和可靠性。

离群点检测方法可以分为基于统计学的方法和基于机器学习的方法两类。

基于统计学的方法是通过假设数据符合某种概率分布,然后计算数据点与该概率分布之间的距离来判断是否为离群点。

常用的基于统计学的方法包括基于均值和标准差的方法、基于中位数和中位绝对偏差的方法、基于箱线图的方法等。

这些方法的优点是简单易懂,计算速度快,但是对于非正态分布的数据不太适用,因为它们假设数据符合某种特定的概率分布。

基于机器学习的方法则是通过训练模型来识别离群点。

这些方法通常需要大量的数据来训练模型,并且需要选择合适的特征和算法来进行训练。

常用的基于机器学习的方法包括基于聚类的方法、基于支持向量机的方法、基于神经网络的方法等。

这些方法的优点是灵活性高,可以适应各种数据分布,但是需要大量的计算资源和时间,以及对算法的选择和参数调整的技术水平要求较高。

在实际应用中,离群点检测方法需要根据具体的数据特征和应用场景来选择。

以下是一些常见的离群点检测方法及其应用场景:基于均值和标准差的方法均值和标准差是统计学中常用的描述数据分布的指标,基于它们的方法是最简单和最常用的离群点检测方法之一。

这种方法假设数据是正态分布的,通过计算数据点与均值的距离来判断是否为离群点。

如果一个数据点的距离超过了均值加上三倍标准差的范围,就可以认为它是离群点。

这种方法适用于数据分布近似正态分布的情况,但是对于非正态分布的数据不太适用。

基于中位数和中位绝对偏差的方法中位数和中位绝对偏差是描述数据分布的另一种统计学指标,它们可以用于检测非正态分布数据中的离群点。

离群点检测算法

离群点检测算法

1 离群点检测算法

离群点检测算法,也称为异常检测,用于识别和分析数据集中新

出现的异常和错误数据值。

它可以帮助数据分析人员分析数据之间的

异常行为并进行响应。

这是一种重要的数据挖掘技术,可以帮助分析

人员发现错误、异常数据和模式,这些数据通常是许多数据挖掘任务

中无法完成的。

离群点检测算法的核心是识别可疑的异常和不自然的数据值,其

中数据值可能比其他数据值显著不同。

它们通常是数据集中的单个离

散数据点。

通过使用离群点检测算法,分析人员可以更好地了解数据,例如,在数据中发现新数据模式,并将不正常的数据过滤掉。

离群点检测的主要步骤包括数据清理、数据可视化和离群点检测。

数据清理是消除数据集中的无用和错误数据,以便更好地了解模型的

输入和输出。

数据可视化包括绘制核密度估计图、箱形图和散点图,

以及多变量关系图,用于更好地分析数据集中的异常行为。

最后,离

群点检测算法可以通过基本离群点检测算法、算法并行算法和网络算法,找出可疑的错误或异常数据点。

离群点检测算法可以帮助分析人员发现和识别异常行为,通过此

技术,分析人员可以更好地理解数据,从而提出更有效的决策。

它是

一种重要的数据挖掘技术,运用它可以发现和过滤掉不正常的数据。

大数据分析中的离群点检测方法比较

大数据分析中的离群点检测方法比较随着大数据技术的不断发展,离群点(Outlier)检测在数据分析领域中扮演着重要的角色。

离群点是指与大部分数据点有明显偏离的观测值,它们可能是数据记录中的错误、异常或罕见事件。

离群点检测在许多领域具有广泛的应用,如网络安全、金融风险评估、医学诊断等。

本文将对几种常见的离群点检测方法进行比较,包括统计学方法、基于距离的方法和机器学习方法。

统计学方法是最早应用于离群点检测的方法之一。

其中最常用的方法是基于正态分布的离群点检测。

该方法假设数据服从正态分布,通过计算观测值与正态分布的距离来确定离群点。

一种常见的方法是使用均值和标准差来测量数据与正态分布之间的差异。

然而,该方法对离群点的分布要求较为严格,对于偏离正态分布的数据或多峰数据分布效果较差。

基于距离的离群点检测方法是另一类常用的方法。

这些方法通过计算数据点之间的距离来确定离群点。

其中一种常见的方法是基于k近邻的离群点检测。

该方法假设离群点周围的邻近点较少,因此测量每个数据点与其k个最近邻点的距离,并根据距离的分布来确定离群点。

然而,该方法对于局部离群点或密集区域中的离群点检测效果较差。

机器学习方法在离群点检测中的应用得到了广泛关注。

这些方法通过训练模型来预测数据点是否为离群点。

其中一种常见的方法是基于异常因子的离群点检测。

该方法使用训练数据拟合模型,然后计算每个数据点与模型之间的差异来确定离群点。

另一种常见的方法是基于聚类的离群点检测,该方法将数据点分为不同的簇,并通过计算数据点与簇中心之间的距离来确定离群点。

机器学习方法能够适应复杂的数据分布,并对多维数据具有较好的效果。

在实际应用中,离群点检测方法的选择取决于数据的特征以及任务的要求。

统计学方法适用于数据服从正态分布且离群点分布较为均匀的情况。

基于距离的方法对于密集区域中的离群点有较好的效果。

机器学习方法则对于复杂的数据分布和多维数据具有较好的适应性。

此外,还有一些集成方法被提出来综合各种离群点检测方法的优点。

基于映射距离比离群因子的离群点检测算法

基于映射距离比离群因子的离群点检测算法张忠平;姚春辰;孙光旭;刘硕;张睿博;魏永辉【期刊名称】《计算机集成制造系统》【年(卷),期】2024(30)5【摘要】针对基于邻近性的离群点检测方法需要花费大量时间过滤正常点,并且在检测全局离群点时难以检测出局部离群点的问题,提出一种基于映射距离比离群因子离群点检测(MDROF)算法。

首先,为了减少正常点在检测过程中的时间消耗,给出了差异相似度的概念,通过定义差异相似度剪枝因子过滤掉数据集中的大部分正常点。

其次,定义映射k距离,通过映射距离与可达距离的比值刻画数据对象的局部离群程度,通过可达密度刻画数据对象的全局离群程度。

最后,结合数据对象相互近邻点的平均排位定义映射距离比离群因子来检测离群点。

在人工数据集以及真实数据集上分别对该算法与其他经典的离群点检测算法在精确率、AUC值和离群点发现曲线上进行实验对比分析。

实验结果证明MDROF算法在离群点检测的准确性和稳定性上明显优于对比算法。

【总页数】14页(P1719-1732)【作者】张忠平;姚春辰;孙光旭;刘硕;张睿博;魏永辉【作者单位】燕山大学信息科学与工程学院;河北省计算机虚拟技术与系统集成重点实验室;武汉理工大学国际教育学院;燕山大学里仁学院;蒙古科技大学信息与通信技术学院【正文语种】中文【中图分类】TP311【相关文献】1.基于聚类离群因子和相互密度的离群点检测算法2.ERDOF:基于相对熵权密度离群因子的离群点检测算法3.基于快速密度峰值聚类离群因子的离群点检测算法4.数据流环境下基于距离的离群点检测算法5.基于期望核密度离群因子的离群点检测算法因版权原因,仅展示原文概要,查看原文内容请购买。

一种基于自然最近邻的离群检测算法

一种基于自然最近邻的离群检测算法

朱庆生;唐汇;冯骥

【期刊名称】《计算机科学》

【年(卷),期】2014(041)003

【摘要】任何涉及k近邻求解问题的算法被应用于处理不同特征的数据集时,参数k值的选择都会明显影响算法的性能和结果.因而,如何选择k近邻算法中敏感参数k值一直是一个研究难点.提出了一种新的近邻关系——自然最近邻,它不需要设置参数k,每个节点的邻居是由算法自适应计算而形成的.针对离群点检测的特殊性,通过确定自然最近邻居搜索算法的终止条件,提出一种基于自然最近邻的新的离群检测算法ODb3N.实验表明,该算法不仅避免了k近邻中参数的选择问题,而且能够更有效地发现离群簇.

【总页数】4页(P276-278,305)

【作者】朱庆生;唐汇;冯骥

【作者单位】重庆大学计算机学院软件理论与技术重庆市重点实验室重庆400044;重庆大学计算机学院软件理论与技术重庆市重点实验室重庆400044;重庆大学计算机学院软件理论与技术重庆市重点实验室重庆400044

【正文语种】中文

【中图分类】TP301;TP391

【相关文献】

1.基于全局最近邻的离群点检测算法 [J], 胡云;施珺;王崇骏;李慧1

2.基于共享最近邻的离群检测算法 [J], 苏晓珂;郑远攀;万仁霞

3.基于自然最近邻的离群检测方法研究 [J], 李士果;卢建云;邓剑勋

4.教育大数据下基于离群检测的教学预警模型探讨——评《基于自然邻居的聚类分析和离群检测算法研究》 [J], 朱震

5.教育大数据下基于离群检测的教学预警模型探讨——评《基于自然邻居的聚类分析和离群检测算法研究》 [J], 朱震

因版权原因,仅展示原文概要,查看原文内容请购买。

lof算法参数

lof算法参数最近,LOF算法参数(Local Outlier Factor)作为离群点检测(Outlier Detection)方法,在数据挖掘及机器学习领域,受到越来越多的关注,它被广泛用于离群点检测、异常检测、相似度比较、网络安全等方面的研究和应用。

LOF算法参数(Local Outlier Factor)首次出现于 2000,是一种基于密度的离群点检测算法,它通过度量每个对象与其邻居之间的相对密度,来识别离群点。

LOF算法可以有效地在多维空间中发现离群点,忽略了数据维度的影响,这使得它能够应用于各种复杂的数据模型中。

为了使LOF算法参数更加有效,一般会首先通过聚类、特征选择和特征预处理等技术来对待检测的数据进行预处理,然后再运用LOF算法对数据进行离群点检测。

LOF算法主要包括三个参数:k值,MinPts,以及。

k值(K)是指每个点都要计算其k个最近邻居,k值越小,就会拉大离群点和正常点之间的差异,这样就可以使检测离群点更容易,但是这也可能导致检测误差大。

MinPts(Minimum Points)是指对一个点来说,算法认为它是离群点的最低标准,也就是它需要至少有MinPts个距离比自身距离大的点,才能被认为是离群点,它的值一般比k值大。

β(β)是指当一个点的k个邻居的距离比自身距离还小,且至少小于,就认为它是离群点,值大小会影响模型所发现的离群点数量和准确度。

另外,LOF算法参数还包括一种可以帮助确定 k以及 MinPts方法,即Nested Density Estimation(NDE),该方法可以快速、准确地计算出离群点的概率,从而帮助确定最合适的 kMinPts。

总的来说,LOF算法参数的使用可以有效的检测出复杂的数据集中的离群点,正确设置LOF算法参数十分重要,既可以更准确、减小误差,也可以提高检测算法的效率。

以上就是有关LOF算法参数的详细介绍,希望能够为你提供帮助。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Data Base Technique •

数据库技术

Electronic Technology & Software Engineering 电子技术与软件工程• 145

【关键词】离群点 邻域 质心 不稳定因子

离群点是指那些明显偏离其它数据、不满足数据的一般模式或行为,与存在的其它数据不一致的数据。

物理学中质心与稳定性间存在联系,离质心越近的点,稳定性越强,反之稳定性越弱。

Jihyun Ha 等人受这一性质的启发提出了使用不稳定因子的健壮离群点检测算法(INS 算法)。

该算法容易将处于稀疏区域与稠密区域的交界处的正常点误判为离群点。

为解决该问题本文提出了基于近邻稳定性的离群点检测算法(NSINS 算法)。

1 基于近邻稳定性的离群点检测算法

1.1 算法思想

本文提出了基于近邻稳定性的离群点检测算法。

该算法的主要思想是:数据集中任意一点p 的k 个最近邻组成p 的k 个邻域,其中第i 个邻域包含了p 和距离p 最近的前i 个点。

每个邻域计算两个质心。

一个质心与p 相关,即邻域中包括点p 时的质心;另一个质心与p 无关,即邻域中不包括点p 时的质心。

最后会得到两类质心,每类都有k 个。

比较这两类质心的位置变化,最终确定p 的不稳定程度。

定义与p 无关的质心考虑到了近邻的稳定性对p 不稳定因子的影响。

1.2 相关定义

定义1 邻域(neighborhood )。

点p 的邻域表示距离点p 最近的k 个点的集合,用ϭk (p)表示,即:

(1)

其中d(p,q)表示p ,q 之间的距离,p k 是

基于近邻稳定性的离群点检测算法

文/黄馨玉1 陈晓东2

p 的第k 个最近邻。

当P 点计入ϭk (p)中时,

ϭk (p)的基数是k+1;当p 点不计入ϭk (p)中时,

ϭk (p)的基数是k 。

定义2 相关邻域质心(related centre of mass)。

点p 的相关邻域质心表示p 的邻域包括点p 时的质心,用rm k (p)表示:

(2)

其中X q =(x q1,...,x qd )是点q 在d 维空间中

的坐标。

定义3 无关邻域质心(unrelated centre of mass)。

点p 的无关邻域质心表示p 的邻域不含p 时的质心,用urm k (p)表示:

(3)

其中点q 代表第k 个邻域中除p 以外的任意一点,X q =(x 1,…,x d )是点q 在d 维空间中的坐标

定义4 相关质心距离(distance of related center mass )。

相关质心距离表示两个相邻的相关质心之间的距离。

用rm_d i (p)

表示:(4)

定义5 无关质心距离(distance of unrelated center mass )。

无关质心距离表示两个相邻的无关质心之间的距离。

用urm_d i (p)

表示:

(5)

定义6 不稳定因子(instability factor )不稳定因子定义为相关质心距离之和与无关质心距离之和的比,用INSF 表示:

(6)INSF(P)值为1,说明p 与邻域内各点均匀分布;值大于1,说明p 的加入使得邻域质心的变化加剧,从而说明p 的不稳性较强;值小

于1,说明p 的加入使得邻域质心的变化减缓,从而说明p 的稳定性较强。

比值越大,p 离群

可能性越高。

2 实例分析

数据集采用INS 算法中的葡萄酒质量数据集。

该数据集包括1599个红葡萄酒样本数据和4898个白葡萄酒样本数据。

品质差的葡萄酒和品质高的葡萄酒数据量很少,是离群点检测的目标。

红葡萄酒数据集中K 取值50时,INS 准确率88.9%,NSINS 准确率94.4%;K 取值100时,INS 准确率88.9%,NSINS 准确率100%。

白葡萄酒数据集中K 取值50时,INS 准确率65%,NSINS 准确率85%;K 取值100时,INS 准确率70%,NSINS 准确率80%。

3 结束语

本文提出的算法改进了使用不稳定因子的健壮离群点检测算法,考虑到了近邻的稳定性对被检测点的影响,该算法综合两类质心的变化情况来决定不稳定因子大小。

在数据集分布不规则的情况下优势明显。

参考文献

[1]Xia Huo-Song. Data warehouse and

data mining technolo [M]. Beijing: Science Press, 2004: 229-231.

[2]Jihyun Ha, Seulgi Seok, Jong-Seok

Lee.Robust outlier detection using the instability factor[J]. Knowledge-Based Systems. 2014(63):15–23.

作者简介

黄馨玉(1990-),女,天津市人。

硕士研究生。

研究方向为数据挖掘。

陈晓东(1986-),男,天津市人。

大学本科学历。

从事工作软件开发。

作者单位

1.天津市农业资源与环境研究所 天津市 300380

2.渤海银行 天津市 300171。