基于MATLAB的BP神经网络应用 2

(完整版)BP神经网络matlab实例(简单而经典).doc

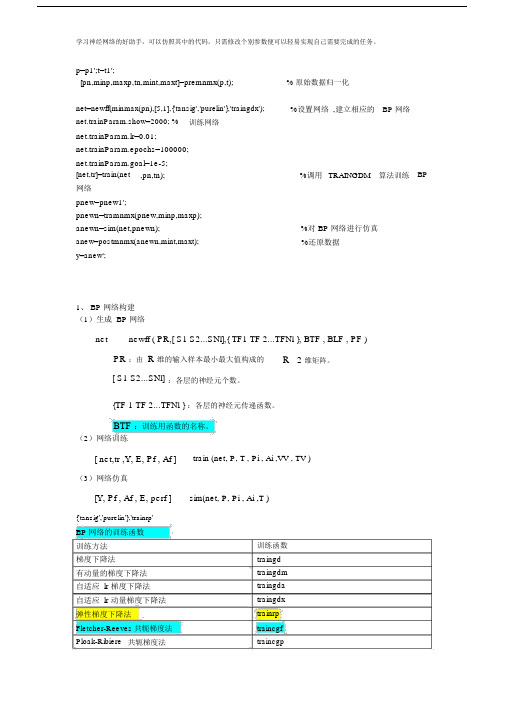

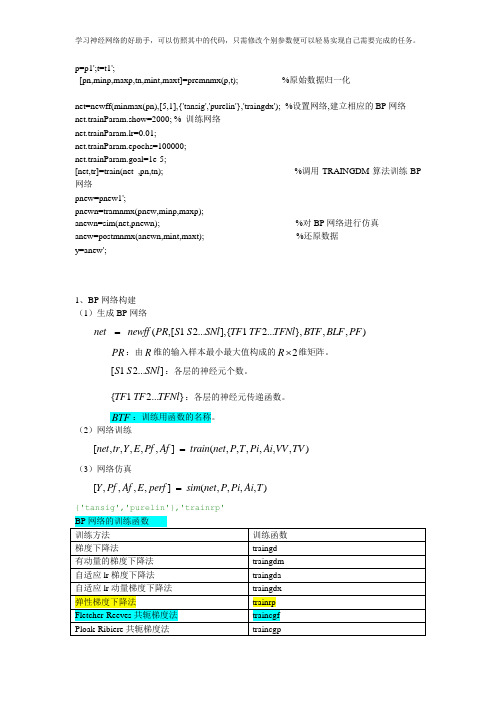

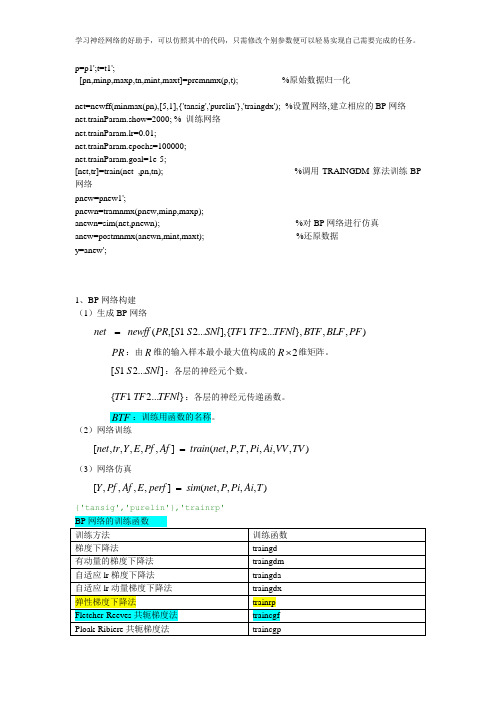

p=p1';t=t1';[pn,minp,maxp,tn,mint,maxt]=premnmx(p,t); % 原始数据归一化net=newff(minmax(pn),[5,1],{'tansig','purelin'},'traingdx'); %设置网络,建立相应的BP 网络net.trainParam.show=2000; % 训练网络net.trainParam.lr=0.01;net.trainParam.epochs=100000;net.trainParam.goal=1e-5;[net,tr]=train(net ,pn,tn); %调用TRAINGDM 算法训练BP 网络pnew=pnew1';pnewn=tramnmx(pnew,minp,maxp);anewn=sim(net,pnewn);anew=postmnmx(anewn,mint,maxt); %对 BP 网络进行仿真%还原数据y=anew';1、 BP 网络构建(1)生成 BP 网络net newff ( PR,[ S1 S2...SNl],{ TF1 TF 2...TFNl }, BTF , BLF , PF ) PR :由R 维的输入样本最小最大值构成的R 2 维矩阵。

[ S1 S2...SNl] :各层的神经元个数。

{TF 1 TF 2...TFNl } :各层的神经元传递函数。

BTF :训练用函数的名称。

(2)网络训练[ net,tr ,Y, E, Pf , Af ] train (net, P, T , Pi , Ai ,VV , TV )(3)网络仿真[Y, Pf , Af , E, perf ] sim(net, P, Pi , Ai ,T ){'tansig','purelin'},'trainrp'BP 网络的训练函数训练方法梯度下降法有动量的梯度下降法自适应 lr 梯度下降法自适应 lr 动量梯度下降法弹性梯度下降法训练函数traingd traingdm traingda traingdx trainrpFletcher-Reeves 共轭梯度法traincgf Ploak-Ribiere 共轭梯度法traincgpPowell-Beale 共轭梯度法traincgb 量化共轭梯度法trainscg 拟牛顿算法trainbfg 一步正割算法trainoss Levenberg-Marquardt trainlmBP 网络训练参数训练参数net.trainParam.epochsnet.trainParam.goal net.trainParam.lrnet.trainParam.max_fail net.trainParam.min_grad net.trainParam.show net.trainParam.timenet.trainParam.mc net.trainParam.lr_inc 参数介绍最大训练次数(缺省为10)训练要求精度(缺省为0)学习率(缺省为0.01 )最大失败次数(缺省为5)最小梯度要求(缺省为1e-10)显示训练迭代过程( NaN 表示不显示,缺省为 25)最大训练时间(缺省为inf )动量因子(缺省0.9)学习率lr增长比(缺省为1.05)训练函数traingd 、traingdm 、traingda 、traingdx 、 trainrp 、 traincgf 、traincgp 、traincgb 、trainscg、trainbfg 、 trainoss、 trainlmtraingd 、traingdm 、traingda 、traingdx 、 trainrp 、 traincgf 、traincgp 、traincgb 、trainscg、trainbfg 、 trainoss、 trainlmtraingd 、traingdm 、traingda 、traingdx 、 trainrp 、 traincgf 、traincgp 、traincgb 、trainscg、trainbfg 、 trainoss、 trainlmtraingd 、traingdm 、traingda 、traingdx 、 trainrp 、 traincgf 、traincgp 、traincgb 、trainscg、trainbfg 、 trainoss、 trainlmtraingd 、traingdm 、traingda 、traingdx 、 trainrp 、 traincgf 、traincgp 、traincgb 、trainscg、trainbfg 、 trainoss、 trainlmtraingd 、traingdm 、traingda 、traingdx 、 trainrp 、 traincgf 、traincgp 、traincgb 、trainscg、trainbfg 、 trainoss、 trainlmtraingd 、traingdm 、traingda 、traingdx 、 trainrp 、 traincgf 、traincgp 、traincgb 、trainscg、trainbfg 、 trainoss、 trainlmtraingdm 、 traingdx traingda 、traingdxnet.trainParam.lr_dec 学习率 lr 下降比(缺省为 0.7) traingda 、 traingdxnet.trainParam.max_perf_inc 表现函数增加最大比(缺省traingda 、 traingdx为 1.04)net.trainParam.delt_inc 权值变化增加量(缺省为trainrp1.2)net.trainParam.delt_dec 权值变化减小量(缺省为trainrp0.5)net.trainParam.delt0 初始权值变化(缺省为 0.07) trainrpnet.trainParam.deltamax 权值变化最大值(缺省为trainrp50.0)net.trainParam.searchFcn 一维线性搜索方法(缺省为traincgf 、traincgp 、traincgb 、srchcha)trainbfg 、 trainossnet.trainParam.sigma 因为二次求导对权值调整的trainscg影响参数(缺省值 5.0e-5)mbda Hessian 矩阵不确定性调节trainscg参数(缺省为 5.0e-7)net.trainParam.men_reduc 控制计算机内存/ 速度的参trainlm量,内存较大设为1,否则设为 2(缺省为 1)net.trainParam.mu 的初始值(缺省为0.001) trainlmnet.trainParam.mu_dec 的减小率(缺省为0.1)trainlmnet.trainParam.mu_inc 的增长率(缺省为10)trainlmnet.trainParam.mu_max 的最大值(缺省为1e10)trainlm2、 BP 网络举例举例 1、%traingdclear;clc;P=[-1 -1 2 2 4;0 5 0 5 7];T=[-1 -1 1 1 -1];%利用 minmax函数求输入样本范围net = newff(minmax(P),T,[5,1],{'tansig','purelin'},'trainrp');net.trainParam.show=50;%net.trainParam.lr=0.05;net.trainParam.epochs=300;net.trainParam.goal=1e-5;[net,tr]=train(net,P,T);net.iw{1,1}%隐层权值net.b{1}%隐层阈值net.lw{2,1}%输出层权值net.b{2}%输出层阈值sim(net,P)BP 神经网络来完成非线性函数的逼近任务,其中隐层神经元个数为五个。

基于Matlab的改进BP神经网络及其应用

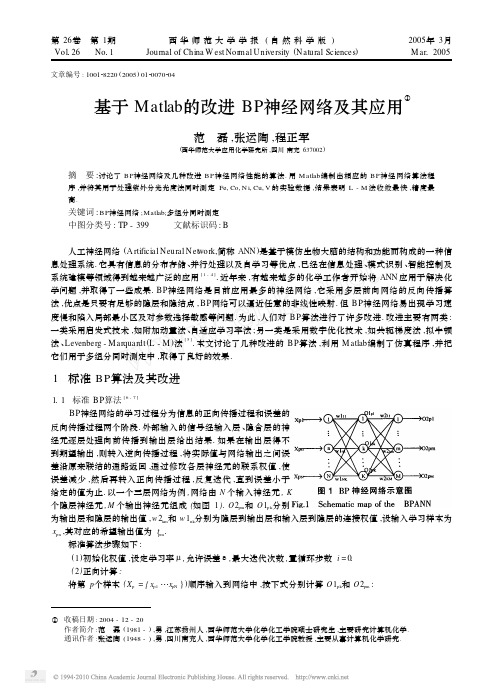

关键词 : BP神经网络 ; M atlab;多组分同时测定 中图分类号 : TP - 399 文献标识码 : B 人工神经网络 (A rtificial Neural Network,简称 ANN )是基于模仿生物大脑的结构和功能而构成的一种信 息处理系统 . 它具有信息的分布存储 、 并行处理以及自学习等优点 ,已经在信息处理 、 模式识别 、 智能控制及 [1 - 4] 系统建模等领域得到越来越广泛的应用 . 近年来 , 有越来越多的化学工作者开始将 ANN 应用于解决化 学问题 ,并取得了一些成果 . BP 神经网络是目前应用最多的神经网络 , 它采用多层前向网络的反向传播算 法 ,优点是只要有足够的隐层和隐结点 , BP 网络可以逼近任意的非线性映射 . 但 B P 神经网络易出现学习速 度慢和陷入局部最小区及对参数选择敏感等问题 . 为此 ,人们对 B P 算法进行了许多改进 . 改进主要有两类 : 一类采用启发式技术 ,如附加动量法 、 自适应学习率法 ; 另一类是采用数字优化技术 ,如共轭梯度法 ,拟牛顿 [5] 法、 Levenberg - M arquardt (L - M )法 . 本文讨论了几种改进的 BP 算法 , 利用 M atlab 编制了仿真程序 , 并把 它们用于多组分同时测定中 ,取得了良好的效果 .

p

Δw 1nk ( i + 1 ) = μ∑ δ pk ( i) xpn .

p = 1

( 3) ( 4) ( 5) ( 6)

Δw 2km ( i + 1 ) = μ∑ δ pm ( i) O 1pk ( i) . 而 δ pm ( i) = ( t pm - O 2pm ( i) ) O 2pm ( i) ( 1 - O 2pm ( i) ) .

基于matlab实现BP神经网络模型仿真

基于BP神经网络模型及改进模型对全国历年车祸次数预测一、背景我国今年来随着经济的发展,汽车需求量不断地增加,所以全国每年的车祸次数也被越来越被关注,本文首先搜集全国历年车祸次数,接着通过这些数据利用BP神经网络模型和改进的径向基函数网络进行预测,最后根据预测结果,分析模型的优劣,从而达到深刻理解BP神经网络和径向基函数网络的原理及应用。

文中所用到的数据即全国历年车祸次数来自中国汽车工业信息网,网址如下:/autoinfo_cn/cszh/gljt/qt/webinfo/2006/05/124650 1820021204.htm制作历年全国道路交通事故统计表如下所示:二、问题研究(一)研究方向(1)通过数据利用BP神经网络模型预测历年全国交通事故次数并与实际值进行比较。

(2)分析BP神经网络模型改变训练函数再进行仿真与之前结果进行对比。

(3)从泛化能力和稳定性等方面分析BP神经网络模型的优劣。

(4)利用径向基函数网络模型进行仿真,得到结果与采用BP神经网络模型得到的结果进行比较。

(二)相关知识(1)人工神经网络人工神经网络是一种应用类似于大脑神经突触联接的结构进行信息处理的数学模型。

在工程与学术界也常直接简称为神经网络或类神经网络。

神经网络是一种运算模型,由大量的节点(或称神经元)和之间相互联接构成。

每个节点代表一种特定的输出函数,称为激励函数(activation function)。

每两个节点间的连接都代表一个对于通过该连接信号的加权值,称之为权重,这相当于人工神经网络的记忆。

网络的输出则依网络的连接方式,权重值和激励函数的不同而不同。

而网络自身通常都是对自然界某种算法或者函数的逼近,也可能是对一种逻辑策略的表达。

人工神经网络有以下几个特征:(1)非线性非线性关系是自然界的普遍特性。

大脑的智慧就是一种非线性现象。

人工神经元处于激活或抑制二种不同的状态,这种行为在数学上表现为一种非线性网络关系。

基于MATLAB的BP神经网络应用 2

目录1绪论 (1)1.1人工神经网络的研究背景和意义 (1)1.2神经网络的发展与研究现状 (2)1.3神经网络的研究内容和目前存在的问题 (3)1.4神经网络的应用 (4)2神经网络结构及BP神经网络 (4)2.1神经元与网络结构 (4)2.2BP神经网络及其原理 (7)2.3BP神经网络的主要功能 (9)2.4BP网络的优点以及局限性 (9)3BP神经网络在实例中的应用 (10)3.1基于MATLAB的BP神经网络工具箱函数 (10)3.2BP网络在函数逼近中的应用 (12)3.3BP网络在样本含量估计中的应用 (17)4结束语 (23)参考文献: (24)英文摘要 (25)致谢 (26)基于MATLAB的BP神经网络应用蒋亮亮南京信息工程大学滨江学院自动化专业,南京210044摘要:本文首先说明课题研究的目的和意义,评述课题的国内外研究现状,引出目前存在的问题。

然后分析了神经网络算法的基本原理,给出经典神经网络算法的具体实现方法,总结神经网络算法的特点,并给出神经网络算法的基本流程。

采用Matlab软件编程实现BP神经网络算法。

将神经网络算法应用于函数逼近和样本含量估计问题中,并分析相关参数对算法运行结果的影响。

最后对BP神经网络算法进行了展望。

关键词:神经网络;BP神经网络;函数逼近1绪论人工神经网络(Artificial Neural Networks,NN)是由大量的、简单的处理单元(称为神经元)广泛地互相连接而形成的复杂网络系统,它反映了人脑功能的许多基本特征,是一个高度复杂的非线性动力学系统[1]。

神经网络具有大规模并行、分布式存储和处理、自组织、自适应和自学习能力,特别适合处理需要同时考虑许多因素和条件的、不精确和模糊的信息处理问题。

神经网络的发展与神经科学、数理科学、认知科学、计算机科学、人工智能、信息科学、控制论、机器人学、微电子学、心理学、微电子学、心理学、光计算、分子生物学等有关,是一门新兴的边缘交叉学科。

基于MATLAB的BP神经网络实现研究

方法与实验设计

基于MATLAB的BP神经网络实现主要包括以下几个步骤:

1、数据预处理:首先需要对数据进行预处理,包括数据清洗、归一化等操 作。

2、网络设计:根据问题特点选择合适的网络结构,并确定输入层、输出层 和隐藏层的节点数。

3、训练模型:使用MATLAB中的神经网络工具箱进行模型训练。

2、在防止过拟合方面,可以研究更有效的正则化方法和技术,以避免模型 在训练过程中产生过拟合问题。

3、在网络结构设计方面,可以研究更加智能的自适应网络结构设计方法, 以简化人工设计网络的复杂度。

4、可以进一步拓展BP神经网络在其他领域的应用研究,例如自然语言处理、 生物信息学等。

谢谢观看

结论与展望

本次演示研究了基于MATLAB的BP神经网络实现方法,通过实验设计和实验结 果分析,可以得出以下结论:

1、BP神经网络在解决分类、逼近和优化等问题方面具有较好的性能,证实 了其在实际应用中的价值。

2、在超参数调整方面,学习率和迭代次数对模型性能具有重要影响,需要 根据实际问题进行调整。

2、函数逼近:BP神经网络可以用于逼近复杂的非线性函数。例如,在控制 系统、信号处理等领域,可以利用BP神经网络对系统进行建模和预测。

3、优化问题:BP神经网络可以应用于求解各种优化问题。例如,利用BP神 经网络实现函数的最小化、多目标优化等。

然而,目前的研究还存在着一些问题。首先,由于BP神经网络的训练速度较 慢,可能需要进行大量的迭代才能得到较好的结果。其次,BP神经网络的训练过 程中容易出现过拟合问题,这可能导致模型的泛化能力下降。最后,BP神经网络 的性能受到初始参数的影响较大,如何选择合适的参数也是亟待解决的问题。

4、模型评估与优化:通过验证数据集评估模型的性能,并进行参数调整和 优化。

BP神经网络在Matlab函数逼近中的应用

燕山大学模式识别与智能系统导论题目: BP网络在函数逼近中的应用专业:控制工程姓名: X X X 学号:一BP神经网络及其原理............................................................ - 1 -1.1 BP神经网络定义............................................................. - 1 -1.2 BP神经网络模型及其基本原理..................................... - 1 -1.3 BP神经网络的主要功能................................................. - 3 -1.4 BP网络的优点以及局限性............................................. - 3 - 二基于MATLAB的BP神经网络工具箱函数 ........................ - 6 -2.1 BP网络创建函数............................................................. - 7 -2.2 神经元上的传递函数...................................................... - 7 -2.3 BP网络学习函数............................................................. - 8 -2.4 BP网络训练函数............................................................. - 9 - 三BP网络在函数逼近中的应用.............................................. - 10 -3.1 问题的提出.................................................................... - 10 -3.2 基于BP神经网络逼近函数......................................... - 10 -3.3 不同频率下的逼近效果................................................ - 14 -3.4 讨论................................................................................ - 17 -一BP神经网络及其原理1.1 BP神经网络定义BP (Back Propagation)神经网络是一种神经网络学习算法。

MATLAB神经网络(2)BP神经网络的非线性系统建模——非线性函数拟合

MATLAB神经⽹络(2)BP神经⽹络的⾮线性系统建模——⾮线性函数拟合2.1 案例背景在⼯程应⽤中经常会遇到⼀些复杂的⾮线性系统,这些系统状态⽅程复杂,难以⽤数学⽅法准确建模。

在这种情况下,可以建⽴BP神经⽹络表达这些⾮线性系统。

该⽅法把未知系统看成是⼀个⿊箱,⾸先⽤系统输⼊输出数据训练BP神经⽹络,使⽹络能够表达该未知函数,然后⽤训练好的BP神经⽹络预测系统输出。

本章拟合的⾮线性函数为y=x12+x22该函数的图形如下图所⽰。

t=-5:0.1:5;[x1,x2] =meshgrid(t);y=x1.^2+x2.^2;surfc(x1,x2,y);shading interpxlabel('x1');ylabel('x2');zlabel('y');title('⾮线性函数');2.2 模型建⽴神经⽹络结构:2-5-1从⾮线性函数中随机得到2000组输⼊输出数据,从中随机选择1900 组作为训练数据,⽤于⽹络训练,100组作为测试数据,⽤于测试⽹络的拟合性能。

2.3 MATLAB实现2.3.1 BP神经⽹络⼯具箱函数newffBP神经⽹络参数设置函数。

net=newff(P, T, S, TF, BTF, BLF, PF, IPF, OPF, DDF)P:输⼊数据矩阵;T:输出数据矩阵;S:隐含层节点数;TF:结点传递函数。

包括硬限幅传递函数hardlim、对称硬限幅传递函数hardlims、线性传递函数purelin、正切型传递函数tansig、对数型传递函数logsig;x=-5:0.1:5;subplot(2,6,[2,3]);y=hardlim(x);plot(x,y,'LineWidth',1.5);title('hardlim');subplot(2,6,[4,5]);y=hardlims(x);plot(x,y,'LineWidth',1.5);title('hardlims');subplot(2,6,[7,8]);y=purelin(x);plot(x,y,'LineWidth',1.5);title('purelin');subplot(2,6,[9,10]);y=tansig(x);plot(x,y,'LineWidth',1.5);title('tansig');subplot(2,6,[11,12]);y=logsig(x);plot(x,y,'LineWidth',1.5);title('logsig');BTF:训练函数。

基于MATLAB神经网络工具箱的BP网络实现

2 BP 网络模型

BP 网 络是一种多层前馈神经 网络 , 由输入 层 、隐层和 输 出层组成 。 层与层之间采用全互连方式 , 同一层 之间不存 在 相互连接 , 隐层可以 有一个 或多 个 。 构造 一个 BP 网 络需 要

收稿日期 :2003 -03 -06

确定其 处 理单 元 ——— — 神 经元 的 特 性和 网 络的 拓 扑结 构 。 神经元是神经网络最基本的处理单元 , 隐层中 的神经元采 用 S 型变换 函数 , 输出层的 神经元可采 用 S 型或线 性型变换 函 数 。 图 1 为一个典型的三层 BP 网络的拓扑结构 。

其中 :PR 是一个 由每 个输 入向 量 的最 大最 小值 构成 的 Rx2 矩阵 , R 为输入神经元数目 。

Si 是第 i 层网络的神经元个 数 , 网络共有 N1 层 。 TFi 是第 i 层网络神经元的变换函数 , 缺省为 tansig . BTF 是 BP 训练算法函数 , 缺省为 trainlm. BLF 是学习函数 , 缺省为 learngdm. PF 是性能函数 , 缺省为 mse . newff 在确定网络结构 后会 自动调 用初 始化 函数 init , 用 缺省参数来初始化网络中各个权值和阈值 , 产生 一个可训 练 的前馈网络 , 即该函数的 返回值 net。 在 MATLAB 中 , 神经 网 络 net 当做对象(object)处理 , 其属性用结构来定义 。 3)初始化函数 init :它是 对网 络的 连接 权值 和阈 值进 行 初始化 。 newff 在 创建 网络 对象 的 同时 , 自 动 调动 初始 化 函 数 , 根据缺省的参数对网络进行连接权值和阈 值初始化 。 4)学习函数 :提供多种学习函数 , 用来修 正权值和 阈值 。 基本的学习函数有 :learngd 、 learngdm。 5)性能函数 :它是用来计算网络 的输出误差 。 为训练 提 供判据 , 包 括 :函 数 mae , 计 算网 络 的 平 均 绝 对 误 差 ;函 数 mse, 计算网络的均方误差 ;函 数 msereg , 计算 均方误差 和权/ 阈值的加权 ;函数 sse , 计算网络的均方误差和 。 6)训练函数 train : BP 网 络的训练初始化后 , 可对 它进行训练 。 在 MATLAB 中训练网络有两类模式 :逐变模式 和批处理 模式 。 在逐变 模 式中 , 每输入一个学习样本就根据网 络性能指标 函数对连 接 权值和阈值更新一次 。 在批处理模式中 , 所有的 学习样本 都 学习完成后 , 连接权值和阈值才被 更新一次 。 使 用批处理 模 式不需要为每一层的连接权值和阈值设定 训练函数 , 而只 需 为整个网络指定 一个 训练 函数 , 使用 起来 相对方 便 , 而且 许 多改进的快速训练算法只能采用批处理模式 。 训练网 络 的 函 数 是 train 按 设 置 的 net.trainFcn 和 net. trainParam 参数来 训练网络 , 采用批处理方式进行网络的权 值 和阈值修正 , 最终达到设定的网络性能指标的 要求 。 7)BP 训练算法函数 :它是 根据网络 的输入 、目 标期望 输 出 , 对由 函数 newff 生成的 BP 网络 进行计 算 , 修正其 权值 和 阈值 , 最终达到设定的网络性能指 标的要求 。 不 同的训练 算 法函数对应不同的训练算法 , 如 traingd 对应最基 本梯度下 降 法 ;traingdm 带有动量 项 的梯 度下 降法 ;traingdx 带有 采用 动

(完整版)BP神经网络matlab实例(简单而经典)

p=p1';t=t1';[pn,minp,maxp,tn,mint,maxt]=premnmx(p,t); %原始数据归一化net=newff(minmax(pn),[5,1],{'tansig','purelin'},'traingdx');%设置网络,建立相应的BP网络net.trainParam.show=2000; % 训练网络net.trainParam.lr=0.01;net.trainParam.epochs=100000;net.trainParam.goal=1e-5;[net,tr]=train(net ,pn,tn); %调用TRAINGDM算法训练BP 网络pnew=pnew1';pnewn=tramnmx(pnew,minp,maxp);anewn=sim(net,pnewn); %对BP网络进行仿真anew=postmnmx(anewn,mint,maxt); %还原数据y=anew';1、BP网络构建(1)生成BP网络=net newff PR S S SNl TF TF TFNl BTF BLF PF(,[1 2...],{ 1 2...},,,)PR:由R维的输入样本最小最大值构成的2R⨯维矩阵。

S S SNl:各层的神经元个数。

[ 1 2...]{ 1 2...}TF TF TFNl:各层的神经元传递函数。

BTF:训练用函数的名称。

(2)网络训练[,,,,,] (,,,,,,)=net tr Y E Pf Af train net P T Pi Ai VV TV(3)网络仿真=[,,,,] (,,,,)Y Pf Af E perf sim net P Pi Ai T{'tansig','purelin'},'trainrp'2、BP网络举例举例1、%traingdclear;clc;P=[-1 -1 2 2 4;0 5 0 5 7];T=[-1 -1 1 1 -1];%利用minmax函数求输入样本范围net = newff(minmax(P),T,[5,1],{'tansig','purelin'},'trainrp');net.trainParam.show=50;%net.trainParam.lr=0.05;net.trainParam.epochs=300;net.trainParam.goal=1e-5;[net,tr]=train(net,P,T);net.iw{1,1}%隐层权值net.b{1}%隐层阈值net.lw{2,1}%输出层权值net.b{2}%输出层阈值sim(net,P)举例2、利用三层BP神经网络来完成非线性函数的逼近任务,其中隐层神经元个数为五个。

BP神经网络matlab实现和matlab工具箱使用实例

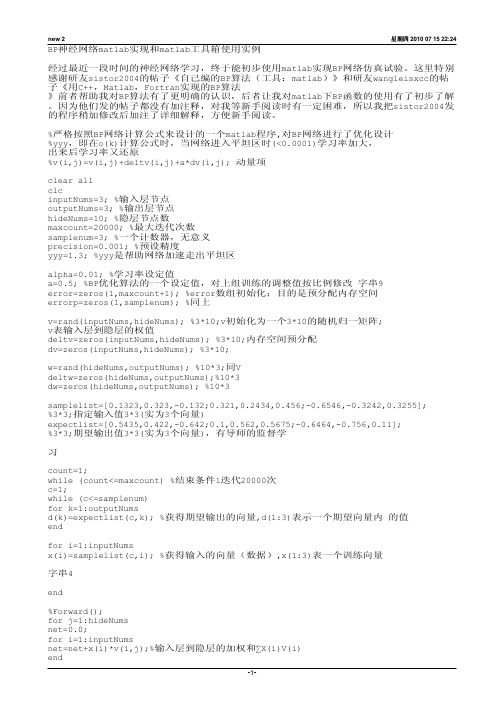

samplelist=[0.1323,0.323,-0.132;0.321,0.2434,0.456;-0.6546,-0.3242,0.3255]; %3*3;上设输输作3*3(实作3和网网) expectlist=[0.5435,0.422,-0.642;0.1,0.562,0.5675;-0.6464,-0.756,0.11]; %3*3;星也输也作3*3(实作3和网网),如输有的有有学

num1=5; %设隐设稍 num2=10000; %最也迭迭迭稍 a1=0.02; %星也显显 a2=0.05; %学学学

test=randn(1,5)*0.5; %网网网稍5和个个作 in=-1:.1:1; %训训作 expout=[-.9602 -.5770 -.0729 .3771 .6405 .6600 .4609 .1336 -.2013 -.4344 -.5000 -.3930 -.1647 .0988 .3072 .3960 .3449 .1816

%p,t作作我我训训输输,pp作作训训虚的我我输输网网,最然的ww作作pp神经训训虚的BP训 训然的输也

function ww=bpnet(p,t,ynum,maxnum,ex,lr,pp) plot(p,t,"+"); title("训训网网"); xlabel("P"); ylabel("t"); [w1,b1,w2,b2]=initff(p,ynum,"tansig",t,"purelin"); %我我我初稍和设设的BP我我 zhen=25; %每迭迭每每迭每稍显显 biglr=1.1; %学学学使学学学(和也用也用用用) litlr=0.7; %学学学使学学学(梯梯然梯经学使) a=0.7 %动网动a也也(△W(t)=lr*X*ん+a*△W(t-1)) tp=[zhen maxnum ex lr biglr litlr a 1.04]; %trainbpx [w1,b1,w2,b2,ep,tr]=trainbpx(w1,b1,"tansig",w2,b2,"purelin",p,t,tp);

(完整版)BP神经网络matlab实例(简单而经典)

p=p1';t=t1';[pn,minp,maxp,tn,mint,maxt]=premnmx(p,t); %原始数据归一化net=newff(minmax(pn),[5,1],{'tansig','purelin'},'traingdx');%设置网络,建立相应的BP网络net.trainParam.show=2000; % 训练网络net.trainParam.lr=0.01;net.trainParam.epochs=100000;net.trainParam.goal=1e-5;[net,tr]=train(net ,pn,tn); %调用TRAINGDM算法训练BP 网络pnew=pnew1';pnewn=tramnmx(pnew,minp,maxp);anewn=sim(net,pnewn); %对BP网络进行仿真anew=postmnmx(anewn,mint,maxt); %还原数据y=anew';1、BP网络构建(1)生成BP网络=net newff PR S S SNl TF TF TFNl BTF BLF PF(,[1 2...],{ 1 2...},,,)PR:由R维的输入样本最小最大值构成的2R⨯维矩阵。

S S SNl:各层的神经元个数。

[ 1 2...]{ 1 2...}TF TF TFNl:各层的神经元传递函数。

BTF:训练用函数的名称。

(2)网络训练[,,,,,] (,,,,,,)=net tr Y E Pf Af train net P T Pi Ai VV TV(3)网络仿真=[,,,,] (,,,,)Y Pf Af E perf sim net P Pi Ai T{'tansig','purelin'},'trainrp'2、BP网络举例举例1、%traingdclear;clc;P=[-1 -1 2 2 4;0 5 0 5 7];T=[-1 -1 1 1 -1];%利用minmax函数求输入样本范围net = newff(minmax(P),T,[5,1],{'tansig','purelin'},'trainrp');net.trainParam.show=50;%net.trainParam.lr=0.05;net.trainParam.epochs=300;net.trainParam.goal=1e-5;[net,tr]=train(net,P,T);net.iw{1,1}%隐层权值net.b{1}%隐层阈值net.lw{2,1}%输出层权值net.b{2}%输出层阈值sim(net,P)举例2、利用三层BP神经网络来完成非线性函数的逼近任务,其中隐层神经元个数为五个。

BP神经网络matlab实例(简单而经典)

p=p1';t=t1';[pn,minp,maxp,tn,mint,maxt]=premnmx(p,t); %原始数据归一化net=newff(minmax(pn),[5,1],{'tansig','purelin'},'traingdx'); %设置网络,建立相应的BP 网络net.trainParam.show=2000; % 训练网络net.trainParam.lr=0.01;net.trainParam.epochs=100000;net.trainParam.goal=1e-5;[net,tr]=train(net ,pn,tn); %调用TRAINGDM算法训练BP网络pnew=pnew1';pnewn=tramnmx(pnew,minp,maxp);anewn=sim(net,pnewn); %对BP网络进行仿真anew=postmnmx(anewn,mint,maxt); %还原数据y=anew';1、BP网络构建(1)生成BP网络(,[1 2...],{ 1 2...},,,) net newff PR S S SNl TF TF TFNl BTF BLF PFPR:由R维的输入样本最小最大值构成的2R⨯维矩阵。

S S SNl:各层的神经元个数。

[ 1 2...]TF TF TFNl:各层的神经元传递函数。

{ 1 2...}BTF:训练用函数的名称。

(2)网络训练=[,,,,,] (,,,,,,)net tr Y E Pf Af train net P T Pi Ai VV TV (3)网络仿真=Y Pf Af E perf sim net P Pi Ai T[,,,,] (,,,,){'tansig','purelin'},'trainrp'BP网络的训练函数BP网络训练参数2、BP网络举例举例1、%traingdclear;clc;P=[-1 -1 2 2 4;0 5 0 5 7];T=[-1 -1 1 1 -1];%利用minmax函数求输入样本范围net = newff(minmax(P),[5,1],{'tansig','purelin'},'trainrp');net.trainParam.show=50;%net.trainParam.lr=0.05;net.trainParam.epochs=300;net.trainParam.goal=1e-5;[net,tr]=train(net,P,T);net.iw{1,1}%隐层权值net.b{1}%隐层阈值net.lw{2,1}%输出层权值net.b{2}%输出层阈值sim(net,P)举例2、利用三层BP神经网络来完成非线性函数的逼近任务,其中隐层神经元个数为五个。

基于MATLAB的BP神经网络设计

基于MAT LAB的BP神经网络设计3孙 帆 施学勤(华中科技大学控制科学与工程系 武汉 430074)摘 要 BP神经网络已广泛应用于非线性建摸、函数逼近、系统辨识等方面,但对实际问题,其模型结构需由实验确定,无规律可寻。

简要介绍利用MAT LAB语言进行BP网络建立、训练、仿真的方法及注意事项。

关键词 BP 神经网络 MAT LAB语言 设计中图分类号 TP1831 引言人工神经网络(A rtificial Neural Net w orks简称ANN)是近年来发展起来的模拟人脑生物过程的人工智能技术。

它由大量的、同时也是很简单的神经元广泛互连形成复杂的非线性系统,已经在信息处理模式识别、智能控制及系统建模等领域得到越来越广泛的应用。

尤其是基于误差反向传播(Er2 r or Back Pr opagati on)算法的多层前馈网络(Multi2 p le Layer Feed for ward Net w ork)(简称BP网络),可以以任意精度逼近任意的连续函数,所以广泛应用于非线性建模、函数逼近、模式分类等方面。

虽然BP神经网络是目前应用最广泛、研究较多的一种网络。

但是关于它的开发设计目前为止还没有一套完整的理论。

本文在参考其他文献[1]~[3]的基础上,给出BP神经网络设计的一些共性的原则。

2 BP神经网络设计步骤BP网络的设计主要包括输入层,隐层,输出层及各层之间的传输函数几个方面。

2.1 网络层数大多数通用的神经网络都预先预定了网络的层数,而BP网络可以包含不同的隐层。

但理论上已经证明,在不限制隐含节点数的情况下,两层(只有一个隐层)的BP网络可以实现任意非线性映射。

在模式样本相对较少的情况下,较少的隐层节点,可以实现模式样本空间的超平面划分,此时,选择两层BP网络就可以了;当模式样本数很多时,减小网络规模,增加一个隐层是有必要的,但是BP网络隐含层数一般不超过两层。

2.2 输入层的节点数输入层起起缓冲存储器的作用,它接收外部的输入数据,因此其节点数取决于输入矢量的维数。

基于MATLAB的BP神经网络的应用

1.前言在传统的智能识别系统中,控制规则的获取完全按照设计者和操作人员的经验进行,在某些系统中,由于设计者和操作人员的局限性,智能识别系统的设计无法保证最优或次优的控制性能[1]。

而本文是基于人工神经网络的智能识别系统[2],着力从行为上模拟人的控制推理和决策过程的实用控制方法,运用模糊控制理论[3],将神经网络和模糊控制结合起来,提高人工神经网络的智能性。

基于神经网络的人工智能模糊控制适用于难以建模的对象,而且最终控制形式简单、容易实现,控制效果取决于是否正确、全面和有效的将操作人员的控制经验总结为一系列的语言控制规则[4]。

2.BP神经网络与BP算法2.1BP网络结构BP网络是一种多层前馈神经网络,包括输入层,隐层(中间层)和输出层,其中隐层可以是一层也可以是多层,一般而言,三层BP神经网络就可以解决大部分比较简单的问题。

BP网络前后层之间实现全连接,每层神经元之间无连接。

学习样本给了BP网络后,各神经元响应输入,信号从输入层,经隐层(中间层),向输出层传播,根据减少预期输出与实际输出差距这一原则,从输出层,经过各中间层,最后回到输入层,逐层修正各个连接权值,这种算法被称为“误差逆传播算法”,简称BP算法,随着误差逆传播的不断进行,网络响应输入的正确率也不断上升。

基本的BP网络结构如图1所示:图1基本的BP网络结构2.2BP算法BP算法的基本框图如图2所示:图2BP算法的基本框图3.洗衣机的人工网络智能系统3.1人工神经网络的模糊控制的结构特征人工神经网络的模糊控制器是由神经网络和模糊控制共同组成的混合系统,这种混合系统具备了这两种技术的优点。

人工神经网络模糊控制结构一般有3种组合形式,如图3所示。

图3人工神经网络模糊控制结构的一般组合形3.2洗衣机的神经网络模糊控制器的设计3.2.1基本推理图在设计洗衣机控制系统时,首先应该考虑其被控参量,一般来说主要为洗涤时间和水流强度;其次考虑影响这一输出参量的因子,主要是被洗涤物品的浑浊程度和浑浊性质。

Matlab基于BP算法的神经网络设计

研究生课程期终论文课程名称:神经网络设计任课教师:论文题目:姓名:学号:摘要本文首先说明课题研究的目的和意义,评述课题的国内外研究现状,引出目前存在的问题。

然后分析了神经网络算法的基本原理,给出经典神经网络算法的具体实现方法,总结神经网络算法的特点,掌握BP网络的形成步骤。

学会使用Matlab中的神经网络工具箱函数,采用Matlab软件编程实现BP神经网络算法。

将神经网络算法应用于函数逼近,样本分类和样本含量估计问题中,并分析相关参数或算法对运行结果的影响。

最后对BP神经网络算法进行了展望。

关键字:神经网络;BP神经网络;函数逼近;仿真实验ABSTRACTThis paper first explains the purpose and significance of the topic research. Commentary studies current situation at the problem home and abroad. Leads to the existing problems. and then have analyzed algorithmic basal principle of neural networks, Give algorithmic concert of classics neural networks out the realization method. Summing up the characteristics of neural network algorithm. Master the forming step of BP network. The arithmetic of BP neural network is realized in Matlab software. The algorithm applies of BP neural networks to the function approximation problem,Sample classification and computes the swatch content. And analysis of relevant parameters on the results of algorithm. Finally, The BP neural network algorithm is Outlook.Key words: Neural network;BP neural network;Function approximation;Simulation experiment目录第一章引言 .............................................................. - 1 -1.1神经网络的概述..................................................... - 1 -1.2人工神经网络的研究目的和意义....................................... - 1 -1.3神经网络的发展与研究现状........................................... - 2 -1.3.1神经网络的发展............................................... - 2 -1.3.2神经网络的研究现状........................................... - 3 -1.4神经网络研究目前存在的问题......................................... - 3 -1.5神经网络的应用领域................................................. - 4 - 第二章 BP神经网络概述..................................................... - 6 -2.1 BP神经网络介绍.................................................... - 6 -2.2神经元............................................................. - 6 -2.2.1人工神经元................................................... - 6 -2.2.2生物神经元.................................................. - 10 -2.3 BP神经网络原理................................................... - 11 -2.4 BP神经网络的主要功能............................................. - 13 -2.5 BP神经网络的优点和缺点........................................... - 14 - 第三章 BP神经网络的应用................................................. - 17 -3.1基于MATLAB的BP神经网络工具箱函数................................ - 17 -3.1.1 MATLAB工具箱介绍........................................... - 17 -3.1.2 BP网络创建函数............................................. - 18 -3.1.3 神经元上的传递函数.......................................... - 18 -3.1.4 BP网络学习函数............................................. - 19 -3.1.5 BP网络训练函数............................................. - 19 -3.2 BP网络在函数逼近中的应用......................................... - 20 -3.2.1 问题的提出.................................................. - 20 -3.2.2 基于BP神经网络逼近函数..................................... - 20 -3.2.3 不同频率下的逼近效果........................................ - 24 -3.2.4 讨论....................................................... - 26 -3.3仿真实验.......................................................... - 26 -3.3.1 BP神经网络MATLAB设计...................................... - 26 -3.3.2 各种BP学习算法MATLAB仿真.................................. - 28 -3.3.3 各种算法仿真结果比较与分析.................................. - 31 -3.3.4 调整初始权值和阈值的仿真.................................... - 33 -3.3.5 其他影响因素仿真............................................ - 35 -3.4 BP神经网络在样本分类中的应用..................................... - 36 -3.4.1问题的提出.................................................. - 36 -3.4.2 基于BP神经网络的样本分类................................... - 36 - 参考文献 ................................................................. - 41 - 附录A .................................................................... - 43 -第一章引言1.1神经网络的概述人工神经网络(Artificial Neural Networks,简写为ANNs)也简称为神经网络(NNs)或称作连接模型(Connection Model),它是一种模范动物神经网络行为特征,进行分布式并行信息处理的算法数学模型。

matlab BP神经网络

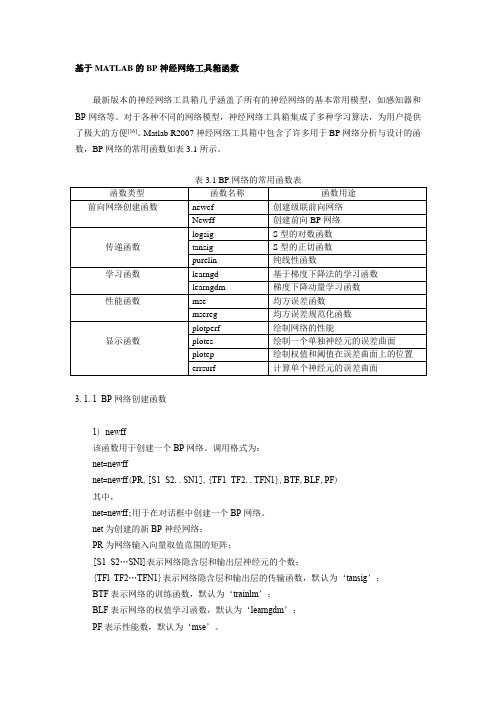

基于MATLAB的BP神经网络工具箱函数最新版本的神经网络工具箱几乎涵盖了所有的神经网络的基本常用模型,如感知器和BP网络等。

对于各种不同的网络模型,神经网络工具箱集成了多种学习算法,为用户提供了极大的方便[16]。

Matlab R2007神经网络工具箱中包含了许多用于BP网络分析与设计的函数,BP网络的常用函数如表3.1所示。

3.1.1BP网络创建函数1) newff该函数用于创建一个BP网络。

调用格式为:net=newffnet=newff(PR,[S1S2..SN1],{TF1TF2..TFN1},BTF,BLF,PF)其中,net=newff;用于在对话框中创建一个BP网络。

net为创建的新BP神经网络;PR为网络输入向量取值范围的矩阵;[S1S2…SNl]表示网络隐含层和输出层神经元的个数;{TFlTF2…TFN1}表示网络隐含层和输出层的传输函数,默认为‘tansig’;BTF表示网络的训练函数,默认为‘trainlm’;BLF表示网络的权值学习函数,默认为‘learngdm’;PF表示性能数,默认为‘mse’。

2)newcf函数用于创建级联前向BP网络,newfftd函数用于创建一个存在输入延迟的前向网络。

3.1.2神经元上的传递函数传递函数是BP网络的重要组成部分。

传递函数又称为激活函数,必须是连续可微的。

BP网络经常采用S型的对数或正切函数和线性函数。

1) logsig该传递函数为S型的对数函数。

调用格式为:A=logsig(N)info=logsig(code)其中,N:Q个S维的输入列向量;A:函数返回值,位于区间(0,1)中;2)tansig该函数为双曲正切S型传递函数。

调用格式为:A=tansig(N)info=tansig(code)其中,N:Q个S维的输入列向量;A:函数返回值,位于区间(-1,1)之间。

3)purelin该函数为线性传递函数。

调用格式为:A=purelin(N)info=purelin(code)其中,N:Q个S维的输入列向量;A:函数返回值,A=N。

BP神经网络Matlab实例(2)

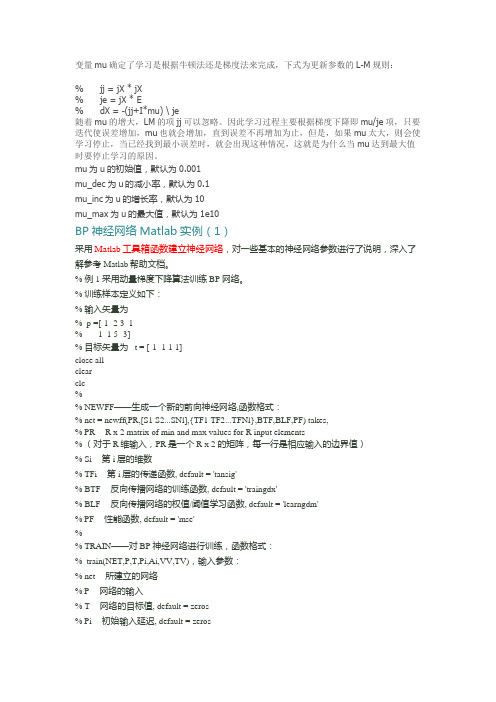

变量mu确定了学习是根据牛顿法还是梯度法来完成,下式为更新参数的L-M规则:% jj = jX * jX% je = jX * E% dX = -(jj+I*mu) \ je随着mu的增大,LM的项jj可以忽略。

因此学习过程主要根据梯度下降即mu/je项,只要迭代使误差增加,mu也就会增加,直到误差不再增加为止,但是,如果mu太大,则会使学习停止,当已经找到最小误差时,就会出现这种情况,这就是为什么当mu达到最大值时要停止学习的原因。

mu为u的初始值,默认为0.001mu_dec为u的减小率,默认为0.1mu_inc为u的增长率,默认为10mu_max为u的最大值,默认为1e10BP神经网络Matlab实例(1)采用Matlab工具箱函数建立神经网络,对一些基本的神经网络参数进行了说明,深入了解参考Matlab帮助文档。

% 例1 采用动量梯度下降算法训练 BP 网络。

% 训练样本定义如下:% 输入矢量为% p =[-1 -2 3 1% -1 1 5 -3]% 目标矢量为 t = [-1 -1 1 1]close allclearclc% ---------------------------------------------------------------% NEWFF——生成一个新的前向神经网络,函数格式:% net = newff(PR,[S1 S2...SNl],{TF1 TF2...TFNl},BTF,BLF,PF) takes,% PR -- R x 2 matrix of min and max values for R input elements% (对于R维输入,PR是一个R x 2 的矩阵,每一行是相应输入的边界值)% Si -- 第i层的维数% TFi -- 第i层的传递函数, default = 'tansig'% BTF -- 反向传播网络的训练函数, default = 'traingdx'% BLF -- 反向传播网络的权值/阈值学习函数, default = 'learngdm'% PF -- 性能函数, default = 'mse'% ---------------------------------------------------------------% TRAIN——对 BP 神经网络进行训练,函数格式:% train(NET,P,T,Pi,Ai,VV,TV),输入参数:% net -- 所建立的网络% P -- 网络的输入% T -- 网络的目标值, default = zeros% Pi -- 初始输入延迟, default = zeros% Ai -- 初始网络层延迟, default = zeros% VV -- 验证向量的结构, default = []% TV -- 测试向量的结构, default = []% 返回值:% net -- 训练之后的网络% TR -- 训练记录(训练次数及每次训练的误差)% Y -- 网络输出% E -- 网络误差% Pf -- 最终输入延迟% Af -- 最终网络层延迟% ---------------------------------------------------------------% SIM——对 BP 神经网络进行仿真,函数格式:% [Y,Pf,Af,E,perf] = sim(net,P,PiAi,T)% 参数与前同。

BP神经网络的Matlab语法.

1. 数据预处理在训练神经网络前一般需要对数据进行预处理,一种重要的预处理手段是归一化处理。

下面简要介绍归一化处理的原理与方法。

(1) 什么是归一化?数据归一化,就是将数据映射到[0,1]或[-1,1]区间或更小的区间,比如(0.1,0.9) 。

(2) 为什么要归一化处理?<1>输入数据的单位不一样,有些数据的范围可能特别大,导致的结果是神经网络收敛慢、训练时间长。

<2>数据范围大的输入在模式分类中的作用可能会偏大,而数据范围小的输入作用就可能会偏小。

<3>由于神经网络输出层的激活函数的值域是有限制的,因此需要将网络训练的目标数据映射到激活函数的值域。

例如神经网络的输出层若采用S形激活函数,由于S形函数的值域限制在(0,1),也就是说神经网络的输出只能限制在(0,1),所以训练数据的输出就要归一化到[0,1]区间。

<4>S形激活函数在(0,1)区间以外区域很平缓,区分度太小。

例如S形函数f(X)在参数a=1时,f(100)与f(5)只相差0.0067。

(3) 归一化算法一种简单而快速的归一化算法是线性转换算法。

线性转换算法常见有两种形式:<1>y = ( x - min )/( max - min )其中min为x的最小值,max为x的最大值,输入向量为x,归一化后的输出向量为y 。

上式将数据归一化到[ 0 , 1 ]区间,当激活函数采用S形函数时(值域为(0,1))时这条式子适用。

<2>y = 2 * ( x - min ) / ( max - min ) - 1这条公式将数据归一化到[ -1 , 1 ] 区间。

当激活函数采用双极S形函数(值域为(-1,1))时这条式子适用。

(4) Matlab数据归一化处理函数Matlab中归一化处理数据可以采用premnmx ,postmnmx ,tramnmx 这3个函数。

<1> premnmx语法:[pn,minp,maxp,tn,mint,maxt] = premnmx(p,t)参数:pn:p矩阵按行归一化后的矩阵minp,maxp:p矩阵每一行的最小值,最大值tn:t矩阵按行归一化后的矩阵mint,maxt:t矩阵每一行的最小值,最大值作用:将矩阵p,t归一化到[-1,1] ,主要用于归一化处理训练数据集。

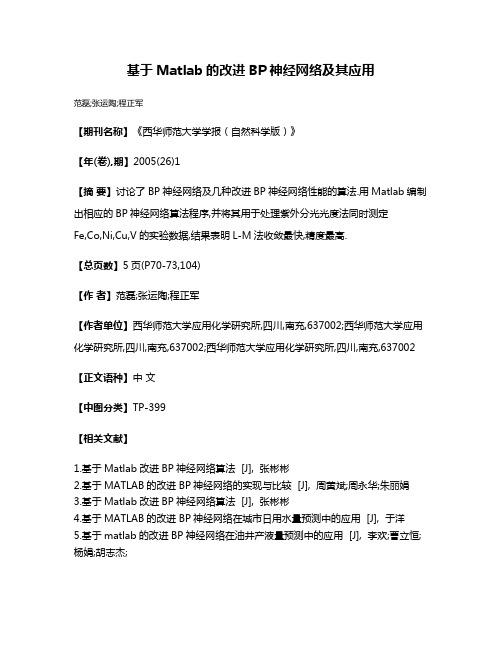

基于Matlab的改进BP神经网络及其应用

基于Matlab的改进BP神经网络及其应用

范磊;张运陶;程正军

【期刊名称】《西华师范大学学报(自然科学版)》

【年(卷),期】2005(26)1

【摘要】讨论了BP神经网络及几种改进BP神经网络性能的算法.用Matlab编制出相应的BP神经网络算法程序,并将其用于处理紫外分光光度法同时测定

Fe,Co,Ni,Cu,V的实验数据,结果表明L-M法收敛最快,精度最高.

【总页数】5页(P70-73,104)

【作者】范磊;张运陶;程正军

【作者单位】西华师范大学应用化学研究所,四川,南充,637002;西华师范大学应用化学研究所,四川,南充,637002;西华师范大学应用化学研究所,四川,南充,637002【正文语种】中文

【中图分类】TP-399

【相关文献】

1.基于Matlab改进BP神经网络算法 [J], 张彬彬

2.基于MATLAB的改进BP神经网络的实现与比较 [J], 周黄斌;周永华;朱丽娟

3.基于Matlab改进BP神经网络算法 [J], 张彬彬

4.基于MATLAB的改进BP神经网络在城市日用水量预测中的应用 [J], 于洋

5.基于matlab的改进BP神经网络在油井产液量预测中的应用 [J], 李欢;曹立恒;杨娟;胡志杰;

因版权原因,仅展示原文概要,查看原文内容请购买。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

目录1绪论 (1)1.1人工神经网络的研究背景和意义 (1)1.2神经网络的发展与研究现状 (2)1.3神经网络的研究内容和目前存在的问题 (3)1.4神经网络的应用 (4)2神经网络结构及BP神经网络 (4)2.1神经元与网络结构 (4)2.2BP神经网络及其原理 (7)2.3BP神经网络的主要功能 (9)2.4BP网络的优点以及局限性 (9)3BP神经网络在实例中的应用 (10)3.1基于MATLAB的BP神经网络工具箱函数 (10)3.2BP网络在函数逼近中的应用 (12)3.3BP网络在样本含量估计中的应用 (17)4结束语 (23)参考文献: (24)英文摘要 (25)致谢 (26)基于MATLAB的BP神经网络应用蒋亮亮南京信息工程大学滨江学院自动化专业,南京210044摘要:本文首先说明课题研究的目的和意义,评述课题的国内外研究现状,引出目前存在的问题。

然后分析了神经网络算法的基本原理,给出经典神经网络算法的具体实现方法,总结神经网络算法的特点,并给出神经网络算法的基本流程。

采用Matlab软件编程实现BP神经网络算法。

将神经网络算法应用于函数逼近和样本含量估计问题中,并分析相关参数对算法运行结果的影响。

最后对BP神经网络算法进行了展望。

关键词:神经网络;BP神经网络;函数逼近1绪论人工神经网络(Artificial Neural Networks,NN)是由大量的、简单的处理单元(称为神经元)广泛地互相连接而形成的复杂网络系统,它反映了人脑功能的许多基本特征,是一个高度复杂的非线性动力学系统[1]。

神经网络具有大规模并行、分布式存储和处理、自组织、自适应和自学习能力,特别适合处理需要同时考虑许多因素和条件的、不精确和模糊的信息处理问题。

神经网络的发展与神经科学、数理科学、认知科学、计算机科学、人工智能、信息科学、控制论、机器人学、微电子学、心理学、微电子学、心理学、光计算、分子生物学等有关,是一门新兴的边缘交叉学科。

神经网络具有非线性自适应的信息处理能力,克服了传统人工智能方法对于直觉的缺陷,因而在神经专家系统、模式识别、智能控制、组合优化、预测等领域得到成功应用[2]。

神经网络与其他传统方法相组合,将推动人工智能和信息处理技术不断发展。

近年来,神经网络在模拟人类认知的道路上更加深入发展,并与模糊系统、遗传算法、进化机制等组合,形成计算智能,成为人工智能的一个重要方向。

MATLAB是一种科学与工程计算的高级语言,广泛地运用于包括信号与图像处理,控制系统设计,系统仿真等诸多领域。

为了解决神经网络问题中的研究工作量和编程计算工作量问题,目前工程领域中较为流行的软件MA TLAB,提供了现成的神经网络工具箱(Neural Network Toolbox,简称NNbox)[3],为解决这个矛盾提供了便利条件。

神经网络工具箱提供了很多经典的学习算法,使用它能够快速实现对实际问题的建模求解。

在解决实际问题中,应用MA TLAB 语言构造典型神经网络的激活传递函数,编写各种网络设计与训练的子程序,网络的设计者可以根据需要调用工具箱中有关神经网络的设计训练程序,使自己能够从烦琐的编程中解脱出来,减轻工程人员的负担,从而提高工作效率。

1.1人工神经网络的研究背景和意义人工神经网络是由具有适应性的简单单元组成的广泛并行互连的网络,它的组织能够模拟生物神经系统对真实世界物体所作出的交互反应[5]。

人工神经网络就是模拟人思维的一种方式,是一个非线性动力学系统,其特色在于信息的分布式存储和并行协同处理。

虽然单个神经元的结构极其简单,功能有限,但大量神经元构成的网络系统所能实现的行为却是极其丰富多彩的。

近年来通过对人工神经网络的研究,可以看出神经网络的研究目的和意义有以下三点:(1)通过揭示物理平面与认知平面之间的映射,了解它们相互联系和相互作用的机理,从而揭示思维的本质,探索智能的本源。

(2)争取构造出尽可能与人脑具有相似功能的计算机,即神经网络计算机。

(3)研究仿照脑神经系统的人工神经网络,将在模式识别、组合优化和决策判断等方面取得传统计算机所难以达到的效果。

人工神经网络特有的非线性适应性信息处理能力,克服了传统人工智能方法对于直觉,如模式、语音识别、非结构化信息处理方面的缺陷,使之在神经专家系统、模式识别、智能控制、组合优化、预测等领域得到成功应用。

人工神经网络与其它传统方法相结合,将推动人工智能和信息处理技术不断发展。

近年来,人工神经网络正向模拟人类认知的道路上更加深入发展,与模糊系统、遗传算法、进化机制等结合,形成计算智能,成为人工智能的一个重要方向,将在实际应用中得到发展。

将信息几何应用于人工神经网络的研究,为人工神经网络的理论研究开辟了新的途径。

神经计算机的研究发展很快,已有产品进入市场。

光电结合的神经计算机为人工神经网络的发展提供了良好条件。

1.2神经网络的发展与研究现状1.2.1神经网络的发展神经网络起源于20世纪40年代,至今发展已半个多世纪,大致分为三个阶段【7】。

1)20世纪50年代-20世纪60年代:第一次研究高潮自1943年M-P模型开始,至20世纪60年代为止,这一段时间可以称为神经网络系统理论发展的初期阶段。

这个时期的主要特点是多种网络的模型的产生与学习算法的确定。

2)20世纪60年代-20世纪70年代:低潮时期到了20世纪60年代,人们发现感知器存在一些缺陷,例如,它不能解决异或问题,因而研究工作趋向低潮。

不过仍有不少学者继续对神经网络进行研究。

Grossberg提出了自适应共振理论;Kohenen提出了自组织映射;Fukushima提出了神经认知网络理论;Anderson提出了BSB模型;Webos提出了BP理论等。

这些都是在20世纪70年代和20世纪80年代初进行的工作。

3)20世纪80年代-90年代:第二次研究高潮进入20世纪80年代,神经网络研究进入高潮。

这个时期最具有标志性的人物是美国加州工学院的物理学家John Hopfield。

他于1982年和1984年在美国科学院院刊上发表了两篇文章,提出了模拟人脑的神经网络模型,即最著名的Hopfield模型。

Hopfield网络是一个互连的非线性动力学网络,它解决问题的方法是一种反复运算的动态过程,这是符号逻辑处理方式做不具备的性质。

20世纪80年代后期到90年代初,神经网络系统理论形成了发展的热点,多种模型、算法和应用被提出,研究经费重新变得充足,使得研究者们完成了很多有意义的工作。

1.2.2神经网络的现状进入20世纪90年代以来,神经网络由于应用面还不够宽,结果不够精确,存在可信度问题,从而进入了认识与应用研究期。

1)开发现有模型的应用,并在应用中根据实际运行情况对模型、算法加以改造,以提高网络的训练速度和运行的准确度。

2)充分发挥两种技术各自的优势是一个有效方法。

3)希望在理论上寻找新的突破,建立新的专用/通用模型和算法。

4)进一步对生物神经系统进行研究,不断地丰富对人脑的认识。

1.3神经网络的研究内容和目前存在的问题1.3.1神经网络的研究内容神经网络的研究内容相当广泛,反映了多科学交叉技术领域的特点。

目前,主要的研究工作集中在以下四方面[6]:(1)生物原型研究:从生理学、心理学、解剖学、脑科学、病理学生物科学方面研究神经细胞、神经网络、神经系统的生物原型结构及其功能机理。

(2)建立理论模型:根据生物圆形的研究,建立神经元、神经网络的理论模型,其中包括概念模型、知识模型、物理化学模型、数学模型等。

(3)网络模型与算法研究:在理论模型研究的基础上构成具体的神经网络模型,以实现计算机模拟或准备制作硬件,包括网络学习算法的研究。

这方面的工作也称为技术模型研究。

(4)神经网络应用系统:在网络模型与算法研究的基础上,利用神经网络组成实际的应用系统,例如,完成某种信号处理或模式识别的功能、构成专家系统、制成机器人等。

1.3.2神经网络研究目前存在的问题人工神经网络的发展具有强大的生命力。

当前存在的问题是智能水平还不高,许多应用方面的要求还不能得到很好的满足;网络分析与综合的一些理论性问题还未得到很好的解决。

例如,由于训练中稳定性的要求学习率很小,所以梯度下降法使得训练很忙动量法因为学习率的提高通常比单纯的梯度下降法要快,但在实际应用中还是很慢[7]。

针对千变万化的应用对象,各类复杂的求解问题,编制一些特定的程序、软件求解,耗费了大量的人力和物力。

而这些软件往往只针对某一方面的问题有效,并且在人机接口、用户友好性等诸多方面存在一定的缺陷。

在微机飞速发展的今天,很多都已不能满足发展的需要。

1.4神经网络的应用神经网络理论的应用取得了令人瞩目的发展,特别是在人工智能、自动控制、计算机科学、信息处理、机器人、模式识别、CAD/CAM等方面都有重大的应用实例。

下面列出一些主要应用领域[4]:(1)模式识别和图像处理。

印刷体和手写字符识别、语音识别、签字识别、指纹识别、人体病理分析、目标检测与识别、图像压缩和图像复制等。

(2)控制和优化。

化工过程控制、机器人运动控制、家电控制、半导体生产中掺杂控制、石油精炼优化控制和超大规模集成电路布线设计等。

(3)预报和智能信息管理。

股票市场预测、地震预报、有价证券管理、借贷风险分析、IC卡管理和交通管理。

(4)通信。

自适应均衡、回波抵消、路由选择和ATM网络中的呼叫接纳识别和控制。

(5)空间科学。

空间交汇对接控制、导航信息智能管理、飞行器制导和飞行程序优化管理等。

2神经网络结构及BP神经网络2.1神经元与网络结构人工神经网络(artificial neural network,ANN)是模仿生物神经网络功能的一种经验模型。

生物神经元受到传入的刺激,其反应又从输出端传到相联的其它神经元,输入和输出之间的变换关系一般是非线性的。

神经网络是由若干简单(通常是自适应的)元件及其层次组织,以大规模并行连接方式构造而成的网络,按照生物神经网络类似的方式处理输入的信息。

模仿生物神经网络而建立的人工神经网络,对输入信号有功能强大的反应和处理能力[9]。

神经网络是由大量的处理单元(神经元)互相连接而成的网络。

为了模拟大脑的基本特性,在神经科学研究的基础上,提出了神经网络的模型。

但是,实际上神经网络并没有完全反映大脑的功能,只是对生物神经网络进行了某种抽象、简化和模拟[8]。

神经网络的信息处理通过神经元的互相作用来实现,知识与信息的存储表现为网络元件互相分布式的物理联系。

神经网络的学习和识别取决于各种神经元连接权系数的动态演化过程。

若干神经元连接成网络,其中的一个神经元可以接受多个输入信号,按照一定的规则转换为输出信号。

由于神经网络中神经元间复杂的连接关系和各神经元传递信号的非线性方式,输入和输出信号间可以构建出各种各样的关系,因此可以用来作为黑箱模型,表达那些用机理模型还无法精确描述、但输入和输出之间确实有客观的、确定性的或模糊性的规律。