进制哈夫曼编码

进制哈夫曼编码

i 1 7

两 种 编 码 方 法 的 编 码率 效相 等 :

2

码字长度的方差: E K i K p(xi )(Ki K )2 i 1 第一种方法:

例:对以下信源进行哈夫曼编码。 P166习题5.3

信源符号ai a1 a2 a3 a4 a5 a6 a7

下午6时48分

概率p(ai) 0.20 0.19 0.18 0.17 0.15 0.10 0.01

码字Wi 10 11 000 001 010 0110 0111

码长Ki 2 2 3 3 3 4 4

5.4 哈夫曼(Huffman)编码

二进制哈夫曼码的编码方法:

(1) 将 信 源 消 息 符 号 按 其 出 现 的 概 率 大 小 依 次 排

p( x1 ) p( x2 ) p( xn )。 列:

(2)取两个概率最小的符号分别配以0和1两个码元, 并将这两个概率相加作为一个新符号的概率,与 未分配二进制码元的符号重新排队。

一般将合并的概率放在上面,这样可获得较小的码方差。

需要大量的存储设备来缓冲码字长度的差异,这是码方差小的码质量 好的原因。

2 码 字长 度 的方 差 : E Ki K p(xi )(Ki K )2 i 1 2

n

下午6时48分

6

5.4 哈夫曼(Huffman)编码(例2)

下午6时48分

4

5.4 哈夫曼(Huffman)编码(例1续)

平均码长: K p( a i )K i 2.72码 元/符 号

i 1 7

哈夫曼二进制编码过程

哈夫曼二进制编码过程(原创实用版)目录1.哈夫曼编码的定义和用途2.哈夫曼编码的过程3.哈夫曼编码的优点4.哈夫曼编码的应用实例正文哈夫曼编码是一种无损数据压缩编码方法,主要用于将原始数据转换为更小的二进制表示,从而实现数据压缩。

它是由美国计算机科学家David A.Huffman 在 1952 年提出的,因此也被称为哈夫曼编码。

哈夫曼编码被广泛应用于数据压缩、图像压缩、音频压缩等领域。

哈夫曼编码的过程主要包括两个步骤:第一步是构造哈夫曼树,第二步是利用哈夫曼树生成哈夫曼编码。

构造哈夫曼树的过程如下:1.将原始数据中的每个字符出现的频率作为权值,将所有权值放入一个哈希表中,并按照权值大小进行排序。

2.从权值最小的两个节点开始,将它们合并为一个新的节点,并将新节点的权值设为两个节点权值之和。

然后将新节点放回哈希表中,并重新排序。

3.重复第二步,直到哈希表中只剩下一个节点,这个节点就是哈夫曼树的根节点。

4.从根节点到每个叶子节点的路径代表一个字符的哈夫曼编码,其中左子节点的边表示 0,右子节点的边表示 1。

利用哈夫曼树生成哈夫曼编码的过程如下:1.从哈夫曼树的根节点开始,沿着一条路径到达某个叶子节点,将路径上的 0 和 1 按照顺序拼接起来,得到一个字符的哈夫曼编码。

2.对哈夫曼树中的每个叶子节点进行同样的操作,得到所有字符的哈夫曼编码。

哈夫曼编码的优点主要有以下几点:1.哈夫曼编码是无损压缩,即压缩后的数据可以完全还原原始数据。

2.哈夫曼编码的压缩效果较好,对于出现频率较高的字符,压缩后的编码较短;对于出现频率较低的字符,压缩后的编码较长。

3.哈夫曼编码的编码和解码过程都比较简单,易于实现和操作。

哈夫曼编码的应用实例包括:1.文本压缩:将文本数据转换为哈夫曼编码,可以大大减少存储空间和传输时间。

2.图像压缩:将图像中的每个像素的颜色值转换为哈夫曼编码,可以减少图像的数据量。

哈夫曼二进制编码过程 -回复

哈夫曼二进制编码过程-回复哈夫曼编码是一种被广泛应用于数据压缩和传输中的编码算法。

它主要通过构建哈夫曼树来为每个字符生成唯一的二进制编码,使得出现频率较高的字符拥有较短的编码长度,从而实现对文本数据的压缩。

本文将详细介绍哈夫曼编码的过程,包括构建哈夫曼树和生成编码的步骤。

1. 统计字符频率:哈夫曼编码的首要步骤是统计待编码文本中字符的出现频率。

为了方便起见,我们将该字符串存储为字符数组,并使用一个哈希表来记录每个字符出现的频率。

通过遍历文本字符数组,我们可以统计每个字符的频率信息。

举个例子,假设我们有一个文本字符串"Hello World!",那么统计后的频率信息可以如下所示:- 'H': 1- 'e': 1- 'l': 3- 'o': 2- ' ': 1- 'W': 1- 'r': 1- 'd': 1- '!': 12. 构建哈夫曼树:构建哈夫曼树是生成哈夫曼编码的关键步骤。

在构建哈夫曼树的过程中,我们以字符频率作为节点的权重,并使用最小堆(或优先队列)数据结构来有效地选择最小的两个节点进行合并。

以下是构建哈夫曼树的步骤:- 将所有的字符和频率信息作为叶子节点,构建一个最小堆。

- 从最小堆中选择两个频率最小的节点,合并它们并创建一个新的内部节点。

- 将新的节点插入最小堆中,并更新频率为两个节点的频率之和。

- 重复以上步骤,直到最小堆中只剩下一个节点,即根节点。

该节点即为哈夫曼树的根节点。

以例子中的频率信息来构建哈夫曼树,步骤如下:- 构建初始化最小堆:1 'H': 12 'e': 13 ' ': 14 'W': 15 'r': 17 '!': 18 'o': 29 'l': 3- 合并频率最小的两个节点'H' 和'e': 1+2 'He': 23 ' ': 14 'W': 15 'r': 16 'd': 17 '!': 18 'o': 29 'l': 3- 合并频率最小的两个节点' ' 和'W': 2 'He': 24+5 ' W': 26 'r': 17 'd': 18 '!': 19 'o': 2- 合并频率最小的两个节点'r' 和'd':2 'He': 22+2 ' W': 26+7 'rd': 28 '!': 19 'o': 210 'l': 3- 重复以上合并操作,直到只剩下一个节点:2 'He': 24 ' W': 213 'rd': 2+2+1+2+3 =1011 '!': 1+2+3+10+2=189 'o': 210 'l': 3+2+2+1=818+10 'rd!': 2818+10+8 'rd!l': 389 'o': 2+4+6+2+38=5252+38 'rd!lo': 902+4+6+2+90 'rd!lol': 104104+2+4+6+2 'Hed ': 118118+118 'Hed W': 236236+52 'Hed Wo': 288288+38 'Hed Wor': 326326+326 'Hed WorHed Wor': 652652+288 'Hed WorHed WorHed Wo': 940940+118 'Hed WorHed WorHed WorHed W': 10581058+236 'Hed WorHed WorHed WorHed WorHed Wo': 12941294+652 'Hed WorHed WorHed WorHed WorHed WorHed Wor': 1946- 最小堆中只剩下一个节点,构建完成的哈夫曼树如下所示:root/ \118 236/ \104 1303. 生成哈夫曼编码:生成哈夫曼编码是哈夫曼编码的最后一步。

哈夫曼编码python

哈夫曼编码python一、什么是哈夫曼编码?哈夫曼编码(Huffman Coding)是一种可变长度编码(Variable Length Code),它可以将不同长度的字符编码成等长的二进制串,从而实现数据压缩的目的。

哈夫曼编码是由David A. Huffman在1952年发明的,它是一种贪心算法,可以得到最优解。

二、哈夫曼编码原理1.字符频率统计在进行哈夫曼编码之前,需要先统计每个字符出现的频率。

通常使用一个字典来存储每个字符和其出现的次数。

2.构建哈夫曼树根据字符出现频率构建一个二叉树,其中频率越高的字符离根节点越近。

构建过程中需要用到一个优先队列(Priority Queue),将每个节点按照频率大小加入队列中,并将队列中前两个节点合并为一个新节点,并重新加入队列中。

重复这个过程直到只剩下一个节点,即根节点。

3.生成哈夫曼编码从根节点开始遍历哈夫曼树,在遍历过程中,左子树走0,右子树走1,直到叶子节点。

将路径上经过的0和1分别表示为0和1位二进制数,并把这些二进制数拼接起来,就得到了该字符的哈夫曼编码。

三、哈夫曼编码Python实现下面是一个简单的Python实现:1.字符频率统计```pythonfrom collections import Counterdef get_char_frequency(text):"""统计每个字符出现的频率"""return Counter(text)```2.构建哈夫曼树```pythonimport heapqclass HuffmanNode:def __init__(self, char=None, freq=0, left=None, right=None): self.char = charself.freq = freqself.left = leftself.right = rightdef __lt__(self, other):return self.freq < other.freqdef build_huffman_tree(char_freq):"""根据字符频率构建哈夫曼树"""nodes = [HuffmanNode(char=c, freq=f) for c, f inchar_freq.items()]heapq.heapify(nodes)while len(nodes) > 1:node1 = heapq.heappop(nodes)node2 = heapq.heappop(nodes)new_node = HuffmanNode(freq=node1.freq+node2.freq, left=node1, right=node2)heapq.heappush(nodes, new_node)return nodes[0]```3.生成哈夫曼编码```pythondef generate_huffman_codes(node, code="", codes={}): """生成哈夫曼编码"""if node is None:returnif node.char is not None:codes[node.char] = codegenerate_huffman_codes(node.left, code+"0", codes) generate_huffman_codes(node.right, code+"1", codes)return codes```四、使用哈夫曼编码进行压缩使用哈夫曼编码进行压缩的方法很简单,只需要将原始数据中的每个字符用对应的哈夫曼编码替换即可。

哈夫曼编码(HuffmanCoding)

哈夫曼编码(HuffmanCoding)

哈夫曼编码(Huffman Coding),又称霍夫曼编码,是一种编码方式,可变字长编码(VLC)的一种。

Huffman于1952年提出一种编码方法,该方法完全依据字符出现概率来构造异字头的平均长度最短的码字,有时称之为最佳编码,一般就叫做Huffman编码(有时也称为霍夫曼编码)。

哈夫曼编码,主要目的是根据使用频率来最大化节省字符(编码)的存储空间。

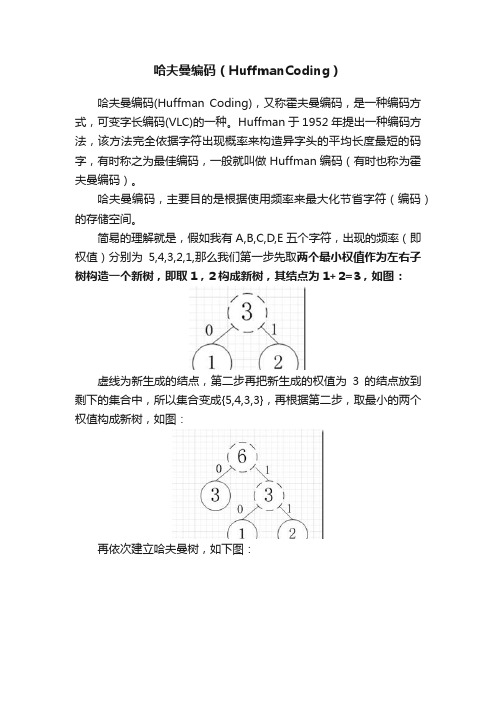

简易的理解就是,假如我有A,B,C,D,E五个字符,出现的频率(即权值)分别为5,4,3,2,1,那么我们第一步先取两个最小权值作为左右子树构造一个新树,即取1,2构成新树,其结点为1+2=3,如图:

虚线为新生成的结点,第二步再把新生成的权值为3的结点放到剩下的集合中,所以集合变成{5,4,3,3},再根据第二步,取最小的两个权值构成新树,如图:

再依次建立哈夫曼树,如下图:

其中各个权值替换对应的字符即为下图:

所以各字符对应的编码为:A->11,B->10,C->00,D->011,E->010

霍夫曼编码是一种无前缀编码。

解码时不会混淆。

其主要应用在数据压缩,加密解密等场合。

如果考虑到进一步节省存储空间,就应该将出现概率大(占比多)的字符用尽量少的0-1进行编码,也就是更靠近根(节点少),这也就是最优二叉树-哈夫曼树。

哈夫曼编码方式对字母进行不定长的二进制编码

哈夫曼编码方式对字母进行不定长的二进制编码哈夫曼编码是一种常用于数据传输和数据压缩的编码方式。

它可以对不同的符号(比如字母或者其他字符)进行不定长的二进制编码,从而实现高效的数据压缩。

在这篇文章中,我将会对哈夫曼编码进行深入的探讨,从原理到应用,让你更全面地了解这一编码方式的重要性和价值。

在介绍哈夫曼编码前,我们先来了解一下传统的固定长度编码和变长编码。

固定长度编码是将每个符号都用固定长度的二进制序列表示,比如ASCII码就是一种固定长度编码方式。

这种编码方式的缺点是不适合对出现频率不同的符号进行编码,会浪费大量的存储空间。

而变长编码则可以根据符号的出现频率来灵活地进行编码,从而实现更高效的数据压缩。

哈夫曼编码就是一种典型的变长编码方式,它是由大卫·哈夫曼在1952年提出的。

在哈夫曼编码中,根据符号出现的频率不同,使用不同长度的二进制序列表示。

出现频率高的符号对应较短的二进制序列,而出现频率低的符号对应较长的二进制序列。

这样一来,可以实现对数据进行高效压缩,减少存储空间的占用。

哈夫曼编码的原理非常巧妙,通过构建哈夫曼树来实现对符号的编码。

在构建哈夫曼树的过程中,首先将所有的符号按照出现频率进行排序,然后将出现频率最低的两个符号合并为一个新的符号,其出现频率为两者之和。

不断重复这个过程,直到所有的符号都被合并在一棵树中。

哈夫曼树的叶子节点就对应着每个符号及其对应的二进制编码。

通过哈夫曼编码,我们可以实现对数据的高效压缩。

这种编码方式在通信和存储领域有着广泛的应用,比如在JPEG、MP3等格式中都采用了哈夫曼编码来对数据进行压缩。

这不仅可以节省存储空间,还可以提高数据传输的效率,是一种非常重要和实用的编码方式。

从个人的角度来看,我认为哈夫曼编码是一种非常巧妙和高效的编码方式。

它充分利用了符号出现频率的特点,实现了对数据的高效压缩,为数据传输和存储提供了重要的技术支持。

哈夫曼编码的应用领域非常广泛,可以说几乎涵盖了所有需要数据压缩的领域。

离散数学中的二进制编码和哈夫曼编码

在离散数学中,二进制编码和哈夫曼编码是两个重要的概念和技术。

它们在信息传输、数据存储和压缩等领域都有广泛的应用。

首先,让我们来了解一下二进制编码。

二进制编码是一种使用0和1表示信息的编码方法。

在计算机中,所有的数据都可以用二进制数表示。

其中,每一位的0或1称为“位(bit)”。

由于只有两种可能的状态,所以二进制编码非常简单和高效。

二进制编码在计算机中有广泛的应用。

例如,我们常见的数字、字母、符号等都可以用二进制编码表示。

其中,最常见的是ASCII码,即AmericanStandard Code for Information Interchange。

它使用7位二进制数表示128种不同的字符。

通过二进制编码,计算机可以准确地表示和处理各种数据。

然而,在某些情况下,使用固定长度的二进制编码会导致存储空间的浪费和数据传输的低效。

为了解决这个问题,哈夫曼编码应运而生。

哈夫曼编码是一种变长编码方式,它根据字符出现的频率进行编码。

出现频率高的字符使用较短的编码,而出现频率低的字符使用较长的编码。

这样,可以大大减少编码的长度,从而提高存储和传输的效率。

哈夫曼编码的构造过程是通过建立哈夫曼树来实现的。

首先,根据字符出现的频率构建一个包含所有字符的森林。

然后,将频率最低的两个字符合并为一棵子树,并更新合并后的字符的频率。

重复这个合并和更新的过程,直到最后只剩下一棵树。

这棵树就是哈夫曼树。

从哈夫曼树的根节点到每个叶子节点的路径上的0和1就是字符的哈夫曼编码。

通过哈夫曼编码,我们可以实现数据的高效存储和传输。

例如,在文本压缩中,常常使用哈夫曼编码对文字进行压缩。

通过统计各个字符的出现频率,并生成对应的哈夫曼树,然后将文本中的字符替换为对应的哈夫曼编码,可以大大减小文本的尺寸,从而实现数据的压缩和存储空间的节省。

总结起来,离散数学中的二进制编码和哈夫曼编码是非常重要的概念和技术。

二进制编码可以准确地表示和处理各种数据,而哈夫曼编码则在数据存储和传输中提高了效率。

哈夫曼二进制编码过程

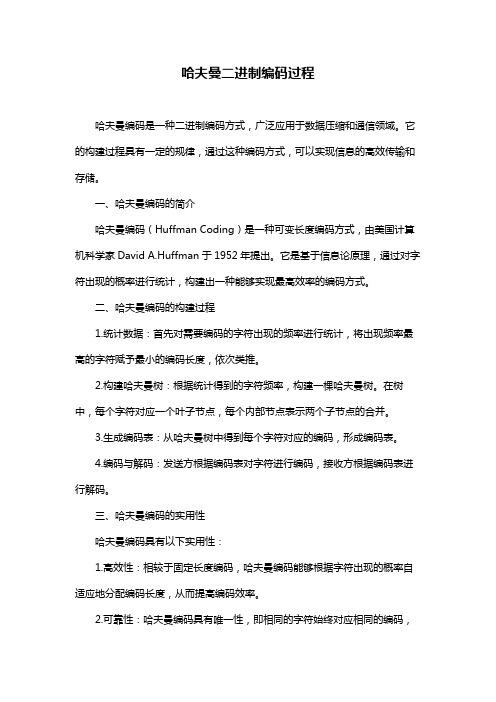

哈夫曼二进制编码过程哈夫曼编码是一种二进制编码方式,广泛应用于数据压缩和通信领域。

它的构建过程具有一定的规律,通过这种编码方式,可以实现信息的高效传输和存储。

一、哈夫曼编码的简介哈夫曼编码(Huffman Coding)是一种可变长度编码方式,由美国计算机科学家David A.Huffman于1952年提出。

它是基于信息论原理,通过对字符出现的概率进行统计,构建出一种能够实现最高效率的编码方式。

二、哈夫曼编码的构建过程1.统计数据:首先对需要编码的字符出现的频率进行统计,将出现频率最高的字符赋予最小的编码长度,依次类推。

2.构建哈夫曼树:根据统计得到的字符频率,构建一棵哈夫曼树。

在树中,每个字符对应一个叶子节点,每个内部节点表示两个子节点的合并。

3.生成编码表:从哈夫曼树中得到每个字符对应的编码,形成编码表。

4.编码与解码:发送方根据编码表对字符进行编码,接收方根据编码表进行解码。

三、哈夫曼编码的实用性哈夫曼编码具有以下实用性:1.高效性:相较于固定长度编码,哈夫曼编码能够根据字符出现的概率自适应地分配编码长度,从而提高编码效率。

2.可靠性:哈夫曼编码具有唯一性,即相同的字符始终对应相同的编码,便于接收方解码。

3.通用性:哈夫曼编码可应用于各种数据压缩和通信场景,如文本、图像、音频等。

四、哈夫曼编码在现代通信中的应用现代通信技术中,哈夫曼编码得到了广泛应用,如:1.数据压缩:如zip、rar等压缩软件,采用哈夫曼编码对数据进行压缩,减少存储空间和传输时间。

2.通信协议:许多通信协议,如HTTP、FTP等,采用哈夫曼编码对传输数据进行编码,提高传输效率。

3.二维码:哈夫曼编码在二维码编码中也有应用,如QR码等。

五、哈夫曼编码的优点与局限性优点:1.高效:根据字符出现概率自适应分配编码长度,提高编码效率。

2.可靠性:唯一性编码,便于接收方解码。

3.通用:适用于多种数据类型和通信场景。

局限性:1.编码复杂度:构建哈夫曼树和生成编码表的过程较为复杂。

哈夫曼编码方法

哈夫曼编码方法

哈夫曼编码(Huffman coding)是一种常用的无损数据压缩算法,用于将源数据转换为可变长度的二进制编码。

它基于源数据中不同符号出现的概率来构建一棵哈夫曼树,然后使用该树来生成每个符号对应的编码。

下面是哈夫曼编码的基本步骤:

1. 统计符号频率:对源数据进行扫描,统计每个符号出现的频率或概率。

2. 构建哈夫曼树:根据符号的频率构建一棵哈夫曼树。

频率较高的符号在树中位置较浅,频率较低的符号在树中位置较深。

3. 生成编码:从根节点开始,沿着哈夫曼树的路径向下,给左子树赋值"0",给右子树赋值"1",直到达到叶子节点。

每个叶子节点的编码就是其路径上经过的0和1序列。

4. 压缩数据:使用生成的编码来代替源数据中的符号,将原始数据进行压缩。

哈夫曼编码的优势在于,频率较高的符号被赋予较短的编码,而频率较低的符号被赋予较长的编码,从而实现了数据压缩。

在解压缩时,使用相同的哈夫曼树,根据编码逐位进行解码,恢复原始数据。

哈夫曼编码在通信、数据存储和多媒体处理等领域广泛应用,能够有效地压缩数据并节省存储空间或传输带宽。

1/ 1。

哈夫曼编码 字符与编码对照表

哈夫曼编码(Huffman Coding)是一种用于无损数据压缩的熵编码算法。

它根据字符在文本中出现的频率来构建一棵哈夫曼树,然后用这棵树为每个字符生成一个唯一的二进制编码。

这些编码的长度是根据字符的频率动态生成的,频率越高的字符,其编码长度越短,从而达到压缩数据的目的。

哈夫曼编码的一个特点是,它生成的编码并不是唯一的。

也就是说,对于同一个文本,不同的哈夫曼编码算法可能会生成不同的编码结果。

这是因为哈夫曼树的构建过程可能受到多种因素的影响,比如字符频率的统计方式、树的构建算法等。

因此,要提供一个具体的字符与编码对照表,我们需要先明确字符的频率以及哈夫曼树的构建过程。

下面是一个简单的示例,假设我们有以下字符及其频率:

基于这些频率,我们可以构建一个哈夫曼树,并为每个字符生成一个唯一的二进制编码。

假设我们得到的编码如下:

请注意,这只是一个示例,实际的哈夫曼编码可能会因为字符频率和哈夫曼树构建算法的不同而有所差异。

哈夫曼编码及其解码全过程

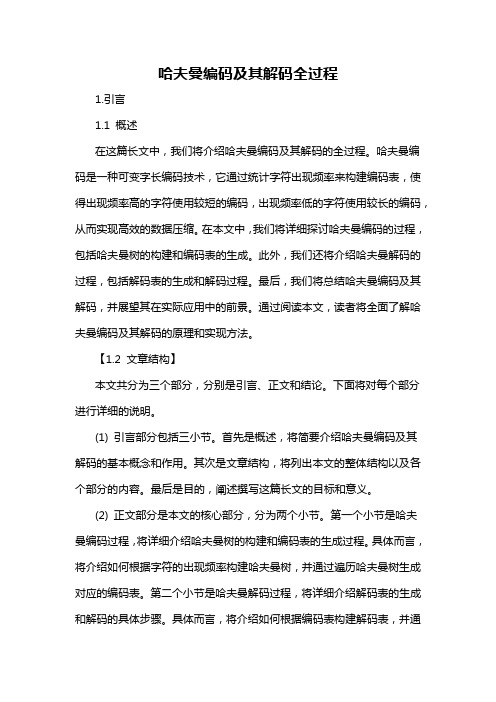

哈夫曼编码及其解码全过程1.引言1.1 概述在这篇长文中,我们将介绍哈夫曼编码及其解码的全过程。

哈夫曼编码是一种可变字长编码技术,它通过统计字符出现频率来构建编码表,使得出现频率高的字符使用较短的编码,出现频率低的字符使用较长的编码,从而实现高效的数据压缩。

在本文中,我们将详细探讨哈夫曼编码的过程,包括哈夫曼树的构建和编码表的生成。

此外,我们还将介绍哈夫曼解码的过程,包括解码表的生成和解码过程。

最后,我们将总结哈夫曼编码及其解码,并展望其在实际应用中的前景。

通过阅读本文,读者将全面了解哈夫曼编码及其解码的原理和实现方法。

【1.2 文章结构】本文共分为三个部分,分别是引言、正文和结论。

下面将对每个部分进行详细的说明。

(1) 引言部分包括三小节。

首先是概述,将简要介绍哈夫曼编码及其解码的基本概念和作用。

其次是文章结构,将列出本文的整体结构以及各个部分的内容。

最后是目的,阐述撰写这篇长文的目标和意义。

(2) 正文部分是本文的核心部分,分为两个小节。

第一个小节是哈夫曼编码过程,将详细介绍哈夫曼树的构建和编码表的生成过程。

具体而言,将介绍如何根据字符的出现频率构建哈夫曼树,并通过遍历哈夫曼树生成对应的编码表。

第二个小节是哈夫曼解码过程,将详细介绍解码表的生成和解码的具体步骤。

具体而言,将介绍如何根据编码表构建解码表,并通过解码表将编码还原成原始字符。

(3) 结论部分也包括两个小节。

首先是总结,将对整篇文章的内容进行简要回顾,并总结哈夫曼编码及其解码的关键步骤和特点。

其次是应用前景,将探讨哈夫曼编码在实际应用中的潜在价值和发展前景,展示其在数据压缩和信息传输等领域的重要性。

通过对文章结构的明确描述,读者可以清晰地了解到本文的整体内容安排,从而更好地理解和阅读本文的各个部分。

1.3 目的本文的目的是介绍哈夫曼编码及其解码的全过程。

通过详细阐述哈夫曼编码的构建和解码过程,使读者能够深入理解哈夫曼编码的原理和应用。

哈夫曼编码长度

哈夫曼编码长度

哈夫曼编码是一种无损数据压缩的算法,它通过构建一棵哈夫曼树来实现压缩。

在构建哈夫曼树的过程中,每个字符都被表示为一个二进制字符串,其中出现频率较高的字符被赋予较短的编码,而出现频率较低的字符则被赋予较长的编码。

这就是哈夫曼编码的本质。

哈夫曼编码的长度取决于字符的出现频率,出现频率越高的字符对应的编码越短,出现频率越低的字符对应的编码越长。

因此,哈夫曼编码长度的平均值与字符出现频率之间存在关系。

假设一个英文文本中包含26个字母,那么每个字母的出现频率可以用一个概率分布来表示。

对于一个概率分布p,其哈夫曼编码的平均长度为:

L(p) = ∑i=1 to n pi * ci

其中n是字符的个数,pi是第i个字符出现的概率,ci是第i 个字符对应的二进制编码的长度。

根据上述公式,我们可以得出一个结论:在任何一个概率分布下,哈夫曼编码长度都比等长的二进制编码长度更短。

这是因为哈夫曼编码根据出现频率的不同,给予不同的字符不同的编码长度,从而实现更高效的压缩效果。

因此,哈夫曼编码被广泛应用于数据压缩领域。

- 1 -。

哈夫曼编码详解(C语言实现)

哈夫曼编码详解(C语言实现)哈夫曼编码是一种常见的前缀编码方式,被广泛应用于数据压缩和传输中。

它是由大卫·哈夫曼(David A. Huffman)于1952年提出的,用于通过将不同的字符映射到不同长度的二进制码来实现数据的高效编码和解码。

1.统计字符频率:遍历待编码的文本,记录每个字符出现的频率。

2.构建哈夫曼树:根据字符频率构建哈夫曼树,其中出现频率越高的字符位于树的较低层,频率越低的字符位于树的较高层。

3.生成编码表:从哈夫曼树的根节点开始,遍历哈夫曼树的每个节点,为每个字符生成对应的编码。

在遍历过程中,从根节点到叶子节点的路径上的“0”表示向左,路径上的“1”表示向右。

4.进行编码:根据生成的编码表,将待编码的文本中的每个字符替换为对应的编码。

5.进行解码:根据生成的编码表和编码结果,将编码替换为原始字符。

下面是一个用C语言实现的简单哈夫曼编码示例:```c#include <stdio.h>#include <stdlib.h>#include <string.h>//定义哈夫曼树的节点结构体typedef struct HuffmanNodechar data; // 字符数据int freq; // 字符出现的频率struct HuffmanNode *left; // 左子节点struct HuffmanNode *right; // 右子节点} HuffmanNode;//定义编码表typedef structchar data; // 字符数据char *code; // 字符对应的编码} HuffmanCode;//统计字符频率int *countFrequency(char *text)int *frequency = (int *)calloc(256, sizeof(int)); int len = strlen(text);for (int i = 0; i < len; i++)frequency[(int)text[i]]++;}return frequency;//创建哈夫曼树HuffmanNode *createHuffmanTree(int *frequency)//初始化叶子节点HuffmanNode **leaves = (HuffmanNode **)malloc(256 * sizeof(HuffmanNode *));for (int i = 0; i < 256; i++)if (frequency[i] > 0)HuffmanNode *leaf = (HuffmanNode*)malloc(sizeof(HuffmanNode));leaf->data = (char)i;leaf->freq = frequency[i];leaf->left = NULL;leaf->right = NULL;leaves[i] = leaf;} elseleaves[i] = NULL;}}//构建哈夫曼树while (1)int min1 = -1, min2 = -1;for (int i = 0; i < 256; i++)if (leaves[i] != NULL)if (min1 == -1 , leaves[i]->freq < leaves[min1]->freq) min2 = min1;min1 = i;} else if (min2 == -1 , leaves[i]->freq < leaves[min2]->freq)min2 = i;}}}if (min2 == -1)break;}HuffmanNode *parent = (HuffmanNode*)malloc(sizeof(HuffmanNode));parent->data = 0;parent->freq = leaves[min1]->freq + leaves[min2]->freq;parent->left = leaves[min1];parent->right = leaves[min2];leaves[min1] = parent;leaves[min2] = NULL;}HuffmanNode *root = leaves[min1];free(leaves);return root;//生成编码表void generateHuffmanCode(HuffmanNode *root, HuffmanCode *huffmanCode, char *code, int depth)if (root->left == NULL && root->right == NULL)code[depth] = '\0';huffmanCode[root->data].data = root->data;huffmanCode[root->data].code = strdup(code);return;}if (root->left != NULL)code[depth] = '0';generateHuffmanCode(root->left, huffmanCode, code, depth + 1);}if (root->right != NULL)code[depth] = '1';generateHuffmanCode(root->right, huffmanCode, code, depth + 1);}//进行编码char *encodeText(char *text, HuffmanCode *huffmanCode)int len = strlen(text);int codeLen = 0;char *code = (char *)malloc(len * 8 * sizeof(char));for (int i = 0; i < len; i++)strcat(code + codeLen, huffmanCode[(int)text[i]].code);codeLen += strlen(huffmanCode[(int)text[i]].code);}return code;//进行解码char* decodeText(char* code, HuffmanNode* root) int len = strlen(code);char* text = (char*)malloc(len * sizeof(char)); int textLen = 0;HuffmanNode* node = root;for (int i = 0; i < len; i++)if (code[i] == '0')node = node->left;} elsenode = node->right;}if (node->left == NULL && node->right == NULL) text[textLen] = node->data;textLen++;node = root;}}text[textLen] = '\0';return text;int maichar *text = "Hello, World!";int *frequency = countFrequency(text);HuffmanNode *root = createHuffmanTree(frequency);HuffmanCode *huffmanCode = (HuffmanCode *)malloc(256 * sizeof(HuffmanCode));char code[256];generateHuffmanCode(root, huffmanCode, code, 0);char *encodedText = encodeText(text, huffmanCode);char *decodedText = decodeText(encodedText, root);printf("Original Text: %s\n", text);printf("Encoded Text: %s\n", encodedText);printf("Decoded Text: %s\n", decodedText);//释放内存free(frequency);free(root);for (int i = 0; i < 256; i++)if (huffmanCode[i].code != NULL)free(huffmanCode[i].code);}}free(huffmanCode);free(encodedText);free(decodedText);return 0;```上述的示例代码实现了一个简单的哈夫曼编码和解码过程。

三进制huffman编码代码

一、引言三进制Huffman编码是一种用于数据压缩的技术,它可以将数据以更高效的方式进行存储和传输。

本文将对三进制Huffman编码的原理和实现代码进行详细介绍。

二、Huffman编码原理1. Huffman编码的基本概念Huffman编码是一种变长编码方式,它根据信息的统计特性来构建不同长度的编码,以实现数据的高效压缩。

在Huffman编码中,出现频率高的字符用较短的编码表示,而出现频率低的字符用较长的编码表示,这样可以减少数据的传输量,从而实现数据压缩的目的。

2. 三进制Huffman编码的特点与传统的二进制Huffman编码不同,三进制Huffman编码适用于对三进制数据进行编码压缩。

在三进制Huffman编码中,数据由0、1、2三种符号组成,因此需要重新设计Huffman编码树和编码表来适应这种特殊情况。

三、三进制Huffman编码的实现1. 构建Huffman编码树我们需要根据数据的统计特点来构建Huffman编码树。

对于三进制数据,我们可以统计每种符号出现的频率,并将其构建成一个优先队列(或最小堆),然后通过不断合并权值最小的两个节点来构建Huffman编码树。

2. 生成编码表在构建好Huffman编码树之后,我们可以通过遍历这棵树来生成每个符号对应的编码。

在遍历的过程中,我们可以使用递归或者迭代的方法来获得每个符号的编码,并将其存储在一个编码表中以便后续的编码和解码操作。

3. 编码和解码操作通过生成的编码表,我们可以将原始的三进制数据编码成对应的Huffman编码,或者将Huffman编码解码成原始的三进制数据。

在编码和解码的过程中,需要注意处理边界情况和错误输入,并保证编码和解码的正确性和高效性。

四、三进制Huffman编码的应用三进制Huffman编码在实际中有着广泛的应用,特别是在存储和传输三进制数据时。

通过三进制Huffman编码,可以大大减少数据的传输量,提高数据传输的效率,从而节省存储和带宽成本。

数据结构哈夫曼编码

数据结构哈夫曼编码

哈夫曼编码是一种用于数据压缩的算法,它基于哈夫曼树(HuffmanTree)进行编码。

哈夫曼编码的基本思想是:对于出现频率高的字符,其编码长度较短;而对于出现频率低的字符,其编码长度较长。

这样,通过调整字符的编码长度,可以有效地压缩数据。

哈夫曼编码的具体步骤如下:

1.统计原始数据中每个字符的出现频率。

2.构建哈夫曼树。

在构建过程中,每次将两个权值最小的节点合并,并将它们的权值相加。

同时,将新生成的节点的权值作为新字符的出现频率。

3.根据哈夫曼树生成哈夫曼编码。

对于哈夫曼树中的每个字符,从根节点到该字符所在节点的路径可以形成一个二进制编码。

通常约定左分支标记为0,右分支标记为1。

这样,从根节点到每个叶节点的路径就可以形成一个二进制编码,该编码即为对应字符的哈夫曼编码。

4.使用哈夫曼编码对原始数据进行压缩。

对于原始数据中的每个字符,根据其哈夫曼编码进行编码,最终得到压缩后的数据。

需要注意的是,哈夫曼编码是一种无损压缩算法,即压缩和解压过程中可以完全还原原始数据。

同时,由于哈夫曼编码是基于字符出现频率进行编码的,因此对于出现频率高的字符,其编码长度较短;而对于出现频率低的字符,其编码长度较长。

这样可以有效地减少数据的存储空间,提高数据压缩率。

使用哈夫曼编码方法,求出编码和平均码长。

哈夫曼编码是一种常用的数据压缩算法,它能够根据不同字符出现的频率来构建不等长的编码,以实现数据的高效压缩。

在这篇文章中,我们将深入探讨哈夫曼编码方法,并求出编码和平均码长。

1. 了解哈夫曼编码哈夫曼编码是由大卫·哈夫曼于1952年提出的一种编码算法,它利用频率较高的字符用较短的编码,而频率较低的字符用较长的编码,从而实现数据的高效压缩。

哈夫曼编码的核心思想是通过构建一棵最优二叉树来实现编码,使得出现频率较高的字符距离根节点较近,而出现频率较低的字符距离根节点较远。

2. 构建哈夫曼树为了求解哈夫曼编码,首先需要构建哈夫曼树。

哈夫曼树的构建过程是一个逐步合并的过程,首先将所有的字符按照出现频率进行排序,然后依次选取频率最小的两个字符合并成一个新的节点,其频率为两个字符的频率之和。

重复这一步骤,直到所有字符都合并成了一个根节点,这棵树就是哈夫曼树。

3. 求解哈夫曼编码在构建好哈夫曼树之后,就可以开始求解每个字符的哈夫曼编码。

从根节点出发,遍历哈夫曼树的左子树走向0,右子树走向1,直到达到叶子节点,记录下路径上的编码即为该字符的哈夫曼编码。

这样,所有字符的哈夫曼编码就求解出来了。

4. 计算平均码长计算平均码长是评价哈夫曼编码效率的重要指标。

平均码长的计算公式为:平均码长=Σ(字符频率*编码长度)。

通过对所有字符的频率乘以对应的编码长度求和,可以得到平均码长。

哈夫曼编码的优势在于,由于频率高的字符编码长度较短,而频率低的字符编码长度较长,因此平均码长相对较短,实现了对数据的高效压缩。

总结:通过本文对哈夫曼编码方法的全面介绍和讨论,我们深入理解了哈夫曼编码的原理和实现过程,以及如何求解编码和平均码长。

哈夫曼编码作为一种高效的数据压缩算法,在实际应用中有着广泛的应用前景。

通过对哈夫曼编码的深入理解,我们可以更好地应用于实际场景中,实现数据的高效压缩和传输。

个人观点:哈夫曼编码作为一种经典的数据压缩算法,具有较高的实用价值和理论研究意义。

哈夫曼编码(Huffman Coding)

哈夫曼编码哈夫曼编码(Huffman Coding)是一种编码方式,哈夫曼编码是可变字长编码(VL C)的一种。

Huffman于1952年提出一种编码方法,该方法完全依据字符出现概率来构造异字头的平均长度最短的码字,有时称之为最佳编码,一般就叫作Huffman 编码。

以哈夫曼树─即最优二叉树,带权路径长度最小的二叉树,经常应用于数据压缩。

在计算机信息处理中,“哈夫曼编码”是一种一致性编码法(又称"熵编码法"),用于数据的无损耗压缩。

这一术语是指使用一张特殊的编码表将源字符(例如某文件中的一个符号)进行编码。

这张编码表的特殊之处在于,它是根据每一个源字符出现的估算概率而建立起来的(出现概率高的字符使用较短的编码,反之出现概率低的则使用较长的编码,这便使编码之后的字符串的平均期望长度降低,从而达到无损压缩数据的目的)。

这种方法是由David.A.Huffman发展起来的。

例如,在英文中,e的出现概率很高,而z的出现概率则最低。

当利用哈夫曼编码对一篇英文进行压缩时,e极有可能用一个位(bit)来表示,而z则可能花去25个位(不是26)。

用普通的表示方法时,每个英文字母均占用一个字节(byte),即8个位。

二者相比,e使用了一般编码的1/8的长度,z则使用了3倍多。

倘若我们能实现对于英文中各个字母出现概率的较准确的估算,就可以大幅度提高无损压缩的比例。

本文描述在网上能够找到的最简单,最快速的哈夫曼编码。

本方法不使用任何扩展动态库,比如STL或者组件。

只使用简单的C函数,比如:memset,memmove,qsort,malloc,realloc和memcpy。

因此,大家都会发现,理解甚至修改这个编码都是很容易的。

背景哈夫曼压缩是个无损的压缩算法,一般用来压缩文本和程序文件。

哈夫曼压缩属于可变代码长度算法一族。

意思是个体符号(例如,文本文件中的字符)用一个特定长度的位序列替代。

因此,在文件中出现频率高的符号,使用短的位序列,而那些很少出现的符号,则用较长的位序列。

二进制哈夫曼编码进行压缩

二进制哈夫曼编码进行压缩

(实用版)

目录

1.二进制哈夫曼编码的概述

2.二进制哈夫曼编码的压缩过程

3.二进制哈夫曼编码的优点与应用

正文

【二进制哈夫曼编码的概述】

二进制哈夫曼编码是一种常用的数据压缩编码方法,适用于所有由 0 和 1 组成的数据。

哈夫曼编码是由哈夫曼树生成的,哈夫曼树是一种特殊的二叉树,它将原始数据转换为对应的编码,以便实现压缩。

这种编码方式可以大大减少数据量,使得数据传输和存储更加高效。

【二进制哈夫曼编码的压缩过程】

二进制哈夫曼编码的压缩过程主要包括以下步骤:

1.根据输入数据(0 和 1)构建哈夫曼树。

首先将输入数据中的每个字符作为叶子节点,然后将相邻的节点合并,得到一个新的父节点。

重复这个过程,直到只剩下一个节点,这个节点就是哈夫曼树的根节点。

2.从哈夫曼树中得到编码表。

从根节点到每个叶子节点的路径代表一个字符的编码,其中左子节点的边表示 0,右子节点的边表示 1。

3.根据编码表,将原始数据转换为对应的哈夫曼编码。

【二进制哈夫曼编码的优点与应用】

二进制哈夫曼编码具有以下优点:

1.无损压缩:哈夫曼编码是一种无损压缩方法,它可以将原始数据完美地恢复。

2.高压缩率:哈夫曼编码能够将由 0 和 1 组成的数据压缩到最短,使得数据传输和存储更加高效。

3.适用于各种数据:哈夫曼编码不仅适用于文本数据,还适用于图像、音频等多种数据类型。

二进制哈夫曼编码在很多领域都有广泛应用,如数据传输、图像压缩、语音编码等。

例如,在 JPEG 图像压缩中,哈夫曼编码被用于对颜色空间中的系数进行压缩。

进制哈夫曼编码

下午12时51分

11

5.4 哈夫曼(Huffman)编码

m进制哈夫曼编码

二进制哈夫曼的编码方法可以很容易推广到m进 制的情况。只是编码过程中构成缩减信源时,每 次都是将m个概率最小的符号合并,并分别用 0,1,…,m-1码符号表示。

为使平均码长最短,必须使最后一步缩减信源有 m个信源符号。如果第一步给概率最小的符号分 配码元时,所取的符号数就不一定是m个。

3

5.4 哈夫曼(Huffman)编码(例1续)

0.20 0.20 0.26 0.35 0.39 0.610 1.0 0.19 0.19 0.20 0.26 0.35 0 0.391 0.18 0.18 0.19 0.20 0 0.26 1 0.17 0.17 0.180 0.19 1 0.15 0.15 0 0.171 0.100 0.11 1 0.01 1

码字。 后来新加的概率为零的符号,虽也赋予码字,实际上这是冗余码字,

并未用上,但这样编成的码,仍是最佳的,也就是平均码长最短,如 果等概率符号排队时注意到顺序,则码长的方差也是最小的。

下午12时51分

14

m进制哈夫曼编码-例1

设单符号离散无记忆信源如下,对信源编三进制 哈夫曼码。

X p(xi

第一种方法码树图

下午12时51分

第二种方法码树图

9

5.4 哈夫曼(Huffman)编码(例2续)

7

两 种 方 法 的 平 均 码 长 相等 :K p(xi )Ki 2.2码 元/符 号 i 1

两 种 编 码 方 法 的 编 码 效率 相 等 : H ( X ) 96.5%

K

码字长度的方差:

对信源进行缩减时,两个概率最小的符号合并后的概率与其它信源符 号的概率相同时,这两者在缩减信源中进行概率排序,其位置放置次 序是可以任意的,故会得到不同的哈夫曼码。此时将影响码字的长度, 一般将合并的概率放在上面,这样可获得较小的码方差。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。