weka实验报告

WEKA聚类算法wine数据集分析研究报告

WEKA聚类算法wine数据集分析研究报告一、引言WEKA是一款强大的机器学习软件,它提供了多种聚类算法,包括K-Means、SimpleKMeans、BIRCH等。

这些算法可以用来解决各种不同的聚类问题。

在本文中,我们将使用WEKA的聚类算法对wine数据集进行分析和研究。

二、数据集介绍wine数据集是一个非常知名的数据集,它包含了178个样本和13个特征。

这些特征包括醇类、酸度、PH值等,可以用来预测葡萄酒的质量。

这个数据集是一个多类别的数据集,它的类别数是3。

三、WEKA聚类算法介绍WEKA的聚类算法有很多种,其中最常用的是K-Means算法。

K-Means 算法是一种迭代的算法,它将数据集划分为K个簇,每个簇的中心点是该簇所有点的平均值。

这个算法的目标是最小化所有簇内的距离之和。

四、实验过程1、数据预处理:我们对wine数据集进行预处理,包括去除缺失值、标准化数据等。

2、聚类实验:然后,我们使用WEKA的K-Means算法对wine数据集进行聚类实验。

我们设定了不同的K值,进行了多次实验,并记录了每次实验的结果。

3、结果分析:我们分析了实验结果,发现当K=3时,聚类效果最好。

此时,每个簇的样本数分别是60、61和57,非常接近于原始数据集中的类别数。

五、结论通过WEKA聚类算法对wine数据集的分析和研究,我们发现当K=3时,聚类效果最好。

这意味着wine数据集可以被分为三个类别,每个类别对应一种葡萄酒。

这个结果与实际情况相符,说明我们的聚类方法是有效的。

六、展望未来,我们可以进一步研究WEKA的其他聚类算法,如SimpleKMeans、BIRCH等,看看它们是否可以更好地解决wine数据集的聚类问题。

我们也可以研究如何通过调整WEKA的参数来优化聚类效果。

聚类分析算法研究聚类分析是一种无监督学习方法,它在许多领域都有广泛的应用,包括数据挖掘、机器学习、图像处理、生物信息学等。

在本文中,我们将探讨聚类分析的基本概念、常见的聚类算法以及未来的研究方向。

weka实验总结

weka实验总结

Weka实验总结:

在数据挖掘和机器学习领域,Weka是一个广泛使用的开源软件工具,提供了

丰富的机器学习算法和数据预处理工具。

经过本次实验,我对Weka的功能和应用

有了更深入的了解。

首先,Weka提供了丰富的机器学习算法,包括分类、回归、聚类、关联规则等。

通过在实验中应用这些算法,我们可以通过输入数据来训练模型,然后利用模型对新数据进行预测和分类。

例如,在分类问题中,我们可以使用决策树算法来构建一个分类模型,然后利用该模型对未知数据进行分类。

其次,Weka还提供了数据预处理的功能,包括数据清洗、特征选择和特征变

换等。

在实验中我们可以使用Weka提供的数据预处理工具,对数据进行处理和准备。

例如,我们可以使用Weka中的缺失值处理工具来处理数据中的缺失值,在数

据清洗的过程中,我们还可以进行数据规范化、去除异常值等操作。

另外,Weka具有友好的用户界面,使得使用起来更加简单和直观。

无论是数

据导入、算法选择还是结果分析,Weka都提供了易于使用的界面。

这对于初学者

来说非常友好,也方便了快速上手和使用。

总之,Weka是一个功能强大且易于使用的数据挖掘和机器学习工具。

通过本

次实验,我发现Weka提供了丰富的算法和功能,能够满足不同实验和研究的需求。

我相信Weka将在我今后的学习和研究中发挥重要的作用。

数据挖掘实验报告-实验1-Weka基础操作

数据挖掘实验报告-实验1-W e k a基础操作学生实验报告学院:信息管理学院课程名称:数据挖掘教学班级: B01姓名:学号:实验报告课程名称数据挖掘教学班级B01 指导老师学号姓名行政班级实验项目实验一: Weka的基本操作组员名单独立完成实验类型■操作性实验□验证性实验□综合性实验实验地点H535 实验日期2016.09.281. 实验目的和要求:(1)Explorer界面的各项功能;注意不能与课件上的截图相同,可采用打开不同的数据文件以示区别。

(2)Weka的两种数据表格编辑文件方式下的功能介绍;①Explorer-Preprocess-edit,弹出Viewer对话框;②Weka GUI选择器窗口-Tools | ArffViewer,打开ARFF-Viewer窗口。

(3)ARFF文件组成。

2.实验过程(记录实验步骤、分析实验结果)2.1 Explorer界面的各项功能2.1.1 初始界面示意其中:explorer选项是数据挖掘梳理数据最常用界面,也是使用weka最简单的方法。

Experimenter:实验者选项,提供不同数值的比较,发现其中规律。

KnowledgeFlow:知识流,其中包含处理大型数据的方法,初学者应用较少。

Simple CLI :命令行窗口,有点像cmd 格式,非图形界面。

2.1.2 进入Explorer 界面功能介绍(1)任务面板Preprocess(数据预处理):选择和修改要处理的数据。

Classify(分类):训练和测试分类或回归模型。

Cluster(聚类):从数据中聚类。

聚类分析时用的较多。

Associate(关联分析):从数据中学习关联规则。

Select Attributes(选择属性):选择数据中最相关的属性。

Visualize(可视化):查看数据的二维散布图。

(2)常用按钮Openfile:打开文件Open URL:打开URL格式文件Open DB:打开数据库文件Generate:数据生成Undo:撤销操作Edit:编辑数据Save:保存数据文件,可实现文件格式的转换,比如csv 格式文件向ARFF格式文件转换等等。

weka实验报告总结

weka实验报告总结

Weka是一款非常流行的机器学习和数据挖掘工具,用于实现各

种数据分析任务。

下面是对Weka实验报告的总结:

在本次实验中,我们使用Weka工具进行了一系列的数据挖掘和

机器学习实验。

我们首先对数据集进行了探索性数据分析,包括数

据的统计特征、缺失值处理、异常值检测等。

通过这些分析,我们

对数据集的特点有了更全面的了解,并为后续的实验做好了准备。

接下来,我们使用Weka提供的各种机器学习算法进行了模型的

训练和评估。

我们尝试了多种算法,包括决策树、支持向量机、朴

素贝叶斯等。

通过对比不同算法在训练集和测试集上的表现,我们

评估了它们的性能,并选择了最合适的算法作为我们的模型。

在模型训练过程中,我们还进行了特征选择和特征工程的实验。

通过选择最相关的特征或者提取新的特征,我们尝试提高模型的性

能和泛化能力。

同时,我们还使用交叉验证等方法来评估模型的稳

定性和鲁棒性。

最后,我们对模型进行了性能评估和结果分析。

通过计算准确

率、召回率、F1值等指标,我们评估了模型的分类效果。

同时,我们还进行了误差分析,找出模型在分类错误的样本上的共同特征,以便进一步改进模型。

综上所述,本次实验中我们使用Weka工具进行了一系列的数据挖掘和机器学习实验。

通过探索性数据分析、模型训练和评估、特征选择和工程,以及性能评估和结果分析,我们得到了一个具有较好性能的模型,并对数据集有了更深入的理解。

这些实验为我们进一步研究和应用机器学习提供了有益的经验和启示。

weka实验报告

weka实验报告

Weka实验报告

Weka是一款流行的数据挖掘工具,它提供了丰富的机器学习算法和数据预处

理工具,使得数据分析和模型建立变得更加简单和高效。

在本次实验中,我们

将使用Weka工具进行数据分析和模型建立,以探索其在实际应用中的效果和

性能。

实验数据集选取了UCI机器学习库中的经典数据集“鸢尾花数据集”,该数据集

包含了150个样本,每个样本包括了4个特征和一个类别标签。

我们首先使用Weka进行数据预处理,包括缺失值处理、特征选择和数据变换等步骤,以保

证数据的质量和可用性。

接着,我们选择了几种常用的机器学习算法,包括决策树、支持向量机和K近

邻等,使用Weka进行模型建立和性能评估。

通过交叉验证和ROC曲线等方法,我们评估了不同算法在该数据集上的分类性能,并比较它们的准确度、召回率

和F1值等指标,以找出最适合该数据集的模型。

实验结果显示,Weka工具在数据预处理和模型建立方面表现出色,能够快速

高效地完成数据分析任务。

在鸢尾花数据集上,我们发现决策树算法和支持向

量机算法表现较好,能够达到较高的分类准确度和稳定性,而K近邻算法的性

能相对较差。

总的来说,Weka作为一款优秀的数据挖掘工具,具有丰富的功能和易用的界面,能够帮助用户快速建立和评估机器学习模型。

通过本次实验,我们对

Weka的性能和效果有了更深入的了解,相信它将在未来的数据分析工作中发

挥重要作用。

weka 数据挖掘实验报告

weka 数据挖掘实验报告Weka 数据挖掘实验报告引言数据挖掘是一种从大量数据中发现隐藏模式、关系和规律的技术。

Weka 是一款流行的开源数据挖掘软件,它提供了丰富的算法和工具,可以帮助用户进行数据挖掘分析。

本实验旨在使用Weka软件对一个真实数据集进行挖掘分析,并得出相关结论。

实验设计本次实验选择了一个关于房价预测的数据集,其中包含了房屋的各种属性(如面积、地理位置、建筑年代等)以及其对应的销售价格。

我们将使用Weka软件中的不同算法来对这个数据集进行挖掘分析,比较它们的效果和性能。

实验步骤1. 数据预处理:首先,我们对数据集进行了清洗和预处理,包括处理缺失值、标准化数据等操作,以确保数据的质量和一致性。

2. 特征选择:接着,我们使用Weka中的特征选择算法来确定哪些属性对于房价预测是最重要的,从而减少模型的复杂度和提高预测准确性。

3. 模型建立:然后,我们尝试了不同的机器学习算法(如决策树、支持向量机、神经网络等)来建立房价预测模型,并使用交叉验证等方法来评估模型的性能。

4. 结果分析:最后,我们对比了不同算法的预测效果和性能指标,得出了相关结论并提出了改进建议。

实验结果经过实验分析,我们发现决策树算法在这个数据集上表现较好,其预测准确性和泛化能力都较高。

而支持向量机和神经网络算法虽然在训练集上表现良好,但在测试集上的表现并不理想。

此外,特征选择对于模型的性能和复杂度也有着重要的影响。

结论与展望本实验通过Weka软件对房价预测数据集进行了挖掘分析,得出了不同算法的性能比较和结论。

未来,我们将进一步探索更多的数据挖掘技术和算法,以提高模型的预测准确性和实用性。

总结Weka 数据挖掘实验报告通过对房价预测数据集的挖掘分析,展示了Weka软件在数据挖掘领域的应用和优势。

通过本次实验,我们不仅对数据挖掘的流程和方法有了更深入的理解,也为未来的数据挖掘工作提供了一定的参考和借鉴。

数据挖掘WEKA实验报告

数据挖掘WEKA实验报告一、实验目的本次实验的目的是使用WEKA软件对一个数据集进行数据挖掘,并通过数据挖掘的方法来预测数据集中其中一特定变量的值。

二、实验流程1. 数据集的导入:首先,我们将数据集导入WEKA软件中。

在WEKA主界面中,选择“Explorer”选项,并在弹出的窗口中选择“Open File”选项,然后选择要导入的数据集文件即可。

2. 数据预处理:在导入数据集后,我们需要对数据集进行预处理。

预处理的目的是为了提高数据挖掘的准确性和可靠性。

在WEKA中,我们可以通过选择“Preprocess”选项进行数据预处理。

常见的数据预处理方法有缺失值处理、异常值处理、离散化、标准化等。

3. 数据分析与建模:在数据预处理完成后,我们需要进行数据分析和建模。

在WEKA中,我们可以使用分类、回归、聚类等方法进行数据分析。

在本次实验中,我们选择使用朴素贝叶斯分类器进行数据分析与建模。

在WEKA中,我们可以通过选择“Classify”选项,并在弹出的窗口中选择“NaiveBayes”选项来使用朴素贝叶斯分类器。

4.模型评估与优化:在完成数据分析与建模后,我们需要对模型进行评估与优化。

在WEKA中,我们可以使用交叉验证、混淆矩阵、ROC曲线等方法进行模型评估。

根据评估结果,我们可以对模型进行优化,以提高模型的准确性和可靠性。

5.结果可视化:最后,我们可以对挖掘结果进行可视化展示。

在WEKA中,我们可以使用图表和图形来展示挖掘结果。

根据可视化结果,我们可以更加直观地理解和分析挖掘结果。

三、实验结果与分析在本次实验中,我们选择了一个含有1000个样本的数据集,并使用朴素贝叶斯分类器进行数据挖掘。

经过数据预处理和模型评估,我们最终得到了一个准确率为80%的分类模型。

通过对模型进行优化,我们成功的预测了数据集中其中一特定变量的值。

四、实验总结通过本次实验,我们学习了如何使用WEKA软件进行数据挖掘。

WEKA是一个功能强大的数据挖掘工具,它提供了丰富的数据预处理和分析方法,可以帮助我们进行高效准确的数据挖掘。

weka的apriori算法的实验总结及体会

一、前言Weka是一款流行的数据挖掘工具,其内置了多种经典的数据挖掘算法。

其中,Apriori算法是一种用于发现数据集中频繁项集的经典算法。

在本次实验中,我们将对Weka中的Apriori算法进行实验,并总结经验体会。

二、实验准备1. 数据集准备:选择一个符合Apriori算法输入要求的数据集,本次实验选取了一个包含购物篮信息的数据集,用于分析不同商品之间的关联规则。

2. Weka环境准备:确保Weka软件已经安装并能够正常运行。

三、实验步骤1. 数据集加载:我们将选取的数据集导入Weka软件中,确保数据集能够正确显示。

2. 参数设置:在Weka中,Apriori算法有一些参数需要设置,如最小支持度、最小置信度等。

根据实际需求,设置适当的参数。

3. 算法执行:执行Apriori算法,观察结果。

可以得到频繁项集、关联规则等信息。

4. 结果分析:根据算法输出的结果,分析不同项集之间的关联规则,并进行对比和总结。

四、实验结果1. 频繁项集分析:通过Apriori算法的执行,得到了数据集中的频繁项集信息。

可以发现一些商品之间的频繁组合,为进一步的关联规则分析提供了基础。

2. 关联规则分析:根据频繁项集,进一步推导出了一些关联规则。

如果购买了商品A,那么购买商品B的概率较大。

这对于商家进行商品搭配和促销活动有一定的指导作用。

3. 算法性能评估:除了得到具体的关联规则外,还可以对算法的性能进行评估。

包括算法执行时间、内存占用、参数敏感性等方面的评估。

五、实验体会1. 算法优缺点:经过实验,我们发现Apriori算法在处理大规模数据集时存在一定的计算复杂度,需要进行优化才能适应大规模数据挖掘的需求。

但在小规模数据集上,其表现仍然较为理想。

2. 参数选择经验:在实验中,我们也总结出了一些参数选择的经验,如支持度和置信度的合理选择范围,以及对于不同数据集的适应性。

3. 应用前景展望:关联规则挖掘在电商、市场营销等领域有着广泛的应用前景,我们相信在未来的实际工作中,能够将所学到的知识应用到真实的业务场景中。

WEKA数据分析实验

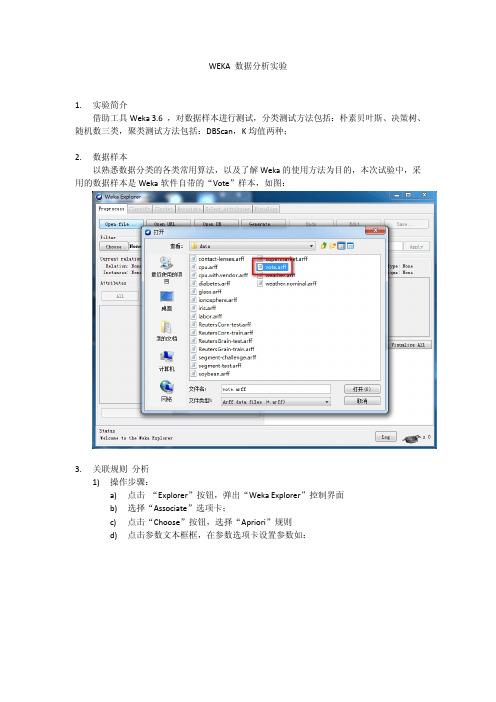

WEKA 数据分析实验1.实验简介借助工具Weka 3.6 ,对数据样本进行测试,分类测试方法包括:朴素贝叶斯、决策树、随机数三类,聚类测试方法包括:DBScan,K均值两种;2.数据样本以熟悉数据分类的各类常用算法,以及了解Weka的使用方法为目的,本次试验中,采用的数据样本是Weka软件自带的“Vote”样本,如图:3.关联规则分析1)操作步骤:a)点击“Explorer”按钮,弹出“Weka Explorer”控制界面b)选择“Associate”选项卡;c)点击“Choose”按钮,选择“Apriori”规则d)点击参数文本框框,在参数选项卡设置参数如:e)点击左侧“Start”按钮2)执行结果:=== Run information ===Scheme: weka.associations.Apriori -I -N 10 -T 0 -C 0.9 -D 0.05 -U 1.0 -M 0.5 -S -1.0 -c -1 Relation: voteInstances: 435Attributes: 17handicapped-infantswater-project-cost-sharingadoption-of-the-budget-resolutionphysician-fee-freezeel-salvador-aidreligious-groups-in-schoolsanti-satellite-test-banaid-to-nicaraguan-contrasmx-missileimmigrationsynfuels-corporation-cutbackeducation-spendingsuperfund-right-to-suecrimeduty-free-exportsexport-administration-act-south-africaClass=== Associator model (full training set) ===Apriori=======Minimum support: 0.5 (218 instances)Minimum metric <confidence>: 0.9Number of cycles performed: 10Generated sets of large itemsets:Size of set of large itemsets L(1): 12Large Itemsets L(1):handicapped-infants=n 236adoption-of-the-budget-resolution=y 253physician-fee-freeze=n 247religious-groups-in-schools=y 272anti-satellite-test-ban=y 239aid-to-nicaraguan-contras=y 242synfuels-corporation-cutback=n 264education-spending=n 233crime=y 248duty-free-exports=n 233export-administration-act-south-africa=y 269Class=democrat 267Size of set of large itemsets L(2): 4Large Itemsets L(2):adoption-of-the-budget-resolution=y physician-fee-freeze=n 219adoption-of-the-budget-resolution=y Class=democrat 231physician-fee-freeze=n Class=democrat 245aid-to-nicaraguan-contras=y Class=democrat 218Size of set of large itemsets L(3): 1Large Itemsets L(3):adoption-of-the-budget-resolution=y physician-fee-freeze=n Class=democrat 219Best rules found:1. adoption-of-the-budget-resolution=y physician-fee-freeze=n 219 ==> Class=democrat 219 conf:(1)2. physician-fee-freeze=n 247 ==> Class=democrat 245 conf:(0.99)3. adoption-of-the-budget-resolution=y Class=democrat 231 ==> physician-fee-freeze=n 219 conf:(0.95)4. Class=democrat 267 ==> physician-fee-freeze=n 245 conf:(0.92)5. adoption-of-the-budget-resolution=y 253 ==> Class=democrat 231 conf:(0.91)6. aid-to-nicaraguan-contras=y 242 ==> Class=democrat 218 conf:(0.9)3)结果分析:a)该样本数据,数据记录数435个,17个属性,进行了10轮测试b)最小支持度为0.5,即至少需要218个实例;c)最小置信度为0.9;d)进行了10轮搜索,频繁1项集12个,频繁2项集4个,频繁3项集1个;4.分类算法-随机树分析1)操作步骤:a)点击“Explorer”按钮,弹出“Weka Explorer”控制界面b)选择“Classify ”选项卡;c)点击“Choose”按钮,选择“trees” “RandomTree”规则d)设置Cross-validation 为10次e)点击左侧“Start”按钮2)执行结果:=== Run information ===Scheme:weka.classifiers.trees.RandomTree -K 0 -M 1.0 -S 1Relation: voteInstances:435Attributes:17handicapped-infantswater-project-cost-sharingadoption-of-the-budget-resolutionphysician-fee-freezeel-salvador-aidreligious-groups-in-schoolsanti-satellite-test-banaid-to-nicaraguan-contrasmx-missileimmigrationsynfuels-corporation-cutbackeducation-spendingsuperfund-right-to-suecrimeduty-free-exportsexport-administration-act-south-africaClassTest mode:10-fold cross-validation=== Classifier model (full training set) ===RandomTree==========el-salvador-aid = n| physician-fee-freeze = n| | duty-free-exports = n| | | anti-satellite-test-ban = n| | | | synfuels-corporation-cutback = n| | | | | crime = n : republican (0.96/0)| | | | | crime = y| | | | | | handicapped-infants = n : democrat (2.02/0.01) | | | | | | handicapped-infants = y : democrat (0.05/0)| | | | synfuels-corporation-cutback = y| | | | | handicapped-infants = n : democrat (0.79/0.01)| | | | | handicapped-infants = y : democrat (2.12/0)| | | anti-satellite-test-ban = y| | | | adoption-of-the-budget-resolution = n| | | | | handicapped-infants = n : democrat (1.26/0.01)| | | | | handicapped-infants = y : republican (1.25/0.25)| | | | adoption-of-the-budget-resolution = y| | | | | handicapped-infants = n| | | | | | crime = n : democrat (5.94/0.01)| | | | | | crime = y : democrat (5.15/0.12)| | | | | handicapped-infants = y : democrat (36.99/0.09)| | duty-free-exports = y| | | crime = n : democrat (124.23/0.29)| | | crime = y| | | | handicapped-infants = n : democrat (16.9/0.38)| | | | handicapped-infants = y : democrat (8.99/0.02)| physician-fee-freeze = y| | immigration = n| | | education-spending = n| | | | crime = n : democrat (1.09/0)| | | | crime = y : democrat (1.01/0.01)| | | education-spending = y : republican (1.06/0.02)| | immigration = y| | | synfuels-corporation-cutback = n| | | | religious-groups-in-schools = n : republican (3.02/0.01)| | | | religious-groups-in-schools = y : republican (1.54/0.04)| | | synfuels-corporation-cutback = y : republican (1.06/0.05)el-salvador-aid = y| synfuels-corporation-cutback = n| | physician-fee-freeze = n| | | handicapped-infants = n| | | | superfund-right-to-sue = n| | | | | crime = n : democrat (1.36/0)| | | | | crime = y| | | | | | mx-missile = n : republican (1.01/0)| | | | | | mx-missile = y : democrat (1.01/0.01)| | | | superfund-right-to-sue = y : democrat (4.83/0.03)| | | handicapped-infants = y : democrat (8.42/0.02)| | physician-fee-freeze = y| | | adoption-of-the-budget-resolution = n| | | | export-administration-act-south-africa = n| | | | | mx-missile = n : republican (49.03/0)| | | | | mx-missile = y : democrat (0.11/0)| | | | export-administration-act-south-africa = y| | | | | duty-free-exports = n| | | | | | mx-missile = n : republican (60.67/0)| | | | | | mx-missile = y : republican (6.21/0.15)| | | | | duty-free-exports = y| | | | | | aid-to-nicaraguan-contras = n| | | | | | | water-project-cost-sharing = n| | | | | | | | mx-missile = n : republican (3.12/0)| | | | | | | | mx-missile = y : democrat (0.01/0)| | | | | | | water-project-cost-sharing = y : democrat (1.15/0.14) | | | | | | aid-to-nicaraguan-contras = y : republican (0.16/0)| | | adoption-of-the-budget-resolution = y| | | | anti-satellite-test-ban = n| | | | | immigration = n : democrat (2.01/0.01)| | | | | immigration = y| | | | | | water-project-cost-sharing = n| | | | | | | mx-missile = n : republican (1.63/0)| | | | | | | mx-missile = y : republican (1.01/0.01)| | | | | | water-project-cost-sharing = y| | | | | | | superfund-right-to-sue = n : republican (0.45/0)| | | | | | | superfund-right-to-sue = y : republican (1.71/0.64) | | | | anti-satellite-test-ban = y| | | | | mx-missile = n : republican (7.74/0)| | | | | mx-missile = y : republican (4.05/0.03)| synfuels-corporation-cutback = y| | adoption-of-the-budget-resolution = n| | | superfund-right-to-sue = n| | | | anti-satellite-test-ban = n| | | | | physician-fee-freeze = n : democrat (1.39/0.01)| | | | | physician-fee-freeze = y| | | | | | water-project-cost-sharing = n : republican (1.01/0)| | | | | | water-project-cost-sharing = y : democrat (1.05/0.05)| | | | anti-satellite-test-ban = y : democrat (1.13/0.01)| | | superfund-right-to-sue = y| | | | education-spending = n| | | | | physician-fee-freeze = n| | | | | | crime = n : democrat (0.09/0)| | | | | | crime = y| | | | | | | handicapped-infants = n : democrat (1.01/0.01)| | | | | | | handicapped-infants = y : democrat (1/0)| | | | | physician-fee-freeze = y| | | | | | immigration = n| | | | | | | export-administration-act-south-africa = n : democrat(0.34/0.11)| | | | | | | export-administration-act-south-africa = y| | | | | | | | crime = n : democrat (0.16/0)| | | | | | | | crime = y| | | | | | | | | mx-missile = n| | | | | | | | | | handicapped-infants = n : republican (0.29/0) | | | | | | | | | | handicapped-infants = y : republican (1.88/0.87) | | | | | | | | | mx-missile = y : democrat (0.01/0)| | | | | | immigration = y : republican (1.01/0)| | | | education-spending = y| | | | | physician-fee-freeze = n| | | | | | handicapped-infants = n : democrat (1.51/0.01)| | | | | | handicapped-infants = y : democrat (2.01/0)| | | | | physician-fee-freeze = y| | | | | | crime = n : republican (1.02/0)| | | | | | crime = y| | | | | | | export-administration-act-south-africa = n| | | | | | | | handicapped-infants = n| | | | | | | | | immigration = n| | | | | | | | | | mx-missile = n| | | | | | | | | | | water-project-cost-sharing = n : democrat (1.01/0.01)| | | | | | | | | | | water-project-cost-sharing = y : republican (1.81/0)| | | | | | | | | | mx-missile = y : democrat (0.01/0)| | | | | | | | | immigration = y| | | | | | | | | | mx-missile = n : republican (2.78/0)| | | | | | | | | | mx-missile = y : democrat (0.01/0)| | | | | | | | handicapped-infants = y| | | | | | | | | mx-missile = n : republican (2/0)| | | | | | | | | mx-missile = y : democrat (0.4/0)| | | | | | | export-administration-act-south-africa = y| | | | | | | | mx-missile = n : republican (8.77/0)| | | | | | | | mx-missile = y : democrat (0.02/0)| | adoption-of-the-budget-resolution = y| | | anti-satellite-test-ban = n| | | | handicapped-infants = n| | | | | crime = n : democrat (2.52/0.01)| | | | | crime = y : democrat (7.65/0.07)| | | | handicapped-infants = y : democrat (10.83/0.02)| | | anti-satellite-test-ban = y| | | | physician-fee-freeze = n| | | | | handicapped-infants = n| | | | | | crime = n : democrat (2.42/0.01)| | | | | | crime = y : democrat (2.28/0.03)| | | | | handicapped-infants = y : democrat (4.17/0.01)| | | | physician-fee-freeze = y| | | | | mx-missile = n : republican (2.3/0)| | | | | mx-missile = y : democrat (0.01/0)Size of the tree : 143Time taken to build model: 0.01seconds=== Stratified cross-validation ====== Summary ===Correctly Classified Instances 407 93.5632 %Incorrectly Classified Instances 28 6.4368 %Kappa statistic 0.8636Mean absolute error 0.0699Root mean squared error 0.2379Relative absolute error 14.7341 %Root relative squared error 48.8605 %Total Number of Instances 435=== Detailed Accuracy By Class ===TP Rate FP Rate Precision Recall F-Measure ROC Area Class0.955 0.095 0.941 0.955 0.948 0.966 democrat0.905 0.045 0.927 0.905 0.916 0.967 republicanWeighted Avg. 0.936 0.076 0.936 0.936 0.935 0.966 === Confusion Matrix ===a b <-- classified as255 12 | a = democrat16 152 | b = republican3)结果分析:a)该样本数据,数据记录数435个,17个属性,进行了10轮交叉验证b)随机树长143c)正确分类共407个,正确率达93.5632 %d)错误分类28个,错误率6.4368 %e)测试数据的正确率较好5.分类算法-随机树分析1)操作步骤:a)点击“Explorer”按钮,弹出“Weka Explorer”控制界面b)选择“Classify ”选项卡;c)点击“Choose”按钮,选择“trees” “J48”规则d)设置Cross-validation 为10次e)点击左侧“Start”按钮2)执行结果:=== Run information ===Scheme:weka.classifiers.trees.J48 -C 0.25 -M 2Relation: voteInstances:435Attributes:17handicapped-infantswater-project-cost-sharingadoption-of-the-budget-resolutionphysician-fee-freezeel-salvador-aidreligious-groups-in-schoolsanti-satellite-test-banaid-to-nicaraguan-contrasmx-missileimmigrationsynfuels-corporation-cutbackeducation-spendingsuperfund-right-to-suecrimeduty-free-exportsexport-administration-act-south-africaClassTest mode:10-fold cross-validation=== Classifier model (full training set) ===J48 pruned tree------------------physician-fee-freeze = n: democrat (253.41/3.75)physician-fee-freeze = y| synfuels-corporation-cutback = n: republican (145.71/4.0)| synfuels-corporation-cutback = y| | mx-missile = n| | | adoption-of-the-budget-resolution = n: republican (22.61/3.32) | | | adoption-of-the-budget-resolution = y| | | | anti-satellite-test-ban = n: democrat (5.04/0.02)| | | | anti-satellite-test-ban = y: republican (2.21)| | mx-missile = y: democrat (6.03/1.03)Number of Leaves : 6Size of the tree : 11Time taken to build model: 0.06seconds=== Stratified cross-validation ====== Summary ===Correctly Classified Instances 419 96.3218 % Incorrectly Classified Instances 16 3.6782 % Kappa statistic 0.9224Mean absolute error 0.0611Root mean squared error 0.1748Relative absolute error 12.887 %Root relative squared error 35.9085 %Total Number of Instances 435=== Detailed Accuracy By Class ===TP Rate FP Rate Precision Recall F-Measure ROC Area Class0.97 0.048 0.97 0.97 0.97 0.971 democrat0.952 0.03 0.952 0.952 0.952 0.971 republicanWeighted Avg. 0.963 0.041 0.963 0.963 0.963 0.971=== Confusion Matrix ===a b <-- classified as259 8 | a = democrat8 160 | b = republican3)结果分析:a)该样本数据,数据记录数435个,17个属性,进行了10轮交叉验证b)决策树分6级,长度11c)正确分类共419个,正确率达96.3218 %d)错误分类16个,错误率3.6782 %e)测试结果接近随机数,正确率较高6.分类算法-朴素贝叶斯分析1)操作步骤:a)点击“Explorer”按钮,弹出“Weka Explorer”控制界面b)选择“Classify ”选项卡;c)点击“Choose”按钮,选择“bayes” “Naive Bayes”规则d)设置Cross-validation 为10次e)点击左侧“Start”按钮2)执行结果:=== Stratified cross-validation ====== Summary ===Correctly Classified Instances 392 90.1149 %Incorrectly Classified Instances 43 9.8851 %Kappa statistic 0.7949Mean absolute error 0.0995Root mean squared error 0.2977Relative absolute error 20.9815 %Root relative squared error 61.1406 %Total Number of Instances 435=== Detailed Accuracy By Class ===TP Rate FP Rate Precision Recall F-Measure ROC Area Class0.891 0.083 0.944 0.891 0.917 0.973democrat0.917 0.109 0.842 0.917 0.877 0.973republicanWeighted Avg. 0.901 0.093 0.905 0.901 0.902 0.973 === Confusion Matrix ===a b <-- classified as238 29 | a = democrat14 154 | b = republican3)结果分析a)该样本数据,数据记录数435个,17个属性,进行了10轮交叉验证b)正确分类共392个,正确率达90.1149 %c)错误分类43个,错误率9.8851 %d)测试正确率较高7.分类算法-RandomTree、决策树、朴素贝叶斯结果比较:RandomTree 决策树朴素贝叶斯正确率93.5632% 96.3218 % 90.1149 %混淆矩阵 a b <-- classified as255 12 | a = democrat16 152 | b = republican a b <-- classified as259 8 | a = democrat8 160 | b = republicana b <-- classified as238 29 | a = democrat14 154 | b =republican标准误差48.8605 % 35.9085 % 61.1406 % 根据以上对照结果,三类分类算法对样板数据Vote测试准确率类似;8.。

数据挖掘weka实验报告

数据挖掘weka实验报告数据挖掘Weka实验报告引言:数据挖掘是一门利用统计学、人工智能和机器学习等技术从大量数据中提取有用信息的学科。

Weka是一款强大的数据挖掘工具,它提供了丰富的算法和功能,使得数据挖掘变得更加容易和高效。

本文将对Weka进行实验,探索其在数据挖掘中的应用。

一、数据集选择和预处理在本次实验中,我们选择了一个关于房价的数据集作为实验对象。

该数据集包含了房屋的各种属性,如面积、位置、卧室数量等,以及对应的房价。

首先,我们需要对数据集进行预处理,以便更好地进行数据挖掘。

1. 缺失值处理在数据集中,我们发现了一些缺失值。

为了保证数据的完整性和准确性,我们采用了Weka提供的缺失值处理方法,如删除缺失值、插补缺失值等。

通过比较不同方法的效果,我们选择了最适合数据集的缺失值处理方式。

2. 特征选择数据集中可能存在一些冗余或无关的特征,这些特征对于数据挖掘的结果可能没有太大的贡献。

因此,我们使用Weka中的特征选择算法,如信息增益、卡方检验等,来选择最具有代表性和相关性的特征。

二、数据挖掘算法应用在预处理完成后,我们开始应用各种数据挖掘算法,探索数据集中隐藏的规律和模式。

1. 分类算法我们首先尝试了几种分类算法,如决策树、朴素贝叶斯等。

通过比较不同算法的准确率、召回率和F1值等指标,我们找到了最适合该数据集的分类算法,并对其进行了优化。

2. 聚类算法除了分类算法,我们还尝试了一些聚类算法,如K均值聚类、层次聚类等。

通过可视化聚类结果,我们发现了数据集中的一些簇,从而更好地理解了数据集的结构和分布。

3. 关联规则挖掘关联规则挖掘是一种发现数据集中项集之间关系的方法。

我们使用了Apriori算法来挖掘数据集中的关联规则,并通过支持度和置信度等指标进行评估。

通过发现关联规则,我们可以了解到不同属性之间的相关性和依赖性。

三、实验结果分析通过实验,我们得到了一系列数据挖掘的结果。

根据实验结果,我们可以得出以下结论:1. 分类算法的准确率较高,可以用于预测房价等问题。

数据挖掘WEKA实验报告

数据挖掘WEKA实验报告一、实验目的本实验旨在使用WEKA数据挖掘工具,对给定的数据集进行分析和挖掘,探索其中的隐藏规律和关联关系,为决策提供科学依据。

二、实验过程1.数据集选择2.数据预处理首先,对数据集进行了探索性数据分析,了解数据的特征和分布情况。

随后,针对缺失数据和异常值进行了处理操作,采用了替换和删除的策略,以保证数据的质量和准确性。

3.特征选择使用WEKA提供的属性选择过程,对数据集中的特征进行了选择。

通过比较不同的特征选择算法(如信息增益、卡方检验、相关系数等),选取了最优的特征子集用于后续的建模。

4.分类建模为了预测年收入水平,我们选择了几个常用的分类算法进行建模和评估。

包括朴素贝叶斯、决策树、随机森林和支持向量机等。

对于每一种算法,我们使用了10折交叉验证的方式进行模型的训练和测试,并记录了准确率、召回率和F1值等指标作为评估结果。

5.结果分析通过比较不同算法的评估结果,我们发现随机森林算法在该数据集上的表现最好,准确率达到了80%以上。

决策树和朴素贝叶斯算法也有不错的表现,分别达到了75%和70%的准确率。

而支持向量机算法的准确率相对较低,仅为60%左右。

三、实验总结通过本次实验,我们学习并掌握了使用WEKA工具进行数据挖掘的基本操作和流程。

通过数据预处理、特征选择和分类建模等步骤,我们成功地对给定的数据集进行了分析和挖掘,并得到了有意义的结果。

但是需要注意的是,数据挖掘并非一种万能的解决方案,其结果也往往受到多个因素的影响。

因此,在实际应用中,我们需要根据具体情况选择合适的算法和方法,并对结果进行合理的解释和评估。

综上所述,本次实验为我们提供了一个良好的实践机会,帮助我们理解和掌握数据挖掘的基本理论和技术,为今后的科学研究和决策提供了有力的支持。

数据挖掘WEKA实验报告3

数据挖掘-WEKA

实验报告三

姓名及学号:杨珍20131198

班级:卓越计科1301

指导老师:吴珏老师

一、实验内容

1、聚类算法(掌握weka中k-means算法的使用)

1)加载weather.arrf文件,选择SimplerKmeans算法,使用默认参数,进行聚类。

对聚类结果进行分析。

2)使用EM算法进行聚类。

3)分别使用DBSCAN和OPTICS算法进行聚类,对结果进行分析。

二、实验步骤

(1)加载iris.arrf文件,选择SimplerKmeans算法

(2)使用EM算法进行聚类。

(3)使用DBSCAN进行聚类

(4)使用OPTICS进行聚类

二、思考与分析

1请分析为什么两种聚类方法的集成有时会改进聚类的质量和效率。

每种聚类方法各有自己的优缺点,采用两种聚类方法在某种程度上会使两种方法的优点缺点互补,从而提高质量和效率。

weka数据挖掘实验报告

weka数据挖掘实验报告Weka数据挖掘实验报告。

数据挖掘是一门利用各种算法和技术来发现数据中隐藏模式和规律的学科,而Weka作为一款开源的数据挖掘软件,提供了丰富的算法和工具,可以帮助用户进行数据挖掘实验和分析。

本实验旨在利用Weka软件对给定的数据集进行数据挖掘分析,并撰写实验报告,以总结实验过程和结果。

首先,我们使用Weka软件载入了所提供的数据集,并对数据进行了初步的观察和分析。

数据集包括了多个属性和类别,我们需要对数据进行预处理,包括处理缺失值、异常值和离群点等。

在数据预处理完成后,我们选择了适当的数据挖掘算法进行建模和分析,包括分类、聚类、关联规则挖掘等。

在进行分类分析时,我们选择了决策树算法进行建模,并通过交叉验证和混淆矩阵等方法对模型进行评估。

通过实验结果发现,决策树算法在该数据集上表现良好,能够对数据进行有效的分类和预测。

接着,我们进行了聚类分析,选择了K 均值算法对数据进行聚类,并对聚类结果进行了可视化展示和分析。

在关联规则挖掘方面,我们利用Apriori算法挖掘了数据集中的频繁项集和关联规则,并对规则进行了解释和应用。

总结本次实验,我们通过Weka软件对给定的数据集进行了全面的数据挖掘分析,包括数据预处理、分类、聚类和关联规则挖掘等。

实验结果表明,在该数据集上我们成功地应用了Weka软件提供的算法和工具,得到了有意义的分析结果,并对数据集中的模式和规律进行了深入挖掘和分析。

通过本次实验,我们不仅熟悉了Weka软件的使用方法,还加深了对数据挖掘理论和算法的理解,提升了数据分析和挖掘的能力。

综上所述,本实验报告总结了我们在Weka软件上进行的数据挖掘实验过程和结果,通过实验我们对数据挖掘的方法和技术有了更深入的理解和应用。

希望通过本次实验,能够对数据挖掘领域的学习和研究有所帮助,为今后的数据分析工作打下坚实的基础。

weka 聚类实验报告

weka 聚类实验报告Weka 聚类实验报告引言聚类是一种常用的数据分析方法,它可以将数据集中的对象划分为不同的组别,使得同一组别内的对象具有相似的特征。

Weka 是一款流行的数据挖掘工具,其中包含了丰富的聚类算法,如K-means、DBSCAN、EM 等。

本实验旨在利用Weka 进行聚类实验,探索不同算法对数据集的聚类效果。

实验设计本次实验选择了UCI数据集中的Iris 数据集,该数据集包含了150 条记录,每条记录包括了4 个特征(花萼长度、花萼宽度、花瓣长度、花瓣宽度)和一个类别标签(鸢尾花的品种)。

我们将利用Weka 中的K-means、DBSCAN 和EM 等算法对该数据集进行聚类,并比较它们的聚类效果。

实验步骤1. 数据预处理:首先,我们将数据集导入Weka,并进行数据预处理,包括缺失值处理、标准化等操作。

2. K-means 聚类:利用Weka 中的K-means 算法对数据集进行聚类,并选择合适的聚类数目。

3. DBSCAN 聚类:利用Weka 中的DBSCAN 算法对数据集进行聚类,并调节合适的参数。

4. EM 聚类:利用Weka 中的EM 算法对数据集进行聚类,并选择合适的分布类型。

实验结果经过实验,我们得到了以下聚类结果:1. K-means 聚类:选择3 个聚类中心,得到了较好的聚类效果,三个类别分别对应于数据集中的三种鸢尾花品种。

2. DBSCAN 聚类:通过调节参数,我们得到了较好的聚类效果,但需要注意对噪声点的处理。

3. EM 聚类:选择高斯混合模型作为分布类型,得到了较好的聚类效果,但需要注意模型的收敛情况。

结论本次实验利用Weka 进行了聚类实验,并比较了K-means、DBSCAN 和EM 等算法的聚类效果。

通过实验结果,我们发现K-means 算法在该数据集上表现较好,能够有效地将数据集分为三个类别,对应于三种鸢尾花品种。

DBSCAN 算法和EM 算法也取得了较好的聚类效果,但需要注意参数的调节和模型的收敛情况。

weka数据挖掘实验报告

weka数据挖掘实验报告Weka数据挖掘实验报告。

一、实验目的。

本次实验旨在利用Weka软件进行数据挖掘实验,通过对给定数据集的分析和挖掘,探索数据之间的关系和规律,进而为实际应用提供决策支持和信息挖掘。

二、实验环境。

本次实验使用Weka软件进行数据挖掘实验,Weka是一款开源的数据挖掘软件,提供了丰富的数据挖掘和机器学习算法,并且具有直观的用户界面,方便用户进行数据挖掘实验。

三、实验步骤。

1. 数据导入,首先,我们将给定的数据集导入到Weka软件中,以便进行后续的数据挖掘分析。

2. 数据预处理,在导入数据后,我们需要对数据进行预处理,包括缺失值处理、异常值处理、数据平滑和数据变换等,以确保数据的质量和完整性。

3. 数据探索,接下来,我们对数据进行探索性分析,包括对数据的描述性统计分析、数据可视化和相关性分析,以了解数据的分布和特征之间的关系。

4. 数据建模,在完成数据探索后,我们将选择合适的数据挖掘算法,建立数据挖掘模型,并对模型进行训练和评估。

5. 模型评估,最后,我们将对建立的数据挖掘模型进行评估,包括模型的准确率、召回率、精确率和F1值等指标的评估,以确定模型的预测能力和泛化能力。

四、实验结果分析。

经过以上步骤的实验操作和分析,我们得到了如下的实验结果:1. 数据预处理,在数据预处理过程中,我们对数据进行了缺失值处理和异常值处理,确保了数据的完整性和准确性。

2. 数据探索,通过对数据的描述性统计分析和可视化分析,我们发现了数据之间的一些潜在关系和规律,为后续的数据建模提供了参考。

3. 数据建模,在选择了合适的数据挖掘算法后,我们建立了数据挖掘模型,并对模型进行了训练和评估,得到了较好的模型效果。

4. 模型评估,最后,我们对建立的数据挖掘模型进行了评估,得到了较高的准确率和召回率,表明模型具有较好的预测能力和泛化能力。

五、实验总结。

通过本次实验,我们深入学习了Weka软件的使用方法和数据挖掘的基本流程,掌握了数据挖掘的关键技术和方法。

weka实验报告

基于w e k a的数据分类分析实验报告1 实验目的(1)了解决策树C4.5和朴素贝叶斯等算法的基本原理。

(2)熟练使用weka实现上述两种数据挖掘算法,并对训练出的模型进行测试和评价。

2 实验基本内容本实验的基本内容是通过基于weka实现两种常见的数据挖掘算法(决策树C4.5和朴素贝叶斯),分别在训练数据上训练出分类模型,并使用校验数据对各个模型进行测试和评价,找出各个模型最优的参数值,并对模型进行全面评价比较,得到一个最好的分类模型以及该模型所有设置的最优参数。

最后使用这些参数以及训练集和校验集数据一起构造出一个最优分类器,并利用该分类器对测试数据进行预测。

3 算法基本原理(1)决策树C4.5C4.5是一系列用在机器学习和数据挖掘的分类问题中的算法。

它的目标是监督学习:给定一个数据集,其中的每一个元组都能用一组属性值来描述,每一个元组属于一个互斥的类别中的某一类。

C4.5的目标是通过学习,找到一个从属性值到类别的映射关系,并且这个映射能用于对新的类别未知的实体进行分类。

C4.5由J.Ross Quinlan在ID3的基础上提出的。

ID3算法用来构造决策树。

决策树是一种类似流程图的树结构,其中每个内部节点(非树叶节点)表示在一个属性上的测试,每个分枝代表一个测试输出,而每个树叶节点存放一个类标号。

一旦建立好了决策树,对于一个未给定类标号的元组,跟踪一条有根节点到叶节点的路径,该叶节点就存放着该元组的预测。

决策树的优势在于不需要任何领域知识或参数设置,适合于探测性的知识发现。

从ID3算法中衍生出了C4.5和CART两种算法,这两种算法在数据挖掘中都非常重要。

属性选择度量又称分裂规则,因为它们决定给定节点上的元组如何分裂。

属性选择度量提供了每个属性描述给定训练元组的秩评定,具有最好度量得分的属性被选作给定元组的分裂属性。

目前比较流行的属性选择度量有--信息增益、增益率和Gini指标。

(2)朴素贝叶斯贝叶斯分类是一类分类算法的总称,这类算法均以贝叶斯定理为基础,故统称为贝叶斯分类。

weka使用报告

WEKA使用实验报告一、实验目的数据挖掘是通过分析存在于数据库里的数据来解决问题。

在数据挖掘中计算机以电子化的形式存储数据,并且能自动的查询数据,通过关联规则、分类与回归、聚类分析等算法对数据进行一系列的处理,寻找和描述数据里的结构模式,进而挖掘出潜在有用的信息。

WEKA是一种开源的数据挖掘工具。

WEKA的全名是怀卡托智能分析环境(Waikato Environment for Knowledge Analysis),是一款免费的,非商业化的数据挖掘工具,其源代码可从(./ml/weka/)得到,我们在本次实验中所使用到的相关数据,也是从该处获得的。

WEKA作为一个公开的数据挖掘工作平台,集合了大量能承担数据挖掘任务的机器学习算法,包括对数据进行预处理,分类,回归,聚类,关联规则以及在新的交互式界面上的可视化。

本次试验,我们要通过学习WEKA工具的使用,与上课内容相结合,针对某些数据挖掘算法建立起数据挖掘模型,进而对数据分析技术有更深层次的了解。

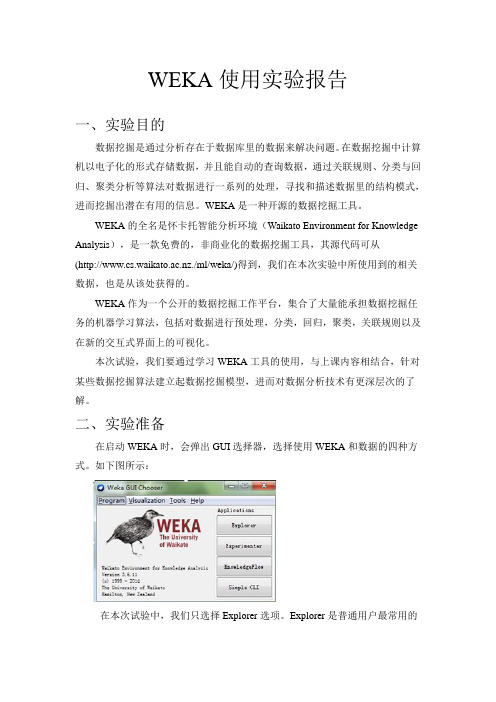

二、实验准备在启动WEKA时,会弹出GUI选择器,选择使用WEKA和数据的四种方式。

如下图所示:在本次试验中,我们只选择Explorer选项。

Explorer是普通用户最常用的一个界面。

用户可以从ARFF文件(WEKA使用的一种文本文件格式)或网页或数据库中读取数据集。

打开数据文件后,可以选择算法对数据进行预处理。

这时窗体上给出了这个数据集的一些基本特征,如含有多少属性,各属性的一些简单统计量,右下方还给出一些可视化效果图。

这些都是比较直观的分析,如果想发现隐藏在数据集背后的关系,还需要选择WEKA提供的各种分类、聚类或关联规则的算法。

界面如下图所示:上图是打开Explorer界面,导入软件自身所带的训练集“segment.arff”文件后所呈现的界面。

我们也可以查看该训练集中的数据,如下图所示:三、实验内容1.贝叶斯算法点“Choose”按钮选择“bayes”,这是WEKA中实现的贝叶斯算法。

weka实验报告

w e k a实验报告(总13页) -本页仅作为预览文档封面,使用时请删除本页-基于weka的数据分类分析实验报告姓名:学号:1实验基本内容本实验的基本内容是通过使用weka中的三种常见分类方法(朴素贝叶斯,KNN和决策树)分别在训练数据上训练出分类模型,并使用校验数据对各个模型进行测试和评价,找出各个模型最优的参数值,并对三个模型进行全面评价比较,得到一个最好的分类模型以及该模型所有设置的最优参数。

最后使用这些参数以及训练集和校验集数据一起构造出一个最优分类器,并利用该分类器对测试数据进行预测。

2数据的准备及预处理格式转换方法原始数据是老师直接给的arff文件,因此不用转换,可以直接导入。

但如果原始数据是excel文件保存的xlsx格式数据,则需要转换成Weka支持的arff 文件格式或csv文件格式。

由于Weka对arff格式的支持更好,这里我们选择arff格式作为分类器原始数据的保存格式。

转换方法:假如我们准备分析的文件为“”,则在excel中打开“”,选择菜单文件->另存为,在弹出的对话框中,文件名输入“breast-cancer”,保存类型选择“CSV(逗号分隔)”,保存,我们便可得到“”文件;然后,打开Weka的Exporler,点击Open file按钮,打开刚才得到的“filename”文件,点击“save”按钮,在弹出的对话框中,文件名输入“breast-cancer”,文件类型选择“Arff data files(*.arff)”,这样得到的数据文件为“”。

如何建立数据训练集,校验集和测试集通过统计数据信息,发现带有类标号的数据一共有286行,为了避免数据的过度拟合,必须把数据训练集和校验集分开,目前的拆分策略是训练集200行,校验集86行。

类标号为‘no-recurrence-events’的数据有201条,而类标号为‘recurrence-events’的数据有85条,为了能在训练分类模型时有更全面的信息,所以决定把包含115条no-recurrence-events类标号数据和85条recurrence-events类标号数据作为模型训练数据集,而剩下的86条类标号类no-recurrence-events的数据将全部用于校验数据集,这是因为在校验的时候,两种类标号的数据的作用区别不大,而在训练数据模型时,则更需要更全面的信息,特别是不同类标号的数据的合理比例对训练模型的质量有较大的影响。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

基于weka的数据分类分析实验报告

姓名:黄学波学号:3130407055

一、实验目的

使用数据挖掘中的分类算法,对数据集进行分类训练并测试。

应用不同的分类算法,比较他们之间的不同。

与此同时了解Weka平台的基本功能与使用方法。

二、实验环境

实验采用Weka 平台,数据使用Weka安装目录下data文件夹下的默认数据集iris.arff。

Weka是怀卡托智能分析系统的缩写,该系统由新西兰怀卡托大学开发。

Weka使用Java 写成的,并且限制在GNU通用公共证书的条件下发布。

它可以运行于几乎所有操作平台,是一款免费的,非商业化的机器学习以及数据挖掘软件。

Weka提供了一个统一界面,可结合预处理以及后处理方法,将许多不同的学习算法应用于任何所给的数据集,并评估由不同的学习方案所得出的结果。

三、数据预处理

Weka平台支持ARFF格式和CSV格式的数据。

由于本次使用平台自带的ARFF格式数据,所以不存在格式转换的过程。

实验所用的ARFF格式数据集如图1所示

图1 ARFF格式数据集(iris.arff)

对于iris数据集,它包含了150个实例(每个分类包含50个实例),共有sepal length、sepal width、petal length、petal width和class五种属性。

期中前四种属性为数值类型,class属性为分类属性,表示实例所对应的的类别。

实验数据集中所有的数据都是实验所需的,因此不存在属性筛选的问题。

若所采用的数据集中存在大量的与实验无关的属性,则需要使用weka平台的Filter(过滤器)实现属性的筛选。

实验所需的训练集和测试集均为iris.arff。

四、实验过程及结果

应用iris数据集,分别采用KNN、C4.5决策树分类器和朴素贝叶斯分类器进行测试和评价,分别在训练数据上训练出分类模型,找出各个模型最优的参数值,并对三个模型进行全面评价比较,得到一个最好的分类模型以及该模型所有设置的最优参数。

最后使用这些参数以及训练集和校验集数据一起构造出一个最优分类器,并利用该分类器对测试数据进行预测。

1、LibSVM分类

Weka 平台内部没有集成libSVM分类器,要使用该分类器,需要下载libsvm.jar并导入

到Weka中。

用“Explorer”打开数据集“iris.arff”,并在Explorer中将功能面板切换到“Classify”。

点“Choose”按钮选择“functions(weka.classifiers.functions.LibSVM)”,选择LibSVM分类算法。

在Test Options 面板中选择Cross-Validatioin folds=10,即十折交叉验证。

然后点击“start”按钮:

将模型应用于测试集:

2、C4.5决策树分类器

依然使用十折交叉验证,训练集和测试集相同。

将模型应用于测试集:

3、朴素贝叶斯分类器

将模型应用于测试集:

4、三种分类算法比较:

五、实验总结

通过本次实验,我对Weka平台有了比较完整和深入的认识,掌握了使用Weka平台进

行数据挖掘的方法,包括数据预处理、分类、聚类、关联分析等。

通过实验,对数据挖掘本身也有了比较直观的认识。