MATLAB神经网络工具箱

在MATLAB中使用卷积神经网络的方法

在MATLAB中使用卷积神经网络的方法近年来,深度学习技术飞速发展,卷积神经网络(Convolutional Neural Network,CNN)已成为计算机视觉领域的主流模型。

CNN通过模拟人脑视觉系统的工作原理,可实现图像识别、目标检测、图像分割等任务。

而在实际应用中,MATLAB作为一款专业的数值计算软件,提供了强大的工具箱和函数库,使得使用卷积神经网络变得更加简便。

一、MATLAB中的CNN工具箱介绍MATLAB中的Deep Learning Toolbox提供了用于设计、训练和部署深度学习模型的功能。

在CNN方面,Deep Learning Toolbox提供了一系列用于构建卷积神经网络的函数和类。

其中,最常用的是convnet系列函数,可以用于创建并配置具有不同层结构的CNN模型。

此外,Deep Learning Toolbox还提供了用于图像数据增强、特征提取、预训练网络等功能,极大地方便了用户进行卷积神经网络实验和应用。

二、创建卷积神经网络模型在MATLAB中,创建卷积神经网络模型一般需要以下步骤:1. 导入数据集:将图像数据集导入MATLAB环境中。

可以使用ImageDatastore类来管理图像数据集,方便读取和处理数据。

2. 数据预处理:对导入的图像数据进行预处理,常见的预处理操作包括图像归一化、随机翻转、旋转等,以增强模型的鲁棒性。

3. 定义网络结构:使用convnet系列函数来定义卷积神经网络的结构。

可以通过添加卷积层、池化层和全连接层来构建自己需要的网络结构。

4. 配置网络参数:通过设置网络参数,如卷积核大小、卷积步长、池化大小等,来进一步调整网络结构和性能。

5. 训练网络:使用训练数据集对卷积神经网络进行训练。

可以选择不同的训练算法和优化器,如随机梯度下降(Stochastic Gradient Descent,SGD)和Adam。

6. 评估模型:使用独立的测试数据集对训练好的模型进行评估,计算准确率、精确率、召回率等指标,以评估模型的性能。

神经网络工具箱操作

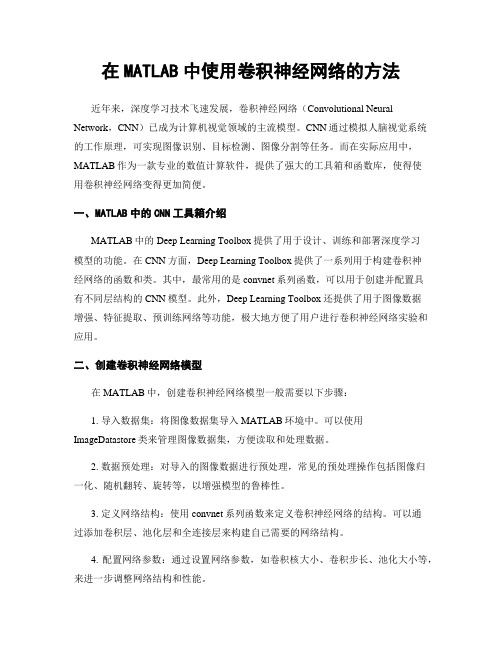

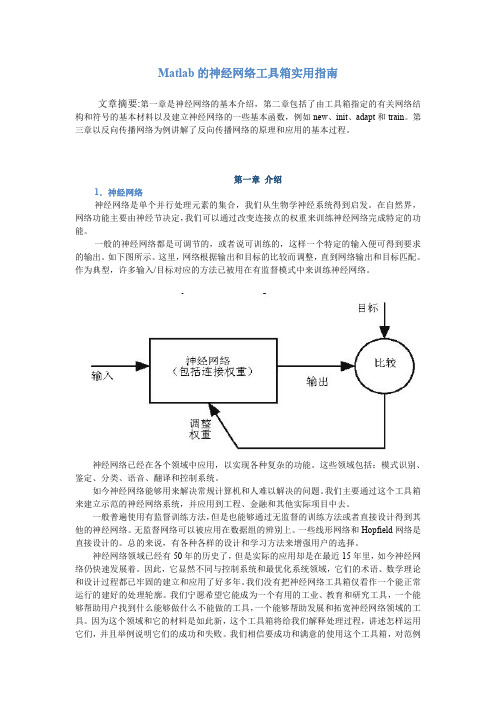

1. 打开MATLAB,在命令行输入nntool,将出现如下界面:图1 神经网络工具箱主界面其中最主要的分为6个部分:第1部分中显示的是系统的输入数据;第2部分是系统的期望输出;第3部分是网络的计算输出;第4部分是网络的误差,即2和3之间的差异;第5部分呈现的是已经建立的神经网络实例;第6部分的两个按钮分别负责数据的导入和网络模型的建立。

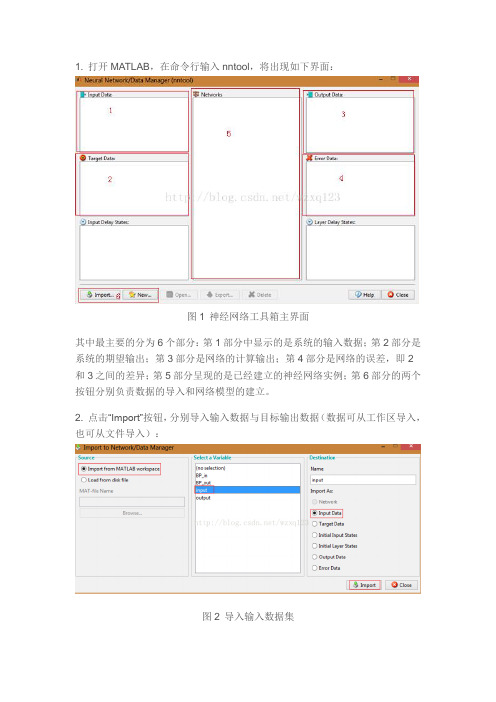

2. 点击“Import”按钮,分别导入输入数据与目标输出数据(数据可从工作区导入,也可从文件导入):图2 导入输入数据集图3 导入期望输出数据集导入数据后主界面的情况如下:图4 导入数据后的情况重要说明:神经网络的数据是以列为基本单位的,即输入与输出数据的列数必须相同,否则将报错!如果原先数据是以行为单位组织的话,可以先在MATLAB 中实现转置然后再导入,即B = A’。

3.现在需要的数据已经有了,下一步就是建立一个神经网络模型对数据集进行学习。

以下步骤以BP网络为例,首先点击“New”按钮,出现如下界面:几个重要部分已在上图中框出:1处用于定义该神经网络的名称;2处用于选择神经网络的类型;3处用于选择网络的输入数据;4处用于确定网络的期望输出数据;5、6、7处分别对神经网络的主要机制函数进行设置;8处设置网络层数;9处用于选择各网络层(需要说明的是:第1层指的是隐含层而不是输入层),从而在10和11处可以对该层的神经元个数和传递函数进行设置;12处按钮可以用于查看当前所设置的神经网络的结构图(下附图);点击13处按钮即可生成对应的神经网络模型。

前面只是简单地介绍了各个部分的作用,具体参数应该如何设置就只有各位自行去学习相关的文献了,此处不再多言。

图6 神经网络结构预览4.现在模型和数据都有了,下一步该进行模型的训练了。

回到主界面如下:图7 回到主界面选中我们刚才建立的神经网络模型,然后点击“Open”按钮,将会出现如下界面:图8 神经网络界面在这里主要介绍两个选项卡中的内容,一个是“Train”,另一个是“Adapt”。

matlab神经网络工具箱简介和函数及示例

目前,神经网络工具箱中提供的神经网络模型主 要应用于:

函数逼近和模型拟合 信息处理和预测 神经网络控制 故障诊断

神经网络实现的具体操作过程:

• 确定信息表达方式; • 网络模型的确定; • 网络参数的选择; • 训练模式的确定; • 网络测试

• 确定信息表达方式:

将领域问题抽象为适合于网络求解所能接受的 某种数据形式。

函数类型 输入函数

其它

函数名 称

netsum netprcd concur dotprod

函数用途

输入求和函数 输入求积函数 使权值向量和阈值向量的结构一致 权值求积函数

BP网络的神经网络工具箱函数

函数类型

函数名称 函数用途

前向网络创建 函数

传递函数

学习函数

函数类型 性能函数 显示函数

函数名 函数用途 称

三、BP网络学习函数

learngd 该函数为梯度下降权值/阈值学习函数,通过神经 元的输入和误差,以及权值和阈值的学习速率, 来计算权值或阈值的变化率。

调用格式; [dW,ls]=learngd(W,P,Z,N,A,T,E,gW,gA,D,LP,LS)

二、神经元上的传递函数

传递函数是BP网络的重要组成部分,必须是连续可 微的,BP网络常采用S型的对数或正切函数和线性函数。

• Logsig 传递函数为S型的对数函数。 调用格式为: • A=logsig(N)

N:Q个S维的输入列向量; A:函数返回值,位于区间(0,1) 中

② info=logsig(code)

问题形式的种类:

数据样本已知; 数据样本之间相互关系不明确; 输入/输出模式为连续的或者离散的; 输入数据按照模式进行分类,模式可能会 具有平移、旋转或者伸缩等变化形式; 数据样本的预处理; 将数据样本分为训练样本和测试样本

如何进行MATLAB神经网络的训练和预测

如何进行MATLAB神经网络的训练和预测【第一章】MATLAB神经网络的基础知识神经网络是一种模拟人类神经系统运行方式的计算模型,它通过模拟人类的感知、学习和决策过程,可以对复杂的问题进行处理和求解。

在实际应用中,MATLAB是一个常用的工具来进行神经网络的训练和预测。

本章将介绍MATLAB 神经网络的基础知识,包括神经网络的原理、MATLAB的神经网络工具箱以及神经网络训练和预测的一般步骤。

1.1 神经网络的原理神经网络由神经元(neuron)组成,每个神经元接收多个输入并产生一个输出。

神经网络的基本单元是感知器(perceptron),它由权重、偏置和激活函数组成。

权重决定了输入对输出的影响程度,偏置用于调整输出的偏移量,激活函数用于处理神经元的输出。

通过调整权重和偏置,神经网络可以学习和适应不同的输入输出模式。

常见的神经网络包括前馈神经网络(feedforward neural network)、循环神经网络(recurrent neural network)和卷积神经网络(convolutional neural network)。

前馈神经网络是最基本的神经网络类型,信息只能在网络中的一个方向流动,即从输入层到输出层。

循环神经网络具有反馈连接,可以记忆之前的状态信息,适用于序列数据的处理。

卷积神经网络则主要用于图像和语音等二维数据的处理。

1.2 MATLAB神经网络工具箱MATLAB提供了一个神经网络工具箱(Neural Network Toolbox),用于设计、训练和模拟神经网络。

该工具箱包括多种神经网络类型、各种激活函数、训练算法和性能函数等各种功能模块。

使用MATLAB神经网络工具箱可以方便地进行神经网络的建模和仿真。

在MATLAB神经网络工具箱中,神经网络被表示为一个网络对象(network object)。

网络对象由一系列图层(layer)组成,每个图层由若干个神经元组成。

网络对象还包括连接权重矩阵、偏置向量和训练参数等属性。

MATLABANN工具箱实用指南

这个简洁的网络符号每一次都会被用到,向量的大小会显示在矩阵变量名字的下面。我 们希望这个符号会让你理解神经网络的结构以及与之相关的矩阵数学。

正如前面所讨论的,当特定的转移函数在一张图中被使用时,转移函数将用上面所示的 符号代替。下面是几个例子:

输入和层 我们将要讨论多层网络,所以我们需要拓展我们的符号来描述这样的网络。特别是我们 要弄清连接输入的权重矩阵和连接层的权重矩阵之间的区别。我们也要分清权重矩阵的目的 和源。 我们将把连接输入的权重矩阵成为输入权重,把来自层输出的权重矩阵称为层矩阵。进 一步说,我们在各个权重和其他网络元素中将用上标区分源(第二个标号)和目的(第一个 标号)。作为示例,我们用简化的形式重画了上面所画的单层多输入网络。 你可以看到,我们把连接输入向量 p 的权重矩阵标记为输入权重矩阵(IW1,1),第二个 标号 1 是源,第二个标号 1 是目的。同样,第一层的元素,比如偏置、网络输入和输出都有 上标 1 来表示它们属于第一层。 在下一章节,我们将用 LW 表示层权重矩阵,用 IW 表示输入权重矩阵。 你可以复习以下这一章开始的符号那一节,它把特定的网络 net 中用数学符号表示的层 权重矩阵转换成代码,如下所示: IW1,1 net. IW{1,1} 这样,你就可以写代码来得到对转移函数的网络输入了: n{1}=net.IW{1,1}*p+net.b{1} 多层神经元网络 一个网络可以有几层,每一层都有权重矩阵 W,偏置向量 b 和输出向量 a。为了区分这 些权重矩阵、输出矩阵等等,在图中的每一层,我们都为感兴趣的变量以上标的形式增加了 层数。你能够看到在下面所示的三层网络图和等式中使用层符号。

得到加权值输入求和节点。它们的和是 Wp,单行矩阵 W 和向量 p 的点乘。

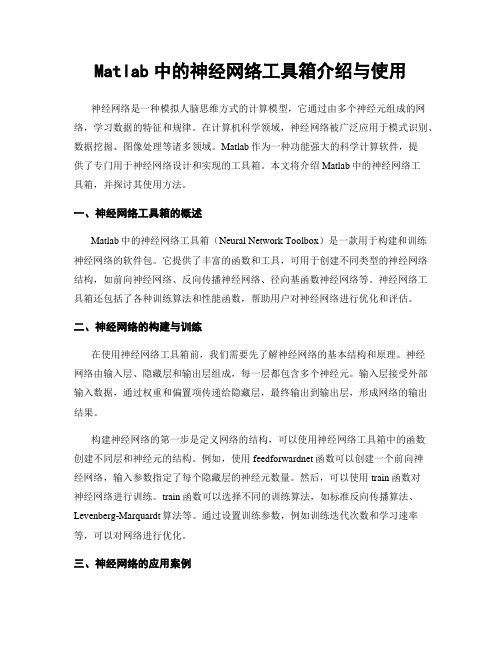

Matlab中的神经网络工具箱介绍与使用

Matlab中的神经网络工具箱介绍与使用神经网络是一种模拟人脑思维方式的计算模型,它通过由多个神经元组成的网络,学习数据的特征和规律。

在计算机科学领域,神经网络被广泛应用于模式识别、数据挖掘、图像处理等诸多领域。

Matlab作为一种功能强大的科学计算软件,提供了专门用于神经网络设计和实现的工具箱。

本文将介绍Matlab中的神经网络工具箱,并探讨其使用方法。

一、神经网络工具箱的概述Matlab中的神经网络工具箱(Neural Network Toolbox)是一款用于构建和训练神经网络的软件包。

它提供了丰富的函数和工具,可用于创建不同类型的神经网络结构,如前向神经网络、反向传播神经网络、径向基函数神经网络等。

神经网络工具箱还包括了各种训练算法和性能函数,帮助用户对神经网络进行优化和评估。

二、神经网络的构建与训练在使用神经网络工具箱前,我们需要先了解神经网络的基本结构和原理。

神经网络由输入层、隐藏层和输出层组成,每一层都包含多个神经元。

输入层接受外部输入数据,通过权重和偏置项传递给隐藏层,最终输出到输出层,形成网络的输出结果。

构建神经网络的第一步是定义网络的结构,可以使用神经网络工具箱中的函数创建不同层和神经元的结构。

例如,使用feedforwardnet函数可以创建一个前向神经网络,输入参数指定了每个隐藏层的神经元数量。

然后,可以使用train函数对神经网络进行训练。

train函数可以选择不同的训练算法,如标准反向传播算法、Levenberg-Marquardt算法等。

通过设置训练参数,例如训练迭代次数和学习速率等,可以对网络进行优化。

三、神经网络的应用案例神经网络在许多领域都有广泛的应用,下面以图像分类为例,介绍如何使用神经网络工具箱来训练一个图像分类器。

首先,我们需要准备训练数据和测试数据。

训练数据通常包含一组已经标记好的图像和相应的标签。

为了方便处理,我们可以将图像转化为一维向量,并将标签转化为二进制编码。

Matlab各工具箱功能简介(部分)

Matlab各工具箱功能简介(部分)Toolbo某工具箱序号工具箱备注一、数学、统计与优化1 Symbolic Math Toolbo某符号数学工具箱Symbolic Math Toolbo某? 提供用于求解和推演符号运算表达式以及执行可变精度算术的函数。

您可以通过分析执行微分、积分、化简、转换以及方程求解。

另外,还可以利用符号运算表达式为 MATLAB?、Simulink? 和Simscape? 生成代码。

Symbolic Math Toolbo某包含 MuPAD? 语言,并已针对符号运算表达式的处理和执行进行优化。

该工具箱备有 MuPAD 函数库,其中包括普通数学领域的微积分和线性代数,以及专业领域的数论和组合论。

此外,还可以使用 MuPAD 语言编写自定义的符号函数和符号库。

MuPAD 记事本支持使用嵌入式文本、图形和数学排版格式来记录符号运算推导。

您可以采用 HTML 或 PDF 的格式分享带注释的推导。

2 Partial Differential Euqation Toolbo某偏微分方程工具箱偏微分方程工具箱?提供了用于在2D,3D求解偏微分方程(PDE)以及一次使用有限元分析。

它可以让你指定和网格二维和三维几何形状和制定边界条件和公式。

你能解决静态,时域,频域和特征值问题在几何领域。

功能进行后处理和绘图效果使您能够直观地探索解决方案。

你可以用偏微分方程工具箱,以解决从标准问题,如扩散,传热学,结构力学,静电,静磁学,和AC电源电磁学,以及自定义,偏微分方程的耦合系统偏微分方程。

3 Statistics Toolbo某统计学工具箱Statistics and Machine Learning Toolbo某提供运用统计与机器学习来描述、分析数据和对数据建模的函数和应用程序。

您可以使用用于探查数据分析的描述性统计和绘图,使用概率分布拟合数据,生成用于Monte Carlo 仿真的随机数,以及执行假设检验。

MATLAB-神经网络工具箱-PPT

train

net=train(net, P, T)

被训练网络 输入向量 目标向量

net.tranParam.epochs=10 ; %预定的最大训 练次数为10, 感知器经过最多训练10次后停止,

adapt

net=adapt(net, P, T) 自适应训练函数

权值和阀值学习函数

learnp

dW=learnp(W,P,Z,N,A,T,E,D,gW,gA,LP,LS)

两个长度为5的向量构成输入样本矩阵P,行向量T为目标向量。利用PLOTPV画 出这个向量的图像。例如: P = [-0.5 -0.5 +0.3 -0.1 -4; -0.5 +0.5 -0.5 +1.0 5]; T = [1 1 0 0 1]; plotpv(P,T); % plotpv函数利用感知器的输入向量和目标向量来画输入向量的图像

dW:权值或阀值的变化矩阵 W:权值矩阵或阀值向量 P:输入向量 T:目标向量 E:误差向量 其他可以忽略,设为[ ]

learnpn 归一化学习函数

网络仿真函数

sim

a = sim(net, P)

网络输出

输入向量

➢分类结果显示绘图函数

plotpv

plotpv(P,T)

画输入向量的图像

plotpc

plotpc(W,b)

这个感知器正确的区分了我们的新点(用红色表示)作为”zero”类(用圆圈表示), 而不是”one”类(用+号表示),尽管需要比较长的训练时间,这个感知器仍然适当的进 行了学习。最后放大感兴趣的区域

实验一 利用感知器进行分类(2)

Step3 添加神经元的初始化值到分类图

初始化的权值被设为0,因此任何输入都会给出同样的输出,并且分类线不会 出现在这个图中,不用害怕,我们会继续训练这个神经网。 hold on linehandle = plotpc(net.IW{1},net.b{1}); //plotpc函数用来画分类线

MATLAB神经网络工具箱中的神经网络模型共55页课件

阈值向量b(t)

标量元素bi (t ) ,i为行,t为时间或迭代函数

网络层符号

加 个权神和经元: ,nns为mm 加,m权为和第m个网络层, s m 为第

网 个络神层经输元出,a为: a输smm出, m为第m个网络层, s m 为第 s m

p2 2,2

p{2}2(,2)

例:

iw

1 ,1 2 ,3

=

iw{1,1}2(,3)

p1,(k1) p{1,k1}

p2 2,(k 1)p{2,k1 }2()

神经网络工具箱常用函数列表

重要的感知器神经网络函数:

初始化: initp 训练: trainp 仿真: simup 学习规则: learnp

Hardlim x>=0 y=1;x<0 y=0 Hardlims:x>=0 y=1; x<0 y=-1 Purelin :y=x Satlin:x<0 y=0;x>1 y=1;x>=0&&x<=1 y=x;

Logsig:y= 1 1 ex

人工神经网络的构成

单个神经元的功能是很有限的,人工神经 网络只有用许多神经元按一定规则连接构 成的神经网络才具有强大的功能。

MATLAB工具箱中的神经网络结构

多层网络的简化表示:

MATLAB神经网络工具箱中的神经 网络模型

基本概念: 标量:小写字母,如a,b,c等; 列向量:小写黑体字母,如a,b,c等,意为一列

数; 矩阵向量:大写黑体字母,如A,B,C等

权值矩阵向量W(t)

标量元素 wi, j (t) ,i为行,j为列,t为时间或迭代

n

(完整word版)Matlab的神经网络工具箱入门

Matlab的神经网络工具箱入门在command window中键入help nnet〉〉help nnetNeural Network ToolboxVersion 7。

0 (R2010b) 03-Aug-2010神经网络工具箱版本7.0(R2010b)03八月,2010图形用户界面功能.nnstart —神经网络启动GUInctool —神经网络分类工具nftool —神经网络的拟合工具nntraintool —神经网络的训练工具nprtool —神经网络模式识别工具ntstool - NFTool神经网络时间序列的工具nntool - 神经网络工具箱的图形用户界面。

查看—查看一个神经网络。

网络的建立功能。

cascadeforwardnet —串级,前馈神经网络。

competlayer —竞争神经层.distdelaynet - 分布时滞的神经网络。

elmannet —Elman神经网络。

feedforwardnet —前馈神经网络.fitnet - 函数拟合神经网络。

layrecnet —分层递归神经网络。

linearlayer —线性神经层.lvqnet —学习矢量量化(LVQ)神经网络。

narnet - 非线性自结合的时间序列网络。

narxnet —非线性自结合的时间序列与外部输入网络。

newgrnn —设计一个广义回归神经网络。

newhop —建立经常性的Hopfield网络。

newlind —设计一个线性层.newpnn —设计概率神经网络.newrb - 径向基网络设计.newrbe - 设计一个确切的径向基网络.patternnet - 神经网络模式识别.感知- 感知。

selforgmap - 自组织特征映射。

timedelaynet - 时滞神经网络。

利用网络。

网络—创建一个自定义神经网络。

SIM卡—模拟一个神经网络.初始化- 初始化一个神经网络.适应—允许一个神经网络来适应。

Matlab神经网络工具箱介绍(Neural Network Toolbox)

2020/5/6

10

• <step.3>建立网络

• Network/Data

Manager窗口中New… 打开Create Network or Data,如右图。

• Name:定义网络名为 network1

• 选择Input/Target Data,设置训练函数等参 数。

• View:查看模型

2020/5/6

f ( p)

Forecasting error xn1 t '

2020/5/6

6

• <step.1>数据构造与预处理 •

2020/5/6

7

• <step.2>训练数据导入nntool

• 根据数据的多少,数据文件的格式等获取样本 数据的方法有:

• 1)直接输入数据:通过采用元素列表方式输 入。适用于样本数目较少时。New…按钮

2020/5/6

21

总结

需要注意的是,源文件名及路径名不能是汉 字,否则导致读取文件失败。

本部分介绍了MATLAB 神经网络工具箱的 图形用户界面,为尚不熟悉以MATLAB 编程进 行神经网络设计与仿真的用户提供了一个非常 好的交互式图形界,使得神经网络的设计和仿真 变得轻而易举。

2020/5/6

22

单击Simulate Network按钮,则在Network/ Data Manager窗口的Outputs和Errors区域分 别显示出相应的仿真结果,选中变量名,单击该 窗口的Open按钮,弹出数据窗口,在该窗口可以 查看仿真结果的具体数据,如图 所示。

2020/5/6

19

• <step.6>结果Export和Save

MATLAB神经网络工具箱

MATLAB神经网络工具箱与液位控制BP 模型的设计与仿真随着科学技术的发展,在控制领域中被控对象变得越来越复杂,控制系统呈现出复杂的非线性、时变及不确定性的特点,难于精确建模,有的虽然可以建立粗略的模型,但求解困难。

人工神经网络具有一定的自学习、自适应和非线性映射能力及容错性等优点,为解决复杂的非线性、不确定、不确知系统的控制问题开辟了一条新的途径。

其中,BP 网络,即基于误差反向传播算法的多层前馈神经网络,由于它可以以任意精度逼近任意的连续函数,因此被广泛应用于非线性建模、函数逼近、模式分类、智能控制及预测等领域。

MATLAB神经网络工具箱是以神经网络理论作为背景的专业工具箱,本文针对某发电厂液位控制建立BP 预测模型,利用目前工程领域流行的MATLAB 6.1中提供的神经网络工具箱,对网络模型进行训练和仿真,给出优化的BP 模型实现步骤。

MATLAB及其神经网络工具箱MATLAB是由MATHWORKS公司开发的一个高性能的技术计算语言。

它在一个简单易用的交互式环境中集成了计算、可视化和程序设计等强大的功能。

神经网络工具箱是MATLAB中集成的一个重要工具箱,工具箱中提供了面向不同神经网络模型特别是BP网络模型的丰富多彩的网络学习和训练函数,其中包括了BP算法和各种改进BP算法,为神经网络的仿真分析提供了极大的方便,从而使MATLAB成为目前世界上最为流行的神经仿真平台。

用户只要调用工具箱中相关函数并输入参数,就可以完成相应的训练仿真。

在本文液位控制BP模型的设计与仿真研究中,主要用到以下几个函数及其主要参数:1)Newff格式: net = newff(PR,[S1 S2… S nl],{TF1 TF2… TF nl},BTF,BLF,PF)其中net是神经网络名;S i是第i层神经网络的神经元个数,网络共有nl层;TFi 是第i层网络神经元的转移函数,缺省为tansig; BTF是BP训练函数,缺省为trainlm;BLF 是学习函数,缺省为learngdm;PF是性能函数,缺省为mse。

[matlab工具箱]神经网络NeuralNet

![[matlab工具箱]神经网络NeuralNet](https://img.taocdn.com/s3/m/1defa8ed710abb68a98271fe910ef12d2af9a9ae.png)

[matlab⼯具箱]神经⽹络NeuralNet//⽬的是学习在BP神经⽹络的基础上添加遗传算法,蚁群算法等优化算法来优化⽹络,这是后话。

先简单了解了MATLAB中的神经⽹络⼯具箱,⼯具箱功能还是⾮常强⼤的,已经可以拟合出⾮常多的曲线来分析了。

神经⽹络⼯具箱选择(4种)今天下载了⾃带的example跑了⼀次试⼀下选择隐藏神经元个数训练结束后可以在plot查看各种图表,这⾥只对⼯具箱操作做简单介绍最近⼀段时间在研究如何利⽤预测其销量个数,在⽹上搜索了⼀下,发现了很多模型来预测,⽐如利⽤回归模型、时间序列模型,GM(1,1)模型,可是⾃⼰在结合实际的⼯作内容,发现这⼏种模型预测的精度不是很⾼,于是再在⽹上进⾏搜索,发现神经⽹络模型可以来预测,并且有很多是结合时间序列或者SVM(⽀持向量机)等组合模型来进⾏预测,本⽂结合实际数据,选取了常⽤的BP神经⽹络算法,其算法原理,因⽹上⼀⼤堆,所以在此不必⼀⼀展⽰,并参考了这篇博⽂,运⽤matlab 2016a,给出了下⾯的代码,并最终进⾏了预测clcclear allclose all%bp 神经⽹络的预测代码%载⼊输出和输⼊数据load C:\Users\amzon\Desktop\p.txt;load C:\Users\amzon\Desktop\t.txt;%保存数据到matlab的⼯作路径⾥⾯save p.mat;save t.mat;%注意t必须为⾏向量%赋值给输出p和输⼊tp=p;t=t;%数据的归⼀化处理,利⽤mapminmax函数,使数值归⼀化到[-1.1]之间%该函数使⽤⽅法如下:[y,ps] =mapminmax(x,ymin,ymax),x需归化的数据输⼊,%ymin,ymax为需归化到的范围,不填默认为归化到[-1,1]%返回归化后的值y,以及参数ps,ps在结果反归⼀化中,需要调⽤[p1,ps]=mapminmax(p);[t1,ts]=mapminmax(t);%确定训练数据,测试数据,⼀般是随机的从样本中选取70%的数据作为训练数据%15%的数据作为测试数据,⼀般是使⽤函数dividerand,其⼀般的使⽤⽅法如下:%[trainInd,valInd,testInd] = dividerand(Q,trainRatio,valRatio,testRatio)[trainsample.p,valsample.p,testsample.p] =dividerand(p,0.7,0.15,0.15);[trainsample.t,valsample.t,testsample.t] =dividerand(t,0.7,0.15,0.15);%建⽴反向传播算法的BP神经⽹络,使⽤newff函数,其⼀般的使⽤⽅法如下%net = newff(minmax(p),[隐层的神经元的个数,输出层的神经元的个数],{隐层神经元的传输函数,输出层的传输函数},'反向传播的训练函数'),其中p为输⼊数据,t为输%tf为神经⽹络的传输函数,默认为'tansig'函数为隐层的传输函数,%purelin函数为输出层的传输函数%⼀般在这⾥还有其他的传输的函数⼀般的如下,如果预测出来的效果不是很好,可以调节%TF1 = 'tansig';TF2 = 'logsig';%TF1 = 'logsig';TF2 = 'purelin';%TF1 = 'logsig';TF2 = 'logsig';%TF1 = 'purelin';TF2 = 'purelin';TF1='tansig';TF2='purelin';net=newff(minmax(p),[10,1],{TF1 TF2},'traingdm');%⽹络创建%⽹络参数的设置net.trainParam.epochs=10000;%训练次数设置net.trainParam.goal=1e-7;%训练⽬标设置net.trainParam.lr=0.01;%学习率设置,应设置为较少值,太⼤虽然会在开始加快收敛速度,但临近最佳点时,会产⽣动荡,⽽致使⽆法收敛net.trainParam.mc=0.9;%动量因⼦的设置,默认为0.9net.trainParam.show=25;%显⽰的间隔次数%指定训练参数% net.trainFcn = 'traingd'; %梯度下降算法% net.trainFcn = 'traingdm'; %动量梯度下降算法% net.trainFcn = 'traingda'; %变学习率梯度下降算法% net.trainFcn = 'traingdx'; %变学习率动量梯度下降算法% (⼤型⽹络的⾸选算法)% net.trainFcn = 'trainrp'; % RPROP(弹性BP)算法,内存需求最⼩%共轭梯度算法% net.trainFcn = 'traincgf'; %Fletcher-Reeves修正算法% net.trainFcn = 'traincgp'; %Polak-Ribiere修正算法,内存需求⽐Fletcher-Reeves修正算法略⼤% net.trainFcn = 'traincgb'; % Powell-Beal复位算法,内存需求⽐Polak-Ribiere修正算法略⼤% (⼤型⽹络的⾸选算法)%net.trainFcn = 'trainscg'; % ScaledConjugate Gradient算法,内存需求与Fletcher-Reeves修正算法相同,计算量⽐上⾯三种算法都⼩很多% net.trainFcn = 'trainbfg'; %Quasi-Newton Algorithms - BFGS Algorithm,计算量和内存需求均⽐共轭梯度算法⼤,但收敛⽐较快% net.trainFcn = 'trainoss'; % OneStep Secant Algorithm,计算量和内存需求均⽐BFGS算法⼩,⽐共轭梯度算法略⼤% (中型⽹络的⾸选算法)%net.trainFcn = 'trainlm'; %Levenberg-Marquardt算法,内存需求最⼤,收敛速度最快% net.trainFcn = 'trainbr'; %贝叶斯正则化算法% 有代表性的五种算法为:'traingdx','trainrp','trainscg','trainoss', 'trainlm'%在这⾥⼀般是选取'trainlm'函数来训练,其算对对应的是Levenberg-Marquardt算法net.trainFcn='trainlm';[net,tr]=train(net,trainsample.p,trainsample.t);%计算仿真,其⼀般⽤sim函数[normtrainoutput,trainPerf]=sim(net,trainsample.p,[],[],trainsample.t);%训练的数据,根据BP得到的结果[normvalidateoutput,validatePerf]=sim(net,valsample.p,[],[],valsample.t);%验证的数据,经BP得到的结果[normtestoutput,testPerf]=sim(net,testsample.p,[],[],testsample.t);%测试数据,经BP得到的结果%将所得的结果进⾏反归⼀化,得到其拟合的数据trainoutput=mapminmax('reverse',normtrainoutput,ts);validateoutput=mapminmax('reverse',normvalidateoutput,ts);testoutput=mapminmax('reverse',normtestoutput,ts);%正常输⼊的数据的反归⼀化的处理,得到其正式值trainvalue=mapminmax('reverse',trainsample.t,ts);%正常的验证数据validatevalue=mapminmax('reverse',valsample.t,ts);%正常的验证的数据testvalue=mapminmax('reverse',testsample.t,ts);%正常的测试数据%做预测,输⼊要预测的数据pnewpnew=[313,256,239]';pnewn=mapminmax(pnew);anewn=sim(net,pnewn);anew=mapminmax('reverse',anewn,ts);%绝对误差的计算errors=trainvalue-trainoutput;%plotregression拟合图figure,plotregression(trainvalue,trainoutput)%误差图figure,plot(1:length(errors),errors,'-b')title('误差变化图')%误差值的正态性的检验figure,hist(errors);%频数直⽅图figure,normplot(errors);%Q-Q图[muhat,sigmahat,muci,sigmaci]=normfit(errors);%参数估计均值,⽅差,均值的0.95置信区间,⽅差的0.95置信区间[h1,sig,ci]= ttest(errors,muhat);%假设检验figure, ploterrcorr(errors);%绘制误差的⾃相关图figure, parcorr(errors);%绘制偏相关图运⾏之后的,结果如下:BP神经⽹络的结果分析图训练数据的梯度和均⽅误差之间的关系图验证数据的梯度与学习次数残差的正态的检验图(Q-Q图)在⽹上,发现可以通过神经⽹络⼯具箱这个GUI界⾯来创建神经⽹络,其⼀般的操作步骤如下:1:在输⼊命令⾥⾯输⼊nntool命令,或者在应⽤程序这个选项下找到Netrual Net Fitting 这个应⽤程序,点击打开,就能看见如下界⾯2:输⼊数据和输出数据的导⼊(在本⽂中选取了matlab⾃带的案例数据)3:随机选择三种类型的数据所占的样本量的⽐例,⼀般选取默认即可4:隐层神经元的确定5:训练算法的选取,⼀般是选择默认即可,选择完成后点击<train>按钮即可运⾏程序6:根据得到的结果,⼀般是MSE的值越⼩,R值越接近1,其训练的效果⽐较,并第⼆张图给出了神经⽹络的各参数的设置以及其最终的结果,其拟合图R越接近1,模型拟合的更好最终的结果图7:如果所得到的模型不能满⾜你的需求,则需重复上述的步骤直⾄能够得到你想要的精确度8:将最终的得到的各种数据以及其拟合值进⾏保存,然后查看,就可以得到所要的拟合值最后参考了⽹上和MATLAB的帮助,给出了⼀些与神经⽹络相关的函数,希望能够帮助⼤家。

如何使用Matlab进行神经网络算法实现

如何使用Matlab进行神经网络算法实现神经网络是一种模拟人类大脑思维和学习方式的计算机算法。

它通过一系列互联的节点(也称为神经元)来模拟大脑中的神经元之间的连接和信息传递。

Matlab 作为一种功能强大的数学软件,也提供了丰富的工具和函数来实现神经网络算法。

本文将介绍如何使用Matlab来实现神经网络算法。

第一部分: 神经网络基础在开始介绍如何使用Matlab实现神经网络算法之前,我们先来了解一些基础知识。

神经网络由输入层、隐藏层和输出层组成。

输入层接收输入数据,隐藏层进行中间计算,输出层产生最终结果。

每个节点与其他节点之间存在连接,连接上有权重,通过调整权重实现学习和优化。

第二部分: Matlab中的神经网络工具箱Matlab提供了专门的神经网络工具箱,可以方便地实现各种神经网络算法。

通过安装并加载这个工具箱,我们可以使用其中的函数和工具来构建和训练神经网络模型。

第三部分: 构建神经网络模型在Matlab中,我们可以使用nprtool函数来进行神经网络模型的构建。

该函数提供了一个图形化界面,可以方便地添加输入层、隐藏层和输出层,并设置相应的参数。

第四部分: 训练神经网络模型构建好神经网络模型后,我们需要训练模型,以使其能够准确地预测和分类数据。

在Matlab中,可以使用train函数来进行神经网络模型的训练。

该函数可以选择不同的训练算法和训练参数,以获得最佳的模型性能。

第五部分: 评估和优化神经网络模型在训练完神经网络模型后,我们需要对其进行评估和优化,以提高其性能和泛化能力。

Matlab提供了多种评估指标和优化方法,例如误差曲线、准确率、召回率等。

第六部分: 应用案例在本部分,我们将通过一个简单的应用案例来演示如何使用Matlab进行神经网络算法实现。

假设我们有一组房屋价格的数据,我们希望通过神经网络来预测新房屋的价格。

我们可以使用Matlab中的数据集导入工具箱来导入数据,然后使用nprtool函数构建和训练神经网络模型,最后使用该模型对新房屋的价格进行预测。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

响应函数 y = σ ( s) 的基本作用:

1、控制输入对输出的激活作用; 2、对输入、输出进行函数转换; 3、将可能无限域的输入变换成指定的有限范 围内的输出。

根据响应函数的不同,人工神经元 有以下几种类型:

阈值单元

响应函数如图a所示,

线性单元

其响应函数如图b所示

非线性单元

常用响应函数为S型(Sigmoid)函数,如图c、 d所示

确定网络模型

选择模型的类型和结构,也可对原网络进行变形和扩充

网络参数的选择

确定输入输出神经元数目

训练模型的确定

选择合理的训练算法,确定合适的训练步数,指定适当的训练目标误 差

网络测试

选择合适的测试样本

人工神经元的一般模型

神经元模型及其简化模型如图所示,输入向

T p = [ p , p , Λ p ] 量 1 2 R 、权值矩阵 w = [ w1,1 , w1, 2 , Λ ,, w1, R ]

与阈值的加权和(内积运算)送入累加器,形成 净输入,即:

人工神经元模型

图中,xi(i=1,2,…,n)为加于输入端(突触)上的 输入信号;ωi为相应的突触连接权系数,它是模拟 突触传递强度的—个比例系数, ∑表示突触后信号的 空间累加;θ表示神经元的阈值,σ表示神经元的响 应函数。该模型的数学表达式为:

n

(3)误差平方和sse(sum squared error)

n

sse = ∑ (t k − ak )

k =1

2

无教师学习(无监督学习)

MATLAB工具箱中的神经网络结构

1.人工神经元的一般模型 在 s=

n

∑ ωi xi − θ 中,令 b = −θ

i =1

R i =1

,

p i = xi

,则

a = f (∑ wi pi + b)

1 2 3 m{2}=n{2,1}= b = 4 5 6

n{2,1}(4)=5

变量符号在MATLAB中的表示

(1)上标变量以细胞矩阵(Cell array)即大括 号表示p1={1} (2)下标变量以圆括号表示 , , p1=p(1),

p = p{1}(2)

1 2

2 p2 , 2 = p{2}(2,2)

例:

iw

1,1 2,3

=

iw{1,1}(2,3)

p

p

1,( k −1)

= p{1, k − 1}

2 ,( k −1) 2

= p{2, k − 1}(2)

神经网络工具箱常用函数列表

重要的感知器神经网络函数: 重要的感知器神经网络函数:

初始化: 初始化: initp 训练: trainp 训练: 仿真: 仿真: simup 学习规则: 学习规则: learnp

线性神经网络函数

初始化: 设计: 仿真: 离线训练: 在线自适应训练: 学习规则: initlin solvelin simulin trainwh adaptwh learnwh

BP网络函数: 网络函数:

initff: 初始化不超过3层的前向网络; simuff:仿真不超过3层的前向网络; trainbp,trainbpx,trainlm:训练BP

多层神经网络结构

a 2 = f 2 ( LW 2 a 1 + b 2 ) = f 2 [ LW 2 f 1 ( IW 1 p + b1 ) + b 2 ]

多层网络简化形式

图中:

P =

[p

1

, p 2 ,... p R

]

1 1 1 b1 = [b1 , b2 ,...bs 1]

1,1 1,1 1,1 iw1 ... iw iw ,1 1, 2 1, R 1,1 1,1 1,1 iw iw iw 2,1 2, 2 2,R 1,1 IW = 1,1 1,1 1,1 iws1 ,R iws1 ,1 iws1 , 2

神经网络的学习方式

有教师学习(监督学习)

误差信号的不同定义: (1)均方误差mse(mean squared error)

mse = E[e] ≈

∑ (t

k =1

n

k

− ak ) n

2

(2)平均绝对误差mae (mean absolute error)

n

mae =

∑| t

k =1

k

− ak |

神经网络例子

创建线性神经网络层

net = newlin([1 3;1 3],1); net.IW{1,1} = [1 2]; net.b{1} = 0; 设有数据集由4个向量组成 p1=[1 2]’ p2= [2 1]’ p3=[2 3]’ p4=[3 1]’ P=[1 2 2 3;2 1 3 1] A = sim(net,P) A= 5485

MATLAB神经网络工 具箱中的神经网络 模型

神经网络工具箱简介

MATLAB 7对应的神经网络工具箱的版本为 Version 4.0.3,它以神经网络理论为基础,利用 MATLAB脚本语言构造出典型神经网络的激活函 数,如线性、竞争性和饱和线性等激活函数,使设 计者对所选定网络输出的计算变成对激活函数的 调用。 还可根据各种典型的修正网络权值规则,加上网 络的训练过程,利用MATLAB编写出各种网络设 计和训练的子程序,用户根据自己的需要去调用。

内层互连前馈网络

通过层内神经元之间的相 互连接,可以实现同一层 神经元之间横向抑制或兴 奋的机制,从而限制层内 能同时动作的神经数,或 者把层内神经元分为若干 组,让每组作为一个整体 来动作。一些自组织竞争 型神经网络就属于这种类 型。

互连网络

互连网络有局部互连和全 互连两种。全互连网络中 的每个神经元都与其他神 经元相连。局部互连是指 互连只是局部的,有些神 经元之间没有连接关系。 Hopfield网络和Boltzmann 机属于互连网络的类型。

说明:

输入层神经元的个数决定IW的行数,输入向 量元素的个数决定IW的列数,即S1行R列.

4.公式和图形中的变量符号在编程 代码中的表示方法

,

,

细胞矩阵:将多个矩阵 向量作为细胞矩阵的” 向量作为细胞矩阵的” 细胞” 细胞”(Cell),细胞矩阵 的各个元素值为对应 细胞的大小和数值类 型

1 2 c = 3 4 5 6 1 2 3 b=

f

a2

pR

f

as

输入

S个神经元的层

n1为第一层神经元的中间运算结果,即连接权向量 与阈值向量的加权和,大小为 S 1 × 1 ,即

n = IW P + b

1 1

,

1

a1为第一层神经元的输出向量,大小为

S ×1

1

a = f ( IW P + b )

1 1 1 1

神经网络的层数为神经元网络层的数目加1, 即隐层数目加1.

仿真: 设计: solvehop solvelin rands learnbp learnh learnp learnwh initlin initp initsm plotsm trainbp trainp trainwh trainsm simuhop solvehop 设计Hopfield网络 设计线性网络 产生对称随机数 反向传播学习规则 Hebb学习规则 感知层学习规则 Widrow-Hoff学习规则 线性层初始化 感知层初始化 自组织映射初始化 绘制自组织映射图 利用反向传播训练前向网络 利用感知规则训练感知层 利用Widrow-Hoff规则训练线性层 利用Kohonen规则训练自组织映射

人工神经网络连接的基本形式:

1.前向网络 网络的结构如图所示。网 络中的神经元是分层排列 的,每个神经元只与前一 层的神经元相连接。最右 一层为输出层,隐含层的 层数可以是一层或多层。 前向网络在神经网络中应 用很广泛,例如,感知器 就属于这种类型。

2. 反馈前向网络

网络的本身是前向型 的,与前一种不同的 是从输出到输入有反 馈回路。

trainbp:最慢; trainbpx:次之; trainlm:速度最快,但需要更多的存储空间。

learnbp:

学习规则

自组织网络

初始化:initsm 仿真: simuc 训练: trainc:利用竞争规则训练 trainsm:利用Kohonen规则训练

反馈网络( 反馈网络(Hopfield网络) 网络)

神经网络工具箱的主要应用

函数逼近和模型拟合 信息处理和预测 神经网络控制 故障诊断

应用神经网络工具箱求解问题的一般过程

确定信息表达方式

数据样本已知 数据样本之间相互关系不确定 输入/输出模式为连续的或者离散的 输入数据按照模式进行分类,模式可能会具有平移、旋转或伸缩等变 化形式 数据样本的预处理 将数据样本分为训练样本和测试样本

多层网络的简化表示:

MATLAB神经网络工具箱中的神经 网络模型

基本概念: 标量:小写字母,如a,b,c等; 列向量:小写黑体字母,如a,b,c等,意为一列 数; 矩阵向量:大写黑体字母,如A,B,C等

权值矩阵向量W(t)

标量元素 wi , j (t ) ,i为行,j为列,t为时间或迭代 函数 列向量 w j (t ) 行向量 wi (t )

Hardlim x>=0 y=1;x<0 y=0 Hardlims:x>=0 y=1; x<0 y=-1 Purelin :y=x Satlin:x<0 y=0;x>1 y=1;x>=0&&x<=1 y=x; 1 Logsig:y=

1+ e

−x

人工神经网络的构成

单个神经元的功能是很有限的,人工神经 网络只有用许多神经元按一定规则连接构 成的神经网络才具有强大的功能。 神经元的模型确定之后,一个神经网络的 特性及能力主要取决于网络的拓扑结构及 学习方法。