决策树很详细的算法介绍 ppt课件

合集下载

决策树分析方法ppt

全局最优

通过剪枝等技术来优化决 策树,以获得全局最优解 (最小损失函数值)。

决策树的预测原理

特征选择

使用训练好的决策树模型对新 的样本进行预测时,需要根据 模型中保存的特征选择规则进

行预测。

路径搜索

从根节点开始,根据模型中保存 的分裂准则和分裂点信息,沿着 树结构向下搜索,直到到达叶子 节点或无法继续分裂的节点。

CART算法步骤

划分数据集、对每个属性计算其划分能力、选择划分能力最大的属性、生成决策 节点、递归生成决策树。

随机森林算法

随机森林算法原理

基于多棵决策树的投票策略,通过训练多棵决策树,然后对 结果进行投票,以得到更加准确的结果。

随机森林算法步骤

数据集随机化、生成多棵决策树、对结果进行投票、选择票 数最多的结果作为输出。

01

02

03

04

总结词:差异对比、应用场景

线性回归是一种基于因变量和 一个或多个自变量之间关系的 预测模型,通常适用于连续目 标变量。

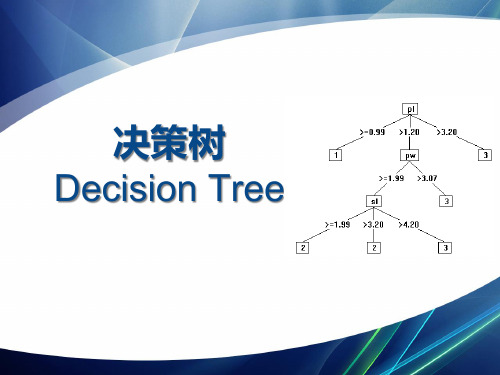

决策树是一种基于自上而下的 贪心搜索算法,将数据集划分 成若干个不相交的子集,每个 子集对应一个决策节点,从而 形成一棵树状结构。

在回归问题上,决策树不如线 性回归表现稳定,但在分类问 题上,决策树表现更优秀,可 以很好地处理非线性关系和异 常值。

C4.5算法

C4.5算法原理

在ID3算法的基础上,增加了剪枝、处理缺失值和连续属性等处理,以得到 更加准确的决策树。

C4.5算法步骤

计算各个属性的信息增益率、选择信息增益率最大的属性、生成决策节点、 递归生成决策树、剪枝处理。

CART算法

CART算法原理

基于二叉树的贪心策略,将数据集划分为两个子集,然后对每个子集递归生成决 策树。

决策树算法(PPT36页)

第七章 决策树和决策规则

本章目标 分析解决分类问题的基于逻辑的方法的特

性. 描述决策树和决策规则在最终分类模型中

的表述之间的区别. 介绍C4.5算法. 了解采用修剪方法降低决策树和决策规则

的复杂度.

决策树和决策规则是解决实际应用中分类 问题的数据挖掘方法。

一般来说,分类是把数据项映射到其中一 个事先定义的类中的这样一个学习函数的 过程。由一组输入的属性值向量(也叫属性 向量)和相应的类,用基于归纳学习算法得 出分类。

单按上面方式计算。下面先介绍一下C4.5 算法中一般包含3种类型的检验结构:

1.离散值的“标准”检验,对属性的每个可 能值有一个分枝和输出。

2.如果属性Y有连续的数值,通过将该值和阈 值Z比较,用输出Y≤Z和Y>Z定义二元检验。

3.基于离散值的更复杂的检验,该检验中属 性的每个可能值被分配到许多易变的组中, 每组都有一个输出和分枝。

7.2 C4.5算法:生成一个决策树

C4.5算法最重要的部分是由一组训练样本 生成一个初始决策树的过程。决策树可以 用来对一个新样本进行分类,这种分类从 该树的根节点开始,然后移动样本直至达 叶节点。在每个非叶决策点处,确定该节 点的属性检验结果,把注意力转移到所选 择子树的根节点上。

例如,如图7-3a为决策树分类模型,待分 类有样本如图7-3b所示,由决策树分类模 型可得出待分类样本为类2。(节点A,C,F(叶 节点))

=0.694

相应的增益: Gain(x1)=0.94-0.694=0.246

按属性3分区可得子集的熵的加权和:

infox2(T)=6/14(-3/6log2(3/6)-3/6log2(3/6)) +8/14(-6/8log2(6/8)-2/8log2(2/8))

本章目标 分析解决分类问题的基于逻辑的方法的特

性. 描述决策树和决策规则在最终分类模型中

的表述之间的区别. 介绍C4.5算法. 了解采用修剪方法降低决策树和决策规则

的复杂度.

决策树和决策规则是解决实际应用中分类 问题的数据挖掘方法。

一般来说,分类是把数据项映射到其中一 个事先定义的类中的这样一个学习函数的 过程。由一组输入的属性值向量(也叫属性 向量)和相应的类,用基于归纳学习算法得 出分类。

单按上面方式计算。下面先介绍一下C4.5 算法中一般包含3种类型的检验结构:

1.离散值的“标准”检验,对属性的每个可 能值有一个分枝和输出。

2.如果属性Y有连续的数值,通过将该值和阈 值Z比较,用输出Y≤Z和Y>Z定义二元检验。

3.基于离散值的更复杂的检验,该检验中属 性的每个可能值被分配到许多易变的组中, 每组都有一个输出和分枝。

7.2 C4.5算法:生成一个决策树

C4.5算法最重要的部分是由一组训练样本 生成一个初始决策树的过程。决策树可以 用来对一个新样本进行分类,这种分类从 该树的根节点开始,然后移动样本直至达 叶节点。在每个非叶决策点处,确定该节 点的属性检验结果,把注意力转移到所选 择子树的根节点上。

例如,如图7-3a为决策树分类模型,待分 类有样本如图7-3b所示,由决策树分类模 型可得出待分类样本为类2。(节点A,C,F(叶 节点))

=0.694

相应的增益: Gain(x1)=0.94-0.694=0.246

按属性3分区可得子集的熵的加权和:

infox2(T)=6/14(-3/6log2(3/6)-3/6log2(3/6)) +8/14(-6/8log2(6/8)-2/8log2(2/8))

人工智能之决策树ppt课件

分支

连接节点之间的路径,代表不同 的决策路径。

决策树学习算法分类

ID3算法

基于信息增益进行特征选择,适用于离散型特征。

C4.5算法

在ID3算法基础上进行改进,支持连续型特征处理, 引入剪枝技术防止过拟合。

CART算法

既可用于分类也可用于回归任务,基于基尼指数 进行特征选择,生成二叉树结构。

应用场景举例

提高泛化能力

02

剪枝后的决策树更加简洁,能够更好地适应新数据,提高模型

的泛化能力。

减少计算资源消耗

03

简化决策树结构可以降低模型训练和预测的计算复杂度,节省

计算资源。

预剪枝策略及实现方法

设定决策树生长的最大深度

在决策树生长过程中,限制其最大深度,防止 过深导致过拟合。

设定叶节点最小样本数

当某个节点的样本数小于设定值时,停止对该 节点的划分,将其作为叶节点。

利用统计学方法进行剪枝

基于统计学原理,对决策树节点进行假设检验,判断是否需要继续划分。

后剪枝策略及实现方法

错误率降低剪枝(Reduced-Error Prun…

自下而上地对决策树进行剪枝,如果剪去某个子树后,整体错误率降低,则进行剪枝。

代价复杂度剪枝(Cost-Complexity Pr…

引入代价复杂度参数,通过最小化整体代价(错误率与复杂度之和)来进行剪枝。

THANKS

感谢观看

集成学习方法在决策树中应用

Bagging方法

通过自助采样法生成多个数据集, 分别训练决策树模型,再对多个 模型的结果进行投票或平均,降 低模型方差。

Boosting方法

通过迭代训练多个弱分类器,将 每个弱分类器的结果加权求和, 得到强分类器,提高模型性能。

连接节点之间的路径,代表不同 的决策路径。

决策树学习算法分类

ID3算法

基于信息增益进行特征选择,适用于离散型特征。

C4.5算法

在ID3算法基础上进行改进,支持连续型特征处理, 引入剪枝技术防止过拟合。

CART算法

既可用于分类也可用于回归任务,基于基尼指数 进行特征选择,生成二叉树结构。

应用场景举例

提高泛化能力

02

剪枝后的决策树更加简洁,能够更好地适应新数据,提高模型

的泛化能力。

减少计算资源消耗

03

简化决策树结构可以降低模型训练和预测的计算复杂度,节省

计算资源。

预剪枝策略及实现方法

设定决策树生长的最大深度

在决策树生长过程中,限制其最大深度,防止 过深导致过拟合。

设定叶节点最小样本数

当某个节点的样本数小于设定值时,停止对该 节点的划分,将其作为叶节点。

利用统计学方法进行剪枝

基于统计学原理,对决策树节点进行假设检验,判断是否需要继续划分。

后剪枝策略及实现方法

错误率降低剪枝(Reduced-Error Prun…

自下而上地对决策树进行剪枝,如果剪去某个子树后,整体错误率降低,则进行剪枝。

代价复杂度剪枝(Cost-Complexity Pr…

引入代价复杂度参数,通过最小化整体代价(错误率与复杂度之和)来进行剪枝。

THANKS

感谢观看

集成学习方法在决策树中应用

Bagging方法

通过自助采样法生成多个数据集, 分别训练决策树模型,再对多个 模型的结果进行投票或平均,降 低模型方差。

Boosting方法

通过迭代训练多个弱分类器,将 每个弱分类器的结果加权求和, 得到强分类器,提高模型性能。

决策树算法演示文稿

Step4 针对这两边各部分的值分别计算它们的增益或增

益比率,以保证选择的划分使得增益最大。

第9章 决策树算法

28 第28页,共65页。

9.2.2.3 C4.5对缺失数据的处理

为了评估属性A是否是决策节点n的最佳测试属性,要计算决策树 在该节点的信息增益Gain(D,A)。假定< , c( )>是S中di的一d个i 训

将要介绍的算法的共同点也是在于都是利 用了相同的属性度量标准Gini指标。

第9章 决策树算法

31 第31页,共65页。

9.2.3 CART算法

Gini指标主要是度量数据划分或训练数据 集D的不纯度为主,系数值的属性作为测试 属性,Gini值越小,表明样本的“纯净度” 越高。Gini指标定义为如下公式:

6 第6页,共65页。

9.1 决策树算法原理

定义 9.1 给定一个训练数据集D=,其中每 个实例,称为例子,训练数据集中包含以 下属性A=。同时给定类别集合C。对于训 练数据集D,决策树是指具有以下性质的树:

每个内部节点都被标记一个属性Ai。

每个弧都被标记一个值,这个值对应于相 应父结点的属性。

9.2.2.1 C4.5的分裂属性选择度量

为了避免这个偏置,弥补ID系列算法的不足就要舍弃

信息增益这个度量而选择别的决策属性作为度量标准。

Quinlan在他1986年中的论文中提出了一种可以使用 的度量标准:增益比率。

增益比率通过加入一个被称为分裂信息(split information)的项来惩罚类似Date这样的属性,分

第9章 决策树算法

19 第19页,共65页。

9.2.1 ID3算法

I ( p, n)

p p n log2

益比率,以保证选择的划分使得增益最大。

第9章 决策树算法

28 第28页,共65页。

9.2.2.3 C4.5对缺失数据的处理

为了评估属性A是否是决策节点n的最佳测试属性,要计算决策树 在该节点的信息增益Gain(D,A)。假定< , c( )>是S中di的一d个i 训

将要介绍的算法的共同点也是在于都是利 用了相同的属性度量标准Gini指标。

第9章 决策树算法

31 第31页,共65页。

9.2.3 CART算法

Gini指标主要是度量数据划分或训练数据 集D的不纯度为主,系数值的属性作为测试 属性,Gini值越小,表明样本的“纯净度” 越高。Gini指标定义为如下公式:

6 第6页,共65页。

9.1 决策树算法原理

定义 9.1 给定一个训练数据集D=,其中每 个实例,称为例子,训练数据集中包含以 下属性A=。同时给定类别集合C。对于训 练数据集D,决策树是指具有以下性质的树:

每个内部节点都被标记一个属性Ai。

每个弧都被标记一个值,这个值对应于相 应父结点的属性。

9.2.2.1 C4.5的分裂属性选择度量

为了避免这个偏置,弥补ID系列算法的不足就要舍弃

信息增益这个度量而选择别的决策属性作为度量标准。

Quinlan在他1986年中的论文中提出了一种可以使用 的度量标准:增益比率。

增益比率通过加入一个被称为分裂信息(split information)的项来惩罚类似Date这样的属性,分

第9章 决策树算法

19 第19页,共65页。

9.2.1 ID3算法

I ( p, n)

p p n log2

决策树ID3算法ppt课件

第6章 决策树

决策树基本概念

决策树的优点

1、推理过程容易理解,决策推理过程可以表示成If Then形式;

2、推理过程完全依赖于属性变量的取值特点;

3、可自动忽略目标变量没有贡献的属性变量,也为判断属性 变量的重要性,减少变量的数目提供参考。

第6章 决策树 在整堂课的教学中,刘教师总是让学生带着问题来学习,而问题的设置具有一定的梯度,由浅入深,所提出的问题也很明确

第6章 决策树

关于分类问题

决策树基本概念

名称 人类

体温 恒温

表皮覆 盖

毛发

胎生 是

水生动 物

否

飞行动 物

否

有腿 是

冬眠 否

海龟 冷血 鳞片

否

半

否

是

否

鸽子 恒温 羽毛

否

否

是

是

否

鲸

恒温 毛发

是

是

否

否

否

X

分类与回归 分类目标属性y是离散的,回归目标属性y是连续的

类标号

哺乳动 物

爬行类 鸟类 哺乳类

y

在整堂课的教学中,刘教师总是让学 生带着 问题来 学习, 而问题 的设置 具有一 定的梯 度,由 浅入深 ,所提 出的问 题也很 明确

第6章 决策树 在整堂课的教学中,刘教师总是让学生带着问题来学习,而问题的设置具有一定的梯度,由浅入深,所提出的问题也很明确

决策树基本概念

关于归纳学习(2)

归纳学习的过程就是寻找一般化描述的过程。这种一般性 描述能够解释给定的输入数据,并可以用来预测新的数据。

锐角三角形内角和等于180度; 钝角三角形内角和等于180度; 直角三角形内角和等于180度;

1、模型构建(归纳) 通过对训练集合的归纳,建立分类模型。

决策树基本概念

决策树的优点

1、推理过程容易理解,决策推理过程可以表示成If Then形式;

2、推理过程完全依赖于属性变量的取值特点;

3、可自动忽略目标变量没有贡献的属性变量,也为判断属性 变量的重要性,减少变量的数目提供参考。

第6章 决策树 在整堂课的教学中,刘教师总是让学生带着问题来学习,而问题的设置具有一定的梯度,由浅入深,所提出的问题也很明确

第6章 决策树

关于分类问题

决策树基本概念

名称 人类

体温 恒温

表皮覆 盖

毛发

胎生 是

水生动 物

否

飞行动 物

否

有腿 是

冬眠 否

海龟 冷血 鳞片

否

半

否

是

否

鸽子 恒温 羽毛

否

否

是

是

否

鲸

恒温 毛发

是

是

否

否

否

X

分类与回归 分类目标属性y是离散的,回归目标属性y是连续的

类标号

哺乳动 物

爬行类 鸟类 哺乳类

y

在整堂课的教学中,刘教师总是让学 生带着 问题来 学习, 而问题 的设置 具有一 定的梯 度,由 浅入深 ,所提 出的问 题也很 明确

第6章 决策树 在整堂课的教学中,刘教师总是让学生带着问题来学习,而问题的设置具有一定的梯度,由浅入深,所提出的问题也很明确

决策树基本概念

关于归纳学习(2)

归纳学习的过程就是寻找一般化描述的过程。这种一般性 描述能够解释给定的输入数据,并可以用来预测新的数据。

锐角三角形内角和等于180度; 钝角三角形内角和等于180度; 直角三角形内角和等于180度;

1、模型构建(归纳) 通过对训练集合的归纳,建立分类模型。

决策树ppt课件

决策树在分类问题中应用

分类问题背景介绍

分类问题是机器学习中一类重要 的问题,旨在将数据划分为不同

的类别。

在现实世界中,分类问题广泛存 在,如垃圾邮件识别、疾病诊断、

信用评分等。

分类算法的目标是通过学习训练 数据中的特征与类别之间的关系, 从而对新的未知数据进行类别预

测。

决策树在分类问题中优势

直观易理解

决策树在处理缺失值和异常值时容易受到干扰,可能导致模型性能下降。可以通过数据 预处理等方法减少缺失值和异常值对模型的影响。

CART算法实例演示

实例背景

假设有一个关于信用卡欺诈的数据集,包含多个特征(如交 易金额、交易时间、交易地点等)和一个目标变量(是否欺 诈)。我们将使用CART算法构建一个分类模型来预测交易 是否属于欺诈行为。

构建决策树时间较长

C4.5算法在构建决策树时需要计算每 个特征的信息增益比,当数据集较大 或特征较多时,构建决策树的时间可 能会较长。

C4.5算法实例演示

数据集介绍

以经典的鸢尾花数据集为例,该数据集包含150个 样本,每个样本有4个特征(花萼长度、花萼宽度、 花瓣长度、花瓣宽度)和1个标签(鸢尾花的类 别)。

建造年份等特征。

选择合适的决策树算法 (如CART、ID3等),

对数据进行训练。

模型评估与优化

采用均方误差等指标评 估模型性能,通过调整 参数、集成学习等方法

优化模型。

结果展示与解读

展示决策树图形化结果, 解释每个节点含义及预

测逻辑。

08

CATALOGUE

总结与展望

决策树模型总结回顾

模型原理

决策树通过递归方式将数据集划分为若干个子集,每个子 集对应一个决策结果。通过构建树形结构,实现分类或回 归任务。

分类问题背景介绍

分类问题是机器学习中一类重要 的问题,旨在将数据划分为不同

的类别。

在现实世界中,分类问题广泛存 在,如垃圾邮件识别、疾病诊断、

信用评分等。

分类算法的目标是通过学习训练 数据中的特征与类别之间的关系, 从而对新的未知数据进行类别预

测。

决策树在分类问题中优势

直观易理解

决策树在处理缺失值和异常值时容易受到干扰,可能导致模型性能下降。可以通过数据 预处理等方法减少缺失值和异常值对模型的影响。

CART算法实例演示

实例背景

假设有一个关于信用卡欺诈的数据集,包含多个特征(如交 易金额、交易时间、交易地点等)和一个目标变量(是否欺 诈)。我们将使用CART算法构建一个分类模型来预测交易 是否属于欺诈行为。

构建决策树时间较长

C4.5算法在构建决策树时需要计算每 个特征的信息增益比,当数据集较大 或特征较多时,构建决策树的时间可 能会较长。

C4.5算法实例演示

数据集介绍

以经典的鸢尾花数据集为例,该数据集包含150个 样本,每个样本有4个特征(花萼长度、花萼宽度、 花瓣长度、花瓣宽度)和1个标签(鸢尾花的类 别)。

建造年份等特征。

选择合适的决策树算法 (如CART、ID3等),

对数据进行训练。

模型评估与优化

采用均方误差等指标评 估模型性能,通过调整 参数、集成学习等方法

优化模型。

结果展示与解读

展示决策树图形化结果, 解释每个节点含义及预

测逻辑。

08

CATALOGUE

总结与展望

决策树模型总结回顾

模型原理

决策树通过递归方式将数据集划分为若干个子集,每个子 集对应一个决策结果。通过构建树形结构,实现分类或回 归任务。

决策树培训讲义(PPT 49页)

Married 100K No

Single 70K

No

Married 120K No

Divorced 95K

Yes

Married 60K

No

Divorced 220K No

Single 85K

Yes

Married 75K

No

Single 90K

Yes

3. samples = { 2,3,5,6,8,9,10 } attribute_list = { MarSt, TaxInc }

选择TaxInc为最优分割属性:

Refund

Yes

No

NO < 80K

Single TaxInc

MarSt

Married Divorced

>= 80K

NO

YES

▪ 问题1:分类从哪个属性开始?

——选择分裂变量的标准

▪ 问题2:为什么工资以80为界限?

——找到被选择的变量的分裂点的标准( 连续变量情况)

分类划分的优劣用不纯性度量来分析。如果对于所有

分支,划分后选择相同分支的所有实例都属于相同的类,

则这个划分是纯的。对于节点m,令 N m 为到达节点m的训练

实例数,

个实例中

N

i m

个属于Ci

类,而

N

i m

Nm 。如果一

个实例到节点m,则它属于 类的概率估i 计为:

pˆ (Ci

|

x, m)

pmi

N

i m

10

Single 125K No

Married 100K No

Single 70K

No

Married 120K No

决策树(完整)ppt课件

Gain(D,密度,0.381)

是7 否

Ent(D)[147Ent(Dt)1173Ent(Dt)]

是8

0.263

;.

28

与离散属性不同,若当前结 点划分属性为连续属性,该连续属 性还可被再次选作后代结点的最优 划分属性。

选择“纹理”作为根结点划分属性

;.

29

现实任务中,尤其在属性数目较多时,存在大量样本出现缺失值。 出于成本和隐私的考虑

;.

30

1. 属性值缺失时,如何进行划分属性选择?(如何计算信息增益) 2. 给定划分属性,若样本在该属性上的值缺失,如何对样本进行划分?

(对于缺失属性值的样本如何将它从父结点划分到子结点中)

D : D : 训练集

训练集中在属性a上没有缺失值的样本子集

D D v :

被属性a划分后的样本子集

D D k :

{8}和{10}同时进入三个分支中,权值分别为:

7,5,3 15 15 15

;.

36

每个属性

~

d个属性描述的样本

~

对样本分类

~

坐标空间中的一个坐标轴 d维空间中的一个数据点 在坐标空间中寻找不同类样本之间的分类边界

决策树形成的分类边界的明显特点:轴平行,分类边界由若干个与坐标轴平行的分段组 成。

优点:学习结果解释性强,每个划分都对应一个属性取值

;.

1

第4章 决策树

根据训练数据是否拥有标记信息

学习任务

监督学习(supervised learning)

无监督学习(unsupervised learning)

半监督学习(semi-supervised learning)

强化学习(reinforcement learning)

是7 否

Ent(D)[147Ent(Dt)1173Ent(Dt)]

是8

0.263

;.

28

与离散属性不同,若当前结 点划分属性为连续属性,该连续属 性还可被再次选作后代结点的最优 划分属性。

选择“纹理”作为根结点划分属性

;.

29

现实任务中,尤其在属性数目较多时,存在大量样本出现缺失值。 出于成本和隐私的考虑

;.

30

1. 属性值缺失时,如何进行划分属性选择?(如何计算信息增益) 2. 给定划分属性,若样本在该属性上的值缺失,如何对样本进行划分?

(对于缺失属性值的样本如何将它从父结点划分到子结点中)

D : D : 训练集

训练集中在属性a上没有缺失值的样本子集

D D v :

被属性a划分后的样本子集

D D k :

{8}和{10}同时进入三个分支中,权值分别为:

7,5,3 15 15 15

;.

36

每个属性

~

d个属性描述的样本

~

对样本分类

~

坐标空间中的一个坐标轴 d维空间中的一个数据点 在坐标空间中寻找不同类样本之间的分类边界

决策树形成的分类边界的明显特点:轴平行,分类边界由若干个与坐标轴平行的分段组 成。

优点:学习结果解释性强,每个划分都对应一个属性取值

;.

1

第4章 决策树

根据训练数据是否拥有标记信息

学习任务

监督学习(supervised learning)

无监督学习(unsupervised learning)

半监督学习(semi-supervised learning)

强化学习(reinforcement learning)

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

8

2020/4/10

速度:指产生和使用模型的计算花费。 建模的速度、预测的速度

强壮性:指给定噪声数据或具有缺失值的数据, 模型正确预测的能力。

可诠释性:指模型的解释能力。

9

2020/4/10

二、决策树(Decision Tree)

决策树归纳的基本算法是贪心算法,它以自顶向下 递归各个击破的方式构造决策树。

训练测试法(training-and-testing)

交叉验证法(cross-validation)

例如,十折交叉验证。即是将数据集分成十分, 轮流将其中9份做训练1份做测试,10次的结果的

均值作为对算法精度的估计,一般还需要进行多 次10倍交叉验证求均值,例如10次10倍交叉验证, 更精确一点。

20

2020/4/10

2、决策树的剪枝(pruning)

决策树学习可能遭遇模型过度拟合(over fitting) 的问题,过度拟合是指模型过度训练,导致模型记 住的不是训练集的一般性,反而是训练集的局部特 性。

如何处理过度拟合呢?对决策树进行修剪。

Gain(年龄)=0.0167 Gain(性别)=0.0972 Gain(家庭所得)=0.0177

17

Max:作为第一个分类依据

2020/4/10

Example(续)

I(7,3)=-((3/7)*log2(3/7)+(4/7)*log2(4/7))=0.9852

Gain(年龄)=0.9852

IF性别=Female AND家庭所得= 低所得THEN购买RV房车=否 IF性别=Female AND家庭所得= 小康THEN购买RV房车=否 IF性别=Female AND家庭所得= 高所得THEN购买RV房车=是

IF性别=Male AND年龄<35 THEN购买RV房车=否 IF性别=Male AND年龄≧35 THEN购买RV房车=是

13

根部节点

? 中间节点

停止分支

2020/4/10

(三)ID3算法(C4.5,C5.0)

Quinlan(1979)提出,以Shannon(1949)的信息论 为依据。

ID3算法的属性选择度量就是使用信息增益,选 择最高信息增益的属性作为当前节点的测试属 性。

信息论:若一事件有k种结果,对应的概率为Pi。 则此事件发生后所得到的信息量I(视为Entropy) 为:

2020/4/10

(四)Decision Tree的建立过程

1、决策树的停止

决策树是通过递归分割(recursive partitioning)建 立而成,递归分割是一种把数据分割成不同小 的部分的迭代过程。

如果有以下情况发生,决策树将停止分割: 该群数据的每一笔数据都已经归类到同一类 别。 该群数据已经没有办法再找到新的属性来进 行节点分割。 该群数据已经没有任何尚未处理的数据。

Example 3:

设 k=4p1=1,p2=0,p3=0,p4=0 I=-(1*log2(1))=0

15

2020/4/10

信息增益

16

2020/4/10

n=16

Example(Gain) n1=4

I(16,4)=-((4/16)*log2(4/16)+(12/16)*log2(12/16))=0.8113 E(年龄)=(6/16)*I(6,1)+(10/16)*I(10,3)=0.7946 Gain(年龄)=I(16,4)-E(年龄)=0.0167

10

2020/4/10

(一)决策树的结构

根部节点(root node) 中间节点(non-leaf node)

(代表测试的条件)

分支(branches)

(代表测试的结果)

叶节点(leaf node)

11

(代表分类后所获得的分类标记2)020/4/10

(二)决策树的形成

12

2020//10

例:

决策树(Decision Tree)

1

2020/4/10

一、分类(Classification)

1、分类的意义

数据库

分类模型— 决策树

分类模型— 聚类

预测

了解类别属性 与特征

2

2020/4/10

2、分类的技术

(1)决策树

数据库

3

分类标记

性别

Female

年龄

Male 婚姻

<35

≧35

未婚 已婚

否

I=-(p1*log2(p1)+ p2*log2(p2)+…+ pk*log2(pk))

14

2020/4/10

Example 1:

设 k=4p1=0.25,p2=0.25,p3=0.25,p4=0.25 I=-(.25*log2(.25)*4)=2

Example 2:

设k=4p1=0,p2=0.5,p3=0,p4=0.5 I=-(.5*log2(.5)*2)=1

贪心算法:在每一步选择中都采取在当前状态下最好 /优的选择。

在其生成过程中,分割方法即属性选择度量是关键。 通过属性选择度量,选择出最好的将样本分类的属 性。

根据分割方法的不同,决策树可以分为两类:基于 信息论的方法(较有代表性的是ID3、C4.5算法等) 和最小GINI指标方法(常用的有CART、SLIQ及 SPRINT算法等)。

Gain(家庭所得)=0.688

I(9,1)=-((1/9)*log2(1/9)+(8/9)*log2(8/9))=0.5032

18

2020/4/10

Gain(年龄)=0.2222

Gain(家庭所得)=0.5032

Example(end)ID3算法

资料

19

Decision Tree

分类规则:

是

否

是

2020/4/10

(2)聚类

4

2020/4/10

3、分类的程序

模型建立(Model Building) 模型评估(Model Evaluation) 使用模型(Use Model)

5

2020/4/10

决策树分类的步骤

数据库

建立模型

训练样本(training samples)

测试样本(testing samples)

评估模型

6

2020/4/10

例:

资料

2.模型评估

1.建立模型 未婚

婚姻

已婚

<35

训 练 样否 本

测 试 样 本

年龄 ≧35

是

家庭 所得

低 小康 高 否否是

错误率为66.67%

3.使用模型

修改模型

7

2020/4/10

4、分类算法的评估

预测的准确度:指模型正确地预测新的或先前 未见过的数据的类标号的能力。