SPSS课件9-回归分析

第9章spss回归.

经15次迭代,相邻两次迭代残差平方和几

34

乎为0,即得到参数最优解,迭代终止。

参数估计表

由表可得非线性回归方程为 Saels=12.904-11.268exp(-0.496advert)

35

参数估计相关系数表 方差分析表

全部变异

与因变量均值的变异

由表中可决系数R2 =0.909,说明模

36

型可以解释因变量的90.9%的变异。

回归分析中是否 包含常数项

8

【结果形式】

H0: b1=…=bn=0

可决系数-自变量可解释 因变量的比例

模型的方差分析

9

H0:a=0 H0:bi=0

模型中常数项与回归系数的检验 回归方程为time=-1.955+3.457diam

10

【实例】为研究某公司职工当前工资水平(salary), 收集了影响因素6个,即开始工资(salbegin $)、受 教育时间(educ)、来公司工作时间(jobtime)、工 种(jobcat)、来前工作经验(prevexp)及是否少数 民族(minority),试用多元线性回归对该公司当前工 资水平建立恰当回归模型。 【数据准备】见下页

21

Curve Estimation中提供了11种本质线性模型:

22

【实例】某产品零售商已知产品的广告投入和销售 额的数据,试找出适当的回归方程。

【作散点图预分析】 Graphs-scatter/dot

简单散点图,用 于一对变量

矩阵散点图,用 单点散点图,用

于多对变量

于单个变量

重叠散点图,用 于多对变量

18

随自变量的加入,线性

H0:b1=…=b5=0

模型都有显著效果

第9章 spss的相关分析和线性回归分析PPT课件

r是相应的偏相关系数。n是观测个数,k是控 制变量的数目,n-k-2是自由度。 在SPSS的偏相关分析过程的输出中只给出偏相 关系数和假设成立的概率p值。

偏相关分析的操作

与简单相关分析操作类似,只不过菜单为

Analyze→Correlate→Partial

实例:利用数据相关回归分析(高校科研研 究).sav,分析发表立项课题数与论文数之间的 偏相关关系,其中投入高级职称的人数为控制变 量。

Pearson相关系数 Spearman 秩相关系数 Kendall t 相关系数

Pearson 相 关 系 数 ( Pearson’s correlation coefficient)又叫相 关系数或线性相关系数。它一般用

字母r表示。

r (xx)(yy) (xx)2 (yy)2

它是由两个变量的样本取值得到,这是一个描 述线性相关强度的量,取值于-1和1之间。当两 个变量有很强的线性相关时,相关系数接近于1 (正相关)或-1(负相关),而当两个变量不 那么线性相关时,相关系数就接近0。

Pearson 相 关 系 数 的 局 限 性 :

①要求变量服从正态分布 ②只能度量线性相关性,对于曲线相关等更为复杂的 情形,该相关系数的大小并不能代表相关性的强弱。 如果Pearson系数很低,只能说明两变量之间没有线 性关系,并不能说明两者之间没有相关关系。也就是 说,该指标只能度量线性相关性,而不是相关性。 (线性相关性隐含着相关性,而相关性并不隐含着线 性相关性)

这很难一概而论。但在计算机输出 中都有和这些相关度量相应的检验

和p-值;因此可以根据这些结果来

判断是否相关

简单相关分析菜单

画散点图

Graphs→Scatter 选择散点图的类型 根据所选择的散点图类型,单击Define对散点图作具体定

第九章 spss的回归分析

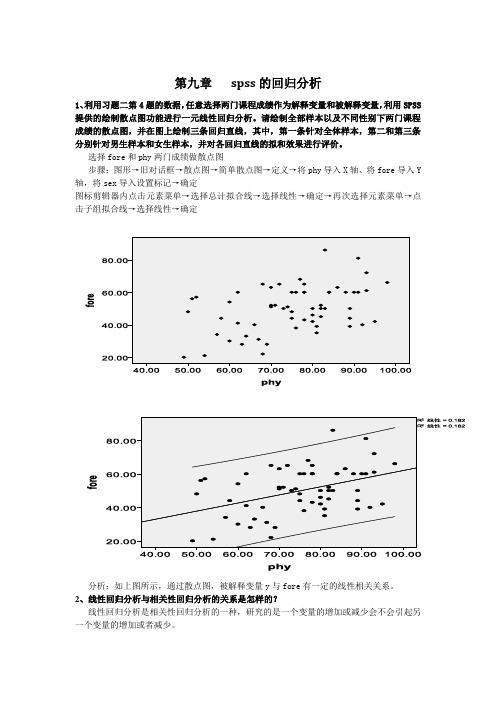

第九章spss的回归分析1、利用习题二第4题的数据,任意选择两门课程成绩作为解释变量和被解释变量,利用SPSS 提供的绘制散点图功能进行一元线性回归分析。

请绘制全部样本以及不同性别下两门课程成绩的散点图,并在图上绘制三条回归直线,其中,第一条针对全体样本,第二和第三条分别针对男生样本和女生样本,并对各回归直线的拟和效果进行评价。

选择fore和phy两门成绩做散点图步骤:图形→旧对话框→散点图→简单散点图→定义→将phy导入X轴、将fore导入Y 轴,将sex导入设置标记→确定图标剪辑器内点击元素菜单→选择总计拟合线→选择线性→确定→再次选择元素菜单→点击子组拟合线→选择线性→确定分析:如上图所示,通过散点图,被解释变量y与fore有一定的线性相关关系。

2、线性回归分析与相关性回归分析的关系是怎样的?线性回归分析是相关性回归分析的一种,研究的是一个变量的增加或减少会不会引起另一个变量的增加或者减少。

3、为什么需要对线性回归方程进行统计检验?一般需要对哪些方面进行检验?线性回归方程能够较好地反映被解释变量和解释变量之间的统计关系的前提是被解释变量和解释变量之间确实存在显著的线性关系。

回归方程的显著性检验正是要检验被解释变量和解释变量之间的线性关系是否显著,用线性模型来描述他们之间的关系是否恰当。

一般包括回归系数的检验,残差分析等。

4、SPSS多元线性回归分析中提供了哪几种解释变量筛选策略?包括向前筛选策略、向后筛选策略和逐步筛选策略。

5、先收集到若干年粮食总产量以及播种面积、使用化肥量、农业劳动人数等数据,请利用建立多元线性回归方程,分析影响粮食总产量的主要因素。

数据文件名为“粮食总产量.sav”。

步骤:分析→回归→线性→粮食总产量导入因变量、其余变量导入自变量→确定结果如图:Variables Entered/Removed bModel Variables Entered Variables Removed Method1 农业劳动者人数(百万人),总播种面积(万公顷), 风灾面积比例(%), 粮食播种面积(万公顷), 施用化肥量(kg/公顷), 年份a. Entera. All requested variables entered.b. Dependent Variable: 粮食总产量(y万吨)ANOVA bModel Sum of Squares df Mean Square F Sig.1 Regression 2.025E9 6 3.375E8 414.944 .000aResidual 2.278E7 28 813478.405Total 2.048E9 34a. Predictors: (Constant), 农业劳动者人数(百万人), 总播种面积(万公顷), 风灾面积比例(%),粮食播种面积(万公顷), 施用化肥量(kg/公顷), 年份b. Dependent Variable: 粮食总产量(y万吨)Coefficients aModel UnstandardizedCoefficients StandardizedCoefficientst Sig.B Std. Error Beta1 (Constant) -613605.817 230903.867 -2.657 .013年份304.688 119.427 .402 2.551 .016粮食播种面积(万公顷) .736 .782 .053 .942 .354总播种面积(万公顷) 1.939 .650 .111 2.984 .006施用化肥量(kg/公顷) 141.077 11.186 .755 12.612 .000风灾面积比例(%) -307.209 51.870 -.174 -5.923 .000-5.121 22.286 -.038 -.230 .820 农业劳动者人数(百万人)a. Dependent Variable: 粮食总产量(y万吨)分析:如以上4个表所示,影响程度来由大到小依次是风灾面积、使用化肥量、总播种面积和年份。

[课件]SPSS回归分析过程详解()PPT

![[课件]SPSS回归分析过程详解()PPT](https://img.taocdn.com/s3/m/9975250eed630b1c59eeb5c4.png)

回归分析的概念

寻求有关联(相关)的变量之间的关系 主要内容:

从一组样本数据出发,确定这些变量间的定 量关系式 对这些关系式的可信度进行各种统计检验 从影响某一变量的诸多变量中,判断哪些变 量的影响显著,哪些不显著 利用求得的关系式进行预测和控制

回归分析的模型

按是否线性分:线性回归模型和非线性回归模型 按自变量个数分:简单的一元回归,多元回归 基本的步骤:利用SPSS得到模型关系式,是否 是我们所要的,要看回归方程的显著性检验(F 检验)和回归系数b的显著性检验(T检验),还要 看拟合程度R2 (相关系数的平方,一元回归用R Square,多元回归用Adjusted R Square)

我们只讲前面3个简单的(一般教科书的讲法)

10.1 线性回归(Liner)

一元线性回归方程: y=a+bx

a称为截距 b为回归直线的斜率 用R2判定系数判定一个线性回归直线的拟合程度:用来说明用自变 量解释因变量变异的程度(所占比例)

b0为常数项 b1、b2、…、bn称为y对应于x1、x2、…、xn的偏回归系数 用Adjusted R2调整判定系数判定一个多元线性回归方程的拟合程度: 用来说明用自变量解释因变量变异的程度(所占比例)

逐步回归方法的基本思想

对全部的自变量x1,x2,...,xp,按它们对Y贡献的大小进 行比较,并通过F检验法,选择偏回归平方和显著的变 量进入回归方程,每一步只引入一个变量,同时建立 一个偏回归方程。当一个变量被引入后,对原已引入 回归方程的变量,逐个检验他们的偏回归平方和。如 果由于引入新的变量而使得已进入方程的变量变为不 显著时,则及时从偏回归方程中剔除。在引入了两个 自变量以后,便开始考虑是否有需要剔除的变量。只 有当回归方程中的所有自变量对Y都有显著影响而不需 要剔除时,在考虑从未选入方程的自变量中,挑选对Y 有显著影响的新的变量进入方程。不论引入还是剔除 一个变量都称为一步。不断重复这一过程,直至无法 剔除已引入的变量,也无法再引入新的自变量时,逐 步回归过程结束。

第九章SPSS回归分析

第3步:启动分析过程。点击【分析】【 回归】【线性】菜单命令,打开如图所示 的对话框。

第4步:设置分析变量。设置因变量:在左边变量 列表中选“成就动机分数”,选入到“因变量”框 中。设置自变量:在左边变量列表中选“智商分数 ”变量,选入“自变量”框中。如果是多元线性回 归,则可以选择多个自变量。

第八个表:残差统计

第九个:标准化残差的概率图

[分析]:由此图可知,所有的点都比较靠近对角线 ,结合前面第八个表中的标准化残差为0.892,小 于2,因此可以认为残差是正态的。

由于自我效能感、服从领导满意度、同事人际敏感 、工作技能水平、个人信心指数这几个变量的回归 系数所对应的sig值不显著,在回归分析中需要删 除这几个变量,然后再建立回归方程。因此在SPSS 中接着再次进行回归分析。

分析:此例属于一元线性回归,一般先做两个变量 之间的散点图进行简单地观测。若散点图的趋势大 概呈线性关系,可以建立线性方程;若不呈线性分 布,可建立其它方程模型,并比较R2来确定选择其 中一种最佳方程式。

一元线性回归方程的原假设为:所建立的回归方程 无效,回归方程中来自总体自变量的系数为0。

第9步:重复前面SPSS的操作步骤,从第2步至第6 步。在第3步将自我效能感、服从领导满意度、同 事人际敏感、工作技能水平、个人信心指数这几个 变量从自变量移出,由于SPSS软件中还保存了刚才 第4、5、6步的操作内容,此时只需要再点击【确 定】按钮,输出分析结果。其中模型摘要、回归方 程、回归系数表如下:

第4步:设置分析参数。单击【统计】按钮,打开“ 线性回归:统计”对话框,可以选择输出的统计量 如图所示。

在“回归系数”栏,选择“估算值”。

在对话框的右边,有五个复选框:

(1)“模型拟合”是系统默认项,输出复相关系数 R、R2及R2修正值,估计值的标准误,方差分析表。 (2)“R方变化量”:增加进入或剔除一个自变量时 , R2的变化。

用SPSS做回归分析ppt课件

例1、某医学研究所对30个不同年龄的人的血压(高 压)进行了测量,得到如下数据:

年龄 39 47 45 47 65 45 67 42 67 56 36 50 39 21 44 血压 144 120 138 145 162 142 170 124 158 154 136 142 120 120 116 年龄 64 56 59 34 42 48 45 17 20 19 53 63 29 25 69 血压 162 150 140 110 128 130 135 114 116 124 158 144 130 125 175

初步分析作图察看按statisticsregressionlinear顺序展开对话框将y作为因变量选入dependent框中然后将其他变量选入作为自变量选入independents框中method框中选择stepwise逐渐回归作为分析方式单击statistics按钮进展需求的选择单击continue前往回归模型的建立被引入与被剔除的变量回归方程模型编号引入回归方程的自变量称号从回归方程被剔除的自变量称号回归方程中引入或剔除自变量的根据结果分析由复相关系数r0982阐明该预告模型高度显著可用于该地域大春粮食产量的短期预告常用统计量方差分析表回归方程为

在最优的方程中,所有变量对因变量Y的影响都应 该是显著的,而所有对Y影响不显著的变量都不包含 在方程中。选择方法主要有:

•逐步筛选法(STEPWISE) (最常用) •向前引入法(FORWARD) •向后剔除法(BACKWARD)等

逐步回归的基本思想和步骤:

开始

对不在方程中的变 量考虑能否引入?

能 引入变量

X1 137. 0 148. 0 154. 0 157. 0 153. 0 151. 0 151. 0 154. 0 155. 0 155. 0 156. 0 155. 0 157. 0 156. 0 159. 0 164. 0 164. 0 156. 0

Spss线性回归分析讲稿ppt课件

察其与因变量之间是否具有线性关系。然后,

将自变量进行组合,生成若干自变量的子集,再

针对每一个自变量的子集生成回归分析报告。

比较调整后的R2值,挑选最优的自变量子集,

生成回归分析模型。

火灾袭来时要迅速疏散逃生,不可蜂 拥而出 或留恋 财物, 要当机 立断, 披上浸 湿的衣 服或裹 上湿毛 毯、湿 被褥勇 敢地冲 出去

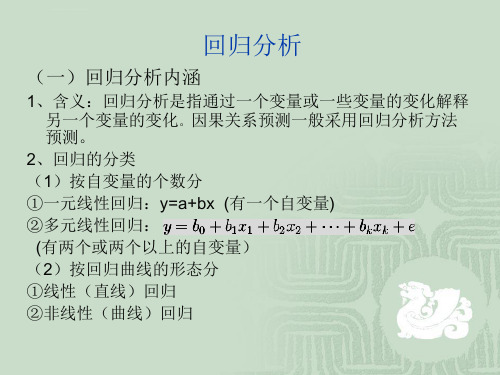

①一元线性回归:y=a+bx (有一个自变量)

②多元线性回归:

(有两个或两个以上的自变量)

(2)按回归曲线的形态分

①线性(直线)回归

②非线性(曲线)回归

火灾袭来时要迅速疏散逃生,不可蜂 拥而出 或留恋 财物, 要当机 立断, 披上浸 湿的衣 服或裹 上湿毛 毯、湿 被褥勇 敢地冲 出去

回归分析

(二)回归分析的主要内容

即销售量的95%以上的变动都可以被该模型所解释,拟和优度较高。

表3

火灾袭来时要迅速疏散逃生,不可蜂 拥而出 或留恋 财物, 要当机 立断, 披上浸 湿的衣 服或裹 上湿毛 毯、湿 被褥勇 敢地冲 出去

一元线性回归分析

表4给出了回归模型的方差分析表,可以看到,F统计量为

734.627,对应的p值为0,所以,拒绝模型整体不显著的

图1

奖金-销售量表

火灾袭来时要迅速疏散逃生,不可蜂 拥而出 或留恋 财物, 要当机 立断, 披上浸 湿的衣 服或裹 上湿毛 毯、湿 被褥勇 敢地冲 出去

一元线性回归

以奖金-销售量表图1做回归分析

2、绘制散点图

打开数据文件,选择【图形】-【旧对话框】-【散点/点状】

图2

火灾袭来时要迅速疏散逃生,不可蜂 拥而出 或留恋 财物, 要当机 立断, 披上浸 湿的衣 服或裹 上湿毛 毯、湿 被褥勇 敢地冲 出去

SPSS-23.0统计分析—在心理学与教育学中的应用-9第九章-回归分析教学教材

第1步:打开分析数据。打开“智商与成就动机.sav”文件 。

第2步:散点图分析。一般先做散点图,点击菜单【图形】 【旧对话框 】【散点图/点图】,弹出对话框。

选择【简单散点图】,再点Βιβλιοθήκη 【定义】。在弹出散点图的 主对话框。

将自变量“智商分数”选到“X轴”框内,因变量“成就动机分数”选 到“Y轴”框内,点击【确定】按钮,得到下图。

选择需要保存的数据种类作 为新变量存在数据编辑窗口。 本例中,在“预测值”框选 择“ 未标准化”。在“预测 区间”框选择“ 平均值”; 置信区间默认保持为“95%”。

第7步:设置选项参数。单击【选项】按钮,打开“线性 回归:选项”对话框:

在“步进法标准”中选择模型拟合判断准则: “⊙ 使用F的概率”,默认为“进入 0.05,删除 0.10”; “○使用F值”,默认为“进入3.84,删除2.71”。 按系统默认的方式选择。

本例中仅有一个变量,选择“ 模型拟合”、“ R方变化量 ”、“ 描述”。

在“残差”栏,有两个选项:

“ 德宾-沃森”;

“ 个案诊断”。个案诊断,即奇异值诊断,有两 个选项:“⊙离群值□标准差”:奇异值判据,默 认项标准差≥3。“○所有个案”:输出所有观测 量的残差值。在本例中不选择。

第6步:设置保存选项。单击【保存】按钮,打开“线性 回归:保存”对话框。

关系,某研究者调查了94名大学生,进行智力测验和成就 动机测验,获得数据文件为“智商与成就动机.sav”,试 分析个人成就动机测验分数对智力测验的回归方程。 分析:此例属于一元线性回归,一般先做两个变量之间的 散点图进行简单地观测。若散点图的趋势大概呈线性关系 ,可以建立线性方程;若不呈线性分布,可建立其它方程 模型,并比较R2 来确定选择其中一种最佳方程式。 一元线性回归方程的原假设 为:所建立的回归方程无效, 回归方程中来自总体自变量的系数为0。备择假设 为:所 建立的回归方程有效,回归方程中来自总体自变量的系数 不为0。

《SPSS数据分析教程》 ——回归分析..

本章学习目标

掌握线性回归分析的基本概念 掌握线性回归的前提条件并能进行验证 掌握线性回归分析结果的解释 掌握多重共线性的判别和处理 能用线性回归模型进行预测

回归分析的基本概念

什么是回归分析

回归分析是研究变量之间相关关系的一种统计方法 如果两个变量之间的Pearson相关系数绝对值较大, 从散点图看出变量间线性关系显著,那么下一步就是 应用回归分析的方法来找出变量之间的线性关系。 例如,房屋的价格和房屋的面积,地理位置,房龄和 房间的个数都有关系。又比如,香烟的销量和许多地 理和社会经济因素有关,像消费者的年龄,教育,收 入,香烟的价格等。

回归模型的显著性的F检验

总平方和SST反映因变量Y的波动程度或者不确 定性,在建立了Y对X的回归方程后,总平方和 SST分解成回归平方和SSR与参差平方和SSE两 部分。其中SSR是由回归方程确定的,SSE是不 能由自变量X解释的波动,是由X之外的未加控 制的因素引起的。这样,SST中能够由自变量 解释的部分为SSR,不能由自变量解释的部分 为SSE。这样回归平方和越大,回归的效果越 好,据此构造F检验统计量

回归术语

对于有一个响应变量的线性回归,当p=1时, 我们称为简单线性回归(Simple Linear Regression,或称为一元线性回归),当 p>2 时我们称为多元线性回归(Multiple Linear Regression)。

回归和相关分析

回归分析是在相关分析的基础上,确定了变量 之间的相互影响关系之后,准确的确定出这种 关系的数量方法。因此,一般情况下,相关分 析要先于回归分析进行,确定出变量间的关系 是线性还是非线性,然后应用相关的回归分析 方法。在应用回归分析之前,散点图分析是常 用的探索变量之间相关性的方法。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

多元线性回归模型

(概念要点)

1.

2.

3.

一个因变量与两个及两个以上自变量之间的回归 描述因变量 y 如何依赖于自变量 x1 , x2 ,…, xp 和误差项 的方程称为多元线性回归模型 涉及 p 个自变量的多元线性回归模型可表示为

2.

对一个具体的观测值来说,变差的大小可 以通过该实际观测值与其均值之差 y y 来 表示

离差平方和的分解

(图示)

y

( xi , y i )

y y

{}

}

ˆ y y ˆ y y

ˆ ˆ ˆ y b 0 + b1 x

y

离差分解图

x

离差平方和的分解

(三个平方和的关系)

1. 从图上看有

ˆ ˆ y y y y + y y

独立性意味着对于一个特定的 x 值,它所对应的ε与 其他 x 值所对应的ε不相关 对于一个特定的 x 值,它所对应的 y 值与其他 x 所 对应的 y 值也不相关

回归方程

(概念要点)

1.

2. 3.

描述 y 的平均值或期望值如何依赖于 x 的方程 称为回归方程 简单线性回归方程的形式如下 E( y ) = b0+ b1 x

“回归”一词的由来

Galton把这种孩子的身高向中间值靠近 的趋势称之为一种回归效应,而他发展的研 究两个数值变量的方法称为回归分析。 这也叫高尔顿的“普遍回归定律”。 高尔顿在智力遗传的方面也得到了类似的结 果:一般来说,天才是要遗传的。但是天才 的后代却要比他们的父辈们平庸,也就是他 们的智力水平将“回归”到中等水平;而一 个智商一般的父母,其孩子却可能是个天才!

Model 1

(Constant) 人 收 均 入

t 6.650 72.007

Sig . .000 .000

a. Dependent Variable: 人 消 均 费

P0=0.000<0.05 , 常数项显著不为零 P1=0.000<0.05,人均消费变量的系数显著不为零

9.2 多元线性回归

9.2.1 9.2.2 9.2.3 9.2.4 多元线性回归模型 回归参数的估计 回归方程的显著性检验 回归系数的显著性检验

第9章 线性回归分析

9.1 9.2 9.3 9.4 一元线性回归 多元线性回归 逐步回归 spss在回归中的应用

“回归”一词的由来

“回归”这个词最先由由英国著名统计学家F.高 尔顿(Francis Galton) 在19世纪末期研究孩子 及他们的父母的身高时提出来的。高尔顿研究发 现,父母和孩子的身高有这样的一个趋势:父母 高,儿女就高;父母矮,儿女也矮。但是高个父 母的儿女们平均起来并不像他们的父母那样高。 儿女辈的平均身高将“退化”到或者说“回归” 到全体人口的平均身高。对于比较矮的父母情形 也类似:他们的孩子比较矮,但这些孩子的平均 身高要比他们的父母的平均身高高。

P=0.000<0.05 拒绝H0, 线性关系显著

回归系数的显著性检验

(要点)

1. 检验 x 与 y 之间是否具有线性关系,或 者说,检验自变量 x 对因变量 y 的影响 是否显著 ˆ 的抽样分布 2. 理论基础是回归系数 b 1 3. 在一元线性回归中,等价于回归方程的 显著性检验

回归系数的显著性检验

3.

残差平方和(SSE)

判定系数 r

1.

2

回归平方和占总离差平方和的比例

2. 反映回归直线的拟合程度 3. 取值范围在 [ 0 , 1 ] 之间 4. r2 1,说明回归方程拟合的越好;r20 ,说明回归方程拟合的越差 5. 判定系数等于相关系数的平方,即r2=(r)2

Model Summary Model 1 R .999a R Sq uare .998 Adjusted R Sq uare .998 Std. Error of the Estimate 13.49860

一元线性回归模型

对于只涉及一个自变量的简单线性回归模 型可表示为 y = b0 + b1 x +

模型中,y 是 x 的线性函数(部分)加上误差项 线性部分反映了由于 x 的变化而引起的 y 的变化 误差项 是随机变量

反映了除 x 和 y 之间的线性关系之外的随机因素对 y 的影响 是不能由 x 和 y 之间的线性关系所解释的变异性

方程的图示是一条直线,因此也称为直线回归方程

b0是回归直线在 y 轴上的截距,是当 x=0 时 y 的期

望值

b1是直线的斜率,称为回归系数,表示当 x 每变动

一个单位时,y 的平均变动值

估计(经验)的回归方程

1. 总体回归参数 b 0 b1 和 是未知的,必需利用样本数 据去估计 ˆ ˆ 2. 用样本统计量 b 0 和 b 1代替回归方程中的未知参 数 b 0和 b1 ,就得到了估计的回归方程 3. 简单线性回归中估计的回归方程为

a. Predictors: (Constant), 人 收 均 入

R2=0.998

回归方程的显著性检验

(线性关系的检验 )

1.

2.

检验自变量和因变量之间的线性关系是否 显著 具体方法是将回归离差平方和(SSR)同剩余 离差平方和(SSE)加以比较,应用F检验来 分析二者之间的差别是否显著

如果是显著的,两个变量之间存在线性关系 如果不显著,两个变量之间不存在线性关系

b0 和 b1 称为模型的参数

一元线性回归模型

(基本假定)

1.

2. 3.

误差项ε是一个期望值为0的随机变量,即E(ε)=0。 对于一个给定的 x 值,y 的期望值为E ( y ) =b 0+ b 1x 对于所有的 x 值,ε的方差σ2 都相同 误差项ε是一个服从正态分布的随机变量,且相 互独立。即ε~N( 0 ,σ2 )

(步骤)

1.

2.

提出假设 H0: b1 = 0 (没有线性关系) H1: b1 0 (有线性关系) 计算检验的统计量

3. 确定显著性水平,并进行决策

t>t2,或P< , 拒绝H0; t<t2,或P> 接受H0

回归系数的显著性检验

对前例的回归系数进行显著性检验(=0.05)

n i

2. 两端平方后求和有

y

i 1

ˆ ˆ y yi y + yi y

2 2 i 1 i 1

n

n

2

总变差平方和 (SST)

残差平方和 (SSE)

SST = SSR + SSE

{

离差平方和的分解

(三个平方和的意义)

1.

9.1.3 回归方程的显著性检验

拟合优度检验(判定系数r 2 检验) 回归方程的显著性检验(F检验) 回归系数的显著性检验(t检验)

离差平方和的分解

1.

因变量 y 的取值是不同的,y 取值的这种 波动称为变差。变差来源于两个方面

由于自变量 x 的取值不同造成的 除 x 以外的其他因素(如x对y的非线性影响、 测量误差等)的影响

回归分析与相关分析的区别

1.

2.

相关分析中,变量 x 变量 y 处于平等的地 位;回归分析中,变量 y 称为因变量,处 在被解释的地位,x 称为自变量,用于预 测因变量的变化 相关分析主要是描述两个变量之间线性关 系的密切程度;回归分析不仅可以揭示变 量 x 对变量 y 的影响大小,还可以由回归 方程进行预测和控制

ˆ ˆ ˆ y b 0 + b1 x

b 是直线 b 其中:ˆ 0是估计的回归直线在 y 轴上的截距, ˆ1 的斜率,它表示对于一个给定的 x 的值,是 y 的估计 值,也表示 x 每变动一个单位时, y 的平均变动值

9.1.2 参数 b0 和 b1 的最小二乘 估计

最小二乘估计法

1. 使因变量的观察值与估计值之间的离差平方和 ˆ ˆ 达到最小来求得 b0 和 b1 的方法。即

尽管“回归”这个名称的由来具有其特定的含义,人 们在研究大量的问题中变量x与y之间的关系并不具有 这种“回归”的含义,但借用这个词把研究变量x与y 之间的统计关系的数学方法称为“回归分析”,也算 是对高尔顿这个伟大的统计学家的一种纪念。

回归分析主要解决以下几方面问题

1.

2.

3.

从一组样本数据出发,确定变量之间的数学 关系式 对这些关系式的可信程度进行各种统计检验, 并从影响某一特定变量的诸多变量中找出哪 些变量的影响显著,哪些不显著 利用所求的关系式,根据一个或几个变量的 取值来预测或控制另一个特定变量的取值, 并给出这种预测或控制的精确程度

总平方和(SST)

反映因变量的 n 个观察值与其均值的总离差

2.

回归平方和(SSR)

反映自变量 x 的变化对因变量 y 取值变化的影 响,或者说,是由于 x 与 y 之间的线性关系引 起的 y 的取值变化,也称为可解释的平方和

反映除 x 以外的其他因素对 y 取值的影响,也 称为不可解释的平方和或剩余平方和

ANOVAb Model 1 Sum of Squares 944762.6 2004.336 946766.9 df 1 11 12 Mean Square 944762.588 182.212 F 5184.954 Sig . .000a

Reg ression Residual Total

a. Predictors: (Constant), 人 收 均 入 b. Dependent Variable: 人 消 均 费

x

最小二乘法

ˆ和 ˆ 根据最小二乘法的要求,可得求解b 0 b 1的标 准方程如下