回归分析方法及其应用中的例子

七种回归分析方法个个经典

七种回归分析方法个个经典什么是回归分析?回归分析是一种预测性的建模技术,它研究的是因变量(目标)和自变量(预测器)之间的关系。

这种技术通常用于预测分析,时间序列模型以及发现变量之间的因果关系。

例如,司机的鲁莽驾驶与道路交通事故数量之间的关系,最好的研究方法就是回归。

回归分析是建模和分析数据的重要工具。

在这里,我们使用曲线/线来拟合这些数据点,在这种方式下,从曲线或线到数据点的距离差异最小。

我会在接下来的部分详细解释这一点。

我们为什么使用回归分析?如上所述,回归分析估计了两个或多个变量之间的关系。

下面,让我们举一个简单的例子来理解它:比如说,在当前的经济条件下,你要估计一家公司的销售额增长情况。

现在,你有公司最新的数据,这些数据显示出销售额增长大约是经济增长的2.5倍。

那么使用回归分析,我们就可以根据当前和过去的信息来预测未来公司的销售情况。

使用回归分析的好处良多。

具体如下:1.它表明自变量和因变量之间的显著关系;2.它表明多个自变量对一个因变量的影响强度。

回归分析也允许我们去比较那些衡量不同尺度的变量之间的相互影响,如价格变动与促销活动数量之间联系。

这些有利于帮助市场研究人员,数据分析人员以及数据科学家排除并估计出一组最佳的变量,用来构建预测模型。

我们有多少种回归技术?有各种各样的回归技术用于预测。

这些技术主要有三个度量(自变量的个数,因变量的类型以及回归线的形状)。

我们将在下面的部分详细讨论它们。

对于那些有创意的人,如果你觉得有必要使用上面这些参数的一个组合,你甚至可以创造出一个没有被使用过的回归模型。

但在你开始之前,先了解如下最常用的回归方法:1.Linear Regression线性回归它是最为人熟知的建模技术之一。

线性回归通常是人们在学习预测模型时首选的技术之一。

在这种技术中,因变量是连续的,自变量可以是连续的也可以是离散的,回归线的性质是线性的。

线性回归使用最佳的拟合直线(也就是回归线)在因变量(Y)和一个或多个自变量(X)之间建立一种关系。

数据挖掘技术之回归分析超全总结,常见回归模型介绍及应用场景

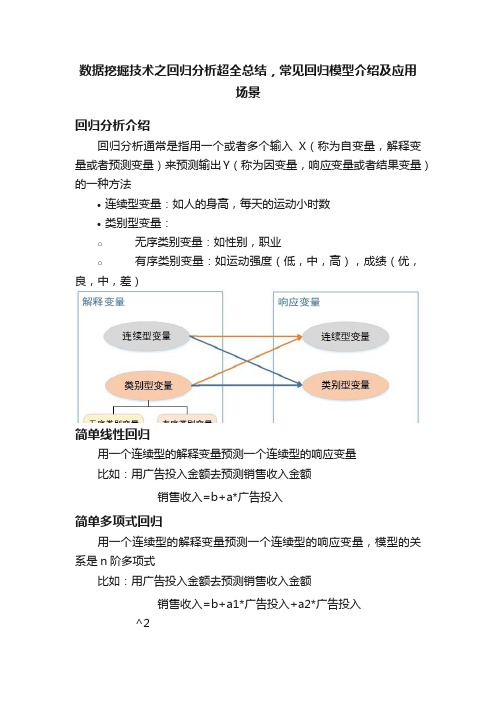

数据挖掘技术之回归分析超全总结,常见回归模型介绍及应用场景回归分析介绍回归分析通常是指用一个或者多个输入X(称为自变量,解释变量或者预测变量)来预测输出Y(称为因变量,响应变量或者结果变量)的一种方法•连续型变量:如人的身高,每天的运动小时数•类别型变量:o无序类别变量:如性别,职业o有序类别变量:如运动强度(低,中,高),成绩(优,良,中,差)简单线性回归用一个连续型的解释变量预测一个连续型的响应变量比如:用广告投入金额去预测销售收入金额销售收入=b+a*广告投入简单多项式回归用一个连续型的解释变量预测一个连续型的响应变量,模型的关系是n阶多项式比如:用广告投入金额去预测销售收入金额销售收入=b+a1*广告投入+a2*广告投入^2多元线性回归用两个或多个连续型的解释变量预测一个连续型的响应变量比如:用风速和当日辐照值去预测光伏电站的发电效率PR发电效率PR=b+a1*风速+a2*当日辐照值多元多项式回归用两个或多个连续型的解释变量预测一个连续型的响应变量,模型的关系是n阶多项式和交叉乘积项比如:用广告投入金额和研发投入金额去预测销售收入金额销售收入=b+a1*广告投入+a2*研发投入+a11*广告投入^2+a22*研发投入^2+a12*广告投入*研发投入多变量回归用一个或者多个解释变量预测多个响应变量Logistic逻辑回归用一个或多个解释变量预测一个类别型响应变量注:Logistic回归的解释变量可以是连续型变量,也可以是类别型变量;响应变量是类别型变量比如:广告的点击率预估问题(二分类问题),图像识别问题(多分类问题)Poison泊松回归用一个或多个解释变量预测一个代表频数的变量Cox比例风险回归用一个或多个解释变量预测一个事件(死亡,失败或者旧病复发)发生的时间。

财务回归分析案例

财务回归分析案例引言在财务领域中,回归分析是一种常用的统计方法,用于研究变量之间的关系。

通过回归分析,我们可以了解一个或多个自变量如何影响因变量,并得出模型的预测能力。

在本文中,我们将介绍一个财务回归分析的案例,以帮助读者更好地理解该方法在实际应用中的作用。

数据收集首先,我们需要收集相关的数据以进行财务回归分析。

在这个案例中,我们将使用一家零售公司的销售数据作为例子。

我们将收集以下数据:1.每个月的销售额(因变量)2.广告费用3.促销费用4.人力资源费用5.物流费用这些数据将帮助我们了解不同因素对销售额的影响,并建立一个回归模型来预测销售额。

数据处理在进行回归分析之前,我们需要对数据进行一些处理。

首先,我们需要将数据进行清洗,删除不完整或错误的数据。

然后,我们可以计算各个自变量之间的相关性,以确定是否存在多重共线性的问题。

如果存在多重共线性,我们需要考虑删除一些自变量或使用其他方法来解决该问题。

回归模型建立在确定了自变量和因变量之后,我们可以建立回归模型来分析它们之间的关系。

在本案例中,我们将使用多元线性回归模型来分析销售额与广告费用、促销费用、人力资源费用和物流费用之间的关系。

回归模型的基本形式如下:销售额= β0 + β1 * 广告费用+ β2 * 促销费用+ β3 * 人力资源费用+ β4 *物流费用+ ε其中,β0、β1、β2、β3、β4为回归系数,ε为误差项。

通过最小二乘法估计回归系数,我们可以得出模型的预测能力。

回归模型分析在得到回归模型后,我们可以进行一些分析以评估模型的有效性。

首先,我们需要评估模型的拟合程度,即模型对观察数据的解释能力。

常用的评价指标包括决定系数(R2)和调整决定系数(adj-R2)。

较高的决定系数表示模型能够较好地解释数据的变异性。

然后,我们可以通过t检验或F检验来判断自变量是否具有显著影响。

统计学上,显著性是指一个变量或模型与随机变量是显著不同的。

如果自变量的p值小于设定的显著性水平(通常为0.05),则可以得出该变量对因变量的影响是显著的。

回归分析的基本原理和应用

回归分析的基本原理和应用回归分析是一种用于探究变量之间关系的统计分析方法。

它能够通过建立一个数学模型,来预测依赖变量(因变量)与一个或多个自变量之间的关系。

本文将介绍回归分析的基本原理和应用。

一、回归分析的基本原理回归分析的基本原理是建立一个数学模型来描述因变量(Y)和自变量(X)之间的关系。

最常用的回归模型是线性回归模型,它假设因变量和自变量之间存在线性关系。

线性回归模型的表示可以用下面的公式表示:Y = β0 + β1X1 + β2X2 + ... + βnXn + ε其中,Y表示因变量,X1至Xn表示自变量,β0至βn表示回归系数,ε表示误差。

回归分析的目标是估计回归系数,以及判断自变量对因变量的影响程度和统计显著性。

其中,最常用的估计方法是最小二乘法,它通过最小化预测值与观测值之间的误差平方和,来确定回归系数的值。

二、回归分析的应用回归分析在实际应用中具有广泛的应用领域。

下面将介绍几个常见的应用例子:1. 经济学应用:回归分析在经济学中被广泛用于研究经济现象和预测经济变量。

例如,可以通过回归分析来研究GDP与失业率之间的关系,以及利率对投资的影响。

2. 市场营销应用:在市场营销领域,回归分析可以帮助分析市场数据和顾客行为,从而制定有效的营销策略。

例如,可以通过回归分析来研究广告投入与销售额之间的关系,以及定价对市场需求的影响。

3. 医学研究应用:回归分析在医学研究中被用于研究疾病的风险因素和治疗效果。

例如,可以通过回归分析来研究吸烟与肺癌之间的关系,以及药物治疗对患者康复的影响。

4. 社会科学应用:在社会科学领域,回归分析可以帮助研究人类行为和社会现象。

例如,可以通过回归分析来研究教育水平与收入之间的关系,以及人口结构对犯罪率的影响。

总结:回归分析是一种重要的统计分析方法,可以用于探究变量之间的关系。

它的基本原理是建立一个数学模型来描述因变量和自变量之间的关系。

在实际应用中,回归分析被广泛用于经济学、市场营销、医学研究等领域。

浅析线性回归分析法在农业生产中的应用

浅析线性回归分析法在农业生产中的应用

线性回归分析法是现代统计分析方法之一,在农业方面应用广泛。

线性回归分析通过对农业生产实际中的环境因素及其与产量之间的关系,分析农业生产的趋势,以优化农业生产中的各种要素,发挥更加有效实用的作用。

在线性回归分析中,主要是以变量(即指标)之间的关系为构成,可以构建出一个模型,用以预测未来的趋势及农作物的产量,以指导农业生产并保证未来的稳定。

比如,利用线性回归分析可以解析农田土壤质量、水质、土壤温度、日照长度、天气情况、施肥量等与农作物产量之间的关系,从而根据特定地块上某种作物的实际情况,预测预期的收成,并籍此分析各因素对本地作物的重要性,以最大化的提高农作物的产量。

另一方面,线性回归也可以用来分析农药的有效性与残留量之间的关系,如根据不同条件下施药量和残留量间的关系,确定施药量及施用时机,减少农药的残留量,以降低药物在环境中的负面影响,保护自然环境。

总之,线性回归分析法可以指导农业生产,分析与生产产出有关变量之间的联系,从而优化农作物的增产。

想要实现这一目标,增产措施必须有效地采用,从而改善农业生产状况。

回归分析方法及其应用中的例子

回归分析方法及其应用中的例子回归分析是一种统计分析方法,用于研究自变量与因变量之间的关系。

它可以通过建立一个数学模型来描述自变量与因变量之间的函数关系,并根据已有的数据对模型进行估计、预测和推断。

回归分析可以帮助我们了解变量之间的相关性、预测未来的结果以及找出主要影响因素等。

在实际应用中,回归分析有许多种方法和技术,下面将介绍其中的几种常见方法及其应用的例子。

1.简单线性回归:简单线性回归是一种最基本的回归分析方法,用于研究两个变量之间的关系。

它的数学模型可以表示为y=β0+β1x,其中y是因变量,x是自变量,β0和β1是常数。

简单线性回归可以用于预测一个变量对另一个变量的影响,例如预测销售额对广告投入的影响。

2.多元线性回归:多元线性回归是在简单线性回归的基础上引入多个自变量的模型。

它可以用于分析多个因素对一个因变量的影响,并以此预测因变量的取值。

例如,可以使用多元线性回归分析房屋价格与大小、位置、年龄等因素之间的关系。

3.逻辑回归:逻辑回归是一种用于预测二元结果的回归方法。

它可以将自变量与因变量之间的关系转化为一个概率模型,用于预测一些事件发生的概率。

逻辑回归常常应用于生物医学研究中,如预测疾病的发生概率或患者的生存率等。

4.多项式回归:多项式回归是一种使用多项式函数来拟合数据的方法。

它可以用于解决非线性关系的回归问题,例如拟合二次曲线或曲线拟合。

多项式回归可以应用于多个领域,如工程学中的曲线拟合、经济学中的生产函数拟合等。

5.线性混合效应模型:线性混合效应模型是一种用于分析包含随机效应的回归模型。

它可以同时考虑个体之间和个体内的变异,并在模型中引入随机效应来解释这种变异。

线性混合效应模型常被用于分析面板数据、重复测量数据等,例如研究不同学生在不同学校的学习成绩。

以上只是回归分析的一些常见方法及其应用的例子,实际上回归分析方法和应用还有很多其他的变种和扩展,可以根据具体问题和数据的特点选择适合的回归模型。

回归分析在数学建模中的应用

回归分析在数学建模中的应用回归分析是一种统计分析方法,用于研究自变量和因变量之间的关系。

它可以用于在数学建模中预测和解释变量之间的关系。

在本文中,我将讨论回归分析在数学建模中的应用以及其在解决实际问题中的重要性。

回归分析有两种主要类型:简单线性回归和多元线性回归。

简单线性回归是指只有一个自变量和一个因变量之间的关系,而多元线性回归是指有多个自变量和一个因变量之间的关系。

无论是简单线性回归还是多元线性回归,都可以用于预测和解释变量之间的关系。

在数学建模中,回归分析可以用于预测未知值。

通过分析一组已知的自变量和因变量之间的关系,可以建立一个数学模型,以便预测因变量的值。

这种预测能力可以在许多领域中得到应用,例如经济学、金融学、社会科学等。

举一个简单的例子,假设我们要建立一个模型来预测一个人的身高。

我们可以收集一组数据,包括自变量(例如年龄、性别、父母身高等)和因变量(身高)。

然后,我们可以使用回归分析来建立一个模型,以便根据给定的自变量来预测一个人的身高。

此外,回归分析还可以用来解释变量之间的关系。

通过分析已知的自变量和因变量之间的关系,可以得出结论,了解自变量对因变量的影响程度。

这对于解决实际问题非常重要。

例如,在经济学中,回归分析可以用来解释消费者支出与收入之间的关系。

通过分析已知的收入和消费者支出数据,可以得出结论,了解收入对消费者支出的影响程度。

这有助于制定经济政策和预测市场需求。

回归分析还可以用来评估自变量之间的相互作用。

在多元线性回归中,我们可以引入交互项,以考虑自变量之间的相互影响。

通过分析已知的自变量和因变量之间的关系,可以确定自变量之间的相互作用,并加以解释。

总的来说,回归分析在数学建模中有广泛的应用。

它可以用于预测和解释变量之间的关系,评估自变量之间的相互作用,解释因变量的变化程度,并评估模型的拟合程度。

回归分析在解决实际问题中起着重要的作用,帮助我们从数据中提取有价值的信息,并进行合理的预测和解释。

一元线性回归分析案例

数学3——统计内容

再冷的石头,坐上三年也会暖 !

1. 画散点图

2. 了解最小二乘法的思想

3. 求回归直线方程

y=bx+a

4. 用回归直线方程解决应用问题

课题:选修2-3 8.5 回归分析案例

复习 变量之间的两种关系

再冷的石头,坐上三年也会暖 !

问题1:正方形的面积y与正方形的边长x之间

选修2-3——统计案例

5. 引入线性回归模型

y=bx+a+e

6. 了解模型中随机误差项e产 生的原因

7. 了解相关指数 R2 和模型拟 合的效果之间的关系

8. 了解残差图的作用 9. 利用线性回归模型解决一类

非线性回归问题 10. 正确理解分析方法与结果

课题:选修2-3 8.5 回归分析案例

再冷的石头,坐上三年也会暖 !

课题:选修2-3 8.5 回归分析案例

解:(1)列出下表,并计算

再冷的石头,坐上三年也会暖 !

i

1

2

3

4

5

6

7

8

9

10

xi 104 180 190 177 147 134 150 191 204 121 yi 100 200 210 185 155 135 170 205 235 125 xiyi 10400 36000 39900 32745 22785 18090 25500 39155 47940 15125

现实生活中存在着大量的相关关系。 如:人的身高与年龄; 产品的成本与生产数量; 商品的销售额与广告费; 家庭的支出与收入。等等

探索:水稻产量y与施肥量x之间大致有何规 律?

课题:选修2-3 8.5 回归分析案例

回归分析的原理和应用

回归分析的原理和应用1. 回归分析的基本概念回归分析是一种通过建立数学模型来探究两个或多个变量之间关系的方法。

它的主要目的是了解因变量(响应变量)如何随着自变量变化而变化。

回归分析通过寻找最佳拟合线或曲线,以最小化观测值和预测值之间的差异,并预测新的观测值。

2. 简单线性回归简单线性回归是最基本的回归分析方法之一,它用于探究两个变量之间的线性关系。

在简单线性回归中,只有一个自变量和一个因变量。

该方法假定自变量和因变量之间存在线性关系,并通过最小二乘法来拟合一条直线。

拟合出的直线可以用来预测新的因变量取值。

3. 多元线性回归多元线性回归是在简单线性回归的基础上扩展出来的,它允许有多个自变量。

多元线性回归的主要思想是通过最小化残差平方和来找到最佳拟合函数。

该方法可以帮助我们探究多个自变量对因变量的影响,并进行预测和解释。

4. 回归分析的应用领域回归分析在许多领域都有广泛的应用。

以下是一些常见领域的例子:•经济学:回归分析可以用来研究经济变量之间的关系,如GDP与失业率之间的关系。

•医学研究:回归分析可以用来研究药物剂量与治疗效果之间的关系,或者研究某种特征与疾病发病率的关系。

•社会科学:回归分析可以用来研究教育水平与收入之间的关系,或者研究人口变量与犯罪率之间的关系。

•金融领域:回归分析可以用来研究股票价格与市场指数之间的关系,或者研究利率与债券价格之间的关系。

5. 回归分析的步骤进行回归分析通常需要以下步骤:1.收集数据:收集自变量和因变量的数据,可以通过实验、调查或观测等方式获取。

2.数据清洗:对收集到的数据进行清洗,包括处理缺失值、异常值和离群值等。

3.模型选择:根据研究目的和数据特点,选择合适的回归模型,如简单线性回归或多元线性回归。

4.拟合模型:使用最小二乘法或其他拟合方法,拟合出最佳的回归方程。

5.模型评估:对拟合出的模型进行评估,包括判断模型的拟合优度和统计显著性,通过残差分析检验模型的假设。

多元回归分析原理及例子

多元回归分析原理及例子1.建立回归方程:多元回归分析的第一步是建立回归方程。

回归方程是一个数学模型,用于描述自变量与因变量之间的关系。

回归方程的形式可以是线性的或非线性的,取决于具体的问题和数据。

2.评估回归系数:回归方程中的回归系数表示自变量对因变量的影响程度。

通过估计回归系数,可以确定每个自变量对因变量的相对重要性。

通常使用最小二乘法来估计回归系数,使得回归方程的拟合值与观测值之间的残差最小化。

3.检验模型拟合度:在多元回归分析中,有几个统计指标可用于衡量回归模型的拟合度,如R方值、F统计量和调整的R方值等。

这些指标可以用来评估回归方程的拟合优度和统计显著性。

4.进行预测和推断:通过建立回归方程,可以进行因变量的预测和对自变量的影响进行推断。

预测可以基于已知的自变量值来进行,而推断可以通过比较不同自变量值的回归系数来得出。

下面将给出一个例子来说明多元回归分析的应用。

假设我们有一个数据集,其中包含汽车的价格(因变量)和汽车的尺寸、重量和马力(自变量)。

我们希望通过多元回归分析来了解这些自变量对汽车价格的影响。

首先,我们建立一个多元回归方程来描述汽车价格与尺寸、重量和马力之间的关系:价格=β0+β1*尺寸+β2*重量+β3*马力其中β0、β1、β2和β3分别是回归方程的截距和回归系数。

然后,我们使用最小二乘法来估计回归系数,并通过评估模型的拟合度来确定回归模型的质量。

例如,可以计算出R方值,它代表因变量的变异程度可以由自变量解释的比例。

较高的R方值表示更好的拟合度。

在完成模型拟合后,我们可以使用回归方程进行预测。

例如,如果我们知道一辆汽车的尺寸、重量和马力,我们可以使用回归方程来预测其价格。

此外,通过比较回归系数的大小,我们可以确定哪个自变量对汽车价格的影响最大。

总之,多元回归分析是一种强大的统计方法,可以帮助我们研究多个自变量对一个因变量的影响。

它可以应用于各种领域,如经济学、社会学、医学和工程等,以解释和预测变量之间的关系。

回归中的自相关案例

回归中的自相关案例

就比如说,你在研究一个城市里冰淇淋的销量和气温的关系。

正常情况下呢,气温越高,冰淇淋销量就越高,这是个很合理的回归关系。

但是呢,这里面可能存在自相关的情况。

假设你每天统计冰淇淋销量和气温,但是你没注意到,这个城市有个特别的节日,这个节日的时候呢,不管气温咋样,大家都爱买冰淇淋,而且这个节日是每过几天就有一次。

这样一来,你会发现,相邻几天的数据就不是那种单纯由气温影响冰淇淋销量了。

比如说,节日前一天和节日当天的销量可能都很高,这就产生了一种自相关,就是数据自己和自己相邻的数据有特殊的联系,而不是按照气温这个因素单纯变化了。

再比如说,研究股票价格和公司盈利的回归关系。

公司盈利按理说应该对股票价格有影响。

可是呢,股市里投资者的情绪有时候会像传染病一样。

如果某一天股票因为一些小道消息突然涨了,投资者就会变得很兴奋,第二天即使公司盈利没有新的变化,股票价格还是可能继续涨,因为前一天的涨势影响了投资者的情绪,让他们继续买入,这就导致了股票价格数据存在自相关,不是单纯按照公司盈利来走了。

又像研究一个小区里用水量和水费单价的关系。

正常水费单价越高,用水量理论上会减少。

但是呢,如果这个小区最近在搞一个节水比赛,大家互相影响,这个月看到邻居节水很厉害,下个月自己也更努力节水,这样用水量的数据就会出现自相关。

可能这个月用水量少不是因为水费单价,而是因为邻居节水带来的这种互相影响的连锁反应。

这就是回归分析里自相关捣乱的一些例子啦。

r语言lasso回归应用实例

r语言lasso回归应用实例以R语言lasso回归应用实例为标题的文章引言在现代统计学中,回归分析是一种常用的方法,用于研究自变量与因变量之间的关系。

然而,传统的回归分析方法在处理高维数据时面临一些挑战,例如变量选择和模型解释的困难。

为了解决这些问题,lasso回归成为了一种流行的方法。

本文将介绍使用R语言进行lasso回归分析的应用实例。

数据准备我们需要准备一个数据集,以便进行lasso回归分析。

我们使用R 语言内置的mtcars数据集作为示例。

该数据集包含了32辆汽车的11个变量,包括汽车的性能指标和特征。

数据预处理在进行回归分析之前,我们需要对数据进行一些预处理操作。

首先,我们将数据集分为自变量和因变量。

在这个例子中,我们将mpg (每加仑行驶的英里数)作为因变量,将其他变量作为自变量。

```# 导入数据集data(mtcars)# 将mpg作为因变量,其他变量作为自变量X <- as.matrix(mtcars[, -1])Y <- mtcars[, 1]```Lasso回归分析接下来,我们使用R语言中的glmnet包进行lasso回归分析。

glmnet包是一个用于普通线性模型和广义线性模型的R软件包,支持lasso回归分析。

在这个例子中,我们使用默认的alpha参数值,即1,表示lasso回归。

我们使用交叉验证来选择最优的lambda参数值。

```# 导入glmnet包library(glmnet)# 使用默认的alpha参数值进行lasso回归分析lasso_model <- glmnet(X, Y, alpha = 1)# 使用交叉验证选择最优的lambda参数值cv_model <- cv.glmnet(X, Y, alpha = 1)```结果解读通过运行上述代码,我们得到了lasso回归分析的结果。

我们可以通过以下步骤来解读结果。

1. 可视化lambda和对应的系数收缩路径。

多元回归分析原理及例子

多元回归分析原理回归分析是一种处理变量的统计相关关系的一种数理统计方法。

回归分析的基本思想是: 虽然自变量和因变量之间没有严格的、确定性的函数关系, 但可以设法找出最能代表它们之间关系的数学表达形式。

回归分析主要解决以下几个方面的问题:(1) 确定几个特定的变量之间是否存在相关关系, 如果存在的话, 找出它们之间合适的数学表达式; (2) 根据一个或几个变量的值, 预测或控制另一个变量的取值, 并且可以知道这种预测或控制能达到什么样的精确度;(3) 进行因素分析。

例如在对于共同影响一个变量的许多变量(因素)之间, 找出哪些是重要因素, 哪些是次要因素, 这些因素之间又有什么关系等等。

回归分析有很广泛的应用, 例如实验数据的一般处理, 经验公式的求得, 因素分析, 产品质量的控制, 气象及地震预报, 自动控制中数学模型的制定等等。

多元回归分析是研究多个变量之间关系的回归分析方法, 按因变量和自变量的数量对应关系可划分为一个因变量对多个自变量的回归分析(简称为“一对多”回归分析)及多个因变量对多个自变量的回归分析(简称为“多对多”回归分析), 按回归模型类型可划分为线性回归分析和非线性回归分析。

本“多元回归分析原理”是针对均匀设计3.00软件的使用而编制的, 它不是多元回归分析的全面内容, 欲了解多元回归分析的其他内容请参阅回归分析方面的书籍。

本部分内容分七个部分, §1~§4介绍“一对多”线性回归分析, 包括数学模型、回归系数估计、回归方程及回归系数的显著性检验、逐步回归分析方法。

“一对多”线性回归分析是多元回归分析的基础, “多对多”回归分析的内容与“一对多”的相应内容类似, §5介绍“多对多”线性回归的数学模型,§6介绍“多对多”回归的双重筛选逐步回归法。

§7简要介绍非线性回归分析。

§1 一对多线性回归分析的数学模型§2 回归系数的最小二乘估计§3 回归方程及回归系数的显著性检验§4 逐步回归分析§5 多对多线性回归数学模型§6 双重筛选逐步回归§7 非线性回归模型§1 一对多线性回归分析的数学模型设随机变量与个自变量存在线性关系:, (1.1)(1.1)式称为回归方程, 式中为回归系数,为随机误差。

逐步回归分析法及其应用

逐步回归分析法及其应用逐步回归分析法是一种广泛应用于统计学和数据分析领域的统计技术,它被用来探索变量之间的关系,以及预测和解释数据的模式。

逐步回归分析法通过逐步添加变量和移除变量,找到最优的变量组合来解释因变量,同时使模型的复杂性最小化。

本文将介绍逐步回归分析法的基本原理、应用场景、案例分析以及需要注意的事项。

逐步回归分析法的基本原理逐步回归分析法基于最小二乘回归,通过向前逐步添加变量和向后逐步移除变量来建立最优的回归模型。

它通过构造一个评价函数,如AIC (Akaike Information Criterion)或BIC (Bayesian Information Criterion),来评估模型的复杂度和拟合度。

逐步回归分析法的目标是找到一个既能解释因变量又能使模型复杂性最小的最优模型。

应用场景逐步回归分析法适用于多种数据分析和统计学应用场景,例如:因果分析:通过逐步回归分析法,可以找出哪些自变量对因变量有显著影响,以及它们的影响程度。

特征选择:在处理高维数据时,逐步回归分析法可以用来选择最重要的特征,以便构建更有效的模型。

时间序列预测:通过逐步回归分析法,可以建立时间序列预测模型,预测未来的趋势和变化。

案例分析以一个实际的例子来说明逐步回归分析法的应用。

假设我们有一个数据集包含了汽车的各项性能指标(如马力、油耗、车重等)和汽车的销售价格。

我们想知道哪些性能指标最能影响汽车的销售价格。

我们使用逐步回归分析法建立一个价格预测模型。

通过向前逐步添加变量和向后逐步移除变量,我们最终找到了一个最优模型,该模型仅包含两个变量:马力(Horsepower)和车重(Weight)。

这个模型告诉我们,汽车的马力越大、车重越轻,销售价格就越高。

接下来,我们使用残差和斜率进一步分析这个模型。

残差是实际值与模型预测值之间的差异,斜率是因变量对自变量的变化率。

通过观察残差和斜率,我们可以得出以下马力对价格的影响比车重更大,因为马力的斜率大于车重的斜率。

回归分析的例子

回归分析是一种用于研究变量之间关系的统计方法。通过分析数据,我们可 以找到变量之间的相关性,并预测未来的趋势和结果。

回归分析的意义

回归分析可以帮助我们理解变量之ห้องสมุดไป่ตู้的关系,并进行预测和决策。它可以应用于各个领域,如经济学、市场营 销、医学等,为我们提供有关变量之间关系的重要见解。

回归分析的基本概念

通过分析残差、确定系数等指标,评估 回归模型的拟合程度和精确度。

简单线性回归的例子

房价预测

使用房屋面积作为自变量,预测房屋价格的例子。

学生成绩预测

使用学习时间作为自变量,预测学生考试成绩的例 子。

多元线性回归的例子

销售额预测

使用广告投入、促销活动和竞争对手销售额作为自变量,预测销售额的例子。

体重预测

1 自变量(X)

独立变量,用于预测因变量的值。

2 因变量(Y)

受自变量影响的变量,我们尝试预测或解释其值。

3 回归方程

用于描述自变量和因变量之间关系的数学方程。

回归分析的步骤

1

收集数据

收集需要分析的自变量和因变量的相关

拟合回归模型

2

数据。

选择合适的回归模型,使用统计方法来

估计回归方程中的参数。

3

评估模型

使用身高、性别和年龄作为自变量,预测体重的例子。

股票价格预测

使用市场指数、公司盈利和行业数据作为自变量,预测股票价格的例子。

回归分析的应用场景

1 市场研究

预测产品销售量或市场份 额。

2 金融风险管理

预测贷款违约的可能性。

3 医学研究

预测疾病发展风险或药物 疗效。

结论和总结

回归分析是一种有力的工具,可以揭示变量之间的关系。通过合适的数据收集和建模,我们可以从数据中获得 有价值的见解,并做出准确的预测和决策。

回归分析方法应用实例

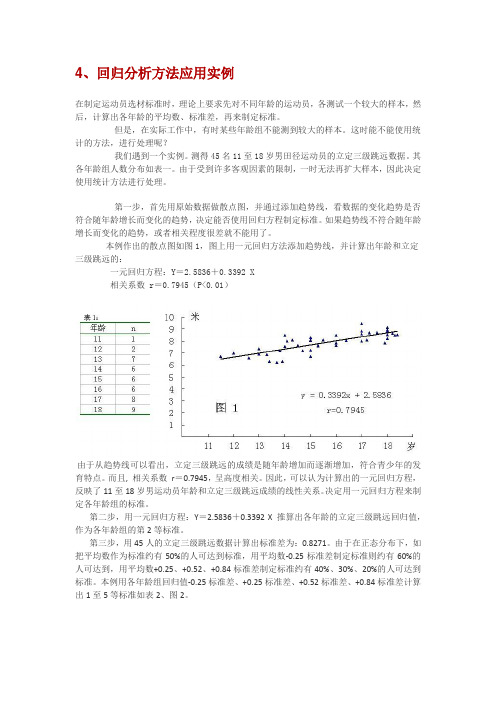

4、回归分析方法应用实例在制定运动员选材标准时,理论上要求先对不同年龄的运动员,各测试一个较大的样本,然后,计算出各年龄的平均数、标准差,再来制定标准。

但是,在实际工作中,有时某些年龄组不能测到较大的样本。

这时能不能使用统计的方法,进行处理呢?我们遇到一个实例。

测得45名11至18岁男田径运动员的立定三级跳远数据。

其各年龄组人数分布如表一。

由于受到许多客观因素的限制,一时无法再扩大样本,因此决定使用统计方法进行处理。

第一步,首先用原始数据做散点图,并通过添加趋势线,看数据的变化趋势是否符合随年龄增长而变化的趋势,决定能否使用回归方程制定标准。

如果趋势线不符合随年龄增长而变化的趋势,或者相关程度很差就不能用了。

本例作出的散点图如图1,图上用一元回归方法添加趋势线,并计算出年龄和立定三级跳远的:一元回归方程:Y=2.5836+0.3392 X相关系数 r=0.7945(P<0.01)由于从趋势线可以看出,立定三级跳远的成绩是随年龄增加而逐渐增加,符合青少年的发育特点。

而且, 相关系数r=0.7945,呈高度相关。

因此,可以认为计算出的一元回归方程,反映了11至18岁男运动员年龄和立定三级跳远成绩的线性关系。

决定用一元回归方程来制定各年龄组的标准。

第二步,用一元回归方程:Y=2.5836+0.3392 X 推算出各年龄的立定三级跳远回归值,作为各年龄组的第2等标准。

第三步,用45人的立定三级跳远数据计算出标准差为:0.8271。

由于在正态分布下,如把平均数作为标准约有50%的人可达到标准,用平均数-0.25标准差制定标准则约有60%的人可达到,用平均数+0.25、+0.52、+0.84标准差制定标准约有40%、30%、20%的人可达到标准。

本例用各年龄组回归值-0.25标准差、+0.25标准差、+0.52标准差、+0.84标准差计算出1至5等标准如表2、图2。

2、应用方差分析方法进行数据统计分析的研究。

回归分析在公司财务分析与预测中的应用

回归分析在公司财务分析与预测中的应用【摘要】回归分析在公司财务分析与预测中的应用是一种重要的数据分析方法。

通过回归分析的基本原理,可以帮助公司识别财务数据之间的关联性,并预测未来的趋势。

在公司财务分析中,回归分析方法广泛应用于确定关键的财务指标之间的相互影响。

在进行财务预测时,回归分析可以帮助公司制定准确的预算和战略规划。

通过案例分析,可以看到回归分析在实际应用中的效果。

风险管理与回归分析的结合也可以降低公司在财务决策中的风险。

回归分析在公司财务分析与预测中的重要性不言而喻,未来发展趋势也将更加智能化和精准化。

回归分析在公司财务管理中扮演着至关重要的角色,有助于公司做出精准的决策和规划。

【关键词】回归分析、公司财务、分析、预测、应用、基本原理、方法、案例分析、风险管理、重要性、未来发展趋势、总结1. 引言1.1 回归分析在公司财务分析与预测中的应用回归分析是一种统计学方法,用于分析变量之间的关系并进行预测。

在公司财务领域,回归分析被广泛应用于财务分析和预测中,帮助企业了解业务运营的趋势和预测未来的财务表现。

回归分析的主要原理是通过建立一个数学模型来描述不同变量之间的关系。

在公司财务分析中,回归分析可以帮助企业确定不同因素对财务表现的影响程度,找到关键的影响因素,从而制定更有针对性的经营策略。

在公司财务预测中,回归分析可以帮助企业预测未来的财务表现,提前发现可能存在的问题并采取相应的措施。

通过建立回归模型,企业可以更准确地预测销售额、利润、资产负债等财务指标,为未来的决策提供依据。

回归分析在公司财务分析与预测中的应用是非常重要的。

它不仅可以帮助企业深入了解自身的财务状况,还可以帮助企业在竞争激烈的市场环境中更好地发展和成长。

通过合理地运用回归分析,企业可以更好地把握商机、降低风险、提高效益,实现可持续发展。

2. 正文2.1 回归分析的基本原理回归分析是一种统计学方法,用于研究一组变量之间的关系。

在公司财务分析和预测中,回归分析可以帮助分析师了解各种财务指标之间的相互影响,以及它们与公司业绩之间的关联。

回归分析算法在预测中的应用

回归分析算法在预测中的应用随着数据科学的兴起,回归分析成为了预测问题中重要的技术。

回归分析通过对过去数据的模式进行分析,找出这些模式的特征,从而预测未来数据的走势。

在本文中,我们将探讨回归分析算法在预测中的应用。

一、回归分析算法的基本原理回归分析是一种用于统计建模的技术,其基本原理是建立一个函数,将一组自变量与因变量联系起来。

通过这个函数,我们可以预测因变量的值。

在回归分析中,常用的函数类型有线性函数、多项式函数、指数函数等。

回归分析的目标是建立一个准确的函数,将自变量与因变量之间的关系描述得尽可能准确。

为了达到这个目的,我们需要寻找最佳的函数形式和参数。

这个过程称为回归分析的“拟合”。

林回归是一种常用的回归分析算法。

在基本原理上,它假设自变量与因变量之间的关系是线性的,即y=β0+β1x。

我们通过对过去数据进行拟合,估计出β0和β1的值,从而构建出预测模型。

二、回归分析算法的优势和不足回归分析算法的主要优势在于它能够在仅有少量数据时进行预测,从而大大缩短预测模型的训练时间。

此外,回归分析算法还可以通过图形化展示模型,让人们更直观地理解数据之间的关系。

然而,回归分析算法也存在着一些不足。

首先,它只能处理单变量或少量自变量的情况,无法处理大规模变量之间的关系。

其次,回归分析算法对数据的质量和数量要求较高,当数据存在缺失或异常值时,结果会受到很大的干扰。

三、回归分析算法在实际应用中的例子回归分析算法在实际应用中非常广泛。

以下是一些应用案例:1、销售预测回归分析可以用来预测产品或服务的销售量。

通过历史销售数据和市场趋势,我们可以构建出一个销售预测模型,从而为公司的生产和销售提供指导。

2、股票价格预测回归分析可以用来预测股票价格的波动。

通过分析历史股票市场的模式,我们可以估计未来股票价格的走势,从而为投资者提供决策支持。

3、医学预测回归分析可以用来预测某些疾病的发生风险。

通过分析患者的基本信息、生物指标和遗传信息等因素,我们可以构建出一个预测模型,从而为医生判断患者的健康状况提供支持。

线性回归算法在日常生活中的应用2000字

线性回归算法在日常生活中的应用2000字随着时代的发展,线性回归算法(Linear Regression Algorithm)已经被广泛应用于日常生活中。

是目前最常使用的统计学方法之一,它用于探索两种或多种变量之间的关系,可以通过使用自动机器学习、统计软件或Excel文件等方式实现。

例如,当我们想要从变量(X)中预测另一个变量(Y)时,可以使用线性回归分析来实现。

线性回归算法在日常生活中的应用非常广泛,可以在许多不同领域中找到它的踪迹。

一个典型的例子是经济领域,经济学家通常会使用线性回归模型来探测消费者的支出行为,研究不同国家的GDP,或者研究投资者如何受到政治变化的影响等等。

此外,线性回归也可以用于市场营销和心理学研究。

场营销领域,线性回归可以用来预测市场趋势、选择最有效的营销活动、分析消费者行为以及实现盈利。

心理学研究中,线性回归可以用来了解不同心理因素是如何影响人们的行为,以及如何协调不同心理因素之间的关系。

线性回归算法在健康科学领域中也有着重要作用,例如基于线性回归的统计分析可以用来分析不同患者对不同药物治疗方案的反应,或者分析患者对疾病治疗的效果。

性回归也可以用来分析现有研究资料,以探索不同健康领域的趋势并制定出有效的治疗方案。

线性回归分析也可以用于教育领域,可以用来分析学生的表现如何受到家庭、社会和教育环境的影响,以及学习计划的效果如何。

外,它还可以用于分析学校的政策是否能取得有效的学习效果。

总的来说,线性回归算法在日常生活中发挥着重要作用,它不仅可以用于经济领域、市场营销领域、心理学研究领域以及健康科学领域,也可以用于教育领域。

对消费者、投资人和患者,以及学生和教师都有着重要的意义,使用这个算法,可以帮助我们更好地理解现代社会的运作,分析潜在的趋势,从而使我们的日常生活更加完美、实用。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

3.1.2 虚拟变量的应用例3.1.2.1:为研究美国住房面积的需求,选用3120户家庭为建模样本,回归模型为:123log log P Y βββ++logQ=其中:Q ——3120个样本家庭的年住房面积(平方英尺) 横截面数据P ——家庭所在地的住房单位价格 Y ——家庭收入经计算:0.247log 0.96log P Y -+logy=4.17 20.371R =()() ()上式中2β=0.247-的价格弹性系数,3β=0.96的收入弹性系数,均符合经济学的常识,即价格上升,住房需求下降,收入上升,住房需求也上升。

但白人家庭与黑人家庭对住房的需求量是不一样的,引进虚拟变量D :01i D ⎧=⎨⎩黑人家庭白人家庭或其他家庭模型为:112233log log log log D P D P Y D Y βαβαβα+++++logQ=例3.1.2.2:某省农业生产资料购买力和农民货币收入数据如下:(单位:十亿元)①根据上述数据建立一元线性回归方程:ˆ 1.01610.09357yx =+ 20.8821R = 0.2531y S = 67.3266F = ②带虚拟变量的回归模型,因1979年中国农村政策发生重大变化,引入虚拟变量来反映农村政策的变化。

01i D ⎧=⎨⎩19791979i i <≥年年 建立回归方程为: ˆ0.98550.06920.4945yx D =++ ()() ()20.9498R = 0.1751y S = 75.6895F =虽然上述两个模型都可通过显着性水平检验,但可明显看出带虚拟变量的回归模型其方差解释系数更高,回归的估计误差(y S )更小,说明模型的拟合程度更高,代表性更好。

3.5.4 岭回归的举例说明企业为用户提供的服务多种多样,那么在这些服务中哪些因素更为重要,各因素之间的重要性差异到底有多大,这些都是满意度研究需要首先解决的问题。

国际上比较流行并被实践所验证,比较科学的方法就是利用回归分析确定客户对不同服务因素的需求程度,具体方法如下:假设某电信运营商的服务界面包括了A1……Am 共M 个界面,那么各界面对总体服务满意度A 的影响可以通过以A 为因变量,以A1……Am 为自变量的回归分析,得出不同界面服务对总体A 的影响系数,从而确定各服务界面对A 的影响大小。

同样,A1服务界面可能会有A11……A1n 共N 个因素的影响,那么利用上述方法也可以计算出A11……A1n 对A1的不同影响系数,由此确定A1界面中的重要因素。

通过两个层次的分析,我们不仅得出各大服务界面对客户总体满意度影响的大小以及不同服务界面上各因素的影响程度,同时也可综合得出某一界面某一因素对总体满意度的影响大小,由此再结合用户满意度评价、与竞争对手的比较等因素来确定每个界面细分因素在以后工作改进中的轻重缓急、重要性差异等,从而起到事半功倍的作用。

例 3.5.4:对某地移动通信公司的服务满意度研究中,利用回归方法分析各服务界面对总体满意度的影响。

a. 直接进入法显然,这种方法计算的结果中,C 界面不能通过显着性检验,直接利用分析结果是错误的,见表3.5.4.1:表3.5.4.1 强制回归的Coefficientsb.逐步回归法这种方法剔除了一个不能通过统计检验的大的服务界面(C界面),虽然通过了显着性检验,但却遗漏了C界面的信息。

同样,使用强制删除法,C服务界面不能通过显着性检验,向前法和向后法亦剔除了C 界面进入分析。

可以看出,通过以上回归分析我们得到了不同的分析结果,显然这种分析方法存在着较大的偏差,随意选取一种是不负责任的,必须深入研究。

一般来说,满意度分析中涉及到许多因素,而诸多因素间存在着一定的关联,因而在进行回归分析时,各自变量之间的共线性问题导致了直接使用线性回归分析模型时一些因子不能参与分析的现象。

一些市场研究咨询公司常采用舍弃一些变量,遗漏部分信息来求得统计检验通过的方法;有的不顾显着性检验结果而强行使用不合理的分析结果来保证变量不被舍弃,从而虚假地保障了信息不被遗漏。

我们认为这是满意度分析错误的两个极端。

处理的正确方法是,利用SPSS软件中的岭回归分析来解决,既保障信息不被遗漏,同时保障分析具有统计意义。

SPSS软件界面没有直接进行岭回归的命令,我们可以通过SPSS 提供的程序编辑命令,自行编辑程序加以实现。

在SAS软件中可直接进行岭回归分析。

对例3.5.4.1进行岭回归,分析结果和表的结果对比如下。

可见两者之间有较大差异(下表数据将已将回归系数之和标准化为100%),F界面对总体满意度的作用被缩小了5%左右,而B界面、D界面的作用各被夸大近5%。

表3.5.4.3 强制回归与岭回归结果的比较5 回归分析方法应用的举例说明——怎样作回归分析How本章以一个例子详细说明回归分析方法在实际研究中是如何应用的。

回归分析变量的数据转换本章举例说明的例子选用39家企业样本数据(见表),带动作用是因变量,其余各变量均为自变量,其中所属产业和员工人数是对该样本企业而言,而接触程度则指该样本企业与本地的龙头企业之间在业务上的接触紧密程度。

接触程度、各自变量和因变量均以Likert五分量表进行度量。

表例子的样本数据样本编号所属产业员工人数接触程度企业合作公共事务营销努力技术改进资源共享风险分担带动作用1皮革2301 2皮革1593 3皮革2082 4皮革1121 5皮革1001 6皮革4951 7皮革3338 皮革 80 1 9 皮革 100 3 10 皮革 150 3 11 皮革 136 1 12 皮革 61 3 13 皮革 17 3 14 皮革 230 3 15 家电 300 5 16 家电 250 3 17 家电 80 5 18 家电 134 3 19 家电 428 3 20 家电 80 3 21 家电 400 2 22 家电 20 3 23 家电 225 4 24 家电 180 3 25 家电 90 3 26 家电 160 1 27 家电 100 2 28 家电 350 3 29 家电 345 3 30 家电 305 1 31 家电 400 2 32 家电 100 3 33 家电 414 2 34 家电 324 2 35 家电 300 4 36 家电 200 3 37 家电 85 3 38 家电 180 1 39 家电 415 35.1.1 企业所属产业虚拟变量的引入从表中看到,自变量所属产业为名义变量,在进行多元回归分析之前需要将其转化为虚拟变量进行处理。

而员工人数在一定程度上能够反映企业的规模,因此也将其处理为虚拟变量。

将皮革产业变量定义为变量D 1,则⎩⎨⎧=101D属于皮革产业属于家电产业5.1.2 企业规模虚拟变量的引入首先按照企业员工人数将企业划分为微型、小型、一般型、中型和大型共5种类型企业,具体划分标准见表:表 企业规模的划分和变量说明企业规模小型 中型 大型 员工数 ≤100 >100且≤300 ≥300 变量名D 2 D 3 D 4由此,有:⎩⎨⎧=102D属于小型产业不属于小型产业;⎩⎨⎧=103D 属于中型产业不属于中型产业 当以上D 2、D 3均为0时,则表示该企业属于大型企业。

5.1.3 引入虚拟变量后的变量数据将上述各变量进行转换处理之后,得到本例进行回归分析的各个变量数据,见表:表 回归分析的变量数据编号 皮革行业 小型 中型 接触程度 企业合作 公共事务 营销努力 技术改进 资源共享 风险分担 带动 D 1 D 2 D 3 Tach Coop Publ Mark Tech Reco Risk Effe 1 1 0 1 1 2 1 0 1 3 3 1 0 1 2 4 1 0 1 1 5 1 1 0 1 6 1 0 0 1 7 1 1 0 3 8 1 1 0 1 9 1 1 0 3 10 1 0 1 3 11 1 0 1 1 12 1 1 0 3 13 1 1 0 3 14 1 0 1 3 15 0 0 1 5 16 0 0 1 3 17 0 1 0 5 18 0 0 1 3 19 0 0 0 3 20 0 1 03210002220103230014240013250103260011270102280003290003300001310002320103330002340002350014360013370103380011390003变量间的相关分析5.2.1 相关分析在Spss软件中的操作SPSS的相关分析是借助于Statistics菜单的Correlate选项完成的。

调用此过程可对变量进行相关关系的分析,计算有关的统计指标,以判断变量之间相互关系的密切程度。

调用该过程命令时允许同时输入两变量或以上变量,但系统输出的是变量间两两相关的相关系数。

激活Statistics菜单选Correlate中的Bivariate...命令项,弹出Bivariate Correlation对话框。

在对话框左侧的变量列表中选中本例的所有变量,点击钮使之进入Variables框;再在Correlation Coefficients框中选择相关系数的类型,共有三种:Pearson为通常所指的相关系数(r),Kendell’s tau-b为非参数资料的相关系数,Spearman为非正态分布资料的Pearson 相关系数替代值,本例选用Pearson项;在Test of Significance框中可选相关系数的单侧(One-tailed)或双侧(Two-tailed)检验,本例选双侧检验。

点击Options...钮弹出Bivariate Correlation:Options对话框,可选有关统计项目。

本例要求输出个变量的均值与标准差,故选Means and standard deviations项,而后点击Continue 钮返回Bivariate Correlation对话框,再点击OK钮即可。

5.2.2 相关分析结果及其解释首先看表中,各变量的均值及其标准差:表变量的描述性数据变量均值标准差样本数effe.7998339coop.8825239publ.8702339mark.8288539tech.6230739reco.8763739risk.8062439D1.3590.4859739D2.3333.4775739D3.4103.4983139tach39由于举本例的目的是为了详细解释在SPSS中如何进行回归分析,所以在本文中不详细论述与本主体关系不大的各项分析及其结论。

在表中,详细列出了所有变量之间的两两相关系数:表变量的相关系数及其显着性effe coop publ mark tech reco risk D1D2D3tach effe1coop.377(*)1publ.385(*).607(**)1mark.410(**).387(*).382(*)1tech.438(**).398(*).617(**).3131reco.709(**).502(**).376(*).174.324(*)1risk.731(**).257.322(*).210.265.659(**)1D1(*)1D2.092.204.017.000.000.017.1511D3.006.070.063.042.137(**)1tach.397(*).162.212.064.349(*).187.304(*).1261 * 相关系数在水平下显着(双尾)** 相关系数在水平下显着(双尾)从表中看到,因变量effe分别与自变量coop、publ、mark、tech、reco、risk、D1和tach 之间的相关系数在水平下是显着的,而与自变量D2和D3之间的相关系数在水平下不显着。