粒子群算法基本思想

mpso算法原理

mpso算法原理MPSO算法原理什么是MP 算法MP(Multiparticle Particle Swarm Optimization)算法是一种优化算法,它基于粒子群优化(PSO)的思想,通过引入多个粒子来增强算法的性能和鲁棒性。

MP算法是一种经典的群体智能算法,已经被广泛应用于优化问题的求解。

粒子群优化(PSO)的简介粒子群优化是一种模拟自然界群体行为的优化算法。

其基本思想是通过模拟群体中粒子的社会行为,寻找最优解。

每个粒子表示一个潜在的解,它通过自身的经验和群体的协作来搜索最优解。

粒子在解空间中移动,通过更新速度和位置来进行搜索。

粒子群优化算法主要包含三个步骤: 1. 初始化:随机生成粒子的位置和速度。

2. 更新:根据当前位置和速度计算粒子的新速度和新位置。

3. 评估:利用目标函数对粒子的新位置进行评估,并更新最优解。

MPSO算法的原理MP算法在粒子群优化算法的基础上进行了改进,引入了多个粒子来增强算法的性能。

下面是MPSO算法的主要原理:1.初始化:随机生成多个粒子的位置和速度。

2.更新全局最优解:根据当前最优解和个体最优解,更新全局最优解。

3.更新速度和位置:根据当前位置、速度和最优解,计算粒子的新速度和新位置。

4.评估:利用目标函数对粒子的新位置进行评估,并更新个体最优解。

5.收敛判断:判断是否达到停止迭代的条件,如果没有,则回到第2步继续迭代。

MPSO算法通过引入多个粒子,增加了算法的搜索空间和搜索能力。

不同粒子之间可以通过信息共享来加快收敛速度,并提高最优解的质量。

通过迭代更新位置和速度,算法逐渐向最优解靠近,最终找到全局最优解。

MPSO算法的优缺点MPSO算法相比于传统的PSO算法具有以下优点: - 收敛速度更快:多个粒子的协作可以加快算法的收敛速度。

- 最优解质量更高:多个粒子可以搜索更多的解空间,找到更好的解。

然而,MPSO算法也存在一些缺点: - 参数设置较为困难:由于引入了多个粒子,MPSO算法的参数需要更加精细地调整,否则可能影响算法的性能。

粒子群优化算法(PSO)

我们采用遗传算法的思想解决。 (1)w*v项可看作是一种变异操作。 (2)c1*(pbest-x) + c2*(gbest-x) 项可看作是一种 交叉操作。

交叉与变异

交叉: P1=(1 2 | 3 4 5 6 | 7 8 9) P2=(9 8 | 7 6 5 4 | 3 2 1) Q1=(1 2 | 7 6 5 4 | 3 8 9) Q2=(9 8 | 3 4 5 6 | 7 2 1) R=(1 2 | 3 4 5 6 | 7 8 9) S=(1 2 | 6 5 4 3 | 7 8 9)

756 4953

遗传算法 1.6s 28.1s 154.6s 200.6s 215.0s

567 3842

粒子群优化 0.016s 0.578s 31.9s 56.1s 73.9s

538 2579

时间分析

性能比较

模拟退火

遗传算法

粒子群优化

研究方向

• (1) 算法分析。PSO在实际应用中被证明是有效的, 但目前 还没有给出完整收敛性、收敛速度估计等方面的数学证明, 已有的工作还远远不够。 • (2) 参数选择与优化。参数w、c1、c2的选择分别关系粒子 速度的3个部分:惯性部分、社 会部分和感知部分在搜索中 的作用.如何选择、优化和调整参数,使得算法既能避免早 熟又 能比较快速地收敛,对工程实践有着重要意义。 • (3) 与其他演化计算的融合。如何将其它演化的优点和PSO 的优点相结合,构造出新的混合算 法是当前算法改进的一 个重要方向。 • (4) 算法应用。算法的有效性必须在应用中才能体现,广泛 地开拓PSO的应用领域,也对深化 研究PSO算法非常有意义。

matlab粒子群算法默认种群规模

【主题】matlab粒子裙算法默认种裙规模【内容】一、介绍matlab粒子裙算法matlab粒子裙算法(Particle Swarm Optimization,简称PSO)是一种启发式优化算法,源自于鸟裙觅食的行为。

PSO算法通过迭代搜索空间中的潜在解,寻找最优解。

其基本思想是模拟鸟裙觅食的行为,在搜索空间中不断调整潜在解的位置,直至找到最优解。

二、 PSO算法的种裙规模在matlab中,PSO算法的种裙规模即为裙体中粒子的数量,它决定了搜索空间的范围和算法的性能。

PSO算法的默认种裙规模为50。

种裙规模的设定直接影响算法的搜索速度和全局最优解的找寻能力。

三、种裙规模的设置原则1. 确定问题的复杂度:种裙规模应根据待解决问题的复杂度来设定。

对于复杂、高维度的问题,适当增加种裙规模有助于提高搜索效率。

2. 计算资源的限制:种裙规模的增加会带来更高的计算开销,因此在资源有限的情况下,需要平衡种裙规模和计算性能。

3. 经验设定:在实际应用中,也可根据经验和实验结果来调整种裙规模,找到最适合问题的设置。

四、调整种裙规模的方法1. 网格搜索法:通过在一定范围内以一定步长遍历种裙规模,评估不同规模下算法的性能和收敛速度,找到最佳的种裙规模。

2. 实验验证法:在实际问题中,通过对不同种裙规模下算法的性能进行实验验证,找到最适合问题的种裙规模。

3. 算法迭代法:根据算法的迭代次数和搜索效果来动态调整种裙规模,逐步优化算法的性能。

五、结语种裙规模是PSO算法中一个重要的参数,它直接关系到算法的搜索效率和性能。

在使用matlab的PSO算法时,合理设置种裙规模对于解决实际问题非常重要。

需要根据问题本身的特点、计算资源的限制以及实际应用情况来进行合理的选择和调整。

希望本文对于matlab粒子裙算法默认种裙规模的设置能够提供一些参考和帮助。

六、种裙规模与算法性能的关系种裙规模是PSO算法中最为关键的参数之一,其大小直接影响算法的搜索效率和全局最优解的寻找能力。

粒子群优化算法的基本原理

vij (k 1) (k)vij (k) 1rand(0,a1)

pij (k) xij (k)

2rand(0, a2)

p

g j

(k

)

xij

(k

)

——(7.1a)

xij (k 1) xij (k) vij (k 1) ——(7.1b)

i 1, 2, , m; j 1, 2, , n

pij (k) xij (k)

2rand(0, a2)

p

g j

(k

)

xij

(k

)

——(7.1a)

式(7.1a)右边的第1部分是粒子在前一时刻的速度;

第2部分为个体“认知”分量,表示粒子本身的思 考,将现有的位置和曾经经历过的最优位置相比。

第3部分是群体“社会(social)”分量,表示粒子 间的信息共享与相互合作。

1 ,2分别控制个体认知分量和群体社会分量相对

贡献的学习率。

随机系数增4 加搜索方向的随机性和算法多样性。

基于6学.6习.1率 粒1,子 2 ,群优化算法的基本原理

Kennedy给出以下4种类型的PSO模型:

▪若 1 > 0,2 > 0,则称该算法为PSO全模型。

▪若 1 > 0,2 = 0,则称该算法为PSO认知模型。

▪ vi (k) v1i v2i

:表vni示T该粒子的搜索方向。

2

的位置。

6.6.1 粒子群优化算法的基本原理

pi (k) p1i p2i

pni T

每个粒子经历过的最优位置(pbest)记为

pg (k) p1g p,2g 群体经历png过T的最优

位置(gbest)记为

,则基本的PSO算法为:

粒子群算法详解

粒子群算法详解粒子群算法(Particle Swarm Optimization,PSO)是一种模拟鸟群觅食行为的优化算法,通过模拟个体之间的协作和信息共享来寻找最优解。

它是一种全局优化算法,可以应用于各种问题的求解。

粒子群算法的基本思想是通过模拟鸟群的行为来寻找最优解。

在算法中,将待优化问题看作一个多维空间中的搜索问题,将问题的解看作空间中的一个点。

每个解被称为一个粒子,粒子的位置代表当前解的状态,速度代表解的更新方向和速度。

粒子之间通过互相交流信息,以共同寻找最优解。

在粒子群算法中,每个粒子都有自己的位置和速度。

每个粒子根据自身的经验和邻域中最优解的经验来更新自己的速度和位置。

速度的更新由三个因素决定:当前速度、个体最优解和全局最优解。

粒子根据这些因素调整速度和位置,以期望找到更优的解。

通过不断迭代更新,粒子群逐渐收敛于最优解。

粒子群算法的核心是更新速度和位置。

速度的更新公式如下:v(t+1) = w * v(t) + c1 * rand() * (pbest - x(t)) + c2 * rand() * (gbest - x(t))其中,v(t+1)为下一时刻的速度,v(t)为当前速度,w为惯性权重,c1和c2为学习因子,rand()为[0,1]之间的随机数,pbest为个体最优解,gbest为全局最优解,x(t)为当前位置。

位置的更新公式如下:x(t+1) = x(t) + v(t+1)通过调整学习因子和惯性权重,可以影响粒子的搜索能力和收敛速度。

较大的学习因子和较小的惯性权重可以增强粒子的探索能力,但可能导致算法陷入局部最优解;较小的学习因子和较大的惯性权重可以加快算法的收敛速度,但可能导致算法过早收敛。

粒子群算法的优点是简单易实现,收敛速度较快,对于大多数问题都能得到较好的结果。

然而,粒子群算法也存在一些缺点。

首先,算法对于问题的初始解和参数设置较为敏感,不同的初始解和参数可能导致不同的结果。

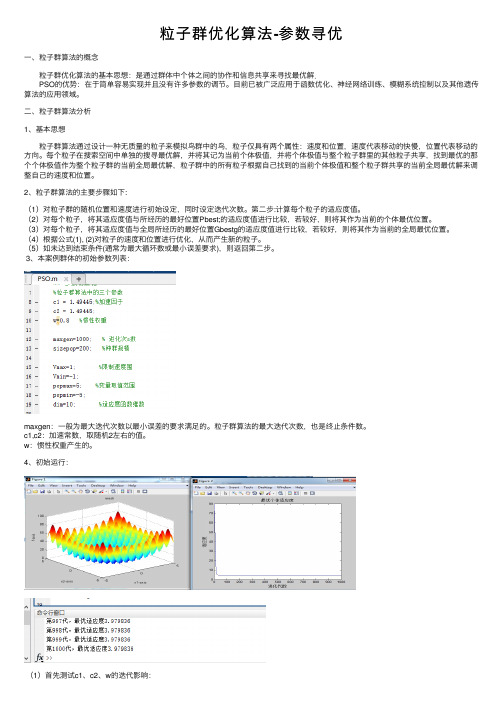

粒子群优化算法-参数寻优

粒⼦群优化算法-参数寻优⼀、粒⼦群算法的概念 粒⼦群优化算法的基本思想:是通过群体中个体之间的协作和信息共享来寻找最优解. PSO的优势:在于简单容易实现并且没有许多参数的调节。

⽬前已被⼴泛应⽤于函数优化、神经⽹络训练、模糊系统控制以及其他遗传算法的应⽤领域。

⼆、粒⼦群算法分析1、基本思想 粒⼦群算法通过设计⼀种⽆质量的粒⼦来模拟鸟群中的鸟,粒⼦仅具有两个属性:速度和位置,速度代表移动的快慢,位置代表移动的⽅向。

每个粒⼦在搜索空间中单独的搜寻最优解,并将其记为当前个体极值,并将个体极值与整个粒⼦群⾥的其他粒⼦共享,找到最优的那个个体极值作为整个粒⼦群的当前全局最优解,粒⼦群中的所有粒⼦根据⾃⼰找到的当前个体极值和整个粒⼦群共享的当前全局最优解来调整⾃⼰的速度和位置。

2、粒⼦群算法的主要步骤如下:(1)对粒⼦群的随机位置和速度进⾏初始设定,同时设定迭代次数。

第⼆步:计算每个粒⼦的适应度值。

(2)对每个粒⼦,将其适应度值与所经历的最好位置Pbest;的适应度值进⾏⽐较,若较好,则将其作为当前的个体最优位置。

(3)对每个粒⼦,将其适应度值与全局所经历的最好位置Gbestg的适应度值进⾏⽐较,若较好,则将其作为当前的全局最优位置。

(4)根据公式(1), (2)对粒⼦的速度和位置进⾏优化,从⽽产⽣新的粒⼦。

(5)如未达到结束条件(通常为最⼤循环数或最⼩误差要求),则返回第⼆步。

3、本案例群体的初始参数列表:maxgen:⼀般为最⼤迭代次数以最⼩误差的要求满⾜的。

粒⼦群算法的最⼤迭代次数,也是终⽌条件数。

c1,c2:加速常数,取随机2左右的值。

w:惯性权重产⽣的。

4、初始运⾏:(1)⾸先测试c1、c2、w的迭代影响:利⽤函数来表⽰各变量:运⾏得:逐渐迭代得:可以看出迭代收敛最早。

随着不断的迭代,最优适应度承不稳定状态。

(2)dim与sizepop的影响:适应度函数维数dim=12:适应度函数维数dim=8:适应度函数维数dim=5:适应度函数维数dim=3:种群规模sizepop=220:种群规模sizepop=200:种群规模sizepop=150:种群规模sizepop=130:将种群规模sizepop调制到<130时,迭代次数⽆法收敛到接近于0,所以判别种群规模sizepop在200最佳。

优化算法-粒子群优化算法

步骤四:对于粒子的每一维,根据式(1)计算得到一个随机点 的位置。

步骤五:根据式(2)计算粒子的新的位置。

步骤六:判断是否满足终止条件。

粒子群优化算法

PSO算法在组合优化问题中的应用

典型的组合优化问题:TSP

粒子群优化算法

量子行为粒子群优化算法的基本模型

群智能中个体的差异是有限的,不是趋向于无穷大的。群体的聚 集性是由相互学习的特点决定的。

个体的学习有以下特点: 追随性:学习群体中最优的知识

记忆性:受自身经验知识的束缚

创造性:使个体远离现有知识

粒子群优化算法

聚集性在力学中,用粒子的束缚态来描述。产生束缚态的原因是 在粒子运动的中心存在某种吸引势场,为此可以建立一个量子化 的吸引势场来束缚粒子(个体)以使群体具有聚集态。

描述为: 给定n 个城市和两两城市之间的距离, 求一条访问各城市

一次且仅一次的最短路线. TSP 是著名的组合优化问题, 是NP难题, 常被用来验证智能启发式算法的有效性。

vid (t 1) wvid (t) c1r1 pid (t) xid (t) c2r2( pgd (t) xid (t))

xid (t 1) xid (t) vid (t 1)

粒子群优化算法

w 惯性权重 可以是正常数,也可以是以时间为变量的线性或非线性

正数。

粒子群优化算法

通常动态权重可以获得比固定值更好的寻优结果,动态权重可以在 pso搜索过程中呈线性变化,也可以根据pso性能的某个测度函数 而动态改变,目前采用的是shi建议的随时间线性递减权值策略。

粒子群优化算法

matlab pso算法

matlab pso算法Matlab PSO算法粒子群优化(Particle Swarm Optimization,PSO)算法是一种模拟鸟群觅食行为的优化算法。

该算法通过模拟鸟群中个体之间的信息共享与协作,实现对搜索空间的全局优化。

PSO算法的基本思想是通过一群粒子的协作与信息共享来搜索最优解。

每个粒子代表着潜在的解,其位置表示解的位置,速度表示解的移动方向和速度。

粒子根据自身的历史最优位置和全局最优位置进行调整,以寻找更优的解。

PSO算法的具体步骤如下:1. 初始化粒子群的位置和速度。

位置和速度一般随机生成,并且在搜索空间内。

2. 计算每个粒子的适应度值。

适应度值根据问题的具体情况来确定,一般是目标函数的值。

3. 更新粒子的个体最优位置和全局最优位置。

个体最优位置是该粒子在搜索过程中找到的最优解,全局最优位置是所有粒子中最优的解。

4. 更新粒子的速度和位置。

粒子的速度和位置根据以下公式计算:速度更新公式:v(i+1) = w * v(i) + c1 * rand() * (pbest - x(i)) + c2 * rand() * (gbest - x(i))位置更新公式:x(i+1) = x(i) + v(i+1)其中,w为惯性权重,c1、c2为加速系数,rand()为[0,1]之间的随机数,pbest为个体最优位置,gbest为全局最优位置。

5. 判断终止条件。

可以通过设置最大迭代次数、目标函数值的收敛程度等来确定终止条件。

6. 如果未达到终止条件,则返回步骤3;否则,输出全局最优位置对应的解。

PSO算法的优点是易于理解和实现,收敛速度快。

但也存在一些缺点,如易于陷入局部最优、对参数的选择敏感等。

在Matlab中,可以使用PSO算法工具箱来实现PSO算法。

该工具箱提供了一系列函数,包括初始化粒子群、更新位置和速度、计算适应度值等。

使用该工具箱可以简化PSO算法的编程工作,提高算法的可靠性和效率。

粒子群算法介绍

1.介绍:粒子群算法(Particle Swarm Optimization, PSO)最早是由Eberhart 和Kennedy于1995年提出,它的基本概念源于对鸟群觅食行为的研究。

设想这样一个场景:一群鸟在随机搜寻食物,在这个区域里只有一块食物,所有的鸟都不知道食物在哪里,但是它们知道当前的位置离食物还有多远。

那么找到食物的最优策略是什么呢?最简单有效的就是搜寻目前离食物最近的鸟的周围区域。

经过实践证明:全局版本的粒子群算法收敛速度快,但是容易陷入局部最优。

局部版本的粒子群算法收敛速度慢,但是很难陷入局部最优。

现在的粒子群算法大都在收敛速度与摆脱局部最优这两个方面下功夫。

其实这两个方面是矛盾的。

看如何更好的折中了。

粒子群算法主要分为4个大的分支:(1)标准粒子群算法的变形在这个分支中,主要是对标准粒子群算法的惯性因子、收敛因子(约束因子)、“认知”部分的c1,“社会”部分的c2进行变化与调节,希望获得好的效果。

惯性因子的原始版本是保持不变的,后来有人提出随着算法迭代的进行,惯性因子需要逐渐减小的思想。

算法开始阶段,大的惯性因子可以是算法不容易陷入局部最优,到算法的后期,小的惯性因子可以使收敛速度加快,使收敛更加平稳,不至于出现振荡现象。

经过本人测试,动态的减小惯性因子w,的确可以使算法更加稳定,效果比较好。

但是递减惯性因子采用什么样的方法呢?人们首先想到的是线型递减,这种策略的确很好,但是是不是最优的呢?于是有人对递减的策略作了研究,研究结果指出:线型函数的递减优于凸函数的递减策略,但是凹函数的递减策略又优于线型的递减,经过本人测试,实验结果基本符合这个结论,但是效果不是很明显。

对于收敛因子,经过证明如果收敛因子取0.729,可以确保算法的收敛,但是不能保证算法收敛到全局最优,经过本人测试,取收敛因子为0.729效果较好。

对于社会与认知的系数c2,c1也有人提出:c1先大后小,而c2先小后大的思想,因为在算法运行初期,每个鸟要有大的自己的认知部分而又比较小的社会部分,这个与我们自己一群人找东西的情形比较接近,因为在我们找东西的初期,我们基本依靠自己的知识取寻找,而后来,我们积累的经验越来越丰富,于是大家开始逐渐达成共识(社会知识),这样我们就开始依靠社会知识来寻找东西了。

粒子群算法粒子群算法简介

粒子群算法(1)----粒子群算法简介二、粒子群算法的具体表述上面罗嗦了半天,那些都是科研工作者写论文的语气,不过,PSO的历史就像上面说的那样。

下面通俗的解释PSO算法。

PSO算法就是模拟一群鸟寻找食物的过程,每个鸟就是PSO中的粒子,也就是我们需要求解问题的可能解,这些鸟在寻找食物的过程中,不停改变自己在空中飞行的位置与速度。

大家也可以观察一下,鸟群在寻找食物的过程中,开始鸟群比较分散,逐渐这些鸟就会聚成一群,这个群忽高忽低、忽左忽右,直到最后找到食物。

这个过程我们转化为一个数学问题。

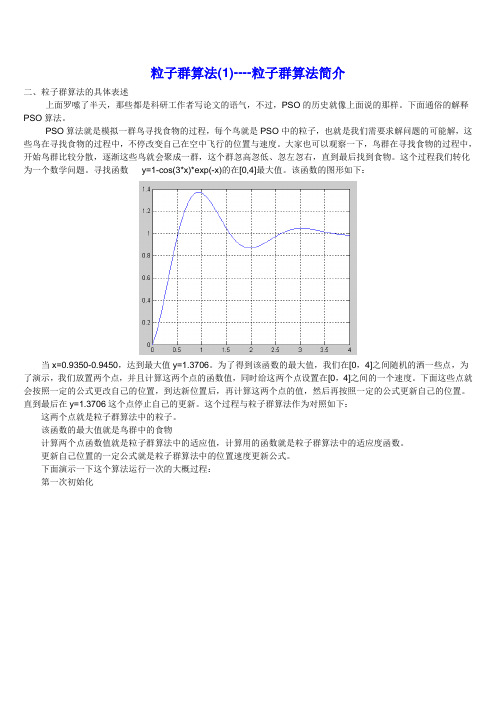

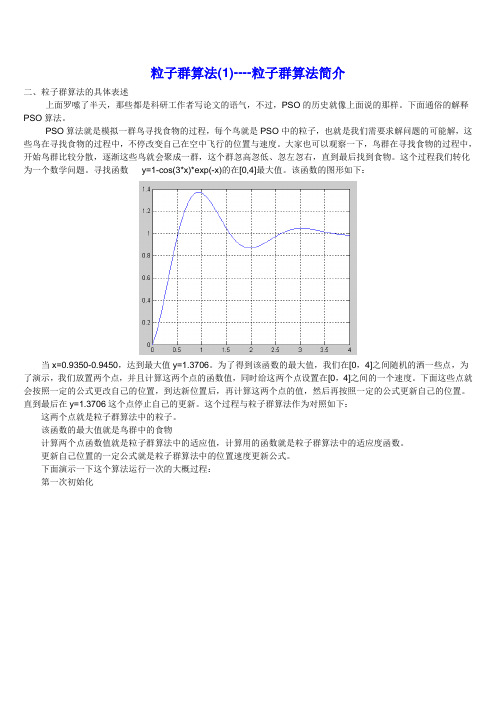

寻找函数y=1-cos(3*x)*exp(-x)的在[0,4]最大值。

该函数的图形如下:当x=0.9350-0.9450,达到最大值y=1.3706。

为了得到该函数的最大值,我们在[0,4]之间随机的洒一些点,为了演示,我们放置两个点,并且计算这两个点的函数值,同时给这两个点设置在[0,4]之间的一个速度。

下面这些点就会按照一定的公式更改自己的位置,到达新位置后,再计算这两个点的值,然后再按照一定的公式更新自己的位置。

直到最后在y=1.3706这个点停止自己的更新。

这个过程与粒子群算法作为对照如下:这两个点就是粒子群算法中的粒子。

该函数的最大值就是鸟群中的食物计算两个点函数值就是粒子群算法中的适应值,计算用的函数就是粒子群算法中的适应度函数。

更新自己位置的一定公式就是粒子群算法中的位置速度更新公式。

下面演示一下这个算法运行一次的大概过程:第一次初始化第一次更新位置第二次更新位置第21次更新最后的结果(30次迭代)最后所有的点都集中在最大值的地方。

粒子群算法(2)----标准的粒子群算法在上一节的叙述中,唯一没有给大家介绍的就是函数的这些随机的点(粒子)是如何运动的,只是说按照一定的公式更新。

这个公式就是粒子群算法中的位置速度更新公式。

下面就介绍这个公式是什么。

在上一节中我们求取函数y=1-cos(3*x)*exp(-x)的在[0,4]最大值。

粒子群算法粒子群算法简介

粒子群算法(1)----粒子群算法简介二、粒子群算法的具体表述上面罗嗦了半天,那些都是科研工作者写论文的语气,不过,PSO的历史就像上面说的那样。

下面通俗的解释PSO算法。

PSO算法就是模拟一群鸟寻找食物的过程,每个鸟就是PSO中的粒子,也就是我们需要求解问题的可能解,这些鸟在寻找食物的过程中,不停改变自己在空中飞行的位置与速度。

大家也可以观察一下,鸟群在寻找食物的过程中,开始鸟群比较分散,逐渐这些鸟就会聚成一群,这个群忽高忽低、忽左忽右,直到最后找到食物。

这个过程我们转化为一个数学问题。

寻找函数y=1-cos(3*x)*exp(-x)的在[0,4]最大值。

该函数的图形如下:当x=0.9350-0.9450,达到最大值y=1.3706。

为了得到该函数的最大值,我们在[0,4]之间随机的洒一些点,为了演示,我们放置两个点,并且计算这两个点的函数值,同时给这两个点设置在[0,4]之间的一个速度。

下面这些点就会按照一定的公式更改自己的位置,到达新位置后,再计算这两个点的值,然后再按照一定的公式更新自己的位置。

直到最后在y=1.3706这个点停止自己的更新。

这个过程与粒子群算法作为对照如下:这两个点就是粒子群算法中的粒子。

该函数的最大值就是鸟群中的食物计算两个点函数值就是粒子群算法中的适应值,计算用的函数就是粒子群算法中的适应度函数。

更新自己位置的一定公式就是粒子群算法中的位置速度更新公式。

下面演示一下这个算法运行一次的大概过程:第一次初始化第一次更新位置第二次更新位置第21次更新最后的结果(30次迭代)最后所有的点都集中在最大值的地方。

粒子群算法(2)----标准的粒子群算法在上一节的叙述中,唯一没有给大家介绍的就是函数的这些随机的点(粒子)是如何运动的,只是说按照一定的公式更新。

这个公式就是粒子群算法中的位置速度更新公式。

下面就介绍这个公式是什么。

在上一节中我们求取函数y=1-cos(3*x)*exp(-x)的在[0,4]最大值。

混沌粒子群算法

混沌粒子群算法混沌粒子群算法是一种基于混沌理论和粒子群算法的优化算法。

它结合了混沌系统的随机性和粒子群算法的协同搜索能力,能够有效地解决各种优化问题。

混沌粒子群算法的基本思想是通过引入混沌系统的随机性,增加算法的多样性和全局搜索能力。

在算法的初始化阶段,通过混沌映射生成一组随机解,并将其作为粒子的初始位置。

然后,根据粒子的当前位置和速度,利用粒子群算法的思想更新粒子的位置和速度。

在更新的过程中,通过引入混沌映射产生的随机扰动,增加了解的多样性,从而提高了算法的全局搜索能力。

混沌粒子群算法的核心是混沌映射。

混沌映射是一类具有混沌特性的非线性动力系统,具有敏感依赖于初值的特点。

混沌映射产生的随机数序列具有高度的随机性和不可预测性,能够增加算法的多样性。

常用的混沌映射有Logistic映射、Henon映射、Tent映射等。

混沌粒子群算法的具体步骤如下:1. 初始化粒子群的位置和速度,选择合适的参数。

2. 计算每个粒子的适应度值,评估当前解的优劣。

3. 根据适应度值更新粒子的最佳位置和全局最佳位置。

4. 根据粒子的最佳位置和全局最佳位置,更新粒子的速度和位置。

5. 判断终止条件,如果满足则输出全局最佳解,否则返回第3步。

混沌粒子群算法在实际应用中具有广泛的应用价值。

它可以用于解决函数优化问题、组合优化问题、机器学习问题等。

与其他优化算法相比,混沌粒子群算法具有以下优点:1. 全局搜索能力强。

通过引入混沌映射产生的随机扰动,增加了解的多样性,能够更好地避免陷入局部最优解。

2. 收敛速度快。

通过粒子群算法的协同搜索能力,能够快速找到最优解。

3. 参数设置简单。

相对于其他优化算法,混沌粒子群算法的参数设置相对简单,不需要过多的调参工作。

然而,混沌粒子群算法也存在一些不足之处。

例如,算法的收敛性和稳定性还需要进一步的研究和改进。

此外,算法对问题的特征依赖较强,对于不同类型的问题,需要进行适当的算法调整和参数设置。

粒子群优化算法

好地求解各类优化问题。

03

多目标优化

多目标优化是未来粒子群优化算法的一个重要研究方向,可以解决实

际优化问题中多个目标之间的权衡和取舍。

THANKS

谢谢您的观看

粒子群优化算法

xx年xx月xx日

目录

• 粒子群优化算法简介 • 粒子群优化算法的基本原理 • 粒子群优化算法的改进 • 粒子群优化算法的应用案例 • 粒子群优化算法的总结与展望

01

粒子群优化算法简介

什么是粒子群优化算法

粒子群优化算法是一种群体智能优化算法,通过模拟鸟群、 鱼群等动物群体的社会行为,利用群体中个体之间的相互作 用和信息共享,寻找问题的最优解。

动态调整约束参数

通过动态调整约束参数,使算法在不同阶段都能保持较好的优化效果。同时 ,可以设置一些参数的自适应调整策略,如根据迭代次数、最优解的位置和 速度等信息来自适应调整。

04

粒子群优化算法的应用案例

函数优化问题

求解函数最大值

粒子群优化算法可以用于求解各类连续或离散函数的最大值,例如非线性函数、 多峰函数等。通过不断迭代寻优,能够找到函数的局部最大值或全局最大值。

03

粒子群优化算法的参数包括粒子群的规模、惯性权重、加速常数和学习因子等 ,这些参数对算法的性能和收敛速度有着重要影响。

粒子群优化算法的应用领域

粒子群优化算法被广泛应用于各种优化问题中,包括函 数优化、路径规划、电力系统优化、机器学习、图像处 理、控制工程、模式识别、人工智能等领域。

具体应用包括:函数优化问题的求解、神经网络训练的 优化、控制系统参数的优化、机器人路径规划、图像处 理中的特征提取和分类等。

空间搜索的改进

引入高斯分布

通过引入高斯分布,使粒子速度更新过程中更侧重于向当前 最优解方向靠拢,提高算法的局部搜索能力。

粒子群算法基本流程

粒子群算法基本流程粒子群算法(Particle Swarm Optimization, PSO)是一种基于自然界群体智能现象的优化算法,常用于解决各种优化问题,如函数优化、组合优化、机器学习等。

本文将详细介绍粒子群算法的基本流程,包括初始化、适应度评价、移动、更新等环节,希望能对读者理解该算法提供一定的帮助。

一、算法介绍粒子群算法最初由Kennedy和Eberhart于1995年提出 [1],其基本思想来源于鸟群觅食行为。

在野外觅食时,鸟群中的鸟会根据所找到的食物数量来确定自己下一步的移动方向。

PSO算法中的“粒子”类似于鸟群中的鸟,它们以个体和群体为导向,通过速度和位置的调整来进行优化搜索。

PSO算法的目标是寻找最优解,通常是最小化或最大化一个函数的值,可表示为:f(x)=\sum_{i=1}^n{f_i(x)}x 是 n 维实数向量,f_i(x) 表示第 i 个函数。

寻找最优解的目标就是在 x 的搜索空间中寻找函数 f(x) 的全局最优解或局部最优解。

二、基本流程粒子群算法的基本流程如下:1. 初始化:随机生成一群粒子,每个粒子的位置和速度都是随机的。

2. 适应度评价:计算每个粒子的适应度值,也就是函数 f(x) 所对应的值,用来表示该粒子所处的位置的优劣程度。

3. 移动:根据当前位置和速度,移动粒子到新的位置。

4. 更新:根据历史上最好的粒子位置和当前最好的粒子位置,更新每个粒子的历史最好位置和当前最好位置,并更新全局最优位置。

5. 终止:当满足一定的终止条件时,停止迭代,并输出最终的粒子位置和最优解。

下文将分别对各环节进行详细介绍。

三、初始化在PSO算法中,粒子的位置和速度都是随机的。

对于每个粒子,需要随机生成一个 n 维实数向量表示其位置,一个同维度的实数向量表示其速度。

可以采用如下方法进行初始化:1. 对于每一个维度,随机生成一个实数范围内的数值,表示该维度上的位置和速度。

2. 在满足约束条件的前提下,生成一个可行解,作为初始化的位置。

粒子群优化算法

粒子群优化算法的基本原理是利用群体中粒子的运动状态和个体最优解以及全局最优解之间的关系。通过不断更新粒子的速度和位置

每个粒子都有一个速度和位置,粒子在搜索空间中的运动状态由速度和位置决定

在每次迭代过程中,粒子通过比较自身的个体最优解和全局最优解,更新自己的速度和位置,以便更好地适应整个群体的运动。更新的公式如下

粒子群优化算法在函数优化中的应用

粒子群优化算法可以用于优化神经网络的参数,如学习率、动量等,以提高神经网络的训练效果和性能。

参数优化

粒子群优化算法也可以用于优化神经网络的拓扑结构,如层数、神经元数等,以进一步提高神经网络的性能。

网络结构优化

粒子群优化算法在神经网络训练中的应用

特征选择

粒子群优化算法可以应用于特征选择,通过优化特征组合以提高分类器的性能。

2023

粒子群优化算法

粒子群优化算法简介粒子群优化算法的基本框架粒子群优化算法的改进粒子群优化算法的应用结论

contents

目录

01

粒子群优化算法简介

粒子群优化算法是一种群体智能优化算法,通过模拟鸟群、鱼群等动物群体的社会行为,利用群体中个体之间的相互作用和信息共享,寻找问题的最优解。

粒子群优化算法的基本思想是将每个个体看作是在搜索空间中自由运动的粒子,粒子的运动状态由速度和位置决定,粒子通过不断更新自身的速度和位置来适应整个群体的运动,最终达到全局最优解。

选择最优解

03粒子群优化算法的改进来自对初始粒子群的敏感依赖

惯性权重的固定值问题

对速度更新公式的依赖

粒子群优化算法的局限性

VS

根据算法的迭代过程和性能,动态调整惯性权重的值,使算法更好地平衡探索和开发能力。

多种惯性权重的选择

粒子群算法

粒子群算法粒子群算法(Particle Swarm Optimization,PSO)是一种群体智能优化算法,它模拟了鸟群觅食行为中个体在信息交流、合作与竞争中寻找最优解的过程。

粒子群算法在解决优化问题中具有较好的效果,尤其适用于连续优化问题。

粒子群算法的基本思想是模拟粒子在解空间中的移动过程,每个粒子代表一个候选解,粒子的位置表示解的一组参数。

每个粒子都有一个速度向量,表示粒子在解空间中的移动方向和速率。

算法的核心是通过更新粒子的位置和速度来搜索目标函数的最优解。

具体来说,粒子的位置和速度更新通过以下公式计算:$$v_i^{t+1} = w\cdot v_i^{t} + c_1 \cdot rand() \cdot (p_i^{best}-x_i^{t}) + c_2 \cdot rand() \cdot (p_g^{best}-x_i^{t})$$$$x_i^{t+1} = x_i^{t} + v_i^{t+1}$$其中,$v_i^{t}$是粒子$i$在时间$t$的速度,$x_i^{t}$是粒子$i$在时间$t$的位置,$p_i^{best}$是粒子$i$自身经历过的最好位置,$p_g^{best}$是整个种群中经历过的最好位置,$w$是惯性权重,$c_1$和$c_2$是加速度因子,$rand()$是一个0到1的随机数。

粒子群算法的优点在于简单、易于理解和实现,同时具有较好的全局搜索能力。

其收敛速度较快,可以处理多维、非线性和非光滑的优化问题。

另外,粒子群算法有较少的参数需要调节,因此适用于许多实际应用中的优化问题。

粒子群算法的应用领域非常广泛,包括机器学习、数据挖掘、图像处理、模式识别、人工智能等。

例如,在机器学习中,粒子群算法可以应用于神经网络的训练和参数优化;在数据挖掘中,粒子群算法可以用于聚类、分类和关联规则挖掘等任务;在图像处理中,粒子群算法可以用于图像分割、边缘检测和特征提取等;在模式识别中,粒子群算法可以用于目标检测和模式匹配等。

第6章粒子群算法基本理论

PSO算法作为一种新兴智能仿生算法,目前还没有完备 的数学理论基础,但作为新兴优化算法已在诸多领域得到广 泛应用。

6.1 粒子群算法的概述

6.1.3 粒子群算法的特点

粒子群算法的优点 ① 粒子群算法依靠粒子速度完成搜索,在迭代进化中只 有最优的粒子将信息传递给其他粒子,搜索速度快。 ② 粒子群算法具有记忆性,粒子群体的历史最好位置可 以记忆,并传递给其他粒子。 ③ 需调整的参数较少,结构简单,易于工程实现。 ④ 采用实数编码,直接由问题的解决定,问题解的变量 数直接作为粒子的维数。

[2] Eberhart R,Kennedy J,A new optimizer using particle swarm theory,Proceeding of the 6th International Symposium on Micro-Machine and Human Science, 1995,39~43

粒子群算法的基本思想是通过群体中个体之间的协作和 信息共享来寻找最优解。

6.1 粒子群算法的概述

6.1.2 粒子群算法的发展

萌芽阶段

1986年,人工生命、计算机图形 学专家 Craig Reynolds提出了简单的 人工生命系统——boid模型(解释为 bird like object),模拟了鸟类在飞行 过程中分离、列队和聚集三种聚群飞 行行为,并能感知到周围一定范围内 其他boid的飞行信息。boid根据该信 息,结合当前自身的飞行状态,在三 条简单行为规则的指导下,做出下一 步的飞行决策。

Step2:评价每个微粒的适应度值。 Step3:将每个微粒的适应度值与其经过的最好位置 pbest进行比较,如果较好则将其作为当前的最好位置pbest。 Step4:将每个微粒的适应度值与种群的最好位置gbest 进行比较,如果较好则将其作为种群的最好位置gbest。 Step5:根据速度和位置公式调整粒子的飞行速度和所 处位置。 Step6:判断是否达到结束条件,若未达到转到Step2。

粒子群优化算法(详细易懂)

更新速度,得:

60

60

60

60

vk1 vk 2 ( pk xk ) 2( pg xk ),

初始位置: 初始速度:

群体历史最优解:pg

x(0) 1

个体历史最优解:pi xi0 , (i 1, 2, 3, 4, 5)

更新位置,得:

不强行拉回解空间

xk 1 xk vk 1

初始位置: 初始速度:

c1r1( pbestid

xk 1 id

)

c2r2 (gbestd

xk 1 id

)

• 粒xi子kd i的第xikdd维1 位v置ikd更1 新公式:

vikd xikd

—第k次迭代粒子i飞行速度矢量的第d 维分量

—第k次迭代粒子i位置矢量的第d维分 量

vikd =wvikd-1

c1r1( pbestid

我们以某种启示,只不过我们常常忽略了 大自然对我们的最大恩赐!......”

粒子群算法的基本思想

设想这样一个场景:一群鸟在随机搜索食物

在这块区域里只有一块食物; 已知 所有的鸟都不知道食物在哪里;

但它们能感受到当前的位置离食物还有多远. 那么:找到食物的最优策略是什么呢?

搜寻目前离食物最近的鸟的周围区域 . 根据自己飞行的经验判断食物的所在。 PSO正是从这种模型中得到了启发. PSO的基础: 信息的社会共享

前次迭代中自身的速度 vk

自我认知部分

c1r1( pbestid

xk 1 id

)

社会经验部分c2r2 (gbestd

xk 1 id

)

c1,c2都不为0,称为 完全型粒子群算法

完全型粒子群算法更容易保持收敛速度和搜索效 果的均衡,是较好的选择.

粒子群优化 实际问题

粒子群优化实际问题

粒子群优化(PSO)是一种启发式优化算法,用于解决各种实

际问题。

PSO算法的基本思想源于鸟群觅食行为,通过模拟

鸟群中的个体协同搜索最优解。

在PSO算法中,解决方案被

表示为粒子群中的一个个体,每个个体都有自己的位置和速度。

粒子群中的个体通过相互通信和协作来寻找最优解。

PSO算法可以应用于各种实际问题,包括但不限于以下领域:

1. 函数优化问题:PSO算法可以用于寻找函数的全局最优解,例如优化机器学习算法的超参数、最小化成本函数等。

2. 机器学习问题:PSO算法可以用于训练神经网络、最优化

模型参数等。

3. 集群分析问题:PSO算法可以用于聚类分析、图像分割、

目标识别等。

4. 组合优化问题:PSO算法可以用于旅行商问题、车辆路径

规划、调度问题等。

5. 物流优化问题:PSO算法可以用于最优化物流的路径、仓

库布局等。

总之,粒子群优化算法可以应用于各种实际问题中,特别适用于复杂的优化问题,具有快速寻找最优解的能力。

粒子群优化算法介绍

粒子群优化算法介绍

粒子群优化算法是一种基于群体智能的优化算法,它模拟了鸟群或鱼群等生物群体的行为,通过不断地迭代寻找最优解。

该算法最初由美国加州大学的Eberhart和Kennedy于1995年提出,目前已经被广泛应用于各种优化问题中。

粒子群优化算法的基本思想是将待优化问题转化为一个多维空间中的搜索问题,将每个解看作空间中的一个粒子,每个粒子的位置表示该解的参数值,速度表示该解的变化方向和速度。

在算法的每一次迭代中,每个粒子都会根据自身的历史最优解和群体最优解来更新自己的速度和位置,以期望找到更优的解。

具体来说,粒子群优化算法的实现过程如下:

1. 初始化粒子群,包括粒子的位置和速度等信息。

2. 计算每个粒子的适应度值,即待优化问题的目标函数值。

3. 更新每个粒子的速度和位置,包括考虑自身历史最优解和群体最优解的影响。

4. 判断是否满足停止条件,如果满足则输出最优解,否则返回第2步。

粒子群优化算法的优点在于其简单易懂、易于实现和收敛速度较快等特点。

同时,该算法还具有较好的全局搜索能力和鲁棒性,能够

应对复杂的非线性优化问题。

然而,粒子群优化算法也存在一些缺点,如易陷入局部最优解、对参数的选择较为敏感等问题。

因此,在实际应用中需要根据具体问题进行调整和优化。

粒子群优化算法是一种有效的优化算法,已经被广泛应用于各种领域,如机器学习、图像处理、控制系统等。

随着人工智能和大数据技术的不断发展,相信粒子群优化算法将会有更广泛的应用前景。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

6

一. ห้องสมุดไป่ตู้SO的产生

2003年,《控制与决策》第二期刊登国内第 一篇PSO论文——综述文章

7

二. PSO的基本思想

1. 对社会行为的模拟 2. 从对“bird flock”的模拟到PSO的演化 3. PSO算法概述 4. 名称的由来:Swarm和Particle

14

二. PSO的基本思想

2. 从对“bird flock”的模拟到PSO算法的演化 (1)速度匹配和“Craziness”

鸟群首先在在二维空间中进行位置的初始化, 每个个体具有X和Y两个速度,对邻居间速度 的匹配导致鸟群的行动完全一致,方向也不 变化,显然小鸟不会这么听话,于是加入了 Craziness变量,对坐标增加一些随机的成 分。

4

一. PSO的产生

Russell C. Eberhart (M’88–SM’89– F’01) received the Ph.D. degree in electrical engineering from Kansas State University, Manhattan. He is the Chair and Professor of Electrical and Computer Engineering, Purdue School of Engineering and Technology. He is coauthor of Computational Intelligence PC Tools (1996), coauthor of Swarm Intelligence(2001). He has published over 120 technical papers.

8

二. PSO的基本思想

1. 对社会行为的模拟: (1)对鸟群行为的模拟 Reynolds和Heppner,Grenander在1987年和 1990年发表的论文中都关注了鸟群群体行动 中的蕴涵的美学

9

二. PSO的基本思想

他们发现,由数目庞大的个体组成的鸟群飞 行中可以改变方向,散开,或者队形的重组 等等,那么一定有某种潜在的能力或者规则 保证了这些同步的行为。这些科学家都认为 上述行为是基于不可预知的鸟类社会行为中 的群体动态学。在这些早期的模型中他们把 重点都放在了个体间距的处理,也就是让鸟 群中的个体之间保持最优的距离。

10

二. PSO的基本思想

1. 对社会行为的模拟: (2)对鱼群行为的研究 1975年,生物社会学家E.O.Wilson在论文中 阐述了对鱼群的研究

11

二. PSO的基本思想

他在论文中提出:“至少在理论上,鱼群的 个体成员能够受益于群体中其他个体在寻找 食物的过程中发现的和以前的经验,这种受 益是明显的,它超过了个体之间的竞争所带 来的利益消耗,不管任何时候食物资源不可 预知的分散于四处。”这说明,同种生物之 间信息的社会共享能够带来好处。这是PSO 的基础。

3

一. PSO的产生

James Kennedy received the Ph.D. degree from the University of North Carolina, Chapel Hill, in 1992. He is with the U.S. Department of Labor, Washington, DC. He is a Social Psychologist who has been working with the particle swarm algorithm since 1994. He has published dozens of articles and chapters on particle swarms and related topics, in computer science and social science journals and proceedings. He is a coauthor of Swarm Intelligence (San Mateo, CA: Morgan Kaufmann, 2001), with R.C. Eberhart and Y. Shi, now in its third printing.

第五章 粒子群优化

1

第五章 粒子群优化(PSO)

一. PSO的产生 二. PSO的基本思想 三. 基本PSO 四. 标准PSO 五. 计算举例 六. 改进与变形

2

一. PSO的产生

Particle Swarm Optimization 简称:PSO 粒子群优化(微粒群优化) 1995年,Kennedy & Eberhart 提出

5

一. PSO的产生

Particle swarm optimization ——IEEE International Conference on Neural Networks, 1995

A new optimizer using particle swarm theory——6th International Symposium on Micromachine and Human Science ,1995

12

二. PSO的基本思想

1. 对社会行为的模拟: (3)对人类的社会行为的模拟

鸟类和鱼类是调节他们的物理运动,来避免 天敌,寻找食物,优化环境的参数,比如温 度等。人类调节的不仅是物理运动,还包括 认知和经验变量。我们更多的是调节自己的 信仰和态度,来和社会中的上流人物或者专 家,或者说在某件事情上获得最优解的人保 持一致。 与前者不同,最大区别在于抽象性!

13

二. PSO的基本思想

1. 对社会行为的模拟: 这种不同导致了计算机仿真上的差别,至少

有一个明显的因素: 碰撞(collision) 两个个体即使不被绑在一块,也具有相同的 态度和信仰,但是两只鸟是绝对不可能不碰 撞而在空间中占据相同的位置。这是因为动 物只能在三维的物理空间中运动,而人类还 在抽象的多维心理空间运动,这里是碰撞自 由的(collision-free)。