大数据经典算法CART 讲解

决策树 cart最佳分割点算法

决策树是一种经典的机器学习算法,它通过对数据集进行分割来构建一个预测模型。

在决策树的构建过程中,寻找最佳的分割点是非常重要的一步。

CART(Classification and Regression Trees)是一种常用的决策树算法,它使用基尼系数来确定最佳的分割点。

本文将重点介绍CART最佳分割点算法的原理和实现方法。

1. 基尼系数的定义在CART算法中,基尼系数是衡量数据集纯度的指标。

对于一个包含K个类别的数据集D,其基尼系数的计算公式如下:Gini(D)=1-Σ(p_i)^2其中,p_i 表示类别 i 在数据集 D 中所占的比例。

当数据集完全纯净时,即只包含单一类别的样本时,基尼系数为 0;当数据集的样本均匀分布在各个类别中时,基尼系数最大为 0.5。

2. 基尼指数的计算在决策树的构建过程中,我们希望找到一个最佳的分割点,使得基尼系数最小。

对于一个二分类的问题,我们可以遍历每个特征的取值,对数据集进行分割,并计算基尼系数。

最终选择使得基尼系数最小的特征和分割点作为最佳的分割点。

3. CART最佳分割点算法CART算法使用递归二分来构建决策树,其最佳分割点算法基本流程如下:1. 遍历每个特征的取值,对数据集进行分割;2. 计算每个分割点的基尼系数;3. 选择使得基尼系数最小的特征和分割点作为最佳的分割点;4. 重复以上步骤,直至满足停止条件(如树的最大深度、节点的最小样本数等)。

4. 实现方法在实际应用中,我们可以使用贪心算法来寻找最佳的分割点。

具体实现方法如下:1. 对于每个特征,对其取值进行排序;2. 遍历每个特征的取值,使用一个指针来指示当前的分割点;3. 维护一个变量来存储当前的基尼系数最小值,以及相应的特征和分割点;4. 在遍历过程中,不断更新基尼系数最小值和最佳的特征和分割点;5. 最终得到使得基尼系数最小的特征和分割点作为最佳的分割点。

5. 结语CART最佳分割点算法是决策树构建过程中的关键步骤,通过有效地寻找最佳的分割点,可以构建出具有良好泛化能力的决策树模型。

cart基础知识ppt课件

引入一个代价复杂性参数,在生成决策树时同时考虑模型 的复杂度和对训练数据的拟合程度,以达到更好的泛化性 能。

后剪枝

在决策树生成后,自底向上对非叶节点进行考察,若将该 节点对应的子树替换为叶节点能带来决策树泛化性能提升 ,则将该子树替换为叶节点。

基于错误的剪枝

使用独立的验证数据集对决策树进行剪枝,当验证错误率 达到一定阈值时停止剪枝。

可解释性研究

随着深度学习等黑盒模型的普及,如何增强Cart算法的可 解释性,使其更好地应用于实际场景中,将是一个值得关 注的问题。

THANKS

感谢观看

CART分类树

基于Gini指数选择最优 特征和切分点,递归生

成二叉树。

CART回归树

基于平方误差最小化原 则选择最优特征和切分 点,递归生成二叉树。

ห้องสมุดไป่ตู้

停止条件

达到最大深度、节点样 本数过少、节点纯度过

高等。

剪枝策略

采用预剪枝或后剪枝策 略,防止过拟合。

剪枝算法优化策略

预剪枝

在决策树生成过程中,提前停止树的生长,避免过度拟合 训练数据。

05

CART在实际问题中应用案例

信贷审批风险评估问题解决方案

数据收集与处理

收集客户基本信息、财务状况、信用记录等 数据,进行数据清洗和预处理。

特征选择与构建

通过统计分析、机器学习等方法筛选关键特 征,构建风险评估模型。

CART模型训练与调优

利用CART算法训练分类模型,通过调整参 数优化模型性能。

现状

目前,CART算法已经被广泛应用于各个领域,包括金融、医疗、教育等;同时 ,许多机器学习库和工具也都提供了CART算法的实现,方便用户进行使用。

cart算法题目

cart算法题目Cart算法,也称为分类和回归树(Classification and Regression Tree),是一种常用的决策树学习方法。

下面是一些关于Cart算法的题目,用于练习和检验自己对Cart算法的理解:1. 基本概念•解释什么是决策树,并给出其优缺点。

◦解释什么是Cart算法,它在哪些场景中应用?2. 构建决策树•使用Cart算法,给出如何根据数据集构建决策树的步骤。

◦当在某个节点上划分不成功时,如何处理?3. 特征选择•解释如何使用Gini指数或基尼不纯度进行特征选择。

◦解释如何使用信息增益或增益率进行特征选择。

4. 剪枝•为什么要对决策树进行剪枝?◦给出决策树剪枝的几种常见方法。

5. 应用场景•Cart算法可以用于分类问题,还可以用于回归问题。

给出一些应用场景。

6. 与其他算法比较•与其他分类算法(如K近邻、支持向量机、朴素贝叶斯)相比,Cart算法的优点和缺点是什么?7. 实战问题•给出一个数据集,使用Cart算法构建决策树,并解释结果。

◦对于一个分类问题,如何使用Cart算法进行预测?8. 优缺点•列出Cart算法的优缺点,并给出改进的方法。

9. 过拟合与欠拟合•Cart算法也可能遇到过拟合和欠拟合问题,解释这两种问题并给出解决方法。

10. 其他注意事项•在使用Cart算法时,还需要注意哪些问题?例如参数选择、特征选择等。

这些题目涵盖了Cart算法的基本概念、构建、应用和一些注意事项。

通过回答这些问题,可以帮助你深入理解Cart算法,并为实际应用打下基础。

CART分类与回归树方法介绍

1.软件下载与安装

1.软件下载与安装

该软件可从官方网站下载并安装。下载安装过程十分简单,只需根据提示完 成即可。

2.界面介绍

2.界面介绍

该软件采用图形用户界面(GUI),界面简洁明了,操作方便易用。主界面包 括菜单栏、工具栏、数据区和结果区等部分。

3.数据导入与清洗

3.数据导入与清洗

(1)点击菜单栏中的“文件”->“打开”,选择实验数据文件导入。支持多 种文件格式,如CSV、Excel等。

谢谢观看

CART分类

3、递归分割:将生成的两个子节点分别递归执行步骤1和2,直到满足停止条 件,生成最终的决策树。

CART分类

4、决策规则生成:根据生成的决策树,生成相应的决策规则,用于对新数据 进行分类。

回归树方法

回归树方法

回归树方法是CART方法的一种变种,主要用于预测连续型目标变量。回归树 通过构建决策树,实现对目标变量的预测。回归树方法的具体步骤如下:

5.结果输出与保存

5.结果输出与保存

(1)结果展示:在结果区展示拟合的回归模型参数、相关系数等结果。 (2)保存结果:点击“文件”->“保存”,将计算结果保存到本地电脑或云 端存储设备。

三、案例分析

三、案例分析

为了更好地说明毒力回归计算方法的应用和软件使用的效果,我们结合一个 实际案例进行阐述。某研究团队在研究某种生物毒素对水生生物的毒害作用时, 通过实验观测获得了毒素浓度与水生生物死亡率的数据。利用毒力回归计算软件, 我们对该数据进行毒力回归计算,并建立相应的回归模型。

案例分析

1、数据预处理:首先对用户购买行为的数据进行清洗和处理,包括去除异常 值、填补缺失值等。

案例分析

2、特征提取:然后对数据进行分析,选择出与购买行为相关的特征,如年龄、 性别、购买频率、购买金额等。

大数据经典算法CART讲解

大数据经典算法CART讲解CART(分类与回归树)是一种经典的机器学习算法,用于解决分类和回归问题。

它是由Leo Breiman等人在1984年提出的,是决策树算法的一种改进和扩展。

CART算法的核心思想是通过将输入空间划分为多个区域来构建一棵二叉树,每个区域用于表示一个决策规则。

CART算法的整个过程可以分为两个部分:生成和剪枝。

在生成阶段,CART算法通过递归地将数据集切分为两个子集,直到满足一些停止条件。

在剪枝阶段,CART算法通过剪枝策略对生成的树进行剪枝,以防止过拟合。

生成阶段中,CART算法的切分准则是基于Gini系数的。

Gini系数衡量了将数据集切分为两个子集后的不纯度,即数据集中样本不属于同一类别的程度。

CART算法通过选择Gini系数最小的切分点来进行切分,使得切分后的两个子集的纯度最高。

剪枝阶段中,CART算法通过损失函数来评估子树的贡献。

损失函数考虑了子树的拟合程度和子树的复杂度,以平衡模型的拟合能力和泛化能力。

剪枝阶段的目标是找到一个最优的剪枝点,使得剪枝后的子树的整体损失最小。

CART算法具有许多优点。

首先,CART算法可以处理多类别问题,不需要进行额外的转换。

其次,CART算法能够处理混合类型的数据,比如同时具有连续型和离散型特征的数据。

此外,CART算法能够处理缺失数据,并能够自动选择缺失数据的处理方法。

最后,CART算法生成的模型具有很好的可解释性,可以直观地理解决策过程。

然而,CART算法也存在一些不足之处。

首先,CART算法是一种贪心算法,通过局部最优来构建模型,不能保证全局最优。

其次,CART算法对输入特征的顺序敏感,不同的特征顺序可能会导致不同的模型结果。

此外,CART算法对噪声和异常值很敏感,可能会导致过拟合。

在实际应用中,CART算法广泛应用于分类和回归问题。

在分类问题中,CART算法可以用于构建决策树分类器,对样本进行分类预测。

在回归问题中,CART算法可以用于构建决策树回归器,根据输入特征预测输出值。

大数据经典算法CART_讲解资料

大数据经典算法CART_讲解资料CART算法,即分类与回归树(Classification and Regression Tree)算法,是一种经典的应用于大数据分析的算法。

它将数据集按照特征属性进行划分,然后根据各个特征属性的分割点将数据集划分为多个子集,进而得到一个树形的划分结构。

通过分析划分特征和划分点的选择,CART算法能够高效地解决分类和回归问题。

对于分类问题,CART算法通过衡量不纯度(impurity)来选择划分特征和划分点。

常用的不纯度指标包括基尼指数(Gini index)和信息增益(information gain)。

基尼指数衡量了随机从一个样本集合中抽取两个样本,其中属于不同类别的概率;信息增益则使用熵(entropy)作为不纯度的度量标准。

CART算法会选择使得划分后的子集的纯度提升最大的特征属性和相应的划分点进行划分。

对于回归问题,CART算法通过最小化划分后的子集的方差来选择划分特征和划分点。

在每个内部节点上,CART算法选择使得划分后的子集的方差最小化的特征属性和相应的划分点进行划分。

CART算法的优点在于它能够处理高维数据和有缺失值的数据,具有较强的鲁棒性。

此外,CART算法构建的决策树具有可解释性,能够提供对数据的直观理解。

同时,CART算法还能处理不平衡类别数据和多类别问题。

然而,CART算法也存在一些不足之处。

首先,CART算法是一种局部最优算法,可能会陷入局部最优解而无法达到全局最优解。

其次,CART 算法不适用于处理连续型特征属性,需要对连续特征进行离散化处理。

此外,由于CART算法是自顶向下的贪心算法,因此容易过拟合,需要采用一些剪枝策略进行模型的修剪。

在实际应用中,为了提高CART算法的性能,可以使用集成学习方法如随机森林、梯度提升树等。

这些方法通过构建多个CART模型,并通过集成的方式来提高预测准确率和鲁棒性。

总结起来,CART算法是一种经典的大数据分析算法,适用于解决分类和回归问题。

CART算法

这(2)里计输算样入本标集题D的文基字尼系数,如果基尼系数小于阈值,则返回决策树子树,当前节点停止

递归。 (3)计算当前节点现ቤተ መጻሕፍቲ ባይዱ的各个特征的各个特征值对数据集D的基尼系数,对于离散值和连续

值的处理方法和基尼系数的计算见第二节。缺失值的处理方法和C4.5算法里描述的相同。 (4)在计算出来的各个特征的各个特征值对数据集D的基尼系数中,选择基尼系数最小的特

剪枝损失函数表达式:

α为正则化参数(和线性回归的正则化一样),C(Tt)为训练数据的预测误差,|Tt|是子树T叶 子节点数量。

当α = 0时,即没有正则化,原始生成的CART树即为最优子树。当α= ∞时,正则化强 度最大,此时由原始的生成CART树的根节点组成的单节点树为最优子树。当然,这是两种 极端情况,一般来说,α越大,剪枝剪的越厉害,生成的最优子树相比原生决策树就越偏小。 对于固定的α,一定存在使得损失函数Cα(Tt)最小的唯一子树。

CART既能是分类树,又能是 回归树。

如果我们想预测一个人是否 已婚,那么构建的CART将是分类 树,其叶子节点的输出结果为一个 实际的类别,在这个例子里是婚姻 的情况(已婚或者未婚),选择叶 子节点中数量占比最大的类别作为 输出的类别。

如果想预测一个人的年龄, 那么构建的将是回归树,预测用户 的实际年龄,是一个具体的输出值。 怎样得到这个输出值?一般情况下 选择使用中值、平均值或者众数进 行表示。

04 CART树算法的剪枝

剪枝的思路: 对于位于节点t的任意一颗子树Tt,如果没有剪枝,损失函数是:

如果将其剪掉,仅保留根节点,损失函数是:Cα(T)= C(T)+ α 当α= 0或α很小,Cα(Tt) < Cα(T),当α增大到一定程度时 Cα(Tt) = Cα(T) 当α继续增大时不等式反向,即满足下式:

2024年度《cart基础知识》ppt课件

通过分析模型中各个变量的贡献度, 判断哪些变量对模型的预测性能影响 较大,为后续模型优化提供依据。

2024/3/23

13

提高模型性能策略分享

特征工程

通过对原始特征进行变换 、组合、筛选等操作,提 取出更有代表性的特征, 提高模型的预测性能。

模型集成

将多个单一模型进行集成 ,利用各个模型的优势, 提高整体模型的预测性能 。常见的集成方法包括 Bagging、Boosting等。

剪枝

为了防止决策树过拟合,需要对决策树进行剪枝操作,即 删除一些不必要的分支和节点,使得决策树更加简洁和泛 化能力更强。

2024/3/23

特征选择

在构建决策树时,需要选择合适的特征进行分裂,特征选 择的目标是找到能够最大化分类能力或减少误差的特征。

交叉验证

一种评估模型性能的方法,将数据集分为训练集和测试集 ,多次重复该过程并取平均值来评估模型性能的稳定性和 可靠性。

适用于高维数据

CART算法能够处理高维数据,并自动选择重要的变量 进行建模。

具有一定的鲁棒性

CART算法对异常值和噪声数据具有一定的鲁棒性,能 够减少它们对模型的影响。

5

相关术语解析

决策树

一种树形结构,其中每个内部节点表示一个特征属性上的 判断条件,每个分支代表一个可能的属性值,每个叶节点 表示一个类别或数值预测结果。

26

THANKS

感谢观看

2024/3/23

27

模型构建

使用CART算法构建分类模型, 通过训练集学习分类规则。

2024/3/23

特征工程

提取交易金额、交易时间、交 易地点等关键特征,并进行归 一化和编码处理。

模型评估

采用准确率、召回率、F1值等 指标评估模型性能,并使用交

CART算法介绍

基尼系数 Gene coefficient

Part Five 分类树生成算法

05 Part Five 分类树生成ቤተ መጻሕፍቲ ባይዱ法

(1)计算现有特征对该数据集的基尼指数,对 于每一个特征A,可以对样本点A是否为a可 以将数据集D分成数据集D1,D2D1,D2 (2)对于所有的特征A和所有可能的切分点a, 选择基尼指数最小的特征以及相对应的切分 点作为最优特征和最佳切分点。 (3)对最优子树递归调用(1)(2),直到满足停 止条件。 (4)生成CART分类树。

CART算法——分类决策树算法

目录

01CART 02基本思想 03CART树的特点 04回归树的生成 05分类树的生成及算法 06剪枝处理

Part One CART

01 Part One CART

分类回归树模型由Breiman 等人在1984年提出,是应用 广泛的决策树学习方法。 CART同样由特征选择、树的 生成以及剪枝组成,既可以 用于分类也可以用于回归。 同样属于决策树的一种。

04 Part Four 分类树的生成

对于给定的样本集合D,其基尼指数为

其中,Ck是D中属于第k类的样本子集,K是类的个数。 |Ck|和D分别表示子集的个数和样本的个数。 如果样本集合D根据特征A是否取某一可能的值α被分 割成D1和D2,即

所以在特征A的条件下集合D的基尼指数为

其中基尼指数Gini(D)表示集合的不确定性,基尼指 数G(D,A)表示A=a分解后集合的不决定性。基尼指数 越大,样本集合的不确定性越大。

Part Six 剪枝处理

06 Part Six 剪枝处理

剪枝是决策树学习算法中对付过拟合的主要手段。主 要是从已生成的书中剪掉一些子树或者叶子节点,并 将根节点或者父节点作为新的叶子节点,从而简化分 类树模型。

CART培训课件(2024)

Chapter

2024/1/30

23

回归树构建过程剖析

2024/1/30

特征选择

01

通过计算每个特征的基尼指数或信息增益,选择最优特征进行

分裂。

决策树生成

02

基于选定的特征,将数据集划分为若干子集,并递归地构建子

树,直到满足停止条件。

剪枝处理

03

为避免过拟合,对生成的决策树进行剪枝处理,包括预剪枝和

数据清洗

处理缺失值、异常值、重 复值等,保证数据质量。

2024/1/30

数据转换

包括数据类型转换、特征 编码、数据标准化等,以 满足模型输入要求。

数据分箱

将连续变量离散化,减少 模型复杂度,提高模型稳 定性。

9

特征选择技巧

通过模型训练效果来评价特征子 集的好坏,如递归特征消除等。

利用模型输出的特征重要性评分 进行特征筛选。

2024/1/30

26

07

总结回顾与拓展延伸

Chapter

2024/1/30

27

关键知识点总结回顾

2024/1/30

CART算法原理

详细介绍了CART算法的基本原理,包括决策树的构建、剪枝等 过程。

特征选择与划分

讲解了CART算法中如何进行特征选择和划分,包括基尼指数、 信息增益等评估指标。

模型评估与优化

分布平衡。

2024/1/30

欠采样

从多数类样本中随机选择部分 样本,减少多数类样本数量, 使类别分布平衡。

SMOTE算法

通过对少数类样本进行插值来 生成新的少数类样本,使类别 分布平衡。

代价敏感学习

为不同类别的样本设置不同的 误分类代价,使得模型在训练 过程中更加关注少数类样本。

决策树--CART树详解

决策树--CART树详解1.CART简介CART是⼀棵⼆叉树,每⼀次分裂会产⽣两个⼦节点。

CART树分为分类树和回归树。

分类树主要针对⽬标标量为分类变量,⽐如预测⼀个动物是否是哺乳动物。

回归树针对⽬标变量为连续值的情况,⽐如预测⼀个动物的年龄。

如果是分类树,将选择能够最⼩化分裂后节点GINI值的分裂属性;如果是回归树,选择能够最⼩化两个节点样本⽅差的分裂属性。

CART跟其他决策树算法⼀样,需要进⾏剪枝,才能防⽌算法过拟合从⽽保证算法的泛化性能。

2.CART分类树2.1算法详解CART分类树预测分类离散型数据,采⽤基尼指数选择最优特征,同时决定该特征的最优⼆值切分点。

分类过程中,假设有K个类,样本点属于第k个类的概率为Pk,则概率分布的基尼指数定义为根据基尼指数定义,可以得到样本集合D的基尼指数,其中Ck表⽰数据集D中属于第k类的样本⼦集。

如果数据集D根据特征A在某⼀取值a上进⾏分割,得到D1,D2两部分后,那么在特征A下集合D的基尼系数如下所⽰。

其中基尼系数Gini(D)表⽰集合D的不确定性,基尼系数Gini(D,A)表⽰A=a分割后集合D的不确定性。

基尼指数越⼤,样本集合的不确定性越⼤。

对于属性A,分别计算任意属性值将数据集划分为两部分之后的Gain_Gini,选取其中的最⼩值,作为属性A得到的最优⼆分⽅案。

然后对于训练集S,计算所有属性的最优⼆分⽅案,选取其中的最⼩值,作为样本及S的最优⼆分⽅案。

2.1实例详解针对上述离散型数据,按照体温为恒温和⾮恒温进⾏划分。

其中恒温时包括哺乳类5个、鸟类2个,⾮恒温时包括爬⾏类3个、鱼类3个、两栖类2个,如下所⽰我们计算D1,D2的基尼指数。

然后计算得到特征体温下数据集的Gini指数,最后我们选择Gain_Gini最⼩的特征和相应的划分。

3.CART回归树3.1算法详解CART回归树预测回归连续型数据,假设X与Y分别是输⼊和输出变量,并且Y是连续变量。

在训练数据集所在的输⼊空间中,递归的将每个区域划分为两个⼦区域并决定每个⼦区域上的输出值,构建⼆叉决策树。

机器学习--CART算法

yes

fair

yes

>40

no

excellen t

no

m ed iu m

例:属性“student”的Gini指数计算过程如下

属性“student”有yes和no两个属性值:

, =

7

=

−

14

7

7

+

14

14

−

7

+

−

14

−

Gini指数

= ′ = 1 − 2

=1 ′ ≠

=1

反映了从 D 中随机抽取两个样例,其类别标记不一致的概率。

属性 a 的基尼指数:

1

2

, =

1 +

2

∆ = − ,

m ed iu m

no

fair

no

<=30

lo w

yes

fair

yes

>40

m ed iu m

yes

fair

yes

<=30

m ed iu m

yes

excellen t

yes

31…40 m ed iu m

no

excellen t

yes

31…40 h igh

yes

fair

yes

>40

no

excellen t

<=30

h igh

no

fair

no

<=30

分类和回归树CART教学课件

CART算法的计算复杂度相对较低,对于大规模数据的处理速度较快 。

缺点

容易过拟合

CART算法倾向于构建完全准 确的决策树,这可能导致在训 练数据上的性能很好,但在测 试数据上的性能较差,即过拟 合。

对异常值敏感

CART算法对异常值比较敏感 ,异常值可能会对树的生成产 生较大影响。

可能产生泛化能力较差的 模型

树的评估

要点一

总结词

树的评估是通过使用测试数据集来评估模型的表现,以避 免过拟合和欠拟合问题。

要点二

详细描述

在CART算法中,树的评估是在训练过程中使用测试数据集 来评估模型的表现。通过比较测试数据集上的预测结果和 真实结果,可以评估模型的准确率、精度、召回率等指标 。此外,还可以使用交叉验证等技术来评估模型的泛化能 力。评估结果可以用于调整模型参数、改进特征选择和剪 枝策略等,以提高模型的表现。

高维特征的处理

随着数据维度的增加,如何有效地处理高维特征 ,避免维度诅咒,是CART算法面临的一个重要 问题。

深度学习与CART算法的融合

探索如何将深度学习的思想与CART算法相结合 ,以实现更强大的特征学习和模型表达能力。

未来可能的应用前景

金融风险评估

利用CART算法构建风险评估模型,帮助金融机构识 别和预防潜在的风险。

树的剪枝

总结词

树的剪枝是为了解决过拟合问题,通过去除 部分分支来简化模型。

详细描述

在CART算法中,树的剪枝是通过去除部分 分支来简化模型的过程。剪枝的目的是提高 模型的泛化能力,减少过拟合的风险。剪枝 可以通过后剪枝和预剪枝两种方式进行。后 剪枝是在生成完整的决策树后进行剪枝,而 预剪枝是在生成决策树的过程中提前停止树 的生长。

大数据经典算法CART 讲解PPT课件

可编辑课件

12

Gini(t1)=1-(2/4)²-(2/4)²=0.5 Gini(t2)=1-(0/4)²-(4/4)²=0 Gini(t3)=1-(1/2)²-(1/2)²=0.5 Gini=4/10×0.5+4/10×0+2/10×0.5=0.3

Gini(t1)=1-(6/8)²-(2/8)²=0.375 Gini(t2)=1-(1/2)²-(1/2)²=0.5 Gini=8/10×0.375+2/10×0.5=0.4

的样本集分为两个子样本集,使得生成的决 策树的每个非叶子节点都有两个分支。

CART算法生成的决策树是结构简洁的二叉树。

可编辑课件

3

摘要

递归划分自变量空间 验证数据进行剪枝

模型评价

可编辑课件

4

Hunt算法

设Dt是与节点t相关联的训练记录集, y={y1,y2,…,yc}是类标号。 Hunt算法的递归定义如下: (1)如果Dt中所有记录都属于同一个类yt,则t是

(第四组)分类与回归树算法(CART)

可编辑课件

1

分类与回归

分类 ——划分离散变量

回归——划分连续变量

可编辑课件

2

什么是CART

分类与回归树

welcome to use these PowerPoint templates, New ConCteAnRtTd采es用ig一n, 种10二y分ea递rs归ex分pe割rie的n技ce术,将当前

当分类回归树划分得太细时,会对噪声数据产 生过拟合作用。因此我们要通过剪枝来解决

前剪枝:停止生长策略

后剪枝:在允许决策树得到最充分生长的基础上, 再根据一定的规则,自下而上逐层进行剪枝。

分类回归树(CART)

分类回归树(CART)概要本部分介绍 CART,是⼀种⾮常重要的机器学习算法。

基本原理CART 全称为 Classification And Regression Trees,即分类回归树。

顾名思义,该算法既可以⽤于分类还可以⽤于回归。

克服了 ID3 算法只能处理离散型数据的缺点,CART 可以使⽤⼆元切分来处理连续型变量。

⼆元切分法,即每次把数据集切分成两份,具体地处理⽅法是:如果特征值⼤于给定值就⾛左⼦树,否则就⾛右⼦树。

对 CART 稍作修改就可以处理回归问题。

先前我们使⽤⾹农熵来度量集合的⽆组织程度,如果选⽤其它⽅法来代替⾹农熵,就可以使⽤树构建算法来完成回归。

本部分将构建两种树,第⼀种是回归树,其每个叶节点包含单个值;第⼆种是模型树,其每个叶节点包含⼀个线性⽅程。

回归树要对树据的复杂关系建模,我们已经决定⽤树结构来帮助切分数据,那么如何实现数据的切分呢?怎么才能知道是否已经充分切分呢?这些问题的答案取决于叶节点的建模⽅式。

回归树假设叶节点是常数值,需要度量出数据的⼀致性,在这⾥我们选择使⽤平⽅误差的总值来达到这⼀⽬的。

选择特征的伪代码如下:对每个特征:对每个特征值:将数据切分成两份(⼆元切分)计算切分的误差(平⽅误差)如果当前误差⼩于当前最⼩误差,那么将当前切分设定为最佳切分并更新最⼩误差返回最佳切分的特征和阈值与 ID3 或 C4.5 唯⼀不同的是度量数据的⼀致性不同,前两者分别是信息增益和信息增益率,⽽这个是⽤平⽅误差的总值,有⼀点聚类的感觉。

⽐如这样的数据集:程序创建的树结构就是:{'spInd': 0, 'spVal': 0.48813000000000001, 'left': 1.0180967672413792, 'right': -0.044650285714285719}在分类树中最常⽤的是基尼指数:在分类问题中,假设有K个类,样本点属于第k类的概率为p k,则概率分布的基尼指数定义为Gini(p)=K∑k=1p k(1−p k)=1−K∑k=1p2k基尼系数与熵的特性类似,也是不确定性的⼀种度量。

机器学习实战---决策树CART简介及分类树实现

机器学习实战---决策树CART简介及分类树实现⼀:CART算法简介(⼀)CART、ID3、C4.5⽐较CART算法的全称是Classification And Regression Tree,采⽤的是Gini指数(选Gini指数最⼩的特征s)作为分裂标准,同时它也是包含后剪枝操作。

ID3算法和C4.5算法虽然在对训练样本集的学习中可以尽可能多地挖掘信息,但其⽣成的决策树分⽀较⼤,规模较⼤。

为了简化决策树的规模,提⾼⽣成决策树的效率,就出现了根据GINI系数来选择测试属性的决策树算法CART。

(⼆)CART分类与回归CART分类与回归树本质上是⼀样的,构建过程都是逐步分割特征空间,预测过程都是从根节点开始⼀层⼀层的判断直到叶节点给出预测结果。

只不过分类树给出离散值,⽽回归树给出连续值(通常是叶节点包含样本的均值),另外分类树基于Gini指数选取分割点,⽽回归树基于平⽅误差选取分割点。

(三)1.ID3、C4.5在ID3算法中我们使⽤了信息增益来选择特征,信息增益⼤的优先选择。

在C4.5算法中,采⽤了信息增益⽐来选择特征,以减少信息增益容易选择特征值多的特征的问题。

但是⽆论是ID3还是C4.5,都是基于信息论的熵模型的,这⾥⾯会涉及⼤量的对数运算。

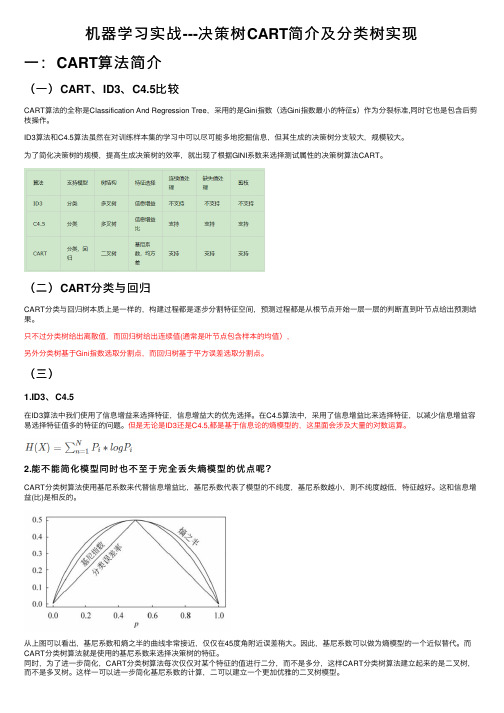

2.能不能简化模型同时也不⾄于完全丢失熵模型的优点呢?CART分类树算法使⽤基尼系数来代替信息增益⽐,基尼系数代表了模型的不纯度,基尼系数越⼩,则不纯度越低,特征越好。

这和信息增益(⽐)是相反的。

从上图可以看出,基尼系数和熵之半的曲线⾮常接近,仅仅在45度⾓附近误差稍⼤。

因此,基尼系数可以做为熵模型的⼀个近似替代。

⽽CART分类树算法就是使⽤的基尼系数来选择决策树的特征。

同时,为了进⼀步简化,CART分类树算法每次仅仅对某个特征的值进⾏⼆分,⽽不是多分,这样CART分类树算法建⽴起来的是⼆叉树,⽽不是多叉树。

这样⼀可以进⼀步简化基尼系数的计算,⼆可以建⽴⼀个更加优雅的⼆叉树模型。

cart算法停止条件

cart算法停止条件

CART算法是一种常用的决策树算法,它通过不断地对数据进行划分,最终生成一棵决策树。

在CART算法中,停止条件的设置非常重要,

它直接影响到算法的性能和结果。

本文将详细介绍CART算法的停止

条件。

CART算法的停止条件主要包括两个方面:树的深度和节点中样本数量的阈值。

首先,树的深度是指决策树的层数。

在CART算法中,如果决策树的

深度达到了预设的最大深度,算法就会停止。

这是因为决策树的深度

越深,模型的复杂度就越高,容易出现过拟合的情况。

因此,设置合

适的最大深度可以有效地避免过拟合问题。

其次,节点中样本数量的阈值是指当某个节点中的样本数量小于预设

的阈值时,算法就会停止划分。

这是因为当节点中的样本数量过少时,划分的效果会变得不稳定,容易出现过拟合的情况。

因此,设置合适

的样本数量阈值可以有效地避免过拟合问题。

除了上述两个停止条件外,CART算法还可以根据其他指标来设置停止条件,例如节点的不纯度、信息增益等。

不过,这些指标的设置需要

根据具体的问题和数据集来确定,不能一概而论。

总之,CART算法的停止条件是非常重要的,它直接影响到算法的性能和结果。

在实际应用中,我们需要根据具体的问题和数据集来设置合适的停止条件,以达到最好的效果。

cart回归树公式

cart回归树公式

Cart回归树是一种基于二元分割的决策树算法,主要用于解决

回归问题。

其基本原理是将训练集分割成多个小的子集,并在每个子集上构建一个简单的线性回归模型,然后将这些子集合并起来,形成一棵回归树。

Cart回归树的公式如下:

1. 首先,选择一个最优的分割点s和最优的分割变量j,使得

将训练集D划分为D_1和D_2两个子集后,能够最大化子集D_1和

D_2中的响应变量的方差之和,即:

s*, j* = argmax_{s, j} [sum_{x_i in D_1(j, s)}(y_i - hat y_{D_1})^2 + sum_{x_i in D_2(j, s)}(y_i - hat y_{D_2})^2] 其中,D_1(j, s)表示第j个变量小于等于s的样本集合,D_2(j, s)表示第j个变量大于s的样本集合;hat y_{D_1}和hat y_{D_2}

分别表示在D_1和D_2上的响应变量的平均值。

2. 然后,以s*和j*为分割条件,将D划分为D_1和D_2两个子集。

3. 对D_1和D_2分别重复步骤1和步骤2,直到达到停止条件(如达到最大深度、子集样本数少于某个阈值等),生成一棵回归树。

4. 对于新的样本x,根据回归树上的分割条件,将其划分到相

应的叶子节点,然后用该叶子节点上的响应变量的平均值作为预测值。

Cart回归树是一种非常简单而且具有很好的可解释性的模型,

但是它也存在一些问题,例如容易过拟合、对数据的离群值比较敏感

等。

因此,在实际应用中,我们通常会使用一些改进的算法,如随机森林、梯度提升树等。

解析CART决策树模型及其解释性

解析CART决策树模型及其解释性决策树是一种常用的机器学习算法,用于解决分类和回归问题。

其中,CART (Classification and Regression Trees)决策树模型是一种特殊的决策树模型,具有较高的解释性和预测能力。

本文将对CART决策树模型及其解释性进行深入探讨。

一、决策树模型的基本原理决策树模型基于一系列决策规则进行分类或回归预测。

其基本原理是通过对数据集进行递归划分,构建一棵二叉树,其中每个非叶子节点代表一个决策规则,每个叶子节点代表一个类别或数值输出。

CART决策树模型的构建过程主要包括以下几个步骤:1. 特征选择:选择一个最佳的特征作为当前节点的划分标准,常用的特征选择方法有信息增益、信息增益比、基尼指数等。

2. 划分数据集:根据选定的特征和划分标准,将数据集划分为多个子集,每个子集对应一个分支。

3. 递归构建子树:对每个子集递归地重复步骤1和步骤2,直到满足停止条件,例如达到预定的树深度或子集中的样本数小于某个阈值。

4. 剪枝处理:对已构建的决策树进行剪枝处理,以防止过拟合。

二、CART决策树模型的解释性CART决策树模型具有较高的解释性,主要体现在以下几个方面:1. 易于理解和解释:CART决策树模型构建的决策树形式直观,每个节点代表一个决策规则,每个分支代表一个特征取值,可以清晰地展示特征与目标变量之间的关系。

通过观察决策树的结构,可以直接理解模型的判断过程和预测结果,便于解释模型的决策依据。

2. 可视化展示:CART决策树模型可以通过可视化工具将决策树以图形的形式展示出来,更加直观地呈现模型的结构和规则。

通过对决策树的观察,可以快速了解模型的特征重要性和决策路径,有助于深入理解模型的运作机制。

3. 特征重要性评估:CART决策树模型可以通过统计特征在决策树中的使用频率或平均信息增益等指标,评估特征的重要性。

这些指标可以帮助我们识别出对目标变量具有较大影响力的特征,从而进行特征选择和特征工程,提高模型的预测性能。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

策树的每个非叶子节点都有两个分支。

CART算法生成的决策树是结构简洁的二叉树。

摘要

递归划分自变量空间

验证数据进行剪枝

模型评价

Hunt算法

设Dt是与节点t相关联的训练记录集, y={y1,y2,…,yc}是类标号。 Hunt算法的递归定义如下: (1)如果Dt中所有记录都属于同一个类yt,则t是 叶子节点。 (2)如果Dt中包含属于多个类的记录,则选择一 个属性测试条件,将记录划分成较小的子集。 对于测试条件的每一个输出创建一个子女结 点,并根据测试结果将Dt中的记录分布到子 女结点中。然后,对于每个子女结点,递归 调用该算法。

分险

收益

利润

Thank you!

GINI (t ) 1 [ p( j t )]

j

2

p ( j t ) 是结点t中类j的相对频率 最大值:(1 - 1/nc),记录在所有类中等分布 最小值:0,所有记录属于同一个类

如何划分训练记录

如何表示测试条件

根据属性类型的不同: 标称属性 序数属性 连续属性 根据分割的数量 二元划分 多元化分

离异或已婚 单身 Gini(t1)=1-(5/6)²-(1/6)²=0.2778 5 2 Gini(t2)=1-(2/4)²-(2/4)²=0.5 否 1 2 Gini=6/10×0.2778+4/10×0.5=0.3667 是

是 否

100 120 125 220 55 65 72 80 87 92 97 110 122 172 230 ≤ > ≤ > ≤ > ≤ > ≤ > ≤ > ≤ > ≤ > ≤ > ≤ > ≤ > 0 3 0 3 0 3 0 3 1 2 2 1 3 0 3 0 3 0 3 0 3 0 0 7 1 6 2 5 3 4 3 4 3 4 3 4 4 3 5 2 6 1 7 0

(第四组)分类与回归树算法(CART)

分类与回归

分类 ——划分离散变量

回归——划分连续变量

什么是CART

分类与回归树

welcome to use these PowerPoint templates, New CART采用一种二分递归分割的技术,将当前 Content design, 10 years experience 的样本集分为两个子样本集,使得生成的决

ቤተ መጻሕፍቲ ባይዱ

单身或已婚 离异 Gini(t1)=1-(6/8)²-(2/8)²=0.375 6 1 Gini(t2)=1-(1/2)²-(1/2)²=0.5 否 2 1 Gini=8/10×0.375+2/10×0.5=0.4 是

单身或离异 已婚 Gini(t1)=1-(3/6)²-(3/6)²=0.5 3 4 Gini(t2)=1-(4/4)²-(0/4)²=0 否 3 0 Gini=6/10×0.5+4/10×0=0.3 是

训 练 集

如何以递归方式建立决策树?

决策树

如何划分训练记录? 如何表示属性测试条件? 如何确定最佳划分? 如何构建测试条件效果最好的树?

如何确定最佳划分

贪婪法:根据子女结点类分布的一致性程度来 选择最佳划分 度量结点的不纯度 Gini 熵 误分类误差

不纯度度量——GINI

对于一个给定的结点t:

60

70

75

85

90

95

Gini 0.420 0.400 0.375 0.343 0.417 0.400 0.300 0.343 0.375 0.400 0.420

测试条件效果

• 为确定测试条件划分,比较父节点(划分前)的 不纯度和子女结点的不纯度,差越大测试效果就 越好

•

不变值

决策树停止生长条件

节点达到完全纯度

树的深度达到用户所要的深度

节点中样本个数少于用户指定个数

异质性指标下降的最大幅度小于用户指定的幅度

决策树(Hunt算法)

有房者 拖欠贷款者=否 是 拖欠贷款者=是 否 拖欠贷款者=否

有房者 是 拖欠贷款者=否 单身 离异 年收入 <80K 拖欠贷款者=否 否 婚姻状况 是 已婚 拖欠贷款者=否 拖欠贷款者=否 ≥80K 拖欠贷款者=是 单身 离异 拖欠贷款者=是 婚姻状况 已婚 拖欠贷款者=否 有房者 否

选择最佳分割点

数值型变量

对记录的值从小到大排序,计算每个值作为临界点 产生的子节点的异质性统计量。能够使异质性减小程 度最大的临界值便是最佳的划分点。

分类型变量

列出划分为两个子集的所有可能组合,计算每种组合下 生成子节点的异质性。同样,找到使异质性减小程度最大 的组合作为最佳划分点。

有房 无房 否 是 3 0 4 3

一递归划分自变量空间

tid 有房者 婚姻状况 年收入 拖欠贷款者

1 2 3 4 5 6 7 8 9 10 是 否 否 是 否 否 是 否 否 否 单身 已婚 单身 已婚 离异 已婚 离异 单身 已婚 单身 125K 100K 70K 120K 95K 60K 220K 85K 75K 90K 否 否 否 否 是 否 否 是 否 是

Gini(t1)=1-(3/3)²-(0/3)²=0 Gini(t2)=1-(4/7)²-(3/7)²=0.4849 Gini=0.3×0+0.7×0.4898=0.343

单身 已婚 离异 Gini(t1)=1-(2/4)²-(2/4)²=0.5 Gini(t2)=1-(0/4)²-(4/4)²=0 4 1 Gini(t3)=1-(1/2)²-(1/2)²=0.5 否 2 0 1 Gini=4/10×0.5+4/10×0+2/10×0.5=0.3 是 2

剪枝

当分类回归树划分得太细时,会对噪声数据产 生过拟合作用。因此我们要通过剪枝来解决

前剪枝:停止生长策略

后剪枝:在允许决策树得到最充分生长的基础上, 再根据一定的规则,自下而上逐层进行剪枝。

剪枝方法

2

最小误差剪枝

代价复杂性

1

悲观误差剪枝

3

代价复杂性剪枝

模型评价

减少在冒险因素或损失因素方面的不确定性。 不仅包括不同模型的比较,而且还要对模型产 生结果的商业价值进行比较。模型评价的角度 有: