信息论与编码_曹雪虹_张宗橙_北京邮电大学出版社课后习题答案

信息论与编码-曹雪虹-课后习题答案(精选.)

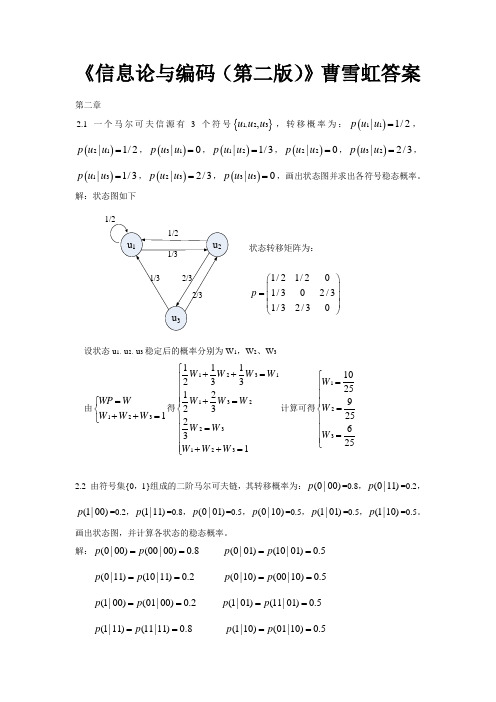

《信息论与编码》-曹雪虹-课后习题答案 第二章2.1一个马尔可夫信源有3个符号{}1,23,u u u ,转移概率为:()11|1/2p u u =,()21|1/2p uu =,()31|0p u u =,()12|1/3p u u =,()22|0p u u =,()32|2/3p u u =,()13|1/3p u u =,()23|2/3p u u =,()33|0p u u =,画出状态图并求出各符号稳态概率。

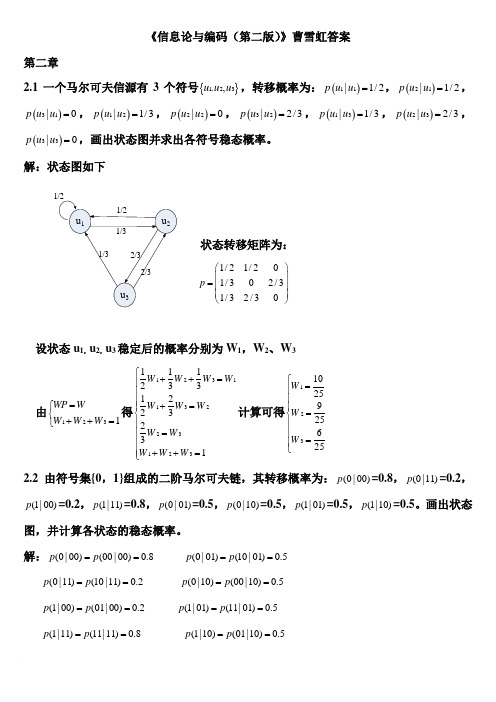

解:状态图如下状态转移矩阵为:1/21/201/302/31/32/30p ⎛⎫ ⎪= ⎪ ⎪⎝⎭设状态u 1,u 2,u 3稳定后的概率分别为W 1,W 2、W 3由1231WP W W W W =⎧⎨++=⎩得1231132231231112331223231W W W W W W W W W W W W ⎧++=⎪⎪⎪+=⎪⎨⎪=⎪⎪⎪++=⎩计算可得1231025925625W W W ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩2.2 由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:(0|00)p =0.8,(0|11)p =0.2,(1|00)p =0.2,(1|11)p =0.8,(0|01)p =0.5,(0|10)p =0.5,(1|01)p =0.5,(1|10)p =0.5。

画出状态图,并计算各状态的稳态概率。

解:(0|00)(00|00)0.8p p == (0|01)(10|01)0.5p p ==(0|11)(10|11)0.2p p == (0|10)(00|10)0.5p p == (1|00)(01|00)0.2p p == (1|01)(11|01)0.5p p == (1|11)(11|11)0.8p p == (1|10)(01|10)0.5p p ==于是可以列出转移概率矩阵:0.80.200000.50.50.50.500000.20.8p ⎛⎫ ⎪⎪= ⎪ ⎪⎝⎭状态图为:设各状态00,01,10,11的稳态分布概率为W 1,W 2,W 3,W 4 有411i i WP W W ==⎧⎪⎨=⎪⎩∑ 得 13113224324412340.80.50.20.50.50.20.50.81W W W W W W W W W W W W W W W W +=⎧⎪+=⎪⎪+=⎨⎪+=⎪+++=⎪⎩ 计算得到12345141717514W W W W ⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求:(1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息; (3) 两个点数的各种组合(无序)对的熵和平均信息量;(4) 两个点数之和(即2, 3, … , 12构成的子集)的熵;(5) 两个点数中至少有一个是1的自信息量。

信息论与编码(曹雪虹 张宗橙)第二、三章答案

2-1.解:该一阶马尔可夫信源,由转移概率构成的转移矩阵为:对应的状态图如右图所示。

设各符号稳定概率为:1p ,2p ,3p 则可得方程组: 1p =211p +312p +313p 2p =211p +323p3p =322p1p +2p +3p =1解得各符号稳态概率为:1p =2510,2p =259,3p =256 2-2.解:该马尔可夫信源的符号条件概率矩阵为:状态转移概率矩阵为:对应的状态图如右图所示。

设各状态的稳态分布概率为1W ,2W ,3W ,4W ,则可得方程组为:1W =0.81W +0.53W 2W =0.21W +0.53W 3W =0.52W +0.24W4W =0.52W +0.84W1W +2W +3W +4W =1解得稳定分布的概率为:1W =145,2W =142,3W =142,4W =145 2-3.解:(1)“3和5同时出现”事件的概率为: p(3,5)=181故其自信息量为: I(3,5)=-㏒2181=4.17bit (2)“两个1同时出现”事件的概率为:p(1,1)=361故其自信息量为: I(1,1)=- ㏒2361=5.17bit (3)两个点数的各种组合构成的信源,其概率空间为:则该信源熵为: H(x 1)=6×361lb36+15×181lb18=4.337bit/事件(4)两个点数之和构成的信源,其概率空间为:则该信源的熵为: H(x 2)=2×361lb36+2×181lb18+2×121lb12+2×91lb9+2×365lb 536+61lb6=3.274bit/事件(5)两个点数中至少有一个是1的概率为: p(1)=3611 故其自信息量为:I(1)= -㏒23611=1.7105bit 2-7.解:(1)离散无记忆信源的每个符号的自信息量为I(x 1)= -㏒283=1.415bit I(x 2)= -㏒241=2bitI(x 3)= -㏒241=2bitI(x 4)= -㏒281=3bit(2)由于信源发出消息符号序列有12个2,14个0,13个1,6个3,故该消息符号序列的自信息量为: I(x)= -㏒2(83)14 (41)25 (81)6=87.81bit平均每个符号携带的信息量为: L H (x)=45)(x I =1.95bit/符号 2-10解:用1x 表示第一次摸出的球为黑色,用2x 表示第一次摸出的球为白色,用1y 表示第二次摸出的球为黑色,用2y 表示第二次摸出的球为白色,则(1)一次实验包含的不确定度为:H(X)=-p(1x )lbp(1x )-p(2x )lbp(2x )=-13lb 13-23lb 23=0.92 bit (2)第一次实验X 摸出的球是黑色,第二次实验Y 给出的不确定度: H(Y|1x )=-p(1y |1x )lb p(1y |1x )-p(2y |1x )lb p(2y |1x )= -27lb 27-57lb 57= 0.86 bit(3)第一次实验X 摸出的球是白色,第二次实验Y 给出的不确定度:H(Y|2x )=-p(1y |2x )lb p(1y |2x )-p(2y |2x )lb p(2y |2x )= -514lb 514-914lb 914= 0.94 bit(4)第二次Y 包含的不确定度:H (Y|X )= -(,)(|)i j j i ijp x y lbp y x å= p(1x ) H(Y|1x )+p(2x )H(Y|2x ) =0.91 bit 2-11 解:(1)仅对颜色感兴趣的不确定度: H(colour)=H (238,1838,1838)= -238lb 238- 2´1838lb 1838=1.24 bit (2) 对颜色和数字都感兴趣的平均不确定度: H(clour,number)=H(number)= -18´118lb 118= 5.25 bit (3)颜色已知的条件熵:H (number|colour )=H (colour,number )- H(colour)=(5.25-1.24) bit=4.01 bit 2-12 解:(1)实验X和Y的平均信息量: H(X,Y)= - (,)i j ijp x y ålb (,)i j p x y = -(,)i j ijr x y ålb (,)i j r x y=H(724,124,0,124,14,0,124,724) =2.3 bit/符号(2)由联合概率,可得p(1y )=11(,)p x y +21(,)p x y +31(,)p x y=11(,)r x y +21(,)r x y +31(,)r x y=724+124+0 =13同理可得P(2y )=p(3y )=13,则实验Y 的平均信息量:H(Y)=H(13,13,13)=1.58 bit/符号(3)在已知实验Y结果的条件下,实验X的平均信息量:H(X|Y)=H(X,Y)-H(Y)=(2.3-1.58) bit/符号=0.72 bit/符号2-13解:由X和Y的联合概率,可得P(x=0)=p(x=0,y=0)+p(x=0,y=1)= 18+38=12同理,p(x=1)= 12, p(y=0)=p(y=1)=12由于Z=XY,由X和Y的联合概率,可得P(z=0)= P(x=0,y=0)+P(x=1,y=0)+P(x=0,y=1)= 7 8P(z=1)=p(x=1,y=1)= 1 8P(x=0,z=0)= P(x=0,y=0)+ P(x=0,y=1)= 12, P(x=0,z=1)=0P(x=0,y=0)P(x=0,y=0) P(x=0,y=0) P(x=0,y=0)P(x=1,z=0)= P(x=1,y=0)= 38, P(x=1,z=1) =P(x=1,y=1)=18P(y=0,z=0)= 12P(y=0,z=1)=0 P(y=1,z=0)=38P(y=1,z=1)=18P(x=0,y=0,z=0)= 18P(x=0,y=0,z=1)=0 P(x=0,y=1,z=0)=38P(x=0,y=1,z=1)=0 P(x=1,y=0,z=0)= 38P(x=1,y=1,z=0)=0P(x=0,y=0,z=1)=0 P(x=0,y=1,z=1)=0 P(x=1,y=1,z=1)= 18,则:(1) H(X)=H(12,12)=1 bitH(Y)=H(12,12)=1 bitH(Z) =H(18,78)= 0.54 bitH(X,Z)=H(12,0,38,18)=1.41 bitH(Y,Z) =H(12,0,38,18)=1.41 bitH(X,Y,Z) =H(18,0,38,0,38,0,0,18)=1.8 bit(2) H(X,Y)=H(18,38,18, 38)=1.81 bitH(X|Y)= H(X,Y) – H(Y)=0.81 bit H(Y |X)= H(X,Y) – H(X)=0.81 bit H(X|Z)= H(X,Z) – H(Z)=0.87 bit H(Z|X)= H(X,Z) – H(X)=0.41 bit H(Y|Z)= H(Y ,Z) – H(Z)=0.87 bit H(Z|Y)=H(Y ,Z)-H(Y)=0.41bitH(X|Y ,Z)=H(X,Y ,Z)-H(Y ,Z)=0.4bit H(Y|X,Z)=H(X,Y ,Z)-H(X,Z)=0.4bit H(Z|X,Y)=H(X,Y ,Z)-H(X,Y)=0(3) I(X;Y)=H(X)-H(X|Y)=0.19bit I(X;Z)=H(X)-H(X|Z)=0.13bit I(Y;Z)=H(X)-H(Y|Z)=0.13bitI(X;Y|Z)=H(X|Z)-H(X|Y,Z)=0.47bit I(Y;Z|X)=H(Y|X)-H(Y|X,Z)=0.41bit I(X;Z|Y)=H(X|Y)-H(X|Y ,Z)=0.41bit 2-14 解:依题意,可得信道传输概率p(y=0|x=0)=1-p(y=1|x=0)=3/4, p(y=1|x=1)=1-p(y=0|x=1)=7/8 联合概率:p(x=0,y=0)=p(y=0|x=0)p(x=0)=3/8同理:p(x=0,y=1)=1/8,p(x=1,y=0)=1/16,p(x=1,y=1)=7/16 概率:p(y=0)=p(x=0,y=0)+p(x=1,y=0)=7/16 p(y=1)=p(x=0,y=1)+p(x=1,y=1)=9/16后验概率:p(x=0|y=0)=p(x=0,y=0)/p(y=0)=(3/8)/(7/16)=6/7 同理:p(x=1|y=0)=1/7,p(x=0|y=1)=2/9,p(x=1|y=1)=7/9,则(1) I (x;y=0)=(|0)(|0)log()i i ii p x y p x y p x ==å)22(0|0)(1|0)(0|0)log (1|0)log (0)(1)p x y p x y p x y p x y p x p x =======+====616177(log log )/0.41/117722bit bit =+=符号符号22222(|)()(|)log ()(0|0)(1|0)(0)(0|0)log (0)(1|0)log (0)(1)(0|1)(1|1)(0)(0|1)log (1)(1|1)log (0)(1)76(l 167i j j i j iji p x y p y p x y p x p x y p x y p y p x y p y p x y p x p x p x y p x y p y p x y p y p x y p x p x ========+=========+===+======å(2)I(X;Y)=222261277192977799og log log log )/111116716916922220.31/bit bit +++=符号符号21211111211212211212)(|)()(|)()(|)()112121722343412a P x a x a P x a P x a x a P x a P x a x a P x a =====+===+====???2-29 解:由已知起始概率和转移概率,可得:P(x 2223122211222122213255P(),()2424111111)(log log log ) 1.5224444111111H(|)(log log log ) 1.52244442211H(|)log 0log )0.9183333221H(|)log 333x a P x a bit bit x a bit bitx a bit bitx a =====---==---==-+-==--同理可得:由起始概率,可得:H(x 另外:21log 0)0.9183bit bit+=2111211222132332213122321333H(|)()(|)()(|)()(|)111( 1.50.9180.918) 1.209244H(|)()(|)()(|)()(|)755( 1.50.9180.918) 1.257122424x x P x a H x a P x a H x a P x a H x a bit bit x x P x a H x a P x a H x a P x a H x a bit bit H ==+=+==???==+=+==???12,31213121213212,3(,)H()H(|)H(|)H()H(|)H(|)(1.5 1.209 1.257) 3.996(,) 3.996()/331.322/L x x x x x x x x x x x x x x bit bitH x x x H x bit bit =++=++=++====符号符号12312311321231231231122332)w w w 122w w 23311w w 4311w w 43w w w 1833w ,w ,w ,141414()w (|)(|)(|)833( 1.50.9180.918) 1.251141414r r r w w w w H x H x a w H x a w H x a bit bit¥++=+=+=++=====++=???,(设各稳定时的概率为,,则解得:该链的极限平均符号熵为000111220(3)log 3 1.58/ 1.2511(/)10.211.417883333(log log log ) 1.4137/1414141414141.251()10.1151.4171.251/H bit r y H H H bit bit H r y H H H bit r ¥¥¥====-=-=-==---==-=-=-===符号符号符号2-30解:依题意,状态转移图如下图所示,其状态转移概率矩阵为P=213310⎛⎫⎪ ⎪ ⎪⎝⎭设状态稳定概率为1W 、2W ,则:231W +2W =1W 131W =2W 解得:1W =34 ;2W =141W +2W =1则:H(X |1S )=-232log 23-132log 13=0.918bit H(X |2S )=0信源熵为:H (X )=1W H(X |1S )+2W H(X |2S )=(34*0.918+14*0)bit=0.688bit2-32解:(1)由状态图,可得状态转移概率矩阵为:P=122122122p p p p p p p p p ⎛⎫- ⎪ ⎪ ⎪- ⎪ ⎪ ⎪- ⎪⎝⎭设状态稳定概率为1W ,2W ,3W ,则: (1-p )1W +2p 2W +2p3W =1W2p1W + (1-p) 2W +2p3W =2W 解得:1W =2W =3W =13,2p1W +2p2W +(1-p) 3W =3W 即p(0)=p(1)=p(2)= 131W +2W +3W =1(2) H(X|0)=H(X|1)=H(X|2)= - (1-p) 2log (1-p) -2p 2log 2p -2p 2log 2p= - (1-p) 2log (1-p) - p 2log 2pH ∞(X)=p(0)H(X|0)+p(1)H(X|1)+p(2)H(X|2)= - (1-p) 2log (1-p) - p 2log 2p bit (3) H(X)= 2log 3=1.58bit(4) 令()0dH X dp ∞=,得lnln(1)1120ln 2(1)ln 2ln 2ln 2pp p p --+---=- 解得p=23,则: 当p=23时,H ∞(X)= (- 132log 13-232log 13)bit =1.58 bit当p=0 时, H(X)=0当p=1时,H(X)=13-1 解(1)由输入概率分布和概率转移,可得: 00(,)p x y =00(|)p y x 0()p x =23*34=12同理,可得:01(,)p x y =14; 10(,)p x y =112; 11(,)p x y =16,则:0()p y =00(,)p x y +10(,)p x y =12+112=7121()p y =01(,)p x y +11(,)p x y =14+16=512因此,H(X)=( - 342log 34- 142log 14) bit =0.811 bit H(X ,Y)=( - 122log 12- 142log 14 - 1122log 112-162log 16)bit=1.73bit H(Y)=( -7122log 712 - 5122log 512)bit=0.98bit H(Y|X)=H(X ,Y)-H(X)=(1.73-0.811)bit=0.919 bitH(X|Y )= H(X ,Y)-H(X)=(1.73-0.98)bit=0.75bit I(X ;Y)=H(X)-H(X|Y)=(0.811-0.75)bit=0.061bit (2)该信道是对称DMC 信道,信道容量为 C= 2log m -1log mijij j pp =∑= 2log 2 +23 2log 23+ 13 2log 13=0.082bit 达到信道容量时输入概率分布为:0()p x = 1()p x =123-2 解:(1)由信源的概率分布和转移概率,可得11(,)p x y =11(|)p y x 1()p x =12α 同理可得:12(,)p x y =12α,13(,)p x y =0 ,21(,)p x y =12(1-α), 22(,)p x y =14(1-α),23(,)p x y =14(1-α),则:1()p y =11(,)p x y +21(,)p x y =12α+12(1-α)=12,同理可得: 2()p y =14α+14;3()p y =14(1-α)因此,接收端的平均不确定度为:2222211111111log ()log ()(1)log (1)22444444311log (1)log (1)()244bit -??--??+??=-+?-?(2)由于噪声产生的不确定度为:22222111111111(|X )=l o g l o g 0l o g l o g l o g 22222244443()22H Y bit ????--?---¶=-由于互信息为:223113I X;Y)=H(Y)-(Y|X)=[-log (1)log (1)]24422+?抖+?-?-(()令(;)0dI X Y d =¶,可得:35?,则:(3(;)()0.161bit 5max i p a C I X Y C ==?=)3-6 解:该信道的概率转移矩阵为 110022110022P=11002211022骣÷ç÷ç÷ç÷ç÷ç÷ç÷ç÷÷ç÷ç÷ç÷ç÷ç÷ç÷ç÷÷ç÷ç÷ç÷ç÷ç÷ç÷ç÷÷ç桫 可见,该信道为对称DMC 信道,因此,该信道的信道容量为: 42222211111C log m log log 4log ()log ()12222ij ij j p p bit ==+=++=å3-7解:(1)由发送符号的概率分布和转移概率,可得: 1111111(,)(|)()0.536p x y p y x p x ==? 同理可得:12132122233132331121(,),(,),(,),(,)10151510113(,),(,),(,),(,)0103010p x y p x y p x y p x y p x y p x y p x y p x y ========11121311211()(,)(,)(,)615303p y p x y p x y p x y =++=++= 同理可得:2311(),()26p y p y ==;111111(,)16(|)1()23p x y p x y p y ===同理可得:21311222321323331221(|)(|)(|)(|)5555313(|)(|)(|)(|)05105p x y p x y p x y p x y p x y p x y p x y p x y ========,,,,,,因此,222222112233H Y)=p(y )log p(y )-p(y )log p(y )-p(y )log p(y )111111log log log 1.459332266bit=---=((2)H Y|X)=(;)log (|i j j i ijp x y p y x -å()222221113112213log log log log log 6210101551551010=----- 222131139log log log 101030101010--- 1.175bit =(3)当接收为2 y ,发出为2x 是正确,发出的是1x 和3x 为错误,由于各自概率为:122232113(|),(|),(|)555p x y p x y p x y === 因此,接收端收到一个符号2y 的错误概率为:123213(|)(|)0.855i p p x y p x y =+=+= (4)从接收端看的平均错误概率为:1213111232213233[(|)(|)]()[(|)(|)]()[(|)(|)]()e P p x y p x y p y p x y p x y p y p x y p x y p y =+++++ 213112321323(,)(,)(,)(,)(,)(,)p x y p x y p x y p x y p x y p x y =+++++ 211311153010101510=+++++0.733= (5)同理可得,从发送端看的平均错误概率为:__210.733e e p p == (6)从转移矩阵来看,正确发送的概率11x y -的概率为0.5,有一半失真;22x y -的概率为0.3,产生失真;33x y -的概率为0,完全失真。

信息论与编码习题答案-曹雪虹

3-14

信源 符号 xi x1 x2 x3 x4 x5 x6 x7

符号概 率 pi 1/3 1/3 1/9 1/9 1/27 1/27 1/27 1/3 1/3 1/9 1/9 2/27 1/27 1/3 1/3 1/9 1/9 1/9

编码过程

编码 1/3 1/3 1/3 2/3 1/3 00 01 100 101 111 1100 1101

得p0p1p223当p0或p1时信源熵为0第三章无失真信源编码31321因为abcd四个字母每个字母用两个码每个码为05ms所以每个字母用10ms当信源等概率分布时信源熵为hxlog42平均信息传递速率为2信源熵为hx0198bitms198bitsbitms200bits33与上题相同351hu12log2?14log4?18log8?116log16?132log32?164log64?1128log128?1128log128?1984111111112481632641281282每个信源使用3个二进制符号出现0的次数为出现1的次数为p0p134相应的香农编码信源符号xix1x2x3x4x5x6x7x8符号概率pi12141811613216411281128累加概率pi00507508750938096909840992logpxi12345677码长ki12345677码字010110111011110111110111111011111110相应的费诺码信源符号概符号xi率pix1x2x3x4x5x6x7x812141811613216411281128111第一次分组0第二次分组0第三次分组0第四次分组0第五次分组011第六次分组01第七次分组01二元码0101101110111101111101111110111111105香农码和费诺码相同平均码长为编码效率为

信息论与编码答案

《信息论与编码》-曹雪虹-课后习题答案第二章2.1一个马尔可夫信源有3个符号{}1,23,u u u ,转移概率为:()11|1/2p u u =,()21|1/2p u u =,()31|0p u u =,()12|1/3p u u =,()22|0p u u =,()32|2/3p u u =,()13|1/3p u u =,()23|2/3p u u =,()33|0p u u =,画出状态图并求出各符号稳态概率。

解:状态图如下状态转移矩阵为:1/21/201/302/31/32/30p ⎛⎫ ⎪= ⎪ ⎪⎝⎭设状态u 1,u 2,u 3稳定后的概率分别为W 1,W 2、W 3由1231WP W W W W =⎧⎨++=⎩得1231132231231112331223231W W W W W W W W W W W W ⎧++=⎪⎪⎪+=⎪⎨⎪=⎪⎪⎪++=⎩计算可得1231025925625W W W ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩2.2 由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:(0|00)p =0.8,(0|11)p =0.2,(1|00)p =0.2,(1|11)p =0.8,(0|01)p =0.5,(0|10)p =0.5,(1|01)p =0.5,(1|10)p =0.5。

画出状态图,并计算各状态的稳态概率。

解:(0|00)(00|00)0.8p p == (0|01)(10|01)0.5p p ==(0|11)(10|11)0.2p p == (0|10)(00|10)0.5p p == (1|00)(01|00)0.2p p == (1|01)(11|01)0.5p p == (1|11)(11|11)0.8p p == (1|10)(01|10)0.5p p ==于是可以列出转移概率矩阵:0.80.200000.50.50.50.500000.20.8p ⎛⎫ ⎪⎪= ⎪ ⎪⎝⎭状态图为:设各状态00,01,10,11的稳态分布概率为W 1,W 2,W 3,W 4 有411i i WP W W ==⎧⎪⎨=⎪⎩∑ 得 13113224324412340.80.50.20.50.50.20.50.81W W W W W W W W W W W W W W W W +=⎧⎪+=⎪⎪+=⎨⎪+=⎪+++=⎪⎩ 计算得到12345141717514W W W W ⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求:(1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, … , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

信息论与编码(第二版)曹雪虹答案

0<p<2/3时

2/3<p<1时

所以当p=2/3时 存在极大值,且 符号

所以

2-33

(1)

解方程组:

得p(0)=p(1)=p(2)=

(2)

(3)

当p=0或p=1时信源熵为0

练习题:有一离散无记忆信源,其输出为 ,相应的概率为 ,设计两个独立的实验去观察它,其结果分别为 ,已知条件概率:

(3)I(X;Y), I(X;Z), I(Y;Z), I(X;Y/Z), I(Y;Z/X)和I(X;Z/Y)。

解:

(1)

Z = XY的概率分布如下:

(2)

(3)

2-14

(1)

P(ij)= P(i/j)=

(2)方法1: =

方法2:

2-15

P(j/i)=

2.16黑白传真机的消息元只有黑色和白色两种,即X={黑,白},一般气象图上,黑色的出现概率p(黑)=0.3,白色出现的概率p(白)=0.7。

X

0

1

0

1/4

0

1

1/4

0

2

0

1/2

P(y1=0)=p(y1=1)=1/2 p(y2=1)=p(y2=1)=1/2

=0.5bit/符号

符号>

所以第二个实验比第一个实验好

P(y1y2x)

00

01

10

11

0

1/4

0

0

0

1

0

0

1/4

0

2

0

1/4

0

1/4

(2)因为Y1和Y2相互独立,所以

P(y1y2|x)

00

(1)如果仅对颜色感兴趣,则计算平均不确定度

信息论与编码-曹雪虹-课后习题参考答案

《信息论与编码》-曹雪虹-课后习题答案第二章错误!未定义书签。

2.1一个马尔可夫信源有3个符号{}1,23,uu u ,转移概率为:()11|1/2p u u =,()21|1/2p u u =,()31|0p u u =,()12|1/3p u u =,()22|0p u u =,()32|2/3p u u =,()13|1/3p u u =,()23|2/3p u u =,()33|0p u u =,画出状态图并求出各符号稳态概率。

W 2、W 31231025925625W W W ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩ 2.2(0|p (0|01)p =0.5,(0|10)p 解:(0|00)(00|00)0.8p p ==(0|01)(10|01)0.5p p ==于是可以列出转移概率矩阵:0.80.200000.50.50.50.500000.20.8p ⎛⎫ ⎪ ⎪= ⎪ ⎪⎝⎭ 状态图为:设各状态00,01,10,11的稳态分布概率为W1,W2,W3,W4有411iiWP WW==⎧⎪⎨=⎪⎩∑得13113224324412340.80.50.20.50.50.20.50.81W W WW W WW W WW W WW W W W+=⎧⎪+=⎪⎪+=⎨⎪+=⎪+++=⎪⎩计算得到12345141717514WWWW⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩2.31/6,求:(1)“3和5(2)“两个1(3)1的自信息量。

11 12 13 14 15 1621 22 23 24 25 2631 32 33 34 35 3641 42 43 44 45 4651 52 53 54 55 5661 62 63 64 65 66共有21种组合:其中11,22,33,44,55,66的概率是3616161=⨯ 其他15个组合的概率是18161612=⨯⨯ (4)x p x p X H X P X i i i 1212181log 1812361log 3612 )(log )()(1211091936586173656915121418133612)( ⎝⎛⨯+⨯+⨯-=-=⎪⎩⎪⎨⎧=⎥⎦⎤⎢⎣⎡∑2.575%是身高160厘米以上的占总数的厘米以上的某女孩是大学生”的设随机变量X 代表女孩子学历X x 1(是大学生) x 2(不是大学生)P(X) 0.25 0.75设随机变量Y 代表女孩子身高Y y1(身高>160cm)y2(身高<160cm)P(Y) 0.5 0.5已知:在女大学生中有75%是身高160厘米以上的即:bitxyp75.0)/(11=求:身高160即:ypxypxpyxpyxI5.075.025.0log)()/()(log)/(log)/(11111111⨯-=-=-=2.6掷两颗骰子,1()(1,2)(2,1)18p x p p=+=log()log18 4.170p x bit=-==7的概率log()log6 2.585p x bit=-==341231/41/8x x===⎫⎪⎭(1)求每个符号的自信息量(2)信源发出一消息符号序列为{202120130213001203210110321010021032011223210},求该序列的自信息量和平均每个符号携带的信息量解:122118()log log 1.415()3I x bit p x === 同理可以求得233()2,()2,()3I x bit I x bit I x bit === 因为信源无记忆,所以此消息序列的信息量就等于该序列中各个符号的信息量之和就有:123414()13()12()6()87.81I I x I x I x I x bit =+++= 平均每个符号携带的信息量为87.81 1.9545=bit/符号 2.8试问四进制、八进制脉冲所含信息量是二进制脉冲的多少倍?解:四进制脉冲可以表示4个不同的消息,例如:{0,1,2,3}八进制脉冲可以表示8个不同的消息,例如:{0,1,2,3,4,5,6,7}二进制脉冲可以表示2个不同的消息,例如:{0,1}假设每个消息的发出都是等概率的,则:四进制脉冲的平均信息量symbol bit n X H / 24log log )(1=== 八进制脉冲的平均信息量symbol bit n XH / 38log log )(2=== 二进制脉冲的平均信息量symbol bit n X H / 12log log )(0===所以:四进制、八进制脉冲所含信息量分别是二进制脉冲信息量的2倍和3倍。

信息论与编码(第二版)曹雪虹(最全版本)答案

《信息论与编码(第二版)》曹雪虹答案第二章2.1一个马尔可夫信源有3个符号{}1,23,u u u ,转移概率为:()11|1/2p u u =,()21|1/2p u u =,()31|0p u u =,()12|1/3p u u =,()22|0p u u =,()32|2/3p u u =,()13|1/3p u u =,()23|2/3p u u =,()33|0p u u =,画出状态图并求出各符号稳态概率。

解:状态图如下状态转移矩阵为:1/21/201/302/31/32/30p ⎛⎫ ⎪= ⎪ ⎪⎝⎭设状态u 1,u 2,u 3稳定后的概率分别为W 1,W 2、W 3由1231WP W W W W =⎧⎨++=⎩得1231132231231112331223231W W W W W W W W W W W W ⎧++=⎪⎪⎪+=⎪⎨⎪=⎪⎪⎪++=⎩计算可得1231025925625W W W ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩ 2.2 由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:(0|00)p =0.8,(0|11)p =0.2,(1|00)p =0.2,(1|11)p =0.8,(0|01)p =0.5,(0|10)p =0.5,(1|01)p =0.5,(1|10)p =0.5。

画出状态图,并计算各状态的稳态概率。

解:(0|00)(00|00)0.8p p == (0|01)(10|01)0.5p p ==(0|11)(10|11)0.2p p == (0|10)(00|10)0.5p p == (1|00)(01|00)0.2p p == (1|01)(11|01)0.5p p == (1|11)(11|11)0.8p p == (1|10)(01|10)0.5p p ==u 1u 2u 31/21/21/32/32/31/3于是可以列出转移概率矩阵:0.80.200000.50.50.50.500000.20.8p ⎛⎫ ⎪⎪= ⎪ ⎪⎝⎭状态图为:000110110.80.20.50.50.50.50.20.8设各状态00,01,10,11的稳态分布概率为W 1,W 2,W 3,W 4 有411i i WP W W ==⎧⎪⎨=⎪⎩∑ 得 13113224324412340.80.50.20.50.50.20.50.81W W W W W W W W W W W W W W W W +=⎧⎪+=⎪⎪+=⎨⎪+=⎪+++=⎪⎩ 计算得到12345141717514W W W W ⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求: (1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, … , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

信息论与编码-曹雪虹-课后习题答案

第二章2.1一个马尔可夫信源有3个符号{}1,23,u u u ,转移概率为:()11|1/2p u u =,()21|1/2p u u =,()31|0p u u =,()12|1/3p u u =,()22|0p u u =,()32|2/3p u u =,()13|1/3p u u =,()23|2/3p u u =,()33|0p u u =,画出状态图并求出各符号稳态概率。

解:状态图如下状态转移矩阵为:1/21/201/302/31/32/30p ⎛⎫ ⎪= ⎪ ⎪⎝⎭设状态u 1,u 2,u 3稳定后的概率分别为W 1,W 2、W 3由1231WP W W W W =⎧⎨++=⎩得1231132231231112331223231W W W W W W W W W W W W ⎧++=⎪⎪⎪+=⎪⎨⎪=⎪⎪⎪++=⎩计算可得1231025925625W W W ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩ 2.2 由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:(0|00)p =0.8,(0|11)p =0.2,(1|00)p =0.2,(1|11)p =0.8,(0|01)p =0.5,(0|10)p =0.5,(1|01)p =0.5,(1|10)p =0.5。

画出状态图,并计算各状态的稳态概率。

解:(0|00)(00|00)0.8p p == (0|01)(10|01)p p == (0|11)(10|11)0.2p p == (0|10)(00|10)p p == (1|00)(01|00)0.2p p == (1|01)(11|01)p p==(1|11)(11|11)0.8p p == (1|10)(01|10)0.5p p ==于是可以列出转移概率矩阵:0.80.200000.50.50.50.500000.20.8p ⎛⎫ ⎪⎪= ⎪ ⎪⎝⎭状态图为:设各状态00,01,10,11的稳态分布概率为W 1,W 2,W 3,W 4 有411i i WP W W ==⎧⎪⎨=⎪⎩∑ 得 13113224324412340.80.50.20.50.50.20.50.81W W W W W W W W W W W W W W W W +=⎧⎪+=⎪⎪+=⎨⎪+=⎪+++=⎪⎩ 计算得到12345141717514W W W W ⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求:(1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, … , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

得:随意取出一球时,所需要的信息量为 (1) P(红)= P(白)=1/2

1 1 1 1 H(X)= log 2 log 2 2 2 2 2

= 1比特

3 2013-8-9

(2)P(白)= 1/100 P(红)= 99/100 所以 1 H(X)= log 2

100

1 99 99 log 2 100 100 100

13 2013-8-9

2-10

解: (1)H(colour)=2/38log19+2*(18/38)log(38/18) =0.22+1.02=1.24bit (2)H(colour,number)=H(number)=log38 =5.25bit (3)H(number|colour)=H(c,n)-H(c) =5.25-1.24=4.01bit

8 2013-8-9

2-5

解: (1)I=log18=4.17bit (2)略

9 2013-8-9

2-6

解:

(1) 平均每个符号携带的信息量:

H(X)=14/45log(45/14)+13/45log(45/13) +12/45log(45/12)+6/45log(45/6) =1.95比特/符号 (2)消息自信息量: I=1.95*45=87.8

40 2013-8-9

信源熵

H w1 H ( x / s1) w2 H ( x / s2) w3 H ( x / s3) 1.435

41 2013-8-9

5

2-23

略

28 2013-8-9

2-24

解: 1 3 4 H ( x) log 4 log 0.81 (1)

4 4 3

(2)

1 *3 I log 4 4

m

100 m

41 1.59m

29 2013-8-9

(3)

30 2013-8-9

ti b1 8 )x ( H0 0 1 H

14 2013-8-9

2-11

解: (1)H(X,Y)=14/24log(24/7)+4/24log24+1/4log4 =2.3bit (2)H(Y)=8/24log3+8/24log3+8/24log3 =1.58bit (3)H(X/Y)=H(X,Y)-H(Y)=0.72

15 2013-8-9

1/2 W1+1/3W2 +1/3W3 = W1 1/2 W1+2/3W3 = W2 2/3W2 =W3

W1 +W2 +W3=1

32 2013-8-9

得:

W1=2/5;W2 =9/25;W3=6/25

33 2013-8-9

2-27

解: 0.8W1+0.5W3=W1 0.2W1+0.5W3=W2 0.5W2+0.2W4=W3 0.5W2+0.8W4=W4 W1+W2+W3+W4=1

1/2

P(b1)=P(b1,a1)+P(b1,a2)=P(b1/a1)P(a1)+ P(b1/a2)P(a2) =(1-ε)*(1/2)+1/2* ε=1/2 P(a1,b1)=1/2*(1-ε) P(a1/b1)= P(a1,b1)/P(b1)=1- ε

20 2013-8-9

I(a1,b1)=log[2*(1-ε)]

6 2013-8-9

(5) I(1,X)=log36/11=1.7105bit

2-3 解: 因为: P(v/u)=P(u,v)/P(u)=(1/4*3/4)/(1/2)=3/8 所以: I=log(8/3)=1.42bit

7 2013-8-9

2-4

解: 平均信息量 h(X)=3/8log(8/3)+2/4log4+1/8log8 =1.905比特/符号 信息量 H(X)=60*1.905=114.3比特

2-12

解: (1)Leabharlann (X)=1; H(Y)=1; H(Z)=7/8*log(8/7)+1/8*log8=0.54 H(YZ)=H(XZ)=H(X)+H(Z/X) =1+1/8*log4+3/8*log(4/3)=1.41 H(XYZ)=H(XZ)+H(Y/XZ)=1.41+0.4=1.81

16 2013-8-9

p(a1/b2) I (a1;b2)=log p(a1)

P(b2)=P(b2,a1)+P(b2,a2)=P(b2/a1)P(a1)+ P(b2/a2)P(a2)

=(1-ε)*(1/2)+1/2* ε=1/2

P(a1,b2)= P(b2/a1)*P(a1)= 1/2* ε

P(a1/b2)=P(a1,b2)/ P(b2)=ε

2-9

解:不确定度即为H(X) (1)H(X)=1/3log3+2/3log(3/2) =0.39+0.53=0.92bit (2)H(X)=4/14log(14/4)+10/14log14/10 =0.346+0.516=0.86bit (3)H(X)=5/14log(14/5)+9/14log(14/9) =0.41+0.53=0.94bit (4)H(x)=1/3*0.86+2/3*0.94=0.92bit

题目

2-2 设在一只布袋中装有100只对人手感觉 全相同的木球,每只球上涂有一种颜色。 100只球的颜色有下列3中情况: (1)红色球和白色球各50置; (2)红色球99只,白色球1只; (3)红、黄、蓝、白色各25只。 求从布袋中随意去除一只球时,猜测其颜色所 需要的信息量。

1 2013-8-9

2-20

解: (1)已知 所以

1 P x ( x) 6

1 H 0 ( X ) 6 log6dx log6 2.58 3

26 2013-8-9

3

(2)

已知

1 P x ( x) 10

所以

1 H 0 ( X ) 10 log10dx 3.322 5

27 2013-8-9

37 2013-8-9

2-29

解:

1 / 3 1 / 3 1 / 3 p 1 / 3 1 / 3 1 / 3 1 / 2 1 / 2 0

1/3W1 +1/3W2 +1/2W3= W 1 1/3W1+1/3W21/2 W 3=W2 1/3W1+1/3 W 2=W3 W1+W2+ W 3=1

I (a1,b2)=log2 ε

21 2013-8-9

2-16

解: (1) H(X)= -P(黑)*log P(黑)- P(白)*log P(白) =0.3*log(1/0.3)+0.7*log(1/0.7)

=0.5211+0.3602

=0.8813

22 2013-8-9

(2) H(X)= Wi * H ( X / Si)

18 2013-8-9

2-13

解: H(IJ)=4*(1/8)*log8+2*(1/10)log10+2/15*log15 +3/36*log36+1/12*log12 =3.415

19 2013-8-9

2-15

解: p(a 1/b1) p(a1/b1) I(a1;b1)=log =log

p(a1)

10 2013-8-9

2-7

解: I(2)=log2=1 I(4)=log4=2 I(8)=log8=3

11 2013-8-9

2-8

解: (1)I(点)=log(4/3)=0.42 I(划)=log4=2 (2)平均信息量: H(X)=1/4log4+3/4log(4/3)=0.81

12 2013-8-9

= 0.08比特

4 2013-8-9

(3) P(红)=P(白)=P(蓝)=P(黄)=1/4

所以 1 1 H(X)= 4 x ( log 2 )

4 4

= 2比特

5 2013-8-9

2-2

解: (1)P(3,5)= 1/36+1/36= 1/18 I (3,5)= log18 = 4.17 bit (2)P(1,1)= 1/6*1/6= 1/36 I (1,1)= log36 = 5.17 bit (3)H(X)=1/36*6*log36+2/36*15*log18 =4.337 bit (4)H(X)=2*(1/36*log36+2/36*log18 +3/36log12+4/36log9+5/36log36/5)+6/36log6 =3.274bit

10000

X

1000

= 13288

6

Log10000 =2.1* 10

6

X=2.1*10 /13.288=158038个

24 2013-8-9

2-18

解: 由

kxdx

0

2

2

1

得 k=1/2 所以

x x ( X ) log dx 1.44bit HC 2 2 0

25 2013-8-9

2-25

解: 0.25p(0)+0.5p(1)=p(0) 0.75p(0)+0.5p(1)=p(1) P(0)+p(1)=1 得: P(0)=0.4;p(1)=0.6

31 2013-8-9

2-26

解:

1 / 2 P 1 / 3 1 / 3

1/ 2 0 2/3

0 2 / 3 0