hanlp中文分词器解读

自然语言分析工具Hanlp依存文法分析python使用总结(附带依存关系英文简写的中文解释)

⾃然语⾔分析⼯具Hanlp依存⽂法分析python使⽤总结(附带依存关系英⽂简写的中⽂解释)最近在做⼀个应⽤依存⽂法分析来提取⽂本中各种关系的词语的任务。

例如:text=‘新中国在马克思的思想和恩格斯的理论阔步向前’:我需要提取这个text中的并列的两个关系,从⽂中分析可知,“马克思的思想”和“恩格斯的理论”是两个并列关系的短语,所以想要将其提取出来;⾸先⼤致了解⼀下依存⽂法分析的前提条件,将句⼦分词并进⾏词性标注,这⼀步⾮常关键,直接决定分析结果的好坏。

看⼀下不修改分词字典情况下直接进⾏并列关系提取的结果:text= "新中国在马克思的思想和恩格斯的理论指导下阔步向前"java = JClass('com.hankcs.hanlp.dependency.nnparser.NeuralNetworkDependencyParser') # 调⽤原始类接⼝进⾏句法分析dp_result = pute(seg_result1)print('java提取结果:'+'\n',dp_result)word_array = dp_result.getWordArray()final= []for word in word_array:result = [word.LEMMA, word.DEPREL, word.HEAD.LEMMA]print("%s --(%s)--> %s" % (word.LEMMA, word.DEPREL, word.HEAD.LEMMA)) # 输出依存关系if result[1]=='COO': # 提取并列关系COOfinal.append(word.LEMMA)final.append(word.HEAD.LEMMA)final_set = set(final)print(final_set)结果:{'思想','理论'}虽然提取出来的结果也算合理,但是还是不够准确,我希望的结果是{'马克思的思想','恩格斯的理论'}接下来我将需要⽬标词动态添加到分词字典中,然后再来进⾏依存⽂法分析text= "新中国在马克思的思想和恩格斯的理论指导下阔步向前"segment =HanLP.newSegment('viterbi')CustomDictionary.insert('马克思的思想', 'n 1024') # insert会覆盖字典中已经存在的词,add会跳过已经存在的词CustomDictionary.insert('恩格斯的理论', 'n 1024')segment.enableCustomDictionaryForcing(True) # 强制执⾏seg_result1 = segment.seg(text) # 分词结果print('分词结果:',seg_result1)java = JClass('com.hankcs.hanlp.dependency.nnparser.NeuralNetworkDependencyParser') # 调⽤原始类接⼝进⾏句法分析dp_result = pute(seg_result1)print('java提取结果:'+'\n',dp_result)word_array = dp_result.getWordArray()final= []for word in word_array:result = [word.LEMMA, word.DEPREL, word.HEAD.LEMMA]print("%s --(%s)--> %s" % (word.LEMMA, word.DEPREL, word.HEAD.LEMMA)) # 输出依存关系if result[1]=='COO':final.append(word.LEMMA)final.append(word.HEAD.LEMMA)final_set = set(final)print(final_set)结果:{'马克思的思想','恩格斯的理论'}以上实现了正确的并列关系提取。

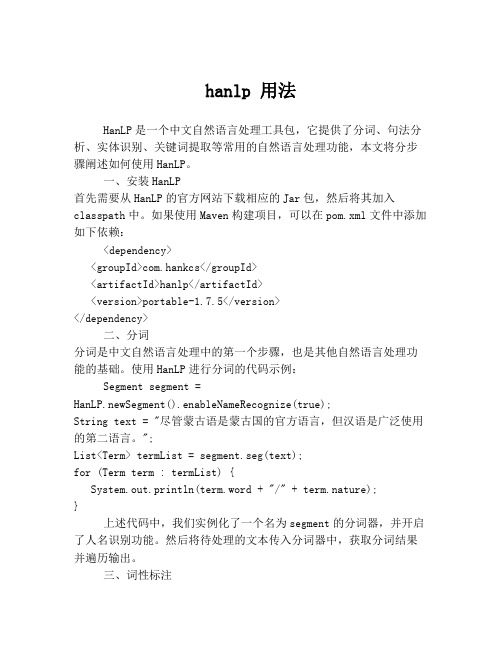

hanlp 用法

hanlp 用法HanLP是一个中文自然语言处理工具包,它提供了分词、句法分析、实体识别、关键词提取等常用的自然语言处理功能,本文将分步骤阐述如何使用HanLP。

一、安装HanLP首先需要从HanLP的官方网站下载相应的Jar包,然后将其加入classpath中。

如果使用Maven构建项目,可以在pom.xml文件中添加如下依赖:<dependency><groupId>com.hankcs</groupId><artifactId>hanlp</artifactId><version>portable-1.7.5</version></dependency>二、分词分词是中文自然语言处理中的第一个步骤,也是其他自然语言处理功能的基础。

使用HanLP进行分词的代码示例:Segment segment =HanLP.newSegment().enableNameRecognize(true);String text = "尽管蒙古语是蒙古国的官方语言,但汉语是广泛使用的第二语言。

";List<Term> termList = segment.seg(text);for (Term term : termList) {System.out.println(term.word + "/" + term.nature);}上述代码中,我们实例化了一个名为segment的分词器,并开启了人名识别功能。

然后将待处理的文本传入分词器中,获取分词结果并遍历输出。

三、词性标注词性标注是将分词结果中的每个词元标注上其词性的过程,词性标注结果对于后续的句法分析和实体识别等任务都具有重要意义。

使用HanLP进行词性标注的代码示例:String[] testCase = new String[]{"商品和服务","结婚的和尚未结婚的确实在干扰分词啊","买水果然后来世博园最后去世博会","中国的首都是北京","欢迎新老师生前来就餐",};for (String sentence : testCase) {List<Term> termList = HanLP.segment(sentence);System.out.println(termList);List<String> posList = HanLP.extractPhrase(sentence);System.out.println(posList);}上述代码中,我们给出了一组待处理的测试用例,然后分别获取了分词结果和词性标注结果,并输出到控制台。

java hanlp 用法

java hanlp 用法HanLP是一款中文自然语言处理工具包,提供了一系列常用的中文自然语言处理功能,包括分词、词性标注、命名实体识别等。

下面是一个简单的示例,展示如何使用HanLP进行中文分词:1. 首先,你需要将HanLP的jar包添加到你的Java项目中。

你可以在HanLP的官方网站上下载最新的jar包,或者使用Maven等依赖管理工具进行添加。

2. 接下来,你可以使用以下代码进行中文分词:```javaimport ;import ;import ;import ;public class HanLPSegDemo {public static void main(String[] args) {// 初始化分词器Segment segment = ();// 对句子进行分词String sentence = "我爱自然语言处理";List<Term> termList = (sentence);// 输出分词结果for (Term term : termList) {( + "/" + );}}}```在上面的代码中,我们首先创建了一个`Segment`对象,该对象是HanLP 中用于中文分词的核心类。

然后,我们调用`seg()`方法对输入的句子进行分词,得到一个`Term`对象的列表。

每个`Term`对象表示一个分词结果,包括分词的词和词性等信息。

最后,我们遍历`Term`对象的列表,输出每个分词的结果。

3. 运行上面的代码,你将会看到以下的输出:```bash我/r爱/v自然/a语言/n处理/v```这表示对输入的句子“我爱自然语言处理”进行了分词,并输出了每个分词的词和词性等信息。

hanlp的作用-解释说明

hanlp的作用-概述说明以及解释1.引言1.1 概述HanLP(即“Han Language Processing”)是一个开源的自然语言处理(NLP)工具包,最初由人民日报社自然语言处理实验室开发,并已经在众多大型项目和企业中被广泛应用。

自然语言处理是人工智能领域中一个重要的研究方向,涉及到对人类语言的理解和处理。

HanLP作为一款功能强大的NLP工具包,集成了一系列中文文本的处理和分析功能,能够帮助开发者快速、准确地处理中文文本数据。

HanLP具备多项核心功能,包括分词、词性标注、命名实体识别、依存句法分析、关键词提取等。

这些功能能够协助用户完成诸如文本分析、信息提取、机器翻译、情感分析、智能问答等各种任务。

HanLP具有以下几个显著特点:1. 智能高效:HanLP采用了深度学习和统计机器学习等先进的技术,能够实现高效、准确的文本处理。

它精心训练的模型和优化算法确保了在不同场景下的稳定性和效果。

2. 针对中文:HanLP是专门为中文设计的工具包,充分考虑了中文的特殊性。

它支持繁简体转换、拼音转换等特殊处理,并基于大规模中文语料库进行训练,以获得更好的中文处理效果。

3. 可定制性:HanLP提供了丰富的功能和参数设置,允许用户根据自己的需求进行个性化定制。

用户可以选择不同的模型、配置和插件,以满足特定场景下的需求。

4. 强大的生态系统:HanLP的社区活跃,拥有众多用户和开发者参与其中。

在HanLP的基础上,还衍生出了丰富的周边工具和应用,形成了一个庞大的生态系统。

总之,HanLP作为一款功能全面、性能出色的中文NLP工具包,为中文文本处理和分析提供了便捷、高效的解决方案。

无论是学术研究还是商业应用,HanLP都是一个不可或缺的利器。

它的出现大大降低了中文自然语言处理的门槛,为中文信息处理领域的发展做出了重要贡献。

1.2 文章结构文章结构部分的内容如下:2. 正文在这一部分,我们将详细介绍HanLP的作用和功能。

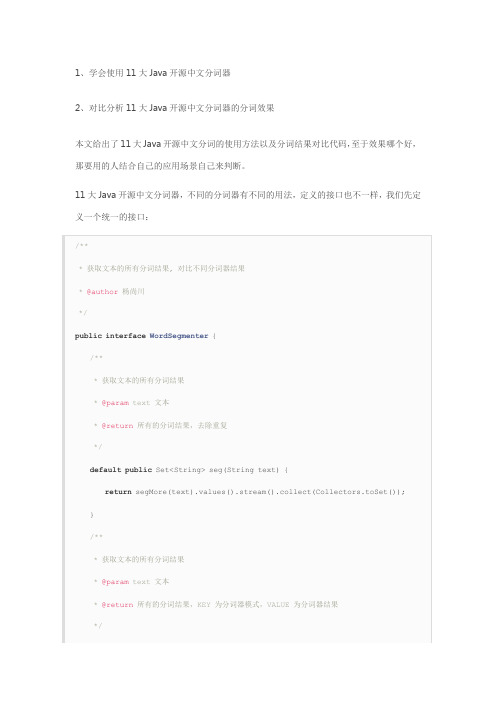

11个Java开源中文分词器使用方法和分词效果对比

1、学会使用11大Java开源中文分词器

2、对比分析11大Java开源中文分词器的分词效果

本文给出了11大Java开源中文分词的使用方法以及分词结果对比代码,至于效果哪个好,那要用的人结合自己的应用场景自己来判断。

11大Java开源中文分词器,不同的分词器有不同的用法,定义的接口也不一样,我们先定义一个统一的接口:

从上面的定义我们知道,在Java中,同样的方法名称和参数,但是返回值不同,这种情况不可以使用重载。

这两个方法的区别在于返回值,每一个分词器都可能有多种分词模式,每种模式的分词结果都可能不相同,第一个方法忽略分词器模式,返回所有模式的所有不重复分词结果,第二个方法返回每一种分词器模式及其对应的分词结果。

在这里,需要注意的是我们使用了Java8中的新特性默认方法,并使用stream把一个map 的value转换为不重复的集合。

下面我们利用这11大分词器来实现这个接口:

1、word分词器

2、Ansj分词器

3、Stanford分词器

4、FudanNLP分词器

5、Jieba分词器

6、Jcseg分词器

7、MMSeg4j分词器

8、IKAnalyzer分词器

9、Paoding分词器

10、smartcn分词器

11、HanLP分词器

现在我们已经实现了本文的第一个目的:学会使用11大Java开源中文分词器。

最后我们来实现本文的第二个目的:对比分析11大Java开源中文分词器的分词效果,程序如下:。

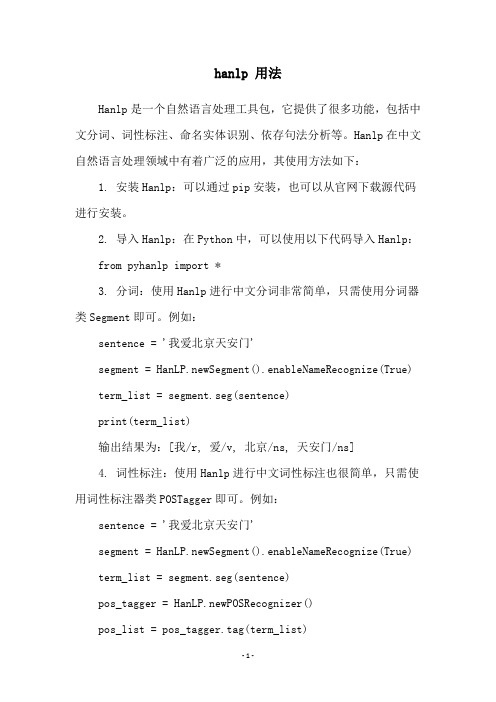

hanlp 用法

hanlp 用法Hanlp是一个自然语言处理工具包,它提供了很多功能,包括中文分词、词性标注、命名实体识别、依存句法分析等。

Hanlp在中文自然语言处理领域中有着广泛的应用,其使用方法如下:1. 安装Hanlp:可以通过pip安装,也可以从官网下载源代码进行安装。

2. 导入Hanlp:在Python中,可以使用以下代码导入Hanlp: from pyhanlp import *3. 分词:使用Hanlp进行中文分词非常简单,只需使用分词器类Segment即可。

例如:sentence = '我爱北京天安门'segment = HanLP.newSegment().enableNameRecognize(True) term_list = segment.seg(sentence)print(term_list)输出结果为:[我/r, 爱/v, 北京/ns, 天安门/ns]4. 词性标注:使用Hanlp进行中文词性标注也很简单,只需使用词性标注器类POSTagger即可。

例如:sentence = '我爱北京天安门'segment = HanLP.newSegment().enableNameRecognize(True) term_list = segment.seg(sentence)pos_tagger = HanLP.newPOSRecognizer()pos_list = pos_tagger.tag(term_list)print(pos_list)输出结果为:[r, v, ns, ns]5. 命名实体识别:使用Hanlp进行中文命名实体识别同样很简单,只需使用命名实体识别器类NERecognizer即可。

例如:sentence = '欧阳建国是南京市长'segment = HanLP.newSegment().enableNameRecognize(True) term_list = segment.seg(sentence)ner_recognizer =HanLP.newSegment().enableNameRecognize(True)ner_list = ner_recognizer.recognize(term_list)print(ner_list)输出结果为:[欧阳建国/nr, 南京/ns]6. 依存句法分析:使用Hanlp进行中文依存句法分析也很简单,只需使用依存句法分析器类DependencyParser即可。

hanlp分词流程

hanlp分词流程

HanLP是一款开源的自然语言处理工具包,可以实现中文分词、词性标注、命名实体识别等功能。

下面将详细介绍HanLP的分词流程。

一、HanLP分词流程概览

HanLP的分词流程可以分为以下几个步骤:文本预处理、分词、词性标注、命名实体识别等。

二、文本预处理

在进行分词之前,需要对待处理的文本进行预处理。

预处理的目的是将文本转化为HanLP可以处理的格式,包括去除空格、标点符号等。

三、分词

分词是HanLP的核心功能之一。

HanLP采用了基于条件随机场(CRF)模型的分词方法,该方法能够在不依赖词典的情况下进行分词,具有较好的鲁棒性和泛化能力。

四、词性标注

词性标注是为分词结果中的每个词语标注其词性。

HanLP提供了预训练好的词性标注模型,可以自动为分词结果进行词性标注。

五、命名实体识别

命名实体识别是指识别文本中的人名、地名、组织机构名等实体。

HanLP采用了基于条件随机场(CRF)模型的命名实体识别方法,

能够较准确地识别出文本中的命名实体。

六、其他功能

除了上述功能外,HanLP还提供了其他一些功能,如关键词提取、摘要生成、文本分类等。

这些功能可以根据具体需求进行选择和使用。

HanLP的分词流程包括文本预处理、分词、词性标注、命名实体识别等步骤。

通过这些步骤,可以对中文文本进行有效的处理和分析,为后续的自然语言处理任务提供基础支持。

HanLP的功能强大且易于使用,是中文文本处理的重要工具之一。

hanlp中文自然语言处理的几种分词方法

hanlp中⽂⾃然语⾔处理的⼏种分词⽅法⾃然语⾔处理在⼤数据以及近年来⼤⽕的⼈⼯智能⽅⾯都有着⾮同寻常的意义。

那么,什么是⾃然语⾔处理呢?在没有接触到⼤数据这⽅⾯的时候,也只是以前在学习计算机⽅⾯知识时听说过⾃然语⾔处理。

书本上对于⾃然语⾔处理的定义或者是描述太多专业化。

换⼀个通俗的说法,⾃然语⾔处理就是把我们⼈类的语⾔通过⼀些⽅式或者技术翻译成机器可以读懂的语⾔。

⼈类的语⾔太多,计算机技术起源于外国,所以⼀直以来⾃然语⾔处理基本都是围绕英语的。

中⽂⾃然语⾔处理当然就是将我们的中⽂翻译成机器可以识别读懂的指令。

中⽂的博⼤精深相信每⼀个⼈都是⾮常清楚,也正是这种博⼤精深的特性,在将中⽂翻译成机器指令时难度还是相当⼤的!⾄少在很长⼀段时间⾥中⽂⾃然语⾔的处理都⾯临这样的问题。

Hanlp中⽂⾃然语⾔处理相信很多从事程序开发的朋友都应该知道或者是⽐较熟悉的。

Hanlp中⽂⾃然语⾔处理是⼤快搜索在主持开发的,是⼤快DKhadoop⼤数据⼀体化开发框架中的重要组成部分。

下⾯就hanlp中⽂⾃然语⾔处理分词⽅法做简单介绍。

Hanlp中⽂⾃然语⾔处理中的分词⽅法有标准分词、NLP分词、索引分词、N-最短路径分词、CRF分词以及极速词典分词等。

下⾯就这⼏种分词⽅法进⾏说明。

标准分词:Hanlp中有⼀系列“开箱即⽤”的静态分词器,以Tokenizer结尾。

HanLP.segment其实是对StandardTokenizer.segment的包装NLP分词:1. List<Term> termList = NLPTokenizer.segment("中国科学院计算技术研究所的宗成庆教授正在教授⾃然语⾔处理课程");2. System.out.println(termList);NLP分词NLPTokenizer会执⾏全部命名实体识别和词性标注。

索引分词:索引分词IndexTokenizer是⾯向搜索引擎的分词器,能够对长词全切分,另外通过term.offset可以获取单词在⽂本中的偏移量。

分词工具Hanlp基于感知机的中文分词框架

分词⼯具Hanlp基于感知机的中⽂分词框架结构化感知机标注框架是⼀套利⽤感知机做序列标注任务,并且应⽤到中⽂分词、词性标注与命名实体识别这三个问题的完整在线学习框架,该框架利⽤1个算法解决3个问题,时⾃治同意的系统,同时三个任务顺序渐进,构成流⽔线式的系统。

本⽂先介绍中⽂分词框架部分内容。

中⽂分词训练只需指定输⼊语料的路径(单⽂档时为⽂件路径,多⽂档时为⽂件夹路径,灵活处理),以及模型保存位置即可:命令⾏java -cp hanlp.jar com.hankcs.hanlp.model.perceptron.Main -task CWS -train -reference data/test/pku98/199801.txt -model data/test/perceptron/cws.binAPIpublic void testTrain() throws Exception{PerceptronTrainer trainer = new CWSTrainer();PerceptronTrainer.Result result = trainer.train("data/test/pku98/199801.txt",Config.CWS_MODEL_FILE);// System.out.printf("准确率F1:%.2f\n", result.prf[2]);}事实上,视语料与任务的不同,迭代数、压缩⽐和线程数都可以⾃由调整,以保证最佳结果:/*** 训练** @param trainingFile 训练集* @param developFile 开发集* @param modelFile 模型保存路径* @param compressRatio 压缩⽐* @param maxIteration 最⼤迭代次数* @param threadNum 线程数* @return ⼀个包含模型和精度的结构* @throws IOException*/public Result train(String trainingFile, String developFile,String modelFile, final double compressRatio,final int maxIteration, final int threadNum) throws IOException单线程时使⽤AveragedPerceptron算法,收敛较好;多线程时使⽤StructuredPerceptron,波动较⼤。

hanlp 中文分词

hanlp 中文分词

摘要:

一、引言

1.介绍hanlp

2.中文分词的重要性

二、hanlp 的中文分词功能

1.什么是中文分词

2.hanlp 分词原理

3.hanlp 分词算法优势

三、hanlp 在中文分词领域的应用

1.搜索引擎

2.文本挖掘

3.语音识别

四、中文分词的未来发展

1.人工智能技术的发展

2.中文分词技术的挑战与机遇

正文:

一、引言

随着互联网的普及,大量的中文文本需要进行处理和分析。

然而,中文文本没有明确的词语边界,导致计算机难以直接理解。

为了解决这个问题,中文分词技术应运而生。

HanLP 是一款强大的中文自然语言处理工具,其中包含的

中文分词功能尤为突出。

二、hanlp 的中文分词功能

1.什么是中文分词

中文分词是将连续的中文文本切分成有意义的独立词汇的过程。

这些词汇可以是名词、动词、形容词等,具备一定的语义信息。

中文分词是自然语言处理的基础任务,对于后续的文本分析、检索、翻译等功能至关重要。

2.hanlp 分词原理

HanLP 采用基于词性标注的分词算法,结合隐马尔可夫模型(HMM)和最大熵模型(MaxEnt)。

hanlp和jieba 的原理

hanlp和jieba 的原理汉语分词是中文自然语言处理的一项重要任务,被广泛应用于搜索引擎、文本分类、信息提取等领域。

HanLP和jieba都是中文分词工具,本文将分别介绍它们的原理及特点。

一、HanLPHanLP是由中国科学院计算技术研究所自然语言处理实验室开发的中文自然语言处理工具包。

其核心分词模块采用的是基于最大熵模型和条件随机场(CRF)的中文分词算法。

最大熵模型是一种概率模型,其基本思想是在满足已知条件的前提下,使不确定性最小化。

在HanLP中,最大熵模型用于对分词候选的概率进行估计,选择概率最大的分词结果作为最终输出。

该方法不依赖于词典和规则,具有较强的自适应能力,能够处理一些新词、专有名词等难以预料的情况。

除了最大熵模型,HanLP还引入了条件随机场(CRF)模型。

CRF是一种无向图模型,能够对序列标注问题进行建模。

在HanLP中,CRF用于对分词结果进行校验和修正,提高分词准确性。

HanLP还具有实体识别、依存分析等多种功能,并且支持多种编程语言接口,如Java、Python等。

它已经成为中文自然语言处理领域的一大瑰宝。

二、jiebajieba是一款基于Python的中文分词工具。

它采用的是基于前缀匹配算法和最大匹配算法的分词方法。

前缀匹配算法是一种字符串匹配算法,能够对较长的字符串进行快速的匹配和查找。

在jieba中,前缀匹配算法用于对待切分的文本进行预处理,将其转化为一棵字典树。

最大匹配算法则是指对字典树上查找长度最大的词或成语作为分词结果。

jieba还提供了基于HMM(隐马尔科夫模型)和CRF的分词算法可选,使得分词结果更加准确。

与HanLP相比,jieba的分词速度较快,因为它基于前缀匹配算法进行文本预处理,能够快速实现分词结果的计算。

jieba也很容易使用,具有Python特有的简洁、易读的语法,适合快速构建中小型项目。

但是,jieba的分词效果相对于HanLP要逊色一些,因为它缺乏对分词结果进行校验和修正的功能。

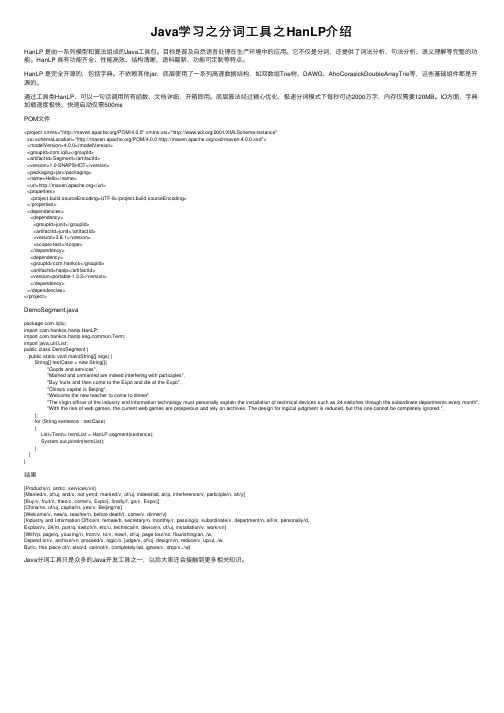

Java学习之分词工具之HanLP介绍

Java学习之分词⼯具之HanLP介绍HanLP 是由⼀系列模型和算法组成的Java⼯具包。

⽬标是普及⾃然语⾔处理在⽣产环境中的应⽤。

它不仅是分词,还提供了词法分析、句法分析、语义理解等完整的功能。

HanLP 具有功能齐全、性能⾼效、结构清晰、语料最新、功能可定制等特点。

HanLP 是完全开源的,包括字典。

不依赖其他jar,底层使⽤了⼀系列⾼速数据结构,如双数组Trie树、DAWG、AhoCorasickDoubleArrayTrie等,这些基础组件都是开源的。

通过⼯具类HanLP,可以⼀句话调⽤所有函数,⽂档详细,开箱即⽤。

底层算法经过精⼼优化,极速分词模式下每秒可达2000万字,内存仅需要120MB。

IO⽅⾯,字典加载速度极快,快速启动仅需500msPOM⽂件<project xmlns="/POM/4.0.0" xmlns:xsi="/2001/XMLSchema-instance"xsi:schemaLocation="/POM/4.0.0 /xsd/maven-4.0.0.xsd"><modelVersion>4.0.0</modelVersion><groupId>com.iqilu</groupId><artifactId>Segment</artifactId><version>1.0-SNAPSHOT</version><packaging>jar</packaging><name>Hello</name><url></url><properties><project.build.sourceEncoding>UTF-8</project.build.sourceEncoding></properties><dependencies><dependency><groupId>junit</groupId><artifactId>junit</artifactId><version>3.8.1</version><scope>test</scope></dependency><dependency><groupId>com.hankcs</groupId><artifactId>hanlp</artifactId><version>portable-1.3.2</version></dependency></dependencies></project>DemoSegment.javapackage com.iqilu;import com.hankcs.hanlp.HanLP;import mon.Term;import java.util.List;public class DemoSegment {public static void main(String[] args) {String[] testCase = new String[]{"Goods and services","Married and unmarried are indeed interfering with participles","Buy fruits and then come to the Expo and die at the Expo","China's capital is Beijing","Welcome the new teacher to come to dinner","The virgin officer of the industry and information technology must personally explain the installation of technical devices such as 24 switches through the subordinate departments every month", "With the rise of web games, the current web games are prosperous and rely on archives. The design for logical judgment is reduced, but this one cannot be completely ignored.",};for (String sentence : testCase){List<Term> termList = HanLP.segment(sentence);System.out.println(termList);}}}结果[Products/n, and/c, services/vn][Married/v, of/uj, and/c, not yet/d, married/v, of/uj, indeed/ad, at/p, interference/v, participle/n, ah/y][Buy/v, fruit/n, then/c, come/v, Expo/j, finally/f, go/v, Expo/j][China/ns, of/uj, capital/n, yes/v, Beijing/ns][Welcome/v, new/a, teacher/n, before death/t, come/v, dinner/v][Industry and Information Office/n, female/b, secretary/n, monthly/r, passing/p, subordinate/v, department/n, all/nr, personally/d,Explain/v, 24/m, port/q, switch/n, etc/u, technical/n, device/n, of/uj, installation/v, work/vn][With/p, page/q, youxing/n, from/v, to/v, now/t, of/uj, page tour/nz, flourishing/an,,/w,Depend on/v, archive/vn, proceed/v, logic/n, judge/v, of/uj, design/vn, reduce/v, up/ul,,/w,But/c, this piece of/r, also/d, cannot/v, completely/ad, ignore/v, drop/v,./w]Java分词⼯具只是众多的Java开发⼯具之⼀,以后⼤家还会接触到更多相关知识。

HanLP《自然语言处理入门》笔记--3.二元语法与中文分词

HanLP《⾃然语⾔处理⼊门》笔记--3.⼆元语法与中⽂分词笔记转载于GitHub项⽬:3. ⼆元语法与中⽂分词上⼀章中我们实现了块⼉不准的词典分词,词典分词⽆法消歧。

给定两种分词结果“商品和服务”以及“商品和服务”,词典分词不知道哪种更加合理。

我们⼈类确知道第⼆种更加合理,只因为我们从⼩到⼤接触的都是第⼆种分词,出现的次数多,所以我们判定第⼆种是正确地选择。

这就是利⽤了统计⾃然语⾔处理。

统计⾃然语⾔处理的核⼼话题之⼀,就是如何利⽤统计⼿法对语⾔建模,这⼀章讲的就是⼆元语法的统计语⾔模型。

3.1 语⾔模型1. 什么是语⾔模型模型指的是对事物的数学抽象,那么语⾔模型指的就是对语⾔现象的数学抽象。

准确的讲,给定⼀个句⼦ w,语⾔模型就是计算句⼦的出现概率 p(w) 的模型,⽽统计的对象就是⼈⼯标注⽽成的语料库。

假设构建如下的⼩型语料库:商品和服务商品和服物美价廉服务和货币每个句⼦出现的概率都是 1/3,这就是语⾔模型。

然⽽ p(w) 的计算⾮常难:句⼦数量⽆穷⽆尽,⽆法枚举。

即便是⼤型语料库,也只能“枚举”有限的数百万个句⼦。

实际遇到的句⼦⼤部分都在语料库之外,意味着它们的概率都被当作0,这种现象被称为数据稀疏。

句⼦⼏乎不重复,单词却⼀直在重复使⽤,于是我们把句⼦表⽰为单词列表w=w_1w_2...w_k,每个w_t,t\in[1,k]都是⼀个单词,然后定义语⾔模型:\begin{aligned} p(\boldsymbol{w}) &=p\left(w_{1} w_{2} \cdots w_{k}\right) \\ &=p\left(w_{1} | w_{0}\right) \times p\left(w_{2} | w_{0} w_{1}\right) \times \cdots \times p\left(w_{k+1} | w_{0} w_{1} w_{2} \dots w_{k}\right) \\ &=\prod_{t=1}^{k+1} p\left(w_{t} | w_{0} w_{1} \cdots w_{t-1}\right) \end{aligned}其中,w_0=BOS (Begin Of Sentence,有时⽤<s>),w_{k+1}=EOS (End Of Sentence,有时也⽤</s>),是⽤来标记句⼦收尾的两个特殊“单词”,在NLP领域的⽂献和代码中经常出现。

hanlp 用法

hanlp 用法HanLP是一款优秀的自然语言处理工具包,它提供了丰富的功能和易于使用的API,可以帮助开发者处理中文文本数据。

本文将介绍HanLP的用法,包括分词、词性标注、命名实体识别、依存句法分析和文本分类等功能。

HanLP可以实现中文分词功能。

分词是将连续的文本切分成一个个有意义的词语的过程。

HanLP提供了多种分词算法,包括基于规则的最大匹配和N最短路径分词算法,以及基于条件随机场模型的分词算法。

开发者可以根据自己的需求选择合适的分词算法进行分词操作。

HanLP还可以实现词性标注功能。

词性标注是对分词结果进行进一步的词性标记,即给每个词语赋予其所属的词性。

HanLP提供了基于感知机模型的词性标注功能,能够准确地为每个词语标注其对应的词性。

除了分词和词性标注,HanLP还可以实现命名实体识别功能。

命名实体识别是对文本中的命名实体进行识别和分类的过程,如人名、地名、机构名等。

HanLP提供了基于条件随机场模型的命名实体识别功能,能够准确地识别出文本中的各种命名实体。

HanLP还可以实现依存句法分析功能。

依存句法分析是对句子中各个词语之间的依存关系进行分析和建模的过程。

HanLP提供了基于神经网络的依存句法分析功能,能够准确地分析出句子中各个词语之间的依存关系。

HanLP还可以实现文本分类功能。

文本分类是将文本按照其所属类别进行分类的过程。

HanLP提供了基于机器学习的文本分类功能,开发者可以使用HanLP训练自己的文本分类模型,或者使用已经训练好的模型进行文本分类操作。

HanLP是一款功能强大、易于使用的自然语言处理工具包。

它提供了分词、词性标注、命名实体识别、依存句法分析和文本分类等多种功能,可以帮助开发者快速处理中文文本数据。

无论是在信息提取、机器翻译、智能问答还是情感分析等领域,HanLP都能发挥重要作用,为开发者提供便捷、高效的解决方案。

中文分词工具简介与安装教程(jieba、nlpir、hanlp、pkuseg、foolnl。。。

中⽂分词⼯具简介与安装教程(jieba、nlpir、hanlp、pkuseg、foolnl。

2.1 jieba2.1.1 jieba简介Jieba中⽂含义结巴,jieba库是⽬前做的最好的python分词组件。

⾸先它的安装⼗分便捷,只需要使⽤pip安装;其次,它不需要另外下载其它的数据包,在这⼀点上它⽐其余五款分词⼯具都要便捷。

另外,jieba库⽀持的⽂本编码⽅式为utf-8。

Jieba库包含许多功能,如分词、词性标注、⾃定义词典、关键词提取。

基于jieba的关键词提取有两种常⽤算法,⼀是TF-IDF算法;⼆是TextRank算法。

基于jieba库的分词,包含三种分词模式:精准模式:试图将句⼦最精确地切开,适合⽂本分析);全模式:把句⼦中所有的可以成词的词语都扫描出来, 速度⾮常快,但是不能解决歧义);搜索引擎模式:搜索引擎模式,在精确模式的基础上,对长词再次切分,提⾼召回率,适合⽤于搜索引擎分词。

Jieba官⽅⽂档:2.1.2 jieba安装Jieba库安装⽐较便捷,只需要在命令框中输⼊:pip install jieba;或者在pycharm中,通过setting-project安装。

2.2 thulac2.2.1 thulac简介THULAC(THU Lexical Analyzer for Chinese)由清华⼤学⾃然语⾔处理与社会⼈⽂计算实验室研制推出的⼀套中⽂词法分析⼯具包,具有中⽂分词和词性标注功能。

THULAC集成了⽬前世界上规模最⼤的⼈⼯分词和词性标注中⽂语料库(约含5800万字),模型标注能⼒强⼤。

该⼯具包在标准数据集Chinese Treebank(CTB5)上分词的F1值可达97.3%,词性标注的F1值可达到92.9%。

同时进⾏分词和词性标注速度为300KB/s,每秒可处理约15万字。

只进⾏分词速度可达到1.3MB/s。

总的来说,可以理解为thulac训练的分词、词性标注语料库很⼤,性能优良。

hanlp中的N最短路径分词

hanlp中的N最短路径分词N-最短路径是中科院分词⼯具NLPIR进⾏分词⽤到的⼀个重要算法,张华平、刘群⽼师在论⽂《基于N-最短路径⽅法的中⽂词语粗分模型》中做了⽐较详细的介绍。

该算法算法基本思想很简单,就是给定⼀待处理字串,根据词典,找出词典中所有可能的词,构造出字串的⼀个有向⽆环图,算出从开始到结束所有路径中最短的前N条路径。

因为允许相等长度的路径并列,故最终的结果集合会⼤于或等于N。

根据算法思想,当我们拿到⼀个字串后,⾸先构造图,接着针对图计算最短路径。

下⾯以⼀个例⼦“他说的确实在理”进⾏说明,开始为了能够简单说明,⾸先假设图上的边权值均为1。

先给出对这句话的3-最短路(即路径最短的前3名, 因为有并列成分, 所以可能候选路径⼤于3)径求解过程图:从节点4开始, 因为4是第⼀个出现多个前驱节点的⾸先看图中上⽅,它是根据⼀个已有词典构造出的有向⽆环图。

它将字串分为单个的字,每个字⽤图中相邻的两个结点表⽰,故对于长度为n的字串,需要n+1个结点。

两节点间若有边,则表⽰两节点间所包含的所有结点构成的词,如图中结点2、3、4构成词“的确”。

图构造出来后,接下来就要计算最短路径,N-最短路径是基于Dijkstra算法的⼀种简单扩展,它在每个结点处记录了N个最短路径值与该结点的前驱,具体过程如上图中下⽅列表。

Table(4)表⽰位于结点4时的最短路径情况,表⽰从结点0到4有两条路径,长度为3的路径前驱为2;长度为4的路径前驱为3。

前驱括号⾥⾯第⼆个数表⽰对相同前驱结点的区分,如(4,1)、(4,2)。

由列表可知,该字串的3-最短路径结果集合为{5,5,6,6,7}。

当然,在实际情况中,权值不可能都设为1的,否则随着字串长度n和最短路径N的增⼤,长度相同的路径数将会急剧增加。

为了解决这样的问题,我们需要通过某种策略为有向图的边赋权重,很⾃然的想法就是边的权重就是该词出现的可能性。

NShortPath的基本思想是Dijkstra算法的变种,拿1-最短路来说吧,先Dijkstra求⼀次最短路,然后沿着最短路的路径⾛下去,只不过在⾛到某个节点的时候,检查到该节点在路径上的下⼀个节点是否还有别的路到它(从PreNode查),如果有,就⾛这些别的路中的没⾛过第⼀条(它们都是最短路上的途径节点)。

hanlp中文分词器解读

中文分词器解析hanlp分词器接口设计:提供外部接口:分词器封装为静态工具类,并提供了简单的接口标准分词是最常用的分词器,基于HMM-Viterbi实现,开启了中国人名识别和音译人名识别,调用方法如下:HanLP.segment其实是对StandardTokenizer.segment的包装。

/*** 分词** @param text 文本* @return切分后的单词*/publicstatic List<Term>segment(String text){return StandardTokenizer.segment(text.toCharArray());}/*** 创建一个分词器<br>* 这是一个工厂方法<br>* 与直接new一个分词器相比,使用本方法的好处是,以后HanLP升级了,总能用上最合适的分词器* @return一个分词器*/publicstatic Segment newSegment()}publicclass StandardTokenizer{/*** 预置分词器*/publicstaticfinalSegment SEGMENT = HanLP.newSegment();/*** 分词* @param text 文本* @return分词结果*/publicstatic List<Term>segment(String text){return SEGMENT.seg(text.toCharArray());}/*** 分词* @param text 文本* @return分词结果*/publicstatic List<Term>segment(char[]text){return SEGMENT.seg(text);}/*** 切分为句子形式* @param text 文本* @return句子列表*/publicstatic List<List<Term>>seg2sentence(String text){return SEGMENT.seg2sentence(text);}}publicstatic Segment newSegment(){returnnew ViterbiSegment();// Viterbi分词器是目前效率和效果的最佳平衡}/*** Viterbi分词器<br>* 也是最短路分词,最短路求解采用Viterbi算法** @author hankcs*/publicclass ViterbiSegment extends WordBasedGenerativeModelSegmentNLP分词NLPTokenizer会执行全部命名实体识别和词性标注。

hanlp 中文分词

hanlp 中文分词

(原创实用版)

目录

1.汉 LP 的中文分词介绍

2.汉 LP 的中文分词原理

3.汉 LP 的中文分词应用领域

4.汉 LP 的中文分词的优点和不足

正文

汉 LP 的中文分词是一种基于人工智能的中文文本处理技术。

汉 LP,全称“汉字语言处理”,是一款由我国清华大学 KEG 实验室研发的开源的中文自然语言处理工具包。

其分词功能,可以将中文文本切分成有独立意义的词汇或短语,为后续的文本分析和处理提供了基础。

汉 LP 的中文分词原理主要是基于词频统计和机器学习算法。

首先,它会通过大量的语料库进行学习,分析词汇在文本中出现的频率和规律,然后建立一个模型,用以预测文本中的词汇边界。

当给定一段中文文本时,汉 LP 的分词模型会根据学习到的规律,将文本切分成有意义的词汇或短语。

汉 LP 的中文分词技术应用广泛,可以用于诸如文本分类、情感分析、信息检索、机器翻译等自然语言处理任务。

以文本分类为例,通过汉 LP 分词,可以将文本切分成有意义的词汇或短语,再进行特征提取和模型训练,最终实现文本的准确分类。

虽然汉 LP 的中文分词功能强大,但也存在一些优点和不足。

优点在于,其分词效果较好,可以准确识别出文本中的词汇边界,且开源免费,易于使用和二次开发。

不足之处在于,由于中文没有明确的词汇边界,导致其在处理一些特殊情况(如新词、歧义词等)时,效果可能不尽如人意。

此外,汉 LP 的分词速度相对较慢,对于大规模的文本处理任务,可能需

要较长的时间。

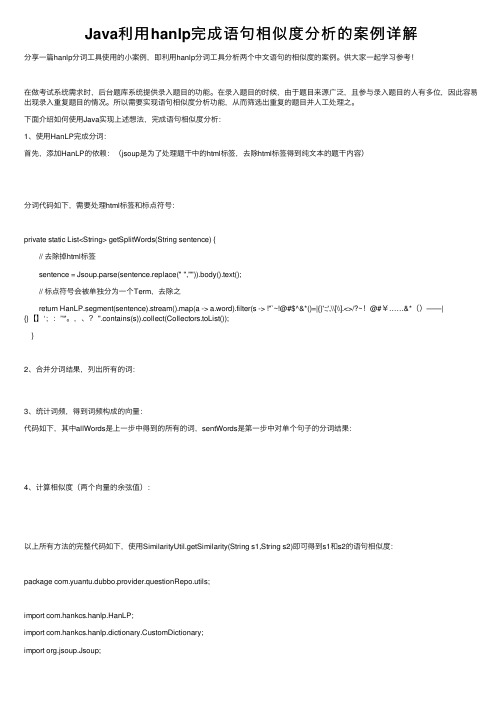

Java利用hanlp完成语句相似度分析的案例详解

Java利⽤hanlp完成语句相似度分析的案例详解分享⼀篇hanlp分词⼯具使⽤的⼩案例,即利⽤hanlp分词⼯具分析两个中⽂语句的相似度的案例。

供⼤家⼀起学习参考!在做考试系统需求时,后台题库系统提供录⼊题⽬的功能。

在录⼊题⽬的时候,由于题⽬来源⼴泛,且参与录⼊题⽬的⼈有多位,因此容易出现录⼊重复题⽬的情况。

所以需要实现语句相似度分析功能,从⽽筛选出重复的题⽬并⼈⼯处理之。

下⾯介绍如何使⽤Java实现上述想法,完成语句相似度分析:1、使⽤HanLP完成分词:⾸先,添加HanLP的依赖:(jsoup是为了处理题⼲中的html标签,去除html标签得到纯⽂本的题⼲内容)分词代码如下,需要处理html标签和标点符号:private static List<String> getSplitWords(String sentence) {// 去除掉html标签sentence = Jsoup.parse(sentence.replace(" ","")).body().text();// 标点符号会被单独分为⼀个Term,去除之return HanLP.segment(sentence).stream().map(a -> a.word).filter(s -> !"`~!@#$^&*()=|{}':;',\\[\\].<>/?~!@#¥……&*()——|{}【】‘;:”“'。

,、? ".contains(s)).collect(Collectors.toList());}2、合并分词结果,列出所有的词:3、统计词频,得到词频构成的向量:代码如下,其中allWords是上⼀步中得到的所有的词,sentWords是第⼀步中对单个句⼦的分词结果:4、计算相似度(两个向量的余弦值):以上所有⽅法的完整代码如下,使⽤SimilarityUtil.getSimilarity(String s1,String s2)即可得到s1和s2的语句相似度:package com.yuantu.dubbo.provider.questionRepo.utils;import com.hankcs.hanlp.HanLP;import com.hankcs.hanlp.dictionary.CustomDictionary;import org.jsoup.Jsoup;import java.util.ArrayList;import java.util.Calendar;import java.util.Collections;import java.util.List;import java.util.stream.Collectors;public class SimilarityUtil {static {CustomDictionary.add("⼦类");CustomDictionary.add("⽗类");}private SimilarityUtil() {}/*** 获得两个句⼦的相似度** @param sentence1* @param sentence2* @return*/public static double getSimilarity(String sentence1, String sentence2) { List<String> sent1Words = getSplitWords(sentence1);System.out.println(sent1Words);List<String> sent2Words = getSplitWords(sentence2);System.out.println(sent2Words);List<String> allWords = mergeList(sent1Words, sent2Words);int[] statistic1 = statistic(allWords, sent1Words);int[] statistic2 = statistic(allWords, sent2Words);double dividend = 0;double divisor1 = 0;double divisor2 = 0;for (int i = 0; i < statistic1.length; i++) {dividend += statistic1[i] * statistic2[i];divisor1 += Math.pow(statistic1[i], 2);divisor2 += Math.pow(statistic2[i], 2);}return dividend / (Math.sqrt(divisor1) * Math.sqrt(divisor2));}private static int[] statistic(List<String> allWords, List<String> sentWords) {int[] result = new int[allWords.size()];for (int i = 0; i < allWords.size(); i++) {result[i] = Collections.frequency(sentWords, allWords.get(i));}return result;}private static List<String> mergeList(List<String> list1, List<String> list2) {List<String> result = new ArrayList<>();result.addAll(list1);result.addAll(list2);return result.stream().distinct().collect(Collectors.toList());}private static List<String> getSplitWords(String sentence) {// 去除掉html标签sentence = Jsoup.parse(sentence.replace(" ","")).body().text();// 标点符号会被单独分为⼀个Term,去除之return HanLP.segment(sentence).stream().map(a -> a.word).filter(s -> !"`~!@#$^&*()=|{}':;',\\[\\].<>/?~!@#¥……&*()——| {}【】‘;:”“'。

hanlp 训练文本分类

hanlp 训练文本分类

HanLP是一款开源的自然语言处理工具包,提供了训练文本分类模型的功能。

文本分类是通过将文本划分到不同的预定义类别中,来实现对文本的自动分类。

下面是使用HanLP训练文本分类模型的一般步骤:

1. 数据准备:准备好用于训练的文本数据集,其中包括已经标注好的文本和对应的类别。

2. 特征提取:将文本数据转换成机器学习算法可以理解的特征向量。

HanLP提供了一些常用的特征提取方法,例如词袋模型、n-gram模型、TF-IDF模型等。

3. 模型训练:根据特征向量和对应的类别标签进行模型训练。

HanLP提供了各种机器学习算法的实现,如朴素贝叶斯、支持向量机等。

4. 模型评估:使用测试集对训练得到的模型进行评估,得到模型的准确率、召回率等指标。

5. 模型应用:使用训练得到的模型对新的文本进行分类预测。

在使用HanLP训练文本分类模型时,可以根据具体需求选择合适的特征提取方法和机器学习算法。

同时,还可以根据需要进行参数调整和模型优化。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

中文分词器解析hanlp分词器接口设计:提供外部接口:分词器封装为静态工具类,并提供了简单的接口标准分词是最常用的分词器,基于HMM-Viterbi实现,开启了中国人名识别和音译人名识别,调用方法如下:HanLP.segment其实是对StandardTokenizer.segment的包装。

/*** 分词** @param text 文本* @return切分后的单词*/publicstatic List<Term>segment(String text){return StandardTokenizer.segment(text.toCharArray());}/*** 创建一个分词器<br>* 这是一个工厂方法<br>* 与直接new一个分词器相比,使用本方法的好处是,以后HanLP升级了,总能用上最合适的分词器* @return一个分词器*/publicstatic Segment newSegment()}publicclass StandardTokenizer{/*** 预置分词器*/publicstaticfinalSegment SEGMENT = HanLP.newSegment();/*** 分词* @param text 文本* @return分词结果*/publicstatic List<Term>segment(String text){return SEGMENT.seg(text.toCharArray());}/*** 分词* @param text 文本* @return分词结果*/publicstatic List<Term>segment(char[]text){return SEGMENT.seg(text);}/*** 切分为句子形式* @param text 文本* @return句子列表*/publicstatic List<List<Term>>seg2sentence(String text){return SEGMENT.seg2sentence(text);}}publicstatic Segment newSegment(){returnnew ViterbiSegment();// Viterbi分词器是目前效率和效果的最佳平衡}/*** Viterbi分词器<br>* 也是最短路分词,最短路求解采用Viterbi算法** @author hankcs*/publicclass ViterbiSegment extends WordBasedGenerativeModelSegmentNLP分词NLPTokenizer会执行全部命名实体识别和词性标注。

,调用方法如下:∙NLP分词NLPTokenizer会执行全部命名实体识别和词性标注。

∙所以速度比标准分词慢,并且有误识别的情况。

publicclass NLPTokenizer{/*** 预置分词器*/publicstaticfinalSegment SEGMENT =HanLP.newSegment().enableNameRecognize(true).enableTranslatedNameRecognize( true).enableJapaneseNameRecognize(true).enablePlaceRecognize(true).enableOr ganizationRecognize(true).enablePartOfSpeechTagging(true);publicstatic List<Term>segment(String text){return SEGMENT.seg(text);}/*** 分词* @param text 文本* @return分词结果*/publicstatic List<Term>segment(char[]text){return SEGMENT.seg(text);}/*** 切分为句子形式* @param text 文本* @return句子列表*/publicstatic List<List<Term>>seg2sentence(String text){return SEGMENT.seg2sentence(text);}}索引分词IndexTokenizer是面向搜索引擎的分词器,能够对长词全切分,另外通过term.offset可以获取单词在文本中的偏移量。

调用方法如下:List<Term>termList=IndexTokenizer.segment("主副食品");for(Termterm:termList){System.out.println(term+"["+term.offset+":"+(term.offset+term.word.length())+"]");}publicclass IndexTokenizer{/*** 预置分词器*/publicstaticfinalSegment SEGMENT = HanLP.newSegment().enableIndexMode(true); publicstatic List<Term>segment(String text){return SEGMENT.seg(text);}/*** 分词* @param text 文本* @return分词结果*/publicstatic List<Term>segment(char[]text){return SEGMENT.seg(text);}/*** 切分为句子形式* @param text 文本* @return句子列表*/publicstatic List<List<Term>>seg2sentence(String text){return SEGMENT.seg2sentence(text);}}繁体分词TraditionalChineseTokenizer可以直接对繁体进行分词,输出切分后的繁体词语。

调用方法如下:List<Term>termList=TraditionalChineseTokenizer.segment("大衛貝克漢不僅僅是名著名球員,球場以外,其妻為前辣妹合唱團成員維多利亞·碧咸,亦由於他擁有突出外表、百變髮型及正面的形象,以至自己品牌的男士香水等商品,及長期擔任運動品牌Adidas的代言人,因此對大眾傳播媒介和時尚界等方面都具很大的影響力,在足球圈外所獲得的認受程度可謂前所未見。

");System.out.println(termList);* 繁体中文分词器** @author hankcs*/publicclass TraditionalChineseTokenizer{/*** 预置分词器*/publicstaticSegment SEGMENT = HanLP.newSegment();privatestatic List<Term>segSentence(String text){if(text.length()==0)return Collections.emptyList();LinkedList<ResultTerm<String>>tsList=CommonAhoCorasickSegmentUtil.segment(t ext,TraditionalChineseDictionary.trie);StringBuilder sbSimplifiedChinese=new StringBuilder(text.length());boolean equal=true;for(ResultTerm<String>term:tsList){if(bel==null)bel=term.word;elseif(bel.length()!=term.word.length())equal=false; sbSimplifiedChinese.append(bel);}String simplifiedChinese=sbSimplifiedChinese.toString();List<Term>termList=SEGMENT.seg(simplifiedChinese);if(equal){int offset=0;for(Term term:termList){term.word=text.substring(offset,offset+term.length());term.offset=offset;offset+=term.length();}}else{Iterator<Term>termIterator=termList.iterator();Iterator<ResultTerm<String>>tsIterator=tsList.iterator();ResultTerm<String>tsTerm=tsIterator.next();int offset=0;while(termIterator.hasNext())Term term=termIterator.next();term.offset=offset;if(offset>tsTerm.offset+tsTerm.word.length())tsTerm=tsIterator.next();if(offset==tsTerm.offset&&term.length()==bel.length()){term.word=tsTerm.word;}else term.word=SimplifiedChineseDictionary.convertToTraditionalChinese(term. word);offset+=term.length();}}return termList;}publicstatic List<Term>segment(String text){List<Term>termList=new LinkedList<Term>();for(String sentence:SentencesUtil.toSentenceList(text)){termList.addAll(segSentence(sentence));}return termList;}/*** 分词** @param text 文本* @return分词结果*/publicstatic List<Term>segment(char[]text){return segment(CharTable.convert(text));}/*** 切分为句子形式** @param text 文本* @return句子列表*/publicstatic List<List<Term>>seg2sentence(String text){List<List<Term>>resultList=new LinkedList<List<Term>>();{for(String sentence:SentencesUtil.toSentenceList(text)){resultList.add(segment(sentence));}}return resultList;}}极速分词是词典最长分词,速度极其快,精度一般。