MPI并行编程

《MPI并行程序设计》课件

MPI的应用领域

MPI广泛应用于科学计算、 大规模数据处理和模拟等领 域,提供了高性能和高效率 的并行计算能力。

MPI基础

1

MPI的环境设置

在开始编写MPI程序之前,需要进行环境设置,包括MPI库的安装和配置,以及节点之间的 网络连接。

据的能力。

总结

1 MPI的优点和缺点

MPI具有高性能、可扩展性和灵活性的优点,但也面临数据通信和负载平衡等挑战。

2 MPI的未来发展趋势

MPI在超级计算和并行计算领域仍发展空间,如更高的并行度、更低的通信延迟和更丰富 的功能。

3 怎样提高MPI的性能

优化MPI程序的性能可以从算法、通信模式、负载均衡和并行度等方面入手,提高并行计 算的效率。

宏定义和预处理

MPI提供了丰富的宏定义和预处理功能,可以简化 并行程序的编写和调试过程,提高开发效率。

实战

1

MPI编程实战

通过实际编写MPI程序,学习如何利用

并行排序实战

2

MPI接口进行并行计算,解决实际问题, 如矩阵运算、图算法等。

利用MPI的并行计算能力,实现高效的排 序算法,提高排序性能和处理大规模数

2

MPI的通信模型

MPI采用消息传递的通信模型,通过发送和接收消息来实现不同进程之间的数据交换和同步。

3

点对点通信

MPI支持点对点通信操作,包括发送、接收和非阻塞通信,用于实现进程之间的直接消息传 递。

4

集合通信

MPI提供了集合通信操作,如广播、栅栏、归约等,用于在整个进程组中进行数据的统一和 协同计算。

MPI高级

MPI的拓扑结构

并行计算_实验三_简单的MPI并行程序及性能分析

并行计算_实验三_简单的MPI并行程序及性能分析一、实验背景和目的MPI(Massive Parallel Interface,大规模并行接口)是一种用于进行并行计算的通信协议和编程模型。

它可以使不同进程在分布式计算机集群上进行通信和协同工作,实现并行计算的目的。

本实验将设计和实现一个简单的MPI并行程序,并通过性能分析来评估其并行计算的效果。

二、实验内容1.设计一个简单的MPI并行程序,并解决以下问题:a.将一个矩阵A进行分块存储,并将其均匀分配给不同的进程;b.将每个进程分别计算所分配的矩阵块的平均值,并将结果发送给主进程;c.主进程将收到的结果汇总计算出矩阵A的平均值。

2.运行该MPI程序,并记录下执行时间。

3.对程序的性能进行分析:a.利用不同规模的输入数据进行测试,观察程序的运行时间与输入规模的关系;b. 使用mpiexec命令调整进程数量,观察程序的运行时间与进程数量的关系。

三、实验步骤1.程序设计和实现:a.设计一个函数用于生成输入数据-矩阵A;b.编写MPI并行程序的代码,实现矩阵块的分配和计算;c.编写主函数,调用MPI相应函数,实现进程间的通信和数据汇总计算。

2.编译和运行程序:a.使用MPI编译器将MPI并行程序编译成可执行文件;b.在集群上运行程序,并记录下执行时间。

3.性能分析:a.对不同规模的输入数据运行程序,记录下不同规模下的运行时间;b. 使用mpiexec命令调整进程数量,对不同进程数量运行程序,记录下不同进程数量下的运行时间。

四、实验结果和分析执行实验后得到的结果:1.对不同规模的输入数据运行程序,记录下不同规模下的运行时间,得到如下结果:输入规模运行时间100x1002.345s200x2005.678s300x30011.234s...从结果可以看出,随着输入规模的增加,程序的运行时间也相应增加。

2. 使用mpiexec命令调整进程数量,对不同进程数量运行程序,记录下不同进程数量下的运行时间,得到如下结果:进程数量运行时间110.345s26.789s43.456s...从结果可以看出,随着进程数量的增加,程序的运行时间逐渐减少,但当进程数量超过一定限制后,进一步增加进程数量将不再显著减少运行时间。

基于MPI的并行程序设计(精)

基于MPI的并行程序设计(精)基于MPI的并行程序设计(精)概述MPI(Message Passing Interface)是一种用于编写并行计算程序的通信协议。

它提供了一系列的函数和语义,使得在多个进程之间进行通信和同步变得简单和高效。

并行计算模型并行计算模型是指如何将计算任务分配给多个处理单元以更高效地完成计算。

其中,最常见的两种模型是SPMD(Single Program Multiple Data)和MPMD(Multiple Program Multiple Data)。

在SPMD模型中,所有的处理单元运行相同的程序,但可以根据需要进行不同的计算。

而在MPMD模型中,不同的处理单元可以运行不同的程序,用于处理不同的数据。

MPI的基本概念在MPI中,通信是通过发送和接收消息来实现的。

一个MPI程序由多个进程组成,每个进程拥有自己的进程号。

进程之间通过进程号来识别和通信。

MPI提供了一系列函数接口,用于发送和接收消息、同步进程等操作。

常用的函数包括`MPI_Send`、`MPI_Recv`、`MPI_Barrier`等。

并行程序设计技巧在设计MPI程序时,需要考虑以下几个方面:1. 进程拓扑:MPI提供了一些函数用于创建进程通信的拓扑结构,Cartesian拓扑、图拓扑等。

合理地设计拓扑结构可以提高通信效率。

2. 进程通信:MPI提供了多种消息发送和接收的方式,如点对点通信、广播、规约等。

根据实际需求选择合适的通信方式可以提高程序性能。

3. 负载平衡:在并行计算中,任务的负载可能不均衡,导致某些进程的负载过重。

通过合理地分配任务并进行负载平衡,可以充分利用计算资源。

4. 数据分布:根据实际问题,合理地将数据分布到不同的进程上,可以减少通信开销,提高程序的效率。

5. 错误处理:并行计算中可能发生错误,如通信错误、计算错误等。

合理地进行错误处理可以增加程序鲁棒性。

MPI是一种强大的并行计算编程框架,可以帮助我们设计和实现高效的并行程序。

MPI并行程序设计

MPI并行程序设计MPI并行程序设计引言MPI(Message Passing Interface)是一种常用的并行计算编程模型,用于在分布式计算环境中实现并行程序设计。

MPI提供了在多个进程之间进行通信和同步的机制,使得程序能够充分利用集群或超级计算机的并行性能。

本文将介绍MPI的基本概念和使用方法,并帮助读者了解如何进行MPI并行程序设计。

MPI基本概念MPI的核心思想是将计算任务划分为多个子任务,并将这些子任务分发给不同的进程进行并行计算。

MPI使用消息传递的方式来实现进程之间的通信和同步。

以下是一些MPI的基本概念:进程通信在MPI中,每个并行计算的进程都有一个唯一的标识符,称为进程号(rank)。

进程之间可以使用通信操作进行消息传递,包括发送消息(send)、接收消息(receive)和同步(synchronize)等操作。

点对点通信点对点通信是指在两个进程之间进行消息传递,包括发送方和接收方。

发送方使用`MPI_Send`函数发送消息,接收方使用`MPI_Recv`函数接收消息。

广播通信广播通信是指一个进程向所有其他进程发送消息的操作。

发送方使用`MPI_Bcast`函数广播消息,接收方使用`MPI_Recv`函数接收消息。

归约操作归约操作是指将一组数值合并为一个数值的操作,如求和、求最大值等。

MPI提供了多种归约操作,包括`MPI_Reduce`和`MPI_Allreduce`。

并行计算模式MPI支持多种并行计算模式,包括主从模式、对等模式等。

在主从模式中,一个进程作为主进程,负责分发任务和收集结果;其余进程作为从进程,负责执行分配的子任务。

在对等模式中,所有进程都具有相同的任务和贡献。

MPI程序设计步骤编写MPI并行程序的一般步骤如下:1. 初始化MPI环境:使用`MPI_Init`函数初始化MPI环境,并获取进程数量和进程编号等信息。

2. 分配任务:根据进程编号和任务数量,将总计算任务划分为子任务,并分发给各个进程。

基于MPI的并行程序设计

基于MPI的并行程序设计MPI(Message Passing Interface)是一种用于并行计算的消息传递编程接口。

它提供了一组用于在多个进程之间传递消息的函数,使得在并行计算中能够更加高效地利用计算资源。

本文将介绍MPI的基本原理和并行程序设计的一些基本概念。

MPI的基本原理是基于消息传递的,并行计算模型。

在MPI中,计算节点被组织成一个逻辑拓扑结构,每个节点都可以通过消息传递的方式与其他节点进行通信。

这种消息传递方式可以通过网络或者高速互连的硬件来实现,使得多个节点之间可以并行地进行计算。

并行程序设计的关键是分割问题和分配任务。

在MPI中,通常将任务分割成若干个较小的子任务,然后将这些子任务分配给不同的计算节点进行并行计算。

每个计算节点独立地计算自己的子任务,并通过消息传递与其他节点进行通信,最终将计算结果汇总起来。

并行程序设计的另一个重要概念是同步和异步操作。

同步操作是指在发送或接收消息时,发送进程或接收进程需要等待对应的操作完成后才能继续执行。

而异步操作则是指发送和接收消息的操作不会阻塞进程的执行,进程可以继续执行其他的计算操作。

MPI提供了一系列的同步和异步通信操作,例如MPI_Isend和MPI_Irecv函数,用于实现非阻塞的消息传递。

在并行程序设计中,性能优化是一个重要的课题。

为了提高并行计算的效率,可以采用一些优化技术,例如流水线计算、任务分发和负载均衡。

流水线计算是指将计算任务划分为若干个阶段,并将每个阶段分配给不同的计算节点进行并行计算。

任务分发是指将计算任务动态地分配给空闲的计算节点,以实现任务的并行处理。

负载均衡是指将计算任务均匀地分配给不同的计算节点,以避免一些节点的计算负载过重。

总的来说,MPI是一种基于消息传递的并行编程接口,提供了一系列的通信原语,用于在计算节点之间进行消息传递。

通过合理地分割问题、分配任务和优化计算过程,可以实现高效的并行程序设计。

在当前的多核计算环境中,MPI仍然是一种重要的并行编程模型,在科学计算、大规模数据分析等领域有着广泛的应用。

基于MPI并行编程环境简述

基于MPI并行编程环境简述MPI并行编程环境是一种并行编程解决方案,它被广泛应用于高性能计算领域。

本文将对MPI并行编程环境做一个简单的介绍,包括MPI的概念、MPI的基本编程模式、MPI的特点和应用场景等方面。

最后还将介绍一些MPI编程中要注意的问题。

一、MPI的概念MPI是Message Passing Interface的缩写,意思是“消息传递接口”,它是一种并行计算环境的标准化接口,并且被广泛应用于高性能计算领域。

MPI允许程序员编写MPI应用程序来在多个进程之间传递消息,并对应用程序进行并行化处理。

MPI定义了一套通信协议,使得单个进程可以通过网络连接与其他进程进行通信。

MPI支持多种编程语言,包括C、C++、Fortran等。

MPI的实现通常包括一个标准库和一个运行时系统,它们提供了一系列函数和工具,用于支持消息传递协议和进程管理。

二、MPI的基本编程模式MPI的基本编程模式是消息传递模型,它通过传递消息实现进程之间的通信和同步。

MPI提供了一套通信协议,包括点对点通信和集合通信两种方式,以及同步通信和异步通信两种方式。

在点对点通信中,发送方将消息传递给接收方;在集合通信中,一组进程相互交换数据。

同步通信要求发送方等待接收方的响应,而异步通信则可以在发送消息之后立即返回并继续执行。

三、MPI的特点MPI具有以下几个特点:1. 并行性:MPI可以同时在多个进程之间完成任务,并能够将运算分解成多个独立的计算单元来并行执行。

2. 可移植性:MPI的标准化接口使得程序员可以跨平台编写MPI应用程序,而无需考虑底层计算机架构和操作系统的区别。

3. 可扩展性:MPI支持将计算任务分配到大规模的计算资源上,能够有效地扩展计算能力。

4. 通信效率高:MPI的通信协议具有高效的性能,支持传输大量的数据,因此可以在高速网络上实现高速通信。

四、MPI的应用场景MPI主要应用于高性能计算领域,可以用于大规模数值模拟、数据挖掘、机器学习等任务。

visual studio fortran mpi用法

在 Visual Studio 中使用 Fortran 和 MPI(Message Passing Interface)进行并行编程,可以通过以下步骤:1. 安装 Visual Studio:首先,确保已安装 Visual Studio。

您可以从 Microsoft 官方网站上下载适用于 Fortran 开发的 Visual Studio 版本。

2. 安装 Intel Fortran Compiler:如果您计划使用 Intel Fortran 编译器进行开发,需要安装 Intel Parallel Studio XE,其中包含了 Intel Fortran Compiler。

3. 创建 Fortran 项目:在 Visual Studio 中,选择 "创建新项目",然后选择 "Fortran" 类型的项目。

4. 配置项目属性:在项目属性中,设置编译器选项和链接器选项,以及其他项目设置。

例如,设置编译器为 Intel Fortran Compiler。

5. 编写 Fortran 代码:编写您的 Fortran 代码,可以使用 Fortran 90/95/2003/2008 的语法。

6. 添加 MPI 支持:在 Fortran 代码中,使用 MPI 库函数进行并行编程。

您需要添加MPI 头文件和库文件的路径,以便编译和链接 MPI 相关代码。

MPI 头文件通常位于MPI 安装目录的 include 文件夹下,而库文件则位于 lib(Windows)或 lib64(Linux)文件夹下。

7. 构建和运行:构建项目并运行生成的可执行文件。

在运行 MPI 程序时,您可能需要在启动命令中指定使用的进程数(例如,mpiexec -n 4)。

这些步骤提供了一个基本的框架,让您可以在 Visual Studio 中进行 Fortran 和 MPI 的并行编程。

根据您的具体需求和环境,可能还需要进行一些其他的配置和设置。

MPI并行编程实战技巧

MPI并行编程实战技巧MPI并行编程实战技巧MPI(Message Passing Interface)是一种用于并行程序设计的通信库,常用于分布式内存系统中的并行计算。

在并行编程实践中,掌握一些实战技巧可以帮助我们更高效地利用MPI进行程序开发。

首先,我们需要注意程序的并行性。

在使用MPI 编写并行程序时,我们需要将问题分解为多个子问题,每个子问题由不同的进程处理。

这就需要我们对问题的分解和并行算法有一定的了解。

合理地划分任务可以最大程度地发挥并行计算的优势。

其次,合理地利用MPI的通信机制。

MPI通过发送和接收消息来实现进程间的通信。

在编写MPI程序时,我们需要注意如何选择适当的通信模式和通信函数。

常用的通信模式有点对点通信和集合通信。

点对点通信适用于两个进程之间的直接通----宋停云与您分享----信,而集合通信适用于多个进程之间的通信。

MPI 提供了一系列通信函数,如MPI_Send、MPI_Recv 等,我们需要根据具体情况选择合适的函数。

另外,我们还需要注意MPI的性能优化。

MPI程序的性能受多种因素影响,如通信开销、负载平衡等。

为了提高程序的性能,我们需要考虑如何减少通信开销,如合并消息、减少消息的发送次数等。

此外,我们还需要保持负载的平衡,避免进程之间的负载不均衡导致性能下降。

最后,我们需要进行MPI程序的调试和性能分析。

MPI程序的调试和性能分析是很重要的一步。

对于程序中的错误,我们可以使用一些调试工具来定位和解决。

而对于性能分析,我们可以使用一些性能分析工具来找出程序的瓶颈,并进行相应的优化。

总之,MPI并行编程是一门有挑战性的技术,但通过掌握一些实战技巧,我们可以更好地利用MPI进行程序开发。

我们需要注意程序的并行性、----宋停云与您分享----合理利用MPI的通信机制、进行性能优化以及进行调试和性能分析。

通过不断地实践和总结,我们可以逐渐提高自己的MPI编程能力。

----宋停云与您分享----。

MPI并行程序设计自学教程

MPI并行程序设计自学教程MPI是一种用于编写并行程序的工具,旨在将计算任务分发给多个处理单元,以加速程序的执行速度。

MPI的全称是Message Passing Interface,它提供了一组函数和语法,用于在不同处理单元之间传递消息和同步计算。

要学习MPI并行程序设计,我们首先需要了解MPI的基本概念和原理。

MPI是一个基于消息传递的并行编程模型,它将计算任务划分为一系列独立的进程,每个进程在自己的内存空间中执行。

进程之间通过发送和接收消息来进行通信,以便协调计算任务的执行。

MPI的编程模型主要包括以下几个概念:1.进程:计算任务的基本执行单元。

每个进程都有自己的地址空间和程序计数器,并且可以并行执行相同或不同的指令。

2.通信域:进程之间可以相互通信的区域。

在MPI中,通信域由一组进程组成,可以是整个并行程序的全部进程,也可以是由进程分组而成的子集。

3.消息:进程之间传递的数据块。

消息包括发送方的标识符、接收方的标识符和数据本身。

4.同步:确保不同进程之间的通信按特定的顺序进行。

同步操作可以保证消息的可靠传递和正确的计算顺序。

为了开始学习MPI并行程序设计,可以按照以下步骤进行:1. 安装MPI库:首先需要安装MPI库,可选的MPI库有多种,如Open MPI、MPICH等。

选择并安装一个适合的MPI库,并确保能在计算机上正常运行。

2.学习MPI基本函数:MPI提供了一组函数,用于创建进程、发送和接收消息、同步进程等。

可以逐步学习这些函数的使用方法,并写一些简单的MPI程序来测试。

3.理解进程并行模型:理解MPI的进程并行模型,并思考如何将计算任务分发给不同的进程并协调它们的执行。

可参考一些经典的并行算法和并行设计模式,如并行矩阵乘法、并行归并排序等。

4.设计并实现MPI程序:根据实际需求,设计并实现一个MPI程序。

可以从简单的问题开始,逐步扩展到更复杂的问题。

在程序设计过程中,注意消息的发送和接收顺序,以及进程之间的同步操作。

c语言mpi并行计算矩阵乘法

c语言mpi并行计算矩阵乘法

C语言中的MPI(Message Passing Interface)是一种用于编写并行程序的标准,它允许多个进程在不同的计算节点上进行通信和协作。

矩阵乘法是一个经典的并行计算问题,可以通过MPI来实现并行化。

首先,我们需要将矩阵乘法的计算任务分配给不同的进程。

可以将两个矩阵分别分块,然后将这些块分配给不同的进程。

每个进程负责计算其分配到的部分,并将结果发送回主进程。

在C语言中,可以使用MPI库来实现这一过程。

首先,需要初始化MPI环境,并确定每个进程的编号和总进程数。

然后,主进程可以负责将矩阵分块并发送给其他进程,其他进程则接收并进行计算。

计算完成后,结果可以发送回主进程,由主进程进行汇总。

需要注意的是,在并行计算中,需要考虑数据通信的开销以及负载均衡等问题。

合理地分配任务和减少通信开销是并行计算中需要考虑的重要问题。

另外,还可以考虑使用一些优化技术来提高并行矩阵乘法的性

能,比如使用非阻塞通信、优化数据布局以减少通信量、使用多级并行等技术。

总之,使用C语言和MPI实现矩阵乘法的并行计算需要考虑任务分配、数据通信、性能优化等多个方面,需要综合考虑并合理设计并行算法。

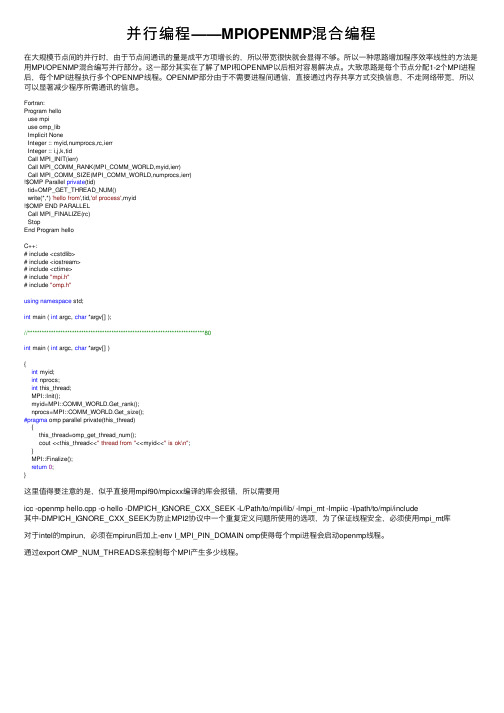

并行编程——MPIOPENMP混合编程

并⾏编程——MPIOPENMP混合编程在⼤规模节点间的并⾏时,由于节点间通讯的量是成平⽅项增长的,所以带宽很快就会显得不够。

所以⼀种思路增加程序效率线性的⽅法是⽤MPI/OPENMP混合编写并⾏部分。

这⼀部分其实在了解了MPI和OPENMP以后相对容易解决点。

⼤致思路是每个节点分配1-2个MPI进程后,每个MPI进程执⾏多个OPENMP线程。

OPENMP部分由于不需要进程间通信,直接通过内存共享⽅式交换信息,不⾛⽹络带宽,所以可以显著减少程序所需通讯的信息。

Fortran:Program hellouse mpiuse omp_libImplicit NoneInteger :: myid,numprocs,rc,ierrInteger :: i,j,k,tidCall MPI_INIT(ierr)Call MPI_COMM_RANK(MPI_COMM_WORLD,myid,ierr)Call MPI_COMM_SIZE(MPI_COMM_WORLD,numprocs,ierr)!$OMP Parallel private(tid)tid=OMP_GET_THREAD_NUM()write(*,*) 'hello from',tid,'of process',myid!$OMP END PARALLELCall MPI_FINALIZE(rc)StopEnd Program helloC++:# include <cstdlib># include <iostream># include <ctime># include "mpi.h"# include "omp.h"using namespace std;int main ( int argc, char *argv[] );//****************************************************************************80int main ( int argc, char *argv[] ){int myid;int nprocs;int this_thread;MPI::Init();myid=MPI::COMM_WORLD.Get_rank();nprocs=MPI::COMM_WORLD.Get_size();#pragma omp parallel private(this_thread){this_thread=omp_get_thread_num();cout <<this_thread<<" thread from "<<myid<<" is ok\n";}MPI::Finalize();return0;}这⾥值得要注意的是,似乎直接⽤mpif90/mpicxx编译的库会报错,所以需要⽤icc -openmp hello.cpp -o hello -DMPICH_IGNORE_CXX_SEEK -L/Path/to/mpi/lib/ -lmpi_mt -lmpiic -I/path/to/mpi/include其中-DMPICH_IGNORE_CXX_SEEK为防⽌MPI2协议中⼀个重复定义问题所使⽤的选项,为了保证线程安全,必须使⽤mpi_mt库对于intel的mpirun,必须在mpirun后加上-env I_MPI_PIN_DOMAIN omp使得每个mpi进程会启动openmp线程。

mpi基本用法 -回复

mpi基本用法-回复MPI基本用法MPI(Message Passing Interface)是一种常用的并行计算编程模型,它允许在分布式内存系统中进行进程间通信。

MPI被广泛应用于科学计算、高性能计算以及大规模数据处理等领域。

本文将介绍MPI的基本用法,为大家一步一步解释如何使用MPI进行并行计算。

第一步:MPI的安装和设置1.1 安装MPI库首先,要在计算机上安装MPI库。

常用的MPI库包括Open MPI、MPICH 和Intel MPI等。

根据操作系统的不同,可以选择合适的MPI库进行安装。

1.2 环境变量设置安装完成后,需要设置相应的环境变量。

将MPI的安装目录添加到系统路径(PATH)中,以便系统可以找到MPI的执行程序。

同时,还需要设置LD_LIBRARY_PATH环境变量,以指定MPI库的位置。

第二步:MPI的编程模型MPI的编程模型基于进程间的消息传递。

每个进程都有自己的地址空间,并且可以通过MPI的函数进行相互通信。

MPI定义了一系列的函数和数据类型,用于实现进程间的消息传递和同步操作。

2.1 初始化MPI环境在开始使用MPI之前,需要调用MPI的初始化函数来建立MPI的运行环境。

可以通过以下代码来完成初始化操作:c#include <mpi.h>int main(int argc, char argv) {MPI_Init(&argc, &argv);TODO: MPI代码MPI_Finalize();return 0;}在这段代码中,`MPI_Init()`函数用于初始化MPI环境,`MPI_Finalize()`函数用于关闭MPI环境。

`argc`和`argv`是命令行参数,通过它们可以传递程序运行所需的参数。

2.2 进程间通信MPI提供了一系列的通信函数,用于实现进程间的消息传递。

常用的通信函数包括`MPI_Send()`、`MPI_Recv()`、`MPI_Bcast()`和`MPI_Reduce()`等。

mpi

Message Passing Interface—消息传递接口

与OpenMP并行程序不同,MPI是一 种基于信息传递的并行编程技术。消息传 递接口是一种编程接口标准,而不是一种 具体的编程语言。简而言之,MPI标准定义 了一组具有可移植性的编程接口。

1.MPi组成

• 数据类型

定义了精确的数据类型参数而不使用字节计数,以数据类型为单位指定 消息的长度; 对于C和Fortran,MPI均预定义了一组数据类型和一些附加的数据类型; 可以发送 或接收连续的数据,还可以处理不连续的数据;中的一个通信域定义了一组进程和一个通信的上下文,虚拟处理 器拓扑、属性等内容。它以对象形式存在,作为通信操作的附加参数。 MPI预定义的通信域:mpi comm world(包含所有进程)、 mpi comm self(只包含各个进程自己的进程组)

• MPI调用接口—6个基本调用

1.mpi init()初始化MPI执行环境,建立多个MPI进程之间的联系,为 后续通信做准备 2.mpi finalize 结束MPI执行环境 3.mpi comm rank用来标识各个MPI进程的,给出调用该函数的进程的 进程号,返回整型的错误值 两个参数:MPI_Comm类型的通信域,标识参与计算的MPI进程组; &rank返回调用进程中的标识号 4.mpi comm size用来标识相应进程组中有多少个进程

• 组通信—一个特定组内所有进程都参加全局的数据处理和通信操作

功能:通信—组内数据的传输 同步—所有进程在特定的点上取得一致 计算—对给定的数据完成一定的操作 类型:1)数据移动 广播(mpi bcast) 收集(mpi gather) 散射(mpi scater) 组收集(mpi all gather)全交换(all to all) 2)聚集 规约(mpi reduce)将组内所有的进程输入 缓冲区中的数据按 定操作OP进行运算,并将起始结果返回到root进程的接收缓冲区 扫描(mpi scan)要求每一个进程对排在它前面的进程进行规约 操作,结果存入自身的输出缓冲区 3)同步 路障(mpi barrier)实现通信域内所有进程互相同步,它们将处 于等待状态,直到所有进程执行它们各自的MPI-BARRIER调用

MPI并行编程入门

MPI几个基本函数

• 获取处理器的名称 C:

int MPI_Get_processor_name(char *name, int *resultlen)

Fortran 77:

MPI_GET_PROCESSOR_NAME(NAME, RESULTLEN, IERR) CHARACTER *(*) NAME INTEGER RESULTLEN, IERROR • 在返回的name中存储所在处理器的名称 • resultlen存放返回名字所占字节 • 应提供参数name不少于MPI_MAX_PRCESSOR_NAME个字

MPI基础知识

• 进程与消息传递 • MPI重要概念 • MPI函数一般形式 • MPI原始数据类型 • MPI程序基本结构 • MPI几个基本函数 • 并行编程模式

进程与消息传递

• 单个进程(process) – 进程与程序相联,程序一旦在操作系统中运行即成为进程。 进程拥有独立的执行环境(内存、寄存器、程序计数器等) ,是操作系统中独立存在的可执行的基本程序单位 – 串行应用程序编译形成的可执行代码,分为“指令”和“数据”两 个部分,并在程序执行时“独立地申请和占有”内存空间,且 所有计算均局限于该内存空间。

MPI几个基本函数

• 得到通信器的进程数和进程在通信器中的标号 C:

int MPI_Comm_size(MPI_Comm comm, int *size) int MPI_Comm_rank(MPI_Comm comm, int *rank)

Fortran 77:

MPI_COMM_SIZE(COMM, SIZE, IERROR) INTEGER COMM, SIZE, IERROR

MPI重要概念

• 进程组(process group) 指MPI 程序的全部进程集合的一个有序

c++的mpi编程

c++的mpi编程C++的MPI编程是一种用于实现并行计算的方法。

MPI(Message Passing Interface)是一种通信协议,它允许在分布式计算系统中进行高效的消息传递。

在C++中使用MPI编程,可以充分利用多核处理器和集群计算机等并行资源。

以下是C++ MPI编程的基本步骤:1. 配置MPI环境:首先,需要在操作系统上安装MPI库。

安装完成后,可以通过编译器参数或环境变量指定MPI库的路径。

2. 编写程序:编写一个C++程序,使用MPI库提供的函数进行通信和同步。

常见的MPI函数包括发送和接收消息的函数(如MPI_Send 和MPI_Recv),以及用于进程间通信的函数(如MPI_Comm_size和MPI_Comm_rank)。

3. 分配计算资源:在程序中,使用MPI_Comm_size函数获取进程数量,然后根据问题规模和计算资源分配任务。

可以使用MPI_Comm_rank函数获取当前进程的编号。

4. 初始化MPI:在程序开始时,使用MPI_Init函数初始化MPI库。

在程序结束时,使用MPI_Finalize函数关闭MPI库。

5. 编写主函数:在主函数中,使用MPI函数进行进程间通信和数据交换。

例如,可以使用MPI_Send和MPI_Recv函数实现数据的发送和接收。

6. 编写并行区域:在并行区域中,使用MPI_Barrier函数同步进程。

这样可以确保所有进程在执行并行区域之前达到相同的进度。

7. 结束MPI:在程序结束时,使用MPI_Finalize函数关闭MPI库。

以下是一个简单的C++ MPI编程示例:```cpp#include <iostream>#include <mpi.h>int main(int argc, char *argv[]) {// 初始化MPI库MPI_Init(&argc, &argv);// 获取进程数量和当前进程编号int size, rank;MPI_Comm_size(MPI_COMM_WORLD, &size);MPI_Comm_rank(MPI_COMM_WORLD, &rank);// 输出进程信息std::cout << "Hello, I am process " << rank << " of " << size << "." << std::endl;// 结束MPI库MPI_Finalize();return 0;}```这个示例程序将输出各个进程的编号和总进程数。

高性能计算中的MPI并行编程方法

高性能计算中的MPI并行编程方法随着科技的快速发展,计算机的性能和运算速度也越来越快。

然而,在面对海量数据和复杂运算时,单台计算机的性能已经无法满足需求。

因此,高性能计算(High Performance Computing, HPC)逐渐成为科学研究和工程领域中必不可少的一部分。

在HPC领域中,MPI并行编程是一种被广泛使用的技术,能够有效地提高计算机的并行性和计算速度。

MPI并行编程是什么?MPI(Message Passing Interface)是一种并行编程的通信库。

在MPI中,所有进程之间都是通过发送和接收消息来通信的。

MPI并行编程在计算机集群(Cluster)中应用广泛,因为计算机集群中的计算节点是分布在不同的物理服务器上,MPI并行编程可以将这些节点组合成一个逻辑上的整体,有效地提高了计算机的并行性。

MPI并行编程的优点MPI并行编程有如下优点:1.能够实现海量数据和复杂运算的高效处理,提高了计算速度。

2.可靠性高,因为MPI并行编程中所有进程之间都是通过发送和接收消息来通信的,不依赖于共享内存,可以有效避免内存泄漏等问题。

3.良好的可移植性,MPI API已经被很多计算机系统所支持,使得代码在不同的平台上也可以运行。

MPI并行编程的应用领域MPI并行编程被广泛应用于高性能计算领域,包括海洋模拟、气象预报、金融计算、生物医学等多个领域。

在气象预报中,MPI并行计算可以对气象数据进行分布式处理,快速生成气象预报模型,为人们提供准确的天气信息。

在金融领域,MPI并行编程可以进行股票行情分析、期货合约计算等任务,为投资者提供科学的决策支持。

在生物医学领域,MPI并行编程可以进行基因序列比对、药物分子模拟等任务,为科学家们提供准确的实验数据。

MPI并行编程的实现方法MPI通信和计算模型是一种消息传递模型,MPI中进程之间的通信主要与其它进程的交互有关。

在MPI并行编程中,进程的编写过程可以被分为以下几个步骤:1.初始化MPI环境在编写MPI程序时,必须首先调用MPI环境的初始化函数,建立进程之间的通讯。

并行计算中的MPI编程技巧及实践经验总结

并行计算中的MPI编程技巧及实践经验总结在并行计算中,MPI(Message Passing Interface)已成为一种广泛应用的并行编程模型。

MPI是一套并行通信协议和编程规范的集合,它可以在分布式内存系统中进行多个进程之间的通信和数据传输。

本文将总结一些MPI编程的技巧和实践经验,帮助开发人员更好地理解和应用MPI,以提高并行计算的效率和性能。

首先,了解MPI的基本概念和术语是理解和应用MPI编程的关键。

MPI中最重要的概念是通信域(communicator)。

通信域是一组进程的集合,这些进程可以相互通信。

在MPI中,有一个默认的通信域MPI_COMM_WORLD,它包含所有参与并行计算的进程。

另外,还有一些常用的通信域操作函数,例如MPI_Comm_size和MPI_Comm_rank函数,用于获取通信域中的进程数和当前进程的标识。

熟悉这些概念和函数,有助于编写可靠和高效的MPI程序。

其次,合理划分任务和数据,对于并行计算的效率至关重要。

在MPI中,一种常见的并行模式是将任务划分为多个子任务,并由不同进程来处理。

例如,可以将一个大规模的计算问题分解为多个小规模的子问题,由多个进程并行计算,最后将结果汇总。

另外,还可以将数据划分为多个块,分配给不同的进程进行处理。

合理的任务和数据划分可以最大程度地利用并行计算资源,提高计算效率和性能。

在MPI编程中,注意避免过多的通信操作,尽量减少进程间的通信次数和数据传输量。

频繁的通信操作会增加通信开销,降低程序的效率。

因此,可以通过合并通信操作,减少数据传输的次数。

例如,可以将多个小消息合并为一个大消息,进行一次批量传输,而不是每个小消息都单独进行传输。

此外,还可以使用非阻塞通信函数,例如MPI_Isend和MPI_Irecv函数,来实现异步通信,减少通信的等待时间。

另一个需要注意的是并行计算中的负载均衡。

负载均衡是指保证多个进程之间的工作量大致相等,避免某些进程一直处于空闲状态,导致计算效率低下。

MPI并行编程

chainrtm*aargincv(,[] ) { chainrtm*aargincv(,[] )

#include "mpi.h" #include <stdio.h> main( int argc,

char *argv[] ) {

MPI_Init( &argc, &argv ); printf( "Hello, world!\n" ); MPI_Finalize(); }

2021/7/1

#include "mpi.h" #inc#liundcelu<dsetd"miop.hi.>h"

• MPI 1.2 (1997) • …. • MPI 2.2 (2009-09)

2021/7/1

6

MPI是一个库,而不是一门语言

• 这个标准支持 C 语言和 FORTRAN 语言 • MPI库可以被FORTRAN77/C/Fortran90/C++调

用 • 它遵守所有对库函数/过程的调用规则,和

/*进程数,该变量为各处理器中的同名变量, 存储是分布的 */

/*我的进程ID,存储也是分布的

*/

MPI_Status status;

/*消息接收状态变量,存储也是分布的

*/

char message[100];

一般的函数/过程没有什么区别

高性能计算--MPI并行编程

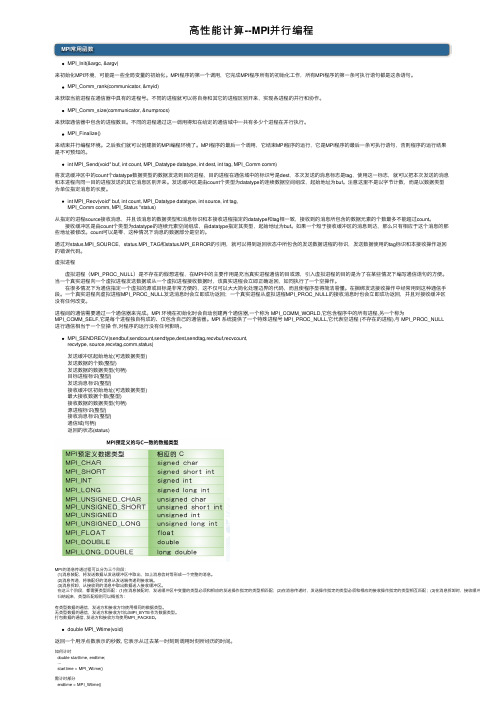

⾼性能计算--MPI并⾏编程MPI常⽤函数MPI_Init(&argc, &argv)来初始化MPI环境,可能是⼀些全局变量的初始化。

MPI程序的第⼀个调⽤,它完成MPI程序所有的初始化⼯作,所有MPI程序的第⼀条可执⾏语句都是这条语句。

MPI_Comm_rank(communicator, &myid)来获取当前进程在通信器中具有的进程号。

不同的进程就可以将⾃⾝和其它的进程区别开来,实现各进程的并⾏和协作。

MPI_Comm_size(communicator, &numprocs)来获取通信器中包含的进程数⽬。

不同的进程通过这⼀调⽤得知在给定的通信域中⼀共有多少个进程在并⾏执⾏。

MPI_Finalize()来结束并⾏编程环境。

之后我们就可以创建新的MPI编程环境了。

MPI程序的最后⼀个调⽤,它结束MPI程序的运⾏,它是MPI程序的最后⼀条可执⾏语句,否则程序的运⾏结果是不可预知的。

int MPI_Send(void* buf, int count, MPI_Datatype datatype, int dest, int tag, MPI_Comm comm)将发送缓冲区中的count个datatype数据类型的数据发送到⽬的进程,⽬的进程在通信域中的标识号是dest,本次发送的消息标志是tag,使⽤这⼀标志,就可以把本次发送的消息和本进程向同⼀⽬的进程发送的其它消息区别开来。

发送缓冲区是由count个类型为datatype的连续数据空间组成,起始地址为buf。

注意这⾥不是以字节计数,⽽是以数据类型为单位指定消息的长度。

int MPI_Recv(void* buf, int count, MPI_Datatype datatype, int source, int tag,MPI_Comm comm, MPI_Status *status)从指定的进程source接收消息,并且该消息的数据类型和消息标识和本接收进程指定的datatype和tag相⼀致,接收到的消息所包含的数据元素的个数最多不能超过count。

并行编程--MPI开发入门

系统环境配置Win2K Adv Svr + VC6MPI开发包下载网上搜索下载MPICH2地址/mpi/mpich2/MPI开发包安装下载完毕,开始安装MPICH2开发包,提示需要.NET 1.1 框架。

鉴于本人对 2003爱好,直接安装了整个开发环境,也可以只安装.NET框架。

可以到微软官方网站下载安装包(/netframework/downloads/framework1_1/)。

安装.NET框架后便可以安装MPICH2开发包。

安装后可以看到MPICH2目录层次:环境配置“我的电脑”path中设置MPICH2的bin目录(%MPICH2%\bin)以便运行mpiexec程序。

我的具体设置如下:VC6开发环境中包含MPICH2开发包的include目录和lib目录。

具体步骤:打开VC6,选择”Tools->Options”,在弹出的“Options”对话框中选择Directories选项卡,分别设置如下图:(设置Include目录%MPICH2%/include)(设置Lib目录%MPICH2%/LIB)MPICH2环境配置。

运行%MPICH2%/LIB下wmpiregister,在注册界面输入本机器用户名和密码以便mpiexec运行程序。

开发第一个程序“Hello World”经过上面的步骤,MPICH2开发环境已经建立好,下面便可以步入MPICH2的大殿了。

开始最简单也是最经典程序“Hello World”,在过程中倒是遇到不少麻烦。

打开VC6,建立一个控制台应用程序,如下图:依照课本,包含头文件且把代码敲入main函数中。

#include "mpi.h"#include <cstdio>int main(int argc, char* argv[]){MPI_Init(&argc, &argv);printf("Hello World!\n");MPI_Finalize();return 0;}编译程序,发现出现很多编译错误,一时间不知道怎么办好。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

// call MPI_Finalize(rc)

运行的结果

MPI初始化

call MPI_Init(ierr) Integer ierr

MPI结束

call MPI_Finalize(ierr) Integer ierr

当前进程标识

call MPI_Comm_rank(MPI_COMM_WORLD,myid,ierr) In MPI_COMM_WORLD 为进程所在的通信域 Out Integer myid,ierr

非阻塞消息接收

MPI_IRecv(buf,count,datatype,source,tag,comm,request,ierr) In buf,count,datatype,source,tag,comm Out request,ierr

非阻塞通信的完成

MPI_Wait(request,status) In request Out status

混合模式

主进程分发完任务后,参与计算 如计算1+..+100,主进程可以自己计算1..33,分 发任务34..66和67..100到两个从进程。可以提 高效率

一个简单的MPI程序

include 'mpif.h‘ integer myid,numprocs,ierr,rc call MPI_Init(ierr) call MPI_Comm_rank(MPI_COMM_WORLD,myid,ierr) call MPI_Comm_size(MPI_COMM_WORLD,numprocs,ierr) //添加需要并行的程序 Write(*,*) "Hello World! process is :",myid

组通信

一对一

MPI_Send MPI_Recv MPI_ISend MPI_IRecv

一对多 广播 MPI_Bcast

多对一

收集 MPI_Gather

多对多

编写安全的通信 If (rank.eq.0) then Call MPI_Recv(recvbuf,count,real,1,tag,comm,status,ierr) Call MPI_Rend(sendbuf,count,real,1,tag,comm,ierr) Else if (rank.eq.1) Call MPI_Recv(recvbuf,count,real,0,tag,comm,status,ierr) Call MPI_Rend(sendbuf,count,real,0,tag,comm,ierr) Endif

MPI并行进程的实现

MPI并行程序设计平台由标准消息传递函数及相关辅助函数 构成,多个进程通过调用这些函数(类似调用子程序),进 行通信;

一个程序同时启动多份,形成多个独立的进程, 在不同的处理机上运行,拥有独立的内存空间, 进程间通信通过调用MPI函数来实现;每个进程 开始执行时,将获得一个唯一的序号(rank)。 例如启动P个进程,序号依次为0,1,…,P-1;

6.780 6.840 6.960

取时间平均值,则并行时间:1.437s 串行时间:6.860s 加速比为:6.860/1.437=4.77 效率为:4.77/4=1.19

加速比一般不会超过处理器个数,efund的并行加速比 大于处理器个数,不知什么原因

主程序的并行思路 可扩展的 先粗颗粒度,再细颗粒度

efund并行的结果分析

开始

读入参数 计算并生成fcfcpc.datset

matrix

计算并生成eplasm.dat

grid 结束

计算并生成econto.dat

采用对等模式进行MPI程序设计 计算 结束

开始

程序的运行时间 由耗时最长的进 程决定

在linux集群上用4个节点运行所需要的时间

谢

谢!

…

CPU

(b) DSM, 逻辑上单一地址空间

P/C

P/C

…

P/C

定制/标准网络

(c) Cluster, 物理/逻辑上多地址空间

什么是并行计算

进程 1

进程 2

传统的串行计算,分为“指令” 和“数据”两个部分,并在程序 执行时“独立地申请和占有”内 存空间,且所有计算均局限于 该内存空间。

进程 1

进程 2

MPI已经成为一种标准,应用越来越广泛。而最流行的MPI工具集 当属mpich,是目前高效率的超大规模并行计算(1000个处理器) 最可信赖的平台。 目标: 是提供一个实际可用的、可移植的、高效的和灵活的消息传递 接口标准. MPI以语言独立的形式来定义这个接口库, 并提供了与C、 Fortran和Java语言的绑定. 这个定义不包含任何专用于某个特别的 制造商、操作系统或硬件的特性. 由于这个原因, MPI在并行计算界 被广泛地接受.

发送信息

接收信息

并行计算将进程相对独立的 分配于不同的节点上,由 各自独立的操作系统调度, 享有独立的CPU和内存资源 (内存可以共享);进程间 相互信息交换通过消息传递;

MPI模型 MPI(Message Passing Interface)

在当前所有的消息传递软件中, 最重要最流行的是MPI, 它能运行 在所有的并行平台上, 包括SMP和PVP. 二者已经在Windows NT 和 Windows 9X这样的非Unix平台上实现. 程序设计语言支持C, Fortran和Java.在国产的三大并行机系列神威、银河和曙光上都实 现了对MPI和支持.

计算 fcfcpc.dat rfcoil.dat eplasm.dat econto.dat 运行时间 0.230 1.240 运行时间 0.210 1.190 1.380 0.390 运行时间 0.230 1.240 1.520 0.350 时间单位:秒

线程 0 1 2 3

1.410

0.370

串行程序的时间

MPI并行编程简介

主/从式

主进程将任务分发到从进程分别计算,再收集 计算结果,比如计算1+…+100,可以分成两部 份。进从程计算1+..+50和51+..+100,主进程收 集结果再相加

对等式

每个进程相对独立计算各自的任务 比如要计算1+…+100和1*…*100,可以由两个 进程独立计算

进程0 进程1

从进程1接收消息A

从进程0接收消息B

向进程1发送消息B

向进程1发送消息A

产生死锁的通信调用

1

例子

1 dx arctan( x) |1 arctan( 1) arctan( 0) arctan( 1) / 4 0 0 1 x 2

令:

f ( x)

4 (1 x 2 )

则有:

1

0

f ( x)dx

4

f ( x)

4 (1 x 2 )

0

N

1

2 i 1 1 1 N i 0.5 f( ) f ( ) 2 N N N i 1 N i 1

Myid:本身进程号 Numprocs:总的进程数 For(I=myid+1;I<=n;I+=numprocs) /*每一个进程计算一部份矩形的面积,若进程总数为4, 将0-1区间为100个矩形 0进程:1,5,9,13,…,97 1进程:2,6,10,14,…,98 2进程:3,7,11,15,…,99 3进程:4,8,12,16,…,100 */ 然后0进程汇总数据

消息接收 MPI_Recv(buf,count,datatype,source,tag,comm,status) In count,datatype,source,tag,comm Out buf,status(返回状态)

MPI类型匹配:数据类型要一致

数据接收缓冲区

数据发送缓冲区

通信域包含的进程数

Call MPI_Comm_size(MPI_COMM_WORLD,numprocs,ierr) In MPI_COMM_WORLD Out Integer numprocs,ierr

通信域

一个通信域是一个进程组加上一个现场,进程组是所 有参加通信的进程的集合,如果一共有N个进程参加 通信,则进程编号从0到N-1;现场提供一个相对独 立的通信区域 6 1 3 7 0 5 9 1011 4 2 8

引用接收数据

非阻塞消息发送与接收

非阻塞消息发送

MPI_ISend(buf,count,datatype,dest,tag,comm,request,ierr) In buf,count,datatype,dest,tag,comm Out request,ierr Request(返回的非阻塞通信对象)

MPI并行编程

报告人:李俊照

内容

1、MPI并行编程简介

2、efund并行的结果分析

3、主程序的并行思路

几种我们常见的并行计算机

CPU CPU

…

CPU

LM

虚拟分布共享存储(DSM) LM LM

总线或交叉开关 定制网络 SM

CPU (a) SMP, 物理上单一地址空间

LM LM LM

CPU

0

1

0 3 4 5 1 3 4 5 2

2

MPI消息

MPI消息包括信封和数据两部份 信封:<源/目,标识,通信域> 数据:<起始地址,数据个数,数据类型> MPI_Send(buf,count,datatype,dest,tag,comm)