计算机视觉特征检测和匹配

计算机视觉的基本流程

计算机视觉的基本流程

计算机视觉是一种模拟人类视觉的技术,它通过算法和数学模型来使计算机识别和理解图像或视频中的对象和场景。

计算机视觉的基本流程包括以下步骤:

1. 图像采集:计算机视觉的第一步是获取图像或视频。

这可能涉及到使用摄像机、扫描仪或其他设备来捕捉图像或视频。

2. 图像处理:图像或视频采集后,需要进行预处理。

这可能包括降噪、增强图像对比度等操作,以便更好地提取有用信息。

3. 特征提取:接下来,需要从图像或视频中提取关键特征。

这可能包括物体的形状、大小、颜色、纹理等信息。

4. 特征匹配:在识别物体时,需要将提取的特征与已知物体的特征进行匹配。

这可能涉及到使用匹配算法,如SIFT、SURF等。

5. 目标检测:一旦特征匹配成功,就可以进行目标检测。

这可能涉及到使用机器学习算法,如支持向量机(SVM)等。

6. 目标跟踪:如果目标在图像或视频中移动,需要进行目标跟踪。

这可能涉及到使用滤波器、卡尔曼滤波器等算法。

7. 目标识别:最后一步是识别目标。

这可能涉及到使用神经网络、深度学习等算法。

总之,计算机视觉的基本流程包括图像采集、图像处理、特征提取、特征匹配、目标检测、目标跟踪和目标识别。

这些步骤通常需要进行多次迭代,以不断提高计算机视觉的准确性和效率。

- 1 -。

了解计算机视觉技术中的特征匹配算法

了解计算机视觉技术中的特征匹配算法计算机视觉技术是一门研究如何使计算机能够通过摄像头等设备获取、分析和理解图像信息的学科,而特征匹配算法是计算机视觉技术中的一项重要技术之一。

本文将详细介绍特征匹配算法的原理、应用和发展趋势。

特征匹配算法是指通过提取图像中的特征点,并将这些特征点与数据库中的特征点进行匹配,从而实现图像识别、目标跟踪、三维重建等任务的一种算法。

它的核心思想是通过计算特征点之间的相似性度量值,找到最佳匹配,从而确定图像之间的对应关系。

特征匹配算法主要采用以下步骤:特征提取、特征描述和特征匹配。

首先,特征提取阶段利用一些局部图像特性的检测器(如尺度不变特征变换(SIFT)、加速稳健特征(ASIFT)等)从图像中提取关键点。

然后,在特征描述阶段,算法会为每个关键点生成一个向量,该向量包含关键点附近的图像内容信息。

最后,在特征匹配阶段,算法会将图像中的特征点与数据库中的特征点进行匹配,并计算相似性度量值,以确定最佳匹配。

特征匹配算法在计算机视觉领域中有广泛的应用。

其中,图像检索是最常见的应用之一。

通过利用特征匹配算法,用户可以通过输入一张查询图像,从庞大的图像数据库中快速找到与之相似的图像。

此外,特征匹配算法还可以用于目标跟踪、三维重建、运动估计等领域。

然而,特征匹配算法也面临一些挑战和问题。

首先,图像中的噪声、光照变化和视角变化等因素会干扰特征提取和匹配过程,降低算法的准确性。

其次,当图像中存在大量特征点或者特征点之间存在相似性很高的情况时,算法的匹配效果也会受到影响。

最后,特征匹配算法在大规模图像数据库中的应用仍然面临计算效率的挑战。

针对这些问题,研究者们提出了许多改进的特征匹配算法。

例如,对于光照和视角变化问题,可以使用尺度不变特征变换(SIFT)算法,该算法对图像缩放和旋转具有较好的不变性。

对于大规模图像数据库的匹配问题,可以采用基于局部二进制模式(LBP)的加速稳健特征(ASIFT)算法,该算法可以提高匹配的效率。

BRISK特征点检测匹配算法的探究

BRISK特征点检测匹配算法的探究BRISK(Binary Robust Invariant Scalable Keypoints)特征点检测算法是一种用于计算机视觉领域的关键点检测和匹配的算法。

它在快速特征点检测和匹配方面表现出色,同时保持了很强的稳健性。

本文将探讨BRISK算法的原理、流程以及应用,并讨论其在图像处理领域的重要性。

BRISK算法的原理是基于二进制描述符的尺度不变性的。

它使用了一种基于样本比较和像素对比的方法来检测图像中的关键点。

该算法首先在图像中提取角点,然后对这些角点进行描述符计算,最后通过描述符的匹配来实现特征点的匹配。

BRISK算法的优点在于其对旋转、尺度和亮度变化有很好的鲁棒性,可以在图像中检测到各种实际场景下的关键点。

1.对图像进行预处理:将RGB图像转换为灰度图像,并进行高斯平滑处理。

2. 提取角点:使用FAST算法或Harris角点检测器提取图像中的角点。

3.计算描述符:在每个角点周围采样一些采样点,计算这些采样点的灰度值和周围像素的对比情况。

4.特征匹配:对每个检测到的关键点,通过描述符的比较来进行特征点匹配。

在BRISK算法中,描述符的计算是其核心部分。

描述符通常是一个二进制字符串,用于表示特征点周围的像素对比情况。

在BRISK中,描述符的计算通过对周围像素的样本点进行对比来实现。

这种方法具有很好的尺度不变性和鲁棒性,能够在各种环境下准确地匹配特征点。

BRISK算法在图像处理领域有着广泛的应用。

它可以用于目标跟踪、图像拼接、三维重建等不同领域。

在目标跟踪中,BRISK算法可以用于检测目标物体在不同帧之间的位置变化,实现目标的跟踪和定位。

在图像拼接中,BRISK算法可以用于寻找不同图像中相似的特征点,从而实现图像的拼接。

在三维重建中,BRISK算法可以用于检测图像中的特征点,从而实现对物体的三维重建。

总的来说,BRISK算法是一种性能优越的特征点检测和匹配算法,具有很好的尺度不变性和稳健性。

特征匹配的三个步骤

特征匹配的三个步骤特征匹配是一种常用的图像处理和计算机视觉领域的技术,它可以通过比较图像中的特征点来找出两幅图像之间的相似性。

特征匹配的三个步骤包括特征提取、特征描述和特征匹配。

一、特征提取特征提取是特征匹配的第一步,它的目标是从图像中提取出最具代表性的特征点。

常用的特征点包括角点、边缘点和斑点等。

在进行特征提取时,需要考虑到图像中的噪声和变形等因素,选择合适的特征提取算法。

在特征提取的过程中,一种常用的方法是使用Harris角点检测算法。

该算法通过计算图像中每个像素点的角点响应函数来识别角点。

角点是图像中灰度变化最大的点,具有较高的信息量和稳定性。

二、特征描述特征描述是特征匹配的第二步,它的目标是对提取出的特征点进行描述,将其转换为具有可比性的特征向量。

常用的特征描述算法包括SIFT(尺度不变特征变换)、SURF(加速稳健特征)和ORB (Oriented FAST and Rotated BRIEF)等。

在特征描述的过程中,SIFT算法是一种经典的方法。

它通过对特征点周围的局部区域进行尺度空间的变换和高斯模糊处理,得到特征点的尺度不变描述子。

这种描述子具有旋转不变性和尺度不变性,能够更好地描述特征点的特征。

三、特征匹配特征匹配是特征匹配的最后一步,它的目标是找出两幅图像中具有相似特征的特征点对。

特征匹配可以通过计算特征向量之间的相似度来实现,常用的相似度度量方法包括欧氏距离、汉明距离和余弦相似度等。

在特征匹配的过程中,一种常用的方法是使用最近邻法。

该方法将待匹配图像中的每个特征点与参考图像中的特征点进行比较,选择距离最近的特征点作为匹配点。

通过设定一个阈值来判断匹配点的可靠性,可以过滤掉不可靠的匹配点。

特征匹配是一种通过比较图像中的特征点来找出两幅图像之间的相似性的技术。

它包括特征提取、特征描述和特征匹配三个步骤。

特征匹配在图像处理和计算机视觉领域有着广泛的应用,如图像拼接、目标跟踪和图像检索等。

特征匹配算法

特征匹配算法

1 特征匹配算法

特征匹配算法是计算机视觉技术的一种将特征描述子在两个图像中做排序,并返回匹配点的数学工具。

它是一种可以用来解决图像的广泛的和可靠的运动跟踪,定位和图像检索等问题的技术。

特征匹配算法在当今广泛应用,尤其在运动估计,对象跟踪,图像建模,图像内容提取等方面有着重要的研究价值。

它可以用来快速和有效地检测特征点,有助于在图像上定位特征,并通过计算机视觉算法来验证匹配点是否有效。

2 特征匹配算法的工作流程

特征匹配算法的工作流程包括特征检测,特征描述子的提取,特征的比对,匹配点的筛选和最终的匹配结果的验证等几个步骤。

1.特征检测:根据输入图片中特征点的空间分布,基本特征量,形状,结构等特点,使用特征检测算法检测出图片中的特征。

2.特征描述子的提取:在从图片中检测出的特征的基础上,使用特征描述子的提取算法提取每个特征的特征描述子。

3.特征的比对:将不同图片中提取出的特征描述子进行比较,以定位出特征之间的短暂的有效的匹配点。

4.匹配点的筛选:框定出有效的匹配点,去除不准确的匹配点,最终得到实用的匹配结果。

5.匹配结果验证:使用人工或计算机视觉算法计算得到的有效的匹配结果,并进行验证,来作最终的确认。

3 结论

特征匹配算法是一种用于计算机视觉技术的数学工具,其工作流程分为特征检测,特征描述子的提取,特征的比对,匹配点的筛选,最终的匹配结果的验证等几步。

它在当今有着重要的应用价值,可以被用于运动估计,对象跟踪,图像建模,图像内容提取等方面,以及图像的快速定位,建立高质量的匹配结果等方面,能够节省大量的时间和经验。

pythonopencv3基于ORB的特征检测和BF暴力匹配knn匹配flann匹配

pythonopencv3基于ORB的特征检测和BF暴力匹配knn匹配flann匹配Python OpenCV3中的ORB特征检测和BF暴力匹配以及FLANN匹配是计算机视觉中常用的技术,用于在图像中寻找相似的特征点并进行匹配。

下面将详细介绍这些技术以及如何使用它们。

一、ORB特征检测ORB(Oriented FAST and Rotated BRIEF)是一种用于检测图像特征的算法。

它结合了FAST特征检测和BRIEF特征描述子,并对其进行了改进,以便在实时性和准确性之间取得较好的平衡。

使用OpenCV中的ORB特征检测算法需要使用以下步骤:1. 创建ORB对象:使用cv2.ORB_create(方法创建ORB对象。

3. 绘制特征点:使用cv2.drawKeypoints(方法绘制特征点,传入原始图像、特征点和输出图像。

二、BF暴力匹配BF(Brute-Force)暴力匹配是一种简单但较慢的特征点匹配算法。

它通过计算两组特征点之间的欧氏距离,找到距离最近的特征点对。

使用BF暴力匹配算法需要使用以下步骤:1. 创建BFMatcher对象:使用cv2.BFMatcher_create(方法创建BFMatcher对象。

2. 匹配特征点:调用BFMatcher对象的match(方法,传入两组特征描述子,方法将返回最佳匹配的特征点对。

3. 绘制匹配结果:使用cv2.drawMatches(方法绘制匹配结果,传入原始图像和两组特征点。

三、FLANN匹配FLANN(Fast Approximate Nearest Neighbors)是一种快速近似最近邻算法,它可以在大型数据集上进行高效的最近邻。

在图像匹配中,它可以加速特征点匹配的过程。

使用FLANN匹配算法需要使用以下步骤:1. 创建FLANN匹配器:使用cv2.FlannBasedMatcher(方法创建FLANN匹配器对象。

2. 创建索引:调用BFMatcher对象的knnMatch(方法,传入两组特征描述子和最近邻数k,方法将返回最佳匹配的特征点对。

图像特征检测与匹配方法研究综述

图像特征检测与匹配方法研究综述图像特征检测与匹配是计算机视觉领域的重要研究方向,它在许多实际应用中发挥着关键作用,如图像检索、目标识别和三维重建等。

本文对图像特征检测与匹配方法进行综述,主要包括特征检测算法、特征描述算法和特征匹配算法三个方面。

一、特征检测算法特征检测算法旨在寻找图像中的稳定不变性特征点,以便用于后续的特征描述和匹配。

常用的特征检测算法包括Harris角点检测算法、SIFT 算法和SURF算法等。

1. Harris角点检测算法:该算法通过计算图像的局部灰度变化,寻找具有最大角度变化的像素。

它能够有效检测出图像中的角点,但对于尺度变化和旋转不变性较差。

2.SIFT算法:SIFT算法通过构建高斯金字塔和尺度空间极值检测,寻找出图像中的尺度不变的关键点。

同时,通过计算局部图像的梯度方向直方图,生成特征向量描述子,实现图像的匹配。

3. SURF算法:SURF算法是SIFT算法的改进版本,采用了一种快速的积分图像技术,大大提高了计算效率。

SURF算法在计算图像的尺度空间极值点时,使用了一种基于Hessian矩阵的指标,检测出更加稳定的特征点。

二、特征描述算法特征描述算法利用特征点周围的图像信息,生成唯一且具有区分度的特征向量。

常用的特征描述算法有SIFT描述子、SURF描述子和ORB描述子等。

1.SIFT描述子:SIFT描述子通过计算特征点周围的梯度信息,生成128维的特征向量。

它具有较强的区分度和旋转不变性,在图像匹配任务中表现较好。

2. SURF描述子:SURF描述子是一种基于Haar小波特征的描述子,使用了一种积分图像计算方法,降低了计算复杂度。

SURF描述子的维度为64维,具有良好的尺度不变性和旋转不变性。

3.ORB描述子:ORB描述子是一种快速的二值描述子,基于FAST角点检测算法和BRIEF描述子。

它既具有较快的计算速度,又能够保持较好的特征区分度,适用于实时图像处理任务。

三、特征匹配算法特征匹配算法的目标是在不同图像中找到相互匹配的特征点对。

sfit特征提取和匹配的具体步骤

sfit特征提取和匹配的具体步骤

SIFT(尺度不变特征变换)是一种用于图像处理和计算机视觉的特征提取和匹配算法。

它能够在不同尺度和旋转下提取出稳定的特征点,并且对光照变化和噪声有一定的鲁棒性。

SIFT特征提取的具体步骤包括:

1. 尺度空间极值检测,在不同尺度下使用高斯差分函数来检测图像中的极值点,用来确定关键点的位置和尺度。

2. 关键点定位,通过对尺度空间的极值点进行精确定位,使用Hessian矩阵来确定关键点的位置和尺度。

3. 方向分配,对关键点周围的梯度方向进行统计,确定关键点的主方向,使得特征具有旋转不变性。

4. 关键点描述,以关键点为中心,划分周围的区域为小区块,计算每个区块内的梯度方向直方图,构建特征向量。

SIFT特征匹配的具体步骤包括:

1. 特征点匹配,使用特征向量的距离来进行特征点的匹配,通常使用欧氏距离或者近邻算法进行匹配。

2. 鲁棒性检验,对匹配点进行鲁棒性检验,例如RANSAC算法可以剔除错误匹配点,提高匹配的准确性。

3. 匹配结果筛选,根据匹配点的特征向量距离或一致性进行筛选,得到最终的匹配结果。

总的来说,SIFT特征提取和匹配的具体步骤包括特征点检测、定位、描述以及匹配过程。

这些步骤能够帮助我们在图像处理和计算机视觉中提取出稳定的特征并进行准确的匹配,从而实现目标识别、图像配准等应用。

机器视觉处理算法中特征点匹配常用方法

一、介绍在机器视觉处理算法中,特征点匹配是一个重要的环节,它是指在两幅图像中找到相对应的特征点的过程。

特征点匹配的准确度会直接影响到后续的物体识别、目标跟踪、三维重建等任务的效果。

特征点匹配的算法选择和设计是至关重要的。

本文将针对机器视觉处理算法中特征点匹配常用方法进行全面评估,并提供个人观点和理解。

二、常用的特征点匹配方法1. Harris角点检测Harris角点检测是一种常用的特征点提取方法,通过计算图像的灰度变化来检测角点。

通过非极大值抑制和角点响应函数来筛选出最具代表性的角点。

2. SIFT特征匹配SIFT是一种基于局部特征的描述符,它通过在不同尺度空间和不同方向上寻找局部极值来检测图像的关键点,然后使用特征描述符进行匹配。

3. SURF特征匹配SURF是对SIFT算法的改进,它使用了快速Hessian矩阵检测关键点,并使用加速的Haar小波特征描述符进行匹配。

4. ORB特征匹配ORB是一种同时具备SIFT和SURF的优点的算法,它结合了FAST角点检测和BRIEF描述符,具有更快的速度和更好的性能。

5. 其他方法除了上述常用的特征点匹配方法,还有基于深度学习的方法、基于颜色直方图的方法、基于形状上下文的方法等,这些方法根据具体任务和应用场景选择的灵活性更强。

三、个人观点和理解在特征点匹配的方法中,不同的算法适用于不同的场景和要求。

对于实时性要求较高的场景,可以选择ORB特征匹配算法;对于精度要求较高的场景,可以选择SIFT或SURF特征匹配算法。

结合深度学习的方法可以在特定数据集上取得更好的效果。

在实际应用中,需要根据具体情况进行选择和组合使用。

四、总结回顾特征点匹配在机器视觉处理算法中起着至关重要的作用,不同的方法都有各自的优势和局限性。

通过本文的介绍,可以看出特征点匹配算法的发展已经非常成熟,并且在不断地向着更加快速、精确以及适用于更多场景的方向发展。

对于我个人而言,特征点匹配算法的研究不仅是对图像处理技术的挑战,更是对计算机视觉领域的探索。

又快又准的特征匹配方法

又快又准的特征匹配方法又快又准的特征匹配方法是计算机视觉领域中非常重要的一个问题。

特征匹配是指在两个或多个图像中找到具有相似性的特征点,并建立它们之间的对应关系。

特征匹配在很多应用中都有广泛的应用,如图像配准、目标检测和跟踪等。

在过去的几十年中,研究人员提出了许多特征匹配方法,其中一些方法即使在处理大规模数据集时也能提供很高的匹配准确性和效率。

下面将介绍几种又快又准的特征匹配方法。

1.SIFT(尺度不变特征变换)SIFT是一种非常经典的特征匹配算法,在很多应用中都被广泛使用。

它通过将图像中的特征点转换成尺度、旋转和亮度不变的向量,然后使用特征向量之间的欧氏距离来进行匹配。

SIFT算法具有很高的匹配准确性和鲁棒性,但在处理大规模数据集时会存在时间和空间复杂度较高的问题。

2.SURF(加速稳健特征)SURF是一种基于SIFT的改进算法,能够在保持较高匹配准确性的同时提高匹配的速度。

SURF算法用Hessian矩阵来检测特征点,并通过使用积分图像来加速特征描述子的计算。

这种基于加速稳健特征的特征匹配方法比SIFT更快、更鲁棒,适用于处理大规模数据集。

3.ORB(方向倒角二值描述子)ORB是一种在效率和准确性之间取得平衡的特征匹配算法。

它结合了FAST关键点检测器和BRIEF特征描述子,使用方向倒角二进制描述子来表示特征点,从而使得匹配速度更快。

ORB算法在实践中表现良好,尤其适用于移动设备上的实时应用。

4.BRISK(加速鲁棒特征)BRISK是一种能够提供快速、鲁棒特征匹配的算法。

它通过快速角点检测器来检测特征点,并使用二进制描述子来进行特征匹配。

BRISK算法具有较低的计算复杂度和内存消耗,并且能够在保持较高的匹配准确性的同时提供很高的速度。

TCH(局部联合二进制特征)LATCH是一种基于二进制特征匹配的算法,具有很高的匹配速度和鲁棒性。

LATCH算法通过使用快速特征检测器和局部联合二进制描述子来检测和匹配图像中的特征点。

掌握图像处理中的特征提取与匹配方法

掌握图像处理中的特征提取与匹配方法引言图像处理是计算机视觉中的重要领域之一,它涵盖了从采集到处理再到分析整个图像处理流程。

特征提取和匹配是图像处理中的重要环节,它们有助于图像分类、图像识别、目标跟踪等应用场景中的实现。

本文将介绍图像处理中的特征提取与匹配方法。

一、特征提取特征提取是指从图像中提取一些基本特征的过程,这些特征能够描述或表示图像中的某些重要属性。

一般来说,特征提取要求提取出的特征应具有以下特点:可重复性、可靠性、特异性、鲁棒性、计算效率等。

在实际应用中,常用的特征提取方法包括SIFT、SURF、HOG、LBP等。

1. SIFT尺度不变特征转换(Scale-invariant feature transform,SIFT)是一种常用的特征提取算法。

它通过在各个尺度上检测图像的关键点,然后对每个关键点周围的像素进行梯度计算,再把梯度信息转换为特征向量,最终得到具有尺度不变性的特征描述子,用于匹配和分类。

SIFT算法具有较好的鲁棒性和旋转不变性,在目标跟踪、图像检索等领域具有广泛的应用。

2. SURF加速稳健特征(Speeded Up Robust Features,SURF)是一种基于尺度空间的特征提取算法。

它采用了快速哈尔小波变换来加速特征计算,并引入了Hessian矩阵来描述图像的局部特征,加强了图像的鲁棒性和抗干扰性。

SURF算法与SIFT算法相比,具有更快的计算速度和更好的抗噪性,适合于大规模图像数据的特征提取。

3. HOG方向梯度直方图(Histogram of Oriented Gradients, HOG)是一种基于图像梯度方向和强度的特征描述方法。

HOG算法通过计算图像中每个像素点的梯度幅值和梯度方向,并将其汇总为几个方向的直方图,最终得到具有方向和梯度信息的特征向量。

HOG算法具有较好的抗变形和旋转不变性,适合于人体检测、模式识别等领域。

4. LBP局部二值模式(Local Binary Pattern, LBP)是一种基于纹理分析的特征提取算法。

如何使用计算机视觉技术进行图像匹配和识别

如何使用计算机视觉技术进行图像匹配和识别近年来,计算机视觉技术的发展取得了巨大的进展,为我们的生活带来了诸多便利。

其中,图像匹配和识别技术成为了计算机视觉领域中极为重要的研究方向。

本文将介绍如何使用计算机视觉技术进行图像匹配和识别,以帮助读者更好地理解和应用这一领域。

首先,我们需要明确图像匹配和识别的概念。

图像匹配是指在给定一组输入图像中,找到与目标图像最相似的图像。

而图像识别则是在已知一组目标图像的情况下,识别输入图像中是否存在这些目标图像。

这两个任务在很多实际应用场景中具有重要的意义,例如人脸识别、物体检测等。

在计算机视觉中,图像的特征描述是图像匹配和识别的基础。

常见的特征描述算法包括颜色直方图、局部二值模式(LBP)、尺度不变特征变换(SIFT)等。

这些算法可以从图像中提取出能够表征图像内容的特征向量,进而用于图像匹配和识别任务。

例如,对于人脸识别这一任务,我们可以用SIFT算法提取出人脸图像的特征向量,然后通过比较不同图像的特征向量相似度来判断是否为同一个人脸。

图像匹配和识别任务的关键在于建立合适的模型。

传统的方法中,常用的模型包括支持向量机(SVM)、最近邻(KNN)、决策树等。

这些模型可以通过特征向量之间的比较和分类来实现图像匹配和识别。

然而,随着深度学习的兴起,卷积神经网络(CNN)成为了图像匹配和识别任务中最为热门的模型。

CNN通过多层卷积和池化操作,能够学习到图像中的高级特征,并通过全连接层进行分类和匹配。

在训练阶段,我们可以使用大量的标注数据来训练CNN模型,以便使其能够更好地适应于我们的任务。

除了模型选择和特征描述,图像匹配和识别任务中还需要考虑到图像的预处理和后处理。

预处理主要是对原始图像进行裁剪、缩放或去噪等操作,以便使图像更适合于模型的输入。

后处理则是对模型的输出进行处理,例如通过设置阈值来判断输入图像中的目标是否存在,或者通过图像的连通区域来合并或分割不同的目标。

在实际应用中,图像匹配和识别技术已被广泛应用于各个领域。

图像处理中的特征提取和匹配算法

图像处理中的特征提取和匹配算法图像处理在日益热门的人工智能技术中扮演着一种重要的角色。

在图像处理中,特征提取和匹配算法是两个至关重要的步骤。

特征提取是通过分析图像的局部特点来创建描述图像内容的向量,而匹配是将不同图像的特征或特征向量进行比较,以确定它们是否相似。

本文将介绍几种常用的特征提取和匹配算法。

一、特征提取算法1.尺度不变特征变换(SIFT)SIFT是一种特征提取算法,它能够从不同的尺度和方向上提取图像的局部特征。

这种算法在检索和匹配图像中特别有用。

SIFT算法的基本思想是通过高斯差分算子得到一组尺度空间图像,通过高斯图像之间的差异来确定关键点,然后计算每个关键点的局部梯度的幅值和方向,最后形成一个基于梯度方向的特征描述符。

2.速度增强型稀疏编码(SLEEC)SLEEC是一种新型的高效特征提取算法。

与其他算法不同的是,SLEEC只需扫描一次训练数据即可获得最具代表性的特征。

该算法通过运用具有多个分辨率的降采样、随机稀疏和加速度分析三种技术提取特征,从而实现了比其他算法更高的准确性和速度。

二、特征匹配算法1.暴力匹配算法暴力匹配算法是一种基本的匹配算法,它实现了图像特征之间的精确匹配。

该算法通过比较两个图像之间的每个可能的匹配,来确定匹配的好坏。

虽然该算法的准确性很高,但是它非常耗时,因此只适用于小图像匹配。

2.基于Flann树的匹配算法基于Flann树的匹配算法通过对特征向量进行一系列分割和聚类,以快速找到大量数据中的相似匹配。

该算法不仅适用于大规模数据集,而且具有高效和稳定性。

3.随机抽样一致性算法(RANSAC)随机抽样一致性算法是一种常见的特征匹配算法。

该算法通过随机采样一对点来确定匹配,在这个过程中,通过迭代重复采样和检测结果,不断提高匹配模型的准确度。

结论:在图像处理和计算机视觉中,特征提取和匹配是核心算法。

不同的特征提取和匹配算法适用于不同的应用场合。

在实际应用中,为了达到对图像的快速识别和匹配,我们需要根据具体的需求,选择合适的特征提取和匹配算法。

ORB特征点检测匹配算法

ORB特征点检测匹配算法ORB (Oriented FAST and Rotated BRIEF) 特征点检测匹配算法是一种用于计算机视觉中特征点提取和描述的算法。

它结合了FAST角点检测器和BRIEF描述符,具有旋转不变性和快速计算速度,被广泛应用于目标识别、图像拼接、三维重建等领域。

ORB算法的主要步骤包括特征点检测、特征描述和特征匹配。

1.特征点检测:ORB算法采用FAST角点检测器进行特征点检测,FAST角点检测器是一种高速的角点检测算法,通过比较中心点像素值和其周围相邻像素值的差异来判断是否为角点。

FAST角点检测器在角度变化和尺度变化下具有一定的鲁棒性。

ORB算法在FAST角点检测的基础上进行改进,引入了旋转不变性,通过计算像素的灰度质心,来判断角点的旋转方向,并计算角点的方向和尺度。

2.特征描述:ORB算法使用BRIEF描述符对特征点进行描述,BRIEF是一种二进制描述符,它通过随机选择一组像素对,并比较它们的亮度值来生成一个二进制串。

BRIEF描述符具有较低的计算复杂度和存储空间需求,适合于在实时性要求较高的场景中使用。

为了提高旋转不变性,ORB算法在BRIEF描述符的基础上引入了方向校正,将旋转不变特征描述符 (Rotated BRIEF) 与尺度不变特征描述符(Scale Invariant Feature Transform, SIFT) 结合起来。

在计算BRIEF描述符之前,ORB算法将图像进行多个尺度的高斯模糊操作,计算每个尺度下的图像金字塔,并在每个金字塔层级上计算BRIEF描述符。

3.特征匹配:特征点匹配是ORB算法的最后一步,通过计算特征点之间的距离来确定匹配关系。

ORB算法使用汉明距离 (Hamming Distance) 来衡量两个二进制描述符的相似性,汉明距离越小表示两个特征点越相似。

为了提高匹配的鲁棒性,ORB算法采用了基于最近邻和次近邻距离比的匹配策略,只有当最近邻距离比次近邻距离的阈值小于一个阈值时,才认为匹配成功。

SIFT特征点提取与匹配

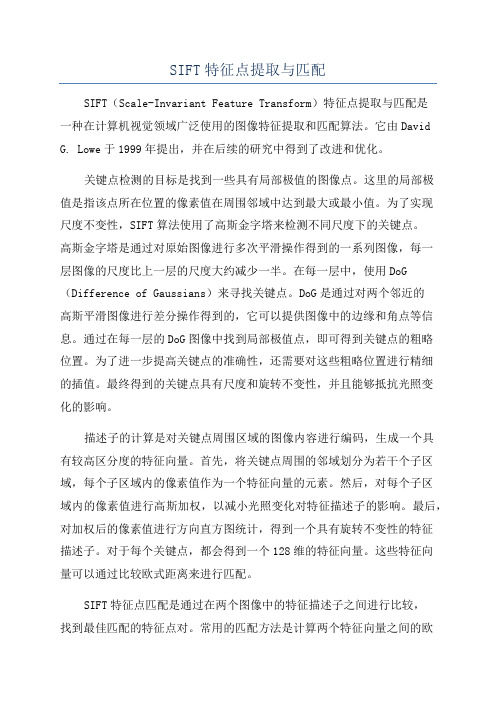

SIFT特征点提取与匹配SIFT(Scale-Invariant Feature Transform)特征点提取与匹配是一种在计算机视觉领域广泛使用的图像特征提取和匹配算法。

它由David G. Lowe于1999年提出,并在后续的研究中得到了改进和优化。

关键点检测的目标是找到一些具有局部极值的图像点。

这里的局部极值是指该点所在位置的像素值在周围邻域中达到最大或最小值。

为了实现尺度不变性,SIFT算法使用了高斯金字塔来检测不同尺度下的关键点。

高斯金字塔是通过对原始图像进行多次平滑操作得到的一系列图像,每一层图像的尺度比上一层的尺度大约减少一半。

在每一层中,使用DoG (Difference of Gaussians)来寻找关键点。

DoG是通过对两个邻近的高斯平滑图像进行差分操作得到的,它可以提供图像中的边缘和角点等信息。

通过在每一层的DoG图像中找到局部极值点,即可得到关键点的粗略位置。

为了进一步提高关键点的准确性,还需要对这些粗略位置进行精细的插值。

最终得到的关键点具有尺度和旋转不变性,并且能够抵抗光照变化的影响。

描述子的计算是对关键点周围区域的图像内容进行编码,生成一个具有较高区分度的特征向量。

首先,将关键点周围的邻域划分为若干个子区域,每个子区域内的像素值作为一个特征向量的元素。

然后,对每个子区域内的像素值进行高斯加权,以减小光照变化对特征描述子的影响。

最后,对加权后的像素值进行方向直方图统计,得到一个具有旋转不变性的特征描述子。

对于每个关键点,都会得到一个128维的特征向量。

这些特征向量可以通过比较欧式距离来进行匹配。

SIFT特征点匹配是通过在两个图像中的特征描述子之间进行比较,找到最佳匹配的特征点对。

常用的匹配方法是计算两个特征向量之间的欧式距离,并将距离最小的两个特征点视为匹配点。

为了提高匹配的准确性和鲁棒性,还可以采用诸如RANSAC(RANdom SAmple Consensus)的算法来剔除错误匹配。

计算机视觉课程简介

申抒含 中国科学院自动化研究所 模式识别国家重点实验室

计算机视觉课程主讲老师

胡占义

研究员 第1周

申抒含

副研究员 第1-7、12周

高伟 副研究员 第8-11周

孔庆群

助理研究员 第13周

为什么研究计算机视觉——使机器具有视觉感知能力

人类视觉

计算机视觉

为什么研究计算机视觉—Every image tells a story

语义

计算机视觉课程结构图

图像 2.特征检测 3.特征匹配

结 构 化 语 义 化

4.图像分割 6.运动估计 7.目标跟踪

5.图像配准

8-11.三维重建

12.识别 13.人脑工程

课程安排

课程内容: 计算机视觉的基本理论与应用 参考书: 自制课件,无需购买参考书; R. Szeliski, Computer Vision: Algorithms and Applications, Springer, 2011. R. Hartely and A. Zisserman, Multiple View Geometry in Computer Vision (Second Edition), Cambridge University Press, 2003; 课件下载网址: 课题组网站: 课程资料:/zh/teaching/index.html

数字图像处理

图像增强

图像

图像

计算机视觉与数字图像处理、计算机图形学的区别

计算机图形学

Face Rendering synthetic synthetic real

结构+纹理+光照

图像

G. Borshukov, Siggraph 2003

特征点检测与匹配算法

特征点检测与匹配算法引言特征点检测与匹配算法是计算机视觉领域的重要研究方向之一。

它在图像处理、图像识别、目标跟踪等应用中发挥着重要的作用。

本文将从特征点检测的概念出发,逐步介绍特征点检测与匹配算法的原理、常用方法及其应用。

特征点检测概述特征点是图像中具有显著性、稳定性且可重复检测的图像区域。

特征点检测是指在图像中自动寻找这些具有特征性的点,并进行描述和匹配的过程。

特征点检测广泛应用于图像匹配、图像拼接、目标识别等领域。

特征点检测算法原理Harris角点检测算法Harris角点检测算法是一种经典的特征点检测算法。

它通过计算图像中每个像素点的Harris响应函数来判断其是否为角点。

Harris角点检测算法对图像的局部对比度和灰度变化进行了建模,能够检测出图像中的角点。

算法步骤: 1. 计算图像的灰度梯度。

2. 对每个像素计算一个自相关矩阵。

3. 计算自相关矩阵的Harris响应函数。

4. 设置一个阈值,根据Harris响应函数的值判断是否为角点。

SIFT算法尺度不变特征转换(SIFT)算法是一种常用的特征点检测算法。

SIFT算法通过使用高斯差分函数来检测图像中的关键点,并计算关键点的描述子,实现了对旋转、尺度缩放等变换的不变性。

算法步骤: 1. 构建高斯金字塔。

2. 在金字塔的每一层上使用高斯差分函数寻找关键点。

3. 基于关键点的位置和尺度,生成关键点的描述子。

4. 使用描述子进行关键点的匹配。

SURF算法加速稳健特征(SURF)算法是一种基于SIFT算法的改进方法。

SURF算法通过加速计算和改进特征描述子的方式,提高了特征点检测的效率和稳定性。

算法步骤: 1. 使用高斯滤波器构建图像金字塔。

2. 使用盒子滤波器计算图像的Hessian矩阵。

3. 使用Hessian矩阵检测图像中的极值点作为特征点。

4. 根据特征点的尺度和方向计算特征点的描述子。

特征点匹配算法特征点匹配是指在两幅图像之间寻找相同或相似的特征点的过程。

ORB特征点检测匹配算法

ORB特征点检测匹配算法ORB(Oriented FAST and Rotated BRIEF)是一种基于特征点的检测和描述算法,它结合了FAST角点检测器和BRIEF描述子生成器的优点,具有快速、高效和鲁棒性等优点。

ORB特征点检测匹配算法在计算机视觉领域得到了广泛应用,可以用于图像配准、物体识别、SLAM等各种应用场景中。

1.检测算法ORB特征点的检测算法主要由两个部分组成:FAST角点检测器和Harris角点响应检测器。

FAST角点检测器是一种高效的角点检测算法,可以用来寻找图像中的角点。

Harris角点响应检测器则是一种基于灰度梯度的角点检测算法,可以用来确定角点的强度和位置。

在ORB特征点检测算法中,首先使用FAST角点检测器对图像进行角点检测,然后在检测到的角点周围使用Harris角点响应检测器来确定最终的特征点位置。

通过这种组合方式,可以同时实现高效和鲁棒的角点检测,提高特征点检测的准确性和稳定性。

2.描述算法ORB特征点的描述算法主要由两个部分组成:BRIEF特征描述子生成器和ORB特征描述子。

BRIEF是一种二进制描述子生成算法,可以将每个特征点周围的像素值转换为一个二进制串。

ORB特征描述子是在BRIEF基础上进行改进的一种特征描述子,可以提高描述子的稳定性和鲁棒性。

在ORB特征点描述算法中,首先使用BRIEF特征描述子生成器对检测到的特征点进行二进制描述,然后通过ORB特征描述子将二进制描述子进行优化和加权,提高描述子的区分度和准确性。

通过这种方式,可以快速生成高质量的特征描述子,用于后续的特征匹配和识别过程。

3.匹配算法ORB特征点匹配算法主要通过计算两幅图像中的特征点之间的相似性来进行匹配。

在匹配过程中,通常采用汉明距离或欧氏距离等指标来度量特征点之间的相似性,找到最匹配的特征点对。

通过匹配算法,可以实现图像的配准、物体的识别和SLAM等应用。

总的来说,ORB特征点检测匹配算法是一种高效、鲁棒的特征点检测和描述算法,具有快速计算速度、高准确性和广泛应用等优点,适用于各种计算机视觉应用领域。

特征匹配综述

特征匹配综述

特征匹配是计算机视觉中的一个重要任务,用于在两个或多个图像中找到相似的特征点或区域。

特征匹配可以用于目标检测、图像配准、运动估计等应用。

在特征匹配中,我们通常先在图像中提取特征点,然后使用一种匹配算法来计算特征点之间的相似度,并找到最佳匹配。

有许多不同的特征检测和匹配算法可供选择,下面是一些常用的方法:

1. 尺度不变特征变换(SIFT):SIFT是一种高效且鲁棒的特征检测和匹配算法,能够在不同尺度和旋转角度下对特征点进行准确匹配。

2. 加速稳健特征(FAST):FAST是一种快速特征检测算法,适用于实时应用,具有较好的稳定性和鲁棒性。

3. 模板匹配:模板匹配是一种简单但有效的特征匹配方法,通过比较图像中的像素值来找到相似的区域。

模板匹配在一些特定场景下具有较好的性能。

4. 匹配学习:匹配学习是一种利用机器学习算法学习匹配规则的方法。

通过训练一个分类器或回归模型,可以实现更准确和鲁棒的特征匹配。

虽然特征匹配在很多应用中都能取得不错的结果,但仍然存在一些挑战和限制。

例如,当图像中存在视角变化、遮挡、噪声等情况时,特征匹配的准确性可能会

下降。

因此,为了提高特征匹配的性能,研究人员一直在不断改进算法和提出新的方法。

总而言之,特征匹配是计算机视觉领域中的一个重要任务,有许多不同的算法和方法可供选择。

随着技术的不断发展,特征匹配在各种应用中的性能和效果也得到了不断提高。

如何利用计算机视觉技术进行图像特征提取与匹配的关键技巧分享

如何利用计算机视觉技术进行图像特征提取与匹配的关键技巧分享计算机视觉技术的飞速发展使得人们能够以前所未有的方式处理和理解图像数据。

图像特征提取与匹配是计算机视觉领域中的核心任务之一,它对于识别、检测和跟踪等应用具有至关重要的作用。

在本文中,我们将分享一些利用计算机视觉技术进行图像特征提取与匹配的关键技巧。

一、图像特征提取技术图像特征提取是将图像数据转化为计算机可以理解和处理的形式的过程。

常用的图像特征提取技术包括颜色特征、纹理特征和形状特征等。

1. 颜色特征提取颜色是图像中最直观的特征之一。

提取颜色特征的方法有很多种,其中最常用的是直方图法。

直方图可以反映图像中不同颜色的分布,通过统计每个颜色在图像中的出现次数,可以得到颜色直方图。

颜色直方图可以用于图像分类、目标跟踪等领域。

2. 纹理特征提取纹理是图像中像素排列形成的局部空间结构。

纹理特征提取的目的是通过提取纹理的某些统计特征来描述纹理的结构信息。

常用的纹理特征提取方法有灰度共生矩阵法、局部二值模式法等。

这些方法通过计算像素之间的关系统计量,得到能够描述纹理特征的矩阵或向量。

纹理特征可以应用于图像检索、物体识别等领域。

3. 形状特征提取形状特征是描述物体轮廓或边界的特征。

形状特征提取的方法有很多种,常用的有边缘检测法和边界描述法。

边缘检测法通过寻找图像中不连续的亮度变化来提取边界信息;边界描述法则通过计算边界的形状描述子,如弧长、曲率等来描述形状特征。

二、图像特征匹配技术图像特征匹配是将给定图像的特征与数据库中的特征进行比对,找到最相似的图像或物体的过程。

图像特征匹配的关键在于如何选择合适的匹配算法和度量方法。

1. 特征点匹配特征点匹配是图像特征匹配中最常见的方法。

在图像中选择鲁棒的特征点,并计算特征向量或描述子,然后利用特征向量或描述子进行匹配。

常用的特征点匹配算法有SIFT、SURF和ORB等。

这些算法具有良好的尺度不变性和旋转不变性,能够有效地匹配图像。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

•Find corresponding pairs

•Use these pairs to align images

Matching with Features

• Problem 1:

– Detect the same point independently in both images

E (u, v) u, v u M v

• Describe a point in terms of eigenvalues of M: measure of corner response

R 12 k 1 2

2

• A good (corner) point should have a large intensity change in all directions, i.e. R should be large positive

direction of the slowest change

Selecting Good Features

1 and 2 are large

Selecting Good Features

large 1, small 2

Selecting Good Features

small 1, small 2

Harris Detector: Mathematics

2

• R depends only on eigenvalues of M • R is large for a corner

“Edge”

R<0

“Corner”

• R is negative with large magnitude for an edge

Matching with Features

•Detect feature points in both images

Matching with Features

•Detect feature points in both images

•Find corresponding pairs

Matching with Features

I x2 M w( x, y ) x, y IxI y

IxI y 2 Iy

M is also called “structure tensor”

Harris Detector: Mathematics

Intensity change in shifting window: eigenvalue analysis

More motivation…

• Feature points are used also for:

– – – – – – – Image alignment (homography, fundamental matrix) 3D reconstruction Motion tracking Object recognition Indexing and database retrieval Robot navigation … other

directions

1 and 2 are small; E is almost

constant in all directions

“Flat” region

“Edge” 1 >> 2 1

Harris Detector: Mathematics

Measure of corner response:

Selecting Good Features

• What’s a ―good feature‖?

– Satisfies brightness constancy—looks the same in both images – Has sufficient texture variation – Does not have too much texture variation – Corresponds to a ―real‖ surface patch—see below:

R det M k does not requires computing the eigenvalues.

det M 12 trace M 1 2

(k – empirical constant, k = 0.04-0.06)

Can nail it

5

Building a Panorama

M. Brown and D. G. Lowe. Recognising Panoramas. ICCV

How do we build a panorama?

• We need to match (align) images • Global methods sensitive to occlusion, lighting, parallax effects. So look for local features that match well. • How would you do it by eye?

Harris Detector: Workflow

Harris Detector: Workflow

Compute corner response R

Harris Detector: Workflow

Find points with large corner response: R>threshold

x, y

2

Window function

Shifted intensity

Intensity

Window function w(x,y) = 1 in window, 0 outside

or Gaussian

Taylor series approx to shifted image

Harris Detector: Mathematics

no chance to match!

We need a repeatable detector

Matching with Features

• Problem 2:

– For each point correctly recognize the corresponding one

?

We need a reliable and distinctive descriptor

Harris Detector: Workflow

Take only the points of local maxima of R

Harris Detector: Workflow

Harris Detector: Summary

• Average intensity change in direction [u,v] can be expressed as a bilinear form:

Harris Detector: Basic Idea

“flat” region: no change as shift window in all directions

“edge”: no change as shift window along the edge direction

“corner”: significant change as shift window in all directions

Harris Detector: Mathematics

Classification of image points using eigenvalues of M: 2 “Edge” 2 >> 1

“Corner” 1 and 2 are large, 1 ~ 2; E increases in all

Bad feature Left eye view Good feature Right eye view

– Does not deform too much over time

Contents

• Harris Corner Detector – Overview – Analysis • Detectors – Rotation invariant – Scale invariant – Affine invariant • Descriptors – Rotation invariant – Scale invariant – Affine invariant

• |R| is small for a flat region

R>0

“Flat” |R| small

“Edge” R<0 1

Harris Detector

• The Algorithm:

– Find points with large corner response function R (R > threshold) – Take the points of local maxima of R

E (u, v) u, v

u M v

1, 2 – eigenvalues of M

direction of the fastest change

Ellipse E(u,v) = const

Iso-intensity contour of E(u,v) (max)-1/2 (min)-1/2

An introductory example: Harris corner detector

C.Harris, M.Stephens. “A Combined Corner and Edge Detector”. 1988

The Basic Idea

• We should easily localize the point by looking through a small window • Shifting a window in any direction should give a large change in intensity