Matlab教程课件-RBF神经网络(my)

RBF神经网络:原理详解和MATLAB实现

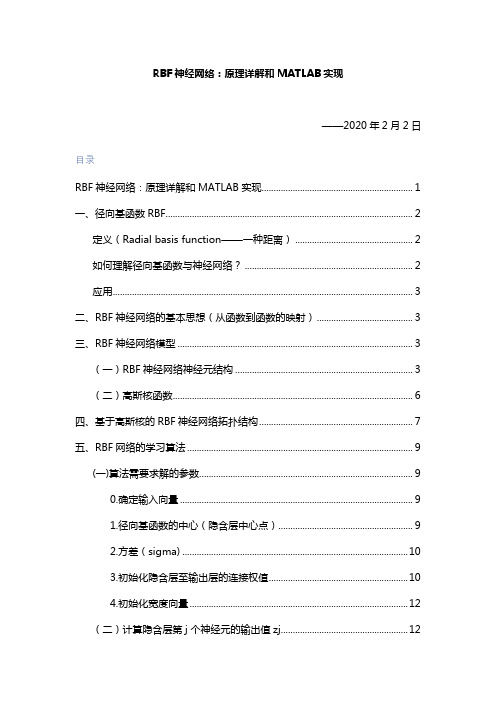

RBF神经⽹络:原理详解和MATLAB实现RBF神经⽹络:原理详解和MATLAB实现——2020年2⽉2⽇⽬录RBF神经⽹络:原理详解和MATLAB实现 (1)⼀、径向基函数RBF (2)定义(Radial basis function——⼀种距离) (2)如何理解径向基函数与神经⽹络? (2)应⽤ (3)⼆、RBF神经⽹络的基本思想(从函数到函数的映射) (3)三、RBF神经⽹络模型 (3)(⼀)RBF神经⽹络神经元结构 (3)(⼆)⾼斯核函数 (6)四、基于⾼斯核的RBF神经⽹络拓扑结构 (7)五、RBF⽹络的学习算法 (9)(⼀)算法需要求解的参数 (9)0.确定输⼊向量 (9)1.径向基函数的中⼼(隐含层中⼼点) (9)2.⽅差(sigma) (10)3.初始化隐含层⾄输出层的连接权值 (10)4.初始化宽度向量 (12)(⼆)计算隐含层第j 个神经元的输出值zj (12)(三)计算输出层神经元的输出 (13)(四)权重参数的迭代计算 (13)六、RBF神经⽹络算法的MATLAB实现 (14)七、RBF神经⽹络学习算法的范例 (15)(⼀)简例 (15)(⼆)预测汽油⾟烷值 (15)⼋、参考资料 (19)⼀、径向基函数RBF定义(Radial basis function——⼀种距离)径向基函数是⼀个取值仅仅依赖于离原点距离的实值函数,也就是Φ(x)=Φ(‖x‖),或者还可以是到任意⼀点c的距离,c点称为中⼼点,也就是Φ(x,c)=Φ(‖x-c‖)。

任意⼀个满⾜Φ(x)=Φ(‖x‖)特性的函数Φ都叫做径向基函数。

标准的⼀般使⽤欧⽒距离(也叫做欧式径向基函数),尽管其他距离函数也是可以的。

在神经⽹络结构中,可以作为全连接层和ReLU层的主要函数。

⼀些径向函数代表性的⽤到近似给定的函数,这种近似可以被解释成⼀个简单的神经⽹络。

径向基函数在⽀持向量机中也被⽤做核函数。

常见的径向基函数有:⾼斯函数,⼆次函数,逆⼆次函数等。

matlab教程(完整版)ppt课件

与Maple、Mathematica数学计算软件相比,MATLAB以数值计算见长,而 Maple等以符号运算见长,能给出解析解和任意精度解,而处理大量数据的能力 远不如MATLAB。

5/6/2020

.Matlab Language

4

课程安排

课堂教学:共24学时;(1-12周) 上机试验:共24学时。

(2-13周,周二7-8节,九实401、402、403)

学习成绩: 1)上机实验成绩占30%; 2)考勤 10% ; 3) 考试60% (随堂考试)。

主要参考书 ➢ 《精通MATLAB 6.5》张志涌 等编著,北航出版,2003年 ➢ 《高等应用数学问题的Matlab求解》 薛定宇等著,清华大学出

MATLAB软件功能之强大、应用之广泛,已成为为21世纪最为重要的科学计算 语言。可见学习掌握这一工具的重要性。

5/6/2020

.Matlab Language

13

1.2 MATLAB产品的体系结构

围绕着MATLAB这个计算核心,形成了诸多针对不同 习使M实用A际MMTA上LATATMLBLAA产ABTBS间 的呢品LimA或核?由uB围 称 专 Bl离心若本这ilnoM文 标 编 行用绕为k散。c就干身M核 数A是k件 译效准模着模s时AT有模就心 据e窗编 生率的L块S块tT间、块是必i与 可ALm口译 成C。集集AB的S要组一u/基视图i生函BlC,(mCi动n了成个础化是+形oP成数k如Bm+态o仿,解极,于M应(用的位而领l方o标库w文Cp系cA真这不其i是一e且用工开域T详o式lk准或r件eTmos统Sr核一同丰集体发新领具,见eLo的这y的可m可tslA建s心b软的富高的提的域箱可tMu)、种执eCBo以nm模所A件模的x/性高产供工的大以i,专编行)cM被CTB、a开产块资能效品的具算概首+L门t译A文l,任iooA+分发T品完源数编家工箱法有先c用器n件这B何语Lk析的的成库B值程族s具还程到在4A于可,e些一言0lB和to应体不,多计语的箱在序网线、连以以c工产种文k仿用系同那个算言计,不包上帮S续将s提具品件Cie真g程结的么,与。算这t断,查助/时Mn、高箱提,Ca序构功应另些增被找文Al+D程的供而T包+能该外工加称是档S。序L列许生编P,,从A还具。为否。的表多成译B其哪有箱如专 已M程运以的器A中一其的果用 有序及T有部他总你工 相L每A:分公数有具 关个B开司已特箱 的本工始或有别工身具着研1的具所箱0手0究应箱提的多、单用,供使个学,

2024版matlab教程(全)资料ppt课件

进行通信系统的建模、仿真和分析。

谢谢聆听

B

C

变量与赋值

在MATLAB中,变量不需要事先声明,可以 直接赋值。变量名以字母开头,可以包含字 母、数字和下划线。

常用函数

MATLAB提供了丰富的内置函数,如sin、 cos、tan等三角函数,以及abs、sqrt等数 学函数。用户可以通过help命令查看函数的

D

使用方法。

02 矩阵运算与数组操作

错误处理

阐述try-catch错误处理机制的语法、 执行流程及应用实例。

04

函数定义与调用

函数概述

阐述函数的概念、作用及分类,包括内置函数和 自定义函数。

函数调用

深入剖析函数的调用方法,包括直接调用、间接 调用及参数传递等技巧。

ABCD

函数定义

详细讲解自定义函数的定义方法,包括函数名、 输入参数、输出参数及函数体等要素。

拟合方法

利用已知数据点构造近似函数,如最小二乘法、多项 式拟合、非线性拟合等。

插值与拟合的比较

插值函数经过所有数据点,而拟合函数则追求整体上 的近似。

数值积分与微分

01

数值积分方法

利用数值技术计算定积分的近似 值,如矩形法、梯形法、辛普森 法等。

02

数值微分方法

通过数值技术求解函数的导数或 微分,如差分法、中心差分法、 五点差分法等。

02

01

矩阵运算

加法与减法

对应元素相加或相减,要求矩阵 大小相同

乘法

使用`*`或`mtimes`函数进行矩阵 乘法,要求内维数相同

点乘与点除

使用`.*`、`./`进行对应元素相乘或 相除,要求矩阵大小相同

特征值与特征向量

matlab教程ppt(完整版)

展示部分与整体的关系,通过扇形面积或角度表 示占比。

三维图形

01

02

03

04

三维散点图

在三维空间中展示两个变量之 间的关系,通过点的位置展示

数据。

三维曲面图

通过曲面表示两个或多个变量 之间的关系,可以展示数据的

分布和趋势。

三维等高线图

表示三维空间中数据的分布和 变化,通过等高线的形状和密

集程度展示数据。

处理运行过程中出现的错误和 异常情况。

通过优化算法和代码结构,提 高程序的运行效率。

对代码进行重新组织,使其更 易于阅读和维护。

03

MATLAB可视化

绘图基础

散点图

描述两个变量之间的关系,通过点的分布展示数 据。

条形图

比较不同类别的数据大小,通过条形的长度或高 度进行比较。

折线图

展示时间序列数据或多个变量之间的关系,通过 线条的走势呈现数据变化。

控制系统仿真

使用MATLAB进行控制系统仿真 ,模拟系统动态性能。

控制系统优化

对控制系统进行优化设计,如权 重优化、多目标优化等。

THANK YOU

感谢聆听

对图像进行几何变换,如缩放、旋转、平移 等操作。

动画制作

帧动画

通过一系列静态图像的连续播放,形 成动态效果。

路径动画

让对象沿指定路径移动,形成动态效 果。

变形动画

让对象从一个形状逐渐变形为另一个 形状,形成动态效果。

交互式动画

允许用户通过交互操作控制动画的播 放、暂停、回放等操作。

04

MATLAB在科学计算中的应用

对函数进行数值积分和微分, 用于解决定积分和微分方程问 题。

数值优化

matlab教程ppt(完整版)

矩阵的数学运算

总结词

详细描述

总结词

详细描述

掌握矩阵的数学运算,如求逆 、求行列式、求特征值等。

在MATLAB中,可以使用inv() 函数来求矩阵的逆,使用det() 函数来求矩阵的行列式,使用 eig()函数来求矩阵的特征值。 例如,A的逆可以表示为 inv(A),A的行列式可以表示 为det(A),A的特征值可以表 示为eig(A)。

• 总结词:了解特征值和特征向量的概念及其在矩阵分析中的作用。 • 详细描述:特征值和特征向量是矩阵分析中的重要概念。特征值是满足Ax=λx的标量λ和向量x,特征向量是与特征值对

应的非零向量。特征值和特征向量在许多实际问题中都有应用,如振动分析、控制系统等。

04

MATLAB图像处理

图像的读取与显示

变量定义

使用赋值语句定义变量,例如 `x = 5`。

矩阵操作

学习如何创建、访问和操作矩 阵,例如使用方括号 `[]`。

函数编写

学习如何创建自定义函数来执 行特定任务。

02

MATLAB编程

变量与数据类型

01

02

03

变量命名规则

MATLAB中的变量名以字 母开头,可以包含字母、 数字和下划线,但不应与 MATLAB保留字冲突。

了解矩阵的数学运算在实际问 题中的应用。

矩阵的数学运算在许多实际问 题中都有应用,如线性方程组 的求解、矩阵的分解、信号处 理等。通过掌握这些运算,可 以更好地理解和解决这些问题 。

矩阵的分解与特征值

• 总结词:了解矩阵的分解方法,如LU分解、QR分解等。

• 详细描述:在MATLAB中,可以使用lu()函数进行LU分解,使用qr()函数进行QR分解。这些分解方法可以将一个复杂的 矩阵分解为几个简单的部分,便于计算和分析。

RBF神经网络英文课件

Computing the Output Weights Our equations for the weights are most conveniently written in matrix form by defining matrices with components (Wkj = wkj, (Φpj = φj(xp, and (Tpk = {tkp}. This gives Φ T ΦW T − T = 0 and the formal solution for the weights is ( W T = Φ †T in which we have the standard pseudo inverse of Φ Φ † ≡ (Φ T Φ −1 Φ T which can be seen to have the property Φ †Φ = I. We see that the network weights can be computed by fast linear matrix inversion techniques. In practice we tend to use singular value decomposition (SVD to avoid possible ill-conditioning of Φ , i.e. ΦTΦ being singular or near singular. L13-11Overview and Reading 1. 2. 3. 4. 5. We began by defining Radial Basis Function (RBF mappings and the corresponding network architecture. Then we considered the computational power of RBF networks. We then saw how the two layers of network weights were rather different and different techniques were appropriate for training each of them. We first looked at several unsupervised techniques for carrying out the first stage, namely optimizing the basis functions. We then saw how the second stage, determining the output weights, could be performed by fast linear matrix inversion techniques. Reading 1. 2. Bishop: Sections 5.2, 5.3, 5.9, 5.10, 3.4 Haykin: Sections 5.4, 5.9, 5.10, 5.13 L13-12。

matlab教程ppt(完整版)

可以使用`'`运算符对矩阵进行 转置。

矩阵高级运算

01

逆矩阵

可以使用`inv`函数求矩阵的逆矩阵 。

行列式

可以使用`det`函数求矩阵的行列式 。

03

02

特征值和特征向量

可以使用`eig`函数求矩阵的特征值 和特征向量。

秩

可以使用`rank`函数求矩阵的秩。

04

04

matlab绘图功能

绘图基本命令

控制设计

MATLAB提供了控制系统设计和分析 工具箱,可以方便地进行控制系统的 建模、分析和优化。

03

信号处理

MATLAB提供了丰富的信号处理工具 箱,可以进行信号的时域和频域分析 、滤波器设计等操作。

05

04

图像处理

MATLAB提供了图像处理工具箱,可 以进行图像的增强、分割、特征提取 等操作。

02

matlab程序调试技巧分享

01

调试模式

MATLAB提供了调试模式,可以 逐行执行代码,查看变量值,设 置断点等。

日志输出

02

03

错误处理

通过使用fprintf函数,可以在程 序运行过程中输出日志信息,帮 助定位问题。

MATLAB中的错误处理机制可以 帮助我们捕获和处理运行时错误 。

matlab程序优化方法探讨

显示结果

命令执行后,结果将在命令窗口中显示。

保存结果

可以使用`save`命令将结果保存到文件中。

matlab变量定义与赋值

定义变量

使用`varname = value`格式定义变 量,其中`varname`是变量名, `value`是变量的值。

赋值操作

使用`=`运算符将值赋给变量。例如 ,`a = 10`将值10赋给变量a。

matlab教程ppt(完整版)

控制流语句

使用条件语句(如if-else)和 循环语句(如for)来控制程序 流程。

变量定义

使用赋值语句定义变量,例如 `a = 5`。

矩阵运算

使用矩阵进行数学运算,如加 法、减法、乘法和除法等。

函数编写

创建自定义函数来执行特定任 务。

02

MATLAB编程语言基础

变量与数据类型

变量命名规则

数据类型转换

编辑器是一个文本编辑器 ,用于编写和编辑 MATLAB脚本和函数。

工具箱窗口提供了一系列 用于特定任务的工具和功 能,如数据可视化、信号 处理等。

工作空间窗口显示当前工 作区中的变量,可以查看 和修改变量的值。

MATLAB基本操作

数据类型

MATLAB支持多种数据类型, 如数值型、字符型和逻辑型等 。

04

MATLAB数值计算

数值计算基础

01

02

03

数值类型

介绍MATLAB中的数值类 型,包括双精度、单精度 、复数等。

变量赋值

讲解如何给变量赋值,包 括标量、向量和矩阵。

运算符

介绍基本的算术运算符、 关系运算符和逻辑运算符 及其优先级。

数值计算函数

数学函数

列举常用的数学函数,如 三角函数、指数函数、对 数函数等。

矩阵的函数运算

总结词:MATLAB提供了许多内置函 数,可以对矩阵进行各种复杂的运算

。

详细描述

矩阵求逆:使用 `inv` 函数求矩阵的 逆。

特征值和特征向量:使用 `eig` 函数 计算矩阵的特征值和特征向量。

行列式值:使用 `det` 函数计算矩阵 的行列式值。

矩阵分解:使用 `factor` 和 `expm` 等函数对矩阵进行分解和计算指数。

matlab教程ppt(完整版)

汇报人:可编辑

2023-12-24

目录

• MATLAB基础 • MATLAB编程 • MATLAB矩阵运算 • MATLAB数值计算 • MATLAB可视化 • MATLAB应用实例

01

CATALOGUE

MATLAB基础

MATLAB简介

MATLAB定义

MATLAB应用领域

菜单栏

包括文件、编辑、查看、主页 、应用程序等菜单项。

命令窗口

用于输入MATLAB命令并显示 结果。

MATLAB主界面

包括命令窗口、当前目录窗口 、工作空间窗口、历史命令窗 口等。

工具栏

包括常用工具栏和自定义工具 栏。

工作空间窗口

显示当前工作区中的变量。

MATLAB基本操作

变量定义

使用变量名和赋值符号(=)定义变 量。

详细描述

直接输入:在 MATLAB中,可以直 接通过输入矩阵的元 素来创建矩阵。例如 ,`A = [1, 2, 3; 4, 5, 6; 7, 8, 9]`。

使用函数创建: MATLAB提供了多种 函数来创建特殊类型 的矩阵,如`eye(n)`创 建n阶单位矩阵, `diag(v)`创建由向量v 的元素构成的对角矩 阵。

使用bar函数绘制柱状图 ,可以自定义柱子的宽

度、颜色和标签。

使用pie函数绘制饼图, 可以自定义饼块的比例

和颜色。

三维绘图

01

02

03

04

三维线图

使用plot3函数绘制三维线图 ,可以展示三维空间中的数据

点。

三维曲面图

使用surf函数绘制三维曲面图 ,可以展示三维空间中的曲面

。

三维等高线图

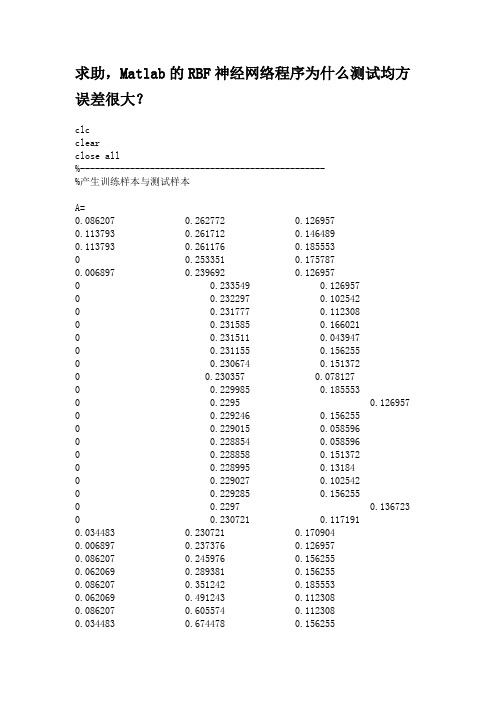

Matlab的RBF神经网络程序

求助,Matlab的RBF神经网络程序为什么测试均方误差很大?clcclearclose all%-------------------------------------------------%产生训练样本与测试样本A=0.086207 0.262772 0.1269570.113793 0.261712 0.1464890.113793 0.261176 0.1855530 0.253351 0.1757870.006897 0.239692 0.1269570 0.233549 0.1269570 0.232297 0.1025420 0.231777 0.1123080 0.231585 0.1660210 0.231511 0.0439470 0.231155 0.1562550 0.230674 0.1513720 0.230357 0.0781270 0.229985 0.1855530 0.2295 0.126957 0 0.229246 0.1562550 0.229015 0.0585960 0.228854 0.0585960 0.228858 0.1513720 0.228995 0.131840 0.229027 0.1025420 0.229285 0.1562550 0.2297 0.136723 0 0.230721 0.1171910.034483 0.230721 0.1709040.006897 0.237376 0.1269570.086207 0.245976 0.1562550.062069 0.289381 0.1562550.086207 0.351242 0.1855530.062069 0.491243 0.1123080.086207 0.605574 0.1123080.034483 0.674478 0.1562550.062069 0.733842 0.1709040.196552 0.768613 0.1123080.086207 0.792452 0.1709040.034483 0.807965 0.1171910.086207 0.826889 0.131840.168966 0.844617 0.1660210.168966 0.859543 0.1367230.196552 0.879376 0.1367230.196552 0.894525 0.2246160.196552 0.911278 0.1464890.141379 0.922284 0.0585960.196552 0.927073 0.1367230.113793 0.930332 0.1464890.168966 0.932973 0.1464890.168966 0.938881 0.0634780.168966 0.94669 0.1025420.196552 0.952802 0.0976590 0.958737 0.1513720.006897 0.960443 0.1025420 0.96324 0.117191 0.113793 0.965827 0.0781270.034483 0.966464 0.2392650.113793 0.969583 0.1709040.086207 0.971601 0.1855530.141379 0.973354 0.131840.034483 0.974763 0.1367230.062069 0.975569 0.1171910.034483 0.976746 0.1367230.006897 0.977846 0.131840.062069 0.978429 0.1757870.086207 0.979458 0.1562550.062069 0.9806 0.1171910.006897 0.980925 0.1367230.141379 0.981492 0.1269570.086207 0.982099 0.1269570.113793 0.982412 0.1269570.141379 0.982897 0.1367230.141379 0.983022 0.1660210.141379 0.983042 0.1269570.168966 0.982819 0.1025420.113793 0.98267 0.1123080.034483 0.982283 0.1269570.062069 0.981973 0.1269570.034483 0.981375 0.1269570.034483 0.98087 0.097659 0.062069 0.980189 0.1367230.006897 0.979309 0.0927760.062069 0.97864 0.156255 0.034483 0.978171 0.1123080.086207 0.976915 0.1513720.034483 0.97639 0.092776 0.141379 0.974982 0.1367230.113793 0.97389 0.117191 0.141379 0.972857 0.1269570.006897 0.971918 0.1367230.034483 0.971257 0.1855530.034483 0.970788 0.1464890.141379 0.946456 0.1562550.141379 0.946006 0.1123080.196552 0.945368 0.1513720.196552 0.944625 0.1367230.168966 0.944014 00.168966 0.94322 00.168966 0.942578 00.086207 0.942183 0.1367230.168966 0.941189 0.6152530.168966 0.940438 00.113793 0.939679 0.2783290.168966 0.93903 00.113793 0.938545 0.7861570.141379 0.938212 00.113793 0.937371 0.8398690.141379 0.936737 0.1025420.196552 0.936103 00.141379 0.935489 00.196552 0.935199 00.168966 0.934507 0.1464890.168966 0.934213 0.2099670.168966 0.933709 0.1562550.168966 0.933075 0.1171910.168966 0.932586 0.0976590.196552 0.932183 0.0927760.196552 0.931936 0.1513720.141379 0.931326 0.131840.168966 0.931087 0.0781270.196552 0.92881 0.2246160.086207 0.928482 0.1660210.141379 0.927965 0.1123080.113793 0.927402 0.13184 0.113793 0.926866 0.13184 0.141379 0.926568 0.126957 0.141379 0.926392 0.097659 0.196552 0.926079 0.112308 0.141379 0.923708 0.097659 0.141379 0.923188 0.146489 0.113793 0.922887 0.097659 0.168966 0.922503 0.126957 0.141379 0.922053 0.102542 0.086207 0.921791 0.136723 0.086207 0.921463 0.151372 0.062069 0.921247 0.117191 0.086207 0.920946 0.078127 0.062069 0.920747 0.126957 0.113793 0.920484 0.136723 0.141379 0.920359 0.078127 0.034483 0.920121 0.063478 0.113793 0.918869 0.200201 0.062069 0.918626 0.327158 0.086207 0.918477 0.156255 0.141379 0.918254 0.327158 0.034483 0.918078 0.117191 0.034483 0.917879 0.078127 0.086207 0.917714 0.146489 0.006897 0.917589 0.063478 0.113793 0.917425 0.136723 0.086207 0.917167 0.136723 0.034483 0.917006 0.136723 0.062069 0.916232 0.073244 0.086207 0.916118 0.200201 0.113793 0.916056 0.092776 0.062069 0.915922 0.126957 0.086207 0.915762 0.058596 0.113793 0.915696 0.126957 0.168966 0.914048 0.185553 0.113793 0.913199 0.117191 0.113793 0.912487 0.185553 0.086207 0.912014 0.009766 0.168966 0.911642 0.078127 0.034483 0.911087 0.166021 0.168966 0.910637 0.200201 0.113793 0.910472 0.166021 0.196552 0.910324 0.1367230.141379 0.90978 0.131840.113793 0.907644 0.1660210.224138 0.907569 0.1464890.196552 0.907468 0.1464890.196552 0.907444 0.1367230.196552 0.907338 0.1171910.168966 0.907237 0.1269570.196552 0.907202 0.2050840.196552 0.907123 0.1269570.196552 0.907045 0.0781270.168966 0.906767 0.1660210.196552 0.906724 0.1513720.196552 0.906716 0.1123080.141379 0.906615 0.1513720.168966 0.906509 0.1855530.196552 0.906458 0.1562550.196552 0.906043 0.1123080.168966 0.905938 0.1709040.168966 0.905691 0.131840.168966 0.905394 0.126957; %训练样本,共三百组A=A';A1=A(1,:);A2=A(2,:);A3=A(3,:);B=3.1:.0458:16.8; %训练目标C=0.168966 0.905394 0.1269570.168966 0.905277 0.1025420.196552 0.905155 0.1367230.168966 0.905171 0.131840.141379 0.90519 0.1464890.141379 0.905194 0.048830.196552 0.905198 0.1171910.141379 0.905167 0.1269570.113793 0.905163 0.1123080.168966 0.905155 0.1123080.168966 0.905124 0.1513720.196552 0.905065 0.1171910.168966 0.905069 0.1367230.196552 0.905026 0.2002010.141379 0.905011 0.0781270.113793 0.904971 0.1709040.196552 0.904905 0.146489 0.141379 0.904881 0.151372 0.113793 0.904838 0.146489 0.168966 0.904799 0.156255 0.141379 0.904748 0.058596 0.168966 0.904717 0.112308 0.196552 0.904635 0.102542 0.141379 0.904627 0.126957 0.086207 0.904568 0.097659 0.196552 0.904545 0.097659 0.196552 0.904431 0.136723 0.196552 0.90442 0.117191 0.141379 0.904381 0.117191 0.168966 0.904353 0.136723 0.141379 0.904326 0.156255 0.168966 0.904259 0.13184 0.168966 0.904228 0.151372 0.168966 0.904224 0.063478 0.141379 0.904204 0.112308 0.141379 0.904212 0.126957 0.168966 0.904177 0.151372 0.141379 0.904146 0.151372 0.086207 0.90413 0.151372 0.141379 0.904099 0.078127 0.113793 0.904099 0.126957 0.086207 0.904079 0.146489 0.141379 0.904044 0.112308 0.168966 0.904025 0.092776 0.141379 0.903989 0.073244 0.113793 0.903985 0.092776 0.196552 0.90397 0.112308 0.196552 0.903954 0.097659 0.141379 0.903923 0.170904 0.113793 0.903888 0.112308 0.141379 0.903856 0.097659 0.168966 0.903817 0.13184 0.141379 0.903817 0.102542 0.141379 0.90379 0.073244 0.141379 0.903778 0.13184 0.141379 0.903762 0.073244 0.113793 0.903755 0.136723 0.062069 0.903719 0.175787 0.168966 0.903708 0.1513720.141379 0.903708 0.1123080.168966 0.903657 0.1855530.113793 0.903653 0.1171910.113793 0.903637 0.1367230.168966 0.90361 0.1709040.168966 0.903575 0.1269570.141379 0.903551 0.1025420.141379 0.903532 0.1367230.141379 0.903512 0.1367230.141379 0.903481 0.1513720.141379 0.903473 0.1269570.113793 0.903434 0.1367230.141379 0.903457 0.1171910.168966 0.903473 0.1757870.141379 0.903418 0.1171910.168966 0.903406 0.1562550.086207 0.903383 0.1562550.141379 0.903363 0.1464890.141379 0.903359 0.1367230.141379 0.903328 0.1123080.141379 0.903297 0.131840.141379 0.90325 0.1464890.168966 0.902917 0.1269570.168966 0.902851 0.131840.113793 0.902816 0.1855530.141379 0.902816 0.0732440.141379 0.902792 0.0781270.086207 0.902792 0.1464890.141379 0.902745 0.1660210.168966 0.902675 0.1171910.141379 0.902632 0.1562550.086207 0.902612 0.1367230.113793 0.902612 0.126957;%测试样本,共一百组C=C';C1=C(1,:);C2=C(2,:);C3=C(3,:);D=3.1:.1383:16.8; %测试目标%--------------------------------------------------%归一化[PN1,mina1,maxa1,TN,minb,maxb] = premnmx(A1,B);[PN2,mina2,maxa2,TN,minb,maxb] = premnmx(A2,B);[PN3,mina3,maxa3,TN,minb,maxb] = premnmx(A3,B);PN4 = tramnmx(C1,mina1,maxa1);PN5 = tramnmx(C2,mina2,maxa2);PN6 = tramnmx(C3,mina3,maxa3);TN2 = tramnmx(D,minb,maxb);A=[PN1;PN2;PN3];C=[PN4;PN5;PN6];%---------------------------------------------------% 训练switch 2case 1spread = 0.2;net = newrbe(A,TN,spread);case 2goal =0;spread =0.2;MN = size(A,2);DF = 25;net = newrb(A,TN,goal,spread,MN,DF);case 3spread = 0.2;net = newgrnn(A,TN,spread);end%--------------------------------------------------% 测试YN1 = sim(net,A); % 训练样本实际输出YN2 = sim(net,C); % 测试样本实际输出MSE1 = mean((TN-YN1).^2) % 训练均方误差MSE2 = mean((TN2-YN2).^2) % 测试均方误差%--------------------------------------------------% 反归一化Y2 = postmnmx(YN2,minb,maxb);%--------------------------------------------------% 结果作图plot(1:length(D),D,'r:',1:length(Y2),Y2,'b-');clear; >> xdata=xlsread('2011.xls'); >> x1=xdata(1:12,1:3); >> P1=x1'; >> T1 = [repmat([1;0;0],1,4),repmat([0;1;0],1,4),repmat([0;0;1],1,4)]; >> x2=xdata(13:44,1:3); >> P2=x2'; >> T2 = [repmat([1;0;0],1,9),repmat([0;1;0],1,10),repmat([0;0;1],1,13)]d=t123'; %ÇóתÖÃdp=[0.3 30000 0.001];B = int8(d);sizeofp=size(91);sizeft=size(1);[pn,meanp,stdp,tn,meant,stdt]=prestd(91,1);[ptrans,transMat]=prepca(pn,0.001);iitr1=6:3:1;iitr2=[9:3:1 9:3:1 6:3:1 6:3:1 4:3:1];P1=tranbr(:iitr1)P2=tranbr(:iitr2)。

绝对经典RBF神经网络ppt课件

exp

1

2 i 2

X k ti

2

k 1,2,N;i 1,2,, I

该网络为局部逼近网络

RBF网络的工作原理

函数逼近: 以任意精度逼近任一连续函数。一般函数都可表示成一组 基函数的线性组合,RBF网络相当于用隐层单元的输出构 成一组基函数,然后用输出层来进行线性组合,以完成 逼近功能。

分类: 解决非线性可分问题。RBF网络用隐层单元先将非线性可 分的输入空间设法变换到线性可分的特征空间(通常是高 维空间),然后用输出层来进行线性划分,完成分类功能。

j1

举1.问例题:的提R出:B假F设网如下络的输实入现输出函样本数,输逼入向近量为[-1 1] 区间上等间隔的数组成的向量P,相应的期望值向量为T。

P=-1:0.1:1; T=[-0.9602 -0.5770 -0.0729 0.3771 0.6405 0.6600 0.4609 0.1336 -

则扩展常数可取为

3.学权习值权的学值习可以用LMS学习算法

注意:①LMS算法的输入为RBF网络隐含层的输出

②RBF网络输出层的神经元只是对隐含层

神经元的输出加权和。

因此RBF网奇络异的矩实阵际或输非出方为阵Y的n矩阵不GnW n

其中 Y nXAXy=k存Aj ,在AnX逆,Ak矩=X阵1,,2则若, X称, N为; j 1,2, J

用用L伪M逆S方方法法A求求的解解伪pWi逆Wnv阵(n。AG)在1 D求ma伪Wtl逆aDnb中用d1X,n

e

dk

n

,

d

N

T

D为期望响应 G 是矩阵 G的伪逆

伪逆的求法 G G T G 1 G T

matlab教程ppt(完整版)

矩阵减法:两个相同大小 的矩阵可以进行减法运算 ,例如D=A-B。

矩阵的分解与特征值

详细描述

矩阵分解:将一个复杂的矩阵分 解为几个简单的、易于处理的矩 阵,例如LU分解、QR分解等。

特征值:矩阵的特征值是该矩阵 的一个重要的数值属性,可以用 于分析矩阵的性质和特征。

矩阵运算

介绍矩阵的创建、索引、算术 运算和逻辑运算等操作。

控制流

介绍if语句、for循环和while 循环等控制流结构的使用方法 。

02

MATLAB编程

变量与数据类型

01

02

03

变量命名规则

MATLAB中的变量名以字 母开头,可以包含字母、 数字和下划线,但不能包 含空格。

数据类型

MATLAB支持多种数据类 型,如数值型、字符型、 逻辑型和单元数组等。

matlab教程PPT(完整版)

汇报人:可编辑 2023-12-26

目 录

• MATLAB基础 • MATLAB编程 • MATLAB矩阵运算 • MATLAB图像处理 • MATLAB数值分析 • MATLAB应用实例

01

MATLAB基础

MATLAB简介

MATLAB定义

MATLAB应用领域

MATLAB是一种用于算法开发、数据 可视化、数据分析和数值计算的编程 语言和环境。

函数编写

01

02

03

04

函数定义

使用`function`关键字定义函 数,指定输入输出参数。

函数体

在函数定义中编写实现特定功 能的代码。

函数调用

通过函数名和输入参数调用自 定义函数。

神经网络 配套ppt RBF(2)

6

5

RBF网络实现内插问题

• 内插问题(数值逼近)

– 给定样本数据:{p 1, t1} , { p 2, t 2} , …, {p Q, tQ } – 寻找函数,使之满足:ti = F (Pi ) ,1 ≤ i ≤ Q

• RBF网络解决内插问题

– – – – 网络隐层使用Q个隐节点 把所有Q个样本输入分别作为Q个隐节点的数据中心 各基函数取相同的扩展常数 确定权值可解线性方程组:

∑ w radbas( P − P

j =1 j i

j

) = ti

1≤ i ≤ Q

设第j 个隐节点在第i个样本的输出为: = radbas( Pi − Pj ) , rij Rw 可矩阵表示: = t,若R可求逆,则解为:w = R −1t 。 根据Micchelli定理可得,如果隐节点激活函数采用径向基 函数,且P , P2 ,..., PQ 各不相同,则线性方程组有唯一解。 1

RBF网络是个三层结构(R-S1-S2)的前馈网,其中,R代 表输入层并指出输入维数; S1代表由径向基神经元构成的隐 层并指出神经元数目; S2是线性输出层。

4

5

RBF网络结构

• RBF网络层间的连接

– 输入层到隐层之间的权值(数据中心)固定。 – 隐层到输出层之间的权值可调。

5

5

RBF网络工作原理

9

5

正则化方法(改进泛化性能)

– 设有样本数据:{p 1, t1} , { p 2, t 2} , … , {p Q, tQ }, F(P)是逼近函数。 – 传统方法是最小化标准误差项来实现 1 Q E S ( F ) = ∑ (t i − F (Pi )) 2 2 i =1 – 由于从有限样本导出一个函数的解有无穷多个,该问题 是不适定的(ill-posed)。Tikhonov提出了正则化方法来解 决这类问题。就是在标准误差项的基础上,增加一个限 制逼近函数复杂性的项(称为正则化项),即 1 2 E C ( F ) = DF 2 其中,D是线性微分算子,关于解F(p)的形式的先验知识 就包含在其中,即D的选取与所解的问题有关。 D也称为 稳定因子,它使正则化问题的解稳定光滑,从而连续。

MATLAB神经网络工具箱中的神经网络模型共55页课件

阈值向量b(t)

标量元素bi (t ) ,i为行,t为时间或迭代函数

网络层符号

加 个权神和经元: ,nns为mm 加,m权为和第m个网络层, s m 为第

网 个络神层经输元出,a为: a输smm出, m为第m个网络层, s m 为第 s m

p2 2,2

p{2}2(,2)

例:

iw

1 ,1 2 ,3

=

iw{1,1}2(,3)

p1,(k1) p{1,k1}

p2 2,(k 1)p{2,k1 }2()

神经网络工具箱常用函数列表

重要的感知器神经网络函数:

初始化: initp 训练: trainp 仿真: simup 学习规则: learnp

Hardlim x>=0 y=1;x<0 y=0 Hardlims:x>=0 y=1; x<0 y=-1 Purelin :y=x Satlin:x<0 y=0;x>1 y=1;x>=0&&x<=1 y=x;

Logsig:y= 1 1 ex

人工神经网络的构成

单个神经元的功能是很有限的,人工神经 网络只有用许多神经元按一定规则连接构 成的神经网络才具有强大的功能。

MATLAB工具箱中的神经网络结构

多层网络的简化表示:

MATLAB神经网络工具箱中的神经 网络模型

基本概念: 标量:小写字母,如a,b,c等; 列向量:小写黑体字母,如a,b,c等,意为一列

数; 矩阵向量:大写黑体字母,如A,B,C等

权值矩阵向量W(t)

标量元素 wi, j (t) ,i为行,j为列,t为时间或迭代

n

《神经网络与matlab》PPT课件

MATLAB的神经网络工具箱简

介 构造典型神经网络的激活函数,使设计者对所选

网络输出的计算变成对激活函数的调用。 根据各种典型的修正网络权值的规则,再加上网 络的训练过程,利用matlab编写各种网络设计和训练 的子程序。 设计人员可以根据自己的需要去调用工具箱中有 关的设计和训练程序,将自己从繁琐的编程中解脱出 来,提高工作效率。

1. 问题描述

通过对函数进行采样得到了网络的输入变 量P和目标变量T:

P=-1:0.1:1; T=[-0.9602 -0.577. -0.0729 0.3771 0.6405 0.6600 0.4609 0.1336 -0.2013 -0.4344 -0.5000 -0.3930 -0.1647 0.0988 0.3072 0.3960 0.3449 0.1816 -0.0312 -0.2189 -0.3201]

说Байду номын сангаас:

参数TFi可以采用任意的可微传递函数,比如transig, logsig和purelin等; 训练函数可以是任意的BP训练函数,如trainm,trainbfg, trainrp和traingd等。BTF默认采用trainlm是因为函数的速度 很快,但该函数的一个重要缺陷是运行过程会消耗大量的内 存资源。如果计算机内存不够大,不建议用trainlm,而建议 采用训练函数trainbfg或trainrp。虽然这两个函数的运行速度 比较慢,但它们的共同特点是内存占用量小,不至于出现训 练过程死机的情况。

函数类型 输入函数

其它

函数名 称

netsum netprcd concur dotprod

函数用途

输入求和函数 输入求积函数 使权值向量和阈值向量的结构一致 权值求积函数

RBF神经网络:原理详解和MATLAB实现

RBF神经网络:原理详解和MATLAB实现——2020年2月2日目录RBF神经网络:原理详解和MATLAB实现 (1)一、径向基函数RBF (2)定义(Radial basis function——一种距离) (2)如何理解径向基函数与神经网络? (2)应用 (3)二、RBF神经网络的基本思想(从函数到函数的映射) (3)三、RBF神经网络模型 (3)(一)RBF神经网络神经元结构 (3)(二)高斯核函数 (6)四、基于高斯核的RBF神经网络拓扑结构 (7)五、RBF网络的学习算法 (9)(一)算法需要求解的参数 (9)0.确定输入向量 (9)1.径向基函数的中心(隐含层中心点) (9)2.方差(sigma) (10)3.初始化隐含层至输出层的连接权值 (10)4.初始化宽度向量 (12)(二)计算隐含层第j 个神经元的输出值zj (12)(三)计算输出层神经元的输出 (13)(四)权重参数的迭代计算 (13)六、RBF神经网络算法的MATLAB实现 (14)七、RBF神经网络学习算法的范例 (15)(一)简例 (15)(二)预测汽油辛烷值 (15)八、参考资料 (19)一、径向基函数RBF定义(Radial basis function——一种距离)径向基函数是一个取值仅仅依赖于离原点距离的实值函数,也就是Φ(x)=Φ(‖x‖),或者还可以是到任意一点c的距离,c点称为中心点,也就是Φ(x,c)=Φ(‖x-c‖)。

任意一个满足Φ(x)=Φ(‖x‖)特性的函数Φ都叫做径向基函数。

标准的一般使用欧氏距离(也叫做欧式径向基函数),尽管其他距离函数也是可以的。

在神经网络结构中,可以作为全连接层和ReLU层的主要函数。

如何理解径向基函数与神经网络?一些径向函数代表性的用到近似给定的函数,这种近似可以被解释成一个简单的神经网络。

径向基函数在支持向量机中也被用做核函数。

常见的径向基函数有:高斯函数,二次函数,逆二次函数等。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

RBF网络输出 F( pi ) wj( pi cj ) j1

举例:RBF网络实现函数逼近

1.问题的提出:假设如下的输入输出样本,输入向量为[-1 1] 区间上等间隔的数组成的向量P,相应的期望值向量为T。

P=-1:0.1:1; T=[-0.9602 -0.5770 -0.0729 0.3771 0.6405 0.6600 0.4609 0.1336 -0.2013 -0.4344

反演S型函数: r

拟多二次函数:

1

r

1

exp

r2

2

1

r 2 2

1

/

2

σ 称为基函数的扩展常数 或宽度, σ越小,径向基 函数的宽度越小,基函数 就越有选择性。

全局逼近和局部逼近

当神经网络的一个或多个可 调参数(权值和阈值)对任何 一个输出都有影响,则称该 神经网络为全局逼近网络。

全局逼近网络 学习速度很慢,无法满足实时性要求的应用

Q

wjG( pi p j ) ti 1 i Q

j 1

设第j 个隐节点在第i个样本的输出为:ij G( pi p j )

可矩阵表示:W T,若R可逆,则解为 W 1T

根据Micchelli定理可得,如果隐节点激活函数采用 径向基函数,且p1, p2 ,..., pQ 各不相同,则线性方程组 有唯一解。

①给定样本数据

P {p1, p2 pi pQ},

②寻找函数,使其满足:ti F( pi )

T {t1,t2 ti

1i Q

tQ}

G( P C1

p1

p2

G( P C2

w2w1

F P

pQ

wQ

G( P CQ )

1.网络隐层使用Q个隐节点。 2.把所有Q个样本输入分别作为Q个隐节点的中心。 3.各基函数取相同的扩展常数。 4.确定权值可解线性方程组:

分类: 解决非线性可分问题。RBF网络用隐层单元先将非线性可 分的输入空间设法变换到线性可分的特征空间(通常是高 维空间),然后用输出层来进行线性划分,完成分类功能。

RBF神经网络两种模型

正规化网络RN 通用逼近器

基本思想: 通过加入一个含有解的先验知识的约束来 控制映射函数的光滑性,若输入一输出映射 函数是光滑的,则重建问题的解是连续的, 意味着相似的输入对应着相似的输出。

题。 局部逼近网络(MLP是全局逼近网络),这意味着逼近一个输

入输出映射时,在相同逼近精度要求下,RBF所需的时间要 比MLP少。 具有唯一最佳逼近的特性,无局部极小。 合适的隐层节点数、节点中心和宽度不易确定。

径向基函数(RBF)

1.

Gauss(高斯)函数:r

exp

r2

2 2

2. 3.

局部逼近网络 学习速度快,有可能满足有实时性要求的应用

对网络输入空间的某个局 部区域只有少数几个连接 权影响网络的输出,则称

该网络为局部逼近网络

RBF网络的工作原理

函数逼近: 以任意精度逼近任一连续函数。一般函数都可表示成一组 基函数的线性组合,RBF网络相当于用隐层单元的输出构 成一组基函数,然后用输出层来进行线性组合,以完成 逼近功能。

径向基函数 取统一的扩展定

没有设置阈值

输出函数的线性中包含阈值参数, 用于补偿基函数在样本集上的

平均值与目标值之平均值之间的差别。

函数逼近问题(内插值)

一般函数都可表示成一组基函数的线性组合,

RBF网络相当于用隐层单元的输出构成一组基函数,

然后用输出层来进行线性组合,以完成逼近功能。

grid on

% 应用newb()函数可以快速构建一个径向基神经网络,并且网络自动根据输入向量和期望值 进行调整,从而进行函数逼近,预先设定均方差精度为eg以及散布常数sc。 eg=0.02; sc=1; net=newrb(P,T,eg,sc);

3.网络测试:将网络输出和期望值随输入向量变化 的曲线绘制在一张图上,就可以看出网络设计是 否能够做到函数逼近。

2.网络设计:设计一个径向基函数网络,网络有两层,隐含层 为径向基神经元,输出层为线性神经元。

p=-3:0.1:3; a=radbas(p); figure; plot(p,a) title('径向基传递函数') xlabel('输入p') ylabel('输出a')

grid on

% 每一层神经元的权值和阈值都与径向基函数的位置和宽度有关系,输出层的线性神经元将 这些径向基函数的权值相加。如果隐含层神经元的数目足够,每一层的权值和阈值正确, 那么径向基函数网络就完全能够精确的逼近任意函数。

-0.5000 -0.3930 -0.1647 0.0988 0.3072 0.3960 0.3449 0.1816 -0.0312 -0.2189 -0.3201]; %以输入向量为横坐标,期望值为纵坐标,绘制训练用样本的数据点。 figure; plot(P,T,'+') title('训练样本') xlabel('输入矢量P') ylabel('目标矢量T') grid on %目的是找到一个函数能够满足这21个数据点的输入/输出关系,其中一个方法是通 过构建径向基函数网络来进行曲线拟合

广义网络GN

模式分类

基本思想: 用径向基函数作为隐单元的“基”,构成隐含 层空间。隐含层对输入向量进行变换,将低维 空间的模式变换到高维空间内,使得在低维 空间内的线性不可分问题在高维空间内线性可分。

两种模型的比较

RN

隐节点=输入样本数

所有输入样本设为 径向基函数的中心

GN

隐节点<输入样本数

径向基函数的中心 由训练算法确定

RBF网络特点

只有一个隐层,且隐层神经元与输出层神经元的模型不同。 隐层节点激活函数为径向基函数,输出层节点激活函数为线

性函数。 隐层节点激活函数的净输入是输入向量与节点中心的距离

(范数)而非向量内积,且节点中心不可调。 隐层节点参数确定后,输出权值可通过解线性方程组得到。 隐层节点的非线性变换把线性不可分问题转化为线性可分问

a2=radbas(p-1.5); a3=radbas(p+2); a4=a+a2*1+a3*0.5; figure; plot(p,a,'b-',p,a2,'b-',p,a3,'b-',p,a4,'m--'); title('径向基传递函数之和') xlabel('输入p') ylabel('输出a')