3个径向基网络的matlab源程序

MATLAB径向基神经网络函数

众所周知,BP网络用于函数逼近时,权值的调节采用的是负梯度下降法。

这个调节权值的方法有局限性,即收敛慢和局部极小等。

径向基函数网络(RBF)在逼近能力、分类能力和学习速度等方面均优于BP 网络。

Matlab中提供了四个径向基函数相关的函数,它们都是创建两层的神经网络,第一层都是径向基层,第二层是线性层或者竞争层。

主要的区别是它们权值、阀值就算函数不同或者是否有阀值。

注意:径向基函数网络不需要训练,在创建的时候就自动训练好了。

= newrbe(P,T,spread)newrbe()函数可以快速设计一个径向基函数网络,且是的设计误差为0。

第一层(径向基层)神经元数目等于输入向量的个数,加权输入函数为dist,网络输入函数为netprod;第二层(线性层)神经元数模有输出向量T确定,加权输入函数为dotprod,网络输入函数为netsum。

两层都有阀值。

第一层的权值初值为p',阀值初值为0.8326/spread,目的是使加权输入为±spread时径向基层输出为0.5,阀值的设置决定了每一个径向基神经元对输入向量产生响应的区域。

2.[net,tr] = newrb(P,T,goal,spread,MN,DF)该函数和newrbe一样,只是可以自动增加网络的隐层神经元数模直到均方差满足精度或者神经元数模达到最大为止。

P=-1:0.1:1;T=sin(P);spread=1;mse=0.02;net=newrb(P,T,mse,spread);t=sim(net,P);plot(P,T,'r*',P,t) = newgrnn(P,T,spread)泛回归网络(generalized regression neural network)广义回归网络主要用于函数逼近。

它的结构完全与newbre的相同,但是有以下几点区别(没有说明的表示相同):(1)第二网络的权值初值为T(2)第二层没有阀值(3)第二层的权值输入函数为normpod,网络输入函数为netsum>> P=0:1:20;>> T=exp(P).*sin(P);>> net=newgrnn(P,T,0.7);>> p=0:0.1:20;>> t=sim(net,p);>> plot(P,T,'*r',p,t) = newpnn(P,T,spread)概率神经网络(probabilistic neural network)该网络与前面三个最大的区别在于,第二层不再是线性层而是竞争层,并且竞争层没有阀值,其它同newbre,故PNN网络主要用于解决分类问题。

matlab中three-phase pi section line数学模型 -回复

matlab中three-phase pi section line数学模型-回复什么是三相pi section line,如何对其进行数学建模以及如何使用MATLAB进行这些计算。

1. 什么是三相pi section line?三相pi section line是一种常见的电机驱动系统电路,主要由三个电阻和三个电容组成。

它主要用于控制三相交流电机的供电,使其输出不同的功率。

三相pi section line可以通过调节电容和电阻的值来改变输出功率的大小,以满足驱动不同负载的需求。

2. 如何对三相pi section line进行数学建模?对于三相pi section line,其数学模型可以通过电路方程来描述。

我们可以使用基尔霍夫电压定律和基尔霍夫电流定律来建立电路方程,在此基础上求解未知电流和电压。

具体来说,我们可以将三相pi section line电路分为两部分:输入部分和输出部分。

输入部分包括三个电源,每个电源对应一个相位,通常会使用60度相位差。

输出部分包括三个电容和三个电阻,每个电容和电阻都与一个相位对应。

对于输入部分,我们可以写出如下电压方程:V1 = V*cos(wt)V2 = V*cos(wt - 120)V3 = V*cos(wt + 120)其中V表示输入电压的峰值,wt表示角频率,一般为2*pi*f,f表示频率。

根据基尔霍夫电流定律,我们可以将输出部分的电流表达为:I1 = (V1 - Vi) / (R1 + 1 / (w*C1))I2 = (V2 - Vi) / (R2 + 1 / (w*C2))I3 = (V3 - Vi) / (R3 + 1 / (w*C3))其中Ri和Ci分别表示第i个电阻和电容的阻抗值,Vi表示输出部分电容的电压。

现在我们需要求解未知电压Vi和电流Ii。

我们可以使用基尔霍夫电压定律,得到如下方程组:Vi - V1 = Vc1Vi - V2 = Vc2Vi - V3 = Vc3其中Vci表示第i个电容器的电压。

第1章 MATLAB R2015b环境

(5)图像处理工具箱(Image Processing Toolbox):主要应用于二维滤波器 设计和滤波输入,图像恢复增强,色彩、集合及形态操作,二维变换,图像分析和 统计等。 (6)优化工具箱(Optimization Toolbox):主要应用于线性规划和二次规划, 求函数的最大值和最小值,多目标优化,约束条件下的优化,非线性方程求解等。 (7)统计工具箱(Statistics Toolbox):主要应用于概率分布和随机数生成, 多变量分析,回归分析,主极分析,假设检验等。 (8)符号数学工具箱(Symbolic Math Toolbox):主要实现符号运算,包括 极限、微积分、符号方程等。

(6)“RESOURCES”区工具栏 “RESOURCES”区工具栏主要是对MATLAB的资源管理,包括帮助资料 “Help”、网上社区资料“Community”和需求支持资料“Request Support”。

2. 绘图面板工具栏 在图1.1中选择面板“PLOTS”则切换到绘图面板,当工作空间创建了变量 “a”时工具栏如图1.3所示。

新建一个仿真模型 新建一个流程表 新建一个Simulink项目 新建一个M脚本文件,打开M文件编辑/调试器 打开已有文件 打开查找文件对话框查找文件 比较两个文件的内容

(2)“VARIABLE”区工具栏 “VARIABLE”区工具栏主要是对变量的操作,各按钮的常用功能如表1.2所示。

下拉菜单 Save Workspace New Variable Open Variable Clear Variable 功 能 使用二进制的MAT文件保存工作空间的内容 创建新变量 打开工作空间中已经创建的变量,单击下拉箭头选择工作空间的变量 清空工作空间的变量,单击下拉箭头选择变量和函数

一些matlab网址

下载安装:【原创】Matlab7.x教育网神速下载,绝对有效/thread-752-1-1.html【原创】Matlab2009a(7.8)安装图解教程及下载/thread-2083-1-2.html【原创】Matlab初始化initializing极慢解决方法/thread-598-1-1.html【原创】MATLAB Toolbox Path Cache is out of date 解决方法/thread-467-1-1.html【原创】符号工具箱Unable to initialize kernel的解决方法/thread-923-1-1.html【原创】Matlab2008a/b安装图解教程和常见问题解答/thread-472-1-2.html【原创】Linux系统下安装Matlab2008a指南/thread-470-1-2.html【原创】AMD上安装Matlab,预处理器兼容性配置/thread-473-1-3.html基础应用:【原创】Matlab中动画的实现、制作和保存/thread-592-1-1.html 【原创】代数方程的MATLAB求解详解/thread-2213-1-1.html 【原创】Matlab教学实验常见问题反馈(by dsj6700417)/thread-2070-1-2.html【原创】Matlab中常用的一些帮助查询命令使用说明/thread-707-1-9.html【原创】Matlab绘图什么时候会自动刷新屏幕/thread-702-1-9.html【原创】Matlab中日期处理和程序运行时函数详解/thread-524-1-9.html【原创】Matlab中数组元素的引用方法和讨论/thread-357-1-9.html【原创】数组、矩阵和向量等几个概念的区别和讨论/thread-356-1-9.html数学运算:【原创】微分方程(ODEs/PDEs)的Matlab求解详解和汇总/thread-526-1-1.html【原创】数值分析&计算方法在Matlab中的实现汇总/thread-265-1-1.html【原创】Lyapunov、Sylvester和Riccati方程的Matlab求解/thread-539-1-19.html【原创】线性/非线性方程(组)的MATLAB解法汇总/thread-607-1-19.html【原创】差分方程(递推关系式)的Matlab求解/thread-717-1-19.html【原创】Matlab中如何实现任意位置圆柱的绘制/thread-362-1-19.html【原创】Matlab中如何实现二维和三维隐函数绘图/thread-361-1-19.html【原创】Hermite插值的实现及各段系数的提取/thread-358-1-15.html【原创】Matlab中分段函数相关运算的实现/thread-266-1-12.html【原创】Matlab中几个数值积分函数的比较和优缺点/thread-359-1-9.html【原创】傅里叶级数(fourier series)展开的Matlab实现/thread-249-1-3.html【原创】线性方程组的Matlab解法/thread-550-1-2.html 【讨论】Matlab模拟一个星期至少有3天以上下雨的概率/thread-1144-1-15.html【源码】Matlab求解微分方程简单算例/thread-289-1-2.html 【源码】拟蒙特卡洛方法(Quasi-Monte Carlo)积分实例/thread-673-1-1.htmlGUI开发:/search. ... mp;searchsubmit=yes优化&拟合:/search. ... mp;searchsubmit=yes统计概率:/search. ... mp;searchsubmit=yes扩展编程:/search. ... mp;searchsubmit=yes其他应用:【原创】MATLAB多线程实时工具——Timer对象/thread-646-1-1.html控制系统:【原创】线性矩阵不等式(LMI)在Matlab中的实现和讲解/thread-535-1-1.html【原创】滑模变结构控制系统设计与分析/thread-900-1-3.html 【书籍】《kalman Filtering:Theory And Practice Using Matlab》/thread-2509-1-1.html【讲义】自动控制理论实验指导书/thread-1837-1-1.html【讲义】潘天红《Matlab using》ppt讲义——SJTU图像处理:【原创】Matlab环境下使用USB2.0摄像头编程/thread-893-1-1.html【源码】图像预处理——字符识别实例(I&II)/thread-498-1-2.html【源码】Face Detection System(基于神经网络的脸部识别系统)/thread-499-1-3.html【源码】癌细胞形态学分析Matlab源代码/thread-577-1-1.html资料来源:/forum.php?mod=viewthread&tid=2515&page=1#pid32606。

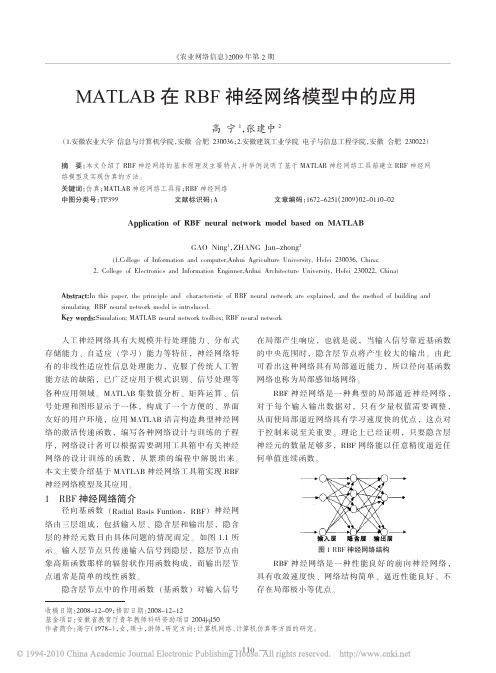

MATLAB在RBF神经网络模型中的应用

MATLAB 在RBF 神经网络模型中的应用高宁1,张建中2(1.安徽农业大学信息与计算机学院,安徽合肥230036;2.安徽建筑工业学院电子与信息工程学院,安徽合肥230022)摘要:本文介绍了RBF 神经网络的基本原理及主要特点,并举例说明了基于MATLAB 神经网络工具箱建立RBF 神经网络模型及实现仿真的方法。

关键词:仿真;MATLAB 神经网络工具箱;RBF 神经网络中图分类号:TP399文献标识码:A文章编码:1672-6251(2009)02-0110-02Application of RBF neural network model based on MATLABGAO Ning 1,ZHANG Jan-zhong 2(1.College of Information and computer,Anhui Agriculture University,Hefei 230036,China;2.College of Electronics and Information Enginner,Anhui Architecture University,Hefei 230022,China)Abstract:In this paper,the principle and characteristic of RBF neural network are explained,and the method of building and simulating RBF neural network model is introduced.Key words:Simulation;MATLAB neural network toolbox;RBF neural network人工神经网络具有大规模并行处理能力、分布式存储能力、自适应(学习)能力等特征,神经网络特有的非线性适应性信息处理能力,克服了传统人工智能方法的缺陷,已广泛应用于模式识别、信号处理等各种应用领域。

神经网络计算-建模讲义解析

去生成80个训练样本、25个检测样本进行实验。训练样本 精度达到95%左右,而检验样本精度在65-80%之间.

-

71

作业

设计一个 BP 网络对上图中的英文字母进行分类。输入 向量含1 2 个分量,输出单元个数取1,分别用-1、0和1代 表字符A、I、O。训练时可选择不同的隐节点数及不同的 学习率进行对比。

-

60

活化函数 • Sigmoid函数

gx 1

1exp(x) -

fxtanh(x)

61

双曲正切函数

• 表达式:

tanh(x)

eexx

ex ex

.

• 图像

-

62

Sigmoid函数特点

• 光滑, 单调递增,上、下有界(称为饱和性). • 导数值可由其函数值给出

gx 1- g(x) g(x);

模式识别、函数逼近和数据压缩等问题。

返回

-

8

人工神经网络的结构

具有一个隐层的前馈网络 单层全连接反馈网络

-

9

神经网络的特性

• 鲁棒性(容错) • 并行计算 • 自我学习 • 硬件实现 • 求满意解

-

10

神经网络的三要素

• 网络结构; • 信息流动规则; • 权值学习规则。

-

11

神经网络的学习方式

输入样本向量预处理

• 输入样本向量的各个分量有时在数量级上

差异较大,若不进行适当的处理,数量级 大的分量可能完全湮没其它分量的作用。 为此在训练开始之前,需对各个分量做相 应的调整,使其具有大致相同的数量级。

-

59

输入样本向量预处理

matlab调用高斯核函数 -回复

matlab调用高斯核函数-回复Matlab是一种高效、强大的科学计算软件工具,具有广泛的应用领域。

在机器学习领域中,常常需要使用高斯核函数进行模型的训练和预测。

本文将逐步介绍如何在Matlab中调用高斯核函数,并解释其原理和应用。

第一步:了解高斯核函数高斯核函数,也被称为径向基函数(Radial Basis Function,RBF),是一种常用的核函数。

核函数是一种在机器学习中广泛应用的数学工具,用于将输入数据从原始空间映射到一个更高维度的特征空间。

高斯核函数的表达式为:K(x, y) = exp(- x-y ^2 / (2 * sigma^2))其中,x和y是输入样本,x-y ^2表示欧几里得距离的平方,sigma^2为高斯核函数的参数。

高斯核函数的核心思想是通过计算输入样本与训练样本之间的相似度,来评估它们之间的相关性。

相似度越高,相关性就越强。

高斯核函数的输出结果在0到1之间,可以表示样本之间的相似度或相关性。

第二步:在Matlab中定义高斯核函数在Matlab中,可以通过定义一个函数来实现高斯核函数的计算。

下面是一个例子:matlabfunction K = gaussian_kernel(x, y, sigma)K = exp(-norm(x-y)^2 / (2 * sigma^2));end上述代码中,我们定义了一个名为gaussian_kernel的函数,它接受两个输入样本x和y,以及高斯核函数的参数sigma。

函数的输出结果是它们之间的相似度。

在函数体内,我们使用了Matlab内置函数norm来计算输入样本之间的欧几里得距离。

第三步:使用高斯核函数进行模型训练在机器学习中,高斯核函数常被用于支持向量机(Support Vector Machine,SVM)的训练过程。

SVM是一种二分类模型,通过寻找一个最优超平面来分割不同类别的样本。

高斯核函数可以用于在非线性可分的情况下,将样本映射到一个更高维度的特征空间,从而增加了模型的表达能力。

神经网络及深度学习(包含matlab代码)

f ( x)

1 1 e Qx

(2.3)

它反映了神经元的饱和特性。 上式中, Q 为表示神经元非线性的参数, 称增益值(Gain), 也称调节参数。 Q 值越大, S 形曲线越陡峭; 反之, Q 值越小, S 形曲线越平坦; 一般取 Q=1。 (b)双曲正切激励函数,一般取为(-1,1)内连续取值:

神经网络及深度学习

(包含 MATLAB 仿真) 人工神经网络(Artificial Neural Network,即 ANN ) ,作为对人脑最简单的一种抽象和 模拟,是人们模仿人的大脑神经系统信息处理功能的一个智能化系统,是 20 世纪 80 年代 以来人工智能领域兴起的研究热点。 人工神经网络以数学和物理方法以及信息处理的角度对 人脑神经网络进行抽象, 并建立某种简化模型, 旨在模仿人脑结构及其功能的信息处理系统。 人工神经网络最有吸引力的特点就是它的学习能力。因此从 20 世纪 40 年代人工神经 网络萌芽开始, 历经两个高潮期及一个反思期至 1991 年后进入再认识与应用研究期, 涌现 出无数的相关研究理论及成果, 包括理论研究及应用研究。 最富有成果的研究工作是多层网 络 BP 算法,Hopfield 网络模型,自适应共振理论,自组织特征映射理论等。因为其应用价 值, 该研究呈愈演愈烈的趋势, 学者们在多领域中应用人工神经网络模型对问题进行研究优 化解决。 人工神经网络是由多个神经元连接构成,因此欲建立人工神经网络模型必先建立人工 神经元模型,再根据神经元的连接方式及控制方式不同建立不同类型的人工神经网络模型。 一、人工神经元及神经网络 1.1 人工神经元模型 仿生学在科技发展中起着重要作用,人工神经元模型的建立来源于生物神经元结构的 仿生模拟,用来模拟人工神经网络。人们提出的神经元模型有很多,其中最早提出并且影响 较大的是 1943 年心理学家 McCulloch 和数学家 W. Pitts 在分析总结神经元基本特性的基础上 首先提出的 MP 模型。该模型经过不断改进后,形成现在广泛应用的 BP 神经元模型。人工 神经元模型是由人量处理单元厂泛互连而成的网络,是人脑的抽象、简化、模拟,反映人脑 的基本特性。一般来说,作为人工神经元模型应具备三个要素: (1) 具有一组突触或连接,常用 wij 表示神经元 i 和神经元 j 之间的连接强度。 (2) 具有反映生物神经元时空整合功能的输入信号累加器 。 (3) 具有一个激励函数 f 用于限制神经元输出。激励函数将输出信号限制在一个允许 范围内。 一个典型的人工神经元模型如图 1-11-1 所示。

nsga-ⅲ算法matlab代码及注释

nsga-ⅲ算法matlab代码及注释一、NSGA-Ⅲ算法简介NSGA-III算法是多目标优化领域的一种经典算法,它是基于非支配排序的遗传算法。

该算法通过模拟自然选择的过程,不断改进种裙中的个体,以寻找Pareto前沿上的最优解。

NSGA-III算法在解决多目标优化问题方面表现出色,广泛应用于工程、经济和管理等领域。

二、代码实现下面是NSGA-III算法的Matlab代码示例,包含了代码的注释和解释。

```matlab初始化参数pop_size = 100; 种裙大小max_gen = 100; 最大迭代次数p_cross = 0.8; 交叉概率p_mut = 0.1; 变异概率n_obj = 2; 目标函数数量初始化种裙pop = initialization(pop_size);进化过程for gen = 1:max_gen非支配排序和拥挤度距离计算[fronts, cd] = non_dominated_sort(pop);种裙选择offspring = selection(pop, fronts, cd, pop_size);交叉和变异offspring = crossover(offspring, p_cross);offspring = mutation(offspring, p_mut);合并父代和子代种裙pop = merge_pop(pop, offspring, pop_size);end结果分析pareto_front = get_pareto_front(pop);plot_pareto_front(pareto_front);```三、代码解释1. 初始化参数:设置种裙大小、最大迭代次数、交叉概率、变异概率和目标函数数量等参数。

2. 初始化种裙:调用初始化函数,生成初始的种裙个体。

3. 进化过程:在每一代中,进行非支配排序和拥挤度距离计算,然后进行种裙选择、交叉和变异操作,最后合并父代和子代种裙。

RBF神经网络在智能传感器模块设计中的应用

其 中 : . 网络 隐层 第 i 神经元的总输 入 ; . 第 i n为 个 b为 个 神经元的偏置值 ;0 9 为隐层权值矩 阵的第 i 个行 向量的 第j 个元素 ; ; 第 i P是 ; 个输入向量的 j 时刻输入值 。

R F神 经网络的输出层通常是纯线性神经 元 ,只是其 B

的特征输 入点 ,那 么其对 应的输 出应趋 于 1;2) ( 对于 非

样 本点输 入 ,输入与特征 输入 的点距离越远 ,则神经元 的 输 出越小 。 因此 , B R F神经网络 的输入权值是 由样本决定的 ,

而 与期望输 出并没有太大关系 。

R 神 经 网络Malb 程 序 BF t 源 a

O5 . 0

60 .

6O . 7O .

2 . 50

2 . 5O 2 . 5O

06 .

O6 . O7 .

56 .2

56 .2 65 .6

22 2 .3

28 9 .1 03 1 .2

8

9

01 .

02 .

70 .

70 .

2 . 50

2 . 5O

个) 传感 器系统 ; 若欲消 除 n 个干 扰量 的影响 ,则 需测量

n 1个参量的多 (+ 个 ) + n1 传感 器系统。 人工 神经网络具有较 强的非线性 映射 能力 、较好 的学 习和容错能 力 ,在 函数逼近 、预测 、信号处理 、控制系统 领域 中得到广泛 的应用 。径 向基 ( BF 神经 网络是 一种典 R ) 型 的性 能 良好的三层前馈 局部人工 神经网络 ,具有 较快 的 训练速 度和 非线性能 力 ,能以任意精 度全局逼迫 一个非线 性 函数 ,使 其在 很 多领 域得 到 广泛 应 用。本 文 采用 R F B 神 经网络 ,监测干扰 量温度 T的温度传感器的输 出电压为 U ,监测干扰量恒流源供 电电流 I 电流传感器的输 出电压 T 的 u ,改善压 阻式 压力 传感器 (C -0 ) . J Y 2 1 的温 度稳定 性与 恒

matlab各工具箱功能简介(部分)

Toolbox工具箱序号工具箱备注一、数学、统计与优化1Symbolic Math Toolbox符号数学工具箱Symbolic Math Toolbox™提供用于求解和推演符号运算表达式以及执行可变精度算术的函数。

您可以通过分析执行微分、积分、化简、转换以及方程求解。

另外,还可以利用符号运算表达式为MATLAB®、Simulink®和Simscape™生成代码。

Symbolic Math Toolbox 包含MuPAD®语言,并已针对符号运算表达式的处理和执行进行优化。

该工具箱备有MuPAD 函数库,其中包括普通数学领域的微积分和线性代数,以及专业领域的数论和组合论。

此外,还可以使用MuPAD 语言编写自定义的符号函数和符号库。

MuPAD 记事本支持使用嵌入式文本、图形和数学排版格式来记录符号运算推导。

您可以采用HTML 或PDF 的格式分享带注释的推导。

2Partial Differential Euqation Toolbox偏微分方程工具箱偏微分方程工具箱™提供了用于在2D,3D求解偏微分方程(PDE)以及一次使用有限元分析。

它可以让你指定和网格二维和三维几何形状和制定边界条件和公式。

你能解决静态,时域,频域和特征值问题在几何领域。

功能进行后处理和绘图效果使您能够直观地探索解决方案。

你可以用偏微分方程工具箱,以解决从标准问题,如扩散,传热学,结构力学,静电,静磁学,和AC电源电磁学,以及自定义,偏微分方程的耦合系统偏微分方程。

3Statistics Toolbox统计学工具箱Statistics and Machine Learning Toolbox 提供运用统计与机器学习来描述、分析数据和对数据建模的函数和应用程序。

您可以使用用于探查数据分析的描述性统计和绘图,使用概率分布拟合数据,生成用于Monte Carlo 仿真的随机数,以及执行假设检验。

回归和分类算法用于依据数据执行推理并构建预测模型。

(完整版)PNN神经网络聚类法

目录摘要 01概率神经网络 01。

1网络模型 01.2分类思想 (1)1。

3 PNN分类的优点 (2)2 PNN网络的构建 (3)2.1 构建步骤 (3)2.2 Matlab中的主要代码 (3)3 Matlab编程及结果分析 (4)3。

1 Matlab中的编程 (4)3.2 仿真结果分析 (8)3。

3 结论 (12)4 总结 (12)参考文献 (13)PNN神经网络聚类法摘要近几年来,对于神经网络的研究越来越普遍,神经网络在我们社会生活中的作用也越来越不可替代,尤其在模式识别的领域里,更是有着举足轻重的作用。

酒是由多种成分按不同的比例构成的,兑酒时需要三种原料(X,Y,Z),现在已测出不同酒中三种原料的含量,本文正是基于PNN神经网络针对酒中X、Y、Z三种含量的不同来对酒进行识别分类。

本文首先介绍了PNN神经网络的网络模型以及它对不同的模式进行分类判别的思想,然后针对本文的酒类判别的要求来构建PNN网络,并在Matlab中进行编程仿真,最后对所仿真的结果进行了分析比较,最后找出最优的模式分类。

1概率神经网络概率神经网络(Probabilistic Neural Networks,PNN)是由D。

F。

Specht在1990年提出的.主要思想是用贝叶斯决策规则,即错误分类的期望风险最小,在多维输入空间内分离决策空间。

它是一种基于统计原理的人工神经网络,它是以Parzen窗口函数为激活函数的一种前馈网络模型。

PNN吸收了径向基神经网络与经典的概率密度估计原理的优点,与传统的前馈神经网络相比,在模式分类方面尤其具有较为显著的优势.1。

1网络模型PNN的结构如图1所示,共由四层组成。

图1 概率神经网络结构概率神经网络PNN 是径向基网络的一个分支,是前馈网络的一种.它是一种有监督的网络的分类器,基于概率统计思想,由Bayes 分类规则构成,采用Parzen窗函数密度估计方法估算条件概率,进行分类模式识别.PNN 的结构模型如图,共分四层:输入层、样本层(又称模式层)、求和层和决策层(又称竞争层输出层).对应网络输入X=[x1,x2,…xm ]T ,其输出为Y=[y1,y2,…,yL ]T ,输入向量为m ,待匹配的类别数为L 。

matlab径向基函数

matlab径向基函数Matlab中的径向基函数(RBF)是一种非常有用的数学工具,它在机器学习、数据挖掘和模式识别等领域中被广泛应用。

本文将详细介绍Matlab中径向基函数的定义、原理、实现以及应用。

一、定义径向基函数是一种基于距离的函数,可以将一个点映射到一个高维空间。

在Matlab中,常见的径向基函数包括高斯函数、多项式函数、细胞函数等等。

高斯函数最常用,定义如下:$$\phi_j(x)=exp(-\frac{\parallel x-x_j\parallel^2}{2\sigma_j^2})$$$x$是数据点,$x_j$是高斯函数的中心点,$\sigma_j$是高斯函数的带宽。

根据高斯函数的定义,带宽越小,函数在中心点处的值就越大,函数在中心点附近的值也会更大,但是随着距离的增加,函数值会急剧下降;带宽越大,函数在中心点处的值就越小,函数在中心点附近的值也会更小,但是随着距离的增加,函数值会缓慢下降。

二、原理径向基函数的原理是基于距离的概念,即同类样本之间的距离相对较小,而不同类样本之间的距离相对较大。

在分类或聚类任务中,将样本点映射到高维空间,利用高斯函数或其他径向基函数完成对样本点的聚类或分类。

三、实现在Matlab中,实现径向基函数可以采用以下步骤:1.读取数据集可以采用读取csv文件、Excel文件等方式获取数据集。

在本文中,我们使用Matlab自带的鸢尾花数据集(Iris)进行演示。

2.选择使用的径向基函数本文采用高斯函数,即:$$\phi_j(x)=exp(-\frac{\parallel x-x_j\parallel^2}{2\sigma_j^2})$$3.计算高斯函数参数可以采用层次聚类(hierarchical clustering)、K-means聚类等方法,计算高斯函数的中心点和带宽。

4.计算径向基函数矩阵根据高斯函数的定义,可以根据数据集、高斯函数中心点和带宽计算径向基函数矩阵,具体方法如下:```matlabfunction Gaussian_RBF_Matrix =Gaussian_RBF(dataPoints,numberOfCenters,Gaussian_RBF_Radii)randomIndexs = randperm(size(dataPoints,1));dataPoints = dataPoints(randomIndexs,:); %shuffle datapointscenters = datasample(dataPoints,numberOfCenters); % selects numberOfCenters number of centers at randomdistances = pdist2(dataPoints,centers);Gaussian_RBF_Matrix = exp(-((distances./Gaussian_RBF_Radii).^2));end````dataPoints`是数据集,`numberOfCenters`是高斯函数中心点的数量,`Gaussian_RBF_Radii`是高斯函数的带宽。

(完整版)基于SVM的齿轮箱轴承故障诊断(含matlab程序)

基于支持向量机(SVM)的齿轮箱轴承故障识别一、轴承故障诊断1、概述轴承是旋转设备的一个重要部件,它提供重要的负载承受能力,以支撑转子系统抵抗静态的和动态的外力。

轴承构件,由于它的使用寿命长、负载能力高、能量损失低而被广泛应用于工业和公用设施,是大型机械装备(包括动力机械、机车车辆、泵与风机等)中的关键部件。

高速运转的大型机械装备,其轴承的载荷重且为交变载荷,而且工作环境恶劣,经常发生轴承性能劣化和损坏,影响整个装置的安全可靠性,一旦出现故障将导致严重的损失,有必要对轴承工作状态进行模式识别与诊断。

轴承根据工作的摩擦性质不同可分为滑动摩擦轴承(简称滑动轴承)和滚动摩擦轴承(简称滚动轴承)两大类。

本文所测得的数据来自实验室齿轮箱的滑动轴承,滑动轴承的特点有:(1)在高速重载下能正常工作,寿命长。

(2)精度高。

(3)滑动轴承可做成剖分式的,能满足特殊结构的需要。

(4)液体摩擦轴承具有很好的缓冲和阻尼作用,可以吸收震动,缓和冲击。

(5)滑动轴承的径向尺寸比滚动轴承的小。

(6)起动摩擦阻力较大。

通过对轴承进行故障诊断有以下优势:(1)早期预报、防止事故发生,降低事故发生率;(2)预知性维修,提高设备管理水平,降低维修费用,减少维修时间,增加运行时间;(3)提高设备的设计、制造水平,改进产品质量;(4)确定复杂机器的最佳工作参数,提高效率;(5)降低噪声,泄露等污染,保护环境。

2、滑动轴承失效形式(1)磨粒磨损进入轴承间隙的硬颗粒(如灰尘、砂粒等),在起动、停车或轴颈与轴承发生边缘接触时,都将加剧轴承磨损,导致几何形状改变、精度丧失,轴承间隙加大,使轴承性能在预期寿命前急剧恶化。

(2)刮伤进入轴承间隙中的硬颗粒或轴颈表面粗糙的轮廓峰顶,在轴承上划出线状伤痕,导致轴承因刮伤失效。

(3)咬合(胶合)当轴承温升过高,载荷过大,油膜破裂时,或在润滑油供应不足条件下,轴颈和轴承的相对运动表面材料发生粘附和迁移,从而造成轴承损坏。

Matlab源程序代码

正弦波的源程序:(一),用到的函数1,f2t函数function x=f2t(X)global dt df t f T N%x=f2t(X)%x为时域的取样值矢量%X为x的傅氏变换%X与x长度相同并为2的整幂%本函数需要一个全局变量dt(时域取样间隔) X=[X(N/2+1:N),X(1:N/2)];x=ifft(X)/dt;end2,t2f函数。

function X=t2f(x)global dt df N t f T%X=t2f(x)%x为时域的取样值矢量%X为x的傅氏变换%X与x长度相同,并为2的整幂。

%本函数需要一个全局变量dt(时域取样间隔) H=fft(x);X=[H(N/2+1:N),H(1:N/2)]*dt;end(二),主程序。

1,%(1)绘出正弦信号波形及频谱global dt df t f Nclose allk=input('取样点数=2^k, k取10摆布');if isempty(k), k=10; endf0=input('f0=取1(kz)摆布');if isempty(f0), f0=1; endN=2^k;dt=0.01; %msdf=1/(N*dt); %KHzT=N*dt; %截短期Bs=N*df/2; %系统带宽f=[-Bs+df/2:df:Bs]; %频域横坐标t=[-T/2+dt/2:dt:T/2]; %时域横坐标s=sin(2*pi*f0*t); %输入的正弦信号S=t2f(s); %S是s的傅氏变换a=f2t(S); %a是S的傅氏反变换a=real(a);as=abs(S);subplot(2,1,1) %输出的频谱plot(f,as,'b');gridaxis([-2*f0,+2*f0,min(as),max(as)])xlabel('f (KHz)')ylabel('|S(f)| (V/KHz)') %figure(2)subplot(2,1,2)plot(t,a,'black') %输出信号波形画图gridaxis([-2/f0,+2/f0,-1.5,1.5])xlabel('t(ms)')ylabel('a(t)(V)')gtext('频谱图')最佳基带系统的源程序:(一),用到的函数f2t函数和t2f函数。

RBF神经网络:原理详解和MATLAB实现

RBF神经网络:原理详解和MATLAB实现——2020年2月2日目录RBF神经网络:原理详解和MATLAB实现 (1)一、径向基函数RBF (2)定义(Radial basis function——一种距离) (2)如何理解径向基函数与神经网络? (2)应用 (3)二、RBF神经网络的基本思想(从函数到函数的映射) (3)三、RBF神经网络模型 (3)(一)RBF神经网络神经元结构 (3)(二)高斯核函数 (6)四、基于高斯核的RBF神经网络拓扑结构 (7)五、RBF网络的学习算法 (9)(一)算法需要求解的参数 (9)0.确定输入向量 (9)1.径向基函数的中心(隐含层中心点) (9)2.方差(sigma) (10)3.初始化隐含层至输出层的连接权值 (10)4.初始化宽度向量 (12)(二)计算隐含层第j 个神经元的输出值zj (12)(三)计算输出层神经元的输出 (13)(四)权重参数的迭代计算 (13)六、RBF神经网络算法的MATLAB实现 (14)七、RBF神经网络学习算法的范例 (15)(一)简例 (15)(二)预测汽油辛烷值 (15)八、参考资料 (19)一、径向基函数RBF定义(Radial basis function——一种距离)径向基函数是一个取值仅仅依赖于离原点距离的实值函数,也就是Φ(x)=Φ(‖x‖),或者还可以是到任意一点c的距离,c点称为中心点,也就是Φ(x,c)=Φ(‖x-c‖)。

任意一个满足Φ(x)=Φ(‖x‖)特性的函数Φ都叫做径向基函数。

标准的一般使用欧氏距离(也叫做欧式径向基函数),尽管其他距离函数也是可以的。

在神经网络结构中,可以作为全连接层和ReLU层的主要函数。

如何理解径向基函数与神经网络?一些径向函数代表性的用到近似给定的函数,这种近似可以被解释成一个简单的神经网络。

径向基函数在支持向量机中也被用做核函数。

常见的径向基函数有:高斯函数,二次函数,逆二次函数等。

matlab 的rbf函数编程

matlab 的rbf函数编程在MATLAB中,实现RBF(径向基函数)网络的编程通常需要以下步骤:1. 导入数据,首先,你需要导入你的数据集。

可以使用MATLAB的内置函数如`csvread`或者`xlsread`来导入数据,或者直接创建一个数据矩阵。

2. 数据预处理,对于RBF网络,通常需要对数据进行标准化或归一化处理,以确保网络的训练和预测过程能够顺利进行。

3. 网络训练,使用MATLAB的神经网络工具箱(Neural Network Toolbox)中的函数,比如`newrb`(用于建立RBF网络)和`train`(用于训练网络),来训练RBF网络。

在训练之前,你需要确定RBF网络的结构,比如隐藏层节点的数量和RBF函数的类型。

4. 网络预测,训练完成后,可以使用训练好的RBF网络对新的数据进行预测。

使用`sim`函数来进行预测,传入训练好的网络和待预测的输入数据。

下面是一个简单的示例代码,用于在MATLAB中实现RBF网络的训练和预测:matlab.% 导入数据。

data = load('your_data_file.csv');% 数据预处理。

% 这里假设数据已经进行了合适的预处理。

% 定义RBF网络结构。

hiddenLayerSize = 10; % 设置隐藏层节点数量。

net = newrb(input, target, goal, spread); % 创建RBF网络。

% 网络训练。

net = train(net, input, target); % 训练RBF网络。

% 网络预测。

output = sim(net, input); % 使用训练好的网络进行预测。

在这个示例中,`input`是输入数据,`target`是对应的目标输出,`goal`是训练的目标性能,`spread`是RBF函数的扩展参数。

你需要根据你的数据和需求来调整这些参数。

需要注意的是,RBF网络的性能很大程度上取决于网络结构和参数的选择,因此在实际应用中需要进行一定的调参和验证工作。

matlab三机九节点电力系统仿真(带程序)

GEgj(1,i)=angle(N(i,4)*exp(1i*N(i,5))+1i*gen(i,3)/10000*conj(((N(i,8)/100+1i*N(i,9)/100)/(N(i,4)*exp(1i*N(i,5))))));

稳态情况下有,机械功率Pme=Pe

四、求解运动方程

发电机的运动方程可以写成常微分方程组:

其中Pmi为第i个机组故障前稳态的电磁功率。在本次仿真中Djωi为零,即阻尼为零。仿真开始,t=0Βιβλιοθήκη 引入故障,0.083s后切除故障。

求解运动方程后得到曲线如下:

五、结果分析

上图分别显示了各台发电机的转子角与时间的关系曲线,显示了发电机转速差的曲线,和 、 的曲线,由图可以看到,最大角差 为 ,出现在 处,无论是 还是 第二个摇摆都不大于第一个摇摆,可见系统是稳定的。

一、潮流计算

由于本文以三机九节点为模型,假定节点一为参考节点,这样就有2两个发电机的PV节点,6个PQ节点,未知量为8个节点(包括2个PV节点和6个PQ节点)的电压相角,还有6个节点(PQ节点)的电压幅值。

可以先求出Y矩阵

图4-1 Y矩阵

然后,我们列写方程,也就是利用各个节点的有功、无功功率的平衡关系,列写14个功率平衡方程。这样就能使用牛顿一拉夫逊算法来求解这14个非线性方程。

%支路数据

%从到电阻电抗容纳类型变比

B=[1 4 0.0 0.0576 0.0 1 1

matlab源代码

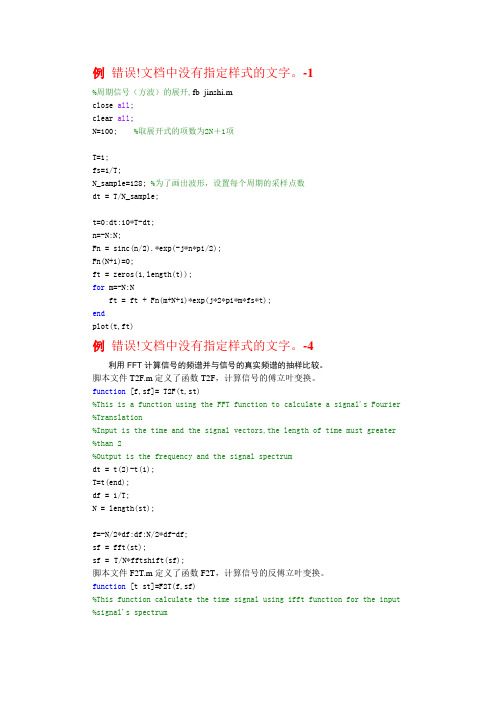

例错误!文档中没有指定样式的文字。

-1%周期信号(方波)的展开,fb_jinshi.mclose all;clear all;N=100; %取展开式的项数为2N+1项T=1;fs=1/T;N_sample=128; %为了画出波形,设置每个周期的采样点数dt = T/N_sample;t=0:dt:10*T-dt;n=-N:N;Fn = sinc(n/2).*exp(-j*n*pi/2);Fn(N+1)=0;ft = zeros(1,length(t));for m=-N:Nft = ft + Fn(m+N+1)*exp(j*2*pi*m*fs*t);endplot(t,ft)例错误!文档中没有指定样式的文字。

-4利用FFT计算信号的频谱并与信号的真实频谱的抽样比较。

脚本文件T2F.m定义了函数T2F,计算信号的傅立叶变换。

function [f,sf]= T2F(t,st)%This is a function using the FFT function to calculate a signal's Fourier %Translation%Input is the time and the signal vectors,the length of time must greater %than 2%Output is the frequency and the signal spectrumdt = t(2)-t(1);T=t(end);df = 1/T;N = length(st);f=-N/2*df:df:N/2*df-df;sf = fft(st);sf = T/N*fftshift(sf);脚本文件F2T.m定义了函数F2T,计算信号的反傅立叶变换。

function [t st]=F2T(f,sf)%This function calculate the time signal using ifft function for the input %signal's spectrumdf = f(2)-f(1);Fmx = ( f(end)-f(1) +df);dt = 1/Fmx;N = length(sf);T = dt*N;%t=-T/2:dt:T/2-dt;t = 0:dt:T-dt;sff = fftshift(sf);st = Fmx*ifft(sff);另写脚本文件fb_spec.m如下:%方波的傅氏变换, fb_spec.mclear all;close all;T=1;N_sample = 128;dt=T/N_sample;t=0:dt:T-dt;st=[ones(1,N_sample/2), -ones(1,N_sample/2)]; %方波一个周期subplot(211);plot(t,st);axis([0 1 -2 2]);xlabel('t'); ylabel('s(t)');subplot(212);[f sf]=T2F(t,st); %方波频谱plot(f,abs(sf)); hold on;axis([-10 10 0 1]);xlabel('f');ylabel('|S(f)|');%根据傅氏变换计算得到的信号频谱相应位置的抽样值sff= T^2*j*pi*f*0.5.*exp(-j*2*pi*f*T).*sinc(f*T*0.5).*sinc(f*T*0.5);plot(f,abs(sff),'r-')例错误!文档中没有指定样式的文字。

[matlab工具箱]神经网络NeuralNet

![[matlab工具箱]神经网络NeuralNet](https://img.taocdn.com/s3/m/1defa8ed710abb68a98271fe910ef12d2af9a9ae.png)

[matlab⼯具箱]神经⽹络NeuralNet//⽬的是学习在BP神经⽹络的基础上添加遗传算法,蚁群算法等优化算法来优化⽹络,这是后话。

先简单了解了MATLAB中的神经⽹络⼯具箱,⼯具箱功能还是⾮常强⼤的,已经可以拟合出⾮常多的曲线来分析了。

神经⽹络⼯具箱选择(4种)今天下载了⾃带的example跑了⼀次试⼀下选择隐藏神经元个数训练结束后可以在plot查看各种图表,这⾥只对⼯具箱操作做简单介绍最近⼀段时间在研究如何利⽤预测其销量个数,在⽹上搜索了⼀下,发现了很多模型来预测,⽐如利⽤回归模型、时间序列模型,GM(1,1)模型,可是⾃⼰在结合实际的⼯作内容,发现这⼏种模型预测的精度不是很⾼,于是再在⽹上进⾏搜索,发现神经⽹络模型可以来预测,并且有很多是结合时间序列或者SVM(⽀持向量机)等组合模型来进⾏预测,本⽂结合实际数据,选取了常⽤的BP神经⽹络算法,其算法原理,因⽹上⼀⼤堆,所以在此不必⼀⼀展⽰,并参考了这篇博⽂,运⽤matlab 2016a,给出了下⾯的代码,并最终进⾏了预测clcclear allclose all%bp 神经⽹络的预测代码%载⼊输出和输⼊数据load C:\Users\amzon\Desktop\p.txt;load C:\Users\amzon\Desktop\t.txt;%保存数据到matlab的⼯作路径⾥⾯save p.mat;save t.mat;%注意t必须为⾏向量%赋值给输出p和输⼊tp=p;t=t;%数据的归⼀化处理,利⽤mapminmax函数,使数值归⼀化到[-1.1]之间%该函数使⽤⽅法如下:[y,ps] =mapminmax(x,ymin,ymax),x需归化的数据输⼊,%ymin,ymax为需归化到的范围,不填默认为归化到[-1,1]%返回归化后的值y,以及参数ps,ps在结果反归⼀化中,需要调⽤[p1,ps]=mapminmax(p);[t1,ts]=mapminmax(t);%确定训练数据,测试数据,⼀般是随机的从样本中选取70%的数据作为训练数据%15%的数据作为测试数据,⼀般是使⽤函数dividerand,其⼀般的使⽤⽅法如下:%[trainInd,valInd,testInd] = dividerand(Q,trainRatio,valRatio,testRatio)[trainsample.p,valsample.p,testsample.p] =dividerand(p,0.7,0.15,0.15);[trainsample.t,valsample.t,testsample.t] =dividerand(t,0.7,0.15,0.15);%建⽴反向传播算法的BP神经⽹络,使⽤newff函数,其⼀般的使⽤⽅法如下%net = newff(minmax(p),[隐层的神经元的个数,输出层的神经元的个数],{隐层神经元的传输函数,输出层的传输函数},'反向传播的训练函数'),其中p为输⼊数据,t为输%tf为神经⽹络的传输函数,默认为'tansig'函数为隐层的传输函数,%purelin函数为输出层的传输函数%⼀般在这⾥还有其他的传输的函数⼀般的如下,如果预测出来的效果不是很好,可以调节%TF1 = 'tansig';TF2 = 'logsig';%TF1 = 'logsig';TF2 = 'purelin';%TF1 = 'logsig';TF2 = 'logsig';%TF1 = 'purelin';TF2 = 'purelin';TF1='tansig';TF2='purelin';net=newff(minmax(p),[10,1],{TF1 TF2},'traingdm');%⽹络创建%⽹络参数的设置net.trainParam.epochs=10000;%训练次数设置net.trainParam.goal=1e-7;%训练⽬标设置net.trainParam.lr=0.01;%学习率设置,应设置为较少值,太⼤虽然会在开始加快收敛速度,但临近最佳点时,会产⽣动荡,⽽致使⽆法收敛net.trainParam.mc=0.9;%动量因⼦的设置,默认为0.9net.trainParam.show=25;%显⽰的间隔次数%指定训练参数% net.trainFcn = 'traingd'; %梯度下降算法% net.trainFcn = 'traingdm'; %动量梯度下降算法% net.trainFcn = 'traingda'; %变学习率梯度下降算法% net.trainFcn = 'traingdx'; %变学习率动量梯度下降算法% (⼤型⽹络的⾸选算法)% net.trainFcn = 'trainrp'; % RPROP(弹性BP)算法,内存需求最⼩%共轭梯度算法% net.trainFcn = 'traincgf'; %Fletcher-Reeves修正算法% net.trainFcn = 'traincgp'; %Polak-Ribiere修正算法,内存需求⽐Fletcher-Reeves修正算法略⼤% net.trainFcn = 'traincgb'; % Powell-Beal复位算法,内存需求⽐Polak-Ribiere修正算法略⼤% (⼤型⽹络的⾸选算法)%net.trainFcn = 'trainscg'; % ScaledConjugate Gradient算法,内存需求与Fletcher-Reeves修正算法相同,计算量⽐上⾯三种算法都⼩很多% net.trainFcn = 'trainbfg'; %Quasi-Newton Algorithms - BFGS Algorithm,计算量和内存需求均⽐共轭梯度算法⼤,但收敛⽐较快% net.trainFcn = 'trainoss'; % OneStep Secant Algorithm,计算量和内存需求均⽐BFGS算法⼩,⽐共轭梯度算法略⼤% (中型⽹络的⾸选算法)%net.trainFcn = 'trainlm'; %Levenberg-Marquardt算法,内存需求最⼤,收敛速度最快% net.trainFcn = 'trainbr'; %贝叶斯正则化算法% 有代表性的五种算法为:'traingdx','trainrp','trainscg','trainoss', 'trainlm'%在这⾥⼀般是选取'trainlm'函数来训练,其算对对应的是Levenberg-Marquardt算法net.trainFcn='trainlm';[net,tr]=train(net,trainsample.p,trainsample.t);%计算仿真,其⼀般⽤sim函数[normtrainoutput,trainPerf]=sim(net,trainsample.p,[],[],trainsample.t);%训练的数据,根据BP得到的结果[normvalidateoutput,validatePerf]=sim(net,valsample.p,[],[],valsample.t);%验证的数据,经BP得到的结果[normtestoutput,testPerf]=sim(net,testsample.p,[],[],testsample.t);%测试数据,经BP得到的结果%将所得的结果进⾏反归⼀化,得到其拟合的数据trainoutput=mapminmax('reverse',normtrainoutput,ts);validateoutput=mapminmax('reverse',normvalidateoutput,ts);testoutput=mapminmax('reverse',normtestoutput,ts);%正常输⼊的数据的反归⼀化的处理,得到其正式值trainvalue=mapminmax('reverse',trainsample.t,ts);%正常的验证数据validatevalue=mapminmax('reverse',valsample.t,ts);%正常的验证的数据testvalue=mapminmax('reverse',testsample.t,ts);%正常的测试数据%做预测,输⼊要预测的数据pnewpnew=[313,256,239]';pnewn=mapminmax(pnew);anewn=sim(net,pnewn);anew=mapminmax('reverse',anewn,ts);%绝对误差的计算errors=trainvalue-trainoutput;%plotregression拟合图figure,plotregression(trainvalue,trainoutput)%误差图figure,plot(1:length(errors),errors,'-b')title('误差变化图')%误差值的正态性的检验figure,hist(errors);%频数直⽅图figure,normplot(errors);%Q-Q图[muhat,sigmahat,muci,sigmaci]=normfit(errors);%参数估计均值,⽅差,均值的0.95置信区间,⽅差的0.95置信区间[h1,sig,ci]= ttest(errors,muhat);%假设检验figure, ploterrcorr(errors);%绘制误差的⾃相关图figure, parcorr(errors);%绘制偏相关图运⾏之后的,结果如下:BP神经⽹络的结果分析图训练数据的梯度和均⽅误差之间的关系图验证数据的梯度与学习次数残差的正态的检验图(Q-Q图)在⽹上,发现可以通过神经⽹络⼯具箱这个GUI界⾯来创建神经⽹络,其⼀般的操作步骤如下:1:在输⼊命令⾥⾯输⼊nntool命令,或者在应⽤程序这个选项下找到Netrual Net Fitting 这个应⽤程序,点击打开,就能看见如下界⾯2:输⼊数据和输出数据的导⼊(在本⽂中选取了matlab⾃带的案例数据)3:随机选择三种类型的数据所占的样本量的⽐例,⼀般选取默认即可4:隐层神经元的确定5:训练算法的选取,⼀般是选择默认即可,选择完成后点击<train>按钮即可运⾏程序6:根据得到的结果,⼀般是MSE的值越⼩,R值越接近1,其训练的效果⽐较,并第⼆张图给出了神经⽹络的各参数的设置以及其最终的结果,其拟合图R越接近1,模型拟合的更好最终的结果图7:如果所得到的模型不能满⾜你的需求,则需重复上述的步骤直⾄能够得到你想要的精确度8:将最终的得到的各种数据以及其拟合值进⾏保存,然后查看,就可以得到所要的拟合值最后参考了⽹上和MATLAB的帮助,给出了⼀些与神经⽹络相关的函数,希望能够帮助⼤家。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

xlabel('Input x');

ylabel('Output y');

Centers = SamIn(:,1:ClusterNum);

NumberInClusters = zeros(ClusterNum,1); % 各类中的样本数,初始化为零

W(i) = W(i) + lrW*WGrad;

end

end

% 测试

TestDistance = dist(Center',TargetIn);

TestSpreadsMat = repmat(SP',1,TargetSamNum);

TestHiddenUnitOut = radbas(TestDistance./TestSpreadsMat);

% 根据目标函数获得样本输入输出

rand('state',sum(100*clock))

NoiseVar = 0.1;

Noise = NoiseVar*randn(1,SamNum);

SamIn = 8*rand(1,SamNum)-4;

SamOutNoNoise = 1.1*(1-SamIn+2*SamIn.^2).*exp(-SamIn.^2/2);

% 根据目标函数获得样本输入输出

rand('state',sum(100*clock))

NoiseVar = 0.1;

Noise = NoiseVar*randn(1,SamNum);

SamIn = 8*rand(1,SamNum)-4;

SamOutNoNoise = 1.1*(1-SamIn+2*SamIn.^2).*exp(-SamIn.^2/2);

end

% 计算各隐节点的扩展常数(宽度)

AllDistances = dist(Centers',Centers); % 计算隐节点数据中心间的距离(矩阵)

Maximum = max(max(AllDistances)); % 找出其中最大的一个距离

for i = 1:ClusterNum % 将对角线上的0 替换为较大的值

xlabel('Input x');

ylabel('Output y');

[InDim,MaxUnitNum] = size(SamIn); % 样本输入维数和最大允许隐节点数

% 计算隐节点输出阵

Distance = dist(SamIn',SamIn);

HiddenUnitOut = radbas(Distance/SP);

lrCent = 0.001; % 隐节点数据中心学习系数

lrSP = 0.001; % 隐节点扩展常数学习系数

lrW = 0.001; % 隐节点输出权值学习系数

ErrHistory = []; % 用于记录每次参数调整后的训练误差

for epoch = 1:MaxEpoch

AllDist = dist(Center',SamIn);

PosSelected = [];

VectorsSelected = [];

HiddenUnitOutSelected = [];

ErrHistory = []; % 用于记录每次增加隐节点后的训练误差

VectorsSelectFrom = HiddenUnitOut;

dd = sum((SamOut.*SamOut)')';

SpreadsMat = repmat(Spreads,1,SamNum);

HiddenUnitOut = radbas(Distance./SpreadsMat); % 计算隐节点输出阵

HiddenUnitOutEx = [HiddenUnitOut' ones(SamNum,1)]'; % 考虑偏移

%一维输入,一维输出,逼近效果很好!

1.基于聚类的RBF 网设计算法

SamNum = 100; % 总样本数

TestSamNum = 101; % 测试样本数

InDim = 1; % 样本输入维数

ClusterNum = 10; % 隐节点数,即聚类样本数

Overlap = 1.0; % 隐节点重叠系数

SamOut = SamOutNoNoise + Noise;

TestSamIn = -4:0.08:4;

TestSamOut = 1.1*(1-TestSamIn+2*TestSamIn.^2).*exp(-TestSamIn.^2/2);

figure

hold on

grid

plot(SamIn,SamOut,'k+')

if SelectedNum>0,

[lin,xxx] = size(Denominator);

Denominator(:,PosSelected) = ones(lin,1);

end

Angle = ((SamOut*VectorsSelectFrom) .^ 2) ./ Denominator;

% 按最小距离原则对所有样本进行分类

for i = 1:SamNum

AllDistance = dist(Centers',SamIn(:,i));

[MinDist,Pos] = min(AllDistance);

NumberInClusters(Pos) = NumberInClusters(Pos) + 1;

W2

B2

2.基于梯度法的RBF 网设计算法

SamNum = 100; % 训练样本数

TargetSamNum = 101; % 测试样本数

InDim = 1; % 样本输入维数

UnitNum = 10; % 隐节点数

MaxEpoch = 5000; % 最大训练次数

E0 = 0.9; % 目标误差

TestSpreadsMat = repmat(Spreads,1,TestSamNum);

TestHiddenUnitOut = radbas(TestDistance./TestSpreadsMat);

TestNNOut = W2*TestHiddenUnitOut+B2;

plot(TestSamIn,TestNNOut,'k-')

SPGrad = AllDist(i,:).^2*(Error.*UnitOut(i,:)*W(i)/(SP(i)^3))';

WGrad = Error*UnitOut(i,:)';

Center(:,i) = Center(:,i) + lrCent*CentGrad;

SP(i) = SP(i) + lrSP*SPGrad;

Centers(:,i) = mean(SamIn(:,Index)')';

end

% 判断新旧聚类中心是否一致,是则结束聚类

EqualNum = sum(sum(Centers==OldCenters));

if EqualNum == InDim*ClusterNum,

break,

end

W2Ex = SamOut*pinv(HiddenUnitOutEx); % 求广义输出权值

W2 = W2Ex(:,1:ClusterNum); % 输出权值

B2 = W2Ex(:,ClusterNum+1); % 偏移

% 测试

TestDistance = dist(Centers',TestSamIn);

AllDistances(i,i) = Maximum+1;

end

Spreads = Overlap*min(AllDistances)'; % 以隐节点间的最小距离作为扩展常数

% 计算各隐节点的输出权值

Distance = dist(Centers',SamIn); % 计算各样本输入离各数据中心的距离

plot(TargetIn,TargetOut,'k--')

xlabel('Input x');

ylabel('Output y');

Center = 8*rand(InDim,UnitNum)-4;

SP = 0.2*rand(1,UnitNum)+0.1;

W = 0.2*rand(1,UnitNum)-0.1;

TestNNOut = W*TestHiddenUnitOut;

plot(TargetIn,TestNNOut,'k-')

% 绘制学习误差曲线

figure

hold on

grid

[xx,Num] = size(ErrHistory);

plot(1:Num,ErrHistory,'k-');

3.基于OLS 的RBF 网设计算法

SamNum = 100; % 训练样本数

TestSamNum = 101; % 测试样本数

SP = 0.6; % 隐节点扩展常数

ErrorLimit = 0.9; % 目标误差

% 根据目标函数获得样本输入输出

rand('state',sum(100*clock))