霍夫曼编码

霍夫曼编码详细步骤

霍夫曼编码是一种可变长度的编码方式,用于对字符或符号进行压缩。

下面是霍夫曼编码的详细步骤:

1. 统计字符出现频率:首先需要对待压缩的文本进行统计,统计每个字符出现的频率,并将其保存在一个频率表中。

2. 构建霍夫曼树:根据频率表中的数据,可以构建出一棵霍夫曼树。

在霍夫曼树中,每个非叶子节点表示一个字符或符号,其权值为该字符或符号在原始文本中出现的频率。

3. 确定编码方案:根据霍夫曼树,可以确定每个字符或符号的编码方式。

具体来说,对于霍夫曼树上的每个非叶子节点,可以选择其左子树和右子树中权值较小的那个作为该节点的编码。

这样,就可以得到每个字符或符号的唯一编码。

4. 压缩文本:有了霍夫曼编码方案后,就可以对待压缩的文本进行编码。

具体来说,对于文本中的每个字符或符号,可以通过查找霍夫曼树来确定其对应的编码,并将编码替换为原始字符或符号。

这样,就可以得到压缩后的文本。

5. 解压文本:在解压文本时,需要将压缩后的编码还原为原始字符或符号。

具体来说,对于压缩后的文本中的每个编码,可以通过查找霍夫曼树来确定其对应的原始字符或符号,并将其替换为编码。

这样,就可以得到解压后的文本。

需要注意的是,霍夫曼编码虽然可以大大减小文本的大小,但是在实际应用中,由于霍夫曼树的构建过程比较复杂,因此编码和解码的速度相对较慢。

此外,霍夫曼编码还存在一定的冲突问题,需要采用一些冲突解决方案来避免。

霍夫曼编码代码

霍夫曼编码代码霍夫曼编码是一种变长编码方式,常用于数据压缩领域。

它的基本思想是将出现频率较高的字符用较短的编码表示,出现频率较低的字符用较长的编码表示,从而达到压缩数据的目的。

一、霍夫曼树1. 定义霍夫曼树是一棵带权树,即每个节点都有一个权值。

在霍夫曼树中,权值越大的节点离根节点越近。

2. 构建方法(1) 将所有字符按照出现频率从小到大排序。

(2) 取出两个频率最小的字符作为叶子节点,构建一棵二叉树,并将这两个节点的权值相加作为父节点的权值。

(3) 将新生成的父节点插入到已排序好的序列中,并将序列重新排序。

(4) 重复步骤2和3,直到只剩下一个节点为止。

这个节点就是霍夫曼树的根节点。

二、霍夫曼编码1. 定义对于给定字符串中每个字符,在霍夫曼树中找到对应叶子节点所在路径上所有父节点组成一个二进制数作为该字符对应编码。

由于霍夫曼树中权值小的节点离根节点较远,所以编码长度较长的字符出现频率较低。

2. 编码方法(1) 遍历霍夫曼树,将左子树标记为0,右子树标记为1。

(2) 对于每个字符,在霍夫曼树中找到对应叶子节点所在路径上所有父节点组成一个二进制数作为该字符对应编码。

3. 解码方法(1) 遍历霍夫曼树,将左子树标记为0,右子树标记为1。

(2) 将编码字符串按照从左到右的顺序依次遍历,并在霍夫曼树上寻找对应叶子节点。

当遇到0时,向左走;当遇到1时,向右走。

直到找到叶子节点,则该编码对应的字符就是该叶子节点的值。

三、Python实现下面是一个简单的Python实现:```pythonimport heapqfrom collections import defaultdict# 构建霍夫曼树def build_tree(freq):heap = [[weight, [char, '']] for char, weight in freq.items()]heapq.heapify(heap)while len(heap) > 1:left = heapq.heappop(heap)right = heapq.heappop(heap)for pair in left[1:]:pair[1] = '0' + pair[1]for pair in right[1:]:pair[1] = '1' + pair[1]heapq.heappush(heap, [left[0] + right[0]] + left[1:] + right[1:])return sorted(heapq.heappop(heap)[1:], key=lambda p: (len(p[-1]), p))# 编码字符串def encode(str, freq):tree = build_tree(freq)code_dict = dict(tree)encoded_str = ''for char in str:encoded_str += code_dict[char]return encoded_str# 解码字符串def decode(encoded_str, freq):tree = build_tree(freq)code_dict = dict(tree)decoded_str = ''while encoded_str:for char, code in code_dict.items():if encoded_str.startswith(code):decoded_str += charencoded_str = encoded_str[len(code):]breakreturn decoded_str# 测试代码if __name__ == '__main__':str = 'hello world'freq = defaultdict(int)for char in str:freq[char] += 1print('Frequency:', freq)encoded_str = encode(str, freq)print('Encoded string:', encoded_str)decoded_str = decode(encoded_str, freq)print('Decoded string:', decoded_str)```四、总结霍夫曼编码是一种常用的数据压缩算法,其基本思想是将出现频率较高的字符用较短的编码表示,出现频率较低的字符用较长的编码表示。

霍夫曼编码和pcm编码

霍夫曼编码和pcm编码

霍夫曼编码和PCM编码是两种常见的数据压缩技术。

它们分别用于压缩离散数据和连续数据。

霍夫曼编码是一种可变长度编码方法,用于压缩离散数据。

它通过将出现频率较高的字符用较短的编码表示,而将出现频率较低的字符用较长的编码表示。

这样可以有效地减少数据的传输量。

霍夫曼编码的基本思想是构建一棵哈夫曼树,其中叶子节点表示字符,路径表示编码。

编码过程中需要统计字符的出现频率,并根据频率构建哈夫曼树。

解码时,根据哈夫曼树进行反向遍历,将编码还原为原始字符。

霍夫曼编码常用于文件压缩和数据传输领域。

PCM编码(Pulse Code Modulation)是一种用于压缩连续数据的方法。

它将连续的模拟信号转换为离散的数字信号。

PCM编码过程中,模拟信号被等间隔的采样,并通过量化将每个采样值映射为最接近的离散值。

然后,将这些离散值进行编码并存储或传输。

解码时,将编码的离散值还原为原始的模拟信号。

PCM编码的优点是简单易实现,且在音频和视频领域广泛应用。

霍夫曼编码和PCM编码在数据压缩方面具有不同的优势。

霍夫曼编码适用于离散数据,尤其是出现频率差异较大的情况,能够有效地减少传输量。

而PCM编码适用于连续数据,特别是模拟信号的采样与还原,

能够保留较高的信号质量。

在实际应用中,可以根据数据的特点选择适合的压缩方法,以实现更高效的数据传输和存储。

霍夫曼编码解码过程

霍夫曼编码解码过程霍夫曼编码是一种基于概率的变长编码方法,主要用于无损数据压缩。

其核心思想是给出现概率较高的符号赋予较短的编码,反之则赋予较长的编码。

这样,平均码长将会接近于原始数据的熵,从而实现有效的数据压缩。

以下是霍夫曼编码和解码的过程:霍夫曼编码过程:1.首先,统计出待编码数据中每个字符出现的频率,例如,对于字符串"ABABABABA",我们可以得到字符'A'出现4次,字符'B'出现5次。

2.创建一个霍夫曼树。

这个树是一个二叉树,其中每个节点代表一个字符,节点的频率作为权重。

3.从根节点开始,对于每个节点,如果其左子节点和右子节点代表的字符不同,则将当前节点替换为一个新的字符,这个新字符的码字是左子节点和右子节点码字的组合。

需要注意的是,实际的霍夫曼编码过程中可能会有多种不同的树结构生成相同的结果,因此在具体实现时需要保证算法的稳定性和可重复性。

霍夫曼解码过程:霍夫曼解码是将霍夫曼编码后的数据进行还原的过程。

由于霍夫曼编码是前缀编码,也就是说编码后的码字没有前缀相同的后缀,因此解码过程是唯一的。

具体来说,解码步骤如下:1.从第一个字节开始,根据霍夫曼树的每个分支的权值(即字符出现的频率),从根节点向下查找对应的字符。

例如,对于码字"00",我们首先找到根节点,然后找到左子节点对应的字符'A'。

2.对于每个后续的字节,重复上述步骤。

需要注意的是,由于霍夫曼编码是前缀编码,因此我们不需要担心码字的结束位置,只要遇到一个码字,就可以一直解码下去,直到所有数据都被解码。

通过以上步骤,我们可以将霍夫曼编码的数据还原成原始的数据。

总的来说,霍夫曼编码是一种非常有效的无损数据压缩方法,尤其适用于数据中存在大量重复元素的情况。

霍夫曼编码原理

霍夫曼编码是一种变长编码方式,用于将字符或符号序列转换为二进制数,以便用于数据压缩或传输。

霍夫曼编码的原理如下:

统计每个字符或符号在待编码序列中出现的频率,并根据频率构建一个频率表。

根据频率表,构建一个霍夫曼树。

霍夫曼树是一种特殊的二叉树,其中每个叶子节点代表一个字符或符号,并且每个内部节点的权值等于其左右子节点权值之和。

从根节点开始,为每个叶子节点赋予一个编码。

左子节点的编码为0,右子节点的编码为1。

通过遍历霍夫曼树,可以得到每个字符或符号的霍夫曼编码。

将原始序列中的每个字符或符号替换为对应的霍夫曼编码,得到压缩后的二进制数。

霍夫曼编码的特点是:

每个字符或符号的编码都是唯一的,不会出现编码冲突。

出现频率高的字符或符号的编码较短,而出现频率低的字符或符号的编码较长,从而实现了数据的压缩。

霍夫曼编码是一种前缀编码,即任何一个字符或符号的编码都不是另一个字符或符号编码的前缀,这样可以避免解码时的歧义。

在实际应用中,霍夫曼编码广泛用于数据压缩、图像压缩和音频压缩等领域,能够有效减小数据的存储空间和传输带宽。

霍夫曼编码

以下是Huffman编码原理简介:霍夫曼(Huffman)编码是1952年为文本文件而建立,是一种统计编码。

属于无损压缩编码。

霍夫曼编码的码长是变化的,对于出现频率高的信息,编码的长度较短;而对于出现频率低的信息,编码长度较长。

这样,处理全部信息的总码长一定小于实际信息的符号长度。

对于学多媒体的同学来说,需要知道Huffman编码过程的几个步骤:l)将信号源的符号按照出现概率递减的顺序排列。

(注意,一定要递减)2)将最下面的两个最小出现概率进行合并相加,得到的结果作为新符号的出现概率。

3)重复进行步骤1和2直到概率相加的结果等于1为止。

4)在合并运算时,概率大的符号用编码0表示,概率小的符号用编码1表示。

5)记录下概率为1处到当前信号源符号之间的0,l序列,从而得到每个符号的编码。

下面我举个简单例子:一串信号源S={s1,s2,s3,s4,s5}对应概率为p={40,30,15,10,5},(百分率)按照递减的格式排列概率后,根据第二步,会得到一个新的概率列表,依然按照递减排列,注意:如果遇到相同概率,合并后的概率放在下面!最后概率最大的编码为0,最小的编码为1。

如图所示:所以,编码结果为s1=1s2=00s3=010s4=0110s5=0111霍夫曼编码具有如下特点:1) 编出来的码都是异字头码,保证了码的唯一可译性。

2) 由于编码长度可变。

因此译码时间较长,使得霍夫曼编码的压缩与还原相当费时。

3) 编码长度不统一,硬件实现有难度。

4) 对不同信号源的编码效率不同,当信号源的符号概率为2的负幂次方时,达到100%的编码效率;若信号源符号的概率相等,则编码效率最低。

5) 由于0与1的指定是任意的,故由上述过程编出的最佳码不是唯一的,但其平均码长是一样的,故不影响编码效率与数据压缩性能。

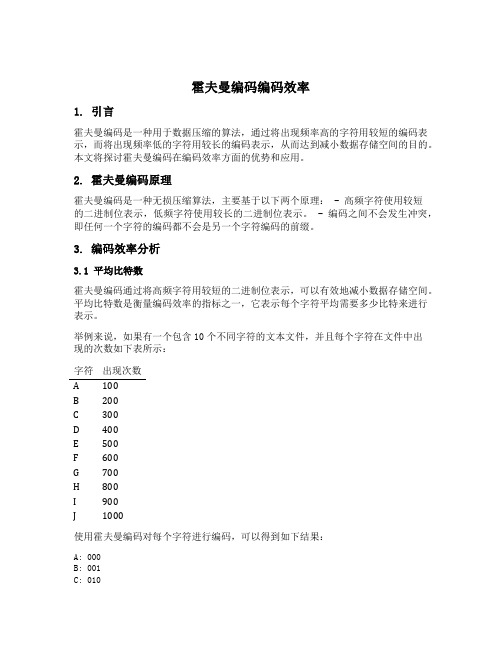

霍夫曼编码编码效率

霍夫曼编码编码效率1. 引言霍夫曼编码是一种用于数据压缩的算法,通过将出现频率高的字符用较短的编码表示,而将出现频率低的字符用较长的编码表示,从而达到减小数据存储空间的目的。

本文将探讨霍夫曼编码在编码效率方面的优势和应用。

2. 霍夫曼编码原理霍夫曼编码是一种无损压缩算法,主要基于以下两个原理: - 高频字符使用较短的二进制位表示,低频字符使用较长的二进制位表示。

- 编码之间不会发生冲突,即任何一个字符的编码都不会是另一个字符编码的前缀。

3. 编码效率分析3.1 平均比特数霍夫曼编码通过将高频字符用较短的二进制位表示,可以有效地减小数据存储空间。

平均比特数是衡量编码效率的指标之一,它表示每个字符平均需要多少比特来进行表示。

举例来说,如果有一个包含10个不同字符的文本文件,并且每个字符在文件中出现的次数如下表所示:字符出现次数A 100B 200C 300D 400E 500F 600G 700H 800I 900J 1000使用霍夫曼编码对每个字符进行编码,可以得到如下结果:A: 000B: 001C: 010D: 011E: 10F: 110G: 1110H: 1111I: 10000J: 10001根据上述编码方案计算平均比特数为:(100 * 3 + 200 *3 +300 *3 +400 *3 +500 *2 +600 *3 +700 *4 +800 *4 +900 *5 +100 0 *5) / (100+200+300+400+500+600+700+800+900+1000) = (48000 / 5500) ≈8.73比特/字符。

可以看出,霍夫曼编码相较于其他编码方式具有更高的编码效率。

3.2 压缩比率压缩比率是衡量数据压缩效果的指标之一,它表示压缩后的数据大小与原始数据大小之间的比值。

霍夫曼编码的压缩比率通常比较高,尤其是对于含有大量重复字符的数据。

使用上一节中的例子,假设原始数据大小为10KB,经过霍夫曼编码后,可以得到的压缩后的数据大小为8.73比特/字符 * 5500字符≈ 4782.5比特。

霍夫曼编码和实现

霍夫曼编码(Huffman Coding)是一种被广泛应用的编码方法,它以信源空间的概率分布为基准,用概率匹配方法进行信源编码。

实现霍夫曼编码可以分为几个步骤:

1. 统计:首先,你需要对字符出现的频率进行统计。

在霍夫曼编码中,每个字符出现的频率与其在编码中的长度是一一对应的。

出现频率越高的字符,其编码长度越短;出现频率越低的字符,其编码长度越长。

2. 创建二叉树:然后,你需要创建一个二叉树。

这个二叉树的左节点和右节点分别代表0和1,每个节点都包含一个字符及其出现的频率。

这个二叉树会被用来生成霍夫曼编码。

3. 生成编码:在创建好二叉树后,你可以从最上面的根节点(也就是最左边的节点)开始,沿着树向下走,遇到左节点就向左走,遇到右节点就向右走。

当你到达一个叶子节点(也就是没有子节点的节点)时,就可以停止下来。

这个路径就是该字符的霍夫曼编码。

4. 编码和解码:在得到霍夫曼编码后,你可以通过反向遍历二叉树来解码出原始的字符。

从根节点开始,根据当前节点的状态向左或向右走,直到到达叶子节点为止。

实现霍夫曼编码可以使用任何一种编程语言。

在Python中,你可以使用类和函数来实现这些步骤。

例如,你可以创建一个类来表示

二叉树,并使用函数来创建树、生成编码和解码字符等。

以上是霍夫曼编码的基本步骤和实现方法。

在实际应用中,还需要考虑一些其他因素,例如如何处理字符集的大小、如何优化编码和解码的时间等。

霍夫曼编码的平均码长公式

霍夫曼编码的平均码长公式霍夫曼编码是一种基于贪心策略的编码方式,它可以将字符或符号集合转换为最优编码,从而实现数据压缩的目的。

而霍夫曼编码的平均码长公式则是用来计算霍夫曼编码的平均码长的公式,它在数据压缩领域中有着广泛的应用。

一、霍夫曼编码的基本原理霍夫曼编码是一种可变长度编码,它是基于字符出现频率的统计信息来构建编码表的。

具体而言,霍夫曼编码的基本原理可以归纳为以下几个步骤:1. 统计字符出现频率:对于给定的一段文本,首先需要统计每个字符出现的频率,即每个字符在文本中出现的次数。

2. 构建霍夫曼树:根据字符出现频率,构建一棵霍夫曼树,其中频率较小的字符位于树的底层,频率较大的字符位于树的顶层。

3. 生成编码表:从霍夫曼树的根节点开始,向下遍历树的每个节点,对于左子树的节点,将编码值设为0,对于右子树的节点,将编码值设为1,直到遍历到每个叶子节点为止,生成每个字符的霍夫曼编码。

4. 进行数据压缩:将文本中的每个字符替换为其对应的霍夫曼编码,从而实现数据压缩的目的。

二、霍夫曼编码的平均码长公式霍夫曼编码的平均码长公式是用来计算霍夫曼编码的平均码长的公式,它的具体形式为:L = ∑ (fi * li)其中,L表示霍夫曼编码的平均码长,fi表示第i个字符出现的频率,li表示第i个字符的霍夫曼编码长度。

在这个公式中,频率越高的字符,其霍夫曼编码长度越短,而频率越低的字符,其霍夫曼编码长度越长。

因此,霍夫曼编码的平均码长可以作为衡量编码效率的指标,其值越小,表示编码效率越高。

三、霍夫曼编码的应用霍夫曼编码在数据压缩领域中有着广泛的应用。

在实际的数据传输和存储中,数据的大小往往是一个重要的限制因素。

而通过使用霍夫曼编码,可以将数据进行有效压缩,从而减少数据传输和存储所需的空间和时间。

此外,霍夫曼编码还被广泛应用于图像、音频和视频等多媒体数据的压缩中。

通过将多媒体数据转换为二进制数据,并采用霍夫曼编码进行压缩,可以大幅度减少多媒体数据的存储和传输所需的空间和带宽。

霍夫曼编码原理及编码规则

霍夫曼编码原理及编码规则引言概述:霍夫曼编码是一种常用的数据压缩算法,通过将出现频率较高的字符用较短的编码表示,从而实现对数据的高效压缩。

本文将介绍霍夫曼编码的原理及编码规则,并分析其在数据压缩中的应用。

正文内容:1. 霍夫曼编码原理1.1 可变长度编码- 霍夫曼编码是一种可变长度编码,不同字符的编码长度不同。

- 出现频率较高的字符使用较短的编码,出现频率较低的字符使用较长的编码。

1.2 无前缀编码- 霍夫曼编码是一种无前缀编码,即任何一个字符的编码都不是其他字符编码的前缀。

- 这样可以避免解码时的歧义,保证解码的唯一性。

1.3 最优编码- 霍夫曼编码是一种最优编码,即平均编码长度最短。

- 通过构建霍夫曼树,将出现频率较高的字符放在树的顶部,出现频率较低的字符放在树的底部,从而实现最优编码。

2. 霍夫曼编码规则2.1 构建霍夫曼树- 统计字符出现的频率,根据频率构建霍夫曼树。

- 霍夫曼树的构建可以使用贪心算法,每次选择频率最低的两个节点合并,直到只剩下一个根节点。

2.2 分配编码- 从根节点开始,向左走为0,向右走为1,将每个字符的编码从根节点到叶子节点的路径记录下来。

- 通过遍历霍夫曼树,分配每个字符的编码。

2.3 压缩数据- 将原始数据中的每个字符替换为对应的编码。

- 将编码后的数据按照固定长度进行存储,从而实现数据的压缩。

3. 应用场景3.1 数据压缩- 霍夫曼编码可以对数据进行高效压缩,减小存储空间的占用。

- 在图像、音频、视频等大数据文件的传输和存储中,霍夫曼编码被广泛应用。

3.2 传输错误检测- 霍夫曼编码具有一定的纠错能力,可以检测传输中的错误。

- 通过校验编码的长度和校验和等方式,可以检测出传输中发生的错误。

3.3 数据加密- 霍夫曼编码可以用于数据加密,通过将原始数据转换为编码后的数据,增加数据的安全性。

- 在信息安全领域中,霍夫曼编码被用于数据加密和解密的过程。

总结:霍夫曼编码是一种可变长度、无前缀的最优编码算法,通过构建霍夫曼树和分配编码,实现对数据的高效压缩。

证明霍夫曼编码为最优编码

证明霍夫曼编码为最优编码一、引言霍夫曼编码是一种常见的无损数据压缩编码方法,它通过构建最优前缀码的方式,实现了数据的压缩。

在众多的编码方法中,霍夫曼编码以其简洁、高效的特点,成为了最常用的编码方式之一。

然而,对于霍夫曼编码是否为最优编码的问题,仍然存在一定的争议。

本文将通过分析霍夫曼编码的特性,证明霍夫曼编码为最优编码。

二、霍夫曼编码的特性1.简洁性:霍夫曼编码采用的最优前缀码是一种长度最小的码字,这意味着在同样的数据序列中,霍夫曼编码能够以更少的位数来表示数据,从而实现数据的压缩。

2.高效性:霍夫曼编码的构建过程是基于数据依赖关系和概率统计的,它能够自动识别出数据中存在的规律,并利用这些规律来构建最优前缀码。

因此,霍夫曼编码在编码和解码过程中具有较高的效率。

3.适应性:霍夫曼编码的构建过程不受数据类型和分布的限制,它能够适应不同类型的数据和不同的数据分布情况。

因此,霍夫曼编码具有广泛的适用性。

三、证明过程为了证明霍夫曼编码为最优编码,我们可以从以下几个方面进行分析:1.平均长度:霍夫曼编码的平均长度是最短的,因为它只使用最短的符号来表示数据。

相比之下,其他编码方法可能会使用更长的符号来表示数据,从而导致平均长度变长。

2.唯一性:霍夫曼编码中的每个码字都是唯一的,这意味着在解码过程中不会出现混淆和误解码的情况。

相比之下,其他编码方法可能会出现多个等效的码字,导致解码错误。

3.适应性强:霍夫曼编码的构建过程不受数据类型和分布的限制,这意味着它能够适应各种类型的数据和不同的数据分布情况。

相比之下,其他编码方法可能只适用于特定类型的数据或特定分布情况。

综上所述,霍夫曼编码具有简洁性、高效性和适应性等特点,这些特点使得霍夫曼编码成为最优编码之一。

因此,我们可以得出结论:霍夫曼编码确实是最优编码。

四、结论通过对霍夫曼编码特性的分析,我们可以证明霍夫曼编码为最优编码之一。

它具有简洁性、高效性和适应性等特点,能够以更少的位数来表示数据,从而实现数据的压缩。

霍夫曼编码代码

霍夫曼编码代码简介霍夫曼编码是一种常用的无损数据压缩算法,广泛应用于数据传输和存储中。

它通过构建一棵霍夫曼树,将出现频率较高的字符用较少的二进制位表示,从而达到压缩数据的目的。

本文将详细介绍霍夫曼编码的原理、实现方式以及编写霍夫曼编码的代码示例。

霍夫曼编码原理霍夫曼编码的核心原理是根据字符出现的频率构建一棵霍夫曼树。

树的叶子节点对应字符,叶子节点到根节点的路径上的分支标记为0或1,构成了字符的霍夫曼编码。

编码的规则是,出现频率较高的字符对应的编码较短,而出现频率较低的字符对应的编码较长。

霍夫曼编码的步骤1.统计字符的频率:遍历待压缩的数据,统计每个字符出现的次数。

2.构建霍夫曼树:将字符频率作为权值创建一棵霍夫曼树,其中频率较低的字符位于树的下层。

3.生成霍夫曼编码表:从霍夫曼树的根节点开始,向左走的路径标记为0,向右走的路径标记为1,递归生成每个字符对应的霍夫曼编码。

4.压缩数据:按照生成的编码将原始数据转换成二进制字符串,将字符串转换为字节流保存。

实现霍夫曼编码的关键数据结构在实现霍夫曼编码时,我们需要以下两个关键的数据结构: 1. 霍夫曼树:用于构建霍夫曼编码,其节点包含字符和对应的频率。

2. 霍夫曼编码表:用于存储每个字符对应的编码。

伪代码实现下面是一个简单的伪代码实现霍夫曼编码的例子:# 伪代码实现霍夫曼编码def huffman_encoding(data):# 统计字符频率freq_map = count_frequency(data)# 构建霍夫曼树huffman_tree = build_huffman_tree(freq_map)# 生成霍夫曼编码表huffman_code_table = generate_code_table(huffman_tree)# 压缩数据encoded_data = encode_data(data, huffman_code_table)return encoded_data, huffman_code_table实例演示为了更好理解霍夫曼编码的过程,我们以字符串”hello world”为例进行演示。

霍夫曼编码

进行压缩编码时,只要将码值用码字代替即可。 进行压缩编码时,只要将码值用码字代替即可。所 以源符a1 a1 a2 a2 a3 a3 a3 a4 a4 a4 a4 以源符 a5 a5 a5 a6 a6 a6 a7 a7 a8编码为: 编码为: 编码为 010010011011101101101000000001 1011011010000100001001。 。 平均码长 B=0.1*3+0.1*3+0.15*3+0.2*2+0.15* 3+0.15*3+0.1*4+0.05*4=2.95(b) 熵H= 2.9087 编码效率N=H/B=2.9087/2.95=98.6%

Your company slogan

(二)霍夫曼树的构建

霍夫曼编码实际上构造了一个码树, 霍夫曼编码实际上构造了一个码树,码树从最上层的端点开始 构造,直到树根结束。这里举个例子说明如何生成霍夫曼树。 构造,直到树根结束。这里举个例子说明如何生成霍夫曼树。假 设对由a 设对由a1、a2、a3、a4、a5、a6、a7、a8八个信源符号组成的 源信息字符串: 源信息字符串:“a1 a1 a2 a2 a3 a3 a3 a4 a4 a4 a4 a5 a5 a5 a6 a6 a6 a7 a7 a8”进行霍夫曼编码。首先应对信息中各数字 进行霍夫曼编码。 出现的次数进行统计如下 如下: 出现的次数进行统计如下:

Your company slogan

谢 谢 大 家 !

Your company slogan

霍夫曼编码Huffman 霍夫曼编码Huffman Coding

长春理工大学 080212418 高延邦

目录

一、什么是编码 二、霍夫曼编码简介 三、霍夫曼编码的熵 四、霍夫曼编码

霍夫曼编码

霍夫曼编码霍夫曼编码是可变字长编码(VLC)的一种。

该方法完全依据字符出现概率来构造异字头的平均长度最短的码字,有时称之为最佳编码,一般就称Huffman编码。

定理:在变字长编码中,如果码字长度严格按照对应符号出现的概率大小逆序排列,则其平均码字长度为最小。

霍夫曼编码的具体方法:先按出现的概率大小排队,把两个最小的概率相加,作为新的概率和剩余的概率重新排队,再把最小的两个概率相加,再重新排队,直到最后变成1。

每次相加时都将“0”和“1”赋与相加的两个概率,读出时由该符号开始一直走到最后的“1”,将路线上所遇到的“0”和“1”按最低位到最高位的顺序排好,就是该符号的霍夫曼编码。

进行霍夫曼编码时,应把合并后的概率放在其他相同概率的信源符号之上,以得到码方差最小的码。

熵是信息量的度量方法,它表示某一事件出现的消息越多,该事件发生的可能性则越小,即是数学上的概率问题。

游程编码基于多分辨率的图像拼接技术图像拼接算法分两类:基于区域相关的拼接算法和基于特征相关的拼接算法。

在关于特征集合匹配的算法中,往往可能由于图像尺寸较大而造成算法的计算量大,因此需要尝试一些尽量减少计算量的算法,金字塔算法就是其中之一。

一般来说,前面提到的,建立在分辨率的变化基础上的匹配算法最为常用,这种由粗到精的分层策略通常开始在一个粗分辨率的参考图像和待拼接图像中,然后再上升到更好的分辨率的时候逐渐提高对应的匹配精度。

在每一层,相应地降低搜索空间,因而节省了必要的计算时间。

另外一个也很重要的优点就是在拼接中比较大的特征点先被匹配,然后才是对更加细节的部分进行比较小的修正。

但是另外一方面,该方法也会在粗糙的分辨率情况下出现错误匹配的而导致匹配的最终失败。

为了克服这个缺陷,返回或者一致性检查经常会被加在这类算法当中。

最近,由于超分辨率的特性,图像的小波分解也在金字塔算法中被提及,在寻找对应的匹配特征集合的时候使用的小波和小波系数可能不同,但但大多数使用的方法是通过两个滤波器将图像分解为四个系数集合(LL,HL,LH,HH),其中L是低通滤波器,H是高通滤波器,分别对图像的行和列进行处理得到的分量,各个分量代表了图像不同特征,以及不同的情况下的分辨率,对不同分量的匹配,也可以得到不同效果以及计算量的匹配结果。

霍夫曼编码c语言

霍夫曼编码c语言霍夫曼编码是一种用于数据压缩的编码技术,它通过重新组织数据中的符号来减少传输或存储数据所需的比特数。

在C语言中实现霍夫曼编码需要掌握数据结构、算法和编码理论的基础知识。

一、霍夫曼编码原理霍夫曼编码的基本原理是利用符号出现的频率来构建一个最优的编码方案,使得编码后的比特率最小。

在霍夫曼图中,每个符号对应一个唯一的路径,路径上的节点表示该符号可能出现的概率。

通过选择概率较大的路径,可以获得较短的编码,从而实现数据压缩。

二、C语言实现霍夫曼编码以下是一个简单的C语言实现霍夫曼编码的示例代码:```c#include<stdio.h>#include<stdlib.h>#include<stdbool.h>//定义霍夫曼树节点结构体typedefstructNode{charsymbol;//符号structNode*left;//左子节点structNode*right;//右子节点intfrequency;//符号频率}Node;//构建霍夫曼树函数Node*buildHuffmanTree(intfrequencies[],intn){//合并相同频率的节点for(inti=0;i<n-1;i++){for(intj=i+1;j<n;j++){if(frequencies[i]==frequencies[j]){ Node*temp=frequencies[i]; frequencies[i]=frequencies[j]; frequencies[j]=temp;mergeNodes(frequencies,i,j);}}}//构建霍夫曼树Node*root=NULL;for(inti=0;i<n;i++){if(root==NULL){root=frequencies[i];}else{Node*child=frequencies[i];child->left=root;root->right=child;root=child;}}returnroot;}//合并两个节点的函数voidmergeNodes(intfrequencies[],inti,intj){frequencies[i]=frequencies[j];//合并节点频率frequencies[j]=NULL;//移除多余节点}//输出霍夫曼编码函数voidprintCodes(Node*root,char*codes[],intindex){if(root==NULL){//如果节点为空,输出编码为空字符串printf("%s",codes[index]);return;}elseif(root->left!=NULL){//如果节点左子节点不为空,输出左子节点的编码作为前缀printCodes(root->left,codes,index*2+1);}elseif(root->right!=NULL){//如果节点右子节点不为空,输出右子节点的编码作为前缀(可用作解码的辅助信息)printCodes(root->right,codes,index*2+2);}else{//如果节点为叶子节点,输出节点的符号作为编码的前缀(去掉重复前缀)并输出当前编码的长度(作为该符号的出现次数)intfreq=root->frequency;//当前符号频率(去掉重复前缀后的频率)while(codes[index]!='\0'){//将前缀放入已使用的字符串数组中以供其他叶子节点使用,重复前缀使用最少的次数(去除重复)并输出当前编码长度和符号本身作为输出结果index--;//指针向后移动一位,直到指针指向'\0'字符为止(已使用的字符串数组)或遇到NULL字符为止(编码数组结束)并返回编码长度和符号本身作为输出结果供其他叶子节点使用和参考。

霍夫曼编码算法

霍夫曼编码算法介绍霍夫曼编码是一种用于数据压缩的算法,由大数学家霍夫曼在1952年提出。

它采用变长编码的方式,将频率高的字符用较短的码字表示,频率低的字符用较长的码字表示,从而实现压缩数据的目的。

霍夫曼编码广泛应用于图像、音频、视频等领域,是现代数字通信的基础。

基本原理霍夫曼编码的基本原理是通过建立一颗霍夫曼树来实现对字符的编码和解码。

具体步骤如下:1.统计字符出现的频率。

遍历待编码的数据,记录每个字符出现的频率。

2.构建霍夫曼树。

将频率作为节点权值,构建一颗二叉树。

频率越高的节点越靠近根节点。

3.分配编码。

从根节点出发,每次遇到左子树就加0,遇到右子树就加1,直到叶子节点。

将路径上的0和1组合起来就得到了字符的编码。

4.生成霍夫曼编码表。

遍历霍夫曼树的所有叶子节点,将每个字符及其对应的编码存储在编码表中。

5.进行编码和解码。

使用生成的霍夫曼编码表,将待编码的数据转换成对应的编码。

解码时,通过从霍夫曼树的根节点开始,依次读取编码位,直到叶子节点得到原始字符。

优势与应用•高效的数据压缩能力。

由于频率高的字符用较短的码字表示,频率低的字符用较长的码字表示,霍夫曼编码可以大幅减少数据的存储空间。

•具有良好的可扩展性。

由于霍夫曼编码基于构建树的思想,可以根据实际应用需要对应用领域的数据进行定制化的编码。

•广泛应用于图像、音频、视频等领域。

霍夫曼编码可以有效地压缩这些类型的数据,减小文件大小,提高传输速度。

•在网络传输中的应用。

霍夫曼编码可以缩短数据传输时间,减少网络带宽消耗。

示例和示意图使用霍夫曼编码进行数据压缩的步骤1.统计字符出现的频率。

字符频率A 4B 2C 1D 1E 62.构建霍夫曼树。

3.分配编码。

字符频率编码A 4 00B 2 01C 1 100D 1 101E 6 114.生成霍夫曼编码表。

字符编码A 00B 01C 100D 101E 115.进行编码和解码。

待编码数据:ABBDCEEE编码后的数据:01000111001111解码后的数据:ABBDCEEE总结霍夫曼编码是一种高效的数据压缩算法,通过根据字符出现的频率构建霍夫曼树,并将每个字符分配一个唯一的编码,实现了对数据的压缩和解压缩。

霍夫曼编码的举例

霍夫曼编码1. 概述霍夫曼编码是一种用于数据压缩的算法,通过将频率较高的字符用较短的编码表示,从而实现对数据的高效压缩。

该编码算法由霍夫曼(David A. Huffman)于1952年提出,被广泛应用于通信、存储等领域。

2. 基本原理霍夫曼编码的基本思想是根据字符出现的频率来构建一棵二叉树,出现频率越高的字符距离根节点越近,从而对其进行更短的编码。

编码过程中,将字符与其对应的编码一一映射,使得每个字符的编码都是唯一的,且没有编码是另一个编码的前缀。

3. 编码过程下面以一个简单的例子来说明霍夫曼编码的过程。

假设有一个字符串:“ABBCCCDDDDEEEEE”,我们需要对其进行编码。

3.1. 统计字符频率首先,我们需要统计每个字符在字符串中出现的频率。

统计结果如下:字符频率A 1B 2C 3D 4E 53.2. 构建霍夫曼树根据字符的频率,我们可以构建一棵霍夫曼树。

构建过程如下:1.将频率最低的两个字符作为叶子节点,创建一个父节点,父节点的频率为两个子节点的频率之和。

2.将父节点插入到频率表中,并删除原来的两个子节点。

3.重复上述步骤,直到只剩下一个节点,即为根节点。

构建过程如下图所示:15/ \5 10/ \ / \A B C D/ \E E3.3. 生成编码表根据霍夫曼树,我们可以生成字符与其对应编码的映射表。

生成过程如下:1.从根节点开始,沿着左子树路径为0,沿着右子树路径为1,将路径上经过的编码记录下来。

2.重复上述步骤,直到遍历到叶子节点,将叶子节点对应的字符和编码记录下来。

生成的编码表如下:字符编码A 00B 01C 10D 11E 11注意:由于霍夫曼树中的叶子节点只有一个字符,因此没有编码会是另一个编码的前缀。

3.4. 进行编码使用生成的编码表,我们可以将原始字符串进行编码。

编码过程如下:将原始字符串中的每个字符替换为其对应的编码,得到编码后的字符串。

原始字符串:“ABBCCCDDDDEEEEE”编码后的字符串:“010101101010101011111111111”3.5. 进行解码使用生成的编码表,我们可以将编码后的字符串进行解码。

霍夫曼编码算法

霍夫曼编码算法

霍夫曼编码算法是一种产生可变长度编码的无损数据压缩算法。

它由

美国数学家霍夫曼(David A. Huffman)于1952年发明,是一种非

常有效的压缩算法。

该算法通过构造一颗霍夫曼树来得出每个字符的

编码。

霍夫曼编码的基本思想是:将出现频率高的字符用短长度的编码表示,而用长编码表示出现频率低的字符。

霍夫曼编码要求编码的前缀码是

无歧义的,即任何一个字符的编码都不是另一个字符编码的前缀。

如此,当解出字符串的特定前缀之后,就可以确定该前缀所表示的唯一

字符。

霍夫曼编码压缩数据的具体步骤如下:

1. 统计出待压缩文件中每个字符出现的频率,即权值;

2. 将它们按权值从小到大排列,每个字符看作一个权重为其出现次数

的节点,构成一个节点森林;

3. 把两个权值最小的森林节点合并成一个新的树,树上节点的权值为

两个被合并的节点权值之和;

4. 重复步骤3,直到所有的节点都被合并成一棵树,即霍夫曼树;

5. 对霍夫曼树进行遍历,将从根节点到每个叶子节点的路径表示为字

符的编码;

6. 将文件中出现的字符依次用它们的编码代替,生成压缩文件。

霍夫曼编码的优点在于,能够根据文件本身的结构和不同字符的出现频率来确定每个字符的编码,从而实现更高效的压缩。

缺点在于,需要构造一棵霍夫曼树,造成一定的时间和空间开销。

同时,由于编码长度的变化,对于随机数据的压缩效果可能不如其他编码算法。

总之,霍夫曼编码是一种非常有效的无损数据压缩算法,广泛应用于文件压缩、通信、多媒体和图像压缩等领域。

霍夫曼编码

2.2.5霍夫曼编码霍夫曼(Huffman)编码是统计编码中的一种。

统计编码是根据消息出现概率的分布特性而进行工作的,它属于无损压缩编码。

这种编码的原理是,在消息和码字之间找到确切的对应关系,以便在能准确无误地恢复。

常用的统计编码除了霍夫曼编码外还有香农-范诺(Shannon-Fano)编码、算术编码等。

霍夫曼编码利用消息符号的统计特性设计的一种编码方法,较多地应用于数字图像处理中。

霍夫曼编码采用码词长度可变的编码方式,即基于不同符号出现的不同概率使用不同的编码位数。

其算法步骤如下:(1) 根据符号概率的大小按递减次序排列。

(2) 把概率最小的两个符号的概率相加,组成新符号的概率。

(3) 重复第(1)(2)步,直到最后两个符号为1为止。

(4) 从后往前进行编码。

每一步有两个数值(概率),各赋予一个二进制数:概率大的赋予0、概率小的赋予1。

也可以对概率大的赋予1、概率小的赋予0,但在编码过程中,赋值必须相同。

例如,字母A、B、C、D、E相应出现的概率为0.35、0.25、0.18、0.12、0.1,霍夫曼编码过程为:完成排序概率第1步第2步第3步第4步0.35 0.35 0.4 0.6 10.25 0.25 0.35 0.40.18 0.22 0.250.12 0.180.1编码(概率大的赋予0、概率小的赋予1)0.35 0.35 0.4 0.6:00.25 0.25 0.35:0 0.4:10.18 0.22:0 0.25:10.12:0 0.18:10.1:1霍夫曼编码为:概率霍夫曼编码码长0.35 00 20.25 01 20.18 11 20.12 100 30.1 101 4由此例可知,霍夫曼编码的长度和符号的概率大小相反,概率大的符号编码长度短,概率小的符号编码长度长。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

四川大学计算机学院2009级戚辅光

【关键字】

霍夫曼编码原理霍夫曼译码原理霍夫曼树霍夫曼编码源代码 霍夫曼编码分析霍夫曼编码的优化霍夫曼编码的应用

【摘要】

哈夫曼编码(Huffman Coding)是一种编码方式,哈夫曼编码是可变字长编码(VLC)的一种。uffman于1952年提出一种编码方法,该方法完全依据字符出现概率来构造异字头的平均长 度最短的码字,有时称之为最佳编码,一般就叫作Huffman编码。哈夫曼压缩是个无损的压缩算法,一般用来压缩文本和程序文件。它属于可变代码长度算法一族。意思是个体符号(例如,文本文件中的字符)用一个特定长度的位序列替代。因此,在文件中出现频率高的符号,使用短的位序列,而那些很少出现的符号,则用较长的位序列。

return ;

}

for(i=1;i<=nNode;i++)

{

j=i;

int h=0;

while(myHuffmantree[j].parent!=j)

{

int x=j;

j=myHuffmantree[j].parent;

if(myHuffmantree[j].ld==x)

{

numOfCode[h++]=0;

myHuffmantree[i].ld=-1; //叶子节点没有左孩子

myHuffmantree[i].rd=-1; //叶子节点没有右孩子

myHuffmantree[i].parent=i; //叶子节点父节点先初始化为他本身

}

for(i=n+1;i<=m;i++)

{

inta,b;

select(a,b);

a:01

c:010

d:011

现在给你一段编码0110101,要求将其译码!

按照上面介绍的方法我们可以直到:

编码的前三个字符是且仅是d的编码,所以011译码为d,依次译码可得整串的译码结果为daa

霍夫曼编码源代码:

#include<iostream>

#include<cstring>

#include<algorithm>

cout<<"-----------霍夫曼树节点信息如下(子节点为-1表示是叶子节点)---------------"<<endl<<endl;

build(nNode);

cout<<endl;

Code();

cout<<"\n-------------------------字符串的编码结果如下--------------------------\n";

intweightOfToCode[100000] ; //字符串的权值!

HuffmantreemyHuffmantree[1000000]; //霍夫曼树(数组模拟)

char allchar[1000000]; //所哟出现过的字符

mycode coder[1000000]; //字符与对应的编码

#include<map>

using namespace std;

#define INF 0x7fffffff //无穷大

structHuffmantree //霍夫曼树的节点

{

int weight;

intparent,ld,rd;

};

structmyNode

{

charch;

intnum;

};

structmycode //字符和其对应的编码

}

}

void Code() //编码

{

inti,j;

intnumOfCode[100000];

cout<<"--------------------------各字符编码结果如下----------------------------"<<endl;

if(Len==1)

{

cout<<toCode[0]<<" : "<<"0\n";

{

myToCode[h].ch=iter->first;

allchar[h]=iter->first;

weightOfToCode[h]=iter->second;

myToCode[h++].num=iter->second;

}

ode=h-1; //叶子节点个数

cout<<"----------------------字符统计如下--------------------------------------"<<endl;

{

coder[i].s[x++]=numOfCode[k];

printf("%d",numOfCode[k]);

}

cout<<endl;

}

}

void select(int&a,int&b) //选择两个权值最小的节点

{

int i;

int min1=INF;

int min2=INF;

int sign1=1; //最小值的下标

【正文】

引言

哈夫曼编码(Huffman Coding)是一种编码方式,哈夫曼编码是可变字长编码(VLC)的一种。uffman于1952年提出一种编码方法,该方法完全依据字符出现概率来构造异字头的平均长度最短的码字,有时称之为最佳编码,一般就叫作Huffman编码。

霍夫曼编码原理:

霍夫曼编码的基本思想:输入一个待编码的串,首先统计串中各字符出现的次数,称之为频次,假设统计频次的数组为count[],则霍夫曼编码每次找出count数组中的值最小的两个分别作为左右孩子,建立他们的父节点,循环这个操作2*n-1-n(n是不同的字符数)次,这样就把霍夫曼树建好了。建树的过程需要注意,首先把count数组里面的n个值初始化为霍夫曼树的n个叶子节点,他们的孩子节点的标号初始化为-1,父节点初始化为他本身的标号。接下来是编码,每次从霍夫曼树的叶子节点出发,依次向上找,假设当前的节点标号是i,那么他的父节点必然是myHuffmantree[i].parent,如果i是myHuffmantree[i].parent的左节点,则该节点的路径为0,如果是右节点,则该节点的路径为1。当向上找到一个节点,他的父节点标号就是他本身,就停止(说明该节点已经是根节点)。还有一个需要注意的地方:在查找当前权值最小的两个节点时,那些父节点不是他本身的节点不能考虑进去,因为这些节点已经被处理过了。

霍夫曼译码原理:

对于霍夫曼的译码,可以肯定的是其译码结果是唯一的。

证明:因为霍夫曼编码是根据霍夫曼树来确定的,霍夫曼树是一棵二叉树,编码的时候是从树根一直往下走,直到走到叶子节点为止,在其经过的路径上,如果是树的左子树则为0,否则为1。因为每一次都要走到树的叶子节点,多以不可能存在两个编码a和b,使得a是b的前缀或者b是a的前缀。所以编码一定可以唯一确定。

int Len; //待编码的字符的总长度

int Coding[100000]; //译码之后的01串

intlenOfCoding ; //01串的长度

void build(int n); //建立霍夫曼树

void select(int&a,int&b); //选择两个权值最小的节点

void Code(); //编码

map<char,int>myMap;

for(i=0;i<len;i++) //统计字符串中各字符出现的频次!

{

myMap[toCode[i]]++;

}

map<char,int>::iterator iter;

int h=1;

for(iter=myMap.begin();iter!=myMap.end();iter++)

sign1=i;

}

}

}

for(i=1;i<=totalNode;i++)

{

if(myHuffmantree[i].parent==i) //说明其是已经更新过的节点

myHuffmantree[i].parent=i;

}

for(i=1;i<=totalNode;i++)

{

printf("节点:%3d权值:%3d左节点:%3d右节点:%3d父节点:%3d \n",i,myHuffmantree[i].weight,myHuffmantree[i].ld,myHuffmantree[i].rd,myHuffmantree[i].parent);

}

else if(myHuffmantree[j].rd==x)

{

numOfCode[h++]=1;

}

}

cout<<" "<<allchar[i]<<" : ";

int x=0;

coder[i].len=h;

coder[i].ch=allchar[i];

for(int k=h-1;k>=0;k--)

int sign2=2; //次小值的下标

for(i=1;i<=totalNode;i++)

{

if(myHuffmantree[i].parent==i) //说明其是已经更新过的节点

{

if(myHuffmantree[i].weight<min1)