Hadoop安装配置超详细步骤

hadoop 大数据环境 安装攻略

先在Bios里面把虚拟机设置为enable第一步:安装虚拟机虚拟光驱VMware-workstation-full-11.0.0-2305329.exe需要注册码的,里面有生成注册码的小软件第二步:解压CentOS65-ori.rar里面有一个txt文档,打开后为用户名:root/hadoophadoop/hadoop(加入sudoers和root组)做好的设置:jdk(JAVA_HOME=/Usr/java/jdk1.8.0_20--有错别字,应该是小写的u)hosts和network做了基本修改ip地址是dhcpmysql安装完毕(utf8编码,root/123456)iptable和selinux都关掉了hadoop用户建立了ssh密钥,root还没有ssh安装了vmwaretools,但不是特别灵敏将CentOS65-ori.rar解压缩后的文件里面的CentOS65-origin.vmx文件直接拖入虚拟机里面。

这样就打开了登陆进去,密码是hadoop第三步:右键启动一个终端输入java –version第四步在虚拟机里面有快照功能,就像是ghost一样,可以随时还原。

可以将Windows里面的文件直接拖入linux虚拟机里面的系统里。

接下来,解压这个文件,拖入到linux虚拟机里面的系统里,郁闷的是没有拖进去,这个地方有问题。

第五步新建一个虚拟机,利用那个4G多的镜像文件。

之后一顿自动的安装,另外一个系统进来了,进到虚拟机里面了,功能更多。

中间貌似出现错误了,但是等待后,继续安装,启动输入密码hh,进入了第五步这个linux系统里面有火狐狸浏览器,进入,登陆baidu,搜索jdk linux,找到合适的jdk下载下载了,安装两个大招:再次关闭防火墙,确认关闭防火墙,重启Ctrl+C 停止配置完毕后,在系统命令行下执行;source~/.bash_profile,使得环境变量配置生效。

可以在系统命令行下输入source接下来,把这个文件.bash_profile 拖入,拖到source后面。

简单梳理hadoop安装流程文字

简单梳理Hadoop安装流程

今儿个咱们来简单梳理下Hadoop的安装流程,让各位在四川的兄弟姐妹也能轻松上手。

首先,你得有个Linux系统,比如说CentOS或者Ubuntu,这点很重要。

然后在系统上整个Java环境,Hadoop 是依赖Java运行的。

把JDK下载安装好后,记得配置下环境变量,就是修改`/etc/profile`文件,把Java的安装路径加进去。

接下来,你需要在系统上整个SSH服务,Hadoop集群内部的通信要用到。

安好SSH后,记得配置下无密钥登录,省得每次登录都要输密码,多麻烦。

Hadoop的安装包可以通过官方渠道下载,也可以在网上找现成的。

下载好安装包后,解压到你的安装目录。

然后就开始配置Hadoop的环境变量,跟配置Java环境变量一样,也是在

`/etc/profile`文件里加路径。

配置Hadoop的文件是重点,都在Hadoop安装目录下的`etc/hadoop`文件夹里。

有`hadoop-env.sh`、`core-site.xml`、`hdfs-site.xml`这些文件需要修改。

比如`core-site.xml`里要设置HDFS的地址和端口,`hdfs-site.xml`里要设置临时目录这些。

最后,就可以开始格式化HDFS了,用`hdfs namenode-format`命令。

然后启动Hadoop,用`start-all.sh`脚本。

如果一

切配置正确,你就可以用`jps`命令看到Hadoop的各个进程在运行了。

这整个过程看似复杂,但只要你跟着步骤来,注意配置文件的路径和内容,相信你也能轻松搞定Hadoop的安装。

Hadoop集群安装详细步骤亲测有效

Hadoop集群安装详细步骤亲测有效第一步:准备硬件环境- 64位操作系统,可以是Linux或者Windows-4核或更高的CPU-8GB或更高的内存-100GB或更大的硬盘空间第二步:准备软件环境- JDK安装:Hadoop运行需要Java环境,所以我们需要先安装JDK。

- SSH配置:在主节点和从节点之间建立SSH连接是Hadoop集群正常运行的前提条件,所以我们需要在主节点上生成SSH密钥,并将公钥分发到从节点上。

第四步:配置Hadoop- core-site.xml:配置Hadoop的核心参数,包括文件系统的默认URI和临时目录等。

例如,可以将`hadoop.tmp.dir`设置为`/tmp/hadoop`。

- hdfs-site.xml:配置Hadoop分布式文件系统的参数,包括副本数量和块大小等。

例如,可以将副本数量设置为`3`。

- yarn-site.xml:配置Hadoop的资源管理系统(YARN)的参数。

例如,可以设置YARN的内存资源分配方式为容器的最大和最小内存均为1GB。

- mapred-site.xml:配置Hadoop的MapReduce框架的参数。

例如,可以设置每个任务容器的内存限制为2GB。

第五步:格式化Hadoop分布式文件系统在主节点上执行以下命令,格式化HDFS文件系统:```hadoop namenode -format```第六步:启动Hadoop集群在主节点上执行以下命令来启动Hadoop集群:```start-all.sh```此命令将启动Hadoop的各个组件,包括NameNode、DataNode、ResourceManager和NodeManager。

第七步:测试Hadoop集群可以使用`jps`命令检查Hadoop的各个进程是否正常运行,例如`NameNode`、`DataNode`、`ResourceManager`和`NodeManager`等进程都应该在运行中。

Hadoop集群安装详细步骤

Hadoop集群安装详细步骤|Hadoop安装配置文章分类:综合技术Hadoop集群安装首先我们统一一下定义,在这里所提到的Hadoop是指Hadoop Common,主要提供DFS(分布式文件存储)与Map/Reduce的核心功能。

Hadoop在windows下还未经过很好的测试,所以笔者推荐大家在linux(cent os 5.X)下安装使用。

准备安装Hadoop集群之前我们得先检验系统是否安装了如下的必备软件:ssh、rsync和Jdk1.6(因为Hadoop需要使用到Jdk中的编译工具,所以一般不直接使用Jre)。

可以使用yum install rsync来安装rsync。

一般来说ssh是默认安装到系统中的。

Jdk1.6的安装方法这里就不多介绍了。

确保以上准备工作完了之后我们就开始安装Hadoop软件,假设我们用三台机器做Hadoop集群,分别是:192.168.1.111、192.168.1.112和192.168.1.113(下文简称111,112和113),且都使用root用户。

下面是在linux平台下安装Hadoop的过程:在所有服务器的同一路径下都进行这几步,就完成了集群Hadoop软件的安装,是不是很简单?没错安装是很简单的,下面就是比较困难的工作了。

集群配置根据Hadoop文档的描述“The Hadoop daemons are N ameNode/DataNode and JobTracker/TaskTracker.”可以看出Hadoop核心守护程序就是由NameNode/DataNode 和JobTracker/TaskTracker这几个角色构成。

Hadoop的DFS需要确立NameNode与DataNode角色,一般NameNode会部署到一台单独的服务器上而不与DataNode共同同一机器。

另外Map/Reduce服务也需要确立JobTracker和TaskTracker的角色,一般JobTracker与NameNode共用一台机器作为master,而TaskTracker与DataNode同属于slave。

centos安装配置hadoop超详细过程

1、集群部署介绍1.1 Hadoop简介Hadoop是Apache软件基金会旗下的一个开源分布式计算平台。

以Hadoop分布式文件系统(HDFS,Hadoop Distributed Filesystem)和MapReduce(Google MapReduce的开源实现)为核心的Hadoop为用户提供了系统底层细节透明的分布式基础架构。

对于Hadoop的集群来讲,可以分成两大类角色:Master和Salve。

一个HDFS集群是由一个NameNode和若干个DataNode组成的。

其中NameNode作为主服务器,管理文件系统的命名空间和客户端对文件系统的访问操作;集群中的DataNode管理存储的数据。

MapReduce框架是由一个单独运行在主节点上的JobTracker和运行在每个集群从节点的TaskTracker共同组成的。

主节点负责调度构成一个作业的所有任务,这些任务分布在不同的从节点上。

主节点监控它们的执行情况,并且重新执行之前的失败任务;从节点仅负责由主节点指派的任务。

当一个Job被提交时,JobTracker接收到提交作业和配置信息之后,就会将配置信息等分发给从节点,同时调度任务并监控TaskTracker的执行。

从上面的介绍可以看出,HDFS和MapReduce共同组成了Hadoop分布式系统体系结构的核心。

HDFS在集群上实现分布式文件系统,MapReduce在集群上实现了分布式计算和任务处理。

HDFS在MapReduce任务处理过程中提供了文件操作和存储等支持,MapReduce在HDFS的基础上实现了任务的分发、跟踪、执行等工作,并收集结果,二者相互作用,完成了Hadoop分布式集群的主要任务。

1.2 环境说明集群中包括4个节点:1个Master,3个Salve,节点之间局域网连接,可以相互ping通,具体集群信息可以查看"Hadoop集群(第2期)"。

节点IP地址分布如下:机器名称IP地址Master.Hadoo p 192.168.1 .2Salve1.Hadoo p 192.168.1 .3Salve2.Hadoo p 192.168.1 .4Salve3.Hadoo p 192.168.1 .5四个节点上均是CentOS6.0系统,并且有一个相同的用户hadoop。

Hadoop的安装及配置

Hadoop的安装及配置Hadoop的安装及配置单节点环境搭配(一)安装JDK。

版本1.7以上。

1、java -version查看是否已经安装2、sudo apt-get update3、sudo apt-get install default-jdk4、java -version 确认安装情况5、which java显示安装路径附:java安装方法:1、源码包准备;2、解压源码包通过终端在/usr/local目录下新建java文件夹,命令行:sudomkdir /usr/local/java然后将下载到压缩包拷贝到java文件夹中,命令行:进入jdk源码包所在目录cp jdk-U161-linux-x64.tar.gz /usr/local/java然后进入java目录,命令行:cd /usr/local/java解压压缩包,命令行:sudo tar xvf jdk-u161-linux-x64.tar.gz然后可以把压缩包删除,命令行:sudo rm jdk-u161-linux-x64.tar.gz3、设置jdk环境变量这里采用全局设置方法,它是是所有用户的共用的环境变量sudogedit ~/.bashrc打开之后在末尾添加//注意每行前后不要有多余的空格export JAVA_HOME=/usr/local/java/jdk1.8.0_161 export JRE_HOME=${JAVA_HOME}/jreexport CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib export PATH=${JAVA_HOME}/bin:$PATH4、java -version看看是否安装成功(二)设置SSH无密码登录1、sudo apt-get install ssh2、sudo apt-get install rsync3、ssh-keygen -t rsa4、ll ~/.ssh 查看生成的密钥(三)hadoop下载安装1、在apache官方网站下载hadoop2、解压tar -zxvf hadoop-2.6.5.tar.gz3、sudo mv hadoop-2.6.5 /usr/local/hadoop4、ll /usr/local/hadoop 查看安装情况(四)hadoop环境变量的设置1、sudogedit ~/.bashrc2、添加下列设置设置HADOOP_HOME为Hadoop的安装路径export HADOOP_HOME=/usr/local/hadoop设置PATHexport PATH=$PATH:$HADOOP_HOME/binexport PATH=$PATH:$HADOOP_HOME/sbin3、Hadoop其他环境变量设置export HADOOP_MAPRED_HOME=$HADOOP_HOMEexport HADOOP_COMMON_HOME=$HADOOP_HOMEexport HADOOP_HDFS_HOME=$HADOOP_HOMEexport YARN_HOME=$HADOOP_HOMEexportHADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/na tiveexport HADOOP_OPTS="-DJava.library.path=$HADOOP_HOME/lib"exportJAVA_LIBRARY_PATH=$HADOOP_HOME/lib/native:$JAVA_LIBRA RY_PATH4、source ~/.bashrc(五)修改Hadoop配置文件1、设置hadoop-env.sh配置文件sudogedit /usr/local/hadoop/etc/hadoop/hadoop-env.sh修改export JAVA_HOME=/usr/local/java/jdk1.8.0_1612、修改core-site.xmlsudo vim /usr/local/hadoop/etc/hadoop/core-site.xml/doc/eb13635280.html,hdfs://localhost:9000。

hadoop安装配置

Hadoop安装配置一、环境配置:jdk版本:1.6以上二、安装jdk1.JDK下载: 下载自解压包: jdk-6u13-linux-i586.bin$sh jdk-6u13-linux-i586.bin 按提示选择yes.或者$chmod 755 jdk-6u13-linux-i586.bin$./jdk-6u13-linux-i586.bin 解压后$mv jdk1.6.0_13 /usr/local/ //将其移到相应目录下到此JDK已经安装完成2.删除原有的JDK (如果之前安装过)$ alternatives –remove java /usr/share/java/libgcj-java-placeholder.sh$ alternatives --remove javac/usr/share/java/libgcj-javac-placeholder.sh$ alternatives --remove jar /usr/bin/fastjar$ alternatives --remove jar.1.gz /usr/share/man/man1/fastjar.1.gz3.创建软连接,方便使用a、删去原有链接(如果之前安装过)到/usr/bin目录下,把原用的java, javac文件删除:$rm –rf java $rm –rf javacb、在/usr/bin 下建立软连接 java$ ln –s jdk1.6.0_13/bin/java /usr/bin/java$ ln -s jdk1.6.0_13/bin/javac /usr/bin/javacc、为了方便后面的工作建立两个软链接:$ cd /usr/local/$ ln -s jdk1.6.0_13 /usr/local/jdk$ ln -s jdk1.6.0_13/jre /usr/local/jre4.编写环境变量:编辑/etc/profile:$ sudo vi /etc/profile增加以下内容:JAVA_HOME=/usr/local/jdkJRE_HOME=/usr/local/jrePATH=$PATH:$JAVA_HOME/bin:JRE_HOME/binCLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar:$JRE_HOME/lib:export JAVA_HOME JRE_HOME PATH CLASSPATH5.使环境变量生效:$ source /etc/profile$ java -version//结果 java version "1.6.0_13" Java(TM) 2 Runtime Environment, StandardEdition (build 1.6.0_13) Java HotSpot(TM) Client VM (build 1.6.0_13, mixedmode, sharing三、安装配置ssh1、下载安装$ sudo apt-get install ssh 自动下载安装$ sudo apt-get install rsync 升级2、设置无密码访问a、在NameNode 上实现无密码登录本机:$ ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa ,直接回车,完成后会在~/.ssh/生成两个文件:id_dsa 和id_dsa.pub。

hadoop集群安装配置的主要操作步骤-概述说明以及解释

hadoop集群安装配置的主要操作步骤-概述说明以及解释1.引言1.1 概述Hadoop是一个开源的分布式计算框架,主要用于处理和存储大规模数据集。

它提供了高度可靠性、容错性和可扩展性的特性,因此被广泛应用于大数据处理领域。

本文旨在介绍Hadoop集群安装配置的主要操作步骤。

在开始具体的操作步骤之前,我们先对Hadoop集群的概念进行简要说明。

Hadoop集群由一组互联的计算机节点组成,其中包含了主节点和多个从节点。

主节点负责调度任务并管理整个集群的资源分配,而从节点则负责实际的数据存储和计算任务执行。

这种分布式的架构使得Hadoop可以高效地处理大规模数据,并实现数据的并行计算。

为了搭建一个Hadoop集群,我们需要进行一系列的安装和配置操作。

主要的操作步骤包括以下几个方面:1. 硬件准备:在开始之前,需要确保所有的计算机节点都满足Hadoop的硬件要求,并配置好网络连接。

2. 软件安装:首先,我们需要下载Hadoop的安装包,并解压到指定的目录。

然后,我们需要安装Java开发环境,因为Hadoop是基于Java 开发的。

3. 配置主节点:在主节点上,我们需要编辑Hadoop的配置文件,包括核心配置文件、HDFS配置文件和YARN配置文件等。

这些配置文件会影响到集群的整体运行方式和资源分配策略。

4. 配置从节点:与配置主节点类似,我们也需要在每个从节点上进行相应的配置。

从节点的配置主要包括核心配置和数据节点配置。

5. 启动集群:在所有节点的配置完成后,我们可以通过启动Hadoop 集群来进行测试和验证。

启动过程中,我们需要确保各个节点之间的通信正常,并且集群的各个组件都能够正常启动和工作。

通过完成以上这些操作步骤,我们就可以成功搭建一个Hadoop集群,并开始进行大数据的处理和分析工作了。

当然,在实际应用中,还会存在更多的细节和需要注意的地方,我们需要根据具体的场景和需求进行相应的调整和扩展。

Hadoop详细安装配置过程

1.下载并安装安装sshsudo apt-get install openssh-server openssh-client3.搭建vsftpd#sudo apt-get update#sudo apt-get install vsftpd配置参考的开始、关闭和重启$sudo /etc/vsftpd start #开始$sudo /etc/vsftpd stop #关闭$sudo /etc/vsftpd restart #重启4.安装sudo chown -R hadoop:hadoop /optcp /soft/ /optsudo vi /etc/profilealias untar='tar -zxvf'sudo source /etc/profilesource /etc/profileuntar jdk*环境变量配置# vi /etc/profile●在profile文件最后加上# set java environmentexport JAVA_HOME=/opt/export CLASSPATH=.:$JAVA_HOME/lib/:$JAVA_HOME/lib/ export PATH=$JAVA_HOME/bin:$PATH配置完成后,保存退出。

●不重启,更新命令#source /etc/profile●测试是否安装成功# Java –version其他问题:出现unable to resolve host 解决方法参考开机时停在Starting sendmail 不动了的解决方案参考安装软件时出现E: Unable to locate package vsftpd 参考vi/vim 使用方法讲解参考分类: Hadoop--------------------------------------------克隆master虚拟机至node1 、node2分别修改master的主机名为master、node1的主机名为node1、node2的主机名为node2 (启动node1、node2系统默认分配递增ip,无需手动修改)分别修改/etc/hosts中的ip和主机名(包含其他节点ip和主机名)---------配置ssh免密码连入hadoop@node1:~$ ssh-keygen -t dsa -P ''-f ~/.ssh/id_dsaGenerating public/private dsa key pair.Created directory '/home/hadoop/.ssh'.Your identification has been saved in/home/hadoop/.ssh/id_dsa.Your public key has been saved in/home/hadoop/.ssh/.The key fingerprint is:SHA256:B8vBju/uc3kl/v9lrMqtltttttCcXgRkQPbVoU hadoop@node1The key's randomart image is:+---[DSA 1024]----+|....||o+.E .||. oo +||..++||o +.o ooo +||=o.. o. ooo. o.||*o....+=o .+++.+|+----[SHA256]-----+hadoop@node1:~$ cd .sshhadoop@node1:~/.ssh$ ll总用量16drwx------ 2 hadoop hadoop 4096 Jul 24 20:31 ./drwxr-xr-x 18 hadoop hadoop 4096 Jul 2420:31../-rw------- 1 hadoop hadoop 668 Jul 24 20:31 id_dsa-rw-r--r-- 1 hadoop hadoop 602 Jul 24 20:31hadoop@node1:~/.ssh$ cat >> authorized_keyshadoop@node1:~/.ssh$ ll总用量20drwx------ 2 hadoop hadoop 4096 Jul 24 20:32 ./drwxr-xr-x 18 hadoop hadoop 4096 Jul 2420:31../-rw-rw-r-- 1 hadoop hadoop 602 Jul 24 20:32 authorized_keys-rw------- 1 hadoop hadoop 668 Jul 24 20:31 id_dsa-rw-r--r-- 1 hadoop hadoop 602 Jul 24 20:31单机回环ssh免密码登录测试hadoop@node1:~/.ssh$ ssh localhostThe authenticity of host'localhost ' can't be established.ECDSA key fingerprint is SHA256:daO0dssyqt12tt9yGUauImOh6tt6A1SgxzSfSmpQqJVEiQTxas. Are you sure you want to continue connecting (yes/no) yesWarning: Permanently added 'localhost'(ECDSA)to the list of known hosts.Welcome to Ubuntu (GNU/Linux x86_64)* Documentation:packages can be updated.178 updates are security updates.New release' LTS' available.Run 'do-release-upgrade'to upgrade to it.Last login: Sun Jul 2420:21:392016from exit注销Connection to localhost closed.hadoop@node1:~/.ssh$出现以上信息说明操作成功,其他两个节点同样操作让主结点(master)能通过SSH免密码登录两个子结点(slave)hadoop@node1:~/.ssh$ scp hadoop@master:~/.ssh/./The authenticity of host'master ' can't be established.ECDSA key fingerprint is SHA256:daO0dssyqtt9yGUuImOh646A1SgxzSfatSmpQqJVEiQTxas.Are you sure you want to continue connecting (yes/no) yesWarning: Permanently added 'master,'(ECDSA)to the list of known hosts.hadoop@master's password:100%603s 00:00 hadoop@node1:~/.ssh$ cat >> authorized_keys如上过程显示了node1结点通过scp命令远程登录master结点,并复制master的公钥文件到当前的目录下,这一过程需要密码验证。

Hadoop完全分布式详细安装过程

Hadoop详细安装过程一、本文思路1、安装虚拟化PC工具VMware,用于支撑Linux系统。

2、在VMware上安装Ubuntu系统。

3、安装Hadoop前的准备工作:安装JDK和SSH服务。

4、配置Hadoop。

5、为了方便开发过程,需安装eclipse。

6、运行一个简单的Hadoop程序:WordCount.java注:在win7系统上,利用虚拟工具VMware建立若干个Linux系统,每个系统为一个节点,构建Hadoop集群。

先在一个虚拟机上将所有需要配置的东西全部完成,然后再利用VMware 的克隆功能,直接生成其他虚拟机,这样做的目的是简单。

二、所需软件1、VMware:VMware Workstation,直接百度下载(在百度软件中心下载即可)。

2、Ubuntu系统:ubuntu-15.04-desktop-amd64.iso,百度网盘:/s/1qWxfxso注:使用15.04版本的Ubuntu(其他版本也可以),是64位系统。

3、jdk:jdk-8u60-linux-x64.tar.gz,网址:/technetwork/java/javase/downloads/jdk8-downloads-2133151.html注:下载64位的Linux版本的jdk。

4、Hadoop:hadoop-1.2.1-bin.tar.gz,网址:/apache/hadoop/common/hadoop-1.2.1/注:选择1.2.1版本的Hadoop。

5、eclipse:eclipse-java-mars-1-linux-gtk-x86_64.tar.gz,网址:/downloads/?osType=linux注:要选择Linux版本的,64位,如下:6、hadoop-eclipse-plugin-1.2.1.jar,这是eclipse的一个插件,用于Hadoop的开发,直接百度下载即可。

三、安装过程1、安装VMware。

hadoop 操作手册

hadoop 操作手册Hadoop 是一个分布式计算框架,它使用 HDFS(Hadoop Distributed File System)存储大量数据,并通过 MapReduce 进行数据处理。

以下是一份简单的 Hadoop 操作手册,介绍了如何安装、配置和使用 Hadoop。

一、安装 Hadoop1. 下载 Hadoop 安装包,并解压到本地目录。

2. 配置 Hadoop 环境变量,将 Hadoop 安装目录添加到 PATH 中。

3. 配置 Hadoop 集群,包括 NameNode、DataNode 和 JobTracker 等节点的配置。

二、配置 Hadoop1. 配置 HDFS,包括 NameNode 和 DataNode 的配置。

2. 配置 MapReduce,包括 JobTracker 和 TaskTracker 的配置。

3. 配置 Hadoop 安全模式,如果需要的话。

三、使用 Hadoop1. 上传文件到 HDFS,使用命令 `hadoop fs -put local_file_path/hdfs_directory`。

2. 查看 HDFS 中的文件和目录信息,使用命令 `hadoop fs -ls /`。

3. 运行 MapReduce 作业,编写 MapReduce 程序,然后使用命令`hadoop jar my_` 运行程序。

4. 查看 MapReduce 作业的运行结果,使用命令 `hadoop fs -cat/output_directory/part-r-00000`。

5. 从 HDFS 中下载文件到本地,使用命令 `hadoop fs -get/hdfs_directory local_directory`。

6. 在 Web 控制台中查看 HDFS 集群信息,在浏览器中打开7. 在 Web 控制台中查看 MapReduce 作业运行情况,在浏览器中打开四、管理 Hadoop1. 启动和停止 Hadoop 集群,使用命令 `` 和 ``。

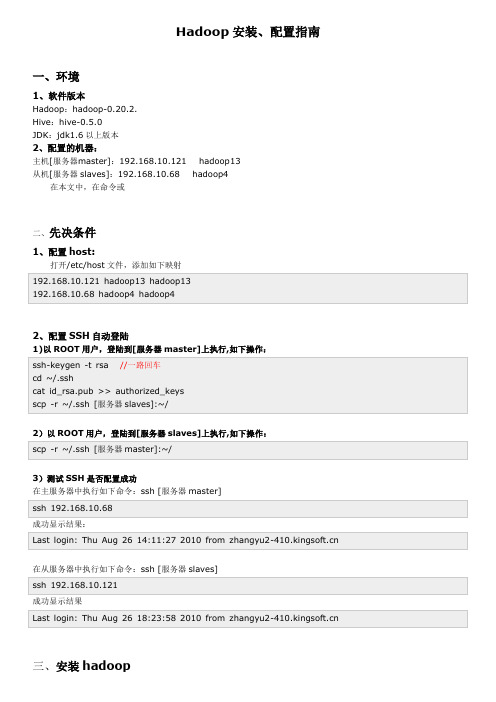

hadoop安装配置指南

Hadoop安装、配置指南一、环境1、软件版本Hadoop:hadoop-0.20.2.Hive:hive-0.5.0JDK:jdk1.6以上版本2、配置的机器:主机[服务器master]:192.168.10.121 hadoop13从机[服务器slaves]:192.168.10.68 hadoop4在本文中,在命令或二、先决条件1、配置host:打开/etc/host文件,添加如下映射192.168.10.121 hadoop13 hadoop13192.168.10.68 hadoop4 hadoop42、配置SSH自动登陆1)以ROOT用户,登陆到[服务器master]上执行,如下操作:ssh-keygen -t rsa //一路回车cd ~/.sshcat id_rsa.pub >> authorized_keysscp -r ~/.ssh [服务器slaves]:~/2)以ROOT用户,登陆到[服务器slaves]上执行,如下操作:scp -r ~/.ssh [服务器master]:~/3)测试SSH是否配置成功在主服务器中执行如下命令:ssh [服务器master]ssh 192.168.10.68成功显示结果:Last login: Thu Aug 26 14:11:27 2010 from 在从服务器中执行如下命令:ssh [服务器slaves]ssh 192.168.10.121成功显示结果Last login: Thu Aug 26 18:23:58 2010 from 三、安装hadoop1、JDK安装,解压到/usr/local/jdk1.6.0_17,并配置/etc/profile环境export JAVA_HOME=/usr/local/jdk/jdk1.7.0export PATH=$JAVA_HOME/bin:$JAVA_HOME/jre:$PATHexport CLASSPATH=$JAVA_HOME/lib:$JAVA_HOME/lib/tools.jarJDK路径:/usr/local/jdk/jdk1.7.0export JAVA_HOME=/usr/local/jdk/jdk1.7.0export PATH=$JAVA_HOME/bin:$JAVA_HOME/jre:$PATHexport CLASSPATH=$JAVA_HOME/lib:$JAVA_HOME/lib/tools.jar/usr/local/jdk/jdk1.7.02、下载Hadoop 并解压到[服务器master]的/root/zwmhadoop目录下tar zxvf hadoop-0.20.2.tar.gz四、配置hadoop1.配置主机[服务器master]到zwm hadoop/hadoop-0.20.2/ hadoop 目录下,修改以下文件:1)配置conf/hadoop-env.sh文件,在文件中添加环境变量,增加以下内容:export JAVA_HOME=/usr/local/jdk1.6.0_17export HADOOP_HOME=/root/zwmhadoop/hadoop-0.20.2/2)配置conf/core-site.xml文件,增加以下内容<?xml version="1.0"?><?xml-stylesheet type="text/xsl" href="configuration.xsl"?><!-- Put site-specific property overrides in this file. --><configuration><property><name></name><value>hdfs://192.168.10.121:9000</value>//你的namenode的配置,机器名加端口<description>The nam e of the default file system. Either the literal string "local" o r a host:port for DFS.</description></property></configuration>3)配置conf/hdfs-site.xml文件,增加以下内容<?xml version="1.0"?><?xml-stylesheet type="text/xsl" href="configuration.xsl"?><!-- Put site-specific property overrides in this file. --><configuration><property><name>hadoop.t m p.dir</name><value>/root/zwmhadoop/t m p</value>//Hadoop的默认临时路径,这个最好配置,然后在新增节点或者其他情况下莫名其妙的DataNode启动不了,就删除此文件中的t mp目录即可。

(完整版)Hadoop安装教程_伪分布式配置_CentOS6.4_Hadoop2.6.0

Hadoop安装教程_伪分布式配置_CentOS6.4/Hadoop2.6.0都能顺利在CentOS 中安装并运行Hadoop。

环境本教程使用CentOS 6.4 32位作为系统环境,请自行安装系统(可参考使用VirtualBox安装CentOS)。

如果用的是Ubuntu 系统,请查看相应的Ubuntu安装Hadoop教程。

本教程基于原生Hadoop 2,在Hadoop 2.6.0 (stable)版本下验证通过,可适合任何Hadoop 2.x.y 版本,例如Hadoop 2.7.1, Hadoop 2.4.1等。

Hadoop版本Hadoop 有两个主要版本,Hadoop 1.x.y 和Hadoop 2.x.y 系列,比较老的教材上用的可能是0.20 这样的版本。

Hadoop 2.x 版本在不断更新,本教程均可适用。

如果需安装0.20,1.2.1这样的版本,本教程也可以作为参考,主要差别在于配置项,配置请参考官网教程或其他教程。

新版是兼容旧版的,书上旧版本的代码应该能够正常运行(我自己没验证,欢迎验证反馈)。

装好了CentOS 系统之后,在安装Hadoop 前还需要做一些必备工作。

创建hadoop用户如果你安装CentOS 的时候不是用的“hadoop” 用户,那么需要增加一个名为hadoop 的用户。

首先点击左上角的“应用程序” -> “系统工具” -> “终端”,首先在终端中输入su,按回车,输入root 密码以root 用户登录,接着执行命令创建新用户hadoop:如下图所示,这条命令创建了可以登陆的hadoop 用户,并使用/bin/bash 作为shell。

CentOS创建hadoop用户接着使用如下命令修改密码,按提示输入两次密码,可简单的设为“hadoop”(密码随意指定,若提示“无效的密码,过于简单”则再次输入确认就行):可为hadoop 用户增加管理员权限,方便部署,避免一些对新手来说比较棘手的权限问题,执行:如下图,找到root ALL=(ALL) ALL这行(应该在第98行,可以先按一下键盘上的ESC键,然后输入:98 (按一下冒号,接着输入98,再按回车键),可以直接跳到第98行),然后在这行下面增加一行内容:hadoop ALL=(ALL) ALL(当中的间隔为tab),如下图所示:为hadoop增加sudo权限添加上一行内容后,先按一下键盘上的ESC键,然后输入:wq (输入冒号还有wq,这是vi/vim编辑器的保存方法),再按回车键保存退出就可以了。

Hadoop安装配置超详细步骤

Hadoop安装配置超详细步骤Hadoop的安装1、实现linux的ssh无密码验证配置.2、修改linux的机器名,并配置/etc/hosts3、在linux下安装jdk,并配好环境变量4、在windows下载hadoop 1.0.1,并修改hadoop-env.sh,core-site.xml,hdfs-site.xml,mapred-site.xml,masters,slaves文件的配置5、创建一个给hadoop备份的文件。

6、把hadoop的bin加入到环境变量7、修改部分运行文件的权限8、格式化hadoop,启动hadoop注意:这个顺序并不是一个写死的顺序,就得按照这个来。

如果你知道原理,可以打乱顺序来操作,比如1、2、3,先哪个后哪个,都没问题,但是有些步骤还是得依靠一些操作完成了才能进行,新手建议按照顺序来。

一、实现linux的ssh无密码验证配置(1)配置理由和原理Hadoop需要使用SSH协议,namenode将使用SSH协议启动namenode和datanode进程,(datanode向namenode传递心跳信息可能也是使用SSH协议,这是我认为的,还没有做深入了解)。

大概意思是,namenode 和datanode之间发命令是靠ssh来发的,发命令肯定是在运行的时候发,发的时候肯定不希望发一次就弹出个框说:有一台机器连接我,让他连吗。

所以就要求后台namenode和datanode 无障碍的进行通信。

以namenode到datanode为例子:namenode作为客户端,要实现无密码公钥认证,连接到服务端datanode上时,需要在namenode上生成一个密钥对,包括一个公钥和一个私钥,而后将公钥复制到datanode上。

当namenode通过ssh连接datanode时,datanode就会生成一个随机数并用namenode的公钥对随机数进行加密,并发送给namenode。

hadoop安装指南(非常详细,包成功)

➢3.10.2.进程➢JpsMaster节点:namenode/tasktracker(如果Master不兼做Slave, 不会出现datanode/TasktrackerSlave节点:datanode/Tasktracker说明:JobTracker 对应于NameNodeTaskTracker 对应于DataNodeDataNode 和NameNode 是针对数据存放来而言的JobTracker和TaskTracker是对于MapReduce执行而言的mapreduce中几个主要概念,mapreduce整体上可以分为这么几条执行线索:jobclient,JobTracker与TaskTracker。

1、JobClient会在用户端通过JobClient类将应用已经配置参数打包成jar文件存储到hdfs,并把路径提交到Jobtracker,然后由JobTracker创建每个Task(即MapTask和ReduceTask)并将它们分发到各个TaskTracker服务中去执行2、JobTracker是一个master服务,软件启动之后JobTracker接收Job,负责调度Job的每一个子任务task运行于TaskTracker上,并监控它们,如果发现有失败的task就重新运行它。

一般情况应该把JobTracker部署在单独的机器上。

3、TaskTracker是运行在多个节点上的slaver服务。

TaskTracker主动与JobTracker通信,接收作业,并负责直接执行每一个任务。

TaskTracker都需要运行在HDFS的DataNode上3.10.3.文件系统HDFS⏹查看文件系统根目录:Hadoop fs–ls /。

hadoop配置和启动详细步骤

1.5. 查看jdk版本

2.配置ssh免密登录2.1.1.生成公钥和私钥

Hale Waihona Puke 2.1.2.复制公钥把公钥复制给需要免密登陆的机器

1把hadoop的hadoop2.6.4.tar.gz文件上传到一台linux系统(主节点)

3.创建一个安装目录

mkdir /root/apps

fs.defaultFS

hdfs://linux9:9000

4.把hadoop-2.6.4解压到这个apps 目录

tar –zxvf hadoop-2.6.4.tar.gz /root/apps

5.配置hadoop的环境变量

vi /etc/profile

让prifile文件生效

source /etc/profile

6.进入hadoop的配置文件目录

7.需要配置五个配置文件7.1. c ore-site.xml

把配置好的hadoop文件分发到所有的从节点

hadoop配置和启动详细步骤

1.配置jdk

1.1. Alt+p调出sftp窗口

1.2. 上传

说明:

如果是上传的文件夹必须是–r

put -r “path/filename”

1.3. 解压缩

1.4. 配置环境变量vi /etc/profile

让这个文件修改后生效

Hadoop集群的搭建和配置

Hadoop集群的搭建和配置Hadoop是一种分布式计算框架,它可以解决大数据处理和分析的问题。

Hadoop由Apache软件基金会开发和维护,它支持可扩展性、容错性、高可用性的分布式计算,并且可以运行在廉价的硬件设备上。

Hadoop集群的搭建和配置需要多个步骤,包括安装Java环境、安装Hadoop软件、配置Hadoop集群、启动Hadoop集群。

以下是这些步骤的详细说明。

第一步:安装Java环境Hadoop运行在Java虚拟机上,所以首先需要安装Java环境。

在Linux系统下,可以使用以下命令安装Java环境。

sudo apt-get install openjdk-8-jdk在其他操作系统下,安装Java环境的方式可能有所不同,请查阅相应的文档。

第二步:安装Hadoop软件Hadoop可以从Apache官方网站上下载最新版本的软件。

下载后,解压缩到指定的目录下即可。

解压缩后的目录结构如下:bin/:包含了Hadoop的可执行文件conf/:包含了Hadoop的配置文件lib/:包含了Hadoop的类库文件sbin/:包含了Hadoop的系统管理命令share/doc/:包含了Hadoop的文档第三步:配置Hadoop集群配置Hadoop集群需要编辑Hadoop的配置文件。

其中最重要的是hadoop-env.sh、core-site.xml、hdfs-site.xml和mapred-site.xml。

hadoop-env.sh:这个文件定义了Hadoop集群的环境变量。

用户需要设置JAVA_HOME、HADOOP_HOME等环境变量的值。

core-site.xml:这个文件定义了Hadoop文件系统的访问方式。

用户需要设置、hadoop.tmp.dir等参数的值。

hdfs-site.xml:这个文件定义了Hadoop分布式文件系统的配置信息。

用户需要设置.dir、dfs.data.dir等参数的值。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Hadoop的安装1、实现linux的ssh无密码验证配置.2、修改linux的机器名,并配置/etc/hosts3、在linux下安装jdk,并配好环境变量4、在windows下载hadoop 1.0.1,并修改hadoop-env.sh,core-site.xml,hdfs-site.xml, mapred-site.xml,masters,slaves文件的配置5、创建一个给hadoop备份的文件。

6、把hadoop的bin加入到环境变量7、修改部分运行文件的权限8、格式化hadoop,启动hadoop注意:这个顺序并不是一个写死的顺序,就得按照这个来。

如果你知道原理,可以打乱顺序来操作,比如1、2、3,先哪个后哪个,都没问题,但是有些步骤还是得依靠一些操作完成了才能进行,新手建议按照顺序来。

一、实现linux的ssh无密码验证配置(1)配置理由和原理Hadoop需要使用SSH协议,namenode将使用SSH协议启动namenode和datanode进程,(datanode向namenode传递心跳信息可能也是使用SSH协议,这是我认为的,还没有做深入了解)。

大概意思是,namenode 和datanode之间发命令是靠ssh来发的,发命令肯定是在运行的时候发,发的时候肯定不希望发一次就弹出个框说:有一台机器连接我,让他连吗。

所以就要求后台namenode和datanode 无障碍的进行通信。

以namenode到datanode为例子:namenode作为客户端,要实现无密码公钥认证,连接到服务端datanode上时,需要在namenode上生成一个密钥对,包括一个公钥和一个私钥,而后将公钥复制到datanode上。

当namenode通过ssh连接datanode时,datanode就会生成一个随机数并用namenode的公钥对随机数进行加密,并发送给namenode。

namenode收到加密数之后再用私钥进行解密,并将解密数回传给datanode,datanode确认解密数无误之后就允许namenode 进行连接了。

这就是一个公钥认证过程,其间不需要用户手工输入密码。

重要过程是将客户端namenode公钥复制到datanode上。

(2)具体操作生成密钥的方法,是操作在namenode上的,在linux上输入ssh-keygen -t rsa 一直回车,可以生成密钥。

我们办公室的namenode上已经有了生成好的密钥,所以不用生成。

只需将namenode上的密钥copy下来,复制到需要装hadoop的电脑上即可。

1、在namenode上找到/root/.ssh 文件,会看到两个文件id_rsa.pub,id_rsa。

然后执行cp id_rsa.pub authorized_keys然后ssh localhost验证是否成功,第一次要你输入yes,以后就不需要了。

(这是自我验证,把id_rsa.pub 文件拷贝到authorized_keys,然后自我检验,自己连自己看看能否成功)2、拷贝密钥方法一:你可以使用WinSCP软件,将authorized_keys文件复制到datanode的/root/.ssh文件里。

方法二:你可以在linux上输入[root@namenode1 ~]# cd /root/.ssh[root@namenode1 .ssh]# lsauthorized_keys id_rsa id_rsa.pub known_hosts[root@namenode1 .ssh]# sz authorized_keys(将文件下载到你电脑)然后在你要装datanode上输入[root@datanode1_3 ~]# cd /root/.ssh[root@datanode1_3 .ssh]# rz(选择文件上传到datanode的对应文件上)将authorized_keys传到datanode的/root/.ssh 上。

方法三:输入命令行:[root@namenode1 .ssh] #scp authorized_keys 192.168.1.109(datanode的IP):/root/.ssh这是拷贝命令,将namenode上的authorized_keys 拷贝到datanode的/root/,ssh 上。

(3)验证配置成功的方法在namenode上输入:ssh datanode的IP地址(或者在hosts文件配置好后,也可以使用datanode的机器名)第一次连接时,会出现一个问题,输入yes,就可以连到datanode的机子上了,无需密码。

root@namenode1 ~]# ssh datanode1_2The authenticity of host 'datanode1_2 (192.168.1.117)' can't be established.RSAkeyfingerprintis2b:3b:84:66:fb:bd:b1:a7:77:ae:49:7 7:52:a8:53:7d.Are you sure you want to continue connecting (yes/no)? yesWarning: Permanently added 'datanode2' (RSA) to the list of known hosts.Last login: Wed Apr 25 15:57:15 2012[root@datanode1_2 ~]#我们可以看到我们已经转到了datanode上了。

注意:(1)当你ssh连到datanode之后,也就是你已经转到了该datanode下,不在原来的机器上了。

你可以输入命令行:#exit 回到原来的机器。

(2)namenode ssh到datanode是不需要密码的,但是datanode ssh到namenode上是需要密码的。

二、修改linux机器名(1)查看主机名在命令行输入:hostname[root@namenode1 /]# cd[root@namenode1 ~]# hostnamenamenode1这是你的主机名。

(2)修改主机名(这一步主要是修改主机,让主机记住分机)1、执行cd /etc/sysconfig,进入/etc/sysconfig目录下2、执行vi network,修改network文件,NETWORKING=yesHOSTNAME=hadoopName(修改成你需要的)把HOSTNAME改成你想要的机器名,办公室的电脑是改成namenode 和datanode,保存。

3、执行cd /etc,进入/etc目录下4、执行vi hosts[root@namenode1 etc]# vi hosts192.168.1.115 namenode1 namenode1192.168.1.116 datanode1_1 datanode1_1192.168.1.117 datenode1_2 datanode1_2192.168.1.111 datenode1_3 datanode1_3192.168.1.109 datenode1_4 datanode1_4127.0.0.1 localhost.localdomain localhost要加入的datanode,把IP地址和机器名加在后面。

这一步是让主机记住datanode的名字。

所以在修改datanode的hosts时,只需写入namenode和你需要加入hadoop机器的datanode的IP地址及机器名就好。

[root@datanode1_4 etc]# vi hosts127.0.0.1 localhost.localdomain localhost192.168.1.115 namenode1 namenode1192.168.1.109 datanode1_4 datanode1_45、输入hostname检查主机名。

重启电脑之后执行hostname命令。

三、安装JDK,并配置环境变量(1)安装JDK先在linux下面建一个目录用来安装jdk,我建的目录是/usr/program,就是以后jdk安装到这个目录下面。

在namenode上已经下载有最新的JDK安装包,不需要重新下载,直接使用。

[root@namenode1 ~]# cd /usr/program/[root@namenode1 program]# lshadoop-1.0.1 hadoop-1.0.1.tar.gz jdk-6u31-linux-x64.bin hadoop-1.0.1.tar jdk1.6.0_31把jdk-6u31-linux-x64.bin 这个文件传到你要安装的datanode的新建目录/usr/program上去。

然后开始安装1、执行chmod +x jdk-6u31-linux-x64.bin,(这是因为这个文件传过来不是可执行的文件,要把他变成可执行文件)。

2、执行 ./jdk-6u31-linux-x64.bin,(1、2步骤都是在/usr/program 目录下执行的,2步骤,一路回车,遇到yes/no? 全部yes,最后会done,安装成功).3、执行 ls,会发现/usr/program 这个目录下有个文件,一个是jdk-6u31-linux-x64.bin就是我们上传上来的,另一个就是jdk1.6.0_31,就是jdk的安装根目录.(2)配置环境变量1、执行 cd /etc, 进入/etc 目录下。

2、执行 vi profile, 修改profile文件在里面加入以下四行(红色部分):HOSTNAME=`/bin/hostname`HISTSIZE=1000if [ -z "$INPUTRC" -a ! -f "$HOME/.inputrc" ]; thenINPUTRC=/etc/inputrcfiexport JA V A_HOME=/usr/program/jdk1.6.0_31export PATH=$JA V A_HOME/bin:$JA V A_HOME/jre/bin:$PATHexport CLASSPATH=.:$JA V A_HOME/lib:$JA V A_HOME/jre/lib# export PATH USER LOGNAME MAIL HOSTNAME HISTSIZE INPUTRC export HADOOP_HOME=/usr/program/hadoop-1.0.1export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbinexport CLASSPATH=$CLASSPATH:$HADOOP_HOME/hadoop-core-1.0.1.jarfor i in /etc/profile.d/*.sh ; doif [ -r "$i" ]; thenif [ "$PS1" ]; then. $ielse. $i >/dev/null 2>&1fifidoneunset iunset pathmunge3、执行chmod +x profile ,把profile变成可执行文件4、执行source profile,把profile里的内容执行生效5、执行,java、javac、java -version 查看是否安装成功.(四)、下载hadoop 1.0.1,并修改hadoop-env.sh,core-site.xml,hdfs-site.xml, mapred-site.xml,masters,slaves文件的配置。