基于hancon双目立体视觉焊缝检测

基于HALCON的双目立体视觉工件尺寸测量

基于HALCON图像处理的焊缝识别与提取方法的研究

基于HALCON图像处理的焊缝识别与提取方法的研究作者:阚仁峰杨龙兴南玉龙来源:《物联网技术》2017年第05期摘要:为了提高传统的焊接效率,基于HALCON图像识别及处理技术,文中提出了一种改进的去“雾”算法并结合暗通道理论来凸显焊缝特征;通过亚像素边缘提取焊缝轮廓;再利用HALCON算子,计算得到焊缝中心轨迹。

实验结果表明,该组合算法能够准确提取出焊缝的基本参数,为后续自动焊接跟踪提供了保障。

关键词:HALCON;去“雾”算法;暗通道;亚像素中图分类号:TH132;TP39 文献标识码:A 文章编号:2095-1302(2017)05-00-030 引言图像处理技术是以计算机视觉为基础,在计算机领域得到广泛应用的技术,包括光学、光电子学、信号处理、图像处理等一系列学科。

在21世纪制造业自动化程度快速发展的时期,图像处理技术已经走向实际生产应用,成为生产过程中的关键技术之一,具有广泛的应用前景[1]。

具有代表性的图像处理软件——HALCON,是德国MVtec公司开发的一套完善的标准的机器视觉算法包,拥有应用广泛的机器视觉集成开发环境,包含了各类滤波、色彩分析、几何数学变换、形态学计算分析、校正、分类、形状搜索等基本图像处理功能,可应用于现代工业上的各类自动化检测。

焊接是两种或两种以上同种或异种材料通过原子或分子之间的结合和扩散连接成一体的工艺过程,已渗透到制造业的各个领域,直接影响到产品的质量、可靠性和寿命以及生产成本、效率和市场反应速度[2]。

鉴于焊接技术的发展现状以及焊接过程中各种因素的影响,焊接需要经过人工打磨的后处理工序才能得到高质量的焊缝,但人工打磨耗时耗力,并且生产周期长,质量得不到保证。

因此利用HALCON机械视觉软件[3,4]对焊缝进行视觉识别与测量,并对后期过程实现智能自动化加工,是一项非常有意义的工作[5]。

本文提出改进的去“雾”算法,在焊缝白亮化的图上,增强焊缝特征,并基于HALCON视觉软件组合一套算法,提取焊缝的轮廓特征及相关参数。

基于HALCON的双目视觉系统深度信息测量技术研究

基于HALCON的双目视觉系统深度信息测量技术研究基于 HALCON 的双目视觉系统深度信息技术研究立体视觉技术是机器人技术研究中最为活跃的一个分支是智能机器人的重要标志双目立体视觉是通过对同一目标的两幅图像提取识别匹配和解释进行三维环境信息的重建其过程主要包括视频捕获摄像机定标图像预处理和特征提取立体匹配以及三维重建为解决智能移动机器人工业装配机器人家用机器人公共服务机器人的视觉问题双目立体视觉技术的进一步研究可对多目视觉具有重要的启发本文对双目立体视觉测深原理和双目视觉系统的结构进行了初步研究其图象处理主要包括图像的获取摄像机标定图像预处理与特征提取立体匹配信息提取等五个部分并且应用 HALCON 软件实现了这些步骤的算法最后对基于HALCON 双目视觉系统测量深度进行了初步编程测试关键字双目视觉系统 HALCON 标定IV基于 HALCON 的双目视觉系统深度信息技术研究AbstractStereo vision technology is one of active branches in the robot technology it is animportant symbol of the intelligent robot Inthe system the three-dimensionalreconstruction environmental information is reconstructedby the objective extractionfrom images identification matching and explanation The process includes videocapture camera calibration image pre-processing and feature extractionthree-dimensional matching and three-dimensional reconstruction In order to solve theproblems about the vision of smart mobile robots industrial robot household robotsrobot visual public service problems the further study on the three-dimensional visiontechnology could inspire to more eyes visionIn the thesis the principle of binocular stereovision measuring depth and thestructure of binocular stereo vision are studied preliminarily Itsimage process includesfive parts such as image acquisition calibrationimage pre-processing and featureextraction three-dimensional matching and information extraction Thehalcon softwareto realize the algorithm of these steps have been applied Finally theexperiment of theprogramming to measure the depth based on the halcon in the binocularvision systemhave been carried and tested preliminaryKey words Binocular vision system halcon CalibrationV基于 HALCON 的双目视觉系统深度信息技术研究目录第一章绪论 111 研究的背景及意义 112 双目立体视觉系统的现状及发展方向 1com 双目视觉系统技术的国内外现状1com 双目立体视觉系统发展方向313 本文的主要研究内容 3第二章双目立体系统测量深度原理 521 双目立体视觉原理 522 体视觉系统的图象处理 6com 图像的获取 6com 摄像机的标定 7com 图像预处理与特征提取9com 图像匹配 9com 获得立体信息 1023 双目视觉系统的结构 11com 系统的结构 11com 双目测量深度的硬件组成12 第三章双目视觉系统深度测量程序设计 1431 本程序的设计思路及程序框图 1432 利用HALCON进行双目测深图像处理结果14 com 获取标定板图像 14com 处理标定板图像 15com 双目视觉系统标定 17com 获取观察物图像 17com 矫正图像 18com 获得中心点 3D信息1833 生成VC程序及制作应用软件20第四章基于halcon双目测深实验结果及误差分析21 41 实验结果 21VI基于 HALCON 的双目视觉系统深度信息技术研究42 误差分析 21第五章设计总结与展望 23参考文献 24致谢 26附录 1 27附录2 38声明 42VII基于 HALCON 的双目视觉系统深度信息技术研究第一章绪论11 研究的背景及意义双目视觉系统技术的研究一直是机器视觉中的热点和难点使用双目立体视觉系统可以确定任意物体的三维轮廓并且可以得到轮廓上任意点的三维坐标因此双目立体视觉系统可以应用在多个领域双目立体视觉系统在机器视觉领域有着广泛的应用前景双目立体视觉是机器视觉的一种重要形式它是基于视差原理并由多幅图像获取物体三维几何信息的方法双目立体视觉系统一般由双摄像机从不同角度同时获得被测物的两幅数字图像或由单摄像机在不同时刻从不同角度获得被测物的两幅数字图像并基于视差原理恢复出物体的三维几何信息重建物体三维轮廓及位置HALCON是德国MVtec公司的图像处理软件是世界公认具有最佳效能的机器视觉软件这是一套图像处理库由一千多个各自独立的函数以及底层的数据管理核心构成其中包含了各类滤波色彩分析以及几何数学变换形态学计算分析校正分类辨识形状搜索等等基本的几何以及图像计算功能由于这些功能大多并非针对特定工作设计的因此只要用得到图像处理的地方就可以用HALCON强大的计算分析能力来完成工作由于机器视觉技术的发展这种可以"取代人眼"对重复工作不会疲劳精度高且稳定的特质促进了高科技业的发展例如电子业[1]产量的大幅提升本文研究了基于 HALCON 实现双目立体视觉系统以及立体视觉的基本理论方法和相关技术搭建双目立体视觉系统和提高算法效率12 双目立体视觉系统的现状及发展方向com 双目视觉系统技术的国内外现状双目视觉系统技术应用非常广泛目前主要应用于四个领域机器人导航操作系统的参数检测三维测量和虚拟现实日本大阪大学自适应机械系统研究院研制了一种自适应双目视觉伺服系统利用双目体视的原理以每幅图像中相对静止的三个标志为参考实时计算目标图像的雅可比矩阵从而预测出目标下一步运动方向实现了对运动方式未知的目标的自适1基于 HALCON 的双目视觉系统深度信息技术研究应跟踪该系统仅要求两幅图像中都有静止的参考标志无需摄像机参数而传统的视觉跟踪伺服系统需事先知道摄像机的运动光学等参数和目标的运动方式日本东京大学将实时双目立体视觉和机器人整体姿态信息集成开发了仿真机器人动态行走导航系统该系统实现分两个步骤首先利用平面分割算法分离所拍摄图像对中的地面与障碍物再结合机器人躯体姿态的信息将图像从摄像机的二维平面坐标系转换到描述躯体姿态的世界坐标系建立机器人周围区域的地图其次根据实时建立的地图进行障碍物检测从而确定机器人的行走方向华盛顿大学与微软公司合作为火星卫星探测者号研制了宽基线立体视觉系统使探测者号能够在火星上对其即将跨越的几千米内的地形进行精确的定位导航系统使用同一个摄像机在探测者的不同位置上拍摄图像对拍摄间距越大基线越宽能观测到越远的地貌系统采用非线性优化得到两次拍摄图像时摄像机的相对准确的位置利用鲁棒性强的最大似然概率法结合高效的立体搜索进行图像匹配得到亚像素精度的视差并根据此视差计算图像对中各点的三维坐标相比传统的体视系统能够更精确地绘制探测者号周围的地貌和以更高的精度观测到更远的地形东南大学电子工程系基于双目立体视觉提出了一种灰度相关多峰值视差绝对值极小化立体匹配新方法可对三维不规则物体偏转线圈的三维空间坐标进行非接触精密测量哈工大采用异构双目活动视觉系统实现了全自主足球机器人导航将一个固定摄像机和一个可以水平旋转的摄像机分别安装在机器人的顶部和中下部可以同时监视不同方位视点体现出比人类视觉优越的一面通过合理的资源分配及协调机制使机器人在视野范围测量精度及处理速度方面达到最佳匹配双目协调技术可使机器人同时捕捉多个有效目标观测相遇目标时通过数据融合也可提高测量精度在实际比赛中其他传感器失效的情况下仅仅依靠双目协调仍然可以实现全自主足球机器人导航火星 863 计划课题人体三维尺寸的非接触测量采用双视点投影光栅三维测量原理由双摄像机获取图像对通过计算机进行图像数据处理不仅可以获取服装设计所需的特征尺寸还可根据需要获取人体图像上任意一点的三维坐标该系统已通过中国人民解放军总后勤部军需部鉴定可达到的技术指标数据采集时间小于5s人提供身高胸围腰围臀围等围度的测量精度不低于10cm[2]2基于 HALCON 的双目视觉系统深度信息技术研究com 双目立体视觉系统发展方向就目前立体视觉技术的发展现状而言要构造出类似于人眼的通用双目立体视觉系统还有很长的路要走进一步的研究方向可归纳如下1如何建立更有效的双目体视模型能更充分地反映立体视觉不确定性的本质属性为匹配提供更多的约束信息降低立体匹配的难度2 探索新的适用于全面立体视觉的计算理论和匹配策略选择有效的匹配准则和算法结构以解决存在灰度失真几何畸变透视旋转缩放等噪声干扰特殊结构平坦匹域重复相似结构等及遮掩景物的匹配问题双目立体视觉这一有着广阔应用前景的学科随着光学电子学以及计算机技术的发展将不断进步逐渐实用化不仅将成为工业检测生物医学虚拟现实等领域的关键技术还有可能应用于航天遥测军事侦察等领域目前在国外双目体视技术已广泛应用于生产生活中而我国正处于初始阶段尚需广大科技工作者共同努力为其发展做出贡献13 本文的主要研究内容立体视觉的基本原理是从两个或多个视点观察同一景物以获取在不同视角下的感知图像通过三角测量原理计算图像象素间的位置偏差即视差来获取物体的三维信息这一过程与人类视觉的立体感知过程是类似的一个完整的双目立体视觉系统一般包括图像的获取摄像机标定图像预处理与特征提取立体匹配信息提取等五个部分本文研究内容为利用 HALCON 软件对图像进行处理通过图像匹配技术得到目标视差从而转化为物体所需的深度信息程序大致关键步骤分为图像获取―摄像机标定-物体识别-深度信息确定分析了各个步骤的相应问题和处理方法并将本课题的重点集中于测量深度信息各种算法 HALCON 软件编程这一部分第一章介绍了本文的研究意义以及双目立体视觉系统的国内外现状和发展方向最后介绍了本文的主要研究内容及章节安排第二章介绍了双目立体视觉原理及结构介绍了双目视觉的技术实现包括图像获取摄像机标定图像预处理与特征提取立体匹配信息提取3基于 HALCON 的双目视觉系统深度信息技术研究第三章研究了应用 HALCON 软件编程各种算法所得的整个程序四个主要步骤标定立体摄像系统获取图像矫正图像获得 3D 信息以及制作 VC 程序和应用软件第四章对基于 HALCON 双目视觉系统测量深度进行了实验对实验结果处理并分析了实验误差第五章最后介绍了本设计的总结及对今后的工作进行了展望4基于 HALCON 的双目视觉系统深度信息技术研究第二章双目立体系统测量深度原理21 双目立体视觉原理双目立体视觉三维测量是基于视差原理图 2-1 所示为简单的平视双目立体成像原理图两摄像机的投影中心分别为O 和O 点P为观察物上的中心点基线距b21为两摄像机的投影中心的连线距离两摄像机的焦距为f且相同左边摄像机的坐标系的原点在摄像机镜头的光心O处坐标系O_ x y z 如图 1 所示左右摄像机的c c c成像平面为O uv和O uv O 和O 分别为左右图像坐标系的原点在摄像机光轴与平21 2 1面的交点实际上摄像机的成像平面在镜头的光心后面f处这里绘制在镜头的光心前面f处成像平面的u轴和v轴和摄像机坐标系O_ x y z 的x 轴和y 轴方向一致c c c c c这样可以简化计算过程图2 -1 双目立体成像原理图点P在左摄像机成像平面和右摄像机成像平面中相应的坐标分别为Pu v 和11 1P u v 假定两摄像机的图像在同一个平面上则P点坐标y 在O uv和O uv系中v2 2 2c1 2坐标相同即v v 由三角几何关系得到215基于 HALCON 的双目视觉系统深度信息技术研究x x b ycu f c u c v v1 v2 f2-11 2 1z z zc c c视差定义为某一点在两幅图像中相应点的位置差其表达式为f bd u u2-21 2zc由此可计算出空间中某点P 在左摄像机坐标系中的坐标为b u1xc db vy c 2-3db fzcd因此只要能够找到空间中某点 P 在左右两个摄像机像面上的相应点并且通过摄像机标定获得摄像机的内外参数就可以确定这个 P 点的三维坐标这样深度信息的测量变为 P 点的 Z 轴之间的差值22 体视觉系统的图象处理一个完整的双目立体视觉系统的图象处理一般包括图像的获取摄像机标定图像预处理与特征提取立体匹配信息提取等五个部分com 图像的获取双目体视的图像获取是由不同位置的两台摄像机CCD 经过移动或旋转拍摄同一幅场景获取立体图像对其模型如图 2-2 假定摄像机C 与 C 的角距和内部参12数都相等两摄像机的光轴互相平行二维成像平面u O v 和u O v 重合P 与P 分1 1 12 2 2 1 2别是空间点P在C 与C 上的成像点但一般情况下两个摄像机的内部参数不可能1 2完全相同摄像机安装时无法看到光轴和成像平面故在实际中难以应用上海交大在理论上对会聚式双目体视系统的测量精度与系统结构参数之间的关系作了详尽分析并通过试验指出对某一特定点进行三角测量该点测量误差与两CCD光轴夹角是一个复杂的函数关系若两摄像头光轴夹角一定则被测坐标系与摄像头坐标系之间距离越大测量得到点距离的误差就越大在满足测量范围的前提下应选择两CCD之间夹角在 50-80 度之间[561012]6基于 HALCON 的双目视觉系统深度信息技术研究图2-2 双摄像机模型com 摄像机的标定计算机视觉的基本任务之一是从摄像机获取的图像信息出发计算三维空间中物体的几何信息而空间物体表面某点的三维几何位置与其在图像中对应点之间的相互关系是由摄像机成像的几何模型决定的这些几何模型参数就是摄像机参数这个过程被称为摄像机标定根据摄像机参数性质可以分为内部参数和外部参数内部参数描述摄像机的内部光学和几何特性如图像中心焦距镜头畸变以及其它系统误差参数等相对于一个世界坐标系的摄像机坐标的三维位置和方向称为外部参数摄像机标定是立体视觉研究的重要组成部分首先建立 4 个坐标系见图 2-3 1 三维世界坐标系O_X YZ Xw ww wYw Zw 为物体点 P 的三维世界坐标 2 摄像机坐标系 O_X Y Z 图中光心到图c c c像平面距离OO 为摄像机有效焦距 f 3 成像平面坐标系 O XY P X Y1 uu u表示针孔模型下 P点的理想成像坐标P X Y 是由透镜径向畸变引起的偏离 Pd d d uX Y 的实际成像平面坐标 4 图像坐标系 O uv 原点 O 在图像平面u u 0 0的左上角每一像素的坐标u v 分别是该像素在数组中的列数和行数所以uv 是以像素为单位的图像坐标系的坐标[2389]7基于HALCON 的双目视觉系统深度信息技术研究图2-3四个坐标系图摄像机内参数的标定和单目视觉系统标定一致双目立体视觉系统的标定主要是指摄像机的内部参数标定后确定视觉系统的结构参数 R 和 T 即两个摄像机之间的位置关系R 和 T 分别为旋转矩阵和平移向量一般方法是采用标准的 2D 或3D 精密靶标通过摄像机图像坐标与三维世界坐标的对应关系求得这些参数具体的标定过程如下1将标定板放置在一个适当的位置使它能够在两个摄像机中均可以完全成像通过标定确定两个摄像机的内部参数以及他们的外部参数R T 与R T1 12 2则R T 表示左摄像机与世界坐标系的相对位置R T 表示右摄像机与世界坐标1 12 2系的相对位置2 假定空间中任意一点在世界坐标系左摄像机坐标系和右摄像机坐标系下的非齐次坐标分别为Xw Xc1 Xc2 则X R X T X R X T 11 2-41 C1 1 2W2 C W 2消去XW 得到1 1 11 2-5X R R X T R R T2 2 C 1 1 2 2 C 1 12两个摄像机之间的位置关系RT可以用以下关系式表示R R R T T R R T 1 1 2-62 1 2 2 1 128基于 HALCON 的双目视觉系统深度信息技术研究com 图像预处理与特征提取由光学成像系统生成的二维图像包含了各种各样的随机噪声和畸变因此需要对原始图像进行预处理突出有用信息抑制无用信息从而改善图像质量图像预处理的目的主要有两个一是改善图像的视觉效果提高图像的清晰度二是使图像变的更有利于计算机的处理便于各种特征分析图像预处理技术包括图像对比度的增强随机噪声的去除边缘特征的加强等特征提取是为了得到匹配赖以进行的图像特征由于目前尚没有一种普遍适用的理论可运用于图像特征的提取从而导致了立体视觉研究中匹配特征的多样性目前常用的匹配特征主要有点特征线特征和区域特征等一般来讲大尺度特征含有较丰富的图像信息在图像中的数目较少易于得到快速的匹配但它们的定位精度差特征提取与描述困难而小尺度特征数目较多其所含信息较少因而在匹配时需要较强的约束准则和匹配策略以克服歧义匹配和提高运算效率良好的匹配特征应具有可区分性不变性稳定性唯一性以及有效解决歧义匹配的能力[1415]com 图像匹配由双目立体视觉系统原理可以看出双目立体视觉是建立在对应点的视差基础之上因此左右图像中各点的匹配关系成为双目立体视觉技术的一个极其重要的问题然而对于实际的立体图像对求解对应问题极富挑战性可以说是双目立体视觉中最困难的一步为了能够增加匹配结果的准确性以及匹配算法的速度在匹配过程中通常会加入下列几种约束1 极线约束在此约束下匹配点已经位于两副图像中相应的极线上2 唯一性约束两副图像中的对应的匹配点有且仅有一个3 视差连续性约束除了遮挡区域和视差不连续区域外视差的变化都是平滑的4 顺序一致性约束位于一副图像极线上的系列点在另一幅图像中极线上有相同的顺序图像匹配的方法有基于图像灰度区域的匹配基于图像特征的匹配和基于解释的匹配或者多种方法结合的匹配针对模板匹配HALCON 提供了许多不同的方法方法的选择取决于图像的数据和需要解决的任务9基于 HALCON 的双目视觉系统深度信息技术研究基于灰度值的匹配gray-value-based macthing 是典型的匹配方法如果物体中灰度值变化不大没缺损部分和混乱这种方法可以被使用这种方法能够处理单一物体实例该实例在查找图像中可以是旋转的基于形状的匹配shape-based macthing 是机器视觉中的先进技术基于形状的匹配不是使用灰度值而是提取并使用轮廓的特征来产生模板和完成匹配在照明的变化和物体灰度值的变化的情况下这种方法得到的效果都是完全一致的他能够处理物体上的缺损部分混乱和噪声而且同一模板的多个实例可被同时发现多个的不同模板也可以被同时使用这种方法允许物体被旋转和缩放基于成分的匹配component-based matching 被认为是一种更高级的基于形状的匹配增强的功能是物体能够包含若干个可旋转和平移的部分旋转和平移是相对于这些部分之间进行的一个简单的例子是一对钳子逻辑上这被认为是一个物体但物体上它包含了两部分成分匹配允许只用一个查找步骤就能处理类似这样的复合物与将各个部分处理为整个特殊模型的方法相比成分匹配的优点在于提高了执行速度和算法的健壮性基于点的匹配point-based matching 目的是为了组合两幅有两幅重叠区域的图像首先在这两幅图像上提取有效点这些点被输入到实际的匹配过程匹配的结果是从一幅图像到另一幅图像映射允许平移旋转缩放和透视失真这种映射的典型应用是把两幅图像结合成一幅更大的图像当然一幅图像也可以作为模板对待另一幅图像则被视为包含需被查找模板实例的图像对待这种方法的优点在于能够处理没有校准的透视失真缺点在于增加了执行时间时间主要被用于有[1]效点的提取com 获得立体信息立体视觉的任务就是得出感兴趣场景的三维信息对于不同的应用可以有不同的要求但最基本的就是要计算目标的深度信息得到三维坐标若需要结果的可视化则可对场景进行重建己知立体成像模型和完成立体匹配后三维信息的恢复是比较容易的重要的是如何提高计算的精确度其影响因素是多方面的如摄像机参数标定图像特征定位的精确程度和立体匹配的准确性等等因此要提高三维重建的精度还需要更深入的研究而本文研究的正是最基本的目标获得深度信息得到三维坐标10基于 HALCON 的双目视觉系统深度信息技术研究23 双目视觉系统的结构com 系统的结构由上述双目视觉系统的基本原理可知为了获得三维空间中某点P 的三维坐标需要在左右两个摄像机像面上都存在该点的相应点立体视觉系统的一般结构为交叉摆放的两个摄像机从不同角度观测同一被测物体如图 2-4 所示为系统结构的实物图图2-4 一般双目立体视觉系统结构的实物图图2-4 所示双目视觉系统中两个真彩色摄像机型号均为 SSE1616两相机光轴中心设计在同一水平面上水平间距设计为 20Omm 且两摄像机之间的为50 度摄像机的图像传感器和镜头的物理参数分别为图像有效尺寸646515晶片尺寸617 H μm617 V μm 镜头焦距 f 16 mm 考虑到本系统为双目立体视觉系统要求双摄像机能够同时采集场景图像所以本文采用的是大恒公司 DH-VT121 视频采集卡它是基于 PC104-Plus 总线开发的可双路同时操作的视频采集卡它具有高品质的图像质量和稳定性因为深度信息的测量变为 P 点在不同位置的 Z 轴之间的差11基于 HALCON 的双目视觉系统深度信息技术研究值这样我们只要识别到一个点就可以因此我设定观察物为一张带有黑圆圈白纸P 点设为黑圆圈的中心点这样通过求得观察物上点P的两个摄像机的图像中相应点的图像坐标便可以由双目立体视觉测量原理求取点P在三维空间坐标基于双摄像机的双目立体视觉系统必须安装在一个稳定的平台上在进行双目视觉系统标定以及应用该系统进行测量时要确保摄像机的内参比如焦距和两个摄像机相对位置关系不能够发生变化如果任何一项发生变化则需要重新对双目立体视觉系统进行标定com 双目测量深度的硬件组成。

基于HALCON的双目摄像机标定

基于HALCON的双目摄像机标定于春和;祁乐阳【摘要】Based on the binocular stereo vision system for the purpose of calibration. The internal and external parameters of stereo vision system of binocular camera are obtained by using HALCON calibration board and comparative experiment by software rich operator platform. The results are accurate and simple. The program is robust and efficient, and can be applied to binocular stereoscopic vision system effectively, which provides a solid foundation for 3D reconstruction of human face based on binocular stereoscopic vision.%基于对双目摄像机立体视觉系统进行标定的目的.采用HALCON标定板,通过软件丰富算子平台进行对比实验得到双目摄像机立体视觉系统的内部参数以及外部参数.算法结果准确,简单易行.其程序鲁棒性强,运算效率高,能够高效的运用到双目立体视觉系统中,为基于双目立体视觉的人脸三维重建提供了坚实的基础.【期刊名称】《电子设计工程》【年(卷),期】2017(025)019【总页数】4页(P190-193)【关键词】刚性转换;双目标定;机器视觉;HALCON标定板【作者】于春和;祁乐阳【作者单位】沈阳航空航天大学电子信息工程学院,辽宁沈阳 110136;沈阳航空航天大学电子信息工程学院,辽宁沈阳 110136【正文语种】中文【中图分类】TN391Abstract:Based on the binocular stereo vision system for the purpose of calibration.The internal and external parameters of stereo vision system of binocular camera are obtained by using HALCON calibration board and comparative experiment by software rich operator platform.The results are accurate and simple.The program is robust and efficient,and can be applied to binocular stereoscopic vision system effectively,which provides a solid foundation for 3D reconstruction of human face based on binocular stereoscopic vision.Key words:rigidity conversion;binocular calibration;machine vision;HALCON calibration plate摄像机标定是机器视觉和摄像测量领域相对基础的工作,同时也是最复杂、困难的工作。

基于焊缝特征的焊接路径视觉辨识方法研究

基于焊缝特征的焊接路径视觉辨识方法研究张国强荆炀(甘肃省特种设备检验检测研究院)摘要针对埋弧多层焊焊接路径规划在线示教引导方法,由于厚板结构热输入量大,焊接过程中发生板件翘曲变形时无法对示教路线进行实时调整的问题,提出一种中厚板多层多道焊焊缝轮廓获取方法及焊接路径规划策略。

搭建了双目立体视觉系统,通过标定、图像校正及滤波等预处理,得到焊缝轮廓特征点三维坐标;通过立体匹配和三维坐标重构得到焊缝轮廓的三维图像;通过对焊缝轮廓表面形貌的分析,针对不同形貌的焊缝特征提出不同的焊接路径规划策略,得到空间三维路径曲线,规划的焊接路径与焊缝特征保持了良好的对应关系。

通过提供的焊缝路径三维坐标为焊枪位姿的实时对中和调整提供了基础数据。

关键词埋弧焊多层多道焊焊接路径双目立体视觉路径规划智能化中图分类号TG441.7文献标识码A文章编号1000-3932(2020)06-0497-06厚板结构多层多道焊在高压容器、船舶等领域广泛应用。

目前厚板结构焊接主要采用埋弧自动焊,但其焊接过程需要人工观察焊枪与坡口或焊道走向,并实时调整焊枪与之对中。

多层多道焊焊接路径的自动识别与规划是实现埋弧焊焊接厚板结构智能化的关键,也是埋弧焊机器人的关键技术。

对于埋弧多层焊焊接路径的规划,—般采用在线示教引导的方法,但在焊接过程中由于厚板结构热输入量大,焊接过程中如果发生板件翘曲变形就无法对示教路线进行实时调整。

机器视觉技术因具有非接触、精度高等优点被广泛应用于测量、跟踪等领域,为焊接路径的获取提供了技术支撑$匕张华军等采用激光条纹获取焊接轮廓特征点的方法,通过焊缝轮廓特征点信息对焊接路径、弧长控制和焊接工艺参数进行调整[2]o张鹏贤等采用单目视觉加激光条纹的方法,对长输管道组对间隙量和错边量进行激光视觉检测;通过双目立体视觉系统建立焊缝轮廓的三维重构图,完成焊宽、余高和填充度的评价$&,'%"笔者通过双目立体视觉系统提取多层多道焊焊缝轮廓,根据焊缝轮廓表面特征信息提出相应的路径规划策略,并通过对获取离散点的拟合给出了一道焊和多道焊的焊接三维路径曲线。

基于HALCON的双目立体视觉系统实现

基于HALCON的双目立体视觉系统实现双目立体视觉系统是一种模拟人眼观察物体的视觉系统,通过两个摄像机模拟人眼的双眼观察物体的方式,获取物体的三维信息。

HALCON是一种广泛应用于机器视觉领域的开发工具,可以用于开发和实现双目立体视觉系统。

双目立体视觉系统通过两个距离较短的摄像机成像同一个场景,利用两个图像的差异来计算场景中物体的深度信息。

在HALCON中,实现双目立体视觉系统的关键步骤包括相机校准、图像获取、图像匹配以及深度计算。

首先,进行相机校准。

双目相机系统的校准是获取准确三维信息的基础,HALCON提供了相机标定工具来获取相机的内参和畸变参数。

通过使用标定板或者特定的标定物体拍摄一组图像,可以通过HALCON的相机标定工具获取相机的校准参数。

接下来,进行图像获取。

使用两个相机同时拍摄同一个场景的图像,获取左右两个相机的图像。

HALCON提供了图像处理的函数和工具,可以方便地读取和处理图像。

然后,进行图像匹配。

通过对左右两个相机的图像进行匹配,找到对应的视差点对。

HALCON提供了多种图像匹配算法,可以根据具体的应用需求选择合适的算法,例如基于相似度的匹配算法、基于特征点的匹配算法等。

最后,进行深度计算。

根据图像匹配得到的视差点对,可以通过三角测量方法计算物体的深度信息。

HALCON提供了三角测量的函数和工具,可以根据视差和相机间的基线距离计算出物体的深度。

除了基本的双目立体视觉系统实现,HALCON还提供了丰富的图像处理和计算机视觉函数,可以进行目标检测、目标跟踪、图像分割等进一步的应用开发。

双目立体视觉系统在智能制造、机器人导航、自动驾驶等领域具有广泛应用。

通过HALCON的支持,可以方便地实现双目立体视觉系统,并为各种应用场景提供高效可靠的解决方案。

总结来说,基于HALCON的双目立体视觉系统实现,需要进行相机校准、图像获取、图像匹配和深度计算等步骤。

HALCON提供了丰富的函数和工具,可以方便地实现这些步骤,并为双目立体视觉系统的应用提供强大的支持。

基于HALCON的双目立体视觉系统实现

因此,只要能够找到空间中某点在左右两个摄像机像面上的相应点,并且通过摄像机标定获得图5 校正后的双目立体视觉系统1.3 双目立体视觉系统标定摄像机内参数的标定和单目视觉系统标定一致,双目立体视觉系统的标定主要是指摄像机的内部参数标定后确定视觉系统的结构参数R和T(即两个摄像机之间的位置关系,R和T分别为旋转矩阵和平移向量)。

一般方法是采用标准的2D或3D精密靶标,通过摄像机图像坐标与三维世界坐标的对应关系求得这些参数。

具体的标定过程如下:1、将标定板放置在一个适当的位置,使它能够在两个摄像机中均可以完全成像。

通过标定确定两个摄像机的内部参数以及他们的外部参数(R1、T1与R2、T2),则R1、T1表示左摄像机与世界坐标系的相对位置,R2、T2表示右摄像机与世界坐标系的相对位置。

2、假定空间中任意一点在世界坐标系、左摄像机坐标系和右摄像机坐标系下的非齐次坐标分别为xw、x1、x2,则:消去xw,得到: 两个摄像机之间的位置关系R、T可以用以下关系式表示:1.4 双目立体视觉中的对应点匹配由双目立体视觉系统原理可以看出双目立体视觉是建立在对应点的视差基础之上,因此左右图像中各点的匹配关系成为双目立体视觉技术的一个极其重要的问题。

然而,对于实际的立体图像对,求解对应问题极富挑战性,可以说是双目立体视觉中最困难的一步。

为了能够增加匹配结果的准确性以及匹配算法的速度,在匹配过程中通常会加入下列几种约束:(1)极线约束。

在此约束下,匹配点已经位于两副图像中相应的极线上。

(2)唯一性约束。

两副图像中的对应的匹配点应该有且仅有一个。

(3)视差连续性约束。

除了遮挡区域和视差不连续区域外,视差的变化都是平滑的。

(4)顺序一致性约束。

位于一副图像极线上的系列点,在另一幅图像中极线上有相同的顺序。

图像匹配的方法有基于图像灰度(区域)的匹配、基于图像特征的匹配和基于解释的匹配或者多种方法结合的匹配。

二.使用HALCON进行双目立体视觉测量本节以电路板高度测量为例,讲述在HALCON中如何方便快捷地实现高效双目立体视觉测量(图像为640*480)。

基于Halcon的固定视点手眼标定方法

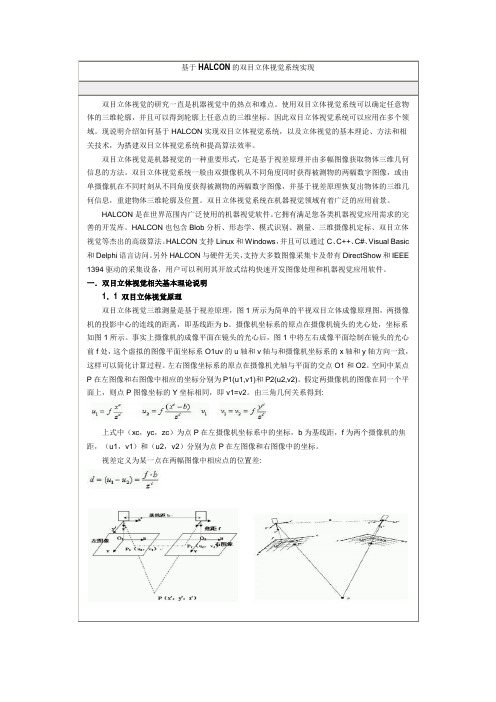

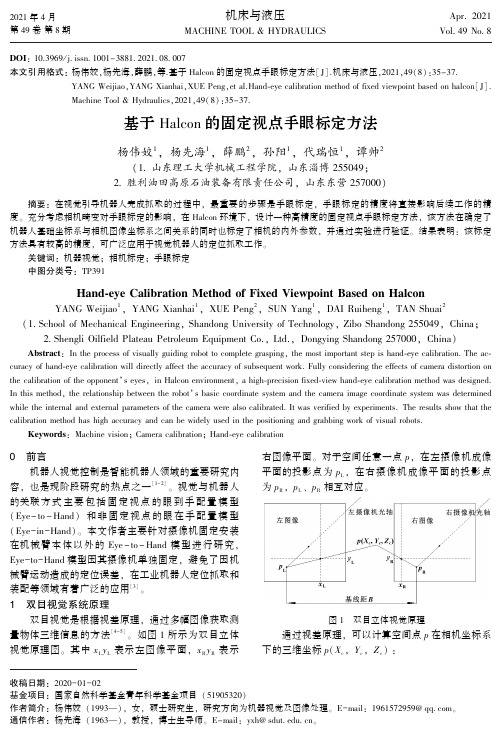

2021年4月第49卷第8期机床与液压MACHINETOOL&HYDRAULICSApr.2021Vol 49No 8DOI:10.3969/j issn 1001-3881 2021 08 007本文引用格式:杨伟姣,杨先海,薛鹏,等.基于Halcon的固定视点手眼标定方法[J].机床与液压,2021,49(8):35-37.YANGWeijiao,YANGXianhai,XUEPeng,etal.Hand⁃eyecalibrationmethodoffixedviewpointbasedonhalcon[J].MachineTool&Hydraulics,2021,49(8):35-37.收稿日期:2020-01-02基金项目:国家自然科学基金青年科学基金项目(51905320)作者简介:杨伟姣(1993 ),女,硕士研究生,研究方向为机器视觉及图像处理㊂E-mail:1961572959@qq com㊂通信作者:杨先海(1963 ),教授,博士生导师㊂E-mail:yxh@sdut edu cn㊂基于Halcon的固定视点手眼标定方法杨伟姣1,杨先海1,薛鹏2,孙阳1,代瑞恒1,谭帅2(1 山东理工大学机械工程学院,山东淄博255049;2 胜利油田高原石油装备有限责任公司,山东东营257000)摘要:在视觉引导机器人完成抓取的过程中,最重要的步骤是手眼标定,手眼标定的精度将直接影响后续工作的精度㊂充分考虑相机畸变对手眼标定的影响,在Halcon环境下,设计一种高精度的固定视点手眼标定方法,该方法在确定了机器人基础坐标系与相机图像坐标系之间关系的同时也标定了相机的内外参数,并通过实验进行验证㊂结果表明:该标定方法具有较高的精度,可广泛应用于视觉机器人的定位抓取工作㊂关键词:机器视觉;相机标定;手眼标定中图分类号:TP391Hand⁃eyeCalibrationMethodofFixedViewpointBasedonHalconYANGWeijiao1,YANGXianhai1,XUEPeng2,SUNYang1,DAIRuiheng1,TANShuai2(1 SchoolofMechanicalEngineering,ShandongUniversityofTechnology,ZiboShandong255049,China;2 ShengliOilfieldPlateauPetroleumEquipmentCo.,Ltd.,DongyingShandong257000,China)Abstract:Intheprocessofvisuallyguidingrobottocompletegrasping,themostimportantstepishand⁃eyecalibration.Theac⁃curacyofhand⁃eyecalibrationwilldirectlyaffecttheaccuracyofsubsequentwork.Fullyconsideringtheeffectsofcameradistortiononthecalibrationoftheopponent seyes,inHalconenvironment,ahigh⁃precisionfixed⁃viewhand⁃eyecalibrationmethodwasdesigned.Inthismethod,therelationshipbetweentherobot sbasiccoordinatesystemandthecameraimagecoordinatesystemwasdeterminedwhiletheinternalandexternalparametersofthecamerawerealsocalibrated.Itwasverifiedbyexperiments.Theresultsshowthatthecalibrationmethodhashighaccuracyandcanbewidelyusedinthepositioningandgrabbingworkofvisualrobots.Keywords:Machinevision;Cameracalibration;Hand⁃eyecalibration0㊀前言机器人视觉控制是智能机器人领域的重要研究内容,也是现阶段研究的热点之一[1-2]㊂视觉与机器人的关联方式主要包括固定视点的眼到手配置模型(Eye-to-Hand)和非固定视点的眼在手配置模型(Eye-in-Hand)㊂本文作者主要针对摄像机固定安装在机械臂本体以外的Eye-to-Hand模型进行研究,Eye-to-Hand模型因其摄像机单独固定,避免了因机械臂运动造成的定位误差,在工业机器人定位抓取和装配等领域有着广泛的应用[3]㊂1㊀双目视觉系统原理双目视觉是根据视差原理,通过多幅图像获取测量物体三维信息的方法[4-5]㊂如图1所示为双目立体视觉原理图㊂其中xLyL表示左图像平面,xRyR表示右图像平面㊂对于空间任意一点p,在左摄像机成像平面的投影点为pL,在右摄像机成像平面的投影点为pR,pL㊁pR相互对应㊂图1㊀双目立体视觉原理通过视差原理,可以计算空间点p在相机坐标系下的三维坐标p(Xc,Yc,Zc):Xc=x-cxfZ=(x-cx)Bd-cx+cxᶄYc=y-cyfZ=y-cy()Bd-cx+cxᶄZc=Bfd-cx+cxᶄìîíïïïïïïïï(1)其中:B为基线距,mm;d为视差,mm;f为相机焦距;cx㊁cxᶄ分别表示左右相机的图像中心与光心x轴水平方向偏移量,mm;cy为左相机图像中心与光轴x轴垂直方向偏移量,mm㊂2㊀摄像机标定坐标转换手眼标定的前提是要进行摄像机标定,求解空间中的世界坐标系与图像像素坐标系的关系,即为摄像机标定过程[6]㊂该过程中涉及的坐标系包括世界坐标系(xw,yw,zw)㊁摄像机坐标系(xc,yc,zc)㊁图像物理坐标系(x,y)㊁图像像素坐标系(u,v)㊂(1)世界坐标系与摄像机坐标系的转换xcyczcéëêêêêùûúúúú=Rxwywzwéëêêêêùûúúúú+T=r11r12r13r21r22r23r31r32r33éëêêêêùûúúúúxwywzwéëêêêêùûúúúú+txtytzéëêêêêùûúúúú(2)其中:R为旋转变换矩阵;T为平移变换矩阵㊂(2)摄像机坐标系与图像坐标系的转换u-u0=x/dx=sxxv-v0=y/dy=syy{(3)(3)世界坐标系与图像坐标系的转换Xf=u-u0fx=r11xw+r12yw+r13zw+txr31xw+r32yw+r33zw+tzYf=v-v0fy=r21xw+r22yw+r23zw+tyr31xw+r32yw+r33zw+tzìîíïïïï(4)将式(3)和式(4)代入式(2),可得齐次坐标为zcuv1éëêêêùûúúú=fx0u000fyv000010éëêêêùûúúúRT0T1éëêêùûúúxwywzw1éëêêêêêùûúúúúú=M1M2X=MX(5)其中:ax=sxfx=fx/dx,ay=syfy=fy/dy;M1为摄像机内部参数;M2为摄像机外部参数㊂3㊀固定视点手眼标定3 1㊀标定模型的建立在机器视觉中,机械手臂抓取运动过程中主要涉及机械臂基坐标系㊁工具坐标系㊁标定板坐标系㊁摄像机坐标系和世界坐标系[7-8]㊂整个过程的变换实质是将图像坐标系的坐标转换为机械臂基坐标的位姿变换㊂固定视点手眼标定模型如图2所示㊂图2㊀Eye-to-Hand模型㊀㊀手眼标定的目标:(1)求解摄像机坐标系下机械手基础坐标位姿camHbase;(2)求解工具坐标系下标定板坐标位姿toolHcal㊂3 2㊀摄像机内参获取本文作者基于Halcon进行标定㊂Halcon是德国MVtec公司开发的图像处理软件,具有完善的综合标准软件库和机器视觉集成开发环境[9]㊂选用Halcon三维标定,该方法可以有效地消除径向畸变和视角畸变,在x㊁y㊁z方向平移和旋转标定板,相机和镜头参数作为标定过程中算子StartCamPar的初值㊂获取摄像机的内参的标定过程如图3所示㊂(1)选择标定板并初始化参数㊂标定过程选用7ˑ7的圆形阵列㊁直径为10mm㊁圆心距为20mm㊁厚度为0 18mm的标定板,在标定初始选择标定文件路径和摄像机参数;(2)图像采集㊂将摄像机固定,机器人末端夹具带动标定板变换至不同空间位置,保存标定板位于㊃63㊃机床与液压第49卷不同位置时的摄像机图像,采集图像15幅,由于Halcon图像采集对光照等条件要求较高,在实时采集过程中需要对标定板位置进行实时调整,采集满足标定要求的标定板图像;(3)提取原点中心并标定㊂提取标定板中阵列分布的原点中心并进行标定,去除图像畸变,获取校正后的摄像机内部参数㊂图4为标定图像㊂图3㊀摄像机内参的标定流程图4㊀标定图像3 3㊀固定视点手眼标定通过机械臂末端工具带动标定板移动到不同位置,标定手眼关系同时获取摄像机内部参数,调用摄像机内参标定得到的二维图像,通过手眼关系的转换得到准确的三维信息,获取手眼标定的目标参数关系㊂获取机械臂末端工具相对于机械臂底座基坐标的位姿baseHtool以及标定板相对于摄像机的位姿camHcal,同时获取摄像机坐标系与机器人工具坐标系之间的相互关系,并得到了工具坐标系相对于相机坐标系的位姿camHtool,从而可以得到手眼标定的结果,即基础坐标系下标定板位姿camHcal:camHcal=camHbase㊃baseHtool㊃toolHcal基于Halcon进行手眼标定的流程如图5所示㊂图5㊀基于Halcon手眼标定流程标定板坐标系相对于基坐标系的位姿计算式为:baseHobj=baseHcam㊃camHobj,表示出最终需要的工件位姿,得到这个位姿便可以给机器人发送运动指令,控制手抓进行抓取任务㊂4㊀实验结果及分析选用BB2双目摄像机和UR5机器人进行实验,摄像机通过支架固定于机械臂末端夹具上方,整个系统可获取摄像机内外参数以及摄像机与机械臂的相对位姿㊂通过文中提出的基于Halcon的标定方法,可以较为准确地获取图2中各坐标系之间的相互转换关系,满足了工业生产中对目标物体的准确抓取和定位工作,得到表1所示的标定结果㊂表1㊀手眼标定结果标定变量标定结果/mm标定变量标定结果/(ʎ)x坐标0.162x轴旋转量90.159y坐标0.002y轴旋转量0.284z坐标0.073z轴旋转量90.065㊀㊀由表1可得标定结果仍存在一些误差㊂分析误差产生的主要原因有:(1)在图像采集过程中会受光照变化等噪声影响产生标定误差;(2)摄像机固有精度所带来的的实际误差;(3)各方面误差的累积影响标定结果㊂5㊀结束语本文作者提出基于Halcon的固定视点手眼标定方法,在获得机器人基础坐标与相机图像坐标之间关系的同时也标定了相机的内外参数㊂实验结果表明该方法标定精度较高,标定方法简便㊂该固定视点的手眼标定方法可广泛应用于流水线生产过程中的分拣和装配等工作㊂参考文献:[1]张艳芳,李倩,刘晓刚,等.基于开放平台的机器人视觉抓取控制系统设计[J].机床与液压,2017,45(21):31-34.ZHANGYF,LIQ,LIUXG,etal.Designofrobotvisiongraspingcontrolsystembasedonopenplatform[J].Ma⁃chineTool&Hydraulics,2017,45(21):31-34.[2]丘椿荣.基于视觉伺服的机器人动态跟踪抓取技术研究[D].武汉:华中科技大学,2019.QIUCR.Studyonroboticdynamicaltrackingandgraspingtechnologybasedonvisualservoing[D].Wuhan:HuazhongUniversityofScienceandTechnology,2019.(下转第71页)㊃73㊃第8期杨伟姣等:基于Halcon的固定视点手眼标定方法㊀㊀㊀TIANJ,NIWG,ZHUSX.Magneticcircuitanalysisandsimulationofshear⁃valvemodemagnetorheologicaldamper[J].ChineseHydraulics&Pneumatics,2015(12):45-48.[9]WANGMK,CHENZB,WERELEYNM.Magnetorheologicaldamperdesigntoimprovevibrationmitigationun⁃deravolumeconstraint[J].SmartMaterialsandStruc⁃tures,2019,28(11):114003.[10]冯彪.飞机前起落架摆振仿真分析与参数优化[D].南京:南京航空航天大学,2012.PENGB.Simulationandoptimizationofaircraftnoseland⁃inggearshimmy[D].Nanjing:NanjingUniversityofAero⁃nauticsandAstronautics,2012.[11]王功成.汽车前轮摆振系统动力学分析与评价平台开发[D].合肥:合肥工业大学,2014.WANGGC.Analysisandevaluationplatformforfrontwheelshimmysystem[D].Hefei:HefeiUniversityofTechnology,2014.[12]许晓龙.基于磁流变减震器的起落架振动仿真平台开发[D].天津:中国民航大学,2015.XUXL.DevelopmentofvibrationsimulationplatformforlandinggearbasedonMRdamper[D].Tianjin:CivilAvi⁃ationUniversityofChina,2015.[13]刘照曦.基于磁流变减震器的起落架落震仿真模块开发[D].天津:中国民航大学,2015.LIUZX.Simulationmodel sexploitationofMRdamperonlandinggear[D].Tianjin:CivilAviationUniversityofChina,2015.[14]田静,王恕浩.飞机前轮摆振影响因素分析[J].机械设计,2019,36(7):52-57.TIANJ,WANGSH.Analysisontheinfluencingfactorofshimmyoftheaircraft snosewheel[J].JournalofMa⁃chineDesign,2019,36(7):52-57.[15]胡挺,吴立军.CATIA二次开发技术基础[M].北京:电子工业出版社,2006.[16]张越.基于VB对CATIA二次开发的非标零件标准化设计研究[D].长春:长春理工大学,2018.ZHANGY.Researchonstandardizationdesignofnon⁃standardpartsbasedonVBCATIAsecondarydevelop⁃ment[D].Changchun:ChangchunUniversityofScienceandTechnology,2018.[17]赵宏强,衡保利,谭青,等.利用MATLAB与VB的传感器静态自动标定技术[J].现代制造工程,2010(5):30-32.ZHAOHQ,HENGBL,TANQ,etal.Sensorstaticauto⁃calibrationtechniquebasedonMATLABandVB[J].ModernManufacturingEngineering,2010(5):30-32.[18]冯雪.基于MATLAB与VB的工频波形分析系统[D].上海:上海交通大学,2009.FENGX.PowerfrequencywaveformanalysissystembasedonMATLABandVB[D].Shanghai:ShanghaiJiaoTongUniversity,2009.[19]LORDCorporation.MRF-132DGmagneto⁃rheoloticalfluid[Z].USA:LORDCorporation,2011.[20]MANJEETK,SUJATHAC.MagnetorheologicalvalvesbasedonHerschel-Bulkleyfluidmodel:modelling,mag⁃netostaticanalysisandgeometricoptimization[J].SmartMaterialsandStructures,2019,28(11):115008.(责任编辑:张艳君)(上接第37页)[3]谢小鹏,彭泽林.一种固定视点的机器人手眼关系标定方法[J].中国测试,2018,44(6):1-5.XIEXP,PENGZL.Ahand⁃eyecalibrationmethodbasedonrobotwithstationaryviewpoint[J].ChinaMeasurement&Test,2018,44(6):1-5.[4]王之凤,张文君,许键.双目智能眼镜视差快速测试系统设计[J].光学技术,2018,44(1):30-34.WANGZF,ZHANGWJ,XUJ.Rapid⁃testingsystemofbinocularsmartglassopticalparallax[J].OpticalTech⁃nique,2018,44(1):30-34.[5]李长春,胡炜,顾寄南,等.上下料机器人视觉测量系统关键技术的研究[J].机床与液压,2018,46(15):68-70.LICC,HUW,GUJN,etal.Researchonkeytechnologyofbinocularvisionmeasurementsystemofloadingandunloa⁃dingrobot[J].MachineTool&Hydraulics,2018,46(15):68-70.[6]胡松,王道累.摄像机标定方法的比较分析[J].上海电力学院学报,2018,34(4):366-370.HUS,WANGDL.Comparativeanalysisofcameracalibra⁃tionmethods[J].JournalofShanghaiUniversityofElectricPower,2018,34(4):366-370.[7]舒奇,黄家才.基于Halcon的机器人手眼标定方法研究[J].南京工程学院学报(自然科学版),2019,17(1):45-49.SHUQ,HAUNGJC.Astudyonrobothand⁃eyecalibrationmethodbasedonHalcon[J].JournalofNanjingInstituteofTechnology(NaturalScienceEdition),2019,17(1):45-49.[8]陆艺,沈添秀,郭小娟,等.线结构光视觉传感器机器人手眼关系标定[J].中国测试,2019,45(10):6-9.LUY,SHENTX,GUOXJ,etal.Robothand⁃eyerelation⁃shipcalibrationbasedonlinestructuredlightvisionsensor[J].ChinaMeasurement&Test,2019,45(10):6-9.[9]田春林,陈李博,马国庆,等.基于Halcon的工业机器人手眼标定方法研究[J].制造业自动化,2018,40(3):16-18.TIANCL,CHENLB,MAGQ,etal.Researchonhand⁃eyecalibrationmethodofindustrialrobotbasedonHalcon[J].ManufacturingAutomation,2018,40(3):16-18.(责任编辑:张艳君)㊃17㊃第8期田静等:基于磁流变减摆器的摆振仿真平台开发㊀㊀㊀。

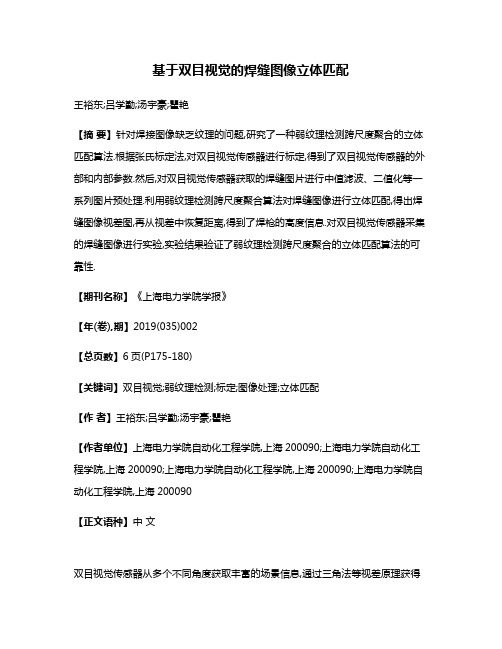

基于双目视觉的焊缝图像立体匹配

基于双目视觉的焊缝图像立体匹配王裕东;吕学勤;汤宇豪;瞿艳【摘要】针对焊接图像缺乏纹理的问题,研究了一种弱纹理检测跨尺度聚合的立体匹配算法.根据张氏标定法,对双目视觉传感器进行标定,得到了双目视觉传感器的外部和内部参数.然后,对双目视觉传感器获取的焊缝图片进行中值滤波、二值化等一系列图片预处理.利用弱纹理检测跨尺度聚合算法对焊缝图像进行立体匹配,得出焊缝图像视差图,再从视差中恢复距离,得到了焊枪的高度信息.对双目视觉传感器采集的焊缝图像进行实验,实验结果验证了弱纹理检测跨尺度聚合的立体匹配算法的可靠性.【期刊名称】《上海电力学院学报》【年(卷),期】2019(035)002【总页数】6页(P175-180)【关键词】双目视觉;弱纹理检测;标定;图像处理;立体匹配【作者】王裕东;吕学勤;汤宇豪;瞿艳【作者单位】上海电力学院自动化工程学院,上海200090;上海电力学院自动化工程学院,上海200090;上海电力学院自动化工程学院,上海200090;上海电力学院自动化工程学院,上海200090【正文语种】中文双目视觉传感器从多个不同角度获取丰富的场景信息,通过三角法等视差原理获得场景内目标物的深度信息,可有效解决单目传感器无法测得目标深度信息的难点[1]。

基于双目视觉传感器的双目立体视觉技术已逐渐应用于各个领域中[2]。

双目立体视觉技术包括图像获取,摄像机标定、图像预处理和立体匹配4个过程。

从二维焊缝图像中提取焊缝特征点的三维信息,需通过视觉传感器标定获取视觉传感器的外部参数和内部参数。

目前,视觉传感器标定方法主要有射影标定法、自标定法、正交消隐法、相机纯旋转标定法和平面模板两步法等[3]。

2016年,长春理工大学的张超等学者[4]提出了一种基于位姿约束的标定算法,是将相对位姿作为约束条件解出双目视觉的初始内部参数,再通过重复迭代剔除误差率较大的标定图像,当误差率小于指定值时得到较精确的双目视觉内部参数。

基于OpenCV的双目立体视觉测距_摄像机标定

基于OpenCV的双目立体视觉测距_摄像机标定论文导读::双目立体视觉模型。

摄像机标定。

立体匹配采用OpenCV库中的块匹配立体算法。

目前的测距方法主要有主动测距和被动测距两种方法。

论文关键词:双目立体视觉,摄像机标定,立体匹配,测距(一)引言基于计算机视觉理论的视觉测距技术是今后发展的一个重要方向,它在机器人壁障系统、汽车导航防撞系统等领域有着广泛的应用前景。

目前的测距方法主要有主动测距和被动测距两种方法。

论文采用的是被动测距法。

被动测距法是在自然光照条件下,根据被测物体本身发出的信号(如光信号)来测量距离,主要包括立体视觉测距法、单目测距法、测角被动测距法等[1]。

立体视觉测距法是仿照人类利用双目感知距离信息的一种测距方法,直接模拟人的双眼处理景物,简便可靠,但该方法的难点是选择合理的匹配特征和匹配准则[2]。

双目立体视觉系统采用两台摄像机同时从两个不同视点获取同一景物的多幅图像,即立体图像对,通过测量景物在立体图像对中的视差,再利用双目视觉成像原理就可以计算出目标到摄像机的距离。

立体匹配采用OpenCV库中的块匹配立体算法,在得到摄像机参数和匹配点后再利用最小二乘法即可算出三维信息。

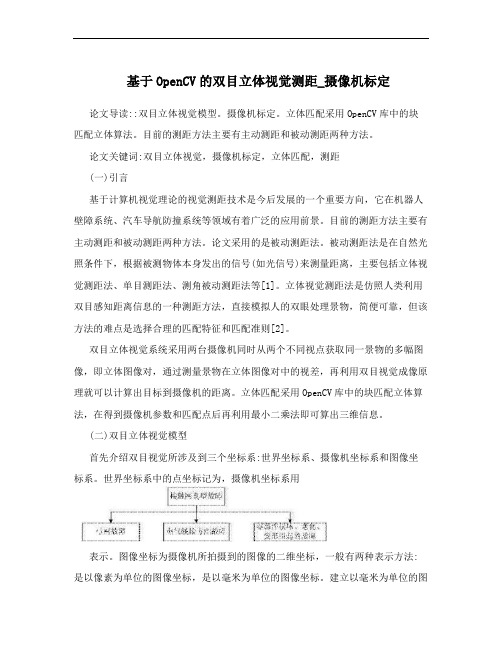

(二)双目立体视觉模型首先介绍双目视觉所涉及到三个坐标系:世界坐标系、摄像机坐标系和图像坐标系。

世界坐标系中的点坐标记为,摄像机坐标系用表示。

图像坐标为摄像机所拍摄到的图像的二维坐标,一般有两种表示方法:是以像素为单位的图像坐标,是以毫米为单位的图像坐标。

建立以毫米为单位的图像坐标是因为坐标只表示了像素在数字图像中的行数和列数,并没有表示出该像素在数字图像中的物理位置[3]论文范文。

图1为平行双目视觉模型,即参数相同的两个摄像机平行放置,两光轴互相平行且都平行于z 轴,x 轴共线摄像机标定,两摄像机光心的距离为B(即基线距)。

图中O1、O2为左右两摄像机的焦点,I1 、I2为左右摄像机的像平面,P1 、P2 分别是空间点P(X,Y,Z)在左右像平面上的成像点,f是摄像机的焦距。

一种基于双目视觉和Halcon的高效机器人手眼标定方法

现代电子技术Modern Electronics Technique2023年7月1日第46卷第13期Jul.2023Vol.46No.130引言随着生产技术发展和产业转型升级,机器人视觉在自动化和智能化的应用越来越广,工业机器人代替人工劳动是发展的趋势[1]。

视觉是机器人的“眼睛”,利用视觉可以实现对机器人的控制和定位,如基于Kinect 视觉功能的机器人控制[2]、基于双目立体视觉的目标识别定位[3]。

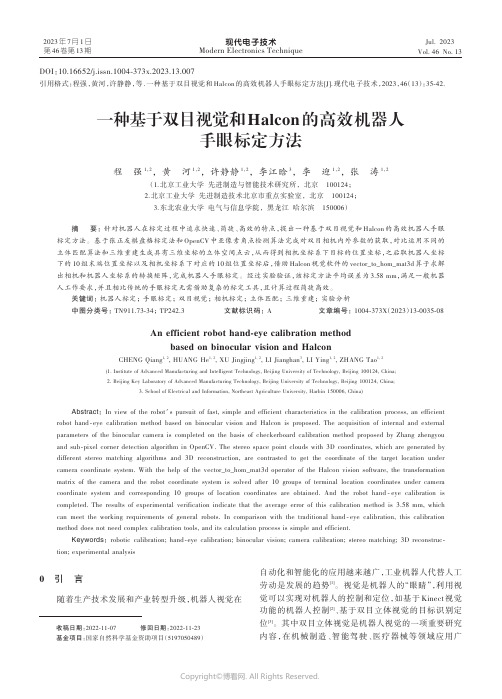

其中双目立体视觉是机器人视觉的一项重要研究内容,在机械制造、智能驾驶、医疗器械等领域应用广一种基于双目视觉和Halcon 的高效机器人手眼标定方法程强1,2,黄河1,2,许静静1,2,李江晗3,李迎1,2,张涛1,2(1.北京工业大学先进制造与智能技术研究所,北京100124;2.北京工业大学先进制造技术北京市重点实验室,北京100124;3.东北农业大学电气与信息学院,黑龙江哈尔滨150006)摘要:针对机器人在标定过程中追求快速、简捷、高效的特点,提出一种基于双目视觉和Halcon 的高效机器人手眼标定方法。

基于张正友棋盘格标定法和OpenCV 中亚像素角点检测算法完成对双目相机内外参数的获取,对比运用不同的立体匹配算法和三维重建生成具有三维坐标的立体空间点云,从而得到相机坐标系下目标的位置坐标,之后取机器人坐标下的10组末端位置坐标以及相机坐标系下对应的10组位置坐标后,借助Halcon 视觉软件的vector_to_hom_mat3d 算子求解出相机和机器人坐标系的转换矩阵,完成机器人手眼标定。

经过实验验证,该标定方法平均误差为3.58mm ,满足一般机器人工作要求,并且相比传统的手眼标定无需借助复杂的标定工具,且计算过程简捷高效。

关键词:机器人标定;手眼标定;双目视觉;相机标定;立体匹配;三维重建;实验分析中图分类号:TN911.73⁃34;TP242.3文献标识码:A文章编号:1004⁃373X (2023)13⁃0035⁃08An efficient robot hand⁃eye calibration methodbased on binocular vision and HalconCHENG Qiang 1,2,HUANG He 1,2,XU Jingjing 1,2,LI Jianghan 3,LI Ying 1,2,ZHANG Tao 1,2(1.Institute of Advanced Manufacturing and Intelligent Technology,Beijing University of Technology,Beijing 100124,China;2.Beijing Key Laboratory of Advanced Manufacturing Technology,Beijing University of Technology,Beijing 100124,China;3.School of Electrical and Information,Northeast Agriculture University,Harbin 150006,China)Abstract :In view of the robot′s pursuit of fast,simple and efficient characteristics in the calibration process,an efficient robot hand ⁃eye calibration method based on binocular vision and Halcon is proposed.The acquisition of internal and external parameters of the binocular camera is completed on the basis of checkerboard calibration method proposed by Zhang zhengyou and sub⁃pixel corner detection algorithm in OpenCV.The stereo space point clouds with 3D coordinates,which are generated by different stereo matching algorithms and 3D reconstruction,are contrasted to get the coordinate of the target location under camera coordinate system.With the help of the vector_to_hom_mat3d operator of the Halcon vision software,the transformation matrix of the camera and the robot coordinate system is solved after 10groups of terminal location coordinates under camera coordinate system and corresponding 10groups of location coordinates are obtained.And the robot hand ⁃eye calibration is completed.The results of experimental verification indicate that the average error of this calibration method is 3.58mm,whichcan meet the working requirements of general robots.In comparison with the traditional hand ⁃eye calibration,this calibration method does not need complex calibration tools,and its calculation process is simple and efficient.Keywords :robotic calibration;hand⁃eye calibration;binocular vision;camera calibration;stereo matching;3D reconstruc⁃tion;experimental analysisDOI :10.16652/j.issn.1004⁃373x.2023.13.007引用格式:程强,黄河,许静静,等.一种基于双目视觉和Halcon 的高效机器人手眼标定方法[J].现代电子技术,2023,46(13):35⁃42.收稿日期:2022⁃11⁃07修回日期:2022⁃11⁃23基金项目:国家自然科学基金资助项目(5197050489)35现代电子技术2023年第46卷泛[4]。

基于双目视觉的待涂装焊缝的识别

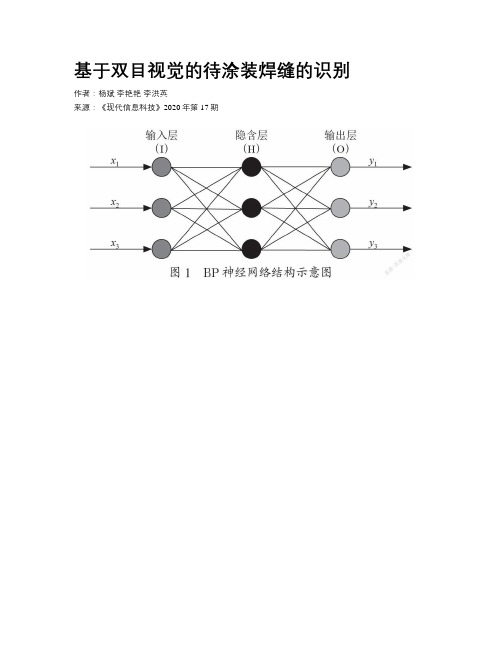

基于双目视觉的待涂装焊缝的识别作者:杨斌李艳艳李洪英来源:《现代信息科技》2020年第17期摘要:在工件涂装的过程中会遇到焊缝差异不易区分和识别的问题,基于此问题文章提出一种基于LeNet-5的待涂装焊缝识别系统。

该系统先将数据增强后的图像进行图像去噪预处理,对LeNet-5卷积神经网络进行模型训练;然后將双目系统实时拍摄的焊缝图像运用训练好的模型实现焊缝类型快速识别;最后根据得出的分类信息引导焊缝涂装机器人进行精准的焊缝喷涂。

实验结果表明,该系统可以快速提取焊缝图像更全面的特征,大大提高了焊缝识别准确率。

关键词:焊缝识别;图像去噪;深度学习;LeNet-5中图分类号:TP242 文献标识码:A 文章编号:2096-4706(2020)17-0149-04Abstract:In the process of the workpiece coating,the welding seam difference is difficult to be distinguished and identified. Based on this problem,this paper proposes a LeNet-5-based welding seam identification system to be coated. The system first carries out image denoising preprocessing after data enhancement,conducts model training for LeNet-5 convolutional neural network,and then applies the trained model to realize rapid recognition of weld types for weld images taken in real time by the binocular system. Finally,according to the obtained classification information,the welding seam coating robot is guided to carry out accurate welding seam spraying. The experimental results show that the system can quickly extract more comprehensive features of weld images and greatly improve the accuracy of weld recognition.Keywords:welding seam identification;image denoising;deep learning;LeNet-50 引言我国是制造大国,在零器件加工和制造行业中焊缝涂装是其零部件生产或者组装过程中不可缺少的重要流程之一。

Halcon-标定双目立体视觉系统

Halcon-标定双目立体视觉系统1.caltab_points( : :CalTabDescrFile:X,Y,Z)从标定文件中读取标定板坐标系中的标定点坐标2.binocular_calibration( : :NX,NY,NZ,NRow1,NCol1, NRow2,NCol2,StartCamParam1,StartCamParam2,NStartPose1, NStartPose2,EstimateParams:CamParam1,CamParam2, NFinalPose1,NFinalPose2,RelPose,Errors)计算立体视觉系统的所有参数参数:NX,NY,NZ:标定点坐标数组;NRow1,NCol1,NRow2,NCol2:标定点的图像坐标数组;StartCamParam1,StartCamParam2:相机1,2的初始内参数;NStartPose1,NStartPose2:标定板在相机1,2的初始位姿;EstimateParams:选择将被计算的相机参数;CamParam1,CamParam2:计算得到的相机1,2的内参数;NFinalPose1,NFinalPose2:所有标定模型在摄像机坐标系中的位姿数组;RelPose:相机2相对于相机1的位姿;Errors:像素距离的平均错位率;3.check_epipolar_constraint(ImageRectifiedL, ImageRectifiedR: :RectCamParL,RectCamParR,WindowHandle1, WindowHandle2:EpipolarError)内部程序,检查并显示极线约束4.gen_binocular_rectification_map( :Map1,Map2: CamParam1,CamParam2,RelPose,SubSampling,Method, MapType:CamParamRect1,CamParamRect2,CamPoseRect1, CamPoseRect2,RelPoseRect)产生变换映射,该映射描述了左右相机对到图像校正后的基平面之间的映射。

基于HALCON的双目视觉株高测量

基于HALCON的双目视觉株高测量作者:郝慧鹏等来源:《电子技术与软件工程》2013年第22期摘要计算机视觉技术是近几年来发展较快的信息处理技术,随着图像处理技术的专业化、计算机硬件成本的降低和速度的提高,计算机视觉的应用已变得越来越广泛。

株高是植物生长指标的重要参数,是一个物种争夺阳光能力的主要决定因素。

为此,本文基于HALCON,利用双目视觉方法对株高进行测量,通过对双目直接测量结果进行误差修正,使得实验得到的结果误差不超过2%,该方法具有一定的可行性。

【关键词】株高 HALCON 双目视觉误差修正1 引言计算机视觉技术是近几年来发展较快的信息处理技术,随着图像处理技术的专业化、计算机硬件成本的降低和速度的提高,计算机视觉的应用已变得越来越广泛,其中不乏在农业中的应用。

株高是植物生长指标的重要参数,是一个物种争夺阳光的能力的主要决定因素[1]。

对于作物来讲,株高参数是作物产量预估不可或缺的参数。

然而对于具体的利用机器视觉方法直接测量株高的研究还是比较少的,本文就是利用HALCON软件,采用双目计算机视觉方法来实现株高的测量。

2 双目视觉原理双目视觉的基本原理是从两个视点观察同一景物,获取不同视角下的两幅图像,然后根据三角测量原理计算不同图像对应像素间的视差(disparity ),获取景物的三维信息,从而实现场景三维重构。

根据两个摄像机位姿的不同,双目视觉有多种模式,常用的有双目横向模式,双目横向会聚模式以及双目纵向模式(也称双目轴向模式)。

为了增加测量精度,基线一般不能太小,但基线长度也不可太长,否则,由于物体各部分相互遮挡,两个摄像机可能不能同时观察到目标点。

图1是会聚双目成像中的视差原理图。

图中给出两镜头连线所在平面(XZ平面),两镜头中心间的距离(即基线)是B,两光轴在XZ平面相交于(0,0,Z)点,交角为(未知)。

现在来看如果已知像平面坐标点(x1, y1)和(x2, y2 ),如何求取世界点W的坐标(X,Y,Z)。

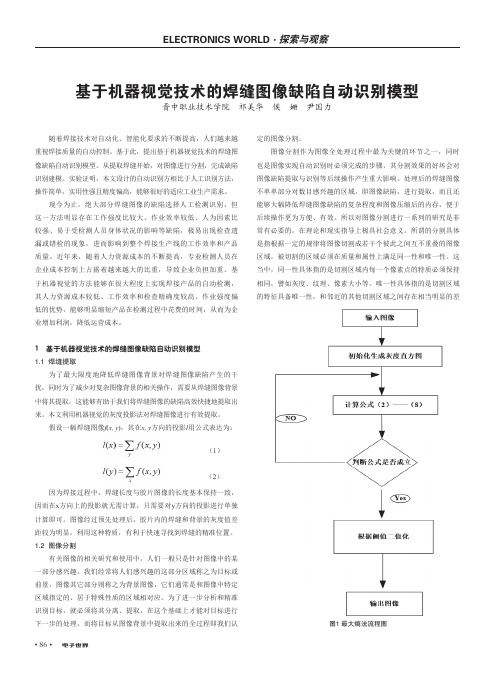

基于机器视觉技术的焊缝图像缺陷自动识别模型

• 86•随着焊接技术对自动化、智能化要求的不断提高,人们越来越重视焊接质量的自动控制。

基于此,提出基于机器视觉技术的焊缝图像缺陷自动识别模型。

从提取焊缝开始,对图像进行分割,完成缺陷识别建模。

实验证明,本文设计的自动识别方相比于人工识别方法,操作简单,实用性强且精度偏高,能够很好的适应工业生产需求。

现今为止,绝大部分焊缝图像的缺陷选择人工检测识别,但这一方法明显存在工作强度比较大、作业效率较低、人为因素比较强、易于受检测人员身体状况的影响等缺陷,极易出现检查遗漏或错检的现象,进而影响到整个焊接生产线的工作效率和产品质量。

近年来,随着人力资源成本的不断提高,专业检测人员在企业成本控制上占据着越来越大的比重,导致企业负担加重。

基于机器视觉的方法能够在很大程度上实现焊接产品的自动检测,其人力资源成本较低、工作效率和检查精确度较高、作业强度偏低的优势,能够明显缩短产品在检测过程中花费的时间,从而为企业增加利润,降低运营成本。

1 基于机器视觉技术的焊缝图像缺陷自动识别模型1.1 焊缝提取为了最大限度地降低焊缝图像背景对焊缝图像缺陷产生的干扰,同时为了减少对复杂图像背景的相关操作,需要从焊缝图像背景中将其提取,这能够有助于我们将焊缝图像的缺陷高效快捷地提取出来。

本文利用机器视觉的灰度投影法对焊缝图像进行有效提取。

假设一幅焊缝图像f (x, y ),其在x, y 方向的投影l 用公式表达为:(1)(2)因为焊接过程中,焊缝长度与胶片图像的长度基本保持一致,因而在x 方向上的投影就无需计算,只需要对y 方向的投影进行单独计算即可。

图像经过预先处理后,胶片内的焊缝和背景的灰度值差距较为明显,利用这种特质,有利于快速寻找到焊缝的精准位置。

1.2 图像分割有关图像的相关研究和使用中,人们一般只是针对图像中的某一部分感兴趣。

我们经常将人们感兴趣的这部分区域称之为目标或前景,图像其它部分则称之为背景图像,它们通常是和图像中特定区域指定的、居于特殊性质的区域相对应。

《基于机器视觉的焊缝识别及其轨迹规划研究》

《基于机器视觉的焊缝识别及其轨迹规划研究》一、引言随着工业自动化和智能制造的快速发展,焊接作为重要的工艺手段,其自动化和智能化水平对于提高生产效率和产品质量具有重要意义。

焊缝识别作为焊接自动化和智能化的关键技术之一,其准确性和效率直接影响到焊接的质量和效率。

本文基于机器视觉技术,对焊缝识别及其轨迹规划进行了深入研究。

二、机器视觉在焊缝识别中的应用机器视觉技术通过图像处理和模式识别等方法,实现对焊缝的自动识别和定位。

在焊接过程中,机器视觉系统通过捕捉焊缝区域的图像信息,利用图像处理算法对焊缝进行识别和定位。

这种技术可以有效地提高焊缝识别的准确性和效率,减少人为操作的误差和干扰。

(一)焊缝图像的获取与预处理焊缝图像的获取是机器视觉识别的基础。

在焊接过程中,通过安装高清摄像头等设备,获取焊缝区域的图像信息。

由于焊接过程中存在光照不均、噪声干扰等问题,需要对获取的图像进行预处理,如去噪、增强等操作,以提高图像的质量和信噪比。

(二)焊缝特征提取与识别通过对预处理后的焊缝图像进行特征提取和识别,可以实现对焊缝的自动识别和定位。

常用的特征提取方法包括边缘检测、轮廓提取、霍夫变换等。

通过这些方法可以提取出焊缝的形状、位置、大小等特征信息,为后续的轨迹规划提供依据。

三、焊缝轨迹规划研究焊缝轨迹规划是实现焊接自动化的关键技术之一。

通过对焊缝轨迹的规划和优化,可以实现对焊接过程的自动化控制,提高焊接质量和效率。

(一)轨迹规划算法研究目前常用的轨迹规划算法包括插值法、拟合法、优化算法等。

插值法通过在已知的离散点之间进行插值,得到连续的轨迹曲线;拟合法则是通过拟合算法将离散的点集拟合成一条光滑的曲线;优化算法则是通过对轨迹曲线进行优化,得到最优的焊接轨迹。

(二)考虑实际因素的轨迹规划在实际的焊接过程中,需要考虑多种因素对轨迹规划的影响,如焊接速度、焊枪姿态、工件形状等。

因此,在轨迹规划过程中需要综合考虑这些因素,以保证焊接质量和效率。

基于hancon双目立体视觉焊缝检测

基于halcon的双目立体视觉焊缝检测基于halcon的双目立体视觉焊缝检测1 前言现代焊接生产中,对焊接技术和质量的要求愈来愈高。

自动化和智能化在焊接生产上的应用日趋广泛。

近年来图像处理技术和机器视觉技术得到空前的发展,如果把机器视觉技术用在焊缝成形质量评判中,可以提高评判效率,为焊接质量评判的智能化打下基础。

机器视觉是运用计算机来模拟人的视觉,从不同事物的图像中获取信息,进行相应处理并加以分析、理解,最终应用于实际的检测与测量等。

机器视觉检测和测量方法不但可以有效提高生产效率与自动化程度,且易于实现信息的集成,从而满足数字化自动化生产的要求。

机器视觉中的立体视觉技术把二维景物的分析推广到了三维景物,该项技术可方便实现从图像获取到三维景物表面重建的完整体系,对于整个机器视觉的发展具有重要意义。

双目立体视觉是立体视觉中的一个重要的分支,它直接模拟人视觉处理景物的方式,可以在各种条件下灵活地测量景的立体信息。

2 双目视觉检测2.1 基本理论如图1 所示,设点P为空间焊缝某一特征点,该点在两相机平面O1和O2的投影点依次为P1和P2。

图1 双目视觉原理根据空间解析几何理论,很显然,式( 3) 中的4个方程均具有平面解析式的形式,前2 方程代表2平面相交,得到的是直线O1P1P 的方程,同理直线O2P2P 的方程由后2 个方程得出。

两直线方程相交,即可求出P 点的空间三维坐标。

可见,若采用单相机模型,则理论上仅能解出一条直线的空间方程,无法得出空间点的准确三维坐标,而双目视觉理论则能够克服这个缺陷,从而使焊缝的精确测量有了可能。

2.2图像处理为实现准确测量的目的,必须对采集到的图像进行数字化处理。

首先,经过相机采集到的焊缝图像不可避免地存在一些污染痕迹,这些痕迹会对有效捕捉焊缝特征点产生影响,这在计算机图形学中被称之为噪点,要进行降噪处理以剔除噪点。

其次,初步采集到的图像为全信息图像,欲提取有效焊缝信息,必须对图像进行二值化处理,以便计算机有效区分焊缝轮面坐标系O -XlYl ,O -XrYr 的转换矩阵分别为Ml 和Mr ,那么根据透镜成像原理,针对左右相机,可得如下2 个方程:111121314112122232431323334=11111111u m mm m v m m m m m mmm llllll l l l l l l X X Y Y Z Z M ⎡⎤⎡⎤⎡⎤⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥=⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦⎣⎦⎣⎦⎣⎦ (1) 211121314r 22122232431323334=11111111u m m m m m m m m m mmmrrrr rr r rr r r r X X Y Y Z Z v M ⎡⎤⎡⎤⎡⎤⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥=⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦⎣⎦⎣⎦⎣⎦ (2) 式中: ( u1,v1,1) 和( u2,v2,1) 依次为p1和p2的齐次相机平面坐标; ( X ,Y ,Z ,1 ) 为点P 在空间绝对坐标系中的齐次坐标。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

基于halcon的双目立体视觉焊缝检测

基于halcon的双目立体视觉焊缝检测

1 前言

现代焊接生产中,对焊接技术和质量的要求愈来愈高。

自动化和智能化在焊接生产上的应用日趋广泛。

近年来图像处理技术和机器视觉技术得到空前的发展,如果把机器视觉技术用在焊缝成形质量评判中,可以提高评判效率,为焊接质量评判的智能化打下基础。

机器视觉是运用计算机来模拟人的视觉,从不同事物的图像中获取信息,进行相应处理并加以分析、理解,最终应用于实际的检测与测量等。

机器视觉检测和测量方法不但可以有效提高生产效率与自动化程度,且易于实现信息的集成,从而满足数字化自动化生产的要求。

机器视觉中的立体视觉技术把二维景物的分析推广到了三维景物,该项技术可方便实现从图像获取到三维景物表面重建的完整体系,对于整个机器视觉的发展具有重要意义。

双目立体视觉是立体视觉中的一个重要的分支,它直接模拟人视觉处理景物的方式,可以在各种条件下灵活地测量景的立体信息。

2 双目视觉检测

2.1 基本理论

如图1 所示,设点P为空间焊缝某一特征点,该点在两相机平面O1和O2的投影点依次为P1和P2。

图1 双目视觉原理

根据空间解析几何理论,很显然,式( 3) 中的4个方程均具有平面解析式的形式,前2 方程代表2平面相交,得到的是直线O1P1P 的方程,同理直线O2P2P 的方程由后2 个方程得出。

两直线方程相交,即可求出P 点的空间三维坐标。

可见,若采用单相机模型,则理论上仅能解出一条直线的空间方程,无法得出空间点的准确三维坐标,而双目视觉理论则能够克服这个缺陷,从而使焊缝的精确测量有了可能。

2.2图像处理

为实现准确测量的目的,必须对采集到的图像进行数字化处理。

首先,经过相机采集到的焊缝图像不可避免地存在一些污染痕迹,这

些痕迹会对有效捕捉焊缝特征点产生影响,这在计算机图形学中被称之为噪点,要进行降噪处理以剔除噪点。

其次,初步采集到的图像为全信息图像,欲提取有效焊缝信息,必须对图像进行二值化处理,以便计算机有效区分焊缝轮面坐标系O -XlYl ,O -XrYr 的转换矩阵分别为Ml 和Mr ,那么根据透镜成像原理,针对左右相机,可得如下2 个方程:

1111213141121

22232431

32

33

34=11111

1

1

1u m m

m m v m m m m m m

m

m l

l

l

l

l l l l l l l l X X Y Y Z Z M ⎡⎤⎡⎤⎡⎤⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥=⎢⎥⎢⎥⎢⎥

⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦⎣⎦

⎣⎦⎣⎦ (1) 211121314r 221

2223243132

33

34=11111

1

1

1u m m m m m m m m m m

m

m

r

r

r

r

r r r r

r

r r r X X Y Y Z Z v M ⎡⎤⎡⎤⎡⎤⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥=⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦⎣⎦

⎣⎦⎣⎦ (2) 式中: ( u1,v1,1) 和( u2,v2,1) 依次为p1和p2的齐次相机平面坐标; ( X ,Y ,Z ,1 ) 为点P 在空间绝对坐标系中的齐次坐标。

将式( 1) 和式( 2) 展开并联立有:

1

1311113212133131434

1

131211322213323243413111131111311114341312113222133()()()()()()()()()()()(l

l

l

l

l

l

l

l

l

l

l

l

l

l

r

r

r

r

r

r

r

r

r

r

r

r

r

X Y Z X Y Z X Y Z X Y u m m u m m u m m m u v m m v m m v m m m u u m m u m m u m m m u v m m v m m v m -+-+-=--+-+-=--+-+-=--+-+-232434

)r

r

r

Z m m u =- (3)

2.3 焊缝检测

设P 和Q 为焊缝图像边缘上的2 个像素点,其经过计算得出的三维坐标为( XP ,YP ,ZP) 和( XQ ,YQ ,ZQ) ,那么,根据空间2点距

离公式有P和Q两点间的距离为:

d=(4) 由此,可计算焊缝边缘上任意两点的距离。

垂直于焊缝轴线并与其轮廓相交的线段长度可认为是焊缝宽度,同时已知空间点坐标也可计算曲线长度,从而有效计算长度。

焊缝高度信息可由左右相机采集到校正后图像立体匹配之后得到的深度图中图像灰度值的变化得到

3 焊缝检测系统

为实现对焊缝检测,需要一套完备的软硬件系统,系统主要结构模块包括图像采集模块、图像处理模块、双目视觉计算模块以及最后的焊缝尺寸计算模块。

下面分别对各个模块进行详细介绍。

3.1 图像采集模块

桥面裂缝检测双目视觉测量系统图像采集模块的核心是双目相机。

本系统两个CCD工业相机,将两个USB工业相机固定在支架上与计算机相连,同过调用halcon程序即可同时采集两幅清晰的焊缝缝图像。

3.2 图像处理模块

图像处理的步骤为:

1) 通过在程序中多次调用算子mean_image对图像进行均值滤波处

理,从而剔除对检测结果不利的噪点。

2) 利用算子emphasize对降噪后的图像进行增强处理,为裂缝边缘检测做准备。

3) 利用算子var_threshold进行自动阈值分割,进而利用算子region_to_bin对图像进行二值化,二值化后图像如图2所示。

图2 二值化焊缝图像

4) 由图2可知焊缝二值化图像效果较差,因此在程序中利用形态学算子closing_circle对图像进行闭运算得到效果较好的二值化图像如图4所示。

图3 二值化图像

5)由图3可知改进后的二值化图像虽仍具有许多孔洞,但利用图3已可以提取焊缝的左右边缘。

在程序中利用halcon算子threshold_sub_pix即可根据二值化图像提取出图像中的轮廓信息,接着通过使用算子select_shape_xld通过对轮廓位置及长度的筛选,提取出焊缝的左右轮廓并滤掉由二值化图像中不需要的孔洞带来的其他轮廓。

提取出的轮廓如图4所示。

6)根据提取出的焊缝的两个轮廓,利用算子distance_cc可计算出两轮廓间最长与最短的坐标距离。

图4 焊缝左右轮廓

3.3 双目视觉计算模块

3.3.1 相机标定

3.1节中对双目视觉基本理论与坐标计算方法作了介绍,其中转换矩阵Ml和Mr中的某些参数是相机的固有属性,称为内参数( 如镜头畸变系数) ,这些参数是已知的。

而将三维空间点投影到二维平面过程中的平移矩阵和旋转矩阵中的参数是未知的,为求解这些参数,以

及得到相机实际内参需要在检测前对相机进行标定。

本文采用自制10cm标定板机halcon标定函数对左右相机进行标定。

经标定之后,相机的内外参数即可求得,代入Ml 和Mr 矩阵,即可参与计算。

3.3.2 图像匹配与尺寸计算

以上分析可见,空间点P 的三维坐标是通过这一点在左右相机平面上的二维坐标计算可得。

因此,从理论上讲,必须精确寻得点P 在左右相机平面中的像点,才能进行准确计算。

这一过程称为图像的匹配过程。

本文中采用halcon自带函数binocular_disparity即可实现图像的匹配。

经匹配计算之后,即可得出同一空间点在两相机平面中的二维坐标。

然后即可得到图像坐标之间与实际物理距离之间比值关系K,根据比例K及上节计算得到的轮廓之间的坐标距离,即可得到两轮廓间的实际物理距离。

将实际得到的结果在halcon图形窗口中显示如下:

图5 程序计算结果

4 结论

系统分析了双目视觉测量理论,从理论上证明了双目视觉技术更适用于尺寸检测。

组建了基于双目视觉技术的焊缝检测系统,说明了双目视觉测量技术在焊缝检测应用方面有较高的可靠度,使之能应用于工程实践。

但是,计算结果表明视觉检测结果与实际值仍有很大误差,系统测量精度需进一步提高。