多重比较统计方法

多重比较常用的方法是

多重比较常用的方法是

以下是多重比较常用的方法:

1. 实验方法:通过设计并进行实验,比较不同组或条件下的结果。

这种方法可以控制变量并确定因果关系。

2. 统计方法:使用统计学分析工具,比较不同组或条件下的数据。

常用的统计方法包括t 检验、方差分析(ANOVA)等。

3. 调查方法:通过问卷调查或面对面访谈等方式收集数据,并比较不同组或条件下的回答。

这种方法可以了解人们的意见、想法和态度。

4. 文献综述:通过查阅已有的文献,比较不同研究的结果和观点。

这种方法可以提供对某个领域内不同研究成果的概览。

5. 模拟方法:使用数学模型或计算机模拟,比较不同条件下的模拟结果。

这种方法可以研究现实中难以操作的情况,或者根据模型预测未来可能的变化。

6. 反事实推理:通过假设不同情况下的结果,比较不同假设下的效果。

这种方法可以推测在不同条件下可能发生的事情。

7. 对照实验:将研究对象分为实验组和对照组,比较两组的差异。

这种方法可

以消除个体差异对研究结果的影响。

8. 直接观察:通过观察不同条件或环境下的现象,比较其差异。

这种方法适用于研究自然界中的现象,如动物行为、天气变化等。

这些方法在不同领域和研究目的下都有广泛应用,可以根据具体情况选择合适的方法进行多重比较。

多重比较方法与统计学中的多样本分析

多重比较方法与统计学中的多样本分析统计学是一门研究数据收集、分析和解释的学科,它在各个领域都起到了重要的作用。

在统计学中,多样本分析是一种常见的研究方法,用于比较两个或多个样本之间的差异。

为了准确地比较不同样本之间的差异,研究人员常常需要使用多重比较方法。

多重比较方法是一种用于控制误差率的统计技术。

在进行多样本分析时,如果不使用多重比较方法,可能会出现错误的结论。

例如,假设我们要比较三组药物对某种疾病的治疗效果,如果我们只进行单个比较,那么可能会得出某个药物比其他两个药物更有效的结论。

然而,如果我们进行多个比较,可能会发现这个结果只是由于偶然性造成的。

在多重比较方法中,最常用的方法之一是Bonferroni校正。

Bonferroni校正是一种简单但有效的方法,它通过将显著性水平除以比较的次数来控制错误率。

例如,如果我们进行了三个比较,显著性水平设定为0.05,那么在Bonferroni校正下,每个比较的显著性水平将为0.05/3=0.0167。

这样,我们就可以更准确地判断不同样本之间的差异是否显著。

除了Bonferroni校正,还有其他一些常用的多重比较方法,如Holm-Bonferroni方法、Tukey方法和Scheffe方法等。

这些方法在控制误差率的同时,还考虑了样本之间的相关性和方差的不等性。

根据实际情况,研究人员可以选择适合自己研究的多重比较方法。

在实际应用中,多样本分析和多重比较方法被广泛应用于各个领域。

例如,在医学研究中,研究人员常常需要比较不同治疗方法的效果;在社会科学研究中,研究人员常常需要比较不同群体之间的差异。

通过使用多样本分析和多重比较方法,研究人员可以更准确地了解不同样本之间的差异,从而为实际问题的解决提供科学依据。

然而,多重比较方法也存在一些限制。

首先,多重比较方法只能用于比较离散型变量或连续型变量的差异,对于其他类型的数据,如时间序列数据或多级分类数据,需要使用其他的分析方法。

lsd多重比较法的定义

lsd多重比较法的定义

LSD多重比较法(LSD-Mean Multiple Comparison Test)是一种用于统计学中多个组间比较的方法。

它被广泛应用于实验设计和数据分析中,用于确定不同组之间是否存在显著差异。

LSD多重比较法的基本思想是将每个组的均值与其他组的均值进行两两比较,然后根据比较结果进行显著性判断。

具体步骤如下:

1. 计算每个组的均值。

2. 对于每个组,计算其均值与其他组均值之间的差异。

3. 根据差异的大小和标准误差,计算每个差异的显著性水平。

4. 对于每个组,将其与其他组的显著性水平进行比较,确定是否存在显著差异。

5. 如果存在显著差异,可以使用其他方法(如置信区间)来进一步描述差异的大小。

LSD多重比较法的优点是简单易用,计算方便。

然而,它也有一定的局限性,比如不适用于大样本量或不符合正态分布的数据。

此外,由于进行多次比较,可能增加了第一类错误(拒绝了真实零假设)的风险,因此需要谨慎解释结果。

多重比较方法及其在实证分析中的应用

多重比较方法及其在实证分析中的应用第一章绪论随着科技的发展,大数据时代的到来,数据分析越来越成为人们重视并热衷的领域。

本文旨在介绍多重比较方法及其在实证分析中的应用,通过对比多重比较和单个比较的优劣,阐述多重比较方法的必要性和实用性。

第二章多重比较方法的基本概念2.1 多重比较方法的概念在统计学中,多重比较方法是指用于比较三个或多个(但少于总体中的所有个体)总体在一个或多个方面上的方法。

多重比较方法可以更全面地了解总体之间的差异,防止在进行多重检验时产生的多重错误。

2.2 多重比较方法的分类多重比较方法可以分为两类:一级比较和二级比较。

一级比较方法适用于确定多个总体是否存在差异,例如T检验、单因素方差分析和多因素方差分析等方法。

二级比较方法适用于确定哪些总体之间存在差异,例如考虑Bonferroni校正、Tukey方法、Scheffé方法和Dunnett方法等方法。

第三章多重比较方法的应用3.1 多重比较在医学研究中的应用例如在药物研究中,多个药物需要比较其效果是否有显着差异,采用多重比较方法可以避免假阳性的结果,同时减少研究时间和成本。

3.2 多重比较在经济学研究中的应用例如在城市房价研究中,需要对各个地区的房价进行比较,采用多重比较方法可以防止在多个区域中错判高价位,同时减少样本选择的问题。

3.3 多重比较在生态学研究中的应用例如在生态系统复杂度的研究中,多个因素需要进行比较,采用多重比较方法可以降低产生假阳性的概率,更好地理解生态系统中各元素之间的关系。

第四章多重比较方法的优劣比较在进行多重比较时,我们需要比较其与单个比较的优劣之处。

多重比较方法可以全面地了解总体之间的差异,避免在进行多重检验时产生的多重错误。

同时多重比较方法能够减少样本的假阳性结果,提高数据的可靠性和真实性。

但是多重比较方法也需要注意慎重选择,同时避免由于样本的选择和样本误差等问题引起的假阳性。

第五章结论通过对多重比较方法的介绍与应用,可以看出多重比较方法在实证分析中有着极大的作用,能够更好地了解总体之间的差异,避免在进行多重检验时产生的多重错误,同时减少研究时间和成本。

lsd法多重比较结果解读 -回复

lsd法多重比较结果解读-回复LSD法多重比较是一种统计方法,用于对多组数据进行比较,以确定哪些组之间存在显著差异。

在LSD法中,通过对每对组进行两两比较,计算得出每对组之间的平均差异和统计学的显著性水平。

本文将一步一步地回答以中括号内的内容为主题的问题,并解释LSD法多重比较的结果解读。

[什么是LSD法多重比较?]LSD法多重比较是Least Significant Difference(最小显著差异)法的缩写。

它是一种用于比较多组数据之间的统计方法。

当研究者在实验或调查中涉及到多个组别或处理条件时,LSD法可以帮助确定哪些组别之间存在着显著差异。

[LSD法多重比较的步骤是什么?]LSD法多重比较的步骤如下:1. 首先,进行ANOVA(方差分析)以确定组别间的总体差异是否显著。

如果ANOVA结果显示组别间存在显著差异,则可以继续进行LSD法多重比较。

2. 选择一个基准组,通常是各组均值的平均值。

这个基准组将用作比较其他组别的参照。

3. 对每对组别进行两两比较。

计算出每对组别的平均差异(即均值之差)以及其显著性水平。

4. 使用统计学中的LSD值作为显著差异的界限。

如果两组间的平均差异大于LSD值,则可以认为这些组之间存在显著差异。

5. 重复以上步骤,直到对每对组别都进行了比较。

[如何解读LSD法多重比较的结果?]在LSD法多重比较的结果中,我们主要关注两个方面:平均差异和显著性水平。

平均差异代表着各组别之间的差异大小。

如果两组之间的平均差异越大,说明这两组之间存在更明显的差异。

平均差异可以通过计算两组均值之差得出,并通过统计学的计算得到置信区间。

显著性水平表示着两组之间的差异是否达到了统计学上的显著性。

在LSD 法多重比较中,通常使用显著性水平为0.05或0.01,代表了研究者对观察到的差异是否足够有信心以推断差异在总体中存在。

当两组之间的平均差异大于LSD值时,我们可以认为这两组之间存在显著差异。

多重比较

四、多重比较F值显著或极显著,否定了无效假设H O,表明试验的总变异主要来源于处理间的变异,试验中各处理平均数间存在显著或极显著差异,但并不意味着每两个处理平均数间的差异都显著或极显著,也不能具体说明哪些处理平均数间有显著或极显著差异,哪些差异不显著。

因而,有必要进行两两处理平均数间的比较,以具体判断两两处理平均数间的差异显著性。

统计上把多个平均数两两间的相互比较称为多重比较(multiplecomparisons )。

多重比较的方法甚多,常用的有最小显著差数法(LSD 法)和最小显著极差法(LSR 法),现分别介绍如下。

(一)最小显著差数法 (LSD 法,least significant difference ) 此法的基本作法是:在F 检验显著的前提下,先计算出显著水平为α的最小显著差数αLSD ,然后将任意两个处理平均数的差数的绝对值..j i x x-与其比较。

若..j i x x ->LSD a 时,则.i x 与.j x 在α水平上差异显著;反之,则在α水平上差异不显著。

最小显著差数由(6-17)式计算。

..)(j i e x x df a a S t LSD -=(6-17)式中:)(e df t α为在F 检验中误差自由度下,显著水平为α的临界t 值,..j i x x S -为均数差异标准误,由(6-18)式算得。

n MS S e x xj i /2..=- (6-18)其中e MS 为F 检验中的误差均方,n 为各处理的重复数。

当显著水平α=0.05和0.01时,从t 值表中查出)(05.0e df t和)(01.0e df t ,代入(6-17)式得:....)(01.001.0)(05.005.0j i e j i e x x df x x df S t LSD S t LSD--==(6-19)利用LSD 法进行多重比较时,可按如下步骤进行:(1)列出平均数的多重比较表,比较表中各处理按其平均数从大到小自上而下排列;(2)计算最小显著差数05.0LSD和LSD;.001(3)将平均数多重比较表中两两平均数的差数与05.0LSD比较,作LSD、01.0出统计推断。

多重比较的基本步骤

多重比较(Multiple Comparisons)是统计学中的一种方法,用于在进行方差分析(ANOVA)或其他假设检验后,对多个均值之间的差异进行细致的比较,以确定哪些组之间的差异是显著的。

以下是多重比较的基本步骤:1.进行初步分析:o首先进行一个总体的统计分析,如单因素或双因素方差分析(One-way ANOVA或Two-way ANOVA),以确定是否存在至少两个组别之间均值的显著差异。

2.选择多重比较方法:o根据研究目的和样本大小,选择合适的多重比较方法。

常见的多重比较方法包括:▪LSD(Least Significant Difference)法▪Tukey’s HSD(Honestly Significant Difference)法▪Bonferroni校正▪Dunnett’s test(主要用于与对照组比较)▪Sidak校正▪Šidák校正▪Benjamini-Hochberg校正(用于控制假阳性率)3.计算比较:o应用选定的方法,对所有可能的组间比较进行计算,得出每一对比较的p值和置信区间。

4.调整显著性水平:o为了控制I型错误(假阳性)的发生概率,通常会对原始的显著性水平(如α=0.05)进行调整。

例如,如果进行了k个比较,可能需要将每个比较的显著性水平设定为α/k(如使用Bonferroni校正)。

5.解释结果:o根据调整后的显著性水平,解释每对比较的结果,指出哪些组之间的差异在统计上是显著的。

6.报告结果:o报告每一对比较的统计量、p值和结论,必要时可以绘制图表直观展示显著差异。

7.评估假设检验结果:o评估所有比较结果的整体一致性,以及是否符合研究的假设和目标。

请注意,多重比较可能导致假阳性率增加,因此选择合适的校正方法很重要。

同时,分析结果不仅要基于统计显著性,还要结合实际研究背景和意义进行解读。

多重比较方法

多重⽐较⽅法前篇讲的是两个总体样本之间的⽐较⽅法,如果有多个处理⽔平,通常使⽤三种常见的⽅法,最⼩显著差数法(LSD法)、复极差法(q 法)和Duncan⽒新复极差法(SSR法)。

本质上都属于t检验法。

因此,使⽤这三种⽅法必须满⾜⽅差齐性。

如果通过F检验p>0.05,⽅差具有齐次性。

具体操作⽅法可参考:例如,⼀个试验中k个处理平均数间可能有k(k-1)/2个⽐较,因⽽这种⽐较是复式⽐较亦称为多重⽐较(multiple comparisons)。

进⾏⽅差分析时需要满⾜独⽴样本、⽅差齐性、正态分布等条件,如果⽅差不具备齐性(F检验),可⾸先进⾏数据转换,如通过对数变换、平⽅根变换、倒数变换、平⽅根反正弦变换等⽅法变换后再进⾏⽅差齐性检验,若还不⾏只能进⾏⾮参数检验。

1:最⼩显著差数法(least significant difference,简称LSD法),LSD 法实质上是t测验。

其程序是:在处理间的F测验为显著的前提下,计算出显著⽔平为α的最⼩显著差数;任何两个平均数的差数如其绝对值≥,即为在α⽔平上显著;反之则为不显著。

举例:试以LSD法测验各种药剂处理的苗⾼平均数之间的差异显著性。

下⾯⽤字母标记法对各种药剂处理的苗⾼平均数之间的差异显著性进⾏⽐较。

⾸先约定:(1)5%⽔平的差异显著性⽤⼩写英⽂字母标记,1%⽔平的差异显著性⽤⼤写英⽂字母标记;(2)若两平均数之间差异显著⽤不同字母标记,若两平均数之间差异不显著⽤相同字母标记。

2:复极差法(q法)LSD法的t测验是根据两个样本平均数差数(k=2)的抽样分布提出来的,但是⼀组处理(k>2)是同时抽取k个样本的结果。

抽样理论提出k=2时与k>2时,例如k=10时其随机极差是不同的,随着k的增⼤⽽增⼤,因⽽⽤k=2时的t测验有可能夸⼤k=10时最⼤与最⼩两个样本平均数差数的显著性。

基于极差的抽样分布理论,Student-Newman-Keul提出了q测验或称复极差测验,有时⼜称SNK测验(SAS软件中就是这种叫法)或NK测验。

多重比较

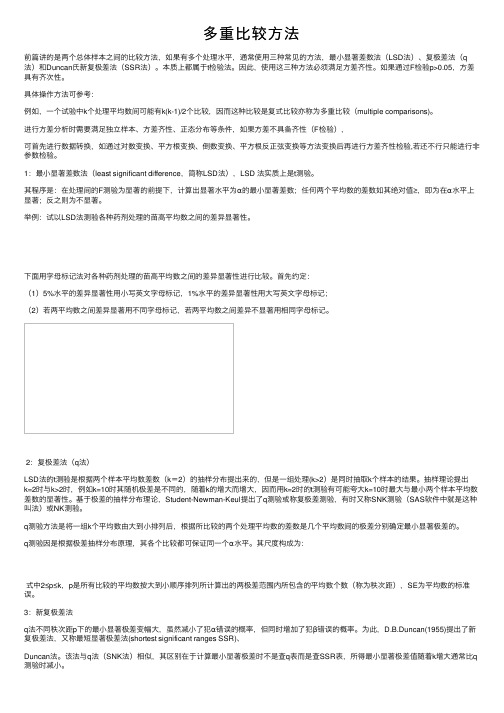

例 不同品种猪4个月增重量的方差分析表

变异来源 品种间 品种内 总变异

SS

df

s2

F

F0.05

F0.01

103.94 3 34.647 3.802 * 3.49 5.95

109.36 12 9.113

213.30 15

√ √ S x1 - x2 =

2se2 = n

2×9.113 =2.1346 4

于处理组间的比较。

(二)最小显著极差法(LSR法)

是指不同平均数间用不同的显著差数标准进行 比较,可用于平均数间的所有相互比较。

新复极差法

q 检验

(New multiple rang method) SSR法

(q-test)

新复极差法(SSR)

SSR法又称Duncan法。无效假设H0 为:

(1)按相比较的样本μ容A 量–μ计B 算= 平0 均数标准误:

M = 相隔数 + 2

大白与沈黑:M=4,极差=6.8> 5大.0白0与沈白:M=3,极差=5.1> 4大.8白8与沈花:M=2,极差=3.0< 4.65

猪品种间4个月增重量差异显著性比较表(新复极差法)

品种

大白 沈花 沈白 沈黑

平均数

30.9 27.9 25.8 24.1

差异显著性

α=0.05

α=0.01

√ √ S x =

se2 n

=

9.113 =1.5094(kg) 4

查附表9,当dfe =12,M=2时, SSR0.05 =3.08,SSR0.01=4.32

LSR0.05 =1.5094×3.08=4.65 LSR0.01 =1.5094 ×4.32=6.52

统计学中的多重比较程序及其控制方法

统计学中的多重比较程序及其控制方法统计学是一门研究数据收集、分析和解释的学科,它在各个领域中都起着重要的作用。

在众多的统计方法中,多重比较程序是一种常用的工具,用于比较多个群体或处理之间的差异。

本文将介绍多重比较程序的基本概念、常见方法以及如何控制多重比较中的错误率。

一、多重比较程序的基本概念多重比较程序是一种用于比较多个群体或处理之间差异的统计方法。

在实际应用中,我们经常需要比较多个处理的均值、中位数或其他统计指标,以确定它们之间是否存在显著差异。

传统的单个比较方法,如t检验或方差分析,只能用于比较两个群体或处理之间的差异。

而多重比较程序则允许我们同时比较多个群体或处理之间的差异,从而更全面地了解数据的差异。

二、常见的多重比较方法1. Bonferroni校正方法Bonferroni校正方法是最常用的多重比较方法之一。

该方法通过将显著性水平除以比较的总数,来控制每个比较的显著性水平。

例如,如果我们要进行10个比较,显著性水平为0.05,则每个比较的显著性水平应为0.05/10=0.005。

Bonferroni校正方法的优点是简单易懂,容易计算。

然而,它的缺点是过于保守,可能导致较高的第二类错误率(即错误地接受了原假设)。

2. Tukey-Kramer方法Tukey-Kramer方法是一种常用的多重比较方法,适用于方差分析中的多个配对比较。

该方法通过计算每对处理之间的比较值,来确定哪些处理之间存在显著差异。

Tukey-Kramer方法的优点是在控制错误率的同时,能够提供详细的比较结果。

然而,它的缺点是对样本量的要求较高,且在样本量不平衡时可能失效。

三、控制多重比较中的错误率在进行多重比较时,我们需要注意控制两种类型的错误率:第一类错误率(即错误地拒绝了原假设)和第二类错误率(即错误地接受了原假设)。

为了控制第一类错误率,我们可以使用Bonferroni校正方法、Holm校正方法或Benjamini-Hochberg校正方法等。

常用的多重比较方法

常用的多重比较方法

在数据分析和统计学中,常用的多重比较方法包括以下几种:

1. 方差分析中的多重比较方法:用于比较多个组或处理之间的均值差异,包括Tukey's HSD(Tukey's Honestly Significant Difference)、Bonferroni校正和Scheffé法等。

2. 多重t检验:用于比较两个或多个样本均值是否有显著差异,通常用于独立样本或配对样本之间的比较。

3. 多重相关分析:用于比较多个变量之间的相关性,包括Pearson相关系数、Spearman等级相关系数等。

4. 多重回归分析:用于比较多个自变量对因变量的影响程度,可以进行变量选择和模型比较。

5. 多重比例比较:用于比较不同组别之间的比例差异,包括卡方检验和Fisher 精确检验等。

以上仅列举了常见的一些多重比较方法,具体选择何种方法应根据研究问题、数据类型和假设情况等综合考虑。

此外,需要注意的是,在进行多重比较时,需要

进行多重校正,以控制因进行多个比较而增加的类型I错误的风险。

统计学中的多重比较与调整

统计学中的多重比较与调整统计学中的多重比较和调整是一个重要的主题,它涉及到在多组数据之间进行比较时如何控制错误发现率。

在实际研究或实验中,我们常常需要同时比较多组数据,这样就增加了出现假阳性(即错误地拒绝零假设)的可能性。

为了解决这个问题,多重比较与调整方法应运而生。

一、多重比较方法多重比较方法是在比较多组数据时控制错误的方法。

常见的多重比较方法包括共同控制类型I错误发现率(Family-wise Error Rate, FWER)和控制逐比较错误发现率(False Discovery Rate, FDR)两种。

1. 共同控制FWER的方法共同控制FWER的方法的目标是尽量降低整体的错误发现率,其中最著名的方法是Bonferroni校正。

Bonferroni校正是最简单和最保守的调整方法之一,它将显著性水平除以比较数量来控制FWER。

虽然它控制了整体错误率,但对于大样本量或多组比较的情况下,可能导致过于保守的结果。

2. 控制FDR的方法控制FDR的方法主要用于大量比较的情况下,例如基因表达研究中的差异基因分析。

常见的FDR调整方法包括Benjamini-Hochberg方法和Benjamini-Yekutieli方法。

这些方法通过控制被错误发现的零假设的百分比来控制FDR。

二、调整方法的应用在实际应用中,根据研究设计和研究目的的不同,选择合适的调整方法非常重要。

下面以一个基因表达研究为例来说明不同调整方法的应用。

假设我们进行了一个基因表达研究,同时比较了10000个基因在两组样本中的表达差异。

我们的目标是找出显著差异的基因。

首先,我们进行t检验来比较每个基因在两组样本中的表达差异,并计算出每个基因对应的p值。

然后,我们可以选择控制FWER的Bonferroni校正方法来进行多重比较的调整。

假设我们设置显著性水平为0.05,由于有10000个基因进行比较,因此我们将显著性水平除以10000来得到每个基因的显著性水平,即0.05/10000=0.000005。

统计学中的多重比较方法

统计学中的多重比较方法统计学是一门研究数据收集、分析和解释的学科,广泛应用于各个领域。

在数据分析过程中,我们经常需要进行多重比较,以确定不同组之间的差异或者找出显著性结果。

本文将介绍统计学中常用的多重比较方法,帮助读者更好地理解和应用这些方法。

一、背景介绍多重比较是指在进行多个假设检验时,需要对每个比较的显著性水平进行调整,以控制整体错误率。

在实际应用中,如果不对多重比较进行调整,可能会导致过高的错误率,从而得出错误的结论。

因此,多重比较方法在统计学中具有重要的意义。

二、Bonferroni校正法Bonferroni校正法是最常见的多重比较方法之一。

该方法的基本思想是将显著性水平α除以比较的总数,得到每个比较的校正显著性水平。

例如,如果我们进行了10个比较,显著性水平设定为0.05,则每个比较的校正显著性水平为0.05/10=0.005。

通过这种方式,我们可以有效地控制整体错误率。

然而,Bonferroni校正法也存在一些限制。

首先,它假设所有比较之间是独立的,这在实际应用中并不总是成立。

其次,该方法可能会导致过于保守的结果,降低了检验的功效。

因此,在实际应用中,我们需要根据具体情况选择适当的多重比较方法。

三、Tukey HSD方法Tukey HSD(Honestly Significant Difference)方法是一种常用的多重比较方法,适用于方差分析(ANOVA)中的多个组之间的比较。

该方法通过计算平均差异的标准误差,得出每个比较的显著性水平。

与Bonferroni校正法相比,Tukey HSD方法具有更好的功效,同时也能控制整体错误率。

然而,该方法要求各组之间的方差齐性,并且对样本量的要求较高。

如果数据不满足这些假设,我们可以考虑使用其他的多重比较方法。

四、False Discovery Rate控制方法False Discovery Rate(FDR)控制方法是一种相对较新的多重比较方法,用于控制预期的错误发现率。

多重比较梯形表法

多重比较梯形表法

多重比较梯形表法(Multiple Comparison Ladder Method)是一种用于确定某个因素的多个水平之间是否存在显著差异的统计分析方法。

该方法适用于多个相关水平之间的比较,主要用于处理多重比较问题,例如比较不同处理组之间的均值差异。

通过进行多重比较梯形表分析,可以帮助确定哪些水平对应变量存在显著差异,而哪些水平之间则没有显著差异。

具体步骤如下:

1. 首先进行方差分析(ANOVA)等相关统计分析,确定因素的主效应是否显著。

2. 若主效应显著,则进行多重比较梯形表分析。

3. 创建一个梯形表,将不同水平之间的差异按照显著性水平逐步比较。

4. 通过统计检验方法(例如Tukey's HSD法、Bonferroni法等)进行两两比较,确定哪些水平之间存在显著差异。

需要注意的是,多重比较梯形表法应用时要注意控制错误率,避免因多次比较而导致错误的显著性结论。

常见的控制方法包括Bonferroni校正、Holm-Bonferroni校正等。

希望以上回答对您有所帮助。

bonferroni 法 多重比较统计表制作

Bonferroni 法是一种常用的多重比较统计方法,它可以控制实验中同时进行多个假设检验产生的错误率。

在实际数据分析过程中,我们经常需要进行多组数据之间的比较,比如不同药物对疾病的疗效、不同广告对销售额的影响等等。

而这些多组比较往往会导致统计上的假阳性(Type I error)增加,因此需要采用多重比较校正的方法来控制错误率。

我们可以使用以下步骤来制作 bonferroni 法的多重比较统计表:1. 确定要比较的组数目在进行 bonferroni 法多重比较统计之前,首先需要确定要比较的组数目。

我们有三组数据 A、B、C 需要进行配对比较,那么我们就需要进行 3*3=9 次配对比较。

确定了组数目之后,就可以开始进行bonferroni 法的多重比较统计。

2. 确定显著性水平在进行 bonferroni 法的多重比较统计时,我们需要确定显著性水平,通常情况下选择 0.05 或 0.01 作为显著性水平。

这一步是为了确保在进行多次假设检验时,产生的错误率能够得到控制。

3. 计算调整后的显著性水平bonferroni 法的核心思想是将原来的显著性水平除以要比较的组数目,然后将得到的结果作为每一组比较的显著性水平。

如果我们选择了显著性水平为 0.05,并且要进行 9 次配对比较,那么每一组比较的显著性水平就是 0.05/9=0.0056。

4. 进行假设检验接下来,我们就可以进行 bonferroni 法的多重比较统计了。

对于每一组比较,我们需要计算得到 t 值或 z 值,然后根据样本量和自由度查找 t 分布表或 z 分布表,最终得到检验统计量的 P 值。

如果 P 值小于调整后的显著性水平,我们就拒绝原假设,否则接受原假设。

5. 制作多重比较统计表最后一步就是根据进行 bonferroni 法多重比较的结果,制作多重比较统计表。

表格中应当包含每一组比较的名称、检验统计量的值、自由度和 P 值。

通过多重比较统计表,我们可以清晰地了解各组数据之间的显著性差异,从而提供科学依据支持我们的研究结论。

duncan多重比较法标abc

duncan多重比较法标abc Duncan 多重比较法是一种常用的统计方法,也是一种多重比较方法。

它主要是用于统计学中的两个或多个受试者组(或处理组)之间的比较。

相对于其他多重比较方法的特点是它更适用于小样本研究,其强的假设保护措施是保证了α错误率控制在预设的范围内的主要原因。

Duncan 多重比较法的优点是:以较少的样本量得到比较的结果;保证拒绝假设的α误差控制在给定的范围内;分析结果容易解释。

Duncan多重比较法的基本思想是两两比较样本均值之后排出一个排列列表,再对此进行分析。

Duncan多重比较法的核心是确定每两个平均数之间是否存在显着差异,以及将平均下降是否符合我们的假设。

除了在研究过程中使用统计软件之外,Duncan多重比较法还可以手动计算。

首先,需要对受试者组内的均值进行排列。

排列可以用升序或降序排列。

然后,先从第一和第二个平均数组成的四元组开始检索,接着从第一和第三个平均数组成的四元组开始检索,以此类推。

经过多次检索后,会生成所有的d个两两平均数之间的比较组。

在通过两两比较平均数之后,我们得到所有组之间的平均差异。

但是,这些已经比较的平均数之间的显着差异可能并不充分说明样本组之间的显着差异。

因此,需要进行一次F检验,以验证所有组之间是否存在显著性差异。

Duncan 多重比较法标ABC通常用于小样本数据分析,例如生物学实验或医学研究。

在分析过程中,需要对数据进行分组,并将它们分成三组。

具体而言,将数据按相似性分为类似的三组。

认识到每组之间的相似性减少了α错误率的可能性,也进一步揭示了潜在的研究因素。

Duncan 多重比较法标ABC的标准是需要事先进行独立均值检验(ANOVA)。

只有当ANOVA确定组之间存在显著性差异时,才能使用Duncan多重比较法进行后续分析。

此外,Duncan多重比较法标ABC结合了多种检验技术,例如主成分分析,因此可以从方向不同的角度对数据集进行分析。

这种方法可以帮助研究人员发现隐藏在数据中的非线性关系。

多重比较

多重比较四、多重比较F 值显著或极显著,否定了无效假设H O ,表明试验的总变异主要来源于处理间的变异,试验中各处理平均数间存在显著或极显著差异,但并不意味着每两个处理平均数间的差异都显著或极显著,也不能具体说明哪些处理平均数间有显著或极显著差异,哪些差异不显著。

因而,有必要进行两两处理平均数间的比较,以具体判断两两处理平均数间的差异显著性。

统计上把多个平均数两两间的相互比较称为多重比较(multiple comparisons )。

多重比较的方法甚多,常用的有最小显著差数法(LSD 法)和最小显著极差法(LSR 法),现分别介绍如下。

(一)最小显著差数法 (LSD 法,least significant difference ) 此法的基本作法是:在F 检验显著的前提下,先计算出显著水平为α的最小显著差数αLSD ,然后将任意两个处理平均数的差数的绝对值..j i x x -与其比较。

若..j i x x ->LSD a 时,则.i x 与.j x 在α水平上差异显著;反之,则在α水平上差异不显著。

最小显著差数由(6-17)式计算。

..)(j i e x x df a a S t LSD -=(6-17)式中:)(e df t α为在F 检验中误差自由度下,显著水平为α的临界t 值,..j i x x S -为均数差异标准误,由(6-18)式算得。

nMS S e x x j i /2..=-(6-18)其中e MS 为F 检验中的误差均方,n 为各处理的重复数。

当显著水平α=0.05和0.01时,从t 值表中查出)(05.0e df t 和)(01.0e df t ,代入(6-17)式得:....)(01.001.0)(05.005.0j i e j i e x x df x x df S t LSD S t LSD --==(6-19)利用LSD 法进行多重比较时,可按如下步骤进行: (1)列出平均数的多重比较表,比较表中各处理按其平均数从大到小自上而下排列;(2)计算最小显著差数05.0LSD 和01.0LSD ; (3)将平均数多重比较表中两两平均数的差数与05.0LSD 、01.0LSD 比较,作出统计推断。

统计学中的多重比较方法

统计学中的多重比较方法统计学的研究领域中,多重比较方法是一种强大的工具,用于在研究中探索多个群体或处理之间的差异。

多重比较方法的主要目标是避免在进行统计推断时产生错误的结论。

本文将介绍统计学中常见的多重比较方法,包括Bonferroni校正、Dunnett校正和Tukey-Kramer校正。

1. Bonferroni校正Bonferroni校正是一种广泛使用的多重比较方法,其原理是将显著性水平按照进行比较的数量进行调整。

假设我们进行了m个比较,原始的显著性水平为α,则在Bonferroni校正下,每个比较的显著性水平将调整为α/m。

这样可以保护整体显著性水平,降低错误发现的概率。

但是,Bonferroni校正可能导致统计功效降低,因此需要权衡研究设计和显著性水平的设置。

2. Dunnett校正Dunnett校正是一种特定的多重比较方法,适用于对一个处理组进行多个处理间比较的情况。

与Bonferroni校正不同,Dunnett校正通过将每个比较与一个参照组进行比较,降低了错误发现的概率。

具体而言,Dunnett校正通过在比较中引入一个额外的自由度,来调整每个比较的显著性水平。

这种方法在医学研究和实验设计中经常被使用。

3. Tukey-Kramer校正Tukey-Kramer校正是一种用于多个群体间比较的方法,可以有效控制类型I错误的产生。

在Tukey-Kramer校正下,每个比较的显著性水平将根据一种修正的公式进行调整。

与Bonferroni校正类似,Tukey-Kramer校正能够提供更具吸引力的结果,但也可能降低统计功效。

这种方法主要应用于方差分析(ANOVA)和多元分析(MANOVA)等统计方法。

总结统计学中的多重比较方法是研究设计和结果分析中重要的一环。

通过对多个群体或处理进行比较,可以提供更全面的信息和洞察,并减少错误的结论。

本文介绍了三种常见的多重比较方法,包括Bonferroni校正、Dunnett校正和Tukey-Kramer校正。

统计实验设计中的方差分析与多重比较方法

统计实验设计中的方差分析与多重比较方法方差分析(ANOVA)和多重比较方法是统计学中常用于研究实验设计的重要工具。

方差分析用于比较多个组别之间的均值是否有显著差异,而多重比较方法则用于确定哪些组别之间存在差异。

本文将介绍方差分析和多重比较方法的原理、应用以及相关注意事项。

一、方差分析(ANOVA)的原理方差分析是用于比较两个或多个组别之间差异的一种统计方法。

它基于总体均值之间的方差来判断各组别之间是否存在显著差异。

方差分析的核心思想是将总体方差分为组内方差与组间方差,并通过比较两者的大小来判断组别之间的差异是否显著。

在进行方差分析时,需要满足以下假设:各组别之间的样本来自于正态分布的总体,各组别的方差相等,样本之间独立。

对于一个因变量和一个自变量,可以使用单因素方差分析;对于一个因变量和多个自变量,可以使用多因素方差分析。

方差分析的结果通常通过F统计量来体现。

F统计量是组间方差与组内方差的比值,如果F值足够大,就可以认为组别之间存在显著差异。

如果显著性水平小于设定的阈值(通常是0.05),则可以拒绝无差异的假设,认为组别之间存在显著差异。

二、多重比较方法当我们得出方差分析结果显示组别之间存在显著差异时,接下来需要进行多重比较以确定具体差异在哪些组别之间。

多重比较方法可以帮助我们进行两两组别之间的比较,以确定哪些组别之间存在差异。

常见的多重比较方法包括Tukey方法、Bonferroni方法和Duncan方法等。

这些方法的原理和步骤有所不同,但基本思想是进行多次假设检验,并通过控制错误率来确定具体差异是否显著。

Tukey方法是一种常用的多重比较方法,它通过计算各组别之间的平均差异和置信区间来判断是否存在显著差异。

Bonferroni方法则是将显著性水平除以比较的次数,以控制整体错误率。

Duncan方法是利用多重范围检验校正标准来确定差异的存在。

三、方差分析与多重比较方法的应用方差分析和多重比较方法在统计实验设计中有广泛的应用。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

多个均值之间的多重比较

在完成方差分微得知某因素对观测结果的影响显著时,仅表明该因素的各水平下的均数之间的差别总体上是显著的,并不知道任何2个均数之间的差别是否显著(此时,即使在多数场合下,可认为均数的最大值与最小值之间的差别显著,但却不知p值的大小)。

当实际工作者希望进一步知道更为详细的情况时,就需要在多个均数之间进行多重比较。

然而,根据所控制误差的类型和大小不同,便产生了许许多多的多重比较法。

设某因素有10个水平,若采用通常的t检验进行多重比较,共需比较的次数为∶C210=45次,即使每次比较时都把α控制在0.05水平上(即令CER=0.05),但此时EER=1-(1-0.05)45=0.90,这表明作完45次多重比较后,所犯Ⅰ型错误的总概率可达到0.90,事实上,选用t检验进行多重比较,仅仅控制了CER,却大大地增大了EER!

1.两两比较

(1)仅控制CER(比较误差率)的方法

①T法(即成组比较的t检验法,但误差的均方不是由所比较的2组数据、而是由全部数据算得的)注意∶用此法所作比较的次数越多,其EER(试验误差率)就越大。

②LSD法:也叫最小显著差数法,只用于2组例数相等的场合LSD的值被称为Fisher的最小显著差.注意∶用此法所作比较的次数越多,其EER(试验误差率)就越大。

③DUNCAN法

(2)控制MEER(最大试验误差率)的方法

①BON法(即Bonferroni t检验法)

它令CER=ε=α/C,这里C为比较的总次数,当因素有K个水平时,则C=K(K-1)/2,下同。

②SIDAK法(根据Sidak的不等式进行校正的t检验法)

③SCHEFFE法

它是由Scheffe于1953和1959年提出的另一种控制MEER的法,

Scheffe检验的结果与先作的方差分析的结果是相容的,即若ANOVA的结果是显著,用此法至少能发现一次比较的结果是显著的,反之,若ANOVA的结果为不显著,用此法也找不出任何2个均数之间有显著差别来(然而,大部分多重比较法则可能会发现有显著差别的对比组)。

如果比较的次数明显地大于均数的个数时,Scheffe法的检验功效可能高于BON法和SIDAK法。

对于两两比较,一般来说,Sidak t法的检验功效高。

④TUKEY法(也称为Tukey或Tukey-Kramer法)

Tukey(1952,1953)以学生化极差为理论根据,提出了专门用于两两比较的检验(有时也称为诚实(或最大)显著差检验)。

当各组样本含量相等时,此检验控制MEER;当样本含量不等时,Tukey(1953)和Kramer(1956)分别独立地提出修正的方法。

对Tukey-Kramer 法控制MEER没有一般的证明,但Dunnett(1980)用蒙特卡洛法研究发现此法非常好。

此法的检验功效高于BON法、SIDSAK法或SCHEFFE法。

⑤GT2法或SMM法

它是有Hochberg(1974)推导尝且与Tukey法像似的一种方法,它用学生化最大模数取代学生化极差,并运用Sidak(1976)的未校正的t不等式。

在样本含量相等时,已证明此法把MEER控制在不超过α的水平上。

一般认为,此法的检验功效低于Tukey-Kramer法,并且,在样本含量相等时,此法的检验功效总低于Tukey检验。

若式(2.5.5)成立,则宣称所比较的

2均数之间的差别显著。

⑥GABRIEL法

它是由Gabriel(1978)提出的,用于样本含量不等时的一种多重比较法。

此法建立于学生化最大模基础之上。

样本含量相等时,Gabriel检验与Hochberg检验是等阶的;样本含量不等时,Gabriel法比GT2法具有更高的检验功效,但当样本含量相差悬殊时,此法可能变得不精确。

⑦REGWQ法和REGWF法(详见“多级检验”)

2.多级检验(MSTs─Multiple-Stage Test)

使用多级检验可以获得同时检验的更高功效。

MSTs分为步长增加法和步长减少法,步长减少法一直被用得较广泛,SAS/STAT中采用的也是此法。

设某显著因素有K个水平,即有K个均数需要比较,则步长减少的MSTs法的检验步骤为∶第1步∶将均数由大到小排队,即X-1≥X-2≥…≥X-k;

第2步∶比较X-1与X-k。

此时是跨度(即一般统计书中所说的处理数)为K级的2个均数之间的比较,若两者之间差别不显著,则意味着其他任何2个均数之间的差别也都不显著,应停止一切比较;反之,则进行下面的第3步;

第3步∶比较X-1与X-k-1、X-2与X-k。

此时是跨度为K-1级的2个均数之间的比较,沿用第2步后面的思路,一直进行下去,如果每一步都有不满足停止比较的对比组,最后应达到跨度为2的所有需要比较的相邻2均数间都作完比较时为止。

MSTs法在作每一级比较时,通过控制γa的水平(a=K,K-1,…,2)来实现其最终要控制的某种误差率。

γa在特定的中所起的作用相当于t和F分中的概率α,即γa也是一种显著性水平,它与对比的2个均数之间的跨度(即处理数a)有关。

在MSTs中,最著名的2种方法分别是DUNCAN法和SNK法,这2种方法及其主要区别如下∶

(1)DUNCAN法(常称为新多极差检验法、SSR法)

此法控制的是Ⅰ型比较误差率CER=α(即每作1次比较所对应的犯Ⅰ型错误的概率为α),而不是试验误差率MEER。

为实现此目标,它所对应的γa=1-(1-α)a-1。

有些研究结果表明,

如果不考虑较高的Ⅰ型误差率,那么,此法优于Tukey法。

在都是控制CER的3种法中,SAS 宁愿推荐LSD法或T法,因为它们易于计算和解释。

DUNCAN法的检验统计量为q,当式(2.5.7)成立时,则宣称所比较的2均数之间差别显著。

如果是用手工计算,需查DUNCAN检验用的q临界值表得到q的临界值。

(2)SNK法(称为多极差检验法或Student-Newman-Keuls法或q检验法)

此法控制的是EERC=α,为实现此目标,它所对应的γa=α。

值得注意的是SAS并不推荐使用此方法,因为它所产生的MEER相当大,尤其是在比较的次数C很大时,MEER将趋近于1。

控制MEER的另2种MSTs法不像SNK法和DUNCAN法那样出名,但它们却是到本世纪七十年代为止的文献中介绍的最有效的步长减少的MSTs 法,它们是REGWQ法和REGWF法,由Ryan(1959,1960)、Einot和Gabriel(1975)和Welsch(1977)研究出来,

(3)REGWQ法(4)REGWF法

3.WALLER法(即贝叶斯法)

该法由Waller和Duncan(1969)采用,它不是控制Ⅰ型误差率,而是在附加损失条件下使贝叶斯风险达到最小值。

该法的假定条件是∶各组总体均数具有未知方差的先验正态,均数的方差的对数具有先验均匀。

4. DUNNETT法(即所有处理组均数分别与对照组均数比较)

DUNNETT检验控制MEER在不超过事先给定的α水平上。