基于值迭代的MDP算法求解最优策略

马尔可夫决策过程中的策略迭代算法应用案例(五)

马尔可夫决策过程(MDP)是一种用于描述随机决策问题的数学框架。

在MDP 中,一个决策代理通过与环境进行交互,从而实现某些目标。

马尔可夫决策过程中的策略迭代算法是一种通过不断改进策略来寻找最优策略的方法。

本文将通过介绍一个实际应用案例,来说明策略迭代算法在马尔可夫决策过程中的应用。

案例背景假设有一个餐厅,餐厅的主要目标是最大化利润。

餐厅有两种菜品A和B,每天的客流量是不确定的。

为了最大化利润,餐厅需要确定每天供应菜品A和菜品B的数量。

在这个情景下,可以将餐厅的经营问题建模为一个马尔可夫决策过程。

状态空间和动作空间在这个例子中,状态空间可以表示为餐厅每天的客流量,动作空间可以表示为供应的菜品A和菜品B的数量。

在这个案例中,为了简化问题,我们假设客流量只有两种可能的状态:高客流量和低客流量。

动作空间也简化为两个动作:供应大量菜品A和供应大量菜品B。

奖励函数餐厅的目标是最大化利润,因此可以将利润作为奖励函数。

具体来说,对于每一种状态和动作组合,可以通过计算供应菜品A和菜品B所带来的收入和成本来确定奖励值。

策略迭代算法策略迭代算法是一种通过不断改进策略来寻找最优策略的方法。

在马尔可夫决策过程中,策略可以表示为在每个状态下采取每个动作的概率。

策略迭代算法包括两个步骤:策略评估和策略改进。

策略评估在策略评估阶段,需要计算当前策略下每个状态的值函数。

值函数表示在给定策略下,从某个状态开始能够获得的未来奖励的期望值。

对于我们的餐厅案例,值函数可以表示为在高客流量和低客流量下供应菜品A和菜品B所能获得的预期利润。

在策略评估阶段,可以使用动态规划算法来计算值函数。

动态规划算法是一种通过将问题分解为子问题并逐步求解这些子问题来找到最优解的方法。

在我们的案例中,可以利用动态规划算法来计算每个状态下的值函数。

策略改进在策略改进阶段,需要找到可以改进当前策略的动作。

具体来说,对于每个状态,需要选择能够最大化值函数的动作作为新策略。

马尔可夫决策过程中的策略优化方法(七)

马尔可夫决策过程(Markov Decision Process,MDP)是一种用于描述随机决策过程的数学模型。

在许多领域,如机器学习、控制论和运筹学中都有广泛的应用。

在MDP中,代理(agent)需要通过一系列的决策来实现目标,每一步的决策会对下一步的状态产生影响,这种影响是随机的。

如何设计一个优化的策略,使得代理能够在MDP中获得最大的累积奖励,是一个重要的研究课题。

## 马尔可夫决策过程基础MDP是由状态空间、动作空间、状态转移概率和奖励函数组成的数学模型。

在MDP中,代理根据当前的状态选择一个动作,系统会根据状态转移概率将代理转移到另一个状态,并给予相应的奖励。

代理的目标是通过选择动作来最大化累积奖励。

在MDP中,最优的策略是使得代理在每个状态下选择能够获得最大期望奖励的动作。

## 策略迭代算法策略迭代算法是一种用于求解MDP最优策略的经典方法。

该算法包括两个步骤:策略评估和策略改进。

在策略评估步骤中,算法会根据当前策略来计算每个状态的值函数,即在该状态下能够获得的累积奖励的期望值。

在策略改进步骤中,算法会根据值函数来更新策略,使得在每个状态下选择能够获得最大值函数的动作。

重复进行这两个步骤直到策略收敛,即策略不再发生改变,此时获得的策略就是最优策略。

## 值迭代算法值迭代算法是另一种用于求解MDP最优策略的经典方法。

该算法通过迭代的方式来逼近最优值函数,并根据最优值函数来更新策略。

值迭代算法的核心思想是不断地更新每个状态的值函数,使其逼近最优值函数。

一旦值函数收敛,即可根据值函数来得到最优策略。

相比策略迭代算法,值迭代算法通常收敛速度更快。

## 强化学习与MDP强化学习是一种通过与环境交互来学习最优策略的机器学习方法。

MDP通常被用作强化学习的基础模型。

在强化学习中,代理通过与环境的交互来不断地调整策略,以最大化累积奖励。

强化学习算法,如Q-learning和深度强化学习,借助MDP的框架来实现自主学习和决策。

马尔可夫决策过程中的策略优化方法(十)

马尔可夫决策过程(MDP)是一种用于建模具有随机性和不确定性的决策问题的数学框架。

在MDP中,决策者根据当前状态和可能采取的行动来制定决策,目标是最大化长期累积奖励。

策略优化是MDP中的一个重要问题,它涉及如何选择最佳的行动策略以实现最大化的奖励。

在本文中,我们将讨论马尔可夫决策过程中的策略优化方法。

首先,让我们介绍一下MDP的基本概念。

MDP由一个五元组(S, A, P, R, γ)组成,其中S是状态空间,A是行动空间,P是状态转移概率,R是奖励函数,γ是折扣因子。

在MDP中,决策者根据当前状态和可能的行动选择一个行动,然后系统根据状态转移概率转移到下一个状态,并给予相应的奖励。

决策者的目标是找到一个最佳策略,使得长期累积奖励最大化。

在MDP中,有两种基本的策略:确定性策略和随机策略。

确定性策略是指在每个状态下都选择一个确定的行动,而随机策略是指在每个状态下选择一个行动的概率分布。

确定性策略可以通过价值函数或者动作价值函数来进行优化,而随机策略则需要使用策略梯度方法来进行优化。

对于确定性策略,我们可以使用值迭代或者策略迭代来进行优化。

值迭代是一种基于价值函数的优化方法,它通过迭代更新每个状态的价值函数来找到最优策略。

策略迭代是一种基于动作价值函数的优化方法,它通过迭代更新策略来找到最优策略。

这两种方法都可以保证在有限步数内找到最优策略,但是在状态空间较大时,它们的计算复杂度会变得非常高。

对于随机策略,我们可以使用策略梯度方法来进行优化。

策略梯度方法是一种直接对策略进行优化的方法,它通过计算策略的梯度来更新策略参数,使得长期累积奖励最大化。

策略梯度方法的优点是可以处理高维状态空间和连续动作空间,但是它的收敛速度较慢,需要大量的样本来进行训练。

除了上述方法,还有一些其他的策略优化方法,例如Q-learning、SARSA等。

这些方法都是基于不同的思想来进行策略优化的,它们在不同的问题领域都有着各自的优势和局限性。

马尔可夫决策过程中的策略迭代算法复杂度分析(七)

马尔可夫决策过程(Markov Decision Process,简称MDP)是一种用于描述随机决策过程的数学框架。

在MDP中,智能体通过一系列决策来实现某种目标,每个决策都会对环境产生影响,并且这种影响是随机的。

马尔可夫决策过程中的策略迭代算法是一种常用的解决方案,它通过不断迭代优化策略来寻求最优解。

本文将对马尔可夫决策过程中的策略迭代算法的复杂度进行分析。

首先,我们来回顾一下马尔可夫决策过程中的一些基本概念。

在MDP中,我们通常会定义状态空间、动作空间、奖励函数、状态转移函数等。

智能体在不同的状态下可以采取不同的动作,并且每个动作都会对环境产生影响,从而导致状态的转移。

此外,环境会根据智能体采取的动作给予奖励,智能体的目标就是通过选择合适的动作来最大化长期奖励的累积。

策略迭代算法是一种常用的求解MDP最优策略的方法。

该算法包括策略评估和策略改进两个步骤。

在策略评估阶段,我们会对当前策略进行评估,计算每个状态的值函数。

具体来说,我们可以通过求解Bellman方程或者进行蒙特卡洛模拟来估计值函数。

在策略改进阶段,我们会根据已经计算出的值函数来更新策略,使得策略朝着更优的方向前进。

接下来,我们来分析策略迭代算法的复杂度。

在策略评估阶段,通常需要解线性方程组或进行蒙特卡洛模拟。

如果状态空间和动作空间较大,那么线性方程组的求解会变得非常耗时,而蒙特卡洛模拟的计算量也会随之增加。

因此,在大规模问题下,策略评估的复杂度会随着状态空间和动作空间的增加而指数级增长。

在策略改进阶段,通常需要对值函数进行迭代优化,直到值函数收敛。

这一过程的复杂度取决于值函数的收敛速度,如果值函数收敛速度较慢,那么策略改进的复杂度也会相应增加。

综合来看,策略迭代算法的复杂度主要取决于两个方面:一是策略评估阶段的复杂度,二是策略改进阶段的复杂度。

在大规模问题下,这两个阶段的复杂度都会变得非常高,甚至难以处理。

因此,针对大规模MDP问题,需要采用一些高效的近似算法来求解最优策略,比如基于近似值函数的策略迭代算法或者基于采样的增强学习算法。

马尔可夫决策过程中的策略迭代算法复杂度分析(四)

马尔可夫决策过程(MDP)是一种用于建模随机决策的数学框架,被广泛应用于强化学习和人工智能领域。

其中,策略迭代算法是一种常用的求解MDP最优策略的方法。

本文将对策略迭代算法的复杂度进行深入分析。

首先,我们需要了解策略迭代算法的基本原理。

策略迭代算法是一种通过不断迭代优化策略来求解MDP最优策略的方法。

其基本思想是先随机初始化一个策略,然后利用该策略对状态空间进行遍历,计算出每个状态的值函数。

接着,根据值函数来更新策略,再次对状态空间进行遍历,如此往复,直到策略收敛于最优策略。

在策略迭代算法中,每一次迭代都需要对整个状态空间进行遍历,计算值函数和更新策略,因此算法的复杂度是非常高的。

具体来说,策略迭代算法的复杂度可以分为两个方面来进行分析:时间复杂度和空间复杂度。

首先是时间复杂度。

在每一次迭代中,需要对整个状态空间进行遍历,计算值函数和更新策略。

假设状态空间的大小为n,动作空间大小为m,那么对于每个状态,需要计算其值函数和选择最优动作,时间复杂度为O(m)。

因此,整个策略迭代算法的时间复杂度为O(n*m)。

在实际应用中,状态空间和动作空间通常都非常大,因此策略迭代算法的时间复杂度是相当高的。

其次是空间复杂度。

在策略迭代算法中,需要保存每个状态的值函数和策略,以便进行更新和比较。

假设值函数和策略都是以数组的形式存储,那么空间复杂度为O(n)。

在实际应用中,状态空间通常非常大,因此策略迭代算法的空间复杂度也是相当高的。

除了时间复杂度和空间复杂度,还有一些其他因素会影响策略迭代算法的复杂度。

例如,值函数的计算和策略的更新可能需要进行多次迭代才能收敛,这会增加算法的时间复杂度。

此外,如果状态空间和动作空间非常大,可能会导致算法的收敛速度非常慢,从而增加算法的时间复杂度。

综上所述,策略迭代算法在求解MDP最优策略时具有较高的复杂度。

在实际应用中,为了降低算法的复杂度,可以采用一些优化方法,例如使用近似计算方法、分布式计算方法或者结合其他启发式算法来加速收敛。

马尔可夫决策过程中的策略迭代算法复杂度分析(五)

马尔可夫决策过程(MDP)是一种用于建模随机决策过程的数学框架。

在MDP 中,智能体从一个状态转移到另一个状态,并且在每个状态下采取行动来最大化累积奖励。

策略迭代算法是一种解决MDP的方法,它通过反复迭代策略来获得最优策略。

在策略迭代算法中,首先需要初始化一个策略,然后进行值函数的评估和策略改进。

值函数的评估是用来估计每个状态的价值,而策略改进则是根据值函数来改善当前策略。

这两个步骤会交替进行,直到策略收敛为止。

策略迭代算法的复杂度主要取决于值函数的评估和策略改进这两个步骤的计算复杂度。

在值函数的评估中,需要计算每个状态的价值,这通常需要通过迭代方法进行求解。

对于有限状态空间的MDP来说,可以使用动态规划算法来进行值函数的评估,其时间复杂度为O(n^3),其中n为状态空间的大小。

而对于大规模状态空间的MDP来说,值函数的评估通常会使用近似方法,如蒙特卡洛方法或时序差分学习,其时间复杂度会取决于采样的次数和状态空间的大小。

在策略改进中,需要根据值函数来改善当前策略。

通常情况下,可以通过贪婪策略来进行策略改进,即在每个状态下选择具有最大价值的行动。

这个过程的时间复杂度通常为O(n^2),其中n为状态空间的大小。

综上所述,策略迭代算法的复杂度主要取决于值函数的评估和策略改进这两个步骤的计算复杂度。

对于有限状态空间的MDP来说,策略迭代算法的时间复杂度通常为O(n^3),其中n为状态空间的大小。

而对于大规模状态空间的MDP来说,策略迭代算法的时间复杂度会受到值函数评估方法的影响,通常会采用近似方法来进行求解。

在实际应用中,由于MDP通常具有大规模状态空间,策略迭代算法的时间复杂度会相对较高。

因此,研究如何提高策略迭代算法的计算效率是一个重要的课题。

近年来,一些基于深度学习的方法如深度Q网络(DQN)和深度确定性策略梯度(DDPG)等被引入到MDP的求解中,取得了一定的效果。

这些方法通过利用神经网络的强大拟合能力来近似值函数和策略,从而提高了策略迭代算法的计算效率。

mdp 值迭代算法

mdp 值迭代算法MDP 值迭代算法MDP 值迭代算法是一种用于求解马尔可夫决策过程(Markov Decision Process,简称 MDP)的经典算法。

MDP 是一种数学模型,可以用来描述和求解具有随机性和决策性的问题。

值迭代算法是其中一种常用的解决方法。

MDP 值迭代算法的基本思想是通过迭代计算每个状态的值函数,直到收敛为止。

值函数表示在每个状态下采取最优策略可以获得的累计奖励。

通过迭代更新值函数,最终可以得到每个状态的最优值函数,从而求解出最优策略。

算法的具体步骤如下:1. 初始化每个状态的值函数为0,或者一个较小的随机值。

2. 对于每个状态,根据当前的值函数和已知的转移概率,计算采取每个可能行动后的下一个状态的值函数。

3. 更新每个状态的值函数为所有可能行动中能够获得最大值的值函数。

4. 重复步骤2和步骤3,直到值函数收敛。

在每次迭代中,值函数的更新基于贝尔曼方程,该方程描述了当前状态的值函数和下一个状态的值函数之间的关系。

通过不断迭代更新值函数,最终可以得到最优的值函数和最优策略。

MDP 值迭代算法的收敛性是得到保证的。

由于每次迭代都会使值函数逼近最优值函数,经过足够多次的迭代后,值函数会收敛到最优值函数。

同时,算法的时间复杂度是有限的,因为在每次迭代中,只需要计算每个状态的值函数一次,而不需要知道整个状态转移概率。

MDP 值迭代算法在实际问题中有广泛的应用。

例如,在强化学习中,可以使用该算法来求解智能体在环境中的最优策略。

另外,在资源分配、排队论、金融工程等领域,MDP 值迭代算法也被用于求解最优决策问题。

需要注意的是,值迭代算法虽然能够求解出最优策略,但在实际问题中可能会面临状态空间过大的挑战。

当状态空间较大时,算法的计算复杂度会显著增加,导致求解时间过长。

因此,在实际应用中,常常需要结合其他方法,如近似算法或采样算法,来降低计算复杂度。

总结起来,MDP 值迭代算法是一种用于求解马尔可夫决策过程的经典算法,通过迭代计算每个状态的值函数,最终得到最优的值函数和最优策略。

值函数迭代算法

值函数迭代算法一、引言值函数迭代算法是强化学习中一种经典的算法,用于解决马尔可夫决策过程(MDP)问题。

在MDP中,智能体通过与环境交互来学习最优策略。

值函数迭代算法通过迭代更新值函数,逐步逼近最优值函数,并得到最优策略。

二、值函数和策略在值函数迭代算法中,我们首先要了解值函数和策略的概念。

2.1 值函数值函数用于评估智能体在不同状态下的价值。

对于一个MDP问题,值函数可以分为两种类型:状态值函数和动作值函数。

2.1.1 状态值函数状态值函数(V函数)表示智能体在某个状态下的预期回报。

具体而言,对于状态s,其状态值函数表示为V(s)。

状态值函数可以用于评估智能体在不同状态下的优劣。

2.1.2 动作值函数动作值函数(Q函数)表示智能体在某个状态下采取某个动作的预期回报。

具体而言,对于状态s和动作a,其动作值函数表示为Q(s,a)。

动作值函数可以用于评估智能体在不同状态下采取不同动作的优劣。

2.2 策略策略表示智能体在不同状态下采取不同动作的概率分布。

策略可以是确定性策略或随机策略。

确定性策略表示在每个状态下只选择一个动作,而随机策略表示在每个状态下选择动作的概率不确定。

三、值函数迭代算法原理值函数迭代算法是一种基于动态规划的算法,通过迭代更新值函数来逼近最优值函数和最优策略。

值函数迭代算法包括两个步骤:策略评估和策略改进。

3.1 策略评估策略评估的目标是计算当前策略下的值函数。

策略评估可以通过迭代更新值函数来实现。

具体而言,策略评估的更新公式如下:V_{k+1}(s) = \sum_{a} \pi(a|s) \sum_{s',r} p(s',r|s,a)[r + \gamma V_k(s')]其中,V_k(s)表示第k次迭代时状态s的值函数,V_{k+1}(s)表示第k+1次迭代时状态s的值函数,(a|s)表示在状态s下选择动作a的概率,p(s’,r|s,a)表示从状态s采取动作a后转移到状态s’并获得奖励r的概率,。

如何在马尔可夫决策过程中处理策略迭代算法与值迭代算法比较(七)

在强化学习领域,马尔可夫决策过程(MDP)是一种常用的数学框架,用于建模决策问题。

MDP通常用于描述一个智能体在与环境互动的过程中,如何做出决策以达到最优的目标。

在解决MDP问题时,策略迭代算法和值迭代算法是两种常用的方法,它们分别采用不同的思路来寻找最优策略。

本文将对这两种算法进行比较,并探讨它们的优缺点。

首先,我们来看一下策略迭代算法。

策略迭代算法是一种基于策略评估和策略改进的迭代算法。

在每一轮迭代中,算法首先对当前策略进行评估,计算出该策略对应的值函数。

然后,算法利用这个值函数来改进策略,使得新的策略相对于旧策略能够取得更好的效果。

这个过程一直迭代下去,直到策略收敛为止。

策略迭代算法的优点在于,它能够保证在有限步内收敛到最优策略,并且在每一步迭代中都能够得到一个改进的策略。

然而,策略迭代算法的缺点也是显而易见的,它的每一轮迭代都需要进行策略评估和策略改进,计算量较大,收敛速度较慢。

接下来,我们再来看一下值迭代算法。

值迭代算法是一种基于值函数迭代的算法。

在值迭代算法中,算法首先初始化值函数,然后通过值函数的迭代更新来逐步逼近最优值函数。

一旦值函数收敛,最优策略也就能够被得到。

与策略迭代算法相比,值迭代算法的优点在于,它的每一步迭代都是基于值函数的更新,计算量较小,收敛速度较快。

然而,值迭代算法的缺点也是存在的,它在每一步迭代中都需要更新值函数,这对于状态空间较大的问题来说,计算量也是非常庞大的。

在实际应用中,我们如何选择策略迭代算法和值迭代算法呢?一般来说,当状态空间较小时,我们可以选择策略迭代算法,因为它能够保证在有限步内收敛到最优策略。

而当状态空间较大时,我们可以选择值迭代算法,因为它的收敛速度较快,计算量较小。

此外,我们还可以将策略迭代算法和值迭代算法结合起来,利用它们各自的优点,来解决复杂的MDP问题。

总的来说,策略迭代算法和值迭代算法都是解决MDP问题的有效方法,它们各自有着自己的优缺点。

马尔可夫决策过程中的策略优化方法(五)

马尔可夫决策过程(Markov Decision Process,MDP)是一个用于建模决策问题的数学框架,它被广泛应用于人工智能、运筹学、控制论等领域。

在MDP中,决策者处于一个随机环境中,通过选择不同的行动来影响环境状态的转移,并试图最大化长期累积奖励。

在实际应用中,我们经常需要寻找一种优化策略的方法来解决MDP问题,本文将介绍一些常见的策略优化方法。

首先,要介绍的是价值迭代算法(Value Iteration)。

价值迭代算法是一种基于价值函数的迭代优化方法。

在MDP中,价值函数表示了每个状态下的长期累积奖励,而价值迭代算法通过不断更新每个状态的价值函数,最终收敛到最优价值函数。

一般来说,价值迭代算法可以分为同步更新和异步更新两种方式。

同步更新是指在每次迭代中同时更新所有状态的价值函数,而异步更新则是只更新部分状态的价值函数。

价值迭代算法的优点是能够收敛到最优解,并且不需要对环境动态特性做出假设,但缺点是在状态空间过大时计算复杂度较高。

其次,策略迭代算法(Policy Iteration)也是一种常见的策略优化方法。

与价值迭代算法不同,策略迭代算法是直接对策略进行迭代优化。

在MDP中,策略表示了在每个状态下选择不同行动的概率分布。

策略迭代算法通过交替进行策略评估和策略改进两个步骤,最终收敛到最优策略。

策略迭代算法的优点是能够收敛到最优解,并且在状态空间较大时计算复杂度相对较低,但缺点是需要对环境动态特性做出一定的假设。

除了传统的迭代优化方法,近年来,一些基于近似的策略优化方法也得到了广泛的关注。

这些方法包括基于函数近似的策略优化、基于样本的策略优化等。

其中,基于函数近似的策略优化方法通过使用函数逼近器(如神经网络、线性模型等)来近似价值函数或策略函数,从而减少状态空间的复杂度。

而基于样本的策略优化方法则是通过采样环境来获取状态-动作对的样本数据,然后利用这些样本数据来优化策略。

这些方法的优点是能够处理高维、大规模的状态空间,但缺点是需要克服函数逼近误差和样本采样偏差等问题。

如何利用马尔可夫决策过程进行路径规划(五)

马尔可夫决策过程(Markov Decision Process,简称MDP)是一种用于建模决策问题的数学框架。

它能够帮助我们在不确定的环境中做出最优的决策,因此在路径规划领域有着广泛的应用。

本文将探讨如何利用马尔可夫决策过程进行路径规划,并介绍一些相关的算法和方法。

马尔可夫决策过程的基本概念是状态、动作和奖励。

在路径规划中,状态可以用来描述机器人或车辆所处的位置和姿态,动作则表示机器人或车辆可以采取的行动,奖励则反映了每个状态-动作对的好坏程度。

通过建立状态空间、动作空间和奖励函数,我们可以利用马尔可夫决策过程来制定路径规划策略。

首先,我们需要定义状态空间。

在路径规划中,状态空间通常表示机器人或车辆可能处于的所有位置和姿态。

例如,如果我们希望规划一个机器人在办公室中移动的路径,状态空间可以包括办公室中的每个房间和每个房间中的不同位置。

通过将状态空间离散化,我们可以将连续空间转化为离散空间,从而简化路径规划问题的复杂度。

其次,我们需要定义动作空间。

动作空间表示机器人或车辆可以采取的所有行动。

在路径规划中,动作通常包括移动到相邻位置、转向、停止等。

通过定义动作空间,我们可以将路径规划问题分解为一系列局部决策问题,从而更容易求解最优路径。

接下来,我们需要定义奖励函数。

奖励函数用来评估每个状态-动作对的好坏程度。

在路径规划中,奖励函数通常根据目标位置和当前位置的距离、碰撞风险、能源消耗等因素来设计。

通过合理设计奖励函数,我们可以引导机器人或车辆做出最优的决策,以实现最优的路径规划。

一旦我们定义了状态空间、动作空间和奖励函数,就可以利用马尔可夫决策过程来制定路径规划策略。

在实际应用中,我们通常会使用一些基于MDP的算法来求解最优策略,例如值迭代算法、策略迭代算法、Q-learning算法等。

值迭代算法是一种基于动态规划的方法,通过不断更新每个状态的值函数来求解最优策略。

它的优点是收敛速度较快,但缺点是需要对整个状态空间进行遍历,计算量较大。

马尔可夫决策过程中的策略迭代算法分析(十)

马尔可夫决策过程(MDP)是一种用于描述随机决策问题的数学框架。

它是一种基于马尔可夫链的动态系统模型,被广泛应用于强化学习、控制论、运筹学等领域。

在MDP中,决策者试图找到一个最优策略,使得长期收益最大化。

策略迭代算法是一种用于求解MDP最优策略的经典方法,本文将对策略迭代算法进行分析。

MDP的基本概念MDP模型由五元组(S, A, P, R, γ)组成,其中S为状态空间,A为动作空间,P为状态转移概率矩阵,R为奖励函数,γ为折扣因子。

在每个时刻t,智能体处于状态s,执行动作a,根据状态转移概率和奖励函数,环境会将智能体转移到下一状态s'并给予奖励r。

MDP旨在求解一个最优的策略π:在每个状态下选择一个最优的动作,使得长期收益最大化。

策略迭代算法策略迭代算法是一种基于价值函数的策略优化方法。

它的基本思想是不断迭代地改进策略,直到收敛于最优策略。

该算法包括两个步骤:策略评估和策略改进。

策略评估:在策略π下,对每个状态s计算其值函数Vπ(s)。

值函数表示在状态s下按照策略π所能得到的长期收益。

策略评估通过迭代计算每个状态的值函数,直至收敛于真实值函数Vπ。

策略改进:在策略评估的基础上,对每个状态s选择一个最优的动作a,构建新的策略π'。

若新策略与旧策略相同,则停止算法;否则返回策略评估步骤,继续迭代。

策略迭代算法的优势在于它能够保证最终收敛于最优策略。

然而,它也存在一些缺点,比如收敛速度慢、内存占用大等问题。

因此,研究者们提出了很多改进的策略迭代算法,比如快速策略迭代、异步策略迭代等。

改进的策略迭代算法在传统的策略迭代算法中,策略评估和策略改进是交替进行的,这使得算法的收敛速度受到限制。

为了加速收敛,研究者们提出了一系列改进的策略迭代算法。

其中,快速策略迭代(FPI)是一种重要的改进方法。

它通过将策略评估和策略改进的过程合并在一起,加快了算法的收敛速度。

此外,异步策略迭代(API)也是一种有效的改进算法。

mdp 值迭代算法

mdp 值迭代算法MDP值迭代算法MDP(Markov Decision Process)值迭代算法是一种用于求解马尔可夫决策过程的经典算法。

在强化学习中,MDP值迭代算法被广泛应用于求解最优策略问题。

本文将介绍MDP值迭代算法的原理和步骤,并通过实例解释其应用。

一、MDP简介马尔可夫决策过程是一种用于描述序列决策问题的数学模型,它基于马尔可夫性质,将问题的状态、动作和奖励进行建模。

MDP包括状态空间、动作空间、状态转移概率和奖励函数等组成部分。

在MDP中,智能体根据当前状态选择一个动作,并通过状态转移概率和奖励函数获得下一个状态和奖励。

二、MDP值迭代算法原理MDP值迭代算法的目标是求解MDP问题的最优值函数和最优策略。

值函数表示在每个状态下采取最优策略所能获得的累计奖励,最优策略则是使值函数最大化的策略。

值迭代算法的核心思想是通过迭代更新值函数来逼近最优值函数。

算法从一个初始的值函数开始,通过不断迭代更新值函数,直到值函数收敛于最优值函数。

迭代更新的过程中,算法会计算每个状态的最优动作和对应的值函数,并将这些信息用于更新值函数。

更新值函数的过程可以通过贝尔曼方程进行描述。

三、MDP值迭代算法步骤MDP值迭代算法的具体步骤如下:1. 初始化值函数:将所有状态的值函数初始化为0或其他合适的初始值。

2. 迭代更新值函数:重复以下步骤直到值函数收敛:a. 对于每个状态,计算其所有可能动作的值函数。

b. 选择动作值函数最大化的动作作为最优动作。

c. 使用贝尔曼方程更新当前状态的值函数。

3. 输出最优策略:根据最优值函数,选择每个状态下值函数最大的动作作为最优策略。

四、MDP值迭代算法实例为了更好地理解MDP值迭代算法,下面以一个简单的网格世界问题为例进行说明。

假设有一个3x3的网格世界,智能体在网格中移动,每个格子都有一个奖励,目标是使智能体获得尽可能大的累计奖励。

智能体可以选择上、下、左、右四个动作进行移动,但在边界格子上移动时会保持原地。

马尔可夫决策过程中的策略迭代算法与蒙特卡洛树搜索算法比较

马尔可夫决策过程(MDP)是一种用来描述在不确定环境下进行决策的数学框架,它在人工智能和强化学习领域有着广泛的应用。

在MDP中,智能体通过选择不同的动作来影响环境状态的转移,并通过获得奖励来评估每个动作的好坏。

为了解决MDP问题,常常使用策略迭代算法和蒙特卡洛树搜索算法。

本文将对这两种算法进行比较,分析它们的优缺点和适用场景。

策略迭代算法是一种基于价值迭代的动态规划方法,它通过不断更新策略和价值函数来寻找最优策略。

在每一次迭代中,策略迭代算法首先计算当前策略下的价值函数,然后根据新的价值函数更新策略,直到策略收敛到最优策略为止。

策略迭代算法的优点是收敛速度快,能够找到全局最优解,但其缺点是在状态空间较大时计算复杂度较高。

与之相对应的是蒙特卡洛树搜索算法,它是一种基于树搜索的方法,通过模拟对不同动作进行评估,并选择最优的动作来更新策略。

蒙特卡洛树搜索算法在每次迭代中通过模拟多次游戏来评估每个动作的价值,并根据这些评估结果来选择下一步的动作。

蒙特卡洛树搜索算法的优点是适用于高维状态空间和大规模搜索问题,但其缺点是需要大量的模拟和计算时间。

从算法的比较可以看出,策略迭代算法适用于状态空间较小的MDP问题,而蒙特卡洛树搜索算法适用于状态空间较大的MDP问题。

在实际应用中,可以根据具体的问题特点来选择合适的算法。

例如,在棋类游戏中,状态空间较大,可以使用蒙特卡洛树搜索算法来搜索最优解;而在工程控制领域,状态空间较小,可以使用策略迭代算法来求解最优策略。

除了适用场景的不同,策略迭代算法和蒙特卡洛树搜索算法在计算效率、收敛性和鲁棒性等方面也有所差异。

策略迭代算法在状态空间较小时计算效率较高,收敛性较好,但在状态空间较大时可能会陷入局部最优解。

而蒙特卡洛树搜索算法在状态空间较大时计算效率较高,鲁棒性较好,但收敛性可能会受到模拟次数和模型精度的影响。

总的来说,策略迭代算法和蒙特卡洛树搜索算法各有优缺点,需要根据具体问题来选择合适的算法。

贝尔曼最优公式的证明

贝尔曼最优公式的证明贝尔曼最优公式是强化学习中一种重要的算法,它通过迭代的方式计算出最优策略。

在这个过程中,我们以人类的视角来探讨它的证明。

让我们思考一个问题:在一个有限的时间内,如何选择最优的行动策略来最大化累积奖励?这是强化学习面临的核心问题之一。

贝尔曼最优公式正是为了解决这个问题而提出的。

我们假设有一个马尔可夫决策过程(MDP),其中包含状态空间S、动作空间A、状态转移概率P和奖励函数R。

我们的目标是找到一个最优策略π*,使得在任何状态s下,通过执行π*(s)得到的累积奖励最大化。

现在,让我们来推导贝尔曼最优公式的证明。

首先,我们定义一个状态s的值函数V(s),表示从状态s开始,按照最优策略π*执行所能获得的累积奖励的期望值。

换句话说,V(s)是在状态s下所能达到的最大累积奖励。

根据马尔可夫性质,我们知道在任何状态s下,执行一个动作a后,会转移到另一个状态s'的概率是P(s'|s,a)。

那么从状态s开始,按照最优策略π*执行所能获得的累积奖励的期望值,可以表示为:V(s) = max[∑P(s'|s,a)(R(s,a,s')+γV(s'))]其中,∑P(s'|s,a)(R(s,a,s')+γV(s'))表示从状态s执行动作a后,转移到状态s'并获得奖励R(s,a,s')的期望值,γ是折扣因子,用于衡量未来奖励的重要性。

接下来,我们假设已经知道了每个状态的值函数V(s),我们可以通过计算每个状态的最优动作来求解最优策略。

我们定义一个动作函数Q(s,a),表示在状态s下执行动作a所能获得的累积奖励的期望值。

那么,Q(s,a)可以表示为:Q(s,a) = ∑P(s'|s,a)(R(s,a,s')+γV(s'))根据贝尔曼最优公式,我们可以得到:V(s) = max[Q(s,a)]也就是说,一个状态的值函数等于在该状态下所有可能动作的值函数的最大值。

基于值迭代的MDP算法求解最优策略

。

P(s|s' ,a)1

s ' S

❖ 例如P(s’|s,a),显然 0≤P(s’|s,a)≤1,并且

❖ 策略 Π:指决策者对于特定状态,应选择的动作。

❖ MDP决策的策略是将状态映射到动作,同时满足 使Agent选择的动作能够获得环境报酬的累计值最 大。

值函数

LOGO

❖ 值函数:指对于特定策略和某一状态,执行该策 略直到达到吸收状态,所获得的累计回报的期望。

LOGO

❖ 石轲,基于马尔可夫决策过程理论的Agent决策问 题研究,中国科学技术大学,2010

❖ 孙湧,仵博, 冯延蓬,基于策略迭代和值迭代的 POMDP算法,计算机 研究与发展,2008年

❖ 刘克,实用马尔可夫决策过程[M] .北 京 :清华 大学出版社 ,2004

❖ 鲁庆,基于栅格法的移动机器人路径规划研究, 电脑与信息技术,2007年

do

8

VHistory(s ) : V(s)

9

max V(s) : R(s) γ

P s' |s, a V(s' )

a

s'

10

DeltaOneIt eration (VHistory( s) V(s)) 2

11 end // foreach

12 if ( DeltaOneIt eration THRESHOLD)

do

2 V(s) : 0

3 end // foreach

4 initialize V[9] : 1 . 0 , V[10] : 1.0

5 while ( true )

6 DeltaOneIt eration : 0

7 for each s except state 9 and 10 in StateSpace

名词解释mdps

名词解释mdps标题:名词解释MDPs引言概述:马尔可夫决策过程(MDPs)是一种用于建模和求解序贯决策问题的数学框架。

它在人工智能领域和强化学习中具有重要的应用。

本文将从五个大点详细阐述MDPs的概念、特点、应用、求解方法和挑战。

正文内容:1. MDP的概念1.1 MDP的定义:MDP是一个四元组(S, A, P, R),其中S是状态的集合,A是动作的集合,P是状态转移概率矩阵,R是奖励函数。

1.2 状态和动作:状态是系统在某一时刻的特定情况,动作是在给定状态下可执行的操作。

2. MDP的特点2.1 马尔可夫性质:MDP中的状态转移只与当前状态和执行的动作有关,与过去的状态和动作无关。

2.2 奖励函数:MDP中的奖励函数用于评估每个状态转移的好坏程度,目标是最大化累积奖励。

2.3 延迟奖励:MDP中的奖励可能在未来的多个时间步骤中才会得到体现。

2.4 策略:策略是从状态到动作的映射,用于指导智能体在MDP中的决策。

3. MDP的应用3.1 强化学习:MDPs是强化学习的基础,通过学习和优化策略,智能体可以在不断与环境交互的过程中获得最优决策。

3.2 自动控制:MDPs可以用于建模和求解自动控制问题,例如无人驾驶车辆的路径规划和控制。

3.3 资源分配:MDPs可以应用于资源分配问题,例如优化物流和生产调度等领域。

4. MDP的求解方法4.1 基于价值迭代的方法:通过迭代更新状态的价值函数,逐步求解最优策略。

4.2 基于策略迭代的方法:通过迭代更新策略,逐步求解最优策略。

4.3 Q-learning算法:基于Q值的更新规则,通过不断探索和利用的方式学习最优策略。

5. MDP的挑战5.1 维度灾难:随着状态和动作空间的增加,MDPs的求解难度呈指数级增长。

5.2 奖励稀疏性:在某些情况下,MDPs中的奖励很少,使得学习最优策略变得困难。

5.3 非确定性环境:MDPs中的状态转移和奖励可能受到随机因素的影响,增加了求解的复杂性。

马尔可夫决策过程中的策略迭代算法优化(Ⅱ)

马尔可夫决策过程(Markov Decision Process,MDP)是一种用于描述具有随机性和不确定性的决策问题的数学框架。

在MDP中,智能体(agent)通过选择不同的动作来影响环境状态的转移,并获得相应的奖励。

MDP的目标是找到一个最优的策略,使得智能体在不确定环境中能够获得最大的长期奖励。

在解决MDP问题时,一个重要的工具就是策略迭代算法。

策略迭代算法是一种通过不断改进当前策略来寻找最优策略的方法。

它包括价值迭代和策略改进两个步骤,通过这两个步骤的循环迭代,最终可以找到最优的策略。

首先,让我们来看一下价值迭代算法。

价值迭代算法的核心思想是通过迭代更新每个状态的价值函数,直到收敛为止。

具体来说,对于每个状态,算法会根据当前的价值函数和环境的转移概率,计算选择不同动作后可能获得的奖励,并选择能够获得最大奖励的动作来更新当前状态的价值。

这样不断迭代直到收敛,最终得到每个状态的最优价值函数。

接下来是策略改进步骤。

在策略改进步骤中,算法会根据已经得到的价值函数,对当前的策略进行改进。

具体来说,对于每个状态,算法会根据当前的价值函数,选择能够获得最大奖励的动作来更新当前的策略。

这样不断迭代直到当前的策略不再发生改变,即找到了最优的策略。

然而,传统的策略迭代算法在处理大规模的MDP问题时会面临一些问题。

其中最主要的问题就是计算复杂度过高,导致算法运行时间过长。

为了解决这一问题,有学者提出了一种基于近似算法的策略迭代优化方法。

近似策略迭代算法的核心思想是通过近似价值函数和策略函数来减少计算复杂度,从而加速算法的收敛速度。

具体来说,算法会使用一些近似方法来计算状态的价值函数和策略函数,而不是对所有的状态进行精确计算。

这样可以大大减少计算量,提高算法的运行效率。

在近似策略迭代算法中,常用的近似方法包括函数逼近、采样和近似优化等。

其中,函数逼近是一种通过选择合适的函数形式来近似表示价值函数和策略函数的方法。

价值迭代算法

价值迭代算法简介价值迭代算法(Value Iteration Algorithm)是强化学习中一种常用的算法,用于求解马尔可夫决策过程(Markov Decision Process,MDP)的最优策略。

在MDP 中,智能体需要在不同的状态下做出决策,使得累积的回报最大化。

价值迭代算法通过计算每个状态的价值函数,从而确定最优策略。

工作原理价值迭代算法首先初始化每个状态的价值函数为0,然后按照以下步骤进行迭代,直到价值函数收敛为止:1.对于每个状态s,计算所有可能的动作a的价值函数Q(s,a)。

2.更新状态s的价值函数V(s)为所有动作的价值函数Q(s,a)中的最大值。

3.重复步骤1和步骤2,直到所有状态的价值函数不再发生变化。

具体来说,算法在每一次迭代中遍历所有状态,并对每个状态进行动作选择和更新。

通过迭代计算,最终可以得到所有状态的最优价值函数和最优策略。

算法伪代码以下是基于价值迭代算法的伪代码:函数 value_iteration(状态集合S, 动作集合A, 转移函数T, 奖励函数R, 计算误差ε):初始化价值函数V为0重复直到收敛:初始化误差Δ为0对于每个状态s属于S:计算状态s的动作价值函数Q(s,a),其中a属于A更新状态s的价值函数V为动作价值函数Q(s,a)的最大值更新误差Δ为V(s)的变化量与当前最大误差的较大值如果误差Δ小于给定误差ε,则停止迭代返回价值函数V和最优策略π示例应用假设我们有一个机器人需要在一个迷宫环境中找到宝藏,同时避免陷阱。

我们可以使用价值迭代算法来解决该问题。

首先,我们定义状态集合S为迷宫中的每个位置,动作集合A为上、下、左、右四个方向。

转移函数T定义了机器人在每个位置上执行动作后可能到达的下一个位置。

奖励函数R定义了机器人在每个位置上执行动作后可能获得的奖励,宝藏位置对应较大的奖励,陷阱位置对应较小的奖励。

接下来,我们可以使用价值迭代算法来计算每个位置的价值函数,并根据最大价值函数选择动作,直到达到收敛条件。

mdp值迭代例题

mdp值迭代例题以下是一个简单的例子,演示如何使用值迭代算法求解Markov决策过程(MDP)问题。

假设有一个简单的迷宫,如下图所示:luaS = {0, 1, 2, 3, 4}A = {'U', 'D', 'L', 'R'}P = [[0.8, 0.1, 0.0, 0.1],[0.1, 0.8, 0.1, 0.0],[0.0, 0.1, 0.8, 0.1],[0.1, 0.0, 0.1, 0.8],[0.8, 0.1, 0.0, 0.1]]R = [0, -1, -1, -1, 0]其中,S 表示状态集合,A 表示动作集合,P 表示状态转移概率矩阵,R 表示奖励函数。

根据值迭代算法,我们可以按照以下步骤求解最优策略:1.初始化值函数V(s) 为0,对于所有s ∈S。

2.对于每个状态s,执行以下循环:a. 对于每个动作a,计算在状态s 下执行动作a 的期望回报:Q(s, a) = R(s, a) + ΣP(s', a | s, a) * max Q(s', a') * V(s')。

b. 更新值函数:V(s) = max Q(s, a)。

3.当所有状态的值函数收敛时,停止循环。

4.根据最优策略π*(s) = arg max Q(s, a),对于所有s ∈S,输出最优策略π*(s)。

在这个例子中,使用Python 的numpy 库实现值迭代算法:pythonimport numpy as np# 定义状态转移概率矩阵 P 和奖励函数 RP = np.array([[0.8, 0.1, 0.0, 0.1],[0.1, 0.8, 0.1, 0.0],[0.0, 0.1, 0.8, 0.1],[0.1, 0.0, 0.1, 0.8],[0.8, 0.1, 0.0, 0.1]])R = np.array([0, -1, -1, -1, 0])# 初始化值函数 V 为全零矩阵V = np.zeros((5, 1))# 值迭代循环,迭代次数为 50 次for i in range(50):for s in range(5):Q = np.zeros((5, len(A))) # Q(s, a)矩阵初始化为全零矩阵for a in A: # 对于每个动作 a,计算 Q(s, a)for s_next in range(5): # 对于每个可能的状态 s',计算 P(s', a | s, a) * max Q(s', a') * V(s')Q[s_next][a] = P[s][s_next][a] * (R[s_next] + np.max(Q[:, A])) * V[s_next]# 更新值函数 V(s) = max Q(s, a)V[s] = np.max(Q[:, A])。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

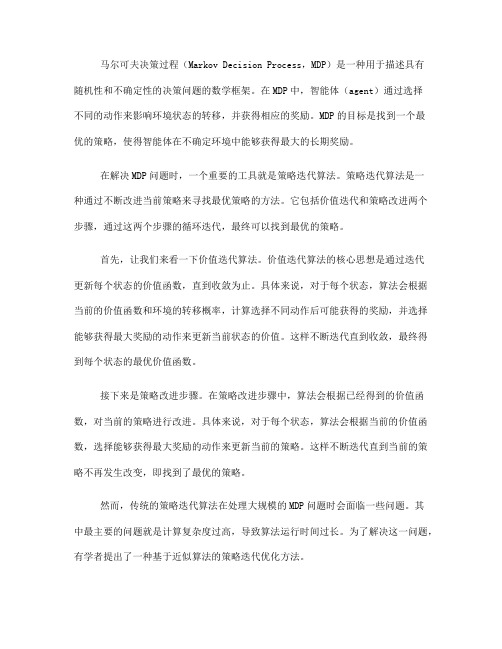

基于值迭代的MDP算法求解最优 策略

姓名:陈丽 学号:E13301110

参考文献

LOGO

❖ 石轲,基于马尔可夫决策过程理论的Agent决策问 题研究,中国科学技术大学,2010

❖ 孙湧,仵博, 冯延蓬,基于策略迭代和值迭代的 POMDP算法,计算机 研究与发展,2008年

❖ 刘克,实用马尔可夫决策过程[M] .北 京 :清华 大学出版社 ,2004

P s' |s, a Q(s' , a' )

s'

a'

s'

13

DeltaOneIt eration (QHistory( s, a) Q(s, a)) 2

14

end // inner foreach

15 end // outer foreach

16 if ( DeltaOneIt eration THRESHOLD)

❖ (2)动空间 A:{ N, E, S, W },小机器人有北, 东,南,西四个可选动作。

❖ (3)状态转移概率模型 { P }:每个动作以0.8的概率 到达动作期望状态,分别以0.1的概率到达动作的 两个侧向状态。

❖ (4)状态转移回报模型R:R((10)) = +1.0,

R((9)) = -1.0,R(其他状态) = -0.02。

LOGO

❖设立阈值THRESHOLD为0.0001,算 法经过12轮迭代结束;

结果分析

❖ 方格中显示对应状态的V值。

LOGO

算法改进

LOGO

1 algrithm Q - offline learing

2 for each s in StateSpace

do

3 for each a in ActionSpac e do

回报函数

4

Q(s, a) : 0

5 end ..// inner foreach

动作值函数:

6 end // outer foreach 7 while ( true )

m ax Q a : ()s P s |s, 'R ,a|sa (, s γ )'

P s |s'Q ,a,a ) ('s

s'

值函数

LOGO

❖ 值函数:指对于特定策略和某一状态,执行该策 略直到达到吸收状态,所获得的累计回报的期望。

❖ 值函数为:V:(R s) (γsm ) aP s|s'ax ,V)(s' a s'

❖ 其中γ为折扣因子,其目标是让期望值有界.

问题陈述

LOGO

❖ (1)状态空间 S:小机器人有11个活动状态,编号 0~10;

a' s'

8 DeltaOneIt eration : 0

9 for each s in StateSpace

do

10

for each a in ActionSpac e do

11

QHistory(s , a) : Q(s, a)

12

max Q(s, a) : P s' |s, a R(s' | s, a) γ

❖ (5)γ=0.99

❖ (6)定义状态10和9为吸收状态,第一次到达吸收 状态时,获得对应吸收状态回报;

问题陈述

LOGO

目标、 吸收状态 禁止、 吸收状态

❖ 例如P(6)|(5),N = 0.8,P(8)|(5),N = 0.1,P(3)|(5),N = 0.1, P(其他状态)|(5),N = 0.0。

❖ 鲁庆,基于栅格法的移动机器人路径规划研究, 电脑与信息技术,2007年

问题背景描述

LOGO

❖ 利用栅格法对空间划分,搜索一条从起始栅格到 终点栅格的路径,构成机器人运动的可行路径。

障碍 物

目标、 吸收状态

禁止、 吸收状态

实验内容: 基于值迭代的MDP 算法,找出从某状 态到达目标状态时, 使状态值函数达到 最大值的最优策略。

7 for each s except state 9 and 10 in StateSpace

do

8

VHistory(s ) : V(s)

9

max V(s) : R(s) γ

P s' |s, a V(s' )

a

s'

10

DeltaOneIt eration (VHistory( s) V(s)) 2

11 end // foreach

12 if ( DeltaOneIt eration THRESHOLD)

13

return

14 end //if

15 end //while

16 end algrithm VI

一轮迭代后,当各状 态的V值变化量小于 阀值时,我们称此时 找到问题的最优策略 ;

实验结果

马尔可夫决策过程(MDP)

LOGO

❖ 基本的MDP模型是一个四元组:< S, A, { P } ,R >

。

P(s|s' ,a)1

s ' S

❖ 例如P(s’|s,a),显然 0≤P(s’|s,a)≤1,并且

❖ 策略 Π:指决策者对于特定状态,应选择的动作。

❖ MDP决策的策略是将状态映射到动作,同时满足 使Agent选择的动作能够获得环境报酬的累计值最 大。

17

return

18 end //if

19 end //while

20 end algrithm Q - offline learning

实验结果

LOGO

实验结果

LOGO

结果分析

LOGO

ML

算法设计

LOGO

0 algrithm Value Iteratin

1 for each s in StateSpace

do

2 V(s) : 0

3 end // foreach

4 initialize V[9] : 1 . 0 , V[10] : 1.0

5 while ( true )

6 DeltaOneIt eration : 0