基于回归方法分析波士顿房价数据间的相关关系

作业-机器学习-波士顿房价预测四种回归算法

作业-机器学习-波⼠顿房价预测四种回归算法# -*- coding:utf-8 -*-#基于波⼠顿房屋租赁数据进⾏房屋租赁价格预测模型构建,使⽤lasso回归算法做特征选择后,分别使⽤线性回归,#Lasso回归, Ridge回归, ElasticNet四类回归算法构建模型(分别测试1,2,3阶)import numpy as npimport matplotlib as mplimport matplotlib.pyplot as pltimport pandas as pdimport warningsimport sklearnfrom sklearn.linear_model import LinearRegression,LassoCV,RidgeCV,ElasticNetCVfrom sklearn.preprocessing import PolynomialFeatures #多项式特征from sklearn.pipeline import Pipelinefrom sklearn.linear_model.coordinate_descent import ConvergenceWarning #拦截异常的from sklearn.model_selection import train_test_splitfrom sklearn.preprocessing import StandardScalerfrom sklearn.grid_search import GridSearchCV #从sklearn.grid_search中导⼊⽹格搜索模块GridSearchCV。

from sklearn import metrics #评价指标def notEmpty(s):return s !='' #是空的话就是FLASE,不是空的话就是TRUE#设置字符集,防⽌中⽂乱码mpl.rcParams['font.sans-serif']=[u'simHei']mpl.rcParams['axes.unicode_minus']=False#拦截异常warnings.filterwarnings(action = 'ignore', category=ConvergenceWarning)# 加载数据names = ['CRIM','ZN', 'INDUS','CHAS','NOX','RM','AGE','DIS','RAD','TAX','PTRATIO','B','LSTAT'] #前13个和房价相关的字段,LSTAT为房价path = "datas/boston_housing.data"# 由于数据⽂件格式不统⼀,所以读取的时候,先按照⼀⾏⼀个字段属性读取数据,然后再安装每⾏数据进⾏处理fd = pd.read_csv(path,header=None)#print(fd.shape)data = np.empty((len(fd),14)) # len(fd)⾏,14列for i, d in enumerate(fd.values): #enumerate⽣成⼀列索引i,d为其元素d = map(float,filter(notEmpty,d[0].split(' '))) #filter⼀个函数,⼀个list, 就是空的扔掉,有值的留下#根据函数结果是否为真,来过滤list中的项data[i]=list(d)#分割数据x,y = np.split(data,(13,),axis=1) #分割前13列数据# print(x[0:5])#print(y) 由于y是个⼆维的,所以要⽤ravel拉成⼀维的y = y.ravel() #转换格式拉直操作#print(y[0:5])ly=len(y)# print(y.shape)print('样本数据量:%d,特征个数:%d '%x.shape)print('target样本数据量:%d'%y.shape[0])#Pipeline常⽤于并⾏调参models = [Pipeline([('ss', StandardScaler()),('poly', PolynomialFeatures()),('linear', RidgeCV(alphas=np.logspace(-3,1,20)))]),Pipeline([('ss', StandardScaler()),('poly', PolynomialFeatures()),('linear', LassoCV(alphas=np.logspace(-3,1,20))) #logspace 以10为底,从10的-3次⽅⽌10的0次⽅,中间有20步]),Pipeline([('ss', StandardScaler()),('poly', PolynomialFeatures()),('linear', LinearRegression())]),Pipeline([('ss', StandardScaler()),('poly', PolynomialFeatures()),('linear', ElasticNetCV(alphas=np.logspace(-3,1,20)))])]#参数字典,字典中的key是属性的名称,value是可选的参数列表parameters = {"poly__degree": [3,2,1],"poly__interaction_only": [True, False],#只产⽣交互相选TRUE,得到[0次⽅,X本⾝,Y本⾝,X1*Y1] ;默认选FLASE,不仅产⽣交互项,如X1*X1,Y1*Y1也会有"poly__include_bias": [True, False], #多项式幂为零的特征作为线性模型中的截距,默认为True"linear__fit_intercept": [True, False]}# rf = PolynomialFeatures(2,interaction_only=True)# a = pd.DataFrame({# 'name':[1,2,3,4,5],# 'score':[2,3,4,4,5]# })# b=rf.fit_transform(a)# print(b)#数据分割x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.2, random_state=0)#Lasso和Ridge模型⽐较运⾏图表展⽰titles = ['Ridge','Lasso','LinearRegression','ElasticNet']colors = ['g-','b-','y-','c-']plt.figure(figsize=(16,8), facecolor='w')ln_x_test = range(len(x_test))plt.plot(ln_x_test, y_test,'r-',lw=2,label=u'真实值')for t in range(4):#获取模型并设置参数#GridSearchCV: 进⾏交叉验证,选择出最优的参数值出来#第⼀个输⼊参数:进⾏参数选择的模型,#param_grid:⽤于进⾏模型选择的参数字段,要求是字典类型;cv: 进⾏⼏折交叉验证model = GridSearchCV(models[t], param_grid=parameters, cv=5, n_jobs=1) #五折交叉验证#模型训练-⽹格搜索model.fit(x_train, y_train)#模型效果值获取(最优参数)print('%s算法:最优参数:'%titles[t],model.best_params_)print('%s算法:R值=%.3f'%(titles[t],model.best_score_))#模型预测y_predict=model.predict(x_test)#画图plt.plot(ln_x_test,y_predict,colors[t],lw=2,label=u'%s算法估计值,$R^2$=%.3f'%(titles[t],model.best_score_)) #图形显⽰plt.legend(loc='lower right')plt.grid(True)plt.title(u'波⼠顿房屋价格预测')plt.show()## 模型训练 ====> 单个Lasso模型(1-3阶特征选择)<degree参数给定1-3阶情况的最优参数>for e in range(1,4):model = Pipeline([('ss', StandardScaler()),('poly', PolynomialFeatures(degree=e, include_bias=True, interaction_only=True)),('linear', LassoCV(alphas=np.logspace(-3,1,20), fit_intercept=False))])# 模型训练model.fit(x_train, y_train)# 模型评测## 数据输出print ("%d阶参数:"%e, list(zip(names,model.get_params('linear')['linear'].coef_)))print ("%d阶截距:"%e, model.get_params('linear')['linear'].intercept_)。

回归算法波士顿房价预测PPT课件

1

任务实施

我们采用了几种不同的回归算法对波士顿房价问题进行拟合:

• 首先,使用sklearn.model_selection模块的train_test_split()方法来划分测试集和训练集。

• 接着,我们需要定义R2函数,用于衡量回归模型对观测值的拟合程度。它的定义是R2 = 1“回归平方和在总平方和中所占的比率”,可见回归平方和(即预测值与实际值的误差平

1

一、单变量线性回归

1.模型定义

一般用来表示参数集合,即通用公式为:

其中的x是数据的特征属性值,例如上面例子中房子的面积;y是目标值,即房子的价格。

这就是我们常说的线性回归方程。和是模型的参数,参数的学习过程就是根据训练集来确

定,学习任务就是用一条直线来拟合训练数据,也就是通过学习找到合适的参数值。

方和)越小,则R2越接近于1,预测越准确,模型的拟合效果越好。

1.多项式回归

如果训练集的散点图没有呈现出明显的线性关系,而是类

似于一条曲线的样子,就像图中这样。我们尝试用多项式

回归对它进行拟合。

我们先看一下二次曲线的方程y=ax^2+bx+c,如果将

x^2理解为一个特征,将x理解为另外一个特征,那么就

可以看成有两个特征的一个数据集,这个式子依旧是一个

线性回归的式子。这样就将多项式回归问题,转化为多变

对应的真实结果y(即真实房价),那么可以将模型用矩阵形式表达为:

1

二、多变量线性回归

2.损失函数

3.最小二乘法求解

对损失函数求偏导并令其等于0,得到的θ就是模型参数的值。

1

二、多变量线性回归

4.梯度下降法求解

梯度下降法的基本思想可以类比为一个下山的过程。一个

利用三种回归模型预测波士顿房价的问题描述

利用三种回归模型预测波士顿房价的问题描述

波士顿房价预测是基于波士顿地区的一些特征来预测房屋价格的问题。

我们收集了一些关于波士顿地区的数据,包括犯罪率、住宅平均房间数、低于贫困线的比例等等。

我们的目标是建立一个回归模型,根据这些特征来预测房屋的价格。

为了达到这个目标,我们可以选择三种回归模型进行预测。

第一种是线性回归模型,它假设房价与特征之间存在线性关系。

我们可以通过拟合一个线性方程来预测房价。

第二种是决策树回归模型,它通过构建一棵决策树来预测房价。

决策树模型可以捕捉到特征之间的非线性关系,并且可以处理离散和连续型特征。

第三种是支持向量回归模型,它通过找到一个最优的超平面来拟合数据。

支持向量回归模型可以处理高维特征,并且可以处理离群点的影响。

我们可以使用这些回归模型对波士顿房价进行预测,并通过评估模型的性能来选择最优的模型。

预测结果可以帮助房地产开发商、投资者和买家做出更明智的决策。

尽管我们要避免敏感内容的讨论,但在实际应用中,还会考虑到其他因素如地理位置、交通便利性等对房价的影响。

基于回归的房价预测模型研究

产业经济基于回归的房价预测模型研究王景行(唐山市第二中学,河北唐山063000)摘要:本文关注房价的影响因素,从79个影响特征中选择重要的特征,并且使用特征处理方案来得到更优特征,用以训练多个回归模型,包括Lasso回归模型,以及XGBoost回归模型,最终使用Stacking模型融合方案来预测房价。

在测试数据集中的表现模型融合优于单模型结果,所以最终使用模型融合方案来对房价做预测。

通过#匕次房价预测,旨在发现房屋价格的影响因素以及得到房屋预测模型用以将来迁移学习其他地域的房屋价格预测。

关键词:模型融合;线性回归;房价预测;建模分析中图分类号:F299.23文献识别码:A文章编号:2096—3157(2020)19—0120—03—、研究背景随着大数据时代的到来,具备大数据思想至关重要,人工智能技术在各行各业的应用已是随处可见。

在生产制造业,人工智能技术可以极大地提高生产效率,节省劳动成本,提升产品质量;在服务业,可以优化行业现有产品和服务,提升其质量和劳动生产率;金融、医疗等领域,也因人工智能技术的加入而愈发繁荣,人们的生活也因为其更加便利。

房屋作为每个公民的必需品,在生活中的地位非常重要,买房已成为人们谈论较多的话题,如何在合适的时间买房卖房也成为了人们关注焦点,因此在这样的背景下,产生了本次的房价预测相关问题。

目前在房价预测领域主要体现在两个问题上:一是选择合适的数学模型来预测房价走向,用以评估房价的变化;二是寻找引起房价变化的原因,国家可借此来帮助市场协调房价变化,公民可以根据时事来判断入手时机。

本文主要分析第一个问题,即选择合适的数学模型来帮助预测房价。

本文将从波士顿的房价数据为着手点,以该市的房屋的相关属性来作为特征,筛选重要信息,并且将一些信息做适当处理,最终用以预测该市的其他房屋价格。

二、研究方法1.线性回归算法简介(1)算法思想在统计学中,线性回归曲(Linear Regression)是利用称为线性回归方程的最小平方函数对一个或多个自变量和因变量之间关系进行建模的一种回归分析raM o这种函数是一个或多个称为回归系数的模型参数的线性组合。

基于回归的房价预测模型研究

基于回归的房价预测模型研究作者:王景行来源:《全国流通经济》2020年第19期摘要:本文关注房价的影响因素,从79个影响特征中选择重要的特征,并且使用特征处理方案来得到更优特征,用以训练多个回归模型,包括Lasso回归模型,以及XGBoost回归模型,最终使用Stacking模型融合方案来预测房价。

在测试数据集中的表现模型融合优于单模型结果,所以最终使用模型融合方案来对房价做预测。

通过此次房价预测,旨在发现房屋价格的影响因素以及得到房屋预测模型用以将来迁移学习其他地域的房屋价格预测。

关键词:模型融合;线性回归;房价预测;建模分析中图分类号:F299.23;文献识别码:A;文章编号:2096-3157(2020)19-0120-03一、研究背景随着大数据时代的到来,具备大数据思想至关重要,人工智能技术在各行各业的应用已是随处可见。

在生产制造业,人工智能技术可以极大地提高生产效率,节省劳动成本,提升产品质量;在服务业,可以优化行业现有产品和服务,提升其质量和劳动生产率;金融、医疗等领域,也因人工智能技术的加入而愈发繁荣,人们的生活也因为其更加便利。

房屋作为每个公民的必需品,在生活中的地位非常重要,买房已成为人们谈论较多的话题,如何在合适的时间买房卖房也成为了人们关注焦点,因此在这样的背景下,产生了本次的房价预测相关问题。

目前在房价预测领域主要体现在两个问题上:一是选择合适的数学模型来预测房价走向,用以评估房价的变化;二是寻找引起房价变化的原因,国家可借此来帮助市场协调房价变化,公民可以根据时事来判断入手时机。

本文主要分析第一个问题,即选择合适的数学模型来帮助预测房价。

本文将从波士顿的房价数据为着手点,以该市的房屋的相关属性来作为特征,筛选重要信息,并且将一些信息做适当处理,最终用以预测该市的其他房屋价格。

二、研究方法1.线性回归算法简介(1)算法思想在统计学中,线性回归[2](Linear Regression)是利用称为线性回归方程的最小平方函数对一个或多个自变量和因变量之间关系进行建模的一种回归分析[3][4]。

波士顿房价数据统计分析报告

波士顿房价数据统计分析报告作者:米纯来源:《经营管理者·中旬刊》2016年第07期摘要:该报告以波士顿房价数据样本为研究对象,目的是通过统计学方法分析各变量与波士顿郊区房价之间的关系,选出对房价影响较大的几个变量,并确定各变量之间的数学关系。

分析采用的软件是SPSS,分析方法为因子分析、相关分析、回归分析方法。

首先,鉴于样本变量较多,因此通过因子分析检验是否可以对变量进行降维处理。

然后,对数据进行相关性分析,先找出5个与房价相关性较强的变量,并针对变量建立多元回归模型,在对该模型评价之后,确认了其中三个变量的强相关关系;在剔除相关性较弱的两个变量之后,又建立了新的回归模型,经评价,该模型对变量的解释较贴切,检验效果显著。

通过以上分析,得出影响房价的主要因素为:房间数量、居民社会地位、教育程度,并构建了多元线性方程。

关键词:因子分析相关多元回归一、统计前估计及变量的选择处理1.预先估计。

初步判断14个变量,根据个人先验知识做出房价影响因素的估计:预计空气质量和距离就业中心的距离将在很大程度上影响房价,即,NOX和DIS两个变量将显示出与价变量MEDV之间的强相关关系。

2.变量选择。

波士顿房价数据样本共14个变量,包括13个定量变量和1个定性变量,共计506个数据。

定性变量为,是否临近河边——CHAS。

除此之外其余都为定量变量。

鉴于数据量较大,且为了统计方便,在接下来的分析中,将剔除该定性变量。

对剩下的13个变量进行统计分析。

二、因子分析该样本数据14个属性,共计506个数据。

数据样本较大,维数较高。

考虑到更加便捷地提高分析效率,要分析各因素对波士顿房价的影响,首先对变量进行降维处理,考虑14个变量中是否可由一两个综合变量来进行概括。

因此,首先对样本数据进行主成分和因子分析。

设置因子数量为3.1.主成分选取。

数据结果显示,前三个成分特征值累计占了总方差的72.341%,后面的特征值贡献低于10%,且越来越小。

《用Python玩转数据》项目—线性回归分析入门之波士顿房价预测(一)

《⽤Python玩转数据》项⽬—线性回归分析⼊门之波⼠顿房价预测(⼀)sklearn的波⼠顿房价数据是经典的回归数据集。

在MOOC的课程《⽤Python玩转数据》最终的实践课程中就⽤它来进⾏简单的数据分析,以及模型拟合。

⽂章将主要分为2部分:1、使⽤sklearn的linear_model进⾏多元线性回归拟合;同时使⽤⾮线性回归模型来拟合(暂时还没想好⽤哪个?xgboost,还是SVM?)。

2、使⽤tensorflow建⽴回归模型拟合。

⼀、使⽤sklearn linear_regression 模型拟合boston房价datasetsfrom sklearn import datasetsfrom sklearn import linear_modelfrom sklearn.cross_validation import train_test_splitfrom sklearn import metricsimport osimport matplotlib.pyplot as pltimport pandas as pdimport numpy as np'''----------load 数据集-----------'''dataset = datasets.load_boston()# x 训练特征:['CRIM', 'ZN', 'INDUS', 'CHAS', 'NOX', 'RM', 'AGE', 'DIS','RAD', 'TAX', 'PTRATIO', 'B', 'LSTAT']x = dataset.datatarget = dataset.target#把label变为(?, 1)维度,为了使⽤下⾯的数据集合分割y = np.reshape(target,(len(target), 1))#讲数据集1:3⽐例分割为测试集:训练集x_train, x_verify, y_train, y_verify = train_test_split(x, y, random_state=1)'''x_train的shape:(379, 13)y_train的shape:(379, 1)x_verify的shape:(127, 13)y_verify 的shape:(127, 1)''''''----------定义线性回归模型,进⾏训练、预测-----------'''lr = linear_model.LinearRegression()lr.fit(x_train,y_train)y_pred = lr.predict(x_verify)'''----------图形化预测结果-----------'''#只显⽰前50个预测结果,太多的话看起来不直观plt.xlim([0,50])plt.plot( range(len(y_verify)), y_verify, 'r', label='y_verify')plt.plot( range(len(y_pred)), y_pred, 'g--', label='y_predict' )plt.title('sklearn: Linear Regression')plt.legend()plt.savefig('lr/lr-13.png')plt.show()'''----------输出模型参数、评价模型-----------'''print(lr.coef_)print(lr.intercept_)print("MSE:",metrics.mean_squared_error(y_verify,y_pred))print("RMSE:",np.sqrt(metrics.mean_squared_error(y_verify,y_pred)))#输出模型对应R-Squareprint(lr.score(x_train,y_train))print(lr.score(x_verify,y_verify)) 结果如下:[[-1.13256952e-01 5.70869807e-02 3.87621062e-02 2.43279795e+00-2.12706290e+01 2.86930027e+00 7.02105327e-03 -1.47118312e+003.05187368e-01 -1.06649888e-02 -9.97404179e-01 6.39833822e-03-5.58425480e-01]]-----------权重参数W[45.23641585]----------偏置biasMSE: 21.88936943247483RMSE: 4.678607638226872----------MSE和RMSE都是表⽰衡量同之间的偏差0.7167286808673383----------训练集的R-Square0.7790257749137334-----------测试集的R-Square从图看,部分数据结果偏差不⼤,部分预测结果还有⼀定差距,从r-square来看拟合效果凑合。

波士顿房价预测

波⼠顿房价预测利⽤R语⾔对波⼠顿房价数据做描述性分析和多元线性回归来预测波⼠顿房价:A<-read.csv("E:/R语⾔练习/波⼠顿房价/housing.csv",head=T) #读取数据dim(A) #查看数据⼤⼩506 14Q=1;for(i in 1:ncol(A)){Q[i]<-class(A[,i])}Q;rm(Q); #查看每⼀列的数据类型,并且整理⼀下CRIM “numeric” ⼈均犯罪率ZN “numeric” 超过2W5平⽅英尺的住宅⽤地所占⽐例INDUS “numeric” 城市⾮零售业的商业⽤地⽐例CHAS “integer” Charles河是否流经NOX “numeric” ⼀氧化碳浓度RM “numeric” 每栋住宅的平均房间数AGE “numeric” 1940年以前建成的⾃住房⽐例DIS “numeric” 到波⼠顿五个中⼼区域的加权平均距离RAD “integer” 到达⾼速公路的便利指数TAX “numeric” 每1W美元的全值财产税率PIRATIO “numeric” 师⽣⽐B “numeric” BK是⿊⼈⽐例,越接近0.63越⼩,B=1000*(BK-0.63)^2 LSTAT “numeric” 低收⼊⼈⼝⽐例MEDV “numeric” ⾃住房屋房价的平均房价单位为(1W美元)Q=1;for(i in 1:ncol(A)){Q[i]<-sum(is.na(A[,i]));}Q; #查看每⼀列空值个数描述性分析:plot(CRIM,MEDV) #查看散点图和直⽅图每个犯罪率对应的房价⼤概都呈正态分布,期望随着犯罪率的升⾼⽽降低,因为犯罪率越⾼,越没⼈敢住,⾃然没⼈买,房价就下降了,听说底特律最便宜的只要1美元。

调查的地区⼤部分都在0附近,此处⽅差也⽐较⼤,波动较⼤,当CRIM>2时,⽅差⽐较稳定了。

波士顿房价数据统计分析报告

波士顿房价数据统计分析报告波士顿是美国马萨诸塞州的首府,也是全美国东北地区的重要城市之一。

作为一座国际化的城市,波士顿的房地产市场一直备受关注。

本报告将对波士顿房价数据进行统计分析,帮助读者了解该市的房价水平及其趋势。

1. 数据收集及处理为了进行准确的分析,我们收集了波士顿近五年的房价数据。

这些数据包括:房屋销售价格、房屋面积、地理位置、建筑年份等信息。

在数据收集后,我们进行了数据清洗和处理,剔除了异常值和缺失数据,以确保分析的准确性和可靠性。

2. 波士顿房价统计根据我们所收集到的数据,我们对波士顿的房价进行了统计。

通过计算房价的平均值、中位数、最大值和最小值,我们可以得到以下结论:波士顿的房价整体呈上升趋势,市场供需平衡,房价相对稳定。

同时,由于地区的不同,房价存在一定的差异性,一些地段的房价较高,而一些地段的房价较低。

3. 波士顿房价因素分析为了了解波士顿房价的主要影响因素,我们进行了进一步的分析。

通过对房价与房屋面积、地理位置、建筑年份等变量进行相关性分析,我们可以得到以下结论:3.1 房屋面积:房屋面积与房价呈正相关关系,即房屋面积越大,房价越高。

3.2 地理位置:地理位置也是影响房价的重要因素。

波士顿市中心的房价较高,而远离市中心的地区房价相对较低。

3.3 建筑年份:建筑年份对房价也有一定影响。

一般来说,较新的房屋价格相对较高,而老旧的房屋价格相对较低。

4. 波士顿房价趋势预测根据历史数据和市场发展情况,我们可以初步预测波士顿房价的趋势。

由于波士顿的经济繁荣和对房地产的需求,房价预计将继续保持上升趋势。

然而,由于市场的变化和政策的干预,房价上涨的速度可能会有所放缓。

5. 投资建议对于有意投资波士顿房地产的人士,我们给出以下建议:5.1 选择地理位置优越的房产,特别是市中心附近的房屋,因为这些房产的增值潜力更高。

5.2 留意新建项目,特别是位于新兴发展地区的房屋。

这些项目通常具有较高的升值潜力。

基于线性回归的房价分析预测

基于线性回归的房价分析预测摘要:主要运用线性回归分析方法,以波士顿房价及链家等提供的北京、石家庄房价数据为样本,通过纵向和横向分析研究,得出宏观政策、人口因素、环境因素等对房价的影响,并综合各种因素对近期房价作出基本预测。

关键词:线性回归;分析预测;房价随着中国经济的飞速发展和城市建设的不断推进,城市房价一路高涨,成为近几年民生关注的热点问题。

无论是寻找限购空隙的投资客,还是被溢出效应挤到一线城市周围地区的刚需人群,抑或是被市场购房热情助推的二三线城市房价,都与楼市息息相关。

如何透过纷繁复杂的楼市表象,探寻房价影响因素,预测房价趋势走向,无疑具有很强的社会实践意义。

本文将主要运用线性回归分析方法,对房价影响因素及其趋势走向加以分析预测。

1 时间维度上的房价指数纵向分析该部分主要探究在时间方向上的房价增速与政策影响的关系。

1.1 数据源分析以链家提供的北京市2011—2013年房价数据为例,关键的几个因素为:小区编码、签约时间、单价。

我们的处理方法是,首先,得到各个时间点上小区上次成交的平均单价,再对各个小区求得均值,认为是该时间点上整个北京的房价均值(表1)。

从曲线可以看到,这并不符合所谓的“稳步上涨”。

从常理上推断,房价的上涨受宏观形势(尤其是国家政策)的影响更为明显。

1.2 宏观政策和房价增速的关系参考以下链接https:// /view/1421ae5ca76e 58fafbb0031e.html,总结在2010-2013年时间段国家关于房地产领域调控的关键政策[3],列表如下:(表2)对比上文的房价指数图,可以看到,宏观政策对指数增速的影响是显著的。

1.3 分段加权线性回归我们简化地认为,房价的增长模式是简单的稳定增长,然而增长速率由政策的不同而不同。

同时,考虑到政策对市场影响的延后性,我们直接对房价指数的对数做分段线性回归。

观测房价走势图,可以看到,在2011年10月份,房价指数并不稳定。

基于pyspark的波士顿房价预测案例

基于pyspark的波⼠顿房价预测案例⽬录本实验包含线性回归模型、梯度上升回归、决策树、随机森林、梯度回归树五种模型的创建和⽐较以及加载!⼀、问题描述:本次实验休⼠顿房价数据集是⼀个回归问题,共有506个样本,13个输⼊变量和1个输出变量。

数据集中的每⼀⾏数据都是对休⼠顿周边或城镇房价的情况描述,下⾯对数据集变量说明下,⽅便理解数据集变量代表的意义。

数据集各特征介绍:· CRIM:城镇⼈均犯罪率。

· ZN:住宅⽤地超过 25000 sq.ft. 的⽐例。

· INDUS:城镇⾮零售商⽤⼟地的⽐例。

· CHAS:查理斯河空变量(如果边界是河流,则为1;否则为0)。

· NOX:⼀氧化氮浓度。

· RM:住宅平均房间数。

· AGE:1940 年之前建成的⾃⽤房屋⽐例。

· DIS:到波⼠顿五个中⼼区域的加权距离。

· RAD:辐射性公路的接近指数。

· TAX:每 10000 美元的全值财产税率。

· PTRATIO:城镇师⽣⽐例。

· B:1000(Bk-0.63)^ 2,其中 Bk 指代城镇中⿊⼈的⽐例。

· LSTAT:⼈⼝中地位低下者的⽐例。

· price:⾃住房的平均房价,以千美元计。

⼆、机器学习预测模型概述:1、线性回归分析中,如果只包括⼀个⾃变量和⼀个因变量,且⼆者的关系可⽤⼀条直线近似表⽰,这种回归分析称为⼀元线性回归分析。

如果包括两个或两个以上的⾃变量,且因变量和⾃变量之间是线性关系,则称为。

2、随机森林回归模型随机森林回归模型为⼀种集成学习算法。

通过在数据上构建多个模型,集成所有模型的建模结果。

⼤概流程如下:从样本集中使⽤Bootstrap采样选出n个样本。

从所有属性中随机选择k个属性,之后再使⽤信息增益、基尼指数⽅法不断找到最佳分割属性建⽴CART决策树(也可以是svm、LR 等),这⾥的k控制了随机性的引⼊程度。

4.线性回归api与波士顿房价预测案例

4.线性回归api与波⼠顿房价预测案例线性回归api再介绍sklearn.linear_model.LinearRegression(fit_intercept=True)通过正规⽅程优化fit_intercept:是否计算偏置LinearRegression.coef_:回归系数LinearRegression.intercept_:偏置sklearn.linear_model.SGDRegressor(loss="squared_loss", fit_intercept=True, learning_rate ='invscaling', eta0=0.01) SGDRegressor类实现了随机梯度下降学习,它⽀持不同的loss函数和正则化惩罚项来拟合线性回归模型。

loss:损失类型loss=”squared_loss”: 普通最⼩⼆乘法fit_intercept:是否计算偏置learning_rate : string, optional学习率填充'constant': eta = eta0'optimal': eta = 1.0 / (alpha * (t + t0)) [default]'invscaling': eta = eta0 / pow(t, power_t)power_t=0.25:存在⽗类当中对于⼀个常数值的学习率来说,可以使⽤learning_rate=’constant’ ,并使⽤eta0来指定学习率。

SGDRegressor.coef_:回归系数SGDRegressor.intercept_:偏置 波⼠顿房价预测 1:数据集介绍给定的这些特征,是专家们得出的影响房价的结果属性。

我们此阶段不需要⾃⼰去探究特征是否有⽤,只需要使⽤这些特征。

到后⾯量化很多特征需要我们⾃⼰去寻找1 分析回归当中的数据⼤⼩不⼀致,是否会导致结果影响较⼤。

基于梯度下降算法的房价回归分析与预测

2020年第5期10计算机应用信息技术与信息化基于梯度下降算法的房价回归分析与预测陈泽坤* 程晓荣CHEN Ze-kun CHENG Xiao-rong摘 要 近年来房价飞速上涨,如何预测房价的变化逐渐受到政府和个人的关注。

本文选取美国波士顿的房价数据作为数据样本集,研究了基于梯度下降算法的房价回归分析与预测模型,首先预处理数据集的数据,然后结合梯度下降算法进行数据集的回归分析,找到影响房价的主要因素并训练求得拟合函数,最后通过拟合函数建立了一个较为准确的房价预测模型,并使用测试集数据验证其预测能力。

关键词 机器学习;数据归一化;缺失值处理; 梯度下降; 回归分析doi:10.3969/j.issn.1672-9528.2020.05.001* 华北电力大学(保定)计算机系 河北保定 0710000 前言随着国民经济水平的提高,人们对于生活质量和生活环境的要求不断提高。

住房成为人们关注的重点,交通是否便利、是否为学区房、周围环境质量和气候情况等问题成为购房者考虑的主要因素,而房价则是综合这个影响因素的一个主要体现。

从2008年开始,一些一线城市房价迅速增长,政府相继推出限购政策,压低房价。

近年来,有着优质教育资源的学区房、临近高铁站的小区住宅以及拥有高科技的高档科技住宅越来越受到人们的喜爱,房价不断飙升,未见有停止之势。

梯度下降是机器学习中的常用算法,通过不断迭代计算函数的梯度,判断该点的某一方向和目标之间的距离,最终求得最小的损失函数和相关参数,为建立线性模型提供支持。

传统梯度下降算法逐渐衍生出随机和批量两种不同的梯度下降算法,成为机器学习和深度学习的重要算法。

回归分析是机器学习的常用算法,回归过程中找到自变量和目标变量之间的某种联系找到一个合适的假设函数来充分拟合数据集。

通过学习数据集,找到样本特征和标签之间的对应关系是线性回归算法的总体思路。

房价变化成为个人和政府乃至国家关注的重点,有许多影响因素如气候条件、犯罪率和交通便利程度等,所以房价的预测也就有了现实的意义。

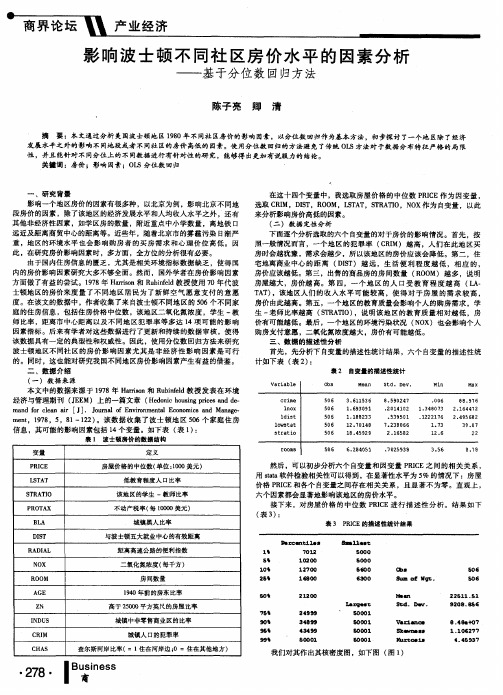

影响波士顿不同社区房价水平的因素分析——基于分位数回归方法

1. 7 3 1 2. 6

. 0 0 6 1, 34 80 7 3 . 1 2 221 7 6

8 8. 97 2. 1 64 47 : 2. 4 9 S6 8:

l ow st at st r ati o

5 06 5 O6

l 2. 7 01 48 1 8. 4 59 29

,. 2 3 80 66 2. 1 65 82

裹 2 自变量的描述性统计

VaC 1 a bl e Ob s Mea n St d, D e . Mi n M S:

( 一)数 据来源 本文中的数据来源于 1 9 7 8年 H a r i r s o n和 R u b i n f e l d教授发表 在环境 经济与管理期刊 ( J E E M)上的一篇文章 ( He d 0 n i c h o u s i n g p r i c e s a n d d e . m a n d f o r c l e a n a i r[ J ] .J o u n r a l o f E n v i r o n m e n t a l E c o n o m i c s a n d M a n a g e — m e n t ,1 9 7 8 , 5 , 8 1 —1 2 2 ) 。该数 据收集 了波士 顿地 区 5 0 6个 家庭住 房 信息 ,其可能的影响因素包括 1 4 个变量 。如下表 ( 表1 )

基于统计回归分析的房价预测模型研究

基于统计回归分析的房价预测模型研究随着房地产市场的快速发展,房价预测成为了一个重要的研究领域。

基于统计回归分析的房价预测模型可以帮助房地产开发商、投资者和政府部门做出合理的决策。

本文将聚焦于基于统计回归分析的房价预测模型研究,分为以下几个方面展开讨论。

首先,我们将探讨统计回归分析在房价预测中的应用。

统计回归分析是一种用来研究两个或多个变量之间关系的统计方法。

在房价预测中,我们可以选择一系列与房价相关的变量作为解释变量,例如房屋面积、地理位置、楼层高度等。

通过回归分析,我们可以建立一个数学模型来描述这些解释变量与房价之间的关系,并用模型来预测未来的房价。

其次,我们将介绍常用的统计回归分析方法。

在房价预测中,常见的回归分析方法包括线性回归、多项式回归和逻辑回归等。

线性回归是最常见的一种回归分析方法,它假设解释变量与房价之间存在线性关系。

多项式回归则可以处理非线性关系,通过引入高次项,将解释变量与房价之间的关系拟合成一个多项式函数。

逻辑回归适用于二分类问题,可以用来预测房屋是否会上涨或下跌。

接着,我们将探讨回归模型的建立和评估。

在建立回归模型时,我们需要选择适当的解释变量,并使用统计方法来估计模型的参数。

常见的估计方法包括最小二乘法、最大似然估计和广义矩估计等。

在评估回归模型时,我们可以使用拟合优度指标(如R方和调整的R方)来评估模型的拟合程度。

此外,还可以使用残差分析来检验模型的假设。

最后,我们将讨论基于统计回归分析的房价预测模型的应用案例和局限性。

基于统计回归分析的房价预测模型已经在实际应用中取得了一定的成果。

例如,一些城市的房地产开发商可以利用这些模型来预测未来的房价走势,从而做出合理的开发计划。

然而,统计回归分析也存在一些局限性。

例如,它要求解释变量与房价之间存在线性或非线性关系,但实际情况可能更加复杂。

此外,模型的可解释性也是一个挑战,我们需要解释模型的结果并将其应用于实践。

综上所述,基于统计回归分析的房价预测模型研究在房地产领域具有重要的应用价值。

回归模型与房价预测

回归模型与房价预测1. 导⼊boston房价数据集,⼀元线性回归模型,建⽴⼀个变量与房价之间的预测模型,并图形化显⽰。

代码:from sklearn import datasets# 波⼠顿房价数据集data = datasets.load_boston()import pandas as pd# 转为DataFramedataDF = pd.DataFrame(data.data,columns=data.feature_names)dataDF# 数据可视化操作和⼈为的⼀元线性拟合import matplotlib.pyplot as pltx = data.data[:,5]y = data.targetplt.figure(figsize=(10,7))plt.scatter(x,y,c='r',marker='p')plt.plot(x,7*x+10,'g')plt.show()截图:代码:# 建⽴⼀元线性回归模型from sklearn.linear_model import LinearRegressionfrom sklearn.model_selection import train_test_splitx_train,x_test,y_train,y_test = train_test_split(data.data[:,5],data.target,test_size=0.3,)lr = LinearRegression()lr.fit(x_train.reshape(-1,1), y_train)print("斜率:",lr.coef_," 截距:",lr.intercept_)# 再次绘图:plt.figure(figsize=(10,7))plt.scatter(x_train,y_train)plt.plot(x,8.6*x-32,'g')plt.show()截图:2. 多元线性回归模型,建⽴13个变量与房价之间的预测模型,并检测模型好坏,并图形化显⽰检查结果。

基于线性回归分析——boston房价预测

基于线性回归分析——boston房价预测本⽂采⽤正规⽅程、梯度下降、带有正则化的岭回归三种⽅法对BOSTON房价数据集进⾏分析预测,⽐较三种⽅法之间的差异from sklearn.datasets import load_bostonfrom sklearn.linear_model import LinearRegression, SGDRegressor, Ridge, LogisticRegressionfrom sklearn.model_selection import train_test_splitfrom sklearn.preprocessing import StandardScalerfrom sklearn.metrics import mean_squared_error, classification_reportfrom sklearn.externals import joblibimport pandas as pdimport numpy as npclass HousePredict():"""波⼠顿房⼦数据集价格预测"""def __init__(self):# 1.获取数据lb = load_boston()# 2.分割数据集到训练集和测试集x_train, x_test, y_train, y_test = train_test_split(lb.data, lb.target, test_size=0.25)# print(y_train, y_test)# 3.特征值和⽬标值是都必须进⾏标准化处理, 实例化两个标准化API# 3.1特征值标准化self.std_x = StandardScaler()self.x_train = self.std_x.fit_transform(x_train)self.x_test = self.std_x.transform(x_test)# 3.2⽬标值标准化self.std_y = StandardScaler()self.y_train = self.std_y.fit_transform(y_train.reshape(-1, 1)) # ⼆维self.y_test = self.std_y.transform(y_test.reshape(-1, 1))def mylinear(self):"""正规⽅程求解⽅式预测:return: None"""# 预测房价结果,直接载⼊之前保存的模型# model = joblib.load("./tmp/test.pkl")# y_predict = self.std_y.inverse_transform(model.predict(self.x_test))# print("保存的模型预测的结果:", y_predict)# estimator预测# 正规⽅程求解⽅式预测结果lr = LinearRegression()lr.fit(self.x_train, self.y_train)print("正规⽅程求解⽅式回归系数", lr.coef_)# 保存训练好的模型# joblib.dump(lr, "./tmp/test.pkl")# # 预测测试集的房⼦价格y_lr_predict = self.std_y.inverse_transform(lr.predict(self.x_test))## print("正规⽅程测试集⾥⾯每个房⼦的预测价格:", y_lr_predict)print("正规⽅程的均⽅误差:", mean_squared_error(self.std_y.inverse_transform(self.y_test), y_lr_predict)) return Nonedef mysdg(self):"""梯度下降去进⾏房价预测:return: None"""sgd = SGDRegressor()sgd.fit(self.x_train, self.y_train)print("梯度下降得出的回归系数", sgd.coef_)# 预测测试集的房⼦价格y_sgd_predict = self.std_y.inverse_transform(sgd.predict(self.x_test))# print("梯度下降测试集⾥⾯每个房⼦的预测价格:", y_sgd_predict)print("梯度下降的均⽅误差:", mean_squared_error(self.std_y.inverse_transform(self.y_test), y_sgd_predict)) return Nonedef myridge(self):"""带有正则化的岭回归去进⾏房价预测"""rd = Ridge(alpha=1.0)rd.fit(self.x_train, self.y_train)print("岭回归回归系数", rd.coef_)# 预测测试集的房⼦价格y_rd_predict = self.std_y.inverse_transform(rd.predict(self.x_test))# print("岭回归每个房⼦的预测价格:", y_rd_predict)print("岭回归均⽅误差:", mean_squared_error(self.std_y.inverse_transform(self.y_test), y_rd_predict))return Nonereturn Noneif __name__ == "__main__":A = HousePredict()A.mylinear()A.mysdg()A.myridge()正规⽅程求解⽅式回归系数 [[-0.10843933 0.13470414 0.00828142 0.08736748 -0.2274728 0.257911140.0185931 -0.33169482 0.27340519 -0.22995446 -0.20995577 0.08854303-0.40967023]]正规⽅程的均⽅误差: 20.334736834357248梯度下降得出的回归系数 [-0.08498404 0.07094101 -0.03414044 0.11407245 -0.09152116 0.3256401-0.0071226 -0.2071317 0.07391015 -0.06095605 -0.17955743 0.08442426-0.35757617]梯度下降的均⽅误差: 21.558873305580214岭回归回归系数 [[-0.10727714 0.13281388 0.00561734 0.0878943 -0.22348981 0.259296690.0174662 -0.32810805 0.26380776 -0.22163145 -0.20871114 0.08831287-0.4076144 ]]岭回归均⽅误差: 20.37300555358197过拟合:⼀个假设在训练数据上能够获得⽐其他假设更好的拟合,但是在训练数据外的数据集上却不能很好地拟合数据,此时认为这个假设出现了过拟合的现象。

机器学习之路:python回归树DecisionTreeRegressor预测波士顿房价

机器学习之路:python回归树DecisionTreeRegressor预测波⼠顿房价python3 学习api的使⽤代码:1from sklearn.datasets import load_boston2from sklearn.cross_validation import train_test_split3from sklearn.preprocessing import StandardScaler4from sklearn.tree import DecisionTreeRegressor5from sklearn.metrics import r2_score, mean_squared_error, mean_absolute_error6import numpy as np78'''9回归树:10严格上说回归树不能算是回归11叶⼦节点是⼀团训练数据的均值不是连续具体的预测值1213解决特征⾮线性的问题14不要求特征标准化和统⼀量化1516容易过于复杂丧失泛化能⼒17稳定性较差,细微改变会导致树结构发⽣重⼤变化1819'''2021# 1 准备数据22# 读取波⼠顿地区房价信息23 boston = load_boston()24# 查看数据描述25# print(boston.DESCR) # 共506条波⼠顿地区房价信息,每条13项数值特征描述和⽬标房价26# 查看数据的差异情况27# print("最⼤房价:", np.max(boston.target)) # 5028# print("最⼩房价:",np.min(boston.target)) # 529# print("平均房价:", np.mean(boston.target)) # 22.5328063241106773031 x = boston.data32 y = boston.target3334# 2 分割训练数据和测试数据35# 随机采样25%作为测试 75%作为训练36 x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.25, random_state=33)373839# 3 训练数据和测试数据进⾏标准化处理40 ss_x = StandardScaler()41 x_train = ss_x.fit_transform(x_train)42 x_test = ss_x.transform(x_test)4344 ss_y = StandardScaler()45 y_train = ss_y.fit_transform(y_train.reshape(-1, 1))46 y_test = ss_y.transform(y_test.reshape(-1, 1))4748# 4 使⽤回归树进⾏训练和预测49# 初始化k近邻回归模型使⽤平均回归进⾏预测50 dtr = DecisionTreeRegressor()51# 训练52 dtr.fit(x_train, y_train)53# 预测保存预测结果54 dtr_y_predict = dtr.predict(x_test)5556# 5 模型评估57print("回归树的默认评估值为:", dtr.score(x_test, y_test))58print("平回归树的R_squared值为:", r2_score(y_test, dtr_y_predict))59print("回归树的均⽅误差为:", mean_squared_error(ss_y.inverse_transform(y_test),60 ss_y.inverse_transform(dtr_y_predict)))61print("回归树的平均绝对误差为:", mean_absolute_error(ss_y.inverse_transform(y_test), 62 ss_y.inverse_transform(dtr_y_predict)))6364'''65回归树的默认评估值为: 0.706650591253343866平回归树的R_squared值为: 0.706650591253343867回归树的均⽅误差为: 22.74669291338583668回归树的平均绝对误差为: 3.0874015748031569'''。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

DOI: 10.12677/sa.2020.93036

336

统计学与应用

赵冉

本例是属于回归模型的案例,在数据集中包含 506 组数据。通过对波士顿房地产数据进行初步的观 察并分析找出影响房价中位数的因素,希望建立一个能够预测房屋价值的多元线性回归模型。

2.1.2. 多元线性回归模型的一般形式 设随机变量 y 与一般变量 x1, x2 ,, xp 的线性回归模型为 y = β0 + β1x1 + β2 x2 + + β p xp + ε

yˆ *=

βˆ1* x1*

+

βˆ2* x2*

+ +

βˆ

* p

x*p

式中,

βˆ1*

,

βˆ2*

,,

βˆ

* p

是

y

对自变量

x1 ,

x2

,,

xp

的标准化回归系数。

2.2.2. 回归参数的普通最小二乘估计

( ) ( ) ∑ Q

即寻找参数 β0 , β1,, β p=

β0

,nβ1

,, yi −

βp β0

的估计值 βˆ1 − β1xi1 − −

, βˆ2 ,, β p xip 2

βˆp ,使离差平方和 达到极小。

当 ( X ′X )−1 存在i=时1 ,即得回归参数的最小二乘估计为:

βˆ = ( X ′X )−1 X ′y

2.2.3. 回归方程、回归系数的检验 1) F 检验 对多元线性回归方程的显著性检验就是要看自变量 x1, x2 ,, xp 从整体上对随机变量 y 是否有明显的影响。 原假设 H0 : β=1 β=2 = β=p 0

Statistics and Application 统计学与应用, 2020, 9(3), 335-344 Published Online June 2020 in Hans. /journal/sa https:///10.12677/sa.2020.93036

一种收缩估计方法,其基本思想是在回归系数的绝对值之和小于一个常数的约束条件下,使残差平方和 最小化,从而能够产生某些严格等于 0 的回归系数,进一步得到可以解释的模型。R 语言中有多个包可 以实现 Lasso 回归,这里使用 lars 包实现。

Open Access

1. 引言

波士顿房价数据集是统计的 20 世纪 70 年代中期波士顿郊区房价的中位数,统计了当时教区部分的 犯罪率、房产税等共计 13 个指标,统计出房价,试图能找到指标与房价的关系并进行预测。

2. 材料与方法

2.1. 变量名称与建模目的

2.1.1. 变量名称简介 分析波士顿房价数据集(Boston House Price Dataset)可知影响响应变量 MEDV 的因素可能有 13 个,

Abstract

According to the variables in the Boston housing price data set, a linear regression model was established for the Boston housing price by using R software. The significance test of the regression equation and regression coefficient was carried out. The model was established after the Box-Cox transformation was used for the case that the basic assumptions were violated. Lasso regression was used to simplify the equation appropriately, but the regression coefficient of the model established by lasso regression was small, because the variables in this data were not multicollinearity, which was consistent with the judgment results of R software. Finally, the response variable in the data and the independent variable whose absolute value of its correlation coefficient is greater than 0.5 establish a linear regression equation and predict the housing price. Because the distribution range of housing price in Boston will change with the change of influencing factors, and the median has certain robustness, we establish a regression model for the median of housing price, namely quantile regression model.

Analysis of the Correlation between Housing Price Data in Boston Based on the Regression Method

Ran Zhao

Qufu Normal University, Qufu Shandong

Received: May 8th, 2020; accepted: May 23rd, 2020; published: Jun. 1st, 2020

摘要

根据波士顿房价数据集中的变量使用R软件对波士顿房价建立线性回归模型,对回归方程和回归系数进

文章引用: 赵冉. 基于回归方法分析波士顿房价数据间的相关关系[J]. 统计学与应用, 2020, 9(3): 335-344. DOI: 10.12677/sa.2020.93036

赵冉

行显著性检验,针对违背基本假设的情况使用Box-Cox变换后再建立模型。为适当精简方程使用Lasso回 归,但其建立的模型回归系数很小,原因是此数据中的变量并没有多重共线性,与使用R软件判断结果 一致。最后,数据中的响应变量与其相关系数的绝对值大于0.5的自变量建立线性回归方程,并对房价进 行预测。由于波士顿房价的分布范围会随着影响因素的变化而发生变化,且中位数具有一定的稳健性, 因而我们对房价的中位数建立回归模型,即分位数回归模型。

DOI: 10.12677/sa.2020.93036

337

统计学与应用

赵冉

构造 F 检验统计量如下:

F

=

SSR

SSE (n −

p p

− 1)

当原假设成立时,F 服从自由度为 ( p, n − p −1) 的 F 分布。 当 F > Fα ( p, n − p −1) 时,拒绝原假设 H0 ,否则认为在显著性水平 α 下,y 与 x1, x2 ,, xp 有显著的线

时,存在严重的多重共线性。 2) 解决方法 剔除不重要的解释变量,在此例中我们将看到不显著的回归系数,当回归系数不显著时,剔除变量。 由于样本量足够大,因而增大样本量已经无法解决问题。 岭回归,详见参考文献[4]。 主成分回归与偏最小二乘估计。

2.2.6. Lasso 回归 Lasso 回归又称为套索回归,并提供了从零开始到最小二乘拟合的系数和拟合的整个序列。Lasso 是

式中, β0 , β1,, β p 是 p +1 个未知参数, β0 称为回归常数, β1,, β p 称为回归系数。y 称为解释变量(因 变量), x1, x2 ,, xp 是 p 个可以精确测量并控制的一般变量,称为解释变量(自变量)。

ε 是随机误差,并且假定

E (ε ) = 0

var

(ε

)

=

关键词

线性回归模型,Box-Cox变换,Lasso回归,预测

Copyright © 2020 by author(s) and Hans Publishers Inc. This work is licensed under the Creative Commons Attribution International License (CC BY 4.0). /licenses/by/4.0/

性关系,即回归方程是显著的。

2) t 检验 检验 x j 是否显著等价于检验

H0 j= : β j 0= , j 1, 2,, p

如果接受原假设,则 x j 不显著;如果拒绝原假设,则 x j 是显著的。

据此可以构造 t 统计量

tj =

βˆ c jj σˆ

式中

∑ σˆ =

n

−

1 p

−

1

i

n =1

ei2

诊断方法:图示检验法 自相关系数法 DW 检验 解决方法:迭代法 差分法 BOX-COX 变换

2.2.5. 多重共线性

1) 共线性诊断

① 方差扩大因子法

c jj

=

1

1

−

R

2 j

作为方差扩大因子的定义,证明见参考文献[2],当 VIFj

≥ 10 时,说明自变量

xj

与其余自

变量之间有严重的多重共线性。(注意:有些教材认为 vif > 4 即存在多重共线性。详见参考文献[3]。)

Keywords

Linear Regression Model, Box-Cox Transformation, Lasso Regression, Prediction