新的人脸识别特征集_A New Feature Set for Face Detection

face_recognition人脸识别模块

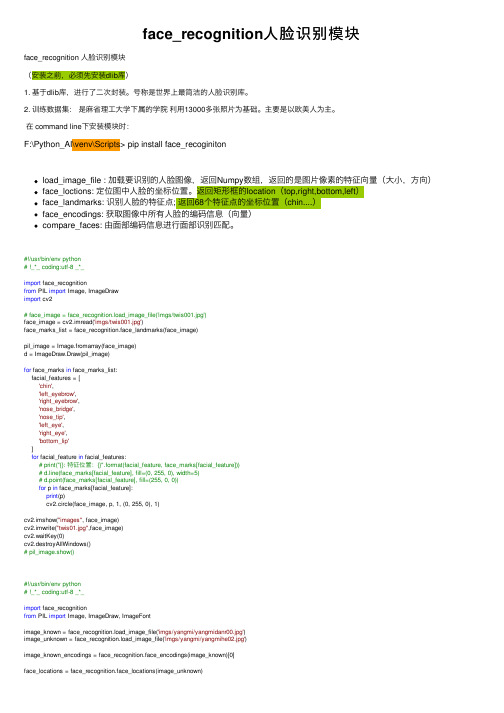

face_recognition⼈脸识别模块face_recognition ⼈脸识别模块(安装之前,必须先安装dlib库)1. 基于dlib库,进⾏了⼆次封装。

号称是世界上最简洁的⼈脸识别库。

2. 训练数据集:是⿇省理⼯⼤学下属的学院利⽤13000多张照⽚为基础。

主要是以欧美⼈为主。

在 command line下安装模块时:F:\Python_AI\venv\Scripts> pip install face_recoginitonload_image_file : 加载要识别的⼈脸图像,返回Numpy数组,返回的是图⽚像素的特征向量(⼤⼩,⽅向)face_loctions: 定位图中⼈脸的坐标位置。

返回矩形框的location(top,right,bottom,left)face_landmarks: 识别⼈脸的特征点; 返回68个特征点的坐标位置(chin....)face_encodings: 获取图像中所有⼈脸的编码信息(向量)compare_faces: 由⾯部编码信息进⾏⾯部识别匹配。

#!/usr/bin/env python# !_*_ coding:utf-8 _*_import face_recognitionfrom PIL import Image, ImageDrawimport cv2# face_image = face_recognition.load_image_file('imgs/twis001.jpg')face_image = cv2.imread('imgs/twis001.jpg')face_marks_list = face_recognition.face_landmarks(face_image)pil_image = Image.fromarray(face_image)d = ImageDraw.Draw(pil_image)for face_marks in face_marks_list:facial_features = ['chin','left_eyebrow','right_eyebrow','nose_bridge','nose_tip','left_eye','right_eye','bottom_lip']for facial_feature in facial_features:# print("{}: 特征位置:{}".format(facial_feature, face_marks[facial_feature]))# d.line(face_marks[facial_feature], fill=(0, 255, 0), width=5)# d.point(face_marks[facial_feature], fill=(255, 0, 0))for p in face_marks[facial_feature]:print(p)cv2.circle(face_image, p, 1, (0, 255, 0), 1)cv2.imshow("images", face_image)cv2.imwrite("twis01.jpg",face_image)cv2.waitKey(0)cv2.destroyAllWindows()# pil_image.show()#!/usr/bin/env python# !_*_ coding:utf-8 _*_import face_recognitionfrom PIL import Image, ImageDraw, ImageFontimage_known = face_recognition.load_image_file('imgs/yangmi/yangmidanr00.jpg')image_unknown = face_recognition.load_image_file('imgs/yangmi/yangmihe02.jpg')image_known_encodings = face_recognition.face_encodings(image_known)[0]face_locations = face_recognition.face_locations(image_unknown)results = []for i in range(len(face_locations)):top, right, bottom, left = face_locations[i]face_image = image_unknown[top:bottom, left:right]face_encoding = face_recognition.face_encodings(face_image)if face_encoding:result = {}matches = face_pare_faces(face_encoding, image_known_encodings, tolerance=0.5) if True in matches:print('在未知图⽚中找到了已知⾯孔')result['face_encoding'] = face_encodingresult['is_view'] = Trueresult['location'] = face_locations[i]result['face_id'] = i + 1results.append(result)if result['is_view']:print("已知⾯孔匹配照⽚上的第{}张脸!".format(result['face_id']))pil_image = Image.fromarray(image_unknown)draw = ImageDraw.Draw(pil_image)view_face_locations = [i['location'] for i in results if i['is_view']]for location in view_face_locations:top, right, bottom, left = locationdraw.rectangle([(left, top), (right, bottom)], outline=(0, 255, 0), width=2)font = ImageFont.truetype("consola.ttf", 20, encoding='unic')draw.text((left, top - 20), "yangmi", (255, 0, 0), font=font)pil_image.show()# 可以试着⽤cv2来画框,和写字 puttext#!/usr/bin/env python# !_*_ coding:utf-8 _*_import face_recognitionimport cv2img_known = face_recognition.load_image_file("imgs/joedan/cows.jpeg")img_unkown = face_recognition.load_image_file("imgs/joedan/joedan01.jpg")face_encodings_known = face_recognition.face_encodings(img_known)face_encodings_unknow = face_recognition.face_encodings(img_unkown)[0]matches = face_pare_faces(face_encodings_known, face_encodings_unknow, tolerance=0.5) print(matches)locations = face_recognition.face_locations(img_known)print(locations)if True in matches:index = matches.index(True)match = locations[index]print(match)top, right, bottom, left = matchcv2.rectangle(img_known, (left, top), (right, bottom), (0, 0, 255), 2)cv2.imshow("images", img_known)cv2.waitKey(0)cv2.destroyAllWindows()。

人工智能基础(习题卷62)

人工智能基础(习题卷62)第1部分:单项选择题,共50题,每题只有一个正确答案,多选或少选均不得分。

1.[单选题]以下说话正确的是()A)一个机器学习模型如果有较高准确率,总是说明这个分类器是好的B)如果增加模型复杂度,那么模型的测试错误率不一定会降低C)如果增加模型复杂度,那么模型的训练错误率总是会降低答案:C解析:一个机器学习模型如果有较高准确率,不能说明这个分类器是好的。

对于不平 衡的数据集进行预测时,正确率不能反映模型的性能。

模型越复杂,在训练集上越容易表现 好,在测试集上越容易表现不好。

2.[单选题]关于卷积层的说法,错误的是()A)卷积核的尺寸是由人为指定的B)卷积核的参数值是人为指定的C)卷积层可以作为神经网络的隐藏层D)特征图是为卷积层的最终输出答案:B解析:3.[单选题]有两个样本点,第一个点为正样本,它的特征向量是(0, -1);第二个点为负样本,它的特征向量是(2, 3),从这两个样本点组成的训练集构建一个线性SVM 分类器的分类面方程是()。

A)2x+_y=4B)x+2y=5C)x+2y=3D)2x-y=0答案:C解析:对于两个点来说,最大间隔就是垂直平分线,因此求出垂直平分线即可。

斜率是 两点连线的斜率的负倒数。

即-1/ (-1-3)/(0-2)=-1/2,可得戶-(l/2)x + C.过中点(0+2) /2, (-1+3)/2)= (1, 1),可得 c=3/2,故方程为 x+2戶3。

4.[单选题]在具体求解中,能够利用与该问题有关的信息来简化搜索过程,称此类信息为( )A)启发信息B)简化信息C)搜索信息D)求解信息答案:A解析:5.[单选题]下列哪个不是RPA实施回报率的评估因素?()A)成本节省B)生产力提升C)质量改进D)劳动力需求有规律答案:DA)人机交互系统B)机器人-环境交互系统C)驱动系统D)控制系统答案:A解析:7.[单选题]下面不属于人工智能研究基本内容的是()A)机器感知B)机器思维C)机器学习D)自动化答案:D解析:8.[单选题]大数据正快速发展为对数量巨大、来源分散、格式多样的数据进行采集、存储和关联分析,从中发现新知识、创造新价值、提升新能力的()A)新一代技术平台B)新一代信息技术和服务业态C)新一代服务业态D)新一代信息技术答案:B解析:9.[单选题]梯度下降算法中,损失函数曲面上轨迹最混乱的算法是以下哪种算法?A)SGDB)BGDC)MGDD)MBGD答案:A解析:10.[单选题]当不知道数据所带标签时,可以使用哪种技术促使带同类标签的数据与带其他标签的数据相分离?()A)分类B)聚类C)关联分析D)隐马尔可夫链答案:B解析:11.[单选题]线性判别分析常被视为一种经典的()技术。

人脸识别核心算法及MATLAB代码

人脸识别核心算法在检测到人脸并定位面部关键特征点之后,主要的人脸区域就可以被裁剪出来,经过预处理之后,馈入后端的识别算法。

识别算法要完成人脸特征的提取,并与库存的已知人脸进行比对,完成最终的分类。

我们在这方面的主要工作包括:∙基于LGBP的人脸识别方法问题:统计学习目前已经成为人脸识别领域的主流方法,但实践表明,基于统计学习的方法往往会存在“推广能力弱”的问题,尤其在待识别图像“属性”未知的情况下,更难以确定采用什么样的训练图像来训练人脸模型。

鉴于此,在对统计学习方法进行研究的同时,我们还考虑了非统计模式识别的一类方法。

思路:对于给定的人脸图像,LGBP方法首先将其与多个不同尺度和方向的Gabor滤波器卷积(卷积结果称为Gabor特征图谱)获得多分辨率的变换图像。

然后将每个Gabor特征图谱划分成若干互不相交的局部空间区域,对每个区域提取局部邻域像素的亮度变化模式,并在每个局部空间区域内提取这些变化模式的空间区域直方图,所有Gabor特征图谱的、所有区域的直方图串接为一高维特征直方图来编码人脸图像。

并通过直方图之间的相似度匹配技术(如直方图交运算)来实现最终的人脸识别。

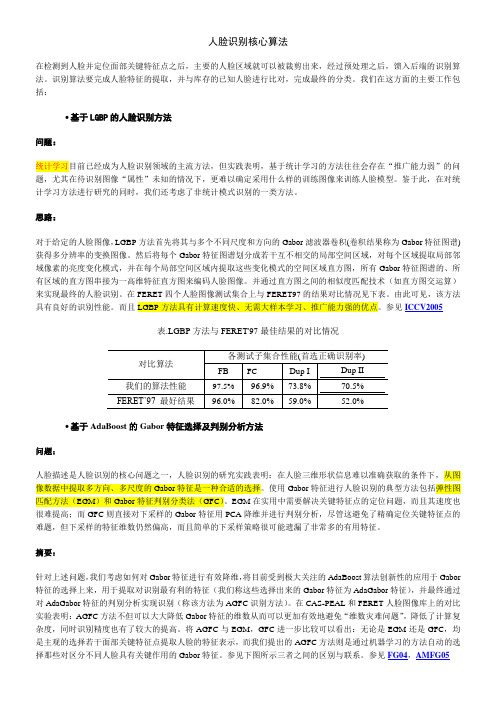

在FERET四个人脸图像测试集合上与FERET97的结果对比情况见下表。

由此可见,该方法具有良好的识别性能。

而且LGBP方法具有计算速度快、无需大样本学习、推广能力强的优点。

参见ICCV2005表.LGBP方法与FERET'97最佳结果的对比情况∙基于AdaBoost的Gabor特征选择及判别分析方法问题:人脸描述是人脸识别的核心问题之一,人脸识别的研究实践表明:在人脸三维形状信息难以准确获取的条件下,从图像数据中提取多方向、多尺度的Gabor特征是一种合适的选择。

使用Gabor特征进行人脸识别的典型方法包括弹性图匹配方法(EGM)和Gabor特征判别分类法(GFC)。

EGM在实用中需要解决关键特征点的定位问题,而且其速度也很难提高;而GFC则直接对下采样的Gabor特征用PCA降维并进行判别分析,尽管这避免了精确定位关键特征点的难题,但下采样的特征维数仍然偏高,而且简单的下采样策略很可能遗漏了非常多的有用特征。

人脸识别介绍_IntroFaceDetectRecognition

Knowledge-based Methods: Summary

Pros:

Easy to come up with simple rules Based on the coded rules, facial features in an input image are extracted first, and face candidates are identified Work well for face localization in uncluttered background

Template-Based Methods: Summary

Pros:

Simple

Cons:

Templates needs to be initialized near the face images Difficult to enumerate templates for different poses (similar to knowledgebased methods)

Knowledge-Based Methods

Top Top-down approach: Represent a face using a set of human-coded rules Example:

The center part of face has uniform intensity values The difference between the average intensity values of the center part and the upper part is significant A face often appears with two eyes that are symmetric to each other, a nose and a mouth

人脸识别涉及到的知识

English Version:The Knowledge Behind Face Recognition TechnologyFace recognition is an advanced technology that has revolutionized the way we interact with digital systems. It involves a myriad of complex concepts and technologies, ranging from computer vision and artificial intelligence to biometric analysis. In this article, we will delve into the knowledge and principles behind face recognition.At its core, face recognition relies heavily on computer vision, a field that deals with the analysis and understanding of digital images and videos. Computer vision algorithms are trained to detect and identify patterns, such as edges, shapes, and textures, within these digital representations. In the context of face recognition, these algorithms are specifically designed to recognize and extract features from human faces.One of the most critical components of face recognition is feature extraction. This process involves identifying distinctive characteristics of a face, such as the shape of the eyes, nose, or mouth, and encoding them into a numerical representation. These features are then used to create a unique identifier for each individual, known as a faceprint.Faceprints are then compared against a database of pre-existing faceprints to identify a match. This comparison process is facilitated by algorithms that calculate the similarity between two faceprints based on various metrics. If a match is found, the system can then identify the individual associated with that faceprint.Artificial intelligence (AI) plays a crucial role in face recognition by enabling the system to learn and improve over time. Machine learning algorithms, such as deep neural networks, are trained on large datasets of faces to recognize patterns and make accurate identifications. As more data becomes available, these algorithms become more accurate and reliable.Biometric analysis is another important aspect of face recognition. Biometrics refers to the measurement and analysis of physical characteristics for identification purposes. In face recognition, biometric analysis involves measuring and comparing facial features to verify the identity of an individual.In conclusion, face recognition technology draws upon a vast array of knowledge and technologies, including computer vision, artificial intelligence, and biometric analysis. The complexity and sophistication of these components make face recognition a powerful and accurate tool for identification and verificationin various applications.Chinese Version:人脸识别背后的知识人脸识别技术已经彻底改变了我们与数字系统的交互方式,是一项革命性的技术。

人脸关键点检测 经典算法

人脸关键点检测经典算法人脸关键点检测经典算法是计算机视觉领域的一个重要研究方向,它旨在识别和定位人脸图像中的关键点,如眼睛、鼻子、嘴巴等。

本文将介绍人脸关键点检测的基本原理以及三种经典算法:传统机器学习方法、深度学习方法和级联回归方法。

通过分析比较这些算法的优劣势,我们能够更好地理解人脸关键点检测技术的发展和应用。

一、人脸关键点检测基本原理人脸关键点检测的基本原理是将人脸图像中的关键点位置信息映射到特定的坐标系中。

这样一来,我们就可以通过机器学习或深度学习算法来训练模型,使其能够自动识别和定位这些关键点。

具体来说,人脸关键点检测的基本步骤包括以下几个方面:1. 数据准备:从人脸图像或视频中收集一系列标注好的训练样本,其中包含了关键点的位置信息。

2. 特征提取:将人脸图像转换成计算机可以理解的特征向量。

常用的特征包括灰度直方图、梯度直方图和局部二值模式等。

3. 模型训练:使用机器学习或深度学习算法对提取的特征进行训练,以建立关键点检测模型。

4. 模型测试和优化:使用测试集评估模型的性能,并根据需要对模型进行调整和优化。

二、传统机器学习方法传统机器学习方法在人脸关键点检测中有着较长的历史。

常用的传统机器学习方法包括支持向量机(SVM)、随机森林(RandomForest)和神经网络等。

在传统机器学习方法中,特征提取是一个关键问题。

基于传统机器学习方法的人脸关键点检测通常使用手工设计的特征表示,如HOG(Histogram of Oriented Gradients)、SIFT(Scale-Invariant Feature Transform)和SURF(Speeded Up Robust Features)等。

其中,HOG是一种常用的特征表示方法,它通过计算图像中不同方向上梯度的直方图来描述图像的纹理和边缘信息。

SIFT和SURF 则是基于图像局部特征的表示方法,它们可以在尺度、旋转和光照变化下保持特征的稳定性。

人脸识别(英文)Face-Recognition

Application

Face Recognition Access Control System

Face Recognition access control system is called FaceGate, Whenever one wishes to access a building, FaceGate verifies the person’s entry code or card, then compares his face with its stored “key.” It registers him as being authorized and allows him to enter the building. Access is denied to anyone whose face does not match.

Fundamentals

step 3 ) recognization process

After step2, the extracted feature of the input face is matched against those faces in the database; just like this pictuer, it outputs the result when a match is found.

n A computer application for automatically identifying or verifying a person from a digital image or a video frame from a video source.

Processing Flow

Application

简要说明人脸识别技术的流程

简要说明人脸识别技术的流程英文回答:Facial recognition technology is a process that involves the identification and verification of individuals based on their facial features. The process can be divided into several steps.1. Face Detection: The first step in facial recognition is to detect and locate faces in an image or video. This involves using algorithms to identify facial features such as eyes, nose, and mouth.2. Face Alignment: Once the faces are detected, the next step is to align them in a standardized way. This is done to ensure that the facial features are in a consistent position for accurate analysis.3. Feature Extraction: In this step, unique features of the face are extracted to create a facial template. Thesefeatures can include the distance between the eyes, the shape of the nose, and the curvature of the lips. These templates are then used for comparison and identification purposes.4. Face Matching: The extracted facial templates are compared with those stored in a database. This is done by calculating the similarity between the features of the input face and the stored templates. If a match is found, the person is identified.5. Decision Making: Once a match is found, a decision is made based on the requirements of the application. This can include granting access to a secure area, unlocking a device, or triggering an alert if the person is a suspect.It is important to note that facial recognition technology is not 100% accurate and can be influenced by factors such as lighting conditions, facial expressions, and occlusions. However, advancements in deep learning and artificial intelligence have significantly improved the accuracy and reliability of facial recognition systems.中文回答:人脸识别技术是一种基于人脸特征进行个体识别和验证的过程。

外刊阅读精选第三辑答案

基础篇P1 Leonardo, 500 years after his deathVocabularyI.1.展出的最后一站2.揭幕一个回顾展3.非常重视作画4.突出这位艺术家的兴趣II.1. rarely displayed masterwork2. a curated version of3. present reproductions of Leonardo’s inventions4. house nearly a third of Leonardo’s surviving artwork5. bring life to his paintingsReading comprehension1-4 DDBCTranslation1. Lu Xun Museum houses the articles he used and some of his manuscripts.2. Colette will be hosting a house-warming party at 6.00 pm on Saturday.3. The Olympic Games gave the country an opportunity to showcase its economic achievements.4. The couple has three children, each of whom is studying in a world-renowned university.P3 The facts about FacebookVocabularyI.1. 我们(公司)运转的准则2. 改变你的偏好3. 对系统的不信任4. 有悖于我们的商业利益5. 任由有害或造成不和的内容(传播)6. 侦查欺诈或假冒账号II.1. a service that is affordable to everyone2. transparency tools3. assume we do things that we don’t do4. systems are still evolving and improvingReading comprehension1-4 DDDBTranslationI.1. 因此,根据人们喜欢的页面、点击的内容和其他信号,我们创建了类别,例如,喜欢园艺页面和居住在西班牙的人,然后向广告商收费,向该类别显示广告。

Face recognition 人脸识别系统

摘要摘要随着社会的发展,各个方面对快速有效的自动身份验证的要求日益迫切。

由于生物特征是人的内在属性,具有很强的自身稳定性和个体差异性,因此是身份验证的理想依据。

这其中,利用人脸特征又是最自然直接的手段,相比其他生物特征,它具有直接、友好、方便的特点,易于为用户接受。

人脸识别是一个涉及面广且又很有挑战性的研究课题,近年来关于人脸识别的研究取得了较大的进展。

关键词:人脸识别,AT89C51单片机,液晶显示器AbstractAs the development of the society, there are increasing demands in automatic identity check. Since some biological characteristics are intrinsic and stable to people and are strongly different from one to the others, they can be used as features for identity check. Among all the characteristics of human, the characteristics of face are the most direct tools which are friendly and convenient and can easily be accepted by the customers.Face recognition is an extensive and challenging research problem. Recently, significant progresses have been made in the technology of the face recognition.Key word:AT89C51 MCU,human face recognition,LCD目录摘要 (Ⅰ)Abstract (Ⅱ)第1章绪论 (3)1.1人脸识别系统的背景和意义 (3)1.2国内外人脸识别系统的研究现状 (4)1.2.1国外的发展概况 (4)1.2.2 国内的发展概况 (5)1.3 本论文的内容 (5)1.4 本文的任务 (5)第2章人脸图片识别总体方案设计 (6)2.1系统硬件结构 (6)第3章系统硬件部分的设计与实现 (7)3. 1硬件设计基本流程 (7)2.2单片机的发展概况及其选择 (8)3.2 AT89C51单片机的介绍 (8)3.2.1 AT89C51单片机的特点 (14)3.2.2 AT89C51单片机的硬件结构 (15)3.3 图片的导入 (15)3.3.1 MAX232资料简介 (16)3.4显示器的选择 (18)3.5.1 12864液晶介绍 (18)3.6 EPROM和RAM的综合扩展 (32)3.6.1 62256 RAM芯片介绍 (33)3.6.2 27256 EPROM芯片介绍 (34)3.6.3 74LS373 锁存器原理 (36)第4章系统可靠性的设计 (40)4.1 硬件可靠性的设计 (40)4.2 本系统中的抗干扰的预防措施 (40)致谢 (42)参考文献 (43)第1章绪论1.1人脸识别系统的背景和意义鉴别人的身份是一个非常困难的问题,传统的身份鉴别方法把这个问题转化为鉴别一些标识个人身份的事物,这包括两个方面:①身份标识物品,比如钥匙、证件、ATM卡等;②身份标识知识,比如用户名和密码。

人脸识别基本名词

人脸识别基本名词在人脸识别领域,有一些基本的名词和概念,下面是其中一些常用的:1.人脸检测(Face Detection):人脸检测是指通过算法和技术来自动检测图像或视频中的人脸区域。

它是人脸识别的第一步,用于确定图像中是否存在人脸。

2.人脸对齐(Face Alignment):人脸对齐是将检测到的人脸在图像上进行标准化和调整,使得人脸区域具有一致的位置、大小和朝向,以便进行后续的特征提取和比对。

3.特征提取(Feature Extraction):特征提取是从人脸图像或人脸区域中提取出有助于识别和表征的关键特征。

常用的特征包括颜色、纹理、形状和局部特征等。

4.特征向量(Feature Vector):特征向量是特征提取过程中得到的数值化表示,它将人脸特征转换为向量形式,用于进行人脸匹配和识别。

5.人脸匹配(Face Matching):人脸匹配是指对两个或多个人脸图像或人脸特征进行比对,以确定它们是否属于同一个人或是否相似。

匹配过程可以采用相似度度量方法,如欧氏距离、余弦相似度等。

6.人脸识别(Face Recognition):人脸识别是指将输入的人脸图像与已知数据库中的人脸进行比对,然后确定其身份或标识。

它可以用于人脸认证、身份验证、身份辨认等应用。

7.人脸数据库(Face Database):人脸数据库是存储人脸图像、人脸特征和标注信息的集合,用于人脸识别系统的建立和训练。

通常包括多个人的人脸数据。

8.活体检测(Liveness Detection):活体检测是为了防止使用照片、视频或面具等伪造物进行攻击而引入的技术。

它通过分析人脸动作、纹理、光照等特征,判断图像或视频中的人脸是否为真实的活体。

以上是人脸识别领域的一些基本名词和概念,它们构成了人脸识别技术的基础,用于实现人脸的检测、对齐、特征提取、匹配和识别等功能。

[论文理解]人脸识别论文总结(一)

![[论文理解]人脸识别论文总结(一)](https://img.taocdn.com/s3/m/6c1a37c4370cba1aa8114431b90d6c85ec3a882c.png)

[论⽂理解]⼈脸识别论⽂总结(⼀)Face Recognition Papers Review主要两个贡献,⼀是把fc 的权重存到不同卡上去,称为model parallel , ⼆是随机选择negative pair 来近似softmax 的分母(很常规的做法)。

Model Parallel :FC 分类分配到n 台显卡上,每台显卡分C/n 类,每张卡存权重的⼀部分,计算局部每张卡上的exp 和sumexp ,然后交互计算softmax 。

考虑梯度回传问题,这样做梯度也是parallel 的,不同于数据parallel 。

数据parallel 的话求梯度是需要⽤整个W 才能求W 的梯度的,⽽model paralle 因为有了梯度公式,可知:∇logits i =prob i −onehot i这⼀下明朗了,所以求权重W i 的梯度就有∇W i =X T ∗∇logits i不需要整个W 就可以求部分W 的梯度啦。

作者觉得尽管model parallel 了,但softmax 的分母部分还是⼤啊,于是借鉴常⽤的⽆监督⽅法,随机sample negative pairs ,不需要全部的negative pair 就可以估计出softmax的分母了。

主要提出⼀种动态更新权重的池⼦⽅法,⽤单独⼀个特征⽹络来提取特征作为权重,⽽⾮直接学全连接的权重,然后动态更新这个池⼦,就不需要存储⼤量的权重了,加速了训练、。

⽅法其实很朴素。

前⾯那个⽅法是把权重存到不同的GPU 上去,因此,如果ID 越来越多,我们加卡就可以了,但本⽂的⽅法不需要,也是节约成本的⼀个⽅法。

⽅法⼤致如下:准备两个⽹络,P ⽹络⽤来训练,G ⽹络是P ⽹络的moving avg ,不训练,最开始随机初始化池⼦,记好当前batch 的id ,如果id 在池⼦⾥,训练P ⽹络⽤CE Loss ,和cosine loss ,如果不在⽤cosine loss ,训练⼀轮后更新G ⽹络。

人工智能基础(习题卷23)

人工智能基础(习题卷23)第1部分:单项选择题,共50题,每题只有一个正确答案,多选或少选均不得分。

1.[单选题]一般将原始业务数据分为多个部分,()用于模型的构建。

A)训练集B)测试集C)验证集答案:A解析:2.[单选题]下列哪些没有使用Anchorbox?A)FasterRCNNB)YOLOv1C)YOLOv2D)YOLOv3答案:B解析:3.[单选题]关于循环神经网络设计的叙述中,错误的是( )。

A)能处理可变长度的序列B)基于图展开思想C)基于参数共享思想D)循环神经网络不可应用于图像数据答案:D解析:4.[单选题]语音识别的单元选择主要有三种,不包括()。

A)单词单元B)音量单元C)音节单元D)音素单元答案:B解析:5.[单选题]下列哪个算法可以用于特征选择(___)A)朴素贝叶斯B)感知器C)支持向量机D)决策树答案:D解析:6.[单选题]除了问题本身的定义之外,使用问题特定知识的搜索策略被认为是( )。

A)启发式算法B)minimax算法C)深度优先搜索答案:A解析:7.[单选题]使机器听懂人类的话最重要的是( )。

A)研发算法B)距离近C)高精度传感器D)清晰的话语答案:A解析:8.[单选题]执行以下命令之后,dic的值是哪一个?dic={'小张': 95, '木子': 85, '小虎': 80, '陈怡': 75, '朝朝': 66}dic['倩倩']=88A){'小张': 95, '木子': 85, '小虎': 80, '陈怡': 75, '朝朝': 66, '倩倩': 88}B){'小张': 95, '小虎': 80, '陈怡': 75, '朝朝': 66}C){'小张': 95, '小虎': 80, '陈怡': 75, '朝朝': 66, '倩倩': 88}D)以上都不是答案:A解析:9.[单选题]文档是待处理的数据对象,它由一组词组成,这些词在文档中不计顺序,如一篇论 文、一个网页都可以看作一个文档。

ReliefF-SVM RFE组合式特征选择人脸识别

华北电力大学电子与通信工程系,河北保定 071003【摘要】针对人脸识别中因特征个数较多对识别的实时性和准确性影响较大的问题,提出了ReliefF-SVM RFE组合式特征选择的人脸识别方法。

利用离散余弦变换提取特征和ReliefF对人脸图像特征集做特征初选,降低特征维数空间,再用改进的SVM RFE(Support Vector Machine Recursive Feature Elimination)选择最优特征,解决了利用SVM RFE特征选择时因特征数多而算法需多次训练耗时长的问题。

对训练得到的特征排序表采用交叉留一验证方法选取最优子集,再由SVM分类识别。

在UMIST人脸库上实验证明,可以在特征数为52时,达到98.84%的识别率,识别时间仅需0.037 s。

【期刊名称】计算机工程与应用【年(卷),期】2013(049)011【总页数】4【关键词】人脸识别;支持向量机回归特征消除(SVM RFE);ReliefF;离散余弦变换;特征选择1 引言人脸识别中,由于人脸包含大量的特征信息,如何合理而有效地选择有利特征,消除冗余,加快运算速度,提高分类效率和正确率,一直是一个研究的热点问题。

适当减少特征维数,保留人脸主要信息,在众多特征中寻找出最有用的特征已成为机器学习的重要研究方向。

根据特征选择的过程是否独立于后续的学习算法,特征选择算法可以分为Filter和Wrapper两大类[1]。

Filter方法和分类学习算法无关,一般直接利用所有训练数据的统计性能评估特征。

该方法的一个明显优势在于可以很快地排除很大数量的非关键性的噪声特征,缩小优化特征子集搜索范围,具有时间复杂度低的优点,用来作为特征的预选器非常好,但缺点是评估和后续学习算法的性能有较大偏差;Wrapper 类方法直接利用分类学习算法的训练准确率评估特征子集可对不同的分类器选用相适应的特征子集,根据这个分类器在验证集上的表现来评价所选择的特征,该方法在速度上比滤波方法慢,但其所选的优化特征子集的规模相对要小得多,评估和分类算法性能偏差小,非常有利于关键特征的辨识和精简诊断决策机器的结构。

人脸识别 习题

人脸识别习题精选人脸识别习题:一、选择题1. 人脸识别主要依赖于哪种技术?A. 语音识别B. 图像处理C. 自然语言处理D. 机器学习2. 在人脸识别中,哪种算法通常用于特征提取?A. K-近邻算法B. 支持向量机C. 卷积神经网络D. 决策树3. 人脸识别中的“人脸检测”阶段主要是为了什么?A. 确定人脸的位置和大小B. 识别出人脸的性别C. 分析人脸的表情D. 判断人脸的朝向二、填空题1. 在人脸识别中,__________ 是一种常用的特征提取方法,它可以有效地从原始图像中提取出人脸的关键信息。

2. __________ 是人脸识别中的一个关键步骤,它通过对提取的特征进行匹配,从而判断输入的人脸是否与已知人脸相同。

三、简答题1. 请简要描述人脸识别系统的工作流程。

2. 列举几种常见的人脸识别应用场景。

3. 人脸识别技术面临哪些挑战和限制?四、编程题1. 假设你有一个包含多张人脸图像的数据集,请你设计一个简单的人脸识别程序,要求能够识别出输入图像中的人脸是否属于数据集中的已知人脸。

2. 利用Python的OpenCV库,实现一个人脸检测程序,要求能够检测并标记出输入图像中的人脸位置。

五、分析题1. 分析人脸识别技术在安全领域的应用及其可能存在的风险。

2. 讨论如何提高人脸识别系统的准确性和鲁棒性。

人脸识别习题答案一、选择题1.【答案】B【解析】人脸识别主要依赖于图像处理技术,通过对人脸图像进行处理和分析,提取出人脸的特征信息,进而进行识别。

因此,正确答案为B。

2.【答案】C【解析】在人脸识别中,卷积神经网络(CNN)通常用于特征提取。

CNN能够自动学习图像中的特征,并且对于人脸识别等任务表现出色。

因此,正确答案为C。

3.【答案】A【解析】人脸检测是人脸识别中的一个重要阶段,它的主要目的是确定人脸的位置和大小,即从输入的图像中检测出人脸区域。

因此,正确答案为A。

二、填空题1.【答案】特征提取2.【答案】人脸识别匹配三、简答题1.【答案】人脸识别系统的工作流程通常包括以下几个步骤:(1)人脸检测:从输入的图像中检测出人脸区域。

android人脸识别API

摘要:通过两个主要的API,Android提供了一个直接在位图上进行脸部检测的方法,这两个API分别是android.media.FaceDetector和android.media.FaceDetector.Face,已经包含在Android官方API中。

通过两个主要的API,Android提供了一个直接在位图上进行脸部检测的方法,这两个API分别是android.media.FaceDetector和android.media.FaceDetector.Face,已经包含在Android官方API中。

本教程来自Developer网站,向大家介绍了这些API,同时提供教程中实例代码下载。

图片来源:Wikipedia所谓人脸检测就是指从一副图片或者一帧视频中标定出所有人脸的位置和尺寸。

人脸检测是人脸识别系统中的一个重要环节,也可以独立应用于视频监控。

在数字媒体日益普及的今天,利用人脸检测技术还可以帮助我们从海量图片数据中快速筛选出包含人脸的图片。

在目前的数码相机中,人脸检测可以用来完成自动对焦,即“脸部对焦”。

“脸部对焦”是在自动曝光和自动对焦发明后,二十年来最重要的一次摄影技术革新。

家用数码相机,占绝大多数的照片是以人为拍摄主体的,这就要求相机的自动曝光和对焦以人物为基准。

via 构建一个人脸检测的Android Activity你可以构建一个通用的Android Activity,我们扩展了基类ImageView,成为MyImageView,而我们需要进行检测的包含人脸的位图文件必须是565格式,API才能正常工作。

被检测出来的人脸需要一个置信测度(confidence measure),这个措施定义在android.media.FaceDetector.Face.CONFIDENCE_THRESHOLD。

最重要的方法实现在setFace(),它将FaceDetector对象实例化,同时调用findFaces,结果存放在faces里,人脸的中点转移到MyImageView。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Type 1&2:

The red area ratio is only required to be [1/2 1) times the whole area The relative position of red area is not required to be in the middle of whole area. The relative position of red area is not required to be in the middle of white area. The width and height are not required to be the same, only even lengths are required.

TII type 2 (TII2) consists a right triangle with the right angle at the up-right corner. Let the width of the original image be W, TII2(1:W+1, -1) = 0, TII2(1:W+1, 0) = 0, (1, 1) TII2(0, y) = 0. TII2(x-1, y-2) TII2(x, y) = I (x, y) TII2(x-1, y-1) + TII2(x, y-1) I (x, y) + TII2(x-1, y-1) W TII2(x, y-1) - TII2(x-1, y-2).

Type 1

Type 2

Type 3

Type 4

MIR Lab, ISA/NTHU

Type 5

michael@.tw

Type 6

14

3.2.1 Extension of Rectangle Features (Cont.)

Extensions of each type:

0 0 0 0 0 0 0 0 0 0 0

0

0

0

0

0

0

0

0

0

0

0

0 0 0

0

0 0 0 0 0 0

W

MIR Lab, ISA/NTHU michael@.tw

TII1(x+1, y-1)

9

3.1.2 Triangle Integral Images (Cont.)

MIR Lab, ISA/NTHU michael@.tw 4

2. Related Work

2001 – Viola and Jones introduce:

Rectangle

integral image Training algorithm based on AdaBoost A cascaded structure

g. RII(x2+w2-1, y2-1) a. RII(x1-1, y1-1) h. RII(x2-1, y2-1) (x1, y1) (x2, y2) h2 f. TII1(x2+w2, y2-1) b. RII(x1+w1-1, y1-1) h1 w2 w1 d. RII(x1+w1-1, y1+h1-1)

MIR Lab, ISA/NTHU

michael@.tw

12

3.2 Features (Cont.)

A feature extracts a value by subtracting the sum of pixels of the light area from the sum of pixels of the dark area in an image. A sum of a rectangle area can be computed by four points in a RII:

2X

Three rectangle feature:

1

=

2

MIR Lab, ISA/NTHU

–2X

1

–2X

2

michael@.tw

16

3.2.2 Type 7: Triangle Feature Type A

This research introduces two new types of triangle features. Up-left right triangle feature (type 7):

a. RII(x-1, y-1) (x, y) height d. RII(x+width-1, y+height-1) b. RII(x+width-1, y-1)

c. RII(x-1, y+height-1)

width

The sum of pixels in gray area = d - b - c + a .

Image Resize image Contrast stretching

Transform to integral images

Face Detection

Faces Non-faces

MIR Lab, ISA/NTHU

michael@.tw

3

Outline

1. Introduction 2. Related Work 3. Integral Image and Features 4. Learning Strong Classifiers 5. Cascade of Classifiers 6. Experimental Results 7. Conclusions and Future Work

0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0

MIR Lab, ISA/NTHU

michael@.tw

10

3.2 Features

We can observe that a human face has some useful characteristics, for example:

I ( x' , y ' )

RII(x, y)

(x, y)

The RII at location (x, y) contains the sum of the pixels above and to the left of (x, y). We also calculate the square sum of the image calculating variance for contrast correction (see 6.1).

MIR Lab, ISA/NTHU

michael@.tw

7

3.1.1 Rectangle Integral Image

The definition of Rectangle Integral Image (RII):

RII( x, y)

x ' x , y ' y

MIR Lab, ISA/NTHU michael@.tw 2

1. Introduction

Face detection is an important component of a video information retrieval system. This research focuses on the upright-frontal face detection problem. System flow chart:

michael@.tw 13

MIR Lab, ISA/NTHU

3.2.1 Extension of Rectangle Features

We extend some feature types to be more generalized. Totally six types of rectangle features are u3, 4&5:

Type 6:

MIR Lab, ISA/NTHU

3.2.1 Extension of Rectangle Features (Cont.)

We calculate rectangle features by subtracting areas of two (type 1~5) or three (type 6) rectangles. Two rectangle feature: = –

michael@.tw 8

MIR Lab, ISA/NTHU

3.1.2 Triangle Integral Images

This research introduces two new types of triangle integral images (TIIs). TII type 1 (TII1) consists a right triangle with the right angle at the up-left corner. TII1(x+1, y-2) Let the width of the original image be W, TII1(1:W+1, -1) = 0, (1, 1) TII1(1:W+1, 0) = 0, TII1(W+1, y) = 0. TII1(x, y-1) TII1(x, y) = I (x, y) + TII1(x, y-1) I (x, y) + TII1(x+1, y-1) - TII1(x+1, y-2).

The

area of eyes is usually darker than the area of the bridge of the nose. The area across eyes is usually darker than the area of cheeks. (proposed by Viola)