基于仿射迭代模型的特征点匹配算法

surf特征点的匹配过程

surf特征点的匹配过程

Surf特征点的匹配过程包括以下步骤:

1. 提取特征点:通过Surf算法提取两幅图像中的特征点。

Surf算法通过计算图像中的Hessian矩阵的行列式来检测潜在的特征点,然后通过计算特征点的主方向和构建特征描述子。

2. 计算特征描述子:对于每个特征点,Surf算法会将其周围的图像区域划分为若干个子区域,然后提取每个子区域的Haar小波响应。

这些Haar小波响应将组成特征描述子。

通过这种方式,每个特征点都能够具有一个128维的特征描述子。

3. 特征点匹配:通过计算两幅图像中特征点的相似度来进行匹配。

常用的方法是计算两个特征描述子之间的欧氏距离或是余弦相似度。

对于每个特征点,选择在另一幅图像中与其具有最小距离的特征点作为匹配点。

4. 特征点筛选:根据匹配点之间的距离进行筛选,排除一些不太可信的匹配点。

常用的方法是计算匹配点的距离与次近距离之间的比值,如果这个比值小于一个给定的阈值,就将匹配点保留下来。

5. 可选的优化步骤:可以通过使用RANSAC(随机抽样一致性)算法进一步筛选匹配点,消除由于噪声或误识别造成的错误匹配。

RANSAC算法会随机选择一组匹配点,并计算这些匹配点与模型之间的误差,然后根据误差进行筛选,最后得到更准确的匹配结果。

通过以上步骤,Surf特征点的匹配过程可以得到两幅图像中匹配点的对应关系,从而进行图像配准、目标跟踪等应用。

python opencv 特征点匹配算法

Python是一门功能强大的编程语言,而OpenCV则是一款开放源代码的计算机视观方面的库。

特征点匹配是计算机视觉领域中非常关键和基础的技术之一。

本文将介绍Python和OpenCV中常用的特征点匹配算法。

一、SIFT算法尺度不变特征变换(Scale-Invariant Feature Transform,SIFT)是一种用于提取图像局部特征的算法。

它能够在不同尺度和旋转角度上找到关键点,并且对图像的缩放、旋转保持不变性。

SIFT算法主要分为四个步骤:尺度空间极值检测、关键点定位、关键点方向确定和关键点描述。

在OpenCV中,可以使用cv2.xfeatures2d.SIFT_create()函数来创建SIFT对象,然后调用detectAndCompute()方法来提取关键点和描述符。

二、SURF算法加速稳健特征检测(Speeded-Up Robust Features,SURF)是一种基于Hessian矩阵的特征提取算法。

它比SIFT算法更快速,并且在某些情况下比SIFT算法具有更好的性能。

SURF算法也可以实现尺度和旋转不变性。

在OpenCV中,可以使用cv2.xfeatures2d.SURF_create()函数来创建SURF对象,并同样调用detectAndCompute()方法来提取关键点和描述符。

三、ORB算法Oriented FAST and Rotated BRIEF(ORB)是一种基于FAST关键点检测和BRIEF描述符的算法。

它在速度和性能之间取得了很好的平衡,具有较快的速度和较好的检测性能。

ORB算法对旋转具有不变性,但对于尺度变换的不变性较差。

在OpenCV中,可以使用cv2.ORB_create()函数来创建ORB对象,然后同样调用detectAndCompute()方法来提取关键点和描述符。

四、匹配算法特征点提取之后,就需要进行特征点的匹配。

常用的特征点匹配算法包括暴力匹配、FLANN匹配等。

loftr特征匹配公式推导

loftr特征匹配公式推导

LoFTR特征匹配公式推导

一、引言

LoFTR (Localization over Freeform Targets with Radar) 是一种基于雷达的目标定位技术,它可以在复杂环境中实现高精度的目标定位。

LoFTR通过比较雷达接收到的信号与存储的目标特征来实现目标识别和定位。

特征匹配是LoFTR中的关键步骤,其准确性直接影响到定位精度。

本文将重点推导LoFTR的特征匹配公式,为后续的目标定位提供理论基础。

二、LoFTR特征匹配公式推导

假设雷达接收到的信号表示为S(t),目标特征表示为F(t),则特征匹配的过程可以表示为寻找最佳的时间延迟τ,使得S(t)和F(t)之间的互相关函数达到最大值。

互相关函数定义为:

R(τ) = ∫S(t) * F(t-τ) dt

其中,*表示共轭复数。

为了方便计算,我们通常使用离散化的信号,此时互相关函数可以表示为:

R[k] = S[k] * F[k-n]

其中,k表示时间索引,n表示时间延迟的样本数。

通过遍历所有可能的n值,我们可以找到使得R[k]最大的n,即最佳时间延迟。

三、结论

通过上述推导,我们可以看到LoFTR的特征匹配过程是基于互相关函数的计算。

在实际应用中,我们需要根据具体的雷达信号和目标特征来选择合适的时间延迟和特征匹配算法,以提高目标定位的精度。

此外,考虑到实际环境中存在的噪声和干扰,可能还需要对雷达信号进行预处理和滤波等操作,以改善特征匹配的效果。

基于特征点的图像配准算法研究

基于特征点的图像配准算法研究一、前言:图像配准算法的重要性在计算机视觉领域,图像配准是一项基础任务,其主要作用是将不同图像之间的位置关系进行对应,这对于后续的图像分析和处理都至关重要。

例如,医学影像领域中常用的CT、MRI等设备采集到的影像几乎都需要进行配准,否则会影响成像结果。

在军事领域中,需要通过多个角度从不同载体获取的图像进行配准,以方便分析情报、制定作战计划等。

目前,常用的图像配准算法有很多种,其中基于特征点的算法是一种广泛使用的方法。

本文将对基于特征点的图像配准算法进行研究和分析。

二、特征点的基本概念特征点(Feature Point),是指在一张图像中能够表示出其特殊性质或重要特征的一个点,该点在另一张相似图像中仍容易识别出来。

通常情况下,特征点的选择是基于如下几个原则:(1)该点周围具有更多的信息,特别是物体边缘、角点和线的节点处;(2)该点在不同的尺度或旋转角度下都能够被检测到;(3)该点具有鲁棒性,能够在图像噪声和光照变化等干扰情况下保持稳定。

三、基于特征点的图像配准算法1. 特征提取首先,需要对待匹配的图像进行特征点提取。

特征点提取是指在待匹配图像中提取出具有代表性的、具有重要意义的特征点。

常用的特征点提取算法有如下几种:(1)Harris算法:通过计算领域内像素间的角点响应函数来检测角点,实现简单,但对图像的光照、噪声等条件敏感。

(2)SIFT算法:通过使用尺度空间的高斯拉普拉斯变换来检测局部特征,对图像旋转、尺度变化、光照变化、噪声等干扰具有较好的鲁棒性。

(3)SURF算法:通过加速版的SIFT算法来提取图像中的特征点,主要优点是速度更快,鲁棒性更好。

(4)FAST算法:通过对像素的亮度值进行排序,检测出具有代表性的像素点,速度比较快,但对噪声敏感。

2. 特征匹配提取出待匹配图像和目标图像的特征点之后,需要对这些点进行匹配,以确定它们之间的位置关系。

通常采用的方法是计算其在多幅图像中的描述子,并通过计算特征点之间的相似度进行匹配。

opencv findtransformecc 原理

opencv findtransformecc 原理findTransformECC是OpenCV 中的一个函数,用于找到两个图像之间的仿射变换。

这个函数主要基于特征匹配和迭代最近点(Iterative Closest Point,ICP)算法。

以下是其工作原理的详细解释:1.特征检测与描述符提取: 首先,findTransformECC需要从两个图像中提取关键点。

这些关键点可以是角点、边缘或其他形式的局部图像特征。

对于每个关键点,该函数提取一个或多个描述符,这些描述符捕获了关键点周围图像的局部特性。

常见的描述符包括SIFT、SURF、ORB 等。

2.特征匹配: 一旦从两个图像中提取了关键点和描述符,就需要进行特征匹配。

这通常通过比较描述符之间的相似性来完成,例如使用FLANN(Fast Library for Approximate Nearest Neighbors)或暴力匹配算法。

匹配的目标是找到源图像中的每个关键点在目标图像中的对应点。

3.迭代最近点(ICP) 算法: 接下来,findTransformECC使用迭代最近点(ICP)算法来估计仿射变换。

ICP 是一种迭代优化技术,用于最小化源图像和目标图像中对应点之间的距离。

初始估计的仿射变换通常是一个粗略的估计,然后ICP 通过迭代更新这个变换,直到找到最优的变换参数。

4.仿射变换模型: 仿射变换模型可以表示为2x3 的变换矩阵,用于将源图像中的点映射到目标图像中。

这个矩阵由2D 平移向量、缩放因子、旋转角度和倾斜角度等参数组成。

通过ICP 算法,可以找到这些参数的最优值,从而得到仿射变换矩阵。

5.应用变换: 最后,使用找到的仿射变换矩阵将源图像中的所有点映射到目标图像中。

这个过程可以通过OpenCV 中的warpAffine函数实现。

需要注意的是,findTransformECC是一个比较复杂的函数,涉及到特征检测、描述符提取、特征匹配和迭代优化等多个步骤。

一种基于仿射参数估计的图像配准方法

一种基于仿射参数估计的图像配准方法专利名称::一种基于仿射参数估计的图像配准方法技术领域::本发明属于计算机图像处理领域,涉及一种图像配准方法。

背景技术::图像配准是同一场景的两幅或多幅图像在空间上的对准。

它在医学,遥感图像分析、图像融合、图像检索、目标识别等领域得到广泛的应用。

同时它也是多传感器图像融合、遥感图像镶嵌、目标变化检测、三维重建等领域中提高精度和有效性的瓶颈,是必需的前期工作。

图像配准方法分为基于图像灰度和基于图像特征的配准。

其中,基于灰度信息的图像配准方法一般不需要对图像进行复杂的预先处理,而是利用图像本身具有灰度的一些统计信息来度量图像的相似程度,实现起来比较简单,经过几十年的发展,人们提出了许多基于灰度信息的图像配准方法,如互相关法(也称模板匹配法)、序贯相似度检测匹配法、交互信息法等。

基于特征的匹配方法首先要对待配准图像进行预处理,也就是图像分割和特征提取的过程,再利用提取得到的特征完成两幅图像特征之间的匹配,通过特征的匹配关系建立图像之间的配准映射关系。

由于图像中有很多种可以利用的特征,因而产生了多种基于特征的方法。

常用到的图像特征有特征点(包括角点、高曲率点等)直线段、边缘、轮廓、闭合区域、特征结构以及统计特征如矩不变量、重心等等。

以上两种方法虽然都有各自的优势,且都取得了不错的效果,但这两种方法也都有自己的不足之处,基于图像灰度的配准方法配准速度比较慢;基于图像特征的配准方法算法复杂,而且往往由于特征提取的不完全,导致匹配率较低,对误匹配比较敏感,随着误匹配率的增大,配准效果会有明显的下降。

这在很大程度上限制了以上两种方法在实际工程中的应用,由于现有的基于灰度和基于特征的图像配准方法对误匹配均比较敏感,因此对特征点配准准确度提出了很高的要求,然而在许多实际工程中,例如航遥感空影像配准,由于飞机飞行姿态受气流影响比较严重,导致相邻帧图像之间存在很大的畸变,在进行点配准时误匹配在所难免,利用传统方法进行图像配准就会出现较大的偏差。

特征匹配 匹配策略

特征匹配匹配策略:

特征匹配是图像处理和计算机视觉中的重要技术,用于在两幅或多幅图像之间找到对应的特征点,并建立特征点之间的对应关系。

特征匹配的匹配策略主要有以下几种:

1.基于阈值的匹配策略:通过设定阈值来比较两个特征点之间的相似度,如果相似度

大于阈值,则认为这两个特征点是匹配的。

这种策略简单、快速,但容易受到光照、旋转等因素的影响,匹配精度不高。

2.基于最近邻距离比的匹配策略:首先计算两个特征点之间的距离,然后通过比较该

距离与次近邻距离的比值来判断是否匹配。

这种策略能够排除一些不准确的匹配点,但计算复杂度较高。

3.基于特征描述符的匹配策略:通过提取特征点的特征描述符(如SIFT、SURF等),

然后比较两个特征点的描述符是否相似来判定是否匹配。

这种策略对光照、旋转等变化具有一定的鲁棒性,但计算量大,需要较长的计算时间。

4.基于深度学习的匹配策略:利用深度学习技术进行特征点的匹配,如卷积神经网络

(CNN)等。

这种策略能够自动学习特征表示,具有较高的匹配精度和鲁棒性,但需要大量的训练数据和计算资源。

ORB特征点检测匹配算法

ORB特征点检测匹配算法ORB (Oriented FAST and Rotated BRIEF) 特征点检测匹配算法是一种用于计算机视觉中特征点提取和描述的算法。

它结合了FAST角点检测器和BRIEF描述符,具有旋转不变性和快速计算速度,被广泛应用于目标识别、图像拼接、三维重建等领域。

ORB算法的主要步骤包括特征点检测、特征描述和特征匹配。

1.特征点检测:ORB算法采用FAST角点检测器进行特征点检测,FAST角点检测器是一种高速的角点检测算法,通过比较中心点像素值和其周围相邻像素值的差异来判断是否为角点。

FAST角点检测器在角度变化和尺度变化下具有一定的鲁棒性。

ORB算法在FAST角点检测的基础上进行改进,引入了旋转不变性,通过计算像素的灰度质心,来判断角点的旋转方向,并计算角点的方向和尺度。

2.特征描述:ORB算法使用BRIEF描述符对特征点进行描述,BRIEF是一种二进制描述符,它通过随机选择一组像素对,并比较它们的亮度值来生成一个二进制串。

BRIEF描述符具有较低的计算复杂度和存储空间需求,适合于在实时性要求较高的场景中使用。

为了提高旋转不变性,ORB算法在BRIEF描述符的基础上引入了方向校正,将旋转不变特征描述符 (Rotated BRIEF) 与尺度不变特征描述符(Scale Invariant Feature Transform, SIFT) 结合起来。

在计算BRIEF描述符之前,ORB算法将图像进行多个尺度的高斯模糊操作,计算每个尺度下的图像金字塔,并在每个金字塔层级上计算BRIEF描述符。

3.特征匹配:特征点匹配是ORB算法的最后一步,通过计算特征点之间的距离来确定匹配关系。

ORB算法使用汉明距离 (Hamming Distance) 来衡量两个二进制描述符的相似性,汉明距离越小表示两个特征点越相似。

为了提高匹配的鲁棒性,ORB算法采用了基于最近邻和次近邻距离比的匹配策略,只有当最近邻距离比次近邻距离的阈值小于一个阈值时,才认为匹配成功。

基于SURF的特征点快速匹配算法

1 引 言

可 以大 大减 少 匹配 计 算 量 , 应 用 在 对 图像 处 理 实 时 性 要求 较 高 的光 电跟踪 系统 中具 有 明显 的优势 。 特征 匹配 的关 键在 于寻 找一 种较 好 的特征 描述 法 和特 征 匹配算 法 。就 点 特 征 而 言 , 目前 常见 的特 征点提 取 方 法 有 H a r r i s 特征 、 S U S A N特 征 、 S I F T特 征 等 I 4 。其 中 , D . G . L o w e提 出 的 S I T 特 征 由于 F 对 光照 、 旋转 、 尺 度 等 变换 具 有 不 变 性 , 受 到 了学 者 的广泛关 注 J , 但是 S I T 特 征需 要进 行 1 F 2 8维 的矢 量 特征运 算 , 在 高速 视 频 处 理 系 统 中实 时实 现 较 为 困难 。He r b e r t B a y等 提 出 的 S U R F特 征 在 S I F T的 基础 上 简 化 了 图像 金 字 塔 分 解 的操 作 _ 6 J 。类 似 于

中图分 类号 : T P 3 9 1 . 4 1 文献 标识 码 : A D OI : 1 0 . 3 9 6 9 / j . i s s n . 1 0 0 1 — 5 0 7 8 . 2 0 1 4 . 0 3 . 2 8

Fa s t f e a t u r e p o i n t ma t c h i ng a l g o r i t hm b a s e d o n S URF

・图像 与信 号处 理 ・

基于 S U R F的特 征 点 快 速 匹 配算 法

尧思 远 , 王晓明, 左 帅

( 华 北 光 电技 术 研 究 所 , 北京 1 0 0 0 1 5 )

基于特征点提取和匹配的点云配准算法

基于特征点提取和匹配的点云配准算法点云配准是将多个点云数据进行变换和对齐的过程,通常用于三维重建、SLAM(Simultaneous Localization and Mapping)、机器人导航等应用领域。

基于特征点提取和匹配的点云配准算法是一种常用的点云配准方法,其主要步骤包括特征点提取、特征描述、特征匹配、姿态估计和变换求解等。

首先,需要从每个输入点云中提取特征点。

特征点是具有较好区分度和稳定性的点,可以用来描述点云的局部特征。

目前常用的特征点提取算法包括SIFT(Scale-invariant Feature Transform)、ISS(Intrinsic Shape Signatures)、NARF(Normal Aligned Radial Features)等。

这些算法通过局部表面曲率、顶点法线或表面切片等几何属性来检测特征点。

接下来,对于每个特征点,需要计算其特征描述子。

特征描述子是一种能够对特征点进行准确描述和表示的向量表示。

常见的特征描述算法包括FPFH(Fast Point Feature Histograms)、SHOT(Signature of Histograms of OrienTations)等。

这些算法通过计算特征点周围的局部几何属性,如法线方向、曲率等,来构建特征描述子。

然后,对于两个点云,需要进行特征点之间的匹配。

特征匹配是将两个点云中的相似特征点进行对应的过程,通常是通过计算特征描述子之间的距离来完成的。

常用的匹配算法有最近邻、KD树等。

通过匹配得到的相似特征点对可以用于后续的配准过程。

在特征点匹配之后,通过求解两组对应点之间的变换关系,可以得到点云的刚体变换(Rotation and Translation)。

常用的姿态估计算法有最小二乘法、RANSAC(Random Sample Consensus)等。

这些算法通过最小化匹配点对之间的误差,找到最好的刚体变换参数。

基于仿射变换的局部特征匹配算法

基于仿射变换的局部特征匹配算法戚海想【摘要】Aiming at the situation of the ASIFT algorithm where there areone-to-many, and many-to-one matching, and eventually leading to cor-rect matching are eliminated, proposes a local feature matching algorithm based on affine transformation (LMA). The method is based on the matching key point set under the ASIFT algorithm, in different local areasof an image, chooses three pairs of matching key point and calculates the corresponding affine transformation matrix, for every key point in the reference image, searches for matching key point by the nearest affine transformation matrix, and eliminate the matching key points which have bigger error in the matching key point set by the RANSAC algorithm. The experimental results show that by this kind of space constraint, improved algorithm can obviously increase the number of matching key points, atthe same time of ensuring high matching accuracy.%针对SIFT算法中存在一对多和多对一匹配,并最终导致正确匹配被剔除的情况,提出一种基于仿射变换的局部特征匹配算法(LMA)。

特征点匹配——SIFT算法详解

特征点匹配——SIFT算法详解SIFT(Scale-Invariant Feature Transform)是一种用于在图像中寻找关键点并进行匹配的算法。

该算法由David Lowe在1999年发布,并且一直被广泛应用于计算机视觉领域。

SIFT算法具有尺度不变性和旋转不变性,可以在不同的图像尺度和旋转角度下进行特征点的匹配。

SIFT算法的主要步骤包括关键点检测、关键点描述和特征点匹配。

关键点检测:在一张图像中,关键点通常是指存在于不同尺度和方向上的局部最大值或局部最小值。

SIFT使用高斯差分金字塔来检测关键点。

首先,通过对原始图像进行高斯模糊,创建一个金字塔,然后在每一组金字塔中计算高斯差分图像。

接着,通过比较每个像素周围的8个像素和自身像素的差值,找到局部极值点。

最后,使用尺度空间极大值抑制来进一步过滤出稳定的关键点。

关键点描述:在关键点检测后,需要对每个关键点进行描述。

SIFT使用局部图像梯度的直方图来描述关键点。

首先,在每个关键点周围的16x16像素块上计算梯度的幅值和方向。

然后将这个块分成16个4x4的子块,并在每个子块上计算一个8方向的直方图。

最后,将这些直方图连接起来形成一个128维的向量,用来表示该关键点。

在对两幅图像提取出关键点并进行描述后,需要对这些特征点进行匹配。

SIFT使用欧式距离来计算特征向量之间的相似性。

对于每个特征点,将其描述子与另一幅图像中的所有描述子进行比较,选择最佳匹配的特征点对。

SIFT算法在匹配过程中还引入了RANSAC算法来排除错误的匹配。

RANSAC(Random Sample Consensus)是一种迭代的鲁棒性估计方法,可以通过随机选择一个小子集来估计模型参数,并通过计算剩余误差和阈值来确定最终的模型。

总结一下,SIFT算法通过关键点检测、关键点描述和特征点匹配三个步骤来实现对图像中的特征点进行匹配。

该算法具有尺度不变性和旋转不变性,可以在不同的图像尺度和旋转角度下进行特征点的匹配。

特征匹配的原理

特征匹配的原理特征匹配是计算机视觉领域中一种常用的图像处理技术,它通过对比图像中的特征点,找出图像之间的相似之处。

特征匹配在图像识别、目标跟踪、图像拼接等应用中有着广泛的应用。

特征匹配的原理是基于图像中的特征点,通过比较特征点之间的相似度来确定图像之间的匹配关系。

特征点是图像中具有独特性和稳定性的点,它可以通过图像的局部特征进行描述。

常见的特征点包括角点、边缘点、斑点等。

特征匹配的过程一般包括以下几个步骤:1. 特征提取:首先从图像中提取特征点。

常用的特征提取算法有Harris角点检测、SIFT(尺度不变特征变换)和SURF(加速稳健特征)等。

2. 特征描述:对于提取到的特征点,需要对其进行描述,以便进行后续的匹配。

描述子是一个具有固定长度的向量,它可以描述特征点周围的图像信息。

常用的描述子算法有SIFT描述子和SURF描述子等。

3. 特征匹配:将待匹配的图像与参考图像进行特征匹配。

常用的匹配算法有暴力匹配和FLANN(快速最近邻搜索)匹配等。

暴力匹配会对待匹配图像的每个特征点逐个与参考图像中的特征点进行比较,计算它们之间的相似度,然后选取最相似的特征点作为匹配结果。

FLANN匹配则利用了kd-tree等数据结构,通过快速搜索找到最相似的特征点。

4. 匹配验证:对于匹配的结果,需要进行验证以排除错误匹配。

常用的验证方法有基于几何关系的RANSAC算法和基于相似度的阈值判定等。

特征匹配的准确性和稳定性对于后续的图像处理任务非常重要。

为了提高匹配的准确性,可以选择更加稳定的特征点和描述子,并使用更加严格的匹配验证方法。

此外,还可以通过图像预处理、特征点筛选等方法来提高匹配的效果。

特征匹配是一种通过对比图像中的特征点来确定图像之间匹配关系的图像处理技术。

它在计算机视觉领域有着广泛的应用,可以用于图像识别、目标跟踪、图像拼接等任务中。

特征匹配的原理是基于特征点的提取、描述和匹配,通过计算特征点之间的相似度来确定匹配关系。

SIFT特征点提取与匹配算法

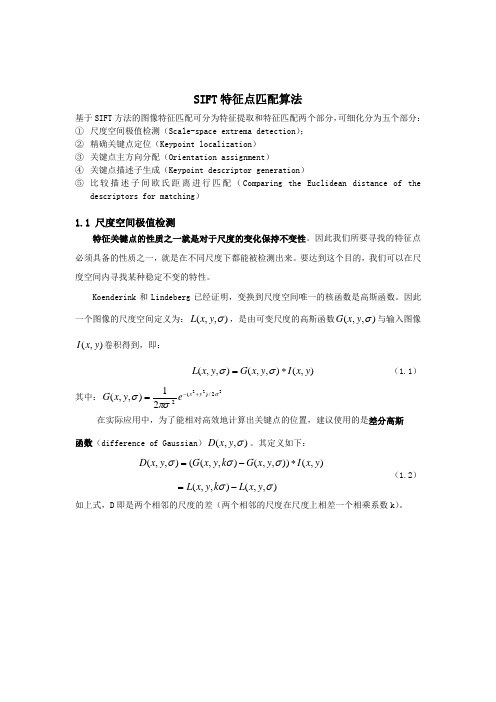

SIFT 特征点匹配算法基于SIFT 方法的图像特征匹配可分为特征提取和特征匹配两个部分,可细化分为五个部分: ① 尺度空间极值检测(Scale-space extrema detection );② 精确关键点定位(Keypoint localization )③ 关键点主方向分配(Orientation assignment )④ 关键点描述子生成(Keypoint descriptor generation )⑤ 比较描述子间欧氏距离进行匹配(Comparing the Euclidean distance of the descriptors for matching )1.1 尺度空间极值检测特征关键点的性质之一就是对于尺度的变化保持不变性。

因此我们所要寻找的特征点必须具备的性质之一,就是在不同尺度下都能被检测出来。

要达到这个目的,我们可以在尺度空间内寻找某种稳定不变的特性。

Koenderink 和Lindeberg 已经证明,变换到尺度空间唯一的核函数是高斯函数。

因此一个图像的尺度空间定义为:(,,)L x y σ,是由可变尺度的高斯函数(,,)G x y σ与输入图像(,)I x y 卷积得到,即:),(),,(),,(y x I y x G y x L *=σσ (1.1) 其中:2222/)(221),,(σπσσy x e y x G +-=在实际应用中,为了能相对高效地计算出关键点的位置,建议使用的是差分高斯函数(difference of Gaussian )(,,)D x y σ。

其定义如下:),,(),,(),()),,(),,((),,(σσσσσy x L k y x L y x I y x G k y x G y x D -=*-= (1.2)如上式,D 即是两个相邻的尺度的差(两个相邻的尺度在尺度上相差一个相乘系数k )。

图 1.1图1.1所展示的是建立DOG 的一种实用的方法。

特征点检测算法

特征点检测算法一、SIFT(Scale Invariant Feature Transform)算法基本原理及主要特征1、SIFT 算法基本原理SIFT 算子是图像匹配算法中性能较好的算子,基于SIFT 算法的特征图像配准可大致分为特征的检测、描述和匹配。

特征检测是在尺度空间中进行的,首先生成图像尺度空间,然后检测尺度空间中的局部极值点,再通过剔除低对比度点和边缘响应点对局部极值点进行精确定位;在对特征进行描述时,先计算每个极值点的主方向,对极值点为中心的区域进行直方图梯度方向统计,生成特征描述子;最后,通过特征描述子寻找匹配的特征,建立图像之间的联系。

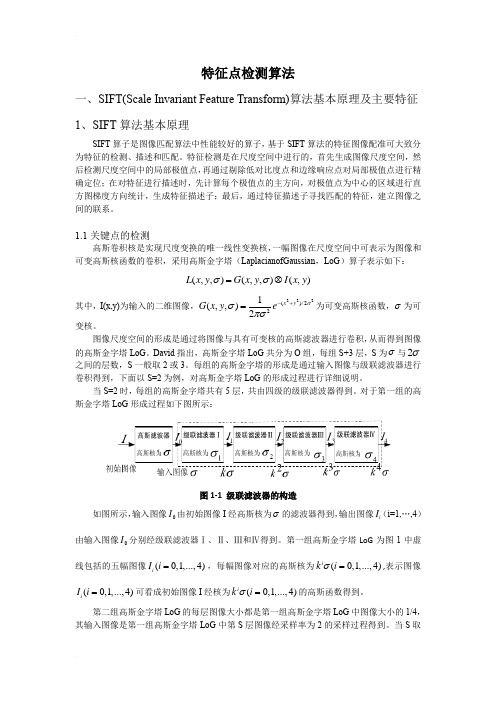

1.1关键点的检测高斯卷积核是实现尺度变换的唯一线性变换核,一幅图像在尺度空间中可表示为图像和可变高斯核函数的卷积,采用高斯金字塔(LaplacianofGaussian ,LoG )算子表示如下:(,,)(,,)(,)L x y G x y I x y σσ=⊗其中,I(x,y)为输入的二维图像,222()/221(,,)2xy G x y e σσπσ-+=为可变高斯核函数,σ为可变核。

图像尺度空间的形成是通过将图像与具有可变核的高斯滤波器进行卷积,从而得到图像的高斯金字塔LoG 。

David 指出,高斯金字塔LoG 共分为O 组,每组S+3层,S 为σ与2σ之间的层数,S 一般取2或3。

每组的高斯金字塔的形成是通过输入图像与级联滤波器进行卷积得到,下面以S=2为例,对高斯金字塔LoG 的形成过程进行详细说明。

当S=2时,每组的高斯金字塔共有5层,共由四级的级联滤波器得到。

对于第一组的高斯金字塔LoG 形成过程如下图所示:图1-1 级联滤波器的构造如图所示,输入图像0I 由初始图像I 经高斯核为σ的滤波器得到,输出图像i I (i=1,…,4)由输入图像0I 分别经级联滤波器Ⅰ、Ⅱ、Ⅲ和Ⅳ得到。

第一组高斯金字塔LoG 为图1中虚线包括的五幅图像(0,1,...,4)i I i =,每幅图像对应的高斯核为(0,1,...,4)ik i σ=, 表示图像(0,1,...,4)i I i =可看成初始图像I 经核为(0,1,...,4)i k i σ=的高斯函数得到。

一种高性能SAR图像边缘点特征匹配方法

第39卷第12期自动化学报Vol.39,No.12 2013年12月ACTA AUTOMATICA SINICA December,2013一种高性能SAR图像边缘点特征匹配方法陈天泽1李燕2摘要针对合成孔径雷达(Synthetic aperture radar,SAR)图像特征匹配中特征提取的不稳定性和相似度优化搜索的复杂性问题,提出了一种精确高效稳健的SAR图像边缘点集匹配方法.首先,分析了仿射变换模型在遥感图像匹配中的适应性,并对仿射变换模型进行了参数分解;其次,提出了基于方向模板的SAR图像边缘检测算子,并利用SAR图像边缘的梯度和方向特征,建立了基于像素迁移的多源SAR边缘点集相似性匹配准则,以及图像匹配的联合相似度–联合特征均方和(Square summation joint feature,SSJF);然后,利用改进的遗传算法(Genetic algorithm,GA)来进行相似度的全局极值优化搜索,获取变换模型参数和边缘点集的对应关系;最后,从理论上分析了本文方法的性能,并利用多幅SAR图像的匹配实验以及与原有方法的对比分析,对本文方法的性能进行了验证.关键词合成孔径雷达图像匹配,仿射变换模型,参数分解,像素迁移,联合相似测度,遗传算法引用格式陈天泽,李燕.一种高性能SAR图像边缘点特征匹配方法.自动化学报,2013,39(12):2051−2063DOI10.3724/SP.J.1004.2013.02051A High Performance Edge Point Feature Match Method of SAR ImagesCHEN Tian-Ze1LI Yan2Abstract A precise,efficient and robust edge point set matching method of synthetic aperture radar(SAR)image is presented.First,the adaptability of the affine transform model used in the remote sensing image matching is analyzed,and the parameters of the affine transform model are decomposed.Next,a modified ratio of exponentially weighted averages (ROEWA)edge detector is used to get the strength and direction of each edge point with the eight directional templates, the matching similarity criterion and the joint similarity–square summation joint feature(SSJF)are constructed based on the strength and direction of the edge point in images.Then,parameters of the transform model between the matching SAR images are determined with the modified genetic algorithms(GA)which is used to obtain the global optimum extremum of the joint similarity.Finally,the performance of the method is analyzed in theory and validated with SAR images matching experiments.Key words Synthetic aperture radar(SAR)images matching,affine transform model,parameters decomposition,pixel migration,joint similarity,genetic algorithm(GA)Citation Chen Tian-Ze,Li Yan.A high performance edge point feature match method of SAR images.Acta Automatica Sinica,2013,39(12):2051−2063合成孔径雷达(Synthetic aperture radar, SAR)图像匹配的目的是找到同一场景下不同时间或不同视角、不同传感器获取的两幅或多幅SAR 图像之间的一一对应关系,是三维重建、目标识别、匹配制导、变化检测、信息融合等应用中的关键技术.由于受成像时间、传感器姿态、波段、极化方式以及图像噪声等多种因素影响,不同SAR图像的灰收稿日期2012-10-30录用日期2013-08-19Manuscript received October30,2012;accepted August19, 2013国家自然科学基金(61002023)资助Supported by National Natural Science Foundation of China (61002023)本文责任编委戴琼海Recommended by Associate Editor DAI Qiong-Hai1.国防科学技术大学电子科学与工程学院长沙4100732.炮兵防空兵装备技术研究所北京1000121.College of Electronic Science and Engineering,National Uni-versity of Defense Technology,Changsha4100732.Artillery and Air Defense Corps Research Institute of Equipment and Technologies,Beijing100012度会存在较大的差异,所以从图像匹配稳健性、适应性、计算复杂度等方面考虑,在理论和实际应用中常采用基于特征的图像匹配技术.SAR图像匹配中常用的特征可归结为点、线、面三类特征基元[1],其中,点特征是图像结构特征中的最小基元,广泛存在于各种场景的SAR图像中,而且其特征提取和描述方法相对简单,是以点特征匹配成为常见的特征匹配方法.特征匹配算法的前提是两幅图像中必须共同存在这些同名特征并且能够被精确提取和一致描述[2].由于相干成像特性,SAR图像中存在相干斑噪声,使得提取的特征点中包含较多的噪声,容易出现参与匹配的多幅SAR图像中特征点集不一致的现象,所以光学图像点特征匹配中常用的基于几何特征点(如角点、拐点、交点、质心点等)的迭代最近点(Iterative closest point,ICP)算法[3]、粒子群优化[4]等点集匹配方法在SAR图像中较少应用.2052自动化学报39卷目前,SAR图像点特征匹配中应用较多的是几何不变特征匹配方法.该类方法一般采用具有几何不变性的特征提取方法(如SIFT[5−8]、SURF[9])来提取几何不变特征点,或采用具有几何不变性的描述方法来对特征进行描述,如根据点特征之间的相互关系建立不变三角网[9−10]、通过几何哈希方法建立特征描述子[11]等,以消除几何变换对特征匹配的影响来获取点集间的匹配关系.但前者对于服从乘性噪声分布模型的SAR图像难以取得理想效果[6],而且SIFT特征提取方法也难以在异侧成像的SAR图像中寻找到稳健的同名点[5],后者需要在特征提取的基础上,利用三角网组网和直方图建立等特征编组方法来进行特征描述,过程较为复杂,对SAR图像中的斑点噪声比较敏感,容易出现同一场景的不同SAR图像中特征点集的描述结果不同的现象,影响特征匹配的准确性,导致误配、错配甚至匹配不成功的情况出现.所以稳健而普适的图像特征匹配需要采用一种SAR图像中普遍存在、且提取和描述方法都较为简单的特征.以边缘点为基础表示和描述的结构特征,既是图像中的主体信息,相同场景中两幅图像的边缘特征,又代表了共同场景中存在的物理结构,存在某种意义上的相似,所以可以通过提取包含图像结构特征的边缘点集,构建相似性准则,来实现图像匹配.基于边缘点的图像匹配,可以通过建立边缘直方图来进行直方图匹配[12],亦可利用形状描述算子来进行形状匹配[13−14],以建立特征之间的对应关系.但这些方法需在边缘特征的基础上进行复杂的特征编组等处理,同样难以保证匹配特征的一致性,导致这些方法的稳定性和适用性存在不足.为了简化特征提取与描述的过程,Keller等[15]和Yao等[16]、苏泽群等[17]、Wang等[18]基于边缘特征的隐含相似性,利用像素迁移的思想,构建了梯度均方和(Square summation gradient,SSG)相似度,实现了多传感器图像的配准.与其他特征匹配方法相比,像素迁移方法最大的优点在于获取图像特征描述子的过程大为简化,只需进行边缘特征提取即可,而且各类场景和目标图像中基本都存在边缘特征,是以具有较好的普适性.其难点在于,与其他特征匹配方法不同,该方法中待匹配的两幅图像的单对同名点之间没有明确的相似关系,单幅图像中边缘点之间也无明确的关联属性,无法建立待匹配的两幅图像中边缘点集之间的对应关系(如几何关系、统计关系、拓扑关系),同名特征匹配时不能利用特征之间的相互关系来直接进行参数解算或缩小参数搜索范围,而必须通过模型参数全局空间内的优化搜索来实现最优匹配,是以将图像匹配问题转化成了一个数学优化问题[18].而且,文献[15−18]中的方法只利用梯度和来建立相似度准则函数,没有利用更多的边缘点信息来构建匹配准则,使得模型参数解算的收敛速度非常慢,循环时间过长,循环迭代中也只利用SSG参量来进行判决,其循环迭代结束的判决条件不独立,不能对匹配结果从另一个方面进行验证,从而容易陷入局部最优而难以找到全局最优.而且,该方法中仿射变换模型的6个参数不具有明确的几何意义,使得在优化和解算过程中,无法有依据地确定优化搜索空间范围和参数取值分辨率等,导致图像匹配的优化搜索难以收敛或收敛太慢,运行效率过低,也不便于在后续处理中对匹配参数进行分析和理解.针对这些问题,本文提出了基于仿射变换参数分解模型和联合测度的SAR图像边缘特征匹配方法,来增强图像匹配的适应性,提高匹配精度和匹配效率.首先,对仿射变换模型进行参数分解,使得仿射变换的6个参数具有具体的几何意义,据此来有针对性地确定和限制参数范围;其次,利用基于模板的方向ROEWA算子提取SAR图像边缘的强度和方向信息;然后,基于像素迁移思想,建立了多源SAR图像边缘点集相似性匹配准则,以及图像匹配的联合相似度–联合特征均方和(Square summation joint feature,SSJF);最后,采用改进后的遗传算法来进行优化搜索,以快速达到全局最优.1仿射变换模型及参数分解图像之间的变换模型主要包括:刚体变换、相似变换、仿射变换、投影变换和多项式变换等.文献[19]从多视角成像模型的角度,证明仿射变换适合成像平台离场景很远且场景平坦的两幅图像之间的变换.对于遥感图像,地面相对于传感器的距离较远,当地形起伏不大时,可近似认为各同名点的对应Z轴坐标或深度的比值为常数,即近似满足仿射变换,所以可以用仿射变换模型来表示.1.1仿射变换模型仿射变换模型除了考虑两幅图像之间的平移、旋转和缩放外,还考虑了图像切变(即沿对角线的压缩)的几何变化,其变换关系可表达如下:x2=a1x1+b1y1+c1y2=a2x1+b2y1+c2(1)其中,(x1,y1)为待匹配图像坐标,(x2,y2)为参考图像像素坐标,a1,b1,c1,a2,b2,c2为模型参数.6个参数中,c1,c2分别表示图像在X轴和Y轴之间的平移,但a1,b1,a2,b2的具体几何意义不明确,在图像匹配中,无法根据具体情况确定各参数的值域范围和参数取值分辨率,为了避免出现匹配失败的情12期陈天泽等:一种高性能SAR图像边缘点特征匹配方法2053况,一般采取扩大参数值域范围的方法,从而导致搜索时间过长.1.2模型参数分解为了明确a1,b1,a2,b24个参数的几何意义,可以将仿射变换过程分解成缩放、旋转、切变、平移四个步骤[20],具体变换过程如图1所示.图示中的虚线表示变换前图形,实线表示变换后图形,前一幅图中的变换结果为后一幅图中变换的原图.图1仿射变换过程示意图Fig.1Sketch map of the affine transformation procedure若分别令水平放缩尺度、垂直放缩尺度、旋转角度、切变尺度、水平平移和垂直平移参数为s x,s y,θ,r,d x,d y,则式(1)中各参数可如式(2)表示.其中,m=r+√2−r22,n=r−√2−r22.所以式(1)中a1,b1,a2,b24个不具有具体几何意义的参数,经过分解后,可由s x,s y,θ,r这4个具有明确几何意义的参数来进行计算,亦可明确其具体的值域范围.其中水平放缩尺度、垂直放缩尺度s x,s y可根据两幅待匹配图像的分辨率的实际情况进行预估.实际的遥感图像中,水平分辨率和垂直分辨率一般相同,所以水平和垂直放缩尺度也一般相等,即s x=s y.θ的值域范围为[0,360),切变尺度r的值域范围为(0,√2).水平平移和垂直平移d x,d y的值域可根据具体情况确定.a1=s x(m cosθ+n sinθ)a2=s x(n cosθ−m sinθ)b1=s y(n cosθ+m sinθ)b2=s y(m cosθ−n sinθ)c1=d xc2=d y(2)2SAR图像边缘强度和方向特征提取由于SAR图像相干斑噪声一般服从乘性噪声模型而非加性噪声模型,所以传统的差分梯度边缘提取算法在SAR图像中难于取得理想的效果,文献[21]从理论上证明了差分梯度边缘检测算子不适于SAR图像边缘检测.目前,ROA(Ratio of aver-age)算子[22]以及ROEWA(Ratio of exponentially weighted averages)算子[23]是SAR图像中阶跃边缘检测的主要方法.其中,ROEWA算子采用的是多边缘模型,更接近于实际的SAR图像,实用性更强.而且ROEWA算子与梯度算子有很多共性,最重要的就是在边缘处取得极大值,在非边缘处取值较小且变化较小,所以可将ROEWA算子作用后的强度图像认定为梯度图像.ROEWA算子具有恒虚警特性,边缘定位准、虚假边缘少、抗断裂性好,非常适用于检测SAR图像中线状目标的边缘,但不能得到边缘方向.目前用于SAR图像边缘点方向检测的方法很多,文献[24]提出了利用Gabor滤波器计算边缘方向的方法,但整幅图像只能提取四个方向.本文采用改进的ROEWA算法,在计算边缘强度的同时,利用方向模板和二次曲线进行方向估计,得到了边缘方向,具体方法和步骤参见文献[25].该方法的边缘提取结果如图2所示.2054自动化学报39卷图2SAR图像边缘强度和方向特征提取结果Fig.2Extraction of edge strength and direction fromSAR image3基于像素迁移的SAR图像匹配一般来说,特征匹配中常用的几何特征(如点、线、形状、轮廓、骨架等)本质上是梯度较大的边缘点特征.这些梯度较大的边缘点集,可看作是涵盖了大量结构特征和少量无关因素(如孤点大噪声等)的综合.对于具有相同场景的不同图像,这些点集存在着某种意义上的相似.像素迁移,即是从一幅图像中提取部分梯度较大的边缘点构成初始点集,将其各点坐标按照变换模型变换到另一幅图像中,其对应点集即为目的点集[18],通过构建与之适应的相似性测度,然后采取合适的参数优化方法,来实现多幅图像的边缘点集匹配.3.1SAR图像匹配初始点集选择光电图像像素迁移方法中选择的梯度极值一般为道路、河岸、海岸线等线状目标的连续边缘,具有较好的稳定性.但由于电磁散射机理的原因,SAR 图像中的梯度(或强度)极值区域可能包含了部分具有强散射结构、大介电常数材质或粗糙表面的物体(如建筑物、电线杆、金属目标等)对应的强散射图像,这些强散射区域在SAR图像中表现为高亮度和高强度,其边界会掩盖场景中真正的边缘特征,导致边缘不连续,而且会随着SAR图像成像参数的改变而变化,不是边缘特征匹配中所需要的稳定结构特征.所以本文在选取初始边缘点集时,在ROEWA 算子边缘强度特征提取的基础上,选择灰度和边缘强度靠前的连续边缘特征,剔除亮度较高且边缘强度较大的边缘点,如此虽然会去掉一部分强边缘特征,但提高了选取的结构特征的稳定性,可以满足图像匹配的需要.3.2基于像素迁移的相似性匹配准则一般而言,图像匹配可以归结为一个对应关系求解的过程.从匹配准则的角度来说,其数学模型可以描述为[16]minf,T(J)=k[I1(x(k))−f(I2(T(x(k))))]2(3)其中,T为变换模型,I1,I2是图像信息,x(k)代表坐标点集,f表示对图像信息的某种映射,J为准则函数.根据I1,I2中的相互关系确定相似测度,即可获取I1,I2中的对应关系.但基于像素迁移的图像匹配方法中准则函数构造和参数解算与上述方法不同.在准则函数构建中,由于同一区域不同图像的相似特征隐含在梯度最大的点集当中,所以以隐含相似结构特征的梯度最大点集为初始点集,通过坐标变换转换到另一幅图像的目的点集,当不同变换模型中目的点集的梯度值最大时,则该次转换最为有效.因此像素迁移匹配方法中的相似性准则为几何变换后目的点集的SSG 最大,其数学模型为maxT(J)=S2∈I2|I1(T(S2))|2(4)其中,I1,I2表示梯度模值图,S2为I2中最大梯度点集.由于每次迁移对应一个SSG值和一组变换模型参数,因此变换模型可以通过对相似度的迭代优化方法来获得,即当SSG取得最大值时,相似度最大,其对应的变换模型参数即为所求的匹配解.但上述方法在构建相似度时只考虑了边缘的梯度特征.实际上,图像边缘点的方向是边缘点的梯度方向,图像中直线结构特征的边缘点方向相同,是以边缘点方向特征同样也能描述场景结构,图像边缘方向提取实验(如图2(c)所示)证明了这一结论.全局匹配中,两幅待匹配图像中不同同名特征点的方向差应该为一个常数,即两幅图像之间的旋转角度.所以,将一幅图像中边缘点集通过空间变换迁移到另一幅图像的边缘点集中,每次迁移亦对应一组变12期陈天泽等:一种高性能SAR 图像边缘点特征匹配方法2055换参数和一个方向差分均方和(Square summationdifference direction,SSDD)值.当两个边缘点集中对应边缘点的方向差最接近于旋转角度时,两个点集最相似,SSDD 取得最小.该次迁移最为有效,对应的参数即为所求匹配解,根据式(3),则其数学模型为min T(J )=k[D (x 1(k ))−D (x 2(k ))−θ]2(5)其中,D (x 1(k ))和D (x 2(k ))为x 1(k )和x 2(k )的方向值,θ为待匹配的两幅图像之间的旋转角度.所以,为了提高图像匹配中模型参数解算的精度,可以增加隐含特征点集方向关系的约束条件.当两幅图像精确匹配时,应该满足SSG 最大且SSDD 最小(理论上,当图像方向特征提取完全精确时,SSDD 为0),综合两者考虑,将两幅图像的隐含特征点集的SSDD 与SSG 测度进行综合,建立基于联合特征均方和(SSJF)的联合相似测度.3.3联合相似度构建参照文献[16]的方法,我们首先构建了SSG 和SSDD 两个独立相似度:F 1(S 1(P ))=(x i ,y i )∈S 1(P )|I 1(x i ,y i )|2(6)F 2(S 1(P ))=(x i ,y i )∈S 1(P )|∆D (x i ,y i )|2(7)∆D (x i ,y i )=D 1(x i ,y i )−D 2(x i ,y i )−θ(8)其中,设I 1,I 2,D 1,D 2分别为两幅图像的边缘强度图和方向图,P 是模型变换的参数矢量,本文中采用仿射变换模型,θ为两幅匹配图像之间的旋转角度.S 2为图像I 2中强度值在所有强度中靠前的坐标点集,S 1(P )为S 2进行P 变换后迁移到图像I 1中的点集.在参数解算的循环迭代过程中,希望SSG 单调递增,SSDD 单调递减,即当两幅图像精确匹配时,应该满足SSG 最大、SSDD 最小.据此本文定义了基于SSG 和SSDD 的联合测度SSJF:F (S 1(P ))=|αF 1(S 1(P ))−(1−α)F 2(S 1(P ))|(9)其中,α为SSG 测度在联合测度中的权重,其值依据SSG 和SSDD 两个独立测度在联合测度中的相对作用确定.由于像素迁移匹配方法是通过优化解算方法求取SSJF 在图像I 1中的极值,所以α的取值不会影响测度最终的收敛方向和参数解算的精度,但会影响参数解算优化搜索的速度.联合测度中,收敛速度越快的独立测度,其权重应该越大.文中的两个独立测度,各自的收敛速度取决于图像重叠区域中梯度图和方向图的结构性的强弱程度.结构性越强,收敛速度越快.常规场景的图像中,一般较少有显著的直线边缘特征,但大多会有不规则形状的曲线边缘特征,组成这些曲线的边缘点一般具有近似相等的梯度,但其方向变化较大,梯度图的结构性一般强于方向图的结构性,所以在一般情况下,SSG 测度的权重要大于SSDD 测度的权重.此外,在实际应用中,SAR 图像边缘点强度的值域范围与边缘点方向差的值域范围不相等,所以还需要进行规格化,即将两者的值域归化到同一范围.将式(6)和式(7)代入式(9),则:F 1(S 1(P ))=(x i ,y i )∈S 1(P )α|I 1(x i ,y i ) 2−(1−α)|∆D (x i ,y i ) 2(10)每次迁移对应一组变换参数和一个SSJF 值.因此,联合测度值最大时,其相似度也为最大,该次迁移最为有效,对应的参数即为所求匹配解.其数学模型可以写为max P(J )=F (S 1(P ))(11)联合测度的建立,提供了边缘点梯度特征和方向特征两个方面的约束,在极值求解的优化解算中,通过两个独立测度的相互印证,可避免单一测度时陷入搜索空间某一局部范围“陷阱”的情况,加快联合测度的优化迭代效率,并可通过设置边缘点方向误差的阈值来计算相应的SSDD 阈值,作为循环迭代结束的判读依据.4准则函数的优化求解4.1优化解算分析准则函数(11)的优化搜索实质是一个多元函数的优化问题,对于图像匹配来说,该优化问题的数学结构十分清楚,但维数高、空间大、多极值、环境复杂.待求的SSJF 随P 的变化而变得非常复杂,并且存在大量密集局部极值点,因此容易陷入局部最优,对求取全局最优也将非常困难,依靠传统优化算法(包括Powell 、牛顿法、粒子群优化(Particle swarm optimization,PSO)等[15])难以求解.遗传算法(Genetic algorithms,GA)是一种借鉴生物界自然选择和进化机制发展起来的高度并行、随机、自适应搜索算法[26],本文利用遗传算法空间全局搜索能力较强的特点,直接以SSJF 作为个体的适应值,在可行解空间中搜寻最适应个体,也即全局最优解.2056自动化学报39卷4.2遗传算法优化寻优方法的改进现有的遗传算法中,各参数范围以及对应染色体的长度一直保持不变,即各参数的分辨率和可选个数一直不变.这样虽然保证能取得正确匹配解,但在整个循环迭代过程中,收敛速度较慢,而且在设置各参数对应染色体的长度时,为了取得优化效率和解算精度的折中,难以设置范围和高分辨率的染色体长度,使得优化解算难以取得高精度的结果.根据遗传算法优化解算的基本原理分析可知:在循环优化的初始阶段,主要目的是快速稳定地搜寻到匹配解算的初始值,所以需要参数范围大,但取值分辨率可稍低,而且该阶段SSJF极值较小,容易找到最新的SSJF极值,收敛速度较快;在循环优化的后期,主要目的是确定匹配解算的精确值,所以需要取值分辨率较高,但参数范围可压缩,而且该阶段SSJF极值相对较大,难以较快找到新的极值,收敛速度较慢.所以,本文在收敛迭代过程中,基于优化解算逐渐精确的各参数的解,逐步压缩各参数范围来提高收敛速度,同时逐步扩展各参数的染色体长度和种群大小,提高匹配定位的精度.为了保证正确匹配值在修正后的参数范围内,以优化解算的各参数值为中心,重新计算参数范围.对于长度增加的各参数染色体值,为了不改变该次循环中各参数染色体的值,根据格雷码编码规则,对各参数染色体增加的长度以补0方式处理.基于改进的GA的SSJF极值求解步骤如下:步骤1.提取待匹配图像I2中边缘强度值在所有强度中梯度较大的坐标点集,作为每次迁移的原象.步骤2.确定模型变换参数矢量P、设置控制参数(交换率P c、突变率P m、种群大小N s),构建适应度函数,按预定规模进行种群初始化.步骤3.遗传算法优化迭代.a)依适应值最优策略进行后代选择;b)按参数模型变换到I1强度图和方向图中,计算SSDD、SSG和SSJF以及适应值;c)寻找渐优的SSJF极值,否则返回a);d)修正各参数的取值范围和染色体长度以及相应增加的种群大小;e)SSDD小于阈值或者达到最大迭代次数,结束循环,否则返回a).5性能分析图像匹配方法的性能主要包括精度、效率和稳健性三个方面.5.1匹配精度由图像之间的变换模型可知,理论上,基于几何变换的图像匹配精度由变换参数的取值精度和待匹配图像图幅大小决定,参数取值精度由参数取值分辨率衡量.本文方法中,计算量许可的条件下,参数s x,s y, r的取值分辨率可达10−2数量级,参数d x,d y,θ的取值分辨率可达10−1数量级,则sinθ、cosθ的取值分辨率精度可达10−3数量级,所以仿射变换模型系数a1,b1,a2,b2的取值精度的数量级可达10−2×10−1×10−3,即10−6,c1,c2可达10−1.设图像尺寸的数量级为10x,则最终匹配精度数量级为max(10x−6,10−1).SSG方法中,计算量相等(即6个参数染色体总长度相等)的条件下,参数a1,b1的取值精度的数量级可达10−3,c1,c2的取值精度数量级仍为10−1,所以最终精度数量级为max(10x−3,10−1).遥感图像的图幅尺寸一般为103到104数量级,则本文方法匹配精度可达10−1数量级,SSG方法匹配精度为100到101数量级.由此可以看出,在遥感图像匹配中,本文方法的匹配精度比SSG方法的匹配精度可高出1至2个数量级.而且,要想进一步提高匹配精度,本文方法只需提高d x,d y即c1,c2的取值精度即可,但SSG方法还需提高a1,b1,a2,b2的取值精度,如此则计算量会大大增加.5.2解算效率利用本文方法的关键在于参数空间范围内找到SSJF的最优,所以匹配效率主要取决于参数循环的计算量,而计算量由运行代数和每代循环的计算量共同决定.利用本文方法可以大大减少计算量,较好地提高搜索效率.首先,SSG方法中,因为大部分参数不具有具体的几何意义,实际匹配中无法确定相对精确的参数范围,所以参数的值域范围无法确定,为了确保匹配成功,只得扩大值域范围,使得遗传算法中的染色体长度增加,种群大小变大,运行代数也需相应增加,所以增加了计算量.本文方法中的各参数具有具体的几何意义,各参数的初始范围可以根据实际情况较好地确定,能大大减少运行代数和每次循环的计算量.其次,原来方法中的6个参数是直接得到的,而本文的参数需要经过进一步的乘法运算后才能得到仿射变换参数,所以为了得到相同的参数取值精度,本文方法中染色体长度大大减小,可大大减少计算量.此外,SSG方法中,只利用SSG特征来进行相似性评估,没有其他条件进行约束,所以需要大量的匹配点才能保证不出现错匹配情况.本文方法利用联合测度来进行相似性计算,可以从边缘。

特征匹配原理

特征匹配原理

特征匹配原理是指通过比较图像或物体的特征点,找出它们之间的对应关系。

特征点是图像或物体中具有唯一性和稳定性的点,可以通过角点检测、边缘检测等方法来提取。

常用的特征点包括SIFT、SURF、ORB等。

特征匹配的原理包括以下几个步骤:

1. 特征点提取:通过特征点提取算法,在待匹配的图像或物体中提取出一些具有唯一性和稳定性的特征点。

2. 特征描述:对于每个特征点,计算其周围区域的特征描述符。

这些描述符具有一定的独特性,能够区分不同的特征点。

3. 特征匹配:将待匹配的图像或物体的特征点与参考图像或物体的特征点进行匹配。

通过比较特征描述符的相似度,找出最佳的匹配对应。

4. 匹配筛选:根据匹配的相似度,通过一定的阈值筛选匹配对应关系。

一般来说,相似度越高的匹配对应关系越可靠。

特征匹配的原理主要基于以下假设:

1. 特征点的提取和描述是可靠的,能够准确地提取出具有唯一性和稳定性的特征点。

2. 特征点的匹配是可靠的,通过比较特征点的相似度,能够找到最佳的匹配对应关系。

3. 特征匹配结果能够准确地表达图像或物体的几何变换关系,例如平移、旋转、缩放等。

特征匹配在计算机视觉和图像处理领域有广泛的应用,例如目标检测、图像配准、三维重建等。

ORB特征点检测匹配算法

ORB特征点检测匹配算法ORB(Oriented FAST and Rotated BRIEF)是一种基于特征点的检测和描述算法,它结合了FAST角点检测器和BRIEF描述子生成器的优点,具有快速、高效和鲁棒性等优点。

ORB特征点检测匹配算法在计算机视觉领域得到了广泛应用,可以用于图像配准、物体识别、SLAM等各种应用场景中。

1.检测算法ORB特征点的检测算法主要由两个部分组成:FAST角点检测器和Harris角点响应检测器。

FAST角点检测器是一种高效的角点检测算法,可以用来寻找图像中的角点。

Harris角点响应检测器则是一种基于灰度梯度的角点检测算法,可以用来确定角点的强度和位置。

在ORB特征点检测算法中,首先使用FAST角点检测器对图像进行角点检测,然后在检测到的角点周围使用Harris角点响应检测器来确定最终的特征点位置。

通过这种组合方式,可以同时实现高效和鲁棒的角点检测,提高特征点检测的准确性和稳定性。

2.描述算法ORB特征点的描述算法主要由两个部分组成:BRIEF特征描述子生成器和ORB特征描述子。

BRIEF是一种二进制描述子生成算法,可以将每个特征点周围的像素值转换为一个二进制串。

ORB特征描述子是在BRIEF基础上进行改进的一种特征描述子,可以提高描述子的稳定性和鲁棒性。

在ORB特征点描述算法中,首先使用BRIEF特征描述子生成器对检测到的特征点进行二进制描述,然后通过ORB特征描述子将二进制描述子进行优化和加权,提高描述子的区分度和准确性。

通过这种方式,可以快速生成高质量的特征描述子,用于后续的特征匹配和识别过程。

3.匹配算法ORB特征点匹配算法主要通过计算两幅图像中的特征点之间的相似性来进行匹配。

在匹配过程中,通常采用汉明距离或欧氏距离等指标来度量特征点之间的相似性,找到最匹配的特征点对。

通过匹配算法,可以实现图像的配准、物体的识别和SLAM等应用。

总的来说,ORB特征点检测匹配算法是一种高效、鲁棒的特征点检测和描述算法,具有快速计算速度、高准确性和广泛应用等优点,适用于各种计算机视觉应用领域。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第12卷 第4期2007年4月中国图象图形学报Journal of I m age and GraphicsVol .12,No .4Ap r .,2007基金项目:国家自然科学基金项目(60473117)收稿日期:2005209207;改回日期:2006201218第一作者简介:邓宝松(1978~ ),男。

2001年获国防科技大学工学学士学位,现为国防科技大学多媒体研究开发中心博士研究生。

主要研究方向为计算机视觉、虚拟现实及可视化。

E 2mail:dbs310@基于仿射迭代模型的特征点匹配算法邓宝松宋汉辰杨 冰吴玲达(国防科学技术大学多媒体研究开发中心,长沙 410073)摘 要 图像序列中的特征点匹配是计算机视觉中的一个基本问题,也是目标识别、图像检索以及3维重建等问题的基础。

为了提高图像匹配的精度,提出了一种针对两幅图像的高精度特征点自动匹配算法。

该算法首先分析并提出两幅图像中相应特征点的邻域窗口之间的单应映射可以用仿射变换模型来近似;然后通过快速的基于仿射变换模型的迭代优化方法,不仅估计并矫正了相应邻域窗口之间的透视畸变,同时还补偿了在特征点检测阶段对相应特征点的定位误差,从而使匹配结果达到子像素级精度;最后通过真实图像的实验以及与现有算法的比较结果表明,该算法不仅得到了更多的匹配关系,还提高了特征点匹配的精度。

关键词 特征点匹配 单应映射 仿射变换 定位误差补偿 对极几何中图法分类号:TP391.41 文献标识码:A 文章编号:100628961(2007)0420678206Fea ture Po i n t M a tch i n g Ba sed on Aff i n e Itera ti ve M odelDENG Bao 2s ong,S ONG Han 2chen,Y ANG B ing,WU L ing 2da(M ulti m edia R esearch &D evelop m ent Center ,N ational U niversity of D efense Technology,Changsha 410073)Abstract Feature point matching is a key p r oble m of computer visi on and is frequently used in object recogniti on,i m age retrieval and 3D reconstructi on and s o on .I n this paper,an accurate feature points matching method f or t w o 2fra me i m ages was p r oposed .Since it was p r oved that the homography bet w een t w o windows of corres ponding feature can be geometrically app r oxi m ated by an affine transf or mati on model .The p r ojective dist orti on of windows of corres ponding feature was esti m ated and rectified by a fast iterative sche me based on the affine transf or mati on model .A t the sa me ti m e,the l ocati on err or of corres ponding feature points p r oduced at the feature detecti on stage was compensated using the esti m ated affine para meters .The matching results of corres ponding feature points can achieve sub 2p ixel p recisi on,which effectively i m p r ove the p recisi ons of the final ep i polar geometry .Experi m ental results of real i m ages and the comparis ons with other methods str ongly de monstrate the validity and accuracy of the algorith m.Keywords feature point matching,homography,affine transf or mati on,l ocati on err or compensati on,ep i polar geometry1 引 言众所周知,特征点匹配是计算机视觉中的经典问题,其在自动导航、目标识别、3维重建以及图像数据库检索等许多领域都有着重要的研究和应用价值。

然而目前这一问题并没有被很好地解决,其主要原因包括成像过程中发生的透视畸变、亮度变化以及场景的相互遮挡等[1,2],这些因素都给特征点的匹配带了一定的困难。

现有匹配算法大部分是基于图像亮度相关性的[2~4],其前提是假设同一场景点在不同图像上所成的像点是相似的,且与其邻域内的场景点所成像点的相对位置保持不变,然而这些性质在透视成像过程中并不能得到很好地保持。

由于图像间存在较大的透视畸变,这类直接匹配方法很难自动矫正相应特征点邻域窗口(以下称邻域窗口)的局部形状,再加上两组待匹配特征点集之间真正可用的不变量第4期邓宝松等:基于仿射迭代模型的特征点匹配算法679 很少,因此匹配结果并不尽人意。

后来的研究方法其主要思想是先对相应邻域窗口之间的几何变换进行建模,然后通过求解模型参数来进行两个邻域窗口的畸变矫正。

最初矫正使用的是相似变换模型,包括旋转[5]和比例放缩[6~8];后来扩展为仿射变换模型[2,9~11],显然,仿射变换包含相似变换,它是相应邻域窗口之间透视畸变的一个很好近似,这一点在本文第2节中还会详细描述。

然而,这些基于仿射变换模型的方法大多侧重于仿射不变性特征的提取和表示,而没有针对提高匹配结果的精度。

此外,由于像素的量化误差以及特征点检测算法本身的弊端,致使相应特征点的定位误差较大,不能满足高精度应用的需要。

本文首先利用Harris算法[12]分别在两幅图像中检测得到两组特征点集,然后通过区域搜索和迭代优化来自动估计并矫正相应邻域窗口间的透视畸变,同时补偿检测阶段相应特征点间的定位误差,使得匹配精度真正达到子像素级,从而大大提高了对极几何关系的估计精度。

真实图像的实验结果以及与已有算法的比较验证了本文算法的正确性和高精度。

2 图像几何变换模型如果将光滑场景表面上以点P为中心的局部邻域面片G近似认为是平面的话,其在两幅图像上所成的像之间满足2维平面上的单应映射(用3×3单应矩阵H表示),该变换将第1幅图像I上的一个圆形窗口变换到第2幅图像I^上的椭圆形窗口(如图1所示)。

H由摄像机的内外参数和平面方程唯一确定,由H就可以实现相应邻域窗口之间的透视矫正。

设第1幅图像上特征点p的邻域窗口内某一图像点的坐标为p=(x,y)T(以p为原点),其对应点在第2幅图像上的坐标为^p=(^x,^y)T(以^p为原点),则二者之间的映射关系可以表示为^x ^y 1~Hxy1=A0v T1xy1(1)其中,~表示齐次向量之间的相等;A为2×2矩阵,表征邻域窗口之间的仿射变换;而v=(v1,v2)T是2维向量,表征透视形变的大小。

在实际应用中,由于v1和v2非常小,可以被忽略,而直接用仿射变换模图1 光滑场景表面面片在两幅图像上所成像之间的几何变换模型Fig.1 The homography bet w een corres ponding feature windows of the s mooth patch on scene surface型来近似表示这种映射关系[9,13],即^p=A p。

如引言中所介绍,在第2幅图像I^上检测出的特征点^p并非与点p精确对应,二者之间存在着一定的偏移。

现有的很多直接匹配算法中都忽略了这一偏移向量t,而直接将检测得到的特征点作为匹配结果的坐标,这在实际中是不合适的,而且有时甚至会导致较大的误差。

考虑这种因素的影响,相应邻域窗口之间的映射关系可以进一步修正为^p=A p+t(2) 3 特征点匹配特征点匹配的目的就是在两组待匹配特征点集中分别找到一个子集,使得两个子集之间存在一一映射,即映射两端都对应着同一场景空间点,而其依据就是二者及其邻域在亮度上的相似性。

有很多的准则用来衡量两个邻域窗口的相关程度,常用的有规范化交叉相关系数(nor malized cr oss correlati on, NCC)[4]和亮度差值的平方和(sum of squared difference,SS D)[14],而这两个度量准则在一定程度上也是一致的。

本文采用首先最小化两个邻域窗口中对应像素亮度差值的平方和,然后再用规范化交叉相关系数判断两个窗口相似程度的方法,即对两幅图像上的每一对相应特征点及其邻域窗口,找到合适的仿射变换参数,使得下式最小。

εm in=m inA,tκp∈W I(p)-I^(A p+t)2d p(3)680 中国图象图形学报第12卷其中,W 表示第1幅图像上的邻域窗口,I (p )表示图像点p 处的亮度值。

如果能找到最优的仿射变换参数A best 和t best,使得式(3)达到最小,且此时两邻域窗口的规范化交叉相关系数大于给定阈值δmax ,则认为两个特征点是匹配的,否则认为其不是由同一场景点投影所形成。

3.1 仿射迭代算法本文采用迭代方法来最小化式(3),即首先将其在初始参数A =E 2×2和t =0处进行一阶泰勒展开,即在式(5)中未知参数为a,进一步整理可得到[I (p )-I ^(p )]+xI x +yI y≈F (p )T a (6)其中,F (p )T=[xI x ,yI x ,xI y ,yI y ,I x ,I y ],将式(6)两边同乘以F (p ),并将两个窗口内的像素值进行加权即可以得到H a =h (7) 上式中h =κω(p )F (p )(I (p )+x I x +y I y )d p,H =κω(p )F (p )F (p )Td p ,其中ω(p )表示窗口内像素的权重函数,由于可以通过该函数增大窗口中心像素的重要性,因此合适的ω(p )能够大大加快算法的收敛速度。