分块核偏最小二乘法

偏最小二乘法

偏最小二乘法 ( PLS)是光谱多元定量校正最常用的一种方法 , 已被广泛应用 于近红外 、 红外 、拉曼 、核磁和质谱等波谱定量模型的建立 , 几乎成为光谱分析中建立线性定量校正模型的通用方法 〔1, 2〕 。

近年来 , 随着 PLS 方法在光谱分析尤其是分子光谱如近红外 、 红外和拉曼中应用 的深入开展 , PLS 方法还被用来解决模式识别 、定量校正模型适用性判断以及异常样本检测等定性分析问题 。

由于 PLS 方法同时从光谱阵和浓度阵中提取载荷和得分 , 克服主成分分析 ( PCA)方法没有利用浓度阵的缺点 , 可有效降维 , 并消除光谱间可能存在的复共线关系 , 因此取得令人非常满意的定性分析结果 〔3 ~ 5〕 。

本文主要介绍PLS 方法在光谱定性分析方面的原理及应用 实例 。

偏最小二乘方法(PLS-Partial Least Squares))是近年来发展起来的一种新的多元统计分析法, 现已成功地应用于分析化学, 如紫外光谱、气相色谱和电分析化学等等。

该种方法,在化合物结构-活性/性质相关性研究中是一种非常有用的手段。

如美国Tripos 公司用于化合物三维构效关系研究的CoMFA (Comparative Molecular Field Analysis)方法, 其中,数据统计处理部分主要是PLS 。

在PLS 方法中用的是替潜变量,其数学基础是主成分分析。

替潜变量的个数一般少于原自变量的个数,所以PLS 特别适用于自变量的个数多于试样个数的情况。

在此种情况下,亦可运用主成分回归方法,但不能够运用一般的多元回归分析,因为一般多元回归分析要求试样的个数必须多于自变量的个数。

§§ 6.3.1 基本原理6.3 偏最小二乘(PLS )为了叙述上的方便,我们首先引进“因子”的概念。

一个因子为原来变量的线性组合,所以矩阵的某一主成分即为一因子,而某矩阵的诸主成分是彼此相互正交的,但因子不一定,因为一因子可由某一成分经坐标旋转而得。

偏最小二乘法基本知识

---------------------------------------------------------------最新资料推荐------------------------------------------------------偏最小二乘法基本知识偏最小二乘法(PLS)简介-数理统计偏最小二乘法 partial least square method 是一种新型的多元统计数据分析方法,它于1983年由伍德(S.Wold)和阿巴诺(C.Albano)等人首次提出。

近几十年来,它在理论、方法和应用方面都得到了迅速的发展。

偏最小二乘法长期以来,模型式的方法和认识性的方法之间的界限分得十分清楚。

而偏最小二乘法则把它们有机的结合起来了,在一个算法下,可以同时实现回归建模(多元线性回归)、数据结构简化(主成分分析)以及两组变量之间的相关性分析(典型相关分析)。

这是多元统计数据分析中的一个飞跃。

偏最小二乘法在统计应用中的重要性体现在以下几个方面:偏最小二乘法是一种多因变量对多自变量的回归建模方法。

偏最小二乘法可以较好的解决许多以往用普通多元回归无法解决的问题。

偏最小二乘法之所以被称为第二代回归方法,还由于它可以实现多种数据分析方法的综合应用。

主成分回归的主要目的是要提取隐藏在矩阵 X 中的相关信息,然后用于预测变量 Y 的值。

这种做法可以保证让我们只使用那些独立变量,噪音将被消除,从而达到改善预测模型质量的目的。

1 / 9但是,主成分回归仍然有一定的缺陷,当一些有用变量的相关性很小时,我们在选取主成分时就很容易把它们漏掉,使得最终的预测模型可靠性下降,如果我们对每一个成分进行挑选,那样又太困难了。

偏最小二乘回归可以解决这个问题。

它采用对变量 X 和 Y 都进行分解的方法,从变量 X 和 Y中同时提取成分(通常称为因子),再将因子按照它们之间的相关性从大到小排列。

现在,我们要建立一个模型,我们只要决定选择几个因子参与建模就可以了基本概念偏最小二乘回归是对多元线性回归模型的一种扩展,在其最简单的形式中,只用一个线性模型来描述独立变量 Y 与预测变量组 X 之间的关系: Y= b0 + b1X1 + b2X2 + ... + bpXp 在方程中, b0 是截距, bi 的值是数据点 1 到 p 的回归系数。

正交偏最小二乘法

正交偏最小二乘法正交偏最小二乘法(Orthogonal Partial Least Squares, OPLS)是一种常用的多元统计分析方法,广泛应用于数据建模、特征选择、变量筛选等领域。

本文将介绍正交偏最小二乘法的原理、应用和优势,以及其在实际问题中的应用案例。

正交偏最小二乘法是基于偏最小二乘法(Partial Least Squares, PLS)的改进方法。

偏最小二乘法是一种回归分析的方法,通过将自变量和因变量进行线性组合,建立回归模型。

但是在应用过程中,偏最小二乘法可能存在多个潜在的自变量对应一个因变量的情况,这就导致了模型的不稳定性和可解释性差。

正交偏最小二乘法通过引入正交化的步骤,解决了偏最小二乘法的不足。

其基本思想是,在建立回归模型的过程中,除了考虑与因变量相关的部分(预测分量),还引入与因变量不相关的部分(正交分量),从而提高模型的解释能力和稳定性。

通过正交化的操作,正交偏最小二乘法能够将数据进行更好的降维,去除噪声和冗余信息,提取出对预测结果有用的信息。

正交偏最小二乘法在实际问题中具有广泛的应用。

例如,在药物研发领域,研究人员可以利用正交偏最小二乘法对大量的分子结构和活性数据进行建模和预测,快速筛选出具有潜在药效的化合物。

在工业过程控制中,正交偏最小二乘法可以用于建立传感器数据与产品质量之间的关系,实现对产品质量的在线监测和控制。

此外,正交偏最小二乘法还可以应用于生物信息学、化学分析、图像处理等领域。

与其他方法相比,正交偏最小二乘法具有以下优势。

首先,正交偏最小二乘法能够解决多重共线性问题,降低模型的复杂度,提高模型的解释能力。

其次,正交偏最小二乘法能够处理高维数据,提取出对预测结果有用的特征,减少冗余信息的干扰。

此外,正交偏最小二乘法还可以进行特征选择,帮助研究人员挖掘出对预测结果具有重要影响的变量。

下面以一个实际应用案例来说明正交偏最小二乘法的应用。

假设我们需要建立一个模型来预测商品的销售量。

_最小二乘法

,

• 线性模型 y = X θ + e 线性模型: 式中: 维输出向量; 维噪声向量; 式中: y 为n维输出向量;e 为n维噪声向量;θ 为m 维输出向量 维噪声向量 维参数向量; 维测量矩阵。 维参数向量;X 为 n × m 维测量矩阵。

足够大,当 只要 α 足够大 当 k > m 后,初值 P (0)、 0) 初值 θ ( 对估计的影响可以忽略. 对估计的影响可以忽略

LS法和 法和RLS法的比较 法和 法的比较

• • • LS法是一次完成算法,适于离线辩识,要记忆全部测 法是一次完成算法,适于离线辩识, 法是一次完成算法 量数据; 量数据; RLS法是递推算法,适于在线辩识和时变过程,只需 法是递推算法, 法是递推算法 适于在线辩识和时变过程, 要记忆n+1步数据; 步数据; 要记忆 步数据 RLS 法用粗糙初值时,如若 N 较小时,估计精度不 法用粗糙初值时, 较小时, 如 LS 法。

以上三式构成一组递推最小二乘估计算式 ^ ^ • 物理意义:新的参数估计 θ N +1是对上次老的估计 θ N 进行 物理意义: 修正而得出的。 修正而得出的。

初值选取方式

• 初值选取一般有两种方法可以考虑 初值选取一般有两种方法可以考虑: 1、先取一批数据,求取 θ ( N ) , P(N)做初值 、先取一批数据 求取 做初值,N>m 做初值

最小二乘有限元方法

最小二乘有限元方法嘿,朋友们!今天咱来聊聊这个最小二乘有限元方法。

你说这玩意儿像不像一个超级厉害的魔法工具呀!咱先说说有限元方法,这就好比是给一个复杂的大问题分块,把它切成一小块一小块的,然后再分别去处理,就像咱切蛋糕一样。

这样一来,原本很难搞的大难题就变得容易多啦。

那最小二乘呢,就像是给这些分块处理加上了一个精准的标准。

就好像射箭,咱得瞄得特别准才能射中靶心呀!它能让我们的计算结果更精确,更可靠。

想象一下,我们在面对一个超级复杂的工程问题,或者是一个让人头疼的科学难题时,最小二乘有限元方法就像一位超级英雄挺身而出。

它能够把那些乱成一团的信息整理得井井有条,给我们指明方向。

你看啊,在很多领域,比如机械制造呀,建筑设计呀,甚至是航空航天,都少不了它的身影呢!它就像是幕后的大功臣,默默地为这些伟大的事业贡献着自己的力量。

咱平常生活中也能感受到它的厉害之处呢。

比如说,你家房子的稳固性,说不定就有它的功劳。

它在背后悄悄地计算着各种力量的平衡,确保房子稳稳地立在那里。

而且哦,最小二乘有限元方法还在不断发展和进步呢!就像我们人一样,不断学习,不断成长。

它变得越来越强大,能解决的问题也越来越多。

这可不是我在这儿瞎吹呀,你去问问那些搞科研的、搞工程的,谁不知道它的厉害。

它真的是我们解决复杂问题的得力助手呀!说真的,要是没有最小二乘有限元方法,那我们好多事情可都不好办啦!它就像是我们前进道路上的一盏明灯,照亮我们走向成功的路。

怎么样,现在是不是对最小二乘有限元方法有了更深的认识啦?它可不是什么遥不可及的高深玩意儿,而是实实在在为我们服务的好东西呀!所以呀,可别小看了它哟!让我们一起为这个厉害的方法点个赞吧!。

系统辨识最小二乘法大作业 (2)

系统辨识大作业最小二乘法及其相关估值方法应用学院:自动化学院学号:姓名:日期:基于最小二乘法的多种系统辨识方法研究一、实验原理1.最小二乘法在系统辨识中用得最广泛的估计方法是最小二乘法(LS)。

设单输入-单输出线性定长系统的差分方程为(5.1.1)式中:为随机干扰;为理论上的输出值。

只有通过观测才能得到,在观测过程中往往附加有随机干扰。

的观测值可表示为(5.1.2)式中:为随机干扰。

由式(5.1.2)得(5.1.3)将式(5.1.3)带入式(5.1.1)得(5.1.4)我们可能不知道的统计特性,在这种情况下,往往把看做均值为0的白噪声。

设(5.1.5)则式(5.1.4)可写成(5.1.6)在观测时也有测量误差,系统内部也可能有噪声,应当考虑它们的影响。

因此假定不仅包含了的测量误差,而且包含了的测量误差和系统内部噪声。

假定是不相关随机序列(实际上是相关随机序列)。

现分别测出个随机输入值,则可写成个方程,即上述个方程可写成向量-矩阵形式(5.1.7) 设则式(5.1.7)可写为(5.1.8)式中:为维输出向量;为维噪声向量;为维参数向量;为测量矩阵。

因此式(5.1.8)是一个含有个未知参数,由个方程组成的联立方程组。

如果,方程数少于未知数数目,则方程组的解是不定的,不能唯一地确定参数向量。

如果,方程组正好与未知数数目相等,当噪声时,就能准确地解出(5.1.9)如果噪声,则(5.1.10)从上式可以看出噪声对参数估计是有影响的,为了尽量较小噪声对估值的影响。

在给定输出向量和测量矩阵的条件下求系统参数的估值,这就是系统辨识问题。

可用最小二乘法来求的估值,以下讨论最小二乘法估计。

2.最小二乘法估计算法设表示的最优估值,表示的最优估值,则有(5.1.11)写出式(5.1.11)的某一行,则有(5.1.12) 设表示与之差,即-(5.1.13)式中成为残差。

把分别代入式(5.1.13)可得残差。

设则有(5.1.14) 最小二乘估计要求残差的平方和为最小,即按照指数函数(5.1.15) 为最小来确定估值。

最小二乘方法

最小二乘方法:原理、应用与实现一、引言最小二乘方法是数学优化中的一种重要技术,广泛应用于各种实际问题中。

它的基本原理是通过最小化误差的平方和来估计未知参数,从而实现数据拟合、线性回归等目标。

本文将对最小二乘方法的原理、应用与实现进行详细介绍,并探讨其在实际问题中的应用。

二、最小二乘方法的原理最小二乘方法的基本原理可以概括为:对于一组观测数据,通过最小化误差的平方和来估计未知参数。

具体而言,设我们有一组观测数据{(xi, yi)},其中xi是自变量,yi是因变量。

我们希望找到一个函数f(x),使得f(xi)与yi之间的差距尽可能小。

为了量化这种差距,我们采用误差的平方和作为目标函数,即:J = Σ(f(xi) - yi)²我们的目标是找到一组参数,使得J达到最小值。

这样的问题称为最小二乘问题。

在实际应用中,我们通常采用线性函数作为拟合函数,即:f(x) = a + bx其中a和b是待估计的参数。

此时,最小二乘问题转化为求解a 和b的问题。

通过求解目标函数J关于a和b的偏导数,并令其为零,我们可以得到a和b的最优解。

这种方法称为最小二乘法。

三、最小二乘方法的应用数据拟合:最小二乘方法在数据拟合中有广泛应用。

例如,在物理实验中,我们经常需要通过一组观测数据来估计某个物理量的值。

通过采用最小二乘方法,我们可以找到一条最佳拟合曲线,从而得到物理量的估计值。

这种方法在化学、生物学、医学等领域也有广泛应用。

线性回归:线性回归是一种用于预测因变量与自变量之间关系的统计方法。

在回归分析中,我们经常需要估计回归系数,即因变量与自变量之间的相关程度。

通过采用最小二乘方法,我们可以得到回归系数的最优估计值,从而建立回归方程。

这种方法在经济学、金融学、社会科学等领域有广泛应用。

图像处理:在图像处理中,最小二乘方法常用于图像恢复、图像去噪等问题。

例如,对于一幅受到噪声污染的图像,我们可以采用最小二乘方法对图像进行恢复,从而得到更清晰、更真实的图像。

偏最小二乘法基本知识

偏最小二乘法(PLS)简介-数理统计偏最小二乘法partial least square method是一种新型的多元统计数据分析方法,它于1983年由伍德(S.Wold)和阿巴诺(C.Albano)等人首次提出。

近几十年来,它在理论、方法和应用方面都得到了迅速的发展。

偏最小二乘法长期以来,模型式的方法和认识性的方法之间的界限分得十分清楚。

而偏最小二乘法则把它们有机的结合起来了,在一个算法下,可以同时实现回归建模(多元线性回归)、数据结构简化(主成分分析)以及两组变量之间的相关性分析(典型相关分析)。

这是多元统计数据分析中的一个飞跃。

偏最小二乘法在统计应用中的重要性体现在以下几个方面:偏最小二乘法是一种多因变量对多自变量的回归建模方法。

偏最小二乘法可以较好的解决许多以往用普通多元回归无法解决的问题。

偏最小二乘法之所以被称为第二代回归方法,还由于它可以实现多种数据分析方法的综合应用。

主成分回归的主要目的是要提取隐藏在矩阵X中的相关信息,然后用于预测变量Y的值。

这种做法可以保证让我们只使用那些独立变量,噪音将被消除,从而达到改善预测模型质量的目的。

但是,主成分回归仍然有一定的缺陷,当一些有用变量的相关性很小时,我们在选取主成分时就很容易把它们漏掉,使得最终的预测模型可靠性下降,如果我们对每一个成分进行挑选,那样又太困难了。

偏最小二乘回归可以解决这个问题。

它采用对变量X和Y都进行分解的方法,从变量X和Y 中同时提取成分(通常称为因子),再将因子按照它们之间的相关性从大到小排列。

现在,我们要建立一个模型,我们只要决定选择几个因子参与建模就可以了基本概念偏最小二乘回归是对多元线性回归模型的一种扩展,在其最简单的形式中,只用一个线性模型来描述独立变量Y与预测变量组X之间的关系:Y= b0 + b1X1 + b2X2 + ... + bpXp在方程中,b0是截距,bi的值是数据点1到p的回归系数。

例如,我们可以认为人的体重是他的身高、性别的函数,并且从各自的样本点中估计出回归系数,之后,我们从测得的身高及性别中可以预测出某人的大致体重。

系统辨识之最小二乘

写成矩阵的形式为:

Y = Fq + e

3.6

é - y(n)

- y(n -1) … - y(1) u(n) … u(1) ù

F

=

ê ê ê

-

y(n "

-1)

- y(n) "

… - y(2)

u(n +1)

…

u(2)

ú ú

…"

" # "ú

êë- y(n + N ) - y(n + N -1) ! - y(N ) u(n + N ) ! u(N )úû

q = F -1y

如果噪声x ¹ 0,则 q = F-1y - F-1x

从上式可以看出噪声 x 对参数估计有影响,为了尽量减小噪声 x 对q 估值的影响,应取 N>(2n+1), 即方程数大于未知数数目。在这种情况下,不能用解方程的办法来求q ,而要采用数理统计的办法, 以便减小噪声对q 估值的影响。在给定输出向量 y 和测量矩阵 F 的条件下求系统参数q 的估值,这 就是系统辨识问题。可用最小二乘法来就q 的估值。

在科学研究中,为了揭示某些相关量之间的关系,找出其规律,往往需要求解其函数解析式。

一种方法是采用插值逼近法,即所构造的近似函数 f (x) 在已知节点 xi 上必须满足 f(xi) = yi 要求逼 近函数 f (xi) 与被逼近函数 f (x) 在各已知点 xi 处的误差为零,即要求 f (x) 的曲线必须通过所有的

取泛函 J (q )为

N

å å J (q ) = (Y - Fq )2 = e2 (n + i) = eT • e = (Y - Fq )T (Y - Fq ) i =1

偏最小二乘法原理(一)

偏最小二乘法原理(一)偏最小二乘法什么是偏最小二乘法?偏最小二乘法(PLS),是一种回归分析方法,主要用于多元多品种属性向量,特别适用于变量间共线性较强,样本数据量少的情况下。

PLS主要通过特征提取的方式进行建模,从而提高了建模的精度和准确性。

偏最小二乘法原理偏最小二乘法主要是从两个方向出发:1.最大化自变量的方差,同时找到与因变量具有最大相关性的新变量2.在新变量上建立回归模型PLS的具体步骤1.数据预处理:对原始数据进行标准化处理或中心化处理2.选取潜在变量(Latent Variable):通过对原始数据进行特征提取,得到与自变量具有最大相关性的新变量3.建立回归模型:通过对新变量进行回归模型拟合,得到最终模型4.模型验证:通过对样本外数据进行预测和验证,评估模型泛化能力PLS与其他回归方法的比较1.与PCA的比较对于相同的数据集,PCA和PLS都可以进行降维处理,但其目的不同。

PCA的目的是最大化变量之间的协方差,而PLS的目的是最大化自变量与因变量之间的相关性。

因此,PLS通常比PCA更适合解决回归问题。

2.与传统回归模型的比较传统回归模型主要依靠自变量与因变量之间的线性关系来建立模型,但这种模型很容易出现过度拟合的情况。

在自变量之间存在共线性的情况下,PLS可以通过特征提取的方式减少冗余信息,从而提高模型的泛化能力。

总结偏最小二乘法是一种很有用的回归分析方法,尤其在多元多品种属性向量、变量之间共线性较强、样本数据量少的情况下,PLS具有很好的优化效果。

但是,在应用过程中需要注意数据预处理、潜在变量的选取和数据验证等方面的问题,才能保证模型的精度和准确性。

PLS的应用领域PLS主要应用于以下方面:1.化学领域:如药物分析、食品工业等2.生物医学领域:如疾病诊断、蛋白质研究等3.工业领域:如质量控制、过程优化等4.土木工程领域:如工程设计、性能预测等PLS的优点1.PLS可以通过特征提取的方式解决变量间共线性的问题,从而提高模型的泛化能力2.PLS可以在有限的数据量下得到较为准确的预测结果,尤其适用于数据样本量较少,但变量较多的情况3.PLS可以采用交叉验证的方法对模型进行评估,从而提高模型的鲁棒性PLS的缺点1.PLS需要对数据进行预处理,特别是当数据存在噪声、异常点等问题时,可能会影响模型的准确性2.PLS需要考虑潜在变量的选取和合适的回归模型建立,因此需要一定的专业知识和经验3.PLS在处理大量变量时,可能会导致过拟合问题,因此需要对模型进行调整和优化结语偏最小二乘法是一种非常实用的回归分析方法,在多种领域有广泛的应用。

偏最小二乘算法

偏最小二乘算法偏最小二乘算法(Partial Least Squares Regression,简称PLS 回归)是一种常用的统计分析方法,用于处理多变量数据集中的回归问题。

它是在被解释变量与解释变量之间存在复杂关系的情况下,通过降维和建立线性模型来解决回归问题的一种有效手段。

下面将详细介绍偏最小二乘算法的原理和应用。

一、原理介绍偏最小二乘算法的核心思想是通过寻找解释变量与被解释变量之间最大的协方差方向,将原始变量空间转换为新的综合变量空间,从而实现降维的目的。

具体步骤如下:1. 数据预处理:对原始数据进行中心化和标准化处理,以消除量纲和变量之间的差异。

2. 求解权重矩阵:根据解释变量和被解释变量的协方差矩阵,通过迭代的方式求解权重矩阵,使得新的综合变量能够最大程度地反映原始变量之间的关系。

3. 计算综合变量:将原始变量与权重矩阵相乘,得到新的综合变量。

4. 建立回归模型:将新的综合变量作为自变量,被解释变量作为因变量,通过最小二乘法建立回归模型。

5. 预测与评估:利用建立的回归模型对新的解释变量进行预测,并通过评估指标(如均方根误差、决定系数等)评估模型的拟合效果。

二、应用案例偏最小二乘算法在多个领域都有广泛的应用,下面以药物研究为例,介绍其应用案例。

假设我们需要研究一个药物的活性与其分子结构之间的关系。

我们可以收集一系列药物分子的结构信息作为解释变量,收集相应的生物活性数据作为被解释变量。

然后利用偏最小二乘算法,建立药物活性与分子结构之间的回归模型。

通过偏最小二乘算法,我们可以找到最相关的分子结构特征,并将其转化为新的综合变量。

然后,利用建立的模型,我们可以预测新的药物的活性,从而指导药物设计和优化。

三、优缺点分析偏最小二乘算法具有以下优点:1. 能够处理多变量之间的高度相关性,避免了多重共线性问题。

2. 通过降维,提高了模型的解释能力和预测精度。

3. 对于样本量较小的情况,仍能有效建立回归模型。

2-最小二乘估计

,当样本较大时,BIC 的惩罚力度更大。

如果接受比较的模型之间是非嵌套的(即不存在某个模型是另一个模型的约

束形式),并且只有一个是正确设定的,则当样本足够大时,AIC 和 BIC 准则总

是可以挑选出正确的模型,但此时挑选的结果与使用最小残差平方和为准则的结

果一样;当接受比较的两个模型之间是嵌套的,并且简单模型是正确设定的,即

理解为在普通的

的基础上考虑进新增变量的 t 统计

值的影响,那么适当的修改调整的 的计算公式,我们甚至可以使得当新增变 量比较显著性(t 统计值绝对值大于 2),调整的 会上升。

为此,调整的 的计算公式可修改如下:

(2-22)

其中,

。

与普通的调整 相比,上式中分母的调整系数为

,而不是

,

它体现了对新增变量显著性的考虑。上式对于我们理解 t 统计值与方程的 之 间的关系是很有帮助的;实际应用中,可先根据 t 统计值的大小消除不显著的变

其中,s 称为回归标准误(Standard error of the regression)。

的估计, (2-5)

2.1.3 拟合能力

不妨记 Y 的拟合值(或估计值)为

,则有

其中, 和 为相互正交的对称幂等矩阵。

注意到

,因此必有

。

至此,可知 LS 估计的作用相当于把变量 Y 中所有关于 X 的影响通过正交

第 4 页 共 29 页

最小二乘估计

另外两个常用于比较模型优劣的准则3为 AIC 和 BIC 准则,计算如下: (2-9) (2-10)

其中,

, 为对数似然函数值。

AIC 或 BIC 越小意味着回归模型设定越好。 比较式(2-9)和(2-10)可知,AIC 和 BIC 准则对于新增解释变量的惩罚

《偏最小二乘方法》课件

首先对数据进行预处理和特征选择,然后利用偏最小二乘方法提取 主成分,最后建立预测模型并进行模型评估。

预测建模效果

通过偏最小二乘方法建立的预测模型具有较好的稳定性和泛化能力 ,能够为实际应用提供可靠的预测结果。

04

偏最小二乘方法在机器学习中的 应用

分类问题

偏最小二乘方法在分类问题中可以用于特征提取和模型训练。通过提取数据中的潜在特征,偏最小二 乘方法能够降低数据维度,同时保留分类信息,提高分类准确率。

提高可解释性 为了更好地理解模型的内在机制 ,未来研究可以进一步探索如何 提高偏最小二乘方法的结果可解 释性。

扩展应用领域

随着大数据和人工智能技术的不 断发展,偏最小二乘方法可以进 一步扩展到更多领域,如自然语 言处理、图像处理等。

结合其他算法

未来研究可以将偏最小二乘方法 与其他算法结合,如深度学习、 强化学习等,以获得更好的性能 和更广泛的应用。

金融数据分析

总结词

偏最小二乘方法在金融数据分析中广 泛应用于预测股票价格、评估投资组 合风险和回报等方面。

详细描述

通过分析历史股票数据和市场信息, 偏最小二乘方法能够建立有效的预测 模型,帮助投资者做出更明智的决策 。

市场细分分析

总结词

偏最小二乘方法在市场细分分析中用于识别不同消费者群体的特征和行为模式,从而制定更有针对性的营销策略 。

线性回归(Linear Regression)

PLS和线性回归都是预测模型,但PLS更适合处理具有复杂相关性和非线性的数据集, 而线性回归假设数据服从正态分布且变量独立。

支持向量机(SVM)

PLS和SVM都是监督学习算法,但PLS更适用于高维度和多因多果的问题,而SVM主要 应用于分类问题。

偏最小二乘算法

偏最小二乘算法以偏最小二乘算法(Partial Least Squares Regression,简称PLSR)是一种在统计学和数据分析领域中常用的多元回归方法。

它主要用于处理具有多个自变量和一个因变量的数据,通过寻找最佳的线性组合来建立模型,从而解决数据分析和预测问题。

本文将介绍PLSR算法的原理、应用和优势,以及其在实际问题中的应用案例。

1. PLSR算法的原理PLSR算法基于最小二乘法,通过将自变量和因变量进行线性组合,找到一组最佳的投影方向,使得投影后的变量之间的协方差最大,并且与因变量之间的相关性最大。

这样,就可以通过建立线性模型来预测因变量的值。

PLSR算法在处理高维数据和多重共线性问题时具有很好的效果。

2. PLSR算法的应用PLSR算法可以应用于多个领域,如化学、生物医学、食品科学等。

在化学领域,PLSR算法常用于分析和预测化学物质的性质,例如预测某种化学物质的溶解度、反应速率等。

在生物医学领域,PLSR算法可以用于分析遗传数据,如基因表达谱和蛋白质组学数据,以及预测药物的活性和副作用。

在食品科学中,PLSR算法可以用于分析食品的成分和品质,以及预测产品的口感和营养价值。

3. PLSR算法的优势相比于其他回归方法,PLSR算法具有以下几个优势:(1)PLSR算法可以处理高维数据和多重共线性问题,避免了过拟合和模型不稳定性的问题。

(2)PLSR算法可以同时考虑自变量和因变量之间的关系,可以更准确地建立预测模型。

(3)PLSR算法可以通过选择最佳的投影方向来降低数据的维度,减少自变量的数量,提高模型的可解释性和预测能力。

(4)PLSR算法可以处理非线性关系,通过引入非线性变换或核技巧,可以拟合更复杂的数据模式。

4. PLSR算法的应用案例以药物研发为例,研究人员常常需要建立药物活性和物理化学性质之间的关系模型。

通过收集一系列药物分子的物理化学性质数据和生物活性数据,可以使用PLSR算法建立预测模型,从而预测新药物的活性。

最小二乘的求解及简化

所以QR分解把正规方程简化为等价形式

ˆ RhM d M

易知,Q不用显式的计算出来,这样硬件实现的时候就 不需要耗费存储器。

3、解决QRD分解的三种典型方法

3.1 Gram-Schmidt正交化 3.2 Givens旋转

3.3 Householder反射

3.4 QR分解中的物理意义

是复数,能得到结果 的正交矩阵G为

r Gv 0

c G s

s c

其中

H r v1 v2 , c v1 / r , s v2 / r 。容易证明 G G I

2 2

Givens旋转推广到N维矢量

Givens旋转可以轻易的推广到消除一个N元素矢量中 的一个元素。可以进行如下操作:对于一个N维矢 量 vN v1 ,, vi ,, v j ,, vN T , vi 0 和 v j 0 ,可以构造一 个 N N 正交矩阵 GN 为 其中

3.2 Givens旋转

考虑一个二元素矢量 v v1 , v2 ,其中暂时假设 v1 和 2 v2 是实数。矢量的长度为 r v12 v 2 ,角度

T

v2 为 tan 。所以, v 1

1

v1 r cos v v 2 r sin

3.1 Gram-Schmidt正交化

具体实现的方法是利用 v j 和前面已经确定出的矢 量 q1 , q2 ,, q j 1 ,来确定 q j ,过程如下

q1 v1

q j v j ~ rij qi ,

i 1 j 1

j 2,3,, M

其中

~ rij qiH v j q qi

核偏最小二乘法

核偏最小二乘法核偏最小二乘法(KPLS)是一种经典的多元统计分析方法,在多个学科领域中被广泛使用。

本文将分步骤阐述KPLS的基本原理和实现流程。

一、KPLS是什么?KPLS是一种基于最小二乘回归的线性预测模型。

与普通的最小二乘回归相比,KPLS在回归预测过程中通过核函数将样本数据从原空间映射到高维特征空间,进而在新的特征空间中进行数据建模和预测。

KPLS的优势在于它可以用于处理非线性关系的数据,并且能够同时处理多个自变量和多个因变量之间的关系。

二、KPLS的基本原理1. 核函数KPLS使用的核函数是一种非线性函数,它将样本数据从原始空间映射到高维特征空间。

常用的核函数有径向基函数和多项式核函数等。

径向基函数的形式如下:K(xi,xj) = exp(-||xi-xj||^2/2σ^2)其中||xi-xj||表示向量xi和xj之间的欧几里得距离,σ表示一个控制局部图形的参数,它控制着核函数的光滑性。

2. KPLS模型的建立KPLS模型的建立分为两个步骤:训练模型和模型预测。

训练模型的过程是将样本数据通过核函数映射到新的高维特征空间中,进而捕捉自变量和因变量之间的非线性关系,使用PLS算法来对模型进行优化。

模型的预测过程是将测试数据通过核函数映射到新的特征空间中,并利用训练模型得到的权值和因子对其进行预测。

3. KPLS的优点及应用领域KPLS相较于普通的最小二乘回归以及一般的PLS方法具有更好的非线性建模能力。

它可以用于处理复杂的数据结构,包括光谱、化学反应等众多领域。

在生物医学领域中,KPLS被广泛用于预测蛋白质结构、药物毒理学研究等方面。

在化学领域中,KPLS用于预测物质的光谱响应、分子结构等方面。

三、KPLS的实现流程KPLS的实现需要以下步骤:1. 加载数据并划分数据集为训练集和测试集。

2. 选择核函数类型,并将训练集和测试集数据通过核函数映射到新的特征空间中。

3. 使用PLS算法对样本数据进行建模,得到权值和因子。

偏最小二乘法算法

偏最小二乘法1.1基本原理偏最小二乘法(PLS)是基于因子分析的多变量校正方法,其数学基础为主成分分析。

但它相对于主成分回归(PCR)更进了一步,两者的区别在于PLS法将浓度矩阵Y和相应的量测响应矩阵X同时进行主成分分解:X=TP+EY=UQ+F式中T和U分别为X和Y的得分矩阵,而P和Q分别为X和Y的载荷矩阵,E和F 分别为运用偏最小二乘法去拟合矩阵X和Y时所引进的误差。

偏最小二乘法和主成分回归很相似,其差别在于用于描述变量Y中因子的同时也用于描述变量X。

为了实现这一点,数学中是以矩阵Y的列去计算矩阵X的因子。

同时,矩阵Y的因子则由矩阵X的列去预测。

分解得到的T和U矩阵分别是除去了人部分测量误差的响应和浓度的信息。

偏最小二乘法就是利用各列向量相互正交的特征响应矩阵T和特征浓度矩阵U进行回归:U=TB得到回归系数矩阵,又称关联矩阵E:B=(TT )F U因此,偏最小二乘法的校正步骤包括对矩阵Y和矩阵X的主成分分解以及对关联矩阵B的计算。

1.2主成分分析主成分分析的中心目的是将数据降维,以排除众多化学信息共存中相互重叠的信息。

他是将原变量进行转换,即把原变量的线性组合成几个新变量。

同时这些新变量要尽可能多的表征原变量的数据结构特征而不丢失信息。

新变量是一组正交的,即互不相关的变量。

这种新变量又称为主成分。

如何寻找主成分,在数学上讲,求数据矩阵的主成分就是求解该矩阵的特征值和特征矢量问题。

卞面以多组分混合物的量测光谱来加以说明。

假设有n个样本包含p个组分,在m 个波长下测定其光谱数据,根据比尔定律和加和定理有:如果混合物只有一种组分,则该光谱矢量与纯光谱矢量应该是方向一致,而人小不同。

换句话说,光谱A表示在由p个波长构成的p维变量空间的一组点(n个),而这一组点一定在一条通过坐标原点的直线上。

这条直线其实就是纯光谱b。

因此由m个波长描述的原始数据可以用一条直线,即一个新坐标或新变量来表示。

如果一个混合物由2个组分组成,各组分的纯光谱用bl, b2表示,则有:<=c“b: + c i2bl有上式看出,不管混合物如何变化,其光谱总可以用两个新坐标轴bl,b2来表示。

动态过程数学模型参数估计的最小二乘方法Least

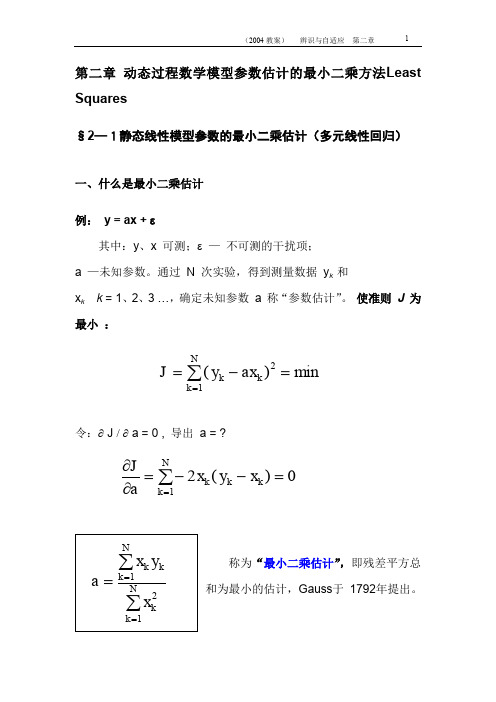

第二章 动态过程数学模型参数估计的最小二乘方法Least Squares§2—1静态线性模型参数的最小二乘估计(多元线性回归)一、什么是最小二乘估计例: y = ax + ε其中:y 、x 可测;ε — 不可测的干扰项;a —未知参数。

通过 N 次实验,得到测量数据 y k 和x k k = 1、2、3 …,确定未知参数 a 称“参数估计”。

使准则 J 为最小 :令:∂ J / ∂ a = 0 , 导出 a = ?称为“最小二乘估计”,即残差平方总和为最小的估计,Gauss 于 1792年提出。

min)(21=-=∑=k N k k ax y J 0)(21=--=∂∂∑=k k N k k x y x a J二、多元线性回归线性模型 y = a 0+ a 1x 1+ + a n x n + ε 式(2 - 1- 1)引入参数向量: θ = [ a 0,a 1, a n ]T (n+1)*1进行 N 次试验,得出N 个方程:y k = ϕk T θ + εk ; k=1、2…、N 式(2 -1- 2)其中:ϕk = [ 1,x 1,x 2, ,x N ] T (n+1) *1方程组可用矩阵表示为y = Φ θ + ε 式(2 -1- 3)其中:y = [ y 1,y 2, 。

,y N ]T (N *1) ε = [ ε1, ε2, 。

,ε N ]T (N *1) N *(n+1) 估计准则:有:⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎣⎡=⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=T N T T nN Nn n x x x x x x ϕϕϕφ....1...........1...121121211121)(θϕT k N k k y J -=∑=[]⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡----=)(..)(*)(...)(1111θϕθϕθϕθϕT N N T T N N T y y y y J= (y — Φ θ)T ( y — Φ θ)(1*N) ( N *1) J = y T y + θT ΦT Φ θ -y T Φ θ - θT ΦT y= y T y + θT ΦT Φ θ - 2 θT ΦT y 式(2 -1- 4)假设:(ΦT Φ)(n+1)(n+1) 满秩,由 利用线性代数的以下两个矩阵对向量求偏导数的公式:A x A x T =∂∂)( 和 Ax xAx x T 2)(=∂∂ 有: y y T T T ΦΦ=∂∂θθ)( 和 θθθθΦΦ=∂ΦΦ∂T T T2)( 所以:y y y y J T T T T T T T ΦΦΦΦΦΦ22)2(-=-+∂∂=∂∂θθθθθθ 解出参数估计向量: θ Ls =(ΦT Φ)-1 ΦT y 式(2 -1- 5) 令:P = (ΦT Φ)-1 则参数估计向量 θ Ls = P ΦT y参数估计向量 θ Ls 被视为以下“正则方程”的解:(ΦT Φ)θ = ΦT y 式(2 -1- 6)注:为了便于区别, 我们用红体字符表示估计量或计算值,而用黑体表示为参数真值或实际测量值。

最小二乘问题

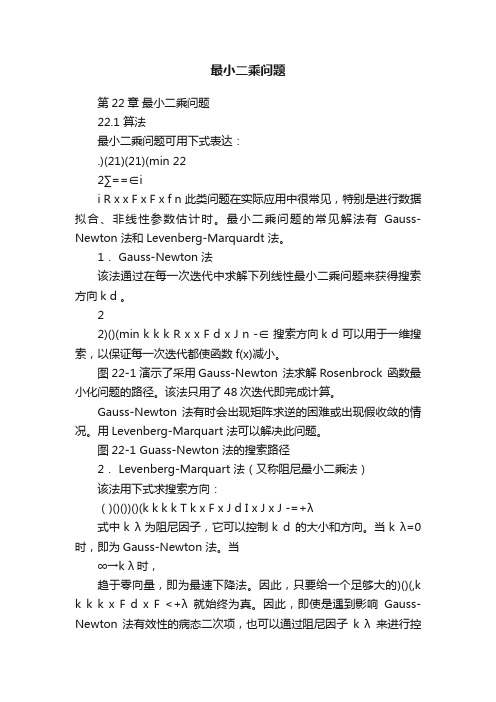

最小二乘问题第22章最小二乘问题22.1 算法最小二乘问题可用下式表达:.)(21)(21)(min 222∑==∈ii R x x F x F x f n 此类问题在实际应用中很常见,特别是进行数据拟合、非线性参数估计时。

最小二乘问题的常见解法有Gauss-Newton 法和Levenberg-Marquardt 法。

1. Gauss-Newton 法该法通过在每一次迭代中求解下列线性最小二乘问题来获得搜索方向k d 。

22)()(min k k k R x x F d x J n -∈ 搜索方向k d 可以用于一维搜索,以保证每一次迭代都使函数f(x)减小。

图22-1演示了采用Gauss-Newton 法求解Rosenbrock 函数最小化问题的路径。

该法只用了48次迭代即完成计算。

Gauss-Newton 法有时会出现矩阵求逆的困难或出现假收敛的情况。

用Levenberg-Marquart 法可以解决此问题。

图22-1 Guass-Newton 法的搜索路径2. Levenberg-Marquart 法(又称阻尼最小二乘法)该法用下式求搜索方向:()()())()(k k k k T k x F x J d I x J x J -=+λ式中k λ为阻尼因子,它可以控制k d 的大小和方向。

当k λ=0时,即为Gauss-Newton 法。

当∞→k λ时,趋于零向量,即为最速下降法。

因此,只要给一个足够大的)()(,k k k k x F d x F <+λ就始终为真。

因此,即使是遇到影响Gauss-Newton 法有效性的病态二次项,也可以通过阻尼因子k λ来进行控制。

因此,Levenberg-Marquart 法给出的是介于Gauss-Newton 法和最速下降法之间的搜索方向。

图22-2是该法的演示,它用了90次迭代运算,介于Gauss-Newton 法的48次和最速下降法的1000次之间。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

文章编 号 :2 82 2 ( 0 7 0 -660 0 5 -74 2 0 ) 50 2 .5

分 块 核 偏 最 小 二 乘 法

自裔 峰 , 肖 建 , 于

摘

龙

( 西南交通大 学电气工程学 院 ,四川 成都 6 0 3 ) 1 1 要: 针对核偏 最A -  ̄- -乘法 ( P S 随核 函数矩 阵维 数膨 胀 L) 提 J 乘  ̄

中图分类号 : 2 03 文 献标识码 : A

Bl c W ie Ke ne r i lLe s- ua e e ho o k- s r lPa ta a tSq r sM t d

B Ir  ̄ , X A i , Ⅲ l g A in fg IO Ja n o n

( c ol f l tcl n . otw s J oogU iesy hnd 10 1 hn ) Sho e r a E g ,Suh et i tn nvrt,C e gu6 0 3 ,C ia oE ci a i

在使用普通 的统计 回归方法建模过程 中, 模型变量多重相关性严重 , 或者系统 中样本容量少于变量数 量, 都会给建模过程带来 困难. 偏最小二乘法 (a i atqae, L ) pra l s s r P S 是源于化工领域过程控制 的建模 t le - u s

( oen ) 回归(erso ) 判别 (i r i tn 和分类(l si tn 技术 , m dl g 、 i r ei 、 g sn d cm n i ) s i ao c sfa o ) ai i c 借助提取 主元 的思路 , 有效 地提取对系统解释性最强 的综合信息 , 从而实现对高维数据空 间的降维处理 , 较好地克服 变量 多重相关 性 , 到广 泛 的研究 J为 了提 高线 性 P S在 非线 性 的情 况下 提取 主元 的能 力 , 线 性 化 的 P S及核 偏 最 得 . L 非 L 小二乘 法 ( e e pra l s su e, P S 成 为 目前研 究 的热 点 -]K L kr l a i at qa s K L ) n t le - r 5. P S将论 域 内的输 入 数 据通 过 非 线性函数映射到特征空间 , 然后在特征空间中建立线性或者非线性的 P S回归模型 , 以更加有效地在 L 可 非线性情况下抽取主元. P S K L 算法一般 由普通 P S算法通过核方法改进而成 7 文献 [ ] 出的 K L L .. J 2提 PS 算法 由文献 [ ] 1 中的简化 P S L 算法变化而来. 与之前的方法 比较 , 该方法不需要通过迭代计算而是直接抽 取主元 , 并且根据统计学 习理论提出了实际风险的性能指标 , 不但有助于核 函数 的参数选 择 , 而且还实现 了结 构 风险最 小 化原 则 .

I I n t e BKPL l S。t e b th. s t o n t e KPL i r n fr d i t l c — s £ o a e n I a c wie me d i l h h S S ta so me n o a b o k wie me I d b s d o l t e s mmerc c r c e fk r e t x,S } ti e a e h e u r me to o u e a dwa e a d h y t ha a tro e lmar i n i O tl tr lx st e r q ie n n c mp t rh r a r n d c e s s a c l t n i . S mua in e u t e i e t a te e r a e c l u ai tme i lto r s l o v rf s h t } BKPL i l S r du e c c l to t e c s a u a/ n i l me ef cie y。a d c n i l me tt e i e tfc to lo t m o e s mp e wih a g e tsz ie KPL fe tv l n a mp e n h d n i a in a g r h f rt a l t r a ie wh l i i h S f is a l. K e r s: IPL y wo d < S;ke e ti n r lma rx;dme so a x lso i n in le p o i n;BIPL < S;c lulto i a c a in t me

Abta t to f lc - i en l at l es- u rs( K L sr c :A me do o kw s kre p ra lat q ae B P S)w spooe oslete h b e i s a rp sd t o v h polm o i e s n l x ls no e e m txi ac - i e e p ra l s su rs( P S) rbe f m ni a poi f r l ar b t w s k r l a i at q ae K L . d o e o kn i n h e n t le .

维普资讯

第4 2卷

第 5期

西

南

交

通

大

学

学

报

Vo . 2 No 5 14 . 0c.2 0 t o7

20 07年 1 0月

J OURN O HW ES L O ONG U V AL OF S UT TJ T NI ERS Y Ⅱ’

(KL) K L B P S .B P S根据核 函数矩 阵对称 的性质 , K L 将 P S中的批 量算 法转变成分块算法 , 不但减小 了对计算 机硬 件的要求 , 而且减少 了计算 时间. 仿真结果 验证 了 B P S的有 效性 , KL 而且 在样本 数量 巨大 , P S无 法实 现 的情 KL 况下 , K L 能保 证辨识算法 的实 现. B P S也 关键 词 : 核偏最小 二乘 ; 函数矩 阵 ; 核 维数膨胀 ; 分块核偏 最小二乘 ; 计算 时间