信息论与编码 第八章

信息论与编码复习题目

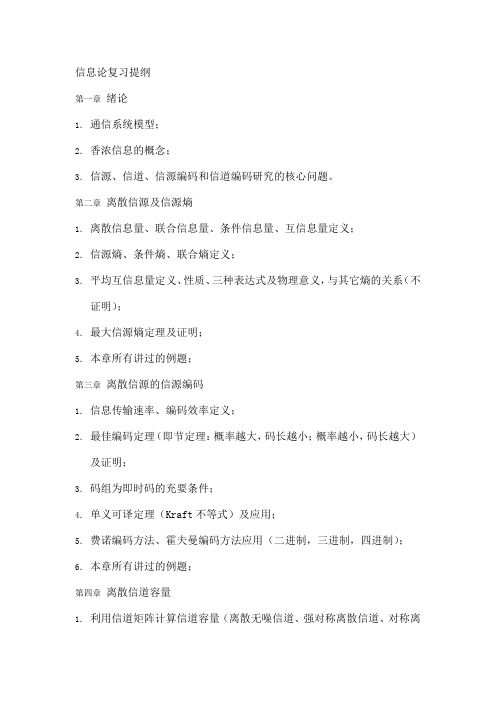

信息论复习提纲第一章绪论1.通信系统模型;2.香浓信息的概念;3.信源、信道、信源编码和信道编码研究的核心问题。

第二章离散信源及信源熵1.离散信息量、联合信息量、条件信息量、互信息量定义;2.信源熵、条件熵、联合熵定义;3.平均互信息量定义、性质、三种表达式及物理意义,与其它熵的关系(不证明);4.最大信源熵定理及证明;5.本章所有讲过的例题;第三章离散信源的信源编码1.信息传输速率、编码效率定义;2.最佳编码定理(即节定理:概率越大,码长越小;概率越小,码长越大)及证明;3.码组为即时码的充要条件;4.单义可译定理(Kraft不等式)及应用;5.费诺编码方法、霍夫曼编码方法应用(二进制,三进制,四进制);6.本章所有讲过的例题;第四章离散信道容量1.利用信道矩阵计算信道容量(离散无噪信道、强对称离散信道、对称离散信道、准对称离散信道);2.本章讲过的例题;第五章连续消息和连续信道1.相对熵的定义;2.均匀分布、高斯分布、指数分布的相对熵及证明;3.峰值功率受限条件下的最大熵定理及证明,平均功率受限条件下的最大熵定理及证明,均值受限条件下的最大熵定理及证明;4.香农公式及意义;5.本章所有讲过的例题;第六章差错控制1.重量、最小重量、汉明距离、最小汉明距离、编码效率的定义;2.最小距离与检错、纠错的关系(即节定理);3.本章所有讲过的例题;第七章线性分组码1.线性分组码定义;2.线性分组码的最小距离与最小重量的关系及证明;3.生成矩阵、一致校验矩阵定义,给出线性方程组求出生成矩阵和一致校验矩阵的标准形式,生成矩阵与一致校验矩阵的关系;4.制作标准阵列并利用标准阵列译码;5.本章所有讲过的例题;第八章循环码1.生成多项式的特点,有关定理(三定理1,定理2,定理3)及证明;2. 生成矩阵、一致校验矩阵定义,如何获得生成矩阵、一致校验矩阵的典型形式;3.本章所有讲过的例题; 习题:1.已知随机变量X 和Y 的联合分布如下:计算:、I(X;Y)。

信息论与编码技术》实验教案

信息论与编码技术实验教案第一章:信息论基础1.1 信息的概念与度量介绍信息的基本概念,信息源的随机性,信息的不确定性。

讲解信息的度量方法,如香农熵、相对熵等。

1.2 信道模型与容量介绍信道的概念,信道的传输特性,信道的噪声模型。

讲解信道的容量及其计算方法,如单符号信道、多符号信道等。

第二章:信源编码与压缩2.1 信源编码的基本概念介绍信源编码的定义、目的和方法。

讲解信源编码的基本原理,如冗余度、平均冗余度等。

2.2 压缩算法与性能评价介绍无损压缩算法,如霍夫曼编码、算术编码等。

讲解有损压缩算法,如JPEG、MP3等。

分析各种压缩算法的性能评价指标,如压缩比、重建误差等。

第三章:信道编码与错误控制3.1 信道编码的基本概念介绍信道编码的定义、目的和方法。

讲解信道编码的基本原理,如纠错码、检错码等。

3.2 常见信道编码技术介绍常用的信道编码技术,如卷积码、汉明码、奇偶校验等。

分析各种信道编码技术的性能,如误码率、编码效率等。

第四章:数字基带传输4.1 数字基带信号与基带传输介绍数字基带信号的概念,数字基带信号的传输特性。

讲解数字基带信号的传输方法,如无编码调制、编码调制等。

4.2 基带传输系统的性能分析分析基带传输系统的性能指标,如误码率、传输速率等。

讲解基带传输系统的优化方法,如滤波器设计、信号调制等。

第五章:信号检测与接收5.1 信号检测的基本概念介绍信号检测的定义、目的和方法。

讲解信号检测的基本原理,如最大后验概率准则、贝叶斯准则等。

5.2 信号接收与性能分析分析信号接收的方法,如同步接收、异步接收等。

讲解信号接收性能的评价指标,如信噪比、误码率等。

第六章:卷积编码与Viterbi算法6.1 卷积编码的基本原理介绍卷积编码的定义、结构及其多项式。

讲解卷积编码的编码过程,包括初始状态、状态转移和输出计算。

6.2 Viterbi算法及其应用介绍Viterbi算法的原理,算法的基本步骤和性能。

讲解Viterbi算法在卷积编码解码中的应用,包括路径度量和状态估计。

信息论与编码习题参考答案(全)

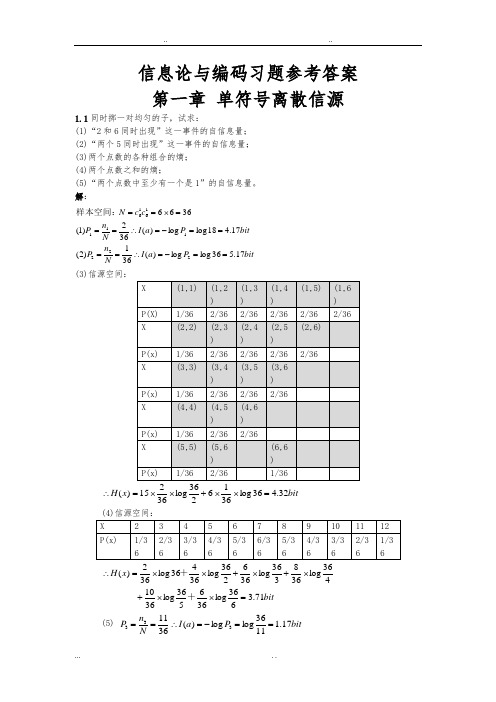

信息论与编码习题参考答案 第一章 单符号离散信源1.1同时掷一对均匀的子,试求:(1)“2和6同时出现”这一事件的自信息量; (2)“两个5同时出现”这一事件的自信息量; (3)两个点数的各种组合的熵; (4)两个点数之和的熵;(5)“两个点数中至少有一个是1”的自信息量。

解:bitP a I N n P bit P a I N n P c c N 17.536log log )(361)2(17.418log log )(362)1(36662221111616==-=∴====-=∴===⨯==样本空间:(3)信源空间:bit x H 32.436log 3662log 3615)(=⨯⨯+⨯⨯=∴ (4)信源空间: bitx H 71.3636log 366536log 3610 436log 368336log 366236log 36436log 362)(=⨯⨯+⨯+⨯+⨯⨯=∴++ (5) bit P a I N n P 17.11136log log )(3611333==-=∴==1.2如有6行、8列的棋型方格,若有两个质点A 和B ,分别以等概落入任一方格,且它们的坐标分别为(Xa ,Ya ), (Xb ,Yb ),但A ,B 不能同时落入同一方格。

(1) 若仅有质点A ,求A 落入任一方格的平均信息量; (2) 若已知A 已落入,求B 落入的平均信息量; (3) 若A ,B 是可辨认的,求A ,B 落入的平均信息量。

解:bita P a P a a P a I a P A i 58.548log )(log )()(H 48log )(log )(481)(:)1(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率bitb P b P b b P b I b P A i 55.547log )(log )()(H 47log )(log )(471)(:B ,)2(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率是落入任一格的情况下在已知 bitAB P AB P AB H AB P AB I AB P AB i i i i i i i 14.11)4748log()(log )()()(log )(471481)()3(47481=⨯=-=-=∴⨯=∑⨯=是同时落入某两格的概率1.3从大量统计资料知道,男性中红绿色盲的发病率为7%,女性发病率为0.5%.如果你问一位男士:“你是否是红绿色盲?”他的回答可能是:“是”,也可能“不是”。

信息论与编码

信息论与编码信息论与编码是计算机科学、信号处理、通信等领域研究的重要内容。

它是通信原理、符号编码、数字信号处理、信息安全等学科的基础,也是计算机科学及其相关领域的重要方法和工具。

一般而言,信息论是一门与数据传输相关的学科,它研究的主要内容是信息的编码、转换以及数据传输失真的评估和抑制。

信息论的主要概念是信息量,这是一种衡量信息传输效率的指标,它表示发送者可以从被发送消息中获得的信息。

编码是指把信息从一种形式转换成另一种形式来进行信息传输。

编码和信息论之间有着密切的联系,因为编码可以把源信息转换成可传输的信号,这可显著降低传输中的信息丢失。

另外,编码还具有加密的功能,即增加发送和接收的隐私性和安全性,从而防止被盗用。

信息论和编码的结合使传输信息的速率、质量、容量等因素都得到了极大的提高。

在现代通信技术中,随着技术发展节省空间、改善质量和提高数据速率等方面,信息论和编码技术都变得越来越重要。

具体来说,信息论主要包括信息熵(Entropy),信息量(Information),香农编码(ShannonCoding)和信道容量(ChannelCapacity)等概念,而编码主要涉及数据编码(DataCoding),符号编码(SymbolCoding),纠错编码(ErrorCoding)和时间码(TimeCoding)等概念。

信息的熵是衡量信息量的量度,它可以度量一段信息在传输中可能单位时间所达到的最大速率。

而在符号编码中,编码器会根据符号出现的概率将信息转换成最短的比特序列,从而有效地减少传输时的信息丢失。

除此之外,纠错编码技术也可以有效地提高传输的可靠性,尤其是在无线通信领域,很多现代无线通信设备都采用了纠错编码技术。

另外,时间码也可以帮助传输系统更好的处理时延的问题。

有些时间码是可以精确知道传输信息的起点和终点的,它可以使得信号的传输更加有效,在节省时间和空间的同时提高了传输效率。

总之,信息论和编码技术在计算机科学、信号处理和通信等有关领域都有广泛的应用,它们为信息传输提供了卓越的支持,也为信息传输的准确性提供了强有力的技术支持。

大学信息论与编码(第2版)-信息论与编码

20XX年复习资料大学复习资料专业:班级:科目老师:日期:第1章绪论1.1信息论的形成与发展⏹信息论的发展过程✓20X X X X24年,H N y q u i s t,信息率与带宽联系✓20X X X X28年,R V H a r t l e y,引入非统计信息量✓20X X X X36年,E H A r m s t r o n g,带宽与抗干扰能力✓20X X X X36年,H D u d l e y,发明声码机✓40年代初,N W i e n e r,“控制论”✓20X X X X48年,S h a n n o n,“信息论”“A m a t h e m a t i c a l t h e o r y o fc o m m u n i c a t i o n s”信息时代的里程碑✓50年代开始,I R E成立信息论组,出版信息论汇刊⏹信息论的形成与发展✓20X X X X59年,S h a n n o n,信源压缩编码理论,“C o d i n g t h e o r e m f o r a d i s c r e t e s o u r c e w i t h a f i d e l i t y c r i t e r i o n”✓20X X X X0X X1年,S h a n n o n,“双路通信信道”,多用户理论✓20X X X X0X X2年,C o v e r,广播信道⏹三大定理⏹无失真信源编码定理(第一极限定理)⏹信道编码定理(第二极限定理)⏹限失真信源编定理(第三极限定理)S h a n n o n信息论:在噪声环境下,可靠地、安全地、有效地传送信息理论----狭义信息论⏹信息✓定义广义定义:信息是物质的普遍属性,所谓物质系统的信息是指它所属的物理系统在同一切其他物质系统全面相互作用(或联系)过程中,以质、能和波动的形式所呈现的结构、状态和历史概率信息:信息表征信源的不定度,但它不等同于不定度,而是为了消除一定的不定度必须获得与此不定度相等的信息量⏹信息✓性质信息是无形的信息是可共享的信息是无限的信息是无所不在的信息是可度量的⏹信息✓信息与消息、信号比较消息是信息的数学载体、信号是信息的物理载体信号:具体的、物理的消息:具体的、非物理的 信息:非具体的、非物理的 信息的定义和性质⏹ 信息、消息、信号u 信号最具体,它是一物理量,可测量、可显示、可描述,同时它又是载荷信息的实体 信息的物理层表达u 消息是具体的、非物理的,可描述为语言文字、符号、数据、图片,能够被感觉到,同时它也是信息的载荷体。

《信息论与编码》课件

优点

可以快速计算出哈希值,常用于数据完整性验证和密码存储。

缺点

对于某些输入,哈希函数可能产生冲突,即不同的输入可能会产生相同的哈希值。

信息论的应用

05

数据压缩

数据压缩是信息论的一个重要应用,通过编码技术减少数据冗余,提高存储和传输效率。

压缩算法

常见的压缩算法包括哈夫曼编码、算术编码、LZ77和LZ78等,这些算法利用数据的统计特性进行压缩。

定义

RSA(Rivest-Shamir-Adleman)、ECC(椭圆曲线加密)等。

常见的非对称加密算法

密钥管理相对简单,安全性较高。

优点

加密速度较慢,通常比对称加密算法慢几个数量级。

缺点

定义

哈希函数是一种将任意长度的数据映射为固定长度哈希值的函数。

常见的哈希函数

MD5(Message Digest Algorithm 5)、SHA(Secure Hash Algorithm)等。

互信息定义

条件互信息表示一个随机变量在给定另一个随机变量的条件下与第三个随机变量之间的相关性。

条件互信息定义

信源编码

02

无损压缩编码是一种完全保留原始数据,没有任何信息损失的编码方式。

有损压缩编码是一种允许一定信息损失的编码方式,通常用于图像、音频和视频等连续媒体数据的压缩。有损压缩编码通过去除数据中的冗余信息和细节来减少存储空间或传输时间。解压缩时,虽然不能完全恢复原始数据,但人眼或耳朵通常无法察觉到损失的信息。因此,它常用于需要快速传输或低成本存储的场景,如数字电视广播、互联网流媒体等。有损压缩编码的优点是压缩率高,适合处理大量数据;缺点是原始数据的完整性和真实性可能受到损失。常见的有损压缩算法包括JPEG、MPEG、MP3等。这些算法通过离散余弦变换、小波变换等技术来减少数据量,同时采用量化等技术来控制信息损失的程度。

信息论与编码试卷及答案

一、(11')填空题(1)1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

(2)必然事件的自信息是0 。

(3)离散平稳无记忆信源X的N次扩展信源的熵等于离散信源X的熵的N倍。

(4)对于离散无记忆信源,当信源熵有最大值时,满足条件为__信源符号等概分布_。

(5)若一离散无记忆信源的信源熵H(X)等于2.5,对信源进行等长的无失真二进制编码,则编码长度至少为3 .(6)对于香农编码、费诺编码和霍夫曼编码,编码方法惟一的是香农编码. (7)已知某线性分组码的最小汉明距离为3,那么这组码最多能检测出_2_______个码元错误,最多能纠正___1__个码元错误。

(8)设有一离散无记忆平稳信道,其信道容量为C,只要待传送的信息传输率R__小于___C(大于、小于或者等于),则存在一种编码,当输入序列长度n足够大,使译码错误概率任意小. (9)平均错误概率不仅与信道本身的统计特性有关,还与___译码规则____________和___编码方法___有关三、(5')居住在某地区的女孩中有25%是大学生,在女大学生中有75%是身高1.6米以上的,而女孩中身高1。

6米以上的占总数的一半。

假如我们得知“身高1.6米以上的某女孩是大学生”的消息,问获得多少信息量?解:设A表示“大学生”这一事件,B表示“身高1.60以上”这一事件,则P(A)=0。

25 p(B)=0.5 p(B|A)=0.75 (2分)故 p(A|B)=p(AB)/p(B)=p(A)p(B|A)/p(B)=0。

75*0。

25/0。

5=0。

375 (2分)I(A|B)=—log0.375=1。

42bit (1分)四、(5')证明:平均互信息量同信息熵之间满足I(X;Y)=H(X)+H(Y)—H(XY)证明:(2分)同理(1分)则因为(1分)故即(1分)五、(18’)。

黑白气象传真图的消息只有黑色和白色两种,求:1)黑色出现的概率为0。

《信息论与编码》课程教学大纲

《信息论与编码》课程教学大纲一、课程基本信息课程代码:16052603课程名称:信息论与编码英文名称:Information Theory and Coding课程类别:专业课学时:48学分:3适用对象:信息与计算科学考核方式:考试先修课程:数学分析、高等代数、概率论二、课程简介《信息论与编码》是信息科学类专业本科生必修的专业理论课程。

通过本课程的学习,学生将了解和掌握信息度量和信道容量的基本概念、信源和信道特性、编码理论等,为以后深入学习信息与通信类课程、为将来从事信息处理方面的实际工作打下基础。

本课程的主要内容包括:信息的度量、信源和信源熵、信道及信道容量、无失真信源编码、有噪信道编码等。

Information Theory and Coding is a compulsory professional theory course for undergraduates in information science. Through this course, students will understand and master the basic concepts of information measurement and channel capacity, source and channel characteristics, coding theory, etc., lay the foundation for the future in-depth study of information and communication courses, for the future to engage in information processing in the actual work.The main contents of this course include: information measurement, source and source entropy, channel and channel capacity, distortion-free source coding, noisy channel coding, etc。

信息论与编码

信息论与编码一、引言信息论与编码是研究信息的传输、压缩和保护的领域。

本文将介绍信息论与编码的基本概念和原理,并探讨其在通信领域的应用。

二、信息论的基本概念1. 信息的定义与度量信息是对不确定性的减少所带来的好处,可以用来描述一个事件的惊喜程度。

信息量的度量可以通过信息熵来体现,信息熵越大,表示所获得的信息量越大。

2. 信道与信源信道是信息传输的通道,信源是产生信息的源头。

信息传输涉及到信源的编码和信道的传输,目标是在传输过程中尽可能减少信息丢失和失真。

三、编码的基本原理1. 码长与编码效率码长是指编码后的代码长度,编码效率是指单位信息量所对应的平均码长。

编码效率越高,表示编码所占用的空间越小。

2. 哈夫曼编码哈夫曼编码是一种基于概率的编码方法,根据字符出现的概率来确定对应的编码,出现频率高的字符使用短码,出现频率低的字符使用长码。

3. 香农编码香农编码是一种理想编码方式,它可以达到信息论的极限,即编码长度无限接近于信息熵。

香农编码需要知道信源的概率分布,才能进行编码。

四、信息论与通信的应用1. 信道编码与纠错为了减少信道传输中的误码率,可以通过引入编码和纠错码来提高传输的可靠性。

常用的编码方法包括奇偶校验码、循环冗余校验码等。

2. 数据压缩数据压缩是通过编码方法将冗余信息去除,以减小存储和传输的开销。

常见的数据压缩算法有LZW算法、哈夫曼编码等。

3. 密码学与信息安全信息论与密码学有着密不可分的关系,通过信息论的方法可以研究密码系统的安全性和抗攻击能力。

常用的加密算法包括对称加密算法和公钥加密算法。

五、总结信息论与编码是研究信息传输与保护的重要领域,它的应用涉及到通信、数据压缩和信息安全等多个领域。

通过合理的编码和解码方法,可以实现高效可靠的信息传输和存储。

信息论与编码的研究对于推动通信技术的发展和提高信息安全性具有重要意义。

答案与解析略(本文共计561字,仅供参考)。

信息论与编码第7-8章习题解答

相应的校验矩阵为

1 0 0 1 ' G 和 G 的差别仅是列的置换,所以 H 和 H ' 的差别也是同样的列置换,所以 1 1 0 1 1 0 1 1 0 1 1 1 1 0 H = 0 1 1 1 0 0 0 I 4×4 0 0 0 1 1 1 1

该码的校验矩阵任意二列线性独立,而第 1,2,3 列之和为零矢量,所以存在 着相关的三列,从而最小 Hamming 重量为 3。

wH (c 1 + c 2 ) = wH (c 1 ) + wH (c 2 ) − 2 wH (c 1 ⋅ c 2 ) 是偶数,其中 c1 ⋅ c 2 表示 c1 和 c 2 的交截。因此 c1 + c 2 ∈ E n ,所以 En 是一个线性码。

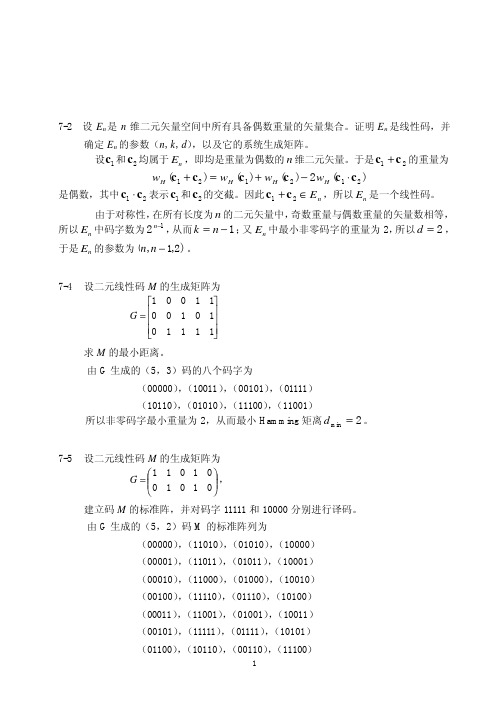

由于对称性, 在所有长度为 n 的二元矢量中, 奇数重量与偶数重量的矢量数相等, n −1 所以 En 中码字数为 2 , 从而 k = n − 1 ; 又 En 中最小非零码字的重量为 2, 所以 d = 2 , 于是 En 的参数为 ( n, n − 1,2) 。 7-4 设二元线性码 M 的生成矩阵为 1 0 0 1 1 G = 0 0 1 0 1 0 1 1 1 1 求 M 的最小距离。 [解] 由 G 生成的(5,3)码的八个码字为 (00000) , (10011 ) , (00101) , (01111) (10110) , (01010) , (11100) , (11001) 所以非零码字最小重量为 2,从而最小 Hamming 矩离 d min = 2 。 7-5 设二元线性码 M 的生成矩阵为 1 1 0 1 0 G = 0 1 0 1 0 , 建立码 M 的标准阵,并对码字 11111 和 10000 分别进行译码。 [解] 由 G 生成的(5,2)码 M 的标准阵列为 (00000) , (11010) , (01010) , (10000) (00001) , (11011) , (01011 ) , (10001) (00010) , (11000) , (01000) , (10010) (00100) , (11110) , (01110) , (10100) (00011 ) , (11001) , (01001) , (10011 ) (00101) , (11111) , (01111) , (10101) (01100) , (10110) , (00110) , (11100)

信息论与编码第八章课后习题答案

扩展信源的平均码长为:

L3 = 0.729 + 0.081*9 + 0.009*15 + 0.005 = 1.598

L3 = 0.532667 码符号/信源符号 N 四次扩展信源略; 当 N → ∞ 时,根据香农第一定理,平均码长为:

LN = H (S ) = 0.469 码符号/信源符号 N log r

第八章课后习题

【8.1】求概率分布为(1/3,1/5,1/5,2/15,2/15)信源的二元霍夫曼码。讨论此码对于 概率分布为(1/5,1/5,1/5,1/5,1/5)的信源也是最佳二元码。 解:

概率分布为(1/3,1/5,1/5,2/15,2/15)信源二元霍夫曼编码过程如下:

同样,对于概率分布为(1/5,1/5,1/5,1/5,1/5)的信源,编码过程如下:

488 2 少?如何编码? 解:

平均每个消息携带的信息量为 2 比特,因此发送每个消息最少需要的二元脉 冲数为 2。如果四个消息非等概率分布,采用紧致码编码,可使得所需要的二元 脉冲数最少,编码过程如下:

平均码长为:

∑ L = P(si )li = 1.75 二元码符号/信源符号

即在此情况下消息所需的二元脉冲数为 1.75 个。 【8.6】若某一信源有 N 个符号,并且每个符号等概率出现,对这信源用最佳霍 夫曼码进行二元编码,问当 N = 2i 和 N = 2i +1( i 是正整数)时,每个码字的长 度等于多少?平均码长是多少? 解:

码长的方差,并计算平均码长和方差,说明哪一种码更实用些。 解:

进行三元编码,需增补一个概率为 0 的信源符号,两种编码方法如下所示。

图1

图2

ห้องสมุดไป่ตู้

信息论与编码第八章1

T

H=[ Q I ] G=[ I P]

I I T Q P T 0 P

只有当PT=Q或P=QT时等式才成立。

例

(6,3)线性分组码,其生成矩阵是

1 1 1 0 1 0 G 1 1 0 0 0 1 0 1 1 1 0 1

定义8.2 对于2k个n长码字全体构成的分组码, 其码字中的k位称为信息位,n-k位称为校验位 或监督位。

线性分组码:监督元与信息元之间的关系可用 一组线性方程组来描述的(n, k)分组码。

编码效率:一个组中信息所占的比重。

k R n

– k:信息码元的数目 – n:编码组码元的总数目 – r:监督码元的数目

n = k+ r

定义8.3若(n,k)分组码中k个信息位同原始k 个信息位相同,且位于n长码字的前(或后)k位, 为校验位位于其后(或前),则称该分组码为系 统码,否则为非系统码。 定义8.4两个序列之间的汉明距离定义为两个序 列之间对应位不同的位数。 例如:α和β为码组X中的两个不同码字,X为一 个长度为N的二元码组,其中:

第8章 纠错编码

8.1纠错编码的基本概念 8.2纠错编码的分类 8.3线性分组码

8.4循环码

8.1 纠错编码的基本概念

• 信源编码提高数字信号有效性 将信源的模拟信号转变为数字信号 降低数码率,压缩传输频带(数据压缩) • 信道编码提高数字通信可靠性 数字信号在信道的传输过程中,由于实际信道的 传输特性不理想以及存在加性噪声,在接收端往 往会产生误码。 目的在于提高通信(或存储)的可靠性,减 低误码率。

令 H=

1 1 1 0 0 1 1 1 1 1 0 1 1 0 0 0 0 1 0 0 0 0 1 0 0 0 0 1

信息论与编码原理

信息论与编码原理信息论与编码原理是现代通信领域中的重要理论基础,它涉及到信息的传输、存储和处理等方面,对于信息技术的发展和应用具有重要的指导意义。

信息论是由美国数学家克劳德·香农于1948年提出的,它主要研究信息的量化、传输和保密等问题。

而编码原理则是指对信息进行编码和解码的方法和原理,它是信息论的重要应用领域之一。

信息论的基本概念包括信息的度量、信息的传输和存储、信道容量等。

首先,信息的度量是指用来衡量信息量的大小,通常使用的是香农提出的信息熵来度量信息的不确定性。

信息熵越大,表示信息的不确定性越高,反之则表示信息的不确定性越低。

其次,信息的传输和存储是指如何在通信系统中传输和存储信息,这涉及到信道编码、调制解调、多路复用等技术。

最后,信道容量是指在给定的信道条件下,最大的传输速率,它是通信系统设计的重要参考指标。

在信息论的基础上,编码原理主要研究如何将信息进行编码和解码,以便在传输和存储过程中提高信息的可靠性和效率。

编码原理主要包括信源编码、信道编码和误差控制编码等内容。

首先,信源编码是指对来自信源的信息进行编码,以便在传输和存储过程中减少信息的冗余度,提高信息的压缩率。

其次,信道编码是指在信道传输过程中对信息进行编码,以提高信息的可靠性和抗干扰能力。

最后,误差控制编码是指在传输过程中对信息进行编码,以便在接收端对传输过程中产生的误差进行检测和纠正。

信息论与编码原理在现代通信系统中有着广泛的应用,它为通信系统的设计和优化提供了重要的理论基础。

在数字通信系统中,信息论和编码原理被广泛应用于调制解调、信道编码、多路复用、分组交换等方面,以提高通信系统的性能和可靠性。

在无线通信系统中,信息论和编码原理被应用于多天线技术、自适应调制调试、功率控制等方面,以提高无线通信系统的容量和覆盖范围。

在互联网和移动通信领域,信息论和编码原理也被广泛应用于数据压缩、数据加密、错误检测和纠正等方面,以提高数据传输的效率和安全性。

信息论与编码第三版 第8章

由:c u G 得

信息位

0 0 0 0 1 1 1 1 0 0 1 1 0 0 1 1 0 1 0 1 0 1 0 1 0 1 0 1 1 0 1 0

校验位

0 1 1 0 1 0 0 1 0 0 1 1 1 1 0 0 0 1 1 0 0 1 1 0

由两组码字循环构成的循环码。

信息论与编码

【例】(7,4)循环码: g ( x) 1 x x3 , k 4

g ( x) (1101000) xg ( x) (0110100) x 2 g ( x) (0011010) x3 g ( x) (0001101)

1101000 0110100 G 0011010 0001101

码字: c (c0 , c1 ,, cn 1 ) c( x) c0 c1 x cn 1 x n 1 对于线性分组码C,可以表示成码字多项式构成的集合:

字多项式 码字多项式

C C ( x) c0 c1 x cn1 x n1 (c0 , c1 ,, cn1 ) C

当一个循环码的生成矩阵确定后,其编码规则为:

c u G

1101000 0110100 (1110010) 如:u (1010) c (1010) 0011010 0001101

信息论与编码

三.循环码的系统码

由上述方法作出ห้องสมุดไป่ตู้生成矩阵所编出的码不是系统形式,如何得到系统形 式的循环码?

2 3 n k 1 则: xg ( x) g 0 x g1 x g 2 x g n k x

x 2 g ( x) g 0 x 2 g1 x 3 g 2 x 4 g n k x n k 2 x k 1 g ( x) g 0 x k 1 g1 x k g 2 x k 1 g n k x n 1

信息论基础-第八章差错控制编码2

f Z Z 2 X 7Z X 0 的根。

注意:在上面的方程中,未知数是 Z 。

有限域上的方程并无一般解,因为方程的解是定义在有限域上 的,所有可能的解只有有限多个,所以可用试探法求解;

根据上一示例的元素表,可得

f X 6 X 6 2 X 7 X 6 X X 12 X 13 X X 3 X 2 X 1 X 3 X 2 1 X 0

多项式关于模 nX 的加法和乘法运算

加法 u X v X u X v X nX 乘法 u X v X u X v X nX

若 nX 为 n 次的多项式,则余式具有如下的一般 形式 p X cn1X n1 cn2 X n2 ... c1X c0 , ci 0,1

性质1 若要线性分组码能够检测出任一码字中的小于等于 e 位的误码,则应满足

dmin e 1

e

1

dmin

wi

wj

禁禁 禁用禁码禁 字 许禁用禁 禁码禁字

性质2 若要线性分组码能够检出并纠正任一码字中的小于等 于t位的误码,则应满足

dmin 2t 1

t wi

dmin 1 wj

t wj

禁禁用禁 禁码禁字 许禁用禁 禁码禁字

... m0,n1

... m1,n1

..ቤተ መጻሕፍቲ ባይዱ ...

mk

...

1,

n

1

系统码的特点

a0a1...ak2ak1 编码 a0a1...ak2ak1ck 2cn1 c0c1...ck2ck1ck 2cn1

系统码的编码输出结构

信息位部份 监督位部份

c0c1...ck2ck1 a0a1...ak2ak1 ck 2cn1

信息论第八章课后习题

(1)现将图像通过给定的信道传输,不考虑图像的任何统计特性,并采用二元

等长码,问需要多长时间才能传完这幅图像?

(2)若考虑图像的统计特性(不考虑图像的像素之间的依赖性),求此图像的

信源熵

H (S),并对灰度级进行霍夫曼最佳二元编码,问平均每个像素需

用多少二元码符号来表示?这时需多少时间才能传送完这幅图像?

1 1 1 1 1 1 1 1 1 1

2 2 2 2 2 2 2 2 2 2

2 2 2 2 2 2 2 3 3 3

3 3 3 3 3 3 3 4 4 4

4 4 4 4 4 4 4 5 5 5

5 5 5 5 6 6 6 6 6 6

7 7 7 7 7 8 8 8 8 8

另有一无损无噪二元信道,单位时间(秒)内传输

可见,二者的码字完全相同。

【8.2】设二元霍夫曼码为

(00,01,10,11)和(0,10,110,111),求出可以编得这样霍夫

曼码的信源的所有概率分布。

解:

二元霍夫曼编码的过程必定是信源缩减的过程,编码为

(00,01,10,11)的信

源,其码树如下图所示。

假设四个信源符号的概率分别是

i(2i -1) + 2(i +1) i2i + i + 22

L= == i +

i ii

2 + 12 + 12 + 1

【8.7】设信源

ss Lss

12 M -1 M ù

S :

pp L pp

12 M -1 M

M

i=1

é

《信息论、编码与密码学》课后习题答案

(3)两个码字之间的最小距离等于任何非零码字的最小重量,即

设 ,即 , , , ,

首先证明条件(1):

, , , , , ,

很明显,条件(1)是满足的。条件(2)也是显然成立的。

最后证明条件(3):

不难看出最小距离 ,并且最小重量 ,即

综上,三个条件都满足,那么 就是一个线性码,它的最小距离是2。

0.01

1111

该信源的熵为:

每个组的平均比特数为:

故该码的效率为:

(3)依题意,把符合每三个分成一组,再重新应用霍夫曼编码算法,得:

编码表格如下:

符号对

概率

自信息

码字

0.1250

2.7090

100

0.1000

3.3223

0000

0.1000

3.3223

0001

0.1000

3.3223

110

0.0800

12)这是一个线性码?

解:(1) =

=

=

=

=

=

=

=

此矩阵生成的码为:{00000,01010,10011,11001,10100,11110,00111,01101}

(2)

又在二元情况下,

奇偶校验矩阵可写为:

(4该码的标准阵列

(5)奇偶校验矩阵H的第1、3列的和为零向量,

因此,这个码的最小距离为:d*=2。

3.6443

011

0.0800

3.6443

0100

0.0800

3.6443

0101

0.0640

3.9662

0011

0.0250

5.3223

12953_精品课课件信息论与编码(全套讲义)

2024/1/28

10

03

信道编码

2024/1/28

11

信道编码概述

01

信道编码的基本概念

为了提高信息传输的可靠性,在信源编码的基础上增加一些监督码元,

这些多余的码元与信息码元之间以某种确定的规则相互关联(约束)。

02

信道编码的目的

对传输的信息码元进行检错和纠错,提高信息传输的可靠性。

2024/1/28

编码的基本原则

有效性、可靠性、安全性、经 济性。

8

编码的分类与原理

2024/1/28

分类

根据编码对象的不同,可分为信源编码、信道编码和加密 编码等。

原理

不同的编码方式采用不同的编码原理和算法,如信源编码 中的哈夫曼编码、信道编码中的卷积码和LDPC码等。

编码与调制的关系

编码是数字通信中的关键技术之一,与调制技术密切相关 。编码后的信号需要通过调制技术转换为适合在信道中传 输的信号。

2024/1/28

信宿

接收并处理信息的实体或系统, 如人、计算机等。

译码器

将信道中传输的信号还原成原始 信息。

6

02

编码理论

2024/1/28

7

编码的基本概念

编码定义

将信息从一种形式或格式转换 为另一种形式的过程。

2024/1/28

编码的目的

提高信息传输效率,增强信息 抗干扰能力,实现信息的可靠 传输。

共同应对挑战

在信息传输和存储领域,信息论 和编码技术将共同应对诸如信道 噪声、数据压缩等挑战。

创新应用领域

通过信息论与编码的交叉融合, 将产生更多创新性的应用,如无 损压缩、加密通信等。

2024/1/28

信息论与编码(第三版)

信息熵H(X)表征了变量X的随机性。

3.3 信息熵的基本性质

信息熵是信源概率空间的一种特殊函数。这个函数的取 值大小,与信源的符号数及其概率分布有关。

用概率矢量P来表示概率分布P(x):

当时 r : = H (X ) 2 E lo p ( 1 a g i) i q 1p (a i)lo p (a g i)

H r(X)H (X)/lorg

熵的含义

熵是从整个集合的统计特性来考虑的,它从平均意 义上来表征信源的总体特征。

信源输出前,熵H(X)表示信源的平均不确定性;

N

P (x i) P (a i1 a i2 ,.a i .N ) . , P (a ik ),ik ( 1 ,2 ,.q ) ..,

k 1

N维随机矢量的一个取值, i=(ai1 ai2…aiN)

P(aik)是符号集A的一维 概率分布

3)离散无记忆信源的N次扩展信源

若X为离散无记忆信源: P X (x) P ( a a 1 1 )

通信的实质?

即:传递信息,消除不确定性。

2.2.2 信息熵

对一个信源发出不同消息所含有的信息量也不同。所以 自信息I(ai)是一个随机变量,不能用它来作为整个信源 的信息测度。

信息熵:自信息的数学期望,平均自信息量Hr(X):

H r(X )E lo rp g (1 a i) i q 1p(a i)lo rp g (a i) r进制单位/符号

简介

是一门应用概率论、随机过程、数理统计和近 代代数的方法,来研究信息传输、提取和处理 中一般规律的学科。

奠基人:美国数学家香农(C.E.Shannon) 1948年“通信的数学理论”

信息论与编码共59页

信息论与编码基础

离散信道

② 互信息的性质

对称性 相互独立时的X和Y 互信息量可为正值或负值 不大于其中任一事件的自信息量

信息论与编码基础

离散信道

对称性

I(xi;yj)=I(yj; xi)

推导过程

I(xi;yj)logp(px(ix/iy)j)logp(px(ix/iy)jp)(py(jy)j)

对天气x3, I(x3;y1)lo 2p g (p x (3 x /3 y )1)lo 21 1 /g /8 41 (比 )特

对天气x4 I(x4;y1)lo 2p g (p x (4 x /4 y )1)lo 21 1 /g /8 41 (比 )特

结果表明从y1分别得到了各1比特的信息量; 或者说y1 使x2,x3,x4的不确定度各减少量1比特。

X—信源发出的离散消息集合; Y—信宿收到的离散消息集合; 信源通过有干扰的信道发出消息传递给信宿; 信宿事先不知道某一时刻发出的是哪一个消息,所以每个消息是随机事件的一

个结果; 最简单的通信系统模型: 信源X、信宿Y的数学模型为

P ( X X ) p x ( 1 x , 1 )p ( ,x x 2 2 ) , , ,,p x ( ix i) , ,p ( x x n n ) 0 p ( x i) 1 ,

五、信道容量

六、信源与信道的匹配

信息论与编码基础

离散信道

1、信道的分类 2、离散信道的数学模型 3、单符号离散信道

信息论与编码基础

离散信道

1、信道的分类 2、离散信道的数学模型 3、单符号离散信道

信息论与编码基础

离散信道

1、信道的分类

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第八章

8.10解:由于有生成矩阵G和校验矩阵H,使,所以可以通过上式得到,故可以得到。

8.11解:由题意得:n=15,k=9,n-k=6

该多项式构成(15,9)码共有3种不同的选择,生成多项式和检验多项式分别为:

= (x+1)(x4+x3+1)(x4+x3+x2+x+1)

=

= (x+1)(x4+x+1)(x4+x3+1)

8.12解:(1)生成矩阵

校验矩阵

(2)y(x) = x7+x5+x3+x+1不是码多项式。

(3)s(x) = y(x) [mod g(x)]= x7+x5+x3+x+1

8.13解:循环汉明码编码器如下所示:

8.15解:因为,且,所以 校验多项式为.故可以生成一个(21,11)的循环码。

由于,所以得到,则伴随式通式为

8.17解:码的校验矩阵为

,假设信道错误出现在最高位,即=(100000000000000),对应的错误图样多项式为,可以求得相应的伴随式多项式为,即相应的伴随式多项式为,对应的伴随式为

则相应的译码电路为。