汕头大学数据挖掘期末复习

大学数据挖掘期末考试题

大学数据挖掘期末考试题学院试题密封期限:学期末本试题共三部分,满分100分,考试时间120分钟。

第一部分:选择题(共40分,每小题2分)1.下列哪个选项是正确的?A.选项AB.选项BC.选项CD.选项D2.下列哪个选项是错误的?A.选项AB.选项BC.选项CD.选项D3.以下哪项描述不正确?A.选项AB.选项BC.选项CD.选项D4.以下哪项描述正确?A.选项AB.选项BC.选项CD.选项D第二部分:填空题(共30分,每小题3分)1.我国现行的宪法于(1)年(2)月(3)日颁布。

2.我国的国家根本大法是(4)。

3.《中华人民共和国宪法》规定:中华人民共和国的一切权力属于(5)。

4.全国人民代表大会是我国的最高国家权力机关,它的最高领导机构是(6)。

5.中华人民共和国主席、副主席由全国人民代表大会选举,任期(7)年。

第三部分:简答题(共30分,每小题10分)1.请简要介绍我国的政治制度。

我国的政治制度是社会主义制度,是以工人阶级为领导的以工农联盟为基础的人民民主专政。

我国最高国家权力机关是全国人民代表大会和它的常委会,国家行政机关是国务院和它的组成部门,最高审判机关是XXX,最高检察机关是XXX。

2.请简要介绍我国的经济发展情况。

我国的经济发展取得了长足的进步,成为世界第二大经济体。

我国实行的是社会主义市场经济,通过改革开放,吸引了大量的外资,推动了经济的快速发展。

我国的GDP连续多年以高速增长,人民生活水平不断提高。

3.请简要介绍我国的文化传统。

我国的文化传统源远流长,拥有悠久的历史和丰富的文化遗产。

我国的文化包括中华文化、儒家文化、道家文化、XXX文化等等。

中华文化是我国的主要文化,它包括了诗、书、画、印、琴、棋、剑等七艺,是我国的传统文化精髓。

儒家文化是我国的传统文化之一,它强调仁爱、诚信、孝道等道德观念。

道家文化是我国的哲学文化,它强调道、德、天、地等观念。

文化是我国的宗教文化,它强调慈悲、般若等观念。

数据挖掘期末考试题库

数据挖掘期末考试题库

进行数据挖掘期末考试前,老师通常会准备一份题库,供学生参考复习。

这个题库包含了一系列的问题,涵盖了数据挖掘的各个方面。

以下是一个示例的数据挖掘期末考试题库,供同学们参考:

1. 什么是数据挖掘?数据挖掘的主要目标是什么?

2. 请简要介绍数据挖掘的主要过程。

3. 数据挖掘中常用的数据预处理方法有哪些?请分别进行介绍。

4. 数据挖掘中常用的特征选择方法有哪些?请分别进行介绍。

5. 数据挖掘中常用的分类算法有哪些?请分别进行介绍。

6. 数据挖掘中常用的聚类算法有哪些?请分别进行介绍。

7. 数据挖掘中常用的关联规则挖掘算法有哪些?请分别进行介绍。

8. 什么是异常检测?数据挖掘中常用的异常检测方法有哪些?请分别进行介绍。

9. 数据挖掘中的交叉验证是什么?请简要说明。

10. 数据挖掘中如何评估分类算法的性能?请简要说明评估指标。

11. 数据挖掘中如何评估聚类算法的性能?请简要说明评估指标。

12. 数据挖掘中如何评估关联规则挖掘算法的性能?请简要说明评估指标。

13. 数据挖掘在实际应用中的案例有哪些?请分别进行介绍。

14. 在数据挖掘过程中,如何选择适当的算法和技术?请简要说明。

15. 数据挖掘存在哪些挑战和限制?请分别进行介绍。

以上题目是一个简要的示例,涵盖了数据挖掘的基本概念、主要过程、常用方法和评估指标等方面。

同学们可以根据这些问题来进行复

习和准备,加深对数据挖掘的理解和掌握。

希望以上题库对同学们的期末考试有所帮助。

祝大家考试顺利!。

【数据挖掘】期末考试备考复习宝典 (一文搞定,期末考试不再担忧)

【数据挖掘】期末考试备考复习宝典单选1、下列选项哪个描述的是“训练样本”(B)A、在电子病历数据中,每一个样本有八个检测指标,但是没有医生诊断结果B、在电子病历数据中,每一个样本有八个检测指标,每个样本还有一个医生诊断结果C、在电子病历数据中,每一个样本有八个检测指标,但是没有医生诊断结果;算法自动得到这些样本的诊断结果D、在电子病历数据中,每一个样本有八个检测指标,医生根据这八个指标做出诊断2、下列选项哪个描述的是“分类”(C)A、在电子病历数据中,每一个样本有八个检测指标,但是没有医生诊断结果B、在电子病历数据中,每一个样本有八个检测指标,每个样本还有一个医生诊断结果C、在电子病历数据中,每一个样本有八个检测指标,但是没有医生诊断结果;算法自动得到这些样本的诊断结果D、在电子病历数据中,每一个样本有八个检测指标,医生根据这八个指标做出诊断3、列哪个选项描述的不是“聚类”(C)A、搜索引擎返回的文档中,将相似的文档聚合成一类B、电子商务网站数据中,购物历史相似的用户自动聚合成一组C、电子商务网站数据中,分析出用户常常一起购买的商品,组合到一起促销D、在电子病历数据中,将体检指标相似的样本自动聚合成一组4、在MATLAB语言中,以下说法中错误的是A、MATLAB中默认的数据类型是doubleB、3<5的运算结果是logical类型C、变量Abc和abc是代表两个相同的变量D、灰度图的图像矩阵中的数据是uint8类型5、数据对象的别名不包括(D)A、记录B、样本C、向量D、特征6、属性的别名不包括(B)A、特征B、样本C、字段D、维7、下列说法不正确的是(C)A、测量标度是将数值或符号与对象的属性相关联的规则B、属性的性质不必与用来度量它的值的性质完全相同C、即使在不同的应用问题中,同一个物理量也必然使用同一种类型的属性来描述D、属性类型可以划分为:标称、序数、区间、比率这四种8、某办公自动化系统中,采用出生年份表示雇员的年龄,这是什么类型属性(C)A、标称B、序数C、区间D、比率9、某学籍管理系统中,采用百分制表示学生分数,这是什么类型属性(D)A、标称B、序数C、区间D、比率10、描述一个数据集的属性主要不包括(A)A、置信度B、维度C、分辨率D、稀疏性11、下列说法中错误的是(D)A、噪声是测量误差的随机部分B、数据中出现遗漏值的原因,可能是信息没有收集到,或者属性不适用于所有情况。

数据挖掘考试复习资料

数据挖掘考试复习资料一、名词解释1、数据仓库:面向主题的、集成的、非易失的、是随时间变化的数据集合,用来支持管理决策。

2、聚类:将物理或抽象对象的集合分成由类似的对象组成的多个类的过程被称为聚类3、数据挖掘:从大量的数据中挖掘那些令人感兴趣的、有用的、隐含的、先前未知的和可能有用的模式或知识4、人工神经网络:人工神经网络是一种应用类似于大脑神经突触联接的结构进行信息处理的数学模型。

在工程与学术界也常直接简称为神经网络或类神经网络。

5、文本挖掘:文本数据挖掘(Text Mining)是指从文本数据中抽取有价值的信息和知识的计算机处理技术6 OLAP又称联机分析处理,是使分析人员、管理人员或执行人员能够从多种角度对从原始数据中转化出来的、能够真正为用户所理解的、并真实反映企业为特性的信息进行快速、一致、交互地存取,从而获得对数据的更深入了解的一类软件技术。

定义1:OLAP是针对特定问题的联机数据访问和分析。

通过对信息(维数据)的多种可能的观察形式进行快速、稳定一致和交互性的存取,允许管理决策人员对数据进行深入地观察。

定义2:OLAF是使分析人员、管理人员或执行人员能够从多种角度对从原始数据中转化出来的、能够真正为用户所理解的、并真实反映企业“维”特性的信息进行快速、一致、交互地存取,从而获得对数据的更深入了解的一类软件技术。

)7、概念描述:就是对目标类对象的内涵进行描述,并概括这类对象的有关特征。

特征化:提供给定数据汇集的简洁汇总比较:提供两个或多个数据汇集的比较描述8、信息熵:在信息论中,熵被用来衡量一个随机变量出现的期望值。

它代表了在被接收之前,信号传输过程中损失的信息量,又被称为信息熵。

信息熵也称信源熵、平均自信息量。

二、简答题1、数据仓库和传统数据库的区别和联系是什么?(1)区别:数据仓库和数据库是不同的概念数据仓库是一个综合的解决方案,而数据库只是一个现成的产品。

数据仓库需要一个功能十分强大的数据库引擎来驱动,它更偏向于工程。

大学数据挖掘课程考试复习材料

一.1. 数据处理与数据分为'操作型'和'分析型'处理与数据. 2. 操作型数据: 细节的, 存取瞬间准确,可更新,操作需求事先可知,生命周期符合SDLC,性能要求高,操作单元,事务驱动,面向应用,支持日常操作. 分析型数据:综合的,代表过去数据,不更新,操作需求事先不可知,完全不同的生命周期,要求宽松,操作集合,分析驱动,面向分析,支持管理需求. 3. 数据组织结构:高度综合级,轻度综合级,当前细节级,早期细节级. 4. 数据组织形式:简单堆积文件,轮转综合文件,简化直接文件,连续文件. 5. 数据挖掘七个步骤:数据清理,数据集成,数据选择,数据变换,数据挖掘,模式评估,知识表示. 6. 数据挖掘系统的主要成分:1 数据库,数据仓库或其他信息库 2 数据库或数据仓库效劳器 3 知识库4数据挖掘引擎 5 模式评估模块6图形用户界面.7 数据挖掘功能: 用于指定数据挖掘任务中要找的模式类型. 8. 数据挖掘任务分为两类:描述和预测.9. 概念/类描述方法:数据特征化,数据区分,数据特征化与比拟. 10 .关联分析发现关联规那么,适用于事务数据分析.关联规那么分为:多维/单维关联规那么. 11. 粒度越大,表示细节程度越低,综合程度越高. 12. 数据仓库定义: 数据仓库是一个面向主题的,集成的,不可更新且随时间不断变化的数据集合,用来支持管理人员的决策. 二.1. 数据立方体由位和事实定义. 维是关于一个组织想要记录的透视或实体;事实是数值的度量. 2. 多维数据模型模式分类: 星型模式,雪花模式,事实星座模式[ 维表,事实表]. 3.度量根据所用的聚焦函数分成三类:分布的度量,代数的度量,整体的度量. 4. 多维数据模型上的OLAP操作:上卷,下钻,切片,切块,转轴,钻过,钻透.5.数据仓库设计的四种视图:1 自顶向下视图2数据源视图 3 数据仓库视图4商务查询视图. 6. 数据仓库通常采用三层结构:底层:数据仓库效劳器中层:OLAP效劳器顶层:前端工具.7. OLAP效劳器类型:关系OLAP(ROLAP效劳器;多维OLAP(MOLAP效劳器;混合OLAP(HOLAP效劳器;特殊的SQL效劳器. 8. ROLAP:关系数据库技术; 响应慢; 数据装载快; 存储消耗小; 维数无限制; 通过SQL 实现存储;维护困难;无文件大小控制.MOLAP专为OLAP设计;性能好,反响快;数据装载快;需进行预计算,无法支持维变化;缺乏模型,访问标准,管理简便;受操作系统文件大小控制. *ROLAP不支持有关预计算读写操作,无法多行计算,无法维间计算• *MOLAP支持高性能决策支持计算;跨维计算,多用户读写操作. 9. 数据仓库设计步骤:1 选取待建模的高务处理 2 选取高务处理的粒度 3 选取用于每个事实表记录的维 4 选取安放在事实表中的度量三 1. 数据质量问题:1 噪声数据2空缺数据3不一致数据4重复5维度高 2. 噪声处理方法:1 分箱2聚类3回归 3. 预处理的根本方法:数据清理,数据集成,数据变量,数据归约 4. 数据选取的参考原那么:1 尽可能赋予属性名和属性值的明确含义2同意多数据源的属性值编码 3 去掉唯一的属性4取出重复属性5去除可以忽略字段6合理选择关联字段 5. 分箱的4种方法:统一权重,统一区间,最小熵,用户自定义区间 6. 数据平滑方法:按箱平均值平滑,按箱中值平滑,按箱便捷平滑7. 数据集成涉及问题:模式集成,数据冗余,数据值冲突8. 数据交换涉及内容:平滑,聚集,数据概化,标准化,属性构造. 9. 数据归约的策略:维归约,数据压缩,数值压缩,离散化和概念分层生成10. 属性子集选择的根本启发式方法包含的技术:1 逐步向前选择 2 逐步向后删除 3 向前选择和向后删除的结合 4 判定树归纳11. 压缩技术:有损(分为小波变换(分为DWT/DFT /主要成分分析PCA /无损12.数值归约:有参方法/无参方法13. 空缺值处理方法:1 忽略元组2人工填写空缺值3使用一个全局常量填充空缺值4使用属性的平局值填充空缺值5使用与给定元组属同一类的所有样本的平均值6使用最可能的值填充空缺值14.抽样:1简单项选择取n个样本,不回放2简单项选择择n个样本,回放3聚类抽样4分层抽样15. 概念分层方法: 1 分箱2直方图分析3聚类分析 4 基于熵的离散化4通过自然划分分段四.1. 数据挖掘语言分类:1 数据挖掘查询语言DMQL2 数据挖掘建模语言PMML3 通用数据挖掘语言 2. 数据挖掘任务的原语:1 任务相关数据原语2要挖掘的知识种类原语3背景知识原语4兴趣度测量原语5被发现模式的表示和可视原语3. 任务相关数据包括:1 数据库与数据仓库名称2数据立方3数据选择条件4相关属性或维5 数据分组条件 4. 背景知识概念分层的主要类型:1 模式层次 2 集合分组分层 3 基于操作层次 4 基于规那么分层 5. 兴趣度度量特点: 简洁性, 确定性, 实用性, 新颖性 6. 兴趣度的分类: 客观兴趣度〔数据驱动〕, 主观兴趣度〔用户驱动〕 7. 数据挖掘系统的结构设计耦合模式: 不耦合,松散耦合,半紧密耦合,紧密耦合8. 挖掘的知识类型:1 特征化2区分3关联4分类/ 预测 5 聚类五六. 1. 从数据分析角度,数据挖掘分为:描述性,预测性 2. 概念描述基本方法:多层概念,汇总,特征化,比拟根本技术:表,图表,图,规那么 3. 类比拟的步骤:数据收集,维相关分析,同步概化,导出比拟的表示 4. 关联规那么挖掘的两个过程: 1 找出频繁项集 2 由频繁项集产生强关联规那么 5. 关联规那么根本分类方法:1 按管理规那么处理的变量类别:布尔型和量化性 2 按关联规那么中数据的抽象层次:单层/多层关联规那么 3 按关联规那么中所涉及的变量数目:单维/ 多维关联规那么 4 按关联规那么的各种扩充,关联规那么可扩充到相关分析,以识别项是否相关 6. 多层关联规那么的主要挖掘方法:1 对于所有层使用一致的最小支持度2 在较低层使用递减的最小支持度 3 逐层独立 4 层交叉单项过滤 5 层交叉K-项集过滤七.1.分类与预测是两种数据分析形式•分类是预测分类标号〔离散性〕;预测是建立连续函数模型. 2. 数据分类步骤:1 学习,用分类算法分析训练数据2分类, 测试数据用于评估分类规那么的准确率. 3. 分类与预测的标准和评估:预测的准确率,速度,强壮度,可伸缩性,可解释性. 4. 常用分类方法:1 决策树归纳2贝叶斯信念网络 3 贝叶斯分类4神经网络5. 预测的方法:1 线性回归2 多元回归3 非线性回归4 广义线性模型*预测步骤:1. 问题的理解与提出 2. 数据准备2.1 变量选择 2.2 数据清洗 2.3 变量转化 2.4 可视化 3.1 神经网络 3.2 决策树3.3 关联规那么3.4 其他模型4结果评价与解释〔回1〕 6. 评估分类法准确性的方法:1 保持方法2 k- 交叉确认方法八.1 基于内存的聚类算法通常采用的数据结构:〔1〕数据矩阵:对象—变量结构〔二模矩阵〕〔2〕相异度矩阵:对象—结构〔单模矩阵〕 2. 对聚类质量/相异度估计评估方法:1 区间标度变量2二元变量3标称变量4比例标度型变量5混合类型的变量 3. 簇间距离度量标准:最短/ 最长/ 中间/平均距离 4. 典型的聚类过程:1 数据准备 2 特征提取 3 聚类 4 聚类结果评估5. 聚类方法的主要分类:1 划分方法2 层次方法3 基于密度的方法4 基于网络的方法5 基于模型的方法 6. 孤立点分析的主要方法:1 统计学方法2基于距离的方法3基于偏差的方法7. 划分方法:1 全局最优2启发式方法〔K- 均值,K- 中心点〕 8. 层次方法:1 凝聚方法〔自底向上方法〕2 分裂方法〔自顶向下〕9.复杂类型数据挖掘包括:1复杂对象2空间数据3多媒体数据4文本数据5WEB数据。

数据挖掘期末复习

– Classification/clustering等等这些数据挖掘模型可以分为有/无指导,其它方法也可 以区分;如,normalize, standardize…

– 区分的依据:是否使用了类别标号 – 如何判断一种算法能处理什么类型的数据?k-means/kNN/C4.5/NavieBayes…

• Apriori性质

– 一个频繁项集的任意非空子集必定是频繁的; – 一个不频繁项集的任何超集必定是不频繁的;

• 算法:给定一个事务数据库 ---

– 如何从k-频繁项集得到候选的(k+1)-频繁项集? – 如何得到所有的强关联规则?

分类及其评估

• 分类

– 有指导的学习 – 一般步骤

• k-NN

– 使用什么方法衡量样本间的相似度度量?

闭卷考试

• 题型

– 单项选择(21%) – 多项选择(16%) – 简答题(含计算题)(30%) – 综合应用题(33%)

• 内容

– 数据挖掘、机器学习的基本概念(Lecture1-4) – 关联规则挖掘(Lecture5-7) – 分类模型及其评估(Lecture8-11) – 聚类分析(Lecture12-14) – 属性选择/回归分析(Lecture14-15) – Weka软件(实验部分)

• k-means/DBSCAN的优缺点…

– 簇的形状;时间复杂度;结果的确定性;簇的数目…

• 你认为NavieBayes是“lazy”还是“eager”分类器?Why?你 会选择J4.8还是NavieBayes对这样的数据进行分类?

– NavieBayes从训练数据集显式地构造了一个概率模型用于分类; – 通常,可以从分类效率、分类精度、误差成本(ROC曲线)等角度来

数据挖掘期末复习整理

51.无监督学习(185):又称为“聚类”,每个训练元组的类标号是未知的,并且要学习的类的个数或集合也可能事先不知道。

52.如何评价学习算法(187):从以下几个方面评价:准确率、速度、鲁棒性、可升缩性、可解释性。

2.决策树(P189):信息增益(192)例6-1;增益率(184)例6-2;

3.贝叶斯分类(P200);贝叶斯定理(201);朴素贝叶斯分类(202);例6-4 P203

四.综合

1.数据挖掘产生的背景

答:随着信息科技的进步以及电子化时代的到来,人们以更快捷、更容易、更廉价的方式获取和存储数据,使得数据及信息量以指数方式增长。据粗略估计,一个中等规模企业每天要产生100MB以上的商业数据。而电信、银行、大型零售业每天产生的数量以TB来计算。人们搜集的数据越来越多,剧增的数据背后隐藏着许多重要的信息,人们希望对其进行更高层次的分析,以便更好的利用这些数据。先前的数据库系统可以高效的实现数据的录入、查询、统计等功能,但无法发现数据背后隐藏的知识手段。导致了“数据爆炸但知识贫乏”的现象。于是人们开始提出“要学会选择、提取、抛弃信息”,并且开始考虑:如何才能不被信息淹没?如何从中及时发现有用的知识、提高信息利用率?如何从浩瀚如烟海的资料中选择性的搜集他们认为有用的信息?这给我们带来了另一些头疼的问题:

结果=(1-0.5)*6+0.5*7=6.5

25.五数概况(35):由中位数,四分位数Q1和Q3,最小和最大观·测值组成,按一下序列写为:Minimun,Q1,Median,Q3,Maximum.

26.方差、标准差(35):

N个观测值x1,x2………Xn的方差是:

数据挖掘期末试卷

数据挖掘期末试卷一、简答题(共5题,每题10分)1.数据挖掘的定义和目标是什么?2.数据预处理的步骤有哪些?请详细描述。

3.请简述交叉验证在数据挖掘中的作用。

4.请解释什么是聚类分析,并举例说明其在实际应用中的作用。

5.请解释关联规则挖掘的概念,并说明其在市场篮子分析中的应用。

二、计算题(共2题,每题20分)1.假设有一个包含100个数据样本的数据集D,其中80个样本属于类别A,20个样本属于类别B。

现给定一个新的数据样本x,请根据给定的数据集D和数据样本x,使用K近邻算法来确定x的类别,并说明你的推理过程。

2.给定一个包含1000个样本的数据集D,每个样本包含5个特征。

现在希望通过主成分分析(PCA)来对数据集进行降维处理。

请根据给定的数据集D,使用PCA算法来完成降维处理,并说明你的推理过程。

三、编程题(共1题,40分)对于给定的数据集D,其中包含1000个数据样本,每个样本包含5个特征。

请编写Python代码来实现基于K均值算法的聚类分析,并对数据集D进行聚类。

请在代码注释中详细描述你的算法实现过程,并附带代码运行结果截图。

四、应用题(共1题,20分)假设你是一家电商平台的数据分析师,现在希望通过关联规则挖掘来分析用户的购物行为。

请根据给定的购物篮数据集,使用关联规则挖掘算法来发现频繁项集和关联规则,并解释你的挖掘结果。

五、思考题(共1题,10分)数据挖掘技术在当今社会的各个领域中起到了重要的作用。

请从你所了解的领域中选择一个,并说明数据挖掘在该领域中的应用场景和作用。

同时,对于这个领域中可能出现的挑战和问题,你认为采用数据挖掘技术能够解决哪些问题,又有哪些限制?以上为《数据挖掘期末试卷》的题目列表,包括了简答题、计算题、编程题、应用题和思考题。

希望能够通过这些题目来测试学生对于数据挖掘知识的理解和应用能力。

祝大家成功完成试卷!。

数据挖掘复习

数据挖掘复习1、简单描述一下数据挖掘的过程(1)数据清洗:清除数据噪声和与挖掘主题明显无关的数据(2)数据集成:将来自多个数据源中的相关数据组合到一起(3)数据选择:根据数据挖掘的目标选取待处理的数据(4)数据转换:将数据转换为易于进行数据挖掘的数据存储形式(5)数据挖掘:根据一定评估标准,从挖掘结果中筛选出有意义的相关知识(6)知识表示:利用可视化和知识表达技术,向用户展示所挖掘的相关知识2、均值、中位数、截断均值在反应数据中心方面的特点(1)均值:(2)中位数:对于倾斜的(非对称的)数据,中位数是数据中心的一个较好度量(3)截断均值:均值对极端值很敏感,截断均值可以避免少量极端值影响均值3、在数据预处理的时候可以发现并清除噪音数据吗?噪音数据一般有哪些处理方法(1)可以。

数据清理的目的就是试图填充缺失值、去除噪声并识别利群点、纠正数据中的不一致值。

(2)1、分箱:通过考察周围的值来平滑有序数据的值2、聚类:聚类将类似的值组织成群或簇。

落在簇集合之外的值被视为异常值3、回归:通过回归(线性回归、非线性回归)让数据适合一个函数来平滑数据4、举例说明什么是数据挖掘的关联分析任务例:通过对数据集进行关联分析,发现关联规则A→B,表示购买产品A的顾客通常都会购买产品B。

关联规则中的前件和后件不存在必然的因果关系,只是表示如果前件出现了,后件也很有可能出现。

5、一趟聚类算法是如何在时效性和处理混合型数据方面得到提高的?它的缺点是什么?(1)(2)1、对于大规模数据集,聚类时效性和准确性难以满足要求2、难以直接处理混合属性的数据3、聚类结果依赖于参数,而参数的选择主要靠经验或试探,没有简单、通用的方法。

数据挖掘期末复习

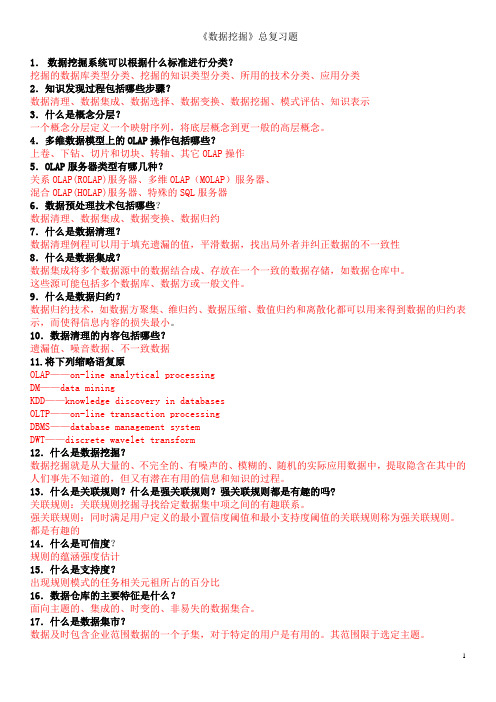

《数据挖掘》总复习题1.数据挖掘系统可以根据什么标准进行分类?挖掘的数据库类型分类、挖掘的知识类型分类、所用的技术分类、应用分类2.知识发现过程包括哪些步骤?数据清理、数据集成、数据选择、数据变换、数据挖掘、模式评估、知识表示3.什么是概念分层?一个概念分层定义一个映射序列,将底层概念到更一般的高层概念。

4.多维数据模型上的OLAP操作包括哪些?上卷、下钻、切片和切块、转轴、其它OLAP操作5.OLAP服务器类型有哪几种?关系OLAP(ROLAP)服务器、多维OLAP(MOLAP)服务器、混合OLAP(HOLAP)服务器、特殊的SQL服务器6.数据预处理技术包括哪些?数据清理、数据集成、数据变换、数据归约7.什么是数据清理?数据清理例程可以用于填充遗漏的值,平滑数据,找出局外者并纠正数据的不一致性8.什么是数据集成?数据集成将多个数据源中的数据结合成、存放在一个一致的数据存储,如数据仓库中。

这些源可能包括多个数据库、数据方或一般文件。

9.什么是数据归约?数据归约技术,如数据方聚集、维归约、数据压缩、数值归约和离散化都可以用来得到数据的归约表示,而使得信息内容的损失最小。

10.数据清理的内容包括哪些?遗漏值、噪音数据、不一致数据11.将下列缩略语复原OLAP——on-line analytical processingDM——data miningKDD——knowledge discovery in databasesOLTP——on-line transaction processingDBMS——database management systemDWT——discrete wavelet transform12.什么是数据挖掘?数据挖掘就是从大量的、不完全的、有噪声的、模糊的、随机的实际应用数据中,提取隐含在其中的人们事先不知道的,但又有潜在有用的信息和知识的过程。

13.什么是关联规则?什么是强关联规则?强关联规则都是有趣的吗?关联规则:关联规则挖掘寻找给定数据集中项之间的有趣联系。

数据挖掘期末考试题型及复习

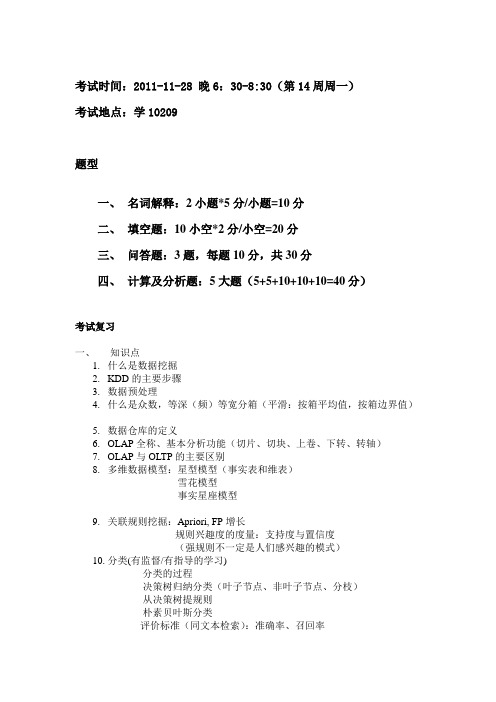

考试时间:2011-11-28 晚6:30-8:30(第14周周一)

考试地点:学10209

题型

一、名词解释:2小题*5分/小题=10分

二、填空题:10小空*2分/小空=20分

三、问答题:3题,每题10分,共30分

四、计算及分析题:5大题(5+5+10+10+10=40分)

考试复习

一、知识点

1.什么是数据挖掘

2.KDD的主要步骤

3.数据预处理

4.什么是众数,等深(频)等宽分箱(平滑:按箱平均值,按箱边界值)

5.数据仓库的定义

6.OLAP全称、基本分析功能(切片、切块、上卷、下转、转轴)

7.OLAP与OLTP的主要区别

8.多维数据模型:星型模型(事实表和维表)

雪花模型

事实星座模型

9.关联规则挖掘:Apriori, FP增长

规则兴趣度的度量:支持度与置信度

(强规则不一定是人们感兴趣的模式)

10.分类(有监督/有指导的学习)

分类的过程

决策树归纳分类(叶子节点、非叶子节点、分枝)

从决策树提规则

朴素贝叶斯分类

评价标准(同文本检索):准确率、召回率

11.聚类(无监督/无指导的学习)

什么是聚类,数据挖掘对聚类的典型要求有哪些?

主要的聚类算法: 划分

层次(凝聚和分裂)

基于密度

基于网格

基于模型

K-MEANS

12.孤立点分析/离群点分析

(孤立点未必是噪声)

13.Web挖掘,空间数据挖掘。

数据挖掘期末考试重点

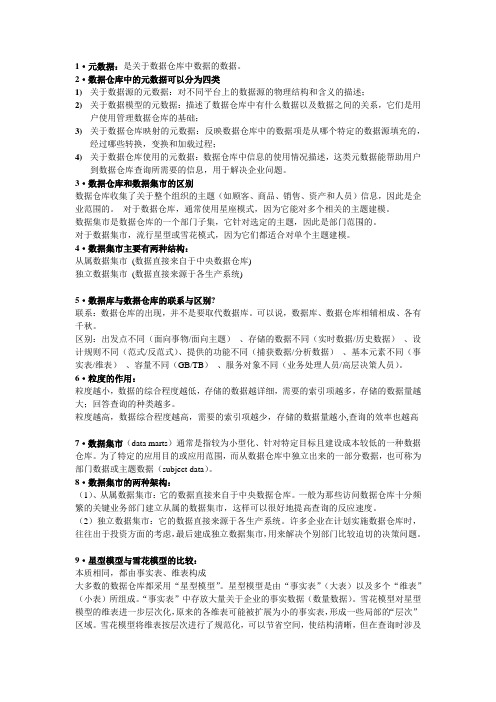

1·元数据:是关于数据仓库中数据的数据。

2·数据仓库中的元数据可以分为四类1)关于数据源的元数据:对不同平台上的数据源的物理结构和含义的描述;2)关于数据模型的元数据:描述了数据仓库中有什么数据以及数据之间的关系,它们是用户使用管理数据仓库的基础;3)关于数据仓库映射的元数据:反映数据仓库中的数据项是从哪个特定的数据源填充的,经过哪些转换,变换和加载过程;4)关于数据仓库使用的元数据:数据仓库中信息的使用情况描述,这类元数据能帮助用户到数据仓库查询所需要的信息,用于解决企业问题。

3·数据仓库和数据集市的区别数据仓库收集了关于整个组织的主题(如顾客、商品、销售、资产和人员)信息,因此是企业范围的。

对于数据仓库,通常使用星座模式,因为它能对多个相关的主题建模。

数据集市是数据仓库的一个部门子集,它针对选定的主题,因此是部门范围的。

对于数据集市,流行星型或雪花模式,因为它们都适合对单个主题建模。

4·数据集市主要有两种结构:从属数据集市(数据直接来自于中央数据仓库)独立数据集市(数据直接来源于各生产系统)5·数据库与数据仓库的联系与区别?联系:数据仓库的出现,并不是要取代数据库。

可以说,数据库、数据仓库相辅相成、各有千秋。

区别:出发点不同(面向事物/面向主题)、存储的数据不同(实时数据/历史数据)、设计规则不同(范式/反范式)、提供的功能不同(捕获数据/分析数据)、基本元素不同(事实表/维表)、容量不同(GB/TB)、服务对象不同(业务处理人员/高层决策人员)。

6·粒度的作用:粒度越小,数据的综合程度越低,存储的数据越详细,需要的索引项越多,存储的数据量越大;回答查询的种类越多。

粒度越高,数据综合程度越高,需要的索引项越少,存储的数据量越小,查询的效率也越高7·数据集市(data marts)通常是指较为小型化、针对特定目标且建设成本较低的一种数据仓库。

数据挖掘期末复习提纲(整理版)

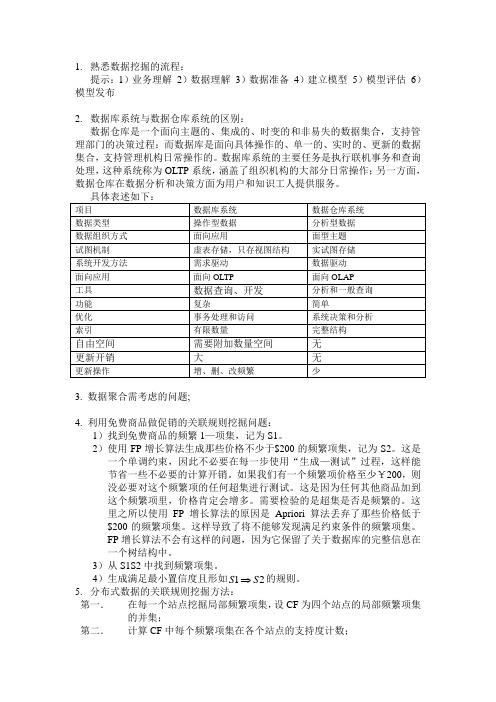

1.熟悉数据挖掘的流程:提示:1)业务理解2)数据理解3)数据准备4)建立模型5)模型评估6)模型发布2.数据库系统与数据仓库系统的区别:数据仓库是一个面向主题的、集成的、时变的和非易失的数据集合,支持管理部门的决策过程:而数据库是面向具体操作的、单一的、实时的、更新的数据集合,支持管理机构日常操作的。

数据库系统的主要任务是执行联机事务和查询处理,这种系统称为OLTP系统,涵盖了组织机构的大部分日常操作;另一方面,数据仓库在数据分析和决策方面为用户和知识工人提供服务。

3. 数据聚合需考虑的问题;4. 利用免费商品做促销的关联规则挖掘问题:1)找到免费商品的频繁1—项集,记为S1。

2)使用FP增长算法生成那些价格不少于$200的频繁项集,记为S2。

这是一个单调约束,因此不必要在每一步使用“生成—测试”过程,这样能节省一些不必要的计算开销。

如果我们有一个频繁项价格至少¥200,则没必要对这个频繁项的任何超集进行测试。

这是因为任何其他商品加到这个频繁项里,价格肯定会增多。

需要检验的是超集是否是频繁的。

这里之所以使用FP增长算法的原因是Apriori算法丢弃了那些价格低于$200的频繁项集。

这样导致了将不能够发现满足约束条件的频繁项集。

FP增长算法不会有这样的问题,因为它保留了关于数据库的完整信息在一个树结构中。

3)从S1S2中找到频繁项集。

4)生成满足最小置信度且形如2S 的规则。

1S5.分布式数据的关联规则挖掘方法:第一.在每一个站点挖掘局部频繁项集,设CF为四个站点的局部频繁项集的并集;第二.计算CF中每个频繁项集在各个站点的支持度计数;第三.计算CF中每个项集的全局支持度计数,可以通过将它在四个站点的局部支持度计数累加起来;那些全局支持度大于支持度阀值的项集为频繁项集;第四.从全局频繁项集里导出强规则。

6.急切分类、惰性分类的优缺点:急切分类比惰性分类在速度上要更快。

因为它在接受新的待测数据之前已经构造了一个概括的模型。

汕头大学数据挖掘期末复习

大学2019数据挖掘期末复习资料(浩军老师班)考试围:数据预处理、数据关联分析、分类与预测、SVM、K-MEANS、聚类考试题型:简答题,复习请以实验相关容为主数据挖掘课程的主要容:1.数据挖掘概述2.数据预处理3.数据挖掘算法-关联分析4.数据挖掘算法-分类与预测5.数据挖掘算法-聚类分析一、数据挖掘概述什么是数据挖掘?数据挖掘概念:从大量数据中寻找其规律的技术,是统计学、数据库技术和人工智能技术(机器学习)的综合。

数据挖掘定义:数据挖掘(Data Mining)就是从大量的、不完全的、有噪声的、模糊的、随机的实际应用数据中,提取隐含在其中的、人们事先不知道的、但又是潜在有用的信息和知识的过程。

数据的特征:大容量、含噪音(不完全、不正确)、异质数据(多种数据类型混合的数据源,来自互联网的数据是典型的例子)数据挖掘有哪些步骤?1.确定预测目标2.统计数据特征3.根据数据特征进行数据预处理4.应用数据挖掘模型(分类、聚类、关联分析、离群点挖掘、标记等)5.分析模型的准确率6.找出影响模型准确率的因素,回到第3步迭代直到模型足够完美。

二、数据预处理数据预处理有哪些步骤?1.数据清理2.数据集成3.数据归约4.数据变换与数据离散化为什么要进行数据预处理?现实世界的数据是不完整的、含有噪声的、不一致的、冗余的。

低质量的数据将导致低质量的挖掘结果。

1)现实世界的数据一般是脏的、不完整的和不一致的。

2)数据预处理技术可以改进数据的质量,从而有助于提高其后的挖掘过程的精度和性能。

3) 高质量的决策必然依赖于高质量的数据,因此数据预处理是知识发现过程的重要步骤。

数据的质量涉及的三个要素是?准确性,完整性和一致性。

现实世界的数据一般是脏的不完整的不一致的。

数据预处理技术可以改善数据的质量。

如何填充数据中存在的缺失值?1.忽略元组(删除)2.使用一个全局常量填充空缺值(例如NULL)3.使用属性的平均值、众数、中位数来填充空缺值4.人工填充空缺值数据清理补充缺失的属性值:使用属性的中心度量(如均值或者中位数或者众数(频率度量出现单峰)填充缺失值。

数据挖掘导论期末试题及答案

数据挖掘导论期末试题及答案第一部分:试题问答题1. 数据挖掘的定义是什么?2. 数据挖掘的过程包括哪些步骤?3. 请简要解释数据预处理的步骤。

4. 请列举常用的数据挖掘算法。

5. 请解释聚类分析和分类分析的区别。

6. 什么是关联规则挖掘?请给出一个例子。

7. 在数据挖掘过程中,如何评估模型的性能?8. 什么是过拟合?如何避免过拟合?9. 数据挖掘有哪些应用领域?10. 请简要介绍数据挖掘中的隐私保护技术。

编程题1. 给定一个包含n个整数的列表,请编写Python代码来计算列表中所有数的平均值。

2. 使用Python编写一个函数,接受两个参数n和m,返回一个列表,其中包含从n到m之间所有偶数的平方。

3. 在Python中,定义函数calcBMI(height, weight),接受一个人的身高(单位:米)和体重(单位:千克),计算并返回该人的BMI指数。

4. 使用Python编写一个函数,接受一个字符串作为参数,返回字符串中每个字符出现的次数。

第二部分:答案问答题1. 数据挖掘的定义是从大量的数据中发现先前未知、可理解和实际可用的模式的过程。

2. 数据挖掘的过程包括数据收集、数据预处理、特征选择、算法选择、模型构建、模型评估和模型应用等步骤。

3. 数据预处理的步骤包括数据清洗、数据集成、数据变换和数据规约。

4. 常用的数据挖掘算法包括决策树算法、朴素贝叶斯算法、支持向量机算法、K均值算法和关联规则挖掘算法等。

5. 聚类分析是将数据对象分为不同的组别,而分类分析是根据已有的分类标签对数据对象进行分类。

6. 关联规则挖掘是在大规模数据集中寻找项目之间的有趣关系的过程。

例如,购买尿布的人也倾向于购买婴儿食品。

7. 评估模型的性能可以使用准确率、精确率、召回率、F1值等指标进行评估。

8. 过拟合是指模型在训练集上表现很好,但在测试集或真实数据上表现糟糕的现象。

为了避免过拟合,可以使用交叉验证、正则化等方法。

数据挖掘期末考试复习题(精).doc

1数据挖掘来源于机器学习2数据仓库是面向主题的集成的稳定的不同时间的数据集合,用于支持经营管理中决策制定过程;3元素据描述了数据仓库的数据和环境,遍及数据仓库的所有方面,是整个数据仓库的核心,4Codd将数据分析模型分为四类绝对模型解释模型思考模型或公式化;5数据立方体是在所以可能组合的维上进行分组聚集运算的总和;6 (数据质量)是(|数据仓库|)的成败关键; 7概括分析是探索者分析过程的第一步。

8.数据仓库的物理模型设计是对逻辑模型设计的数据模型确定物理存储结构和存取方法。

9.自组织网络以ART模型,Kohonen模型为代表,用于聚集类。

10.预测是利用历史数据找出变化规律,建立模型。

并用此模型来预测未来数据的种类,特征等;11调和数据是存储在企业级数据仓库和操作型数据存储中的数据。

12 S Q L Server ssas提供了所以业务数据的同意整合试图,可以作为传统报表和数据挖掘,在线分析处理,关键性能指示器记分卡的基础13数据仓库的概念模型定义通常采用信息包括图法来进行设计;14关联规则的经典算法包括()()15分类关联规则16分类器设计阶段包含划分数据集,分类器构造,分类器测试;16雪花模型是对星型模型式维表的进一步层次化和规范化来消除冗余的数据;17数据处理通常分为两大类,联机事务处理,联机分析处理。

18数据抽取的两个常见类型是静态抽取和增量抽取;19维度表一般由主键,分类层次和描述属性组成。

20 ROLAp是基于关系数据库的OLAP实现,而MO L AP是基于多维数据机构组织的OLAP实现。

21数据仓库按照其开发过程,其关键环节包括数据抽取,数据存储,数据管理,数据表现。

2 2 KD D是从数据集中识别出有效的新颖的潜在有用的以及最终可理解的模式的高级处理过程。

2 3 遗传算法的基本要素问题编码:初始群体的设定:适应值函数的设计:遗传操作设计;控制参数设定:24数据集市数据集市是指具有特定应用的数据仓库,主要针对某个具有应用战与意义的应用或者具体部门级的应用,支持用户利用自己有的数据获得重要竞争的优势。

数据挖掘期末复习

目录1什么是数据挖掘(Data Mining)?请举例。

(2)2简述知识发现(KDD)过程。

(2)3简述数据挖掘的功能。

(PPT引言1.4) (2)4为什么要进行数据预处理?(PPT2,1) (3)5怎样平滑噪声数据(ppt2.3.2) (3)6在数据清理中,对缺失值有哪些处理方法? (4)7描述数据有哪几种基本图形形式? (4)8简述盒图的作用。

(4)9规范化有哪些形式,举例。

(4)10按照分箱法对数据进行离散化。

(5)11什么是数据仓库?或数据仓库的4特性? (6)12简述数据仓库建模的基本模式。

(3种,可图示)PPT数据仓库P40~49 (6)13频繁模式与关联规则基本概念,最大频繁项,闭合频繁项。

PPT8.1 (8)14 Apriori算法基本步骤。

能够根据所给数据写出算法具体执行过程。

(9)15何为Apriori性质、反单调性? (9)分析算法效率。

PPT 8 P25~27 (9)16简述FP-Growth算法基本步骤。

(9)17比较Apriori与FP-Growth算法。

(优缺点、适用范围?) (11)18阐述决策树分类的主要步骤,有哪些算法? (11)19阐述神经网络分类的主要原理。

(三层结构,后向传播) (14)20简述最近邻分类的原理。

(14)21什么是急切学习法、惰性学习法? (14)22什么是聚类分析? (15)23什么是层次聚类?有哪几种类型? (15)24简述K-均值方法基本步骤,优缺点。

(15)25写出几种典型层次聚类算法的名称、各自特点。

(16)26简述基于密度的聚类方法,例如DBSCAN。

(16)1什么是数据挖掘(Data Mining)?请举例。

●数据挖掘:是从大量数据中提取或"挖掘"知识,也就是从存放在数据库,数据仓库或其他信息库中的数据挖掘有趣知识的过程.●数据挖掘是可以从数据库中提取有趣的知识规律或高层信息发现的知识,可以用于决策,过程控制,信息管理,查询处理.●它不是一种从数据库,统计学和机器学习发展的技术的简单转化,它涉及多学科技术的集成,包括数据库技术,统计学,机器学习,高性能计算模式识别,神经网络,数据可视化,信息检索,图象与信号处理和空间数据分析.随着数据库技术发展,数据的丰富带来了对强有力的数据分析工具的需求,大量的数据被描述为"数据丰富,但信息贫乏",所以数据挖掘出来了.意义:需求:数据丰富,但知识贫乏。

数据挖掘期末知识点总结

数据挖掘期末知识点总结数据挖掘是一门涉及统计学、机器学习、数据库技术、数据可视化等多个学科的交叉学科,是从大量数据中发现隐含模式、关系和知识的过程。

在当今信息爆炸的时代,数据挖掘成为了一个重要的工具,它可以帮助企业发现商机、政府做决策、学术界进行研究等,因此受到了广泛的关注。

在这篇文章中,我将对数据挖掘的一些重要知识点进行总结,包括数据预处理、数据挖掘模型、评估指标等内容,希望能够对大家有所帮助。

1. 数据预处理数据预处理是数据挖掘中非常重要的一步,其目的是将原始数据转换成适合建模的数据。

数据预处理包括数据清洗、数据集成、数据变换和数据约简等步骤。

数据清洗是指处理数据中的噪声和异常值,使数据更加干净。

数据集成是指将多个数据源中的数据合并成一个数据集。

数据变换是指将数据转换成适合建模的形式,比如将分类数据转换成数值型数据。

数据约简是指减少数据集的复杂度,降低建模的难度。

2. 数据挖掘模型数据挖掘模型是数据挖掘的核心,它是用来从数据中抽取知识的工具。

常见的数据挖掘模型包括分类、聚类、关联规则挖掘、回归分析等。

分类是一种用于预测离散型变量的模型,主要包括决策树、支持向量机、朴素贝叶斯等。

聚类是一种用于将数据集分成若干类的模型,主要包括K均值聚类、层次聚类、密度聚类等。

关联规则挖掘是一种用于发现数据项之间的关联关系的模型,主要用于市场篮子分析。

回归分析是一种用于预测数值型变量的模型,主要包括线性回归、多项式回归、岭回归等。

3. 评估指标评估指标用于评价数据挖掘模型的性能,常见的评估指标包括准确率、召回率、精确度、F1值、ROC曲线等。

准确率是模型预测正确的样本数占总样本数的比例。

召回率是模型预测出的正样本中实际为正样本的比例。

精确度是模型预测出的正样本中实际为正样本的比例。

F1值是精确度和召回率的调和平均数,综合考虑了精确度和召回率的性能。

ROC曲线是一种用于评价二分类模型性能的图像指标,它反映了模型在不同阈值下的性能表现。

数据挖掘期末考试试题(含答案)

数据挖掘期末考试试题(含答案)题目一:数据预处理题目描述:给定一个包含缺失值的数据集,采取合适的方法对缺失值进行处理,并解释你的方法选择的原因。

答案:缺失值在数据分析中是一个常见的问题。

我选择使用均值填充的方法来处理缺失值。

这种方法将缺失的值用该特征的均值进行代替。

我选择均值填充的原因是因为这种方法简单易用,并且可以保持数据的整体分布特征。

均值填充假设缺失值与观察到值的分布相似,因此使用均值填充可以避免引入过多的噪音。

题目二:关联规则挖掘题目描述:给定一个购物篮数据集,包含多个商品的组合,使用Apriori 算法挖掘频繁项集和关联规则,并给出相关的评估指标。

答案:Apriori算法是一种常用的关联规则挖掘算法。

它通过计算支持度和置信度来挖掘频繁项集和关联规则。

首先,通过扫描数据集,计算每个项集的支持度。

然后,根据设定的最小支持度阈值,选取频繁项集作为结果。

接着,根据频繁项集,计算每个规则的置信度。

利用最小置信度阈值,筛选出高置信度的关联规则。

评估指标包括支持度、置信度和提升度。

支持度衡量一个项集在数据集中出现的频率,置信度衡量规则的可信程度,提升度衡量规则对目标项集出现的增益。

题目三:聚类算法题目描述:给定一个数据集,包含多个样本和多个特征,使用K-means算法将样本划分为K个簇,并解释评估聚类性能的指标。

答案:K-means算法是一种常用的聚类算法。

它通过迭代的方式将样本划分为K个簇。

首先,随机选择K个初始聚类中心。

然后,对于每个样本,计算其与每个聚类中心的距离,并将其划分到距离最近的簇中。

接着,更新每个簇的聚类中心,计算新的聚类中心位置。

重复以上步骤,直到聚类中心不再发生变化或达到预定的迭代次数。

评估聚类性能的指标包括簇内平方和(SSE)和轮廓系数。

簇内平方和衡量样本与其所属簇的距离之和,SSE越小表示聚类效果越好。

轮廓系数衡量样本与其所属簇以及其他簇之间的距离,值介于-1到1之间,越接近1表示聚类效果越好。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

汕头大学2019数据挖掘期末复习资料(浩军老师班)考试范围:数据预处理、数据关联分析、分类与预测、SVM、K-MEANS、聚类考试题型:简答题,复习请以实验相关内容为主数据挖掘课程的主要内容:1.数据挖掘概述2.数据预处理3.数据挖掘算法-关联分析4.数据挖掘算法-分类与预测5.数据挖掘算法-聚类分析一、数据挖掘概述什么是数据挖掘?数据挖掘概念:从大量数据中寻找其规律的技术,是统计学、数据库技术和人工智能技术(机器学习)的综合。

数据挖掘定义:数据挖掘(Data Mining)就是从大量的、不完全的、有噪声的、模糊的、随机的实际应用数据中,提取隐含在其中的、人们事先不知道的、但又是潜在有用的信息和知识的过程。

数据的特征:大容量、含噪音(不完全、不正确)、异质数据(多种数据类型混合的数据源,来自互联网的数据是典型的例子)数据挖掘有哪些步骤?1.确定预测目标2.统计数据特征3.根据数据特征进行数据预处理4.应用数据挖掘模型(分类、聚类、关联分析、离群点挖掘、标记等)5.分析模型的准确率6.找出影响模型准确率的因素,回到第3步迭代直到模型足够完美。

二、数据预处理数据预处理有哪些步骤?1.数据清理2.数据集成3.数据归约4.数据变换与数据离散化为什么要进行数据预处理?现实世界的数据是不完整的、含有噪声的、不一致的、冗余的。

低质量的数据将导致低质量的挖掘结果。

1)现实世界的数据一般是脏的、不完整的和不一致的。

2)数据预处理技术可以改进数据的质量,从而有助于提高其后的挖掘过程的精度和性能。

3) 高质量的决策必然依赖于高质量的数据,因此数据预处理是知识发现过程的重要步骤。

数据的质量涉及的三个要素是?准确性,完整性和一致性。

现实世界的数据一般是脏的不完整的不一致的。

数据预处理技术可以改善数据的质量。

如何填充数据中存在的缺失值?1.忽略元组(删除)2.使用一个全局常量填充空缺值(例如NULL)3.使用属性的平均值、众数、中位数来填充空缺值4.人工填充空缺值数据清理补充缺失的属性值:使用属性的中心度量(如均值或者中位数或者众数(频率度量出现单峰)填充缺失值。

使用最可能的值填充缺失值(可以用回归,使用贝叶斯形式化方法)光滑数据,去掉噪声:噪声是被测量的变量的随机误差或者方差。

数据光滑的技术:分箱法,把有序的数据数量等频地分到箱子中,可以用箱的均值光滑,用箱的边界值光滑,用箱的中位数光滑。

数据集成将数据由多个数据源合并成一个一致的数据存储,如数据仓库(集成多个数据库)。

数据归约可以通过如聚集、删除冗余特征或者聚类来降低数据的规模。

(得到数据的简化表示)简化数据、但产生相同或者相似的结果通过选择替代的、“较小的”数据表示形式来减少数据量。

数据变换(例如,规范化,离散化)可以把数据压缩到较小的区间,如0.0到1.0。

这可以提高涉及距离度量的挖掘算法的准确率和效率。

规范化和聚集数据最小-最大规范化最小-最大规范化:将原始数据v经线性变换,映射到区间[new_minA, new_maxA]选择区间,找到数据最大值和最小值,进行区间规范化离群点可能影响规范化零族规范化z-score规范化(零均值规范化):属性A的值基于A的平均值和标准差规范化。

对离群点不敏感AAvvσμ-='离散化:通俗的说,离散化是在不改变数据相对大小的条件下,对数据进行相应的缩小。

概念解释离群点:与数据的一般行为或模型不一致的数据对象数据错误不可避免数据输入和获取过程出现的错误数据集成表现出来的错误数据传输过程所引入的错误分箱:通过考察数据的“近邻”(周围的值)来光滑有序数据的值。

局部光滑。

回归:(线性回归,多元线性回归)用一个函数(回归函数)拟合数据来光滑数据。

聚类:将类似的值聚集为簇。

可以识别并删除离群点、解决数据的不一致基本描述数据汇总的图形显示(数据排序后使用)盒图(需要先将数据进行有序排列):盒图可以用五数概括(上下四分位数、中位数、上下边缘)四分位数是3个值,把排序的数据集分成4个相等的部分。

盒的端点一般在四分位数上,使得盒的长度是四分位数的极差IQR(上四分位数75%,下四分位数25%)中位数用盒内的线标记。

盒外两条虚线(称为胡须)延伸到最小和最大的观测值(上边缘、下边缘)。

超过过四分位数1.5*IQR时,单独画出离群点,否则让胡须扩展到它们。

直方图:通常让一个桶代表给定属性的一个连续值域。

概括给定属性分布的图形方法,每个矩形等宽。

分位数图:是一种观察单变量数据分布的简单有效的方法。

分位数-分位数图可以查看一个分布到另外一个分布是否有漂移(确定间隔)散布图(散点图):是一种观察双变量数据的有用的方法,用于观察点簇和离群点,或考察相关联系的可能性。

确定两个数值变量之间看上去是否存在联系、模式或者趋势的有效图形之一。

两个变量属性的三个关系可以从散点图上看出来:正相关、负相关、不相关。

分布式度量、代数度量、整体度量的概念1)分布式度量:可以通过如下方法计算度量(即函数):将数据集划分成较小的子集,计算每个子集的度量,然后合并计算结果,得到原(整个)数据集的度量值。

sum()、count()、min()、max()2)代数度量:可以通过应用一个代数函数于一个或多个分布度量计算的度量(平均数sum/count)3)整体度量:必须对整个数据集计算的度量。

例如:中位数、众数三、数据关联分析关联规则挖掘(Association Rule Mining)是数据挖掘中最活跃的研究内容之一。

一个典型的关联规则的例子:70%购买了牛奶的顾客将倾向于同时购买面包。

发现这样的关联规则可以为市场预测、决策和策划等方面提供依据。

技术用语解释:频繁模式是频繁地出现在数据集中的模式(如项集、子序列、子结构)频繁项集:例如,频繁地同时出现在交易数据集中的商品项目(如牛奶与面包)的集合是频繁项集。

序列模式:例如,先买PC,然后是数码相机,再后是内存卡,如果它频繁地出现在历史数据库中,则称它为一个频繁的序列模式。

子结构:一个子结构可能涉及不同的结构形式,如子图、子树或者子格,它可能与项集或者子序列结合在一起。

如果一个子结构频繁地出现,则称它为频繁的结构模式。

关联规则中的支持度和置信度?规则的支持度和置信度是规则兴趣度的两种度量。

它们分别反映所发现规则的有用性和确定性。

Computer=>antivirus_software[support = 2%;confidence =60%]表示所分析的所有事物的2%显示计算机和杀毒软件被同时购买,置信度60%意味购买计算机的顾客60%也购买了杀毒软件。

支持度(项集X在交易集中出现的概率)可信度(置信度)⏹关联规则的可信度(Confidence)是指包含X和Y的交易数与包含X的交易数之比:support(X)Y)support(XY)(Xconfidence⋃=⇒⏹关联规则的可信度反映了如果交易中包含X,则交易中同时出现Y的概率。

⏹例如:关联规则R1: {bread} ⇒ {milk}的可信度为confidence(R1) =support({bread,milk}) / support({bread})= 0.5/0.7 = 5/7。

项目与项集⏹设I={i1, i2, …, i m}是由m个不同项目构成的集合,其中的每个i k (k=1, 2, …, m)被称为一个项目(Item)。

❑例如:在超市的关联规则挖掘中,项目就是顾客购买的各种商品,如:bread, milk等。

⏹项目的集合I被称为项目集合(Itemset),简称项集。

❑I中元素个数称为项集的长度;⏹例如:超市出售6种商品,即:项集I中包含6个项目,则I的长度为6。

❑长度为k的项集称为k-项集(k-Itemset)。

⏹例如:对于项集{cake, milk},可称为2-项集。

项集的最小支持度与频繁集⏹用于发现关联规则的项集必须满足的最小支持度的阈值,称为项集的最小支持度(Minimum Support),记为sup min。

❑从统计意义上讲,它表示用户关心的关联规则必须满足的最低重要性。

❑只有满足最小支持度的项集才能产生关联规则。

⏹支持度大于或等于sup min的项集称为频繁项集,简称频繁集,反之则称为非频繁集。

❑通常,k-项集如果满足sup min,可称为k-频繁集,记作L k。

强关联规则⏹关联规则的最小支持度(Minimum Support)表示关联规则需要满足的最低支持度,记为sup min。

⏹关联规则的最小可信度(Minimum Confidence)表示关联规则需要满足的最低可信度,记为conf min。

⏹如果关联规则同时满足如下两个条件:support(X⇒Y) ≥ sup minconfidence(X⇒Y) ≥ conf min⏹称关联规则为强关联规则,否则称为弱关联规则。

⏹在挖掘关联规则时,产生的关联规则要经过sup min和conf min的衡量,筛选出来的强关联规则才能用于指导决策。

关联规则的挖掘:经典算法:Apriori算法关联规则挖掘包含以下两个步骤:⏹首先,找出所有频繁集;⏹其次,由频繁集产生强关联规则。

Apriori算法通过多次扫描数据集,找出所有频繁集,然后用这些频繁集产生强关联规则Apriori算法通过迭代来穷举出数据集中的所有频繁集。

⏹算法过程:❑输入数据集D,最小支持度阈值SUPmin❑首先,产生1-频繁集L1;❑其次,在L1上通过连接和修剪产生2-频繁集L2;❑依次类推,可在L k上通过连接和修剪产生(k+1)-频繁集L k+1;❑最后,直到无法产生新的频繁集为止。

⏹连接:只相差一个项目的两个项集才能进行连接(集合“并”操作)。

例如:由L2生成C3的过程中,L2中的{A,C}和{B,C}只相差一个项目,因此它们可以连接生成{A,B,C}。

但是,L2中的{A,C}和{B,E}无法进行连接。

⏹修剪:去除子集不是频繁集的项集。

Apriori算法的性质:频繁集的所有非空子集也一定是频繁的。

例如:虽然L2中的{A,C}和{B,C}可以连接生成{A,B,C},但是由于{A,B,C}的子集{A,B}不是频繁集(不在L2中),因此,需要从C3中删除{A,B,C} 。

描述算法过程:1.输入:数据集D,最小支持度阈值sup min。

2.K=13.产生CK:K-候选频繁集4.根据最小支持度筛选K-候选频繁集生成LK:K-频繁集5.循环2~3步骤,直到无法生成新的频繁集为止6.输出可以产生关联规则的所有频繁集L。

Apriori的挑战与改进思路⏹挑战❑多遍事务数据库扫描❑候选频繁项集的数目巨大❑候选项集的计数工作量较大⏹改进Apriori:思路❑减少事务数据库扫描次数❑减少候选项集数目❑有效支持候选项集的计数提高Apriori的有效性1.基于散列的技术2.事务压缩3.划分4.抽样5.动态项集技术四、数据分类与预测分类有那些方法,优缺点?判定树归纳分类(缺失数据敏感)-优点:1.决策树易于理解和解释2.能够同时处理数据型和常规型属性3.在相对短的时间内能够对大型数据源做出可行且效果良好的结果。