MATLAB 判别分析

数模-化验结果判别及matlab程序

地贫患者的基因筛查问题摘要地中海贫血(简称“地贫”)是全球广为流行、危害极为严重的遗传性溶血性疾病,全世界至少有亿人携带地中海贫血的致病基因。

医学上通过大人群的基因筛查来预防地贫患儿的出生。

本文应用统计学原理,对病人以及健康人的110个基因进行分析,采用Fisher判别模型建立判别标准和多元统计模型spss 软件进行筛选。

问题一,利用费希尔模型判别待测者是否患有地贫,以编号1~20地贫患者的样本,编号21~40健康人员的样本,分别作为模版建立模型,用mathlab软件求解得到待测组的患病者编号41~60个是待筛查人员的样本。

问题二,为确定“地贫”样本与“健康”样本在基因链上的区别。

以及癌症样本中是否有子类。

我们用1~20数据为标准化并确立相关系数矩阵,求出相关矩阵的特征值和特征向量,然后通过前m 个主成分的累计贡献率满足%85)1/()1(≥∑=∑=kikkikλλ来确定贡献率矩阵,从而得出各种基因的权值,又利用初始特征值需大于 1,再运用逐步剔除法得出关键基因关键字:地贫患者的基因 Fisher判别筛查相关系数矩阵1 问题重述化验指标能够协助医生诊断。

人们到医院就诊时,诊断就诊人员是否患肾炎时通常要化验人体内各种元素含量。

表是确诊病例的化验结果,其中1-30号病例是已经确诊为肾炎病人的化验结果;31-60号病例是已经确定为健康人的结果。

表是就诊人员的化验结果。

1.根据表中的数据,提出一种或多种简便的判别方法,判别属于患者或健康人的方法,并检验你提出方法的正确性。

2.按照1提出的方法,判断表中的30名就诊人员的化验结果进行判别,判定他(她)们是肾炎病人还是健康人。

3.能否根据表的数据特征,确定哪些指标是影响人们患肾炎的关键或主要因素,以便减少化验的指标。

4.根据3的结果,重复2的工作。

5.对2和4的结果作进一步的分析。

2 问题分析问题解决的关键是如何正确判断正常人与患者之间的差异,利用所给数据,可以选择用医学统计方法[1]中的判别分析法[2]进行分析。

FISHER线性判别MATLAB实现

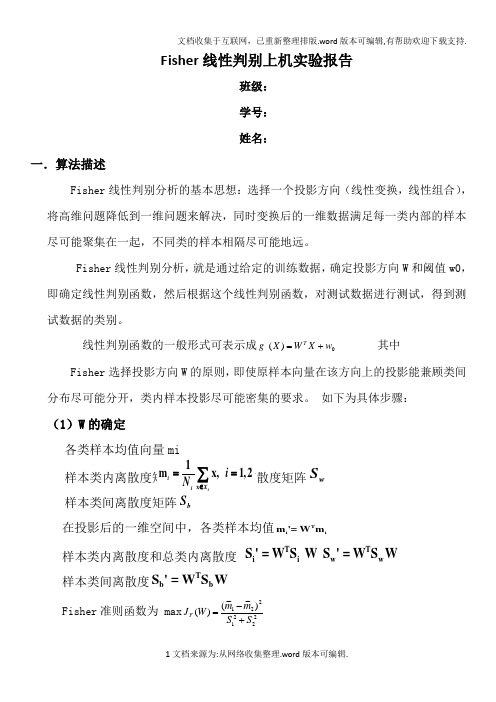

Fisher 线性判别上机实验报告班级: 学号: 姓名:一.算法描述Fisher 线性判别分析的基本思想:选择一个投影方向(线性变换,线性组合),将高维问题降低到一维问题来解决,同时变换后的一维数据满足每一类内部的样本尽可能聚集在一起,不同类的样本相隔尽可能地远。

Fisher 线性判别分析,就是通过给定的训练数据,确定投影方向W 和阈值w0, 即确定线性判别函数,然后根据这个线性判别函数,对测试数据进行测试,得到测试数据的类别。

线性判别函数的一般形式可表示成0)(w X W X g T += 其中Fisher 选择投影方向W 的原则,即使原样本向量在该方向上的投影能兼顾类间分布尽可能分开,类内样本投影尽可能密集的要求。

如下为具体步骤:(1)W 的确定w S 样本类间离散度矩阵b在投影后的一维空间中,各类样本均值Tiim '= Wm样本类内离散度和总类内离散度 T Ti i ww S ' = W S W S ' = W S W 样本类间离散度Tbb S ' = W S W Fisher 准则函数为 max 2221221~~)~~()(S S m m W J F +-=(2)阈值的确定w 0是个常数,称为阈值权,对于两类问题的线性分类器可以采用下属决策规则: 令)()()(21x x x g g g -=则:如果g(x)>0,则决策w x 1∈;如果g(x)<0,则决策w x 2∈;如果g(x)=0,则可将x 任意分到某一类,或拒绝。

(3)Fisher 线性判别的决策规则 Fisher 准则函数满足两个性质:1.投影后,各类样本内部尽可能密集,即总类内离散度越小越好。

2.投影后,各类样本尽可能离得远,即样本类间离散度越大越好。

根据这个性质确定准则函数,根据使准则函数取得最大值,可求出W :-1w 12W = S (m - m ) 。

这就是Fisher 判别准则下的最优投影方向。

使用Matlab进行数据降维的基本步骤

使用Matlab进行数据降维的基本步骤数据降维是一种常用的数据预处理技术,它可以降低数据的维度,减少数据的冗余信息,提高数据的处理效率和模型的精确度。

在实际应用中,我们经常需要处理高维数据,如图像、文本、视频等,而高维数据的处理会带来计算和存储的问题,因此需要经过降维处理。

本文将介绍使用Matlab进行数据降维的基本步骤。

一、数据预处理在进行数据降维之前,通常需要对数据进行一些预处理,以减少数据中的噪音和冗余信息。

常见的数据预处理方法包括数据清洗、数据归一化和特征选择等。

在Matlab中,可以使用预处理工具箱来实现这些功能。

1. 数据清洗数据清洗是指对数据进行预处理,去除其中的噪音、异常值和缺失值等。

在Matlab中,可以使用函数`ismissing`和`fillmissing`来检测和处理缺失值,可以使用函数`isoutlier`来检测和处理异常值。

2. 数据归一化数据归一化是指将数据按比例缩放到一个特定的范围,以消除不同量纲和量级的影响。

常见的数据归一化方法包括最小-最大归一化和标准化。

在Matlab中,可以使用函数`normalize`来实现数据归一化。

3. 特征选择特征选择是指从原始特征中选择一部分最有代表性的特征,以减少特征维度和冗余信息。

常见的特征选择方法包括过滤式、包裹式和嵌入式等。

在Matlab中,可以使用函数`featureSelection`来实现特征选择。

二、降维方法在进行数据降维之前,需要选择合适的降维方法。

常见的降维方法包括主成分分析(PCA)、线性判别分析(LDA)和核主成分分析(KPCA)等。

在Matlab中,可以使用降维工具箱来实现这些方法。

1. 主成分分析(PCA)主成分分析是一种常用的无监督降维方法,它通过线性变换将原始特征空间转化为新的特征空间,新的特征空间中的每个维度都是原始特征的线性组合。

在Matlab中,可以使用函数`pca`来实现主成分分析。

2. 线性判别分析(LDA)线性判别分析是一种常用的有监督降维方法,它通过线性变换将原始特征空间转化为新的特征空间,新的特征空间中的每个维度都是原始特征的线性组合,并且使得不同类别的样本之间的距离最大化。

多元统计分析MATLAB

多元统计分析MATLABMATLAB是一种用于技术计算和数据可视化的高级编程语言和环境。

它提供了丰富的工具箱和函数,用于进行多元统计分析,并能够帮助用户处理和分析大规模的数据。

在MATLAB中,可以使用各种函数进行多元统计分析,包括主成分分析(PCA)、多元方差分析(MANOVA)、线性回归、多元线性回归、判别分析、聚类分析和因子分析等。

这些函数可以帮助用户处理和分析多维数据,找到关键变量,解释变量之间的关系,并从数据中提取有用的信息。

主成分分析(PCA)是一种常用的多元统计分析方法,可用于降维和特征提取。

PCA可以将原始数据转化为一组新的无关变量,称为主成分,这些主成分是原始数据中方差最大的方向。

通过PCA,可以减少数据的维度,并可视化数据的分布和模式。

多元方差分析(MANOVA)是一种常用的多元统计分析方法,可用于比较两个或多个组别之间的差异。

MANOVA可以同时考虑多个因变量,并判断它们之间的差异是否显著。

它可以帮助我们理解多个因变量与一个或多个自变量之间的关系。

线性回归和多元线性回归是常见的用于建立因变量与自变量之间关系的统计方法。

MATLAB提供了强大的线性回归函数,可以帮助用户拟合线性模型,并评估模型的拟合优度。

判别分析是一种分类方法,可用于将观测对象分为不同的组别。

MATLAB中提供了各种判别分析函数,可用于建立分类模型,并预测新的观测对象所属的组别。

聚类分析是一种无监督学习方法,可用于将观测对象划分为相似的组别。

MATLAB中提供了各种聚类分析函数,如k-means和层次聚类,可用于对数据进行聚类,并将相似的观测对象放在一起。

因子分析是一种用于确定观测变量之间的潜在结构的统计方法。

MATLAB中提供了因子分析函数,可用于提取主成分和因子,并解释观测变量之间的关系。

综上所述,MATLAB提供了丰富的工具和函数,可用于进行多元统计分析。

这些方法可以帮助用户处理和分析大规模的数据,找到关键变量,解释变量之间的关系,并从数据中提取有用的信息。

Matlab中的多变量数据分析方法介绍

Matlab中的多变量数据分析方法介绍引言:数据分析是现代科学和工程领域中的重要组成部分。

在大数据时代,我们经常需要处理和分析的是多个变量之间的复杂关系。

Matlab作为一个功能强大的数值计算环境,提供了许多用于多变量数据分析的工具和函数。

本文将介绍一些常用的Matlab多变量数据分析方法,并结合实际案例进行说明。

一、主成分分析(Principal Component Analysis)主成分分析是一种经典的多变量数据分析方法,它可以将高维数据集映射到一个更低维的空间中,同时保持数据的主要特征。

在Matlab中,可以使用pca函数来进行主成分分析。

下面我们以一组山地气象数据为例,进行主成分分析:```matlabload data.mat[coeff,score,latent,tsquared] = pca(data);```上述代码中,`data`是一个包含多个变量的矩阵,`coeff`表示主成分分析后的系数矩阵,`score`表示投影后的数据集,`latent`是每个主成分的方差贡献率,`tsquared`表示样本点的Hotelling T^2统计量。

二、聚类分析(Cluster Analysis)聚类分析是一种将样本分组为具有相似特征的群组的方法。

在Matlab中,可以使用`clusterdata`函数进行聚类分析。

下面我们以一个鸢尾花的数据集为例,对花的属性进行聚类分析:```matlabload fisheririsclust = clusterdata(meas, 'linkage', 'ward', 'maxclust', 3);```上述代码中,`meas`是一个包含多个花的属性的矩阵,`clust`表示每个样本所属的聚类簇。

三、因子分析(Factor Analysis)因子分析是一种用于发现潜在因子并研究它们之间关系的统计方法。

在Matlab 中,可以使用`factoran`函数进行因子分析。

利用MATLAB实现最小错误率贝叶斯判别

利用MATLAB实现最小错误率贝叶斯判别作者:宋秋强黄若坤杨超超王英伟来源:《科技创新导报》2013年第06期摘要:Matlab软件平台为用户提供了强大的科学计算与可视化功能,具有简单、易用的用户环境,尤其适合矩阵数据的计算处理。

根据Matlab的特点,将其与模式识别原理结合起来,以油水层识别为例,求解基于多元正态概率模型下的最小错误率贝叶斯判别函数和决策面方程。

关键词:Matlab 模式识别贝叶斯判别油水层识别中图分类号:TP391.41 文献标识码:A 文章编号:1674-098X(2013)02(c)-00-01模式识别的分类问题是根据识别对象特征的观察值将其分到某个类别中去。

贝叶斯(Bayes)判别法是模式识别方法中的一个基本方法。

该方法通过对类别已知样本的学习,提取样本特征并建立判别函数方程,从而来实现对新样本的预测。

根据决策规则的不同,贝叶斯判别法又包含最小错误率贝叶斯判别、最小风险贝叶斯判别等。

最小错误率的贝叶斯判别就是利用概率论中的贝叶斯公式,得出使错误率最小的分类规则。

Matlab集数字分析、矩阵运算、信号处理和图象处理、显示于一体,构成了一个方便灵活的、界面友好的用户环境[1]。

同时Matlab提供了大量的功能函数,这些函数的灵活运用会使研究人员避免大量重复性的劳动。

对于测井方法研究和数据处理来说,由于获得的信息都是数字化的,所以应用Matlab可以很方便地解决与测井相关的问题。

Matlab的出现使得测井工作者能够把更多的精力集中到专业的方法研究中。

该文通过对贝叶斯判别法的原理进行剖析,提出通过Matlab软件来实现该算法,程序编制过程简单且方法运用灵活。

1 方法原理及应用根据贝叶斯判别的基本理论,在多元正态概率分布中,基于最小错误率的贝叶斯判别函数和决策面方程由如下式子给出[2]:判别函数:gix=-12x-μiTi-1x-μi-d2ln2π-12lnΣi+lnPωi ①决策面方程:gix=gj(x)②其中x=x1,x2,……,xdT是d 维列向量。

matlab识别一组数据之间差异的方法

一、概述在数据分析领域,识别一组数据之间的差异是非常重要的。

对数据进行差异分析有助于找出不同数据之间的模式和规律,帮助我们更好地理解数据。

MATLAB作为一种强大的数据分析工具,提供了多种方法用于识别数据之间的差异。

本文将介绍一些常用的方法,帮助读者更好地运用MATLAB进行数据差异分析。

二、基本统计方法1. 均值比较均值比较是一种常见的数据差异分析方法。

在MATLAB中,可以使用t检验或者方差分析来进行均值比较。

通过计算不同样本的均值和方差,可以判断它们之间的差异是否具有显著性。

2. 相关性分析相关性分析用于研究两个或多个变量之间的相关性程度。

在MATLAB 中,可以使用相关系数或者协方差矩阵来进行相关性分析。

相关性分析可以帮助我们了解不同变量之间的相关性,从而识别数据之间的差异。

三、数据可视化方法1. 箱线图箱线图是一种常用的数据可视化方法,用于展示一组数据的分布情况。

在MATLAB中,可以使用boxplot函数来绘制箱线图。

通过观察不同数据的箱线图,可以直观地看出它们之间的差异。

2. 散点图散点图是一种展示两个变量之间关系的图表。

在MATLAB中,可以使用scatter函数来绘制散点图。

通过观察不同数据的散点图,可以发现它们之间的差异或者关联。

3. 直方图直方图用于展示一组数据的分布情况。

在MATLAB中,可以使用histogram函数来绘制直方图。

通过比较不同数据的直方图,可以发现它们之间的差异。

四、机器学习方法1. 聚类分析聚类分析是一种无监督学习方法,用于将相似的数据点分组到同一类别中。

在MATLAB中,可以使用k-means聚类算法来进行聚类分析。

通过聚类分析,可以将数据分为不同的类别,从而帮助我们识别数据之间的差异。

2. 主成分分析主成分分析是一种降维技术,用于发现数据集中的模式和结构。

在MATLAB中,可以使用pca函数来进行主成分分析。

通过主成分分析,可以找出数据中的主要特征,帮助我们识别数据之间的差异。

Matlab中的人脸识别与表情分析方法

Matlab中的人脸识别与表情分析方法人脸识别和表情分析是计算机视觉领域中的热门研究方向。

在这个信息爆炸的时代,人们对于自动化识别和分析人脸表情的需求越来越高。

Matlab作为一种功能强大的数值计算与可视化软件,提供了一些重要的工具和算法来实现人脸识别和表情分析。

本文将介绍Matlab中一些常用的人脸识别与表情分析方法。

首先,我们来介绍一下人脸识别的基本概念和方法。

人脸识别是指通过计算机技术来识别和验证人脸的身份。

常见的人脸识别方法包括主成分分析(PCA)、线性判别分析(LDA)和支持向量机(SVM)等。

在Matlab中,可以使用内置的人脸识别工具箱来实现这些方法。

其中,主成分分析是一种常用的降维方法,它通过对数据进行特征提取和投影变换,将高维数据映射到低维空间。

在人脸识别中,PCA可以用来提取脸部特征,并通过与已知人脸数据的比较来判断其身份。

在Matlab中,可以使用pca函数实现主成分分析。

另一种常用的人脸识别方法是线性判别分析。

LDA可以通过最大化类间散布和最小化类内散布的方式来找到最优的投影向量,从而实现有效的人脸分类。

Matlab提供了lda函数来实现线性判别分析。

此外,支持向量机也是一种常用的分类方法,它的基本思想是寻找一个最优的超平面来实现数据的最佳分类。

在人脸识别领域,SVM可以通过训练一组已知标记的人脸图像来建立分类模型,然后利用该模型来识别新的人脸图像。

Matlab中的svmtrain和svmclassify函数可以帮助我们实现这一过程。

除了人脸识别,表情分析也是一个引人注目的研究领域。

表情分析旨在从人脸图像中提取和解释情绪表达。

常见的表情分析方法包括基于特征提取的方法、基于神经网络的方法和基于统计模型的方法等。

在Matlab中,可以使用图像处理工具箱提供的函数来实现基于特征提取的表情分析。

这些函数包括人脸检测、特征检测和分类器训练等功能。

通过这些函数,我们可以提取脸部特征,如眼睛、嘴巴等,进而分析表情的特征,如笑容、愤怒等。

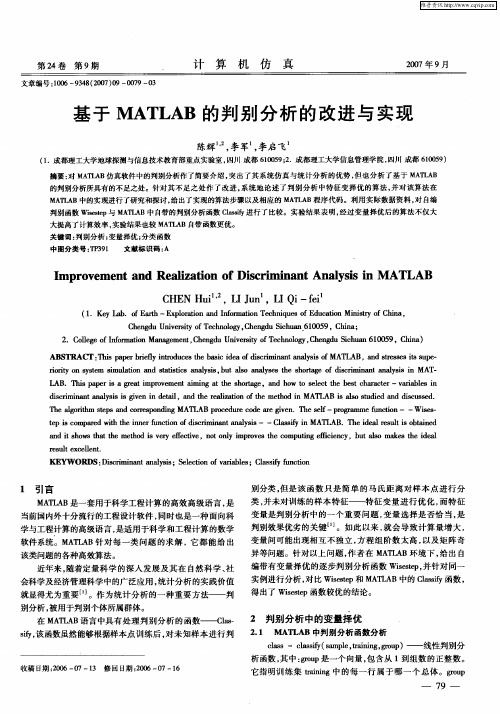

基于MATLAB的判别分析的改进与实现

C E u ,L u L i e H N H i一 I n , I —fi , J Q

( .Ke a .o at 1 yL b fE r h—E poain a dIfr t nT c nq e f u ain Miit fC ia x lrt n nomai e h iu so c t nsr o hn , o o Ed o y

(. 1 成都理工大学地球探测 与信息技术教育部重点实验 室, t l IJ 成都 6 05 ;.  ̄I 10 9 2 成都理工大学信息管理学院 , t l I J 成都 6 05 )  ̄I 10 9 摘要: N T A 仿真软件 中的判别分析作 了简要介 绍 , 出了其 系统仿真 与统计分析 的优势 , 也分析 了基 于 N T A 对 ALB 突 但 A LB 的判别分析所具有的不足之处 。针对其 不足之处 作 了改进 , 系统 地论述 了判别 分析 中特征变择 优的算 法 , 并对该 算法在 1 TA V L B中的实现进行 了研究和探讨 , I A 给出了实现 的算法步骤 以及相应的 1 T A V L B程序代码 。利用 实际数据资料 , 自 I A 对 编 判别 函数 Wi s p与 1 T A st ee V L B中 自带的判别分析 函数 C ̄ l 进行 了比较 。实 验结果表 明, I A l sy f 经过变 量择 优后的算法不仅大

大提 高了计算效率 , 实验结果也较 1A L B自带 函数更优 。 V TA I 关键 词: 判别分析 ; 变量择优 ; 分类函数

中 图分 类号 :P 9 T3 1 文 献 标 识 码 : A

I pr v m e ta a ia in fDie i i a tAn l ss i ATLAB m o e n nd Re l to o s rm n n a y i n M z

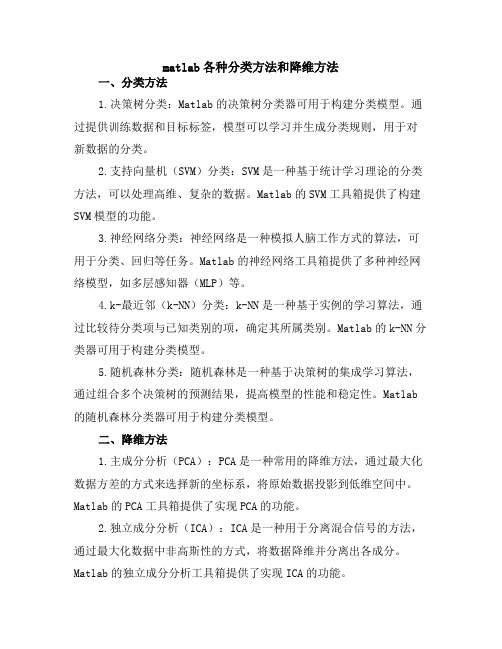

matlab各种分类方法和降维方法

matlab各种分类方法和降维方法一、分类方法1.决策树分类:Matlab的决策树分类器可用于构建分类模型。

通过提供训练数据和目标标签,模型可以学习并生成分类规则,用于对新数据的分类。

2.支持向量机(SVM)分类:SVM是一种基于统计学习理论的分类方法,可以处理高维、复杂的数据。

Matlab的SVM工具箱提供了构建SVM模型的功能。

3.神经网络分类:神经网络是一种模拟人脑工作方式的算法,可用于分类、回归等任务。

Matlab的神经网络工具箱提供了多种神经网络模型,如多层感知器(MLP)等。

4.k-最近邻(k-NN)分类:k-NN是一种基于实例的学习算法,通过比较待分类项与已知类别的项,确定其所属类别。

Matlab的k-NN分类器可用于构建分类模型。

5.随机森林分类:随机森林是一种基于决策树的集成学习算法,通过组合多个决策树的预测结果,提高模型的性能和稳定性。

Matlab 的随机森林分类器可用于构建分类模型。

二、降维方法1.主成分分析(PCA):PCA是一种常用的降维方法,通过最大化数据方差的方式来选择新的坐标系,将原始数据投影到低维空间中。

Matlab的PCA工具箱提供了实现PCA的功能。

2.独立成分分析(ICA):ICA是一种用于分离混合信号的方法,通过最大化数据中非高斯性的方式,将数据降维并分离出各成分。

Matlab的独立成分分析工具箱提供了实现ICA的功能。

3.线性判别分析(LDA):LDA是一种用于二分类问题的降维方法,通过在样本间找到一个最优的超平面,将高维数据降维到二维空间中,提高分类的效率和准确性。

Matlab的线性判别分析工具箱提供了实现LDA的功能。

4.t-分布邻域嵌入(t-SNE):t-SNE是一种非线性降维方法,通过将高维数据映射到低维空间中,保留数据的分布和结构信息,用于可视化数据分析。

Matlab的t-SNE工具箱提供了实现t-SNE的功能。

在使用这些方法时,需要注意选择适合的数据和任务,并进行适当的参数调整和模型评估,以确保得到准确和可靠的分类或降维结果。

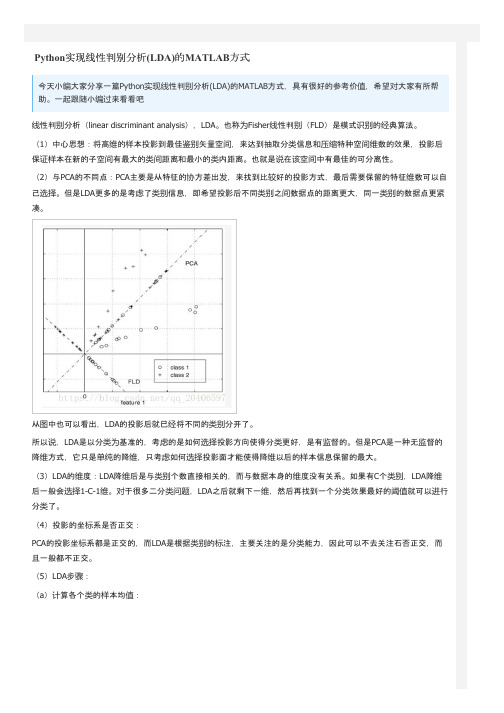

Python实现线性判别分析(LDA)的MATLAB方式

#计算第一类样本在直线上的投影点 xi=[] yi=[] for i in range(0,p):

y0=X1[i,1] x0=X1[i,0] x1=(k*(y0-b)+x0)/(k**2+1) y1=k*x1+b xi.append(x1) yi.append(y1) print(xi)

%3.2700 3.5200 1

X=load('22.txt'); pos0=find(X(:,3)==0); pos1=find(X(:,3)==1); X1=X(pos0,1:2); X2=X(pos1,1:2); hold on plot(X1(:,1),X1(:,2),'r+','markerfacecolor', [ 1, 0, 0 ]); plot(X2(:,1),X2(:,2),'b*','markerfacecolor', [ 0, 0, 1 ]);

plt.show()

以上这篇Python实现线性判别分析(LDA)的MATLAB方式就是小编分享给大家的全部内容了,希望能给大家一个参考, 也希望大家多多支持。

p=np.size(X1,0) print(p) q=np.size(X2,0)

print(q)

#第二步,求类内散度矩阵 S1=np.dot((X1-M1).transpose(),(X1-M1)) print(S1) S2=np.dot((X2-M2).transpose(),(X2-M2)) print(S2) Sw=(p*S1+q*S2)/(p+q)

Python实现线性判别分析(LDA)的MATLAB方式

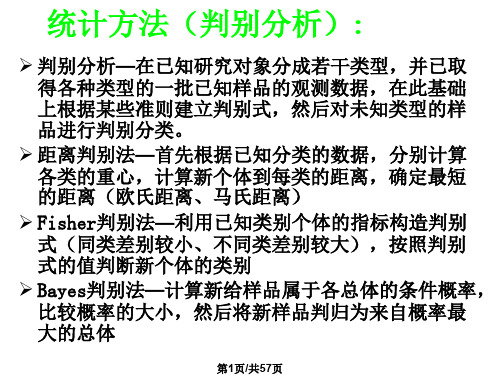

判别分析

判别分析判别分析是利用原油的分类信息,得到判别函数(判别函数是这种分类函数关系式,一般是与分类相关的若干个指标的线性关系式),然后利用该函数去判断未知样品属于哪一类。

常用的判别分析方法有:距离判别法、费歇尔判别法、贝叶斯判别法等。

在Matlab软件包中,将已经分类的m个数据(长度为n)作为行向量,得到一个矩阵trianing,每行都属于一个分类类别,分类类别构成一个整数列向量g(共有m行),待分类的k个数据(长度为n)作为行向量,得到一个矩阵sample,然后利用classify函数进行线性判别分析(默认)。

它的格式为classify(sample, training, group)training=[];%已知数据group=[]; %已知数据的分类sample=[]; %待分类样品class= classify(sample, training, group) %输出样品分类较复杂的格式:[class,err]= classify(sample, training, group,’type’) %输出样品分类其中:class 返回分类表;err 返回误差比例信息;sample 样本数据矩阵;training 已有的分类数据矩阵;group 分类列向量;type有三种选择:type=linear(默认设置)表示进行线性判别分析;type=quadratic 表示进行二次判别分析;type=mahalanobis 表示用马氏距离进行判别分析。

例:某地大气样品污染分类表如下:气体氯硫化氢二氧化硫碳4 环氧氯丙烷环己烷污染分类1 0.056 0.084 0.031 0.038 0.008 0.022 12 0.038 0.130 0.079 0.170 0.058 0.430 23 0.050 0.074 0.041 0.048 0.007 0.020 14 0.045 0.050 0.110 0.100 0.025 0.006 15 0.040 0.055 0.100 0.110 0.022 0.007 16 0.030 0.110 0.070 0.160 0.050 0.046 27 0.034 0.095 0.058 0.160 0.200 0.029 18 0.084 0.066 0.029 0.032 0.012 0.041 29 0.064 0.072 0.020 0.250 0.028 0.038 210 0.069 0.087 0.027 0.050 0.089 0.021 11 0.052 0.084 0.021 0.037 0.007 0.0222 0.041 0.055 0.110 0.110 0.021 0.0073 0.030 0.112 0.072 0.160 0.056 0.0214 0.074 0.083 0.105 0.190 0.020 1training=[0.056 0.084 0.031 0.038 0.008 0.0220.038 0.130 0.079 0.170 0.058 0.4300.050 0.074 0.041 0.048 0.007 0.0200.045 0.050 0.110 0.100 0.025 0.0060.040 0.055 0.100 0.110 0.022 0.0070.030 0.110 0.070 0.160 0.050 0.0460.034 0.095 0.058 0.160 0.200 0.0290.084 0.066 0.029 0.032 0.012 0.0410.064 0.072 0.020 0.250 0.028 0.0380.069 0.087 0.027 0.050 0.089 0.021]; %已知数据group=[1;2;1;1;1;2;1;2;2;1]; %已知数据的分类sample=[0.052 0.084 0.021 0.037 0.007 0.0220.041 0.055 0.110 0.110 0.021 0.0070.030 0.112 0.072 0.160 0.056 0.0210.074 0.083 0.105 0.190 0.020 1]; %待分类样品class=classify(sample,training,group) %输出样品分类class =1122。

matlab中的降维方法

MATLAB中的降维方法1.引言降维是一种在数据分析和机器学习领域中常用的技术,它可以将高维数据映射到一个更低维的子空间中,从而提取出重要的特征信息。

在M A TL AB中,有多种降维方法可以选择,本文将介绍其中的几种常见方法,包括主成分分析(PC A)、线性判别分析(LD A)和t-分布随机邻近嵌入(t-S NE)。

2.主成分分析(P C A)主成分分析是一种无监督学习方法,用于将高维数据转换为低维数据。

它通过计算数据的协方差矩阵,并找到一组正交基来表示数据,使得基上的投影方差最大化。

在M AT LA B中,我们可以使用`p ca`函数来进行主成分分析。

首先,将原始数据矩阵传递给该函数,并指定所需的主成分数量,函数会返回主成分得分和主成分方差解释比例。

3.线性判别分析(LD A)线性判别分析是一种有监督学习方法,主要用于分类任务中的降维。

它试图找到一个低维投影空间,其中不同类别的数据点之间的距离最大化,同时同一类别内的数据点之间的距离最小化。

在M AT LA B中,使用`f it cd is cr`函数来进行线性判别分析。

该函数需要输入原始数据和对应的标签,可以返回投影后的数据以及类别之间的判别特征。

4. t分布随机邻近嵌入(t-SN E)t-SN E是一种非线性降维方法,广泛应用于可视化高维数据。

它使用t-分布来表示高维空间和低维空间之间的相似度,并通过最小化两个空间之间的KL散度,实现数据的降维。

在M AT LA B中,可以使用`t sn e`函数来进行t-SN E降维。

该函数接受原始数据矩阵作为输入,并返回降维后的数据矩阵。

5.总结M A TL AB提供了丰富的降维方法,包括主成分分析、线性判别分析和t-SN E等。

这些方法可以帮助我们处理高维数据,提取出重要的特征信息,并可视化数据。

根据具体任务的需求,我们可以选择合适的降维方法来进行数据处理和分析。

要注意的是,在使用这些方法时,需要根据实际情况进行参数调整和结果的解释,以确保得到可靠和有效的降维结果。

MATLAB中的特征选择与降维方法介绍

MATLAB中的特征选择与降维方法介绍引言特征选择与降维是机器学习和模式识别领域中非常重要的一部分,它们可以帮助我们从高维数据中提取出最重要的信息,减少特征空间的维度,并提高学习算法的效率和准确性。

MATLAB作为一种功能强大的科学计算软件,提供了丰富的特征选择和降维的方法和工具,本文将对其中的一些方法进行介绍。

一、特征选择方法1.1 过滤方法过滤方法是一种简单而直观的特征选择方法,它通过对特征进行评估和排序,选择出与目标变量相关性较高的特征。

常用的过滤方法包括皮尔逊相关系数、互信息和卡方检验等。

在MATLAB中,可以使用函数corrcoef、mutualinfo和chi2来进行相关性计算。

1.2 包装方法包装方法是一种基于学习器的特征选择方法,它通过训练一个学习器,结合特征子集的评估指标来搜索最佳的特征子集。

常用的包装方法包括递归特征消除和遗传算法等。

在MATLAB中,可以使用函数rfe和ga来实现相应的包装方法。

1.3 嵌入方法嵌入方法是一种将特征选择和学习算法进行融合的方法,它通过学习算法自身的特性来选择特征。

常用的嵌入方法包括L1正则化和决策树等。

在MATLAB中,可以使用函数lasso和fitctree来实现相应的嵌入方法。

二、降维方法2.1 主成分分析(PCA)主成分分析是一种常用的降维方法,它通过线性变换将原始特征空间映射到一组新的正交特征空间,新特征空间的维度低于原始特征空间。

PCA可以最大程度地保留原始数据的方差,使得降维后的数据尽可能保留原始数据的信息。

在MATLAB中,可以使用函数pca来进行主成分分析。

2.2 线性判别分析(LDA)线性判别分析是一种常用的降维方法,它使用类别信息来寻找最佳投影方向,将原始特征空间映射到一组新的低维特征空间。

LDA可以最大程度地保持不同类别的距离,提高分类的性能。

在MATLAB中,可以使用函数classify来进行线性判别分析。

2.3 独立成分分析(ICA)独立成分分析是一种常用的降维方法,它假设原始数据是由多个独立的成分线性组合而成,通过寻找这些独立成分的投影方向,并使得投影数据之间的相关性最小化,实现对原始数据的降维。

判别分析及MATLAB实现

Apf:(1.14,1.78), (1.18,1.96), (1.20,1.86), (1.26,2.00), (1.28,2.00), (1.30,1.96) ;

n

d1 (x, y) | xi yi | i 1

绝对距离

第5页/共57页

欧氏距离

n

称

d2 (x, y) (xi yi )2

i 1

称

n

dr (x, y) ( | xi yi |r )1/ r

i 1

为n维向量x,y之间的闵可夫斯基距离,其中 r (r 0)

为常数。

显然,当r=2和1时闵可夫斯基距离分别为欧氏距 离和绝对距离.

第6页/共57页

2. 马氏距离

马氏距离是由印度统计学家马哈拉诺比斯(PC Mahalanobis)提出的,由于马氏距离具有统计意义, 在距离判别分析时经常应用马氏距离:

(1) 同一总体的两个向量之间的马氏距离

设有n维向量 x ( x1, x2, , xn )T , y ( y1, y2, , yn )T ,则称

是一个待判样品,距离判别准则为

d(x, (x )T 1(x )

为n维向量x与总体G的马氏距离.

(4.1.2)

MATLAB中有一个命令:d=mahal(Y,X),计算X 矩阵每一个点(行)至Y矩阵中每一个点(行)的 马氏距离。其中Y的列数必须等于X的列数,但它们 的行数可以不同。X的行数必须大于列数。输出d是 距离向量。

Af:(1.24,1.72), (1.36,1.74), (1.38,1.64), (1.38,1.82), (1.38,1.90), (1.40,1.70), (1.48,1.82),(1.54,1.82), (1.56,2.08).

matlab距离判别法

matlab距离判别法

距离判别法是一种常见的模式识别方法,用于将输入样本分配到已知的类别中。

在MATLAB中,可以使用以下函数来实现

距离判别法:

1. pdist2:计算两个矩阵之间的距离。

例如,可以使用`D = pdist2(X, Y)`计算矩阵X中每个样本与矩阵Y中每个样本之间

的欧氏距离。

2. knnsearch:在给定查询点集和参考点集之间查找最近邻。

例如,可以使用`[IDX, D] = knnsearch(X, Y)`找到矩阵Y中每

个样本的最近邻索引和距离。

3. classify:使用各类训练样本和它们的标签,对测试样本进

行分类。

例如,可以使用`predicted_labels =

classify(test_samples, train_samples, train_labels)`对测试样本进

行分类,并返回预测的标签。

4. fitcknn:用于训练K最近邻(K-Nearest Neighbor)分类器。

例如,可以使用`Mdl = fitcknn(train_samples, train_labels)`训练

一个KNN分类器。

这些函数提供了一些基本的工具来实现距离判别法,但具体的实现取决于你的数据和实际问题。

你可以根据自己的需要选择合适的函数,设置适当的参数,并编写相应的代码。

粗大误差判别方法的MATLAB实现

粗大误差判别方法的MATLAB实现毕业设计题目粗大误差判别方法的MATLAB实现学院自动化与电气工程学院专业电气工程及其自动化班级电传1101二〇一五年五月三十一日摘要在现在的学习和教学过程中,MATLAB起着越来越重要的作用,起到了辅助教学、科学研究的重要作用。

利用传统方法进行数据的误差处理既繁琐又浪费时间,而有了MATLAB之后,不仅可以缩短计算用的时间,还可以把庞大的数据几秒中就处理的很精确,达到了事半功倍的效果。

再加上,MATLAB有简洁的绘图功能以及GUI界面,使图形形象生动的展现在我们面前,达到了图形数据化的效果,也在处理误差的同时给我们展现出一个完美的人机界面。

因此,MATLAB的学习对我们至关重要,也是处理误差的非常好的工具。

粗大误差对数据结果的影响很大,本文计算数据时,应该使最终结果尽可能的精确,所以处理粗大误差也是我们应该完成的任务,之前理论学习的七种粗大误差剔除的方法,即:莱以特准则、t检验准则、格拉布斯准则、狄克逊准则、奈尔准则、精细准则、肖维涅准则。

把这七种方法编写成MATLAB程序,剔除粗大误差。

关键词:MATLAB;GUI;误差;数据处理;人机界面ABSTRACTMATLAB playing an increasingly important role in the current process of learning and teaching. It played an important supporting role in teaching, scientific research. Using traditional methods for data processing error cumbersome and time-consuming. after the MATLAB appeared, Not only shorten the time to calculate, but also can put in a few seconds on the largedata processing is very precise, reduce the computing time used and achieve a multiplier effect. in addition, MATLAB neat graphics and GUI interface. So vivid graphics in front of us, to the graphic data of the results, while also addressing error showing us a perfect man-machine interface. Therefore , MATLAB learning is important to us, but also a very good tool for error handling .We should make the calculation results to calculate the precise ,because of the error is making great influence on the data results. Gross error handling is our mission to be accomplished .the methods of the gross error is excluding Levin with special guidelines ;t test guidelines ;Grubbs Guidelines; Dixon criteria Guidelines; Nair criteria Guidelines ;fine criterion ;Xiao Guidelines .we should process MATLAB program to deal with gross error.Key words: MATLAB;GUI;error;data processing;man-machine interface;目录摘要........................................................................................................................... .. (I)ABSTRACT ......................................................................................................... ......... II 1 前言. (1)1.1研究的背景与意义 (1)1.2 研究现状 (1)1.3本文研究的主要内容 (2)2 误差的基本概念 (3)2.1 误差的定义 (3)2.2 误差分类 (3)2.3 随机误差 (3)2.3.1 算术平均值 (3)2.3.2 测量的标准差 (3)2.4 系统误差 (6)2.5 粗大误差 (6)2.5.1判别粗大误差的准则 (6)2.5.2几种准则的比较 (14)2.6 本章小结 (14)3. 粗大误差判别方法的MATLAB实现 (15)3.1 MATLAB软件概述 (15)3.1.1 MATLAB GUI介绍 (15)3.1.2 GUI控件对象及其属性 (15)3.1.3 GUI程序设计步骤 (16)3.2 主界面程序设计 (17)3.3 粗大误差剔除方法选择界面设计 (18)3.4 粗大误差程序设计 (23)3.4.1 莱以特准则的MATLAB实现 (23)3.4.2 罗曼诺夫斯基准则的MATLAB实现 (28)3.4.3 格拉布斯准则的MATLAB实现 (32)3.4.4 狄克松准则的MATLAB实现 (36)3.4.5 奈尔准则的MATLAB实现 (40)3.4.6 精细准则的MATLAB实现 (44)3.4.7 肖维涅准则的MATLAB实现 (48)3.5 本章小结 (51)结论 (52)参考文献 (53)致谢 (54)1前言1.1研究的背景与意义我们生活在大自然中,就要不断地认识自然规律、发展自然规律,自然规律来源于对自然界中的事物进行不断地测量总结出来的。

判别分析的MATLAB实现案例

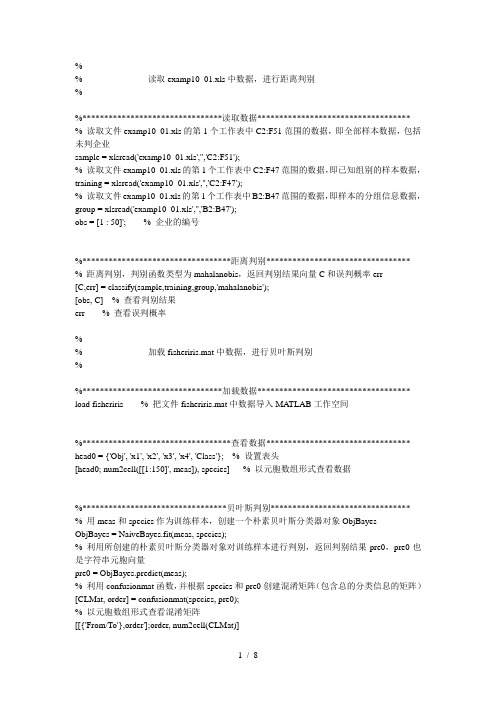

%--------------------------------------------------------------------------% 读取examp10_01.xls中数据,进行距离判别%--------------------------------------------------------------------------%********************************读取数据***********************************% 读取文件examp10_01.xls的第1个工作表中C2:F51范围的数据,即全部样本数据,包括未判企业sample = xlsread('examp10_01.xls','','C2:F51');% 读取文件examp10_01.xls的第1个工作表中C2:F47范围的数据,即已知组别的样本数据,training = xlsread('examp10_01.xls','','C2:F47');% 读取文件examp10_01.xls的第1个工作表中B2:B47范围的数据,即样本的分组信息数据,group = xlsread('examp10_01.xls','','B2:B47');obs = [1 : 50]'; % 企业的编号%**********************************距离判别*********************************% 距离判别,判别函数类型为mahalanobis,返回判别结果向量C和误判概率err[C,err] = classify(sample,training,group,'mahalanobis');[obs, C] % 查看判别结果err % 查看误判概率%--------------------------------------------------------------------------% 加载fisheriris.mat中数据,进行贝叶斯判别%--------------------------------------------------------------------------%********************************加载数据*********************************** load fisheriris % 把文件fisheriris.mat中数据导入MA TLAB工作空间%**********************************查看数据********************************* head0 = {'Obj', 'x1', 'x2', 'x3', 'x4', 'Class'}; % 设置表头[head0; num2cell([[1:150]', meas]), species] % 以元胞数组形式查看数据%*********************************贝叶斯判别********************************% 用meas和species作为训练样本,创建一个朴素贝叶斯分类器对象ObjBayesObjBayes = NaiveBayes.fit(meas, species);% 利用所创建的朴素贝叶斯分类器对象对训练样本进行判别,返回判别结果pre0,pre0也是字符串元胞向量pre0 = ObjBayes.predict(meas);% 利用confusionmat函数,并根据species和pre0创建混淆矩阵(包含总的分类信息的矩阵)[CLMat, order] = confusionmat(species, pre0);% 以元胞数组形式查看混淆矩阵[[{'From/To'},order'];order, num2cell(CLMat)]% 查看误判样品编号gindex1 = grp2idx(pre0); % 根据分组变量pre0生成一个索引向量gindex1gindex2 = grp2idx(species); % 根据分组变量species生成一个索引向量gindex2errid = find(gindex1 ~= gindex2) % 通过对比两个索引向量,返回误判样品的观测序号向量% 查看误判样品的误判情况head1 = {'Obj', 'From', 'To'}; % 设置表头% 用num2cell函数将误判样品的观测序号向量errid转为元胞向量,然后以元胞数组形式查看误判结果[head1; num2cell(errid), species(errid), pre0(errid)]% 对未知类别样品进行判别% 定义未判样品观测值矩阵xx = [5.8 2.7 1.8 0.735.6 3.1 3.8 1.86.1 2.5 4.7 1.16.1 2.6 5.7 1.95.1 3.16.5 0.625.8 3.7 3.9 0.135.7 2.7 1.1 0.126.4 3.2 2.4 1.66.7 3 1.9 1.16.8 3.57.9 1];% 利用所创建的朴素贝叶斯分类器对象对未判样品进行判别,返回判别结果pre1,pre1也是字符串元胞向量pre1 = ObjBayes.predict(x)%--------------------------------------------------------------------------% 加载fisheriris.mat中数据,进行Fisher判别%--------------------------------------------------------------------------%********************************加载数据*********************************** load fisheriris % 把文件fisheriris.mat中数据导入MA TLAB工作空间%**********************************待判样品********************************* % 定义待判样品观测值矩阵xx = [5.8 2.7 1.8 0.735.6 3.1 3.8 1.86.1 2.5 4.7 1.16.1 2.6 5.7 1.95.1 3.16.5 0.625.8 3.7 3.9 0.135.7 2.7 1.1 0.126.4 3.2 2.4 1.66.7 3 1.9 1.16.8 3.57.9 1];%*********************************Fisher判别********************************% 利用fisher函数进行判别,返回各种结果(见fisher函数的注释)[outclass,TabCan,TabL,TabCon,TabM,TabG] = fisher(x,meas,species)%************************绘制两个判别式得分的散点图************************** % 利用fisher函数进行判别,返回各种结果,其中ts为判别式得分[outclass,TabCan,TabL,TabCon,TabM,TabG,ts] = fisher(x,meas,species);% 提取各类的判别式得分ts1 = ts(ts(:,1) == 1,:); % setosa类的判别式得分ts2 = ts(ts(:,1) == 2,:); % versicolor类的判别式得分ts3 = ts(ts(:,1) == 3,:); % virginica类的判别式得分plot(ts1(:,2),ts1(:,3),'ko') % setosa类的判别式得分的散点图hold onplot(ts2(:,2),ts2(:,3),'k*') % versicolor类的判别式得分的散点图plot(ts3(:,2),ts3(:,3),'kp') % virginica类的判别式得分的散点图legend('setosa类','versicolor类','virginica类'); %加标注框xlabel('第一判别式得分'); %给X轴加标签ylabel('第二判别式得分'); %给Y轴加标签%************************只用一个判别式进行Fisher判别************************ % 令fisher函数的第4个输入为0.5,就可以只用一个判别式进行判别[outclass,TabCan,TabL,TabCon,TabM,TabG] = fisher(x,meas,species,0.5)function [outclass,TabCan,TabL,TabCon,TabM,TabG,trainscore] = fisher(sampledata,training,group,contri)%FISHER 判别分析.% class = fisher(sampledata,training,group) 根据训练样本training构造判别式,% 利用所有判别式对待判样品sampledata进行判别. sampledata和training是具有相同% 列数的矩阵,它们的每一行对应一个观测,每一列对应一个变量. group是training对% 应的分组变量,它的每一个元素定义了training中相应观测所属的类. group可以是一% 个分类变量,数值向量,字符串数组或字符串元胞数组. training和group必须具有相% 同的行数. fisher函数把group中的NaN或空字符串作为缺失数据,从而忽略training % 中相应的观测. class中的每个元素指定了sampledata中的相应观测所判归的类,它和% group具有相同的数据类型.%% class = fisher(sampledata,training,group,contri) 根据累积贡献率不低于% contri,确定需要使用的判别式个数,默认情况下,使用所有判别式进行判别. contri % 是一个在(0, 1]区间内取值的标量,用来指定累积贡献率的下限.%% [class, TabCan] = fisher(...)以表格形式返回所用判别式的系数向量,若contri% 取值为1,则返回所有判别式的系数向量. TabCan是一个元胞数组,形如% 'Variable' 'can1' 'can2'% 'x1' [-0.2087] [ 0.0065]% 'x2' [-0.3862] [ 0.5866]% 'x3' [ 0.5540] [-0.2526]% 'x4' [ 0.7074] [ 0.7695]% [class, TabCan, TabL] = fisher(...)以表格形式返回所有特征值,贡献率,累积% 贡献率等. TabL是一个元胞数组,形如% 'Eigenvalue' 'Difference' 'Proportion' 'Cumulative'% [ 32.1919] [ 31.9065] [ 0.9912] [ 0.9912]% [ 0.2854] [] [ 0.0088] [ 1]%% [class, TabCan, TabL, TabCon] = fisher(...)以表格形式返回混淆矩阵(包含总% 的分类信息的矩阵). TabCon是一个元胞数组,形如% 'From/To' 'setosa' 'versicolor' 'virginica'% 'setosa' [ 50] [ 0] [ 0]% 'versicolor' [ 0] [ 48] [ 2]% 'virginica' [ 0] [ 1] [ 49]%% [class, TabCan, TabL, TabCon, TabM] = fisher(...)以表格形式返回误判矩阵.% TabM是一个元胞数组,形如% 'Obj' 'From' 'To'% [ 71] 'versicolor' 'virginica'% [ 84] 'versicolor' 'virginica'% [134] 'virginica' 'versicolor'%% [class, TabCan, TabL, TabCon, TabM, TabG] = fisher(...)将所用判别式作用% 在各组的组均值上,得到组均值投影矩阵,以表格形式返回这个矩阵. TabG是一个元胞% 数组,形如% 'Group' 'can1' 'can2'% 'setosa' [-1.3849] [1.8636]% 'versicolor' [ 0.9892] [1.6081]% 'virginica' [ 1.9852] [1.9443]% [class, TabCan, TabL, TabCon, TabM, TabG, trainscore] = fisher(...)返回% 训练样品所对应的判别式得分trainscore. trainscore的第一列为各训练样品原本所% 属类的类序号,第i+1列为第i个判别式得分.%% Copyright 2009 xiezhh.% $Revision: 1.0.0.0 $ $Date: 2009/10/03 10:40:34 $if nargin < 3error('错误:输入参数太少,至少需要3个输入.');end% 根据分组变量生成索引向量gindex,组名元胞向量groups,组水平向量glevels [gindex,groups,glevels] = grp2idx(group);% 忽略缺失数据nans = find(isnan(gindex));if ~isempty(nans)training(nans,:) = [];gindex(nans) = [];endngroups = length(groups);gsize = hist(gindex,1:ngroups);nonemptygroups = find(gsize>0);nusedgroups = length(nonemptygroups);% 判断是否有空的组if ngroups > nusedgroupswarning('警告: 有空的组.');end[n,d] = size(training);if size(gindex,1) ~= nerror('错误: 输入参数大小不匹配,GROUP与TRAINING必须具有相同的行数.'); elseif isempty(sampledata)sampledata = zeros(0,d,class(sampledata));elseif size(sampledata,2) ~= derror('错误: 输入参数大小不匹配,SAMPLEDATA与TRAINING必须具有相同的列数.'); end% 设置contri的默认值为1,并限定contri在(0, 1]内取值if nargin < 4 || isempty(contri)contri = 1;endif ~isscalar(contri) || contri > 1 || contri <= 0error('错误: contri 必须是一个在(0, 1]内取值的标量.');endif any(gsize == 1)error('错误: TRAINING中的每个组至少应有两个观测.');end% 计算各组的组均值gmeans = NaN(ngroups, d);for k = nonemptygroupsgmeans(k,:) = mean(training(gindex==k,:),1);end% 计算总均值totalmean = mean(training,1);% 计算组内离差平方和矩阵E和组间离差平方和矩阵BE = zeros(d);B = E;for k = nonemptygroups% 分别估计各组的组内离差平方和矩阵.[Q,Rk] = qr(bsxfun(@minus,training(gindex==k,:),gmeans(k,:)), 0);% 各组的组内离差平方和矩阵:AkHat = Rk'*Rk% 判断各组的组内离差平方和矩阵的正定性s = svd(Rk);if any(s <= max(gsize(k),d) * eps(max(s)))error('错误: TRAINING中各组的组内离差平方和矩阵必须是正定矩阵.');endE = E + Rk'*Rk; % 计算总的组内离差平方和矩阵E% 计算组间离差平方和矩阵BB = B + (gmeans(k,:) - totalmean)'*(gmeans(k,:) - totalmean)*gsize(k);end% 求inv(E)*B的正特征值与相应的特征向量EB = E\B;[V, D] = eig(EB);D = diag(D);[D, idD] = sort(D,'descend'); %将特征值按降序排列V = V(:,idD);NumPosi = min(ngroups-1, d); %确定正特征值个数D = D(1:NumPosi, :);CumCont = cumsum(D/sum(D)); %计算累积贡献率% 以表格形式返回所有特征值,贡献率,累积贡献率等. TabL是一个元胞数组head = {'Eigenvalue', 'Difference', 'Proportion', 'Cumulative'};TabL = cell(NumPosi+1, 4);TabL(1,:) = head;TabL(2:end,1) = num2cell(D);if NumPosi == 1TabL(2:end-1,2) = {0};elseTabL(2:end-1,2) = num2cell(-diff(D));endTabL(2:end,3) = num2cell(D/sum(D));TabL(2:end,4) = num2cell(CumCont);% 根据累积贡献率的下限contri确定需要使用的判别式个数CumContGeCon CumContGeCon = find(CumCont >= contri);CumContGeCon = CumContGeCon(1);V = V(:, 1:CumContGeCon); %需要使用的判别式系数矩阵% 以表格形式返回所用判别式的系数向量,若contri取值为1,% 则返回所有判别式的系数向量. TabCan是一个元胞数组TabCan = cell(d+1, CumContGeCon+1);TabCan(1, 1) = {'Variable'};TabCan(2:end, 1) = strcat('x',cellstr(num2str((1:d)')));TabCan(1, 2:end) = strcat('can',cellstr(num2str((1:CumContGeCon)')));TabCan(2:end, 2:end) = num2cell(V);% 将训练样品与待判样品放在一起进行判别m = size(sampledata,1);gv = gmeans*V;stv = [sampledata; training]*V;nstv = size(stv, 1);message = '';outclass = NaN(nstv, 1);for i = 1:nstvobji = bsxfun(@minus,stv(i,:),gv);obji = sum(obji.^2, 2);idclass = find(obji == min(obji));if length(idclass) > 1idclass = idclass(1);message = '警告: 出现了一个或多个结';endoutclass(i) = idclass;endwarning(message);trclass = outclass(m+(1:n)); %训练样品的判别结果(由类序号构成的向量)outclass = outclass(1:m); %待判样品的判别结果(由类序号构成的向量)outclass = glevels(outclass,:); %将待判样品的判别结果进行一个类型转换trg1 = groups(gindex); %训练样品的初始类名称trg2 = groups(trclass); %训练样品经判别后的类名称% 以表格形式返回混淆矩阵(包含总的分类信息的矩阵). TabCon是一个元胞数组[CLMat, order] = confusionmat(trg1,trg2);TabCon = [[{'From/To'},order'];order, num2cell(CLMat)];% 以表格形式返回误判矩阵. TabM是一个元胞数组miss = find(gindex ~= trclass); %训练样品中误判样品的编号head1 = {'Obj', 'From', 'To'};TabM = [head1; num2cell(miss), trg1(miss), trg2(miss)];% 将所用判别式作用在各组的组均值上,得到组均值投影矩阵,以表格形式返回这个矩阵. % TabG是一个元胞数组TabG = cell(ngroups+1,CumContGeCon+1);TabG(:,1) = [{'Group'};groups];TabG(1,2:end) = strcat('can',cellstr(num2str((1:CumContGeCon)')));TabG(2:end,2:end) = num2cell(gv);% 计算训练样品所对应的判别式得分trainscore = training*V;trainscore = [gindex, trainscore];。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

判别分析在生产、科学研究和日常生活中,经常会遇到对某一研究对象属于哪种情况作出判断。

例如要根据这两天天气情况判断明天是否会下雨;医生要根据病人的体温、白血球数目及其它症状判断此病人是否会患某种疾病等等。

从概率论的角度看,可把判别问题归结为如下模型。

设共有n 个总体:

n ξξξ,,,21L

其中i ξ是m 维随机变量,其分布函数为

),,(1m i x x F L ,n i ,,2,1L =

而),,(1m x x L 是表征总体特性的m 个随机变量的取值。

在判别分析中称这m 个变量为判别因子。

现有一个新的样本点T

m x x x ),,(1L =,要判断此样本点属于哪一个总体。

Matlab 的统计工具箱提供了判别函数classify 。

函数的调用格式为:

[CLASS,ERR] = CLASSIFY(SAMPLE,TRAINING ,GROUP, TYPE)

其中SAMPLE 为未知待分类的样本矩阵,TRAINING 为已知分类的样本矩阵,它们有相同的列数m ,设待分类的样本点的个数,即SAMPLE 的行数为s ,已知样本点的个数,即TRAINING 的行数为t ,则GROUP 为t 维列向量,若TRAINING 的第i 行属于总体i ξ,则

GROUP 对应位置的元素可以记为i ,TYPE 为分类方法,缺省值为'linear',即线性分类,TYPE 还可取值'quadratic','mahalanobis'(mahalanobis 距离)。

返回值CLASS 为s 维列向量,给出了SAMPLE 中样本的分类,ERR 给出了分类误判率的估计值。

例已知8个乳房肿瘤病灶组织的样本,其中前3个为良性肿瘤,后5个为恶性肿瘤。

数据为细胞核显微图像的10个量化特征:细胞核直径,质地,周长,面积,光滑度。

根据已知样本对未知的三个样本进行分类。

已知样本的数据为:13.54,14.36,87.46,566.3,0.09779

13.08,15.71,85.63,520,0.1075

9.504,12.44,60.34,273.9,0.1024

17.99,10.38,122.8,1001,0.1184

20.57,17.77,132.9,1326,0.08474

19.69,21.25,130,1203,0.1096

11.42,20.38,77.58,386.1,0.1425

20.29,14.34,135.1,1297,0.1003

-1-

待分类的数据为:

16.6,28.08,108.3,858.1,0.08455

20.6,29.33,140.1,1265,0.1178

7.76,24.54,47.92,181,0.05263

解:编写程序如下:

a=[13.54,14.36,87.46,566.3,0.09779

13.08,15.71,85.63,520,0.1075

9.504,12.44,60.34,273.9,0.1024

17.99,10.38,122.8,1001,0.1184

20.57,17.77,132.9,1326,0.08474

19.69,21.25,130,1203,0.1096

11.42,20.38,77.58,386.1,0.1425

20.29,14.34,135.1,1297,0.1003]

x=[16.6,28.08,108.3,858.1,0.08455

20.6,29.33,140.1,1265,0.1178

7.76,24.54,47.92,181,0.05263]

g=[ones(3,1);2*ones(5,1)];

[class,err]=classify(x,a,g)

-2-。