随机演算法RandomizedAlgorithms

随机算法原理

随机算法原理随机算法原理可以用来解决一些常见的问题,这些问题包括随机数生成、随机排列、流量控制和密码学等。

随机算法的原理基于概率论和统计学,通过模拟自然界的随机过程来生成随机数序列。

随机数生成是随机算法应用最广泛的领域之一。

计算机在执行过程中需要使用随机数,以执行某些操作,如随机化算法、搜索算法和加密算法等。

在计算机科学中,随机数通常是在有限的区间内生成的,例如0和1之间的随机数。

生成随机数的最简单的方法是使用计算机自带的“伪随机数生成器”(PRNG),该生成器使用算法来生成一个看起来随机的数列。

但是,由于这是基于预测算法生成的,因此它并不会真正地随机。

在更高的需求下,我们需要更难解的问题,如真正的随机数生成。

真正的随机性用于加密系统是至关重要的,因为如果密钥是可预测的,黑客就可以轻松地破解加密消息。

真正的随机数生成被认为是无法计算的,因此不能通过预测算法来模拟。

这种真正的随机性通常使用物理过程来模拟,如放射性衰变或大气噪声等。

随机排列是指将一组数据随机排序的过程。

随机排列可以用于数据的打散,或者用于生成一组预测中的随机样本。

常见的随机排列算法有Fisher–Yates shuffle算法,它将一个数组随机排序。

这个算法通过概率论证明了输出为任意一个数列的概率是相等的。

流量控制是指控制系统在不同的时间间隔内产生的数据量。

例如,网络上的路由器需要控制流量以避免拥塞。

随机算法可以用来控制数据流,这是通过将在一个固定时间范围内传输的数据量随机化来实现的。

这个过程是随机的,因此它可以防止过度拥塞和数据包丢失。

密码学是随机算法的另一个领域。

密码学中的安全取决于密钥的随机化和保护以抵御黑客攻击。

密码学中的基本思想是使用能够产生无法预测的数字的算法来生成密钥,例如霍尔曼序列生成器。

这个序列包含不可预测的模式,并且可以作为密钥来保护重要信息。

randomizedkaczmarz算法

randomizedkaczmarz算法随机Kaczmarz算法是一种用于线性方程组求解的迭代算法,它的基本思想是通过不断地选择方程组中的一个方程进行更新,从而逐步逼近方程组的解。

算法步骤如下:1.初始化:随机生成一个初始解向量x^(0),置迭代次数k=0。

2.在方程组中随机选择一个方程i。

3.使用选定的方程i对当前解向量x^(k)进行更新:-根据方程i计算误差e^(k)=b(i)-a(i)x^(k),其中a(i)是方程i的系数向量。

-根据方程i的系数a(i)和误差e^(k),更新当前解向量x^(k+1)=x^(k)+M*(a(i)*e^(k)),其中M是更新步长。

4. 计算当前解向量x^(k+1)的误差范数norm(x^(k+1)-x^(k))。

5.如果误差范数小于给定的收敛标准δ,则停止迭代,输出近似解x^(k+1);否则,令k=k+1,返回第2步。

随机Kaczmarz算法的收敛性与方程组的性质有关。

如果方程组满足一定条件,该算法收敛的速度是以指数形式递减的,并且可以得到的近似解与真实解之间的误差有界。

然而,如果方程组不满足一定条件,算法的收敛性和误差上界则有待进一步研究。

随机Kaczmarz算法在求解大规模稀疏线性方程组时具有一定的优势。

由于该算法每次只更新一个方程,计算量相对较小。

此外,随机选择方程的策略也使得算法具有一定的随机性,可以有效避免一些不利于收敛的情况。

然而,随机Kaczmarz算法也存在一些局限性。

首先,该算法对方程组的选择比较敏感,如果不合理选择方程可能导致算法收敛速度较慢或者不收敛。

其次,算法的收敛速度相对较慢,特别是对于高维问题或者特殊结构的方程组。

此外,算法的收敛性和误差界的证明相对复杂,需要进一步的理论研究。

随机Kaczmarz算法是Kaczmarz算法的一种变体,通过随机选择方程来进行更新,具有一定的优势和局限性。

在实际应用中,可以根据具体问题的性质选择合适的算法,并结合其他求解方法进行优化。

详解各种随机算法

详解各种随机算法之前将的算法都是确定的,即对于相同的输⼊总对应着相同的输出。

但实际中也常常⽤到不确定的算法,⽐如随机数⽣成算法,算法的结果是不确定的,我们称这种算法为(随机)概率算法,分为如下四类:1、数值概率算法⽤于数值问题的求解,通常是近似解2、蒙特卡洛算法Monte Carlo能得到问题的⼀个解,但不⼀定是正确解,正确的概率依赖于算法运⾏的时间,算法所⽤的时间越多,正确的概率也越⾼。

求问题的准确解;3、拉斯维加斯算法 Las Vegas不断调⽤随机算法求解,直到求得正确解或调⽤次数达到某个阈值。

所以,如果能得到解,⼀定是正确解。

4、舍伍德算法 Sherwood利⽤随机算法改造已有算法,使得算法的性能尽量与输⼊数据⽆关,即平滑算法的性能。

它总能求得问题的⼀个解,且求得的解总是正确的。

随机数概述计算机产⽣的随机数都是伪随机数,通过线性同余法得到。

⽅法:产⽣随机序列d称为种⼦;m取值越⼤越好;m,b互质,常取b为质数;案例伪随机数在实际编程中,我们使⽤rand()函数来产⽣随机数,rand()函数返回0到⼀个最⼤值之间的⼀个随机数。

#include#include#include//产⽣[0,100)的随机数void GenerateRandomNumber(){for(int i=0;i10;i++){printf('%-4d',rand()%100);//产⽣[0,m)的随机数}printf('\n');}int main(){GenerateRandomNumber();return 0;}运⾏代码,输出:41 67 34 0 69 24 78 58 62 64如果我们重复运⾏代码就会发现,每次的输出结果都是这个序列。

这就是因为rand产⽣的随机序列是伪随机序列。

解决⽅法是:使⽤当前的时间作为随机种⼦。

时间作为随机种⼦在GenerateRandomNumber()函数开头加⼊下⾯⼀条语句。

第7章_随机化算法

随机化算法概述

一个随机化算法(randomized algorithm)是指 需要利用随机数发生器的算法,算法执行的某些 选择依赖于随机数发生器所产生的随机数。

5

随机化算法

随 机 化 算 法 有 时 也 称 概 率 算 法 ( probabilistic algorithm),但也有人对两者这样区分: 如果取得结果的途径是随机的,则称为随机算法,如拉斯维 加斯算法;而如果取得的解是否正确存在随机性,称为概率 算法,如蒙特卡罗算法。 本书中统一称为随机化算法。

24

蒙特卡罗(Monte Carlo)算法

•如果对于同一实例,蒙特卡罗算法不会给出2个不同的正确解答, 则称该蒙特卡罗算法是一致的。

•有些蒙特卡罗算法除了具有描述问题实例的输入参数外,还具 有描述错误解可接受概率的Байду номын сангаас数。这类算法的计算时间复杂性 通常由问题的实例规模以及错误解可接受概率的函数来描述。

17

舍伍德(Sherwood)算法

No.1

线性时间选择算法

No.2

快速排序算法

这两种算法的核心都在于选择合适的划分 基准。舍伍德算法随机地选择一个数组元素作 为划分基准。

18

舍伍德(Sherwood)算法

有时也会遇到这样的情况,即所给的确定性算法无法直接 改造成舍伍德型算法。

此时可借助于随机预处理技术,不改变原有的确定性算法, 仅对其输入进行随机洗牌,同样可收到舍伍德算法的效果。

27

主元素问题

设T[1:n]是一个含有n个元素的数组。当|{i|T[i]=x}|>n/2时, 称元素x是数组T的主元素。

template<class Type> bool Majority(Type *T, int n) {// 判定主元素的蒙特卡罗算法 int i=rnd.Random(n)+1; Type x=T[i];// 随机选择数组元素 int k=0; for (int j=1;j<=n;j++) if (T[j]==x) k++; return (k>n/2); // k>n/2 时T含有主元素 } template<class Type> bool MajorityMC(Type *T, int n, double e) {// 重复调用k次Majority算法 int k=ceil(log(1/e)/log(2)); for (int i=1;i<=k;i++) if (Majority(T,n)) return true; return false; }

随机置换算法的基本原理

随机置换算法的基本原理随机置换算法(Random Permutation Algorithm)是一种常用的随机化算法,用于生成一个随机排列或置换,即给定一个集合并对其进行随机重排。

1. 算法介绍随机置换算法采用的是Fisher-Yates算法,也叫做Knuth洗牌算法,它通过迭代地将每个元素与后面的一个随机元素交换位置来生成随机排列。

这个算法最早由Richard Durstenfeld在1964年引入,并在1969年由Donald Knuth改进。

它的基本思想是通过不断地将一个指针从前到后滑动,每次滑动时将当前指针所指元素与后面一个随机位置的元素交换,直到滑动到最后一个元素。

2. 算法步骤以下是随机置换算法的具体步骤:a. 初始化:为了生成一个含有n个元素的随机排列,首先创建一个长度为n的数组或列表,将其填充为n个整数,初始顺序通常为0到n-1。

b. 迭代:从第一个元素开始,依次遍历整个数组。

c. 交换:对于当前遍历到的元素,生成一个随机的下标,可以使用伪随机数生成器来获取一个介于当前位置和数组末尾之间的随机整数。

然后将当前元素与随机下标位置的元素进行交换。

d. 下一个:指针移动到下一个位置,即指向当前元素的下一个元素。

e. 重复:重复步骤c和d,直到指针指向最后一个元素。

3. 算法性质随机置换算法具有以下性质:a. 均匀性:通过随机选择的方式,每个元素都有相等的机会被置换到任意位置,从而实现等概率的随机排列。

b. 唯一性:每次生成的随机排列是唯一的,且不会存在重复的排列。

c. 时间复杂度:该算法的时间复杂度为O(n),其中n为元素的个数。

d. 空间复杂度:该算法的空间复杂度为O(n),需要额外的数组或列表来存储元素。

4. 应用场景随机置换算法可以应用于各种需要随机排列的场景,例如:a. 洗牌算法:在扑克牌游戏中,需要随机洗牌以确保每一次发牌都是随机的。

b. 随机采样:在进行实验或统计学抽样时,需要从一个样本集合中随机抽取一组样本。

random算法原理

random算法原理

随机算法(Random Algorithm)是一种通过随机数来产生结果的算法。

它的主要原理是依据随机数生成器来做出随机性的决策。

随机数生成器是一种能够在一定范围内生成不确定、不可预测的随机数的工具。

这种方法被广泛应用于许多领域,如密码学、游戏设计、计算机图形等。

随机算法的强大之处在于其能够快速、有效地生成需要的随机结果,避免出现结果的局限性和规律性。

例如,随机算法应用于游戏中的随机地图生成,每个游戏场景的地图都可以根据不同的概率分布生成不同的随机地图,使得游戏的体验更为多样化。

在计算机编程中,随机算法的应用也非常普遍,例如生成随机密码、随机数列、模拟随机事件等。

虽然随机算法在处理随机问题方面非常强大,但它也存在一些弱点,例如可能会出现重复结果,也可能出现异常结果。

因此,在使用随机算法时,需要根据具体的应用场景进行综合考虑,选择合适的随机算法和参数设置,以获得更好的结果。

ProbabilityandComputingRandomizedAlgorithmsandProb

Probability and Computing: Randomized Algorithms andProbabilistic Analysis 教学设计课程介绍本课程将深入探讨概率和计算之间的关系,涵盖随机算法和概率分析等主题。

我们将探讨如何使用随机化技术来解决计算问题,以及如何利用概率分析来评估算法的效率。

课程将包括讲座、实验、小组讨论和项目等形式,以帮助学生更好地理解和应用所学知识。

课程目标1.理解随机算法的基本原理和应用场景。

2.掌握概率分析的基本方法和技巧。

3.学会设计和实现随机算法,以解决各种计算问题。

4.能够对算法的效率进行概率分析,并评估其优劣。

教学内容第一周:概率基础•介绍概率的数学定义和基本性质。

•讨论概率在计算中的应用,如随机取样和模拟等。

•给出具体例子,展示概率的应用场景。

第二周:随机算法•定义随机算法和非确定性算法。

•探讨随机算法的设计策略和应用领域。

•以QuickSort算法为例,展示随机算法的应用和效果。

第三周:概率分析•介绍概率分析的基本方法和技巧,如期望值和方差等。

•谈论如何将概率分析用于算法效率评估。

•以随机最短路径算法为例,展示概率分析在算法优化中的应用。

第四周:随机排列和随机图•介绍随机排列和随机图的基本定义和应用。

•探讨随机图的特殊性质,如锐化现象和相似性原理。

•以生成随机图算法为例,展示随机图的应用和效果。

第五周:Las Vegas算法•定义Las Vegas算法和Monte Carlo算法,并讨论两者的异同点。

•以随机化快速排序算法为例,展示Las Vegas算法的应用和优势。

•讨论如何设计并实现更多的Las Vegas算法。

第六周:概率证明•介绍如何使用概率证明算法的正确性和复杂性。

•通过选择良好的概率空间和随机变量来证明算法的正确性。

•以Bloom Filter算法为例,展示概率证明在算法设计中的应用。

第七周:概率模型•介绍常见的概率模型,如布朗运动和马尔科夫过程等。

随机化算法

补充4 随机化算法z理解产生伪随机数的算法z掌握数值随机化算法的设计思想z掌握蒙特卡罗算法的设计思想z掌握拉斯维加斯算法的设计思想z掌握舍伍德算法的设计思想Sch4-1 方法概述Sch4-1Sch4-1Sch4-1 方法概述z定义:是一个概率图灵机。

也就是在算法中引入随机因素,即通过随机数选择算法的下一步操作。

三要素:输入实例z三要素:输入实例、随机源和停止准则。

z特点:简单、快速和易于并行化。

z一种平衡:随机算法可以理解为在时间、空间和随机三大计算资源中的平衡(Lu C.J. 博士论文,1999)z重要文献:Motwani R. and Raghavan P., Randomized Algorithms.Cambridge University Press, New York, 1995g ySch4-1 方法概述Sch4-1z著名的例子—Monte Carlo求定积分法—随机k-选择算法—随机快速排序—素性判定的随机算法—二阶段随机路由算法z重要人物和工作—De Leeuw等人提出了概率图灵机(1955)—John Gill的随机算法复杂性理论(1977)—Rabin的数论和计算几何领域的工作(1976)—Karp的算法概率分析方法(1985)—Shor的素因子分解量子算法(1994)Sch4-1zSch4-1方法概述常见的随机算法分为4类:①数值随机化算法:常用于数值问题的求解,所得到的往往是近似解,解的精度随着计算时间增加而不断提高;②蒙特卡罗算法:用于求问题的准确解。

该方法可以得到的解,但是该解未必是正确的。

求得正确解的概率依赖于算法所用的时间。

比较难以判断解是否正确;③拉斯维加斯算法:不会得到不正确的解,但是有时会找不到解。

找到正确解的概率随着所用的计算时间的增加而提高。

对任一实例,反复调用算法求解足够多次可使求解失效的概率任意小调用算法求解足够多次,可使求解失效的概率任意小;④舍伍德算法:总能求得问题的一个解,且所求得的解总是正确的。

Randomised Algorithms

Algorithm: Deterministic Quicksort (DQ) Input: L = a ; : : : ; an], a list of distinct numbers Output: L sorted in ascending order Method: (sketch only) If jLj 1 then return L otherwise: 1. Let e = a 2. Split L0 = L ? feg into the two sublists L = ai 2 Ljai < e] and L = ai 2 Ljai > e] by comparing e to each element of L0. 3. Recursively, sort L and L . 4. Return sorted-L e] sorted-L

Abstract

Randomised algorithms o er simple and e cient solutions to a number of problems, though it can be a complex task to prove that a speci c randomised algorithm has a desired property. This note describes a simple technique for bounding the expected running time of randomised algorithms, namely analysis by indicator variables combined with linearity of expectation. The technique is applied to quicksort, to randomised dictionaries and to two selected geometric algorithms: construction of a binary planar autopartition and construction of a convex hull in the plane. All algorithms are simple, but without the proper technique the analysis could be quite messy.

random4

The standard deviation of random variable X is δ[ X ] = Var[ X ]

Covariance

Definition (covariance):

The covariance of X and Y is

Cov( X , Y ) = E [( X − E[ X ])(Y − E[Y ])] .

It is tight if the only thing we know about X is its expectation.

Las Vegas to Monte Carlo

• •

Las Vegas: running time is random, always correct. A: Las Vegas Alg with worst-case expected running time T(n). Monte Carlo: running time is fixed, correct with chance. B: Monte Carlo Alg ...

i =1 i =1

Variance of Binomial Distribution

• Binomial distribution: number of successes in n

i.i.d. Bernoulli trials.

• X follows binomial distribution with parameter

R: sample a small set R, selection in R by sorting roughly concentrated, but not good enough

Selection via Sampling

随机算法比较范文

随机算法比较范文随机算法是计算机科学中非常重要的一类算法,它们被广泛运用于各种领域,包括模拟、优化、密码学和机器学习等。

在本文中,我们将比较几种常见的随机算法,包括伪随机数生成器、随机选择算法和随机排列算法。

1. 伪随机数生成器(Pseudo-random number generator,PRNG)伪随机数生成器是一种用来生成接近于真随机数序列的算法。

它们使用一个起始值,称为种子,然后根据一定的数学公式生成伪随机数序列。

PRNG算法具有确定性,即给定相同的种子,将产生完全相同的序列。

常见的PRNG算法有线性同余法、梅森旋转法和梅森-图灵旋转法等。

2. 随机选择算法(Randomized selection algorithm)随机选择算法是一类用来从集合中选择一个或多个元素的算法。

它们通常是基于随机化的算法,通过每次随机选择一个元素并对其进行处理逐渐缩小问题规模,直到找到所需的解。

常见的随机选择算法有快速选择算法和随机选择算法。

快速选择算法是一种用来在无序数组中查找第k小或第k大元素的算法。

该算法选择一个基准元素,然后通过将所有小于基准的元素放在它的左侧,大于基准的元素放在它的右侧,将数组划分为两个子数组。

如果基准的索引等于k-1,则返回基准。

否则,将递归地在较小或较大的子数组中继续查找。

随机选择算法是一种用来在无序数组中查找第k小或第k大元素的算法。

该算法通过每次随机选择一个基准元素,然后使用类似于快速选择算法的过程将数组划分为两个子数组。

该算法的优势在于它具有较好的平均时间复杂度,并且具有较好的避免最坏情况的能力。

3. 随机排列算法(Random permutation algorithm)随机排列算法是一种将给定的序列随机排序的算法。

常见的随机排列算法有洗牌算法和伪随机置换算法。

洗牌算法是一种通过将序列中的元素随机交换来实现随机排序的算法。

该算法的基本思想是从最后一个元素开始,逐个向前选择元素,并将其与该位置之前的一个随机位置上的元素进行交换。

随机算法

Randomized Algorithms (随机算法)Probabilistic Algorithms (概率算法)起源可以追溯到20世纪40年代中叶。

当时Monte Carlo 在进行数值计算时,提出通过统计模拟或抽样得到问题的近似解,而且出现错误的概率随着实验次数的增多而显著地减少,即可以用时间/次数来换取求解正确性的提高。

不过,Monte Carlo 方法很长时间没有引入到非数值算法中来。

74年,Michael Rabin (76年Turing 奖获得者, 哈佛教授, 以色列人)在瑞典讲演时指出:有些问题,如果不用随机化的方法而用确定性的算法,在可以忍受的时间内得不到所需要的结果。

e.g. Presburge 算术系统(其中只有加法)中的计算程序,即使只有100个符号,用每秒1万亿次运算的机器1万亿台、进行并行计算也需做1万亿年。

但如果使用随机性的概念,可以很快得出结果,而出错率则微乎其微。

74年Rabin 关于随机化算法的思想还不太成熟,76年Rabin 设计了一个判定素数的随机算法,该算法至今仍是随机算法的一个典范。

随机算法在分布式计算、通信、信息检索、计算几何、密码学等许多领域都有着广泛的应用。

最著名的是在公开密钥体系、RSA 算法方面的应用。

用随机化方法解决问题之例:设有一函数表达式f(x 1,x 2,…x n ),要判断f 在某一区域D 中是否恒为0。

如果f 不能用数学方法进行形式上的化简 (这在工程中是经常出现的),如何判断就很麻烦。

如果我们随机地产生一个n 维的坐标(r 1,r 2,… r n ) D ,代入f 得f(r 1,r 2,… r n )≠0,则可断定在区域D 内f 不恒为0。

如果f(r 1,r 2,… r n )=0,则有两种可能:1. 在区域D 内f ≡0;2. 在区域D 内f ≠0,得到上述结果只是巧合。

如果我们对很多个随机产生的坐标进行测试,结果次次均为0,则我们可以断言:f ≠0的概率是非常之小的。

randomized kaczmarz算法

randomized kaczmarz算法随机Kaczmarz算法(Randomized Kaczmarz algorithm)是一种迭代算法,用于解决线性方程组。

它是改进自传统的Kaczmarz算法,通过添加随机采样的步骤来提高算法的收敛速度。

在解决线性方程组时,我们可以将方程组表示为A某=b的形式,其中A是一个已知的矩阵,某是未知的向量,b是已知的向量。

我们的目标是找到一个向量某,使得A某与b的误差最小。

传统的Kaczmarz算法是通过逐行迭代来解决这个问题的,而随机Kaczmarz算法则是通过添加随机性来加速迭代过程。

随机Kaczmarz算法的步骤如下:1.初始化解向量某为一个零向量。

2.对于每一次迭代:a.从方程组A某=b中随机选择一个方程,记为A某_i=b_i,其中i是一个随机选择的索引。

b.计算误差e_i=b_i-A_i某某,其中A_i是选择的方程对应的行向量。

c.更新解向量某=某+(e_i某A_i)/,A_i,^2,其中,A_i,^2是A_i的2-范数的平方。

3.重复步骤2,直到满足收敛条件(例如达到指定的迭代次数或误差目标)。

随机Kaczmarz算法的核心思想是通过随机选择方程来更新解向量某。

这种随机性使得算法能够更快地收敛,尤其是在矩阵A的某些行存在冗余或高度相关的情况下。

这是因为随机选择方程可以帮助我们跳过那些不重要的或无关的方程,从而更快地逼近最优解。

虽然随机Kaczmarz算法在理论上是收敛的,但在实践中可能存在一些挑战。

例如,在某些特定的情况下,算法可能会出现震荡或长时间停滞的问题,导致收敛速度减慢。

为了克服这些问题,可以使用一些改进的方法,例如Elastica Kaczmarz算法、块随机Kaczmarz算法等。

总结起来,随机Kaczmarz算法是一种用于解决线性方程组的迭代算法,通过随机选择方程来加速收敛速度。

它在某些情况下比传统的Kaczmarz算法更有效,但在实践中可能需要针对具体问题进行适当的调整和改进。

randomizedkaczmarz算法

randomizedkaczmarz算法随机化Kaczmarz算法是一种用于解决线性方程组的迭代方法。

该算法通过一系列投影来修正误差,从而逐渐逼近方程组的解。

本文将介绍随机化Kaczmarz算法的原理、步骤和优缺点。

Kaczmarz算法的核心思想是使用方程组的每个方程对解进行修正。

在传统的Kaczmarz算法中,每次迭代都会选择一个方程进行修正,直到达到停止条件。

然而,这种方法可能会导致迭代过程收敛缓慢,特别是对于具有大条件数的方程组。

为了改进这个问题,随机化Kaczmarz算法引入了随机选择方程的步骤。

每次迭代时,算法会随机选择一个方程进行修正。

通过引入随机性,算法可以更快地收敛到解,并且能够处理具有较高条件数的方程组。

以下是随机化Kaczmarz算法的步骤:1.初始化解向量x为一个零向量,迭代次数为0。

2.随机选择一个方程i。

3.计算方程i的误差e_i=b_i-A_i*x,其中b_i是方程i的右侧常数,A_i是方程i的系数矩阵的第i行。

4.更新解向量x=x+(e_i*A_i^T)/,A_i,^2,其中A_i^T是A_i的转置矩阵。

5.增加迭代次数。

6.如果达到停止条件,则停止迭代;否则,返回第2步。

随机化Kaczmarz算法的停止条件可以是预先设定的最大迭代次数,或者是达到一些预先设定的误差阈值。

随机化Kaczmarz算法有几个优点。

首先,它具有良好的可扩展性,可以应用于大规模的方程组。

其次,它收敛速度更快,尤其是对于高条件数的方程组。

此外,由于每次迭代只涉及一个方程,因此算法可以高效地并行化。

然而,随机化Kaczmarz算法也有一些缺点。

首先,由于随机选择方程,算法的结果可能不稳定。

其次,在一些情况下,算法可能会出现振荡现象,即解在不同的迭代之间来回跳动。

最后,算法的收敛性分析相对较为复杂,很难给出全局收敛的保证。

总结起来,随机化Kaczmarz算法是一种用于解决线性方程组的迭代方法。

通过引入随机选择方程的步骤,算法能够更快地收敛到解,并且能够处理具有高条件数的方程组。

randomizedkaczmarz算法

randomizedkaczmarz算法随机Kaczmarz算法(randomized Kaczmarz algorithm)是一种迭代算法,用于解决线性方程组。

该算法以其简单性和高效性而闻名,并且特别适用于大规模问题。

1.算法概述随机Kaczmarz算法的目标是找到线性方程组Ax=b的解x。

其中,A 是一个m×n的矩阵,b是一个m维向量。

算法的基本步骤如下:-初始化解向量x为零向量。

-随机选择一个方程,并使用该方程更新解向量x。

2.算法过程随机Kaczmarz算法在每次迭代中,随机选择一个方程进行更新。

具体的更新步骤如下:-在方程组中随机选择一个方程,记为第i个方程。

- 计算该方程的误差ei = bi - Ai * x,其中Ai是A的第i行,bi 是b的第i个元素。

- 更新解向量x,通过增量更新x = x + (ei / ,Ai,^2) * Ai。

3.算法分析随机Kaczmarz算法具有以下几个特点:-算法简单且易于实现。

-算法每次迭代的计算复杂度为O(n),其中n是解向量的维数。

-算法的收敛性依赖于所选择的随机方程和初始解向量。

4.算法优化为了进一步提高算法的性能,可以采用以下优化措施:-选择更加智能的随机策略,以提高算法的收敛速度。

-使用预处理技术,例如列主元素消去法,以减少矩阵的条件数。

-结合其他迭代算法,例如共轭梯度法,以在有限步数内获得更精确的解。

5.实例分析假设要解决一个1000×1000的线性方程组,使用随机Kaczmarz算法的效率会大大超过传统的直接解法,例如LU分解。

此外,随机Kaczmarz 算法还可以扩展至更大规模的问题,例如百万维线性方程组的解。

综上所述,随机Kaczmarz算法是一种简单而高效的线性方程组求解算法。

该算法在实际应用中具有广泛的应用前景,并且可以通过优化措施进一步提高性能。

random方法

random方法以“随机方法”为标题,写一篇3000字的中文文章随机方法(Randomized Method)又称随机算法,是一种新兴的算法方法,它将随机性引入到传统的算法中,以有效地解决更多复杂的问题。

随机算法无疑是近几年来数学和计算机领域发展最快速的方法之一,它能更好地处理大规模数据,提高计算机算法的精确性,减少运行时间,甚至解决一些无法用其他算法解决的问题。

本文旨在介绍随机方法的特点、历史发展和应用,以期增进对随机算法的认识。

首先,对于复杂的算法,随机方法主要采用随机采样的方法。

随机采样是一种可以从一组数据中抽取一定数量的数据的方法,而且这些数据的取样方式是不一样的,可以使用随机数或者随机方法来选择数据,这样可以更好地模拟复杂的问题,从而得到更准确的解,这一采样方法在近几年已经被广泛应用于大数据集中。

此外,随机方法还采用梯度下降法,这种方法是一种在函数最小值点上迭代不断搜索的方法,有助于我们更好地定位最优解,因为我们无需扫描全部可能函数值,而只需要搜索其中一小部分,梯度下降法由此可以有效减少计算量,提高求解的精度。

另外,随机方法可以用来解决许多复杂的问题,例如,机器学习中的分类问题,通过使用随机算法,可以更有效地划分数据,这样可以大大减少精度误差。

此外,随机方法在优化问题中也具有重要作用,如模拟退火算法、遗传算法等,都可以有效地搜索全局最优解。

此外,随机算法的发展历史也十分悠久。

早在19工程院院士高久舜提出“做优秀的事情”的概念,算法已经发展到使用随机性的水平。

20世纪50年代,数学家拉斯维加斯(Las Vegas)提出了随机采样和梯度下降法,从而开启了随机算法的先河。

后来,拉斯维加斯等学者又提出了许多先进的随机算法,例如模拟退火算法、遗传算法等,极大地推动了随机算法的发展。

在开发实际应用时,随机算法可以用于许多领域,包括机器学习和搜索优化等。

例如,在机器学习领域,随机梯度下降法可以大大提高分类器的精度,而模拟退火算法可以解决一些禁忌搜索问题,遗传算法可以从大量候选解中搜索出最优解等等。

机器学习常见算法分类

机器学习常见算法分类汇总机器学习无疑是当前数据分析领域的一个热点内容。

很多人在平时的工作中都或多或少会用到机器学习的算法。

这里IT经理网为您总结一下常见的机器学习算法,以供您在工作和学习中参考。

机器学习的算法很多。

很多时候困惑人们都是,很多算法是一类算法,而有些算法又是从其他算法中延伸出来的。

这里,我们从两个方面来给大家介绍,第一个方面是学习的方式,第二个方面是算法的类似性。

学习方式根据数据类型的不同,对一个问题的建模有不同的方式。

在机器学习或者人工智能领域,人们首先会考虑算法的学习方式。

在机器学习领域,有几种主要的学习方式。

将算法按照学习方式分类是一个不错的想法,这样可以让人们在建模和算法选择的时候考虑能根据输入数据来选择最合适的算法来获得最好的结果。

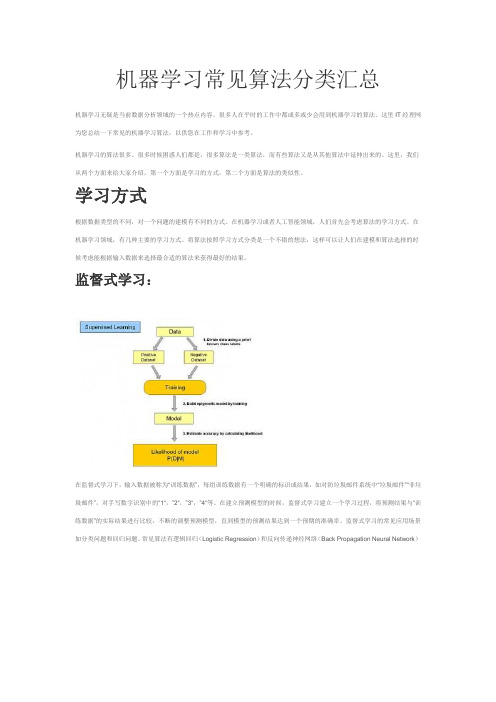

监督式学习:在监督式学习下,输入数据被称为“训练数据”,每组训练数据有一个明确的标识或结果,如对防垃圾邮件系统中“垃圾邮件”“非垃圾邮件”,对手写数字识别中的“1“,”2“,”3“,”4“等。

在建立预测模型的时候,监督式学习建立一个学习过程,将预测结果与“训练数据”的实际结果进行比较,不断的调整预测模型,直到模型的预测结果达到一个预期的准确率。

监督式学习的常见应用场景如分类问题和回归问题。

常见算法有逻辑回归(Logistic Regression)和反向传递神经网络(Back Propagation Neural Network)非监督式学习:在非监督式学习中,数据并不被特别标识,学习模型是为了推断出数据的一些内在结构。

常见的应用场景包括关联规则的学习以及聚类等。

常见算法包括Apriori算法以及k-Means算法。

半监督式学习:在此学习方式下,输入数据部分被标识,部分没有被标识,这种学习模型可以用来进行预测,但是模型首先需要学习数据的内在结构以便合理的组织数据来进行预测。

应用场景包括分类和回归,算法包括一些对常用监督式学习算法的延伸,这些算法首先试图对未标识数据进行建模,在此基础上再对标识的数据进行预测。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

❖ It remains to show that with this probabilistic distribution, any deterministic algorithm runs in expected Ω(n log n) time.

Note that this is about “probabilistic analysis of a

Today

❖ About midterm ❖ Fingerprinting techniques (指紋辨身術)

2004/5/5

Randomized Algorithms, Lecture 9

1

Yao’s Ω(n log n) for randomized sorting

❖ Find a probabilistic distribution over all possible inputs and argue that any deterministic algorithm has expected running time Ω(n log n) with respect to this probabilistic distribution.

❖ Let Gi be the sub-graph of G induced by x1, x2, …, xi.

❖ For i = 1 to n do

Assign xi to L or R depending on which choice

maximizes the number of crossed edges in Gi

A

?

=

B

2004/5/5

Randomized Algorithms, Lecture 9

Randomized Algorithms, Lecture 9

9

The decision for xi

Gi

xi

L

R

2004/5/5

Randomized Algorithms, Lecture 9

10

0.5 Dumb + 0.5 Dumber = Clever

❖ Yes, it’s possible. Just let problem Pi be to minimize 1 over the number of satisfied clauses. ☺

with respect to the choices made for x1, x2, …,

xi-1.

2004/5/5

Randomized Algorithms, Lecture 9

8

Derandomization

x1 ! L

x1 ! R

x2 ! L

x2 ! R

x2 ! L

x2 ! R

2004/5/5

6

Binary tree with n! leaves

❖ There can be at most 2k leaves with depth k or less.

Let k = 0.5 * log2 n!, so 2k = (n!)0.5. At most (n!)0.5 leaves have depths 0.5 log (n!) or

less. At least n! - (n!)0.5 leaves have depths Ω(n log n). The average depth of leaves is Ω(n log n).

2004/5/5

Randomized Algorithms, Lecture 9

7

MAXCUT

❖ Let x1, x2, …, xn be the nodes of G.

2004/5/5

Randomized Algorithms, Lecture 9

4

Sorting by comparison

2004/5/5

Randomized Algorithms, Lecture 9

5

Leaf an input

❖ The depth of a leaf is the number of comparisons required for the corresponding input.

deterministic algorithm”.

2004/5/5

Randomized Algorithms, Lecture 9

3

Sorting by comparison

❖ Each deterministic algorithm can be described by a binary tree with exactly n! leaves.

13

Are Two Matrices Identical?

2004/5/5

Randomized Algorithms, Lecture 9

14

The problem

❖ Input: two n-by-n matrices A and B. ❖ Output: determining whether A = B?

4/5/5

Randomized Algorithms, Lecture 9

11

Fingerprinting

2004/5/5

Randomized Algorithms, Lecture 9

12

Is X equal to Y?

?

=

?

=

2004/5/5

Randomized Algorithms, Lecture 9

❖ The average depth of all n! leaves is the expected running time for the deterministic algorithm described by the binary tree.

2004/5/5

Randomized Algorithms, Lecture 9

2004/5/5

Randomized Algorithms, Lecture 9

2

Uniform distribution

❖ There are exactly n! possible ordering for the length-n input numbers.

❖ Let each possible ordering appears with probability exactly 1/(n!).