《信息论编码》模拟试题二及参考答案

信息论与编码习题与答案第二章

36第一章信息、消息、信号的定义?三者的关系? 通信系统的模型?各个主要功能模块及作用? 第二章信源的分类?自信息量、条件自信息量、平均自信息量、信源熵、不确定度、条件熵、疑义度、 噪声熵、联合熵、互信息量、条件互信息量、平均互信息量以及相对熵的概念? 计算方法? 冗余度?具有概率为p (x )的符号x 自信息量:I (X )- -iogp (x ) 条件自信息量:|(X i= —log p (X i y i )平均自信息量、平均不确定度、信源熵:H (X )二-為p (x )log p (x )iH (XY )=送 p (X i ,y j )|(X i y j ) 一瓦ijij联合熵: H (XY )=:Z p (X i ,y j )I(X i ,y j ^Z p (X i ,y j )log p (X i ,y j)ijij互信息: 弋pyx)亍 pyx) l(X;Y)=W p(X i , y .)log=S p(X i )p(y . X i )log j 入儿p(y j )j 入儿入p(y j )熵的基本性质:非负性、对称性、确定性2.3同时掷出两个正常的骰子,也就是各面呈现的概率都为 1/6,求:(1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, , , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

解: (1)I (xj =-log p(xj 工「log 丄 4.170 bit181l(xj - - log p(xj - - log 5.170 bit条件熵: p (X i ,y j )lo gp (X i y j )p(X i )11116 6 6 61 181 p(x"61 36(1 1 11、 H(X)=—E p(X j )log p(xj = — 6汉 一log — +15 汉一log — 丨=4.337 bit/symbol i< 36 36 18 18 丿(4)两个点数求和的概率分布如下:X234 5 6 7 8 9 10 11 12\=V1 115 15 11 1 1P(X)広 18 12 9 36 6 36 9 12 18 36 H(X) =p(X i )log p(X i )i(1 1 11 1 1 1 1 5511)=_2汉 log +2 乂 log+2 工 log +2乂 log +2 工 log + log< 36 36 181812 12 9 936 36 6 6 J= 3.274 bit / symbol(5){(1,2),(1,3),(1,4),(1,5),(1,6),(2,1),(3,1),(4,1),(5,1),(6,1),(1,1)}11 l(x 」--log p(x 」-- log 1.71036X x 1 = 0 x 2 = 1 x 3 = 2 x 4 = 32.7设有一离散无记忆信源,其概率空间为=f 丿 <3/8 1/41/4 1/8 丿(1 )求每个符号的自信息量 (2)信源发出一消息符号序列为 {202 120 130 213 001 203 210 110 321010 021032 011 223210},求该序列的自信息量和平均每个符号携带的信息量18I (x 1) = log 2log 21.415bit p(x 1)3同理可以求得 1(x2)二 2bit, I (x3) = 2bit, I (x4) = 3bit因为信源无记忆,所以此消息序列的信息量就等于该序列中各个符号的信息量之和 就I =141(X 1) 131(X 2) 121(X 3) 61(X 4)=87.81bit11 12 13 14 1516 21 22 23 24 2526 31 32 33 34 3536 41 42 43 44 4546 51 52 53 54 5556 616263646566共有21种组合:其中11,22,33, 44,55, 66的概率是 1 1 X —6 6 ⑶两个点数的排列如下:1 1 1其他15个组合的概率是2 ——二—6 6 181 36p(X i )— 11 6 6 11 36bit解:2.8试问四进制、八进制脉冲所含信息量是二进制脉冲的多少倍?解:四进制脉冲可以表示 4个不同的消息,例如 八进制脉冲可以表示 8个不同的消息,例如 二进制脉冲可以表示 2个不同的消息,例如 假设每个消息的发出都是等概率的,则:四进制脉冲的平均信息量 H (XJ = log n = Iog4 = 2 bit/symbol 八进制脉冲的平均信息量 H (X 2) = log n = Iog8 = 3 bit/symbol 二进制脉冲的平均信息量 H (X 0) = log n = log2 = 1 bit/symbol所以:四进制、八进制脉冲所含信息量分别是二进制脉冲信息量的 2倍和3倍。

信息论与编码习题参考答案(全)

信息论与编码习题参考答案第一章 单符号离散信源同时掷一对均匀的子,试求:(1)“2和6同时出现”这一事件的自信息量; (2)“两个5同时出现”这一事件的自信息量; (3)两个点数的各种组合的熵; (4)两个点数之和的熵;(5)“两个点数中至少有一个是1”的自信息量。

解:bitP a I N n P bit P a I N n P c c N 17.536log log )(361)2(17.418log log )(362)1(36662221111616==-=∴====-=∴===⨯==样本空间:* (3)信源空间:bit x H 32.436log 3616236log 36215)(=⨯⨯+⨯⨯=∴bitx H 71.3636log 366536log 3610 436log 368336log 366236log 36436log 362)(=⨯⨯+⨯+⨯+⨯⨯=∴++ (5) bit P a I N n P 17.11136log log )(3611333==-=∴==?如有6行、8列的棋型方格,若有两个质点A 和B ,分别以等概落入任一方格内,且它们的坐标分别为(Xa ,Ya ), (Xb ,Yb ),但A ,B 不能同时落入同一方格内。

(1) 若仅有质点A ,求A 落入任一方格的平均信息量; (2) 若已知A 已落入,求B 落入的平均信息量; (3) 若A ,B 是可辨认的,求A ,B 落入的平均信息量。

解: !bita P a P a a P a I a P A i 58.548log )(log )()(H 48log )(log )(481)(:)1(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率bitb P b P b b P b I b P A i 55.547log )(log )()(H 47log )(log )(471)(:B ,)2(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率是落入任一格的情况下在已知 bitAB P AB P AB H AB P AB I AB P AB i i i i i i i 14.11)4748log()(log )()()(log )(471481)()3(47481=⨯=-=-=∴⨯=∑⨯=是同时落入某两格的概率从大量统计资料知道,男性中红绿色盲的发病率为7%,女性发病率为%.如果你问一位男士:“你是否是红绿色盲”他的回答可能是:“是”,也可能“不是”。

信息论与编码试题与答案

1、平均自信息为表示信源的平均不确定度,也表示平均每个信源消息所提供的信息量。

平均互信息表示从Y获得的关于每个X的平均信息量,也表示发X前后Y的平均不确定性减少的量,还表示通信前后整个系统不确定性减少的量。

2、最大离散熵定理为:离散无记忆信源,等概率分布时熵最大。

3、最大熵值为。

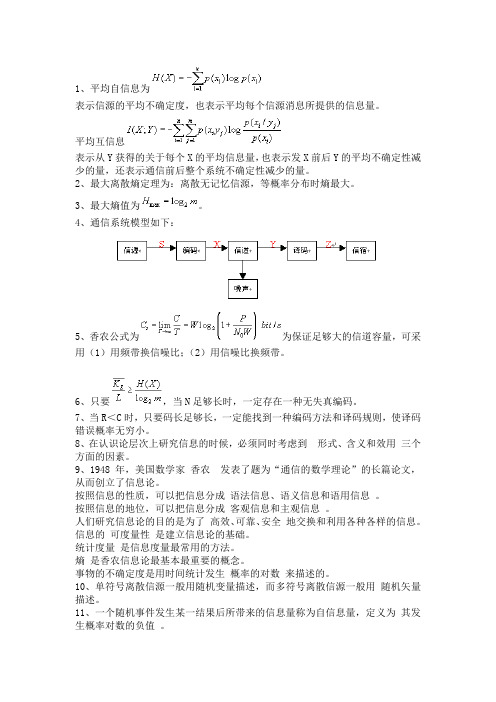

4、通信系统模型如下:5、香农公式为为保证足够大的信道容量,可采用(1)用频带换信噪比;(2)用信噪比换频带。

6、只要,当N足够长时,一定存在一种无失真编码。

7、当R<C时,只要码长足够长,一定能找到一种编码方法和译码规则,使译码错误概率无穷小。

8、在认识论层次上研究信息的时候,必须同时考虑到形式、含义和效用三个方面的因素。

9、1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

按照信息的性质,可以把信息分成语法信息、语义信息和语用信息。

按照信息的地位,可以把信息分成客观信息和主观信息。

人们研究信息论的目的是为了高效、可靠、安全地交换和利用各种各样的信息。

信息的可度量性是建立信息论的基础。

统计度量是信息度量最常用的方法。

熵是香农信息论最基本最重要的概念。

事物的不确定度是用时间统计发生概率的对数来描述的。

10、单符号离散信源一般用随机变量描述,而多符号离散信源一般用随机矢量描述。

11、一个随机事件发生某一结果后所带来的信息量称为自信息量,定义为其发生概率对数的负值。

12、自信息量的单位一般有 比特、奈特和哈特 。

13、必然事件的自信息是 0 。

14、不可能事件的自信息量是 ∞ 。

15、两个相互独立的随机变量的联合自信息量等于 两个自信息量之和 。

16、数据处理定理:当消息经过多级处理后,随着处理器数目的增多,输入消息与输出消息之间的平均互信息量 趋于变小 。

17、离散平稳无记忆信源X 的N 次扩展信源的熵等于离散信源X 的熵的 N 倍 。

18、离散平稳有记忆信源的极限熵,=∞H )/(lim 121-∞→N N N X X X X H 。

信息论与编码考试题(附答案版)

1.按发出符号之间的关系来分,信源可以分为(有记忆信源)和(无记忆信源)2.连续信源的熵是(无穷大),不再具有熵的物理含义。

3.对于有记忆离散序列信源,需引入(条件熵)描述信源发出的符号序列内各个符号之间的统计关联特性3.连续信源X,平均功率被限定为P时,符合(正态)分布才具有最大熵,最大熵是(1/2ln (2πⅇσ2))。

4.数据处理过程中信息具有(不增性)。

5.信源冗余度产生的原因包括(信源符号之间的相关性)和(信源符号分布的不均匀性)。

6.单符号连续信道的信道容量取决于(信噪比)。

7.香农信息极限的含义是(当带宽不受限制时,传送1bit信息,信噪比最低只需-1.6ch3)。

8.对于无失真信源编码,平均码长越小,说明压缩效率(越高)。

9.对于限失真信源编码,保证D的前提下,尽量减少(R(D))。

10.立即码指的是(接收端收到一个完整的码字后可立即译码)。

11.算术编码是(非)分组码。

12.游程编码是(无)失真信源编码。

13.线性分组码的(校验矩阵)就是该码空间的对偶空间的生成矩阵。

14.若(n,k)线性分组码为MDC码,那么它的最小码距为(n-k+1)。

15.完备码的特点是(围绕2k个码字、汉明矩d=[(d min-1)/2]的球都是不相交的每一个接受吗字都落在这些球中之一,因此接收码离发码的距离至多为t,这时所有重量≤t的差错图案都能用最佳译码器得到纠正,而所有重量≤t+1的差错图案都不能纠正)。

16.卷积码的自由距离决定了其(检错和纠错能力)。

(对)1、信息是指各个事物运动的状态及状态变化的方式。

(对)2、信息就是信息,既不是物质也不是能量。

(错)3、马尔可夫信源是离散无记忆信源。

(错)4、不可约的马尔可夫链一定是遍历的。

(对)5、单符号连续信源的绝对熵为无穷大。

(错)6、序列信源的极限熵是这样定义的:H(X)=H(XL|X1,X2,…,XL-1)。

(对)7、平均互信息量I(X;Y)是接收端所获取的关于发送端信源X的信息量。

信息论与编码第2章习题解答

信息论与编码第2章习题解答2.1设有12枚同值硬币,其中⼀枚为假币。

只知道假币的重量与真币的重量不同,但不知究竟是重还是轻。

现⽤⽐较天平左右两边轻重的⽅法来测量(因⽆砝码)。

为了在天平上称出哪⼀枚是假币,试问⾄少必须称多少次?解:分三组,每组4个,任意取两组称。

会有两种情况,平衡,或不平衡。

(1) 平衡:明确假币在其余的4个⾥⾯。

从这4个⾥⾯任意取3个,并从其余8个好的⾥⾯也取3个称。

⼜有两种情况:平衡或不平衡。

a )平衡:称⼀下那个剩下的就⾏了。

b )不平衡:我们⾄少知道那组假币是轻还是重。

从这三个有假币的组⾥任意选两个称⼀下,⼜有两种情况:平衡与不平衡,不过我们已经知道假币的轻重情况了,⾃然的,不平衡直接就知道谁是假币;平衡的话,剩下的呢个⾃然是假币,并且我们也知道他是轻还是重。

(2) 不平衡:假定已经确定该组⾥有假币时候:推论1:在知道该组是轻还是重的时候,只称⼀次,能找出假币的话,那么这组的个数不超过3。

我们知道,只要我们知道了该组(3个)有假币,并且知道轻重,只要称⼀次就可以找出来假币了。

从不平衡的两组中,⽐如轻的⼀组⾥分为3和1表⽰为“轻(3)”和“轻(1)”,同样重的⼀组也是分成3和1标⽰为“重(3)”和“重(1)”。

在从另外4个剩下的,也就是好的⼀组⾥取3个表⽰为“准(3)”。

交叉组合为:轻(3) + 重(1)?=======?轻(1) + 准(3)来称⼀下。

⼜会有3种情况:(1)左⾯轻:这说明假币⼀定在第⼀次称的时候的轻的⼀组,因为“重(1)”也出现在现在轻的⼀边,我们已经知道,假币是轻的。

那么假币在轻(3)⾥⾯,根据推论1,再称⼀次就可以了。

(2)右⾯轻:这⾥有两种可能:“重(1)”是假币,它是重的,或者“轻(1)”是假币,它是轻的。

这两种情况,任意取这两个中的⼀个和⼀个真币称⼀下即可。

(3)平衡:假币在“重(3)”⾥⾯,⽽且是重的。

根据推论也只要称⼀次即可。

2.2 同时扔⼀对骰⼦,当得知“两骰⼦⾯朝上点数之和为2”或“⾯朝上点数之和为8”或“骰⼦⾯朝上之和是3和4”时,试问这三种情况分别获得多少信息量?解:设“两骰⼦⾯朝上点数之和为2”为事件A ,则在可能出现的36种可能中,只能个骰⼦都为1,这⼀种结果。

信息论与编码考题标准答案

信 息 论 与 编 码 考题与标准答案第一题 选择题1.信息是( b )a. 是事物运动状态或存在方式的描述b.是事物运动状态或存在方式的不确定性的描述c.消息、文字、图象d.信号 2.下列表达式哪一个是正确的(e )a. H (X /Y )=H (Y /X )b. )();(0Y H Y X I <≤c.)/()(),(X Y H X H Y X I -=d. )()/(Y H Y X H ≤e. H (XY )=H (X )+H (Y /X )3.离散信源序列长度为L ,其序列熵可以表示为( b )a. )()(1X LH X H =b.c. ∑==Ll lXH X H 1)()(d. )()(X H X H L =4.若代表信源的N 维随机变量的取值被限制在一定的范围之内,则连续信源为( c ),具有最大熵。

a. 指数分布b. 正态分布c. 均匀分布d. 泊松分布 5.对于平均互信息);(Y X I ,下列说法正确的是( b )a. 当)(i x p 一定时,是信道传递概率)(i j x y p 的上凸函数,存在极大值b. 当)(i x p 一定时,是信道传递概率)(i j x y p 的下凸函数,存在极小值c.当)(i j x y p 一定时,是先验概率)(i x p 的上凸函数,存在极小值d.当)(i j x y p 一定时,是先验概率)(i x p 的下凸函数,存在极小值 6.当信道输入呈( c )分布时,强对称离散信道能够传输最大的平均信息量,即达到信道容量 a. 均匀分布 b. 固定分布 c. 等概率分布 d. 正态分布7.当信道为高斯加性连续信道时,可以通过以下哪些方法提高抗干扰性(b d ) a. 减小带宽 b. 增大发射功率 c. 减小发射功率 d.增加带宽第二题 设信源 ⎥⎦⎤⎢⎣⎡=⎥⎦⎤⎢⎣⎡6.04.0)(21x x X p X 通过一干扰信道,接收符号为Y={y 1,y 2},信道传递矩阵为⎥⎦⎤⎢⎣⎡43416165 求:(1) 信源 X 中事件 x 1 和 x 2 分别含有的自信息量。

信息论与编码第二章习题参考答案

2.1 同时掷两个正常的骰子,也就是各面呈现的概率都是1/6,求: (1)“3和5同时出现”事件的自信息量; (2)“两个1同时出现”事件的自信息量;(3)两个点数的各种组合(无序对)的熵或平均信息量; (4)两个点数之和(即2,3,…,12构成的子集)的熵;(5)两个点数中至少有一个是1的自信息。

解:(1)一个骰子点数记为X ,另一个骰子的点数记做Y ,X 、Y 之间相互独立,且都服从等概率分布,即同理一个骰子点数为3,另一个骰子点数为5属于组合问题,对应的概率为181616161613Y Py 5X Px 5Y Py 3X Px P 1=⨯+⨯===+===)()()()(对应的信息量为比特)()(17.4181-lb P -I 11===lb(2)两个骰子点数同时为1的概率为)()(3611Y Py 1X Px P 2==== 对应的信息量为比特)()(17.5361-lb P -I 22===lb(3)各种组合及其对应的概率如下,6,5,4,3,2,1Y X 3616161Y X P ===⨯==)(共6种可能18161612Y X P =⨯⨯=≠)( 共有15种可能因此对应的熵或者平均自信息量为34.418118115-3613616-H 1=⨯⨯⨯⨯=)()(lb lb 比特/符号 (4)令Z=X+Y ,可以计算出Z 对应的概率分布如下对应的熵为符号比特)()()()()()()(/1.914366366-3653652-3643642-3633632-3633632-3623622-361361-2H 1=⨯⨯⨯⨯⨯⨯⨯⨯⨯⨯⨯⨯⨯=lb lb lb lb lb lb lb (5)X 、Y 相互独立,所以联合熵为比特)()(597.06162Y X,I =⨯=lb2.2 设在一只布袋中装有100个大小、手感完全相同的球,每个球上涂有一种颜色。

100个球的颜色有下列3种情况:(1)红色球和白色球各50个; (2)红色球99个,白色球1个; (3)红、黄、蓝、白色球各25个。

信息论与编码第二章答案

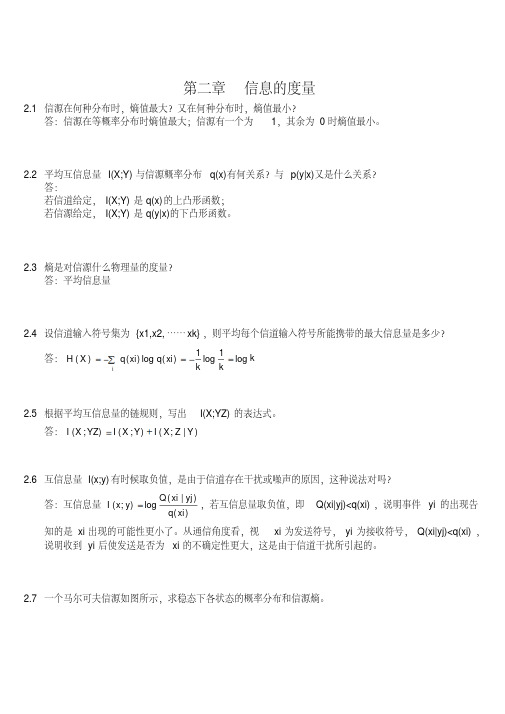

第二章信息的度量2.1信源在何种分布时,熵值最大?又在何种分布时,熵值最小?答:信源在等概率分布时熵值最大;信源有一个为1,其余为0时熵值最小。

2.2平均互信息量I(X;Y)与信源概率分布q(x)有何关系?与p(y|x)又是什么关系?答:若信道给定,I(X;Y)是q(x)的上凸形函数;若信源给定,I(X;Y)是q(y|x)的下凸形函数。

2.3熵是对信源什么物理量的度量?答:平均信息量2.4设信道输入符号集为{x1,x2,……xk},则平均每个信道输入符号所能携带的最大信息量是多少?答:kk k xi q xi q X H i log 1log 1)(log )()(2.5根据平均互信息量的链规则,写出I(X;YZ)的表达式。

答:)|;();();(Y Z X I Y X I YZ X I 2.6互信息量I(x;y)有时候取负值,是由于信道存在干扰或噪声的原因,这种说法对吗?答:互信息量)()|(log );(xi q yj xi Q y x I ,若互信息量取负值,即Q(xi|yj)<q(xi),说明事件yi 的出现告知的是xi 出现的可能性更小了。

从通信角度看,视xi 为发送符号,yi 为接收符号,Q(xi|yj)<q(xi),说明收到yi 后使发送是否为xi 的不确定性更大,这是由于信道干扰所引起的。

2.7一个马尔可夫信源如图所示,求稳态下各状态的概率分布和信源熵。

答:由图示可知:43)|(41)|(32)|(31)|(41)|(43)|(222111110201s x p s x p s x p s x p s x p s x p 即:43)|(0)|(41)|(31)|(32)|(0)|(0)|(41)|(43)|(222120121110020100s s p s s p s s p s s p s s p s s p s s p s s p s s p 可得:1)()()()(43)(31)()(31)(41)()(41)(43)(210212101200s p s p s p s p s p s p s p s p s p s p s p s p得:114)(113)(114)(210s p s p s p )]|(log )|()|(log )|()[()]|(log )|()|(log )|()[()]|(log )|()|(log )|()[(222220202121211111010100000s s p s s p s s p s s p s p s s p s s p s s p s s p s p s s p s s p s s p s s p s p H 0.25(bit/符号)2.8一个马尔可夫信源,已知:0)2|2(,1)2|1(,31)1|2(,32)1|1(x x p x x p x x p x x p 试画出它的香农线图,并求出信源熵。

计算机科学技术:信息论与编码考试题库二

计算机科学技术:信息论与编码考试题库二1、问答题(江南博哥)请给出平均码长界定定理及其物理意义。

答案:2、填空题多用户信道的信道容量用()来表示。

答案:多维空间的一个区域的界限3、判断题狭义的信道编码既是指:信道的检、纠错编码。

答案:对4、判断题互信息量I(X;Y)表示收到Y后仍对信源X的不确定度。

答案:对5、判断题对于具有归并性能的无燥信道,当信源等概率分布时(p(xi)=1/n),达到信道容量。

答案:错6、问答?有两个二元随机变量X和Y,它们的联合概率为P[X=0,Y=0]=1/8,P[X=0,Y=1]=3/8,P[X=1,Y=1]=1/8,P[X=1,Y=0]=3/8。

定义另一随机变量Z=XY,试计算:(1)H(X),H(Y),H(Z),H(XZ),H(YZ),H(XYZ);(2)H(X/Y),H(Y/X),H(X/Z),H(Z/X),H(Y/Z),H(Z/Y),H (X/YZ),H(Y/XZ),H(Z/XY);(3)I(X;Y),I(X;Z),I(Y;Z),I(X;Y/Z),I(Y;Z/X),I(X;Z/Y)。

答案:7、填空题平均互信息量I(X;Y)与信源熵和条件熵之间的关系是()。

答案:(X;Y)=H(X)-H(X/Y)8、填空题根据输入输出信号的特点,可将信道分成离散信道、连续信道、()信道。

答案:半离散或半连续9、填空题单符号离散信源一般用随机变量描述,而多符号离散信源一般用()描述。

答案:随机矢量10、填空题信源编码的目的是提高通信的(),信道编码的目的是提高通信的(),加密编码的目的是保证通信的()。

答案:有效性;可靠性;安全性11、填空题某离散无记忆信源X,其符号个数为n,则当信源符号呈()分布情况下,信源熵取最大值()。

答案:等概;log(n)12、名词解释前向纠错(FEC)答案:是指差错控制过程中是单向的,无须差错信息的反馈。

13、名词解释信源编码答案:就是针对信源输出符号序列的统计特性,通过概率匹配的编码方法,将出现概率大的信源符号尽可能编为短码,从而使信源输出的符号序列变换为最短的码字序列针对信源输出符号序列的统计特性,通过概率匹配的编码方法,将出现概率大的信源符号尽可能编为短码,从而使信源输出的符号序列变换为最短的码字序列。

信息论与编码期末复习试题2套含答案(大学期末复习资料)

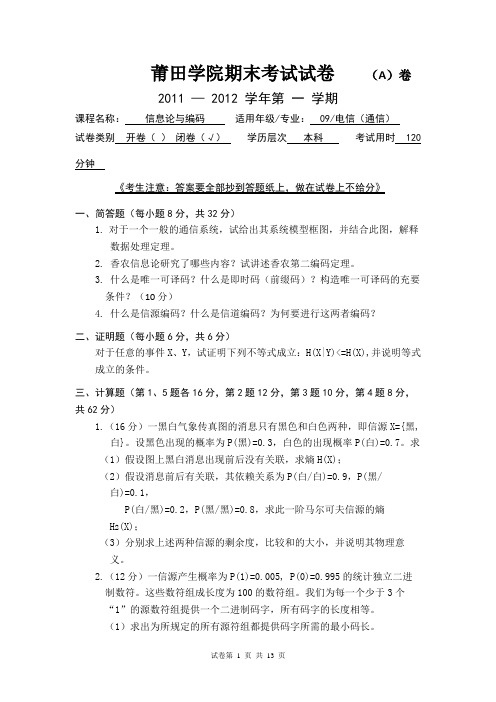

莆田学院期末考试试卷(A)卷2011 — 2012 学年第一学期课程名称:信息论与编码适用年级/专业: 09/电信(通信)试卷类别开卷()闭卷(√)学历层次本科考试用时 120分钟《.考生注意:答案要全部抄到答题纸上,做在试卷上不给分.........................》.一、简答题(每小题8分,共32分)1.对于一个一般的通信系统,试给出其系统模型框图,并结合此图,解释数据处理定理。

2. 香农信息论研究了哪些内容?试讲述香农第二编码定理。

3. 什么是唯一可译码?什么是即时码(前缀码)?构造唯一可译码的充要条件?(10分)4. 什么是信源编码?什么是信道编码?为何要进行这两者编码?二、证明题(每小题6分,共6分)对于任意的事件X、Y,试证明下列不等式成立:H(X|Y)<=H(X),并说明等式成立的条件。

三、计算题(第1、5题各16分,第2题12分,第3题10分,第4题8分,共62分)1.(16分)一黑白气象传真图的消息只有黑色和白色两种,即信源X={黑,白}。

设黑色出现的概率为P(黑)=0.3,白色的出现概率P(白)=0.7。

求(1)假设图上黑白消息出现前后没有关联,求熵H(X);(2)假设消息前后有关联,其依赖关系为P(白/白)=0.9,P(黑/白)=0.1,P(白/黑)=0.2,P(黑/黑)=0.8,求此一阶马尔可夫信源的熵H2(X);(3)分别求上述两种信源的剩余度,比较和的大小,并说明其物理意义。

2.(12分)一信源产生概率为P(1)=0.005, P(0)=0.995的统计独立二进制数符。

这些数符组成长度为100的数符组。

我们为每一个少于3个“1”的源数符组提供一个二进制码字,所有码字的长度相等。

(1)求出为所规定的所有源符组都提供码字所需的最小码长。

(2)求信源发出一数符组,而编码器无相应码字的概率。

3.(10分)已知一个(6,3)线性分组码的全部码字为001011,110011,010110,101110,100101,111000,011101,000000。

信息论与编码第二版答案 (3)

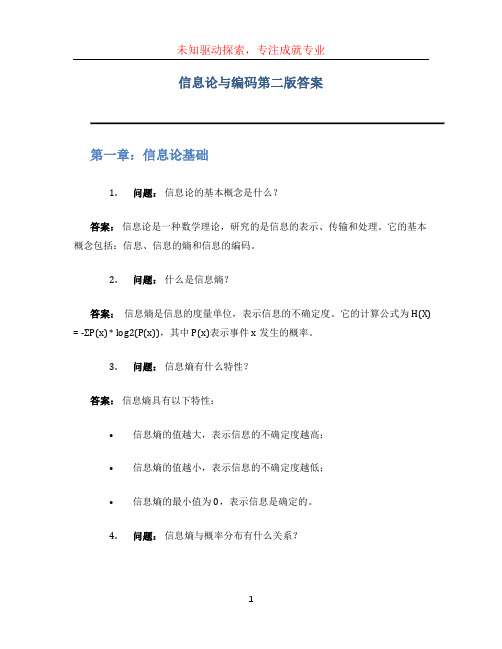

信息论与编码第二版答案第一章:信息论基础1.问题:信息论的基本概念是什么?答案:信息论是一种数学理论,研究的是信息的表示、传输和处理。

它的基本概念包括:信息、信息的熵和信息的编码。

2.问题:什么是信息熵?答案:信息熵是信息的度量单位,表示信息的不确定度。

它的计算公式为H(X) = -ΣP(x) * log2(P(x)),其中P(x)表示事件x发生的概率。

3.问题:信息熵有什么特性?答案:信息熵具有以下特性:•信息熵的值越大,表示信息的不确定度越高;•信息熵的值越小,表示信息的不确定度越低;•信息熵的最小值为0,表示信息是确定的。

4.问题:信息熵与概率分布有什么关系?答案:信息熵与概率分布之间存在着直接的关系。

当概率分布均匀时,信息熵达到最大值;而当概率分布不均匀时,信息熵会减小。

第二章:数据压缩1.问题:数据压缩的目的是什么?答案:数据压缩的目的是通过消除冗余和重复信息,使数据占用更少的存储空间或传输更快。

2.问题:数据压缩的两种基本方法是什么?答案:数据压缩可以通过无损压缩和有损压缩两种方法来实现。

无损压缩是指压缩后的数据可以完全还原为原始数据;而有损压缩则是指压缩后的数据不完全还原为原始数据。

3.问题:信息压缩的度量单位是什么?答案:信息压缩的度量单位是比特(bit),表示信息的数量。

4.问题:哪些方法可以用于数据压缩?答案:数据压缩可以通过以下方法来实现:•无结构压缩方法:如霍夫曼编码、算术编码等;•有结构压缩方法:如词典编码、RLE编码等;•字典方法:如LZW、LZ77等。

第三章:信道容量1.问题:什么是信道容量?答案:信道容量是指在给定信噪比的条件下,信道传输的最大数据速率。

2.问题:信道容量的计算公式是什么?答案:信道容量的计算公式为C = W * log2(1 + S/N),其中C表示信道容量,W表示信道带宽,S表示信号的平均功率,N表示噪声的平均功率。

3.问题:信道容量与信噪比有什么关系?答案:信道容量与信噪比成正比,信噪比越高,信道容量越大;反之,信噪比越低,信道容量越小。

信息论与编码习题参考答案

第二章习题参考答案2-1解:同时掷两个正常的骰子,这两个事件是相互独立的,所以两骰子面朝上点数的状态共有6×6=36种,其中任一状态的分布都是等概的,出现的概率为1/36。

(1)设“3和5同时出现”为事件A ,则A 的发生有两种情况:甲3乙5,甲5乙3。

因此事件A 发生的概率为p(A)=(1/36)*2=1/18 故事件A 的自信息量为I(A)=-log 2p(A)=log 218=4.17 bit(2)设“两个1同时出现”为事件B ,则B 的发生只有一种情况:甲1乙1。

因此事件B 发生的概率为p(B)=1/36 故事件B 的自信息量为I(B)=-log 2p(B)=log 236=5.17 bit (3) 两个点数的排列如下:因为各种组合无序,所以共有21种组合: 其中11,22,33,44,55,66的概率是3616161=⨯其他15个组合的概率是18161612=⨯⨯ symbol bit x p x p X H ii i / 337.4181log 18115361log 3616)(log )()(=⎪⎭⎫ ⎝⎛⨯+⨯-=-=∑(4) 参考上面的两个点数的排列,可以得出两个点数求和的概率分布:sym bolbit x p x p X H X P X ii i / 274.3 61log 61365log 365291log 912121log 1212181log 1812361log 3612 )(log )()(36112181111211091936586173656915121418133612)(=⎪⎭⎫ ⎝⎛+⨯+⨯+⨯+⨯+⨯-=-=⎪⎭⎪⎬⎫⎪⎩⎪⎨⎧=⎥⎦⎤⎢⎣⎡∑(5)“两个点数中至少有一个是1”的组合数共有11种。

bitx p x I x p i i i 710.13611log )(log )(3611116161)(=-=-==⨯⨯=2-2解:(1)红色球x 1和白色球x 2的概率分布为⎥⎥⎦⎤⎢⎢⎣⎡=⎥⎦⎤⎢⎣⎡2121)(21x x x p X i 比特 12log *21*2)(log )()(2212==-=∑=i i i x p x p X H(2)红色球x 1和白色球x 2的概率分布为⎥⎥⎦⎤⎢⎢⎣⎡=⎥⎦⎤⎢⎣⎡100110099)(21x x x p X i 比特 08.0100log *100199100log *10099)(log )()(22212=+=-=∑=i i i x p x p X H (3)四种球的概率分布为⎥⎥⎦⎤⎢⎢⎣⎡=⎥⎦⎤⎢⎣⎡41414141)(4321x x x x x p X i ,42211()()log ()4**log 4 2 4i i i H X p x p x ==-==∑比特2-5解:骰子一共有六面,某一骰子扔得某一点数面朝上的概率是相等的,均为1/6。

信息论及编码理论练习习题答案.docx

第二章信息量和熵八元编码系统,码长为3,第一个符号用于同步,每秒 1000 个码字,求它的信息速率。

解:同步信息均相同,不含信息,因此每个码字的信息量为2log 8 =2 3=6 bit因此,信息速率为 6 1000=6000 bit/s掷一对无偏骰子,告诉你得到的总的点数为: (a) 7; (b) 12。

问各得到多少信息量。

解: (1)可能的组合为 {1 ,6},{2 , 5},{3 ,4},{4, 3},{5,2},{6 ,1} p(a) = 6 = 13661=log 6 = bit得到的信息量 = logp(a)(2)可能的唯一,为 {6 ,6}p(b) =1361=log 36 = bit得到的信息量 = logp(b)经过充分洗牌后的一副扑克(52 张),问:(a)任何一种特定的排列所给出的信息量是多少?(b)若从中抽取 13 张牌,所给出的点数都不相同时得到多少信息量?解: (a) p(a) =152!1=log 52! = bit信息量 = logp(a)13!13种点数任意排列(b)413花色任选p(b) =13!41341313=13 A52C52信息量 = log C5213log 413= bit随机 3 骰子, X 表示第一骰子的果,Y 表示第一和第二骰子的点数之和, Z 表示 3 骰子的点数之和,求H ( Z | Y)、H ( X | Y )、H (Z | X ,Y)、H ( X , Z | Y) 、H (Z | X)。

解:令第一第二第三骰子的果分x1 , x2 , x3, x1, x2, x3相互独立,X x1, Y x1x2, Z x1x2x3H ( Z | Y) =H(x3 ) = log6= bitH ( Z | X )= H ( x2x3) = H (Y)=2(1log 36+2log 18+3log 12+4log 9+5log36)+6log 63636363636536 = bitH ( X | Y) = H ( X ) - I ( X ;Y ) = H ( X ) -[ H (Y) - H (Y | X ) ]而H (Y | X ) = H ( X ) ,所以 H ( X |Y ) = 2 H ( X ) - H (Y) = bit或H ( X | Y) = H ( XY ) - H (Y ) = H ( X ) + H (Y | X ) - H (Y)而 H (Y | X ) = H ( X ),所以H ( X | Y )=2H (X )-H (Y)= bitH (Z | X ,Y) = H (Z |Y ) = H ( X ) = bitH ( X , Z |Y) = H ( X |Y ) + H (Z | XY ) =+= bit一个系送10 个数字, 0,1,⋯,9。

信息论与编码试题集与答案(新)

1. 在无失真的信源中,信源输出由 H (X ) 来度量;在有失真的信源中,信源输出由 R (D ) 来度量。

2. 要使通信系统做到传输信息有效、可靠和保密,必须首先 信源 编码, 然后_____加密____编码,再______信道_____编码,最后送入信道。

3. 带限AWGN 波形信道在平均功率受限条件下信道容量的基本公式,也就是有名的香农公式是log(1)C W SNR =+;当归一化信道容量C/W 趋近于零时,也即信道完全丧失了通信能力,此时E b /N 0为 -1.6 dB ,我们将它称作香农限,是一切编码方式所能达到的理论极限。

4. 保密系统的密钥量越小,密钥熵H (K )就越 小 ,其密文中含有的关于明文的信息量I (M ;C )就越 大 。

5. 已知n =7的循环码42()1g x x x x =+++,则信息位长度k 为 3 ,校验多项式 h(x)= 31x x ++ 。

6. 设输入符号表为X ={0,1},输出符号表为Y ={0,1}。

输入信号的概率分布为p =(1/2,1/2),失真函数为d (0,0) = d (1,1) = 0,d (0,1) =2,d (1,0) = 1,则D min = 0 ,R (D min )= 1bit/symbol ,相应的编码器转移概率矩阵[p(y/x )]=1001⎡⎤⎢⎥⎣⎦;D max = 0.5 ,R (D max )= 0 ,相应的编码器转移概率矩阵[p(y/x )]=1010⎡⎤⎢⎥⎣⎦。

7. 已知用户A 的RSA 公开密钥(e,n )=(3,55),5,11p q ==,则()φn = 40 ,他的秘密密钥(d,n )=(27,55) 。

若用户B 向用户A 发送m =2的加密消息,则该加密后的消息为 8 。

二、判断题1. 可以用克劳夫特不等式作为唯一可译码存在的判据。

(√ )2. 线性码一定包含全零码。

(√ )3. 算术编码是一种无失真的分组信源编码,其基本思想是将一定精度数值作为序列的 编码,是以另外一种形式实现的最佳统计匹配编码。

信息论与编码第二章习题及答案(清华大学出版社)

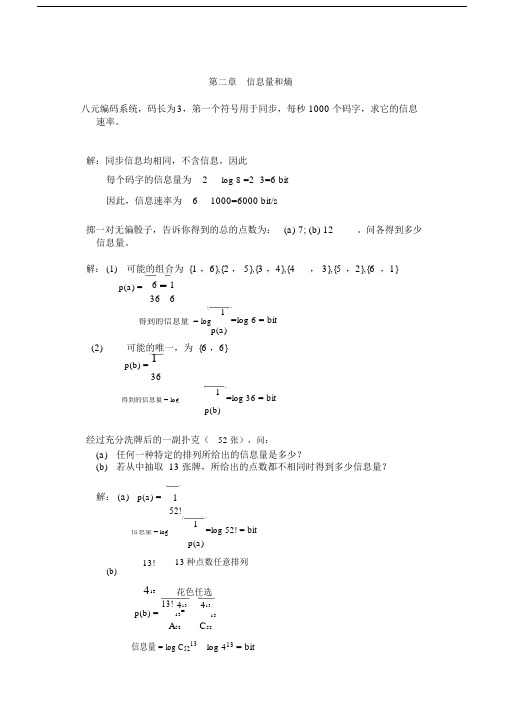

2-1、一阶马尔可夫链信源有3个符号{}123,,u u u ,转移概率为:1112()u p u=,2112()u p u =,31()0u p u =,1213()u p u = ,22()0u p u =,3223()u p u =,1313()u p u =,2323()u p u =,33()0u p u =。

画出状态图并求出各符号稳态概率。

解:由题可得状态概率矩阵为:1/21/20[(|)]1/302/31/32/30j i p s s ⎡⎤⎢⎥=⎢⎥⎢⎥⎣⎦状态转换图为:12S112 13 13S2 23 S3 令各状态的稳态分布概率为1W ,2W ,3W ,则: 1W =121W +132W +133W , 2W=121W +233W , 3W =232W 且:1W +2W +3W =1∴稳态分布概率为:1W =25,2W =925,3W = 6252-2.由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:P(0|00)=0.8,P(0|11)=0.2,P(1|00)=0.2,P(1|11)=0.8,P(0|01)=0.5,p(0|10)=0.5,p(1|01)=0.5,p(1|10)=0.5画出状态图,并计算各符号稳态概率。

解:状态转移概率矩阵为:0.8 0.2 0 00 0 0.5 0.5()0.5 0.5 0 00 0 0.2 0.8j i p s s ⎡⎤⎢⎥⎢⎥=⎢⎥⎢⎥⎣⎦令各状态的稳态分布概率为1w 、2w 、3w 、4w ,利用(2-1-17)可得方程组。

1111221331441132112222332442133113223333443244114224334444240.80.50.20.50.50.20.50.8w w p w p w p w p w w w w p w p w p w p w w w w p w p w p w p w w w w p w p w p w p w w =+++=+⎧⎪=+++=+⎪⎨=+++=+⎪⎪=+++=+⎩ 且12341w w w w +++=;解方程组得:12345141717514w w w w ⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩ 即:5(00)141(01)71(10)75(11)14p p p p ⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩2-3、同时掷两个正常的骰子,也就是各面呈现的概率都是16,求:(1)、“3和5同时出现”事件的自信息量;(2)、“两个1同时出现”事件的自信息量; (3)、两个点数的各种组合的熵或平均信息量; (4)、两个点数之和的熵; (5)、两个点数中至少有一个是1的自信息量。

信息论与编码试卷及答案2.doc

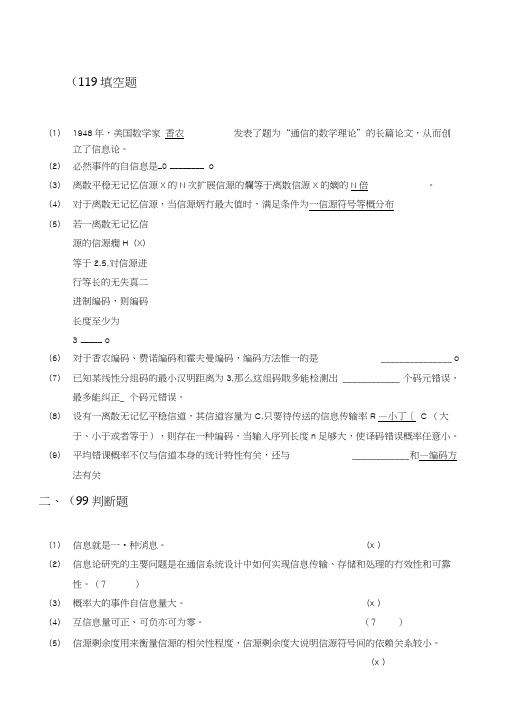

(119填空题(1)1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

(2)必然事件的自信息是_0 ________ o(3)离散平稳无记忆信源X的N次扩展信源的爛等于离散信源X的嫡的N倍。

(4)对于离散无记忆信源,当信源炳冇最大值时,满足条件为一信源符号等概分布(5)若一离散无记忆信源的信源癇H(X)等于2.5,对信源进行等长的无失真二进制编码,则编码长度至少为3 _____ o(6)対于香农编码、费诺编码和霍夫曼编码,编码方法惟一的是_______________ o (7)已知某线性分组码的最小汉明距离为3,那么这组码戢多能检测出 ____________ 个码元错误,最多能纠正_ 个码元错误。

(8)设有一离散无记忆平稳信道,其信道容量为C,只要待传送的信息传输率R —小丁〔 C (大于、小于或者等于),则存在一种编码,当输入序列长度n足够大,使译码错误概率任意小。

(9)平均错课概率不仅与信道本身的统计特性有关,还与____________ 和—编码方法有关二、(99判断题(1)信息就是一•种消息。

(x )(2)信息论研究的主要问题是在通信系统设计中如何实现信息传输、存储和处理的冇效性和可靠性。

(7 )(3)概率大的事件自信息量大。

(x )(4)互信息量可正、可负亦可为零。

(7 )(5)信源剩余度用来衡量信源的相关性程度,信源剩余度大说明信源符号间的依赖关系较小。

(x )(6)对于固定的信源分布,平均互信息量是信道传递概率的下凸函数。

(V )(7)非奇界码一定是唯一可译码,唯一可译码不一定是非奇界码。

(x )(8)信源变长编码的核心问题是寻找紧致码(或最住码),崔夫曼编码方法构造的是最佳码。

(7 )(9)信息率失真函数R(D)是关于平均失真度D的上凸函数. (x )三、(5‘)居住在某地区的女孩中有25%是大学生,在女人学生中有75%是身高1.6米以上的, 而女孩屮身高1.6米以上的占总数的一半。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

一、概念简答题(每题5分,共40分)

1.什么是平均自信息量与平均互信息,比较一下这两个概念的异同

2.简述最大离散熵定理。

对于一个有m个符号的离散信源,其最大熵是多少

3.解释信息传输率、信道容量、最佳输入分布的概念,说明平均互信息与信源的概率分布、信道的传递概率间分别是什么关系

4.对于一个一般的通信系统,试给出其系统模型框图,并结合此图,解释数据处理定理。

5.写出香农公式,并说明其物理意义。

当信道带宽为5000Hz,信噪比为30dB时求信道容量。

6.解释无失真变长信源编码定理。

7.解释有噪信道编码定理。

8.什么是保真度准则对二元信源,其失真矩阵,求a>0时率失真

函数的和

二、综合题(每题10分,共60分)

1.黑白气象传真图的消息只有黑色和白色两种,求:

1)黑色出现的概率为,白色出现的概率为。

给出这个只有两个符号的信源X的数学模型。

假设图上黑白消息出现前后没有关联,求熵;

2)假设黑白消息出现前后有关联,其依赖关系为:,,

,,求其熵;

2.二元对称信道如图。

1)若,,求和;

2)求该信道的信道容量和最佳输入分布。

3.信源空间为

试分别构造二元和三元霍夫曼码,计算其平均码长和编码效率。

4.设有一离散信道,其信道传递矩阵为,并设,试分别按最小错误概率准则与最大似然译码准则确定译码规则,并计算相应的平均错误概率。

5.已知一(8,5)线性分组码的生成矩阵为。

求:1)输入为全00011和10100时该码的码字;2)最小码距。

6.设某一信号的信息传输率为s,在带宽为4kHz的高斯信道中传输,噪声功率谱NO=5×10-6mw/Hz。

试求:

(1)无差错传输需要的最小输入功率是多少?

(2)此时输入信号的最大连续熵是多少写出对应的输入概率密度函数的形式。

模拟试题二答案

一、概念简答题(每题5分,共40分)

1.答:平均自信息为

表示信源的平均不确定度,也表示平均每个信源消息所提供的信息量。

平均互信息

表示从Y获得的关于每个X的平均信息量,也表示发X前后Y的平均不确定性减少的量,还表示通信前后整个系统不确定性减少的量。

2.答:最大离散熵定理为:离散无记忆信源,等概率分布时熵最大。

最大熵值为。

3.答:信息传输率R指信道中平均每个符号所能传送的信息量。

信道容量是一个信道所能达到的最大信息传输率。

信息传输率达到信道容量时所对应的输入概率分布称为最佳输入概率分布。

平均互信息是信源概率分布的∩型凸函数,是信道传递概率的U型凸函数。

4.答:通信系统模型如下:

数据处理定理为:串联信道的输入输出X、Y、Z组成一个马尔可夫链,且有,。

说明经数据处理后,一般只会增加信息的损失。

5.答:香农公式为,它是高斯加性白噪声信道在单位时间内的信道容量,其值取决于信噪比和带宽。

由得,则

6.答:只要,当N足够长时,一定存在一种无失真编码。

7.答:当R<C时,只要码长足够长,一定能找到一种编码方法和译码规则,使译码错误概率无穷小。

8.答:1)保真度准则为:平均失真度不大于允许的失真度。

2)因为失真矩阵中每行都有一个0,所以有,而。

二、综合题(每题10分,共60分)

1.答:1)信源模型为

2)由得

则

2.答:1)

2),最佳输入概率分布为等概率分布。

3.答:1)二元码的码字依序为:10,11,010,011,1010,1011,1000,1001。

平均码长,编码效率

2)三元码的码字依序为:1,00,02,20,21,22,010,011。

平均码长,编码效率

4.答:1)最小似然译码准则下,有,

2)最大错误概率准则下,有,

5.答:1)输入为00011时,码字为00011110;输入为10100时,码字为。

2)

6.答:1)无错传输时,有

即

则

2)在时,最大熵对应的输入概率密度函数为。