_主成分分析

主成分分析

但是这种线性组合,如果丌加限制,则可以有很多,应 该如何去选取呢?

对a加以限制

对组合系数ai' = (a1i,a2i,…,api)作如下要求:

a a ... a

2 1i 2 2i

2 pi

1,

i 1, 2 ,..., p

即:ai为单位向量。 此外,

对F限制

1) Fi不Fj(i≠j, i, j = 1, …, p)互丌相关,即 协方差:Cov(Fi,Fj) = 0

2) F1是X1,X2,…,Xp的一切线性组合(系数满足上述要 求)中方差最大的,即

Var ( F1 ) max Var ( c i X i )

c ' c 1 i 1 p

其中c = (c1,c2,…,cp)' 3)F2是不F1丌相关的X1,X2,…,Xp一切线性组合中方差最 大的,…,Fp是不F1,F2,…,Fp-1都丌相关的X1,X2,… ,Xp的一切线性组合中方差最大的。 满足上述要求的综合指标向量F1,F2,…,Fp就是主成分。

i 1 k 1

达到足够大(一般在85%以上)为原则。

3.5 计算主成分得分

计算n个样品在m个主成分上的得分:

Fi a1i X 1 a 2 i X 2 ... a pi X p

i = 1,2,…,m

主成分分析程序代码

例 输出原始数据矩阵x x=[7.47,1.73,7.20,0.13,0.40,1.33,1.07,36.05;6.67,1.67,18.00,0.67,4.67,19. 00,5.50,26.00;3.32,2.48,36.43,2.17,7.15,22.99,11.95,60.95;3.00,2.29,19.0 2,1.62,6.90,3.57,18.50,49.14;1.67,3.08,48.98,3.69,29.66,31.50,65.53,272. 23;1.96,3.23,14.44,1.64,18.02,33.12,33.10,68.73;1.25,3.69,42.00,4.25,22. 22,19.94,53.50,70.00;1.47,9.87,49.15,3.48,4.11,22.37,19.92,67.10;2.02,0. 97,16.99,12.29,18.00,17.36,3.66,16.59;2.41,1.56,2.81,15.79,3.42,21.61,2. 44,24.26;1.00,2.15,40.16,14.27,5.74,53.90,9.24,27.90;1.70,0.77,3.13,5.00, 6.32,11.48,10.23,30.77;0.97,0.12,2.39,21.16,8.08,16.21,41.26,18.84;2.86, 3.29,29.70,1.91,17.04,41.90,12.05,31.90;1.41,5.58,44.18,6.51,10.88,31.98 ,12.92,31.69;1.02,0.86,13.08,1.59,11.15,21.91,26.67,22.28;0.84,0.24,2.16, 21.14,3.56,24.94,18.73,25.61;1.00,0.23,6.11,13.95,4.59,17.19,26.95,18.01 ;0.74,1.39,14.21,20.55,4.29,15.54,54.11,38.96;0.49,0.83,9.03,13.69,1.39,2 4.35,59.15,49.86;1.20,0.23,2.01,20.99,1.06,25.23,23.84,52.05;1.38,0.31,0. 71,5.27,0.98,3.97,68.88,33.79;1.79,0.63,8.00,4.67,4.58,6.92,65.92,61.50;1. 53,2.84,17.27,3.06,18.51,11.59,19.65,49.50;0.78,2.33,33.11,2.78,18.17,7. 28,75.46,51.56;3.83,1.00,53.83,3.53,3.50,0.17,52.67,111.67;2.50,2.67,49. 88,3.14,3.83,8.33,48.33,43.33;1.48,4.32,27.61,1.68,47.29,1.81,69.42,443. 10]

主成分分析

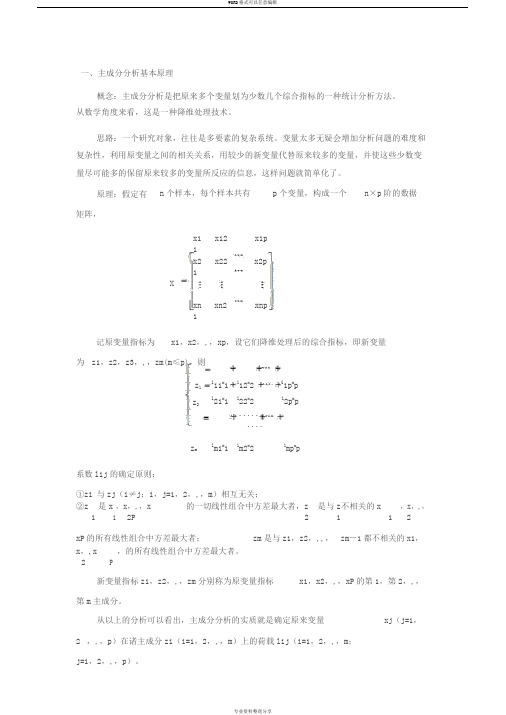

一、主成分分析基本原理概念:主成分分析是把原来多个变量划为少数几个综合指标的一种统计分析方法。

从数学角度来看,这是一种降维处理技术。

思路:一个研究对象,往往是多要素的复杂系统。

变量太多无疑会增加分析问题的难度和复杂性,利用原变量之间的相关关系,用较少的新变量代替原来较多的变量,并使这些少数变量尽可能多的保留原来较多的变量所反应的信息,这样问题就简单化了。

原理:假定有 n 个样本,每个样本共有p 个变量,构成一个n ×p 阶的数据矩阵,x11x12 x1px21 x22 x2p Xxn 1xn2xnp记原变量指标为x1,x2,,,xp ,设它们降维处理后的综合指标,即新变量为 z1,z2,z3,,,zm(m ≤p),则z 1l11x 1 l 12x 2l1p xpz 2 l 21x1 l22x2l2p xp ............ z mlm1x 1 l m2x 2lmp xp系数lij 的确定原则:①zi 与zj (i ≠j ;i ,j=1,2,,,m )相互无关;②z 是x 1 ,x ,,,x 的一切线性组合中方差最大者,z 是与z 不相关的x ,x ,,,1 2P2 1 1 2 xP 的所有线性组合中方差最大者;zm 是与z1,z2,,,, zm -1都不相关的x1,x ,,x P ,的所有线性组合中方差最大者。

2新变量指标z1,z2,,,zm 分别称为原变量指标x1,x2,,,xP 的第1,第2,,,第m 主成分。

从以上的分析可以看出,主成分分析的实质就是确定原来变量xj (j=1,2 ,,,p )在诸主成分zi (i=1,2,,,m )上的荷载lij (i=1,2,,,m ;j=1,2,,,p )。

从数学上可以证明,它们分别是相关矩阵m个较大的特征值所对应的特征向量。

二、主成分分析的计算步骤1、计算相关系数矩阵r11 r12 r1 pr21 r22 r2 pRrp1 rp2 rpprij(i,j=1,2,,,p)为原变量xi与xj的相关系数,rij=rji,其计算公式为n(x ki x i)(x kj x j)r ijk1n n(x ki2(x kj x j)2 x i)k1k12、计算特征值与特征向量解特征方程I R0,常用雅可比法(Jacobi)求出特征值,并使其按大小顺序排列1 2 p0;p 分别求出对应于特征值i的特征向量e i(i1,2,L,p),要求ei=1,即e ij21j1其中e ij表示向量e i的第j 个分量。

主成分分析法

主成分分析法什么事主成分分析法:主成分分析(principal components analysis , PCA 又称:主分量分析,主成分回归分析法主成分分析也称主分量分析,旨在利用降维的思想,把多指标转化为少数几个综合指标。

在统计学中,主成分分析(principal components analysis,PCA)是一种简化数据集的技术。

它是一个线性变换。

这个变换把数据变换到一个新的坐标系统中,使得任何数据投影的第一大方差在第一个坐标(称为第一主成分)上,第二大方差在第二个坐标(第二主成分)上,依次类推。

主成分分析经常用减少数据集的维数,同时保持数据集的对方差贡献最大的特征。

这是通过保留低阶主成分,忽略高阶主成分做到的。

这样低阶成分往往能够保留住数据的最重要方面。

但是,这也不是一定的,要视具体应用而定。

主成分分析的基本思想:在实证问题研究中,为了全面、系统地分析问题,我们必须考虑众多影响因素。

这些涉及的因素一般称为指标,在多元统计分析中也称为变量。

因为每个变量都在不同程度上反映了所研究问题的某些信息,并且指标之间彼此有一定的相关性,因而所得的统计数据反映的信息在一定程度上有重叠。

在用统计方法研究多变量问题时,变量太多会增加计算量和增加分析问题的复杂性,人们希望在进行定量分析的过程中,涉及的变量较少,得到的信息量较多。

主成分分析正是适应这一要求产生的,是解决这类题的理想工具同样,在科普效果评估的过程中也存在着这样的问题。

科普效果是很难具体量化的。

在实际评估工作中,我们常常会选用几个有代表性的综合指标,采用打分的方法来进行评估,故综合指标的选取是个重点和难点。

如上所述,主成分分析法正是解决这一问题的理想工具。

因为评估所涉及的众多变量之间既然有一定的相关性,就必然存在着起支配作用的因素。

根据这一点,通过对原始变量相关矩阵内部结构的关系研究,找出影响科普效果某一要素的几个综合指标,使综合指标为原来变量的线性拟合。

什么是主成分分析

主成分分析(principal component analysis, PCA)如果一组数据含有N个观测样本,每个样本需要检测的变量指标有K个, 如何综合比较各个观测样本的性质优劣或特点?这种情况下,任何选择其中单个变量指标对本进行分析的方法都会失之偏颇,无法反映样本综合特征和特点。

这就需要多变量数据统计分析。

多变量数据统计分析中一个重要方法是主成份分析。

主成分分析就是将上述含有N个观测样本、K个变量指标的数据矩阵转看成一个含有K维空间的数学模型,N个观测样本分布在这个模型中。

从数据分析的本质目的看,数据分析目标总是了解样本之间的差异性或者相似性,为最终的决策提供参考。

因此,对一个矩阵数据来说,在K维空间中,总存在某一个维度的方向,能够最大程度地描述样品的差异性或相似性(图1)。

基于偏最小二乘法原理,可以计算得到这个轴线。

在此基础上,在垂直于第一条轴线的位置找出第二个最重要的轴线方向,独立描述样品第二显著的差异性或相似性;依此类推到n个轴线。

如果有三条轴线,就是三维立体坐标轴。

形象地说,上述每个轴线方向代表的数据含义,就是一个主成份。

X、Y、Z轴就是第1、2、3主成份。

由于人类很难想像超过三维的空间,因此,为了便于直观观测,通常取2个或者3个主成份对应图进行观察。

图(1)PCA得到的是一个在最小二乘意义上拟合数据集的数学模型。

即,主成分上所有观测值的坐标投影方差最大。

从理论上看,主成分分析是一种通过正交变换,将一组包含可能互相相关变量的观测值组成的数据,转换为一组数值上线性不相关变量的数据处理过程。

这些转换后的变量,称为主成分(principal component, PC)。

主成分的数目因此低于或等于原有数据集中观测值的变量数目。

PCA最早的发明人为Karl Pearson,他于1901年发表的论文中以主轴定理(principal axis theorem)衍生结论的形式提出了PCA的雏形,但其独立发展与命名是由Harold Hotelling于1930年前后完成。

主成分分析 因子分析

主成分分析 因子分析主成分分析和因子分析是很重要的统计分析方法。

两者都是用于对一组同质或异质的变量进行数据探索研究的技术,它们都可以提供有价值的结论,增强数据有意义的理解。

1. 主成分分析主成分分析(Principal Component Analysis,简称PCA)是从一大组变量中提取具有代表性的正交变量,组成一个新的变量集合。

PCA通过减少变量数量,减少多变量间相关性带来的重复性,从而提升数据分析的准确性和有效性。

注意减少变量数量不是减少观测样本数量,而是把原先高维度的变量合并成一组较低维度的变量。

PCA算法的基本思想是:它分析原始数据集中的变异,并从中提取主要的变量,然后将这些变量的组合(叫做主成分)用推断法来重新构建原来的数据集,最后能够说明原始变量的结构,对被研究的变量结构有系统的解释。

2. 因子分析因子分析(Factor Analysis,简称FA)是一种用来探索相关变量之间潜在关系的统计分析方法。

这一方法注重的是把一系列的变量映射到一个尽可能少的多个隐变量的过程。

其中,这些隐变量就是“因子”,它们是原来变量的代表性变量,且变量之间有因果或相关的结构关系。

FA的基本思想是,将一组变量之间的复杂的相关关系映射到一组基本关系,即因子上。

然后,当每个变量映射到一个或几个因子上后,只需要解释因子就能够完全解释自变量变化的原因。

常用的因子模型有因子旋转、因子分层、因子波动等。

相比较,主成分分析和因子分析都有各自的专业领域,它们都有不同的数据需求和分析方法,在不同的数据处理中也表现出各自的优势和劣势。

主成分分析处理比较复杂的数据,可以根据原始变量的关系构建视图,但不涉及因果关系的推断;而因子分析可以推导出被研究的变量之间的关系,进而探索或验证其原因。

主成分分析

2.主成分的总方差 由于

tr ( A ) = tr ( T′ΣT ) = tr ( ΣTT′ ) = tr ( Σ )

故

∑ λ = ∑σ

i =1 i i =1

p

p

ii

或

∑V ( y ) = ∑V ( x )

i =1 i i =1 i

p

p

总方差中属于第 i 主成分 yi(或被 yi 所解释)的比例 为

ˆ 三、从R 出发求主成分

ˆ ˆ* ˆ* ˆ R 的 p 个特征值为λ1* ≥ λ2 ≥ L ≥ λ p, 设样本相关阵 ˆ* ˆ 2 ˆ t1 , t * ,L , t *p 为相应的正交单位特征向量,则第 i 样本

主成分

ˆ ˆi yi* = t*x* , i = 1, 2,L , p

其中 x* 是各分量经(样本)标准化了的向量,即

S

主成分得分 在实际应用中,我们常常让 x j 减去 x ,使样本数据 中心化。这不影响样本协差阵 S ,在前面的论述中 惟一需要变化的是,将第 i 主成分改写成中心化的 形式,即

ˆ ˆi yi = t′ ( x − x ) , i = 1, 2,L , p 若将各观测值 x j 代替上式中的观测值向量 x ,则第i

现比较本例中从R 出发和例7.2.2中从 Σ 出发的主成 分计算结果。从R 出发的 y1* 的贡献率0.705明显小于 从 Σ 出发的 y1的贡献率0.938,事实上,原始变量方 差之间的差异越大,这一点也就倾向于越明显, * * * (7.2.15)式有助于我们理解之。 y1 , y2 , y3 可用标准 化前的原变量表达如下: x3 − µ3 x1 − µ1 x2 − µ2 *

主成分的值

ˆi ˆ y ji = t′ ( x j − x ) , i = 1, 2,L , p

主成分分析

语言表达就是要求Cov(F1,F2)=0,称F2为第二主成分, 依此类推可以造出第三,四,…,第p个主成分。不难 想像这些主成分之间不仅不相关,而且它们的方差依次 递减。因此在实际工作中,就挑选前几个最大主成分, 虽然这样做会损失一部分信息,但是由于它使我们抓住 了主要矛盾,并从原始数据中进一步提取了某些新的信 息,因而在某些实际问题的研究中得益比损失大,这种 既减少了变量的数目又抓住了主要矛盾的做法有利于问 题的分析和处理。

第p个特征值所对应特征向量处达到。

这里要说明两点:一个是数学模型中为什么作线性组合? 基于两种原因:①数学上容易处理;②在实践中效果很好。 另一个要说明的是每次主成分的选取使Var(Fi)最大,如果 不加限制就可使Var(Fi) 则就无意义了,而常用的 限制是要求 (2 )主成分的几何意义 从代数学观点看主成分就是p个变量X1…,Xp的 一些特殊的线性组合,而在几何上这些线性组合正是把 X1,…,Xp构成的坐标系旋转产生的新坐标系,新坐标 轴使之通过样品变差最大的方向(或说具有最大的样品 方差 )。下面以最简单的二元正态变量来说明主成分的 9 2015/12/16 几何意义。

我们看到F1,F2是原变量 X1 和 X2 的线性组合,用矩阵表 示是

显然

且是正交矩阵,即

从上图还容易看出二维平面上的n个点的波动(可用方 差表示)大部分可以归结为在 F1 轴上的波动,而在F2轴上 的波动是较小的。如果上图的椭园是相当扁平的,那么我 们可以只考虑F1方向上的波动,忽略F2方向的波动。这样 一来,二维可以降为一维了,只取第一个综合变量 F1即可。 2015/12/16 11 而F1是椭园的长轴。

2、主成分分析的数学模型及几何解释

(1 )、 数学模型

设有 n 个样品,每个样品观测p项指标(变量), X1, X2, …,Xp,得到原始数据资料阵: 2015/12/16 5

主成分分析

解得:1 378 .9,2 132

3.求特征值所对应的单位特征向量

S 130233..14 187.5

1所对应的单位特征向量 (S 1)

0

,其中

a11 a21

(323.4 103.1a11

378.9)a11 103.1a21 (187.5 378.9)a21

胸围x2(cm)

69.5 77.0 78.5 87.5 74.5 74.5 76.5 81.5 74.5 79.0

体重x3(kg)

38.5 55.5 50.8 65.5 49.0 45.5 51.0 59.5 43.5 53.5

对此进行主成分分析。

1. 求样本均值和样本协方差矩阵

x1 161.2 x2 77.3 x3 51.2

0 0

a121 a221 1

解得 ( a11, a21 )= (0.88,0.47)

2 所对应的单位特征向量 (S 2) 0,其中

(323.4 103.1a12

132)a12 103.1a22 (187.5 132)a22

0 0

a122

a2 22

1

解得: (a12 , a22 ) (0.47,0.88)

平移、旋转坐标轴

x 2

F 1

主

F

成

2

•• • • •

分 分 析 的 几 何

•• • •

•• •

•

• •

•••

•

•

•

• •••

• •• •

•• •

• ••

x1

解

••

释

平移、旋转坐标轴

x 2

F 1

什么是主成分分析

什么是主成分分析

主成分分析(Principal Component Analysis,PCA)是一种常用的统计分析方法,主要用于数据降维和特征提取。

通过正交变换将一组可能存在相关性的变量转换为一组线性不相关的变量,这些线性不相关的变量称为主成分。

每个主成分都是原始变量的线性组合,且主成分按照其反映的原始变量的方差大小依次排序。

在实际应用中,主成分分析首先对数据进行标准化处理,然后计算出变量间的协方差矩阵,通过特征值分解或者奇异值分解得到特征值和特征向量。

选取前几个特征值最大的主成分,这些主成分能够解释大部分的方差,从而实现对高维数据的降维处理。

主成分分析有助于简化复杂问题的分析,揭示事物的本质,被广泛应用于多个领域,如经济学、生物学、医学、心理学等。

主成分分析方法

主成分分析方法主成分分析(Principal Component Analysis,PCA)是一种常用的多变量统计分析方法,它可以帮助我们发现数据中的主要模式和结构。

主成分分析的基本思想是通过线性变换将原始变量转换为一组新的互相无关的变量,这些新变量被称为主成分,它们能够尽可能多地保留原始数据的信息。

在实际应用中,主成分分析通常用于降维和数据可视化,以及发现变量之间的潜在关联。

主成分分析的数学原理比较复杂,但是在实际应用中,我们只需要了解其基本步骤和注意事项即可进行分析。

下面我们将介绍主成分分析的基本方法及其应用。

1. 数据标准化。

在进行主成分分析之前,我们首先需要对数据进行标准化处理,以消除变量之间的量纲差异对分析结果的影响。

通常采用的标准化方法包括Z-score标准化和min-max标准化。

Z-score标准化将原始数据转换为均值为0,标准差为1的标准正态分布,而min-max标准化将原始数据缩放到一个特定的区间内,通常是[0, 1]或[-1, 1]。

2. 计算协方差矩阵。

在数据标准化之后,我们需要计算变量之间的协方差矩阵。

协方差矩阵可以反映变量之间的线性关系,它是主成分分析的基础。

通过对协方差矩阵进行特征值分解,我们可以得到特征值和特征向量,进而求得主成分。

3. 提取主成分。

根据特征值的大小,我们可以选择保留的主成分个数。

一般来说,我们会选择特征值较大的前几个主成分,因为它们能够较好地保留原始数据的信息。

通过将原始数据投影到所选择的主成分上,我们可以得到新的主成分得分,从而实现数据的降维。

4. 解释主成分。

在主成分分析的结果中,我们通常会对每个主成分进行解释,以了解它们所代表的含义。

通过观察主成分的载荷(即主成分与原始变量之间的相关系数),我们可以发现主成分与原始变量之间的关系,从而解释主成分所反映的数据模式。

5. 应用主成分分析。

主成分分析可以应用于各种领域,如金融、生物、地理等。

在金融领域,主成分分析常用于股票投资组合的优化和风险管理;在生物领域,主成分分析常用于基因表达数据的分析和分类;在地理领域,主成分分析常用于气候数据的降维和可视化。

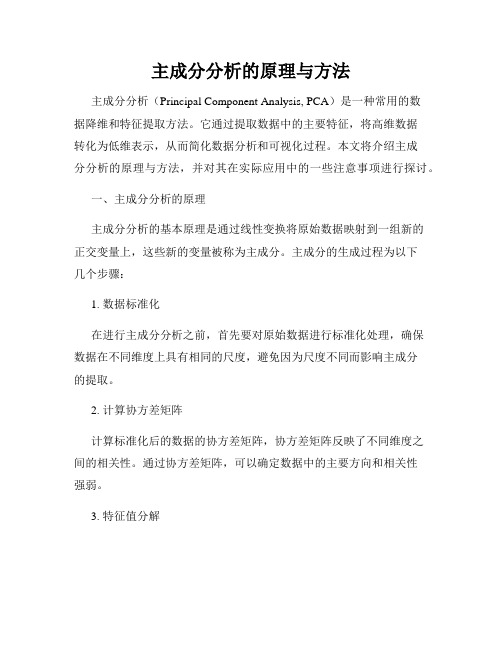

主成分分析的原理与方法

主成分分析的原理与方法主成分分析(Principal Component Analysis, PCA)是一种常用的数据降维和特征提取方法。

它通过提取数据中的主要特征,将高维数据转化为低维表示,从而简化数据分析和可视化过程。

本文将介绍主成分分析的原理与方法,并对其在实际应用中的一些注意事项进行探讨。

一、主成分分析的原理主成分分析的基本原理是通过线性变换将原始数据映射到一组新的正交变量上,这些新的变量被称为主成分。

主成分的生成过程为以下几个步骤:1. 数据标准化在进行主成分分析之前,首先要对原始数据进行标准化处理,确保数据在不同维度上具有相同的尺度,避免因为尺度不同而影响主成分的提取。

2. 计算协方差矩阵计算标准化后的数据的协方差矩阵,协方差矩阵反映了不同维度之间的相关性。

通过协方差矩阵,可以确定数据中的主要方向和相关性强弱。

3. 特征值分解对协方差矩阵进行特征值分解,得到特征值和对应的特征向量。

特征值表示了每个主成分所解释的方差比例,而特征向量则是对应于特征值的主成分。

4. 选择主成分根据特征值的大小,选择前k个最大的特征值对应的特征向量作为主成分,其中k是用户预设的维度。

二、主成分分析的方法主成分分析一般可以通过以下几个步骤来完成:1. 数据准备首先,需要准备原始数据集,并对数据进行标准化处理,使得数据在不同维度上具有相同的尺度。

2. 计算协方差矩阵根据标准化后的数据,计算协方差矩阵,可以使用公式进行计算,也可以使用相关的库函数进行计算。

3. 特征值分解对协方差矩阵进行特征值分解,可以得到特征值和对应的特征向量。

4. 选择主成分根据特征值的大小,选择前k个最大的特征值对应的特征向量作为主成分。

5. 数据转换将原始数据通过选取的主成分进行线性变换,得到在主成分上的投影值,即将高维数据转化为低维表示。

三、注意事项与应用场景在进行主成分分析时,需要注意以下几个事项:1. 数据的线性关系主成分分析假设数据具有线性关系,如果数据之间的关系是非线性的,主成分分析可能无法提取到有效的信息。

主成分分析实例和含义讲解

主成分分析实例和含义讲解1.数据标准化:对原始数据进行标准化处理,使得每个变量的均值为0,方差为1、这一步是为了将不同量级的变量进行比较。

2.计算协方差矩阵:根据标准化后的数据,计算协方差矩阵。

协方差矩阵反映了各个变量之间的线性关系。

3.特征值分解:对协方差矩阵进行特征值分解,得到特征值和对应的特征向量。

特征值表示了各个特征向量的重要程度。

4.选择主成分:根据特征值的大小,选择前k个特征向量作为主成分,k通常是根据主成分所解释的方差比例进行确定。

5.数据投影:将原始数据投影到选取的主成分上,得到降维后的数据。

主成分分析的含义可以从两个方面来解释。

一方面,主成分分析表示了原始数据在新坐标系下的投影,可以帮助我们理解数据的结构和变化。

通过选择前几个主成分,我们可以找到最能够代表原始数据的几个因素,从而实现数据的降维。

例如,在一个包含多个变量的数据集中,如果我们选择了前两个主成分,那么我们可以通过绘制数据在这两个主成分上的投影,来理解数据的分布和变化规律。

同时,主成分的累计方差贡献率可以帮助我们评估所选择的主成分对原始数据方差的解释程度,从而确定降维的精度。

另一方面,主成分分析还可以用于数据的预处理和异常值检测。

通过计算每个变量在主成分上的权重,我们可以判断每个变量对主成分的贡献大小。

如果一些变量的权重很小,那么可以考虑将其从数据集中剔除,从而减少数据的维度和复杂度。

此外,主成分分析还可以检测数据集中的异常值。

在降维的过程中,异常值对主成分的计算结果会产生较大的影响,因此可以通过比较各个主成分的方差贡献率,来识别可能存在的异常值。

总之,主成分分析是一种常用的数据降维方法,它能够帮助我们理解数据集的结构,并鉴别对数据变化影响最大的因素。

通过选择适当的主成分,我们可以实现数据的降维和可视化,并对异常值进行检测。

在实际应用中,主成分分析常常与其他数据挖掘和机器学习方法结合使用,从而发现数据的隐藏模式和关联规则,提高数据分析的效果和准确性。

主成分分析(principalc...

主成分分析(principal components analysis,PCA)又称:主分量分析,主成分回归分析法什么是主成分分析法主成分分析也称主分量分析,旨在利用降维的思想,把多指标转化为少数几个综合指标。

在统计学中,主成分分析(principal components analysis,PCA)是一种简化数据集的技术。

它是一个线性变换。

这个变换把数据变换到一个新的坐标系统中,使得任何数据投影的第一大方差在第一个坐标(称为第一主成分)上,第二大方差在第二个坐标(第二主成分)上,依次类推。

主成分分析经常用减少数据集的维数,同时保持数据集的对方差贡献最大的特征。

这是通过保留低阶主成分,忽略高阶主成分做到的。

这样低阶成分往往能够保留住数据的最重要方面。

但是,这也不是一定的,要视具体应用而定。

[编辑] 主成分分析的基本思想在实证问题研究中,为了全面、系统地分析问题,我们必须考虑众多影响因素。

这些涉及的因素一般称为指标,在多元统计分析中也称为变量。

因为每个变量都在不同程度上反映了所研究问题的某些信息,并且指标之间彼此有一定的相关性,因而所得的统计数据反映的信息在一定程度上有重叠。

在用统计方法研究多变量问题时,变量太多会增加计算量和增加分析问题的复杂性,人们希望在进行定量分析的过程中,涉及的变量较少,得到的信息量较多。

主成分分析正是适应这一要求产生的,是解决这类题的理想工具。

同样,在科普效果评估的过程中也存在着这样的问题。

科普效果是很难具体量化的。

在实际评估工作中,我们常常会选用几个有代表性的综合指标,采用打分的方法来进行评估,故综合指标的选取是个重点和难点。

如上所述,主成分分析法正是解决这一问题的理想工具。

因为评估所涉及的众多变量之间既然有一定的相关性,就必然存在着起支配作用的因素。

根据这一点,通过对原始变量相关矩阵内部结构的关系研究,找出影响科普效果某一要素的几个综合指标,使综合指标为原来变量的线性拟合。

第8章 主成分分析

The principles of Principal Component Analysis (PCA)

X2 (Variable 2)

The original data points, plotted on the original axes of variables (X1, X2, X3) For convenience, we have assumed that the data points are in the shape of a cuboid.

-0.5 C1_H1 C1_H2 OFF-FLAV -1.0 -1.0 RESULT1 ,X-expl : 58%,28% -0.5 0 0.5

C2_H3 C1_H3

PC1 1.0

Map of Samples & Variables

Principal Component Analysis (PCA)

• 12 Jams samples were made from berries plucked in various cultivars and seasonal times. • Several parameters (sensory measurements) were measured on each sample.

1.0 PC2 Bi-plot R.SMELL C4_H3 R.FLAV C4_H2 0.5 C3_H2 SOURNESS C3_H3 SHININES JUICINES C4_H1 0 C3_H1 C2_H1 T HICKNES C2_H2 CHEW.RES BIT TERNE SWEET NES COLOUR REDNESS

Sample comparison according to all 12 variables: multivariate model (PCA)

实验报告一主成分分析

实验报告一主成分分析一、实验目的二、实验原理主成分分析的基本原理是寻找能够最大化数据方差的主轴方向,并以此来确定各个主成分的权重。

具体步骤如下:1.去除数据的均值,使数据集的中心为原点。

2.计算数据的协方差矩阵。

3.对协方差矩阵进行特征值分解,得到特征值和特征向量。

4.对特征值从大到小进行排序,选择前k个特征值对应的特征向量作为主成分。

5.将原始数据映射至选取的k个主成分构成的新坐标系中。

三、实验步骤2.对数据集进行预处理,包括去除缺失值、标准化处理等。

3.计算协方差矩阵。

4.对协方差矩阵进行特征值分解,并选择主成分。

5.将原始数据集映射至选取的主成分构成的新坐标系中。

6.可视化处理后的数据集,以便观察降维效果。

四、实验结果及分析经过主成分分析处理后,我们得到了降维后的数据集。

通过对比降维前后的数据,可以观察到数据在新坐标系中的分布情况。

如果降维后的数据集能够较好地保留原始数据的特征和结构,即数据点在新坐标系中的分布比较紧密,那么主成分分析的效果就较好。

五、实验结论通过实验,我们对主成分分析的原理和应用有了更深入的了解。

主成分分析可以有效地降低数据的维度,并保留原始数据的重要特征。

在实际应用中,主成分分析常用于多变量数据的预处理、降维和数据可视化等任务中,具有广泛的应用价值。

六、实验总结本次实验我们学习了主成分分析的基本原理和应用,并进行了实际操作。

实验结果表明主成分分析可以有效地降低数据的维度,保留了原始数据的重要特征,并成功地将数据映射到新的坐标系中。

通过本次实验的学习,我进一步掌握了主成分分析的方法和技巧,并了解了其在数据分析中的重要作用。

在实际应用中,我们可以根据需求选择适当的主成分数目,以达到最佳的降维效果和数据解释性。

主成分分析

求第一主成分,构造目标函数为:

1(T1, ) T1ΣT1 (T1T1 1)

对目标函数 1(T1, ) 求导数有:

1

T1

2ΣT1

2T1

0

即

(6.5) (6.6)

(Σ I)T1 0

(6.7)

由 6.7 式两边左乘 T1 得到

T1ΣT1

(6.8)

由于 X 的协差阵 Σ 为非负定的,其特征方程(6.7)的根均大于零,

p

变量 Y1,Y2 , ,Yp 的方差之和 k 。主成分分析的目的是 k 1

减少变量的个数,所以一般不会使用所有 p 个主成分的,

忽略一些带有较小方差的主成分将不会给总方差带来太

大的影响。这里我们称

p

k k

k

k 1

(6.23)

为第k 个主成分 Yk 的贡献率。第一主成分的贡献率最大,这表

明 Y1 T1X 综 合 原 始 变 量 X1, X 2 , , X p 的 能 力 最 强 , 而

图6.1 主成分的几何意义

如 标果 系我y1们Oy将2 ,该这坐里标y系1 是按椭逆圆时的针长方轴向方旋向转,某y2个是角椭度圆的变短成轴新方坐向。

旋转公式为

YY21

X1 cos X1 sin

X2 sin X2 cos

(6.1)

我们看到新变量 Y1 和 Y2 是原变量 X1 和 X 2 的线性组合,它的

主成分分析的基本思想

人们为了避免遗漏重要的信息而考虑尽可 能多的指标

随着考虑指标的增多增加了问题的复杂性 由于各指标均是对同一事物的反映,不可

避免地造成信息的大量重叠,这种信息的 重叠有时甚至会抹杀事物的真正特征与内 在规律。 希望在定量研究中涉及的变量较少,而得 到的信息量又较多。 主成分分析正是研究如何通过原来变量的 少数几个线性组合来解释原来变量绝大多 数信息的一种多元统计方法。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

这里我们需要进一步强调的是,从相关阵求得的主成分与协

差阵求得的主成分一般情况是不相同的。实际表明,这种差 异有时很大。我们认为,如果各指标之间的数量级相差悬殊, 特别是各指标有不同的物理量纲的话,较为合理的做法是使 用R代替∑。对于研究经济问题所涉及的变量单位大都不统 一,采用R代替∑后,可以看作是用标准化的数据做分析, 这样使得主成分有现实经济意义,不仅便于剖析实际问题, 又可以避免突出数值大的变量。

(6.4)

我们希望寻找一组新的变量 Y1 , , Ym ( m p ) ,这组新的变

量要求充分地反映原变量 X 1 ,, X p 的信息,而且相互独立。 这里我们应该注意到,对于 Y1 , , Ym 有

D(Yi ) D(Ti X) Ti D( X)Ti Ti ΣTi

结论: 对于 X 的协差阵 Σ 的特征根 1 2 p 0 。

Yk 的最大方差值为第 k 大特征根 k ,其相应的单, X ( X1 ,, X p ) 的协差阵为 Σ , 设 其特征根为 1 2

p 0 ,相应的单位化的特征向量为 T1 , T2 ,, Tp 。那么,由此所确

sin X 1 TX cos X 2

(6.2)

1

其中, T 为旋转变换矩阵,它是正交矩阵,即有 T T 或 TT I 。

易见,n个点在新坐标系下的坐标Y1和Y2几乎不相关。称它

们为原始变量X1和X2的综合变量,n个点y1在轴上的方差达 到最大,即在此方向上包含了有关n个样品的最大量信息。 因此,欲将二维空间的点投影到某个一维方向上,则选择y1 轴方向能使信息的损失最小。我们称Y1为第一主成分,称Y2 为第二主成分。第一主成分的效果与椭圆的形状有很大的关 系,椭圆越是扁平,n个点在y1轴上的方差就相对越大,在y2 轴上的方差就相对越小,用第一主成分代替所有样品所造成 的信息损失也就越小。

图6.1 主成分的几何意义

如果我们将该坐标系按逆时针方向旋转某个角度 变成新坐

标系 y1Oy2 , 这里 y1 是椭圆的长轴方向, 2 是椭圆的短轴方向。 y 旋转公式为 Y1 X 1 cos X 2 sin (6.1) Y2 X 1 sin X 2 cos 我们看到新变量 Y1 和 Y2 是原变量 X 1 和 X 2 的线性组合,它的 矩阵表示形 式为: Y1 cos Y sin 2

明 Y1 T1X 综 合 原 始 变 量 X1 , X 2 ,, X p 的 能 力 最 强 , 而

Y2 , Y3 ,, Yp 的综合能力依次递减。若只取 m( p ) 个主成分,

则称

m k

k 1

m

k 1

p

k

(6.24)

为主成分 Y1 , , Ym 的累计贡献率,累计贡献率表明 Y1 , , Ym 综 合 X1 , X 2 ,, X p 的能力。通常取 m ,使得累计贡献率达到一 个较高的百分数(如 85%以上) 。

考虑两种极端的情形:

一种是椭圆的长轴与短轴的长度相等,即椭圆变成圆,第一主

成分只含有二维空间点的约一半信息,若仅用这一个综合变量, 则将损失约50%的信息,这显然是不可取的。造成它的原因是, 原始变量X1和X2的相关程度几乎为零,也就是说,它们所包含 的信息几乎不重迭,因此无法用一个一维的综合变量来代替。 另一种是椭圆扁平到了极限,变成y1轴上的一条线,第一主成 分包含有二维空间点的全部信息,仅用这一个综合变量代替原 始数据不会有任何的信息损失,此时的主成分分析效果是非常 理想的,其原因是,第二主成分不包含任何信息,舍弃它当然 没有信息损失。

成的对角阵为 1 0 Λ 0 p 主成分可表示为 Y TX 性质 1 主成分的协方差矩阵是对角阵。

(6.17)

(6.18)

性质 2 主成分的总方差等于原始变量的总方差。 性质 3 主成分 Yk 与原始变量 X i 的相关系数为

(Yk , X i )

因此, 在实际应用中, 主成分分析的具体步骤可以归纳为:

将原始数据标准化; 2. 建立变量的相关系数阵; * 3. 求 R 的特征根为 1* p 0 , 相应的特征向量为 1.

* T1* , T2* , , Tp ;

4. 由累积方差贡献率确定主成分的个数( m ) ,并写出

我们知道,当一个变量只取一个数据时,这个变量(数据)

提供的信息量是非常有限的,当这个变量取一系列不同数据 时,我们可以从中读出最大值、最小值、平均数等信息。变 量的变异性越大,说明它对各种场景的“遍历性”越强,提 供的信息就更加充分,信息量就越大。主成分分析中的信息, 就是指标的变异性,用标准差或方差表示它。 主成分分析的数学模型是,设p个变量构成的p维随机向量为 X = (X1,…,Xp)′。对X作正交变换,令Y = T′X,其中T 为正交阵,要求Y的各分量是不相关的,并且Y的第一个分 量的方差是最大的,第二个分量的方差次之,……,等等。 为了保持信息不丢失,Y的各分量方差和与X的各分量方差 和相等。

定的主成分为 Y1 T1 X , Y2 T2 X , , Ym Tm X ,其方差分别为 Σ 的特征根。

第三节 主成分的性质

一 主成分的一般性质

二 主成分的方差贡献率

一、主成分的一般性质

设 Y (Y , Y ,, Y ) 是 的主成分,由 的所有特征根构 Σ X 1 2 p

主成分为 Yi (Ti* ) X ,

i 1,2,, m

二、如何利用主成分分析进行综合 评价

人们在对某个单位或某个系统进行综合评价时都会遇到如何

选择评价指标体系和如何对这些指标进行综合的困难。一般 情况下,选择评价指标体系后通过对各指标加权的办法来进 行综合。但是,如何对指标加权是一项具有挑战性的工作。 指标加权的依据是指标的重要性,指标在评价中的重要性判 断难免带有一定的主观性,这影响了综合评价的客观性和准 确性。由于主成分分析能从选定的指标体系中归纳出大部分 信息,根据主成分提供的信息进行综合评价,不失为一个可 行的选择。这个方法是根据指标间的相对重要性进行客观加 权,可以避免综合评价者的主观影响,在实际应用中越来越 受到人们的重视。 对主成分进行加权综合。我们利用主成分进行综合评价时, 主要是将原有的信息进行综合,因此,要充分的利用原始变 量提供的信息。将主成分的权数根据它们的方差贡献率来确 定,因为方差贡献率反映了各个主成分的信息含量多少。

i 1,2,, m

Cov(Yi , Yk ) Cov(Ti X, Tk X) TiCov( X, X)Tk Ti ΣTk i, k 1,2,, m 这样, 我们所要解决的问题就转化为, 在新的变量 Y1 , , Ym 相

互独立的条件下,求 Ti 使得 D(Yi ) Ti ΣTi ,i 1,2,, m ,达到 最大。

第六章 主成分分析

第一节 第二节 引言 主成分的几何意义及数学 推导

第三节

第四节 第五节

主成分的性质

主成分方法应用中应注意 的问题 实例分析与计算机实现

第一节 引言

多元统计分析处理的是多变量(多指标)问题。由于变量较

多,增加了分析问题的复杂性。但在实际问题中,变量之间 可能存在一定的相关性,因此,多变量中可能存在信息的重 叠。人们自然希望通过克服相关性、重叠性,用较少的变量 来代替原来较多的变量,而这种代替可以反映原来多个变量 的大部分信息,这实际上是一种“降维”的思想。

第四节 主成分方法应用中应注 意的问题

一 实际应用中主成分分析的出发点

二 如何利用主成分分析进行综合评价

一、实际应用中主成分分析的出发点

我们前面讨论的主成分计算是从协方差矩阵 Σ 出发的,其结

果受变量单位的影响。不同的变量往往有不同的单位,对同 一变量单位的改变会产生不同的主成分,主成分倾向于多归 纳方差大的变量的信息,对于方差小的变量就可能体现得不 够,也存在“大数吃小数”的问题。为使主成分分析能够均 等地对待每一个原始变量,消除由于单位的不同可能带来的 影响,我们常常将各原始变量作标准化处理,即令 X i E( X i ) * Xi i 1,, p (6.25) D( X i ) 显然, X* ( X1* ,, X * ) 的协方差矩阵就是 X 的相关系数矩 p 阵 R 。实际应用中, X 的相关系数矩阵 R 可以通过样本数 据来估计。

主成分分析也称主分量分析,是由Hotelling于1933年首先提

出的。由于多个变量之间往往存在着一定程度的相关性。人 们自然希望通过线性组合的方式,从这些指标中尽可能快地 提取信息。当第一个线性组合不能提取更多的信息时,再考 虑用第二个线性组合继续这个快速提取的过程,……,直到 所提取的信息与原指标相差不多时为止。这就是主成分分析 的思想。一般说来,在主成分分析适用的场合,用较少的主 成分就可以得到较多的信息量。以各个主成分为分量,就得 到一个更低维的随机向量;因此,通过主成分既可以降低数 据“维数”又保留了原数据的大部分信息。

二、主成分的数学推导

设 X ( X1 ,, X p ) 为一个

p 维随机向量,并假定存在二阶

(6.3)

矩,其均值向量与协差阵分别记为: μ E (X) , Σ D(X) 考虑如下的线性变换 Y t X t X t X T X 1p p 1 1 11 1 12 2 Y t X t X t X T X 2 21 1 22 2 2p p 2 Yp t p1 X 1 t p 2 X 2 t pp X p Tp X 用矩阵表示为 Y TX 其中 Y (Y1 , Y2 ,Yp ) , T (T1 , T2 ,, Tp ) 。

p

k ii

tki

(6.22)