多重共线性的逐步回归检验分析

多重共线性的检验方法

多重共线性的检验方法

多重共线性(multicollinearity)是指在回归模型中,自变量之间存在高度相关或线性相关的情况。

由于存在多重共线性,导致模型的解释能力降低,预测结果不可靠。

因此,需要对回归模型中自变量之间的关系进行检验和分析。

下面介绍几种多重共线性的检验方法。

1. 相关系数矩阵法。

计算自变量之间的相关系数矩阵,判断是否存在较高的相关系数。

相关系数矩阵主要分为Pearson 相关系数和Spearman 相关系数,其中Pearson 相关系数适用于连续变量之间的关系,Spearman 相关系数适用于序数类或等距类别的变量之间的关系。

2. 变量膨胀因子(VIF)法。

VIF 是判断某个自变量对其他自变量的回归系数影响的程度。

如果某个自变量的VIF 值超过10,就表示需要对其进行检验和分析。

3. 特征值检验法。

通过计算相关系数矩阵的特征值和特征向量,判断模型是否存在多重共线性。

如果某个特征值较小,就表示存在多重共线性。

4. 条件数检验法。

条件数是相邻特征值之比的平方根。

如果条件数大于30,就表示模型存在多重共线性。

综上所述,多重共线性的检验方法有多种,不同的检验方法可以互相验证,得到更加准确的判断结果。

在实际应用中,可以根据具体情况选择合适的方法进行多重共线性的检验。

回归分析中的多重共线性问题及解决方法(Ⅲ)

回归分析是统计学中常用的一种分析方法,它用于研究一个或多个自变量与一个因变量之间的关系。

然而,在进行回归分析时,经常会面临一个多重共线性的问题。

多重共线性是指在回归模型中,自变量之间存在高度相关性的情况。

当自变量之间存在多重共线性时,就会导致回归系数估计不准确,增加了回归模型的不稳定性。

这对于研究者来说是一个很大的困扰,因为他们很难判断自变量之间到底是有关系还是无关系,从而无法准确地分析自变量对因变量的影响。

多重共线性问题的存在会使得回归系数的估计值变得不稳定,回归系数的符号可能会与理论上相悖,使得回归模型的解释性大大降低。

同时,多重共线性还会增加回归系数的标准误差,导致对回归系数的假设检验结果不可信。

那么,如何解决多重共线性问题呢?首先,我们可以通过计算自变量之间的相关系数来判断是否存在多重共线性。

如果自变量之间的相关系数较高,就需要考虑采取一些措施来解决多重共线性问题。

一种解决方法是通过方差膨胀因子(VIF)来检验多重共线性。

VIF是用来判断自变量之间存在多重共线性的一个指标,通常VIF大于10就表示存在多重共线性。

其次,我们可以采取一些方法来解决多重共线性问题。

一种解决方法是通过主成分分析(PCA)来降维。

主成分分析是一种常用的降维方法,它可以将原始的自变量通过线性变换转换为一组新的主成分,从而减少自变量之间的相关性。

通过主成分分析,可以将原始的自变量转换为一组新的主成分,从而减少自变量之间的相关性,解决多重共线性问题。

另一种解决多重共线性问题的方法是通过岭回归(Ridge Regression)。

岭回归是一种常用的回归分析方法,它通过对回归系数进行惩罚,可以减少自变量之间的相关性,从而解决多重共线性问题。

通过岭回归,可以对自变量的回归系数进行缩减,从而减少多重共线性对回归系数估计的影响。

此外,我们还可以通过逐步回归法(Stepwise Regression)来解决多重共线性问题。

逐步回归法是一种常用的变量选择方法,它可以通过逐步添加或删除自变量来选择最优的回归模型。

检验多重共线性的方法

检验多重共线性的方法多重共线性是指在多元回归模型中,自变量之间存在高度相关性,导致模型中的自变量之间互相冗余。

多重共线性会影响回归模型的稳定性和解释能力,降低模型的准确性和可靠性。

因此,检验多重共线性是进行多元回归分析中必不可少的一步。

本文将介绍常用的检验多重共线性的方法。

首先,我们可以通过计算自变量之间的相关系数矩阵来初步判断是否存在多重共线性。

相关系数矩阵包含了自变量之间的两两相关系数,如果相关系数高于0.7或者-0.7,就说明存在较强的线性相关性。

这种初步判断方法虽然简单,但并不可靠,因为它只是衡量了两两变量之间的线性相关关系,不能反映出多个变量的综合影响。

其次,我们可以利用方差膨胀因子(VIF)来检验多重共线性。

VIF是用来衡量自变量之间相关性的指标,计算方法是对每个自变量回归于其他自变量,得到残差平方和,并计算得到VIF值。

一般来说,VIF值大于10就表明存在较强的多重共线性。

但需要注意的是,VIF值受样本量的影响,样本量较小时,即使存在较强的相关性也不一定导致VIF值大于10。

此外,我们还可以利用特征值方法检验多重共线性。

特征值方法将相关系数矩阵进行特征值分解,得到矩阵的特征值和特征向量。

如果存在较强的多重共线性,那么相关系数矩阵的特征值将会非常小。

一般来说,特征值小于1表示存在多重共线性。

不过,特征值方法对于大样本量的数据集较为适用,对于小样本量的数据集可能会出现较大的误差。

除了上述方法,还可以通过偏回归系数的标准误差来检验多重共线性。

当自变量之间存在多重共线性时,偏回归系数的标准误差将会变得非常大,说明对自变量的估计不够精确。

通过计算偏回归系数的标准误差,我们可以判断自变量之间是否存在多重共线性。

此外,还可以通过将自变量进行逐步回归来检验多重共线性。

逐步回归是指将自变量逐个加入回归模型,根据自变量的显著性和增加的解释方差决定是否保留。

如果在逐步回归过程中,自变量的系数发生了剧烈变化或者不再显著,说明存在多重共线性。

什么是多重共线性如何进行多重共线性的检验

什么是多重共线性如何进行多重共线性的检验多重共线性是指在统计模型中,独立变量之间存在高度相关性或者线性依赖关系,从而给模型的解释和结果带来不确定性。

在回归分析中,多重共线性可能导致系数估计不准确、标准误差过大、模型的解释变得复杂等问题。

因此,对于多重共线性的检验和处理是非常重要的。

一、多重共线性的检验多重共线性的检验可以通过以下几种方式进行:1. 相关系数矩阵:可以通过计算独立变量之间的相关系数,判断它们之间的关系强度。

当相关系数超过0.8或-0.8时,可以视为存在高度相关性,即可能存在多重共线性问题。

2. 方差扩大因子(VIF):VIF是用来检验自变量之间是否存在共线性的指标。

计算每一个自变量的VIF值,当VIF值大于10或者更高时,可以视为存在多重共线性。

3. 条件数(Condition index):条件数也是一种用来检验多重共线性的指标。

它度量了回归矩阵的奇异性或者相对不稳定性。

当条件数超过30时,可以视为存在多重共线性。

4. 特征值(Eigenvalues):通过计算特征值,可以判断回归矩阵的奇异性。

如果存在特征值接近于零的情况,可能存在多重共线性。

以上是常用的多重共线性检验方法,可以根据实际情况选择合适的方法进行检验。

二、多重共线性的处理在检测到存在多重共线性问题后,可以采取以下几种方式进行处理:1. 去除相关性强的变量:在存在高度相关变量的情况下,可以选择去除其中一个或多个相关性较强的变量。

2. 聚合相关变量:将相关性强的变量进行加权平均,得到一个新的变量来替代原来的变量。

3. 主成分分析(PCA):主成分分析是一种降维技术,可以将相关性强的多个变量合并成为一个或多个无关的主成分。

4. 岭回归(Ridge Regression):岭回归是一种缓解多重共线性的方法,通过加入一个正则化项,来使得共线性变量的系数估计更加稳定。

5. Lasso回归(Lasso Regression):Lasso回归也是一种缓解多重共线性的方法,通过对系数进行稀疏化,来选择重要的变量。

回归分析中的多重共线性问题及解决方法(七)

回归分析是统计学中常用的一种方法,它用于研究自变量和因变量之间的关系。

然而,在实际应用中,经常会遇到多重共线性的问题,这给回归分析带来了一定的困难。

本文将讨论回归分析中的多重共线性问题及解决方法。

多重共线性是指独立自变量之间存在高度相关性的情况。

在回归分析中,当自变量之间存在多重共线性时,会导致回归系数估计不准确,标准误差增大,对因变量的预测能力降低,模型的解释能力受到影响。

因此,多重共线性是回归分析中需要重点关注和解决的问题之一。

解决多重共线性问题的方法有很多种,下面将介绍几种常用的方法。

一、增加样本量增加样本量是解决多重共线性问题的一种方法。

当样本量足够大时,即使自变量之间存在一定的相关性,也能够得到较为稳健的回归系数估计。

因此,可以通过增加样本量来减轻多重共线性对回归分析的影响。

二、使用主成分回归分析主成分回归分析是一种常用的处理多重共线性问题的方法。

主成分回归分析通过将原始自变量进行线性变换,得到一组新的主成分变量,这些主成分变量之间不存在相关性,从而避免了多重共线性问题。

然后,利用这些主成分变量进行回归分析,可以得到更为准确稳健的回归系数估计。

三、岭回归岭回归是一种经典的解决多重共线性问题的方法。

岭回归通过对回归系数施加惩罚项,从而减小回归系数的估计值,进而降低多重共线性对回归分析的影响。

岭回归的思想是在最小二乘估计的基础上加上一个惩罚项,通过调节惩罚项的系数来平衡拟合优度和模型的复杂度,从而得到更为稳健的回归系数估计。

四、逐步回归逐步回归是一种逐步选择自变量的方法,可以用来解决多重共线性问题。

逐步回归可以通过逐步引入或剔除自变量的方式,来得到一组最优的自变量组合,从而避免了多重共线性对回归系数估计的影响。

以上所述的方法都可以用来解决回归分析中的多重共线性问题。

在实际应用中,应该根据具体的情况选择合适的方法来处理多重共线性问题,从而得到准确可靠的回归分析结果。

总之,多重共线性是回归分析中需要重点关注的问题,通过合适的方法来处理多重共线性问题,可以得到更为准确稳健的回归系数估计,从而提高回归分析的预测能力和解释能力。

多重共线性逐步回归--案例分析

多重共线性的估计和消除一,研究对象影响中国旅游市场发展的主要因素。

二、模型设定及其估计经分析,影响国内旅游市场收入的主要因素,除了国内旅游人数和旅游支出以外,还可能与相关基础设施有关。

为此,考虑的影响因素主要有国内旅游人数2X ,城镇居民人均旅游支出3X ,农村居民人均旅游支出4X ,并以公路里程5X 和铁路里程6X 作为相关基础设施的代表。

为此设定了如下对数形式的计量经济模型:23456123456t t t t t t t Y X X X X X u ββββββ=++++++其中 :t Y ——第t 年全国旅游收入2X ——国内旅游人数 (万人)3X ——城镇居民人均旅游支出 (元)4X ——农村居民人均旅游支出 (元) 5X ——公路里程(万公里) 6X ——铁路里程(万公里)为估计模型参数,收集旅游事业发展最快的1994—2003年的统计数据,如表4.2所示:利用Eviews 软件,输入Y 、X2、X3、X4、X5、X6等数据,采用这些数据对模型进行OLS 回归,结果如表4.3:表4.3由此可见,该模型9954.02=R ,9897.02=R 可决系数很高,F 检验值173.3525,明显显著。

但是当05.0=α时776.2)610()(025.02=-=-t k n t α,不仅2X 、6X 系数的t 检验不显著,而且6X 系数的符号与预期的相反,这表明很可能存在严重的多重共线性。

计算各解释变量的相关系数,选择X2、X3、X4、X5、X6数据,点”view/correlations ”得相关系数矩阵(如表4.4):表4.4由相关系数矩阵可以看出:各解释变量相互之间的相关系数较高,证实确实存在严重多重共线性。

三、消除多重共线性采用逐步回归的办法,去检验和解决多重共线性问题。

分别作Y 对X2、X3、X4、X5、X6的一元回归,结果如表4.5所示:表4.5 变量 X2 X3 X4 X5 X6 参数估计值 0.0842 9.0523 11.6673 34.3324 2014.146 t 统计量8.6659 13.1598 5.1967 6.4675 8.7487 2R0.90370.95580.77150.83940.9054按2R 的大小排序为:X3、X6、X2、X5、X4。

多重共线性的处理

14

主成分数学模型以及几何意义

假设我们所讨论的实际问题中,有p个指标,我们把这p个指 标看作p个随机变量,记为X1,X2,…,Xp,主成分分析就 是要把这p个指标的问题,转变为讨论p个指标的线性组合的 问题,而这些新的指标F1,F2,…,Fk(k≤p),按照保留 主要信息量的原则充分反映原指标的信息,并且相互独立。

这样反复进行,直到再无新变量可以引入,旧变量无法提出 位置。最终建立回归方程

在变量引入后,如果有的变量不显著,则说明新引入的变量 与其他变量存在多重共线性。此时我们将最显著程度达不到 标准的变量剔除。在这个过程中,我们达到了消除多重共线 性的效果。

第二种方法:主成分分析法

主成分分析法是利用降维的思想,在保留原始变量尽可能多 的信息的前提下把多个指标转化为几个综合指标的方法。 通常把转化生成的综合指标称为主成分,每一个主成分都是 原始变量的线性组合,但是各个主成分之间没有相关性,这 就解决的多重共线性的问题。

如果第一主成分不足以代替原来的几个变量的信息,再考虑 选取第二个主成分F2。为了消除多重共线性,要求协方差 cov(F1,F2)=0 以此类推可以选取第三主成分,第四主成分…这些主成分之 间不仅互不相关,而且它们的方差依次递减。 一般来说,选取多少个主成分能够反映原始变量方差的85% 时的个数就足够了。

满足如下的条件:

主成分之间相互独立,即无重叠的信息。即

Cov(Fi,Fj) 0,i j,i,j 1, 2, ,p

主成分的方差依次递减,重要性依次递减,即

Var(F1) Var ( F2 ) Var ( Fp )

10

平移、旋转坐标轴

x2 F2 F1

•• • • • • • • • • • • •• • •• • 成分分析的几何解释 •• • • • •• • • • • •• • • • • • •

回归分析中的多重共线性问题及解决方法(九)

在回归分析中,多重共线性是一个常见的问题。

多重共线性指的是自变量之间存在高度相关性,这会导致回归系数估计不准确,影响模型的解释性和预测能力。

在现实问题中,多重共线性经常出现,因此了解多重共线性的影响和解决方法是非常重要的。

一、多重共线性的影响多重共线性会导致回归系数估计不准确。

在存在多重共线性的情况下,自变量的系数估计可能偏离真实值,而且会出现符号与预期相反的情况。

这会影响对模型的解释,因为我们无法准确地评估每个自变量对因变量的影响程度。

同时,多重共线性也使得模型的预测能力下降,导致对未来数据的预测不准确。

二、多重共线性的检验为了检验模型中是否存在多重共线性,可以使用多种方法。

最常用的方法是计算自变量之间的相关系数。

如果相关系数大于或者,就可以认为存在多重共线性。

此外,还可以使用方差膨胀因子(VIF)来检验多重共线性。

VIF是用来衡量自变量之间相关性的指标,如果VIF的值大于10,就可以认为存在严重的多重共线性。

三、解决多重共线性的方法解决多重共线性问题的方法有很多种,下面介绍几种常用的方法。

1. 剔除相关性较高的自变量当自变量之间存在高度相关性时,可以选择剔除其中一个或几个自变量。

通常选择剔除与因变量相关性较低的自变量,以保留对因变量影响较大的自变量。

2. 使用主成分回归主成分回归是一种常用的解决多重共线性问题的方法。

它通过线性变换将原始的自变量转换为一组不相关的主成分变量,从而减少自变量之间的相关性。

主成分回归可以有效地解决多重共线性问题,并提高模型的解释性和预测能力。

3. 岭回归和套索回归岭回归和套索回归是一种正则化方法,可以在回归模型中加入惩罚项,从而减小自变量的系数估计。

这两种方法都可以有效地解决多重共线性问题,提高模型的鲁棒性和预测能力。

四、结语多重共线性是回归分析中的一个常见问题,会影响模型的解释性和预测能力。

为了解决多重共线性问题,我们可以使用多种方法,如剔除相关性较高的自变量、使用主成分回归、岭回归和套索回归等。

spss多重线性回归逐步回归法操作和结果解释方法

spss多重线性回归逐步回归法操作和结果解释方法∙∙|∙浏览:16524∙|∙更新:2012-11-24 22:30∙1∙2∙3∙4∙5∙6∙7分步阅读一键约师傅百度师傅最快的到家服务,最优质的电脑清灰!spss经常用到的一个回归方法是stepwise,也就是逐步回归,它指的是每次只纳入或者移除一个变量进入模型,这个方法虽然好用,但是最后可能出现几个模型都比较合适,你就要比较这几个模型的优劣,这是个麻烦事,这里就给大家简单的分析分析。

方法/步骤1.打开spss以后,打开数据,这些都准备好了以后,我们开始拟合方程,在菜单栏上执行:analyze---regression---linear,打开回归拟合对话框2.在这里,我们将因变量放大dependent栏,将自变量都放到independent栏3.将method设置为stepwise,这就是逐步回归法4.点击ok按钮,开始输出拟合结果5.我们看到的第一个表格是变量进入和移除的情况,因为这个模型拟合的比较好,所以我们看变量只有进入没有移除,但大部分的时候变量是有进有出的,在移除的变量这一栏也应该有变量的6.第二个表格是模型的概况,我们看到下图中标出来的四个参数,分别是负相关系数、决定系数、校正决定系数、随机误差的估计值,这些值(除了随机误差的估计值)都是越大表明模型的效果越好,根据比较,第四个模型应该是最好的7.方差分析表,四个模型都给出了方差分析的结果,这个表格可以检验是否所有偏回归系数全为0,sig值小于0.05可以证明模型的偏回归系数至少有一个不为零8.参数的检验,这个表格给出了对偏回归系数和标准偏回归系数的检验,偏回归系数用于不同模型的比较,标准偏回归系数用于同一个模型的不同系数的检验,其值越大表明对因变量的影响越大。

END经验内容仅供参考,如果您需解决具体问题(尤其法律、医学等领域),建议您详细咨询相关领域专业人士。

作者声明:本篇经验系本人依照真实经历原创,未经许可,谢绝转载。

Stata面板数据回归分析中的多重共线性问题及解决方法

Stata面板数据回归分析中的多重共线性问题及解决方法在对面板数据进行回归分析时,往往会遇到多重共线性的问题。

多重共线性是指在回归模型中,自变量之间存在较高的线性相关性,导致回归结果不稳定、系数估计不准确甚至产生错误的统计推断。

本文将介绍Stata面板数据回归分析中的多重共线性问题,并提供一些常用的解决方法。

一、多重共线性问题的表现当在进行面板数据回归分析时,我们可以通过查看自变量之间的相关系数矩阵来初步判断是否存在多重共线性。

相关系数矩阵可以通过Stata中的“correlate”命令或者“pwcorr”命令进行计算。

在多重共线性存在的情况下,相关系数矩阵中自变量之间的相关系数往往会接近1或者-1,这表明自变量之间存在较高的线性相关性。

另外,多重共线性还会导致回归结果的方差膨胀因子(Variance Inflation Factor,VIF)较高。

VIF用于判断自变量之间的共线性情况,一般认为当VIF超过10时即存在较强的多重共线性问题。

二、多重共线性问题的影响多重共线性问题对回归结果的影响主要有以下几个方面:1. 系数估计不稳定:多重共线性导致回归系数的估计不稳定,使得模型结果难以解释和进行经济意义上的推断。

2. 系数估计偏差:多重共线性使得自变量之间的效应难以独立估计,从而导致回归系数存在偏差。

3. 系数显著性失真:多重共线性使得回归结果的显著性水平难以准确判断,可能导致对模型中自变量显著性的错误判定。

4. 预测能力下降:多重共线性会降低回归模型的预测能力,使得模型对未来的预测结果不可靠。

三、多重共线性问题的解决方法针对面板数据回归分析中的多重共线性问题,我们可以采取以下几种解决方法:1. 增加样本量:增加样本量可以有效减少多重共线性的问题,使回归结果更加稳定。

2. 删除相关变量:当自变量之间存在高度相关时,可以考虑删除其中一个或多个相关变量。

通过观察相关系数矩阵和VIF值,可以判断哪些变量之间存在较高的线性相关性。

逐步多元回归分析步骤

逐步多元回归分析步骤逐步多元回归分析是一种常用的统计分析方法,用于确定多个自变量与因变量之间的关系。

它通过逐步引入自变量,以逐步提高回归模型的准确性和预测能力。

本文将介绍逐步多元回归分析的步骤,包括问题定义、变量选择、模型拟合和模型评估等。

步骤一:问题定义在进行逐步多元回归分析之前,首先需要明确研究的目的和问题。

这包括确定因变量和自变量,并明确要解决的研究问题。

例如,我们可以研究一些产品的销量与价格、广告投入和市场规模之间的关系,以确定哪些因素对销量影响最大。

步骤二:变量选择变量选择是逐步多元回归分析中最关键的一步。

在这一步中,我们需要选择适当的自变量,并逐步引入到回归模型中。

通常,可以使用相关系数矩阵和散点图等方法来评估自变量与因变量之间的关系。

选择自变量时,应尽量选择与因变量显著相关的变量,并避免选择高度相关的自变量(即多重共线性)。

步骤三:模型拟合在确定自变量后,我们需要建立逐步多元回归模型。

一种常用的方法是逐步回归法,它分为前向选择和后向剔除两种方法。

前向选择从空模型开始,依次引入自变量,每次只引入一个自变量,并根据F检验或t检验判断是否显著,直到所有自变量都引入到模型中。

反之,后向剔除从包含所有自变量的模型开始,逐步剔除不显著的自变量,直到所有的自变量都被剔除。

步骤四:模型评估在模型拟合之后,需要对模型进行评估,以确定模型的拟合程度和预测能力。

通常,可以使用拟合优度指标(如R方和调整的R方)来评估模型的拟合程度。

此外,还可以使用共线性统计量来检测模型中是否存在多重共线性问题。

如果模型存在多重共线性,应采取相应的措施,如去除高度相关的自变量或使用主成分分析等。

步骤五:模型解释和应用最后,在模型评估之后,我们可以对模型进行解释,并根据模型的结果进行相应的应用。

在解释模型时,应关注各个自变量的回归系数和显著性水平,以确定自变量对因变量的影响。

在应用模型时,可以使用模型进行预测、推断和决策等。

多重共线性问题的几种解决方法

多重共线性问题的几种解决方法在多元线性回归模型经典假设中,其重要假定之一是回归模型的解释变量之间不存在线性关系,也就是说,解释变量X1,X2,……,Xk中的任何一个都不能是其他解释变量的线性组合。

如果违背这一假定,即线性回归模型中某一个解释变量与其他解释变量间存在线性关系,就称线性回归模型中存在多重共线性。

多重共线性违背了解释变量间不相关的古典假设,将给普通最小二乘法带来严重后果。

这里,我们总结了8个处理多重共线性问题的可用方法,大家在遇到多重共线性问题时可作参考:1、保留重要解释变量,去掉次要或可替代解释变量2、用相对数变量替代绝对数变量3、差分法4、逐步回归分析5、主成份分析6、偏最小二乘回归7、岭回归8、增加样本容量这次我们主要研究逐步回归分析方法是如何处理多重共线性问题的。

逐步回归分析方法的基本思想是通过相关系数r、拟合优度R2和标准误差三个方面综合判断一系列回归方程的优劣,从而得到最优回归方程。

具体方法分为两步:第一步,先将被解释变量y对每个解释变量作简单回归:对每一个回归方程进行统计检验分析(相关系数r、拟合优度R2和标准误差),并结合经济理论分析选出最优回归方程,也称为基本回归方程。

第二步,将其他解释变量逐一引入到基本回归方程中,建立一系列回归方程,根据每个新加的解释变量的标准差和复相关系数来考察其对每个回归系数的影响,一般根据如下标准进行分类判别:1.如果新引进的解释变量使R2得到提高,而其他参数回归系数在统计上和经济理论上仍然合理,则认为这个新引入的变量对回归模型是有利的,可以作为解释变量予以保留。

2.如果新引进的解释变量对R2改进不明显,对其他回归系数也没有多大影响,则不必保留在回归模型中。

3.如果新引进的解释变量不仅改变了R2,而且对其他回归系数的数值或符号具有明显影响,则认为该解释变量为不利变量,引进后会使回归模型出现多重共线性问题。

不利变量未必是多余的,如果它可能对被解释变量是不可缺少的,则不能简单舍弃,而是应研究改善模型的形式,寻找更符合实际的模型,重新进行估计。

多重共线性问题的定义和影响多重共线性问题的检验和解决方法

多重共线性问题的定义和影响多重共线性问题的检验和解决方法多重共线性问题的定义和影响,多重共线性问题的检验和解决方法多重共线性问题是指在统计分析中,使用多个解释变量来预测一个响应变量时,这些解释变量之间存在高度相关性的情况。

共线性是指两个或多个自变量之间存在线性相关性,而多重共线性则是指两个或多个自变量之间存在高度的线性相关性。

多重共线性问题会给数据分析带来一系列影响。

首先,多重共线性会导致统计分析不准确。

在回归分析中,多重共线性会降低解释变量的显著性和稳定性,使得回归系数估计的标准误差变大,从而降低模型的准确性。

其次,多重共线性会使得解释变量的效果被混淆。

如果多个解释变量之间存在高度的线性相关性,那么无法确定每个解释变量对响应变量的独立贡献,从而使得解释变量之间的效果被混淆。

此外,多重共线性还会导致解释变量的解释力度下降。

当解释变量之间存在高度的线性相关性时,其中一个解释变量的变化可以通过其他相关的解释变量来解释,从而降低了该解释变量对响应变量的独立解释力度。

为了检验和解决多重共线性问题,有几种方法可以采用。

首先,可以通过方差膨胀因子(VIF)来判断解释变量之间的相关性。

VIF是用来度量解释变量之间线性相关性强度的指标,其计算公式为:VIFi = 1 / (1 - R2i)其中,VIFi代表第i个解释变量的方差膨胀因子,R2i代表模型中除去第i个解释变量后,其他解释变量对第i个解释变量的线性回归拟合优度。

根据VIF的大小,可以判断解释变量之间是否存在多重共线性。

通常来说,如果某个解释变量的VIF大于10或15,那么可以认为该解释变量与其他解释变量存在显著的多重共线性问题。

其次,可以通过主成分分析(PCA)来降低多重共线性的影响。

PCA是一种降维技术,可以将高维的解释变量压缩成低维的主成分,从而减少解释变量之间的相关性。

通过PCA,可以得到一组新的解释变量,这些新的解释变量之间无相关性,并且能够保留原始解释变量的主要信息。

(完整版)多重共线性检验与修正

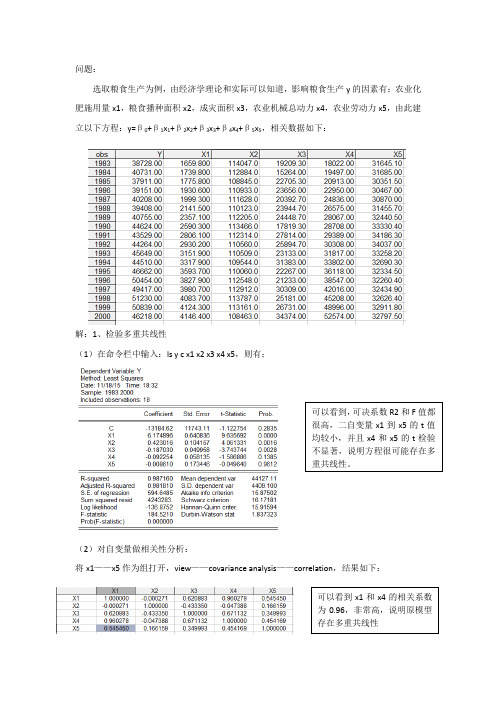

问题:选取粮食生产为例,由经济学理论和实际可以知道,影响粮食生产y的因素有:农业化肥施用量x1,粮食播种面积x2,成灾面积x3,农业机械总动力x4,农业劳动力x5,由此建立以下方程:y=β0+β1x1+β2x2+β3x3+β4x4+β5x5,相关数据如下:解:1、检验多重共线性(1)在命令栏中输入:ls y c x1 x2 x3 x4 x5,则有;可以看到,可决系数R2和F值都很高,二自变量x1到x5的t值均较小,并且x4和x5的t检验不显著,说明方程很可能存在多重共线性。

(2)对自变量做相关性分析:将x1——x5作为组打开,view——covariance analysis——correlation,结果如下:可以看到x1和x4的相关系数为0.96,非常高,说明原模型存在多重共线性2、多重共线性的修正 (1)逐步回归法第一步:首先确定一个基准的解释变量,即从x1,x2,x3,x4,x5中选择解释y 的最好的一个建立基准模型。

分别用x1,x2,x3,x4,x5对y 求回归,结果如下:在基准模型的基础上,逐步将x2,x3等加入到模型中, 加入x2,结果:从上面5个输出结果可以知道,y 对x1的可决系数R2=0.89(最高),因此选择第一个方程作为基准回归模型。

即: Y = 30867.31062 + 4.576114592* x1再加入x3,结果:再加入x4,结果:拟合优度R2=0.961395,显著提高;并且参数符号符合经济常识,且均显著。

所以将模型修改为:Y= -44174.52+ 4.576460*x1+ 0.672680*x2拟合优度R2=0.984174,显著提高;并且参数符号符合经济常识(成灾面积越大,粮食产量越低),且均显著。

所以将模型修改为:Y=-12559.35+5.271306*x1+0.417257*x2-0.212103*x3拟合优度R2=0.987158,虽然比上一次拟合提高了;但是变量x4的系数为-0.091271,符号不符合经济常识(农业机械总动力越高,粮食产量越高),并且x4的t检验不显著。

解决多元线性回归中多重共线性问题的方法分析

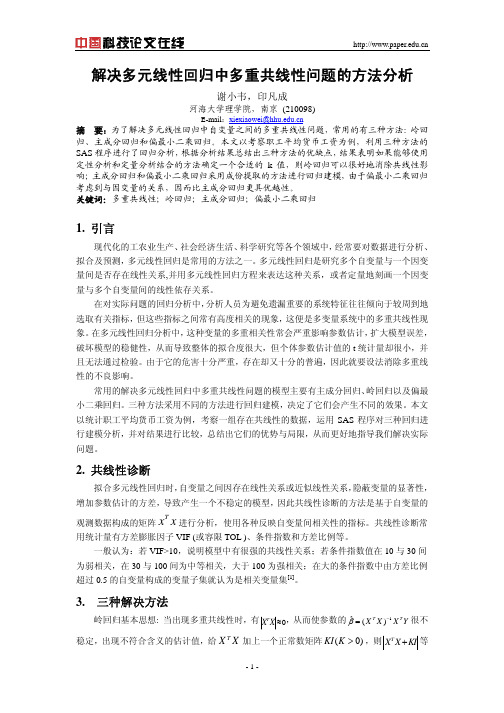

解决多元线性回归中多重共线性问题的方法分析谢小韦,印凡成河海大学理学院,南京 (210098)E-mail :xiexiaowei@摘 要:为了解决多元线性回归中自变量之间的多重共线性问题,常用的有三种方法: 岭回归、主成分回归和偏最小二乘回归。

本文以考察职工平均货币工资为例,利用三种方法的SAS 程序进行了回归分析,根据分析结果总结出三种方法的优缺点,结果表明如果能够使用定性分析和定量分析结合的方法确定一个合适的k 值,则岭回归可以很好地消除共线性影响;主成分回归和偏最小二乘回归采用成份提取的方法进行回归建模,由于偏最小二乘回归考虑到与因变量的关系,因而比主成分回归更具优越性。

关键词:多重共线性;岭回归;主成分回归;偏最小二乘回归1. 引言现代化的工农业生产、社会经济生活、科学研究等各个领域中,经常要对数据进行分析、拟合及预测,多元线性回归是常用的方法之一。

多元线性回归是研究多个自变量与一个因变量间是否存在线性关系,并用多元线性回归方程来表达这种关系,或者定量地刻画一个因变量与多个自变量间的线性依存关系。

在对实际问题的回归分析中,分析人员为避免遗漏重要的系统特征往往倾向于较周到地选取有关指标,但这些指标之间常有高度相关的现象,这便是多变量系统中的多重共线性现象。

在多元线性回归分析中,这种变量的多重相关性常会严重影响参数估计,扩大模型误差,破坏模型的稳健性,从而导致整体的拟合度很大,但个体参数估计值的t 统计量却很小,并且无法通过检验。

由于它的危害十分严重,存在却又十分的普遍,因此就要设法消除多重线性的不良影响。

常用的解决多元线性回归中多重共线性问题的模型主要有主成分回归、岭回归以及偏最小二乘回归。

三种方法采用不同的方法进行回归建模,决定了它们会产生不同的效果。

本文以统计职工平均货币工资为例,考察一组存在共线性的数据,运用SAS 程序对三种回归进行建模分析,并对结果进行比较,总结出它们的优势与局限,从而更好地指导我们解决实际问题。

回归分析中的多重共线性问题及解决方法(八)

回归分析是统计学中的重要方法之一,它用来研究自变量与因变量之间的关系。

然而,在进行回归分析时,研究人员往往会遇到多重共线性的问题。

多重共线性是指自变量之间存在高度相关性的情况,这会导致回归系数估计不准确,甚至失去解释力。

本文将探讨回归分析中的多重共线性问题及解决方法。

1. 多重共线性问题的影响多重共线性问题会造成回归系数的估计不准确,导致参数估计的标准误较大,t统计量较小,从而影响回归模型的显著性检验。

此外,多重共线性还会导致回归系数的符号与理论预期相悖,使得模型的解释能力大大减弱。

2. 多重共线性问题的诊断为了解决回归分析中的多重共线性问题,首先需要进行诊断。

常用的诊断方法包括:方差膨胀因子(VIF)、特征根分析、条件数等。

其中,VIF是应用最为广泛的一种方法,它通过计算自变量之间的相关系数来判断是否存在多重共线性问题。

一般来说,如果自变量之间的相关系数较高(大于),则可以认为存在多重共线性问题。

3. 解决多重共线性的方法一旦发现回归分析中存在多重共线性问题,就需要采取相应的解决方法。

常用的解决方法包括:删除相关性较高的自变量、合并相关自变量、使用主成分回归等。

其中,删除相关自变量是最为直接的方法,但需要谨慎选择,以免丢失重要信息。

合并相关自变量则是将相关自变量进行线性组合,从而减少共线性的影响。

主成分回归则是通过将相关自变量进行主成分提取,来解决多重共线性问题。

这些方法各有优劣,需要根据具体情况来选择合适的方法。

4. 实例分析为了更好地理解多重共线性问题及解决方法,我们可以通过一个实例来进行分析。

假设我们要研究一个人的身高与体重之间的关系,我们选择了身高、体重和BMI指数作为自变量,而体脂率作为因变量。

通过回归分析,我们发现身高、体重和BMI指数之间存在较高的相关性,从而导致回归系数的估计不准确。

为了解决这一问题,我们可以采取合并相关自变量或主成分回归的方法,从而得到更为准确的回归系数估计。

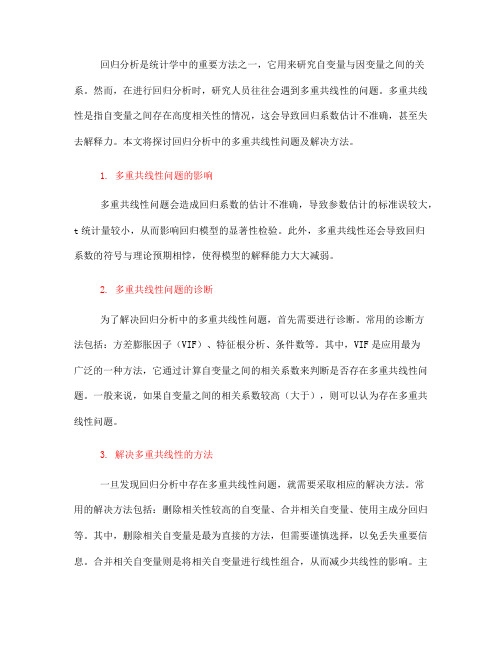

多重共线性检验

采用逐步回归法,来检验并解决多重共线性问题。运行 变量和自变量进行逐步回归分析。

结果分析: 表 4.3 被引入与被剔除的变量

spss19.0 ,对所有应

输入/移去的变量( a)

模 输入的变量

型

移去的 方法

变量

1 GDP(亿元) X2 .

步进(准则 : F-to-enter 的概率 >= .100 )。

联系相对而言变得更微弱。

表 4.4 常用统计量

模型汇总 (d)

模型 R

R方

调整 R 方

标准 估计的误差

Durbin-Watson

1

.950a 0.902

0.894

19.10337

1.52

2

.974b 0.948

0.939

14.45959

3

.987c 0.974

0.967

10.651

a. 预测变量 : ( 常量 ), GDP (亿元) X2。

c. 预测变量 : ( 常量 ), GDP (亿元) X2, 经济增长率 (%) X5, 通货膨胀率 ( %) X4。

d. 因变量 : E (元 /100 美元)

表 4.6 回归系数分析

系数 (a)

非标准化系 数

标准系数

模

标准 误

B

试用版

t

型

差

1 ( 常量 )

885.793

9.875

89.704

GDP(亿元) X2 2 ( 常量 )

估计结果如下 Y=-130.4 + 0.852x1 ( -152 ) ( 12.91 )

R2=0.852, DW=1.492,F=166.74 可以看出运用加权最小二乘法消除了异方差。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

作者简介:杨 有 (95) 16- ,男,重庆人,博士研究生,重庆师范大学数学及计算机科学学院讲师. 基金项目:重庆师范大学科研项目 ( 5L O4 . 0XY0 )

-

3- 9

维普资讯

杨

有

李 晓 虹 : 多 重 共 线 性 的 逐 步 回 归 检 鼍} 析 |分

,

+ + p + L p X

() I

其基本假设是各 自变量

,

,

L, 是相互独立的 。如果某两个或多个 自变量之 间出现 了相关性 ・则称

Байду номын сангаас

为多重共线性。而变 量之 间的多重共线性在实际经济 问题中是大量存在的 。事实上 。首先 ,经济变量的变

化有共 同的趋 势。从时间序列样 本来看 :经济繁荣时期,各基本经济变量 ( 比如收入 、消 费、投 资、价格 )

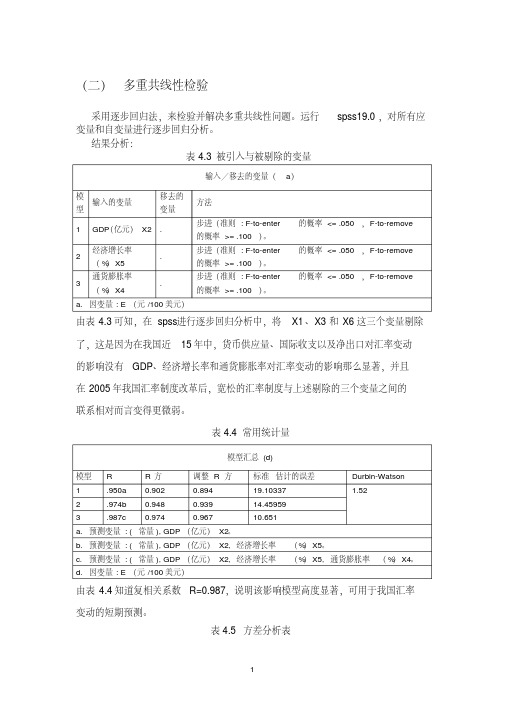

多重共线性 的逐步回归检验分析

杨 有L 李晓虹 ’

4 04; 007 ( .重庆师范大学数学及计算机科学学院,重庆 1

2 。北京航空航天大学计算机学院数字媒体实验室,北京 108 ) 03 0

摘 要:通过国家财政逐步回归模型实例,本文分析了自变量选取原则,阐明了变量筛选的 依据,并在逐步回归具体步骤中,重点描述 了 多重共线性的解决过程,最后利用积矩相关系数, 对多重共线性问题的解决结果进行分析,并给出了合理的实际意义. 关键词:多重共线性;逐步回归;偏 F检验;积矩相关系数

都趋于增长:衰退时期,它们又 同时趋于下降。从横截面数据来看 :生产函数中 ,资本投入与劳动力投入 往往 出现高度 相关情 况,大企业二者都大 ,小企业二者都小 。其次 ,在计量经济模型中 ,往往需要引入滞

后经济变量来 反映真 实的经 济关系 。 例如 ,消费-( - 当期收入。 f 前期收入 ) 两期收入 间有较强的线性相关性 。 ,

了多重共线性的本质 ,并总结 了解决办法 。文献【】 2

通过对 OL S的改进 , 使用岭回归方法建立 了一个模 型实例 。文献【 运用 MA L B工具 ,将一个存在 3 】 TA

对于模型 ( ) 如果从该模型中剔除 白变量 , 1,

得到 由 个 白变量组成的减模型:

Y 屈 + I L+ l + l+ L + . 占 L = + 届 I + I + 2 + J

中图分类号 :F 2 . 文献标识码 :A 文章编号:1 0- 15( 0 6 3 0 3 — 3 247 0 9 8 2 0 )0— 0 9 0 3

1 概 述

回归分析刻 画了变量之 问的近似函数关系,是统计分析 的重要方法,在各行各业 有着广 泛的应 用。对

于 p 个 自变量的多元线性 回归模型: y P + X。 :op +

多重共线性的多元统计 问题影射 为一个线性可分 问

题 ,然后用一般回归神经网络进行 逼近 。

设式 ( ) 1 的复相关系数 的平方和为 , ( ) 式 2

本文根据文献【】 4提供的数据, 以国家l农业总 T

产值 、建筑业总产值 、社会商品零售总产值 、人 口 总数和 受灾面积共六个因素为 自变量 ,以国家财政 收入为 因变量 ,应用 逐步回归分析方法建立 国家财 政收入模型 。 在该实例 中, 分析 了自变量选取原则, 阐明了变量筛选的依据 , 并在逐步回归具体步骤中 。 重点描述 了多重共线 性的解决过程 ,最后利用积矩

如果模型 ( )中并 自 1 变量之间存在多重共线性,则可能导致: 1 ( )该模型的普通域小二乘 ( L ) O S 参

数估计量为 : fr r ・如果 自变量之间存在完全共线性,即存在 常数 G,, 使得 + + + : y GL, C L G,

则f

、

,

不存在,无法得到参数的估计量 。( )在一般共线性或称近似共线性下,虽然可以得到 O S 2 L

计算 的 t 值小于临界值 ,从而错误地作出参数为 0 的推断,将重要 的 自变 量排除在模型之外。 不少 的文献提出了多重共线性的解决方案 。文 献 【 从_ 同的方面给 出了多重共线性 的定义,阐明 l 不 】

判断某个变量是否可 以从模型 中剔除时,我们首先 要 问的 问题是 :这 个变 量对因 变量 的影响是 否显 著 ?解决该 问题 的正规 方法是偏 F检验

法参数估计 但是从参 量, 数估计量的 方差表达式 f c :2 r f

可以 看出, 此时I 0 引 由于 , 起f

主

对角线元素较大 ,从而使参数估计 值的方差增大 ,OL S参数估计量失效 。( )如果模型 ( )中两个 自变 3 1

量具有线性相 关性,例如 和 , ,那么它们巾的一个变量可 以由另一个变量来表 征。这 时,置 和 前的

的复相关系数的平方和为砰 ,定义△2 2砰 。 J R R一

则若A 砰接近 为零 ,就说 明 白变量 对 因变量 没 有 显著影响 ;而 越大 ,就 说明 白变量 对 因变 量 有其它 白 量不可替代的作用 。这个过程相 当 变 于检验假设;H : : , 0 :砰 ≠ ,这种检验称 △ 0

通过国家财政逐步回归模型实例本文分析了自变量选取原则阐明了变量筛选的依据并在逐步回归具体步骤中重点描述了多重共线性的解决过程最后利用积矩相关系数对多重共线性问题的解决结果进行分析并给出了合理的实际意义

维普资讯

数

掌

.T r -究 O

重庆三峡学院 学报—— J NA FC O Q ̄GT R EG G SU V R IY OuR LO H NG H E OR E NI E ST 20 0 6年锫 3期 蒙 2 2卷 o3 2 0 V1 2 06 o 2 . .

参数就不能反映各 自与因变 量之 间的结构关系,而是反映它们对 因变量的共 同影响 。所 以 自变量对应 的参

数 已经失去应有的经济含义 。( )由于多重共线性 的存在 ,使参数估计值 的方差增大 ,也使方差扩大 因子 4

V FV rnen ao atr I(ai c ft n c ) ,这样 ,一方面 ,使 t a Il i F o 变大 统计量 的临界值增 大,拒绝域变 小,导致通过样本