信息论与编码理论基础(第一章)

编码理论基础第1章

1.2信息传输系统的发展、 研究目标与现状

• 1.2.1信息论的形成与发展 • 从历史上看信息论的形成是两部分人 共同努力的结果,一部分是通信工程方面 的学者,另一部分是统计数学家。根据这 一实际情况下面分三个方面来介绍信息论 的形成与发展。 • 1.通信技术的理论基础 • 2. 统计数学的一个分支 • 3.信号与信息处理的一般理论基础

• 1.2.3 纠错编码发展及研究目标 • 1950年汉明(R.W.Hamming)发表的 论文“检错码与纠错码”是开拓编码理论 研究的第一篇论文。1952年费诺给出并证 明了费诺不等式,并给出了关于香农信道 编码逆定理的证明; 1972年S.Arimoto和 R.Blahut分别发展了信道容量的迭代算法; 1948年香农首先分析并研究了高斯信道问 题;1964年J.L.Holsinger发展了有色高斯 噪声信道容量的研究;1969年 M.S.Pinsker提出了具有反馈的非白噪声 高斯信道容量问题;可以说60年代是代数 编码理论发展的鼎盛时朗。70年代出现了 Goppa 码,从而又把编码理论推向了一个 新的高峰。

• 2.现代信源编码

• 虽然经典方法依据了信源本身固有的统计特 性和利用人视觉系统的某些特性进行压缩编码, 但是利用得还不够充分,且伴随着感知生理以及 心理学的发展,人们越来越清楚地认识到:人的 视觉感知特点与统计意义上的信息分布并不一致, 即统计上需要更多的信息量才能表征特征,对视 觉感知可能并不重要。从感知角度来讲,无需详 细表征这部分特征。这时,编码技术的研究就突 破了传统香农理论的框架,注重对感知特性的利 用,使得编码压缩效率得以极大提高,因此称其 为现代压缩编码方法。

1.2.4 密码编码学发展及研究目标 1.古代加密 人类自从有了战争,就面临着通信安全的需 求。最古老的保密技术是手工操作,即消息(信 号)的加密是靠人们用纸和笔以及一些辅助工具 比如密码本来实现的。 古代加密方法大约起源于公元前440年出现在 古希腊战争中的隐写术。当时为了安全传送军事 情报,奴隶主剃光奴隶的头发,将情报写在奴隶 的光头上,待头发长长后将奴隶送到另一个部 落,再次剃光头发,原有的信息复现出来,从而 实现这两个部落之间的秘密通信。 我国古代也早有以藏头诗、藏尾诗、漏格诗及绘画 等形式,将要表达的真正意思或“密语”隐藏在诗文或画 卷 中特定位置的记载,一般人只注意诗或画的表面意境, 而不会去注意或很难发现隐藏其中的“话外之音”。

信息论与编码基础教程第一章

及

常 用

(4)认证性:

术 语

接收者能正确判断所接收的消息的正确性,

验证消息的完整性,而不是伪造和篡改的。

Page 23

1.3

第一章 绪 论

4.信息的特征

信

息 论

(1)信息是新知识、新内容;

的 概

(2)信息是能使认识主体对某一事物的未知

念 及

性或不确定性减少的有用知识;

常

用 (3)信息可以产生,也可以消失,同时信息

Page 31

第一章 绪 论

1-1 信息、消息、信号的定义是什么?三者的关 系是什么?

1-2 简述一个通信系统包括的各主要功能模块及 其作用。

1-3 写出信息论的定义(狭义信息论、广义信息 论)。

1-4 信息有哪些特征? 1-5 信息有哪些分类? 1-6 信息有哪些性质?

Page 32

1.1

信

1961年,香农的“双路通信信道”(Two-

息 论

way Communication Channels)论文开拓了多

发 展

用户信息理论的研究。到20世纪70年代,有关信

简 息论的研究,从点与点间的单用户通信推广发展

史

到多用户系统的研究。

1972年,T Cover发表了有关广播信道的 研究,以后陆续进行了有关多接入信道和广播信 道模型和信道容量的研究。

Page 20

1.3

第一章 绪 论

信 3)信号

息 论

定义:

的 概

把消息换成适合信道传输的物理量(如电

念 信号、光信号、声信号、生物信号等),这种

及 常

物理量称为信号。

用

术

语

信号是信息的载体,是物理性的。

信息论与编码第1章 绪论

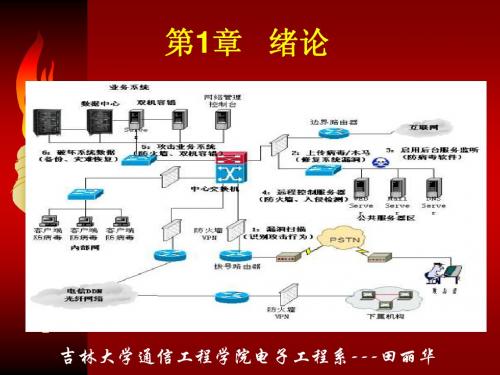

1.2 通信系统的模型

通信的基本问题:在存储或者通信等情况 下,精确或者近似再现信源发出的消息。

信源 编码器 信道 译码器 信宿

干扰源

一般模型

香农信息论的通信系统模型,研究从发端(信源)到收端(信宿)有多少信息被传输。

通信过程: 信源发出的消息,经编码器变为二进制数 串,经由信道传输;到了收端,经过译码, 变为计算机或者人(信宿)能够理解的消 息。

信道编码和差错控制 进展

汉明码,纠一位错 Golay,纠3位错 RS码,循环码 卷积码的发现 Viterbi译码 BCH码,循环码 Turbo,接近香农极限(-1.6db)的编码, 随机迭代、随机交织思想的采用。

未来趋势

无线通信频带资源匮乏,高效和高可靠通 信更加依赖信息论的发展。 Internet通信、移动通信、光存储生物等领 域向信息论提出了要求。

从信源编码器输出到信源译码器输入之间形成等效离散信道。

1.2 通信系统的模型

信 源

定义:产生消息的来源,可以是文字、语言、 图像等; 输出形式:符号形式表示具体消息,是信息 的载体 ; 分类:连续的,离散的; 基本特点:具有随机性。描述其使用概率。ቤተ መጻሕፍቲ ባይዱ 主要研究其统计规律和信源产生的信息速率。

单输入、单输出的单向通信系统; 单输入、多输出的单向通信系统; 多输入、多输出的多向通信系统。

信息论研究的进展

信源编码、数据压缩 信道编码与差错控制 多用户信息论和网络通信 多媒体与信息论 信息论、密码学和数据安全等。 开始研究在通信应用,在投资方面的应用。

信源编码与数据压缩关键理论

信道编码器

通过添加冗余位,进行检错、纠错 信道编码的原则:尽量小的误码率,尽量 少的增加冗余位。 举例: BSC信道发重复码。

《信息论与编码》课件第1章 绪论

1.2 通信系统的模型

信源符号

信 源 编码 信 源

(序列)

编码器 信 道 译码器

x y yˆ

重建符号 (序列)

x

❖ 无失真编码: x xˆ

重建符号与信源发送符号一致, 即编码器输出码字序列与信源 发送序列一一映射;

限失真编码: x xˆ

总是成立的

y yˆ

分别是编码输出码字和接收到的码字

重建符号与信源发送符号不 完全一致;编码器输出码字 序列与信源输出符号序列之 间不是一一映射关系,出现 符号合并,使得重建符号的 熵减少了。

限失真、无失真是由于编译 码器形成的

信道编码

增加冗余

提高

对信道干 扰的抵抗 力

信息传输 的可靠性

❖ 由于信道中存在干扰, 数据传递过程中会出现 错误,信道编码可以检 测或者纠正数据传输的 错误,从而提高数据传 输的可靠性。

1.2 通信系统的模型

调制器

作用:

➢ 将信道编码的输出变换为适合信道传输的 要求的信号 ;

消息

信息的表现形 式;

文字,图像, 声音等;

信号

信号的变化描 述消息;

信息的基本特点

1.不确定性

受信者在接收到信息之前,不知道信源发送 的内容是什么,是未知的、不确定性事件;

2.受信者接收到信息后,可以减少或者消除不确定性;

3. 可以产生、消失、存储,还可以进行加工、处理;

4. 可以度量

1.2 通信系统的模型

冗 信源符号 余 变 相关性强 化 统计冗余强

信源编码器

码序列 相关性减弱 统计冗余弱

相关冗余 统计冗余 生理冗余

模型简化

信源输出前后符号之间存在一定相关性

信源输出符号不服从等概率分布

信息论与编码理论基础(第一章)

11:02

13

11:02

14

第一章:引论(简介)

一、通信系统模型 二、Shannon信息论的中心问题 三、Shannon信息的概念 四、概率复习内容

11:02

15

一、通信系统模型

信源、信道、信宿 信源是消息的来源, 信道是消息传送媒介, 信宿是消息的目的地。

信息是多样的,客观事物是多种多样的、五花 八门的,事物的状态和变化是多姿多彩、变幻 无穷的,属性不同就出现了不同的信息,需要 给出不同的信息定义,从而可创建不同的信息 理论。

比如说信息的不确定性,引出了概率信息,这 是我们讲的最多的。

再如信息的模糊性,引出了模糊信息和模糊信 息论,这个在70年代末提出来的。

信息论基础

11:02

1

教材

王育民、李晖, 信息论与编码理论 (第2版), 高等教育出版社, 2013.

11:02

2

参考书

Thomas M. Cover, Joy A. Thomas, Elements of Information Theory,2nd ed, WILEY Press, 2006. 阮吉寿 张华 译 信息论基础,机械工业出版社,2007.

11:02

6

信息的度量

信息可以被感知,但是不是所有的信息 都可以定量计数,因此,我们要区分信 息和信息量 。

从数学上来说,关于信息量的定义,大 概有100多种。

如果将信息提升到科学进行研究,必须 要对信息进行定量,给出信息的科学测 度,但是这并不是一件很容易的事情。

11:02

7

信息与信息量

还如信息的量子属性,引出了量子信息和量子 信息论。

11:02

8

信息与信息量

信息论与编码理论第一章

1.2 信息论研究的中心问题和发 展

Shannon信息论的基本任务

1948年shannon发表了“通信的数学理论” 奠定了信息论理论基础 基本任务是设计有效而可靠的通信系统

信息论的研究内容

狭义信息论(经典信息论)

研究信息测度,信道容量以及信源和信道编码理论

一般信息论

研究信息传输和处理问题,除经典信息论外还包括噪 声理论,信号滤波和预测,统计检测和估值理论,调 制理论,信息处理理论和保密理论

几乎无错地经由Gaussian信道传信 对于非白Gassian信道,Shannon的注水定理和多载波调制(MCM) CDMA、MCM(COFDM)、TCM、BCM、各种均衡、对消技术、

以及信息存储编码调制技术

信息论几个方面的主要进展

Ⅰ.信源编码与数据压缩 Ⅱ.信道编码与差错控制技术 Ⅲ.多用户信息论与网络通信 Ⅳ.多媒体与信息论 Ⅴ.信息论与密码学和数据安全 Ⅵ.信息论与概率统计 Ⅶ.信息论与经济学 Ⅷ.信息论与计算复杂性 Ⅸ.信息论与系统、控制、信号检测和处理 Ⅹ.量子信息论 Ⅺ.Shannon的其它重要贡献 参见课程网站:信息论进展50年

2.简化模型。理论的作用是浓缩知识之树, “简 单模型胜于繁琐的现象罗列”, “简单化才能显 现出事物的本质,它表现了人的洞察力”。 好的性能量度和复杂性的量度(信息量、熵、 信道容量、商品等),常会引导出优秀的理论结 果和令人满意的实际应用。

1.3 Shannon信息论的局限性

如果实际信源或信道符合所采用的概率模 型描述,这种方法是有效的,否则只能是 近似的,甚至根本无效。

信道 编码器

信道编码 器

调制器

信 道

干扰源

信源 译码器

信道 译码器

信息论与编码理论-全

纠错码 编码调制理论

网络最佳码

Huffman码(1952)、Fano码 算术码(1976,1982) LZ码(1977,1978)

压缩编码 JPEG MPEG

信息论发展简史

电磁理论和电子学理论对通信理论技术发展起重要的 促进作用

1820-1830年,法拉第发现电磁感应 莫尔斯1832-1835建立电报系统。1876年Bell发明电话 1864麦克斯韦预言电磁波存在,1888年赫兹验证该理论 1895年马可尼发明了无线电通信 微波电子管导致微波通信系统,微波雷达系统 激光技术使通信进入光通信时代 量子力学使通信进入量子通信领域

信息论发展简史

1950年汉明码,1960年卷积码的概率译码, Viterbi译码,1982年Ungerboeck编码调制技术, 1993年Turbo编译码技术,1999年LDPC编码技术。 1959年,Shannon提出率失真函数和率失真信源 编码定理 1961年,Shannon的“双路通信信道”开拓了网 络信息论的研究,目前是非常活跃的研究领域。

熵的性质

对称性 非负性 确定性 扩展性 可加性 极值性 是H(P)上凸函数

熵的性质-可加性

q11 q13

p1

q12 q14

H(p1q11,p1q12,…,p4q44)=H(p 1…,p4)+p1H(q11,…,q14)+…+ p4H(q41,…,q44)

p2

p3

p4

熵的极值性

信息论发展简史

1832年莫尔斯电码对shannon编码理论的启发 1885年凯尔文研究了一条电缆的极限传信速率 1922年卡逊对调幅信号的频谱结构进行研究 1924年奈奎斯特证明了信号传输速率和带宽成正比 1928年Hartley提出信息量定义为可能消息量的对数 1939年Dudley发明声码器 1940维纳将随机过程和数理统计引入通信与控制系 统

《信息论与编码基础》第1章 绪论

7

课程讨论主要内容

第3章 离散信道及其信道容量 信道的数学模型及分类 信道疑义度与平均互信息 平均互信息的特性 离散无记忆扩展信道 离散信道的信道容量 信源与信道的匹配

8

课程讨论主要内容

第4章 波形信源及波形信道 波形信源的统计特性和离散化 连续信源和波形信源的信息测度 连续信源熵的性质及最大差熵定理 具有最大差熵的连续信源 连续信道和波形信道的分类 连续信道和波形信道的信息传输率 连续信道和波形信道的信道容量

9

课程讨论主要内容

第5章 基本的信源和信道编码定理 无失真信源编码定理 编码器的概念 等长码 等长信源编码定理 变长码 变长信源编码定理(香农第一定理) 有噪信道编码定理 错误概率与编译码规则 有噪信道编码定理(香农第二定理) 联合信源信道编码定理

10

课程讨论主要内容

第6章 保真度准则下的信源编码 失真的测度 信息率失真函数及其性质 离散无记忆信源的信息率失真函数 保真度准则下的信源编码定理(香农第三定理) 联合有失真信源信道编码定理

1.1 信息的一般概念

19

在通信中对信息的表达分为三个层次:信号、消息、信息。 信号:是信息的物理表达层,是三个层次中最具体的层次。 它是一个物理量,是一个载荷信息的实体,可测量、可描 述、可显示。 消息(或称为符号):是信息的数学表达层,它虽不是一个 物理量,但是可以定量地加以描述,它是具体物理信号的 进一步数学抽象。 可将具体物理信号抽象为两大类型: 离散(数字)消息:由随机序列描述的一组未知量: X=(X1, …, Xi , …, Xn) 连续(模拟)消息:由随机过程描述的未知量:X( t, ω) 信息:是信号与消息的更抽象的表达层次。

1.1 信息的一般概念

17

信息论与编码_第一章

信息论发展中的悲情人物

• 诺贝尔经济学获得者:

JOHN NASH

于1951年发表《非合作博弈论》

成就著名的“纳什均衡”理论

1958年(30岁)开始痴迷于信息编码技术,出现精神失 常。直到80年代末,方从癫疯中苏醒,继续从事经济学博弈 论研究,1994年获得诺贝尔经济学奖

奥斯卡影片《美丽心灵》

第二节、信息的概念

(17) 发现格码,1989,R.deBuda。格(lattice)码可趋近频带受限高斯信道 容量。Loeligerz在1992年已证明,这是Zp上的欧氏空间群码。

(18)发现Turbo码,迭代自适应译码算法,1993, C. Berrou and A. Glavieux. (19) LDPC码,近来又重新被发现。

信息定义的总结

• 信息是人与外界交互的内容,是有序程度的度量 和负熵,是用以减少不定性的东西 ,这些都是 Wiener 、 Brillouin 、 Shannon 等人的理解。这些 认识比仅仅把信息看作消息或通信内容要更深刻。 • 在数学上很容易证明, Hartley 的信息概念仅是 Shannon信息概念的一种特殊情形。 • 总起来说,在现有的各种理解中, Shannon 的定 义比较深刻,而且这种定义还导出了相应的算法。

香农信息定义的缺陷(2)

• 只考虑了随机型的不定性,不能解释与其 他型式的不定性(如模糊不定性)有关的 信息问题。 • 这种信息定义只从功能角度上来表述,还 是没有从根本上回答“信息是什么”的问 题。

2、发展

信 息 论 主 要 几 个 方 面 的 进 展

Ⅰ.信源编码与数据压缩 Ⅱ.信道编码与差错控制技术 Ⅲ.多用户信息论与网络通信 Ⅳ.多媒体与信息论 Ⅴ.信息论与密码学和数据安全 Ⅵ.信息论与概率统计 Ⅶ.信息论与经济学 Ⅷ.信息论与计算复杂性 Ⅸ.信息论与系统、控制、信号检测和处理 Ⅹ.量子信息论 Ⅺ.Shannon的其它重要贡献

第1章 信息论与编码第1章

全信息 全信息

同时考虑事物运动状态及其变化 方式的外在形式、内在含义和效用价值的认识

语法信息 论层次信息。

语义信息

语用信息

信息的重要性质:

存在的普遍性 有序性 相对性 可度量性 可扩充性 可存储、传输与携带性 可压缩性 可替代性

可扩散性

可共享性 时效性

信号、消息与信息区别与联系

通 信 中 的 信 息 含 义 ?

信息论与编码

Information Theory and coding

信息系1402/03/04班

学习目的及意义

最简单的通信系统

信 源

信源包含多少信息?

信 道

信 宿

信源熵

编码 检纠错 信道容量

信道中传输的是什么形式? 信道能传送多少信息? 信宿接收到的信息是否正确?

概 论

信息的一般概念

花朵开放时的色彩是一种信息,它可以引来昆虫为 其授粉;

成熟的水果会产生香味,诱来动物,动物食后为其 传播种子,果香也是一种信息; 药有苦味,让人难以吞咽,药味是一种信息;

听老师讲课可以得到许多知识,知识也是信息

……。

信息的存在

色彩 果香 视觉 嗅觉

苦药

知识 冷热

味觉

听觉 触觉

总之,信息处处存在,人的眼、耳、鼻、 舌、身都能感知信息。

?信息究竟是什么呢?

1928年,美国数学家 哈 特 莱 (Hartley)在 《贝尔系统电话杂志》上发表了一篇题为《信 息传输》的论文。他认为“信息是选择的自由

度”。

事隔20年, 香农

另一位美国数学家 (C. E. Shannon)

在《贝尔系统电话杂志》发表了题为《通信

的数学理论》的长篇论文。他创立了信息论,

信息论与编码一

x2 xm X x 1 q(X ) q (x ) q(x ) q(x ) 1 2 m

x为各种长为N的符号序列,x = x1 x2 … xN ,xi { a1 , a2 , … , ak },1 i N,序列集X = {a1a1… a1 , a1a1… a2 , … , akak… ak },共有kN种序列,x X。 序列的概率q (x) = q (x1x2 … xN) =

根据统计特性,即转移概率p (yx )的不同,信道又可分类为:

无记忆信道 信道的输出y只与当前时刻的输入x有关。

有记忆信道 信道的输出y不仅与当前时刻的输入有关, 还与以前的输入有统计关系 。

1.4.1 离散无记忆信道

离散无记忆信道的输入和输出消息都是离散无记忆的单个符 号,输入符号xi { a1 , a2 , … , ak},1 i I,输出符号yj { b1 , b2 , … , bD },1 j J,信道的特性可表示为转移概率矩阵:

p ( y1 x1 ) p ( y1 x 2 ) P p ( y1 x I ) p ( y 2 x1 ) p( y 2 x 2 ) p( y 2 x I ) p ( y J x1 ) p( y J x 2 ) p( y J x I )

p 1 p 0 P 0 1 p p

0 e

0 1-p 1-p 1

p

p

1

图1-7 二元删除信道

4.二元Z信道

二元Z信道如图1-8所示,信道输入符 号x {0 , 1},输出符号y {0 , 1}转

0 1 移概率矩阵为 P p 1 p

0 1 0 p 1 1-p

下面列举几种常见的离散无记忆信道: 1.二元对称信道(Binary Symmetric Channel,简记为BSC) 这是一种很重要的信道,它的输入符号x {0 , 1},输出符 号y {0 , 1},转移概率p (yx ) ,如图1-5所示,信道特性

信息论与编码第一章

通信系统模型主要分成下列五个部分。

23

编码器可分为信源编码器和信道编码器

• 信源编码器的作用

–是把信源发出的消息变换成由二进制码元 (或多进制码元)组成的代码组,这种代码组 就是基带信号; –同时通过信源编码可以压缩信源的冗余度, 以提高通信系统传输消息的效率。

• 信道编码器的作用

主要作用是提高信息传送的可靠性。

当法拉第于1820-1830年期间发现电磁感应的基本 规律后,不久莫尔斯就建立起电报系统(18321835)。1876年,贝尔又发明了电话系统。 1864年麦克斯韦预言了电磁波的存在,1888年赫兹 用实验证明了这一预言。接着1895年英国的马可尼 和俄国的波波夫就发明了无线电通信。20世纪初 (1907),根据电子运动规则,福雷斯特发明了能 把电磁波进行放大的电子管。。

33

1.4

信息论的主要研究成果

• 语音信号压缩

• 长途电话网标准 –1972年CCITT G.711标准中的 64kbit/s, –1995年 CCITT G. 723.1标准中的 6.3 kbit/s。 • 移动通信中 –1989年GSM标准中语音编码速率为13.2 kbit/s –1994年在为半码速GSM研究的VSELP编码算法中,码 速率为5.6 kbit/s • 军用通信 –美国NSA标准的速率在1975年已达2.4 kbit/s • 目前在实验室中已实现600bit/s的低速率语音编码,特 别是按音素识别与合成原理构造的声码器其速率可低 于100bit/s,已接近信息论指出的极限。

2

课程特点

信息理论为中心,区别 “信源编码” 与“信道编码” 概念和物理意义为主,数学推导尽量 放到课外 结合通信系统实际应用

3

学习目标

信息论与编码第一章绪论

编码的效率与性能

编码效率

编码效率是指编码过程中信息传输速率与原始信息传输速率的比 值,反映了编码过程对信息传输的影响程度。

错误概率

错误概率是指在传输或存储过程中,解码后的信息与原始信息不 一致的概率。

抗干扰能力

抗干扰能力是指编码后的信息在传输过程中抵抗各种干扰的能力, 包括噪声、失真等。

03

信息论与编码的应用领域

信息论与编码第一章绪论

• 信息论的基本概念 • 编码理论的基本概念 • 信息论与编码的应用领域 • 信息论与编码的发展历程 • 信息论与编码的交叉学科

01

信息论的基本概念

信息量的定义与性质

信息量的定义

信息量是衡量信息多少的量,通常用熵来表示。熵是系统不确定性的量度,表示 随机变量不确定性的程度。

04

信息论与编码的发展历程

信息论的起源与发展

19世纪

1928年

随着电报和电话的发明,信息传递开始快 速发展,人们开始意识到信息的传递需要 遵循一定的规律和原则。

美国数学家哈特利提出信息度量方法,为 信息论的诞生奠定了基础。

1948年

1950年代

美国数学家香农发表论文《通信的数学理 论》,标志着信息论的诞生。

信息量的性质

信息量具有非负性、可加性、可数性和传递性等性质。非负性是指信息量总是非 负的;可加性是指多个信息源的信息量可以相加;可数性是指信息量可以量化; 传递性是指信息量可以传递,从一个信息源传到另一个信息源。

信息的度量

信息的度量方法

信息的度量方法有多种,包括自信息、互信息、条件互信息、相对熵等。自信息是指随机变量取某个值的概率; 互信息是指两个随机变量之间的相关性;条件互信息是指在某个条件下的互信息;相对熵也称为KL散度,是两个 概率分布之间的差异度量。

信息论与编码CHAP1

奠基人:美国数学家香农(C.E.Shannon) 1948年“通信的数学理论”

本章内容:

信息的概念 数字通信系统模型 信息论与编码理论研究的主要内容及意义

1.1 信息的概念

信息是信息论中最基本、最重要的概念,既抽象又复杂

信息在日常生活中被认为是“消息”、“知识”、“情 报”等

➢“信息”不同于消息(在现代信息论形成之前,信息一直 被看作是通信中消息的同义词,没有严格的数学含义), 消息是表现形式,信息是实质; ➢“信息”不同于情报,情报的含义比“信息”窄的多, 一般只限于特殊的领域,是一类特殊的信息; ➢信息不同于信号,信号是承载消息的物理量; ➢信息不同于知识,知识是人们根据某种目的,从自然界收 集得来的数据中整理、概括、提取得到的有价值的信息, 是一种高层次的信息。

干扰可以分为两类:1)加性干扰,它是由外界原因产生 的随机干扰,它与信道中传送的信号的统计特性无关,因而 信道的输出是输入和干扰的叠加;2)乘性干扰:信道的输出 信号可看成输入信号和一个时变参量相乘的结果。

❖解调器:从载波中提取信号,是调制的逆过程

❖信道译码器:利用信道编码时所提供的多余度,检查或纠正 数字序列中的错误。

❖ 信道:信号由发送端传输到接收端的媒介。

典型的传输信道有明线、电缆、高频无线信道、 微波通道和光纤通道等;典型的存储媒介有磁芯、磁鼓、 磁盘、磁带等。

❖干扰源:对传输信道或存储媒介构成干扰的来源的总称。干 扰和噪声往往具有随机性,所以信道的特征也可以用概率空 间来描述;而噪声源的统计特性又是划分信道的依据。

❖信源译码器:把经过信道译码器核对过的信息序列转换成适 合接收者接收的信息形式。

❖信宿:消息传送的对象 (人或机器 )。

在通信系统中形式上传输的是消息,但实质上传输 的是信息。消息只是表达信息的工具、载荷信息的客体。 显然,在通信中被利用的(亦即携带信息的)实际客体是 不重要的,而重要的是信息。

信息论与编码第

第1章 绪论

3.信道 信道是信息传输和存储的媒介,是通信系统把载荷消息 的信号从甲地传输到乙地的媒介。在狭义的通信系统中,实 际信道有明线、电缆、波导、光纤、无线电波传播空间等, 这些都属于传输电磁波能量的信道。当然,对广义的通信系 统来说,信道还可以是其他的传输媒介。信道除了传送信号 以外,还有存储信号的作用,在信道中还存在噪声和干扰, 为了分析方便起见,把在系统其他部分产生的干扰和噪声都 等效地折合成信道干扰,看成是由一个噪声源产生的,它将 作用于所传输的信号上。这样,信道输出的是已叠加了干扰 的信号。由于干扰或噪声往往具有随机性,因此信道的特性 也可以用概率空间来描述。

第1章 绪论

当已知信源符号的概率特性时,可计算它的信息熵,用 它表示每个信源符号所载有的信息量。编码定理不但证明了 必存在一种编码方法,使代码的平均长度可任意接近但不能 低于信息熵,而且还阐明达到这一目标的途径,就是使概率 与码长匹配。信源编码定理出现后,编码方法就趋向于合理 化。从无失真信源编码定理出发,1948年,香农在论文中提 出并给出了简单的编码方法(香农编码);1952年,费诺(Fano) 提出了一种费诺码;同年,霍夫曼(D.A.Huffman)构造了一 种霍夫曼编码方法,并证明了它是最佳码。霍夫曼码是有限 长度的块码中最好的码,亦即它是代码总长度最短的码。 1949年,克拉夫特(L.G.Kraft)提出了Kraft不等式,指出了即 时码的码长必须满足的条件。后来,麦克米伦(B.McMillan) 在1956年证明惟一可译码也满足此不等式。到1961年,卡拉 什(J.Karush)简化了麦克米伦的证明方法。

第1章 绪论

若对概率特性未知或不确知的信源进行有效的编码,上 述方法已无能为力。对有些信源,要确知信源的统计特性相 当困难,尤其是高阶条件概率;何况有时信源的概率特性根 本无法测定,或是否存在也不知道。例如,地震波信号就是 如此,因为无法取得大量实验数据。当信源序列是非平稳时, 其概率特性随时间而变更,要测定这种信源的概率特性也近 乎不可能。人们总希望能有一种编码方法通用于各类概率特 性的信源,通用编码就是在信源统计特性未知时对信源进行 编码,且使编码效率很高的一种码。

信息论基础与编码1

信源 编码器

信道 编码器

调制器

01. 研究内容

等效离散信源

信道编码器

信

道

干扰源

信宿 等效信宿

信源 译码器

信道

译0码4器.

申报解调团器队和工作基础

信道译码器

等效离散信道

信息论通信系统的流程框图

小结

❖ 信息的测度:信息量大小与不确定性的程度有关。 用数学的语言来讲,不确定 就是随机性,可运用研究随机事件的数学工具----概率论和随机过程来测度来刻画不 确定性的大小。 ❖ 某一事物所处状态的不确定性大小,与该事物可能出现的不同状态数目以及各 状态呈现的概率大小有关。既然不确定性的大小能够度量,所以信息是可以测度的。 ❖ 信息测度相关的几个概念:样本空间、概率空间 、先验概率 、自信息 、后验 概率、熵以及互信息等概念

➢ 广义信息论:广义信息论不仅包括上述两方面的内容,而且包括所有与信息有关的领域, 如模式识别、计算机翻译、心理学、遗传学、语言学等等。

1.2 信息论的基本概念

•信息:是信息论中最基本、最重要的概念,既抽象又复杂认知与理解,日常生活中被认为是 “消息”、“知识”、“情报”等 。

•消息:用文字等能够被人们感觉器官所感知的形式,将客观物质运动与主观思维活动的状态 描述。

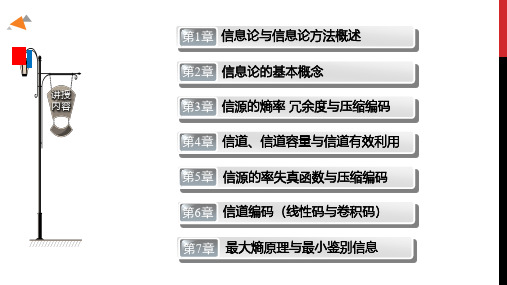

第1章 信息论与信息论方法概述

第2章 信息论的基本概念

讲授

内容

第3章 信源的熵率 冗余度与压缩编码

第4章 信道、信道容量与信道有效利用

第5章 信源的率失真函数与压缩编码

第6章 信道编码(线性码与卷积码)

第7章 最大熵原理与最小鉴别信息

第一章

text

1. 1 信息科学与信息论

1. 2 信息论的基本概念

信息论与编码第1章

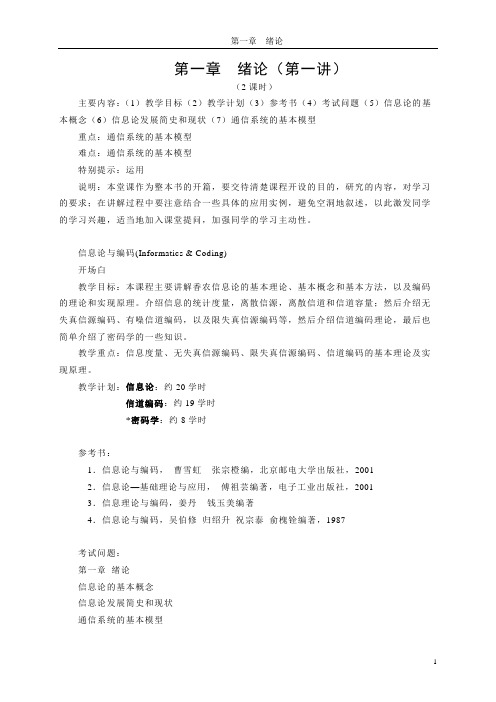

第一章绪论(第一讲)(2课时)主要内容:(1)教学目标(2)教学计划(3)参考书(4)考试问题(5)信息论的基本概念(6)信息论发展简史和现状(7)通信系统的基本模型重点:通信系统的基本模型难点:通信系统的基本模型特别提示:运用说明:本堂课作为整本书的开篇,要交待清楚课程开设的目的,研究的内容,对学习的要求;在讲解过程中要注意结合一些具体的应用实例,避免空洞地叙述,以此激发同学的学习兴趣,适当地加入课堂提问,加强同学的学习主动性。

信息论与编码(Informatic s & Coding)开场白教学目标:本课程主要讲解香农信息论的基本理论、基本概念和基本方法,以及编码的理论和实现原理。

介绍信息的统计度量,离散信源,离散信道和信道容量;然后介绍无失真信源编码、有噪信道编码,以及限失真信源编码等,然后介绍信道编码理论,最后也简单介绍了密码学的一些知识。

教学重点:信息度量、无失真信源编码、限失真信源编码、信道编码的基本理论及实现原理。

教学计划:信息论:约20学时信道编码:约19学时*密码学:约8学时参考书:1.信息论与编码,曹雪虹张宗橙编,北京邮电大学出版社,20012.信息论—基础理论与应用,傅祖芸编著,电子工业出版社,20013.信息理论与编码,姜丹钱玉美编著4.信息论与编码,吴伯修归绍升祝宗泰俞槐铨编著,1987考试问题:第一章绪论信息论的基本概念信息论发展简史和现状通信系统的基本模型§1.1 信息论的基本概念信息论是一门应用近代数理统计方法来研究信息的传输和处理的科学。

在涉及这门课程的具体内容之前,很有必要在引言中,首先放宽视野,从一般意义上描述、阐明信息的基本含意。

然后,再把眼光收缩到信息论的特定的研究范围中,指明信息论的假设前提,和解决问题的基本思路。

这样,就有可能帮助读者,在学习、研究这门课程之前,建立起一个正确的思维方式,有一个正确的思路,以便深刻理解、准确把握以下各章节的具体内容。

信息论与编码第一章信息论基础新

例1:天气预报 10月份,北京天气, 经常出现的天气:晴间多云、晴、多云 其次:多云转阴、阴、阴有小雨 最后:小雪、大雪的概率很低 听天气预报前,我们可以大概猜出天气的情况:晴间多云、 晴、多云 如果预报讲是:晴间多云、晴、多云,与我们的猜测一致, 所消除的不确定性小,获得的信息量也小 如果预报讲是:小雪。与我们的猜测差距很大,所消除的 不确定性大,我们获得的信息量大

一般信 息论

广 义 信 息 论

基础 信息论:信息的测度、信道容量, 信源和信道编码理论等,香农基本理论 工程信息论:香农+维纳 信息论

香农:信源到信宿之间的全过程优化,重点是 编码理论 维纳:接收端,注意研究如何把受干扰的信号 恢复、提取,主要是线性滤波理论、统计检测 与估计理论,噪声理论等

25

2/22/2019

不确定性:

通信的本质:“不知”到“知” ,消除 “不确定性” , 接收者所得到的信息量,在数量上等于通信前后“不确定 性”的消除量 不确定性与“多种结果的可能性”相关联,在数学上“可 2/22/2019 能性”以概率来度量 。 20

研究的对象

信息论研究的对象是消息传输系统。由于消息含 有信息,亦称为信息传输系统,简称通信系统。 人们通过消息的传输和处理过程来研究信息传输 和处理过程中的共同规律。 广义的通信系统指所有的信息流通系统,不单指 电话、FAX,E-mail之类,还包括生物有机体的 遗传系统,神经系统,甚至人类社会的管理系统 等。 通信的基本问题是在彼时彼地精确地或近似地再 现此时此地发出的消息。

2/22/2019 13

1948年,美国数学家、信息论的创始人香农 在题为“通讯的数学理论”的论文中指出:

信息论与编码第1章概论

数据融合

信息论中的数据融合算法可以用于物 联网中的多源数据融合,提高数据处 理效率和准确性。

THANKS

感谢观看

信息论的起源与发展

01

02

03

04

19世纪

随着电报和电话的发明,信息 传递开始受到关注。

20世纪40年代

香农提出信息论,为信息传递 和编码提供了理论基础。

20世纪60年代

随着计算机技术的兴起,信息 论在数据压缩、传输和存储方

面得到广泛应用。

21世纪

信息论在物联网、大数据、人 工智能等领域发挥重要作用。

熵

熵是衡量随机变量不确定性的度量,可以用来衡量信息的平均量。对于离散随机变量,熵 是所有可能事件概率的加权对数值。对于连续随机变量,熵是概率密度函数的积分值的对 数值。

冗余

冗余是指信息中多余的部分,即不包含新信息的部分。编码的目标是减少冗余,提高信息 的有效性和传输效率。

编码的分类

01

信源编码

信源编码是对原始信息进行压缩和编码的过程,以减少信息的冗余和提

编码实践验证信息论理论

编码实践为信息论提供了实验验证的机会,帮助完善和发展信息论的理论体系。

编码推动信息论的应用

编码技术的发展推动了信息论在实际应用领域的发展,使得信息论在通信、数据存储等领域得到广泛 应用。

信息论与编码的应用领域

通信系统

数据存储

信息论和编码在通信系统中发挥着重要作 用,如数字电视、卫星通信、移动通信等 。

信息论与编码第1章概论

• 信息论的基本概念 • 编码理论的基本概念 • 信息论与编码的关系 • 信息论与编码的发展历程 • 信息论与编码的应用案例

01

信息论的基本概念

信息论与编码第一章绪论

➢ 广义信息论

除上述内容外,还包括自然和社会领域有关 信息的内容,如模式识别,计算机翻译,心 理学,遗传学,神经生理学

信息论发展简史

➢ 电磁理论和电子学理论对通信理论技术 发展起重要的促进作用

➢ 研究目的:提高信息系统的可靠性、有效性和安全性以

便达到系统最优化。

1.1 信息的概念

信息是信息论中最基本、最重要的概念,既抽象又 复杂

信息在日常生活中被认为是“消息”、“知识”、“情报” 等➢“信息”不同于消息(在现代信息论形成之前,信息一直

被看作是通信中消息的同义词,没有严格的数学含义), 消息是表现形式,信息是实质;

比

➢ 1928年Hartley提出信息量定义为可能消息量的 对数

➢ 1939年Dudley发明声码器 ➢ 1940维纳将随机过程和数理统计引入通信与控制

系统

信息论发展简史

1948年shannon信息论奠基

1952年Fano证明了Fano不等式,给出了 shannon信道编码逆定理的证明

1957,Wolfowitz,1961 Fano, 1968Gallager给出信道编码定理的简介证 明并描述了码率,码长和错误概率的关系, 1974年Bahl发明了分组码的迭代算法( BCRJ)

➢ 重点讲授信息的概念,信息的度量和计算等 一些基本问题。还学习几种常用的信源编码方 法和纠错编码方法。

课程位置

基础课程

概率论 数理统计

后续课程:

通信原理 数字通信 数字图像处理

课程目标

➢ 掌握基本的信息论概念,而且要求能够和日常 生活和学习结合起来,做到活学活用。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

从数学上来说,关于信息量的定义,大 概有100多种。 如果将信息提升到科学进行研究,必须 要对信息进行定量,给出信息的科学测 度,但是这并不是一件很容易的事情。

22:28

5

信息与信息量

信息是多样的,客观事物是多种多样的、五花 八门的,事物的状态和变化是多姿多彩、变幻 无穷的,属性不同就出现了不同的信息,需要 给出不同的信息定义,从而可创建不同的信息 理论。 比如说信息的不确定性,引出了概率信息,这 是我们讲的最多的。 再如信息的模糊性,引出了模糊信息和模糊信 息论,这个在70年代末提出来的。 还如信息的量子属性,引出了量子信息和量子 信息论。

9

22:28

信息与信息量

1948年发表的《通信的数学理论》文章,这是 一篇20世纪少有的几篇对科学和工程,乃至对 人类社会发展产生了重要影响著作,是可与牛 顿力学相媲美的不朽之作,也是他最重要的科 学贡献。 这使他成为信息论之父,时年仅32岁。作为数 学家,他为数学开辟了一个工程应用的新领域。 这篇文章虽然在1947年完成,但至今仍然闪烁 着智慧的光芒,它将照耀人类今后的数个世纪。

编码器

22:28

14

各部件功能

信道

信号从发端传到收端的介质 系统各部分引入的干扰,包括衰落,多径, 码间干扰,非线性失真,加性噪声,主要是 统计特性 信道的中心问题是研究信道的统计特性和传 信能力,即信道容量

15

干扰源

22:28

各部件功能

译码器

编码器的逆变换 中心问题是研究各种可实现的解调和译码方法 信息的接收者

22:28 29

信息论发展简史

1948年shannon信息论奠基 1952年Fano证明了Fano不等式,给出了 shannon信道编码逆定理的证明 1957,Wolfowitz,1961 Fano, 1968Gallager给出信道编码定理的简介证明并 描述了码率,码长和错误概率的关系,1972年 Arimoto和Blahut发明了信道容量的迭代算法 1956McMillan证明了Kraft不等式。1952年 Fano码,Huffman码。1976 Rissanen算术编 码,1977,78 Ziv和Lempel的LZ算法

22:28 18

香农信息论的基本任务

1948年shannon发表了“通信的数学 理论”奠定了信息论理论基础 基本任务是设计有效而可靠的通信系统

可靠是要使信源发出的消息经过传输后,尽 可能准确地、不失真地再现在接收端 有效是用尽可能短的时间和尽可能少的设备 来传输一定量的消息

22:28

19

信源编码问题

信宿

22:28

16

信息、消息和信号

信息

一个抽象的概念,可以定量的描述。信息、物质和能 量是构成一切系统的三大要素 是信息的载体,相对具体的概念,如语言,文字,数 字,图像 表示消息的物理量,电信号的幅度,频率,相位等等

消息

信号

22:28

17

二、Shannon信息论的 中心问题

“信息论”,又称为“通信的数学理论”,是研究信息的传 输、存储、处理的科学。 信息论的中心问题:为设计有效而可靠的通信系统提供理论 依据。 (具体地说,就是信源编码和信道编码。以下来看所要解决 的具体问题。) 问题一:信源消息常常不能够完全发送。(否则发送量巨 大,比如:信源消息是一片无尽的天空。因此优先捡有 用的发送。什么是有用的?就是信息量大的。什么是信 息量大的?) 问题二:信道因干扰而出现差错,必须进行检错和纠错。 (否则所收到的消息无法识别。)

7

22:28

信息与信息量

信息量度定义的困难性,在众多信息中,只有少数的 信息有了量,大多数的信息是可以感知的,但是无法 度量,因为没有找到合适的信息量的定义,就建不起 来一套理论。 比如说对情感信息中的喜怒哀乐,都可以感知,但是 我们很难度量它们,只能用一些比较模糊的形容词, 描述不同程度的感情。 “你问我对你的爱有多深,我爱你有几分,你去想一 想,你去看一看,月亮代表我的心。”我们还不能确 切地给出“这份爱”有多少“比特”,“那份爱”比 “这份爱”又多多少“比特”。对于美学信息也是如 此。

6

22:28

信息与信息量

信息的复杂性引出了信息的复杂度和复杂度的 信息理论,信息的感知属性引出了感知信息和 感知信息理论,信息的美学属性引出美学信息 和美学信息理论等等。 现在有五花八门的信息理论,已经提出了各式 各样的信息理论,而且得到了众多不同的结果, 都宣称取得了成功。动态信息论、定性信息论、 经济信息论、算法信息论、模糊信息论、量子 信息论等等,还有信息生态学、信息代数、信 息几何等,信息物理学、信息生物学等。

信息论与编码理论

主讲: 刘振华 研究方向:密码学、云安全 邮件:zh_liu@ QQ: 30304237

22:28 1

教材、参考书

教材:王育民、李晖、梁传甲,信息与编码理论, 高等教育出版社,2005.

参考书: R.J.Mceliece,The Theory of Information and Coding,2nd ed, Cambridge University Press, 2002. 姜丹,信息论与编码,中国科学技术大学出版社,2008. 沈世镒 等,信息论与编码理论,科学出版社,2010. 傅祖芸, 信息论——基础理论与应用,电子工业出版社,2001 傅祖芸,信息论与编码学习辅导及习题详解,电子工业出版 社,2004.

纠错码 编码调制理论

网络最佳码

Huffman码(1952)、Fano码 算术码(1976,1982) LZ码(1977,1978)

22:28

压缩编码 JPEG MPEG

27

信息论发展简史

电磁理论和电子学理论对通信理论技术发展起重 要的促进作用

1820-1830年,法拉第发现电磁感应 莫尔斯1832-1835建立电报系统。1876年Bell发明 电话 1864麦克斯韦预言电磁波存在,1888年赫兹验证该理 论 1895年马可尼发明了无线电通信 微波电子管导致微波通信系统,微波雷达系统 激光技术使通信进入光通信时代 量子力学使通信进入量子通信领域

22:28 30

信息论发展简史

1950年汉明码,1960年卷积码的概率译码, Viterbi译码,1982年Ungerboeck编码调制技 术,1993年Turbo编译码技术,1999年LDPC 编码技术。 1959年,Shannon提出率失真函数和率失真信 源编码定理 1961年,Shannon的“双路通信信道”开拓了 网络信息论的研究,目前是非常活跃的研究领域。

信源编码器的作用是根据失真度准则对 信源进行划分,给每一类以不同的表示, 即码字。 信源译码器的任务是根据收到的信源表 示恢复出信源所属的类。

22:28

20

信源编码问题

在给定信源和失真度条件下,要多大信 息速率才行?或对给定信源保留一定的 信息速率下,可以达到的最小失真是多 少?——信源编码问题,即通信“可行 性”研究。 如何实现上述理论——找出实际可行的 信源编码和译码方法。

25

22:28

信息论的研究内容

狭义信息论(经典信息论)

研究信息测度,信道容量以及信源和信道编码理论 研究信息传输和处理问题,除经典信息论外还包括噪声 理论,信号滤波和预测,统计检测和估值理论,调制理 论,信息处理理论和保密理论

一般信息论

广义信息论

除上述内容外,还包括自然和社会领域有关信息的内容, 如模式识别,计算机翻译,心理学,遗传学,神经生理 学

21

22:28

信道编码问题

研究在保证信息传输可靠性的条件下最 有效地利用信道的传信能力的。 设送入信道的信息速率为R,信道容量为 C,信道编码基本理论告诉我们: 若R<C,则可以将速率为R的信息以任意 高的可靠性送至接收端。 若R>C,则不可能。 寻找实际可行的编、译码方法。

22

22:28

香农信息论特点

将概率统计的观点和方法引入到通信理论 研究中,揭示了通信系统中传送的对象 是信息,并对信息给出科学的、定量的 描述,指出通信系统设计的中心问题是 在随机噪声干扰下如何有效而可靠地传 送信息,实现这一目标的途径是编码 (信源编码和信道编码),并且从理论 上证明了可以达到的最佳性能限。

22:28 23

10

22:28

第一章:引论(简介)

一、通信系统模型 二、Shannon信息论的中心问题 三、Shannon信息的概念 四、概率复习内容

22:28 11

一、通信系统模型

信源、信道、信宿

信源是消息的来源, 信道是消息传送媒介, 信宿是消息的目的地。

信源

编码器

信道

译码器

信宿

干扰源

22:28 12

通信系统模型进一步细分

22:28 2

信息与信息量

Wiener :“信息既不是物质,也不是 能量,信息就是信息”。 物质和能量是客观存在的、有形的,信 息是抽象的、无形的。物质和能量是系 统的“躯体”,信息则系统的“灵 魂”。������ 信息要借助于物质和能量才能产生、传 输、存储、处理和感知;物质和能量要 借助于信息来表述和控制。

22:28 31

三、Shannon信息的概念

(直观地认识shannon信息和信息量,而暂 时不使用定义)