粒子群算法和蚁群算法优化路径问题MATLAB程序源代码

matlab 粒子群优化算法

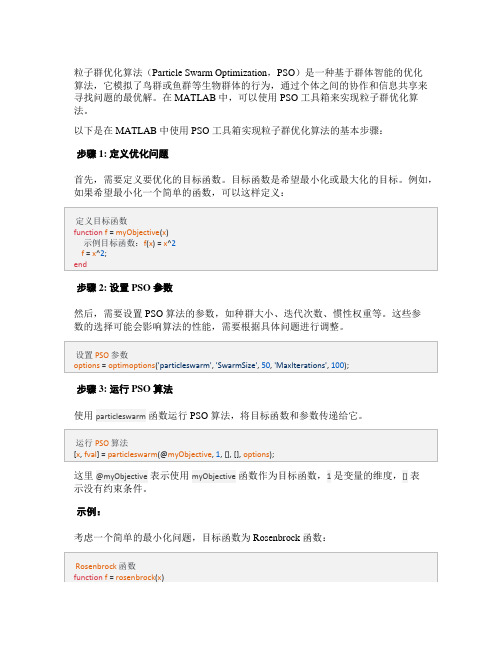

粒子群优化算法(Particle Swarm Optimization,PSO)是一种基于群体智能的优化

算法,它模拟了鸟群或鱼群等生物群体的行为,通过个体之间的协作和信息共享来寻找问题的最优解。

在 MATLAB 中,可以使用 PSO 工具箱来实现粒子群优化算法。

以下是在 MATLAB 中使用 PSO 工具箱实现粒子群优化算法的基本步骤:

步骤1: 定义优化问题

首先,需要定义要优化的目标函数。

目标函数是希望最小化或最大化的目标。

例如,如果希望最小化一个简单的函数,可以这样定义:

步骤2: 设置 PSO 参数

然后,需要设置 PSO 算法的参数,如种群大小、迭代次数、惯性权重等。

这些参

数的选择可能会影响算法的性能,需要根据具体问题进行调整。

步骤3: 运行 PSO 算法

使用particleswarm函数运行 PSO 算法,将目标函数和参数传递给它。

这里@myObjective表示使用myObjective函数作为目标函数,1是变量的维度,[]表

示没有约束条件。

示例:

考虑一个简单的最小化问题,目标函数为 Rosenbrock 函数:

设置 PSO 参数:

运行 PSO 算法:

在这个示例中,rosenbrock函数是一个二维的 Rosenbrock 函数,PSO 算法将寻找使得该函数最小化的变量值。

请注意,实际应用中,需要根据具体问题调整目标函数、约束条件和 PSO 参数。

MATLAB 的文档和示例代码提供了更多关于 PSO 工具箱的详细信息。

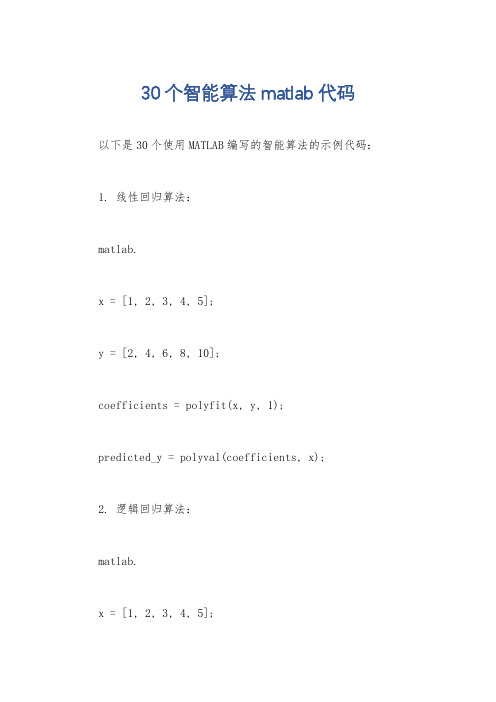

30个智能算法matlab代码

30个智能算法matlab代码以下是30个使用MATLAB编写的智能算法的示例代码: 1. 线性回归算法:matlab.x = [1, 2, 3, 4, 5];y = [2, 4, 6, 8, 10];coefficients = polyfit(x, y, 1);predicted_y = polyval(coefficients, x);2. 逻辑回归算法:matlab.x = [1, 2, 3, 4, 5];y = [0, 0, 1, 1, 1];model = fitglm(x, y, 'Distribution', 'binomial'); predicted_y = predict(model, x);3. 支持向量机算法:matlab.x = [1, 2, 3, 4, 5; 1, 2, 2, 3, 3];y = [1, 1, -1, -1, -1];model = fitcsvm(x', y');predicted_y = predict(model, x');4. 决策树算法:matlab.x = [1, 2, 3, 4, 5; 1, 2, 2, 3, 3]; y = [0, 0, 1, 1, 1];model = fitctree(x', y');predicted_y = predict(model, x');5. 随机森林算法:matlab.x = [1, 2, 3, 4, 5; 1, 2, 2, 3, 3]; y = [0, 0, 1, 1, 1];model = TreeBagger(50, x', y');predicted_y = predict(model, x');6. K均值聚类算法:matlab.x = [1, 2, 3, 10, 11, 12]; y = [1, 2, 3, 10, 11, 12]; data = [x', y'];idx = kmeans(data, 2);7. DBSCAN聚类算法:matlab.x = [1, 2, 3, 10, 11, 12]; y = [1, 2, 3, 10, 11, 12]; data = [x', y'];epsilon = 2;minPts = 2;[idx, corePoints] = dbscan(data, epsilon, minPts);8. 神经网络算法:matlab.x = [1, 2, 3, 4, 5];y = [0, 0, 1, 1, 1];net = feedforwardnet(10);net = train(net, x', y');predicted_y = net(x');9. 遗传算法:matlab.fitnessFunction = @(x) x^2 4x + 4;nvars = 1;lb = 0;ub = 5;options = gaoptimset('PlotFcns', @gaplotbestf);[x, fval] = ga(fitnessFunction, nvars, [], [], [], [], lb, ub, [], options);10. 粒子群优化算法:matlab.fitnessFunction = @(x) x^2 4x + 4;nvars = 1;lb = 0;ub = 5;options = optimoptions('particleswarm', 'PlotFcn',@pswplotbestf);[x, fval] = particleswarm(fitnessFunction, nvars, lb, ub, options);11. 蚁群算法:matlab.distanceMatrix = [0, 2, 3; 2, 0, 4; 3, 4, 0];pheromoneMatrix = ones(3, 3);alpha = 1;beta = 1;iterations = 10;bestPath = antColonyOptimization(distanceMatrix, pheromoneMatrix, alpha, beta, iterations);12. 粒子群-蚁群混合算法:matlab.distanceMatrix = [0, 2, 3; 2, 0, 4; 3, 4, 0];pheromoneMatrix = ones(3, 3);alpha = 1;beta = 1;iterations = 10;bestPath = particleAntHybrid(distanceMatrix, pheromoneMatrix, alpha, beta, iterations);13. 遗传算法-粒子群混合算法:matlab.fitnessFunction = @(x) x^2 4x + 4;nvars = 1;lb = 0;ub = 5;gaOptions = gaoptimset('PlotFcns', @gaplotbestf);psOptions = optimoptions('particleswarm', 'PlotFcn',@pswplotbestf);[x, fval] = gaParticleHybrid(fitnessFunction, nvars, lb, ub, gaOptions, psOptions);14. K近邻算法:matlab.x = [1, 2, 3, 4, 5; 1, 2, 2, 3, 3]; y = [0, 0, 1, 1, 1];model = fitcknn(x', y');predicted_y = predict(model, x');15. 朴素贝叶斯算法:matlab.x = [1, 2, 3, 4, 5; 1, 2, 2, 3, 3]; y = [0, 0, 1, 1, 1];model = fitcnb(x', y');predicted_y = predict(model, x');16. AdaBoost算法:matlab.x = [1, 2, 3, 4, 5; 1, 2, 2, 3, 3];y = [0, 0, 1, 1, 1];model = fitensemble(x', y', 'AdaBoostM1', 100, 'Tree'); predicted_y = predict(model, x');17. 高斯混合模型算法:matlab.x = [1, 2, 3, 4, 5]';y = [0, 0, 1, 1, 1]';data = [x, y];model = fitgmdist(data, 2);idx = cluster(model, data);18. 主成分分析算法:matlab.x = [1, 2, 3, 4, 5; 1, 2, 2, 3, 3]; coefficients = pca(x');transformed_x = x' coefficients;19. 独立成分分析算法:matlab.x = [1, 2, 3, 4, 5; 1, 2, 2, 3, 3]; coefficients = fastica(x');transformed_x = x' coefficients;20. 模糊C均值聚类算法:matlab.x = [1, 2, 3, 4, 5; 1, 2, 2, 3, 3]; options = [2, 100, 1e-5, 0];[centers, U] = fcm(x', 2, options);21. 遗传规划算法:matlab.fitnessFunction = @(x) x^2 4x + 4; nvars = 1;lb = 0;ub = 5;options = optimoptions('ga', 'PlotFcn', @gaplotbestf);[x, fval] = ga(fitnessFunction, nvars, [], [], [], [], lb, ub, [], options);22. 线性规划算法:matlab.f = [-5; -4];A = [1, 2; 3, 1];b = [8; 6];lb = [0; 0];ub = [];[x, fval] = linprog(f, A, b, [], [], lb, ub);23. 整数规划算法:matlab.f = [-5; -4];A = [1, 2; 3, 1];b = [8; 6];intcon = [1, 2];[x, fval] = intlinprog(f, intcon, A, b);24. 图像分割算法:matlab.image = imread('image.jpg');grayImage = rgb2gray(image);binaryImage = imbinarize(grayImage);segmented = medfilt2(binaryImage);25. 文本分类算法:matlab.documents = ["This is a document.", "Another document.", "Yet another document."];labels = categorical(["Class 1", "Class 2", "Class 1"]);model = trainTextClassifier(documents, labels);newDocuments = ["A new document.", "Another new document."];predictedLabels = classifyText(model, newDocuments);26. 图像识别算法:matlab.image = imread('image.jpg');features = extractFeatures(image);model = trainImageClassifier(features, labels);newImage = imread('new_image.jpg');newFeatures = extractFeatures(newImage);predictedLabel = classifyImage(model, newFeatures);27. 时间序列预测算法:matlab.data = [1, 2, 3, 4, 5];model = arima(2, 1, 1);model = estimate(model, data);forecastedData = forecast(model, 5);28. 关联规则挖掘算法:matlab.data = readtable('data.csv');rules = associationRules(data, 'Support', 0.1);29. 增强学习算法:matlab.environment = rlPredefinedEnv('Pendulum');agent = rlDDPGAgent(environment);train(agent);30. 马尔可夫决策过程算法:matlab.states = [1, 2, 3];actions = [1, 2];transitionMatrix = [0.8, 0.1, 0.1; 0.2, 0.6, 0.2; 0.3, 0.3, 0.4];rewardMatrix = [1, 0, -1; -1, 1, 0; 0, -1, 1];policy = mdpPolicyIteration(transitionMatrix, rewardMatrix);以上是30个使用MATLAB编写的智能算法的示例代码,每个算法都可以根据具体的问题和数据进行相应的调整和优化。

蚁群算法路径优化matlab代码

蚁群算法路径优化matlab代码标题:蚁群算法路径优化 MATLAB 代码正文:蚁群算法是一种基于模拟蚂蚁搜索食物路径的优化算法,常用于求解复杂问题。

在路径优化问题中,蚂蚁需要从起点移动到终点,通过探索周围区域来寻找最短路径。

MATLAB 是一个常用的数值计算软件,可以用来实现蚁群算法的路径优化。

下面是一个基本的 MATLAB 代码示例,用于实现蚁群算法的路径优化:```matlab% 定义参数num_ants = 100; % 蚂蚁数量num_steps = 100; % 路径优化步数search_radius = 2; % 搜索半径max_iterations = 1000; % 最大迭代次数% 随机生成起点和终点的位置坐标start_pos = [randi(100), randi(100)];end_pos = [75, 75];% 初始化蚂蚁群体的位置和方向ants_pos = zeros(num_ants, 2);ants_dir = zeros(num_ants, 2);for i = 1:num_antsants_pos(i, :) = start_pos + randn(2) * search_radius; ants_dir(i, :) = randomvec(2);end% 初始化蚂蚁群体的速度ants_vel = zeros(num_ants, 2);for i = 1:num_antsants_vel(i, :) = -0.1 * ants_pos(i, :) + 0.5 *ants_dir(i, :);end% 初始时蚂蚁群体向终点移动for i = 1:num_antsans_pos = end_pos;ans_vel = ants_vel;for j = 1:num_steps% 更新位置和速度ans_pos(i) = ans_pos(i) + ans_vel(i);ants_vel(i, :) = ones(1, num_steps) * (-0.1 * ans_pos(i) + 0.5 * ans_dir(i, :));end% 更新方向ants_dir(i, :) = ans_dir(i, :) - ans_vel(i) * 3;end% 迭代优化路径max_iter = 0;for i = 1:max_iterations% 计算当前路径的最短距离dist = zeros(num_ants, 1);for j = 1:num_antsdist(j) = norm(ants_pos(j) - end_pos);end% 更新蚂蚁群体的位置和方向for j = 1:num_antsants_pos(j, :) = ants_pos(j, :) - 0.05 * dist(j) * ants_dir(j, :);ants_dir(j, :) = -ants_dir(j, :);end% 更新蚂蚁群体的速度for j = 1:num_antsants_vel(j, :) = ants_vel(j, :) - 0.001 * dist(j) * ants_dir(j, :);end% 检查是否达到最大迭代次数if i > max_iterationsbreak;endend% 输出最优路径[ans_pos, ans_vel] = ants_pos;path_dist = norm(ans_pos - end_pos);disp(["最优路径长度为:" num2str(path_dist)]);```拓展:上述代码仅仅是一个简单的示例,实际上要实现蚁群算法的路径优化,需要更加复杂的代码实现。

粒子群算法matlab

粒子群算法matlab本文旨在介绍粒子群算法Matlab。

粒子群算法是一种全局搜索和优化技术,它的目的是通过可重复的迭代搜索来找到搜索空间中的最优解。

本文详细阐述了粒子群算法的基本原理,讨论了它的设计思想和参数设置,以及如何将粒子群算法应用于Matlab中。

最后,本文介绍了若干数值实例,来验证粒子群算法的可行性。

关键词:子群算法;Matlab;全局优化;迭代搜索1.论粒子群算法(Particle Swarm Optimization,PSO)是一种动态优化算法,它能自动识别全局最优解。

它结合了群众智慧和机器学习,是一种运用群体智能手段实现全局优化的有效方法。

由于其计算代价低廉,计算时间短,解决问题效果良好,因此得到了广泛的应用。

Matlab是屡获殊荣的数值计算软件,它能够对各类数据进行可视化分析和仿真模拟。

由于Matlab具有丰富的工具箱,可以快速准确地解决复杂的科学问题,因此它已经成为科学计算的标准软件。

本文将主要介绍如何将粒子群算法应用于Matlab中。

2.法原理粒子群算法是由Kennedy和Eberhart在1995年提出的,它也被称为Zebra算法,是建立在群体智能概念上的,由群体中全局优化算法之一。

粒子群算法以群体中的每个个体的最优位置和最优速度为基础,通过可重复的迭代搜索来找到搜索空间中的最优解。

算法的设计基本思想是:建立一组虚拟粒子,每个粒子代表一个可能的解决方案,每个粒子有一个位置和一个速度。

算法通过不断迭代,让这些粒子像鱼群一样游动,从而找到最优解。

3.法设计粒子群算法由三个参数组成:全局最优系数(cg)、社会系数(cs)和惯性权重(w)。

cg和cs是粒子群算法的两个基本系数,它们分别代表了粒子群对全局最优和社会最优的响应程度。

w是惯性权重,它代表了粒子群对历史最优位置的惯性搜索能力。

通常情况下,系数cg和w会在一定范围内不断变化,使得算法能够更快地找到最优解。

4. Matlab实现为了在Matlab中实现粒子群算法,需要对Matlab的调用进行必要的设置。

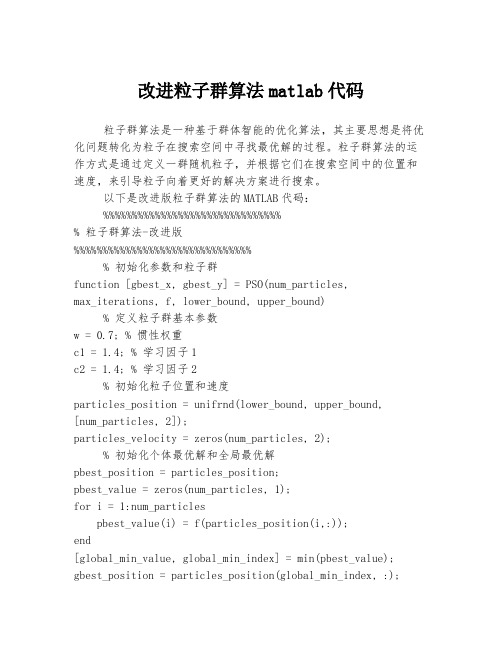

改进粒子群算法matlab代码

改进粒子群算法matlab代码粒子群算法是一种基于群体智能的优化算法,其主要思想是将优化问题转化为粒子在搜索空间中寻找最优解的过程。

粒子群算法的运作方式是通过定义一群随机粒子,并根据它们在搜索空间中的位置和速度,来引导粒子向着更好的解决方案进行搜索。

以下是改进版粒子群算法的MATLAB代码:%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% 粒子群算法-改进版%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% 初始化参数和粒子群function [gbest_x, gbest_y] = PSO(num_particles,max_iterations, f, lower_bound, upper_bound)% 定义粒子群基本参数w = 0.7; % 惯性权重c1 = 1.4; % 学习因子1c2 = 1.4; % 学习因子2% 初始化粒子位置和速度particles_position = unifrnd(lower_bound, upper_bound, [num_particles, 2]);particles_velocity = zeros(num_particles, 2);% 初始化个体最优解和全局最优解pbest_position = particles_position;pbest_value = zeros(num_particles, 1);for i = 1:num_particlespbest_value(i) = f(particles_position(i,:));end[global_min_value, global_min_index] = min(pbest_value); gbest_position = particles_position(global_min_index, :);gbest_value = global_min_value;% 迭代优化for iter = 1:max_iterationsfor i = 1:num_particles% 更新粒子速度particles_velocity(i,:) = w *particles_velocity(i,:) ...+ c1 * rand() * (pbest_position(i,:) -particles_position(i,:)) ...+ c2 * rand() * (gbest_position -particles_position(i,:));% 限制粒子速度范围particles_velocity(i,1) = max(particles_velocity(i,1), lower_bound);particles_velocity(i,1) = min(particles_velocity(i,1), upper_bound);particles_velocity(i,2) = max(particles_velocity(i,2), lower_bound);particles_velocity(i,2) = min(particles_velocity(i,2), upper_bound);% 更新粒子位置particles_position(i,:) = particles_position(i,:) + particles_velocity(i,:);% 限制粒子位置范围particles_position(i,1) = max(particles_position(i,1), lower_bound);particles_position(i,1) = min(particles_position(i,1),upper_bound);particles_position(i,2) = max(particles_position(i,2), lower_bound);particles_position(i,2) = min(particles_position(i,2), upper_bound);% 更新个体最优解temp_value = f(particles_position(i,:));if temp_value < pbest_value(i)pbest_value(i) = temp_value;pbest_position(i,:) = particles_position(i,:);endend% 更新全局最优解[temp_min_value, temp_min_index] = min(pbest_value);if temp_min_value < gbest_valuegbest_value = temp_min_value;gbest_position = pbest_position(temp_min_index,:);endend% 返回全局最优解gbest_x = gbest_position(1);gbest_y = gbest_position(2);end其中,num_particles为粒子数目,max_iterations为最大迭代次数,f为目标函数句柄,lower_bound和upper_bound为搜索空间的下界和上界。

matlab-蚁群算法-机器人路径优化问题

matlab-蚁群算法-机器人路径优化问题4.1问题描述移动机器人路径规划是机器人学的一个重要研究领域。

它要求机器人依据某个或某些优化原则(如最小能量消耗,最短行走路线,最短行走时间等),在其工作空间中找到一条从起始状态到目标状态的能避开障碍物的最优路径。

机器人路径规划问题可以建模为一个有约束的优化问题,都要完成路径规划、定位和避障等任务。

4.2算法理论蚁群算法(AntColonyAlgorithm,ACA),最初是由意大利学者DorigoM.博士于1991年首次提出,其本质是一个复杂的智能系统,且具有较强的鲁棒性,优良的分布式计算机制等优点。

该算法经过十多年的发展,已被广大的科学研究人员应用于各种问题的研究,如旅行商问题,二次规划问题,生产调度问题等。

但是算法本身性能的评价等算法理论研究方面进展较慢。

Dorigo提出了精英蚁群模型(EAS),在这一模型中信息素更新按照得到当前最优解的蚂蚁所构造的解来进行,但这样的策略往往使进化变得缓慢,并不能取得较好的效果。

次年Dorigo博士在文献[30]中给出改进模型(ACS),文中改进了转移概率模型,并且应用了全局搜索与局部搜索策略,来得进行深度搜索。

Stützle与Hoo给出了最大-最小蚂蚁系统(MA某-MINAS),所谓最大-最小即是为信息素设定上限与下限,设定上限避免搜索陷入局部最优,设定下限鼓励深度搜索。

蚂蚁作为一个生物个体其自身的能力是十分有限的,比如蚂蚁个体是没有视觉的,蚂蚁自身体积又是那么渺小,但是由这些能力有限的蚂蚁组成的蚁群却可以做出超越个体蚂蚁能力的超常行为。

蚂蚁没有视觉却可以寻觅食物,蚂蚁体积渺小而蚁群却可以搬运比它们个体大十倍甚至百倍的昆虫。

这些都说明蚂蚁群体内部的某种机制使得它们具有了群体智能,可以做到蚂蚁个体无法实现的事情。

经过生物学家的长时间观察发现,蚂蚁是通过分泌于空间中的信息素进行信息交流,进而实现群体行为的。

粒子群算法求解约束优化问题matlab

粒子群算法求解约束优化问题matlab粒子群算法(Particle Swarm Optimization, PSO)是一种基于群体智能的优化算法,旨在寻找最佳解决方案。

PSO算法源自对鸟群或鱼群等动物群体协作行为的模拟,通过不断地迭代更新粒子的位置和速度来搜索最优解。

在实际问题中,许多优化问题都包含约束条件,例如工程设计中的材料成本、生产效率、能源消耗等,或者在金融领域的资产配置、风险控制等。

而粒子群算法正是为了解决这类具有约束的优化问题而设计的。

让我们先来深入了解一下粒子群算法的原理和基本思想。

PSO算法中,每个粒子代表了一个潜在的解,这个解在解空间中的位置由粒子的位置向量表示。

为了评价这个解的好坏,需要定义一个适应度函数,它代表了解的质量。

对于约束优化问题,适应度函数不仅考虑了目标函数的值,还要考虑约束条件是否满足。

粒子不断地在解空间中搜索,通过跟踪全局最优和个体最优来调整自身的位置和速度,从而朝着更优的解前进。

在使用Matlab进行粒子群算法的求解时,我们首先需要定义目标函数和约束条件,这样才能够进行算法的优化过程。

在定义目标函数时,需要考虑问题的具体情况,包括优化的目标和约束条件的具体形式。

对于约束优化问题,一般会将问题转化为带有罚函数的无约束优化问题,或者使用遗传算法等其他优化方法进行求解。

当然,在使用粒子群算法求解约束优化问题时,也需要考虑一些参数的设置,例如粒子群的数量、最大迭代次数、惯性权重等。

这些参数的设置会对算法的收敛速度和最优解的寻找起到重要的影响。

在使用Matlab进行PSO算法求解时,需要根据具体问题进行参数的调整和优化。

粒子群算法作为一种群体智能算法,在求解约束优化问题方面具有很好的效果。

通过在解空间中不断搜索和迭代更新粒子状态,PSO算法能够有效地找到最优解。

在使用Matlab进行PSO算法求解约束优化问题时,需要注意合理地定义目标函数和约束条件,以及进行参数的调整。

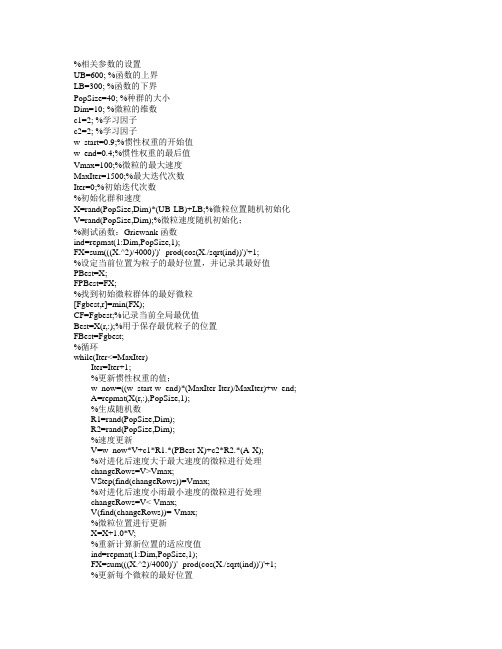

粒子群算法 matlab源代码

%相关参数的设置UB=600; %函数的上界LB=300; %函数的下界PopSize=40; %种群的大小Dim=10; %微粒的维数c1=2; %学习因子c2=2; %学习因子w_start=0.9;%惯性权重的开始值w_end=0.4;%惯性权重的最后值Vmax=100;%微粒的最大速度MaxIter=1500;%最大迭代次数Iter=0;%初始迭代次数%初始化群和速度X=rand(PopSize,Dim)*(UB-LB)+LB;%微粒位置随机初始化V=rand(PopSize,Dim);%微粒速度随机初始化;%测试函数:Griewank函数ind=repmat(1:Dim,PopSize,1);FX=sum(((X.^2)/4000)')'- prod(cos(X./sqrt(ind))')'+1;%设定当前位置为粒子的最好位置,并记录其最好值PBest=X;FPBest=FX;%找到初始微粒群体的最好微粒[Fgbest,r]=min(FX);CF=Fgbest;%记录当前全局最优值Best=X(r,:);%用于保存最优粒子的位置FBest=Fgbest;%循环while(Iter<=MaxIter)Iter=Iter+1;%更新惯性权重的值;w_now=((w_start-w_end)*(MaxIter-Iter)/MaxIter)+w_end;A=repmat(X(r,:),PopSize,1);%生成随机数R1=rand(PopSize,Dim);R2=rand(PopSize,Dim);%速度更新V=w_now*V+c1*R1.*(PBest-X)+c2*R2.*(A-X);%对进化后速度大于最大速度的微粒进行处理changeRows=V>Vmax;VStep(find(changeRows))=Vmax;%对进化后速度小雨最小速度的微粒进行处理changeRows=V<-Vmax;V(find(changeRows))=-Vmax;%微粒位置进行更新X=X+1.0*V;%重新计算新位置的适应度值ind=repmat(1:Dim,PopSize,1);FX=sum(((X.^2)/4000)')'- prod(cos(X./sqrt(ind))')'+1;%更新每个微粒的最好位置P=FX<FPBest;FPBest(find(P))=FX(find(P));%适应值更换PBest(find(P),:)=X(find(P),:)%粒子位置更换[Fgbest,g]=min(FPBest);%保存最好适应值if Fgbest<CF %如果本次适应值好于上次则保存[fBest,b]=min(FPBest);%最好适应值为fBestBest=PBest(b,:);%最好位置为BestendCF=Fgbest;%保留本次适应值准备与下次比较end %循环结束。

蚁群算法路径规划MATLAB程序

y=ROUT(s+1);

Delta_Tau(x,y)=Delta_Tau(x,y)+Q/PL_km;

Delta_Tau(y,x)=Delta_Tau(y,x)+Q/PL_km;

% passes

% Tau output updated pheromone

%% -------------------- variableinitialization-----------------------------

D=G2D(G);

N=size(D,1);%N is the peoblem scale(pixel number)

PLkm=PLkm+DD(W,to_visit);%Path length accumulation

W=to_visit;%move to the next point

for kk=1:N

if TABUkm(kk)==0

if i~=E

Eta(1,i)=1/((ix-Ex)^2+(iy-Ey)^2)^0.5;

else

Eta(1,i)=100;

end

end

ROUTES=cell(K,M);% use cell construct to load the passing route of every ant for every iteration

Len_LJD=length(LJD);%number of points can be selected

%% Colony stop condition:there is no food or go into a impass

蚁群算法matlab代码

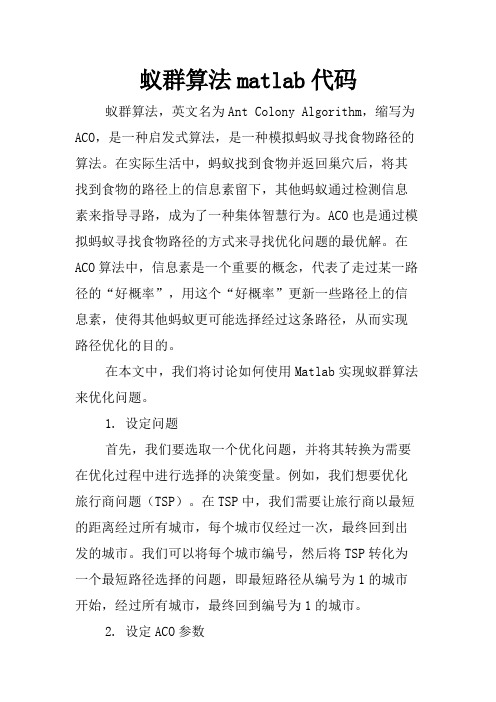

蚁群算法matlab代码蚁群算法,英文名为Ant Colony Algorithm,缩写为ACO,是一种启发式算法,是一种模拟蚂蚁寻找食物路径的算法。

在实际生活中,蚂蚁找到食物并返回巢穴后,将其找到食物的路径上的信息素留下,其他蚂蚁通过检测信息素来指导寻路,成为了一种集体智慧行为。

ACO也是通过模拟蚂蚁寻找食物路径的方式来寻找优化问题的最优解。

在ACO算法中,信息素是一个重要的概念,代表了走过某一路径的“好概率”,用这个“好概率”更新一些路径上的信息素,使得其他蚂蚁更可能选择经过这条路径,从而实现路径优化的目的。

在本文中,我们将讨论如何使用Matlab实现蚁群算法来优化问题。

1. 设定问题首先,我们要选取一个优化问题,并将其转换为需要在优化过程中进行选择的决策变量。

例如,我们想要优化旅行商问题(TSP)。

在TSP中,我们需要让旅行商以最短的距离经过所有城市,每个城市仅经过一次,最终回到出发的城市。

我们可以将每个城市编号,然后将TSP转化为一个最短路径选择的问题,即最短路径从编号为1的城市开始,经过所有城市,最终回到编号为1的城市。

2. 设定ACO参数在使用ACO优化问题时,需要设定一些参数,这些参数会影响算法的表现。

ACO算法需要设定的参数有:1.信息素含量:初始信息素的大小,即每个路径上的信息素浓度。

2.信息素挥发速度:信息素的随时间“减弱”程度。

3.信息素加成强度:蚂蚁经过路径后增加的信息素量。

4.启发式权重:用于计算启发式因子,即节点距离的贡献值。

5.蚂蚁数量:模拟蚂蚁数量,即同时寻找路径的蚂蚁个数。

6.迭代次数:模拟的迭代次数,即ACO算法运行的次数。

7.初始节点:ACO算法开始的节点。

3. 创建ACO优化函数我们可以使用Matlab来创建一个函数来实现ACO算法。

我们称其为“ACOoptimization.m”。

function best_path =ACOoptimization(city_location,iter_num,ant_num,init ial_path,alpha,beta,rho,update_flag) %ACO优化函数 %输入: %city_location: 城市坐标矩阵,格式为[x1,y1;x2,y2;...;xn,yn] %iter_num: 迭代次数 %ant_num: 蚂蚁数量 %initial_path: 起始路径,即初始解 %alpha,beta,rho: 超参数,用于调节蚂蚁选择路径的概率 %update_flag: 是否更新信息素的标志(1表示更新,0表示否) %输出: %best_path: 最优解,即最短路径%初始化信息素 pheromone = 0.01 *ones(length(city_location),length(city_location)); %初始化路径权重 path_weight =zeros(ant_num,1); %城市数量 n_cities =length(city_location);%主循环 for iter = 1:iter_num %一个迭代里所有蚂蚁都寻找一遍路径 for ant =1:ant_num %初始化蚂蚁位置current_city = initial_path; %标记是否经过了某个城市 visit_flag =zeros(1,n_cities);visit_flag(current_city) = 1; %用来存储当前路径 current_path = [current_city];%蚂蚁找东西 for i =1:n_cities-1 %计算路径概率p =calculate_probability(current_city,visit_flag,phero mone,city_location,alpha,beta); %蚂蚁选择路径 [next_city,next_index] = select_path(p);%路径更新current_path = [current_path;next_city];visit_flag(next_city) = 1;current_city = next_city;%更新路径权重path_weight(ant) = path_weight(ant) +Euclidean_distance(city_location(current_path(end-1),:),city_location(current_path(end),:));end%加入回到起点的路径权重path_weight(ant) = path_weight(ant) +Euclidean_distance(city_location(current_path(end),:),city_location(current_path(1),:));%判断是否为最优解 ifant == 1 best_path = current_path; else if path_weight(ant) <path_weight(ant-1) best_path =current_path; end end%更新信息素 ifupdate_flag == 1 pheromone =update_pheromone(pheromone,path_weight,initial_path,current_path,rho); end end end end在函数中,我们首先定义了ACOalg函数的参数,包括城市坐标矩阵,迭代次数,蚂蚁数量,初始路径,超参数alpha,beta,rho,以及是否需要更新信息素。

pso算法matlab代码

pso算法matlab代码粒子群优化算法(Particle Swarm Optimization,PSO)是一种基于群体智能的优化算法,其基本思想是通过模拟鸟群觅食行为来寻找最优解。

以下是一个简单的 MATLAB 代码示例,用于实现 PSO 算法:matlab复制代码% 定义问题参数n_particles = 100; % 粒子数量n_iterations = 100; % 迭代次数n_dimensions = 2; % 问题的维度lb = [-10-10]; % 问题的下界ub = [1010]; % 问题的上界c1 = 2; % 个体学习因子c2 = 2; % 社会学习因子% 初始化粒子群particles = lb + (ub-lb).*rand(n_particles,n_dimensions);velocities = zeros(n_particles, n_dimensions);p_best = particles;g_best = particles(1, :);g_best_fitness = inf;% 主循环for i = 1:n_iterations% 计算每个粒子的适应度值fitness = evaluate(particles); % 更新个体最优解for j = 1:n_particlesif fitness(j) < p_best(j, :)p_best(j, :) = particles(j, :); endend% 更新全局最优解for j = 1:n_particlesif fitness(j) < g_best_fitness g_best_fitness = fitness(j);g_best = particles(j, :);endend% 更新粒子速度和位置for j = 1:n_particlesr1 = rand(); % 个体学习因子随机数r2 = rand(); % 社会学习因子随机数velocities(j, :) = velocities(j, :) +c1*r1*(p_best(j, :) - particles(j, :)) + c2*r2*(g_best - particles(j, :));particles(j, :) = particles(j, :) + velocities(j, :);% 边界条件处理particles(j, :) = max(particles(j, :) , lb);particles(j, :) = min(particles(j, :) , ub);endend% 输出结果disp('全局最优解:');disp(g_best);disp('全局最优解的适应度值:');disp(g_best_fitness);其中,evaluate函数用于计算每个粒子的适应度值,需要根据具体问题进行定义。

matlab工具箱粒子群算法

MATLAB工具箱是一款强大的工具软件,可以用来进行各种科学计算和工程设计。

其中,粒子裙算法(PSO)作为一种优化算法,被广泛应用于多个领域,例如机器学习、智能优化、控制系统等。

本文将详细介绍PSO算法及其在MATLAB工具箱中的应用。

一、粒子裙算法的基本原理粒子裙算法是一种模拟自然界裙体行为的优化算法,其基本原理是模拟鸟裙或鱼裙在搜索食物或迁徙时的行为。

在PSO算法中,被优化的问题被视为一个多维空间中的搜索空间,而每个“粒子”则代表了空间中的一个候选解。

这些粒子在空间中移动,并根据自身的经验和裙体的协作信息来调整其移动方向和速度,最终找到最优解。

二、PSO算法的优化流程1.初始化种裙:在开始时,随机生成一定数量的粒子,并为每个粒子随机分配初始位置和速度。

2.评估粒子适应度:根据问题的特定目标函数,计算每个粒子在当前位置的适应度值。

3.更新粒子速度和位置:根据粒子的个体经验和裙体协作信息,更新每个粒子的速度和位置。

4.更新全局最优解:根据所有粒子的适应度值,更新全局最优解。

5.检查停止条件:重复步骤2-4,直到满足停止条件。

三、PSO算法在MATLAB工具箱中的应用在MATLAB工具箱中,PSO算法被实现为一个函数,可以通过简单的调用来进行优化问题的求解。

以下是一个简单的PSO算法示例:```matlab定义目标函数objFunc = (x) x(1)^2 + x(2)^2;设置PSO参数options = optimoptions(particleswarm, 'SwarmSize', 100,'MaxIterations', 100);调用PSO算法[x, fval] = particleswarm(objFunc, 2, [], [], options);```以上代码中,首先定义了一个目标函数objFunc,然后设置了PSO算法的参数options,最后通过调用particleswarm函数来进行优化求解。

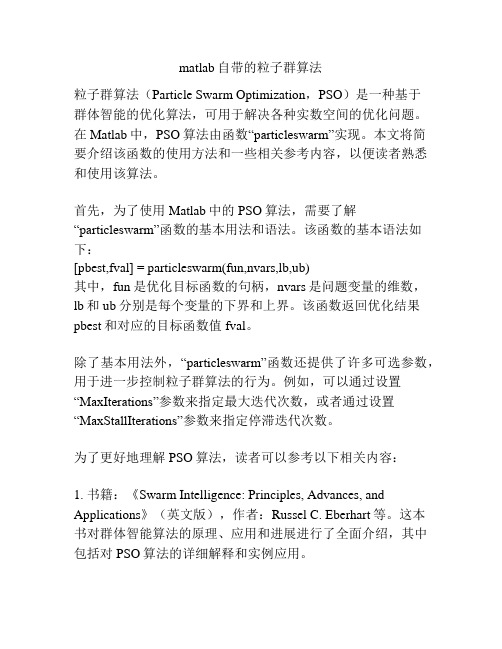

matlab自带的粒子群算法

matlab自带的粒子群算法粒子群算法(Particle Swarm Optimization,PSO)是一种基于群体智能的优化算法,可用于解决各种实数空间的优化问题。

在Matlab中,PSO算法由函数“particleswarm”实现。

本文将简要介绍该函数的使用方法和一些相关参考内容,以便读者熟悉和使用该算法。

首先,为了使用Matlab中的PSO算法,需要了解“particleswarm”函数的基本用法和语法。

该函数的基本语法如下:[pbest,fval] = particleswarm(fun,nvars,lb,ub)其中,fun是优化目标函数的句柄,nvars是问题变量的维数,lb和ub分别是每个变量的下界和上界。

该函数返回优化结果pbest和对应的目标函数值fval。

除了基本用法外,“particleswarm”函数还提供了许多可选参数,用于进一步控制粒子群算法的行为。

例如,可以通过设置“MaxIterations”参数来指定最大迭代次数,或者通过设置“MaxStallIterations”参数来指定停滞迭代次数。

为了更好地理解PSO算法,读者可以参考以下相关内容:1. 书籍:《Swarm Intelligence: Principles, Advances, and Applications》(英文版),作者:Russel C. Eberhart等。

这本书对群体智能算法的原理、应用和进展进行了全面介绍,其中包括对PSO算法的详细解释和实例应用。

2. 学术论文:《Particle swarm optimization》(2008),作者:Maurice Clerc。

这篇经典的学术论文详细阐述了PSO算法的原理、参数设置和改进策略,对理解和应用PSO算法具有重要参考价值。

3. Matlab官方文档:Matlab官方网站提供了针对“particleswarm”函数的详细文档和示例代码。

用户可以通过访问Matlab官方网站并搜索“particleswarm”来获取相关信息。

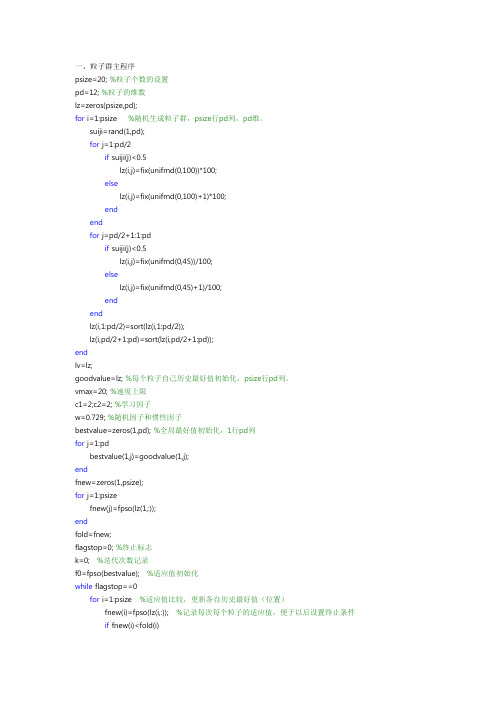

粒子群算法matlab代码

一、粒子群主程序psize=20; %粒子个数的设置pd=12; %粒子的维数lz=zeros(psize,pd);for i=1:psize %随机生成粒子群,psize行pd列,pd维。

suiji=rand(1,pd);for j=1:pd/2if suiji(j)<0.5lz(i,j)=fix(unifrnd(0,100))*100;elselz(i,j)=fix(unifrnd(0,100)+1)*100;endendfor j=pd/2+1:1:pdif suiji(j)<0.5lz(i,j)=fix(unifrnd(0,45))/100;elselz(i,j)=fix(unifrnd(0,45)+1)/100;endendlz(i,1:pd/2)=sort(lz(i,1:pd/2));lz(i,pd/2+1:pd)=sort(lz(i,pd/2+1:pd));endlv=lz;goodvalue=lz; %每个粒子自己历史最好值初始化,psize行pd列。

vmax=20; %速度上限c1=2;c2=2; %学习因子w=0.729; %随机因子和惯性因子bestvalue=zeros(1,pd); %全局最好值初始化,1行pd列for j=1:pdbestvalue(1,j)=goodvalue(1,j);endfnew=zeros(1,psize);for j=1:psizefnew(j)=fpso(lz(1,:));endfold=fnew;flagstop=0; %终止标志k=0; %迭代次数记录f0=fpso(bestvalue); %适应值初始化while flagstop==0for i=1:psize %适应值比较,更新各自历史最好值(位置)fnew(i)=fpso(lz(i,:)); %记录每次每个粒子的适应值,便于以后设置终止条件if fnew(i)<fold(i)fold(i)=fnew(i); %fold记录每个粒子的最好历史值goodvalue(i,j)=lz(i,j);endendendfor i=1:psize%每个粒子历史最好值比较,更新全局最好值f1=fold(i);if f1<f0f0=f1;for j=1:pdbestvalue(1,j)=goodvalue(i,j);endendend%*********粒子趋一点终止条件*********%flagstop0=max(abs(fold)); %比较当次的所有粒子的适应值,flagstop1=min(abs(fold)); %若它们之间差别较小,则可以停止。

蚁群优化算法原理及Matlab编程实现

蚁群优化算法原理及Matlab编程实现

蚁群算法的提出:

人工蚂蚁与真实蚂蚁的异同比较

相同点比较

不同点比较

蚁群算法的流程图

基本蚁群算法的实现步骤

(i,j)的初始化信息量τij(t) = const,其中const表示常数,且初始时刻Δτij(0) = 0。

(2)循环次数。

(3)蚂蚁的禁忌表索引号k=1。

(4)蚂蚁数目。

(5)蚂蚁个体根据状态转移概率公式计算的概率选择元素(城市)j并前进,。

其中,表示在t时刻蚂蚁k由元素(城市)i转移到元素(城市)j的状态转

重要性,反映了蚂蚁在运动过程中启发信息在蚂蚁选择路径中的受重

视程度,其值越大,则该状态转移概率越接近于贪心规则;ηij(t)为启发函数,

表达式为。

式中,d ij表示相邻两个城市之间的距离。

(6)修改禁忌表指针,即选择好之后将蚂蚁移动到新的元素(城市),并把该τij(t + n) = (1 − ρ) * τij(t) + Δτij(t)

(9)若满足结束条件,即如果循环次数,则循环结束并输出程序计算结果,

]蚁群算法的matlab源程序1.蚁群算法主程序:main.m

2.蚁群算法寻找路径程序:path.m

[编辑]蚁群算法仿真结果。

【路径规划】基于粒子群算法实现机器人栅格地图路径规划matlab源码

【路径规划】基于粒子群算法实现机器人栅格地图路径规划matlab源码1 粒子群算法1.1 研究背景粒子群算法的发展过程。

粒子群优化算法(Partical Swarm Optimization PSO),粒子群中的每一个粒子都代表一个问题的可能解,通过粒子个体的简单行为,群体内的信息交互实现问题求解的智能性。

由于PSO操作简单、收敛速度快,因此在函数优化、图像处理、大地测量等众多领域都得到了广泛的应用。

随着应用范围的扩大,PSO算法存在早熟收敛、维数灾难、易于陷入局部极值等问题需要解决,主要有以下几种发展方向。

(1)调整PSO的参数来平衡算法的全局探测和局部开采能力。

如Shi和Eberhart对PSO算法的速度项引入了惯性权重,并依据迭代进程及粒子飞行情况对惯性权重进行线性(或非线性)的动态调整,以平衡搜索的全局性和收敛速度。

2009年张玮等在对标准粒子群算法位置期望及方差进行稳定性分析的基础上,研究了加速因子对位置期望及方差的影响,得出了一组较好的加速因子取值。

(2)设计不同类型的拓扑结构,改变粒子学习模式,从而提高种群的多样性,Kennedy等人研究了不同的拓扑结构对SPSO性能的影响。

针对SPSO存在易早熟收敛,寻优精度不高的缺点,于2003年提出了一种更为明晰的粒子群算法的形式:骨干粒子群算法(Bare Bones PSO,BBPSO)。

(3)将PSO和其他优化算法(或策略)相结合,形成混合PSO算法。

如曾毅等将模式搜索算法嵌入到PSO算法中,实现了模式搜索算法的局部搜索能力与PSO算法的全局寻优能力的优势互补。

(4)采用小生境技术。

小生境是模拟生态平衡的一种仿生技术,适用于多峰函数和多目标函数的优化问题。

例如,在PSO算法中,通过构造小生境拓扑,将种群分成若干个子种群,动态地形成相对独立的搜索空间,实现对多个极值区域的同步搜索,从而可以避免算法在求解多峰函数优化问题时出现早熟收敛现象。

Parsopoulos提出一种基于“分而治之”思想的多种群PSO算法,其核心思想是将高维的目标函数分解成多个低维函数,然后每个低维的子函数由一个子粒子群进行优化,该算法对高维问题的求解提供了一个较好的思路。

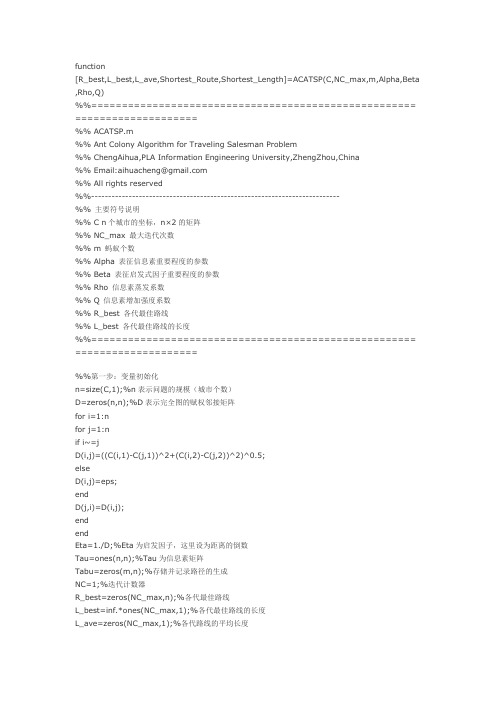

蚁群算法TSP问题matlab源代码

function[R_best,L_best,L_ave,Shortest_Route,Shortest_Length]=ACATSP(C,NC_max,m,Alpha,Beta ,Rho,Q)%%===================================================== ====================%% ACATSP.m%% Ant Colony Algorithm for Traveling Salesman Problem%% ChengAihua,PLA Information Engineering University,ZhengZhou,China%% Email:aihuacheng@%% All rights reserved%%-------------------------------------------------------------------------%% 主要符号说明%% C n个城市的坐标,n×2的矩阵%% NC_max 最大迭代次数%% m 蚂蚁个数%% Alpha 表征信息素重要程度的参数%% Beta 表征启发式因子重要程度的参数%% Rho 信息素蒸发系数%% Q 信息素增加强度系数%% R_best 各代最佳路线%% L_best 各代最佳路线的长度%%===================================================== ====================%%第一步:变量初始化n=size(C,1);%n表示问题的规模(城市个数)D=zeros(n,n);%D表示完全图的赋权邻接矩阵for i=1:nfor j=1:nif i~=jD(i,j)=((C(i,1)-C(j,1))^2+(C(i,2)-C(j,2))^2)^0.5;elseD(i,j)=eps;endD(j,i)=D(i,j);endendEta=1./D;%Eta为启发因子,这里设为距离的倒数Tau=ones(n,n);%Tau为信息素矩阵Tabu=zeros(m,n);%存储并记录路径的生成NC=1;%迭代计数器R_best=zeros(NC_max,n);%各代最佳路线L_best=inf.*ones(NC_m ax,1);%各代最佳路线的长度L_ave=zeros(NC_max,1);%各代路线的平均长度while NC<=NC_max%停止条件之一:达到最大迭代次数%%第二步:将m只蚂蚁放到n个城市上Randpos=[];for i=1:(ceil(m/n))Randpos=[Randpos,randperm(n)];endTabu(:,1)=(Randpos(1,1:m))';%%第三步:m只蚂蚁按概率函数选择下一座城市,完成各自的周游for j=2:nfor i=1:mvisited=Tabu(i,1:(j-1));%已访问的城市J=zeros(1,(n-j+1));%待访问的城市P=J;%待访问城市的选择概率分布Jc=1;for k=1:nif length(find(visited==k))==0J(Jc)=k;Jc=Jc+1;endend%下面计算待选城市的概率分布for k=1:length(J)P(k)=(Tau(visited(end),J(k))^Alpha)*(Eta(visited(end),J(k))^Beta); endP=P/(sum(P));%按概率原则选取下一个城市Pcum=cumsum(P);Select=find(Pcum>=rand);to_visit=J(Select(1));Tabu(i,j)=to_visit;endendif NC>=2Tabu(1,:)=R_best(NC-1,:);end%%第四步:记录本次迭代最佳路线L=zeros(m,1);for i=1:mR=Tabu(i,:);for j=1:(n-1)L(i)=L(i)+D(R(j),R(j+1));endL(i)=L(i)+D(R(1),R(n));endL_best(NC)=min(L);pos=find(L==L_best(NC));R_best(NC,:)=Tabu(pos(1),:);L_ave(NC)=mean(L);NC=NC+1%%第五步:更新信息素Delta_Tau=zeros(n,n);for i=1:mfor j=1:(n-1)Delta_Tau(Tabu(i,j),Tabu(i,j+1))=Delta_Tau(Tabu(i,j),Tabu(i,j+1))+Q/L(i);endDelta_Tau(Tabu(i,n),Tabu(i,1))=Delta_Tau(Tabu(i,n),Tabu(i,1))+Q/L(i);endTau=(1-Rho).*Tau+Delta_Tau;%%第六步:禁忌表清零Tabu=zeros(m,n);end%%第七步:输出结果Pos=find(L_best==min(L_best));Shortest_Route=R_best(Pos(1),:)Shortest_Length=L_best(Pos(1))subplot(1,2,1)DrawRoute(C,Shortest_Route)subplot(1,2,2)plot(L_best)hold onplot(L_ave)function DrawRoute(C,R)%%===================================================== ====================%% DrawRoute.m%% 画路线图的子函数%%-------------------------------------------------------------------------%% C Coordinate 节点坐标,由一个N×2的矩阵存储%% R Route 路线%%===================================================== ====================N=length(R);scatter(C(:,1),C(:,2));plot([C(R(1),1),C(R(N),1)],[C(R(1),2),C(R(N),2)])hold onfor ii=2:Nplot([C(R(ii-1),1),C(R(ii),1)],[C(R(ii-1),2),C(R(ii),2)]) hold onend设置初始参数如下:m=31;Alpha=1;Beta=5;Rho=0.1;NC_max=200;Q=100; 31城市坐标为:1304 23123639 13154177 22443712 13993488 15353326 15563238 12294196 10044312 7904386 5703007 19702562 17562788 14912381 16761332 6953715 16783918 21794061 23703780 22123676 25784029 28384263 29313429 19083507 23673394 26433439 32012935 32403140 35502545 23572778 28262370 2975运行后得到15602的巡游路径,路线图和收敛曲线如下:。

matlab智能算法代码

matlab智能算法代码MATLAB是一种功能强大的数值计算和科学编程软件,它提供了许多智能算法的实现。

下面是一些常见的智能算法及其在MATLAB中的代码示例:1. 遗传算法(Genetic Algorithm):MATLAB中有一个专门的工具箱,称为Global Optimization Toolbox,其中包含了遗传算法的实现。

以下是一个简单的遗传算法示例代码:matlab.% 定义目标函数。

fitness = @(x) x^2;% 设置遗传算法参数。

options = gaoptimset('Display', 'iter','PopulationSize', 50);% 运行遗传算法。

[x, fval] = ga(fitness, 1, options);2. 粒子群优化算法(Particle Swarm Optimization):MATLAB中也有一个工具箱,称为Global Optimization Toolbox,其中包含了粒子群优化算法的实现。

以下是一个简单的粒子群优化算法示例代码:matlab.% 定义目标函数。

fitness = @(x) x^2;% 设置粒子群优化算法参数。

options = optimoptions('particleswarm', 'Display','iter', 'SwarmSize', 50);% 运行粒子群优化算法。

[x, fval] = particleswarm(fitness, 1, [], [], options);3. 支持向量机(Support Vector Machine):MATLAB中有一个机器学习工具箱,称为Statistics and Machine Learning Toolbox,其中包含了支持向量机的实现。

粒子群算法matlab代码(PDF)

粒子群算法(1)----粒子群算法简介一、粒子群算法的历史粒子群算法源于复杂适应系统(Complex Adaptive System,CAS)。

CAS理论于1994年正式提出,CAS中的成员称为主体。

比如研究鸟群系统,每个鸟在这个系统中就称为主体。

主体有适应性,它能够与环境及其他的主体进行交流,并且根据交流的过程“学习”或“积累经验”改变自身结构与行为。

整个系统的演变或进化包括:新层次的产生(小鸟的出生);分化和多样性的出现(鸟群中的鸟分成许多小的群);新的主题的出现(鸟寻找食物过程中,不断发现新的食物)。

所以CAS系统中的主体具有4个基本特点(这些特点是粒子群算法发展变化的依据):首先,主体是主动的、活动的。

主体与环境及其他主体是相互影响、相互作用的,这种影响是系统发展变化的主要动力。

环境的影响是宏观的,主体之间的影响是微观的,宏观与微观要有机结合。

最后,整个系统可能还要受一些随机因素的影响。

粒子群算法就是对一个CAS系统---鸟群社会系统的研究得出的。

粒子群算法(Particle Swarm Optimization,PSO)最早是由Eberhart和Kennedy于1995年提出,它的基本概念源于对鸟群觅食行为的研究。

设想这样一个场景:一群鸟在随机搜寻食物,在这个区域里只有一块食物,所有的鸟都不知道食物在哪里,但是它们知道当前的位置离食物还有多远。

那么找到食物的最优策略是什么呢?最简单有效的就是搜寻目前离食物最近的鸟的周围区域。

PSO算法就从这种生物种群行为特性中得到启发并用于求解优化问题。

在PSO中,每个优化问题的潜在解都可以想象成d维搜索空间上的一个点,我们称之为“粒子”(Particle),所有的粒子都有一个被目标函数决定的适应值(Fitness Value),每个粒子还有一个速度决定他们飞翔的方向和距离,然后粒子们就追随当前的最优粒子在解空间中搜索。

Reynolds对鸟群飞行的研究发现。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

c1=round(rand*(n-2))+1;

c2=round(rand*(n-2))+1;

end

chb1=min(c1,c2);

chb2=max(c1,c2);

ylabel('km','fontsize',12)

%ylim([min(cityCoor(:,2))-1 max(cityCoor(:,2))+1])

grid on

%% 计算城市间距离

n=size(cityCoor,1); %城市数目

cityDist=zeros(n,n); %城市距离矩阵

%^初始化粒子位置

for i=1:indiNumber

individual(i,:)=randperm(n);

end

%% 计算种群适应度

indiFit=fitness(individual,cityCoor,cityDist);

[value,index]=min(indiFit);

粒子群算法和蚁群算法优化路径问题程序源代码---以旅行商问题(TSP)为例

代码用MATLAB编写,两种算法分开编写,读者可以混合编写!

一、

%% 该文件演示基于TSP-PSO(粒子群)算法

clc;clear

%% 下载数据

data=load('pr76.txt');

cityCoor=[data(:,2) data(:,3)];%城市坐标矩阵

grid on

figure

hold on

plot([cityCoor(tourGbest(1),1),cityCoor(tourGbest(n),1)],[cityCoor(tourGbest(1),2),...

cityCoor(tourGbest(n),2)],'ms-','LineWidth',2,'MarkerEdgeColor','k','MarkerFaceColor','g')

cros=tourGbest(chb1:chb2);

ncros=size(cros,2);

%删除与交叉区域相同元素

for j=1:ncros

for k=1:n

if xnew1(i,k)==cros(j)

%更新当前最优和历史最优

for i=1:indiNumber

if indiFit(i)<recordPbest(i)

recordPbest(i)=indiFit(i);

tourPbest(i,:)=individual(i,:);

end

if indiFit(i)<recordGbest

recordGbest=indiFit(i);

tourGbest=individual(i,:);

end

end

[value,index]=min(recordPbest);

%新路径长度变短则接受

dist=0;

for j=1:n-1

dist=dist+cityDist(xnew1(i,j),xnew1(i,j+1));

end

dist=dist+cityDist(xnew1(i,1),xnew1(i,n));

recordGbest=indiFit(index); %群体最优记录

xnew1=individual;

%% 循环寻找最优路径

L_best=zeros(1,nMax);

for N=1:nMax

N

%计算适应度值

indiFit=fitness(individual,cityCoor,cityDist);

while c1==c2

c1=round(rand*(n-2))+1;

c2=round(rand*(n-2))+1;

end

chb1=min(c1,c2);

chb2=max(c1,c2);

recordGbest(N)=recordPbest(index);

%% 交叉操作

for i=1:indiNumber

% 与个体最优进行交叉

c1=unidrnd(n-1); %产生交叉位

c2=unidrnd(n-1); %产生交叉位

L_best(N)=indiFit(index);

tourGbest=individual(index,:);

end

%% 结果作图

figure

plot(L_best)

title('算法训练过程')

xlabel('迭代次数')

ylabel('适应度值')

if indiFit(i)>dist

individual(i,:)=xnew1(i,:);

end

% 与全体最优进行交叉

c1=round(rand*(n-2))+1; %产生交叉位

c2=round(rand*(n-2))+1; %产生交叉位

xnew1(i,k)=0;

for t=1:n-k

temp=xnew1(i,k+t-1);

xnew1(i,k+t-1)=xnew1(i,k+t);

xnew1(i,k+t)=temp;

end

end

end

end

%插入交叉区域

xnew1(i,n-ncros+1:n)=cros;

xnew1(i,c2)=temp;

%新路径长度变短则接受

dist=0;

for j=1:n-1

dist=dist+cityDist(xnew1(i,j),xnew1(i,j+1));

end

end

cityDist(j,i)=cityDist(i,j);

end

end

nMax=200; %进化次数

indiNumber=1000; %个体数目

individual=zeros(indiNumber,n);

dist=dist+cityDist(xnew1(i,1),xnew1(i,n));

if indiFit(i)>dist

individual(i,:)=xnew1(i,:);

end

end

[value,index]=min(indiFit);

%新路径长度变短则接受

dist=0;

for j=1:n-1

dist=dist+cityDist(xnew1(i,j),xnew1(i,j+1));

end

dist=dist+cityDist(xnew1(i,1),xnew1(i,n));

for i=1:n

for j=1:n

if i~=j

cityDist(i,j)=((cityCoor(i,1)-cityCoor(j,1))^2+...

(cityCoor(i,2)-cityCoor(j,2))^2)^0.5;

xnew1(i,k+t)=temp;

end

end

end

end

%插入交叉区域

xnew1(i,n-ncros+1:n)=cros;

cros=tourPbest(i,chb1:chb2);

ncros=size(cros,2);

%删除与交叉区域相同元素

for j=1:ncros

for k=1:n

if xnew1(i,k)==crosj) xnew1(i,k)=0;

for t=1:n-k

temp=xnew1(i,k+t-1);

xnew1(i,k+t-1)=xnew1(i,k+t);

hold on

for i=2:n

plot([cityCoor(tourGbest(i-1),1),cityCoor(tourGbest(i),1)],[cityCoor(tourGbest(i-1),2),...

cityCoor(tourGbest(i),2)],'ms-','LineWidth',2,'MarkerEdgeColor','k','MarkerFaceColor','g')

if indiFit(i)>dist

individual(i,:)=xnew1(i,:);

end

%% 变异操作

c1=round(rand*(n-1))+1; %产生变异位

c2=round(rand*(n-1))+1; %产生变异位

figure

plot(cityCoor(:,1),cityCoor(:,2),'ms','LineWidth',2,'MarkerEdgeColor','k','MarkerFaceColor','g')

legend('城市位置')

title('城市分布图','fontsize',12)

xlabel('km','fontsize',12)