共轭梯度法 MATLAB函数代码

MATLAB程序代码--bp神经网络通用代码

MATLAB程序代码--bp神经网络通用代码matlab通用神经网络代码学习了一段时间的神经网络,总结了一些经验,在这愿意和大家分享一下, 希望对大家有帮助,也希望大家可以把其他神经网络的通用代码在这一起分享感应器神经网络、线性网络、BP神经网络、径向基函数网络%通用感应器神经网络。

P=[-0.5 -0.5 0.3 -0.1 -40;-0.5 0.5 -0.5 1 50];%输入向量T=[1 1 0 0 1];%期望输出plotpv(P,T);%描绘输入点图像net=newp([-40 1;-1 50],1);%生成网络,其中参数分别为输入向量的范围和神经元感应器数量hold onlinehandle=plotpc(net.iw{1},net.b{1});net.adaptparam.passes=3;for a=1:25%训练次数[net,Y,E]=adapt(net,P,T);linehandle=plotpc(net.iw{1},net.b{1},linehandle);drawnow;end%通用newlin程序%通用线性网络进行预测time=0:0.025:5;T=sin(time*4*pi);Q=length(T);P=zeros(5,Q);%P中存储信号T的前5(可变,根据需要而定)次值,作为网络输入。

P(1,2:Q)=T(1,1:(Q-1));P(2,3:Q)=T(1,1:(Q-2));P(3,4:Q)=T(1,1:(Q-3));P(4,5:Q)=T(1,1:(Q-4));P(5,6:Q)=T(1,1:(Q-5));plot(time,T)%绘制信号T曲线xlabel('时间');ylabel('目标信号');title('待预测信号');net=newlind(P,T);%根据输入和期望输出直接生成线性网络a=sim(net,P);%网络测试figure(2)plot(time,a,time,T,'+')xlabel('时间');ylabel('输出-目标+');title('输出信号和目标信号');e=T-a;figure(3)plot(time,e)hold onplot([min(time) max(time)],[0 0],'r:')%可用plot(x,zeros(size(x)),'r:')代替hold offxlabel('时间');ylabel('误差');title('误差信号');%通用BP神经网络P=[-1 -1 2 2;0 5 0 5];t=[-1 -1 1 1];net=newff(minmax(P),[3,1],{'tansig','purelin'},'traingd');%输入参数依次为:'样本P范围',[各层神经元数目],{各层传递函数},'训练函数'%训练函数traingd--梯度下降法,有7个训练参数.%训练函数traingdm--有动量的梯度下降法,附加1个训练参数mc(动量因子,缺省为0.9)%训练函数traingda--有自适应lr的梯度下降法,附加3个训练参数:lr_inc(学习率增长比,缺省为1.05;% lr_dec(学习率下降比,缺省为0.7);max_perf_inc(表现函数增加最大比,缺省为1.04)%训练函数traingdx--有动量的梯度下降法中赋以自适应lr的方法,附加traingdm和traingda的4个附加参数%训练函数trainrp--弹性梯度下降法,可以消除输入数值很大或很小时的误差,附加4个训练参数: % delt_inc(权值变化增加量,缺省为1.2);delt_dec(权值变化减小量,缺省为0.5);% delta0(初始权值变化,缺省为0.07);deltamax(权值变化最大值,缺省为50.0)% 适合大型网络%训练函数traincgf--Fletcher-Reeves共轭梯度法;训练函数traincgp--Polak-Ribiere共轭梯度法;%训练函数traincgb--Powell-Beale共轭梯度法%共轭梯度法占用存储空间小,附加1训练参数searchFcn(一维线性搜索方法,缺省为srchcha);缺少1个训练参数lr%训练函数trainscg--量化共轭梯度法,与其他共轭梯度法相比,节约时间.适合大型网络% 附加2个训练参数:sigma(因为二次求导对权值调整的影响参数,缺省为5.0e-5);% lambda(Hessian阵不确定性调节参数,缺省为5.0e-7)% 缺少1个训练参数:lr%训练函数trainbfg--BFGS拟牛顿回退法,收敛速度快,但需要更多内存,与共轭梯度法训练参数相同,适合小网络%训练函数trainoss--一步正割的BP训练法,解决了BFGS消耗内存的问题,与共轭梯度法训练参数相同%训练函数trainlm--Levenberg-Marquardt训练法,用于内存充足的中小型网络net=init(net);net.trainparam.epochs=300; %最大训练次数(前缺省为10,自trainrp后,缺省为100)net.trainparam.lr=0.05; %学习率(缺省为0.01)net.trainparam.show=50; %限时训练迭代过程(NaN表示不显示,缺省为25)net.trainparam.goal=1e-5; %训练要求精度(缺省为0)%net.trainparam.max_fail 最大失败次数(缺省为5)%net.trainparam.min_grad 最小梯度要求(前缺省为1e-10,自trainrp后,缺省为1e-6) %net.trainparam.time 最大训练时间(缺省为inf)[net,tr]=train(net,P,t); %网络训练a=sim(net,P) %网络仿真%通用径向基函数网络——%其在逼近能力,分类能力,学习速度方面均优于BP神经网络%在径向基网络中,径向基层的散步常数是spread的选取是关键%spread越大,需要的神经元越少,但精度会相应下降,spread的缺省值为1%可以通过net=newrbe(P,T,spread)生成网络,且误差为0%可以通过net=newrb(P,T,goal,spread)生成网络,神经元由1开始增加,直到达到训练精度或神经元数目最多为止%GRNN网络,迅速生成广义回归神经网络(GRNN)P=[4 5 6];T=[1.5 3.6 6.7];net=newgrnn(P,T);%仿真验证p=4.5;v=sim(net,p)%PNN网络,概率神经网络P=[0 0 ;1 1;0 3;1 4;3 1;4 1;4 3]';Tc=[1 1 2 2 3 3 3];%将期望输出通过ind2vec()转换,并设计、验证网络T=ind2vec(Tc);net=newpnn(P,T);Y=sim(net,P);Yc=vec2ind(Y)%尝试用其他的输入向量验证网络P2=[1 4;0 1;5 2]';Y=sim(net,P2);Yc=vec2ind(Y)%应用newrb()函数构建径向基网络,对一系列数据点进行函数逼近P=-1:0.1:1;T=[-0.9602 -0.5770 -0.0729 0.3771 0.6405 0.6600 0.4609...0.1336 -0.2013 -0.4344 -0.500 -0.3930 -0.1647 -0.0988...0.3072 0.3960 0.3449 0.1816 -0.0312 -0.2189 -0.3201];%绘制训练用样本的数据点plot(P,T,'r*');title('训练样本');xlabel('输入向量P');ylabel('目标向量T');%设计一个径向基函数网络,网络有两层,隐层为径向基神经元,输出层为线性神经元%绘制隐层神经元径向基传递函数的曲线p=-3:.1:3;a=radbas(p);plot(p,a)title('径向基传递函数')xlabel('输入向量p')%隐层神经元的权值、阈值与径向基函数的位置和宽度有关,只要隐层神经元数目、权值、阈值正确,可逼近任意函数%例如a2=radbas(p-1.5);a3=radbas(p+2);a4=a+a2*1.5+a3*0.5;plot(p,a,'b',p,a2,'g',p,a3,'r',p,a4,'m--')title('径向基传递函数权值之和')xlabel('输入p');ylabel('输出a');%应用newrb()函数构建径向基网络的时候,可以预先设定均方差精度eg以及散布常数sc eg=0.02;sc=1; %其值的选取与最终网络的效果有很大关系,过小造成过适性,过大造成重叠性net=newrb(P,T,eg,sc);%网络测试plot(P,T,'*')xlabel('输入');X=-1:.01:1;Y=sim(net,X);hold onplot(X,Y);hold offlegend('目标','输出')%应用grnn进行函数逼近P=[1 2 3 4 5 6 7 8];T=[0 1 2 3 2 1 2 1];plot(P,T,'.','markersize',30)axis([0 9 -1 4])title('待逼近函数')xlabel('P')ylabel('T')%网络设计%对于离散数据点,散布常数spread选取比输入向量之间的距离稍小一些spread=0.7;net=newgrnn(P,T,spread);%网络测试A=sim(net,P);hold onoutputline=plot(P,A,'o','markersize',10,'color',[1 0 0]);title('检测网络')xlabel('P')ylabel('T和A')%应用pnn进行变量的分类P=[1 2;2 2;1 1]; %输入向量Tc=[1 2 3]; %P对应的三个期望输出%绘制出输入向量及其相对应的类别plot(P(1,:),P(2,:),'.','markersize',30)for i=1:3text(P(1,i)+0.1,P(2,i),sprintf('class %g',Tc(i)))endaxis([0 3 0 3]);title('三向量及其类别')xlabel('P(1,:)')ylabel('P(2,:)')%网络设计T=ind2vec(Tc);spread=1;net=newgrnn(P,T,speard);%网络测试A=sim(net,P);Ac=vec2ind(A);%绘制输入向量及其相应的网络输出plot(P(1,:),P(2,:),'.','markersize',30)for i=1:3text(P(1,i)+0.1,P(2,i),sprintf('class %g',Ac(i)))endaxis([0 3 0 3]);title('网络测试结果')xlabel('P(1,:)')ylabel('P(2,:)')P=[13, 0, 1.119, 1, 26.3;22, 0, 1.135, 1, 26.3;-15, 0, 0.9017, 1, 20.4;-30, 0, 0.9172, 1, 26.7;24, 0, 1.238,0.9704,28.2;3,24,1.119,1,26.3;0,52,1.089,1,26.3;0,-73,1.0889,1,26.3;1,28, 0.8748,1,26.3;-1,-39,1.1168,1,26.7;-2, 0, 1.495, 1, 26.3;0, -1, 1.438, 1, 26.3;4, 1,0.4964, 0.9021, 26.3;3, -1, 0.5533, 1.2357, 26.7;-5, 0, 1.7368, 1, 26.7;1, 0, 1.1045, 0.0202, 26.3;-2, 0, 1.1168, 1.3764, 26.7;-3, -1, 1.1655, 1.4418,27.5;3, 2, 1.0875, 0.748, 27.5;-3, 0, 1.1068, 2.2092, 26.3;4, 1, 0.9017, 1, 13.7;3, 2, 0.9017, 1, 14.9;-3, 1, 0.9172, 1, 13.7;-2, 0, 1.0198, 1.0809, 16.1;0, 1, 0.9172, 1, 13.7] T=[1, 0, 0, 0, 0 ;1, 0, 0, 0, 0 ;1, 0, 0, 0, 0 ;1, 0, 0, 0, 0 ;1, 0, 0, 0, 0; 0, 1, 0, 0, 0;0, 1, 0, 0, 0;0, 1, 0, 0, 0;0, 1, 0, 0, 0;0, 1, 0, 0, 0;0, 0, 1, 0, 0;0, 0, 1, 0, 0;0, 0, 1, 0, 0;0, 0, 1, 0, 0;0, 0, 1, 0, 0;0, 0, 0, 1, 0 ;0, 0, 0, 1, 0 ;0, 0, 0, 1, 0 ;0, 0, 0, 1, 0 ;0, 0, 0, 1, 0 ; 0, 0, 0, 0, 1;0, 0, 0, 0, 1;0, 0, 0, 0, 1;0, 0, 0, 0, 1;0, 0, 0, 0, 1 ];%期望输出plotpv(P,T);%描绘输入点图像。

matlab梯度算法

matlab梯度算法Matlab梯度算法在数学和计算机科学中,梯度是指一个多元函数在某一点上的变化率或斜率。

梯度算法是一种优化算法,用于找到函数的最小值或最大值。

在Matlab中,有多种方法可以使用梯度算法来优化函数,包括梯度下降和共轭梯度法。

本文将详细介绍Matlab中的梯度算法,并逐步讲解其原理和应用。

I. 梯度下降法梯度下降法是一种基于迭代的优化算法,通过计算函数的梯度来更新参数的值,以逐步接近函数的最小值。

在Matlab中,可以使用"gradientDescent"函数来实现梯度下降法。

1. 实现梯度下降法首先,我们需要定义一个优化目标函数,例如:f(x) = x^2 + 2x + 1。

然后,定义其梯度函数为g(x) = 2x + 2。

接下来,我们可以使用以下代码来计算梯度下降:matlab定义优化目标函数f = (x) x^2 + 2*x + 1;定义梯度函数g = (x) 2*x + 2;初始化参数x0 = 0;设置学习率和迭代次数alpha = 0.01;iterations = 100;梯度下降法for i = 1:iterationsx0 = x0 - alpha * g(x0);end打印最优解disp(['Optimal solution: ', num2str(x0)]);在这个例子中,我们使用了学习率(alpha)为0.01,迭代次数(iterations)为100。

通过不断更新参数x0的值,最终得到了最优解。

2. 梯度下降法的原理梯度下降法的核心思想是利用函数在当前点的梯度信息来更新参数的值,以便能够向着函数的最小值前进。

具体来说,算法的步骤如下:a. 初始化参数的值:选择一个初始参数的值作为起始点。

b. 计算梯度:计算函数在当前点的梯度,即求解函数关于参数的偏导数。

c. 更新参数:根据当前点的梯度和学习率,通过减去梯度的乘积来更新参数的值。

基于matlab平台的三种迭代法求解矩阵方程

数值分析第二次作业学院:电子工程学院基于matlab平台的三种迭代法求解矩阵方程组求解系数矩阵由16阶Hilbert方程组构成的线性方程组的解,其中右端项为[2877/851,3491/1431,816/409,2035/1187,2155/1423,538/395,1587/1279,573/502,947 /895,1669/1691,1589/1717,414/475,337/409,905/1158,1272/1711,173/244].要求:1)Gauss_Sedel迭代法;2)最速下降法;3)共轭梯度法;4)将结果进行分析对比。

解:根据题目要求,编写了对应算法的matlab程序,求解结果如下:(求解精度为10e-4,最大迭代次数1000)1、方程的解:如下图1所示图1 三种方法求解的结果对比图2 Gause_Sedel算法收敛特性图3 最速下降法收敛特性图3 共轭梯度法收敛特性从图中可以看到,在相同的最大迭代次数和预设求解精度条件下,共轭梯度算法仅需要4次迭代便可求出方程组的解,耗时0.000454秒,而且求出解的精度最高;Gauss_Sedel方法需要465次迭代,耗时0.006779秒,求解精度最差;最速下降法需要398次迭代,耗时0.007595秒,求解精度与共轭梯度算法差不多,因此两者求出的解也几乎相同。

从中可以得出结论,共轭梯度算法无论从求解精度还是求解速度上都优于其他两种,最速下降法在求解精度上几乎与共轭梯度算法持平,但求解速度更慢。

Gauss_Sedel方法在求解精度和速度两方面都最差。

具体的解为:Gauss_Sedel迭代法:(共需465次迭代,求解精度达到9.97e-5) X=[0.995328360833192 1.01431732497804 1.052861239300110.934006974137998 0.931493373808838 0.9665081384030661.00661848511341 1.03799789809258 1.051806903036541.06215849948572 1.04857676431223 1.028561990411131.01999170162638 0.971831831519515 0.9525261666348130.916996019179182].最速下降法:(共需398次迭代,求解精度达到9.94e-5)X=[0.998835379744322 1.01507463472900 0.9825890937201850.980191460759243 0.991245169713628 1.003780222253291.01350884374478 1.01928337905816 1.020859096651941.01930314197028 1.01444777381651 1.007040589892970.998384452250809 0.987399404644377 0.9757678149709120.963209150871750].共轭梯度法:(共需4次迭代,求解精度达到3.98e-5)X=[0.996472751179456 1.02707840189049 0.9776233734098530.973206695321590 0.986133032967607 1.001289025642341.01322158496914 1.02047386502293 1.023009050605651.02163015083975 1.01678089454399 1.009203108638740.999772406055155 0.988443827498859 0.9760941924969490.962844741655005].Matlab程序主程序:clc;clear;%% 本程序用于计算第二次数值分析作业,关于希尔伯特矩阵方程的解,用三种方法,分析并比较,也可推广至任意n维的矩阵方程%%A=hilb(16); %生成希尔伯特系数矩阵b=[2877/851;3491/1431;816/409;2035/1187;2155/1423;538/395;1587/1279;573/502;947/895;166 9/1691;1589/1717;414/475;337/409;905/1158;1272/1711;173/244]; %右端向量M=1000; %最大迭代次数err=1.0e-4; %求解精度[x,n,xx,cc,jingdu]=yakebi_diedai(A,b,err,M); % 雅克比算法求解tic;[x1,n1,xx1,cc1,jingdu1]=gauss_seidel(A,b,err,M); % gauss_seidel算法求解toc;tic;[x2,n2,xx2,jingdu2]=zuisuxiajiangfa(A,b,err,M); % 最速下降法求解toc;tic;[x3,flag,jingdu3,n3]=bicg(A,b,err); % matlab内置双共轭梯度算法求解toc;tic;[x4,xx4,n4,jingdu4]=con_grad(A,b,err,M); % 教材共轭梯度算法求解toc;%% 计算相应结果,用于作图%%num=[1:16]';jie=[num,x1,x2,x4]; % 三者的解对比% 三者的收敛情况对比num1=[1:n1]';fit1=[num1,jingdu1'];num2=[1:n2]';fit2=[num2,jingdu2'];num4=[1:n4]';fit4=[num4,jingdu4'];子函数1(Gause_Sedel算法):function [x,n,xx,cc,jingdu] = gauss_seidel(A,b,err,M)% 利用迭代方法求解矩阵方程这里是高斯赛尔得迭代方法% A 为系数矩阵b 为右端向量err为精度大小返回求解所得向量x及迭代次数% M 为最大迭代次数cc 迭代矩阵普半径jingdu 求解过程的精度n 所需迭代次数xx 存储求解过程中每次迭代产生的解for ii=1:length(b)if A(ii,ii)==0x='error';break;endendD=diag(diag(A));L=-tril(A,-1);U=-triu(A,1);B=(D-L)\U;cc=vrho(B); %迭代矩阵普半径FG=(D-L)\b;x0=zeros(length(b),1);x=B*x0+FG;k=0;xx(:,1)=x;while norm(A*x-b)>errx0=x;x=B*x0+FG;k=k+1;xx(:,k+1)=x;if k>=Mdisp('迭代次数太多可能不收敛!');break;endjingdu(k)=norm(A*x-b);endend子函数2(最速下降算法):function [x,n,xx,jingdu]=zuisuxiajiangfa(A,b,eps,M)% 利用迭代方法求解矩阵方程这里是最速下降迭代方法% A 为系数矩阵b 为右端向量err为精度大小返回求解所得向量x及迭代次数% % M 为最大迭代次数jingdu 求解过程的精度n 所需迭代次数xx 存储求解过程中每次迭代产生的解x0=zeros(length(b),1);r0=b-A*x0;t0=r0'*r0/(r0'*A*r0);x=x0+t0*r0;r=b-A*x;xx(:,1)=x;k=0;while norm(r)>epsr=r;x=x;t=r'*r/(r'*A*r);x=x+t*r;r=b-A*x;k=k+1;xx(:,k+1)=x;if k>=Mdisp('迭代次数太多可能不收敛!');break;endn=k;jingdu(k)=norm(r);endend子函31(共轭梯度法):function [x,xx,n,jingdu]=con_grad(A,b,eps,M)% 利用迭代方法求解矩阵方程这里是共轭梯度迭代方法% A 为系数矩阵b 为右端向量err为精度大小返回求解所得向量x及迭代次数% M 为最大迭代次数jingdu 求解过程的精度n 所需迭代次数xx 存储求解过程中每次迭代产生的解x0=zeros(length(b),1);r0=b-A*x0;p0=r0;% t0=r0'*r0/(r0'*A*r0);% x=x0+t0*r0;% xx(:,1)=x;k=0;x=x0;r=r0;p=p0;while norm(r)>epsx=x;r=r;p=p;afa=r'*r/(p'*A*p);x1=x+afa*p;r1=r-afa*A*p;beta=r1'*r1/(r'*r);p1=r1+beta*p;x=x1;r=r1;p=p1;k=k+1;xx(:,k)=x;if k>=Mdisp('迭代次数太多可能不收敛!');break;endn=k;jingdu(k)=norm(r);endend。

matlab解方程的函数

MATLAB解方程的函数1. 简介MATLAB是一种强大的数值计算和科学研究软件,提供了许多内置函数以解方程。

在这篇文章中,我们将详细讨论MATLAB中用于解方程的函数,以及如何使用它们来求解各种数学问题。

2. MATLAB解方程的函数列表以下是MATLAB中常用的解方程函数:1.solve:用于求解代数方程组的函数。

2.fsolve:用于求解非线性方程组的函数。

3.fminsearch:用于寻找函数的最小值的函数。

4.fminunc:用于寻找多元函数的最小值的函数。

5.linprog:用于求解线性规划问题的函数。

6.quadprog:用于求解二次规划问题的函数。

现在,让我们逐个介绍这些函数及其用法。

2.1 solve函数solve函数是MATLAB中用于求解代数方程组的函数。

它通常用于求解符号方程,但也可以用于数值方程。

以下是solve函数的基本用法:syms x y zeq1 = x + y + z == 10;eq2 = x - y - z == 2;eq3 = x^2 + y^2 + z^2 == 16;[solx, soly, solz] = solve(eq1, eq2, eq3, x, y, z);上述代码中,我们定义了三个方程eq1,eq2和eq3,然后使用solve函数求解这个方程组。

solve函数返回了方程组的解solx,soly和solz,它们分别表示方程组中变量x,y和z的解。

fsolve函数是MATLAB中用于求解非线性方程组的函数。

它使用数值方法来找到方程组的近似解。

以下是fsolve函数的基本用法:fun = @(x) [x(1)^2 + x(2)^2 - 25; x(1) - x(2)^3];x0 = [0; 0];[x, fval] = fsolve(fun, x0);上述代码中,我们定义了一个匿名函数fun,该函数表示一个非线性方程组。

然后,我们使用fsolve函数求解这个方程组。

共轭梯度法

3. 算法的 MATLAB 实现

在 MATLAB 中编程实现的共轭梯度法函数为: min GETD 功能:用共轭梯度法求解多维函数的极值。

调用格式: [ x, min f ] min GETD( f , x0, var, eps) 其中, f :目标函数;

x0 :初始点; :自变量向量; var x :目标函数取最小值时的自变量值;

(6) 若 k 1 n ,令 x(0) x( n ) ,转步骤(3) ,否则转步骤(7) ;

(7) 令 p

( k 1)

f ( x

( k 1)

) k p

(k )

, k

f ( x ( k 1) ) f ( x )

(k )

2 2

, 置 k k 1, 转步骤 (4) 。

t 0

(k ) ( k ) (4) 用 一 维 搜 索 法 求 t k , 使 得 f ( x kt p ) m i n f

( ) 5; x( k 1 ) x k( ) kt p k,转步骤

k( ) x

) 令, tk p( ,

(5) 若 f ( x

( k 1)

) ,停止,极小值点为 x ( k 1) ,否则转步骤(6) ;

1 f ( X ) d1 + x1 -x1* 2 1 =d1 + x1 -x1* 2

2

*

2

1 d1 a x1 -x1* 2

2b x1 -x1*

x -x c x -x

2

2b x1 -x1*

matlab求线性方程组的解

matlab求线性方程组的解求解线性方程分为两种方法–直接法和迭代法常见的方法一共有8种直接法Gauss消去法Cholesky分解法迭代法Jacobi迭代法Gauss-Seidel迭代法超松弛迭代法共轭梯度法Bicg迭代法Bicgstab迭代法这里我从计算代码的角度来解释一下,代码按以下顺序给出。

把方程组直接带入已知条件,就可以得到答案。

适用条件Gauss消去法:求解中小规模线性方程(阶数不过1000),一般用于求系数矩阵稠密而且没有任何特殊结构的线性方程组Cholesky分解法:对称正定方程优先使用,系数矩阵A是n 阶对称正定矩阵Jacobi迭代法非奇异线性方程组,分量的计算顺序没有关系Gauss-Seidel迭代法与Jacobi迭代法相似,但计算的分量不能改变超松弛迭代法Jacobi迭代法和Gauss-Seidel迭代法的加速版,由Gauss-Seidel迭代法改进而来,速度较快共轭梯度法需要确定松弛参数w,只有系数矩阵具有较好的性质时才可以找到最佳松弛因子。

但好处是不用确定任何参数,他是对称正定线性方程组的方法也是求解大型稀疏线性方程组最热门的方法Bicg迭代法本质是用双共轭梯度求解线性方程组的方法,对求解的方程没有正定性要求Bicgstab迭代法本质是用稳定双共轭梯度求解线性方程组的方法,对求解的方程没有正定性要求Gauss消去法第一、二个函数ltri、utri是一定要掌握的,后面的几乎每个函数都要用到ltri简单来说,当Ly=bb,L(非奇异下三角矩阵)已知求yfunction y =ltri(L,b)n=size(b,1);y=zeros(n,1);for j =1:n-1y(j)=b(j)/L(j,j);b(j+1:n)=b(j+1:n)-y(j)*L(j+1:n,j); endy(n)=b(n)/L(n,n);utri简单来说,当Ux=yy,U(非奇异上三角矩阵)已知求xfunction x =utri(U,y)n=size(y,1);x=zeros(n,1);for j = n:-1:2x(j)=y(j)/U(j,j);y(1:j-1)=y(1:j-1)-x(j)*U(1:j-1,j);endx(1)=y(1)/U(1,1);gauss算法,计算时粘贴过去就好function[L,U]=gauss(A)n=size(A,1);for k =1:n-1A(k+1:n,k)=A(k+1:n,k)/A(k,k);A(k+1:n,k+1:n)=A(k+1:n,k +1:n)-A(k+1:n,k)*A(k,k+1:n);endL=tril(A,-1)+eye(n);U=triu(A);使用例子已经知道一个线性方程组,这里我就不写出数学形式了,A是系数矩阵,直接把上面写好的函数复制过来在运算就可以。

双共轭梯度法matlab_概述及解释说明

双共轭梯度法matlab 概述及解释说明1. 引言1.1 概述引言部分将介绍“双共轭梯度法(Matlab)”,该方法是一种用于解决优化问题的迭代算法,常用于求解大规模线性方程组、最小二乘问题和非线性最优化等。

本文将全面讲解双共轭梯度法的基础知识、算法流程及其在MATLAB中的应用与实现。

1.2 文章结构本文按照以下方式组织:- 第二节将介绍双共轭梯度法的基础知识,包括梯度下降法、共轭梯度法和双共轭梯度法的简介。

- 第三节将详细阐述双共轭梯度法的算法流程及具体步骤解释,包括初始化步骤、迭代更新步骤以及收敛准则和结束条件设定。

- 第四节将以MATLAB为工具,展示双共轭梯度法在实践中的应用与实现举例。

这一部分将给出MATLAB代码编写指导原则,描述一个示例问题,并说明求解过程和结果分析。

- 最后一节是结论与展望,总结了双共轭梯度法的优点和局限性,并提供对未来可能的研究方向的展望和建议。

1.3 目的本文旨在介绍双共轭梯度法的原理、算法流程及其在MATLAB中的实际应用。

读者将通过本文了解如何使用该方法解决优化问题,并深入理解算法背后的理论基础。

同时,本文还将探讨双共轭梯度法存在的局限性,并展望未来可能的研究方向,为相关领域的研究提供参考。

2. 双共轭梯度法基础知识2.1 梯度下降法简介梯度下降法是一种优化算法,用于求解无约束问题的最小值。

其基本思想是通过沿着目标函数的负梯度方向进行迭代更新,以逐步减小目标函数值。

具体而言,对于一个可微分的目标函数f(x),初始值$x_0$被选为起点,然后通过以下公式进行迭代更新:$$x_{k+1} = x_k - \alpha_k \nabla f(x_k)$$其中$\alpha_k$是步长或学习率,$\nabla f(x_k)$表示在点$x_k$处的梯度(即函数$f(x)$在$x_k$处的导数)。

该过程将重复执行直到满足预设的终止条件。

2.2 共轭梯度法简介共轭梯度法是一种高效的迭代方法,用于解决对称正定线性系统的问题。

最新a03共轭梯度法编程汇总

a03共轭梯度法编程MK7FCCK282Z3SVMK6CZBW26Q6LZ9 MKHMNXTJJQ4S83MKMDE2RESG33HSP90 第二章 11(2)用大M法求解min w=2x1+x2-x3-x4s.t x1-x2+2x3-x4=22x1+x2-3x3+x4=6x1+x2+x3+x4=7xi≥0, i = 1, 2, 3, 4用matlab求解如下:f=[2,1,-1,-1,200,200,200];a=[1 -1 2 -1 1 0 0;2 1 -3 1 0 1 0;1 1 1 1 0 0 1];b=[2 6 7];lb=zeros(7,1);[x,fval,exitflag,output,lambda]=linprog(f,[],[],a,b,lb) Optimization terminated.运行结果如下:x =3.00000.00001.00003.00000.00000.00000.0000fval =2.0000exitflag =1output =iterations: 7algorithm: 'large-scale: interior point'cgiterations: 0message: 'Optimization terminated.'lambda =ineqlin: [0x1 double]eqlin: [3x1 double]upper: [7x1 double]lower: [7x1 double]从上述运行结果可以得出:最优解为x= ,最小值约为f*=2。

P151 第三章 26用共轭梯度算法求f(x) = (x1-1)^2+5*(x2-x1^2)^2的极小点,取初始点x0= 。

用matlab求解如下:function mg=MG()%%共轭梯度法求解习题三第26题%clc;clear;n=2;x=[2 0]';max_k=100;count_k=1;trace(1,1)=x(1);trace(2,1)=x(2);trace(3,1)=f_fun(x);k=0;g1=f_dfun(x);s=-g1;while count_k<=max_kif k==ng0=f_dfun(x);s=-g0;k=0;elser_min=fminbnd(@(t) f_fun(x+t*s),-100,100);x=x+r_min*s;g0=g1;g1=f_dfun(x);if norm(g1)<10^(-6)break;endm=(norm(g1)^2)/(norm(g0)^2);s=-g1+m*s;count_k=count_k+1;trace(1,count_k)=x(1);trace(2,count_k)=x(2);trace(3,count_k)=f_fun(x);k=k+1;endendcount_kxf=f_fun(x)function g=f_dfun(x)g(1,1)=20*x(1)^3-20*x(1)*x(2)+2*x(1)-2;g(2,1)=10*x(2)-10*x(1)^2;function f=f_fun(x)f=5*x(1)^4-10*x(1)^2*x(2)+x(1)^2-2*x(1)+1+5*x(2)^2;运行结果如下:k =59x0 =1.00001.0000f0 =从上述运行结果可以得出:最优解为x= ,最小值约为f*=0。

运筹学实验报告(F-R共轭梯度法、Wolfe简约梯度法)

一、实验目的:1、掌握求解无约束最优化问题的 F-R 共轭梯度法,以及约束最优化问题 Wolfe 简约梯度法。

2、学会用MATLAB 编程求解问题,并对以上方法的计算过程和结果进行分析。

二、实验原理与步骤: 1、F-R 共轭梯度法基本步骤是在点)(k X 处选取搜索方向)(k d , 使其与前一次的搜索方向)1(-k d关于A 共轭,即(1)()(1),0k k k d d Ad --<>=然后从点)(k X 出发,沿方向)(k d 求得)(X f 的极小值点)1(+k X ,即)(m in )()()(0)1(k d X f X f k k λλ+=>+如此下去, 得到序列{)(k X }。

不难求得0,)1()(>=<-k k Ad d的解为)()1()1()()()()1(,,k k k k k k k d Ad d d AX b XX><>-<+=--+注意到)(k d 的选取不唯一,我们可取)1(1)()()(--+-∇=k k k k d X f d β由共轭的定义0,)1()(>=<-k k Add 可得: ><><-=----)1()1()1()(1,,k k k k k Ad d Ad r β共轭梯度法的计算过程如下:第一步:取初始向量)0(X , 计算⎪⎪⎩⎪⎪⎨⎧+=><><-=-=-∇==(0)0(0)(1))0()0()0()0(0(0)(0)(0)(0)d X X ,,X )X (r d λλAd d Ad r A b f第1+k 步:计算⎪⎪⎪⎪⎪⎩⎪⎪⎪⎪⎪⎨⎧+=><><-=+=><><-=-=-∇=+------(k)0(k)1)(k )()()()()1(1(k))()1()1()1()(1(k)(k)(k)d X X ,,r ,,X )X (r λλββk k k k k k k k k k k k k Ad d Ad r d d Ad d Adr A b f2、Wolfe 简约梯度法Wolfe 基本计算步骤:第一步:取初始可行点 x 0∈X l ,给定终止误差ε>0 ,令k:=0;第二步:设 I B k是x k 的 m 个最大分量的下标集,对矩阵A 进行相应分解 A =(B k ,N k );第三步:计算 ∇f(x k)=(∇B f(x k )∇Nf(x k )) ,然后计算简约梯度r N k=−(B k −1N k )T ∇B f(x k )+∇N f(x k );第四步:构造可行下降方向 p k . 若||p k ||≤ε ,停止迭代,输出x k 。

数值分析11(共轭梯度法)

非零向量 p0, p1 ,· · · , pn-1 ∈Rn

p0, p1 ,· · · , pn-1 关于 A 共轭

11:51

p0, p1 ,· · · , pn-1 线性无关

22/41

—— 共轭 ——

更加整体地考虑搜索方向的选择, 选择一组 关于A共轭的向量: n 个向量 p0, p1 ,· · · , pn-1 共轭:

1 f ( x ) ( Ax , x ) (b, x ) 2 的极小值点 x 是线性方程组 Ax = b 的解。 证明: 设 u 是 Ax = b的解 1 Au = b f ( u) ( Au, u) 2 对任意 x∈R n , 只须证明 f (x) – f (u) ≥ 0 1 1 f ( x ) f ( u) ( Ax , x ) (b, x ) ( Au, u) 2 2

11:51

4 x12 x2 x3

4/41

预备知识 III

泰勒展式:

f ( x ) f ( x k ) f ( x k )( x x k ) f ( x k )( x x k )2 R

f ( x) f ( x )

k

f ( x k ) x1

( x1 x )

11:51

20/41

The Best of the 20th Century: Editors Name Top 10 Algorithms, SIAM News

现代迭代方法: Krylov子空间方法 共轭梯度法的关键是构造一组两两共 轭的方向(即一组线性无Байду номын сангаас向量)。巧妙的 是, 共轭方向可以由上次搜索方向和当前的 梯度方法之组合来产生。

2 4 x1 x2 x3 2 2 x12 x3 2 4 x1 x2 x3 2 4 x1 x2 x3 2 2 x12 x2

matlab共轭梯度法求解方程组

主题:matlab共轭梯度法求解方程组近年来,随着科学技术的不断发展,数学建模和计算机仿真成为科学研究和工程技术领域的重要手段。

在实际应用中,我们常常需要解决线性方程组的求解问题,而共轭梯度法作为一种高效的迭代求解方法,广泛应用于信号处理、图像处理、地球物理勘探和优化问题等领域。

本文将介绍如何利用matlab中的共轭梯度法求解线性方程组的基本原理和实际操作方法。

1. 共轭梯度法的基本原理共轭梯度法是一种迭代法,用于求解对称正定线性方程组Ax=b。

该方法的核心思想是通过一系列的迭代操作,逐步逼近方程组的解,直到满足一定的精度要求。

在每一步迭代中,共轭梯度法利用残差和方向向量的共轭性质,不断寻找最优的步长,从而实现方程组的求解。

2. matlab中共轭梯度法的基本调用方法在matlab中,调用共轭梯度法求解线性方程组非常简单。

需要将方程组的系数矩阵A和右端向量b输入到matlab中,然后利用内置函数conjugateGradient进行求解。

具体的调用方法如下:x = conjugateGradient(A, b, x0, maxIter, tol)其中,A为系数矩阵,b为右端向量,x0为初始解向量,maxIter为最大迭代次数,tol为精度要求。

调用完毕后,matlab将返回方程组的近似解x。

3. 共轭梯度法在实际工程中的应用共轭梯度法作为一种高效的求解方法,在工程技术领域得到了广泛的应用。

以图像处理为例,图像处理中经常需要解决大规模的线性方程组,而共轭梯度法能够高效地求解这类问题,提高了图像处理算法的效率和稳定性。

另外,在地球物理勘探中,共轭梯度法也被广泛应用于三维数据的快速处理和解释。

可以说,共轭梯度法在实际工程中发挥着重要的作用。

4. 共轭梯度法的优缺点分析尽管共轭梯度法具有非常高的效率和稳定性,但是该方法也存在一些缺点。

该方法只适用于对称正定的线性方程组,对于一般的线性方程组并不适用。

共轭梯度法的收敛速度受到方程条件数的影响,对于病态问题,可能收敛速度较慢。

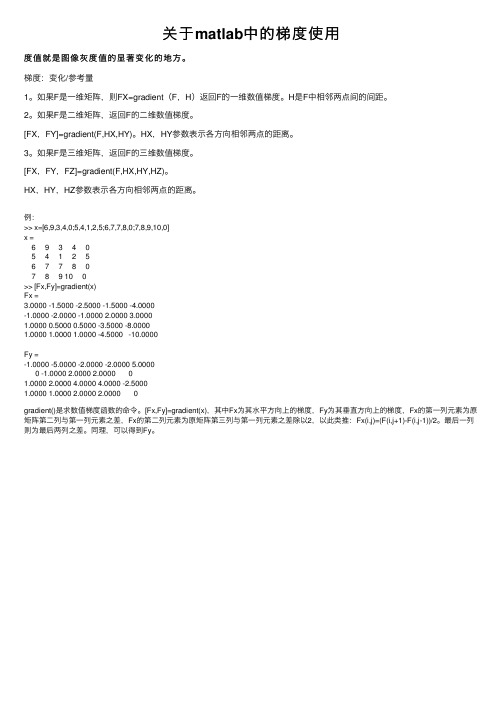

关于matlab中的梯度使用

关于matlab中的梯度使⽤度值就是图像灰度值的显著变化的地⽅。

梯度:变化/参考量1。

如果F是⼀维矩阵,则FX=gradient(F,H)返回F的⼀维数值梯度。

H是F中相邻两点间的间距。

2。

如果F是⼆维矩阵,返回F的⼆维数值梯度。

[FX,FY]=gradient(F,HX,HY)。

HX,HY参数表⽰各⽅向相邻两点的距离。

3。

如果F是三维矩阵,返回F的三维数值梯度。

[FX,FY,FZ]=gradient(F,HX,HY,HZ)。

HX,HY,HZ参数表⽰各⽅向相邻两点的距离。

例:>> x=[6,9,3,4,0;5,4,1,2,5;6,7,7,8,0;7,8,9,10,0]x =6 9 3 4 05 4 1 2 56 7 7 8 07 8 9 10 0>> [Fx,Fy]=gradient(x)Fx =3.0000 -1.5000 -2.5000 -1.5000 -4.0000-1.0000 -2.0000 -1.0000 2.0000 3.00001.0000 0.5000 0.5000 -3.5000 -8.00001.0000 1.0000 1.0000 -4.5000 -10.0000Fy =-1.0000 -5.0000 -2.0000 -2.0000 5.00000 -1.0000 2.0000 2.0000 01.00002.0000 4.0000 4.0000 -2.50001.0000 1.00002.0000 2.0000 0gradient()是求数值梯度函数的命令。

[Fx,Fy]=gradient(x),其中Fx为其⽔平⽅向上的梯度,Fy为其垂直⽅向上的梯度,Fx的第⼀列元素为原矩阵第⼆列与第⼀列元素之差,Fx的第⼆列元素为原矩阵第三列与第⼀列元素之差除以2,以此类推:Fx(i,j)=(F(i,j+1)-F(i,j-1))/2。

最后⼀列则为最后两列之差。

共轭梯度法matlab程序

共轭梯度法matlab程序共轭梯度法是一种用于求解无约束优化问题的迭代算法。

以下是一个简单的MATLAB 程序示例,用于实现共轭梯度法:matlab复制代码function[x, fval, iter] = conjugate_gradient(A, b, x0, tol,max_iter)% A: 矩阵% b: 向量% x0: 初始解% tol: 容忍度% max_iter: 最大迭代次数r = b - A*x0;p = r;x = x0;fval = A*x - b;iter = 0;while (norm(r) > tol) && (iter < max_iter)Ap = A*p;alpha = dot(p, r) / dot(p, Ap);x = x + alpha*p;r = r - alpha*Ap;if iter == 0fval_new = dot(r, r);elsebeta = dot(r, r) / dot(p, Ap);p = r + beta*p;fval_new = dot(r, r);endif fval_new < fvalfval = fval_new;enditer = iter + 1;endend该程序接受一个矩阵A、一个向量b、一个初始解x0、一个容忍度tol和一个最大迭代次数max_iter作为输入,并返回最终解x、目标函数值fval和迭代次数iter。

使用该函数时,您需要将要优化的目标函数转换为矩阵形式,并调用该函数来找到最优解。

例如,假设您要最小化一个函数f(x),可以将该函数转换为矩阵形式A*x - b,其中A是目标函数的雅可比矩阵,b是目标函数的常数项向量。

然后,您可以调用该函数来找到最优解,例如:matlab复制代码A = jacobian(f); % 计算目标函数的雅可比矩阵b = [1, 2, 3]; % 目标函数的常数项向量x0 = [0, 0, 0]; % 初始解向量tol = 1e-6; % 容忍度max_iter = 1000; % 最大迭代次数[x, fval, iter] = conjugate_gradient(A, b, x0, tol, max_iter); % 调用共轭梯度法函数求解最优解。

matlab中conj函数用法

matlab中conj函数用法Matlab中的conj()函数主要用于计算复数的共轭。

在数学上,复数由实数部分和虚数部分组成,共轭就是将复数的虚数部分乘以-1,得到的结果与原复数具有相同的实数部分但虚数部分的符号相反。

本文将详细介绍conj()函数的使用和一些实际应用示例。

一、conj()函数的语法和参数在Matlab中,使用conj()函数计算复数的共轭十分简单,其语法如下所示:conj(z)其中,z表示待计算共轭的复数。

这个函数的参数可以是一个标量、向量、矩阵或多维数组。

二、conj()函数的返回值当只有一个输入参数时,conj()函数的返回值与输入参数具有相同的维度和类型。

返回值中的每个元素都是对相应输入参数元素的共轭。

三、conj()函数的示例为了更好地理解conj()函数的使用方法,我们来看几个示例。

示例1:计算标量复数的共轭matlabz = 2 + 3i;conj(z)执行上述代码,将输出结果为2-3i。

说明在输入为标量复数时,conj()函数将返回对应的共轭值。

示例2:计算向量复数的共轭matlabz = [1+2i, 3-4i, 5+6i];conj(z)执行上述代码,将输出结果为[1-2i, 3+4i, 5-6i]。

说明在输入为向量时,conj()函数将对向量中的每个元素进行共轭运算。

示例3:计算矩阵复数的共轭matlabz = [1+2i, 3-4i; 5+6i, 7-8i];conj(z)执行上述代码,将输出结果为[1-2i, 3+4i; 5-6i, 7+8i]。

在输入为矩阵时,conj()函数对矩阵中的每个元素进行共轭运算。

示例4:计算多维数组复数的共轭matlabz = reshape(1:12 + 1j*(21:32), [2, 2, 3]);conj(z)执行上述代码,将输出一个3维数组,每个元素为输入多维数组中对应元素的共轭。

输出结果为:ans(:,:,1) =1.0000 - 21.0000i 11.0000 - 31.0000i3.0000 - 23.0000i 13.0000 - 33.0000ians(:,:,2) =2.0000 - 22.0000i 12.0000 - 32.0000i4.0000 - 24.0000i 14.0000 - 34.0000ians(:,:,3) =5.0000 - 25.0000i 9.0000 - 29.0000i7.0000 - 27.0000i 11.0000 - 31.0000i说明无论维度有多高,conj()函数都可以正确计算多维数组的共轭。

rosenbrock函数 matlab代码

文章标题:深入探讨Rosenbrock函数及其在Matlab中的实现Rosenbrock函数在数学和计算领域中扮演着重要的角色,它以其复杂的优化特性和独特的形式而闻名。

在本文中,我将从Rosenbrock函数的定义和特性入手,逐步深入探讨其在优化问题中的应用,以及在Matlab中的实现方法。

通过这篇文章,我希望读者能够全面了解Rosenbrock函数的内涵和意义,以及在Matlab中如何利用它进行实际的优化问题求解。

1. Rosenbrock函数的概念和定义Rosenbrock函数,也称为Rosenbrock's valley或Rosenbrock's banana function,是由Howard H. Rosenbrock在1960年提出的用于优化问题的非凸函数。

它的数学表达式为:\[f(x, y) = (a - x)^2 + b(y - x^2)^2\]在这个表达式中,\(a\) 和 \(b\) 是常数,通常取值为 \(a=1\) 和\(b=100\)。

Rosenbrock函数的特点是极小值点位于一个狭长的山谷,因此在优化问题中,经常被用来测试优化算法的性能。

2. Rosenbrock函数的优化特性Rosenbrock函数是一个复杂的非凸函数,经常用来测试优化算法在处理复杂优化问题时的效果。

它具有以下特性:- 局部极小值点:Rosenbrock函数有一个全局极小值点,但也有很多局部极小值点,这增加了优化问题的难度。

- 狭长的山谷:这个函数的山谷形状使得传统的梯度下降等优化算法很难找到全局极小值点,因此需要更高级的算法来解决。

- 非线性特性:Rosenbrock函数包含了二次和四次项,使得其非线性特性非常明显,对优化算法的要求较高。

3. Rosenbrock函数在优化问题中的应用由于Rosenbrock函数的复杂性和非凸特性,它经常被用来测试和评估优化算法的性能。

许多经典的优化算法,如梯度下降、牛顿法、共轭梯度法等,都会在Rosenbrock函数上进行测试,以验证其在处理复杂优化问题时的效果。

共轭梯度法实验报告

数值代数实验报告一、实验名称:用共轭梯度法解线性方程组。

二、实验目的:进一步熟悉理解掌握共轭梯度法解法思路,提高matlab 编程能力。

三、实验要求:已知线性方程矩阵,应用共轭梯度法在相关软件编程求解线性方程组的解。

四、实验原理:1.共轭梯度法:考虑线性方程组Ax b =的求解问题,其中A 是给定的n 阶对称正定矩阵,b 是给定的n 维向量,x 是待求解的n 维向量.为此,定义二次泛函()2T T x x Ax b x ϕ=-.定理1 设A 对称正定,求方程组Ax b =的解,等价于求二次泛函()x ϕ的极小值点. 定理1表明,求解线性方程组问题就转化为求二次泛函()x ϕ的极小值点问题.求解二次函数极小值问题,通常好像盲人下山那样,先给定一个初始向量0x ,确定一个下山方向0p ,沿着经过点0x 而方向为0p 的直线00x x p α=+找一个点1000x x p α=+,使得对所有实数α有()()00000x p x p ϕαϕα+≤+,即在这条直线上1x 使()x ϕ达到极小.然后从1x 出发,再确定一个下山的方向1p ,沿着直线11x x p α=+再跨出一步,即找到1α使得()x ϕ在2111x x p α=+达到极小:()()11111x p x p ϕαϕα+≤+.重复此步骤,得到一串012,,,ααα 和 012,,,p p p ,称k p 为搜索方向,k α为步长.一般情况下,先在k x 点找下山方向k p ,再在直线k k x x p α=+上确定步长k α使()(),k k k k k x p x p ϕαϕα+≤+最后求出1k k k k x x p α+=+.然而对不同的搜索方向和步长,得到各种不同的算法.由此,先考虑如何确定k α.设从k x 出发,已经选定下山方向k p .令 ()()k k f x p αϕα=+()()()2TT k k k k k k x p A x p b x p ααα=++-+()22TT k k k k k p Ap r p x ααϕ=-+,其中k k r b Ap =-.由一元函数极值存在的必要条件有()220TT k k k k f p Ap r p αα'=-=所确定的α即为所求步长k α,即 T k kk Tk kr p p Ap α=. 步长确定后,即可算出1k k k k x x p α+=+.此时,只要0T k k r p ≠,就有()()()()1k k k k k k x x x p x ϕϕϕαϕ+-=+-()2220T k k TT k kk k k k Tk kr p p Ap r p p Ap αα=-=-<即()()1k k x x ϕϕ+<.再考虑如何确定下山方向k p .易知负梯度方向是()x ϕ减小最快的方向,但简单分析就会发现负梯度方向只是局部最佳的下山方向,而从整体来看并非最佳.故采用新的方法寻求更好的下山方向——共轭梯度法. 下面给出共轭梯度法的具体计算过程:给定初始向量0x ,第一步仍选用负梯度方向为下山方向,即00p r =,于是有00010001000,,T T r r x x p r b Ax p Ap αα==+=-.对以后各步,例如第k+1步(k ≥1),下山方向不再取k r ,而是在过点由向量k r 和1k p -所张成的二维平面21{|,,}k k k x x x r p R πξηξη-==++∈内找出使函数ϕ下降最快的方向作为新的下山方向k p .考虑ϕ在2π上的限制:()1,()k k k x r p ψξηϕξη-=++11()()T k k k k k k x r p A x r p ξηξη--=++++12()T k k k b x r p ξη--++. 计算ψ关于,ξη的偏导得: ()()11112,2,T T T k k k k k kT T k k k k r Ar r Ap r r r Ap p Ap ψξηξψξηη----∂=+-∂∂=+∂其中最后一式用到了10T k k r p -=,这可由k r 的定义直接验证.令 0ψψξη∂∂==∂∂, 即知ϕ在2π内有唯一的极小值点001k k k x x r p ξη-=++,其中0ξ和0η满足 00101011,0.T T T k k k k k k T Tk k k k r Ar r Ap r r r Ap p Ap ξηξη----⎧+=⎨+=⎩由于0k r ≠必有00ξ≠,所以可取()01001k k k k p x x r p ηξξ-=-=+作为新的下山方向.显然,这是在平面2π内可得的最佳下山方向.令010k ηβξ-=,则可得1111.T k k k T k k r Ap p Ap β----=-注:这样确定的k p 满足10Tkk p Ap -=,即k p 与1k p -是相互共轭的. 总结上面的讨论,可得如下的计算公式:T k kk Tk kr p p Ap α= , 1k k k k x x p α+=+, 11k k r b Ax ++=-,1T k kk Tk kr Ap p Ap β+=-, 11k k k k p r p β++=+. 在实际计算中,常将上述公式进一步简化,从而得到一个形式上更为简单而且对称的计算公式.首先来简化1k r +的计算公式:11()k k k k k k k k r b Ax b A x p r Ap αα++=-=-+=-.因为k Ap 在计算k α是已经求出,所以计算1k r +时可以不必将1k x +代入方程计算,而是从递推关系1k k k r b Ap α+=-得到.再来简化k α和k β的计算公式.此处需要用到关系式1110,T T T k k k k k k r r r p r p +-+=== 1,2,k =.从而可导出1111,T T k k k k r r r α+++=-, ()111TT T k k k k k k k k k p Ap p r r p r αα+=-=()1111T Tk k k k k k k kr r p r r βαα--=+=.由此可得,T k k k T k k r r p Ap α=, 11.T k k k T k kr r r r β++=.从而有求解对称正定方程组的共轭梯度法算法如下:0x =初值00r b Ax =-;0k =while 0k r ≠1k k =+ if 1k = 00p r =else21122T T k k k k k r r r r β-----= 1122k k k k p r p β----=+ end11111T Tk k k k k r r p Ap α-----=111k k k k x x p α---=+111k k k k r r Ap α---=-endk x x =注:该算法每迭代一次仅需要使用系数矩阵A 做一次矩阵向量积运算. 定理2 由共轭梯度法得到的向量组{}i r 和{}i p 具有如下基本性质: (1)0T i j p r =, 0;i j k ≤<≤ (2)0T i j r r =, i j ≠,0,;i j k ≤≤ (3)0T i j p Ap =, i j ≠,0,;i j k ≤≤ (4)000{,,}{,,}(,,1)k k span r r span p p A r k κ==+,其中0000(,,1){,,,}k A r k span r Ar A r κ+=,通常称之为Krylov 子空间.下面给出共轭梯度法全局最优性定理:定理3 用共轭梯度法计算得到的近似解k x 满足()(){}00min :(,,)k x x x x A r k ϕϕκ=∈+或{}**00min :(,,)k AAx x x x x x A r k κ-=-∈+,其中Ax=*x 是方程组Ax b =的解,0(,,)A r k κ是由所定义的Krylov 子空间. 定理2表明,向量组0,,k r r 和0,,k p p 分别是Krylov 子空间0(,,1)A r k κ+的正交基和共轭正交基.由此可知,共轭梯度法最多n 步便可得到方程组的解*x .因此,理论上来讲,共轭梯度法是直接法.然而实际使用时,由于误差的出现,使k r 之间的正交性很快损失,以致于其有限步终止性已不再成立.此外,在实际应用共轭梯度法时,由于一般n 很大,以至于迭代()O n 次所耗费的计算时间就已经使用户无法接受了.因此,实际上将共轭梯度法作为一种迭代法使用,而且通常是k r 是否已经很小及迭代次数是否已经达到最大允许的迭代次数max k 来终止迭代.从而得到解对称正定线性方程组的实用共轭梯度法,其算法如下:x =初值0;k =;r b Ax =-T r r ρ=while)()max2band k kε><1k k =+if 1k = p r = else;p r p βρρβ==+ end;;T Ap p x x p ωαρωα===+ ;;T r r r r αωρρρ=-== end算法中,系数矩阵A 的作用仅仅是用来由已知向量p 产生向量Ap ω=,这不仅可以充分利用A 的稀疏性,而且对某些提供矩阵A 较为困难而由已知向量p 产生向量Ap ω=又十分方便的应用问题是十分有益的。