近邻分类法

1.简述k最近邻算法的原理、算法流程以及优缺点

1.简述k最近邻算法的原理、算法流程以及优缺点一、什么是K近邻算法k近邻算法又称knn算法、最近邻算法,是一种用于分类和回归的非参数统计方法。

在这两种情况下,输入包含特征空间中的k个最接近的训练样本,这个k可以由你自己进行设置。

在knn分类中,输出是一个分类族群。

一个对象的分类是由其邻居的“多数表决”确定的,k个最近邻居(k为正整数,通常较小),所谓的多数表决指的是,在k个最近邻中,取与输入的类别相同最多的类别,作为输入的输出类别。

简而言之,k近邻算法采用测量不同特征值之间的距离方法进行分类。

knn算法还可以运用在回归预测中,这里的运用主要是指分类。

二、k近邻算法的优缺点和运用范围优点:精度高、对异常值不敏感、无数据输入假定。

缺点:计算复杂度高、空间复杂度高。

适用范围:数值型和标称型、如手写数字的分类等。

三、k近邻算法的工作原理假定存在一个样本数据集合,并且样本集中的数据每个都存在标签,也就是说,我们知道每一个样本数据和标签的对应关系。

输入一个需要分类的标签,判断输入的数据属于那个标签,我们提取出输入数据的特征与样本集的特征进行比较,然后通过算法计算出与输入数据最相似的k个样本,取k个样本中,出现次数最多的标签,作为输入数据的标签。

四、k近邻算法的一般流程(1)收集数据:可以使用任何方法,可以去一些数据集的网站进行下载数据。

(2)准备数据:距离计算所需要的数值,最好是结构化的数据格式(3)分析数据:可以使用任何方法(4)训练算法:此步骤不适用于k近邻算法(5)测试算法:计算错误率(6)使用算法:首先需要输入样本数据和结构化的输出结构(统一数据格式),然后运行k近邻算法判定输入数据属于哪一种类别。

五、k近邻算法的实现前言:在使用python实现k近邻算法的时候,需要使用到Numpy科学计算包。

如果想要在python中使用它,可以按照anaconda,这里包含了需要python需要经常使用到的科学计算库,如何安装。

近邻分类方法及其应用

近邻分类方法及其应用

K近邻分类(K-Nearest Neighbor,KNN)是一种基于实例的学习方法,它的基本思想是:如果一个样本在特征空间中的k个最相似(即特征空间中最邻近)的样本中的大多数属于某一个类别,则该样本也属于这个类别。

KNN算法中,所选择的邻居都是已经正确分类的对象,因此KNN算法既可以用来分类也可以用来回归。

KNN算法应用比较广泛,可以用于分类问题,也可以用于回归问题,尤其是对于小样本数据集,KNN算法可以得到很好的结果。

KNN算法可以用于文本分类、图像识别、手写识别等多种机器学习任务中。

KNN算法也可以用于预测股市走势、用户购买行为等金融领域的应用中。

matlab近邻分类器的构建knn分类方法的实现

近邻分类器(k-nearest neighbor classifier,简称k-NN分类器)是一种常见的机器学习算法,可用于分类和回归问题。

它的工作原理是根据输入实例的特征向量,在训练集中找出与该实例特征最相似的k 个实例,然后使用这k个实例中的多数类别(对于分类问题)或平均值(对于回归问题)作为预测结果。

在本文中,我们将介绍如何使用Matlab编程语言来构建k-NN分类器,以及如何实现k-NN分类方法。

我们将从k-NN分类器的基本原理开始介绍,然后逐步介绍Matlab代码的实现过程,并结合实例进行演示。

1. k-NN分类器的原理及特点k-NN分类器是一种基于实例的学习方法,不同于传统的基于模型的学习方法(如决策树、支持向量机等)。

它的主要特点包括:- 非参数化:k-NN分类器没有显式的模型参数,它的预测结果完全依赖于训练集中实例的分布。

- 适用性广泛:k-NN分类器适用于各种类型的数据,包括连续型、离散型、多类别、多标签等。

- 可解释性强:k-NN分类器的预测结果可以直观地解释为与输入实例最相似的训练集实例的类别。

2. Matlab中k-NN分类器的构建在Matlab中,使用Statistics and Machine Learning Toolbox工具箱可以方便地构建k-NN分类器。

我们需要加载训练集数据和对应的类别标签,然后使用fitcknn函数来构建k-NN分类器模型。

具体的步骤如下:2.1 加载训练集数据和类别标签在Matlab中,可以使用csvread函数或readtable函数来加载训练集数据,然后将数据分为特征向量和类别标签两部分。

例如: ```matlabdata = csvread('train_data.csv');X = data(:, 1:end-1); % 特征向量Y = data(:, end); % 类别标签```2.2 构建k-NN分类器模型使用fitcknn函数可以构建k-NN分类器模型,需要指定k的取值和距离度量方法等参数。

基于K-近邻法的分类器的研究与实现(毕业论文)

基于K-近邻法的分类器的研究与实现摘要模式识别的目的就是对未知的样本,判断它所在的类别。

人类的模式识别能力使得人们可以很好的认识周围的环境并与之交流,如果计算机也具有类似的能力,那么其智能程度将会大大提高,可以发挥更大的功能,更好的为人类服务。

本文的研究课题就属于计算机模式识别领域。

分类器是模式识别系统的重要组成部分;也是机器学习的重要研究领域。

本文主要研究对象是KNN分类方法,运用K近邻法(K Nearest Neighbor)对数据进行分类,并对分类结果进行比较研究。

本文的研究工作主要探讨基于K-近邻法的分类器的实现,主要集中在K-近邻法的理论分析,算法实现。

本文首先介绍了数据挖掘的目的、意义及现状,阐述了K-近邻算法在数据挖掘中的地位和作用,然后对K-近邻法进行了详细的研究与分析,并且实现基于K-近邻法的分类器。

本设计采用SQL Server 数据库系统和c#.net开发工具进行分析研究。

关键词:模式识别;数据挖掘;机器学习; K-近邻法;分类器THE RESEARCH & ACHIEVE OF CLASSIFIER BASED ON THE K-NEAREST NEIGHBOR ALGORITHMABSTRACTThe purpose of pattern recognition is judge it in the category for the unknown sample. The pattern recognition capabilities of human canmake it a good understanding of the environment around and exchange with them, If the computer also has a similar capability, its smart levelwill greatly improve ,the level they can play a greater role and better service to humanity. This research on the subject is a kind of computer pattern recognition.Classifier is an important component part in pattern recognition system;it is also an important research in the area of machine learning.This paper mainly targets KNN classification methods, using k-nearest neighbor for data classification, and compared the results.This article research on the achieve of classifier based on the k-nearest neighbor algorithm.Mainly concentrated in the k-nearest-neighbor theoretical analysis and algorithm .First of all,I introduce the purpose、meaning and recent development of data mining.and expatiate the status and function of k- nearest neighbour in this field.then research and analysis to the k-nearest-neighbor detailed and achieve theclassifier based on k-nearest-neighbor.I design this program with SQL Server database system and c #. net development tools for analysis and study.Key words: pattern recognition; data mining, machine learning; k nearest neighbour; classifier目录1 绪论 (1)1.1 课题背景及目的 (1)1.2 国内外研究状况 (2)1.3 课题研究方法 (2)1.4 论文构成及研究内容 (3)2 分类器概述 (4)2.1 分类器概念 (4)2.2 分类器构造方法 (4)2.3 近邻分类器的分类原理 (5)3 K-近邻法的研究与分析 (8)3.1 KNN概念 (8)3.2 K-近邻法算法研究 (9)3.2.1 K-近邻算法数学模型 (9)3.2.2 K-近邻法研究方法 (9)3.2.3 KNN算法需要解决的问题 (10)4 K-近邻法的分类器的设计与编程实现 (12)4.1 开发环境的选择 (12)4.1.1 数据库系统选择 (12)4.1.2 开发语言的选择 (12)4.2 程序设计实现 (14)4.2.1 界面设计 (14)4.2.2 功能模块设计 (15)4.2.3 数据库连接 (17)4.2.4程序运行与调试 (19)4.3 程序实现结果与分析 (20)5 结论 (21)参考文献 (22)致谢 (2)3附录源程序代码 (24)附件1 开题报告 (35)附件2 英文原文及翻译 (40)1 绪论模式识别或者通俗一点讲自动分类的基本方法有两大类,一类是将特征空间划分成决策域,这就要确定判别函数或确定分界面方程。

K最近邻方法幻灯片

23

Байду номын сангаас个例子的数据样本

假定数据的样本域为水果,它们用颜色 和形状描述。

如苹果颜色为红色,形状为圆形。

24

举例:

X: 是颜色为红色,形状为圆的物体,不知道是什么东 西(不知属于哪类?)

H:X是苹果的假设 P(H|X): 在X是颜色为红色,形状为圆的物体条件

7.d={(6,1)}, dt=sqr(5),N={(2,3),(3,1), (5,0), (6,1)}, d1=sqr(5),d2=sqr(2),d3=sqr(5),d4=sqr(5).

18

贝叶斯分类方法

19

贝叶斯方法产生和发展

起源:贝叶斯统计分析起源于1763 年Bayes的 一篇论文

上世纪30年代,形成了贝叶斯学派。 上世纪50-60年代,发展成了一个很有影响的统

计学派。 上世纪80年代,贝叶斯网络应用于专家系统,成

为表示不确定性知识和推理的一种流行方法。 上世纪90年代,随着数据挖掘技术的出现和发展,

贝叶斯网络开始用于数据挖掘任务。

20

贝叶斯分类方法

贝叶斯分类是统计学分类方法。该方法可以 预测类成员关系的可能性。给一个样本,预 测属于某个类的概率。

5

K-最近邻算法

样本:用 n 维数值属性表示 每个样本为n维空间一个点 X=(x1,x2,……..xn) Y=(y1,y2,……..yn)

度量:点之间的距离(关系)表示

n

d(X,Y) (xi yi )2 i1 6

K-近邻算法

输入: T //训练数据( 带有类标记的样本) K //邻居的数目(给定k个近邻) t //将要被分类的元组

knn分类方法的原理

knn分类方法的原理

KNN(K-Nearest Neighbors)分类方法的原理是基于近邻实例的特征相似性原则。

它可以被描述为以下步骤:

1. 计算待分类样本与训练集中每个样本之间的距离。

常见的距离度量方式包括欧氏距离、曼哈顿距离、余弦距离等。

2. 选择与待分类样本距离最近的K个训练集样本,这些样本被称为K个最近邻。

3. 根据这K个最近邻的标签,进行投票或加权投票来确定待分类样本的类别。

投票策略可以是简单多数表决,也可以是加权投票,即根据距离远近对投票结果进行加权。

KNN分类方法的主要原理是基于实例间的相似性,即认为与一个实例相似的实例往往具有相似的类别标签。

KNN方法的可解释性较强,并且它不需要在训练阶段建立模型,因此它是一种懒惰学习(lazy learning)算法。

但是,KNN方法的计算复杂度较高,特别是在处理大规模数据集时。

另外,KNN方法对于维度灾难问题比较敏感,即在高维空间中往往会出现样本稀疏和距离失效的问题,因此需要进行特征选择和降维预处理。

k近邻算法回归原理

k近邻算法回归原理

k近邻算法(k-nearest neighbor,简称kNN)是一种基本的分类与回归方法。

它的基本原理是基于样本之间的距离进行分类或回归预测。

对于分类问题,k近邻算法通过统计距离待分类样本最近的k个样本中各类别的数量来决定新样本所属的类别。

在具体操作中,先计算待分类样本与训练数据集中每个样本的距离,然后取距离最近的k个样本。

待分类样本的类别就由这k个最近邻样本中数量最多的类别决定。

对于回归问题,k近邻算法通过计算距离待预测样本最近的k个样本的平均值或加权平均值来预测新样本的输出值。

同样地,先计算待预测样本与训练数据集中每个样本的距离,然后取距离最近的k个样本。

预测样本的输出值就由这k个最近邻样本的平均值或加权平均值决定。

值得注意的是,k近邻算法没有显式的训练过程,而是在预测时根据训练数据来进行实时计算。

这种算法适用于数值型和标称型数据,且精度高、对异常值不敏感、无数据输入假定。

然而,其计算复杂度和空间复杂度较高,当数据集很大时,性能可能会受到影响。

以上内容仅供参考,如需更多信息,建议查阅机器学习相关文献或咨询相关领域的研究人员。

k近邻分类法的步骤

k近邻分类法的步骤

4. 确定k值:选择一个合适的k值,表示在分类时考虑的最近邻样本的数量。k值的选择需 要根据具体问题和数据集进行调整。一般来说,较小的k值会使分类结果更敏感,而较大的k 值会使分类结果更平滑。

5. 选择最近邻:根据计算得到的距离,选择与未知样本最近的k个已知样本作为最近邻。

6. 进行投票:对于这k个最近邻样本,根据它们的类别标签进行投票。一般采用多数表决 的方式,将得票最多的类别作为未知样本的预测类别。

7. 输出结果:根据投票结果,将未知样本分类到预测的分类法是一种常用的机器学习算法,用于对未知样本进行分类。其步骤如下:

1. 数据准备:首先,需要准备一个已知类别的训练数据集,其中包含了已知样本的特征和 对应的类别标签。同时,还需要准备一个未知样本的测试数据集,用于进行分类预测。

2. 特征选择:根据问题的需求和数据的特点,选择合适的特征进行分类。特征应该具有区 分不同类别的能力,并且能够提供足够的信息用于分类。

knn计算题

knn计算题

1. 传统的kNN分类方法的距离计算有哪些?

(1)欧式距离:计算两个样本的欧氏距离,也就是样本点之间的直线距离;

(2)曼哈顿距离:计算两个样本的曼哈顿距离,也就是样本点之间的网格距离;

(3)切比雪夫距离:计算两个样本的切比雪夫距离,也就是样本点之间的曲线距离;

(4)马氏距离:计算两个样本的马氏距离,也就是样本点之间的概率距离;

(5)余弦夹角:计算两个样本的余弦夹角,也就是样本点之间的相似度距离。

2. KNN算法有哪几种?

(1)近邻分类算法:K最近邻分类算法是最简单的KNN算法,它根据训练数据集中的其他样本点的距离来预测新样本的类别;

(2)近邻回归算法:K最近邻回归算法是一种分析相近样本的算法,可根据给定样本的k个最相似的样本点,预测给定样本的值;

(3)近邻离群点检测算法:K最近邻离群点检测算法是一种检测异常点的算法,根据与给定样本的距离来判断一个数据是否为离群点。

- 1 -。

其他分类方法范文

其他分类方法范文

分类是机器学习中一项重要而广泛的任务,是将具有相同特性的样本

归类到同一个类别中的过程。

在机器学习的领域中,有许多不同的分类方

法可供使用,每个方法都有自己的优缺点。

本文将重点介绍常见的分类方法,包括朴素贝叶斯分类、K近邻分类、树回归、支持向量机和深度学习等。

朴素贝叶斯分类(Naive Bayes Classification)是基于贝叶斯定理

和特征条件独立假设的分类方法。

它假设每个特征都独立的影响分类结果,即特性之间没有相互作用。

朴素贝叶斯分类器是非常快速的,但过拟合和

极端数据值可能会影响其分类结果。

K近邻分类(K-nearest neighbor classification)是一种基于实

例的学习分类方法,它根据其他相邻的样本来预测未知样本的类别。

K近

邻分类中的K值决定了每个样本被分配到哪个类,K值越大,分类结果越

不敏感于噪声。

它的优点是简单易懂,而缺点是它有可能欠拟合或过拟合。

树回归(Tree-based regression)是一种基于决策树的分类方法,

它根据训练样本的数据特征构建一个决策树,以便能够推断未知样本的分

类结果。

决策树可以有效地捕捉复杂的空间和非线性关系,并且具有高精

度和可解释性。

但是,它有可能过拟合数据,限制它对未知样本的预测能力。

KNN算法原理与应用

12

KNN算法的sklearn实现

sklearn.neighbors模块集成了 k-近邻相关的类,KNeighborsClassifier用做kNN分类

树,KNeighborsRegressor用做kNN回归树。KNeighborsClassifier类的实现原型如下:

class sklearn.neighbors.KNeighborsClassifier(n_neighbors=5, weights='uniform',

testData = [0.2, 0.1]

Result = classify(testData, group, labels, 3)

print(Result)

5

KNN算法基本原理

6

• 运行效果:

•

左下角两个点属于B类用蓝色点标识,右上角

两个点属于A类用红色标识。取k值为3时通过

kNN算法计算,距离测试点(0.2, 0.1)最近的

algorithm='auto', leaf_size=30, p=2, metric='minkowski', metric_params=None, n_jobs=1,

**kwargs)

13

KNN算法的sklearn实现

主要参数如下:

•

•

n_neighbors:整型,默认参数值为5。邻居数k值。

量的kNN搜索。

,适合于样本数量远大于特征数

KNN算法基本原理:距离计算

7

在KNN算法中,如何计算样本间距离非常重要,下面我们介绍几种常见的

距离计算方法。

闵可夫斯基距离

闵可夫斯基距离(Minkowski Distance)是一种常见的方法,用于衡量数值点之间距离。

k近邻方法分类

k近邻方法分类

k近邻方法是一种基于实例的学习方法,它的基本思想是通过找到与待分类样本最相似的k个训练样本,来确定待分类样本的类别。

k 近邻方法分类的优点在于它不需要对数据进行任何假设,因此可以适用于各种类型的数据。

k近邻方法分类的步骤如下:

1. 计算待分类样本与训练样本之间的距离。

距离可以使用欧氏距离、曼哈顿距离等。

2. 选择k个距离最近的训练样本。

3. 统计这k个训练样本中各个类别的出现次数。

4. 将待分类样本归为出现次数最多的类别。

k近邻方法分类的优点在于它可以适用于各种类型的数据,包括连续型、离散型、有序型和无序型数据。

此外,k近邻方法分类还具有较高的准确性和可解释性。

但是,k近邻方法分类也存在一些缺点。

首先,k近邻方法分类需要计算待分类样本与所有训练样本之间的距离,因此当训练样本数量较大时,计算量会非常大。

其次,k近邻方法分类对于数据中的噪声和异常值比较敏感,因为它是基于距离的方法,而噪声和异常

值可能会导致距离计算的不准确。

为了解决这些问题,研究人员提出了一些改进的k近邻方法,如加权k近邻方法、局部加权k近邻方法、基于密度的k近邻方法等。

这些方法可以在一定程度上提高k近邻方法分类的准确性和鲁棒性。

k近邻方法分类是一种简单而有效的分类方法,它可以适用于各种类型的数据,并且具有较高的准确性和可解释性。

但是,它也存在一些缺点,需要在实际应用中进行权衡和改进。

k近邻算法对鸢尾花数据集的分类

K近邻算法(k-nearest neighbors algorithm)是一种常用的分类算法,它通过计算待分类对象与训练集中各个样本的距离,找到与待分类对象距离最近的k个样本,然后根据这k个样本的类别来确定待分类对象的类别。

K近邻算法的简单易懂的特点使其成为机器学习入门的经典算法之一。

鸢尾花数据集(Iris dataset)是机器学习领域中常用的数据集之一,由英国统计学家和生物学家Ronald Fisher于1936年提出。

数据集包含了150个样本,分为三类,每类包含50个样本,每个样本包含4个特征,分别是花萼长度、花萼宽度、花瓣长度和花瓣宽度。

鸢尾花数据集是一个经典的分类问题,很适合用于测试和验证分类算法的性能。

本文将对鸢尾花数据集使用K近邻算法进行分类,并探讨K值的选择、距离度量的方法以及算法性能评估等方面。

一、K值的选择K近邻算法中的K值是一个重要的超参数,它决定了待分类对象的类别依赖于多少个最近邻样本。

K值的选择对算法的性能有着直接的影响,一般来说,K值越小,模型对噪声的敏感度越高,容易受到局部极值的影响;K值越大,模型的鲁棒性越强,但可能会忽略掉样本的局部特征。

在实际应用中,K值的选择需要经过交叉验证等方法来确定,常用的K 值一般在3-10之间。

在本文中,我们将尝试不同的K值来对鸢尾花数据集进行分类,并比较不同K值下的分类性能。

二、距离度量的方法K近邻算法中,样本之间的距离度量是决定待分类对象类别的重要因素之一。

常用的距离度量方法有欧氏距离、曼哈顿距离、切比雪夫距离等。

对于鸢尾花数据集,我们将尝试不同的距离度量方法,比较它们在分类性能上的差异。

三、算法性能评估在对鸢尾花数据集进行分类时,我们将使用常见的性能评估指标来评估算法的性能,包括准确率(Accuracy)、精确率(Precision)、召回率(Recall)、F1值等。

这些指标将帮助我们更直观地了解K近邻算法在鸢尾花数据集上的表现,并为算法的优化提供参考。

KNN(K近邻法)算法原理

KNN(K近邻法)算法原理⼀、K近邻概述k近邻法(k-nearest neighbor, kNN)是⼀种基本分类与回归⽅法(有监督学习的⼀种),KNN(k-nearest neighbor algorithm)算法的核⼼思想是如果⼀个样本在特征空间中的k(k⼀般不超过20)个最相邻的样本中的⼤多数属于某⼀个类别,则该样本也属于这个类别,并具有这个类别上样本的特性。

简单地说,K-近邻算法采⽤测量不同特征值之间的距离⽅法进⾏分类。

通常,在分类任务中可使⽤“投票法”,即选择这k个实例中出现最多的标记类别作为预测结果;在回归任务中可使⽤“平均法”,即将这k个实例的实值输出标记的平均值作为预测结果;还可基于距离远近进⾏加权平均或加权投票,距离越近的实例权重越⼤。

k近邻法不具有显式的学习过程,事实上,它是懒惰学习(lazy learning)的著名代表,此类学习技术在训练阶段仅仅是把样本保存起来,训练时间开销为零,待收到测试样本后再进⾏处理K近邻算法的优缺点:优点:精度⾼、对异常值不敏感、⽆数据输⼊假定缺点:计算复杂度⾼、空间复杂度⾼适⽤数据范围:数值型和标称型⼆、K近邻法的三要素距离度量、k值的选择及分类决策规则是k近邻法的三个基本要素。

根据选择的距离度量(如曼哈顿距离或欧⽒距离),可计算测试实例与训练集中的每个实例点的距离,根据k值选择k个最近邻点,最后根据分类决策规则将测试实例分类。

根据欧⽒距离,选择k=4个离测试实例最近的训练实例(红圈处),再根据多数表决的分类决策规则,即这4个实例多数属于“-类”,可推断测试实例为“-类”。

k近邻法1968年由Cover和Hart提出1.距离度量特征空间中的两个实例点的距离是两个实例点相似程度的反映。

K近邻法的特征空间⼀般是n维实数向量空间Rn。

使⽤的距离是欧⽒距离,但也可以是其他距离,如更⼀般的Lp距离或Minkowski距离Minkowski距离(也叫闵⽒距离):当p=1时,得到绝对值距离,也称曼哈顿距离(Manhattan distance),在⼆维空间中可以看出,这种距离是计算两点之间的直⾓边距离,相当于城市中出租汽车沿城市街道拐直⾓前进⽽不能⾛两点连接间的最短距离,绝对值距离的特点是各特征参数以等权参与进来,所以也称等混合距离当p=2时,得到欧⼏⾥德距离(Euclidean distance),就是两点之间的直线距离(以下简称欧⽒距离)。

kneighborsclassifier 算法介绍

k-nearest neighbors(k-近邻)是一种简单而有效的监督式学习算法。

该算法在分类和回归问题上都有广泛的应用,并且易于理解和实现。

k-nearest neighbors算法的核心思想是基于输入样本的特征,来预测新样本的分类标签或者数值输出。

k-nearest neighbors算法的原理如下:1. 数据集准备:将训练数据集中的样本按照特征进行标记,这些特征用来决定样本的类别或者数值。

另外,还需要准备测试数据集,用于模型的验证和评估。

2. 计算距离:在预测过程中,计算测试样本与训练样本之间的距离。

通常使用的距离度量包括欧氏距离、曼哈顿距离、闵可夫斯基距离等。

3. 选择k值:选择一个合适的k值,该值表示在预测时将考虑最接近的k个训练样本。

选择合适的k值对算法的性能有着重要影响。

4. 预测:根据测试样本与训练样本的距离,选择最接近的k个训练样本,根据这k个训练样本的标签或数值进行预测。

通常采用投票法(对分类问题)或者平均法(对回归问题)来确定最终的预测结果。

k-nearest neighbors算法的优缺点如下:优点:1. 简单、直观:算法实现简单,易于理解和解释。

2. 适用于多类别问题:对于多分类问题,k-nearest neighbors算法表现良好。

3. 适用于非线性数据:对于非线性数据集,k-nearest neighbors算法也能够取得不错的预测效果。

缺点:1. 计算复杂度高:在大型数据集中,由于需要计算相互之间的距离,算法的计算开销比较大。

2. 对异常值敏感:k-nearest neighbors算法对异常值比较敏感,因此在使用该算法时需要注意异常值的处理。

3. 需要合适的k值:k值的选择对算法的性能有着重要的影响,选择不当会导致预测效果下降。

在使用k-nearest neighbors算法时,需要注意以下几点:1. 数据预处理:在应用k-nearest neighbors算法之前,需要对数据进行一定的预处理。

第5讲 最近邻分类器

《模式识别》讲义 2014 版:第五讲 最近邻分类器

概率最大的类作为分类结果,而最近邻分类器则是选择 x’所对应的类,所以其 分类错误率一定是大于等于最小错误率贝叶斯分类的。 设训练集中一共有 N 个样本,则最近邻分类器的平均错误率可定义为:

PN (e) PN (e | x, x) p( x | x)dxp ( x)dx

2、 k-近邻分类器的错误率

当训练集中的样本总数 N→∞时, x 的 k 个近邻都会收敛于 x。 同时若 k→∞, k-近邻分类器的决策规则也就变成了最大后验概率贝叶斯分类, 也就是最小错误 率贝叶斯分类。 当 N→∞时,可以证明 k-近邻分类器的错误率上下界为

( k 1)/..., c

,k-近邻分类器的分类决策为 x j

第 3 页 自动化学院 模式识别与智能系统研究所 高琪 gaoqi@

《模式识别》讲义 2014 版:第五讲 最近邻分类器

图 4 k=3 和 k=9 时的 k-近邻两类分类器

对于二类问题,k 一般取奇数,便于表决。

《模式识别》讲义 2014 版:第五讲 最近邻分类器

第五讲 最近邻分类器

一、 最近邻分类器

1、 最小距离分类

在统计模式识别中,可以采用最小距离分类器,它是计算待分类的样本到各 个已知类别的中心(通常是训练集中同类样本的重心)的距离,将其划分到距它 最近的类别中去,这可以看做是一种最近邻的分类规则。

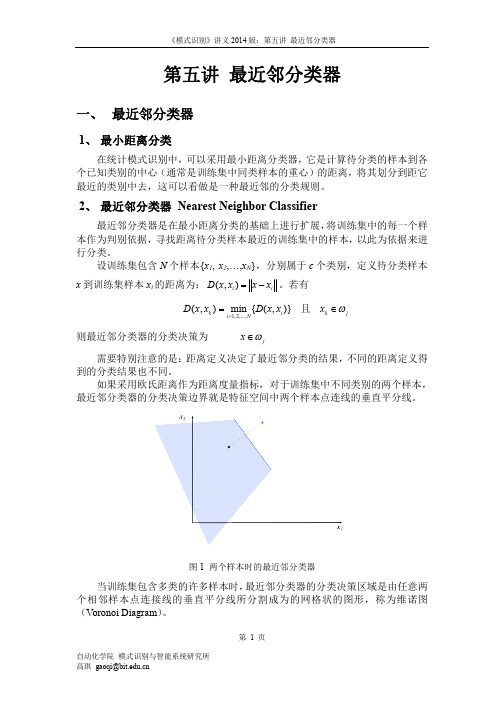

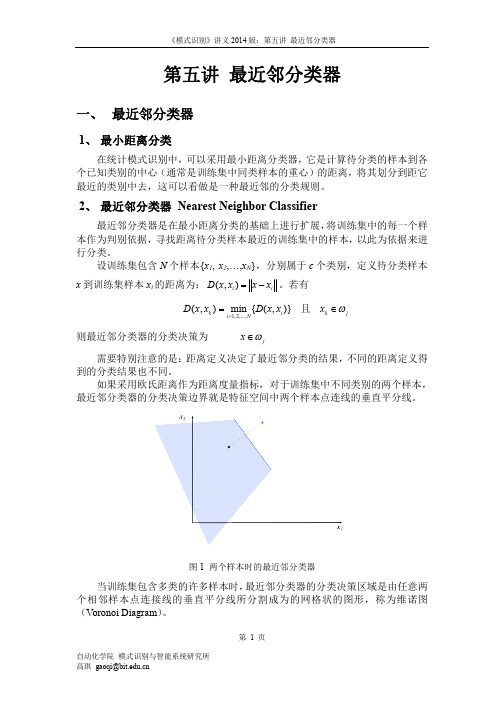

2、 最近邻分类器 Nearest Neighbor Classifier

图 1 两个样本时的最近邻分类器

当训练集包含多类的许多样本时, 最近邻分类器的分类决策区域是由任意两 个相邻样本点连接线的垂直平分线所分割成为的网格状的图形,称为维诺图 (Voronoi Diagram) 。

第5讲 最近邻分类器

Cki [( P* )i 1 (1 P* )k i ቤተ መጻሕፍቲ ባይዱ ( P* ) k i (1 P* )i 1 ]

其中 c 是训练集包含的样本类别数,P*是该分类问题对应的最小贝叶斯分 类错误率。

图 5 k-近邻两类分类器的分类错误率上下界

因此,k-近邻分类器的分类错误率下界是最小贝叶斯分类错误率 P*,上界

第 4 页 自动化学院 模式识别与智能系统研究所 高琪 gaoqi@

《模式识别》讲义 2014 版:第五讲 最近邻分类器

是 P*的一条二次曲线。当 k=1 时,k-近邻分类器就是最近邻分类器,其分类错 c * 误率上界为 P* (2 P ) 。k 越大,k-近邻分类器的分类错误率上界约逼近 P*。 c 1 当 N 有限时,同样有 k 约大,分类的错误率越低。但与此同时,x 的 k 个近 邻分布范围越广,意味着后验概率 P(i | x) 和 P(i | x) 之间差别越大,分类结果 的随机偏差也越大。因此必须折衷选择 k 的大小。 虽然 N 越大,分类错误率也会越低,但是训练集中样本个数 N 的增加,带 来的是计算复杂度和存储复杂度的迅速增加,与此同时,分类错误率仅按照 ~ (1/ N 2 ) 降低,因此代价非常巨大。

2、 k-近邻分类器的错误率

当训练集中的样本总数 N→∞时, x 的 k 个近邻都会收敛于 x。 同时若 k→∞, k-近邻分类器的决策规则也就变成了最大后验概率贝叶斯分类, 也就是最小错误 率贝叶斯分类。 当 N→∞时,可以证明 k-近邻分类器的错误率上下界为

( k 1)/ 2

P* P

设 P 是最近邻分类器平均错误率在 N→∞时的极限值,即

P lim PN (e)

N

若 P 是该分类问题对应的最小贝叶斯分类错误率,则可以证明, c * P* P P* (2 P) c 1 其中 c 是训练集包含的样本类别数。 因此,最近邻分类器的分类错误率下界是最小贝叶斯分类错误率 P*,上界 是 P*的一条二次曲线。其具体取值会落入到图 3 所示的阴影区域中。

最近邻分类方法例题

最近邻分类方法例题【原创实用版4篇】目录(篇1)1.最近邻分类方法的概念2.最近邻分类方法的例题3.例题的解答过程4.例题的结论正文(篇1)最近邻分类方法是一种基于距离度量的分类方法。

它的基本思想是将待分类的样本与已知类别的样本进行比较,找到距离最近的类别,将待分类的样本划分到该类别中。

最近邻分类方法在各种领域都有广泛应用,如数据挖掘、模式识别、机器学习等。

下面是一道最近邻分类方法的例题:假设有以下五个已知类别的样本点:A(2, 3)、B(5, 5)、C(3, 7)、D(7, 9)、E(1, 1)。

现在需要根据这些已知类别的样本点对一个待分类的样本点 P(4, 6) 进行分类。

首先,计算待分类样本点 P 与各个已知类别样本点的距离:- P 到 A 的距离为 sqrt((4-2)^2 + (6-3)^2) = sqrt(8+9) = sqrt(17)- P 到 B 的距离为 sqrt((4-5)^2 + (6-5)^2) = sqrt(1+1) = sqrt(2)- P 到 C 的距离为 sqrt((4-3)^2 + (6-7)^2) = sqrt(1+1) = sqrt(2)- P 到 D 的距离为 sqrt((4-7)^2 + (6-9)^2) = sqrt(9+9) =sqrt(18)- P 到 E 的距离为 sqrt((4-1)^2 + (6-1)^2) = sqrt(9+25) = sqrt(34)可以看出,P 到 B 和 C 的距离最近,都为 sqrt(2)。

但由于 B 在x 轴上的坐标大于 C,根据最近邻分类方法,应将 P 划分到 B 所在的类别,即 P 的类别为 B。

综上所述,通过计算待分类样本点与已知类别样本点的距离,找到距离最近的类别,将待分类样本点划分到该类别中,即可完成最近邻分类。

目录(篇2)1.最近邻分类方法的概念和原理2.最近邻分类方法的例题解析3.最近邻分类方法的优缺点4.在实际应用中的案例和前景正文(篇2)【一、最近邻分类方法的概念和原理】最近邻分类方法是一种基于距离度量的监督学习算法,其基本思想是将数据集中的每个样本划分到距离它最近的类别中。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

对“data3.m”数据,采用剪辑法、压缩法生成参考集,近似描绘其决策面,并用所有数据测试其分类效果。

1.近邻法算法:

近邻法NN(nearest neighborhood)的基本思想是:以全部训练样本作为代表点,计算测试样本与这些代表点的距离,即所有样本的距离,并以最近邻者的类别作为决策。最初的近邻法是由Cover和Hart与1968年提出的。

步骤3:结束过程。若Grabbag中所有样本在执行步骤2时没有发生转入Store的现象,或Grabbag已称空集,则算法终止,否则转入步骤2.

2.近邻法参考核心程序:

3.近邻法分类实验结果:

两分剪辑近邻法:

步骤1将原始样本随机分为两个集合:预测集T和参考集R,分别含有 和 个样本,设两个集合所含样本数量之比为 。来自预测集T合参考集R的样本分别完成考试和参考任务,相互独立。

步骤2对预测及T中的任一个样本 ,利用参考集R采用近邻对其进行分类决策,判定 所属类别为 ,而样本 自身实际所属类别为 ,如 和 不相同,则将不相容样本 从预测集T中删除,预测及T样本数量 减1。对预测集中所有样本依次进行判定,直至删除所有的不相容样本的,得到经过剪辑的考试样本集TE。

步骤1:初始化。Store是空集,原样本集存入Grabbag;从Grabbag中任意选择一样本放入Store中作为新样本集得第一个样本。样本集生成,在Grabbag中取出第i各样本用Store中的当前样本集按最近邻法。

步骤2:分类。若分类错误,则将该样本从Grabbag转入Store中,若分类正确,则将该样本放回Grabbag中。

步骤3利用经过剪辑的考试样本集TE,采用最近邻法对测试样本X做出分类决策。

重复剪辑近邻法:当采用两分剪辑近邻法,预测集T和参考集R所含的样本是由总样本随机产生的,剪辑只针对预测集T中的样本,而参考集R中的样本则经过剪辑。为进一步提高近邻法的分类性能,在样本数量足够多的情况下,可以针对所有样本重复地执行剪辑程序。

步骤1 k=1,将原始样本T随机划分为s个集合,分别为 ,其中 ,分别含有 个样本。

步骤2以对 作为参考集,采用近邻法对预测集 中的所有样本进行分类决策,删除 中所有不相容样本。 ,依次进行,且当 时,以 作为参考集。

步骤3将所有经过剪辑后留下样本组成新的总样本集 。

步骤4重复步骤1至步骤3,反复迭代剪辑,直到再没有样本被剪辑去除则停止,否则转步斯基距离;

参考集:

剪辑法:该方法通过去掉错误分类的原型达到压缩设计集的目的。如果剪辑过彻骨中k取值为1,就得到Devijver和Kittler(1982)的多重剪辑算法。如果采用留一法进行错误估计,就是Wilson的剪辑法(Wittler,1972)。进过一次迭代后,设计样本数减少且分类数不可能超过样本数。对小数据集来将,用交叉验证反法估计错误率的剪辑方法首选多重剪辑算法。其基本思想是,利用现有样本集对其自身进行剪辑,将不同类别交界出的样本以适当方法筛选,可以实现既减少样本数又提高正确识别率的双重目的。

压缩法:利用现有样本集,逐渐生成一个新的样本集,使该样本集在保留最少量样本的条件下,仍能对原有样本的全部用最近邻法正确分类,那么该样本集也就能对测试样本进行分类,并保持正常识别率。

压缩近邻法中定义两个存储器,一个用力啊存放即将生成的样本集,称为Store,另一个存储器则存放原样本集,称为Grabbag。其算法步骤为:

最近邻法:将与测试样本最近邻样本的类别作为决策的方法称为最近邻法。近邻法的错误率比较难以计算。

近邻法k NN(k Nearest NeighborClassificationRule)的基本思想是在侧视样本 的 个近邻中,按出现最多的样本类别作为x的类别,即先对x的k各近邻一一找出它们的类别,然后对x类别进行判别,即在N各训练样本中,找出x的k各近邻。