logistic回归、probit回归与poission回归

logistic regression法

logistic regression法

(原创实用版)

目录

1.线性回归概述

2.Logistic 回归法的原理

3.Logistic 回归法的应用

4.Logistic 回归法的优缺点

正文

线性回归是一种常见的统计分析方法,主要用于研究因变量和自变量之间的关系。

在线性回归中,因变量通常是连续的,而自变量可以是连续的或离散的。

然而,当因变量为二分类或多分类时,线性回归就不再适用。

这时,Logistic 回归法就被引入了。

Logistic 回归法是一种用于解决分类问题的统计方法,其原理是基于逻辑斯蒂函数。

逻辑斯蒂函数是一种 S 型函数,其取值范围在 0 到 1 之间,可以用来表示一个事件发生的概率。

在 Logistic 回归法中,我们通过将自变量输入逻辑斯蒂函数,得到一个概率值,然后根据这个概率值来判断因变量所属的类别。

Logistic 回归法广泛应用于二分类和多分类问题中,例如信用风险评估、疾病预测、市场营销等。

在我国,Logistic 回归法也被广泛应用于各种领域,如金融、医疗、教育等。

Logistic 回归法虽然具有很多优点,但也存在一些缺点。

首先,Logistic 回归法对于自变量过多或者数据量过小的情况不太适用,因为这样容易导致过拟合。

其次,Logistic 回归法的计算过程比较复杂,需要用到特种数学知识,对计算资源的要求也比较高。

总的来说,Logistic 回归法是一种重要的分类方法,具有广泛的应

用前景。

数据分析知识:数据分析中的Logistic回归分析

数据分析知识:数据分析中的Logistic回归分析Logistic回归分析是数据分析中非常重要的一种统计分析方法,它主要用于研究变量之间的关系,并且可以预测某个变量的取值概率。

在实际应用中,Logistic回归分析广泛应用于医学疾病、市场营销、社会科学等领域。

一、Logistic回归分析的原理1、概念Logistic回归分析是一种分类分析方法,可以将一个或多个自变量与一个二分类的因变量进行分析,主要用于分析变量之间的关系,并确定自变量对因变量的影响。

Logistic回归分析使用的是逻辑回归模型,该模型是将自变量与因变量的概率映射到一个范围为0-1之间的变量上,即把一个从负无穷到正无穷的数映射到0-1的范围内。

这样,我们可以用这个数值来表示某个事件发生的概率。

当这个数值大于0.5时,我们就可以判定事件发生的概率比较高,而当这个数值小于0.5时,我们就可以判定事件发生的概率比较小。

2、方法Logistic回归分析的方法有两种:一是全局最优化方法,二是局部最优化方法。

其中全局最优化方法是使用最大似然估计方法,而局部最优化方法则是使用牛顿法或梯度下降算法。

在进行Logistic回归分析之前,我们首先要对数据进行预处理,将数据进行清洗、变量选择和变量转换等操作,以便进行回归分析。

在进行回归分析时,我们需要先建立逻辑回归模型,然后进行参数估计和模型拟合,最后进行模型评估和预测。

在进行参数估计时,我们通常使用最大似然估计方法,即在估计参数时,选择最能解释样本观测数据的参数值。

在进行模型拟合时,我们需要选取一个合适的评价指标,如准确率、召回率、F1得分等。

3、评价指标在Logistic回归分析中,评价指标包括拟合度、准确性、鲁棒性、可解释性等。

其中最常用的指标是拟合度,即模型对已知数据的拟合程度,通常使用准确率、召回率、F1得分等指标进行评价。

此外,还可以使用ROC曲线、AUC值等指标评估模型的性能。

二、Logistic回归分析的应用1、医学疾病预测在医学疾病预测中,Logistic回归分析可以用来预测患某种疾病的概率,如心脏病、肺癌等。

Logistic回归

31 May 2010

华东师范大学

Logistic回归简介 Logistic回归简介 其他一些问题 条件Logistic回归; 多分类有序相应变量的Logistic回归; 多分类无序相应变量的Logistic回归; 含定性解释变量的Logistic回归.

第10页 10页

31 May 2010

华东师范大学

Logistic回归简介 Logistic回归简介

第1页

Logistic回归简介 Logistic回归简介

31 May 2010

华东师范大学

Logistic回归简介 Logistic回归简介 Logistic 回归基本概念

第2页

线性回归模型的一个局限性是要求因变量是定量变量而不 能是定性变量.但是在许多实际问题中,经常出现因变量是 定性变量(分类变量)的情况. 可用于处理分类因变量的统计分析方法有:判别分别, Probit 分析,Logistic 回归分析和对数线性模型等. 在社会科学中,应用最多的是Logistic回归分析. Logistic 回归分析根据因变量取值类别不同,又可以分为 二 值 Logistic 回 归 分 析 和 多 分 类 Logistic 回 归 分 析 , 二 值 Logistic 回归模型中因变量只能取两个值1 和0.

31 May 2010

华东师范大学

Logistic回归简介 Logistic回归简介 Logistic 回归模型的检验

第8页

似然比检验( 似然比检验(likehood ratio test) ) 通过比较包含与不包含某一个或几个待检验观察因素的两个 模型的对数似然函数来进行,其统计量为G=-2(ln L0-ln L1),样 本量较大时,G近似服从自由度为待检因素个数的χ2分布. 记分检验(score test) 记分检验( ) 以未包含待检变量的模型为基础,保留模型中参数的估计值, 并假设新增加的参数为零,计算似然函数的一阶偏导数(称有 效记分)及信息矩阵,两者相乘便得记分检验统计量S.样本量 较大时,S近似服从自由度为待检因素个数的χ2分布. 还有Wald检验等多种检验方法,此处从略.

logistic 回归算法

logistic 回归算法(最新版)目录1.引言2.Logistic 回归算法的原理3.Logistic 回归算法的应用4.Logistic 回归算法的优缺点5.结论正文1.引言Logistic 回归算法是一种常见的机器学习算法,主要用于分类问题。

它的核心思想是利用 sigmoid 函数将输入特征映射到 0 到 1 之间的概率,以此来进行分类。

Logistic 回归算法广泛应用于各种领域,如金融、医疗、社交网络等,具有重要的实际意义。

2.Logistic 回归算法的原理Logistic 回归算法的原理可以概括为以下几个步骤:(1)初始化参数:在开始训练之前,需要对模型的参数进行初始化。

通常采用随机初始化或者预先设定一组参数。

(2)计算损失函数:Logistic 回归算法的目标是最小化损失函数,即模型预测的概率与实际概率之间的差距。

损失函数可以通过对数似然损失或者交叉熵损失进行计算。

(3)梯度下降:通过计算损失函数的梯度,对模型的参数进行更新,使得损失函数不断减小。

(4)重复上述过程:对训练数据进行多轮迭代,直到模型收敛,即损失函数达到最小。

3.Logistic 回归算法的应用Logistic 回归算法广泛应用于二分类问题,如垃圾邮件分类、手写数字识别、信用风险评估等。

在这些应用中,Logistic 回归算法可以帮助我们快速准确地进行分类,提高工作效率。

4.Logistic 回归算法的优缺点Logistic 回归算法的优点有:(1)简单易懂:Logistic 回归算法的原理相对简单,容易理解和实现。

(2)适用于各种领域:Logistic 回归算法广泛应用于各种领域,具有较强的通用性。

(3)可以处理多分类问题:通过将多个 Logistic 回归模型进行组合,Logistic 回归算法可以处理多分类问题。

Logistic 回归算法的缺点有:(1)容易受到噪声影响:当输入特征中存在噪声时,Logistic 回归算法的预测结果可能会受到影响。

logistic回归模型公式

logistic回归模型公式Logistic回归为概率型非线性回归模型,是研究二分类观察结果与一些影响因素之间关系的一种多变量分析方法。

通常的问题是,研究某些因素条件下某个结果是否发生,比如医学中根据病人的一些症状来判断它是否患有某种病。

在讲解Logistic回归理论之前,我们先从LR分类器说起。

LR分类器,即Logistic Regression Classifier。

在分类情形下,经过学习后的LR分类器是一组权值,当测试样本的数据输入时,这组权值与测试数据按照线性加和得到这里是每个样本的个特征。

之后按照sigmoid函数的形式求出由于sigmoid函数的定义域为,值域为,因此最基本的LR分类器适合对两类目标进行分类。

所以Logistic回归最关键的问题就是研究如何求得这组权值。

这个问题是用极大似然估计来做的。

下面正式地来讲Logistic回归模型。

考虑具有个独立变量的向量,设条件慨率为根据观测量相对于某事件发生的概率。

那么Logistic回归模型可以表示为这里称为Logistic函数。

其中那么在条件下不发生的概率为所以事件发生与不发生的概率之比为这个比值称为事件的发生比(the odds of experiencing an event),简记为odds。

对odds取对数得到可以看出Logistic回归都是围绕一个Logistic函数来展开的。

接下来就讲如何用极大似然估计求分类器的参数。

假设有个观测样本,观测值分别为,设为给定条件下得到的概率,同样地,的概率为,所以得到一个观测值的概率为。

因为各个观测样本之间相互独立,那么它们的联合分布为各边缘分布的乘积。

得到似然函数为然后我们的目标是求出使这一似然函数的值最大的参数估计,最大似然估计就是求出参数,使得取得最大值,对函数取对数得到继续对这个分别求偏导,得到个方程,比如现在对参数求偏导,由于所以得到这样的方程一共有个,所以现在的问题转化为解这个方程形成的方程组。

logistic regression逻辑回归算法

logistic regression逻辑回归算法什么是逻辑回归算法?逻辑回归是一种广泛应用于分类问题的统计学习方法。

它的目标是通过对数几率函数来预测输出的概率值,将其转化为一个二分类问题。

逻辑回归常用于预测事件的发生概率,如判断一个邮件是否为垃圾邮件、预测一个学生是否通过考试等。

逻辑回归的基本原理是假设数据服从伯努利分布,通过对数据进行建模来预测概率。

它利用了一种被称为“逻辑函数”(或者称为“Sigmoid函数”)的数学函数。

逻辑函数将实数输入映射到0和1之间的概率输出,这样可以轻松地进行分类判断。

逻辑函数具有以下形式:P (y=1 X) = 1 / (1 + exp(-z))其中P (y=1 X)是给定观测变量X的条件下输出y为1的概率,z是一个线性组合,可以通过如下形式表示:z = β0 + β1x1 + β2x2 + ... + βnxn其中β0, β1, β2, ..., βn是设定的模型参数,x1, x2, ..., xn是输入特征变量。

如何使用逻辑回归算法进行分类问题的预测?逻辑回归算法的核心工作就是通过对训练数据的学习来确定模型的参数,然后利用这些参数来进行分类问题的预测。

步骤1:准备数据集首先,需要收集或准备一个适当的数据集。

数据集应该包括特征变量和对应的分类(响应)变量。

步骤2:参数初始化为了开始建模,需要初始化逻辑回归模型的参数。

一般来说,可以将模型参数设置为0或者一个小的随机值。

步骤3:计算成本函数(代价函数)为了评估模型的性能,需要定义一个成本函数(也称为代价函数,损失函数),该函数可以用来衡量预测结果与真实结果之间的差距。

常用的成本函数是对数损失函数,具有如下形式:J (β) = −[ylog(h(x))+(1−y)log(1−h(x))]其中,h(x)是逻辑函数的输出,y是真实的分类变量。

步骤4:计算梯度和更新参数为了最小化成本函数,使用梯度下降算法来更新模型的参数。

Logistic回归分析报告结果解读分析-logit回归解读

Logistic回归分析报告结果解读分析Logistic回归常用于分析二分类因变量(如存活与死亡、患病与未患病等)与多个自变量得关系。

比较常用得情形就是分析危险因素与就是否发生某疾病相关联。

例如,若探讨胃癌得危险因素,可以选择两组人群,一组就是胃癌组,一组就是非胃癌组,两组人群有不同得临床表现与生活方式等,因变量就为有或无胃癌,即“就是”或“否”,为二分类变量,自变量包括年龄、性别、饮食习惯、就是否幽门螺杆菌感染等。

自变量既可以就是连续变量,也可以为分类变量。

通过Logistic回归分析,就可以大致了解胃癌得危险因素。

Logistic回归与多元线性回归有很多相同之处,但最大得区别就在于她们得因变量不同。

多元线性回归得因变量为连续变量;Logistic回归得因变量为二分类变量或多分类变量,但二分类变量更常用,也更加容易解释。

1、Logistic回归得用法一般而言,Logistic回归有两大用途,首先就是寻找危险因素,如上文得例子,找出与胃癌相关得危险因素;其次就是用于预测,我们可以根据建立得Logistic 回归模型,预测在不同得自变量情况下,发生某病或某种情况得概率(包括风险评分得建立)。

2、用Logistic回归估计危险度所谓相对危险度(risk ratio,RR)就是用来描述某一因素不同状态发生疾病(或其它结局)危险程度得比值。

Logistic回归给出得OR(odds ratio)值与相对危险度类似,常用来表示相对于某一人群,另一人群发生终点事件得风险超出或减少得程度。

如不同性别得胃癌发生危险不同,通过Logistic回归可以求出危险度得具体数值,例如1、7,这样就表示,男性发生胃癌得风险就是女性得1、7倍。

这里要注意估计得方向问题,以女性作为参照,男性患胃癌得OR就是1、7。

如果以男性作为参照,算出得OR将会就是0、588(1/1、7),表示女性发生胃癌得风险就是男性得0、588倍,或者说,就是男性得58、8%。

logistic回归介绍

logistic回归介绍之三——logistic回归的应用条件logistic回归与多重线性回归一样,在应用之前也是需要分析一下资料是否可以采用logistic回归模型。

并不是说因变量是分类变量我就可以直接采用logistic回归,有些条件仍然是需要考虑的。

首要的条件应该是需要看一下自变量与因变量之间是什么样的一种关系。

多重线性回归中,要求自变量与因变量符合线性关系。

而logistic回归则不同,它要求的是自变量与logit(p)符合线性关系,所谓logit实际上就是ln(P/1-P)。

也就是说,自变量应与ln(P/1-P)呈线性关系。

当然,这种情形主要针对多分类变量和连续变量。

对于二分类变量就无所谓了,因为两点永远是一条直线。

这里举一个例子。

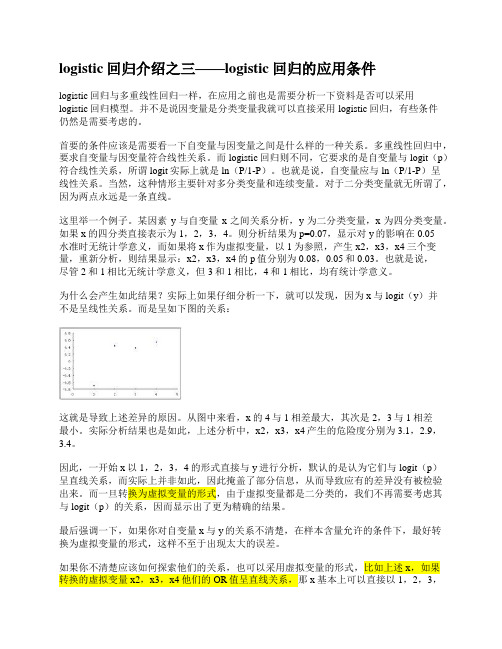

某因素y与自变量x之间关系分析,y为二分类变量,x为四分类变量。

如果x的四分类直接表示为1,2,3,4。

则分析结果为p=0.07,显示对y的影响在0.05水准时无统计学意义,而如果将x作为虚拟变量,以1为参照,产生x2,x3,x4三个变量,重新分析,则结果显示:x2,x3,x4的p值分别为0.08,0.05和0.03。

也就是说,尽管2和1相比无统计学意义,但3和1相比,4和1相比,均有统计学意义。

为什么会产生如此结果?实际上如果仔细分析一下,就可以发现,因为x与logit(y)并不是呈线性关系。

而是呈如下图的关系:这就是导致上述差异的原因。

从图中来看,x的4与1相差最大,其次是2,3与1相差最小。

实际分析结果也是如此,上述分析中,x2,x3,x4产生的危险度分别为3.1,2.9,3.4。

因此,一开始x以1,2,3,4的形式直接与y进行分析,默认的是认为它们与logit(p)呈直线关系,而实际上并非如此,因此掩盖了部分信息,从而导致应有的差异没有被检验出来。

而一旦转换为虚拟变量的形式,由于虚拟变量都是二分类的,我们不再需要考虑其与logit(p)的关系,因而显示出了更为精确的结果。

关于logistic回归模型以及probit模型的几点看法

1.logistic回归模型(包括有序和无序)操作:SPSS——分析——回归(若因变量只是定类数据,则选择二元logistic 或多元logistic;若因变量是定序数据,则需要选择“有序”),在出现的框框中,有因变量、因子、协变量三项。

其中,因变量即为被解释变量,因子和协变量即为解释变量,因子是分类数据,协变量是连续型变量。

注意:(1)做回归模型之前需要检验自变量之间有无多重共线性(方法就是运用因变量和自变量建立线性回归模型)具体如下:分析——回归——线性——因变量及自变量转进相应位置,之后点击“统计”,勾选“共线性诊断”,然后点击“确定”。

如果结果结果中Tolerance(容差或容忍度)小于0.1或者VIF(方差膨胀因子)大于10,或者特征根等于0,或者条件指数大于30,则表示存在共线性。

此时,再运用回归模型就不合适,需要先让共线性问题解决之后才能运用模型继续进行估计。

(2)做回归模型之前还需要做平行性检验。

(方法是分析——回归——有序——输出——勾选平行性检验,此检验的原假设为回归自变量系数相等,如果自变量系数相等则可以用有序logistic回归模型,所以最终需要接受原假设,即P大于0.05)结果分析(针对有序回归模型而言):在似然比检验中,只要P值小于0.05,就说明模型有效,反之无效在回归结果中只要P值小于0.05,同样说明,自变量对因变量的影响是显著的。

2.probit回归模型(包括有序和无序)操作:分析——回归——概率;若做的是有序probit模型,可以分析——广义线性模型——有序概率总结:SPSS做probit模型不太方便,可以用stata软件做3.联系与区别(1)联系:二者都可以应用于因变量为分类变量的情况,并且两种方法的结果比较接近。

(2)区别:probit回归是基于正态分布进行的,而logistic回归是基于二项分布。

(3)具体选择哪一种模型:当自变量中连续变量较多且符合正态分布时,可以考虑运用probit回归模型,而当自变量中分类变量较多时,可以考虑使用logistic回归模型。

logistic回归、probit回归与poission回归

1 p

logistic回归的分类: (1)二分类资料logistic回归: 因变量为两分类变量的资料,

可用非条件logistic回归和条件logistic回归进行分析。非条 件logistic回归多用于非配比病例-对照研究或队列研究资料, 条件logistic回归多用于配对或配比资料。 (2)多分类资料logistic回归: 因变量为多项分类的资料, 可用多项分类logistic回归模型或有序分类logistic回归模型 进行分析。

问题2:

回归系数的意义:

• Logistic回归中的回归系数 i 表示,某一因

素改变一个单位时,效应指标发生与不发生事 件的概率之比的对数变化值,即OR的对数值。 • Logistic回归中的常数项 0 表示,在不接触任 何潜在危险/保护因素条件下,效应指标发生 与不发生事件的概率之比的对数值。

logistic回归、probit回 归与poission回归

第三章:横截面数据:因变量为分类变量及因 变量为频数(计数)变量的情况

• Logistic回归(因变量为二分变量/二项分布) • probit回归 • Poisson (因变量为poisson分布)

概念

logistic回归是研究因变量为二分类或多分类观察结果与影响 因素(自变量)之间关系的一种多变量分析方法,属概率型非线 性回归。

②再拟合包含待检验因素的 logistic 模型,求另一

个对数似然函数值 ln L1 ;③比较两个对数似然函数

值差别的大小

若 2 个模型分别包含l 个自变量和 p 个自变量,

似然比统计量 G 的计算公式为:

G 2(ln Lp ln Ll )

用人话讲明白逻辑回归Logisticregression

用人话讲明白逻辑回归Logisticregression文章目录1.从线性回归说起2.sigmond函数3.推广至多元场景4.似然函数5.最大似然估计6.损失函数7.梯度下降法求解8.结尾【提示:头条号编辑器不支持Markdown,因此涉及公式的部分全部转为图片显示】今天梳理一下逻辑回归,这个算法由于简单、实用、高效,在业界应用十分广泛。

注意咯,这里的“逻辑”是音译“逻辑斯蒂(logistic)”的缩写,并不是说这个算法具有怎样的逻辑性。

前面说过,机器学习算法中的监督式学习可以分为2大类:•分类模型:目标变量是分类变量(离散值);•回归模型:目标变量是连续性数值变量。

逻辑回归通常用于解决分类问题,例如,业界经常用它来预测:客户是否会购买某个商品,借款人是否会违约等等。

实际上,“分类”是应用逻辑回归的目的和结果,但中间过程依旧是“回归”。

为什么这么说?因为通过逻辑回归模型,我们得到的计算结果是0-1之间的连续数字,可以把它称为“可能性”(概率)。

对于上述问题,就是:客户购买某个商品的可能性,借款人违约的可能性。

然后,给这个可能性加一个阈值,就成了分类。

例如,算出贷款违约的可能性>0.5,将借款人预判为坏客户。

1.从线性回归说起考虑最简单的情况,即只有一个自变量的情况。

比方说广告投入金额x和销售量y的关系,散点图如下,这种情况适用一元线性回归。

线性回归的介绍文章戳这里:用人话讲明白线性回归LinearRegression但在许多实际问题中,因变量y是分类型,只取0、1两个值,和x的关系不是上面那样。

假设我们有这样一组数据:给不同的用户投放不同金额的广告,记录他们购买广告商品的行为,1代表购买,0代表未购买。

假如此时依旧考虑线性回归模型,得到如下拟合曲线:这种形式,非常像单位阶跃函数:图像如下:我们发现,把阶跃函数向右平移一下,就可以比较好地拟合上面的散点图呀!但是阶跃函数有个问题,它不是连续函数。

第四章01变量的回归模型Logistic回归Probit回归

为什么要用逻辑回归?

假设存在一个名为“ST可能性”的概念性指标,用来 表示公司被ST的可能性

当“ST可能性”大于某一阈值时,公司就会被ST

我们可以推测,如果有两个公司的经营状况非常接 近,那么其“ST可能性”也应该非常接近

因此可以假设“ST可能性”为一个连续型指标,取值 在正负无穷之间

•Best Logit Model (BIC)

•Best Probit Model (AIC)

•Best Probit Model (BIC)

其表现特征就是在其股票名称前冠以“ST”字样

上海证券交易所股票上市规则(二00一年六月八日)

第九章特别处理 第一节基本原则 9.1.1上市公司出现财务状况或其他状况异常,导致投资者难于判断公司前景,权益可能受到损 害的,本所将对公司股票交易实行特别处理。

9.2.1上市公司出现以下情形之一的,为财务状况异常: (一)最近两个会计年度的审计结果显示的净利润均为负值; (二)最近一个会计年度的审计结果显示其股东权益低于注册资本,即每股净资产低于 股票面值; (三)注册会计师对最近一个会计年度的财务报告出具无法表示意见或否定意见的审计 报告; (四)最近一个会计年度经审计的股东权益扣除注册会计师、有关部门不予确认的部分 ,低于注册资本; (五)最近一份经审计的财务报告对上年度利润进行调整,导致连续两个会计年度亏损 ;

回头看我们的数据:

训练样本:

Year = 1999 (ST 时间 = 2002) 样本容量: 684 ST 案例: 36/684=5.26%

检验样本:

Year = 2000 (ST 时间 = 2003) 样本容量: 746 ST 案例: 47/746=6.30%

Logistic回归分析报告结果解读分析-logit回归解读

Logistic回归分析报告结果解读分析Logistic回归常用于分析二分类因变量(如存活和死亡、患病和未患病等)与多个自变量的关系。

比较常用的情形是分析危险因素与是否发生某疾病相关联。

例如,若探讨胃癌的危险因素,可以选择两组人群,一组是胃癌组,一组是非胃癌组,两组人群有不同的临床表现和生活方式等,因变量就为有或无胃癌,即“是” 或“否”,为二分类变量,自变量包括年龄、性别、饮食习惯、是否幽门螺杆菌感染等。

自变量既可以是连续变量,也可以为分类变量。

通过Logistic回归分析,就可以大致了解胃癌的危险因素。

Logistic回归与多元线性回归有很多相同之处,但最大的区别就在于他们的因变量不同。

多元线性回归的因变量为连续变量;Logistic回归的因变量为二分类变量或多分类变量,但二分类变量更常用,也更加容易解释。

1.Logistic回归的用法一般而言,Logistic回归有两大用途,首先是寻找危险因素,如上文的例子,找出与胃癌相关的危险因素;其次是用于预测,我们可以根据建立的Logistic回归模型,预测在不同的自变量情况下,发生某病或某种情况的概率(包括风险评分的建立)。

2.用Logistic回归估计危险度所谓相对危险度(risk ratio,RR)是用来描述某一因素不同状态发生疾病(或其它结局)危险程度的比值。

Logistic回归给出的OR(odds ratio)值与相对危险度类似,常用来表示相对于某一人群,另一人群发生终点事件的风险超出或减少的程度。

如不同性别的胃癌发生危险不同,通过Logistic回归可以求出危险度的具体数值,例如1.7,这样就表示,男性发生胃癌的风险是女性的1.7倍。

这里要注意估计的方向问题,以女性作为参照,男性患胃癌的OR是 1.7。

如果以男性作为参照,算出的OR将会是0.588(1/1.7),表示女性发生胃癌的风险是男性的0.588倍,或者说,是男性的58.8%。

撇开了参照组,相对危险度就没有意义了。

【尚择优选】logistic回归及其分析攻略

logistic回归参数估计

暴露人群的优势为p1/(1-p1) 非暴露人群的优势为p2/(1-p2) 二者之比,称为优势比(odds ratio,OR)

p1 /(1 p1) ad OR= p2 /(1 p2) bc

对OR求对数,得

ad ˆ ln(OR)=ln( )= 1 bc

什么是Logistic回归

Logistic回归模型: p logit( p) ln( ) 0 1 x1 2 x2 m xm 1 p βi表示自变量xi改变一个单位时,logit(p)的改变量。 其它形式:

p

e 1 e

0 1 x1 2 x 2 ... m x m

什么是Logistic回归

P logit P ln ( ) Logit变换: 1 P

式中等号右边的分数 [p/(1-p)] 是流行病学常用的描述疾病 发生强度的统计指标,称为优势(odds)。 当疾病发生的概率p与不发生的概率q相等皆为0.5时, odds=1,否则odds大于或小于1。

线性回归模型: Logit变换:

ˆ a b1 x1 b2 x2 bm xm y

P logit P ln( ) 1 P

p表示事件发生的概率,1-p为事件不发生的概率 当p=1时,logit(p)=+∞, 当p=0.5时,logit(p)=0, 当p=0时,logit(p)=-∞ 故logit(p)的取值范围是(-∞,+∞)

p1

p( y 1 | x 1) e 1 e

e 1 e

p2 p( y 1 | x 0)

e 1 e

0

常用回归分析方法大荟萃(一)

常用回归分析方法大荟萃(一)logistic回归、poission回归、probit回归、cox回归回归分析可以说是统计学中内容最丰富、应用最广泛的分支。

这一点几乎不带夸张。

包括最简单的t检验、方差分析也都可以归到线性回归的类别。

而卡方检验也完全可以用logistic回归代替。

众多回归的名称张口即来的就有一大片,线性回归、logistic回归、cox回归、poission回归、probit回归等等等等,可以一直说的你头晕。

为了让大家对众多回归有一个清醒的认识,这里简单地做一下总结:1,先说线性回归,这是我们学习统计学时最早接触的回归,就算其它的你都不明白,最起码你一定要知道,线性回归的因变量是连续变量,自变量可以是连续变量,也可以是分类变量。

如果只有一个自变量,且只有两类,那这个回归就等同于t检验。

如果只有一个自变量,且有三类或更多类,那这个回归就等同于方差分析。

如果有2个自变量,一个是连续变量,一个是分类变量,那这个回归就等同于协方差分析。

所以线性回归一定要认准一点,因变量一定要是连续变量。

当然还有其它条件,比如独立性、线性、等方差性、正态性,这些说起来就话长了,而且在前面的几篇文章中我已经逐个介绍了,这里就不罗嗦了。

2, logistic回归,与线性回归并成为两大回归,应用范围一点不亚于线性回归,甚至有青出于蓝之势。

因为logistic回归太好用了,而且太有实际意义了。

解释起来直接就可以说,如果具有某个危险因素,发病风险增加2.3倍,听起来多么地让人通俗易懂。

线性回归相比之下其实际意义就弱了。

logistic回归与线性回归恰好相反,因变量一定要是分类变量,不可能是连续变量。

分类变量既可以是二分类,也可以是多分类,多分类中既可以是有序,也可以是无序。

二分类logistic回归有时候根据研究目的又分为条件logistic回归和非条件logistic回归。

条件logistic回归用于配对资料的分析,非条件logistic回归用于非配对资料的分析,也就是直接随机抽样的资料。

逻辑回归 分类

逻辑回归分类

逻辑回归分类是一种分类技术,用于分析我们的数据集,以预测结果的概率。

它是一种统计学方法,用来模型分类变量之间的关系,此方法被广泛应用于社会科学、计算机科学、医学、生物科学等领域,以预测或推断事物发生的可能性。

二、原理

逻辑回归分类的原理是建立一个模型,它可以根据输入变量(被解释变量)预测一个结果(响应变量)的概率。

它由一个或多个输入变量来预测一个响应变量的概率,响应变量通常是一个二进制类别变量(0/1,yes/no,是/否),因此逻辑回归分类在两类分类中最常见。

三、模型

逻辑回归分类使用的模型是一个逻辑斯蒂回归模型,它是一种广义线性模型,其假设函数服从特定的概率分布。

当我们使用逻辑回归进行分类时,我们建立一个模型来描述输入变量(特征)与响应变量(类别)之间的关系。

模型建立后,我们可以使用该模型来预测一个新的输入变量的响应结果。

四、优缺点

优点:

(1)简单易用:Logistic回归模型本身很简单,易于理解和实现。

(2)可解释性强:Logistic回归模型可以得到特征变量的权重,可以解释哪些特征变量与结果变量有关联,以及他们的相关程度。

(3)数据类型不受限制:Logistic回归模型可以处理连续变量和类别变量,不受数据类型的限制。

缺点:

(1)有一定的线性关系假设:Logistic回归假设特征变量与结果变量之间存在线性关系,这往往不是真实情况,导致logistic回

归模型在实际问题中的表现经常不尽如人意。

(2)结果受限:Logistic回归的结果只能介于0和1之间,而往往现实问题的需求会更加复杂,如果模型的结果不能满足实际问题,就无法使用Logistic回归模型。

logistic回归算法

logistic回归算法LOGISTIC回归算法是统计学中最常用的分类技术,它可以用来判断不同数据特征之间的关系,以及预测它们之间的关系是否可以被概括为一个概率论模型。

它是一种用来将定量特征转换为定性结果的算法,一般用于预测变量的分类属性,如一个候选人的投票意向、一种药物的药效以及一种金融品种的风险等。

Logistic回归算法是一种数据分析技术,它可以有效地预测一个事件是否将发生,也可以用来估算一个事件发生的概率。

它通常被用来解决两类分类问题,如预测客户的购买行为、登陆成功的可能性、垃圾邮件的检测、疾病的诊断、认为什么样的顾客会购买什么产品等。

Logistic回归算法主要分为两个阶段:训练阶段和预测阶段。

训练阶段涉及获取数据、特征选择、参数估计与训练模型;预测阶段涉及模型评估、应用模型预测新实例类别等步骤。

训练阶段需要收集大量数据,确定分类属性,构建数据集。

然后需要从原始数据中提取出影响事件发生的有用特征,这些特征可以是定量的或定性的。

接下来,这些特征需要被转换为Logistic回归算法可以理解的形式,即将它们表示为一系列函数。

然后,需要确定模型的参数,这可以通过使用最大似然估计或正则化算法来完成,从而确定模型的最佳状态,最终得到一个拟合的模型。

预测阶段,基于训练模型,可以用于检验模型的准确度,并对实际数据进行预测,包括定量的评估和定性的推论。

此外,在模型评估时可以采用训练集折半法、起伏点分析法等方法来检验模型的性能,确定其对未知数据的分析能力。

最后可以根据训练结果来预测新的实例的类别。

Logistic回归算法在实际中具有很多应用,举几个例子:预测飞机发动机的故障,分析用户的行为数据来检测可疑活动,利用用户的属性来预测其购买意图,还可以用来诊断病人的疾病及其预后等等。

由于Logistic回归算法快速可靠,实现简单,目前已经被广泛应用于金融、医疗、媒体、电子商务等领域。

总之,Logistic回归算法是用来判断不同数据特征之间的关系,以及预测它们之间的关系是否可以被概括为一个概率论模型的常用分类技术。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

exp( 0 1 X 1 2 X 2 m X m ) P 1 exp( 0 1 X 1 2 X 2 m X m )

其中, 0 为常数项, 1 , 2 , , m 为偏回归系数。

P logit P = ln 为 P 的 logit 变换, 1 P

ln[exp(0 1 X1 2 X 2

0 1 X1 2 X 2 m X m

限。比数去除了概率的上限,比 数的对数去除了概率的下限;且是以0,5为中点对称的,概率大 于0.5产生正的logit,logit距离0的距离反映了概率距离0.5的距离; 概率上相同的改变与在logits上产生的改变是不同的,logit转化 拉直了X与最初的概率之间的非线性关系。

0 x

模型描述了应变量p与x的关系

P概率 1 p( y 1) 1 1 exp[ ( 0 x)]

z 0 1 x

0.5

-3

-2

-1

0

1

2

3

Z值

图1 Logistic回归函数的几何图形

可看出:当 Z 趋于 时, P 值渐进于 1;当 Z 趋于 时,

i 1

n

(15.7)

式中为对数似然函数,对其取一阶导数求解参数。对 于参数 j ( j 1, 2, 即 ,令 ln L 的一阶导数为 0, ,m )

ln L 0 ,用 Newton-Raphson 迭代方法解方程组, j

得出参数 j 的估计值 bj 和 bj 的渐进标准误 Sb j 。

统计量 AIC 、SC 似然比卡方 RSQUARE C统计量 HL统计量

趋势 越小 越大 越大 越大 越小

拟合 作用 越好 类似于多元回归中的残差平方和 越好 类似于多元回归中的回归平方和 越好 类似于多元回归中的R^2 越好 度量观测值和条件预测的相对一致性 越好 度量观测值和预测值总体的一致性

也可以分为logistic回归和条件logistic回归

问题

1. 令因变量两个水平对应的值为0、1,概率为1-p、 p,则显然我们也可以用多重回归进行分析?为 什么要用logistic回归分析? 2. logistic回归回归系数、模型评估、参数估计、 假设检验等与之前的回归分析有何不同? 3. 因变量为二分变量时既可以用logistics回归也可 以用probit回归,那么probit回归及其与logistic 回归的异同之处

备注 P值越小越好

P值越大越好

说明:

在实践中,对以上统计量最为关注的是C统计量, 其次是似然比卡方,最后才是HL统计量。AIC和 SQUARE极少关注,这一点和多元线性回归有很大的 区别。根本原因就是多元线性回归模型是一个预测模 型,目标变量的值具有实际意义;而logistic是一个分 类模型,目标变量只是一个分类标识,因此更关注预 测值和预测值之间的相对一致性而不是绝对一致性。

若 2 个模型分别包含 l 个自变量和 p 个自变量, 似然比统计量 G 的计算公式为:

G 2(ln Lp ln Ll )

当样本含量 n 较大时,在 H 0 成立的条件下, G 统计量近似服从自由度 d p l 的 分布。 如果只对一个回归系数(或一个自变量)进行检 验,则 1 。

exp(bj u 2 Sbj )

案例:

表 1 为吸烟、饮酒与食管癌关系的病例-对照研究调查 资料,试进行 logistic 回归分析。

表 1 吸烟、饮酒与食管癌关系的病例-对照研究资料 分层 1 2 3 4

g

吸烟 0 0 1 1

X1

饮酒 0 1 0 1

X2

总例数 ng 199 170 101 416

模型评估

(1)Hosmer-Lemeshowz指标 HL统计量的原假设Ho是预测值和观测值之间无显著差 异,因此HL指标的P-Value的值越大,越不能拒绝原假设, 即说明模型很好的拟合了数据。 (2)AIC和SC指标 即池雷准则和施瓦茨准则 与线性回归类似AIC和SC越小说明模型拟合的越好 (3)似然比卡方出 从整体上看解释变量对因变量有无解释作用相当于多元 回归中的F检验 在logistic回归中可以通过似然比(likelihood ratio test)进行检验 (4)RSQUARE( R^2 )和C统计量 解释变量解释在多大程度上解释了因变量与线性回归中 的R^2作用类似 在logistic回归中可以通过R^2和C统计量进 行度量

Logit 转化 :

设因变量 Y 是一个二分类变量,其取值为 Y =1 和 Y =0。 影响 Y 取值的 m 个自变量分别为 X 1 , X 2 , , X m 。在 m 个自变量(即暴露因素)作用下阳性结果发生的条件 概率为 P P(Y 1 X 1 , X 2 , , X m ) ,则 logistic 回归模 型可表示为:

OR值

OR的95%CI

对偏回归系数 的假设检验

吸烟与不吸烟的优势比: ˆ exp b exp0.8856 2.42 ,其 OR 的 95%可信区间: OR 1 1 1

exp[b1 u0.05 2 Sb1 ] exp(0.8856 1.96 0.1500) (1.81,3.25)

问题2:

回归系数的意义:

• Logistic回归中的回归系数 i 表示,某一因 素改变一个单位时,效应指标发生与不发生事 件的概率之比的对数变化值,即OR的对数值。 • Logistic回归中的常数项 0 表示,在不接触任 何潜在危险/保护因素条件下,效应指标发生 与不发生事件的概率之比的对数值。 单纯从数学上讲,与多元线 性回归分析中回归系数的解 释并无不同。

2

2. Wald 检验

用 u 检验或 2 检验来检验各参数 j 是否为 0。

u bj Sbj

b j Sb

2

j

2

Sb j 为偏回归系数的标准误。

3.比分检验(score test)

以未包含某个或几个变量的模型为基础,保留模型 中参数的估计值,并假设新增加的参数为零,计算似然函 数的一价偏导数(又称有效比分)及信息距阵,两者相乘 便得比分检验的统计量S 。样本量较大时, S近似服从自 由度为待检验因素个数的2分布。

阳性数 d g 63 63 44 265

阴性数 ng d g 136 107 57 151

首先确定变量的赋值或编码:

1 X1 0

吸烟 不吸烟

1 X2 0

饮酒 不饮酒

1 Y 0

病例 对照

观 察 例 数

在logistic过程步 中加“descending” 选项的目的是使 SAS过程按阳性 率(y=1)拟合模 型,得到阳性病 例对应于阴性病 例的优势比。

P 值渐进于 0; P 值的变化在 0~1 之间,并且随 Z 值的变

化以点(0,0.5)为中心成对称 S 形变化。

线性回归在处理有上限和下限的因变量时面临着 一个问题:X上同样的变化对Y产生的影响不同, 由图1也可以直观的看出这里并不适合进行线性 回归。 虽然有很多非线性的函数可以呈现S形,但由于 Logit转化比较简易,所以更受欢迎。

参数估计

logistic 回归模型的参数估计常采用最大似然估计(与多元线性回 归中的类似)。其基本思想是先建立似然函数与对数似然函数, 求使对数似然函数最大时的参数值,其估计值即为最大 似然估计值。 建立样本似然函数:

n

L P i (1 P i)

Yi i 1

1Yi

( i 1, 2,

除此以外,logistic回归还可以用优势比估计:

自变量 X j 不同水平 c1 和 c0 优势比的估计值:

ˆ exp[b (c c )] OR j j 1 0

当样本含量 n 较大时, bj 的抽样分布近似服从 正态分布,若 X j 只有暴露和非暴露 2 个水平, 则优势比 OR j 的 100(1 )%可信区间为:

概念

logistic回归是研究因变量为二分类或多分类观察结果与影响 因素(自变量)之间关系的一种多变量分析方法,属概率型非线 性回归。 最常用的是二值型logistic ,即因变量的取值只包含两个类 别 例如:好、坏 ;发生、不发生;常用Y=1或Y=0表示。 自变 量X称为危险因素或暴露因素,可为连续变量、等级变量、分类 变量,可有m个自变量X1, X2,… Xm 。P表示Y=1的概率,是 其他变量的一个函数。 【p(Y=1|X)表示在X的条件下Y=1的概率】 logistic回归的数学表达式为:

问题1:

1 Y 0 出现阳性结果 (发病、有效、死亡等) 出现阴性结果 (未发病、无效、存活等)

p(y=1)表示某暴露因素状态下,结果y=1的概率(P)模型。

或

e P( y 1) 1 e 0 x

1 p( y 1) 1 exp[( 0 x)]

p ln XT 1 p

logistic回归的分类:

(1)二分类资料logistic回归: 因变量为两分类变量的资料, 可用非条件logistic回归和条件logistic回归进行分析。非条 件logistic回归多用于非配比病例-对照研究或队列研究资料, 条件logistic回归多用于配对或配比资料。 (2)多分类资料logistic回归: 因变量为多项分类的资料, 可用多项分类logistic回归模型或有序分类logistic回归模型 进行分析。

第三章:横截面数据:因变量为分类变量及因 变量为频数(计数)变量的情况 • Logistic回归(因变量为二分变量/二项分布) • probit回归 • Poisson (因变量为poisson分布)

第三章:横截面数据:因变量为分类变量及因 变量为频数(计数)变量的情况 • Logistic回归(因变量为二分变量/二项分布) • probit回归 • Poisson (因变量为poisson分布)