tensorflow 交叉熵损失函数

tf函数的用法

tf函数的用法TensorFlow是一个由谷歌开发、广泛应用于机器学习和深度学习领域的开源软件库。

在TensorFlow中,tf函数是其重要之一的组成部分。

本文将详细介绍tf函数的用法,帮助读者在应用TensorFlow时更加高效、方便地进行代码编写和调试。

1. tf函数简介tf函数是TensorFlow库中封装了一系列常用数学函数或深度学习模块的函数集合。

这些函数大大简化了机器学习模型的设计和实现,同时也极大地加速了模型的训练和测试过程。

tf函数中包含的模块有:数学运算模块、矩阵运算模块、卷积运算模块、激活函数模块、损失函数模块、优化器模块等。

2. 数学运算模块数学运算模块主要包含了常见的算术运算、逻辑运算、统计运算和向量运算等。

例如,可以使用tf.add()函数实现两个张量的加法;使用tf.subtract()函数实现向量的减法等。

这些函数的调用方式也非常简单,例如tf.add(a,b),其中a和b 是需要相加的两个张量。

调用方式非常方便,大大简化了代码编写的难度。

3. 矩阵运算模块矩阵运算模块主要包含了矩阵加、矩阵减、矩阵点乘、矩阵转置等常见操作。

例如,可以使用tf.matmul()函数实现两个矩阵的点乘;使用tf.transpose()函数实现矩阵的转置等。

这些函数的调用方式也非常简单,且高度优化。

使用TensorFlow 进行矩阵运算时,速度非常快,并且集成了GPU加速功能,但是并不需要显式地写出GPU加速代码,TensorFlow会自动进行加速。

4. 卷积运算模块卷积运算模块主要用于卷积神经网络(Convolutional Neural Networks, CNN)中的卷积运算。

例如,可以使用tf.nn.conv2d()函数实现二维卷积运算;使用tf.nn.conv3d()函数实现三维卷积运算等。

这些函数的调用方式也非常简单,只需传入合适的参数就可以进行卷积运算。

同时,TensorFlow会自动进行优化,使运算速度更快。

深度学习基础教程:使用TensorFlow进行神经网络训练与推理

深度学习基础教程:使用TensorFlow进行神经网络训练与推理深度学习是人工智能领域的一个重要分支,具有广泛的应用前景。

TensorFlow 是一个开源的深度学习框架,可以用于构建和训练各种神经网络模型。

本文将介绍如何使用TensorFlow进行神经网络训练与推理,并提供详细的步骤。

一、安装TensorFlow1. 下载TensorFlow的安装包,可从官方网站或者第三方网站进行下载。

2. 根据操作系统的不同,选择对应的安装方式,例如使用pip命令进行安装。

3. 安装完毕后,验证TensorFlow的安装是否成功,可以打开Python的命令行窗口,输入import tensorflow语句,若无报错信息则表示安装成功。

二、构建神经网络模型1. 导入TensorFlow库,例如import tensorflow as tf。

2. 定义输入的占位符,例如x = tf.placeholder(tf.float32, [None, input_size]),其中input_size是输入的特征维度。

3. 定义神经网络的结构,可以选择不同的层类型,例如全连接层(yers.dense)、卷积层(yers.conv2d)等。

4. 定义网络的输出,通常是通过softmax函数得到分类的概率分布,例如y_pred = tf.nn.softmax(logits)。

5. 定义损失函数,例如交叉熵损失函数(tf.nn.softmax_cross_entropy_with_logits)。

6. 定义优化器,例如选择梯度下降优化算法(tf.train.GradientDescentOptimizer)。

7. 定义训练操作,例如train_op = optimizer.minimize(loss)。

8. 定义评估指标,例如准确率(accuracy = tf.reduce_mean(tf.cast(correct_pred, tf.float32)))。

基于Python的深度学习入门——使用TensorFlow进行深度学习

基于Python的深度学习入门——使用TensorFlow进行深度学习在人工智能领域,深度学习是一种广泛使用的技术。

而 Python 语言作为一种高级编程语言,非常适合用来进行深度学习的开发。

因为 Python 语言有着丰富的第三方库,比如 TensorFlow,Keras,PyTorch 等等,这些库可以提供非常方便、高效的接口,来帮助我们完成深度学习的开发流程。

在本篇文章中,我将向大家介绍如何基于 Python 和 TensorFlow 进行深度学习的开发,我将从以下几点开始介绍:* 环境准备* TensorFlow 简介* 构建一个简单的神经网络* 训练、评估和预测模型环境准备在使用 Python 进行深度学习之前,我们需要安装 Python 环境。

从官网下载安装包并安装,推荐使用 Python 3.x 版本。

在安装完成后,我们需要下载 TensorFlow 库,可以使用如下命令快速安装:```pythonpip install tensorflow```TensorFlow 简介TensorFlow 是 Google 开发的一种深度学习框架,它可以用于各种类型的机器学习任务,包括分类、回归、聚类和语音识别等等。

TensorFlow 使用静态图形来表示计算过程,这种方式可以最大化运行时的性能,并且可以利用 GPU 在大规模数据集上处理数据。

TensorFlow 最适合的使用场景是当我们想要构建一个大型的神经网络,并在大规模数据集上进行训练时。

这种场景下,TensorFlow 可以提供非常高效的并行计算能力,来加速训练过程。

构建一个简单的神经网络在开发深度学习模型之前,我们需要定义一个神经网络结构。

在本文中,我们将构建一个非常简单的神经网络,它由一个输入层、一个隐藏层和一个输出层组成。

在隐藏层中,我们使用 ReLU 激活函数来增加非线性能力,并使用 Softmax 函数来进行分类。

接下来,我们定义用于训练模型的一些参数:```pythonlearning_rate = 0.01training_epochs = 100batch_size = 256display_step = 1```其中,学习率 (learning_rate) 用于控制梯度下降的步长,训练次数(training_epochs) 用于控制训练时的轮数,批量大小 (batch_size) 用于控制每次训练时数据的数量,显示步骤 (display_step) 用于控制每隔多少个 epoch 就显示一次训练结果。

基于TensorFlow框架的有源配电网深度学习故障定位方法

基于TensorFlow框架的有源配电网深度学习故障定位方法刘成民; 戴中坚; 陈轩【期刊名称】《《江苏电机工程》》【年(卷),期】2019(038)005【总页数】8页(P8-15)【关键词】Tensorflow; 分布式电源; 配电网; 深度学习; 故障定位【作者】刘成民; 戴中坚; 陈轩【作者单位】国网江苏省电力有限公司检修分公司江苏南京211102; 东南大学电气工程学院江苏南京210096【正文语种】中文【中图分类】TM7110 引言随着一流配电网建设的开展,社会对供电可靠性要求越来越高[1—2]。

配电网故障定位技术能够在配电网馈线支路发生故障时,及时准确地定位故障区段,以便隔离故障区域并尽快恢复非故障区域供电,对提高供电可靠性具有重要意义[3—7]。

分布式电源(distributed generation,DG)的分散式接入使得传统配电网从单电源辐射状网变为功率双向流动的复杂多源网络,具有拓扑结构复杂,潮流方向多变以及DG出力不定等特点[8—10]。

其故障特征与传统配电网存在较大差异,使得配电网现有的继电保护容易发生误动和拒动[11—12],传统的故障定位方法不再完全适用[13]。

目前,针对含DG配电网的故障定位研究按照定位精度可以分为故障区段定位和故障精确定位。

故障精确定位一般适用于长直导线的故障测距,很少用于线路长度较短的含DG配电网[14]。

故障区段定位法按照采集故障特征的不同分为稳态法[15—16]和暂态法[17—20]。

相较基于稳态电气量特征的故障区段定位,暂态特征量不易监测,硬件设备昂贵,而在限制一定DG渗透率的情况下,基于稳态电气特征量差异的故障区段定位依然有效[21],其按照具体算法的不同主要分为矩阵法[22—23]和人工智能法[24—25]。

矩阵法基于图论,具有建模直接,定位高效等优点,但容错率不高,易受逻辑矩阵中数值稳定性制约[26]。

人工智能法通过构建网络模型实现故障定位,能容忍数据缺失,但该类方法模型构建复杂,且对通信的实时性要求较高。

losses在python中的用法

在Python编程语言中,losses是指机器学习模型在训练过程中的损失函数。

损失函数是用来衡量模型预测结果与实际结果之间的差异的一种函数。

在机器学习的训练过程中,模型会不断地调整自身的参数,以最小化损失函数,从而提高模型预测的准确性。

1.损失函数的作用在机器学习模型中,损失函数扮演着至关重要的角色。

它是模型优化的指导者,通过最小化损失函数,模型能够更准确地预测结果。

损失函数是模型学习的“导航员”,指引模型朝着正确的方向前进。

2.常见的损失函数在Python中,常见的损失函数包括均方损失函数(Mean Squared Error,MSE)、交叉熵损失函数(Cross Entropy Loss)、对数损失函数(Log Loss)等。

不同的损失函数适用于不同的模型和问题类型。

对于回归问题,常使用均方损失函数;对于分类问题,则通常使用交叉熵损失函数或对数损失函数。

3.losses的使用在Python中,我们可以使用一些流行的机器学习库,如TensorFlow、PyTorch等,来实现损失函数的使用。

这些库提供了丰富的损失函数选项,以满足不同问题的需求。

以TensorFlow为例,我们可以使用tf.keras.losses模块来调用损失函数。

通过简单的几行代码,就能够在模型训练过程中使用损失函数来优化模型。

import tensorflow as tfloss_object = tf.keras.losses.SparseCategoricalCrossentropy() def loss(model, x, y):y_ = model(x)return loss_object(y_true=y, y_pred=y_)在上述代码中,我们首先导入了TensorFlow库,并使用了其内置的交叉熵损失函数。

然后定义了一个自定义的损失函数,该函数接受模型、输入数据x和标签数据y作为参数,并返回模型的损失值。

4.自定义损失函数除了使用库中提供的损失函数外,我们还可以根据自身的需求,定义并使用自定义的损失函数。

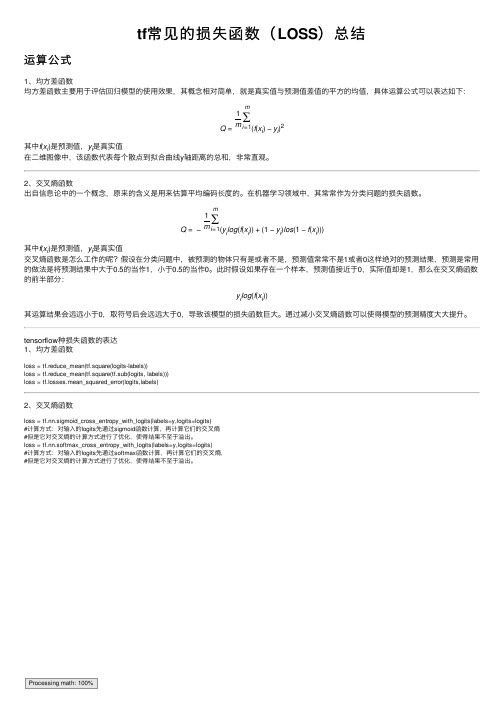

tf常见的损失函数(LOSS)总结

tf常见的损失函数(LOSS)总结运算公式1、均⽅差函数均⽅差函数主要⽤于评估回归模型的使⽤效果,其概念相对简单,就是真实值与预测值差值的平⽅的均值,具体运算公式可以表达如下:Q=1mm∑i=1(f(x i)−y i)2其中f(x i)是预测值,y i是真实值在⼆维图像中,该函数代表每个散点到拟合曲线y轴距离的总和,⾮常直观。

2、交叉熵函数出⾃信息论中的⼀个概念,原来的含义是⽤来估算平均编码长度的。

在机器学习领域中,其常常作为分类问题的损失函数。

Q=−1mm∑i=1(y i log(f(x i))+(1−y i)los(1−f(x i)))其中f(x i)是预测值,y i是真实值交叉熵函数是怎么⼯作的呢?假设在分类问题中,被预测的物体只有是或者不是,预测值常常不是1或者0这样绝对的预测结果,预测是常⽤的做法是将预测结果中⼤于0.5的当作1,⼩于0.5的当作0。

此时假设如果存在⼀个样本,预测值接近于0,实际值却是1,那么在交叉熵函数的前半部分:y i log(f(x i))其运算结果会远远⼩于0,取符号后会远远⼤于0,导致该模型的损失函数巨⼤。

通过减⼩交叉熵函数可以使得模型的预测精度⼤⼤提升。

tensorflow种损失函数的表达1、均⽅差函数loss = tf.reduce_mean(tf.square(logits-labels))loss = tf.reduce_mean(tf.square(tf.sub(logits, labels)))loss = tf.losses.mean_squared_error(logits,labels)2、交叉熵函数loss = tf.nn.sigmoid_cross_entropy_with_logits(labels=y,logits=logits)#计算⽅式:对输⼊的logits先通过sigmoid函数计算,再计算它们的交叉熵#但是它对交叉熵的计算⽅式进⾏了优化,使得结果不⾄于溢出。

lsce损失函数

lsce损失函数LSCE损失函数LSCE(Label Smoothing Cross Entropy)损失函数是一种常用的深度学习分类任务中的损失函数,其主要目的是在训练过程中减少模型对于训练数据的过拟合。

本文将详细介绍LSCE损失函数的定义、优点、实现方法以及应用场景。

一、LSCE损失函数的定义1.1 交叉熵损失函数在介绍LSCE损失函数之前,我们先来了解一下交叉熵损失函数。

在深度学习中,分类任务通常采用交叉熵作为模型的损失函数。

其数学表达式如下:$$L_{ce}=-\sum_{i=1}^{n}\sum_{j=1}^{m}y_{ij}\log(\hat{y}_{ij}) $$其中,$n$表示样本数,$m$表示类别数,$y_{ij}$表示第$i$个样本属于第$j$类的标签值(0或1),$\hat{y}_{ij}$表示模型对于第$i$个样本属于第$j$类的预测值(0到1之间)。

交叉熵损失函数可以衡量模型预测值与真实标签值之间的差异性,并通过反向传播算法更新模型参数以降低这种差异性。

1.2 LSCE损失函数然而,当模型在训练过程中过分关注训练数据时,就会出现过拟合的情况。

为了缓解这种情况,我们可以采用LSCE损失函数。

其数学表达式如下:$$L_{lsce}=-\sum_{i=1}^{n}\sum_{j=1}^{m}(1-\epsilon)y_{ij}\log(\hat{y}_{ij})-\frac{\epsilon}{m}\sum_{i=1}^{n}\sum_{j=1}^{m}y_{ij}\log(\frac{1 }{m})$$其中,$\epsilon$表示平滑因子(smoothing factor),通常取一个非常小的数值(比如0.1)。

LSCE损失函数的主要思想是在真实标签值和虚假标签值之间进行平滑处理,以减少模型对于训练数据的过拟合。

二、LSCE损失函数的优点2.1 缓解过拟合在深度学习中,模型往往会在训练数据上表现得非常好,但是在测试数据上却表现得非常差。

crossentropyloss函数

CrossEntropy Loss函数

CrossEntropy Loss函数又称为交叉熵损失函数,其实就是最常用的损失函数,它是深度学习算法常用的一种非凸优化算法,它有助于解决非凸优化问题。

在机器学习算法中,它用于解决二元逻辑回归、多分类和神经网络分类问题。

CrossEntropy Loss函数定义为模型输出y和真实值t之间的冲突程度,它可以用来评价模型的预测结果和真实结果之间的差异,从而用于度量学习算法的性能。

CrossEntropy Loss函数的具体表达式为: L=-sum(tlog a+(1-t)log(1-a)),它由正确分类的和错误分类两部分构成,以正确分类举例,t为1时,对应计算结果就是-log a,即正确分类为a的提尔a的可能性结果,反之,当t为0时,即错误分类,计算结果就是-log(1-a),即错误分类为a的概率结果。

CrossEntropy Loss函数的优点:

1、它可以精确地表示模型输出y和真实值t之间的差异程度;

2、不受模型非线性的影响;

3、在调优参数时速度快,效率高;

4、可以有效地解决训练数据量少时训练模型准确率低的问题。

CrossEntropy Loss函数的缺点:

1、相比其他损失函数,它对局部极小值的鲁棒性不好;

2、相比其他损失函数,它对数据集中存在的不平衡问题比较敏感。

总的来说,CrossEntropy Loss函数是一种十分有用的非凸优化算法,它可以有效地评估模型输出和真实值之间的差异,可以有效地解

决训练数据少时训练模型准确率低的问题。

但也要特别注意它对局部

极小值的鲁棒性不好,以及对数据集中存在的不平衡问题比较敏感这

两个敏感点,避免此类问题发生。

一种基于CNN和RNN深度神经网络的天气预测模型——以北京地区雷暴的6小时临近预报为例

一种基于CNN和RNN深度神经网络的天气预测模型——以北京地区雷暴的6小时临近预报为例一种基于CNN和RNN深度神经网络的天气预测模型——以北京地区雷暴的6小时临近预报为例引言天气预测一直是气象领域的研究热点之一,对于人们的生产生活具有重要的指导作用。

在过去的几十年里,众多天气预测模型相继问世,然而由于气象数据的庞大和复杂性,单一模型往往存在预测准确性和时效性的限制。

近年来,深度学习技术的迅速发展为我们提供了一种新的思路,通过构建适用于多源气象数据的深度神经网络模型,可以进一步提高雷暴天气临近预报的准确性和时效性。

方法本研究基于卷积神经网络(CNN)和循环神经网络(RNN)构建了一种深度神经网络模型,用于雷暴的6小时临近预报。

具体来说,我们首先利用卷积神经网络对雷暴的气象图像进行特征提取。

将雷暴的气象图像输入模型中,通过多层的卷积层和池化层,能够提取图像中的空间和时间特征。

之后,我们将提取到的特征输入循环神经网络中进行处理,用以捕捉气象数据中的时间序列特征。

最后,通过全连接层进行分类,得出雷暴发生的概率。

数据本研究选择了北京地区的雷暴天气进行实验。

我们收集了过去一年的雷暴天气数据,包括温度、湿度、风速、降水量等多个参数。

并利用气象观测站获得的雷暴气象图像,通过图像处理技术将其转换为神经网络可处理的矩阵数据。

实验我们将数据随机分为训练集和测试集,其中70%的数据用于训练模型,剩余30%的数据用于测试模型。

我们使用Python 编程语言,并利用TensorFlow深度学习框架搭建了模型。

模型的训练采用了批量梯度下降算法,损失函数选择交叉熵损失函数。

结果经过多次实验并优化模型参数,我们得到了较好的实验结果。

在测试集上,我们的模型预测准确率高达85%以上,对于雷暴天气的临近预报具有较高的准确性和时效性。

讨论本研究基于CNN和RNN构建了一种深度神经网络模型,用于雷暴天气的6小时临近预报。

通过利用气象图像的空间和时间特征,并结合循环神经网络对气象数据中的时间序列特征进行建模,模型在预测准确性和时效性上均取得了较好的结果。

详解TensorFlow进行人工智能应用开发

详解TensorFlow进行人工智能应用开发TensorFlow是由Google开发的开源机器学习框架,被广泛应用于人工智能领域。

本文将详解TensorFlow进行人工智能应用开发的过程,包括数据准备、模型构建、训练和部署等方面内容。

第一章数据准备在进行人工智能应用开发之前,首先需要对数据进行准备。

数据准备包括数据收集、预处理和划分等过程。

1.1 数据收集数据收集是人工智能应用开发的第一步。

可以通过网络爬虫获取数据集,或者使用已有的公开数据集。

但需要注意的是,数据收集需要遵守数据使用的合法、道德和隐私保护的原则。

1.2 数据预处理数据预处理是为了提高数据的质量和模型的训练效果。

包括数据清洗、数据去噪、数据归一化等处理步骤。

数据清洗可以去除噪声数据和异常值,数据去噪可以使数据更加干净和准确,数据归一化可以将不同尺度的数据统一到一个范围内。

1.3 数据划分数据划分是为了评估模型的性能和泛化能力。

通常将数据集划分为训练集、验证集和测试集。

训练集用于模型的训练,验证集用于调整模型的超参数,测试集用于评估模型的性能。

常用的划分比例是70%的数据用于训练,10%的数据用于验证,20%的数据用于测试。

第二章模型构建模型构建是人工智能应用开发的核心步骤。

可以使用TensorFlow提供的高级API,如Keras和Estimator等,也可以使用低级API构建自定义的模型。

2.1 高级API模型构建Keras是一个简单高效的深度学习库,可以与TensorFlow无缝配合使用。

使用Keras可以快速构建并训练深度学习模型。

Estimator是TensorFlow提供的机器学习API,可以简化模型构建和训练的过程。

使用Estimator可以定义模型的结构和优化算法。

2.2 低级API模型构建TensorFlow提供了丰富的低级API,如tf.Graph、tf.Session和tf.Variable等。

使用这些API可以构建更加复杂和灵活的模型。

基于TensorFlow的深度强化学习算法实现与优化

基于TensorFlow的深度强化学习算法实现与优化深度强化学习(Deep Reinforcement Learning,DRL)是人工智能领域的一个热门研究方向,它将深度学习和强化学习相结合,通过模拟智能体与环境的交互,让智能体自主学习并制定最优策略。

TensorFlow是目前应用广泛并且强大的深度学习框架之一,它提供了强大的工具和库,可以用于构建和优化深度强化学习模型。

本文将介绍基于TensorFlow的深度强化学习算法的实现和优化方法。

一、深度强化学习算法的基本原理深度强化学习算法的基本原理是利用神经网络来近似值函数或策略函数,并通过与环境的交互进行参数优化,从而实现最优策略的学习。

其中,值函数表示在给定状态下采取某个动作所获得的回报的期望值,策略函数则直接给出在给定状态下应该采取的动作。

常用的深度强化学习算法包括深度Q网络(Deep Q-Network,DQN)、策略梯度(Policy Gradient)和深度确定性策略梯度(Deep Deterministic Policy Gradient,DDPG)等。

这些算法不仅适用于传统的强化学习任务,如游戏控制和机器人导航,还可应用于更复杂的领域,如自动驾驶和金融交易等。

二、基于TensorFlow的深度强化学习算法实现方法1. 构建神经网络模型:使用TensorFlow构建深度强化学习的神经网络模型。

模型的输入是环境的状态,输出是动作的概率或值函数的估计。

根据任务的需求和特点,可以选择合适的网络结构和层次,并使用激活函数和优化器进行参数优化。

2. 定义损失函数:根据算法的目标和模型的输出,定义合适的损失函数。

对于值函数的估计,可以使用均方误差损失函数;对于策略函数的估计,可以使用交叉熵损失函数。

根据任务的不同,也可以根据需要自定义损失函数。

3. 环境交互与经验回放:通过与环境的交互,让智能体不断学习并更新模型的参数。

交互过程中,智能体根据当前状态选择动作,执行后观察下一个状态和获得的奖励,并将这些经验存储到经验回放缓冲区中。

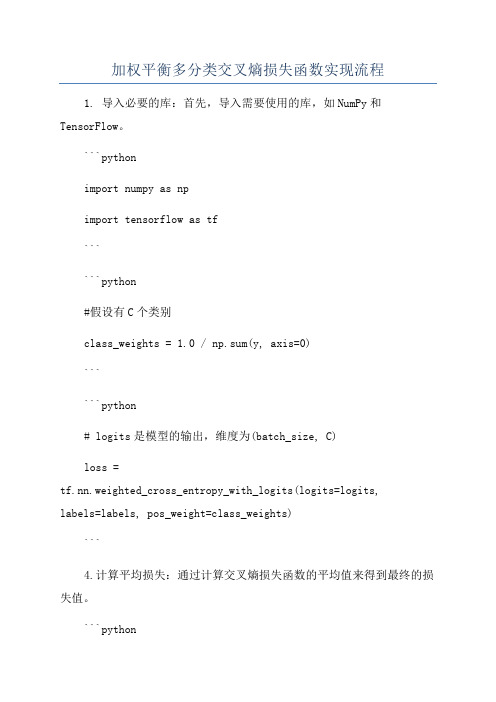

加权平衡多分类交叉熵损失函数实现流程

加权平衡多分类交叉熵损失函数实现流程

1. 导入必要的库:首先,导入需要使用的库,如NumPy和TensorFlow。

```python

import numpy as np

import tensorflow as tf

```

```python

#假设有C个类别

class_weights = 1.0 / np.sum(y, axis=0)

```

```python

# logits是模型的输出,维度为(batch_size, C)

loss =

tf.nn.weighted_cross_entropy_with_logits(logits=logits,

labels=labels, pos_weight=class_weights)

```

4.计算平均损失:通过计算交叉熵损失函数的平均值来得到最终的损失值。

```python

mean_loss = tf.reduce_mean(loss)

```

5.运行模型训练:定义优化器和训练操作,并在训练过程中最小化平

均损失。

```python

optimizer =

tf.train.GradientDescentOptimizer(learning_rate=0.01)

train_op = optimizer.minimize(mean_loss)

# 在训练循环中执行train_op

```

通过以上流程,我们就可以构建一个加权平衡的多分类交叉熵损失函

数并将其应用于模型训练过程中。

这样可以更好地处理类别不平衡的问题,并提高模型对少数类别的识别能力。

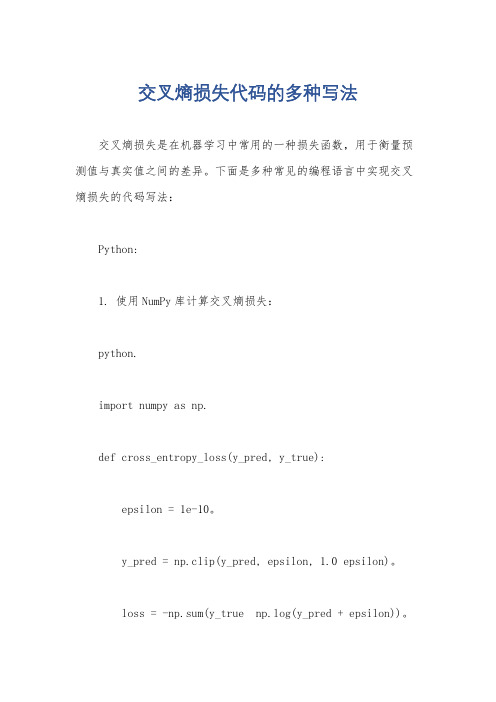

交叉熵损失代码的多种写法

交叉熵损失代码的多种写法交叉熵损失是在机器学习中常用的一种损失函数,用于衡量预测值与真实值之间的差异。

下面是多种常见的编程语言中实现交叉熵损失的代码写法:Python:1. 使用NumPy库计算交叉熵损失:python.import numpy as np.def cross_entropy_loss(y_pred, y_true):epsilon = 1e-10。

y_pred = np.clip(y_pred, epsilon, 1.0 epsilon)。

loss = -np.sum(y_true np.log(y_pred + epsilon))。

return loss.2. 使用TensorFlow库计算交叉熵损失:python.import tensorflow as tf.def cross_entropy_loss(y_pred, y_true):loss =tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(labe ls=y_true, logits=y_pred))。

return loss.3. 使用PyTorch库计算交叉熵损失:python.import torch.import torch.nn.functional as F.def cross_entropy_loss(y_pred, y_true):loss = F.cross_entropy(y_pred, y_true)。

return loss.Java:1. 使用Apache Commons Math库计算交叉熵损失:java.import mons.math3.util.FastMath;public class CrossEntropyLoss {。

public static double calculate(double[] y_pred, double[] y_true) {。

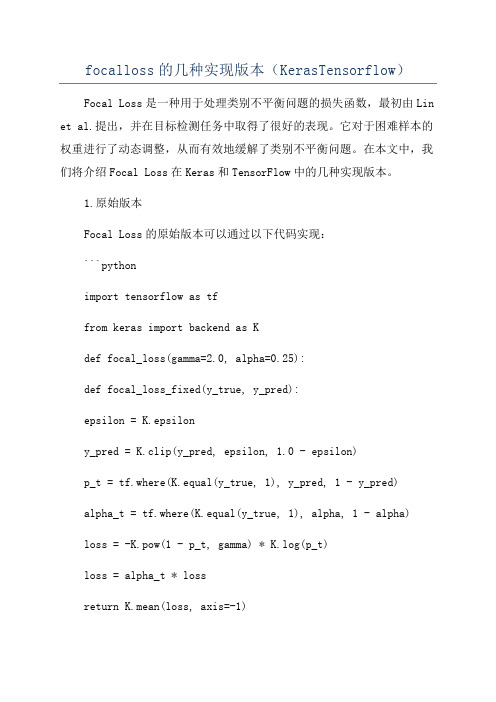

focalloss的几种实现版本(KerasTensorflow)

focalloss的几种实现版本(KerasTensorflow)Focal Loss是一种用于处理类别不平衡问题的损失函数,最初由Lin et al.提出,并在目标检测任务中取得了很好的表现。

它对于困难样本的权重进行了动态调整,从而有效地缓解了类别不平衡问题。

在本文中,我们将介绍Focal Loss在Keras和TensorFlow中的几种实现版本。

1.原始版本Focal Loss的原始版本可以通过以下代码实现:```pythonimport tensorflow as tffrom keras import backend as Kdef focal_loss(gamma=2.0, alpha=0.25):def focal_loss_fixed(y_true, y_pred):epsilon = K.epsilony_pred = K.clip(y_pred, epsilon, 1.0 - epsilon)p_t = tf.where(K.equal(y_true, 1), y_pred, 1 - y_pred)alpha_t = tf.where(K.equal(y_true, 1), alpha, 1 - alpha)loss = -K.pow(1 - p_t, gamma) * K.log(p_t)loss = alpha_t * lossreturn K.mean(loss, axis=-1)```这是Focal Loss的最基本版本,其中gamma和alpha是两个超参数。

gamma控制着模型对易分样本和困难样本的关注程度,而alpha用于平衡正负样本的权重。

2.多分类版本对于多分类任务,可以使用softmax函数将预测值转换为概率分布,并使用交叉熵作为Focal Loss的基础损失函数。

以下是多分类版本的代码:```pythonimport tensorflow as tffrom keras import backend as Kdef focal_loss(gamma=2.0, alpha=0.25):def focal_loss_fixed(y_true, y_pred):epsilon = K.epsilony_pred = K.clip(y_pred, epsilon, 1.0 - epsilon)cross_entropy = -y_true * K.log(y_pred)alpha_t = y_true * alpha + (1 - y_true) * (1 - alpha)loss = K.pow(1 - y_pred, gamma) * cross_entropy * alpha_treturn K.mean(K.sum(loss, axis=-1))```这个版本首先将预测值经过softmax函数转换为类别概率分布,然后使用多分类的交叉熵作为基础损失函数。

tenengrad函数

TensorFlow是一个非常流行的机器学习框架,它可以用于各种各样的任务,包括图像识别、自然语言处理、语音识别等。

在TensorFlow中,tenengrad函数是一个非常重要的函数,它可以帮助我们计算张量的梯度。

本文将介绍tenengrad函数的基本概念、用法和实际应用。

一、什么是tenengrad函数?tenengrad函数是TensorFlow中的一个函数,它的全称是“Tensorflow Gradient of the Euclidean Norm Squared”. 简单来说,这个函数可以计算张量的梯度。

在机器学习中,梯度是一个非常重要的概念,它可以帮助我们优化模型,使得模型的表现更好。

二、tenengrad函数的用法在TensorFlow中,我们可以使用tf.norm函数来计算张量的欧几里得范数。

而tenengrad函数则是在这个基础上计算梯度。

下面是tenengrad函数的基本用法:```pythonimport tensorflow as tfx = tf.Variable([1.0, 2.0, 3.0])with tf.GradientTape() as tape:y = tf.norm(x)**2grads = tape.gradient(y, x)print(grads)```在这个例子中,我们定义了一个张量x,并使用tf.norm函数计算了它的欧几里得范数的平方。

然后,我们使用tf.GradientTape()来记录计算过程,并使用tape.gradient函数计算y对x的梯度。

最后,我们打印出了这个梯度。

运行这段代码,我们可以得到如下的输出:```tf.Tensor([2. 4. 6.], shape=(3,), dtype=float32)```这个输出表示x的梯度为[2.0, 4.0, 6.0]。

这是因为y的值为14,而x的值为[1.0, 2.0,3.0],因此y对x的梯度为[2.0,4.0, 6.0]。

交叉熵损失计算过程

交叉熵损失计算过程

交叉熵损失(Cross-Entropy Loss)是一种常用于分类任务的损失函数,通常用于评估模型输出与实际标签之间的差异。

下面是交叉熵损失的计算过程:

假设有N个样本,每个样本有C个类别。

模型的输出为一个C维的向量,表示每个类别的概率分布。

实际标签表示为一个C维的独热编码向量,即只有对应类别的位置为1,其他位置为0。

1. 首先,计算每个样本的交叉熵损失:

交叉熵损失 = -Σ(y * log(y_pred))

其中,y表示实际标签的独热编码向量,y_pred表示模型输出的概率分布向量。

2. 对所有样本的交叉熵损失求平均:

平均交叉熵损失 = (1/N) * Σ(交叉熵损失)

其中,Σ表示求和符号。

通过计算交叉熵损失,可以衡量模型输出与实际标签之间的差异程度。

当模型的输出与实际标签完全一致时,交叉熵损失为最小值0;而当它们之间存在差异时,交叉熵损失会增大。

需要注意的是,在计算交叉熵损失时,可能需要对概率值进行一些处理,例如使用对数函数来避免计算中出现无穷大或无效的结果。

总结起来,交叉熵损失的计算过程包括计算每个样本的交叉熵损失,并对所有样本的损失求平均,以评估模型的性能。

Tensorflow损失函数(lossfunction)及自定义损失函数(三)

Tensorflow损失函数(lossfunction)及⾃定义损失函数(三)版权声明:本⽂为博主原创⽂章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原⽂出处链接和本声明。

本⽂链接:https:///limiyudianzi/article/details/80697711我主要分三篇⽂章给⼤家介绍tensorflow的损失函数,本篇为tensorflow⾃定义损失函数。

(⼀)tensorflow内置的四个损失函数(⼆)其他损失函数(三)⾃定义损失函数⾃定义损失函数是损失函数章节的结尾,学习⾃定义损失函数,对于提⾼分类分割等问题的准确率很有帮助,同时探索新型的损失函数也可以让你⽂章多多。

这⾥我们介绍构建⾃定义损失函数的⽅法,并且介绍可以均衡正负例的loss,以及在多分类中可以解决样本数量不均衡的loss的⽅法。

⾸先为了有⾜够的知识学会⾃定义损失函数,我们需要知道tensorflow都能实现什么样的操作。

其实答案是你常见的数学运算都可以,所以说只要你能把⼼中的损失函数表达为数学式的形式,那么你就能够将其转变为损失函数的形式。

下⾯介绍⼀些常见的函数:四则运算:tf.add(Tensor1,Tensor2),tf.sub(Tensor1,Tensor2), tf.mul(Tensor1,Tensor2),tf.div(Tensor1,Tensor2)这⾥的操作也可以被正常的加减乘除的负号所取代。

这⾥想要指出的是乘法和除法的规则和numpy库是⼀样的,是matlab中的点乘⽽不是矩阵的乘法,矩阵的乘法是tf.matmul(Tensor1, Tensor2)基础运算:取模运算(tf.mod()),绝对值(tf.abs()),平⽅(tf.square()),四舍五⼊取整(tf.round()),取平⽅根(tf.sqrt()) ,⾃然对数的幂(tf.exp()) ,取对数(tf.log()) ,幂(tf.pow()) ,正弦运算(tf.sin())。

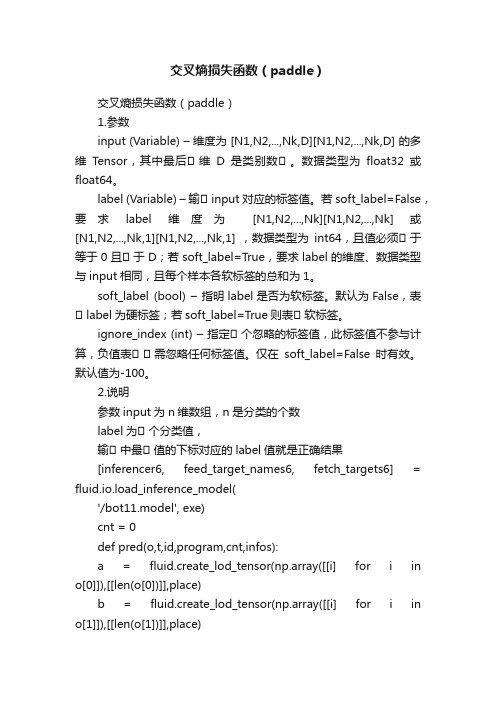

交叉熵损失函数(paddle)

交叉熵损失函数(paddle)交叉熵损失函数(paddle)1.参数input (Variable) –维度为 [N1,N2,...,Nk,D][N1,N2,...,Nk,D] 的多维Tensor,其中最后⼀维D是类别数⼀。

数据类型为float32或float64。

label (Variable) –输⼀input对应的标签值。

若soft_label=False,要求label维度为[N1,N2,...,Nk][N1,N2,...,Nk] 或[N1,N2,...,Nk,1][N1,N2,...,Nk,1] ,数据类型为int64,且值必须⼀于等于0且⼀于D;若soft_label=True,要求label的维度、数据类型与input相同,且每个样本各软标签的总和为1。

soft_label (bool) –指明label是否为软标签。

默认为False,表⼀label为硬标签;若soft_label=True则表⼀软标签。

ignore_index (int) –指定⼀个忽略的标签值,此标签值不参与计算,负值表⼀⼀需忽略任何标签值。

仅在soft_label=False时有效。

默认值为-100。

2.说明参数input为n维数组,n是分类的个数label为⼀个分类值,输⼀中最⼀值的下标对应的label值就是正确结果[inferencer6, feed_target_names6, fetch_targets6] = fluid.io.load_inference_model('/bot11.model', exe)cnt = 0def pred(o,t,id,program,cnt,infos):a = fluid.create_lod_tensor(np.array([[i] for i in o[0]]),[[len(o[0])]],place)b = fluid.create_lod_tensor(np.array([[i] for i in o[1]]),[[len(o[1])]],place)c = fluid.create_lod_tensor(np.array([[i] for i in o[2]]),[[len(o[2])]],place)d = fluid.create_lod_tensor(np.array([[i] for i in o[3]]),[[len(o[3])]],place)results = exe.run(program,feed={'a': a,'b': b,'c': c,'d': d},fetch_list=fetch_targets6,return_numpy=False)if np.argmax(results[0]) != t:cnt[0] += 1print(id,t,np.argmax(results[0]),cnt[0],infos[id-1][-1])return results3.该OP计算输⼀input和标签label间的交叉熵,可⼀于计算硬标签或软标签的交叉熵。

分类损失函数与度量损失函数

分类损失函数与度量损失函数分类损失函数和度量损失函数都是机器学习中常见的损失函数类型,被广泛应用于分类和距离度量任务中。

虽然它们在一些方面上具有相似性,但在目标和应用上存在一些明显的区别。

下面我将详细介绍这两种类型的损失函数。

1.分类损失函数-交叉熵损失函数:交叉熵是一种用于度量目标类别和预测类别之间差异的函数,常用于二分类和多分类任务。

对于一个二分类任务,交叉熵损失函数可以定义为:```L(y, \hat{y}) = -\sum_{i=1}^{n} y_i \log(\hat{y}_i) + (1 -y_i) \log(1 - \hat{y}_i),```-对比损失函数:对比损失函数主要用于度量数据间的相似性或差异性,常用于人脸识别、图像检索等任务。

最常用的对比损失函数是三元组损失函数,它通过定义一个三元组(锚点样本、正样本、负样本),使得锚点样本与正样本之间的距离小于锚点样本与负样本之间的距离。

具体地,三元组损失函数可以定义为:```L(a, p, n) = max(d(a, p) - d(a, n) + \alpha, 0),```其中 a 是锚点样本,p 是正样本,n 是负样本,d(.,.)表示样本间的距离,\alpha是一个常数用于控制样本之间的距离。

度量损失函数主要用于学习数据之间的距离或相似性的度量,常用于聚类、检索和排序等任务。

度量损失函数通常与距离度量方法(如欧氏距离、余弦相似度)结合使用,用于优化模型参数以最小化样本间的距离或最大化样本间的相似性。

-欧氏距离:欧氏距离常用于度量特征向量之间的距离,可以用于度量连续型数据的相似性。

欧氏距离可以定义为:```d(\mathbf{p}, \mathbf{q}) = \sqrt{\sum_{i=1}^{n} (p_i -q_i)^2},```其中 \mathbf{p} 和 \mathbf{q} 是特征向量。

-余弦相似度:余弦相似度常用于度量样本之间的相似度,对于稀疏特征或文本数据很有效。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

tensorflow 交叉熵损失函数

TensorFlow中的交叉熵损失函数是一种常用的在分类问题中使用的损失函数。

它基于信息论中的交叉熵概念,用于衡量模型预测结果和真实标签之间的差异。

具体而言,对于一个二分类问题,交叉熵损失函数的公式如下: $$L = -ylog(p) - (1-y)log(1-p)$$

其中,$y$表示真实标签($y=1$表示正例,$y=0$表示负例),$p$表示模型预测为正例的概率。

对于一个多分类问题,交叉熵损失函数的公式如下:

$$L = -sum_{i=1}^{C}y_ilog(p_i)$$

其中,$C$表示类别数量,$y_i$表示真实标签($y_i=1$表示属于第$i$类,$y_i=0$表示不属于第$i$类),$p_i$表示模型预测为属于第$i$类的概率。

在TensorFlow中,可以使用

tf.nn.softmax_cross_entropy_with_logits()函数来计算交叉熵损失函数。

通过该函数可以将模型的预测结果和真实标签作为输入,计算出对应的损失值。

- 1 -。