逐步回归分析教材

应用数理统计大作业1——逐步回归法分析终教学提纲

应用数理统计大作业1——逐步回归法分析终应用数理统计多元线性回归分析(第一次作业)学院:机械工程及自动化学院姓名:学号:2014年12月逐步回归法在AMHS物流仿真结果中的应用摘要:本文针对自动化物料搬运系统 (Automatic Material Handling System,AMHS)的仿真结果,根据逐步回归法,使用软件IBM SPSS Statistics 20,对仿真数据进行分析处理,得到多元线性回归方程,建立了工件年产量箱数与EMS 数量、周转箱交换周期以及AGC物料交换服务水平之间的数学模型,并对影响年产量箱数的显著性因素进行了分析,介绍了基本假设检验的情况。

关键词:逐步回归;残差;SPSS;AMHS;物流仿真目录1、引言 (1)2、逐步回归法原理 (4)3、模型建立 (6)3.1确定自变量和因变量 (6)3.2分析数据准备 (6)3.3逐步回归分析 (7)4、结果输出及分析 (9)4.1输入/移去的变量 (9)4.2模型汇总 (10)4.3方差分析 (10)4.4回归系数 (11)4.5已排除的变量 (12)4.6残差统计量 (13)4.7残差分布直方图和观测量累计概率P-P图 (14)5、异常情况说明 (15)5.1异方差检验 (15)5.2残差的独立性检验 (17)5.3多重共线性检验 (17)6、结论 (18)参考文献 (20)1、引言回归被用于研究可以测量的变量之间的关系,线性回归则被用于研究一类特殊的关系,即可用直线或多维的直线描述的关系。

这一技术被用于几乎所有的研究领域,包括社会科学、物理、生物、科技、经济和人文科学。

逐步回归是在剔除自变量间相互作用、相互影响的前提下,计算各个自变量x与因变量y之间的相关性,并在此基础上建立对因变量y有最大影响的变量子集的回归方程。

SPSS(Statistical Package for the Social Science社会科学统计软件包)是世界著名的统计软件之一,目前SPSS公司已将它的英文名称更改为Statistical Product and Service Solution,意为“统计产品与服务解决方案”。

气象统计方法:第7章 逐步回归方法

其中,U (0) 表示回归方程中无任何因 子时的回归平方和,此时为0。

假如在p个因子中,xk 的方差贡献最 大,记为 Vmax ,则据回归系数的检验 公式遵从F分布的统计量进行检验:

F

Vmax Q (1)

n l 1

若显著,则引进该因子。(l=1)

第七章 逐步回归方法

引言

在气象预报中,对预报量的预报常常需要从 可能影响预报y的诸多因素中挑选一批关系较好 的作为预报因子,应用多元线性回归的方法建立 回归方程来做预报,但如何才能保证在已选定的 一批因子中得到最优的回归方程呢?逐步回归分 析方法就是针对这一问题提出的一种常用方法。 下面从提出这一方法的基本思路、这一方法的计 算过程出发来作介绍。

在剔除因子过程中,假如 x1 x2 方差贡献都比较小,我们只能剔除其中 的最小者,而不应该全部去掉。因为这 两个因子之间可能存在密切相关关系, 剔除第一个因子后,其对y的影响可能 很大程度转移到第二x1 个因子对y的影响 上。所以回归平方和不会因此减小很多。 但如果同时去掉两个因子,就会比较多 的减少回归平方和,从而影响回归的精 度。

设到l步,方程已有l个因子。若考虑从p-l个因

子中引进哪个变量时,还是要考察他们各个因

子引进后的方差贡献,仍选取最大者,记为

Vmax ,使用统计量 F

Vmax Q (l 1)

n (l 1) 1

作检验,其中 Q(l1) 表示在将要引入回归方 程中的l+1个因子时,回归方程的残差平方 和。如此在方程中逐个地引入因子。

注意:

这样得到的方程并不能保证 其中所有因子都是显著的。因为 各因子之间存在相关关系,所以 引入新变量后,原有的变量就不 一定仍然显著。

第一讲 逐步回归分析讲解

2 1 4 2

A(0)

1

1.5

3

4

4

3

10

5

0.5 0.5 2 1

A(1)

0.5

1

1 3

2

1 2 1

1.5-1×0.5=1 3-1×2=1 4-1×1=3

0.5-0.5×(-0.5)=0.75 2-0.5×1=1.5 1-0.5×3=2.5

SS

1b1

SP12 b2

SP13b3

SP1y

SP21b1 SS 2b2 SP23b3 SP2 y

SP31b1 SP32b2 SS 3b3 SP3y

2b1 1b2 4b3 2 1b1 1.5b2 3b3 4 4b1 3b2 10b3 5

x5

y,%

68.6

70.9

62.2

66.7

57.3

60.5

56.7

60.5

58.0

58.9

x

17.2

13.3

10.3

64.4

62.5

63.4

s

4.1

3.8

4.4

7.0

5.6

3.8

一、计算相关系数阵

1、计算各变量的平均数(为表1—1) 设自变量x1,x2,…,xm与依变量y存在线性关系,m元线性回归 方程为:

由x估测y的估计值 yˆ 的直线回归方程: yˆ =a+bx

第一节 逐步回归分析的基本方法

逐步回归分析的基本方法可以通过一个实例介绍其分析步骤。 例1 为考察舍内干球温度(x1)、湿球温度(x2)、露点温度(x3)、相对湿 度(x4)及舒适度指数(x5)对罗曼蛋鸡产蛋率(y)的影响。随机抽测12个位点 各64只鸡在56—67周令的平均周产蛋率如表1—1。

自变量的选择与逐步回归实用回归分析ppt课件

§5.2 所有子集回归

准则2 赤池信息量AIC达到最小

设回归模型的似然函数为L(θ,x), θ的维数为p,x为样本,在 回归分析中样本为y=(y1,y2,…yn)′,则AIC定义为:

AIC=-2lnL(θˆ L ,x)+2p 其中θˆ L 是θ的极大似然估计,p 是未知参数的个数。

§5.2 所有子集回归

βˆ p (Xp X p )-1 Xpy

ˆ

2 p

n

1 p

1 SSEp

§5.1 自变量选择对估计和预测的影响

二、自变量选择对预测的影响

关于自变量选择对预测的影响可以分成两种情况: 第一种情况是全模型正确而误用了选模型; 第二种情况是选模型正确而误用了全模型式。

§5.1 自变量选择对估计和预测的影响

(一)全模型正确而误用选模型的情况

性质 1. 在 xj与 xp+1, …,xm的相关系数不全为 0 时,选模型回归系数的 最小二乘估计是全模型相应参数的有偏估计,即

E(ˆ jp ) jp j (j=1,2, …,p)。

§5.1 自变量选择对估计和预测的影响

(一)全模型正确而误用选模型的情况 性质 2. 选模型的的预测是有偏的。 给定新自变量值x0p (x01, x02,, x0m ) ,因变量新值为 y0=β0+β1x01+β2x02+…+βmx0m+ε0 用选模型的预测值为

(ˆ 0p ,ˆ 1p ,,ˆ pp )

全模型的最小二乘参数估计为βˆ m (ˆ 0m ,ˆ 1m ,,ˆ mm )

这条性质说明 D(ˆ jp ) D(ˆ jm ), j 0,1,, p 。

§5.1 自变量选择对估计和预测的影响

(一)全模型正确而误用选模型的情况

回归分析的基本思想及其初步应用(第1课时)教案及说明

1.1回归分析的基本思想及其初步应用(第1课时)教案教材:人民教育出版社A版必修3授课教师:中卫市第一中学俞清华【教学目标】在《数学③(必修)》之后,学生已经学习了两个变量之间的相关关系,包括画散点图,最小二乘法求回归直线方程等内容.在人教A版选修1-2第一章第一节“回归分析的基本思想及其初步应用”这一节中进一步介绍回归分析的基本思想及其初步应用.这部分内容《教师用书》共计4课时,第一课时:介绍线性回归模型的数学表达式,解释随机误差项产生的原因,使学生能正确理解回归方程的预报结果;第二课时:从相关系数、相关指数和残差分析角度探讨回归模型的拟合效果,以及建立回归模型的基本步骤;第三课时:介绍两个变量非线性相关关系;第四课时:回归分析的应用. 本节课是第一课时的内容.1、知识与技能目标认识随机误差;2、过程与方法目标(1)会使用函数计算器求回归方程;(2)能正确理解回归方程的预报结果.3、情感、态度、价值观通过本节课的学习,加强数学与现实生活的联系,以科学的态度评价两个变量的相关性,理解处理问题的方法,形成严谨的治学态度和锲而不舍的求学精神.培养学生运用所学知识,解决实际问题的能力.教学中适当地利用学生合作与交流,使学生在学习的同时,体会与他人合作的重要性.【教学重点】随机误差e的认识【教学难点】随机误差的来源和对预报变量的影响【教学方法】启发式教学法【教学手段】多媒体辅助教学【教学流程】【教学过程设计】.几点注明:1、复习引入时教师做示范——提供5组身高与体重的数据,用Excel展示如何画散点图、用最小二乘法求线性回归方程.随机抽样并列表如下:2、计算机做散点图的步骤如下:(1)进入Excel软件操作界面,在A1,B1分别输入“身高”和“体重”,在A,B 列输入相应的数据.(2)点击“图表向导”图标,进入“图表类型”对话框,选择“标准类型”中的“XY散点图”,单击“下一步”.(3)在“图表向导”中的“图表数据源”对话框中,选择“系列”选项,单击“添加”按钮添加系列1,在“X值”栏中输入身高所在数据区域,在“Y值”栏中输入体重所在数据区域,单击“下一步”.(4)进入“图表向导”中的图表选项对话框,对图表的一些属性进行设置. (5)单击“完成”按钮.注:也可以直接使用我们提供的文件来给学生演示,相对节约课堂时间.3、学生使用函数计算器求回归方程的过程如下:MODE SHIFT CLR =1 13 , DT 165 49 ,DT17565, DT 165 58 , DT 157 51 , DT 170 53 SHIFT CLRSHIFTCLR2==1 (进入回归计算模式)(清除统计存储器)(输入五组数据)所以回归方程为 yˆ0.673x-56.79 (计算参数a) (计算参数b)(学生还会使用更先进的计算器)4、课堂使用的数据如下高二女生前15组数据列表:高二女生中间15组数据列表:高二女生后15组数据列表:课本P2例题1 女大学生8组数据列表:例1.1.1回归分析的基本思想及其初步应用(第1课时)教案说明教材:人民教育出版社A版必修3授课教师:中卫市第一中学俞清华1、设计理念《数学课程标准》明确指出:有效的数学学习活动不能单纯地模仿与记忆,动手实践、自主探索与合作交流,可以促进学生自主、全面、可持续的发展,是学生学习数学的重要方式.为使教学真正做到以学生为本,我对教材P2—P3的知识进行了适当地重组和加工,力求给学生提供研究、探讨的时间与空间,让学生充分经历“做数学”的过程,促使学生在自主中求知,在合作中获取,在探究中发展.2、授课内容的数学本质与教学目标定位回归分析,是一种从事物因果关系出发进行预测的方法.操作中,是在掌握大量观察数据的基础上,利用数理统计方法建立因变量与自变量之间的回归关系函数表达式(称回归方程式),预测今后事物发展的趋势.然而,所建立的回归方程与样本点的分布之间还存在有差异,这一差异就是我们本节课学习的主要内容:随机变量.3、学习本课内容的基础以及应用本课内容安排在《数学3(必修)》之后,学生已经学习了两个变量之间的相关关系,包括画散点图,会利用最小二乘法求回归直线方程等内容.以此为基础,进一步讨论一元线性回归模型,分析产生模型中随机误差项的原因,从而让学生了解线性回归模型与函数模型之间的区别与联系,体会统计思维与确定性思维的区别与联系.通过本节课的学习,为后继课程了解偏差平方和分解思想和相关指数的含义、了解相关指数R2和模型拟合的效果之间的关系、了解残差图的作用,体会什么是回归分析、回归分的必要性,都起到铺垫作用.在本节课的教学中,学生使用了函数计算器,教师则利用电脑Excel表格完成对数据的整理,需要学生有一定的动手能力.4、学习本课内容时容易了解与容易误解的地方由于学生对必修3中的线性回归知识已经熟悉,会抽取样本、会画散点图、会利用最小二乘法求出线性回归方程,所以本节课学生容易了解:(1)从散点图看出,样本点呈条状分布,体重与身高具有线性相关关系,因此可以用线性回归方程来近似刻画它们之间的关系.(2)可以发现样本点并不完全落在回归方程上,有随机误差存在.(3)容易理解由一条回归方程预测到的身高172cm的女生体重不是都一样,它只是一个平均值.在学习过程中,相对不易理解的地方有:(1)对于随机误差的来源,学生是能够从样本的个体差异上来理解的,但是对于由用线性回归模型近似真实模型所引起的误差,学生理解还是有一定困难的.(2)随机误差对预报变量的影响,学生从感性上很好理解,当然是随机误差越小越好.但是从理性上认识,怎样从数据上刻画出随机误差是否变小了呢?学生还有困难.5、本节课的教法特点以及预期效果分析5.1 改造创新教师通过分析教材和学生认知规律,创造性地使用教材,做到既重视教材,更重视学生.具体说来有以下改造:(1)创设生活情景.利用学生的“体检经验”设置问题,既没有脱离课本例题1的相关内容,又能激发学生对数学的亲切感,引发学生看个究竟的冲动,兴趣盎然地投入学习.(2)充分体现随机观念.课本上仅仅希望利用8组数据就要学生体会到统计的思想和后继课程中回归分析的必要性,实在是为难学生了.在本课教学设计学生操作时强调“增多数据,加强比较”. 帮助学生体会“不同事件(如课本例1女大学生和高二女生)”,则统计结果不同、“同一事件(如都是高二女生),采样不同结果也不同”的基本事实.(3)教师的作用. 在这节课里,教师在学生操作结束后,利用更多数据的操作,形成一个与学生结果的对比,这一操作与展示为学生创造了新的思维增长点,引领学生进入更深层领悟.5.2 问题性本课教学以问题引导学习活动,通过恰时恰点地提出问题,提好问题,给学生提问的示范,使他们领悟发现和提出问题的艺术,引导他们更加主动和有兴趣地学,逐步培养学生的问题意识,孕育创新精神.例如,在“结果的分析”中的问题4、“预测出的体重值都不同,那么它还有参考价值吗?”目的是让学生充分认识随机误差e的来源和对预报变量的影响,而这一问题的提出,立刻吸引学生细细体会随机观念,同时激发出学生的好奇心,提升深入探求的欲望.5.3 合作、探究的学习方式本节课的合作学习体现在两个方面:除了体现在每个小组内部成员之间,还体现在整堂课的教学结构上.小组成员内部提倡“不同的人作不同的事”,面对不同分组,学生可以自主选择的不同工作,动手带动动脑,遇到小的问题,通过探讨和帮助,能做到“学生的问题由学生自己解决”,促进对某一问题更清晰的认识,还能感受到团结合作的好处与必要.同时,每个小组的劳动成果共同构成课堂教学需要的多条回归方程,组与组之间的合作推动整节课的比较与区分得以实现.5.4教学手段本课积极将数学课程与信息技术进行整合,采用多种技术手段,特点主要体现如下:(1)以PPT 为操作平台,界面活泼,操作简单,能有效支持多种其它技术;(2)教师用Excel图表展示,直观形象,节约时间,帮助学生顺利完成学习内容;(3)学生使用函数计算器动手操作,求出回归方程.本课预期:(1)学生可以很好地复习使用函数计算器求回归方程,虽然在要求学生自己操作前教师有一个示例,但是还是会有一少部分人不会使用,所以在教学前要有一定的思想准备,和必要措施.(2)在分析各个组的预测结果为什么有差异时,由于个体经验不同,对问题的挖掘深度产生不同,这时教师的启发引导可能会十分必要,不能完全由学生漫无目的的“讨论”,使学生活动流于形式.(3)“结果分析”前,由学生展示操作成果,这些结果已经够用来说明问题,教师不要急于参与.在“结果分析”的第4个问题中引入教师利用电脑求出的由45 组数据得到的回归方程,让学生再一次通过比较得到新的思考点——怎样知道自己模拟的回归方程身高变化对体重变化影响有多大呢?这样会使学生自然而然渴望进一步了解相关回归分析的知识,为后继课程做好伏笔.对于体现本节课承上启下的作用,可能更好一些.6 教学反思通过本节课的教学实践,我再次体会到什么是由“关注知识”转向“关注学生”,在教学过程中,注意到了由“给出知识”转向“引起活动”,由“完成教学任务”转向“促进学生发展”,课堂上的真正主人应该是学生.一堂好课,师生一定会有共同的、积极的情感体验.本节课的教学中,知识点均是学生通过探索“发现”的,学生充分经历了探索与发现的过程.教学中没有以练习为主,而是定位在知识形成过程的探索,注重数学的思想性,如统计思想、随机观念、函数思想、数形结合的思想方法等,引导学生体验数学中的理性精神,加强数学形式下的思考和推理。

数学建模之逐步回归分析(精品讲义)

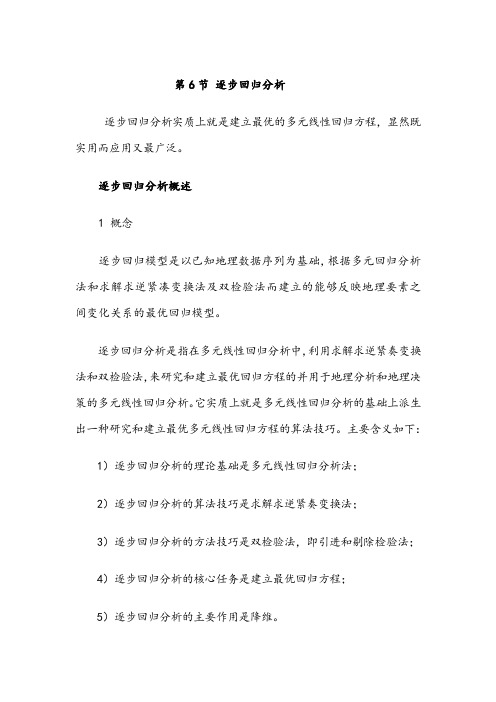

第6节逐步回归分析逐步回归分析实质上就是建立最优的多元线性回归方程,显然既实用而应用又最广泛。

6.1逐步回归分析概述1 概念逐步回归模型是以已知地理数据序列为基础,根据多元回归分析法和求解求逆紧凑变换法及双检验法而建立的能够反映地理要素之间变化关系的最优回归模型。

逐步回归分析是指在多元线性回归分析中,利用求解求逆紧奏变换法和双检验法,来研究和建立最优回归方程的并用于地理分析和地理决策的多元线性回归分析。

它实质上就是多元线性回归分析的基础上派生出一种研究和建立最优多元线性回归方程的算法技巧。

主要含义如下:1)逐步回归分析的理论基础是多元线性回归分析法;2)逐步回归分析的算法技巧是求解求逆紧奏变换法;3)逐步回归分析的方法技巧是双检验法,即引进和剔除检验法;4)逐步回归分析的核心任务是建立最优回归方程;5)逐步回归分析的主要作用是降维。

11主要用途:主要用于因果关系分析、聚类分析、区域规划、综合评价等等。

2 最优回归模型1)概念最优回归模型是指仅包含对因变量有显著影响的自变量的回归方程。

逐步回归分析就是解决如何建立最优回归方程的问题。

2)最优回归模型的含义最优回归模型的含义有两点:(1)自变量个数自变量个数要尽可能多,因为通过筛选自变量的办法,选取自变量的个数越多,回归平方和越大,剩余平方和越小,则回归分析效果就越好,这也是提高回归模型分析效果的重要条件。

(2)自变量显著性自变量对因变量y 有显著影响,建立最优回归模型的目的主要是用于预测和分析,自然要求自变量个数尽可能少,且对因变量y 有显著影响。

若自变量个数越多,一方面预测计算量大,另一方面因n 固定,所以Q S k n Q →--1增大,即造成剩余标准差增大,故要求自变量个数要适中。

且引入和剔除自变量时都要进行显著性检验,使之达到最优化状态,所以此回归方程又称为优化模型。

3 最优回归模型的选择方法最优回归模型的选择方法是一种经验性发展方法,主要有以下四种:(1)组合优选法组合优选法是指从变量组合而建立的所有回归方程中选取最优着。

逐步回归分析

这样,我们得到矩阵

在这个矩阵中,第1行最后一列的元素可以用于 建立一元线性回归模型。如果我们只打算引入一个关 系最密切的变量,则在数据标准化的情况下,可以建 立如下模型

6.2.3 第二轮计算 (1)计算自变量的贡献系数

(2)找出最大和最小贡献系数及其对应的变量序号

§6.1 基本原理

多元逐步回归方法的基本思路:自动地从大 量的可供选择的变量中选取最重要的变量,据以 建立回归分析的预测或者解释模型。

变量选取的根据是自变量对因变量作用程度 的大小:保留作用程度大的变量,剔除作用小的 变量。是否选取一个变量,定量判据之一就是相 关系数。假定有m 个自变量,1 个因变量(用y 表示),则全部变量(包括自变量和因变量)之 间的相关系数矩阵可以表作

一个统计判据——F 检验。设定一个显著性水平 α,查F 检验表,找到F 检验的临界值Fα。

在第l步计算中,假如第v个自变量的贡献系 数最大,数值为

根据F 检验来判断该自变量是否应该被引入模型。 式中h 为尚且没有被引入模型的变量序号,v 为 选出的变量对应的原始变量序号(v=1,2,…,m)。 计算变量引入的F 值判断公式如下

根据相关系数定义一个自变量的“贡献”

系数 ——按照贡献系数的大小决定一个自变量的去留。

式中Pj表示第j 个自变量对因变量的贡献系数,Rjy 表示第j 个自变量与因变量的相关系数,Rjj 表示相 关系数矩阵对角线上第j 行第j 列元素

(j=1,2,ห้องสมุดไป่ตู้,m)。

——第l 步计算的贡献系数表示为

在逐步回归分析过程中,我们不仅要引入 贡献最大的自变量,同时要考虑剔除贡献最小 的因变量。因此,变量的存留与否又涉及到另

SAS第三十三课逐步回归分析

第三十三课 逐步回归分析一、 逐步回归分析在一个多元线性回归模型中,并不是所有的自变量都与因变量有显著关系,有时有些自变量的作用可以忽略。

这就产生了怎样从大量可能有关的自变量中挑选出对因变量有显著影响的部分自变量的问题。

在可能自变量的整个集合有40到60个,甚至更多的自变量的那些情况下,使用“最优”子集算法可能并不行得通。

那么,逐步产生回归模型要含有的X 变量子集的自动搜索方法,可能是有效的。

逐步回归方法可能是应用最广泛的自动搜索方法。

这是在求适度“好”的自变量子集时,同所有可能回归的方法比较,为节省计算工作量而产生的。

本质上说,这种方法在每一步增加或剔除一个X 变量时,产生一系列回归模型。

增加或剔除一个X 变量的准则,可以等价地用误差平方和缩减量、偏相关系数或F 统计量来表示。

无疑选择自变量要靠有关专业知识,但是作为起参谋作用的数学工具,往往是不容轻视的。

通常在多元线性模型中,我们首先从有关专业角度选择有关的为数众多的因子,然后用数学方法从中选择适当的子集。

本节介绍的逐步回归法就是人们在实际问题中常用的,并且行之有效的方法。

逐步回归的基本思想是,将变量一个一个引入,引入变量的条件是偏回归平方和经检验是显著的,同时每引入一个新变量后,对已选入的变量要进行逐个检验,将不显著变量剔除,这样保证最后所得的变量子集中的所有变量都是显著的。

这样经若干步以后便得“最优”变量子集。

逐步回归是这样一种方法,使用它时每一步只有一个单独的回归因子引进或从当前的回归模型中剔除。

Efroymoson (1966)编的程序中,有两个F 水平,记作F in 和F out ,在每一步时,只有一个回归因子,比如说X i ,如果剔除它可能引起RSS 的减少不超过残差均方MSE (即ESS/(N-k-1))的F out 倍,则将它剔除;这就是在当前的回归模型中,用来检验 βi =0的F 比=MSE x x x RSS x x x x RSS i i i /)),,(),,,((121121--- 是小于或等于F out 。

《回归分析》课件 刘超——回归分析教学大纲-hep

回归分析教学大纲概述本书主要内容、特点及全书章节主要标题并附教学大纲本书基于归纳演绎的认知规律,把握统计理论的掌握能力和统计理论的应用能力的平衡,依据认知规律安排教材各章节内容。

教材不仅阐述了回归分析的基本理论和具体的应用技术,还按照认知规律适当拓宽学生思维,介绍了伴前沿回归方法。

教材采用了引例、解题思路、解题模型、概念、案例、习题、统计软件七要素合一的教材内容安排模式,有助于培养学生的统计思维与统计能力。

全书共分14章,包括绪论、一元线性回归、多元线性回归、模型诊断、自变量的问题、误差的问题、模型选择、收缩方法、非线性回归、广义线性模型、非参数回归、机器学习的回归模型、人工神经网络以及缺失数据等内容。

第1章对回归分析的研究内容和建模过程给出综述性介绍;第2章和第3章详细介绍了一元和多元线性回归的参数估计、显著性检验及其应用;第4章介绍了回归模型的诊断,对违背回归模型基本假设的误差和观测的各种问题给出了处理方法;第5章介绍了回归建模中自变量可能存在的问题及处理方法,包括自变量的误差、尺度变化以及共线性问题;第6章介绍了回归建模中误差可能存在的问题及处理方法,包括广义最小二乘估计、加权最小二乘估计;第7章介绍了模型选择方法,包括基于检验的方法、基于标准的方法;第8章介绍了模型估计的收缩方法,包括岭回归、lasso、自适应lasso、主成分法、偏最小二乘法;第9章介绍了非线性回归,包括因变量、自变量的变换以及多项式回归、分段回归、内在的非线性回归等方法;第10章介绍了广义线性模型,包括logistic回归、Softmax回归、泊松回归等;第11章介绍了非参数回归的方法,包括核估计、局部回归、样条、小波、非参数多元回归、加法模型等方法;第12章介绍了机器学习中可用于回归问题的方法,包括决策树、随机森林、AdaBoost模型等;第13章介绍了人工神经网络在回归分析中的应用;第14章介绍了常见的数据缺失问题及处理方法,包括删除、单一插补、多重插补等。

回归分析多元逐步回归

多元回归模型首先将实际问题所提取的全部变量引 入方程,然后再根据变量的显著性检验把方程中不重 要的变量逐一剔除,建立新方程。

缺点:(1)首先在实际问题中,要提取合 适的变量来建立回归方程本身不是一件很容易 的事情,变量间可能存在高度的相互依赖性会 给回归系数的估计带来不合理的解释;

有更大的回归平方和。

§2.5.1 逐步回归算法的形成思路

如此继续下去,假设已经进行到 l 1 步,那第 l 步

是在未选的变量中选出这样一个变量,它与已选入回 归方程的变量组成 元回归方程,比其他余下的任何

一个变量组成的l 元回归方程,有更大的回归平方和。

逐步回归不仅考虑到按贡献大小逐一挑选重要变量, 而且还考虑到较早选入回归方程的某些变量,有可能 随着其后一些变量的选入而失去原有的重要性,这样 的变量也应当及时从回归方程中剔除,使回归方程中 始终只保留重要的变量。

计量

F2i

Vi ( x1 , x2 ,, xl ) / 1 Q( x1,, xl ) /(n l 1)

~

F (1, n l 1)

i 1,2,, l

来检验方程中哪个自变量 可被考虑剔除出方程。

F

对于给定的水平 ,查 分布表得临界

值F (1, n l 1) F出 。 如果F2i F出 ,则 xi 应从方程中剔除; 如果 F2i F出 ,则 xi 不应从方程中剔除。 同样需要说明的是,实际问题可能有多个

(2)其次变量的一次性引入方程,易导致计 算量增大,运算效率降低,精度不够等问题。

§ 2.5 多元逐步回归算法原理

为了得到一个稳健的、可靠的回归模 型,这就需要给出一种方法,使得能从 影响 y 的因素中自动根据某种准则将y 对

现代统计分析方法与应用第7章:自变量选择与逐步回归

前面曾提到模型:

y 0 p 1 p x1 2 p x2 pp x p p

对于该模型现将它的残差平方和记为SSEp,当再增加一个新的自变量xp+1 时,相应的残差平方和记为SSEp+1。根据最小二乘估计的原理,增加自变量 时残差平方和将减少,减少自变量时残差平方和将增加。因此有:

是y0的有偏估计。 从预测方差的角度看,根据性质4,选模型的预测方差小于全模型的预 测方差,即:

ˆ ˆ Dy0 p D y0m

2

从均方预测误差的角度看,全模型的均方预测误差为:

ˆ ˆ ˆ E y0m y0 D y0m E y0m E y0

SSEp1 SSEp

又记它们的复判定系数分别为:

R p1 1

2

SSEp 1

R2 1 p

SST SSEp

SST

由于SST是因变量的离差平方和,因而:

R 21 R 2 p p

即当自变量子集在扩大时,残差平方和随之减少,而复判定系数随之增 大 。 如果按残差平方和越小越好的原则来选择自变量子集,或者为提高复相 关系数,不论什么变量只要多取就行,则毫无疑问选的变量越多越好。这 样由于变量的多重共线性,给变量的回归系数估计值带来不稳定性,加上 变量的测量误差积累,参数数目的增加,将使估计值的误差增大。如此构 造的回归模型稳定性差,使得为增大复相关系数R而付出了模型参数估计稳 定性差的代价。

管理统计逐步回归法分析报告

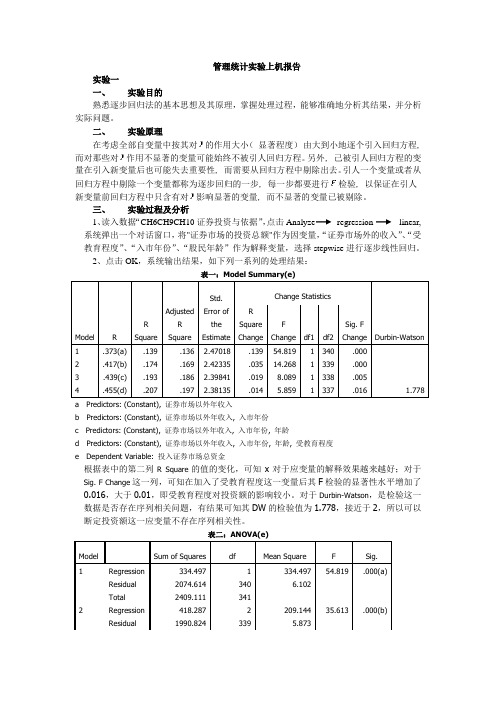

管理统计实验上机报告实验一一、实验目的熟悉逐步回归法的基本思想及其原理,掌握处理过程,能够准确地分析其结果,并分析实际问题。

二、实验原理在考虑全部自变量中按其对的作用大小(显著程度)由大到小地逐个引入回归方程, 而对那些对作用不显著的变量可能始终不被引人回归方程。

另外, 己被引人回归方程的变量在引入新变量后也可能失去重要性, 而需要从回归方程中剔除出去。

引人一个变量或者从回归方程中剔除一个变量都称为逐步回归的一步, 每一步都要进行检验, 以保证在引人新变量前回归方程中只含有对影响显著的变量, 而不显著的变量已被剔除。

三、实验过程及分析1、读入数据“CH6CH9CH10证券投资与依据”,点击Analyze regression linear,系统弹出一个对话窗口,将"证券市场的投资总额"作为因变量,“证券市场外的收入”、“受教育程度”、“入市年份”、“股民年龄”作为解释变量,选择stepwise进行逐步线性回归。

2、点击OK,系统输出结果,如下列一系列的处理结果:表一:Model Summary(e)Model RRSquareAdjustedRSquareStd.Error oftheEstimateChange StatisticsDurbin-WatsonRSquareChangeFChange df1 df2Sig. FChange1 .373(a) .139 .136 2.47018 .139 54.819 1 340 .0002 .417(b) .174 .169 2.42335 .035 14.268 1 339 .0003 .439(c) .193 .186 2.39841 .019 8.089 1 338 .0054 .455(d) .207 .197 2.38135 .014 5.859 1 337 .016 1.778a Predictors: (Constant), 证券市场以外年收入b Predictors: (Constant), 证券市场以外年收入, 入市年份c Predictors: (Constant), 证券市场以外年收入, 入市年份, 年龄d Predictors: (Constant), 证券市场以外年收入, 入市年份, 年龄, 受教育程度e Dependent Variable: 投入证券市场总资金根据表中的第二列R Square的值的变化,可知x对于应变量的解释效果越来越好;对于Sig. F Change这一列,可知在加入了受教育程度这一变量后其F检验的显著性水平增加了0.016,大于0.01,即受教育程度对投资额的影响较小。

最新人教版高中数学选修1-2《回归分析的基本思想及其初步应用》教材梳理

庖丁巧解牛知识·巧学 一、回归分析回归分析是根据变量观测数据分析变量间关系的常用统计分析方法.通常把变量观测数据称为样本.1.散点图与回归方程(1)设对y 及x 做n 次观测得数据(x i ,y i )(i=1,2,…,n).以(x i ,y i )为坐标在平面直角坐标系中描点,所得到的这张图便称之为散点图.其中x 是可观测、可控制的普通变量,常称它为自变量,y 为随机变量,常称其为因变量.知识拓展 散点图是直观判断变量x 与y 是否相关的有效手段. (2)a 与回归系数b 的计算方法若散点呈直线趋势,则认为y 与x 的关系可以用一元回归模型来描述.设线性回归方程为y=a+bx+ε.其中a 、b 为未知参数,ε为随机误差,它是一个分布与x 无关的随机变量.最小二乘估计aˆ和b ˆ是未知参数a 和b 的最好估计. x b y aˆˆ-=,b ˆ=∑∑==---ni ini i ix xy y x x121)())((.深化升华 bˆ的计算还可以用公式b ˆ=∑∑==--ni ini ii x n xyx n yx 1221来计算,这时只需列表求出相关的量代入即可. 2.相关性检验如下图中的两个散点图,很难判断这些点是不是分布在某条直线附近.假如不考虑散点图,按照最小二乘估计计算a 与b ,我们可以根据一组成对数据,求出一个回归直线方程.但它不能反映这组成对数据的变化规律.为了解决上述问题,我们有必要对x 与y 作线性相关性的检验,简称相关性检验.对于变量x 与y 随机抽取到的n 对数据(x 1,y 1),(x 2,y 2),…,(x n ,y n ),检验统计量是样本相关系数r.r=∑∑∑∑∑∑======---=----ni i ni i ni ii ni i n i i ni i iy n y x n x yx n yx y y x x y y x x122122112121)()()()())((.r 具有以下性质:当r 大于0时,表明两个变量正相关,当r 小于0时,表明两个变量负相关;|r|≤1;|r|越接近1,线性相关程度越强;|r|越接近0,线性相关程度越弱.通常当|r|大于0.75时,认为两个变量有很强的线性相关关系.相关性检验临界值如下表所示.相关性检验的临界值表深化升华 相关性检验的步骤也可如下: (1)作统计假设:X 与Y 不具有线性相关关系.(2)根据小概率0.05与n-2在相关性检验的临界值表中查出r 的一个临界值r 0.05. (3)根据样本相关系数计算公式算出r 的值.(4)作出统计推断.如果|r|>r 0.05,表明有95%的把握认为X 与Y 之间具有线性相关关系.如果|r|≤r 0.05,我们没有理由拒绝原来的假设.这时寻找回归直线方程是没有意义的. 3.回归分析的基本概念(1)在数学上,把每个效应(观测值减去总的平均值)的平方和加起来,即用∑=-ni iy y12)(表示总的效应,称为总偏差平方和.(2)数据点和它在回归直线上相应位置的差异(y i -i yˆ)是随机误差的效应,称i e ˆ=(y i -i y ˆ)为残差.(3)分别将残差的值平方后回来,用数学符号表示为∑=-ni i iy y12)(称为残差平方和.它代表了随机误差的效应.(4)总偏差平方和与残差平方和的差称为回归平方和.(5)回归效果的刻画我们可以用相关指数R 2反映.R 2=1-∑∑==--n i ini i iy y yy1212)()ˆ(.显然,R 2的值越大,说明残差平方和越小,也就是说模型的拟合效果越好.4.非线性回归问题 在实际问题中,当变量之间的相关关系不是线性相关关系时,不能用线性回归方程描述它们之间的相关关系,需要进行非线性回归分析,然而非线性回归方程一般很难求,因此把非线性回归化为线性回归应该说是解决问题的好方法.首先,所研究对象的物理背景或散点图可帮助我们选择适当的非线性回归方程yˆ=μ(x;a,b).其中a及b为未知参数,为求参数a及b的估计值,往往可以先通过变量置换,把非线性回归化为线性回归,再利用线性回归的方法确定参数a及b的估计值.问题·探究问题函数关系是一种确定性关系,而对一种非确定性关系——相关关系,我们如何研究?导思:由于相关关系不是一种确定性关系,我们经常运用统计分析的方法,即回归分析,按照画散点图,求回归方程,用回归方程预报等步骤进行.探究:我们可以知道,相关关系中,由部分观测值得到的回归直线,可以对两个变量间的线性相关关系进行估计,这实际上是将非确定性问题转化成确定性问题来研究.由于回归直线将部分观测值所反映的规律性进行了延伸,它在情况预报、资料补充等方面有着广泛的应用,从某种意义上看,函数关系是一种理想的关系模型,而相关关系是一种更为一般的情况.因此研究相关关系,不仅可使我们处理更为广泛的数学应用问题,还要使我们对函数关系的认识上升到一种新的高度.典题·热题思路解析:散点图是表示具有相关关系的两个变量的一组数据的图形.解:散点图如下:例2每立方米混凝土的水泥用量x(单位:kg)与28天后混凝土的抗压强度(单位:kg/cm2)之间的关系有如下数据:(2)如果y与x之间具有线性相关关系,求回归直线方程.思路解析:求回归直线方程和相关系数,可以用计算器来完成.在有的较专门的计算器中,可通过直接按键得出回归直线方程的系数和相关系数,而如果要用一般的科学计算器进行计算,则要先列出相应的表格,有了表格中的那些相关数据,回归方程中的系数和相关系数就都容易求出了.解:(1)r=)6.721294.64572)(20512518600(6.722051218294322⨯-⨯-⨯⨯-≈0.999>0.75.说明变量y 与x 之间具有显著的线性正相关关系.bˆ=143004347205125186006.72205121829432=⨯-⨯⨯-≈0.304, x b y aˆˆ-==72.6-0.304×205=10.28. 于是所求的线性回归方程为yˆ=0.304x+10.28. 深化升华 为了进行相关性检验,通常将有关数据列成表格,然后借助于计算器算出各个量,为求回归直线方程扫清障碍.若由资料知y 对x 有线性相关关系.试求:(1)线性回归方程yˆ=b ˆx+a ˆ的回归系数a ˆ,b ˆ. (2)使用年限为10年时,估计维修费用是多少?思路解析:因为y 对x 有线性相关关系,所以可以用一元线性相关的方法解决问题.利用公式bˆ=∑∑==--ni i ni ii x n x yx n yx 1221,aˆ=y -b ˆx 来计算回归系数.有时为了方便常列表对应写出x i y i ,x i 2,以利于求和.解:(1)x =4,y =5,∑=ni ix12=90,∑=ni ii yx 1=112.3,于是bˆ=245905453.112⨯-⨯⨯-=1.23,aˆ=y -b ˆx =5-1.23×4=0.08. (2)回归直线方程为yˆ=1.23x+0.08.当x=10年时,y ˆ=1.23×10+0.08=12.38(万元),即估计使用10年的维修费用是12.38万元.方法归纳 知道y 与x 呈线性相关关系,就无需进行相关性检验,否则,应首先进行相关性检验.如果本身两个变量不具有相关关系,或者说,它们之间相关关系不显著,即使求出了回归方程也是毫无意义的,而且估计和预测的量也是不可信的.例4一只红铃虫的产卵数y与x有关,现收集了7组观测数据列于表中,试建立y与x之间思路解析:首先要作出散点图,根据散点图判定y与x之间是否具有线性相关关系,若具有线性相关关系,再求线性回归方程.在散点图中,样本点并没有分布在某个带状区域内,因此两个变量不呈线性相关关系,所以不能直接利用线性回归方程来建立两个变量之间的关系.根据已有的函数知识,可以发现样本分布在某一指数函数曲线的周围.解:散点图如下所示:由散点图可以看出:这些点分布在某一条指数函数y=pe qx(p,q为待定的参数)的周围.现在,问题变为如何估计待定的参数p和q,我们可以通过对数变换把指数关系变为线性关系.令z=lny,则变换后样本点应该分布在直线z=bx+a(a=lnp,b=q)周围.这样就可以利用线性回归模型来建立y与x之间的非线性回归方程了.由下图可看出,变换后的样本点分布在一条直线的附近,因此可以用线性回归方程来拟合.经过计算得到线性回归方程为zˆ=0.272x-3.843.因此红铃虫的产卵数对温度的非线性回归方程为yˆ=e0.272x-3.843.方法归纳线性回归问题在解决前可以先画散点图,通过散点图判断是否为线性回归,如果不是线性回归,要先转换为线性回归问题.。

逐步回归分析(教材)

第6节逐步回归分析逐步回归分析实质上就是建立最优的多元线性回归方程,显然既实用而应用又最广泛。

逐步回归分析概述1 概念逐步回归模型是以已知地理数据序列为基础,根据多元回归分析法和求解求逆紧凑变换法及双检验法而建立的能够反映地理要素之间变化关系的最优回归模型。

逐步回归分析是指在多元线性回归分析中,利用求解求逆紧奏变换法和双检验法,来研究和建立最优回归方程的并用于地理分析和地理决策的多元线性回归分析。

它实质上就是多元线性回归分析的基础上派生出一种研究和建立最优多元线性回归方程的算法技巧。

主要含义如下: 1)逐步回归分析的理论基础是多元线性回归分析法;2)逐步回归分析的算法技巧是求解求逆紧奏变换法;3)逐步回归分析的方法技巧是双检验法,即引进和剔除检验法; 4)逐步回归分析的核心任务是建立最优回归方程;5)逐步回归分析的主要作用是降维。

主要用途:主要用于因果关系分析、聚类分析、区域规划、综合评价等等。

2 最优回归模型 1)概念最优回归模型是指仅包含对因变量有显著影响的自变量的回归方程。

逐步回归分析就是解决如何建立最优回归方程的问题。

2)最优回归模型的含义 最优回归模型的含义有两点: (1)自变量个数自变量个数要尽可能多,因为通过筛选自变量的办法,选取自变量的个数越多,回归平方和越大,剩余平方和越小,则回归分析效果就越好,这也是提高回归模型分析效果的重要条件。

(2)自变量显著性自变量对因变量y 有显著影响,建立最优回归模型的目的主要是用于预测和分析,自然要求自变量个数尽可能少,且对因变量y 有显著影响。

若自变量个数越多,一方面预测计算量大,另一方面因n 固定,所以Q S k n Q→--1增大,即造成剩余标准差增大,故要求自变量个数要适中。

且引入和剔除自变量时都要进行显著性检验,使之达到最优化状态,所以此回归方程又称为优化模型。

3 最优回归模型的选择方法最优回归模型的选择方法是一种经验性发展方法,主要有以下四种:(1)组合优选法组合优选法是指从变量组合而建立的所有回归方程中选取最优着。

初中数学教材回归分析教案

一、教学目标1. 让学生理解和掌握初中数学教材中的基本概念、性质、定理和公式,提高学生的数学基础知识和基本技能。

2. 通过回归分析,让学生了解和掌握回归分析的基本原理和方法,提高学生的数据分析能力和解决问题的能力。

3. 培养学生的逻辑思维能力、创新能力和合作能力,使学生在解决实际问题时能够灵活运用数学知识和方法。

二、教学内容1. 初中数学教材中的基本概念、性质、定理和公式的回归分析。

2. 回归分析的基本原理和方法的回归分析。

3. 实际问题中的回归分析应用。

三、教学过程1. 导入:通过一个实际问题,引发学生对回归分析的兴趣和思考,让学生意识到回归分析在解决实际问题中的重要性。

2. 基本概念、性质、定理和公式的回归分析:引导学生回顾和复习初中数学教材中的基本概念、性质、定理和公式,通过举例和练习,让学生理解和掌握这些知识和方法。

3. 回归分析的基本原理和方法的回归分析:让学生了解和掌握回归分析的基本原理和方法,通过示例和练习,让学生学会如何进行回归分析。

4. 实际问题中的回归分析应用:让学生运用回归分析的方法解决实际问题,培养学生的数据分析能力和解决问题的能力。

5. 总结和拓展:通过对回归分析的总结和拓展,让学生进一步提高对回归分析的理解和应用能力。

四、教学方法1. 讲授法:通过教师的讲解和讲解,让学生理解和掌握回归分析的基本原理和方法。

2. 案例教学法:通过实际问题的分析和解决,让学生学会如何运用回归分析的方法解决实际问题。

3. 小组合作学习法:通过小组合作学习和讨论,培养学生的合作能力和创新意识。

4. 练习法:通过课堂练习和课后作业,巩固学生对回归分析的理解和掌握。

五、教学评价1. 课堂表现评价:评价学生在课堂上的参与程度、思考能力和合作能力。

2. 练习和作业评价:评价学生对回归分析的理解和应用能力,以及解决问题的能力。

3. 实际问题解决评价:评价学生运用回归分析的方法解决实际问题的能力。

六、教学资源1. 初中数学教材。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第6节逐步回归分析逐步回归分析实质上就是建立最优的多元线性回归方程,显然既实用而应用又最广泛。

6.1逐步回归分析概述1 概念逐步回归模型是以已知地理数据序列为基础,根据多元回归分析法和求解求逆紧凑变换法及双检验法而建立的能够反映地理要素之间变化关系的最优回归模型。

逐步回归分析是指在多元线性回归分析中,利用求解求逆紧奏变换法和双检验法,来研究和建立最优回归方程的并用于地理分析和地理决策的多元线性回归分析。

它实质上就是多元线性回归分析的基础上派生出一种研究和建立最优多元线性回归方程的算法技巧。

主要含义如下:1)逐步回归分析的理论基础是多元线性回归分析法;2)逐步回归分析的算法技巧是求解求逆紧奏变换法;3)逐步回归分析的方法技巧是双检验法,即引进和剔除检验法;4)逐步回归分析的核心任务是建立最优回归方程;5)逐步回归分析的主要作用是降维。

主要用途:主要用于因果关系分析、聚类分析、区域规划、综合评价等等。

2 最优回归模型1)概念最优回归模型是指仅包含对因变量有显著影响的自变量的回归方程。

逐步回归分析就是解决如何建立最优回归方程的问题。

2)最优回归模型的含义 最优回归模型的含义有两点: (1)自变量个数自变量个数要尽可能多,因为通过筛选自变量的办法,选取自变量的个数越多,回归平方和越大,剩余平方和越小,则回归分析效果就越好,这也是提高回归模型分析效果的重要条件。

(2)自变量显著性自变量对因变量y 有显著影响,建立最优回归模型的目的主要是用于预测和分析,自然要求自变量个数尽可能少,且对因变量y 有显著影响。

若自变量个数越多,一方面预测计算量大,另一方面因n 固定,所以Q S k n Q→--1增大,即造成剩余标准差增大,故要求自变量个数要适中。

且引入和剔除自变量时都要进行显著性检验,使之达到最优化状态,所以此回归方程又称为优化模型。

3 最优回归模型的选择方法最优回归模型的选择方法是一种经验性发展方法,主要有以下四种:(1)组合优选法组合优选法是指从变量组合而建立的所有回归方程中选取最优着。

其具体过程是:(1)建立变量组合的所有回归方程(2)优选回归方程首先对每一个方程及自变量均作显著性检验,优选原则:自变量全部显著,剩余标准差较小,既可选得最优回归方程。

2)剔除优选法剔除优选法适指从包含全部自变量的回归方程中逐个剔除不显著自变量而求得最优回归方程的优选方法。

其具体过程是:(1)建立多元回归方程(2)优选回归方程剔除自变量的原则是先求取偏回归平方和最小者并作显著性检验,若不显著则剔除。

终止原则是直至不显著自变量剔除完为至,而仅保留对因变量y有显著影响的自变量。

3)引入优选法引入优选法是指将所有自变量经显著性检验而逐个引入对因变量有显著影响的自变量的优选方法。

其具体过程是:(1)建立一元回归方程(2)优选回归方程引入原则是偏相关系数绝对值最大者,引入后并进行显著性检验,若显著则继续引进自变量,直至再无显著自变量引进为止。

4)逐步回归分析法逐步回归分析法是指运用回归分析原理采用双检验原则,逐步引入和剔除自变量而建立最优回归方程的优选方法。

具体含义是:(1)每步有二个过程 即引进变量和剔除变量,且引进变量和剔除变量均需作F 检验后方可继续进行,故又称为双重检验回归分析法。

(2)引入变量 引入变量的原则是未引进变量中偏回归平方和最大者并经F 显著性检验,若显著则引进,否则终止。

(3)剔除变量 剔除原则是在引进的自变量中偏回归平方和最小者,并经F 检验不显著,则剔除。

(4)终止条件 即最优条件,再无显著自变量引进,也没有不显著自变量可以剔除,这也是最优回归方程的实质。

由此可知,它并没新的理论,只是多元回归分析基础上派生出的一种算法技巧。

现在就来介绍逐步回归分析的具体建模原理和方法步骤。

6.2逐步回归分析的数学模型逐步回归分析的数学模型是指仅包含对因变量Y 有显著影响自变量的多元线性回归方程。

为了利于变换求算和上机计算,将对其变量进行重新编号并对原始数据进行标准化处理。

6.2.1 变量重新编号 1 新编号数学模型令k x y αα=,自变量个数为k-1,则其数学模型为:113322110...--+++++=k k k x x x x x αααααβββββ式中,α=1,2,3,… ,n n :样本个数 其中:∑-=2)(k k x x S α∑-=2)ˆ(k k U x xS α ∑-=-=2)ˆ(k k U Q xx S S S α j x 的偏回归平方和为:jjj Uc b S ='k x :为k x α的算术平均值 j b :j x 的偏回归系数jj c :为逆矩阵1-L 对角线对应元素 2 回归数学模型新编号的回归数学模型为:113322110...ˆ--+++++=k k k x b x b x b x b b x6.2.2 标准化数学模型标准化回归数学模型是指将原始数据进行标准化处理后而建立的回归数学模型,即实质上是每个原始数据减去平均值后再除以离差平方和的方根。

1 标准化回归数学模型 令 jjj j S x x z -=αα j=1,2,3,… ,k其中:∑==nj j x n x 11αα∑-==2)(j jjj j x x l S α!为离差平方和的方根注意:j j j j j j S S l l ,,,2它们之间的区别,即离差平方和,离差平方和的方根,方差,标准差。

则回归数学模型为:113322110...ˆ--'++'+'+'+'=k k k z z z z zαααααβββββ 2 标准化回归数学模型的正规方程组标准化回归数学模型正规方程组的一般形式为:()()()()()()()()()()()()()()()()()()()()()()()()⎪⎪⎪⎪⎩⎪⎪⎪⎪⎨⎧='++'+'+'+'='++'+'+'+'='++'+'+'+'='++'+'+'+'='++'+'+'+'∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑---------------k k k k k k k k kk k kk k kk k k k k z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z z n αααααααααααααααααααααααααααααααααααααααααααααβββββββββββββββββββββββββ112131321211101311332323213103211233222212102111133122112101113322110.............................................................................................................................................................. 因为,0)(=-=∑∑jj j S x x z αα ,j i ji j j i ij i r S S x x x x z =--=∑∑))((αα所以上述正规方程组可变为:⎪⎪⎪⎪⎩⎪⎪⎪⎪⎨⎧='++'+'+'+='++'+'+'+='++'+'+'+='++'+'+'+=+++++'-------------k k k k k k k k kk k k k k k k k r r r r r r r r r r r r r r r rr r r r n 11113312211113113333232131211232322212111113132121110...0.................................................................0...0...000...000βββββββββββββββββ这样,数据标准化处理后的估计值0,并令,则可得数据标准化处理后的回归方程数学模型的正规方程组的一般形式为:⎪⎪⎪⎩⎪⎪⎪⎨⎧='++'+'+'='++'+'+'='++'+'+'='++'+'+'-------------k k k k k k k k k k k kk k k k k r r r r r r r r r r r r r r r r r r r r 1111331221111311333323213121123232221211111313212111........................................................................ββββββββββββββββ这样,数据标准化后0β'的估计值应为0,并j j d ='β令,则可得:⎪⎪⎪⎩⎪⎪⎪⎨⎧=++++=++++=++++=++++-------------k k k k k k k k k k k k k k k k k r d r d r d r d r r d r d r d r d r r d r d r d r d r r d r d r d r d r 1111331221111311333323213121123232221211111313212111........................................................................其中:⎪⎪⎪⎪⎪⎭⎫⎝⎛=------112111122221111211.....................k k k k k k r r r r r r r r R 称为相关系数矩阵。

⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎣⎡=-k k k k r r r B 121解此方程组,即可求出1321,,,,-k d d d d ,故可得标准化后的回归模型为:112211...ˆ--+++=k k k z d z d z d z标准化的回归模型的矩阵形式:⎥⎥⎥⎥⎥⎥⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎢⎢⎢⎢⎢⎢⎣⎡------------=------------1112221111113223211311112222211211111221211111111k k k n n n k k k k k k k k k S x x S x x S x x S x x S x x S x x S x x S x x S x x S x x S x x S x x X⎥⎥⎥⎥⎥⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎢⎢⎢⎢⎢⎣⎡----=k k nk k k k k k kkk k S x x S x x S x x S x x Y 321⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=⎥⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎢⎣⎡='=------Rnr r r r r r r r rnX X A k k k k k k 000000001121111222211112116.2.3 标准化前后回归模型的关系 1标准化前后的回归模型 1)标准化前后回归模型为:113322110...ˆ--+++++=k k k x b x b x b x b b x2)标准化后回归模型为:112211...ˆ--+++=k k k z d z d z d z2 标准化前后的偏回归系数标准化前后偏回归系数的关系可从变化过程反演得知: 令jjj j S x x z -=代入标准化前的回归模型可得:111122221111...ˆ-----++-+-=-k k k k k k k S x x d S x x d S x x d S x x 整理后得:111222111111222111)(ˆ------++++----=k k k k k k k k k k k k k k x d S Sx d S S x d S S x d S Sx d S S x d S S x x113322110...ˆ--+++++=k k k x b x b x b x b b x将上式与标准化前的回归模型作比较,由待定系数法可知标准化前后回归模型的偏回归系数的关系为:∑-=-==110k j jj k j jkj x b x b d S S b j=1,2,3,…k-1于是,只要求出j d ,即可求出j b ,今后仅讨论标准化后的回归模型。