Hive是一个构建在Hadoop上的数据仓库平台,其设计目标是

大数据知识点总结

大数据知识点总结原始数据要经过一连串收集、提取、清洗、整理等等的预处理过程,才能形成高质量的数据;按照自己的需要,比如要对数据贴标签分类,或者预测,或者想要从大量复杂的数据中提取有价值的且不易发现的信息,下面由为您整理出的大数据知识点总结内容,一起来看看吧。

1、Hadoop是一个由Apache基金会所开发的分布式系统基础架构。

用户可以在不了解分布式底层细节的情况下,开发分布式程序。

充分利用集群的威力进行高速运算和存储。

2、Hadoop实现了一个分布式文件系统(Hadoop Distributed File System),简称HDFS。

HDFS有高容错性的特点,并且设计用来部署在低廉的(low-cost)硬件上;而且它提供高吞吐量(high throughput)来访问应用程序的数据,适合那些有着超大数据集(large data set)的应用程序。

HDFS放宽了(relax)POSIX的要求,可以以流的形式访问(streaming access)文件系统中的数据。

3、Hadoop的框架最核心的设计就是:HDFS和MapReduce。

HDFS为海量的数据提供了存储,则MapReduce为海量的数据提供了计算。

4、Hadoop它主要有以下几个优点:(a)高可靠性。

Hadoop按位存储和处理数据的能力值得人们信赖。

(b)高扩展性。

Hadoop是在可用的计算机集簇间分配数据并完成计算任务的,这些集簇可以方便地扩展到数以千计的节点中。

(c)高效性。

Hadoop能够在节点之间动态地移动数据,并保证各个节点的动态平衡,因此处理速度非常快。

(d)高容错性。

Hadoop能够自动保存数据的多个副本,并且能够自动将失败的任务重新分配。

(e)低成本。

与一体机、商用数据仓库以及QlikView、Yonghong Z-Suite等数据集市相比,hadoop是开源的,项目的软件成本因此会大大降低。

5、HDFS对外部客户机而言,HDFS就像一个传统的分级文件系统。

hive项目案例

hive项目案例Apache Hive 是一个构建在Hadoop上的数据仓库工具,它提供了一个强大的SQL查询引擎,用于处理和分析大规模数据。

以下是一个简单的 Hive 项目案例,该项目旨在展示如何使用 Hive 进行数据分析和查询。

项目背景假设我们有一个电商网站,该网站每天都会产生大量的用户购买数据。

我们的目标是分析这些数据,以了解用户的购买行为和趋势。

数据源数据源是一个存储用户购买记录的CSV 文件,其中包含以下字段:用户ID、商品ID、购买时间、购买数量。

Hive 查询和分析1. 创建数据库和表首先,我们需要创建一个数据库和表来存储用户购买数据:```sqlCREATE DATABASE mydatabase; USE mydatabase;CREATE TABLE user_purchases ( user_id INT,product_id INT,purchase_time STRING,quantity INT)ROW FORMAT DELIMITED FIELDS TERMINATED BY ',';```2. 加载数据将 CSV 文件加载到 Hive 表中:```sqlLOAD DATA LOCAL INPATH '/path/to/' INTO TABLE user_purchases; ```3. 分析购买行为分析哪些商品最受欢迎:```sqlSELECT product_id, COUNT() as purchase_countFROM user_purchasesGROUP BY product_idORDER BY purchase_count DESC;```4. 分析购买趋势分析每天的购买数量:```sqlSELECT purchase_time, SUM(quantity) as total_quantityFROM user_purchasesGROUP BY purchase_timeORDER BY total_quantity DESC;```5. 分析用户偏好分析哪些商品组合最受欢迎:```sqlSELECT user_id, product_id1, product_id2, COUNT() as purchase_countFROM user_purchasesJOIN (SELECT user_id, product_id AS product_id1, product_id AS product_id2 FROM user_purchases) t2ON user__id = _id AND user__id = _id1GROUP BY user_id, product_id1, product_id2ORDER BY purchase_count DESC;```。

华为大数据练习(试卷编号141)

华为大数据练习(试卷编号141)1.[单选题]以下关于DWS数据库透明加密的特点,错误的是:( )。

A)支持行存表数据加密,不支持列存表加密B)支持集群级别配置C)使用KMS服务加密D)加密密钥层次结构有三层答案:A解析:2.[单选题]对于 Elastic Search 描述不正确的是?()A)对 Lucene 进行了扩展B)不支持结构化数据存储C)能够水平扩展D)基于 Lucene 的全文检索服务答案:B解析:3.[单选题]以下( )文件格式为纯行式存储。

A)ORC FileB)Parquet FileC)Sequence FileD)RC File答案:C解析:4.[单选题]MVCC用于解决( )事务冲突。

A)读读B)写写C)读写D)上述都包括答案:C解析:5.[单选题]Redis 中 List 列表是什么数据结构实现的?()A)红黑树B)循环链表C)平衡二叉树D)双向链表6.[单选题]以下哪个选项对 Red is 数据读写流程描述是正确的?()A)Server A 节点返回集群拓扑―一客户端选择集群任意一个 Server A 节点连接――客户端计 算Key 归属的槽位以及对应 Server B 节点并连接--Server B 节点返回业务操作结果B)客户端选择集群任意一个 Server A 节点连接――Server A 节点返回集群拓扑―一客户端计 算Key 归属的槽位以及对应 Server B 节点并连接--Server B 节点返回业务操作结果C)Server A 节点返回集群拓扑--客户端计算 Key 归属的槽位以及对应 Server B 节点并连 接――客户端选择集群任意一个 Server A 节点连接--Server B 节点返回业务操作结果D)客户端选择集群任意一个Server A节点连接――客户端计算Key 归属的槽位以及对应Server B 节点并连接――Server A 节点返回集群拓扑――Server B 节点返回业务操作结果答案:B解析:7.[单选题]CREATE TABLE AS创建表,后面需要添加查询语句类型是:( )。

大数据开发工程师招聘笔试题及解答(某大型央企)2025年

2025年招聘大数据开发工程师笔试题及解答(某大型央企)(答案在后面)一、单项选择题(本大题有10小题,每小题2分,共20分)1、大数据开发工程师在数据处理中经常使用的一种模式是将大规模数据集分成较小的部分,然后并行处理这些数据。

这种处理模式被称为:A、顺序处理B、并行处理C、串行处理D、实时处理2、大数据开发工程师需要频繁处理的数据量巨大,因此常常需要使用一些能够高效管理庞大数据集的技术。

下列哪个技术不是专门用于大数据处理的开源技术?A、HadoopB、SparkC、RedisD、Hive3、关于大数据处理的分布式技术,以下哪个选项不是常见的技术?A. Hadoop HDFSB. SparkC. NoSQL数据库D. Kafka4、在数据处理中,以下哪个指标通常用于描述数据的分布情况?A. 常数B. 标准差C. 直方图D. 频率5、下列哪种编程模型最适合用于处理大规模数据流的实时分析?A. MapReduceB. Spark StreamingC. Hadoop Batch ProcessingD. HiveQL6、在Hadoop生态系统中,哪个组件主要用于存储大量小文件会更加高效?A. HDFSB. HBaseC. HiveD. Amazon S37、大数据开发工程师在处理海量数据时,以下哪种技术通常用于提高数据处理速度和效率?A. MapReduceB. Hadoop Distributed File System (HDFS)C. Apache SparkD. NoSQL数据库8、在大数据项目中,以下哪个组件通常负责数据的清洗和预处理?A. 数据仓库B. ETL工具C. 数据挖掘模型D. 数据可视化工具9、大数据开发工程师在处理海量数据时,以下哪个工具通常用于数据的实时处理和分析?A. HadoopB. SparkC. HiveD. Storm 10、在数据仓库设计中,以下哪个数据模型是用来支持在线事务处理(OLTP)的系统?A. 星型模型B. 雪花模型C. 事实表-维度表模型D. 星网型模型二、多项选择题(本大题有10小题,每小题4分,共40分)1、下列哪些是Hadoop生态系统中的组件?A. HDFSB. MapReduceC. SparkD. MySQLE. Hive2、在Apache Kafka中,下列关于Topic的说法正确的有哪些?A. Topic是由生产者创建的。

华为HCIA-大数据认证练试题与答案-202010

华为HCIA-大数据认证练试题与答案1.下列选项中无法通过大数据技术实现的是?(A)[单选题]A.商业模式发现B.信用评估C.商品推荐D.运营分析2.FusionInsight Manager 的主要功能有以下哪些?(BCD)[多选题]A.数据集成B.系统管理C.安全管理D.服务治理3.假设每个用户最低资源保障设置为yarn,scheduler,capacity,root, QueueA.minimum-user-limit-percent=24。

则以下说法错误的是?(D)[单选题]A.第 3 个用户提交任务时,每个用户最多获得 33.33%的资源B.第 2 个用户提交任务时,每个用户最多获得 50%的资源C.第 4 个用户提交任务时,每个用户最多获得 25%的资源D.第 5 个用户提交任务时,每个用户最多获得 20%的资源4.华为大数据解决方案中平台架构包括以下哪些组成部分?(ABD)[多选题]A. Hadoop层B. FusioInght ManagerC. GaussDB 200D. DataFram5.Spark 自带的资源管理框架是?(A)[单选题]A.Standal oneB.MesosC.YARND.Docker6.关于 RDD,下列说法错误的是?(B)[单选题]A.RDD 具有血统机制(Lineage)B.RDD 默认存储在磁盘C.RDD 是一个只读的,可分区的分布式数据集D.RDD 是 Spark 对基础数据的抽象7.关于 Spark SQL&Hive 区别与联系,下列说法正确的是?(BCD)[多选题]A.Spark SQL 依赖 Hive 的元数据B.Spark SQL 的执行引擎为 Spark core,Hive 默认执行引擎为 MapReduceC.Spark SQL 不可以使用 Hive 的自定义函数D.Spark SQL 兼容绝大部分 Hive 的语法和函数8.在FusionInsight 集群中,Spark 主要与以下哪些组件进行交互?(ABCD)[多选题]A.HDFSB.YARNC.HiveD.ZooKeeper9.关于 Hive 在 FusionInsight HD 中的架构描述错误的是?(A)[单选题]A.只要有一个 HiveServer 不可用,整个 Hive 集群便不可用B.MotaStore 用于提供元数据服务,依赖于 DBServiceC.在同一时间点,HiveServer 只要一个处于Active 状态,另一个则处于Standby 状态D.HiveServer 负责接收客户端请求.解析.执行 HQL 命令并返回查询结果10.通常情况下,Hive 以文本文件存储的表会以回车作为其行分隔符,在华为FusionInsight Hive 中,可以指定表数据的输入和输出格式处理。

(完整word版)HIVE说明文档

HIVE说明文档一、HIVE简介:1、HIVE介绍Hive是一个基于Hadoop的开源数据仓库工具,用于存储和处理海量结构化数据。

它是Facebook 2008年8月开源的一个数据仓库框架,提供了类似于SQL语法的HQL语句作为数据访问接口。

Hive 是基于Hadoop 构建的一套数据仓库分析系统,它提供了丰富的SQL查询方式来分析存储在Hadoop 分布式文件系统中的数据,可以将结构化的数据文件映射为一张数据库表,并提供完整的SQL查询功能,可以将SQL语句转换为MapReduce任务进行运行,通过自己的SQL 去查询分析需要的内容,这套SQL 简称Hive SQL,使不熟悉mapreduce 的用户很方便的利用SQL 语言查询,汇总,分析数据.2、HIVE适用性:它与关系型数据库的SQL 略有不同,但支持了绝大多数的语句如DDL、DML 以及常见的聚合函数、连接查询、条件查询。

HIVE不适合用于联机(online)事务处理,也不提供实时查询功能。

它最适合应用在基于大量不可变数据的批处理作业。

HIVE的特点:可伸缩(在Hadoop的集群上动态的添加设备),可扩展,容错,输入格式的松散耦合.hive不支持用insert语句一条一条的进行插入操作,也不支持update操作。

数据是以load的方式加载到建立好的表中。

数据一旦导入就不可以修改。

DML包括:INSERT插入、UPDATE更新、DELETE删除。

3、HIVE结构Hive 是建立在Hadoop上的数据基础架构,它提供了一系列的工具,可以用来进行数据提取转化加载(ETL),这是一种可以存储、查询和分析存储在Hadoop中的大规模数据的机制,Hive定义了简单的累SQL 查询语言,称为HQL,它允许熟悉SQL的用户查询数据,同时,这个语言也允许熟悉MapReduce开发者的开发自定义的mapper和reducer来处理內建的mapper和reducer无法完成的复杂的分析工作。

大数据理论考试(试卷编号251)

大数据理论考试(试卷编号251)1.[单选题]在回归模型中,下列哪一项在权衡欠拟合(under-fitting)和过拟合(over-fitting)中影响最大()A)多项式阶数B)更新权重 w 时,使用的是矩阵求逆C)使用常数项D.使用梯度下降答案:A解析:选择合适的多项式阶数非常重要。

如果阶数过大,模型就会更加复杂,容易发生过拟合;如果阶数较小,模型就会过于简单,容易发生欠拟合。

2.[单选题]假如使用逻辑回归对样本进行分类,得到训练样本的准确率和测试样本的准确率。

现在,在数据中增加一个新的特征,其它特征保持不变。

然后重新训练测试。

则下列说法正确的是()。

A)训练样本准确率一定会降低B)训练样本准确率一定增加或保持不变C)测试样本准确率一定会降低D)测试样本准确率一定增加或保持不答案:B解析:在模型中增加更多特征一般会增加训练样本的准确率,减小偏差。

但测试样本准确率不一定增加,除非增加的特征是有效特征。

3.[单选题]下列不是数据科学项目的主要角色()。

A)项目发起人B)项目经理C)操作人员D)验收人员答案:D解析:数据科学项目涉及的主要角色有:项目发起人(Project Sponsor)、项目经理(Project Manager)、客户(Client)、数据科学家(Data Scientist)、数据工程师(Data Engineer)、操作员(Operations)等4.[单选题]以下聚合函数,用于求数据平均值的是A)MAXB)SUMC)COUNTD)AV答案:D解析:5.[单选题]Hadoop生态系统中,HBase是一种()。

A)分布式文件系统B)数据仓库C)实时分布式数据库D)分布式计算系统答案:C解析:HBase是一个面向列的实时分布式数据库。

6.[单选题]DWS的stream算子不包括下列哪个:A)broadcastB)gatherC)redistributeD)has答案:D解析:7.[单选题]关于抛出异常的说法中,描述错误的是()。

林子雨大数据技术原理与应用答案(全)

林子雨大数据技术原理及应用课后题答案大数据第一章大数据概述课后题 (1)大数据第二章大数据处理架构Hadoop课后题 (5)大数据第三章Hadoop分布式文件系统课后题 (10)大数据第四章分布式数据库HBase课后题 (16)大数据第五章NoSQl数据库课后题 (22)大数据第六章云数据库课后作题 (28)大数据第七章MapReduce课后题 (34)大数据第八章流计算课后题 (41)大数据第九章图计算课后题 (50)大数据第十章数据可视化课后题 (53)大数据第一章课后题——大数据概述1.试述信息技术发展史上的3次信息化浪潮及其具体内容。

第一次信息化浪潮1980年前后个人计算机开始普及,计算机走入企业和千家万户。

代表企业:Intel,AMD,IBM,苹果,微软,联想,戴尔,惠普等。

第二次信息化浪潮1995年前后进入互联网时代。

代表企业:雅虎,谷歌阿里巴巴,百度,腾讯。

第三次信息浪潮2010年前后,云计算大数据,物联网快速发展,即将涌现一批新的市场标杆企业。

2.试述数据产生方式经历的几个阶段。

经历了三个阶段:运营式系统阶段数据伴随一定的运营活动而产生并记录在数据库。

用户原创内容阶段Web2.0时代。

感知式系统阶段物联网中的设备每时每刻自动产生大量数据。

3.试述大数据的4个基本特征。

数据量大(Volume)据类型繁多(Variety)处理速度快(Velocity)价值密度低(Value)4.试述大数据时代的“数据爆炸”特性。

大数据摩尔定律:人类社会产生的数据一直都在以每年50%的速度增长,即每两年就增加一倍。

5.科学研究经历了那四个阶段?实验比萨斜塔实验理论采用各种数学,几何,物理等理论,构建问题模型和解决方案。

例如:牛一,牛二,牛三定律。

计算设计算法并编写相应程序输入计算机运行。

数据以数据为中心,从数据中发现问题解决问题。

6.试述大数据对思维方式的重要影响。

全样而非抽样效率而非精确相关而非因果7.大数据决策与传统的基于数据仓库的决策有什么区别?数据仓库以关系数据库为基础,在数据类型和数据量方面存在较大限制。

《大数据技术原理与应用》林子雨 课后简答题答案

《大数据技术原理与应用》林子雨课后简答题答案第一章大数据概述1. 试述大数据的四个基本特征。

数据量大:人类进入信息社会后,数据以自然方式增长,数据每两年就会增加一倍多。

数据类型繁多:大数据的数据类型非常丰富,包括结构化数据和非结构化数据,如邮件、音频、视频等,给数据处理和分析技术提出了新的挑战。

处理速度快:由于很多应用都需要基于快速生成的数据给出实时分析结果,因此新兴的大数据分析技术通常采用集群处理和独特的内部设计。

价值密度低:有价值的数据分散在海量数据中。

2. 举例说明大数据的关键技术。

大数据技术层面功能数据采集与预处理利用ETL 工具将分布在异构数据源中的数据抽到临时中间层后进行清洗、转换和集成后加载到数据仓库中,成为联机分析处理、数据挖掘的基础,也可以利用日志采集工具(如 Flume、Kafka 等)将实时采集的数据作为流计算系统的输入,进行实时处理分析。

数据存储和管理利用分布式文件系统、NoSQL 数据库等实现对数据的存储和管理。

数据处理与分析利用分布式并行编程模型和计算框架,结合机器学习和数据挖掘算法,实现对海量数据的处理和分析,并进行可视化呈现。

数据安全和隐私保护构建数据安全体系和隐私数据保护体系。

3. 详细阐述大数据、云计算和物联网三者之间的区别与联系区别联系大数据侧重于海量数据的存储、处理与分析,从海量数据中发现价值,服务于生产和生活;云计算旨在整合和优化各种 IT 资源并通过网络以服务的方式,廉价地提供给用户;物联网的发展目标是实现“ 物物相连”,应用创新是物联网的核心。

从整体上看,大数据、云计算和物联网这三者是相辅相成的。

大数据根植于云计算,大数据分析的很多技术都来自于云计算,云计算的分布式存储和管理系统提供了海量数据的存储和管理能力,分布式并行处理框架MapReduce 提供了数据分析能力。

没有这些云计算技术作为支撑,大数据分析就无从谈起。

物联网的传感器源源不断的产生大量数据,构成了大数据的重要数据来源,物联网需要借助于云计算和大数据技术,实现物联网大数据的存储、分析和处理。

大数据开发工程师招聘笔试题与参考答案2025年

2025年招聘大数据开发工程师笔试题与参考答案(答案在后面)一、单项选择题(本大题有10小题,每小题2分,共20分)1、在大数据处理中,以下哪个技术或框架主要用于实时数据流处理?A. HadoopB. SparkC. KafkaD. Flink2、在大数据存储中,HDFS(Hadoop Distributed File System)的设计目标是?A. 提供低延迟的数据访问B. 支持随机读写操作C. 提供高吞吐量的数据访问D. 适用于小型数据集3、题干:以下哪种数据结构最适合存储大规模数据集,并支持快速的数据检索?A. 数组B. 链表C. 树D. 哈希表4、题干:在分布式系统中,以下哪个组件负责处理数据分片和分布式事务?A. 数据库B. 应用服务器C. 分布式文件系统D. 分布式数据库中间件5、大数据开发工程师在处理大规模数据集时,通常使用的分布式文件系统是:A. HDFS(Hadoop Distributed File System)B. NFS(Network File System)C. SMB(Server Message Block)D. APFS(Apple File System)6、在数据仓库中,用于存储元数据的表通常被称为:A. fact table(事实表)B. dimension table(维度表)C. lookup table(查找表)D. metadata table(元数据表)7、大数据开发工程师在处理海量数据时,以下哪种技术通常用于数据存储和管理?A. 关系型数据库B. NoSQL数据库C. 文件系统D. 数据库管理系统8、在大数据技术中,以下哪个组件通常用于实现数据流处理?A. Hadoop MapReduceB. Apache KafkaC. Apache SparkD. Apache HBase9、在Hadoop生态系统中,用于进行分布式存储的是哪一个组件?A. HDFSB. YARNC. MapReduceD. Hive 10、以下哪个算法不是机器学习中的监督学习算法?A. 支持向量机(SVM)B. 决策树C. 深度学习D. K-均值聚类二、多项选择题(本大题有10小题,每小题4分,共40分)1、以下哪些技术或工具通常用于大数据开发?()A、Hadoop HDFSB、Spark SQLC、MongoDBD、ElasticsearchE、MySQL2、以下哪些算法或模型在机器学习的大数据处理中应用广泛?()A、K-Means聚类B、决策树C、神经网络D、朴素贝叶斯E、线性回归3、关于大数据开发工程师所需掌握的技术栈,以下哪些技术是必要的?()A. Hadoop生态系统(包括HDFS、MapReduce、Hive等)B. Spark大数据处理框架C. NoSQL数据库(如MongoDB、Cassandra)D. 关系型数据库(如MySQL、Oracle)E. 容器技术(如Docker)4、以下关于大数据处理流程的描述,哪些是正确的?()A. 数据采集是大数据处理的第一步,需要从各种数据源获取原始数据。

大数据开发基础(习题卷9)

大数据开发基础(习题卷9)说明:答案和解析在试卷最后第1部分:单项选择题,共57题,每题只有一个正确答案,多选或少选均不得分。

1.[单选题]我们可以利用--query参数将表的查询结果导入 HDFS 中,使用该参数时需要注意必须要和()参数一起使用。

A)--tableB)--target-dirC)--fields-terminated-byD)--where2.[单选题]关于SVM泛化误差描述正确的是()A)超平面与支持向量之间距离B)SVM对未知数据的预测能力C)SVM的误差阈值D)SVM波动范围3.[单选题]Redis 中String数据类型不含以下哪种操作?A)MgetB)sizeC)strlenD)append4.[单选题]下列语句打开文件的位置应该在( )f = open('itheima.txt', 'w')A)C盘根目录下B)D盘根目录下C)Python安装目录下D)与源文件在相同的目录下5.[单选题]由于不同类别的关键词对排序的贡献不同,检索算法一般把查询关键词分为几类,以下哪一类不属于此关键词类型的是()。

A)引用词B)普通关键词C)高频词汇D)扩展关键词6.[单选题]使用OTS Java SDK进行表操作时需要创建,以下( )不属于构造此对象时必须提供的信息。

A)实例名称B)AccountIDC)EndpointD)AccessKeySecret7.[单选题]点击率问题是这样一个预测问题,99%的人是不会点击的,而1%的人是会点击进去的,所以这是一个非常不平衡的数据集。

假设,现在我们已经建了一个模型来分类,而且有了99%的预测准确率,我们可以下的结论是()。

A)模型预测准确率已经很高了,我们不需要做什么了B)模型预测准确率不高,我们需要做点什么改进模型C)无法下结论D)以上答案都不正确8.[单选题]打开一个已有文件,在文件末尾添加信息,正确的打开方式为( )。

大数据与云计算学习(1)

⼤数据与云计算学习(1)⼤数据学习⼀、⼤数据概述:1、⼤数据概念和特征。

正确答案:⼤数据意指⼀个超⼤的、难以⽤现有常规的数据库管理技术和⼯具处理的数据集数据量⼤(Volume):存储的数据量巨⼤,PB级别是常态,因⽽对其分析的计算量也⼤。

数据类型繁多(Variety):数据的来源及格式多样,数据格式除了传统的结构化数据外,还包括半结构化或⾮结构化数据,⽐如⽤户上传的⾳频和视频内容。

⽽随着⼈类活动的进⼀步拓宽,数据的来源更加多样。

处理速度快(Velocity):数据增长速度快,⽽且越新的数据价值越⼤,这就要求对数据的处理速度也要快,以便能够从数据中及时地提取知识,发现价值。

价值密度低(Value):在成本可接受的条件下,通过快速采集、发现和分析,从⼤量、多种类别的数据中提取价值的体系架构。

复杂度(Complexity):对数据的处理和分析的难度⼤。

2、试述⼤数据时代的“数据爆炸”的特性正确答案:⼈类社会产⽣的数据以每年50%速度增长,即每两年增加⼀倍。

3、试述⼤数据对思维⽅式的重要影响?你如何理解数据思维?正确答案:三种思维的转变:全样⽽⾮抽样,效率⽽⾮精确,相关⽽⾮因果具备数据思维,能帮助创业者抓住商业机会。

⽣活中的⼤部分数据,数据思维都可以给你启发。

像AlphaGo ⼀样思考、学习、挑战、迭代AlphaGo= ⼤数据 + ⼈⼯智能 + ⼤规模计算4、举例说明⼤数据的应⽤领域正确答案:⾦融⾏业:⼤数据在⾼频交易、社区情绪分析和信贷风险分析三⼤⾦融创新领域发挥重要作⽤。

汽车⾏业:利⽤⼤数据和物联⽹技术的五⼈驾驶汽车,在不远的未来将⾛进我们的⽇常⽣活。

互联⽹⾏业:借助于⼤数据技术,可以分析客户⾏为,进⾏商品推荐和有针对性⼴告投放。

个⼈⽣活:利⽤与每个⼈相关联的“个⼈⼤数据”,分析个⼈⽣活⾏为习惯,为其提供更加周全的个性化服务。

5、云计算长定义和短定义:正确答案:长定义:云计算是⼀种商业计算模型。

它将计算任务分布在⼤量计算机构成的资源池上,使各种应⽤系统能够根据需要获取计算⼒、存储空间和信息服务。

Cloud computing理论测试部分习题答案

云计算课程理论试题部分答案1. ___执行文件系统命名空间操作()B. Namenode2. 关于基于Hadoop的MapReduce编程的环境配置,下面哪一步是不必要的()C. 安装Eclipse3.下列说法错误的是()A. MapReduce中maper conbiner reducer 缺一不可4..下面那个选项正确配置了HBASE的分布式环境。

B. 在hbase-site.xml文件中设置hbase.cluster.distributed为true5..hbase如何更新列值?C. 表格中增加新版本的值6..Hive是建立在__之上的一个数据仓库。

D. Hadoop7..Hive提供了基于SQL并使得熟悉SQL的用户能够查询数据的__。

A. QL8..对于最小粒度的任务,Hive查询的反应时间约为___。

D. 几分钟9. 按粒度大小的顺序,Hive数据被组成为:数据库,表格,__和桶。

C. 分隔10. INT整数型有多少个字节__。

C. 4 byte11.下面哪一个关于内置操作符的描述是错误的__。

C. A REGREXP B:如果字符串A与简单的SQL规则表达式B不匹配,值为TRUE,否则FALSE12..下面哪种操作是不被Hive查询语言所支持的__。

C. 在一个表格中添加索引。

13..在Ubuntu上安装Cassandra的命令是什么?C. sudo apt-get install Cassandra14..下列哪项在Cassandra中充当排序因子的角色?C. row15..作为一款分布式存储平台,你知道客户是如何通过客户端与服务器连接的吗?A. 是通过把分布在多台(或一台)服务器上卷挂载到客户端上的文件夹的方式实现客户端与服务器相连16.下列说法错误的是(D)A. MapReduce框架提供了作业队列机制B. Counters是由多个MapReduce框架或应用程序定义的全局计数器C. DistributedCache可将具体应用相关的、大尺寸、只读的文件进行有效的分布放置。

云计算与大数据技术-模拟试卷及答案(2套)

一、单项选择题(共10小题,每小题2分,共计20分)1. 大数据价值密度的高低与数据总量大小成反比,这是大数据的那个特点?()(A)Volume(数据量大)(B)Variety(数据类型多)(C)Velocity(流转速度快)(D)V alue(价值密度低)2. Hadoop 2.x比1.x相比,有什么显著变化?()(A)增加DataNode (B)增加NameNode HA(C)增加了资源管理器Y ARN (D)支持Wire-compatibility3. Google GFS的Master上保存了GFS的三种元数据,以下那种元数据不能通过日志文件恢复()。

(A)命名空间(B)Chunk与文件名的映射表(C)Chunk副本的位置信息(D)以上都不能4. 关于YARN组件说法错误的是()(A)YARN采用master/slave架构(B)主节点上运行主服务ResourceMananger(C)从节点上运行从服务NodeManager(D)YARN中引入了一个逻辑概念——槽Slot,它将各类资源抽象化5. 关于Hadoop MapReduce的执行过程,以下哪个顺序正确?()(A)输入→Reduce→Shuffle→Map→输出(B)输入→Map→Shuffle→Reduce→输出(C)输入→Shuffle→Map→Reduce→输出(D)输入→Map→Reduce→Shuffle→输出6. 只启动HDFS,启动成功后,查看JPS,下面那个进程不在其中?()(A)HMaster(B)DataNode(C)Secondary NameNode(D)NameNode7. 下面选项不属于Amazon提供的云计算服务的是()。

(A)弹性计算云服务EC2 (B)简单存储服务S3(C)简单队列服务SQS (D)Net服务8. 下列关于Hive的介绍错误的是()。

(A)Hive本身不存储和处理数据,依赖HDFS存储数据,依赖MapReduce处理数据(B)Hive是构建在Hadoop之上的一个数据仓库工具(C)数据仓库Hive不需要借助于HDFS等就可以完成数据的存储(D)Hive起源于Facebook内部信息处理平台9. ZooKeeper在集群模式下运行,那么在部署ZooKeeper集群时,至少有几个节点?()(A)4(B)3(C)2(D)110. 以下不属于Gossip协议优点的是()。

基于hive的毕业设计题目

基于Hive的毕业设计题目:题目:使用Hive进行数据仓库建设一、背景介绍随着企业业务的快速发展,数据已经成为企业的重要资产。

为了更好地管理和利用这些数据,数据仓库建设成为了一个重要的课题。

Hive是一个开源的数据仓库工具,它提供了数据存储、查询和分析等功能,非常适合用于处理大规模数据。

本毕业设计题目旨在使用Hive进行数据仓库建设,为企业提供高效的数据处理和分析能力。

二、设计目标1. 建立基于Hive的数据仓库架构;2. 实现数据的导入、存储和查询功能;3. 实现数据的分析和挖掘功能;4. 优化Hive的性能,提高数据处理效率。

三、设计思路1. 确定数据源和数据格式:首先需要确定数据源,并了解数据的格式和结构。

对于结构化数据,可以使用Hive自带的表结构进行存储;对于非结构化数据,可以使用其他工具进行转换和处理。

2. 建立Hive表:根据数据源和数据格式,建立相应的Hive表,用于存储数据。

可以使用Hive的内置函数和表达式对数据进行处理和转换。

3. 实现数据导入:可以使用Hive的导入工具将数据从数据源导入到Hive表中。

同时,可以编写Hive脚本和程序,实现数据的批量导入和定期导入。

4. 实现查询和分析功能:可以使用Hive的SQL查询语言对数据进行查询和分析。

同时,可以编写Hive脚本和程序,实现数据的分页、排序、过滤等操作。

5. 优化性能:可以通过优化Hive的配置参数、使用合适的存储格式、优化查询语句等方式,提高Hive的性能。

6. 实现数据的分析和挖掘功能:可以使用Hive与其他工具(如Hadoop、Spark等)结合,实现数据的分析和挖掘功能。

通过编写MapReduce程序或使用其他机器学习算法,对数据进行处理和分析,提取有价值的信息。

四、技术实现1. 使用Hive的导入工具将数据从数据源导入到Hive表中;2. 编写Hive脚本和程序,实现数据的批量导入和定期导入;3. 使用Hive的SQL查询语言对数据进行查询和分析,可以使用Hive的内置函数和表达式对数据进行处理和转换;4. 使用其他工具(如Hadoop、Spark等)结合Hive,实现数据的分析和挖掘功能;5. 使用Hive的分区功能,提高查询效率;6. 使用合适的存储格式(如Parquet、ORC等),减少磁盘IO次数,提高查询性能。

hive insert overwrite 动态分区原理-定义说明解析

hive insert overwrite 动态分区原理-概述说明以及解释1.引言概述部分的内容示例:1.1 概述在大数据技术领域,Hive是一种基于Hadoop的数据仓库工具,它提供了一个类似于SQL的查询语言来处理和分析大规模数据集。

而Hive 的动态分区功能是其重要的特性之一。

动态分区(Dynamic Partitioning)是指在将数据插入到Hive表中时,根据数据的某个字段自动生成分区。

相比于静态分区,动态分区更加灵活和方便,不需要提前对分区进行定义,可以根据数据的实际情况进行分区。

而Hive的Insert Overwrite命令是用来向表中插入新的数据的,当与动态分区功能结合使用时,能够实现根据数据自动生成和更新分区的能力。

本文将详细介绍Hive的Insert Overwrite动态分区的原理和工作机制,以帮助读者更好地理解并应用于实际的数据分析和处理任务中。

在接下来的章节中,我们将首先对Hive进行简要介绍,然后详细讲解Insert Overwrite动态分区的概念和原理,并在最后给出结论和应用场景,展望未来动态分区的发展趋势。

通过阅读本文,读者将能够掌握使用Hive的Insert Overwrite命令进行动态分区的方法,并了解其背后的原理和机制。

同时,还将能够运用这一功能解决实际的数据处理问题,并在今后的数据仓库建设和大数据分析中发挥重要的作用。

让我们开始深入探索Insert Overwrite动态分区的奥秘吧!文章结构部分的内容应该包括以下内容:1.2 文章结构本文将按照以下结构来介绍Hive中的Insert Overwrite动态分区原理:1. 引言:介绍本文要讨论的主题,并对文章进行概述,说明文章的结构和目的。

2. 正文:- 2.1 Hive简介:对Hive进行简要介绍,包括其定义、特点和主要应用场景,为后面动态分区的讨论提供背景信息。

- 2.2 Insert Overwrite动态分区概述:对Insert Overwrite动态分区进行基本概述,解释其作用和使用场景,引出后续原理的讨论。

大数据组件原理

大数据组件是指在处理大数据时所使用的各种软件工具和技术,它们协同工作以解决数据存储、处理、分析和可视化等问题。

以下是一些常见的大数据组件及其原理:1. Hadoop:-原理:Hadoop 是一个开源框架,它允许分布式处理大规模数据集。

它依赖于HDFS(Hadoop Distributed File System)来存储数据,以及MapReduce 来进行数据处理。

2. Spark:-原理:Spark 是一个用于大规模数据处理的开源计算引擎,它提供了比Hadoop MapReduce 更快的数据处理能力。

Spark 使用RDD(Resilient Distributed Datasets)作为其基本数据结构,支持内存计算,可以显著提高数据处理速度。

3. Hive:-原理:Hive 是一个构建在Hadoop 之上的数据仓库工具,它允许用户使用类似SQL 的查询语言(HiveQL)来查询数据。

Hive 将SQL 查询转换为MapReduce 任务进行执行。

4. Pig:-原理:Pig 是另一个构建在Hadoop 上的高级数据处理工具,它使用Pig Latin 语言来简化MapReduce 编程。

Pig 将Pig Latin 脚本转换成一系列的MapReduce 任务。

5. Impala:-原理:Impala 是一个开源的大数据查询引擎,它允许用户快速执行SQL 查询against Hive 和HBase 数据。

Impala 直接在存储层上执行查询,避免了传统MapReduce 的开销。

6. HBase:-原理:HBase 是一个分布式的、面向列的开源数据库,它是Apache 软件基金会的一部分,运行在Hadoop 文件系统上。

HBase 适合于随机实时读/写访问大数据。

7. Kafka:-原理:Kafka 是一个分布式流处理平台,它用于构建实时数据管道和流应用程序。

Kafka 能够处理高速流动的大量数据,并支持数据持久化。

林子雨大数据技术原理与应用答案(全)

林子雨大数据技术原理及应用课后题答案大数据第一章大数据概述课后题 (1)大数据第二章大数据处理架构Hadoop课后题 (5)大数据第三章Hadoop分布式文件系统课后题 (10)大数据第四章分布式数据库HBase课后题 (16)大数据第五章NoSQl数据库课后题 (22)大数据第六章云数据库课后作题 (28)大数据第七章MapReduce课后题 (34)大数据第八章流计算课后题 (41)大数据第九章图计算课后题 (50)大数据第十章数据可视化课后题 (53)大数据第一章课后题——大数据概述1.试述信息技术发展史上的3次信息化浪潮及其具体内容。

第一次信息化浪潮1980年前后个人计算机开始普及,计算机走入企业和千家万户。

代表企业:Intel,AMD,IBM,苹果,微软,联想,戴尔,惠普等。

第二次信息化浪潮1995年前后进入互联网时代。

代表企业:雅虎,谷歌阿里巴巴,百度,腾讯。

第三次信息浪潮2010年前后,云计算大数据,物联网快速发展,即将涌现一批新的市场标杆企业。

2.试述数据产生方式经历的几个阶段。

经历了三个阶段:运营式系统阶段数据伴随一定的运营活动而产生并记录在数据库。

用户原创内容阶段Web2.0时代。

感知式系统阶段物联网中的设备每时每刻自动产生大量数据。

3.试述大数据的4个基本特征。

数据量大(Volume)据类型繁多(Variety)处理速度快(Velocity)价值密度低(Value)4.试述大数据时代的“数据爆炸”特性。

大数据摩尔定律:人类社会产生的数据一直都在以每年50%的速度增长,即每两年就增加一倍。

5.科学研究经历了那四个阶段?实验比萨斜塔实验理论采用各种数学,几何,物理等理论,构建问题模型和解决方案。

例如:牛一,牛二,牛三定律。

计算设计算法并编写相应程序输入计算机运行。

数据以数据为中心,从数据中发现问题解决问题。

6.试述大数据对思维方式的重要影响。

全样而非抽样效率而非精确相关而非因果7.大数据决策与传统的基于数据仓库的决策有什么区别?数据仓库以关系数据库为基础,在数据类型和数据量方面存在较大限制。

大数据开发基础(试卷编号1121)

大数据开发基础(试卷编号1121)1.[单选题]训练样本集S含有天气、气温、人体感受、风力4个指标,已知天气的熵为0.694,温度的熵为0.859,人体感受的熵为0.952,风力的熵为0.971,如使用ID3算法,选择( )为树模型的分界点。

A)天气B)气温C)人体感受D)风力答案:A解析:信息熵(information entropy)是度量样本集合纯度最常用的一种指标,信息熵越大,变量的不确定性越大,反之越小。

树模型的分界点应选择信息熵最小的元素,本体选天气。

2.[单选题]在支持向量机中,软间隔支持向量机的目标函数比硬间隔支持向量机多了一个()A)偏置项 bB)系教C)松弛变量D)两种情况的目标函数相同答案:C解析:3.[单选题]在Hive中,如果只需要结构集的部分数据,可以通过( )子句来限定返回的行数A)limitB)sortC)fromD)order答案:A解析:4.[单选题]根据变量取名的规则,以下变量的命名,合乎规则的是( )A)6SB)S6C)whileD)123name答案:B解析:5.[单选题]为了保障流应用的快照存储的可靠性,快照主要存储在哪里?A)jobManager 的内存中B)可靠性高的单机数据库中6.[单选题]创建DRDS库的时候,每个挂载的RDS实例默认创建的库的个数为:( )。

A)16B)8C)4D)2答案:B解析:7.[单选题]下面有关分类算法的准确率、召回率、F1值的描述,错误的是()。

A)准确率是检索出相关文档数与检索出的文档总数的比率,衡量的是检索系统的查准率B)召回率是指检索出的相关文档数和文档库中所有的相关文档数的比率,衡量的是检索系统的查全率C)正确率、召回率和F值取值都在0和1之间,数值越接近0,查准率或查全率就越高D)为了解决准确率和召回率冲突问题,引入了F1分数答案:C解析:正确率、召回率取值都在0和1之间,数值越接近1,查准率或查全率就越高。

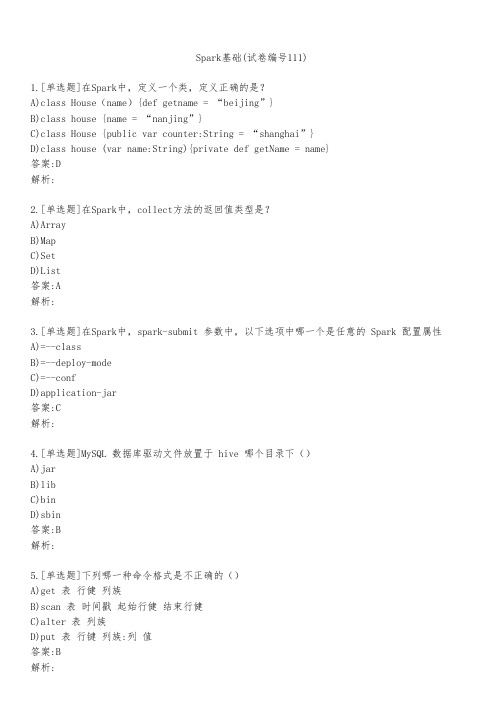

Spark基础(试卷编号111)

Spark基础(试卷编号111)1.[单选题]在Spark中,定义一个类,定义正确的是?A)class House(name){def getname = “beijing”}B)class house {name = “nanjing”}C)class House {public var counter:String = “shanghai”}D)class house (var name:String){private def getName = name}答案:D解析:2.[单选题]在Spark中,collect方法的返回值类型是?A)ArrayB)MapC)SetD)List答案:A解析:3.[单选题]在Spark中,spark-submit 参数中,以下选项中哪一个是任意的 Spark 配置属性A)=--classB)=--deploy-modeC)=--confD)application-jar答案:C解析:4.[单选题]MySQL 数据库驱动文件放置于 hive 哪个目录下()A)jarB)libC)binD)sbin答案:B解析:5.[单选题]下列哪一种命令格式是不正确的()A)get 表 行健 列族B)scan 表 时间戳 起始行健 结束行健C)alter 表 列族D)put 表 行键 列族:列 值答案:B解析:6.[单选题]调用Zookeeper对象创建的节点,不包括()。

A)持久节点B)临时节点C)持久顺序节点D)DataNode节点答案:D解析:7.[单选题]在Scala 中,定义 Set 的格式是什么A)val set=( 元素 , 元素…)B)val set=[元素 , 元素…]C)val set={ 元素 , 元素…}D)val set=Set( 元素 , 元素…)答案:D解析:8.[单选题]下列哪些操作可以设置一个监听器Watcher()A)getDataB)getChildrenC)existsD)setData答案:D解析:9.[单选题]Hive 适合()环境A)Hive 适合用于联机(online)事务处理B)提供实时查询功能C)适合应用在大量不可变数据的批处理作业D)Hive 适合关系型数据环境答案:C解析:10.[单选题]在 HBase 的组件中,哪一个负责日志记录()A)HRegionB)HFileC)MemStoreD)WAL答案:D解析:11.[单选题]在Spark中,map( )函数的参数类型是什么?D)对象答案:B解析:12.[单选题]HBase 与下列哪个选项属于同一种类型的数据库()A)MongoDBB)MariaDBC)MySQLD)Oracle答案:A解析:13.[单选题]下面关于MapReduce模型中Map函数与Reduce函数的描述正确的是()A)一个Map函数就是对一部分原始数据进行指定的操作。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

◦ 导入数据:建表后可以从本地文件系统或HDFS中导入数据文件, 导入命令如下:

load data local inpath ‘/home/hadoop/1’ overwrite into table userinfo

HiveQL的常用操作

◦ 创建分区:创建一张名为userinfo的表,表中有两列id和name, 并且对name进行分区,创建命令为:

数据在Hive里组织成表,分区和桶的形式

◦ 表:Hive里的表类似于关系数据库中的表。每个表都有一个对应的 HDFS目录。表中的数据被序列化后存储在该目录的文件中。 Hive提供了内置的序列化格式。用户还可以通过自定义序列化 和反序列化的方法去支持新的数据格式。每张表的序列化格式 存储在原数据库中,并在查询编译和执行时被自动调用。Hive 同时还支持数据存储在NFS,本地目录的外部表。

◦ Hive的体系结构

CLI JDBC/ ODBC Web GUI

Thrift Server

Metastore

Driver (Compiler, Optimizer, Executor)

Hive

Job Tracker

Name Node

Hadoop

H

Hive相关组件:

◦ 外部接口:Hive提供了例如命令行(CLI)、Web界面等用户接口, 还提供了应用程序接口(API)例如 JDBC,ODBC等。 ◦ Thrift服务器:Hive Thrift服务器是一种跨语言服务的可伸缩软件 框架。它结合律功能强大的软件堆栈的代码生成引擎,可以无缝的 与C++、C#、Java、Python、PHP和Ruby结合。Thrift允许用户 简单地定义文件中的数据类型和服务接口,编译器生成代码来实现 RPC客户端和服务器之间的通信。 Hive内部集成了Thrift服务,支持在多种语言中运行Hive命令,使 客户端可以跨平台连接Hive。

create table userinfo (id int) partitioned by (name string) row format delimited fields terminated by ‘\t’;

◦ 创建桶:可以把表或者是分区组织成桶,桶是按行分开组织特定字 段,每个桶对应一个reduce操作。在建立桶之前要设置 hive.enforce.bucketing属性,命令为:

Hive相关组件:

◦ 元数据库(Metastore):管理系统目录,通常存储在关系数据库如 MySQL,Derby中。Hive所有其他的组件都会与它进行交互。 Hive的元数据中保存了表的属性和服务信息,为查询操作提供依据, 默认的元数据库是内部的Derby,这种情况下metastore和其他 Hive服务运行在同一个Java虚拟机里,只能允许建立单个会话,要 实现多用户多会话支持,需要配置一个独立的元数据库。

Hive支持的数据类型(复杂类型)

复杂类型 大小 不限 不限 描述 一组有序字段,字段类型必须相 同 无序键值对,键值内部字段类型 必须相同

ARRAY MAP

STRUCT

不限

一组字段,字段类型可以不同

Hive提供了类似于SQL的查询语言 HiveQL。

◦ HiveQL支持选择,投影,连接,聚合,合并以及From中 嵌套的子查询语句。 ◦ HiveQL允许在创建表的时候申明表的序列化格式,分区等 HiveQL目前不支持行的删除和更新。 ◦ HiveQL支持多表的插入操作。

简介

Hive的组成 Hive的数据模型

查询语言

Hive 是一个构建在Hadoop 上的数据仓库平台,其设计目标是使 Hadoop上的数据操作与传统SQL结合,让熟悉SQL编程的开发人员 能够向Hadoop平台迁移。

Hive可以在HDFS上构建数据仓库来存储结构化的数据,这些数据来 源于HDFS上的原始数据, Hive提供了类似SQL的查询语言HiveQL, 可以执行查询,变换数据等操作。通过解析,HiveQL语言在底层被 转化为相应的MapReduce操作。

数据在Hive里组织成表,分区和桶的形式

◦ 分区:分区是表的部分列的集合。一个表可以有一个或者多个分区, 这些分区确定了数据在表目录下的分布情况。假设表T的数 据是在/wh/T目录下。如果T在列ds和ctry上被分区,那么 ds值为20090101和ctry值为US的数据将会被存储到 /wh/T/ds=20090101/ctry=US的目录下。

◦ 桶:在每个分区中的数据可以根据列的哈希值进一步划分成桶,每 个桶在分区目录下都存在一个文件中。

Hive支持的数据类型(基本类型)

基本类型 TINYINT SMALLINT INT BIGINT FLOAT DOUBLE BOOLEAN STRING 大小 1字节 2字节 4字节 8字节 4字节 8字节 ~ 最大2GB 有符号整数 有符号整数 有符号整数 有符号整数 单精度浮点数 双精度浮点数 取true/false 字符串,类似于sql的varchar 描述

Hive相关组件:

◦ 解析器(Driver):包括解释器,编译器,优化器,执行器,通过这 一系列对HiveQL查询语句的处理,最后生成查询计划。解析器管 理着HiveQL语句在编译,优化和执行时的生命周期。当接收到一 个HiveQL查询语句时,解析器会创建一个相对的句柄,这个句柄 被用来追踪执行时间,输出行数等数据。 ◦ Hadoop:数据仓库和查询计划存储在HDFS上,计算过程由 MapReduce执行。

HiveQL的常用操作

◦ 创建表:创建一张名为userinfo的表,表中有两列id和name, Hive Shell中的创建命令为:

create table userinfo (id int, name string) row format delimited fields terminated by ‘\t’; row format delimited fields terminated by ‘\t 是HiveQL特有的,用来指定数据 的分隔方式