模式识别导讲义论(五)

哈工大模式识别课件.pptx

Duda

《模式识别》(第二版),清华大学出版社,边

肇祺,张学工;

模式识别 – 绪论

期刊

IEEE Transaction on Pattern Analysis and Machine Intelligence,PAMI;

Pattern Recognition; Pattern Recognition Letter; 模式识别与人工智能;

x

2

1

2

n

exp

1 2

n n

2

d

f , n

2 n

exp

1 2

x

n 2

2

2 n

f ,n

exp

1 2

2

2 n

2 2 n

2 n

x

2

n

2

2 n

2

du

模式识别 – 绪论

3.3期望最大化算法(EM算法)

EM算法的应用可以分为两个方面:

1. 训练样本中某些特征丢失情况下,分布参数的最大 似然估计;

特征提取与选 择

识别结果 模式分类

分类 训练

分类器设计

模式识别 – 绪论

六、模式识别问题的描述

给定一个训练样本的特征矢量集合:

D x1, x2, , xn, xi Rd

分别属于c个类别:

1,2, ,c

设计出一个分类器,能够对未知类别样本x进行分类

y g x, Rd 1, ,c

模式识别 – 绪论

率满足正态分布,即:

px N , 2

p

N

0

,

2 0

模式识别 – 绪论

模式识别(国家级精品课程讲义).ppt

为若干子集, m类就有m个子集,然后根据择近原 则分类。

29

1.1 概述-模式识别的基本方法

理论基础:模糊数学 主要方法:模糊统计法、二元对比排序法、推理法、

模糊集运算规则、模糊矩阵 主要优点:

由于隶属度函数作为样本与模板间相似程度的度量, 故往往能反映整体的与主体的特征,从而允许样本有 相当程度的干扰与畸变。 主要缺点: 准确合理的隶属度函数往往难以建立,故限制了它的 应用。

式中,p(xi )是 X 的第 i 个分量的 边缘

密度。随机矢量 X 的均值矢量 的各

分量是相应的各随机分量的均值。

47

1.3 随机矢量的描述

(二)随机矢量的数字特征:

⑵ 条件期望

在模式识别中,经常 以类别 i 作为条件,在这

种情况下随机矢量 X 的条件期望矢量定义为

i E[ X | i ] X n xp(x | i )dx

34

1.1 概述-模式识别的发展简史

1929年 G. Tauschek发明阅读机 ,能够阅 读0-9的数字。

30年代 Fisher提出统计分类理论,奠定了 统计模式识别的基础。

50年代 Noam Chemsky 提出形式语言理论— —傅京荪提出句法/结构模式识别。

60年代 L.A.Zadeh提出了模糊集理论,模糊 模式识别方法得以发展和应用。

模式(Pattern):对客体(研究对象)特征的描 述(定量的或结构的描述),是取自客观世界 的某一样本的测量值的集合(或综合)。

概念

特征(Features):能描述模式特性的量(测

量值)。在统计模式识别方法中,通常用一

个矢量

x

模式识别导论习题参考答案-齐敏

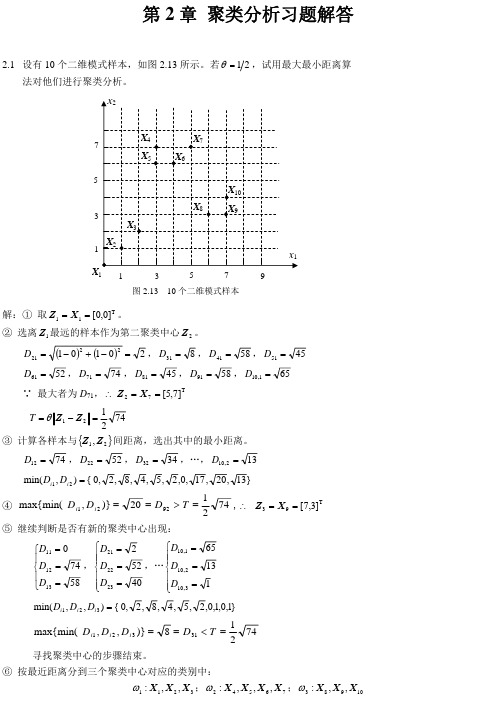

④ max{min( D i1 , D i 2 )}

20 D 92 T

1 74 , Z 3 X 9 [7,3]T 2

⑤ 继续判断是否有新的聚类中心出现:

D10,1 65 D21 2 D11 0 74 52 D D , ,… 12 22 D10, 2 13 D13 58 D23 40 D10,3 1

G2 (0)

G 3 ( 0)

G4 ( 0 )

G5 (0)

0 1 2 18 32 0 5 13

25

G3 (0)

G4 (0)

0 10 20 0

2

G5 (0)

0

(2) 将最小距离 1 对应的类 G1 (0) 和 G2 (0) 合并为一类,得到新的分类

G12 (1) G1 (0), G2 (0) , G3 (1) G3 (0), G4 (1) G4 (0) , G5 (1) G5 (0)

2

X3 X 6 ) 3.2, 2.8

T

④ 判断: Z j ( 2) Z j (1) , j 1,2 ,故返回第②步。 ⑤ 由新的聚类中心得:

X1 : X2 :

D1 || X 1 Z 1 ( 2) || X 1 S1 ( 2 ) D2 || X 1 Z 2 ( 2) || D1 || X 2 Z1 ( 2) || X 2 S1 ( 2 ) D2 || X 2 Z 2 ( 2) ||

T

(1)第一步:任意预选 NC =1, Z1 X 1 0,0 ,K=3, N 1 , S 2 , C 4 ,L=0,I=5。 (2)第二步:按最近邻规则聚类。目前只有一类, S1 { X 1 , X 2 , , X 10 },N 1 10 。 (3)第三步:因 N 1 N ,无聚类删除。 (4)第四步:修改聚类中心

《模式识别》PPT课件

有两个极端的特征选择算法,一个是单独选择法,另一个是穷举选择法。

1. 单独选择法 就是把n个特征每个特征单独使用时的可分性准则函数值都算出来,按准则

函数值从大到小排序,如 J(x1)>J(x2)>…>J(xm)>…J(xn)

然后,取使J较大的前m个特征作为选择结果。 问题:这样得到的m个特征是否就是一个最优的特征组呢?

1 Pe 1 c

另一个极端情况是,如果能有一组特征使得

此时x划归 P类(,其i /错x误)概率1为, 0。且P( j / x) 0 , j i

可见后验概率越集中,错误概率就越小。后验概率分布越平缓(接近均匀分布)

,则分类错误概率就越i 大。

为了衡量后验概率分布的集中程度,需要规定一个定量准则,我们可以借助于 信息论中关于熵的概念。

,

的函数。可定义如下形式的广义熵:

P(1 / x) P(2 / x)

P(c / x)

,

,…

式中,

是一个实的正参数,

。

J

a C

[

P

(1

/

x),

P ( 2

/

x),,

P ( c

/

x)]

c

(21a 1)1[ P a (i / x) 1] i 1

a

a1

不同的 spital法则有

a

a值可以得到不同的熵分离度量,例如当

8.1.1 基于距离的可分性准则 各类样本之间的距离越大,则类别可分

性越大。因此,可以用各类样本之间的距离的平 均值作为可分性准则

Jd

1 2

c

Pi

i 1

c

模式识别讲义_(80pp)

第一章 绪论1.1模式和模式识别模式识别是一门很受人们重视的学科。

早在30年代就有人试图以当时的技术解决一些识别问题,在近代,随着计算机科学技术的发展和应用,模式识别才真正发展起来。

从60年代至今,在模式识别领域中已取得了不少成果。

它的迅速发展和广泛应用前景引起各方面的关注。

模式识别属于人工智能范畴,人工智能就是用机器去完成过去只有人类才能做的智能活动。

在这里,“智能”指的是人类在认识和改造自然的过程中表现出来的智力活动的能力。

例如:通过视觉、听觉、触觉等感官接受图象、文字、声音等各种自然信息去认识外界环境的能力;将感性知识加工成理性知识的能力,即经过分析、推理、判断等思维过程而形成概念、建立方法和作出决策的能力;经过教育、训练、学习不断提高认识与改造客观环境的能力‘对外界环境的变化和干扰作出适应性反应的能力等。

模式识别就是要用机器去完成人类智能中通过视觉、听觉、触觉等感官去识别外界环境的自然信息的那些工作。

虽然模式识别与人工智能关系很密切,但是发展到现在,它已经形成了独立的学科,有其自身的理论和方法。

在许多领域中,模式识别已有不少比较成功的实际应用。

模式的概念:模式这个概念的内涵是很丰富的。

“我们把凡是人类能用其感官直接或间接接受的外界信息都称为模式”。

比如:文字、图片、景物;声音、语言;心电图、脑电图、地震波等;社会经济现象、某个系统的状态等,都是模式。

模式识别:模式识别是一门研究对象描述和分类方法的科学。

如,我们要听某一门课,必须做以下识别:1)看课表—文字识别;2)找教室和座位—景物识别;3)听课—声音识别。

再比如,医生给病人看病:1)首先要了解病情;问2)再做一些必要的检验;查3)根据找到的能够诊断病情的主要特征,如体温、血压、血相等,做出分类决策,即诊断。

对于比较简单的问题,可以认为识别就是分类。

如,对于识别从“0”到“9”这十个阿拉伯数字的问题。

对于比较复杂的识别问题,就往往不能用简单的分类来解决,还需要对待识别模式的描述。

模式识别导论

基于模式识别的个人认识班级自动化1002班姓名刘永福学号 1009101016摘要:本文主要介绍了模式识别的基本理论概念及算法,通过对模式识别的几种算法的概括、分析,推出算法的要求及步骤,实现样本的基本分类要求。

主要包括模式识别及模式识别系统的基本概念以及应用领域、线性判别函数的介绍及相关算法的推理证明、非线性判别函数的介绍及相关算法的推理证明。

一.模式识别及模式识别系统(1)模式识别的基本概念模式识别是以计算机为工具、各种传感器为信息来源,数据计算与处理为方法,对各种现象、事物、状态等进行准确地分析、判断识别与归类,包括人类在内的生物体的一项基本智能。

对于模式和模式识别有“广义”和“狭义”两种解释:广义地说,存在于时间和空间中可观察的事物,如果可以区别它们是否相同或相似,都可以称之为模式。

此时,模式识别是生物体(包括人)的基本活动,与感觉、记忆、学习、思维等心理过程紧密联系,是透视人类心理活动的重要窗口之一。

从这个角度讲,模式识别是研究生物体如何感知对象的学科,属于认识科学的范畴,是生理学家、心理学家、生物学家和神经生理学家的研究内容,常被称做认知模式识别。

具体来说,它是指人们把接收到的有关客观事物或人的刺激信息与他在大脑里已有的知识结构中有关单元的信息进行比较和匹配,从而辨认和确定该刺激信息意义的过程。

正是通过认知模式识别,我们才能认识世界,才能辨别出各个物体之间的差别,才能更好地学习和生活。

狭义地说,模式是为了能让计算机执行和完成分类识别任务,通过对具体的个别事物进行观测所得到的具有时间和空间分布的信息。

把模式所属的类别或同一类中模式的总体称为模式类(或简称为类)。

计算机模式识别就是指根据待识别对象的特征或属性,利用以计算机为中心的机器系统,运用一定的分析算法确定对象的类别的学科,是数学家、信息学专家和计算机专家的研究内容。

因此,模式识别的研究主要集中在认知模式识别和计算机模式识别这两个方面。

模式识别ppt课件

( x)

2.5,1.1为中心的正态曲线,而

之和。

由图看出:每个样本对估计的贡献与样本间

的距离有关,样本越多, PN(x)越准确。

例2:设待估计的p(x)是均值为0,方差为1的正

态密度函数。

若随机抽取X样本中的1个、 16个、 256个作

为学习样本xi,试用窗口法估计pN(x)。

| x xi |

(

)0

(保证 pˆ N ( x) 非负)

hN

( | x x i | )d ( | x x i | ) 0

(使 pˆ N ( x)dx 1)

hN

hN

④ 窗函数的选择

例:矩形窗、正态窗、指数窗、三角窗等等(只要

满足上述两条件,都可作为窗函数使用)

超立方体体积:VN h

d

N

其中

h1

hN

N

d=1,窗口为一线段 ; d=2,窗口为一平面

d=3,窗口为一立方体 ;d>3,窗口为一超立方体

窗口的选择:有多种选择

Φ(u)

方窗函数

Φ(u)

正态窗函数

Φ(u)

指数窗函数

hN

正态窗函数

1

1

,

|

u

|

(u )

2

0.其他

(u )

满足上述条件的区域序列(VN)有两种选择方法,

形成两种非参数估计方法:

1)Parzen窗法;

2)KN近邻估计

两者如何选择VN ?

1)Parzen窗法:

1

使体积VN以N的某个函数减小,例 VN

模式识别培训教程PPT(94张)

线条透视

结构密度

遮盖关系

(二)建构性知觉理论 (Constructive perception)

知觉是一个积极的和建构的过程

知觉并不是由刺激输入直接引起的,而 是所呈现刺激与内部假设、期望、知识以 及动机和情绪因素交互作用的产物

知觉有时可受到不正确的假设和期望影 响,因而也会发生错误

邻近物 体大小 对大小 知觉的 影响

现代观点则认为,知觉是主动 和富有选择性的构造过程。

黄希庭:“知觉是直接作用于感觉器 官的事物的整体在脑中的反映,是人对感 觉信息的组织和解释的过程。”

梁宁建:“知觉是人脑对客观事物的 各种属性、各个部分及其相互关系的综合 的整体的反映,它通过感觉器官,把从环 境中得到的各种信息,如光、声音、味道 等转化为对物体、事件等的经验的过程。”

2. “泛魔堂”模型(“魔城”模型)

通过特征分析识别一个字母R

3.特征分析的生理学依据

1981年诺贝尔医学奖获得者:Hubel & Wiesel

4.特征分析的行为学证据

Neisser(1964)英文字母扫描实验 固定影像与静止影像的实验

5.特征分析说的评论 优点:避开预加工、减轻记忆负担、带有学习

由有关知觉对象的一般知识开始的加工, 由此可以形成期望或对知觉对象形成假 设,这种期望或假设制约着加工的所有 阶段或水平。又称之为概念驱动加工 (Concept-Driven Processing)

•Tulving, Mandler & Baumal的实验

自变量

上下文情况:无上下文、4字上下文、8字上下文 (考察自上而下加工)

1982年他在《科学》杂志上原创性地提出 了“拓扑性质初期知觉”的理论,向半个世纪 以来占统治地位的理论提出了挑战。随后20多 年的时间里,在与国际上持不同学术观点的学 者的争论与交流中,他以令人信服的系列科学 实验不断地完善和论证着这一假说,使之成为 被越来越多的国际同行所接受的学说,进而成 为有国际影响力的理论,他的成果也被《科 学》、《美国科学院院报》等著名学术刊物多 次刊登。2004年,著名知觉杂志《Visual Cognition》以专辑的形式刊载了陈霖教授的 成果并配发了大量国际著名学者的评论性文章。

模式识别认知理论导引

十种模式识别认知理论简介导引人们在认知景物时,常常寻找它与其它事物的相同与不同之处,根据使用目的进行分类,人脑的这种思维能力就构成了模式和识别的能力。

所谓模式,是指若干元素或成分按一定关系形成某种刺激结构,也可以说模式是刺激的组合。

当人们能够确认他所知觉的某个模式是什么时,将它与其他模式区分开来,这就是模式识别。

例如,有人想把一大批图片分成人物、动物、风景、建筑物、其他等五种类型分别保管,上述五种类型就是五个类别,也就是五个不同的模式,分类的过程叫做模式识别。

模式有简有繁,繁杂的模式往往是由多个子模式组成。

认知心理学家西蒙认为:“人们在解决数学问题时,大多数是通过模式识别来解决的,首先要识别眼前的问题属于哪一类,然后以此为索引在记忆储存中提取相应的知识,这就是模式识别。

我们之所以关心模式识别认知理论,是因为它是建立图像(景物)理解数学模型的思想源泉。

例如:传统的模式识别理论有人把它分为五类:模板匹配模式;原型匹配模式;特征分析模式;结构描述模式;傅里叶模式。

现在图像理解中主要的数学处理方法,几乎都是源于五种传统模式识别理论而建立的,或是基于它们的变形。

近二十多年来新提出的模式识别理论有人把它分为五种:视觉计算理论;注意的特征整合理论;成分识别理论;相互作用激活理论;视觉拓扑理论。

其中,马尔(Marr)的视觉计算理论是当前计算机(机器人)视觉的主流理论。

其它的理论,也被众多探索者们作为创新的源泉。

然而,无论上述那一种模式识别理论,都存在着或多或少的片面性,迄今为止尚未形成一个较具有说服力的、普遍认可的模式识别理论。

这正是制约图像识别(计算机视觉)数学模型发展的根本所在。

下面我们将各种模式识别理论分别介绍之。

模板匹配模式(传统模式识别之一)这个模型最早是针对机器的模式识别而提出来的,后来被用来解释人的模式识别。

它的核心思想是认为在人的长时记忆中,贮存着许多各式各样的过去在生活中形成的外部模式的袖珍复本。

模式识别讲座PPT课件

11

Distance-Based Classification

Overview

Distance based classification is the most common type of pattern recognition technique

Module 4 Neural Networks for P.R.

Module 5 Clustering Module 6 Feature Selection

10

Pattern Recognition

Module 1 Distance-Based Classification

Dr. Shi, Daming

Introduction

What is Pattern Recognition

Classify raw data into the ‘category’ of the pattern.

A branch of artificial intelligence concerned with the identification of visual or audio patterns by computers. For example character recognition, speech recognition, face recognition, etc.

7

Introduction

Syntactic Pattern Recognition

Any problem is described with formal language, and the solution is obtained through grammatical parsing

模式识别基础教程PPT课件

8

典型应用

语音识别(例如:IBM ViaVoice系统) 表情分析、年龄、种族、性别分类 OCR: 车牌照、集装箱号码… 手写体识别:汉王 手势识别:基于视觉的,基于数据手套 人脸识别、指纹识别、虹膜识别… 军事目标识别 生物信息、医学图像 遥感、气象

9

模式识别方法

模板匹配 结构模式识别 句法模式识别 统计模式识别 模糊模式识别

机特征向量,用概率统计理论对其进行建模, 用统计决策理论划分特征空间来进行分类。

12

统计模式识别的一般过程

测试模式 预处理

分类

训练 预处理

训练模式

特征提 取/选择

分类

特征提 取/选择

学习分类规则 错误率检测

13

模糊模式识别

1965年Zadeh提出模糊集理论

是对传统集合理论的一种推广

传统:属于或者不属于 模糊:以一定的程度属于

这种技术具有实时性的特点,而且有可能扩展到多个姿 态的人脸检测。

18

人脸的特征表示方法

矩形特征(Harr-like特征)

矩形特征的值是所有白色矩形中点的亮度值的和减 去所有灰色矩形中点的亮度值的和,所得到的差

有4种类型的矩形特征

19

输入图像

积分图像

基于积分图像的 Haar-like特征计

7

模式分类 vs. 模式聚类

Classification Clustering

Category “A”

Categ

(Supervised Classification)

Clustering

(Unsupervised Classification)

“Good” features

“Bad” features

模式识别理论 ppt课件

• K均值聚类法—K-means Clustering Method

• 模糊聚类法—Fuzzy clustering method • PCA投影分类法等等

60

主成分分析的数学 与几何意义示意图

61

16个脑组织试样进行分析,在色谱图中

uxy yt x 12

判别阈值可取两个类心在u方向上轴的投影连线的

中点作为阈值,即:

yt

m~1 m~2 2

49

50

(7) 计算m~ i。

m ~iN 1i j y(ji)N 1i j u x(ji)u m i

(8)

计算yt 。 yt

m~1 m~2 2

(9) 对未知模式x判定模式类。

uxy yt x 12

11

模式识别常用术语

• 特征抽提(Feature Extraction) • 训练集(Training Set) • 识别率(Recognition Rate) • 预测能力(Predictive Ability)

12

注意事项

训练集的数据一定要可靠。 训练集的样本数目要足够多,样本数m与模

式空间维数n 的比值至少应满足m/n≥3,最好 m/n≥10。 模式空间特征的选择是成败的关键,要选取与 样本分类有关的特征,如果不能包括与分类有 关的主要特征,模式识别就不会有好的效果。

4

什么是模式识别

• 模式识别包括两个阶段,即学习阶段和实现阶段, 前者是对样本进行特征选择,寻找分类的规律, 后者是根据分类规律对未知样本集进行分类和识 别。

• 广义的模式识别属计算机科学中智能模拟的研究 范畴,内容非常广泛,包括声音和语言识别、文 字识别、指纹识别、声纳信号和地震信号分析、 照片图片分析、化学模式识别等等。计算机模式 识别实现了部分脑力劳动自动化。

第5讲 最近邻分类器

《模式识别》讲义 2014 版:第五讲 最近邻分类器

概率最大的类作为分类结果,而最近邻分类器则是选择 x’所对应的类,所以其 分类错误率一定是大于等于最小错误率贝叶斯分类的。 设训练集中一共有 N 个样本,则最近邻分类器的平均错误率可定义为:

PN (e) PN (e | x, x) p( x | x)dxp ( x)dx

2、 k-近邻分类器的错误率

当训练集中的样本总数 N→∞时, x 的 k 个近邻都会收敛于 x。 同时若 k→∞, k-近邻分类器的决策规则也就变成了最大后验概率贝叶斯分类, 也就是最小错误 率贝叶斯分类。 当 N→∞时,可以证明 k-近邻分类器的错误率上下界为

( k 1)/..., c

,k-近邻分类器的分类决策为 x j

第 3 页 自动化学院 模式识别与智能系统研究所 高琪 gaoqi@

《模式识别》讲义 2014 版:第五讲 最近邻分类器

图 4 k=3 和 k=9 时的 k-近邻两类分类器

对于二类问题,k 一般取奇数,便于表决。

《模式识别》讲义 2014 版:第五讲 最近邻分类器

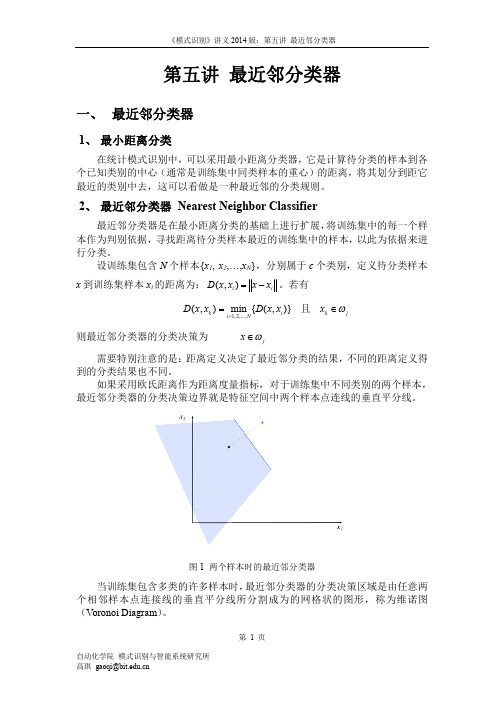

第五讲 最近邻分类器

一、 最近邻分类器

1、 最小距离分类

在统计模式识别中,可以采用最小距离分类器,它是计算待分类的样本到各 个已知类别的中心(通常是训练集中同类样本的重心)的距离,将其划分到距它 最近的类别中去,这可以看做是一种最近邻的分类规则。

2、 最近邻分类器 Nearest Neighbor Classifier

图 1 两个样本时的最近邻分类器

当训练集包含多类的许多样本时, 最近邻分类器的分类决策区域是由任意两 个相邻样本点连接线的垂直平分线所分割成为的网格状的图形,称为维诺图 (Voronoi Diagram) 。

模式识别(PPT)

第一章 模式识别概论

什么是模式(Pattern)?

什么是模式?

• 广义地说,存在于时间和空间中可观察的物 体,如果我们可以区别它们是否相同或是否 相似,都可以称之为模式。 • 模式所指的不是事物本身,而是从事物获得 的信息,因此,模式往往表现为具有时间和 空间分布的信息。 • 模式的直观特性:

结构模式识别

• 该方法通过考虑识别对象的各部分之间的联 系来达到识别分类的目的。 • 识别采用结构匹配的形式,通过计算一个匹 配程度值(matching score)来评估一个未知 的对象或未知对象某些部分与某种典型模式 的关系如何。 • 当成功地制定出了一组可以描述对象部分之 间关系的规则后,可以应用一种特殊的结构 模式识别方法 – 句法模式识别,来检查一个 模式基元的序列是否遵守某种规则,即句法 规则或语法。

实例:句法模式识别(续)

• 多级树描述结构

实例:句法模式识别(续)

• 训练过程:

– 用已知结构信息的图像作为训练样本,先 识别出基元(比如场景图中的X、Y、Z等 简单平面)和它们之间的连接关系(例如 长方体E是由X、Y和Z三个面拼接而成), 并用字母符号代表之; – 然后用构造句子的文法来描述生成这幅场 景的过程,由此推断出生成该场景的一种 文法。

模式识别

- 概念、原理及其应用

引 言

课程对象

• 计算机应用技术专业硕士研究生的专业 基础课 • 电子科学与技术学科硕士研究生的专业 基础课

与模式识别相关的学科

• • • •

• • • • •

统计学 概率论 线性代数(矩阵计算) 形式语言

机器学习 人工智能 图像处理 计算机视觉 …

教学方法

• 着重讲述模式识别的基本概念,基本方 法和算法原理。 • 注重理论与实践紧密结合

模式识别 :模式识别概述.ppt

2019/11/2

15

n

dij

| Xik Xjk |

k 1

② 欧几里德距离

dij

n Xik Xjk 2

k 1

③明考夫斯基距离

| | dij(q) n Xik Xjk q 1 q

k 1

其中当q=1时为绝对值距离,当q=2时为欧氏距离

2019/11/2

询,侦听,机器故障判断。

8. 军事应用

2019/11/2

9

§1-4 模式识别的基本问题

一.模式(样本)表示方法 1. 向量表示 : 假设一个样本有n个变量(特征)

Ⅹ= (X1,X2,…,Xn)T 2. 矩阵表示: N个样本,n个变量(特征)

变量

样本

x1

x2

X1

X11

X12

X2

X21

X22

…

…

…

XN

2019/11/2

11

4. 基元(链码)表示: 在右侧的图中八个基元 分别表示0,1,2,3, 4,5,6,7,八个方

向 和基元线段长度。 则右侧样本可以表示为

X1=006666

这种方法将在句法模式识 别中用到。

2019/11/2

12

二.模式类的紧致性

1. 紧致集:同一类模式类样本的分布比较 集中,没有或临界样本很少,这样的模 式类称紧致集。

16

④ 切比雪夫距离 dij() max | Xik Xjk | 1k n

q趋向无穷大时明氏距离的极限情况 ⑤ 马哈拉诺比斯距离

T

dij(M ) Xi Xj

1 Xi Xj

其中xi ,xj为特征向量, 为协方差。使用的条件是

第5章:模糊模式识别(高级运筹学-中南大学 徐选华)

( A, A)

1 1 [ A A (1 A A)] [1 (1 0)] 1 2 2

2、( A ,B ) = ( B ,A ) ≥ 0 3、 若 A B C ,即 x∈X ,A(x)≤ B(x)≤ C(x) 则 ( A ,C ) ≤ ( B ,C )

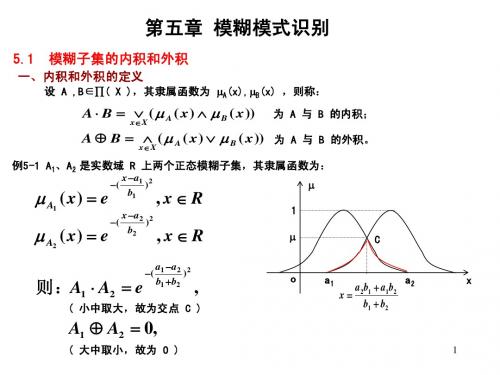

例5-1 A1、A2 是实数域 R 上两个正态模糊子集,其隶属函数为:

( x a1 2 ) b1

A ( x) e

1

,xR

1 C

A ( x) e

2

x a2 2 ( ) b2

,xR

a1 a2 2 ) b1 b2

则:A1 A2 e

(

,

o

a1

( 小中取大,故为交点 C )

B C B CT

0.1 0.2 (0.5,0.6,0.5,0.7,0.8) 0 0.1 0.2 0 0.3 0.4 0.4 0.3 0.4

5

例5-5 企业“经济效益好”这个模糊概念,在论域 “利润” 与论域 “费用” 上分别表现为模糊 向量: A = ( 0.5,0.9,0.3,0.2 ),B = ( 0.1,0.8,0.4 ), 则: “经济效益好”这个模糊概念,在两个论域 “利润” 与 “费用” 之间的转换关系为:

10

例5-10 识别三角形:取论域 U = {( A,B,C )| A + B + C = ,A≥B≥C≥0 }, 其中A,B,C为三角。 定义以下几个模糊子集,并给出其隶属函数: ① 近似等腰三角形 I: I ( A, B, C ) 1 ② 近似直角三角形 R: R ( A, B , C ) 1 ③ 近似正三角形 E:

模式识别讲义精品PPT课件

最大最小距离法

该算法以欧氏距离为基础,首 先辨识最远的聚类中心,然后确 定其他的聚类中心,直到无新的 聚类中心产生。最后将样本按最 小距离原则归入最近的类。

几个算法的简单对比:

k均值和最大最小距离是聚类型算法 而K近邻和感知器属于分类,聚类和 分类

K-means算法缺点主要是: 1. 对异常值敏感 2. 需要提前确定k值

11

11

11 11

11

00

模式识别

-------几种聚类和分类算法的比较

1 11 01 11

110101110101

01

01

10

01

11

01

10

01

K均值算法

k均值算法是什么?

k均值算法也称为C-均值算法,是根据函数准则进行分类 的聚类算法,基于使聚类准则最小化。

依据课本的介绍,它是聚类集中每一个样本点到该聚类 中心的距离平方和。

MATLAB

运行结果

感知器算法

What:

感知器算法通过赏罚原则依据每次对训练集的训练不断修正 判别函数的权向量,当分类器发生错误分类的时候对分类器 进行“罚”,即对权向量进行修改,当感知器正确分类的时 候对分类器进行“赏”,对全向量不进行修改。这样经过迭 代计算后,通过训练集的训练得到最优的判别函数的权向量。

1 11 01 11

110101110101

01

01

10

01

11

01

10

01

代码实现 C语言:

参考数据:

1 11 01 11

110101110101

01

01

10

01

11

01

10

01

模式识别第5章SVM

8

① 模式识别问题:使训练样本集错误率最低

的分类器。 ② 函数拟合问题:最小二乘

1 Remp ( ) N

2 ( y f ( x , )) i 1 N

③ 密度估计问题:最大似然方法

1 Remp ( ) N

log( p( x, ))

i 1

9

N

经验风险最小化方法的问题

小样本统计理论 模式识别方法:支持向量机(Support Vector Machine--

SVM)

4

5.1 机器学习的基本问题和方法

1、机器学习的基本模型:

输入x 系统(S) F(x,y) 学习机器(LM) f(x,ω),ω∈Ω 输出y

预测输出y’

S: 研究的对象 ;

LM: 所求的学习机器。

① 将函数集 {f(x,ω), ω ∈Ω }划

风 分成嵌套的子集结构: 险 S1 S2 … Sk … (各子集按照VC维的大小排列: h1≤ h2 ≤… ≤hk …, 同一个子集中的置信范围) ② 在子集中根据经验风险最小 选择最好的函数。 ③ 选择最小经验风险与置信范 围之和最小的子集。这个子 集中使经验风险最小的函数 即是最优函数。

n

P[sup | R( ) Remp ( ) | ] 0, 或: lim n

0

18

2、VC维

VC维:Vapnik-Chervonenkis Dimension

衡量函数集 f(x, ω) 的性能的指标,用于描述机器学习的复杂性。 用h表示,h是整数。 无计算方法;对特殊的函数,VC维可准确知道

有限样本下:

① 经验风险最小是否是期望风险最小? ② 如不能,经验风险最小化解决期望风险最小化的前提原

(完整word版)模式识别习题解答第五章全文

可编辑修改精选全文完整版题1:设有如下三类模式样本集ω1,ω2和ω3,其先验概率相等,求Sw 和Sb ω1:{(1 0)T, (2 0) T, (1 1) T} ω2:{(—1 0)T, (0 1) T , (-1 1) T}ω3:{(-1 -1)T , (0 -1) T , (0 -2) T }解:由于本题中有三类模式,因此我们利用下面的公式:b S =向量类模式分布总体的均值为C ,))()((00031m m m m m P t i i i i --∑=ω,即:i 31i i 0m )p(E{x }m ∑===ωi m 为第i 类样本样本均值⎪⎪⎪⎪⎭⎫⎝⎛=⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡⎪⎪⎪⎪⎭⎫ ⎝⎛+⎪⎪⎪⎪⎭⎫ ⎝⎛--+⎪⎪⎪⎪⎭⎫⎝⎛=⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡⎪⎭⎫ ⎝⎛--⎪⎪⎪⎪⎭⎫⎝⎛--+⎪⎭⎫⎝⎛-⎪⎪⎪⎪⎭⎫ ⎝⎛-+⎪⎭⎫ ⎝⎛⎪⎪⎪⎪⎭⎫ ⎝⎛=--=⎪⎪⎪⎪⎭⎫ ⎝⎛-=⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡-+--=⎪⎪⎪⎪⎭⎫⎝⎛--=⎥⎦⎤⎢⎣⎡---++-=⎪⎪⎪⎪⎭⎫ ⎝⎛-=⎥⎦⎤⎢⎣⎡++-+-=⎪⎪⎪⎪⎭⎫ ⎝⎛=⎥⎦⎤⎢⎣⎡++++=∑=81628113811381628112181448144811681498149814981498116814481448112131911949119497979797949119491131)m m )(m m ()(P S 919134323131323431m 343121100131m 323211010131m ;313410012131m t 0i 0i 31i i b10321ω;333t(i)(i)k k w i i i i i i i i 1i 11111S P()E{(x-m )(x-m )/}C [(x m )(x m )33361211999271612399279Tk ωω====•==--⎡⎤⎡⎤--⎢⎥⎢⎥==⎢⎥⎢⎥⎢⎥⎢⎥--⎢⎥⎢⎥⎣⎦⎣⎦∑∑∑题2:设有如下两类样本集,其出现的概率相等: ω1:{(0 0 0)T , (1 0 0) T , (1 0 1) T , (1 1 0) T }ω2:{(0 0 1)T , (0 1 0) T , (0 1 1) T , (1 1 1) T }用K-L 变换,分别把特征空间维数降到二维和一维,并画出样本在该空间中的位置.解:把1w 和2w 两类模式作为一个整体来考虑,故0 1 1 1 0 0 0 1 0 0 0 1 0 1 1 1 0 0 1 0 1 0 1 1x ⎛⎫ ⎪= ⎪ ⎪⎝⎭0.5{}0.50.5m E x ⎛⎫⎪== ⎪ ⎪⎝⎭协方差矩阵0.25 0 0{()()} 0 0.25 0 0 0 0.25x C E x m x m ⎛⎫ ⎪'=--= ⎪ ⎪⎝⎭从题中可以看出,协方差矩阵x C 已经是个对角阵,故x C 的本征值1230.25λλλ===其对应的本征向量为: 1231000,1,0001φφφ⎛⎫⎛⎫⎛⎫⎪ ⎪ ⎪=== ⎪ ⎪ ⎪ ⎪ ⎪ ⎪⎝⎭⎝⎭⎝⎭若要将特征空间维数降到二维,因本题中三个本征值均相等,所以可以任意选取两个本征向量作为变换矩阵,在这里我们取1φ和2φ,得到100100⎛⎫⎪Φ= ⎪ ⎪⎝⎭。